遥感图像空间分析技术

遥感图像空间分析技术

1、领域分析:

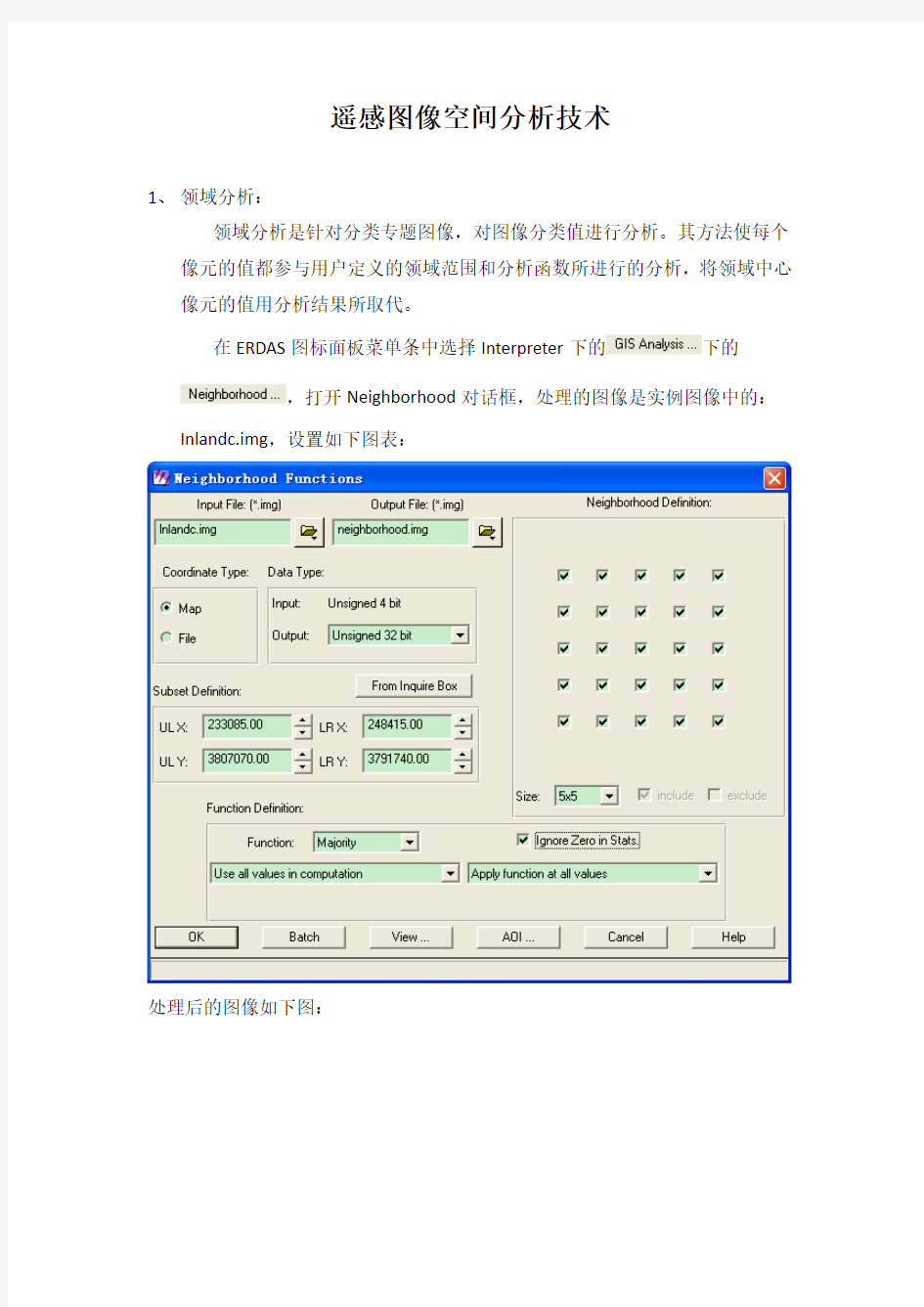

领域分析是针对分类专题图像,对图像分类值进行分析。其方法使每个像元的值都参与用户定义的领域范围和分析函数所进行的分析,将领域中心像元的值用分析结果所取代。

在ERDAS图标面板菜单条中选择Interpreter下的下的

,打开Neighborhood对话框,处理的图像是实例图像中的:Inlandc.img,设置如下图表:

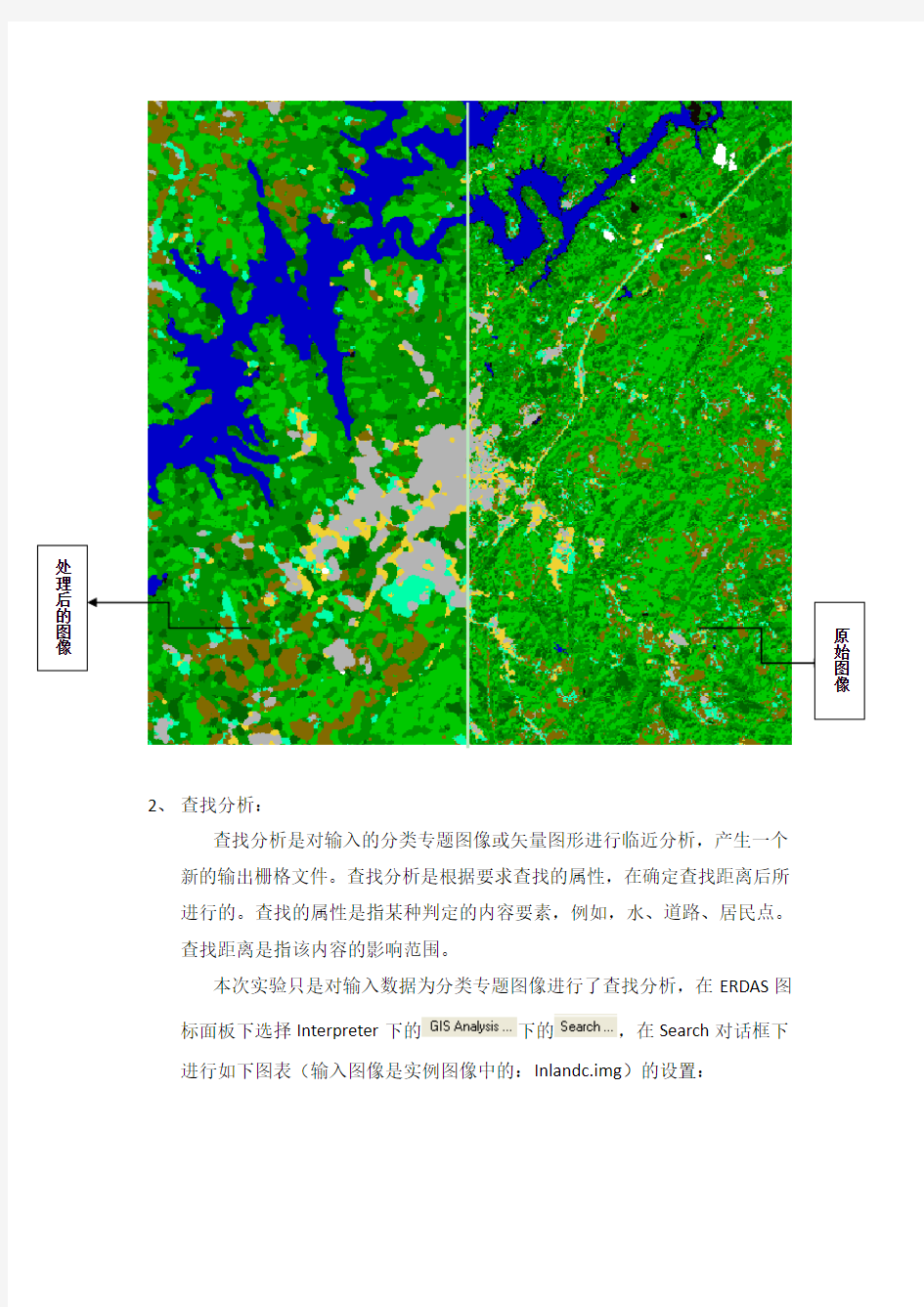

处理后的图像如下图:

2、 查找分析:

查找分析是对输入的分类专题图像或矢量图形进行临近分析,产生一个新的输出栅格文件。查找分析是根据要求查找的属性,在确定查找距离后所进行的。查找的属性是指某种判定的内容要素,例如,水、道路、居民点。查找距离是指该内容的影响范围。

本次实验只是对输入数据为分类专题图像进行了查找分析,在ERDAS 图标面板下选择Interpreter 下的下的,在Search 对话框下进行如下图表(输入图像是实例图像中的:Inlandc.img )的设置:

其中在属性表中可知,Classes为4的属性是水体,如下表:

所以经查找分析的图像如下:

原始图像查找分析后的图像

3、指标分析:

指标分析功能是将两个输入分类专题图像或矢量地图数据,按照用户定义的权重因子进行相加,产生一个新的综合图像文件。

在ERDAS图标面板工具条下点击Interpreter图标,选择

下的图标,在Index对话框中进行如下图表的设置(输入图像是实力图像中的Inslope.img图像与Insoil.img图像):

坡度分类专题图像土壤分类专题图像

指标分析后的图像

其中给坡度分类专题图像设置的权重因子是5,给土壤分类专题图像设置的权重因子是10,指标分析处理后的图像综合了坡度和土壤属性而得到。

指标分析中综合的类型并不一定只是两种,可以是多种因素进行综合,产生一幅综合图。

4、叠加分析:

叠加分析是根据两个输入分类图像文件或矢量图形文件数据的最小值或

最大值,产生一个新的综合图像文件。

在ERDAS图标面板工具条中点击Interpreter图标,选择

下的

,打开Overlay对话框设置的参数(输入图像是Inlandc.img与Input.img)如下图表:

输出图像与输入的两个图像相比较,如下图:

土地利用分类图道路交通分类图

输出图像

通过对两幅输入图像的对比,在输出图像中较明显的黑线应该是道路交通分类图像中的道路,也能很好的分辨出土壤专题分类图里表示清晰的河流,通过这种处理,使两幅分类图像的某些专题要素都能更好的表现出来。

5、归纳分析:

归纳分析功能可以根据两个输入分类专题图像产生一个双向统计表格,内容包括每个Zone类型区域内所有Class类型的像元数量及其面积百分比等统计值,可用于一定区域内多种专题数据相互关系的栅格叠加统计分析。

在ERDAS图标面板工具条中点击Interpreter下的下的,打开Summary对话框设置如下图标的参数:

本次实验的输出结果产生一个以土地利用类型为分区、以坡度为分类的统计表格,即每种土地利用类型上各个坡度的像元总数、百分比和面积的统计结果,表现了每种土地利用类型的坡度情况。如用不同年代的同一地点的土地利用分类图像进行归纳分析就可以算出某类要素变化情况,可以得出很好的比较效果。如下是,输出的文本文件:

关于图像特征提取

关于图像特征提取 特征提取是计算机视觉和图像处理中的一个概念。它指的是使用计算机提取图像信息,决定每个图像的点是否属于一个图像特征。特征提取的结果是把图像上的点分为不同的子集,这些子集往往属于孤立的点、连续的曲线或者连续的区域。 特征的定义 至今为止特征没有万能和精确的定义。特征的精确定义往往由问题或者应用类型决定。特征是一个数字图像中“有趣”的部分,它是许多计算机图像分析算法的起点。因此一个算法是否成功往往由它使用和定义的特征决定。因此特征提取最重要的一个特性是“可重复性”:同一场景的不同图像所提取的特征应该是相同的。 特征提取是图象处理中的一个初级运算,也就是说它是对一个图像进行的第一个运算处理。它检查每个像素来确定该像素是否代表一个特征。假如它是一个更大的算法的一部分,那么这个算法一般只检查图像的特征区域。作为特征提取的一个前提运算,输入图像一般通过高斯模糊核在尺度空间中被平滑。此后通过局部导数运算来计算图像的一个或多个特征。 有时,假如特征提取需要许多的计算时间,而可以使用的时间有限制,一个高层次算法可以用来控制特征提取阶层,这样仅图像的部分被用来寻找特征。 由于许多计算机图像算法使用特征提取作为其初级计算步骤,因此有大量特征提取算法被发展,其提取的特征各种各样,它们的计算复杂性和可重复性也非常不同。 边缘 边缘是组成两个图像区域之间边界(或边缘)的像素。一般一个边缘的形状可以是任意的,还可能包括交叉点。在实践中边缘一般被定义为图像中拥有大的梯度的点组成的子集。一些常用的算法还会把梯度高的点联系起来来构成一个更完善的边缘的描写。这些算法也可能对边缘提出一些限制。 局部地看边缘是一维结构。 角 角是图像中点似的特征,在局部它有两维结构。早期的算法首先进行边缘检测,然后分析边缘的走向来寻找边缘突然转向(角)。后来发展的算法不再需要边缘检测这个步骤,而是可以直接在图像梯度中寻找高度曲率。后来发现这样有时可以在图像中本来没有角的地方发现具有同角一样的特征的区域。 区域 与角不同的是区域描写一个图像中的一个区域性的结构,但是区域也可能仅由一个像素组成,因此许多区域检测也可以用来监测角。一个区域监测器检测图像中一个对于角监测器来说太平滑的区域。区域检测可以被想象为把一张图像缩小,然后在缩小的图像上进行角检测。 脊 长条形的物体被称为脊。在实践中脊可以被看作是代表对称轴的一维曲线,此外局部针对于每个脊像素有一个脊宽度。从灰梯度图像中提取脊要比提取边缘、角和区域困难。在空中摄影中往往使用脊检测来分辨道路,在医学图像中它被用来分辨血管。 特征抽取 特征被检测后它可以从图像中被抽取出来。这个过程可能需要许多图像处理的计算机。其结果被称为特征描述或者特征向量。 常用的图像特征有颜色特征、纹理特征、形状特征、空间关系特征。 一颜色特征 (一)特点:颜色特征是一种全局特征,描述了图像或图像区域所对应的景物的表面性质。一般颜色特征是基于像素点的特征,此时所有属于图像或图像区域的像素都有各自的贡献。由于颜色对图像或图像区域的方向、大小等变化不敏感,所以颜色特征不能很好地捕捉图像中对象的局部特征。另外,仅使用颜色特

6-遥感图像特征和解译标志

上次课主要内容 4.4简单自然地物可识别性分析 4.5复杂地物识别概率(重点理解) ①要素t 的价值②要素总和(t 1,t 2,…,t m )t 的价值 K -K E ∑ = ③复杂地物识别概率的计算理解p70~71例子

第五章遥感图像特征和解译标志 5.1 解译标志的定义和分类 5.2 遥感图像特征与解译标志的关系 5.3 遥感图像的时空特性 5.4 遥感图像中的独立变量 5.5 地物统计特征的构造

第五章遥感图像特征和解译标志 地物特征 电磁波特性 影像特征 遥感图像记录过程 n 图像解译就是建立在研究地物性质、电磁波性质 及影像特征三者的关系之上 n 图像要素或特征,分“色”和“形”两大类:?色:色调、颜色、阴影、反差; ?形:形状、大小、空间分布、纹理等。“形”只有依靠“色”来解译才有意义。

第五章遥感图像特征和解译标志 5.1 解译标志的定义和分类 n两个定义: ?解译标志定义:遥感图像光谱、辐射、空间和时间特征决定 图像的视觉效果、表现形式和计算特点,并导致物体在图像上 的差别。 l给出了区分遥感图像中物体或现象的可能性; l解译标志包括:色调与色彩、形状、尺寸、阴影、细部(图 案)、以及结构(纹理)等; l解译标志是以遥感图像的形式传递的揭示标志; ?揭示标志定义:在目视观察时借以将物体彼此分开的被感知 对象的典型特征。 l揭示标志包括:形状、尺寸、细部、光谱辐射特性、物体的阴 影、位置、相互关系和人类活动的痕迹; l揭示标志的等级决定于物体的性质、他们的相对位置及与周围 环境的相互作用等;

第五章遥感图像特征和解译标志 5.1 解译标志的定义和分类 n解译标志和揭示标志的关系: ?解译标志是以遥感图像的形式传递的揭示标志; ?虽然我们是通过遥感图像识别地物目标的,但是大多数情况 下,基于遥感图像识别地物并作出决定时,似乎并不是利用解 译标志,而是利用揭示标志。 例如,很多解译人员刚看到图像就差不多在脑海中形成地物的形象, 然后仅仅分析这个形象就能作出一定的决定。实际上,有经验的解译人 员,在研究图像的解译标志并估计到传递信息的传感系统的影响以后, 思想中就建立起地物的揭示标志,并在这些标志的基础上识别被感知物 体。解译人员在实地或图像上都没见过的地物或现象是例外。 n解译标志和揭示标志可以按两种方式进行划分:?直接标志和间接标志; ?永久标志和临时标志;

多聚焦图像融合方法综述

多聚焦图像融合方法综述 摘要:本文概括了多聚焦图像融合的一些基本概念和相关知识。然后从空域和频域两方面将多聚焦图像融合方法分为两大块,并对这两块所包含的方法进行了简单介绍并对其中小波变换化法进行了详细地阐述。最后提出了一些图像融合方法的评价方法。 关键词:多聚焦图像融合;空域;频域;小波变换法;评价方法 1、引言 按数据融合的处理体系,数据融合可分为:信号级融合、像素级融合、特征级融合和符号级融合。图像融合是数据融合的一个重要分支,是20世纪70年代后期提出的概念。该技术综合了传感器、图像处理、信号处理、计算机和人工智能等现代高新技术。它在遥感图像处理、目标识别、医学、现代航天航空、机器人视觉等方面具有广阔的应用前景。 Pohl和Genderen将图像融合定义为:“图像融合是通过一种特定的方法将两幅或多幅图像合成一幅新图像”,其主要思想是采用一定的方法,把工作于不同波长范围、具有不同成像机理的各种成像传感器对同一场景成像的多幅图像信息合成一幅新的图像。 作为图像融合研究重要内容之一的多聚焦图像融合,是指把用同一个成像设备对某一场景通过改变焦距而得到的两幅或多幅图像中清晰的部分组合成一幅新的图像,便于人们观察或计算机处理。图像融合的方法大体可以分为像素级、特征级、决策级3中,其中,像素级的图像融合精度较高,能够提供其他融合方法所不具备的细节信息,多聚焦融合采用了像素级融合方法,它主要分为空域和频域两大块,即: (1)在空域中,主要是基于图像清晰部分的提取,有梯度差分法,分块法等,其优点是速度快、方法简单,不过融合精确度相对较低,边缘吃力粗糙; (2)在频域中,具有代表性的是分辨方法,其中有拉普拉斯金字塔算法、小波变换法等,多分辨率融合精度比较高,对位置信息的把握较好,不过算法比较复杂,处理速度比较慢。 2、空域中的图像融合 把图像f(x,y)看成一个二维函数,对其进行处理,它包含的算法有逻辑滤波器法、加权平均法、数学形态法、图像代数法、模拟退火法等。 2.1 逻辑滤波器法 最直观的融合方法是两个像素的值进行逻辑运算,如:两个像素的值均大于特定的门限值,

图像颜色特征提取原理

一、颜色特征 1 颜色空间 1.1 RGB 颜色空间 是一种根据人眼对不同波长的红、绿、蓝光做出锥状体细胞的敏感度描述的基础彩色模式,R、 G、B 分别为图像红、绿、蓝的亮度值,大小限定在 0~1 或者在 0~255。 1.2 HIS 颜色空间 是指颜色的色调、亮度和饱和度,H表示色调,描述颜色的属性,如黄、红、绿,用角度 0~360度来表示;S 是饱和度,即纯色程度的量度,反映彩色的浓淡,如深红、浅红,大小限定在 0~1;I 是亮度,反映可见光对人眼刺激的程度,它表征彩色各波长的总能量,大小限定在 0~1。 1.3 HSV 颜色模型 HSV 颜色模型依据人类对于色泽、明暗和色调的直观感觉来定义颜色, 其中H (Hue)代表色度, S (Saturat i on)代表色饱和度,V (V alue)代表亮度, 该颜色系统比RGB 系统更接近于人们的经验和对彩色的感知, 因而被广泛应用于计算机视觉领域。 已知RGB 颜色模型, 令M A X = max {R , G, B },M IN =m in{R , G,B }, 分别为RGB 颜色模型中R、 G、 B 三分量的最大和最小值, RGB 颜色模型到HSV 颜色模型的转换公式为: S =(M A X - M IN)/M A X H = 60*(G- B)/(M A X - M IN) R = M A X 120+ 60*(B – R)/(M A X - M IN) G= M A X 240+ 60*(R – G)/(M A X - M IN) B = M A X V = M A X 2 颜色特征提取算法 2.1 一般直方图法 颜色直方图是最基本的颜色特征表示方法,它反映的是图像中颜色的组成分布,即出现了哪些颜色以及各种颜色出现的概率。其函数表达式如下: H(k)= n k/N (k=0,1,…,L-1) (1) 其中,k 代表图像的特征取值,L 是特征可取值的个数,n k是图像中具有特征值为 k 的象素的个数,N 是图像象素的总数。由上式可见,颜色直方图所描述的是不同色彩在整幅图像中所占的比例,无法描述图像中的对象或物体,但是由于直方图相对于图像以观察轴为轴心的旋转以及幅度不大的平移和缩放等几何变换是不敏感的,而且对于图像质量的变化也不甚敏感,所以它特别适合描述那些难以进行自动分割的图像和不需要考虑物体空间位置的图像。 由于计算机本身固有的量化缺陷,这种直方图法忽略了颜色的相似性,人们对这种算法进行改进,产生了全局累加直方图法和局部累加直方图法。 2.2 全局累加直方图法 全局累加直方图是以颜色值作为横坐标,纵坐标为颜色累加出现的频数,因此图像的累加直方空间 H 定义为:

遥感数字图像处理要点

遥感数字图像处理-要点 1.概论 遥感、遥感过程 遥感图像、遥感数字图像、遥感图像的数据量 遥感图像的数字化、采样和量化 通用遥感数据格式(BSQ、BIL、BIP) 遥感图像的模型:多光谱空间 遥感图像的信息内容: 遥感数字图像处理、遥感数字图像处理的内容 遥感图像的获取方式主要有哪几种? 如何估计一幅遥感图像的存储空间大小? 遥感图像的信息内容包括哪几个方面? 多光谱空间中,像元点的坐标值的含义是什么? 与通用图像处理技术比较,遥感数字图像处理有何特点? 遥感数字图像处理包括那几个环节?各环节的处理目的是什么? 2.遥感图像的统计特征 2.1图像空间的统计量 灰度直方图:概念、类型、性质、应用 最大值、最小值、均值、方差的意义 2.2多光谱空间的统计特征 均值向量、协方差矩阵、相关系数、相关矩阵的概念及意义 波段散点图概念及分析 主要遥感图像的统计特征量的意义 两个重要的图像分析工具:直方图、散点图 3.遥感数字图像增强处理 图像增强:概念、方法 空间域增强、频率域增强

3.1辐射增强:概念、实现原理 直方图修正,线性变换、分段线性变换算法原理 直方图均衡化、直方图匹配的应用 3.2空间增强 邻域、邻域运算、模板、模板运算 空间增强的概念 平滑(均值滤波、中值滤波)原理、特点、应用 锐化、边缘增强概念 方向模板、罗伯特算子、索伯尔算子、拉普拉斯算子的算法和特点 ?计算图像经过下列操作后,其中心象元的值: –3×3中值滤波 –采用3×3平滑图像的减平滑边缘增强 –域值为2的3×1平滑模板 –Sobel边缘检测 –Roberts边缘检测 –模板 3.3频率域处理 高频和低频的意义 图像的傅里叶频谱 频率域增强的一般过程 频率域低通滤波 频率域高通滤波 同态滤波的应用

遥感图像分析与处理试题答案

遥感图像处理与分析作业 一、名词解释 1.辐射亮度:辐射源在某一方向的单位投影表面在单位立体角内的辐射通量。 2.光谱反射率:被物体反射的光通量与入射到物体的光通量之比。 3.合成孔径雷达:合成孔径雷达就是利用雷达与目标的相对运动把尺寸较小的真实天线孔径用数据处理的方法合成一较大的等效天线孔径的雷达。利用遥感平台的移动,将一个小孔径的天线安装在平台侧方,以代替大孔径的天线,提高方位分辨率的雷达。 4.假彩色遥感图像:根据加色法合成原理,选择遥感影像的某三个波段分别赋予红、绿、蓝三种原色,就可以合成彩色影像。 5.大气窗口:由于大气层的反射、散射和吸收作用,使得太阳辐射的各波段受到衰减的作用轻重不同,因而各波段的透射率也各不相同。把受到大气衰减作用较轻、透射率较高的波段叫大气窗口 6.图像空间分辨率:指像素所代表的地面范围的大小,即扫描仪的瞬时视场,或地面物体能分辨的最小单元。 7.NDVI: (Normal Differential Vegetation Index)归一化植被指数。被定义为近红外波与可见光红波段图像灰度值之差和这两个波段图像灰度值之和的比值。 8.像点位移:地形的起伏和投影面的倾斜会引起航片上像点的位置的变化,叫像点位移。 9.后向散射:在两个均匀介质的分界面上,当电磁波从一个介质中入射时,会在分界面上产生散射,这种散射叫做表面散射。在表面散射中,散射面的粗糙度是非常重要的,所以在不是镜面的情况下必须使用能够计算的量来衡量。通常散射截面积是入射方向和散射方向的函数,而在合成孔径雷达及散射计等遥感器中,所观测的散射波的方向是入射方向,这个方向上的散射就称作后向散射。 10.大气校正:大气校正就是指消除由大气散射引起的辐射误差的处理过程。 11.漫反射:当一束平行的入射光线射到粗糙的表面时,表面会把光线向着四面八方反射,所以入射线虽然互相平行,由于各点的法线方向不一致,造成反射光线向不同的方向无规则地反射,这种反射称之为“漫反射”或“漫射”。 12.中心投影:把光由一点向外散射形成的投影,叫做中心投影。 13.瞬时视场角:扫描镜在一瞬时时间可以视为静止状态,此时接收到的目标地物的电磁波辐射,限制在一个很小的角度之内,这个角度称为瞬时视场角。 14.亮度温度:若实际物体在某一波长下的光辐射度 (即光谱辐射亮度) 与绝对黑体在同一波长下的光谱辐射度相等,则黑体的温度被称为实际物体在该波长下的亮度温度。 15.红外遥感:(infrared remote sensing)是指传感器工作波段限于红外波段范围之内的遥感。探测波段一般在0.76——1000微米之间。是应用红外遥感器(如红外摄影机、红外扫描仪)探测远距离外的植被等地物所反射或辐射红外特性差异的信息,以确定地面物体性质、状态和变化规律的遥感技术。 二、简述题

图像融合的研究背景和研究意义

图像融合的研究背景和研究意义 1概述 2 图像融合的研究背景和研究意义 3图像融合的层次 像素级图像融合 特征级图像融合 决策级图像融合 4 彩色图像融合的意义 1概述 随着现代信息技术的发展,图像的获取己从最初单一可见光传感器发展到现在的雷达、高光谱、多光谱红外等多种不同传感器,相应获取的图像数据量也急剧增加。由于成像原理不同和技术条件的限制,任何一个单一图像数据都不能全面反应目标对象的特性,具有一定的应用范围和局限性。而图像融合技术是将多种不同特性的图像数据结合起来,相互取长补短便可以发挥各自的优势,弥补各自的不足,有可能更全面的反映目标特性,提供更强的信息解译能力和可靠的分析结果。图像融合不仅扩大了各图像数据源的应用范围,而且提高了分析精度、应用效果和使用价值,成为信息领域的一个重要的方向。图像配准是图像融合的重要前提和基础,其误差的大小直接影响图像融合结果的有效性。 作为数据融合技术的一个重要分支,图像融合所具有的改善图像质量、提高几何配准精度、生成三维立体效果、实现实时或准实时动态监测、克服目标提取与识别中图像数据的不完整性等优点,使得图像融合在遥感观测、智能控制、无损检测、智能机器人、医学影像(2D和3D)、制造业等领域得到广泛的应用,成为当前重要的信息处理技术,迅速发展的军事、医学、自然资源勘探、环境和土地、海洋资源利用管理、地形地貌分析、生物学等领域的应用需求更有力地刺激了图像融合技术的发展。 2 图像融合的研究背景和研究意义 Pohl和Genderen对图像融合做了如下定义:图像融合就是通过一种特定算法将两幅或多幅图像合成为一幅新图像。它的主要思想是采用一定的算法,把

图像特征提取总结

图像常见特征提取方法简介 常用的图像特征有颜色特征、纹理特征、形状特征、空间关系特征。 一、颜色特征 (一)特点:颜色特征是一种全局特征,描述了图像或图像区域所对应的景物的表面性质。一般颜色特征是基于像素点的特征,此时所有属于图像或图像区域的像素都有各自的贡献。由于颜色对图像或图像区域的方向、大小等变化不敏感,所以颜色特征不能很好地捕捉图像中对象的局部特征。另外,仅使用颜色特征查询时,如果数据库很大,常会将许多不需要的图像也检索出来。颜色直方图是最常用的表达颜色特征的方法,其优点是不受图像旋转和平移变化的影响,进一步借助归一化还可不受图像尺度变化的影响,基缺点是没有表达出颜色空间分布的信息。 (二)常用的特征提取与匹配方法 (1)颜色直方图 其优点在于:它能简单描述一幅图像中颜色的全局分布,即不同色彩在整幅图像中所占的比例,特别适用于描述那些难以自动分割的图像和不需要考虑物体空间位置的图像。其缺点在于:它无法描述图像中颜色的局部分布及每种色彩所处的空间位置,即无法描述图像中的某一具体的对象或物体。 最常用的颜色空间:RGB颜色空间、HSV颜色空间。 颜色直方图特征匹配方法:直方图相交法、距离法、中心距法、参考颜色表法、累加颜色直方图法。 (2)颜色集 颜色直方图法是一种全局颜色特征提取与匹配方法,无法区分局部颜色信息。颜色集是对颜色直方图的一种近似首先将图像从RGB颜色空间转化成视觉均衡的颜色空间(如HSV 空间),并将颜色空间量化成若干个柄。然后,用色彩自动分割技术将图像分为若干区域,每个区域用量化颜色空间的某个颜色分量来索引,从而将图像表达为一个二进制的颜色索引集。在图像匹配中,比较不同图像颜色集之间的距离和色彩区域的空间关系 (3)颜色矩 这种方法的数学基础在于:图像中任何的颜色分布均可以用它的矩来表示。此外,由于颜色分布信息主要集中在低阶矩中,因此,仅采用颜色的一阶矩(mean)、二阶矩(variance)和三阶矩(skewness)就足以表达图像的颜色分布。 (4)颜色聚合向量 其核心思想是:将属于直方图每一个柄的像素分成两部分,如果该柄内的某些像素所占据的连续区域的面积大于给定的阈值,则该区域内的像素作为聚合像素,否则作为非聚合像素。(5)颜色相关图 二纹理特征 (一)特点:纹理特征也是一种全局特征,它也描述了图像或图像区域所对应景物的表面性质。但由于纹理只是一种物体表面的特性,并不能完全反映出物体的本质属性,所以仅仅利用纹理特征是无法获得高层次图像内容的。与颜色特征不同,纹理特征不是基于像素点的特征,它需要在包含多个像素点的区域中进行统计计算。在模式匹配中,这种区域性的特征具有较大的优越性,不会由于局部的偏差而无法匹配成功。作为一种统计特征,纹理特征常具有旋转不变性,并且对于噪声有较强的抵抗能力。但是,纹理特征也有其缺点,一个很明显的缺点是当图像的分辨率变化的时候,所计算出来的纹理可能会有较大偏差。另外,由于有可能受到光照、反射情况的影响,从2-D图像中反映出来的纹理不一定是3-D物体表面真实

ENVI中的融合方法

ENVI下的图像融合方法 图像融合是将低空间分辨率的多光谱影像或高光谱数据与高空间分辨率的单波段影像重采样生成成一副高分辨率多光谱影像遥感的图像处理技术,使得处理后的影像既有较高的空间分辨率,又具有多光谱特征。图像融合的关键是融合前两幅图像的精确配准以及处理过程中融合方法的选择。只有将两幅融合图像进行精确配准,才可能得到满意的结果。对于融合方法的选择,取决于被融合图像的特征以及融合目的。 ENVI中提供融合方法有: ?HSV变换 ?Brovey变换 这两种方法要求数据具有地理参考或者具有相同的尺寸大小。RGB输入波段必须为无符号8bit数据或者从打开的彩色Display中选择。 这两种操作方法基本类似,下面介绍Brovey变换操作过程。 (1)打开融合的两个文件,将低分辨率多光谱图像显示在Display中。 (2)选择主菜单-> Transform -> Image Sharpening->Color Normalized (Brovey),在Select Input RGB对话框中,有两种选择方式:从可用波段列表中和从Display窗口中,前者要求波段必须为无符号8bit。 (3)选择Display窗口中选择RGB,单击OK。 (4) Color Normalized (Brovey)输出面板中,选择重采样方式和输入文件路径及文件名,点击OK输出结果。 对于多光谱影像,ENVI利用以下融合技术: ?Gram-Schmidt ?主成分(PC)变换 ?color normalized (CN)变换 ?Pan sharpening 这四种方法中,Gram-Schmidt法能保持融合前后影像波谱信息的一致性,是一种高保真的遥感影像融合方法;color normalized (CN)变换要求数据具有中心波长和FWHM,;Pansharpening融合方法需要在ENVI Zoom中启动,比较适合高分辨率影像,如QuickBird、IKONOS等。 这四种方式操作基本类似,下面介绍参数相对较多的Gram-Schmidt操作过程。 (1)打开融合的两个文件。

图像特征提取及识别过程

纹理特征是一种重要的视觉线索,是图像中普遍存在而又难以描述的特征。纹理分类与分割是图像处理领域一个经久不衰的热点研究领域,纹理特征提取作为纹理分类与分割的首要问题,一直是人们关注的焦点,各种纹理特征提取方法层出不穷。 本文在广泛文献调研的基础上,回顾了纹理特征提取方法的发展历程,分析了其研究现状,对纹理特征提取方法进行了较为全面的综述和分类,最后重点研究了基于灰度共生矩阵的图像纹理提取方法,研究如何有效地提取图像纹理特征来对图像进行描述,通过特征值来对图像进行识别。 灰度共生矩阵是一种简单有效的图像纹理特征描述方法,该方法的优势在于:它能利用了图像中像素相对位置的空间信息更加准确地描述图像的纹理,本 文就是利用图像灰度共生矩阵的这一特性,从该矩阵中提取相应的统计参量作为纹理特征来实现对图像的识别。 关键字:灰度共生矩阵,纹理特征提取,图像识别

ABSTRACT Texture is a kind of importa nt visual clues in images , it is widespread but cannot easy to be described . Texture classification and segmentation is a enduring popular research field in image process ing area. Texture feature extract ion has bee n the focus of attention,due to its priority to texture classification and image segmentation. all sorts of texture feature extracti on methods has bee n emerged in en dlessly. On the basis of exte nsive literature inv estigati on, we review the texture feature extract ion methods, an alyze the developme nt of the research status of the texture feature extracti on methods and make a comprehe nsive review of its classificati on . Fin ally ,based on gray symbiotic matrix image problem extracti on methods,we research how to effectively extract image texture feature described by the image characteristic value to image recog niti on. Graylevel co-occurre nee matrix is a simple and effective image texture descripti on method.This method's advantage is: it can use the image pixels relative positions of the spatial in formatio n more to accurately describe the texture image.This paper use the graylevel co-occurre nee matrix of the properties to extract statistics from the matrix corresp onding as texture feature parameters to realize image recog niti on. KEY WORDS : graylevel co-occurrenee matrix, texture feature extraction, image recog niti on

流行的遥感图像处理软件比较

遥感软件 PCI遥感图像处理软件简介 PCI GEOMATICA是PCI公司将其旗下的四个主要产品系列,也就是PCI EASI/PACE、(PCI SPANS,PAMAPS)、ACE、ORTHOENGINE,集成到一个具有同一界面、同一使用规则、同一代码库、同一开发环境的一个新产品系列,该产品系列被称之为 PCI GEOMATICA。对于20多年来一直致力于向地学界提供全方位解决方案的PCI公司来说,始终坚持领先一步的原则,地理咨讯永远在变迁,而地理咨讯软件更处于变迁的前沿。在今天,随着用户需求广度与深度的不断拓宽与加深,越来越多的人希望软件是一个可以满足用户所有需求的良好的工具。由于对这一点的正确把握,经过4年努力,PCI公司将原有的四个产品系列整合在一起,产生了一个使用简单、灵巧的工作平台----PCI GEOMAITCA。该系列产品在每一级深度层次上,尽可能多的满足该层次用户对遥感影像处理、摄影测量、GIS空间分析、专业制图功能的需要,而且使用户可以方便地在同一个应用界面下,完成他们的工作。在这之前,用户需用多个软件来实现,并且需要面对多个软件经销商、多个软件技术支持、多次的培训、对多个软件的维护,以及不得不投入相当大的精力来在多种数据格式间,进行数据转换。产品模块功能介绍 PCI Geomatica FreeView ( PCI地理咨讯通用视窗) FreeView是PCI公司为用户提供的一个免费的影像浏览工具,用户可以从PCI的网址上直接下载。用于浏览、显示各种数据,如矢量、位图、卫星影像(如LANDSAT, SPOT, RADARSAT, ERS-1/2, NOAA A VHRR等)、航片以及与GIS矢量数据叠加显示、进行属性查询等。FreeView 还具有影像增强,任意漫游、缩放、影像灰度值矩阵显示等功能 PCI Geomatica GeoGateway (PCI通用数据转换工具)PCI Geomatica GeoGateway包含PCI Geomatica FreeView的所有功能。 PCI Geomatica Fundamentals (PCI 地理咨讯基础版) PCI Geomatica Fundamentals包含PCI Geomatica GeoGateway的所有功能。主要包括以下部件: Focus 浏览环境 OrthoEngine FLY!(演示模式)软件许可管理器 PCI Geomatica Prime (PCI地理咨讯专业版) PCI Geomatica Prime包含PCI Geomatica Fundamentals(见上一节)的所有功能。此外,增加了PCI Modeler、EASI、FLY!、算法库等模块。 Geomatica Prime 是强大的、低成本解决方案,提供的工具可用于影像几何校正、数据可视化与分析以及专业标准地图生产。 PCI Productivity Tools (PCI地理咨讯生产工具)该软件是PCI公司为了提高PCI软件的生产能力和效率而专门设计的,其主要功能是为用户提供一系列自动或批处理操作的导向功能。该软件是PCI GEOMATICA PRIME或FUNDAMENTALS功能的扩展。主要提供影像自动镶嵌功能及针对ORTHOENGINE 系列产品的航片,光学卫星影像,雷达卫星的自动同名点收集功能。同时提供影像控制点库及库管理功能。 PCI AIRPHOTO MODEL (PCI地理咨讯系统航空正射影像处理器)是一个与PCI Geomatica Fundamentals或Geomatica Prime模块一起使用的功能强大的航空照片正射校正工具。该模块运用了特殊的算法模型将已经扫描的或由数字摄像机得到的照片制作成精确的正射影像图。所生成的图像可以转化为多种文件形式,作为许多GIS/CAD/MAP软件的数据源。同时用户可选择附加的DEM自动提取、3DVIEW 和三维特征提取模块(OrthoEngine Airphoto DEM)来构造自己的数字摄影测量软件包。该软件具有如下功能:项目工程文件建立(含

三种图像融合方法实际操作与分析

摘要:介绍了遥感影像三种常用的图像融合方式。进行实验,对一幅具有高分辨率的SPOT全色黑白图像与一幅具有多光谱信息的SPOT图像进行融合处理,生成一幅既有高分辨率又有多光谱信息的图像,简要分析比较三种图像融合方式的各自特点,择出本次实验的最佳融合方式。 关键字:遥感影像;图像融合;主成分变换;乘积变换;比值变换;ERDAS IMAGINE 1. 引言 由于技术条件的限制和工作原理的不同,任何来自单一传感器的信息都只能反映目标的某一个或几个方面的特征,而不能反应出全部特征。因此,与单源遥感影像数据相比,多源遥感影像数据既具有重要的互补性,也存在冗余性。为了能更准确地识别目标,必须把各具特色的多源遥感数据相互结合起来,利用融合技术,针对性地去除无用信息,消除冗余,大幅度减少数据处理量,提高数据处理效率;同时,必须将海量多源数据中的有用信息集中起来,融合在一起,从多源数据中提取比单源数据更丰富、更可靠、更有用的信息,进行各种信息特征的互补,发挥各自的优势,充分发挥遥感技术的作用。[1] 在多源遥感图像融合中,针对同一对象不同的融合方法可以得到不同的融合结果,即可以得到不同的融合图像。高空间分辨率遥感影像和高光谱遥感影像的融合旨在生成具有高空间分辨率和高光谱分辨率特性的遥感影像,融合方法的选择取决于融合影像的应用,但迄今还没有普适的融合算法能够满足所有的应用目的,这也意味着融合影像质量评价应该与具体应用相联系。[2] 此次融合操作实验是用三种不同的融合方式(主成分变换融合,乘积变换融合,比值变换融合),对一幅具有高分辨率的SPOT全色黑白图像与一幅具有多

光谱信息的SPOT图像进行融合处理,生成一幅既有高分辨率又有多光谱信息的图像。 2. 源文件 1 、 imagerycolor.tif ,SPOT图像,分辨率10米,有红、绿、两个红外共四个波段。 2 、imagery-5m.tif ,SPOT图像,分辨率5米。 3. 软件选择 在常用的四种遥感图像处理软件中,PCI适合用于影像制图,ENVI在针对像元处理的信息提取中功能最强大,ER Mapper对于处理高分辨率影像效果较好,而ERDAS IMAGINE的数据融合效果最好。[3] ERDAS IMAGINE是美国Leica公司开发的遥感图像处理系统。它以其先进的图像处理技术,友好、灵活的用户界面和操作方式,面向广阔应用领域的产品模块,服务于不同层次用户的模型开发工具以及高度的RS/GIS(遥感图像处理和地理信息系统)集成功能,为遥感及相关应用领域的用户提供了内容丰富而功能强大的图像处理工具。 2012年5月1日,鹰图发布最新版本的ERDAS IMAGINE,所有ERDAS 2011软件用户都可以从官方网站上下载最新版本 ERDAS IMAGINE 11.0.5. 新版本包括之前2011服务包的一些改变。相比之前的版本,新版本增加了更多ERDAS IMAGINE和GeoMedia之间的在线联接、提供了更为丰富的图像和GIS产品。用户使用一个单一的产品,就可以轻易地把两个产品结合起来构建一个更大、更清

图像特征提取综述

图像特征提取的定位是计算机视觉和图像处理里的一个概念,表征图像的特性。输入是一张图像(二维的数据矩阵),输出是一个值、一个向量、一个分布、一个函数或者是信号。提取特征的方法千差万别,下面是图像特征的一些特性: 边缘 边缘是两个区域边界的像素集合,本质上是图像像素的子集,能将区域分开。边缘形状是任意的,实践中定义为大的梯度的像素点的集合,同时为了平滑,还需要一些算法进行处理。角 顾名思义,有个突然较大的弧度。早起算法是在边缘检测的基础上,分析边缘的走向,如果突然转向则被认为是角。后来的算法不再需要边缘检测,直接计算图像梯度的高度曲率(合情合理)。但会出现没有角的地方也检测到角的存在。 区域 区域性的结构,很多区域检测用来检测角。区域检测可以看作是图像缩小后的角检测。 脊 长形的物体,例如道路、血管。脊可以看成是代表对称轴的一维曲线,每个脊像素都有脊宽度,从灰梯度图像中提取要比边缘、角和区域都难。 特征提取 检测到特征后提取出来,表示成特征描述或者特征向量。 常用的图像特征:颜色特征、 纹理特征 形状特征 空间关系特征。 1.颜色特征 1.1特点:颜色特征是全局特征,对区域的方向、大小不敏感,但是不能很好捕捉局部特征。 优点:不受旋转和平移变化的影响,如果归一化不受尺度变化的影响。 缺点:不能表达颜色空间分布的信息。 1.2特征提取与匹配方法 (1)颜色直方图 适用于难以自动分割的图像,最常用的颜色空间:RGB和HSV。 匹配方法:直方图相交法(相交即交集)、距离法、中心距法、参考颜色表法、累加颜色直方图法。 对颜色特征的表达方式有许多种,我们采用直方图进行特征描述。常见的直方图有两种:统计直方图,累积直方图。我们将分别实验两种直方图在图像聚类和检索中的性能。 统计直方图 为利用图像的特征描述图像,可借助特征的统计直方图。图像特征的统计直方图实际是一个1-D的离散函数,即: 上式中k代表图像的特征取值,L是特征可取值个数,是图像中具有特征值为k的像素的个数,N是图像像素的总数,一个示例如下图:其中有8个直方条,对应图像中的8种灰度像素在总像素中的比例。

图像融合算法概述

图像融合算法概述 摘要:详细介绍了像素级图像融合的原理,着重分析总结了目前常用的像素级图像融合的方法和质量评价标准,指出了像素级图像融合技术的最新进展,探讨了像素级图像融合技术的发展趋势。 关键词:图像融合; 多尺度变换; 评价标准 Abstract:This paper introduced the principles based on image fusion at pixel level in detail, analysed synthetically and summed up the present routine algorithm of image fusion at pixel level and evaluation criteria of its quality. It pointed out the recent development of image fusion at pixel level, and discussed the development tendency of technique of image fusion at pixel level. Key words:image fusion; multi-scale transform; evaluation criteria 1.引言: 图像融合是通过一个数学模型把来自不同传感器的多幅图像综合成一幅满足特定应用需求的图像的过程, 从而可以有效地把不同图像传感器的优点结合起来, 提高对图像信息分析和提取的能力[ 1] 。近年来, 图像融合技术广泛地应用于自动目标识别、计算机视觉、遥感、机器人、医学图像处理以及军事应用等领域。图像融合的主要目的是通过对多幅图像间冗余数据的处理来提高图像的可靠性; 通过对多幅图像间互补信息的处理来提高图像的清晰度。根据融合处理所处的阶段不同,图像融合通常可以划分为像素级、特征级和决策级。融合的层次不同, 所采用的算法、适用的范围也不相同。在融合的三个级别中, 像素级作为各级图像融合的基础, 尽可能多地保留了场景的原始信息, 提供其他融合层次所不能提供的丰富、精确、可靠的信息, 有利于图像的进一步分析、处理与理解, 进而提供最优的决策和识别性能. 2.图像融合算法概述 2.1 图像融合算法基本理论

图像融合算法的分析与比较

摘要:图像拼接技术一直是计算机视觉、图像处理和计算机图形学的热点研究方向。图像融合算法是图像拼接过程中非常重要的一个步骤,本文介绍了几种常用图像融合算法,并且结合实验对它们的进行了分析和比较。 关键词:图像融合;图像拼接 一、引言图像拼接(image stitching)技术是由于摄像设备的视角限制,不可能一次拍出很大图片而产生的。图像拼接技术可以解决由于相机等成像仪器的视角和大小的局限,不可能一次拍出很大图片而产生的问题。它利用计算机进行自动匹配,合成一幅宽角度图片,因而在实际使用中具有很广泛的用途,同时对它的研究也推动了图像处理有关的算法研究。图1 图像拼接流程图图像拼接技术的基本流程如图1-1所示,首先获取待拼接的图像,然后是图像配准和图像融合,最终得到拼接图。图像拼接技术主要包括两个关键环节,即图像配准和图像融合。图像配准主要指对参考图像和待拼接图像中的匹配信息进行提取,在提取出的信息后寻找图像间的变换模型,然后由待拼接图像经变换模型向参考图像进行对齐,变换后图像的坐标将不再是整数,这就涉及到重采样与插值的技术。图像拼接的成功与否主要是图像的配准。待拼接的图像之间,可能存在平移、旋转、缩放等多种变换或者大面积的同色区域等很难匹配的情况,一个好的图像配准算法应该能够在各种情况下准确找到图像间的对应信息,将图像进行匹配。图像融合的任务就是把配准后的两幅图像根据对准的位置合并为一幅图像。由于两幅相邻图像之间存在重叠区域,因此,采用配准算法可以实现图像的对齐。然而图像拼接的目的是要得到一幅无缝的拼接图像[1]。所谓无缝,就是说在图像拼接结果中,不应该看到两幅图像在拼接过程中留下的痕迹,即不能出现图像拼接缝隙。由于进行拼接的两幅图像并不是在同一时刻采集的,因此,它们不可避免地会受到各种不定因素的影响。由于这些无法控制的因素的存在,如果在图像整合过程结束之后,只是根据该过程中所得到的两幅相邻图像之间的重叠区域信息,将两幅图像简单的叠加起来,那么,在它们的结合部位必然会产生清晰的拼接缝隙,这也就达不到图像拼接所要求的无缝的要求。如何处理图像整合过程中无法解决的拼接缝隙问题,实现真正意义上的无缝拼接,正是图像融合过程中所要解决的问题。对于重叠部分,如果只是简单的取第一幅图像或第二幅图像的数据进行叠加,会造成图像的模糊和拼接的痕迹,这是不能容忍的。图像融合就是要消除图像光强或色彩的不连续性。它的主要思想是让图像在拼接处的光强平滑过渡以消除光强的突变。二、常见的图像融合算法 1、平均值法令,,分别表示第一幅图像、第二幅图像和融合图像在点处的像素值,则融合图像中各点的像素值按式(4-1)确定。 (1) 式(4-1)中,表示第一幅图像中未与第二幅图像重叠的图像区域,表示第一幅图像与第二幅图像重叠的图像区域,表示第二幅图像中未与第一幅图像重叠的图像区域。取两幅图像的平均值的算法速度很快,但效果一般不能令人满意,在融合部分有明显的带状感觉,用眼睛能够观察出区别。本文以左图像所在的坐标系为参考坐标空间,将右图像经过变换矩阵向参考图坐标进行映射,由于双线性插值法在计算效率和精度方面可以达到一个很好的平衡,因此在变换过程中本文采用双线性插值。然后采用平均值法对图像重叠区进行融合,得到图2(a)和图2(b)。从图中可以看出由于采用本文的配准方法拼接出来的图像在拼接点处结合得很好,但是由于重叠区域采用了简单的平均值法来进行融合,有明显的拼缝。 (a) 校园广场图片(b)足球场图片图2 采用平均值法来对图像进行融合 2、重叠区线性过渡为了消除重叠区的拼缝问题,目前采用较多的是重叠区线性过渡的方法. 实现的具体方法是假设重叠区域宽度为l。取过渡因子是()。两幅图像重叠区的x轴和y轴最大和最小值分别为、和、,则过渡因子,重叠区的像

遥感专题讲座——影像信息提取(四、面向对象特征提取)

面向对象的影像分类技术 “同物异谱,同谱异物”会对影像分类产生的影响,加上高分辨率影像的光谱信息不是很丰富,还有经常伴有光谱相互影响的现象,这对基于像素的分类方法提出了一种挑战,面向对象的影像分类技术可以一定程度减少上述影响。 本小节以ENVI中的面向对象的特征提取FX模块为例,对这种技术和处理流程做一个简单的介绍。 本专题包括以下内容: ??●面向对象分类技术概述 ??●ENVI FX简介 ??●ENVI FX操作说明 1、面向对象分类技术概述 面向对象分类技术集合临近像元为对象用来识别感兴趣的光谱要素,充分利用高分辨率的全色和多光谱数据的空间,纹理,和光谱信息来分割和分类的特点,以高精度的分类结果或者矢量输出。它主要分成两部分过程:影像对象构建和对象的分类。

影像对象构建主要用了影像分割技术,常用分割方法包括基于多尺度的、基于灰度的、纹理的、基于知识的及基于分水岭的等分割算法。比较常用的就是多尺度分割算法,这种方法综合遥感图像的光谱特征和形状特征,计算图像中每个波段的光谱异质性与形状异质性的综合特征值,然后根据各个波段所占的权重,计算图像所有波段的加权值,当分割出对象或基元的光谱和形状综合加权值小于某个指定的阈值时,进行重复迭代运算,直到所有分割对象的综合加权值大于指定阈值即完成图像的多尺度分割操作。 影像对象的分类,目前常用的方法是“监督分类”和“基于知识分类”。这里的监督分类和我们常说的监督分类是有区别的,它分类时和样本的对比参数更多,不仅仅是光谱信息,还包括空间、纹理等信息。基于知识分类也是根据影像对象的熟悉来设定规则进行分类。 目前很多遥感软件都具有这个功能,如ENVI的FX扩展模块、易康(现在叫Definiens)、ERDAS的Objective模块、PCI的FeatureObjeX(新收购)等。 表1为三大类分类方法的一个大概的对比。