基于粗糙集和支持向量机的股指期货预测模型研究

实验2分类预测模型_支持向量机

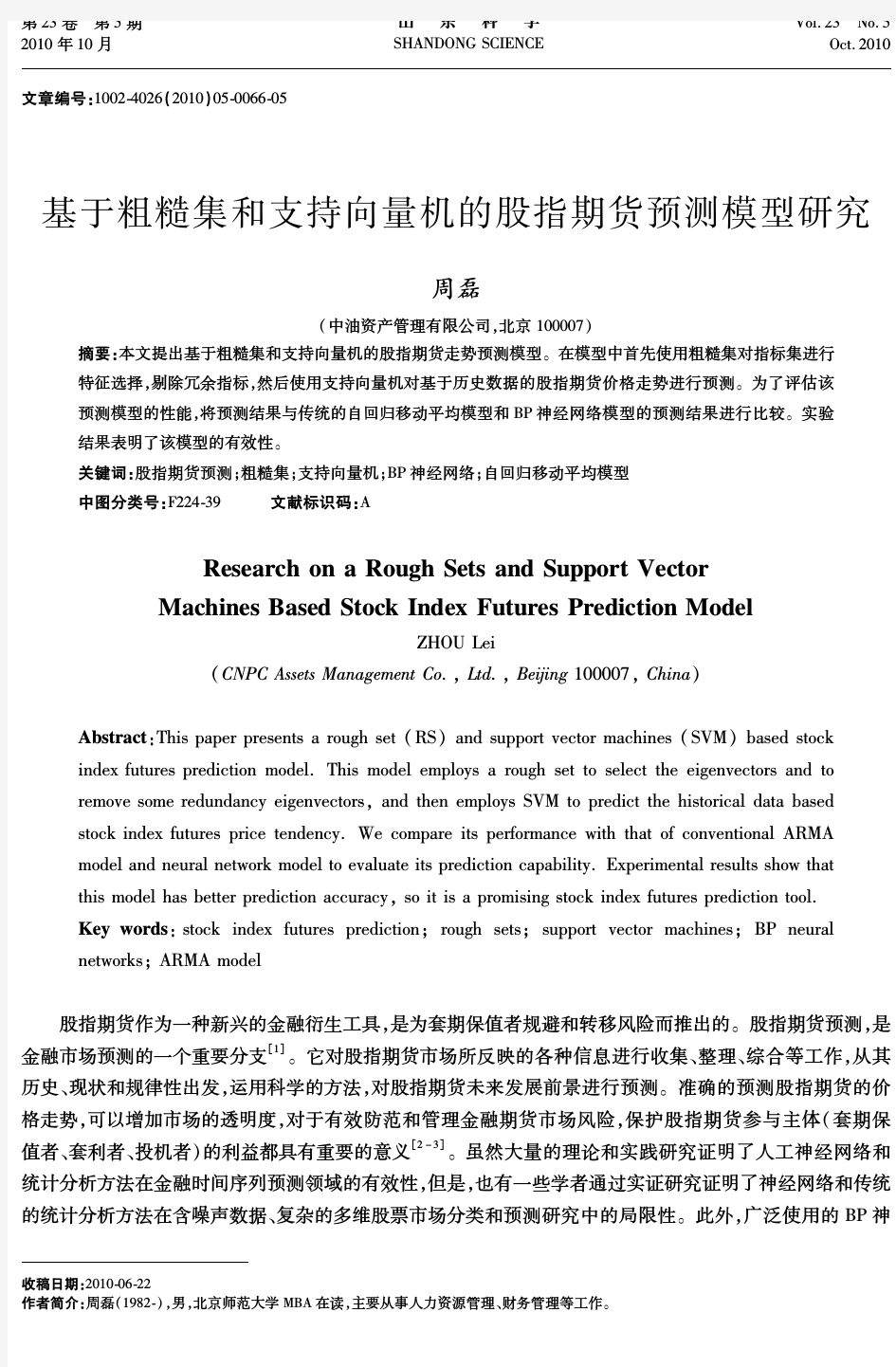

实验2分类预测模型——支持向量机SVM 一、 实验目的 1. 了解和掌握支持向量机的基本原理。 2. 熟悉一些基本的建模仿真软件(比如SPSS 、Matlab 等)的操作和使用。 3. 通过仿真实验,进一步理解和掌握支持向量机的运行机制,以及其运用的场景,特别是 在分类和预测中的应用。 二、 实验环境 PC 机一台,SPSS 、Matlab 等软件平台。 三、 理论分析 1. SVM 的基本思想 支持向量机(Support Vector Machine, SVM ),是Vapnik 等人根据统计学习理论中结构风险最小化原则提出的。SVM 能够尽量提高学习机的推广能力,即使由有限数据集得到的判别函数,其对独立的测试集仍能够得到较小的误差。此外,支持向量机是一个凸二次优化问题,能够保证找到的极值解就是全局最优解。这希尔特点使支持向量机成为一种优秀的基于机器学习的算法。 SVM 是从线性可分情况下的最优分类面发展而来的,其基本思想可用图1所示的二维情况说明。 图1最优分类面示意图 图1中,空心点和实心点代表两类数据样本,H 为分类线,H1、H2分别为过各类中离分类线最近的数据样本且平行于分类线的直线,他们之间的距离叫做分类间隔(margin )。所谓最优分类线,就是要求分类线不但能将两类正确分开,使训练错误率为0,而且还要使分类间隔最大。前者保证分类风险最小;后者(即:分类间隔最大)使推广性的界中的置信范围最小,从而时真实风险最小。推广到高维空间,最优分类线就成为了最优分类面。 2. 核函数 ω

支持向量机的成功源于两项关键技术:利用SVM 原则设计具有最大间隔的最优分类面;在高维特征空间中设计前述的最有分类面,利用核函数的技巧得到输入空间中的非线性学习算法。其中,第二项技术就是核函数方法,就是当前一个非常活跃的研究领域。核函数方法就是用非线性变换 Φ 将n 维矢量空间中的随机矢量x 映射到高维特征空间,在高维特征空间中设计线性学习算法,若其中各坐标分量间相互作用仅限于内积,则不需要非线性变换 Φ 的具体形式,只要用满足Mercer 条件的核函数替换线性算法中的内积,就能得到原输入空间中对应的非线性算法。 常用的满足Mercer 条件的核函数有多项式函数、径向基函数和Sigmoid 函数等,选用不同的核函数可构造不同的支持向量机。在实践中,核的选择并未导致结果准确率的很大差别。 3. SVM 的两个重要应用:分类与回归 分类和回归是实际应用中比较重要的两类方法。SVM 分类的思想来源于统计学习理论,其基本思想是构造一个超平面作为分类判别平面,使两类数据样本之间的间隔最大。SVM 分类问题可细分为线性可分、近似线性可分及非线性可分三种情况。SVM 训练和分类过程如图2所示。 图2 SVM 训练和分类过程 SVM 回归问题与分类问题有些相似,给定的数据样本集合为 x i ,y i ,…, x n ,y n 。其中, x i x i ∈R,i =1,2,3…n 。与分类问题不同,这里的 y i 可取任意实数。回归问题就是给定一个新的输入样本x ,根据给定的数据样本推断他所对应的输出y 是多少。如图3-1所示,“×”表示给定数据集中的样本点,回归所要寻找的函数 f x 所对应的曲线。同分类器算法的思路一样,回归算法需要定义一个损失函数,该函数可以忽略真实值某个上下范围内的误差,这种类型的函数也就是 ε 不敏感损失函数。变量ξ度量了训练点上误差的代价,在 ε 不敏感区内误差为0。损失函数的解以函数最小化为特征,使用 ε 不敏感损失函数就有这个优势,以确保全局最小解的存在和可靠泛化界的优化。图3-2显示了具有ε 不敏感带的回归函数。 o x y 图3-1 回归问题几何示意图 o x y 图3-2 回归函数的不敏感地

向量自回归模型简介

一、Var模型的基本介绍 向量自回归模型(Vector Autoregressive Models,VAR)最早由Sims(1980)提出。他认为,如果模型设定和识别不准确,那么模型就不能准确地反应经济系统的动态特性,也不能很好地进行动态模拟和政策分析。因此,VAR模型通常使用最少的经济理论假设,以时间序列的统计特征为出发点,通常对经济系统进行冲击响应(Impulse-Response)分析来了解经济系统的动态特性和冲击传导机制。由于VAR模型侧重于描述经济的动态特性,因而它不仅可以验证各种经济理论假设,而且在政策模拟上具有优越性。 VAR模型主要用于替代联立方程结构模型,提高经济预测的准确性。用联立方程模型研究宏观经济问题,是当前世界各国经济学者的一种通用做法,它把理论分析和实际统计数据结合起来,利用现行回归或非线性回归分析方法,确定经济变量之间的结构关系,构成一个由若干方程组成的模型系统。联立方程模型适合于经济结构分析,但不适合于预测:联立方程模型的预测结果的精度不高,其主要原因是需要对外生变量本身进行预测。与联立方程模型不同,VAR模型相对简洁明了,特别适合于中短期预测。目前,VAR模型在宏观经济和商业金融预测等领域获得了广泛应用。 二、VAR模型的设定 VAR模型描述在同一样本期间内的n个变量(内生变量)可以作为它们过去值的线性函数。 一个VAR(p)模型可以写成为: 或: 其中:c是n × 1常数向量,A i是n × n矩阵,p是滞后阶数,A(L)是滞后多项式矩阵,L是滞后算子。是n × 1误差向量,满足: 1. —误差项的均值为0 2. Ω—误差项的协方差矩阵为Ω(一个n × 'n正定矩阵) 3.(对于所有不为0的p都满足)—误差项不存在自相关 虽然从模型形式上来看比较简单,但在利用VAR模型进行分析之前,对模型的设定还需要意以下两点: 一是变量的选择。理论上来讲,既然VAR模型把经济作为一个系统来研究,那么模型中

支持向量机数据分类预测

支持向量机数据分类预测 一、题目——意大利葡萄酒种类识别 Wine数据来源为UCI数据库,记录同一区域三种品种葡萄酒的化学成分,数据有178个样本,每个样本含有13个特征分量。50%做为训练集,50%做为测试集。 二、模型建立 模型的建立首先需要从原始数据里把训练集和测试集提取出来,然后进行一定的预处理,必要时进行特征提取,之后用训练集对SVM进行训练,再用得到的模型来预测试集的分类。 三、Matlab实现 3.1 选定训练集和测试集 在178个样本集中,将每个类分成两组,重新组合数据,一部分作为训练集,一部分作为测试集。 % 载入测试数据wine,其中包含的数据为classnumber = 3,wine:178*13的矩阵,wine_labes:178*1的列向量 load chapter12_wine.mat; % 选定训练集和测试集 % 将第一类的1-30,第二类的60-95,第三类的131-153做为训练集 train_wine = [wine(1:30,:);wine(60:95,:);wine(131:153,:)]; % 相应的训练集的标签也要分离出来 train_wine_labels = [wine_labels(1:30);wine_labels(60:95);wine_labels(131:153)]; % 将第一类的31-59,第二类的96-130,第三类的154-178做为测试集 test_wine = [wine(31:59,:);wine(96:130,:);wine(154:178,:)]; % 相应的测试集的标签也要分离出来 test_wine_labels = [wine_labels(31:59);wine_labels(96:130);wine_labels(154:178)]; 3.2数据预处理 对数据进行归一化: %% 数据预处理 % 数据预处理,将训练集和测试集归一化到[0,1]区间 [mtrain,ntrain] = size(train_wine); [mtest,ntest] = size(test_wine); dataset = [train_wine;test_wine]; % mapminmax为MATLAB自带的归一化函数 [dataset_scale,ps] = mapminmax(dataset',0,1); dataset_scale = dataset_scale';

支持向量机模型的研究与设计

百度文库- 让每个人平等地提升自我 支持向量机实验模型的研究与设计 用户手册 1.简介 本模型是基于SVM(即支持向量机)的机器学习模型,能够将线性可分的和非线性可分的两种情况下的两类数据集进行分类,并对分类结果进行分析。用户可以选择装载已有的数据进行分类,也可以手动创建两类数据集进行分类。用户根据要分类的数据集,从两个训练算法中选择适当的训练算法,并且从三个核函数中选择适当的核函数对数据集进行分类。 2.系统要求 操作系统方面:Windows 98,Windows NT,Windows ME,Windows 2000, Windows XP及Windows 2003系统; 应用软件方面:必须安装MATLAB 或以上版本 3.使用说明 (1)首先运行或者文件,进入模型主界面,如下图: 用户在进入实验前必须先按“设置路径”按钮设置路径,然后就可以通过“进入支持向量机模型”按钮进入模型。

百度文库- 让每个人平等地提升自我(2)进入支持向量机机器学习模型后,界面如下图:用户可以通过各个按钮对模型进行操作 (3)装载或创建数据 a.通过“装载数据”按钮装载数据,用户选择数据所在的文件 b.通过“创建数据”按钮创建数据

百度文库- 让每个人平等地提升自我 可以创建线性可分数据集如下: 可以创建非线性可分数据集如下: C.装载数据或创建数据后的界面上显示数据点,如下图:

百度文库- 让每个人平等地提升自我 (4)通过“训练SVM”按钮对数据集进行分类 在此仅介绍了对线性可分数据集分类的情况,对其他的数据集,操作也跟如下类似。在数据集线性可分情况下,使用不同算法的分类结果: 选择SMO训练算法和Linear核函数的分类结果: (5)通过“重新设置”按钮,重新选择SMO训练算法和Polynomial核函数的分类结果

(数学建模教材)31第三十一章支持向量机

第三十一章 支持向量机 支持向量机是数据挖掘中的一项新技术,是借助于最优化方法来解决机器学习问 题的新工具,最初由 V.Vapnik 等人提出,近几年来在其理论研究和算法实现等方面都 取得了很大的进展,开始成为克服“维数灾难”和过学习等困难的强有力的手段,它的 理论基础和实现途径的基本框架都已形成。 §1 支持向量分类机的基本原理 根据给定的训练集 l T = {(x 1,y 1 ), (x 2 ,y 2 ),L ,(x l ,y l )}∈ ( X ? Y ) , 其中 x ∈ X = R n , X 称为输入空间,输入空间中的每一个点 x 由 n 个属性特征组成, i i n y i ∈Y = {-1,1},i = 1,L ,l 。寻找 R 上的一个实值函数 g (x ) ,以便用分类函数 f (x ) = sgn( g (x )), 推断任意一个模式 x 相对应的 y 值的问题为分类问题。 1.1 线性可分支持向量分类机 考虑训练集 T ,若 ?ω ∈ R n , b ∈ R 和正数 ε ,使得对所有使 y = 1 的下标 i 有 i (ω ? x i ) + b ≥ ε(这里 (ω ? x i ) 表示向量 ω 和 x i 的内积),而对所有使 y i = -1 的下标 i 有 (ω ? x i ) + b ≤ -ε ,则称训练集 T 线性可分,称相应的分类问题是线性可分的。 记两 类样本集分别为 M = {x i | y i = 1, x i ∈T }, M = {x i | y i = -1, x i ∈T }。定义 M + 的凸包 conv(M + ) 为 + - ? N + N + ? conv(M + ) = ?x = ∑λ x | ∑ λ λ ≥ 0, j = 1,L , N + ; x ∈ M + ←, = 1, j j j j j ? ↑ j =1 j =1 M - 的凸包 conv(M - ) 为 ? N - N - ? conv(M - ) = ?x = ∑λ x | ∑λ λ ≥ 0, j = 1,L , N - ; x ∈ M - ←. = 1, j j j j j ? ↑ j =1 j =1 其中 N + 表示 + 1 类样本集中样本点的个数, N - 表示 - 1类样本集中样本点的个数,定 理 1 给出了训练集 T 线性可分与两类样本集凸包之间的关系。 定理 1 训练集 T 线性可分的充要条件是, T 的两类样本集 M + 和 M - 的凸包相 离。如下图所示 图 1 训练集 T 线性可分时两类样本点集的凸包 证明:①必要性 -762-

资料:向量自回归模型__详解

第十四章 向量自回归模型 本章导读:前一章介绍了时间序列回归,其基本知识为本章的学习奠定了基础。这一章将要介绍的是时间序列回归中最常用的向量自回归,它独有的建模优势赢得了人们的广泛喜爱。 14.1 VAR 模型的背景及数学表达式 VAR 模型主要应用于宏观经济学。在VAR 模型产生之初,很多研究者(例如Sims ,1980 和Litterman ,1976;1986)就认为,VAR 在预测方面要强于结构方程模型。VAR 模型产生的原因在于20世纪60年代一大堆的结构方程并不能让人得到理想的结果,而VAR 模型的预测却比结构方程更胜一筹,主要原因在于大型结构方程的方法论存在着更根本的问题,并且结构方程受到最具挑战性的批判来自卢卡斯批判,卢卡斯指出,结构方程组中的“决策规则”参数,在经济政策改变时无法保持稳定,即使这些规则本身也是正确的。因此宏观经济建模的方程组在范式上显然具有根本缺陷。VAR 模型的研究用微观化基础重新表述宏观经济模型的基本方程,与此同时,对经济变量之间的相互关系要求也并不是很高。 我们知道经济理论往往是不能为经济变量之间的动态关系提供一个严格的定义,这使得在解释变量过程中出现一个问题,那就是内生变量究竟是出现在方程的哪边。这个问题使得估计和推理变得复杂和晦涩。为了解决这一问题,向量自回归的方法出现了,它是由sim 于1980年提出来的,自回归模型采用的是多方程联立的形式,它并不以经济理论为基础,在模型的每一个方程中,内生变量对模型的全部内生变量的滞后项进行回归,从而估计全部内生变量的动态关系。 向量自回归通常用来预测相互联系的时间序列系统以及分析随机扰动项对变量系统的动态影响。向量自回归的原理在于把每个内生变量作为系统中所有内生变量滞后值的函数来构造模型,从而避开了结构建模方法中需要对系统每个内生变量关于所有内生变量滞后值的建模问题。一般的VAR(P)模型的数学表达式是。 11011{,}t t p t p t t q t q t y v A y A y B x B x B x t μ----=++???++++???++∈-∞+∞ (14.1) 其中1t t Kt y y y =??????()表示K ×1阶随机向量, 1A 到p A 表示K ×K 阶的参数矩阵, t x 表示M ×1阶外生变量向量, 1B 到q B 是K ×M 阶待估系数矩阵, 并且假定t μ是白噪声序列;即, ()0,t E μ= '(),t t E μμ=∑并且'()0,t s E μμ=)t s ≠(。 在实际应用过程之中,由于滞后期p 和q 足够大,因此它能够完整的反映所构造模型的 全部动态关系信息。但这有一个严重的缺陷在于,如果滞后期越长,那么所要估计的参数就会变得越多,自由度就会减少。因此需要在自由度与滞后期之间找出一种均衡状态。一般的准则就是取许瓦咨准则(SC )和池此信息准则(AIC)两者统计量最小时的滞后期,其统计量见式(14-2)与式(14-3)。 2/2/AIC l n k n =-+ (14.2)

支持向量机(SVM)在作物需水预测中的应用研究综述

第卷第期农业水土工程研究进展课程论文V ol. Supp. . 2015年11月Paper of agricultural water and soil engineering progress subject Nov.2015 1 支持向量机(SVM)在作物需水预测中的应用研究综述 (1.中国农业大学水利与土木工程学院,北京,100083) 摘要:水资源的合理配置对于社会经济的发展具有重要意义。而在农业水资源的优化配置中常常需要提供精确的作物需水信息才能接下来进行水量的优化配置。支持向量机是基于统计学习理论的新型机器学习方法,因为其出色的学习性能,已经成为当前机器学习界的研究热点。但是目前对支持向量机的研究与应用大多集中在分类这一功能上,而在农业水资源配置中的应用又大多集中于预测径流量,本文系统介绍了支持向量机的理论与一些应用,并对支持向量机在作物需水预测的应用进行了展望。 关键词:作物需水预测;统计学习理论;支持向量机; 中图分类号:S16 文献标志码:A 文章编号: 0引言 作物的需水预测是农业水资源优化配置的前提和基础之一。但目前在解决数学模型中需要输入有预期的预测精度的数据时还是会遇到困难。例如,当大量的用水者的用水需求作为优化模型的输入时,预测精度太低时优化结果可能会出现偏差。此外,不确定性也存在于水的需求中,水需求受到一些影响因子和系统组成的影响(即人类活动,社会发展,可持续性要求以及政策法规),这不仅在不确定性因子间相互作用过程中使得问题更为复杂,也使得决策者在进行水资源分配过程中的风险增加。所以,准确的预测对水资源的需求对制定有效的水资源系统相关规划很重要。而提高需水量预测精度一直是国内外学术界研究难点和热点。 支持向量机(Support V ector Machine,SVM)是根据统计学理论提出的一种新的通用学习方法,该方法采用结构风险最小化准则(Structural Risk Minimization Principle),求解二次型寻优问题,从理论上寻求全局最优解,较好地兼顾了神经网络和灰色模型的优点[1][2],克服了人工神经网络结构依赖设计者经验的缺点,具有对未来样本的较好的泛化性能,较好解决了高维数、局部极小等问题[3]。目前,SVM已成功的应用于分类、函数逼近和时间序列预测等方面,并在水科学领域中取得了一些成果,Liong[4]已将SVM应用于水文预报,周秀平等[5]已将SVM应用于径流预测,王景雷等[6]亦已将SVM应用于地下水位预报。而需水预测问题本身也可以看作是一种对需水量及其影响因子间的复杂的非线性函数关系的逼近问题,但将SVM应用于作物需水预测的研究尚处于起步阶段。本文简要介绍支持向量机并对其研究进展进行综述,最后对未来使用支持向量机预测作物需水量进行展望。 收稿日期:修订日期:1支持向量机 1.1支持向量机国内外研究现状 自 1970 年以来,V apnik[1,2]等人发展了一种新的学习机——支持向量机。与现有的学习机包括神经网络,模糊学习机,遗传算法,人工智能等相比,它具有许多的优点:坚实的理论基础和较好的推广能力、强大的非线性处理能力和高维处理能力。因此这种学习方法有着出色的学习性能,并在许多领域已得到成功应用,如人脸检测、手写体数字识别、文本自动分类、非线性回归建模与预测、优化控制数据压缩及时间序列预测等。 1998年,Alex J. Smola[7]系统地介绍了支持向量机回归问题的基本概念和求解算法。Drucher[8]将支持向量机回归模型同基于特征空间的回归树和岭回归的集成回归技术bagging做了比较;Alessandro verri[9]将支持向量机回归模型同支持向量机分类模型和禁忌搜索(basic pursuit denoising)作了比较,并且给出了贝叶斯解释。通过分析得出了如下结论:支持向量机回归模型由于不依赖于输入空间的维数,所以在高维中显示出了其优越性。为了简化支持向量机,降低其复杂性,已有了一些研究成果。比如,Burges[10]提出根据给定的支持向量机生成缩减的样本集,从而在给定的精度下简化支持向量机,但生成缩减样本集的过程也是一个优化过程,计算比较复杂;1998年Scholkopf[11]等人在目标函数中增加了参数v以控制支持向量的数目,称为v-SVR,证明了参数v与支持向量数目及误差之间的关系,但支持向量数目的减少是以增大误差为代价的。Suykens等人[12]1999年提出的最小二乘支持向量机(LS-SVM)算法具有很高的学习效率,对大规模数据可采用共轭梯度法求解;田盛丰[13]等人提出了LS-SVM与序贯最优化算法(SMO)的混合算法。 1.2支持向量机在水资源领域研究现状

基于粗糙集支持向量机的遥感影像分类算法

基于粗糙集支持向量机的遥感影像分类算法研究 刘峰1,2,张立民1,张瑞峰2 (1.海军航空工程学院电子信息工程系,山东烟台264001;2.解放军92785部队河北秦皇岛066200)摘要:近年来,随着遥感技术的飞速发展,遥感影像的处理和分类已成为遥感应用研究中的一个热点,粗糙集(RS )理论和支持向量机(SVM )在信息处理和分类方面具有独特的优势,本文将粗糙集支持向量机应用于遥感影像分类,简要介绍了粗糙集理论的基本概念和支持向量机的基本原理,将粗糙集理论的属性约简作为前置系统,剔除冗余属性,把SVM 分类器作为后置系统,对遥感影像进行训练和分类,实验结果表明该模型不仅提高了系统运行的速度,而且分类性能有了一定的提高,为遥感影像分类提供了一条有效途径。关键词:遥感影像;粗糙集;支持向量机;分类中图分类号:TP181 文献标识码:A 文章编号:1674-6236(2012)23-0044-03 Remote sensing image classification based on rough set and support vector machine LIU Feng 1,2,ZHANG Li -min 1,ZHANG Rui -feng 2 (1.Department of Electronic Information Engineering of NAEI ,Yantai 264001,China ; 2.Unit 92785of PLA ,Qinhuangdao 066200,China ) Abstract:In recent years ,with the rapid development of remote sensing technology ,processing and classification of remote sensing image has become a hotspot in application studies of remote sensing.Rough set theory and SVM have unique advantages in information processing and classification.this paper applys RS -SVM to remote sensing image classification ,briefly introduce the concepts of RS and principle of SVM ,attributes reduction in RS theory as preposing system ,get rid of redundancy attributes ,SVM classifier as postposing system ,train and classify remote sensing image.experimental results indicate this model not only raise the operating speed ,but also improve classification performance ,provide a new effective way in remote sensing image classification. Key words:remote sensing image ;rough set ;SVM ;classification 收稿日期:2012-03-31 稿件编号:201203229 基金项目:国家自然科学基金资助(61102165) 作者简介:刘峰(1986—),男,河北石家庄人,硕士研究生。研究方向:雷达图像仿真。 遥感是接收地表物质波谱反射信息的一种被动式遥感技术。随着遥感技术朝着高空间分辨率、高光谱分辨率、高时相分辨率的迅猛发展,人们将获取越来越庞大的遥感数据。作为遥感影像处理过程中的重要步骤,分类一直被从事遥感信息处理的广大科技人员所重视。遥感影像分类方法包括统计模式识别、神经网络、遗传算法、模拟退火算法等,上述方法大多要求已知先验概率或基于渐近理论,在实际应用过程中,样本的数目通常是有限的,上述方法都难以取得理想的效果。基于结构风险最小化原则(SRM )的支持向量机(SVM )模型可以有效地解决小样本条件下的学习问题,而遥感影像具有较强的不确定性,主要表现在同物异谱、同谱异物、时相变化以及地物单元空间分布的相互交错关系等方面,粗糙集理论是一种处理不精确、不完全和不确定信息的新型数据分析工具,1990年以后逐渐引起世界各国学者的广泛关注,将粗糙集理论和支持向量机相结合已成为信息科学最活跃的研究领域之一,本文将基于粗糙集理论的支持向量机用于遥感影像的处理和分类,并进行了仿真实验,实验结果表明计算量大大减少,并且提高了分类精度。 1基于粗糙集理论的支持向量机 粗糙集是一个强大的数据分析工具,属性约简是其理论 的一个重要内容,就是在保持分类能力小变的前提下,通过属性约简,导出概念的分类规则[1]。而粗糙集理论的容错能力与泛化能力相对软弱,且只能处理量化数据等问题,而这恰好是SVM 算法的长处。SVM 基于SRM 原则,它最小化泛化误差的上界,而不是最小化训练误差,保证了SVM 具有更好的泛化性能[7]。由于RS 理论与SVM 算法在信息处理方面有很强的互补性,因此将RS 的属性约简作为前置系统,再根据 RS 方法预处理后的信息结构,用SVM 进行数据训练与预测, 实现粗糙集支持向量机(RS-SVM )。 1.1粗糙集理论的属性约简 属性约简是粗糙集理论的核心内容之一,人类在对一个 事物做出判断和决策时,并不是依据被判断事物的全部特 电子设计工程 Electronic Design Engineering 第20卷Vol.20第23期No.232012年12月Dec.2012 -44-

基于支持向量机回归模型的海量数据预测

2007,43(5)ComputerEngineeringandApplications计算机工程与应用 1问题的提出 航空公司在客舱服务部逐步实行“费用包干”政策,即:综合各方面的因素,总公司每年给客舱服务部一定额度的经费,由客舱服务部提供客舱服务,而客舱服务产生的所有费用,由客舱服务部在“费用包干额度”中自行支配。新的政策既给客舱服务部的管理带来了机遇,同时也带来了很大的挑战。通过“费用包干”政策的实施,公司希望能够充分调用客舱服务部的积极性和主动性,进一步改进管理手段,促进新的现代化管理机制的形成。 为了进行合理的分配,必须首先搞清楚部门的各项成本、成本构成、成本之间的相互关系。本文首先对成本组成进行分析,然后用回归模型和支持向量机预测模型对未来的成本进行预测[1-3],并对预测结果的评价和选取情况进行了分析。 2问题的分析 由于客舱服务部的特殊性,“费用包干”政策的一项重要内容就集中在小时费的重新分配问题上,因为作为客舱乘务员的主要组成部分—— —“老合同”员工的基本工资、年龄工资以及一些补贴都有相应的政策对应,属于相对固定的部分,至少目前还不是调整的最好时机。乘务员的小时费收入则是根据各自的飞行小时来确定的变动收入,是当前可以灵活调整的部分。实际上,对于绝大多数员工来说,小时费是其主要的收入部分,因此,用于反映乘务人员劳动强度的小时费就必然地成为改革的重要部分。 现在知道飞行小时和客万公里可能和未来的成本支出有关系,在当前的数据库中有以往的飞行小时(月)数据以及客万公里数据,并且同时知道各月的支出成本,现在希望预测在知道未来计划飞行小时和市场部门希望达到的客万公里的情况下的成本支出。 根据我们对问题的了解,可以先建立这个部门的成本层次模型,搞清楚部门的各项成本、成本构成、成本之间的相互关系。这样,可以对部门成本支出建立一个层次模型:人力资源成本、单独预算成本、管理成本,这三个部分又可以分别继续分层 次细分,如图1所示。 基于支持向量机回归模型的海量数据预测 郭水霞1,王一夫1,陈安2 GUOShui-xia1,WANGYi-fu1,CHENAn2 1.湖南师范大学数学与计算机科学学院,长沙410081 2.中国科学院科技政策与管理科学研究所,北京100080 1.CollegeofMath.andComputer,HunanNormalUniversity,Changsha410081,China 2.InstituteofPolicyandManagement,ChineseAcademyofSciences,Beijing100080,China E-mail:guoshuixia@sina.com GUOShui-xia,WANGYi-fu,CHENAn.Predictiononhugedatabaseontheregressionmodelofsupportvectormachine.ComputerEngineeringandApplications,2007,43(5):12-14. Abstract:Asanimportantmethodandtechnique,predictionhasbeenwidelyappliedinmanyareas.Withtheincreasingamountofdata,predictionfromhugedatabasebecomesmoreandmoreimportant.Basedonthebasicprincipleofvectormachineandim-plementarithmetic,apredictionsysteminfrastructureonanaircompanyisproposedinthispaper.Lastly,therulesofevaluationandselectionofthepredictionmodelsarediscussed. Keywords:prediction;datamining;supportvectormachine;regressionmodel 摘要:预测是很多行业都需要的一项方法和技术,随着数据积累的越来越多,基于海量数据的预测越来越重要,在介绍支持向量机基本原理和实现算法的基础上,给出了航空服务成本预测模型,最后对预测结果的评价和选取情况进行了分析。 关键词:预测;数据挖掘;支持向量机;回归模型 文章编号:1002-8331(2007)05-0012-03文献标识码:A中图分类号:TP18 基金项目:国家自然科学基金(theNationalNaturalScienceFoundationofChinaunderGrantNo.10571051);湖南省教育厅资助科研课题(theResearchProjectofDepartmentofEducationofHunanProvince,ChinaunderGrantNo.06C523)。 作者简介:郭水霞(1975-),女,博士生,讲师,主要研究领域为统计分析;王一夫(1971-),男,博士生,副教授,主要研究领域为计算机应用技术,软件工程技术;陈安(1970-),男,副研究员,主要研究领域为数据挖掘与决策分析。 12

SPSS Modeler 支持向量机模型评估银行客户信用

Modeler 支持向量机模型评估银行客户信用 本文要介绍的预测分析模型是“支持向量机模型”,我们将为大家简要介绍支持向量机模型的理论,然后结合IBM SPSS Modeler 产品详细讲述如何利用支持向量机模型来解决客户的具体商业问题—银行如何评估客户信用 银行典型案例 商业银行个人信用评估就是根据个人信息和借贷记录等历史数据,判断个人信用,它是保证信贷安全的重要一环。但是商业银行用于信用评估的数据往往具有特性不稳定,历史样本容量较小,指标较多,呈明显的非正态分布。这些特点导致很难利用一般的统计技术进行有效的评估。支持向量机模型( 简称SVM) 能够很好的处理此类数据,进行有效的信用评估。本文介绍了SVM 的基本概念以及Modeler 中使用SVM 进行信用评估的基本步骤和方法,并对结果进行分析和应用 支持向量机模型简介 支持向量机(Support Vector Machine, 简称SVM) 是一项功能强大的分类和回归技术,可最大化模型的预测准确度。与其他常用模型不同,SVM 一个优势就是能很好的处理小样本,高维数,非正态的数据。 SVM 的工作原理是将原始数据通过变换映射到高维特征空间,这样即使数据不是线性可分,也可以对该数据点进行分类。之后,使用变换后的新数据的进行预测分类。例如,图 1 中的数据点落到了两个不同的类别中,可以用一条曲线分隔这两个类别。对数据使用某种数学函数变换后,可以用超平面定义这两个类别之间的边界。 图 1. 数据变换后线性可分示意图

用于变换的数学函数称为核函数。IBM SPSS Modeler 中的SVM 支持下列核函数类型: ?线性 ?多项式 ?径向基函数(RBF) ?Sigmoid 如果数据的线性分隔比较简单,则建议使用线性核函数。在其他情况下,应当使用其他核函数。在所有情况下,最好尝试使用不同的核函数,才能从中找出最佳模型,因为每一个函数均使用不同的算法和参数。 回页首 使用IBM SPSS Modeler 支持向量机模型评估客户信用 IBM SPSS Modeler 中的SVM 提供了可视化的操作方法,具有界面友好,操作方便的特点。此节,介绍如何使用IBM SPSS Modeler SVM 评估客户信用。操作步骤分为: ?创建基本流(Modeler Stream),建立模型;

向量自回归模型讲义

第8章V AR模型与协整 1980年Sims提出向量自回归模型(vector autoregressive model)。这种模型采用多方程联立的形式,它不以经济理论为基础,在模型的每一个方程中,内生变量对模型的全部内生变量的滞后值进行回归,从而估计全部内生变量的动态关系。 8.1向量自回归(V AR)模型定义 8.1.1 模型定义 V AR模型是自回归模型的联立形式,所以称向量自回归模型。假设y1t,y2t之间存在关系,如果分别建立两个自回归模型 y1, t= f (y1, t-1, y1, t-2, …) y2, t= f (y2, t-1, y2, t-2, …) 则无法捕捉两个变量之间的关系。如果采用联立的形式,就可以建立起两个变量之间的关系。V AR模型的结构与两个参数有关。一个是所含变量个数N,一个是最大滞后阶数k。 以两个变量y1t,y2t滞后1期的V AR模型为例,

y 1, t = c 1 + π11.1 y 1, t -1 + π12.1 y 2, t -1 + u 1 t y 2, t = c 2 + π21.1 y 1, t -1 + π22.1 y 2, t -1 + u 2 t (8.1) 其中u 1 t , u 2 t ~ IID (0, σ 2), Cov(u 1 t , u 2 t ) = 0。写成矩阵形式是, ??????t t y y 21=12c c ??????+??????1.221 .211.121.11ππππ??????--1,21,1t t y y +?? ? ???t t u u 21 (8.2) 设, Y t =??????t t y y 21, c =12c c ?????? , ∏1 =??????1.221.211.121.11ππππ, u t =??? ???t t u u 21, 则, Y t = c + ∏1 Y t -1 + u t (8.3) 那么,含有N 个变量滞后k 期的V AR 模型表示如下: Y t = c + ∏1 Y t -1 + ∏2 Y t -2 + … + ∏k Y t -k + u t , u t ~ IID (0, Ω) (8.4) 其中, Y t = (y 1, t y 2, t … y N , t )' c = (c 1 c 2 … c N )' ∏j = ???? ?? ????????j NN j N j N j N j j j N j j ..2.1.2.22.21.1.12.11πππππππππΛ M O M M ΛΛ, j = 1, 2, …, k u t = (u 1 t u 2,t … u N t )',

实验四-支持向量机教学文案

实验四-支持向量机

实验四:支持向量机 班级姓名学号指导老师 一.实验目的 1.了解基有关支持向量机的基本原理 2.能够使用支持向量机的代码解决分类与回归问题 3.了解图像分类的基本原理 二、实验的硬件、软件平台 硬件:计算机 软件:操作系统win10 应用软件:Java 三、实验原理 四、1. LIBSVM 使用方法简介 五、LibSVM是以源代码和可执行文件两种方式给出的。如果是Windows系列操作系统,可以直接使用软件包提供的程序,也可以进行修改编译;如果是Unix类系统,必须自己编译。 六、LIBSVM 在给出源代码的同时还提供了Windows操作系统下的可执行文件,包括:进行支持向量机训练的svmtrain.exe;根据已获得的支持向量机模型对数据集进行预测的svmpredict.exe;以及对训练数据与测试数据进行简单缩放操作的svmscale.exe。它们都可以直接在DOS 环境中使用。如果下载的包中只有C++的源代码,则也可以自己在VC等软件上编译生成可执行文件。七、 八、2. LIBSVM 使用的一般步骤是: 九、1)按照LIBSVM软件包所要求的格式准备数据集; 十、2)对数据进行简单的缩放操作; 十一、3)考虑选用RBF 核函数; 十二、4)采用交叉验证选择最佳参数C与g ; 十三、5)采用最佳参数C与g 对整个训练集进行训练获取支持向量机模型; 十四、6)利用获取的模型进行测试与预测。 十五、 十六、3. LIBSVM使用的数据格式 十七、1)训练数据和检验数据文件格式如下: 十八、

向量自回归与ARCH、GARCH模型

向量自回归 预测是计量经济分析的重要部分,宽泛的说,依据时间序列数据进行经济预测的方法有五种:(1)指数平滑法;(2)单一方程回归模型;(3)联立方程回归模型;(4)单整自回归移动平均模型;(5)向量自回归模型(V AR ,vector autoregression )。 一、V AR 的估计 V AR 方法论同时考虑几个内生变量,它看起来类似于联立方程模型。但是,在V AR 模型中,每一个内生变量都是由它的滞后或过去值以及模型中所有其他内生变量的滞后或过去值来解释。通常模型中没有任何外生变量。在联立方程模型中,我们把一些变量看作内生的,而另一些变量看作外生的或预定的,在估计这些模型之前,必须肯定方程组中的方程是可识别的,而为达到识别的目的,常常要假定某些预定变量仅出现在某些方程之中,这些决定往往是主观的,因此这种方法受到C.A.西姆斯(Christopher Sims )的严厉批评,他认为如果在一组变量中有真实的联立性,这些变量就应该平等对待,而不应事先区分内生和外生变量,以此思路,其推出了V AR 模型。 例我们想考虑中国的货币(M1)与利率(R )的关系。如果通过格兰杰因果关系检验,我们无法拒绝两者之间有双向因果关系的假设,即M1 影响R ,而R 反过来又影响M1,这种情形是应用V AR 的理想情形。假定每个方程都含有M1 和R 的k 个滞后值作为回归元,每个方程都可以用OLS 去估计,实际模型如下: 11111k k t j t j j t j t j j M M R u αβγ--===+++∑∑

2111k k t j t j j t j t j j R M R u αθλ--=='=+++∑∑ 其中u 是随机误差项,在V AR 术语中称为脉冲值(impulses )。在估计以上方程时,必须先决定最大滞后长度,这是一个经验问题,包括过多的滞后项将消耗自由度,而且会引入多重共线性的可能性,而包含过少的滞后值将导致设定误差,解决这个问题的方法之一就是使用赤池、施瓦茨或汉南—奎因准则中的某一个准则,并选择准则最低值的模型,因此,这个过程中试错法就不可避免。 值得注意的是,向量自回归模型中同时引入同一变量的几个滞后项,可能因多重共线性而使每个估计系数在统计上都不显著,但基于F 检验它们可能是联合显著的。 二、V AR 建模的一些问题 V AR 的倡导者强调此法有如下的优点:(1)方法简单,无需决定哪些变量是内生的,哪些变量是外生的,V AR 中的全部变量都是内生的。(2)估计简单:常用的OLS 法可以用于逐个估计每一个方程。 (3)在许多案例中,此方法得到的预测优于用更复杂的联立方程模型得到的预测。 但V AR 建模的批评者指出如下的一些问题: 1、不同于联立方程模型,V AR 利用较少的先验信息,所有是缺乏理论支撑的,因为在联立方程中排除或包含某些变量,对模型的识别起到关键性作用。 2、由于重点放到预测,V AR 模型不适合用于政策分析。 3、实际上,对V AR 建模最大的挑战在于选择适当滞后长度。假

支持向量机等各种算法和模型的优点和缺点

1决策树(Decision Trees)的优缺点 决策树的优点: 一、决策树易于理解和解释.人们在通过解释后都有能力去理解决策树所表达的意义。 二、对于决策树,数据的准备往往是简单或者是不必要的.其他的技术往往要求先把数据一般化,比如去掉多余的或者空白的属性。 三、能够同时处理数据型和常规型属性。其他的技术往往要求数据属性的单一。 四、决策树是一个白盒模型。如果给定一个观察的模型,那么根据所产生的决策树很容易推出相应的逻辑表达式。 五、易于通过静态测试来对模型进行评测。表示有可能测量该模型的可信度。 六、在相对短的时间内能够对大型数据源做出可行且效果良好的结果。 七、可以对有许多属性的数据集构造决策树。 八、决策树可很好地扩展到大型数据库中,同时它的大小独立于数据库的大小。 决策树的缺点: 一、对于那些各类别样本数量不一致的数据,在决策树当中,信息增益的结果偏向于那些具有更多数值的特征。 二、决策树处理缺失数据时的困难。 三、过度拟合问题的出现。 四、忽略数据集中属性之间的相关性。 2 人工神经网络的优缺点 人工神经网络的优点:分类的准确度高,并行分布处理能力强,分布存储及学习能力强,对噪声神经有较强的鲁棒性和容错能力,能充分逼近复杂的非线性关系,具备联想记忆的功能等。人工神经网络的缺点:神经网络需要大量的参数,如网络拓扑结构、权值和阈值的初始值;不能观察之间的学习过程,输出结果难以解释,会影响到结果的可信度和可接受程度;学习时间过长,甚至可能达不到学习的目的。 3 遗传算法的优缺点 遗传算法的优点: 一、与问题领域无关切快速随机的搜索能力。 二、搜索从群体出发,具有潜在的并行性,可以进行多个个体的同时比较,鲁棒性好。 三、搜索使用评价函数启发,过程简单。 四、使用概率机制进行迭代,具有随机性。 五、具有可扩展性,容易与其他算法结合。 遗传算法的缺点: 一、遗传算法的编程实现比较复杂,首先需要对问题进行编码,找到最优解之后还需要对问题进行解码, 二、另外三个算子的实现也有许多参数,如交叉率和变异率,并且这些参数的选择严重影响解的品质,而目前这些参数的选择大部分是依靠经验.没有能够及时利用网络的反馈信息,故算法的搜索速度比较慢,要得要较精确的解需要较多的训练时间。 三、算法对初始种群的选择有一定的依赖性,能够结合一些启发算法进行改进。 4 KNN算法(K-Nearest Neighbour) 的优缺点