基于深度学习的目标检测研究进展

基于深度学习的目标检测研究进展

原创2016-05-30深度学习大讲堂深度学习大讲堂

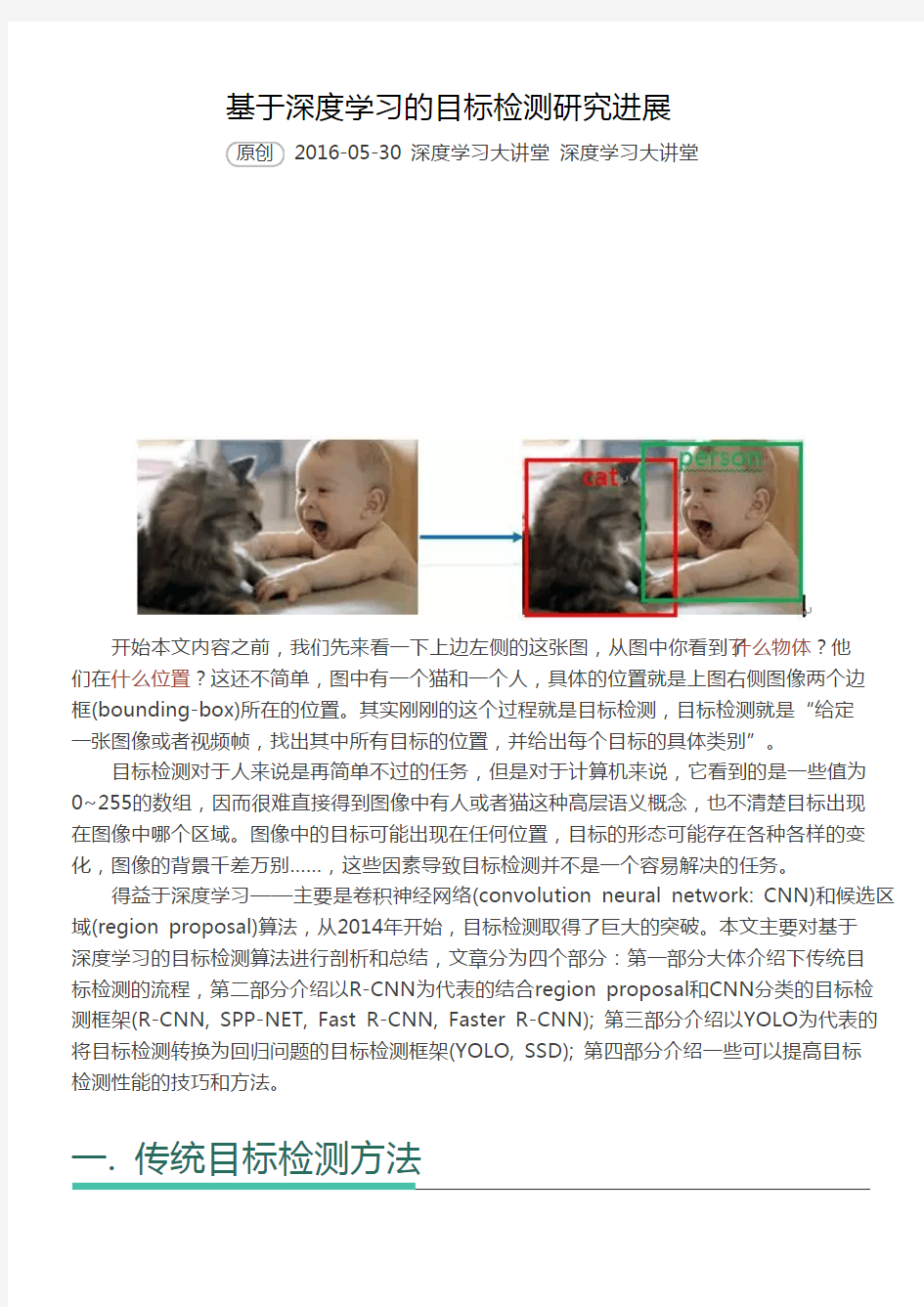

开始本文内容之前,我们先来看一下上边左侧的这张图,从图中你看到了什么物体?他们在什么位置?这还不简单,图中有一个猫和一个人,具体的位置就是上图右侧图像两个边框(bounding-box)所在的位置。其实刚刚的这个过程就是目标检测,目标检测就是“给定一张图像或者视频帧,找出其中所有目标的位置,并给出每个目标的具体类别”。

目标检测对于人来说是再简单不过的任务,但是对于计算机来说,它看到的是一些值为0~255的数组,因而很难直接得到图像中有人或者猫这种高层语义概念,也不清楚目标出现在图像中哪个区域。图像中的目标可能出现在任何位置,目标的形态可能存在各种各样的变化,图像的背景千差万别……,这些因素导致目标检测并不是一个容易解决的任务。

得益于深度学习——主要是卷积神经网络(convolution neural network: CNN)和候选区域(region proposal)算法,从2014年开始,目标检测取得了巨大的突破。本文主要对基于深度学习的目标检测算法进行剖析和总结,文章分为四个部分:第一部分大体介绍下传统目标检测的流程,第二部分介绍以R-CNN为代表的结合region proposal和CNN分类的目标检测框架(R-CNN, SPP-NET, Fast R-CNN, Faster R-CNN); 第三部分介绍以YOLO为代表的将目标检测转换为回归问题的目标检测框架(YOLO, SSD); 第四部分介绍一些可以提高目标检测性能的技巧和方法。

一. 传统目标检测方法

如上图所示,传统目标检测的方法一般分为三个阶段:首先在给定的图像上选择一些候选的区域,然后对这些区域提取特征,最后使用训练的分类器进行分类。下面我们对这三个阶段分别进行介绍。

(1) 区域选择

这一步是为了对目标的位置进行定位。由于目标可能出现在图像的任何位置,而且目标的大小、长宽比例也不确定,所以最初采用滑动窗口的策略对整幅图像进行遍历,而且需要设置不同的尺度,不同的长宽比。这种穷举的策略虽然包含了目标所有可能出现的位置,但是缺点也是显而易见的:时间复杂度太高,产生冗余窗口太多,这也严重影响后续特征提取和分类的速度和性能。(实际上由于受到时间复杂度的问题,滑动窗口的长宽比一般都是固定的设置几个,所以对于长宽比浮动较大的多类别目标检测,即便是滑动窗口遍历也不能得到很好的区域)

(2) 特征提取

由于目标的形态多样性,光照变化多样性,背景多样性等因素使得设计一个鲁棒的特征并不是那么容易。然而提取特征的好坏直接影响到分类的准确性。(这个阶段常用的特征有SIFT、HOG等)

(3) 分类器

主要有SVM, Adaboost等。

总结:传统目标检测存在的两个主要问题:一个是基于滑动窗口的区域选择策略没有针对性,时间复杂度高,窗口冗余;二是手工设计的特征对于多样性的变化并没有很好的鲁棒性。

二. 基于Region Proposal的深度学习目标检测算法

对于传统目标检测任务存在的两个主要问题,我们该如何解决呢?

对于滑动窗口存在的问题,region proposal提供了很好的解决方案。region proposal(候选区域)是预先找出图中目标可能出现的位置。但由于region proposal利用了图像中的纹理、边缘、颜色等信息,可以保证在选取较少窗口(几千个甚至几百个)的情况下保持较高的召回率。这大大降低了后续操作的时间复杂度,并且获取的候选窗口要比滑动窗口的质量更高(滑动窗口固定长宽比)。比较常用的region proposal算法有selective Search和edge Boxes,如果想具体了解region proposal可以看一下PAMI2015的“What makes for effective detection proposals?”

有了候选区域,剩下的工作实际就是对候选区域进行图像分类的工作(特征提取+分类)。对于图像分类,不得不提的是2012年ImageNet大规模视觉识别挑战赛(ILSVRC)上,机器学习泰斗Geoffrey Hinton教授带领学生Krizhevsky使用卷积神经网络将ILSVRC分

类任务的Top-5 error降低到了15.3%,而使用传统方法的第二名top-5 error高达 26.2%。此后,卷积神经网络占据了图像分类任务的绝对统治地位,微软最新的ResNet和谷歌的Inception V4模型的top-5 error降到了4%以内多,这已经超越人在这个特定任务上的能力。所以目标检测得到候选区域后使用CNN对其进行图像分类是一个不错的选择。

2014年,RBG(Ross B. Girshick)大神使用region proposal+CNN代替传统目标检测使用的滑动窗口+手工设计特征,设计了R-CNN框架,使得目标检测取得巨大突破,并开启了基于深度学习目标检测的热潮。

2 1. R-CNN (CVPR2014, TPAMI2015)

(Region-based Convolution Networks for Accurate Object detection and Segmentation)

上面的框架图清晰的给出了R-CNN的目标检测流程:

(1) 输入测试图像

(2) 利用selective search算法在图像中提取2000个左右的region proposal。

(3) 将每个region proposal缩放(warp)成227x227的大小并输入到CNN,将CNN的fc7层的输出作为特征。

(4) 将每个region proposal提取到的CNN特征输入到SVM进行分类。

针对上面的框架给出几点解释:

* 上面的框架图是测试的流程图,要进行测试我们首先要训练好提取特征的CNN模型,以及用于分类的SVM:使用在ImageNet上预训练的模型(AlexNet/VGG16)进行微调得到用于特征提取的CNN模型,然后利用CNN模型对训练集提特征训练SVM。

* 对每个region proposal缩放到同一尺度是因为CNN全连接层输入需要保证维度固定。* 上图少画了一个过程——对于SVM分好类的region proposal做边框回归(bounding-box regression),边框回归是对region proposal进行纠正的线性回归算法,为了让region proposal提取到的窗口跟目标真实窗口更吻合。因为region proposal提取到的窗口不可能跟人手工标记那么准,如果region proposal跟目标位置偏移较大,即便是分类正确了,但是由于IoU(region proposal与Ground Truth的窗口的交集比并集的比值)低于0.5,那么相当于目标还是没有检测到。

小结:R-CNN在PASCAL VOC2007上的检测结果从DPM HSC的34.3%直接提升到了66%(mAP)。如此大的提升使我们看到了region proposal+CNN的巨大优势。

但是R-CNN框架也存在着很多问题:

(1) 训练分为多个阶段,步骤繁琐: 微调网络+训练SVM+训练边框回归器

(2) 训练耗时,占用磁盘空间大:5000张图像产生几百G的特征文件

(3) 速度慢: 使用GPU, VGG16模型处理一张图像需要47s。

针对速度慢的这个问题,SPP-NET给出了很好的解决方案。

3 1. SPP-NET (ECCV2014, TPAMI2015)

(Spatial Pyramid Pooling in Deep Convolutional Networks for Visual Recognition) 先看一下R-CNN为什么检测速度这么慢,一张图都需要47s!仔细看下R-CNN框架发现,对图像提完region proposal(2000个左右)之后将每个proposal当成一张图像进行后续处理(CNN提特征+SVM分类),实际上对一张图像进行了2000次提特征和分类的过程! 有没有方法提速呢?好像是有的,这2000个region proposal不都是图像的一部分吗,那么我们完全可以对图像提一次卷积层特征,然后只需要将region proposal在原图的位置映射到卷积层特征图上,这样对于一张图像我们只需要提一次卷积层特征,然后将每个region proposal的卷积层特征输入到全连接层做后续操作。(对于CNN来说,大部分运算都耗在卷积操作上,这样做可以节省大量时间)。现在的问题是每个region proposal的尺度不一样,直接这样输入全连接层肯定是不行的,因为全连接层输入必须是固定的长度。SPP-NET 恰好可以解决这个问题:

上图对应的就是SPP-NET的网络结构图,任意给一张图像输入到CNN,经过卷积操作我

们可以得到卷积特征(比如VGG16最后的卷积层为conv5_3,共产生512张特征图)。图中的window是就是原图一个region proposal对应到特征图的区域,只需要将这些不同大小window的特征映射到同样的维度,将其作为全连接的输入,就能保证只对图像提取一次卷积层特征。SPP-NET使用了空间金字塔采样(spatial pyramid pooling):将每个window 划分为4*4, 2*2, 1*1的块,然后每个块使用max-pooling下采样,这样对于每个window经过SPP层之后都得到了一个长度为(4*4+2*2+1)*512维度的特征向量,将这个作为全连接层的输入进行后续操作。

小结:使用SPP-NET相比于R-CNN可以大大加快目标检测的速度,但是依然存在着很多问题:

(1) 训练分为多个阶段,步骤繁琐: 微调网络+训练SVM+训练训练边框回归器

(2) SPP-NET在微调网络的时候固定了卷积层,只对全连接层进行微调,而对于一个新的任务,有必要对卷积层也进行微调。(分类的模型提取的特征更注重高层语义,而目标检测任务除了语义信息还需要目标的位置信息)

针对这两个问题,RBG又提出Fast R-CNN, 一个精简而快速的目标检测框架。

4 1. Fast R-CNN(ICCV2015)

有了前边R-CNN和SPP-NET的介绍,我们直接看Fast R-CNN的框架图:

与R-CNN框架图对比,可以发现主要有两处不同:一是最后一个卷积层后加了一个ROI pooling layer,二是损失函数使用了多任务损失函数(multi-task loss),将边框回归直接加入到CNN网络中训练。

(1) ROI pooling layer实际上是SPP-NET的一个精简版,SPP-NET对每个proposal使用了不同大小的金字塔映射,而ROI pooling layer只需要下采样到一个7x7的特征图。对于VGG16网络conv5_3有512个特征图,这样所有region proposal对应了一个7*7*512维度的特征向量作为全连接层的输入。

(2) R-CNN训练过程分为了三个阶段,而Fast R-CNN直接使用softmax替代SVM分类,同时利用多任务损失函数边框回归也加入到了网络中,这样整个的训练过程是端到端的(除去region proposal提取阶段)。

(3) Fast R-CNN在网络微调的过程中,将部分卷积层也进行了微调,取得了更好的检测效

果。

小结:Fast R-CNN融合了R-CNN和SPP-NET的精髓,并且引入多任务损失函数,使整个网络的训练和测试变得十分方便。在Pascal VOC2007训练集上训练,在VOC2007测试的结果为66.9%(mAP),如果使用VOC2007+2012训练集训练,在VOC2007上测试结果为70%(数据集的扩充能大幅提高目标检测性能)。使用VGG16每张图像总共需要3s左右。 缺点:region proposal的提取使用selective search,目标检测时间大多消耗在这上面(提region proposal 2~3s,而提特征分类只需0.32s),无法满足实时应用,而且并没有实现真正意义上的端到端训练测试(region proposal使用selective search先提取处来)。那么有没有可能直接使用CNN直接产生region proposal并对其分类?Faster R-CNN框架就是符合这样需要的目标检测框架。

5 1. Faster R-CNN(NIPS2015)

(Faster R-CNN: Towards Real-Time Object Detection with Region Proposal Networks)

在region proposal + CNN分类的这种目标检测框架中,region proposal质量好坏直接影响到目标检测任务的精度。如果找到一种方法只提取几百个或者更少的高质量的预选窗口,而且召回率很高,这不但能加快目标检测速度,还能提高目标检测的性能(假阳例少)。RPN(Region Proposal Networks)网络应运而生。

RPN的核心思想是使用卷积神经网络直接产生region proposal,使用的方法本质上就是滑动窗口。RPN的设计比较巧妙,RPN只需在最后的卷积层上滑动一遍,因为anchor机制和边框回归可以得到多尺度多长宽比的region proposal。

我们直接看上边的RPN网络结构图(使用了ZF模型),给定输入图像(假设分辨率为600*1000),经过卷积操作得到最后一层的卷积特征图(大小约为40*60)。在这个特征图上使用3*3的卷积核(滑动窗口)与特征图进行卷积,最后一层卷积层共有256个feature

map,那么这个3*3的区域卷积后可以获得一个256维的特征向量,后边接cls layer和reg layer分别用于分类和边框回归(跟Fast R-CNN类似,只不过这里的类别只有目标和背景两个类别)。3*3滑窗对应的每个特征区域同时预测输入图像3种尺度(128,256,512),3种长宽比(1:1,1:2,2:1)的region proposal,这种映射的机制称为anchor。所以对于这个40*60的feature map,总共有约20000(40*60*9)个anchor,也就是预测20000个region proposal。

这样设计的好处是什么呢?虽然现在也是用的滑动窗口策略,但是:滑动窗口操作是在卷积层特征图上进行的,维度较原始图像降低了16*16倍(中间经过了4次2*2的pooling操作);多尺度采用了9种anchor,对应了三种尺度和三种长宽比,加上后边接了边框回归,所以即便是这9种anchor外的窗口也能得到一个跟目标比较接近的region proposal。

NIPS2015版本的Faster R-CNN使用的检测框架是RPN网络+Fast R-CNN网络分离进行的目标检测,整体流程跟Fast R-CNN一样,只是region proposal现在是用RPN网络提取的(代替原来的selective search)。同时作者为了让RPN的网络和Fast R-CNN网络实现卷积层的权值共享,训练RPN和Fast R-CNN的时候用了4阶段的训练方法:

(1) 使用在ImageNet上预训练的模型初始化网络参数,微调RPN网络;

(2) 使用(1)中RPN网络提取region proposal训练Fast R-CNN网络;

(3) 使用(2)的Fast R-CNN网络重新初始化RPN, 固定卷积层进行微调;

(4) 固定(2)中Fast R-CNN的卷积层,使用(3)中RPN提取的region proposal微调网络。 权值共享后的RPN和Fast R-CNN用于目标检测精度会提高一些。

使用训练好的RPN网络,给定测试图像,可以直接得到边缘回归后的region proposal,根据region proposal的类别得分对RPN网络进行排序,并选取前300个窗口作为Fast R-CNN的输入进行目标检测,使用VOC07+12训练集训练,VOC2007测试集测试mAP达到73.2%(selective search + Fast R-CNN是70%), 目标检测的速度可以达到每秒5帧(selective search+Fast R-CNN是2~3s一张)。

需要注意的是,最新的版本已经将RPN网络和Fast R-CNN网络结合到了一起——将RPN 获取到的proposal直接连到ROI pooling层,这才是一个真正意义上的使用一个CNN网络实现端到端目标检测的框架。

小结:Faster R-CNN将一直以来分离的region proposal和CNN分类融合到了一起,使用端到端的网络进行目标检测,无论在速度上还是精度上都得到了不错的提高。然而Faster R-CNN还是达不到实时的目标检测,预先获取region proposal,然后在对每个proposal分类计算量还是比较大。比较幸运的是YOLO这类目标检测方法的出现让实时性也变的成为可能。

总的来说,从R-CNN, SPP-NET, Fast R-CNN, Faster R-CNN一路走来,基于深度学习目标检测的流程变得越来越精简,精度越来越高,速度也越来越快。可以说基于region proposal的R-CNN系列目标检测方法是当前目标最主要的一个分支。

三. 基于回归方法的深度学习目标检测算法

Faster R-CNN的方法目前是主流的目标检测方法,但是速度上并不能满足实时的要求。YOLO一类的方法慢慢显现出其重要性,这类方法使用了回归的思想,既给定输入图像,直接在图像的多个位置上回归出这个位置的目标边框以及目标类别。

1YOLO (CVPR2016, oral)

(You Only Look Once: Unified, Real-Time Object Detection)

我们直接看上面YOLO的目标检测的流程图:

(1) 给个一个输入图像,首先将图像划分成7*7的网格

(2) 对于每个网格,我们都预测2个边框(包括每个边框是目标的置信度以及每个边框区域在多个类别上的概率)

(3) 根据上一步可以预测出7*7*2个目标窗口,然后根据阈值去除可能性比较低的目标窗口,最后NMS去除冗余窗口即可。

可以看到整个过程非常简单,不需要中间的region proposal在找目标,直接回归便完成了位置和类别的判定。

那么如何才能做到直接在不同位置的网格上回归出目标的位置和类别信息呢?上面是YOLO的网络结构图,前边的网络结构跟GoogLeNet的模型比较类似,主要的是最后两层的结构,卷积层之后接了一个4096维的全连接层,然后后边又全连接到一个7*7*30维的张量上。实际上这7*7就是划分的网格数,现在要在每个网格上预测目标两个可能的位置以及这个位置的目标置信度和类别,也就是每个网格预测两个目标,每个目标的信息有4维坐标信息(中心点坐标+长宽),1个是目标的置信度,还有类别数20(VOC上20个类别),总共就是(4+1)*2+20 = 30维的向量。这样可以利用前边4096维的全图特征直接在每个网格上回归出目标检测需要的信息(边框信息加类别)。

小结:YOLO将目标检测任务转换成一个回归问题,大大加快了检测的速度,使得YOLO 可以每秒处理45张图像。而且由于每个网络预测目标窗口时使用的是全图信息,使得false positive比例大幅降低(充分的上下文信息)。但是YOLO也存在问题:没有了region proposal机制,只使用7*7的网格回归会使得目标不能非常精准的定位,这也导致了YOLO 的检测精度并不是很高。

2SSD

(SSD: Single Shot MultiBox Detector)

上面分析了YOLO存在的问题,使用整图特征在7*7的粗糙网格内回归对目标的定位并不是很精准。那是不是可以结合region proposal的思想实现精准一些的定位?SSD结合YOLO 的回归思想以及Faster R-CNN的anchor机制做到了这点。

上图是SSD的一个框架图,首先SSD获取目标位置和类别的方法跟YOLO一样,都是使用回归,但是YOLO预测某个位置使用的是全图的特征,SSD预测某个位置使用的是这个位置周围的特征(感觉更合理一些)。那么如何建立某个位置和其特征的对应关系呢?可能你已经想到了,使用Faster R-CNN的anchor机制。如SSD的框架图所示,假如某一层特征图(图b)大小是8*8,那么就使用3*3的滑窗提取每个位置的特征,然后这个特征回归得到目标的坐标信息和类别信息(图c)。

不同于Faster R-CNN,这个anchor是在多个feature map上,这样可以利用多层的特征并且自然的达到多尺度(不同层的feature map 3*3滑窗感受野不同)。

小结:SSD结合了YOLO中的回归思想和Faster R-CNN中的anchor机制,使用全图各个位置的多尺度区域特征进行回归,既保持了YOLO速度快的特性,也保证了窗口预测的跟Faster R-CNN一样比较精准。SSD在VOC2007上mAP可以达到72.1%,速度在GPU上达到58帧每秒。

总结:YOLO的提出给目标检测一个新的思路,SSD的性能则让我们看到了目标检测在实际应用中真正的可能性。

四. 提高目标检测方法

R-CNN系列目标检测框架和YOLO目标检测框架给了我们进行目标检测的两个基本框架。除此之外,研究人员基于这些框架从其他方面入手提出了一系列提高目标检测性能的方法。

(1) 难分样本挖掘(hard negative mining)

R-CNN在训练SVM分类器时使用了难分样本挖掘的思想,但Fast R-CNN和Faster R-CNN由于使用端到端的训练策略并没有使用难分样本挖掘(只是设置了正负样本的比例并随机抽取)。CVPR2016的Training Region-based Object Detectors with Online Hard Example Mining(oral)将难分样本挖掘(hard example mining)机制嵌入到SGD算法中,使得Fast R-CNN在训练的过程中根据region proposal的损失自动选取合适的region proposal作为正负例训练。实验结果表明使用OHEM(Online Hard Example Mining)机制可以使得Fast R-CNN算法在VOC2007和VOC2012上mAP提高 4%左右。

(2) 多层特征融合

Fast R-CNN和Faster R-CNN都是利用了最后卷积层的特征进行目标检测,而由于高层的卷积层特征已经损失了很多细节信息(pooling操作),所以在定位时不是很精准。HyperNet等一些方法则利用了CNN的多层特征融合进行目标检测,这不仅利用了高层特征的语义信息,还考虑了低层特征的细节纹理信息,使得目标检测定位更精准。

(3) 使用上下文信息

在提取region proposal特征进行目标检测时,结合region proposal上下文信息,检测效果往往会更好一些。(Object detection via a multi-region & semantic segmentation-aware CNN model以及Inside-Outside Net等论文中都使用了上下文信息)

江南营_江南深度研学之旅(1)

诗梦江南,入画寻踪 ——长清区实验小学江南深度研学实践之旅 【课程简介】 一道水,一架桥,一支橹声,隽秀婉约的聚合了太多的历史文化。此次研学活动旨在让同学们了解祖国江南,同时感受一场从远古传说,到春秋的吴越文化,到南北朝的文人风骨,再到明清以及近代的大儒伟人的历史盛宴。活动中,同学们将一起寻访王羲之、蔡元培、鲁迅、周恩来等名人伟人故里,穿越历史,冶爱国之志,体悟文化魅力;一起走进园,欣赏宋代江南私家园林的秀美景观,探寻园林蕴含的文化涵;一起游历西湖,领略“淡妆浓抹总相宜”的如画美景;一起走进综合性人文科学博物馆博物馆、中国黄酒博物馆,全面了解历史文化。 【课程特色】 ●文化名镇江南风采 ●穿越时空触摸历史 【行程简表】

上午探访安昌古镇漫游小桥流水梦回江南水乡游历江南小镇,画笔描绘 第五天 下午乘坐高铁前往:车次G60东-西 15:22-19:48辅导员送站一次相聚一生情谊备注:因天气交通等原因,组委会保留调整活动顺序及个别项目的权力,保证活动总量不变。 【活动费用】 2900/人;包含火车(往返高铁)及活动期间所有的费用。 ?【人文积淀-理性思维】·第一天下午·钱塘江·六和塔 钱塘江潮被誉为“天下第一潮”,是世界一大自然奇观,它是天体引力和地球自转的离心作用,加上湾喇叭口的特殊地形所造成的特大涌潮。六和塔位于省市西湖之南,钱塘江畔 月轮山上,是中国现存最完好的砖木结构古塔之一。 小任务1:学生面对浩渺的钱塘江,接受审美教育,并结合手册提示,探究钱塘江大潮的在科学原理; 小任务2:学生走进六和塔,收集关于六和塔的传说故事,留下自己与六和塔最美的合照; ?【审美情趣-人文积淀】·第二天上午·西湖·省博物馆 西湖,是一首诗,一幅天然图画,一个美丽动人的故事,不论是多年居住在这里的人还是匆匆而过的旅人,无不为这天下无双的美景所倾倒。平湖秋月、断桥残雪、柳浪闻莺、花 港观鱼、雷峰夕照、双峰插云、南屏晚钟、三潭印月,西湖十景个擅其胜。省博物馆是省规 模最大的综合性人文科学博物馆,文物品类丰富,年代序列完整。 小任务1:集体创绘,全体学生齐动手,集体协作,面对美景,协作创作最美的西湖; 小任务2:走进博物馆,寻访国宝,找一找最能代表江南文化的文物,向小组同学分享并交流;

基于深度学习的目标检测技术

基于深度学习的目标检测技术 基于深度学习的目标检测技术演进:R-CNN、Fast R-CNN、Faster R-CNN 在过去的几年中,典型的PASCAL VOC数据集上测量的对象检测性能已经趋于平稳。最好的执行方法是复杂的集成系统,通常结合多个低级别的图像特征与高层次的背景。在本文中,我们提出了一个简单的和可扩展的检测算法,提高了平均准确率(MAP)超过30%,相对于先前的最佳结果VOC 2012实现53.3%的平均准确率。我们的方法结合了两个关键的见解:(1)可以将高容量卷积神经网络(CNNs)应用到自下而上的区域建议中,以便定位和分割对象;(2)当标记的训练数据很少时,监督辅助任务的预训练,然后进行特定领域的微调,可以显著提升性能。由于我们将区域建议与CNNs结合起来,我们称我们的方法为RNCN:具有卷积神经网络特征的区域。我们还将R-CNN与OverFeat进行比较,最近提出的滑动窗口检测器基于类似的卷积神经网络架构。我们发现R-CNN在200级ILSVRC2013检测数据集上大大优于OverFeat。 object detection我的理解,就是在给定的图片中精确找到物体所在位置,并标注出物体的类别。object detection要解决的问题就是物体在哪里,是什么这整个流程的问题。然而,这个问题可不是那么容易解决的,物体的尺寸变化范围很大,摆放物体的角度,姿态不定,而且可以出现在图片的任何地方,更何况物体还可以是多个类别。 object detection技术的演进: RCNN->SppNET->Fast-RCNN->Faster-RCNN 从图像识别的任务说起 这里有一个图像任务: 既要把图中的物体识别出来,又要用方框框出它的位置。

深度学习的研究

深度学习的研究 1、定义和背景: 1.1 深度学习(DL)有各种相近的定义或者高层次描述 自2006年以来,深度学习(deep learning)(也通常叫做深层结构学习或分层学习)已经成为机器学习领域的一个新兴领域(Hinton et al., 2006; Bengio, 2009 ).在过去几年中,深度学习技术的发展已经对信号和信息过程领域产生广泛的影响,并将继续影响到机器学习和人工智能的其它关键领域;参见综述文章(Bengio et al., 2013; Hinton et al., 2012; Yu and Deng, 2 011; Deng, 2011; Arel et al., 2010 ).最近,已有一系列的致力于关于深度学习以及应用的研讨会和特别会议。包括: 这些研究团队在DL的各种不同应用中取得经验性的成功,如计算机视觉、语音识别、语音搜索、语音识别、语音会话和图像特征编码、语义分类、手写识别话语、音频处理、信息检索、机器人学、甚至在分析可能导致新药的分子方面等等。许多优秀的经常更新教程、 传统机器学习和信号处理技术探索仅含单层非线性变换的浅层学习结构。浅层模型的一个共性是仅含单个将原始输入信号转换到特定问题空间特征的简单结构。典型的浅层学习结构包括传统隐马尔可夫模型(HMM)、条件随机场(CRFs)、最大熵模型(MaxEnt)、支持向量机(SVM)、核回归及仅含单隐层的多层感知器(MLP)等。例如,SVM用包含一层(使用核技巧)或者零个特征转换层的浅层模式分离模型。(最近已有将核方法与DL结合的新方法。如,Cho and Saul, 2009; Deng et al., 2012; Vinyals et al., 201 2)。浅层结构的局限性在于有限的样本和计算单元情况下对复杂函数的表示能力有限,针对复杂分类问题其泛化能力受到一定制约。 神经科学研究表明,人的视觉系统的信息处理是分级的。人类感知系统这种明确的层次结构极大地降低了视觉系统处理的数据量,并保留了物体有用的结构信息。有理由相信,对于要提取具有潜在复杂结构规则的自然图像、视频、语音和音乐等结构丰富数据,深度学习能够获取其本质特征。受大脑结构分层次启发,神经网络研究人员一直致力于多层神经网络的研究。 历史上,深层学习的概念起源于神经网络的研究。带有多隐层的前馈神经网络或者多层感知器通常被成为深层神经网络(DNNs),DNNs就是深层构架的一个很好的例子。BP算法作为传统训练多层网络的典型算法,实际上对于仅含几层网络,该训练方法就已很不理想(参见(Bengio, 2009; Glorot and Bengio, 2010). 在学习中,一个主要的困难源于深度网络的非凸目标函数的局部极小点普遍存在。反向传播是基于局部梯度下降,通常随机选取初始点。使用批处理BP算法通常会陷入局部极小点,而且随着网络深度的增加,这种现象更加严重。此原因在一定程度上阻碍了深度学习的发展,并将大多数机器学习和信号处理研究从神经网络转移到相对较容易训练的浅层学习结构。 经验上,有3种技术可以处理深层模型的优化问题:1.大量的隐藏的单元,2.更好的学习算法,3.以及更好的参数初始化技术。

基于小波变换的图像边缘检测算法

基于小波变换的图像边缘检测算法仿真实 现 学生姓名:XX 指导教师:xxx 专业班级:电子信息 学号:00000000000 学院:计算机与信息工程学院 二〇一五年五月二十日

摘要 数字图像边缘检测是图像分割、目标区域识别和区域形态提取等图像分析领域中十分重要的基础,是图像识别中提取图像特征一个重要方法。 目前在边缘检测领域已经提出许多算法,但是提出的相关理论和算法仍然存在很多不足之处,在某些情况下仍然无法很有效地检测出目标物的边缘。由于小波变换在时域和频域都具有很好的局部化特征,并且具有多尺度特征,因此,利用多尺度小波进行边缘检测既能得到良好的抑制噪声的能力,又能够保持边缘的完备。 本文就是利用此方法在MATLAB环境下来对数字图像进行边缘的检测。 关键词:小波变换;多尺度;边缘检测

Abstract The boundary detection of digital image is not only the important foundation in the field of image segmentation and target area identification and area shape extraction, but also an important method which extract image feature in image recognition. Right now, there are a lot of algorithms in the field of edge detection, but these algorithms also have a lot of shotucuts, sometimes, they are not very effective to check the boundary of the digital image. Wavelet transform has a good localization characteristic in the time domain and frequency domain and multi-scale features, So, the boundary detection of digital image by using multi-scale wavelet can not only get a good ability to suppress noise, but also to maintain the completeness of the edge. This article is to use this method in the environment of MATLAB to detect the boundary of the digital image. Keywords: wavelet transform; multi-scale; boundary detection.

研学方案

“研学旅行”实施方案 一、项目实施背景 从2013年发布《国民休闲旅游纲要》到2016年的《关于推进中小学生研学旅行的意见》,国家教育部等多部门发文要求大力推进研学旅行。研学旅行有利于促进学生培育和践行社会主义核心价值观,激发学生对党、对国家、对人民的热爱之情;有利于推动全面实施素质教育,创新人才培养模式,引导学生主动适应社会,促进书本知识和生活经验的深度融合;有利于加快提高人民生活质量,满足学生日益增长的旅游需求,从小培养学生文明旅游意识,养成文明旅游行为习惯。近年来,各地积极探索开展研学旅行,部分试点地区取得显著成效,在促进学生健康成长和全面发展等方面发挥了重要作用。二、定位与宗旨 目前大多数研学旅行还处在研究开发状态,良莠不齐,市场认可度不够,家长热度不高(尤其省内)。这是我们的机遇,也是挑战,我们的定位是要打造出一个学校认可、家长认可、学生认可的研学品牌,让学生在研学中学到东西。 三、具体实施 (一)方案A:纯旅游研学 本方案以若干旅游景点为研学地点,前期采取跟旅行社合作的方式(合作方式有待探讨),研学的核心(课件+“内容”)内容采取跟大学历史系或者旅游系的老师合作。 该方案的优点:该方案采用跟旅行社合作,研学路线可以借用

旅行社的优势,资源充分整合,老师和家长的路线选择多,可以极大丰富学生的课外知识,并且可以开展夏令营和冬令营活动。缺点是要综合考虑各个年龄段的学生,路线过多,会导致前期工作准备不够充足。 方案细节初步安排如下: 1、前期工作(3月20日-3月30日): (1)与某个旅行社达成合作关系(目前有合作意向的有康辉旅行社); (2)与某个大学的历史或者旅游系老师达成合作关系,负责研学核心内容的开发,包括路线的选择和内容的开发 (3)完成计划的策划和确定具体实施细节。 2、中期工作(4月1日-5月30日) (1)4月1日-4月15日与旅行社和老师确定最终的研学路线; (2)4月15日-5月30日一个半月的时间根据最终具体的研学路线,来做具体的研学课件和研学内容,研究出研学到底应该让学生学到什么,怎么保证学生能学到这些; (3)同时根据最终确定的研学方案做好定价方案,在这个过程中要充分进行调研,进学校、访家长,做到收费合理; (4)根据做好的方案做好线上推广,把做好的资料全部上传到线上,可以参考北京世纪明德。

使用深度学习和OpenCV 进行视频目标检测

使用深度学习和OpenCV 进行视频目标检测 使用 OpenCV 和 Python 上对实时视频流进行深度学习目标检测是非常简单的,我们只需要组合一些合适的代码,接入实时视频,随后加入原有的目标检测功能。 本文分两个部分。在第一部分中,我们将学习如何扩展原有的目标检测项目,使用深度学习和 OpenCV 将应用范围扩展到实时视频流和视频文件中。这个任务会通过 VideoStream 类来完成。 深度学习目标检测教程:http://pyimagesearch/2017/09/11/object-detection-with-deep-learning-and-opencv/ VideoStream 类教程:http://pyimagesearch/2016/01/04/unifying-picamera-and-cv2-videocapture-into-a-single-class-w ith-opencv/ 现在,我们将开始把深度学习+目标检测的代码应用于视频流中,同时测量 FPS 处理速度。使用深度学习和 OpenCV 进行视频目标检测 为了构建基于 OpenCV 深度学习的实时目标检测器,我们需要有效地接入摄像头/视频流,并将目标检测应用到每一帧里。 首先,我们打开一个新文件,将其命名为 real_time_object_detection.py,随后加入以下代码: 我们从第 2-8 行开始导入封包。在此之前,你需要 imutils 和 OpenCV 3.3。在系统设置上,你只需要以默认设置安装 OpenCV 即可(同时确保你遵循了所有 Python 虚拟环境命令)。Note:请确保自己下载和安装的是 OpenCV 3.3(或更新版本)和 OpenCV-contrib 版本(适用于 OpenCV 3.3),以保证其中包含有深度神经网络模块。 下面,我们将解析这些命令行参数: 与此前的目标检测项目相比,我们不需要图像参数,因为在这里我们处理的是视频流和视频——除了以下参数保持不变:

数字图像处理和边缘检测

中文译文 数字图像处理和边缘检测 1.数字图像处理 数字图像处理方法的研究源于两个主要应用领域:为便于人们分析而对图像信息进行改进;为使机 器自动理解而对图像数据进行存储、传输及显示。 一幅图像可定义为一个二维函数(,)f x y ,这里x 和y 是空间坐标,而在任何一对空间坐标(,)x y 上 的幅值f 称为该点图像的强度或灰度。当,x y 和幅值f 为有限的、离散的数值时,则图像为数字图像。数字图像处理是指借用数字计算机处理数字图像,值得提及的是数字图像是由有限的元素组成的,每一个元素都有一个特定的位置和幅值,这些元素称为图像元素、画面元素或像素。像素是广泛用于表示数字图像元素的词汇。 视觉是人类最高级的感知器官,所以,毫无疑问图像在人类感知中扮演着最重要的角色。然而,人 类感知只限于电磁波谱的视觉波段,成像机器则可覆盖几乎全部电磁波谱,从伽马射线到无线电波。它们可以对非人类习惯的那些图像源进行加工,这些图像源包括超声波、电子显微镜及计算机产生的图像。因此,数字图像处理涉及各种各样的应用领域。 图像处理涉及的范畴或其他相关领域(例如,图像分析和计算机视觉)的界定在初创人之间并没有 一致的看法。有时用处理的输入和输出内容都是图像这一特点来界定图像处理的范围。我们认为这一定义仅是人为界定和限制。例如,在这个定义下,甚至最普通的计算一幅图像灰度平均值的工作都不能算做是图像处理。另一方面,有些领域(如计算机视觉)研究的最高目标是用计算机去模拟人类视觉,包括理解和推理并根据视觉输入采取行动等。这一领域本身是人工智能的分支,其目的是模仿人类智能。人工智能领域处在其发展过程中的初期阶段,它的发展比预期的要慢的多,图像分析(也称为图像理解)领域则处在图像处理和计算机视觉两个学科之间。 从图像处理到计算机视觉这个连续的统一体内并没有明确的界线。然而,在这个连续的统一体中可 以考虑三种典型的计算处理(即低级、中级和高级处理)来区分其中的各个学科。 低级处理涉及初级操作,如降低噪声的图像预处理,对比度增强和图像尖锐化。低级处理是以输入、输出都是图像为特点的处理。中级处理涉及分割(把图像分为不同区域或目标物)以及缩减对目标物的描述,以使其更适合计算机处理及对不同目标的分类(识别)。中级图像处理是以输入为图像,但输出是从这些图像中提取的特征(如边缘、轮廓及不同物体的标识等)为特点的。最后,高级处理涉及在图像分析中被识别物体的总体理解,以及执行与视觉相关的识别函数(处在连续统一体边缘)等。 根据上述讨论,我们看到,图像处理和图像分析两个领域合乎逻辑的重叠区域是图像中特定区域或 物体的识别这一领域。这样,在研究中,我们界定数字图像处理包括输入和输出均是图像的处理,同时也包括从图像中提取特征及识别特定物体的处理。举一个简单的文本自动分析方面的例子来具体说明这一概念。在自动分析文本时首先获取一幅包含文本的图像,对该图像进行预处理,提取(分割)字符,然后以适合计算机处理的形式描述这些字符,最后识别这些字符,而所有这些操作都在本文界定的数字图像处理的范围内。理解一页的内容可能要根据理解的复杂度从图像分析或计算机视觉领域考虑问题。

江南营江南深度研学之旅1

江南营-江南深度研学之旅(1)

————————————————————————————————作者:————————————————————————————————日期:

诗梦江南,入画寻踪 ——长清区实验小学江南深度研学实践 之旅 【课程简介】 一道水,一架桥,一支橹声,隽秀婉约的杭州绍兴聚合了太多的历史文化。此次研学活动旨在让同学们了解祖国江南,同时感受一场从远古传说,到春秋的吴越文化,到南北朝的文人风骨,再到明清以及近代的大儒伟人的历史盛宴。活动中,同学们将一起寻访王羲之、蔡元培、鲁迅、周恩来等名人伟人故里,穿越历史,陶冶爱国之志,体悟文化魅力;一起走进沈园,欣赏宋代江南私家园林的秀美景观,探寻园林蕴含的文化内涵;一起游历西湖,领略“淡妆浓抹总相宜”的如画美景;一起走进综合性人文科学博物馆浙江博物馆、中国黄酒博物馆,全面了解浙江历史文化。 【课程特色】 ●文化名镇江南风采 ●穿越时空触摸历史 【行程简表】 时间课程安排课程主题课程链接 第一天上午乘坐高铁前往杭州:车次G63 济南-杭州东 07:23-11:53辅导员接站读万卷书行万里路下午参观钱塘江、六和塔看天下第一潮登镇潮六和塔追寻江畔的历史故事 晚上研学课程指导分组讨论课程,研学收获分享 实践-辅导员指导学生完成课程手 册 第二天上午 游历杭州西湖置身如画美景感受西湖柔情参观苏堤、孤山、曲院风荷 浙江博物馆参观历史展品考察浙江文化感受历史文化的沉淀 下午灵隐寺、飞来峰登山览胜景寺宇悟佛心登山参观庙宇,了解佛教文化 晚上研学课程指导分组讨论课程,研学收获分享实践-辅导员指导学生完成课程手册 第三天上午探访鲁迅故里探寻书中世界亲访三味书屋追寻鲁迅先生的足迹 下午 游览沈园漫步江南园林,探寻文化内涵 人文-体味江南风情/建筑-江南园林建 筑风格 参观黄酒博物馆参观历史文物体悟江南魅力历史-绍兴历史文化 晚上 大善塔 仓桥直街 漫步古城小道欣赏绍兴夜色实践-实地感受,见景抒情 第四天上午书圣故里历史街区历游文人旧地感受文化魅力人文-文人旧所、大家荟萃

基于深度学习的目标检测研究进展

基于深度学习的目标检测研究进展 原创2016-05-30深度学习大讲堂深度学习大讲堂 开始本文内容之前,我们先来看一下上边左侧的这张图,从图中你看到了什么物体?他们在什么位置?这还不简单,图中有一个猫和一个人,具体的位置就是上图右侧图像两个边框(bounding-box)所在的位置。其实刚刚的这个过程就是目标检测,目标检测就是“给定一张图像或者视频帧,找出其中所有目标的位置,并给出每个目标的具体类别”。 目标检测对于人来说是再简单不过的任务,但是对于计算机来说,它看到的是一些值为0~255的数组,因而很难直接得到图像中有人或者猫这种高层语义概念,也不清楚目标出现在图像中哪个区域。图像中的目标可能出现在任何位置,目标的形态可能存在各种各样的变化,图像的背景千差万别……,这些因素导致目标检测并不是一个容易解决的任务。 得益于深度学习——主要是卷积神经网络(convolution neural network: CNN)和候选区域(region proposal)算法,从2014年开始,目标检测取得了巨大的突破。本文主要对基于深度学习的目标检测算法进行剖析和总结,文章分为四个部分:第一部分大体介绍下传统目标检测的流程,第二部分介绍以R-CNN为代表的结合region proposal和CNN分类的目标检测框架(R-CNN, SPP-NET, Fast R-CNN, Faster R-CNN); 第三部分介绍以YOLO为代表的将目标检测转换为回归问题的目标检测框架(YOLO, SSD); 第四部分介绍一些可以提高目标检测性能的技巧和方法。 一. 传统目标检测方法

如上图所示,传统目标检测的方法一般分为三个阶段:首先在给定的图像上选择一些候选的区域,然后对这些区域提取特征,最后使用训练的分类器进行分类。下面我们对这三个阶段分别进行介绍。 (1) 区域选择 这一步是为了对目标的位置进行定位。由于目标可能出现在图像的任何位置,而且目标的大小、长宽比例也不确定,所以最初采用滑动窗口的策略对整幅图像进行遍历,而且需要设置不同的尺度,不同的长宽比。这种穷举的策略虽然包含了目标所有可能出现的位置,但是缺点也是显而易见的:时间复杂度太高,产生冗余窗口太多,这也严重影响后续特征提取和分类的速度和性能。(实际上由于受到时间复杂度的问题,滑动窗口的长宽比一般都是固定的设置几个,所以对于长宽比浮动较大的多类别目标检测,即便是滑动窗口遍历也不能得到很好的区域) (2) 特征提取 由于目标的形态多样性,光照变化多样性,背景多样性等因素使得设计一个鲁棒的特征并不是那么容易。然而提取特征的好坏直接影响到分类的准确性。(这个阶段常用的特征有SIFT、HOG等) (3) 分类器 主要有SVM, Adaboost等。 总结:传统目标检测存在的两个主要问题:一个是基于滑动窗口的区域选择策略没有针对性,时间复杂度高,窗口冗余;二是手工设计的特征对于多样性的变化并没有很好的鲁棒性。 二. 基于Region Proposal的深度学习目标检测算法 对于传统目标检测任务存在的两个主要问题,我们该如何解决呢? 对于滑动窗口存在的问题,region proposal提供了很好的解决方案。region proposal(候选区域)是预先找出图中目标可能出现的位置。但由于region proposal利用了图像中的纹理、边缘、颜色等信息,可以保证在选取较少窗口(几千个甚至几百个)的情况下保持较高的召回率。这大大降低了后续操作的时间复杂度,并且获取的候选窗口要比滑动窗口的质量更高(滑动窗口固定长宽比)。比较常用的region proposal算法有selective Search和edge Boxes,如果想具体了解region proposal可以看一下PAMI2015的“What makes for effective detection proposals?” 有了候选区域,剩下的工作实际就是对候选区域进行图像分类的工作(特征提取+分类)。对于图像分类,不得不提的是2012年ImageNet大规模视觉识别挑战赛(ILSVRC)上,机器学习泰斗Geoffrey Hinton教授带领学生Krizhevsky使用卷积神经网络将ILSVRC分

基于matlab的图像边缘检测算法研究和仿真设计

基于matlab的图像边缘检测算法研究和仿真 目录 第1章绪论 1 1.1 序言 1 1.2 数字图像边缘检测算法的意义 1 第2章传统边缘检测方法及理论基础 2 2.1 数字图像边缘检测的现状与发展 2 2.2 MATLAB和图像处理工具箱的背景知识 3 2.3 数字图像边缘检测关于边缘的定义 4 2.4 基于一阶微分的边缘检测算子 4 2.5 基于二阶微分的边缘检测算子 7 第3章编程和调试 10 3.1 edge函数 10 3.2 边缘检测的编程实现 11 第4章总结 13 第5章图像边缘检测应用领域 13 附录参考文献 15

第1章绪论 §1.1 序言 理解图像和识别图像中的目标是计算机视觉研究的中心任务,物体形状、物体边界、位置遮挡、阴影轮廓及表面纹理等重要视觉信息在图像中均有边缘产生。图像边缘是分析理解图像的基础,它是图像中最基本的特征。在Marr的计算机视觉系统中,图像边缘提取占据着非常重要位置,它位于系统的最底层,为其它模块所依赖。图像边缘提取作为计算机视觉领域最经典的研究课题,长期受到人们的重视。 图像边缘主要划分为阶跃状和屋脊状两种类型。阶跃状边缘两侧的灰度值变化明显,屋脊状边缘则位于灰度增加与减少的交界处。传统的图像边缘检测方法大多是从图像的高频分量中提取边缘信息,微分运算是边缘检测与提取的主要手段。由于传统的边缘检测方法对噪声敏感,所以实际运用效果有一定的局限性。近年来,越来越多的新技术被引入到边缘检测方法中,如数学形态学、小波变换、神经网络和分形理论等。 Canny于1986年提出基于最优化算法的边缘检测算子,得到了广泛的应用,并成了与其它实验结果作比较的标准。其原因在于他最先建立了优化边缘检测算子的理论基础,提出了迄今为止定义最为严格的边缘检测的三个标准。另外其相对简单的算法使得整个过程可以在较短的时间实现。实验结果也表明,Canny算子在处理受加性高斯白噪声污染的图像方面获得了良好的效果[1]。 §1.2 数字图像边缘检测算法的意义 数字图像处理是控制领域的重要课题,数字图像边缘检测是图像分割、目标区域识别和区域形状提取等图像分析领域十分重要的基础,是图像识别中提取图像特征的一个重要方法。边缘中包含图像物体有价值的边界信息,这些信息可以用于图像理解和分析,并且通过边缘检测可以极降低后续图像分析和处理的数据量。图像理解和分析的第一步往往就是边缘检测,目前它已成为机器视觉研究领域最活跃的课题之一,在工程应用中占有十分重要的地位。 图像的边缘检测技术是数字图像处理技术的基础研究容,是物体识别的重要基础。边缘特征广泛应用于图像分割、运动检测与跟踪、工业检测、目标识别、双目立体视觉等领域。现有边缘检测技术在抑制噪声方面有一定的局限性,在阈值参数选取方面自适

研学

第一单元 课题人与自我?我自信,会成功 学习目标正确认识自我,能够说出自己的优点和不足;增强自我调控、承受挫折、适应环境的能力;了解树立自信心的方法,培养健全的人格和良好的心理素质;提高心理健康水平,增强自我教育能力,形成健康、自信的人生观。参考主题(1)我自信,会成功;(2)克服考试焦虑;(3)消除孤独感。 实践方式心理测试;收集资料;手工制作。 方法引导发表意见的技巧;如何对调查结果进行统计与分析。 学科整合与心理健康教育、品德与社会、语文等学科整合。关注心理健康,形成健康的生活态度;善于发现其他同学身上的优点并虚心学习;学习名人名言,领悟其深刻含义,并激励自己;进行小制作设计。 课时安排5课时 教学流程 第一课时 研究准备 我们一天天地长大,从妈妈怀里的婴儿,长成了少年。想想自己在成长过程中有哪些烦恼?你是怎么解决的? 同学们根据自己的兴趣自主确定设计研究方案,其方法一般是: 1、我的烦恼及解决的办法 2、我自信,会成功 3、消除孤独感 以上方案进行研究、讨论、尝试初步建立印象。 第二课时 我自信,会成功 一、研究实施 自信对我们走向成功非常重要。今天,就我们一起通过探究活动来寻找自信,增强自信! 二、方法与引导: 发表意见的技巧 1、态度诚恳、谦逊。多采用“我个人认为”、“我目前的想法是”等表达方式; 2、不能只发表否定性意见,对好的方面要充分肯定; 3、对事不对人,只针对事情发表意见; 4、通过举例等方式,引导他人发现存在的问题; 5、避免个人垄断话题,邀请不善于发表意见的组员参与讨论。 三、“我自信,会成功”研究方案 主题名称研究时间 研究目的1、正确认识自己,发现自己的优点与不足 2、

目标检测综述

一、传统目标检测方法 如上图所示,传统目标检测的方法一般分为三个阶段:首先在给定的图像上选择一些候选的区域,然后对这些区域提取特征,最后使用训练的分类器进行分类。下面我们对这三个阶段分别进行介绍。 (1) 区域选择这一步是为了对目标的位置进行定位。由于目标可能出现在图像的任何位置,而且目标的大小、长宽比例也不确定,所以最初采用滑动窗口的策略对整幅图像进行遍历,而且需要设置不同的尺度,不同的长宽比。这种穷举的策略虽然包含了目标所有可能出现的位置,但是缺点也是显而易见的:时间复杂度太高,产生冗余窗口太多,这也严重影响后续特征提取和分类的速度和性能。(实际上由于受到时间复杂度的问题,滑动窗口的长宽比一般都是固定的设置几个,所以对于长宽比浮动较大的多类别目标检测,即便是滑动窗口遍历也不能得到很好的区域) (2) 特征提取由于目标的形态多样性,光照变化多样性,背景多样性等因素使得设计一个鲁棒的特征并不是那么容易。然而提取特征的好坏直接影响到分类的准确性。(这个阶段常用的特征有SIFT、HOG等) (3) 分类器主要有SVM, Adaboost等。 总结:传统目标检测存在的两个主要问题: 一是基于滑动窗口的区域选择策略没有针对性,时间复杂度高,窗口冗余; 二是手工设计的特征对于多样性的变化并没有很好的鲁棒性。 二、基于Region Proposal的深度学习目标检测算法 对于传统目标检测任务存在的两个主要问题,我们该如何解决呢? 对于滑动窗口存在的问题,region proposal提供了很好的解决方案。region

proposal(候选区域)是预先找出图中目标可能出现的位置。但由于region proposal 利用了图像中的纹理、边缘、颜色等信息,可以保证在选取较少窗口(几千个甚至几百个)的情况下保持较高的召回率。这大大降低了后续操作的时间复杂度,并且获取的候选窗口要比滑动窗口的质量更高(滑动窗口固定长宽比)。比较常用的region proposal算法有selective Search和edge Boxes,如果想具体了解region proposal可以看一下PAMI2015的“What makes for effective detection proposals?” 有了候选区域,剩下的工作实际就是对候选区域进行图像分类的工作(特征提取+分类)。对于图像分类,不得不提的是2012年ImageNet大规模视觉识别挑战赛(ILSVRC)上,机器学习泰斗Geoffrey Hinton教授带领学生Krizhevsky使用卷积神经网络将ILSVRC分类任务的Top-5 error降低到了15.3%,而使用传统方法的第二名top-5 error高达26.2%。此后,卷积神经网络占据了图像分类任务的绝对统治地位,微软最新的ResNet和谷歌的Inception V4模型的top-5 error降到了4%以内多,这已经超越人在这个特定任务上的能力。所以目标检测得到候选区域后使用CNN对其进行图像分类是一个不错的选择。 2014年,RBG(Ross B. Girshick)大神使用region proposal+CNN代替传统目标检测使用的滑动窗口+手工设计特征,设计了R-CNN框架,使得目标检测取得巨大突破,并开启了基于深度学习目标检测的热潮。 1. R-CNN (CVPR2014, TPAMI2015) (Region-based Convolution Networks for Accurate Object d etection and Segmentation)

VC图像边缘检测算法研究报告与比较

目录

基于VC的图像边缘检测算法的研究与比较 摘要 图像的边缘是图像最基本的特征,它是灰度不连续的结果。图像分析和理解的第一步是边缘检测,因此边缘检测在图像处理中有着重要的作用。图像边缘检测大幅度地减少了数据量,并且剔除了可以认为不相关的信息,保留了图像重要的结构属性。 本文介绍了三种经典的图像边缘检测算子,并且运用强大的VC软件通过一个图像边缘检测的例子比较了它们的检测效果,分析了它们各自的特点,对学习边缘检测和具体工程应用具有很好的参考价值。 关键词: 图像处理,边缘检测, 算子,比较研究,VC

Comparison AndAnalysis ForImageEdgeDetection Algorithms Based On VC Abstract Edge is the most basic feature of the image, it is the result of discontinuous gray. The first step in image analysis and understanding is edge detection, so edge detection plays an important role in image processing.Image edge detection significantly reduces the amount of data and removes irrelevant information,retains the important structural properties of images. This article describes three types of classical edge detection operators, and the use the powerful software called VC to do the edge detection through a comparison of examples of the effect of their detection, analysis the characteristics,this is good reference value for their learning edge detection and application of specific projects. Key Words:Image processing ,Edge detection ,Operator ,Comparative Study ,VC

研学课程质量管理方案

XXXX中小学研学旅行课程质量管理 一、指导思想 全面贯彻党的教育方针,以《国家中长期教育改革和发展规划纲要》《基础教育课程改革纲要》《国民旅游休闲纲要》为指导,认真落实立德树人的育人目标,以培养学生的综合实践能力和创新能力为核心,以学生发展为本,全面提升学生综合素质。 二、课程设计原则与课程内容 (一)课程设计原则 1.开放性原则:充分利用校内外资源体现目标的多元性,内容的广泛性,时间空间的广域性,展示的多样性和评价的灵活性。 2.整合性原则:以研学旅行资源及教学内容、方法和师资情况为基础,结合学生认知能力和社会实际整合开发课程,保证课程的时效性,实现课程的生成性。 3.体验性原则:尊重学生主体地位,以人为本,以学生活动为主,突出体验实践,培养学生创新精神和实践能力,变知识性的课堂教学为发展性的体验教学。 4.生活性原则:着眼于生活实际的观察视角,把学生从最简单熟悉的生活层面引领到更加广阔的社会生活舞台,加强教育的生活性,突出生活的教育化程度。 (二)课程内容

1.了解社会状况。通过研学旅行活动,了解当前社会实践活动中迫切需要解决的现实问题,如交通、卫生、网络、饮食、环境、动植物保护以及人口老龄化、就业压力、就医入学等现实状况。 2.探究学科问题。包括物理、化学、生物、地理、数学、语文、英语、政治、历史、通用技术、信息技术、体育、音乐、美术以及学科交叉知识的探究,发现一些值得研究的新问题。 3.前沿科技应用。在研学活动中,学习和研究前沿科学技术在生活、生产实践和科学实践领域的应用。如3D打印、AR/VR、无人机、无人驾驶等。 三、课程实施 (1)课程开发要立足教育性。 要使研学旅行做到立意高远、目标明确、活动生动、学习有效,避免出现“只旅不学”或“只学不旅”的现象,就必须把教育性原则放在首位,寻找适切的研学主题和课程教育目标,深度促进研学旅行活动课程与学校课程的有机融合。作为中小学教育教学实践的重要组成部分,研学旅行的活动课程既要结合学生身心特点、接受能力和实际需要,又要注重知识性、科学性和趣味性。 在课程目标的制订上,要与学校的综合实践活动课程统筹考虑,活动中的知识性目标、能力性目标、情感、态度、价值观领域的目标和核心素养的目标等等,都应该是落实课标的核心要点。 (2)研学旅行课程突出实践性 正是我国推动全面实施素质教育的一种重要创新。研学旅行的课

图像分割和图像边缘检测

图像分割和图像边缘检测 边缘检测和图像分割的联系:边缘检测是通过图像的梯度变化将图像中梯度变化明显的地方检测出来,针对的是边缘信息。图像分割是将目标分割出来,针对的是目标对象,边缘检测是空间域图像分割的一种方法,属于包含关系 边缘检测后的图像是二值图像,对二值图像可以运用形态学操作来分割目标,所以边缘检测是图像分割的一个前提。但分割不一定非要用边缘检测。 图像分割:概念: 图像分割是将图像划分成若干个互不相交的小区域的过程,所谓小区域是某种意义下具有共同属性的像素的连通集合。 从集合的观点看:它应该是具有如下性质的一种点集,集合R代表整个区域,对R的分割可看作将R分成N个满足以下五个条件的非空子集R1,R2,,RN: 目的: 无论是图像处理、分析、理解与识别,其基础工作一般都建立在图像分割的基础上; 将图像中有意义的特征或者应用所需要的特征信息提取出来; 图像分割的最终结果是将图像分解成一些具有某种特征的单元,称为图像的基元; 相对于整幅图像来说,这种图像基元更容易被快速处理。 图像分割原理图像分割的研究多年来一直受到人们的高度重视,至今提出了各种类型的分割算法。Pal把图像分割算法分成了6类:阈值分割,像素分割、深度图像分割、彩色图像分割,边缘检测和基于模糊集的方法。但是,该方法中,各个类别的内容是有重叠的。为了涵盖不断涌现的新方法,有的研究者将图像分割算法分为以下六类:并行边界分割技术、串行边界分割技术、并行区域分割技术、串行区域分割技术、结合特定理论工具的分割技术和特殊图像分割技术。 图像分割的特征:分割出来的各区域对某种性质例如灰度,纹理而言具有相似性,区域内部是连通的的且没有过多小孔。 区域边界是明确的

青海研学l旅游发展的SWOT分析

青海省研学旅游发展SWOT分析 (一)优势(strength) 1.旅游资源丰富多样 截至目前,全省旅游A级景点多达106处,其中5A级3家;4A级19家,3A级65家,2A级19家。自然与人文旅游资源丰富多样,著名的景区有青海湖景区,金银滩景区、祁连风光旅游区、茶卡盐湖旅游区等,人文旅游资源有藏传佛教塔尔寺景区、互助土族故土园景区、原子城、湟源丹葛尔古城等,独特的地质条件与多样的民族风情为青海省开展研学旅游提供了强大的物质基础。 2.地质旅游资源优势明显 青海省地域辽阔,在漫长的地球演化过程中,在内外力地质共同作用形成、发展并遗留下来类型众多的不可再生的地质资源,青海省凭借丰富的旅游地质资源,现已获批多处地质资源集中分布区开发建设为国家地质公园,知名的有坎布拉国家地质公园、互助北山国家地质公园、贵德国家地质公园、昆仑山国家地质公园等,形成了红色砂砾岩的丹霞地貌、冰蚀地貌景观、高原岩溶景观、古地震鼓包遗迹等地貌景观,除了具有不可估量的科研价值外,还具有开展研学旅游,建设研学旅游教育基地的广阔前景。 (二)劣势(weakness) 1.景区间通达性差 作为研学旅游目的地其集聚性较差,包尤其是潜在的旅游资源,重要景区间的连接道路、景区内的交通体系、景区的道路标示系统等有待进一步加强,与现代“快旅慢游”需求和“井喷式”增长严重不匹配,缺乏全面系统的交通网将研学旅游景区串联起来。旅游各景区发展不平衡,基础设施、服务配套远不能适应人民群众日益增长的多旅游需求。 2.旅游季节差异性明显 旅游季节性是旅游活动的固有特征,青海省旅游季节性明显,由于气候因素旅游旺季集中在夏季,导致旺季游客量多,而到了冬季,气候比较寒冷,草木凋零,研学旅游开展较为困难、使得旅游景点、宾馆饭店、旅行社等资源和设施大量闲置、出租率下降、运营成本上升,旅游企业为争夺客源进而采取降价竞争,导致经济效益低下。 (三)机遇(opportunity) 1.政策支持焕发旅游活力 近年来,一系列决策为全省旅游业提档升级提供了强大的政策支撑。一是《国务院关于促进旅游业改革发展的若干意见》以及全国旅游发展“515战略”,将旅游业定位为战略性支柱产业和人民群众满意的现代服务业和实现脱贫的重要产业,破除了旅游发展的认识障碍和制度障碍;二是青海省委、省政府出台了《关于促进旅游业改革发展的实施意见》、《2015年—2020年青海省旅游业行动计划》,将推动县域旅游业发展提向更高层次、更大格局迈进;三是地方政府对各地旅游业的重要战略部署。随着研学旅游的深入开展,其巨大的经济效益、社会效益和生态效益毫无疑问将得到各级政府的高度重视,不断获得政策支持力度,实现研学旅游又好又快发展,引领“旅游+”产业新风向。 2.研学旅游竞争力将持续增强 随着旅游的飞速发展,我省已形成一批骨干旅游企业,将继续提升旅游市场主体的竞争力。旅游发展环境全面改善,形成设施齐全、功能配套、优质高效的

图像边缘检测

V ol.15, No.1 ?2004 Journal of Software 软 件 学 报 1000-9825/2004/15(01)0000 图像边缘检测 Edge Detection of Image Li Jie (Department of Computer Science and Technology,Nanjing University, Nanjing, China) Email:lijie1108@https://www.360docs.net/doc/2919301567.html, 摘 要: 边缘检测是在图像的局部区域上针对像素点的一种运算,在计算机视觉、图像理解等应用中扮演着重要的角色,同时也是图象分析与模式识别的重要环节。因为图像的边缘包含了模式识别的有用信息,所以边缘检测是图像分析和模式识别中特征提取的主要手段,也使得边缘检测在计算机视觉的一些预处理算法中有着重要的地位。另外,随着科技日新月异的发展,边缘检测技术也逐渐运用到生产和生活中。因此,对边缘检测的研究也有很重要的实际应用价值。本文介绍了边缘检测的一般步骤,对灰度图像的几种边缘检测算法,作简单的介绍。 关键词: 边缘检测; 经验模型分解;Sobel 算子;神经网络 中图法分类号: TP-301 文献标识码: A 1 引言 边缘检测是图像处理领域中最基本的问题,也是经典的技术难题之一,它的解决对于进行高层次的特征提取、特征描述、目标识别和图像理解等有着重大的影响。因此,边缘检测在图像分割、模式识别、计算机视觉等众多方面都有着非常重要的地位。然而由于成像过程中的投影、混合、畸变和噪声等导致图像的模糊和变形,边缘往往难于检测,这使得人们一直致力于构造具有良好性质的边缘检测算子。边缘检测的研究有着久远的历史,其原因一方面是由于课题本身的重要性,另一方面也反映了这个课题的深度和难度。所以,边缘检测方面的研究具有非常重要的理论意义。 由于边缘为图像中灰度发生急剧变化的区域边界,传统的图像边缘检测方法大多可归结为图像高频分量的增强过程,微分运算自然就成了边缘检测与提取的主要手段。人们最早提出了一阶微分边缘算子,用图像灰度分布的梯度来反映图像灰度的变化,最早如1965年提出的Robert 算子[1],在Robert 算子基础上改进得到的sobel[1]算子、Prewitt[1]算子和Kirsh 算子等。但是,这些算子由于梯度或一阶微分算子通常在图像边缘附近的区域内产生较宽的响应,故上述算子检测到的边缘图像常需作细化处理,这就影响了边缘定位的精度。因而又产生了与边缘方向无关的二阶微分边缘检测算子,即LaPlacian 算子[2l 。利用二阶导数零交叉所提取的边缘宽度为一个像素,所得的边缘结果无需细化,有利于边缘更准确的定位。 近年来,随着科学技术的发展,利用各种新的理论工具对图像进行边缘检测的方法得到了广泛的研究和应用。例如基于形态学的边缘检测算子,借助统计学方法的检测技术[7]、利用神经网络的检测技术[8]、利用模糊理论的检测技术[9]、利用信息论的检测技术[10]、利用遗传算法的检测技术、基于分形特征的边缘检测技术[24]等的研究也相继出现,表现相当活跃。 由于实际图像都含有噪声,并且噪声的分布、方差等信息也都是未知的,而噪声和边缘都是高频信号。外加物理和光照等原因,实际图像中的边缘常常发生在不同的尺度范围上,并且每一边缘像元的尺度信息是未知的。因此,传统的边缘检测算法检测效果并不理想。