视频目标跟踪算法综述_蔡荣太

1引言

目标跟踪可分为主动跟踪和被动跟踪。视频目标跟踪属于被动跟踪。与无线电跟踪测量相比,视频目标跟踪测量具有精度高、隐蔽性好和直观性强的优点。这些优点使得视频目标跟踪测量在靶场光电测量、天文观测设备、武器控制系统、激光通信系统、交通监控、场景分析、人群分析、行人计数、步态识别、动作识别等领域得到了广泛的应用[1-2]。

根据被跟踪目标信息使用情况的不同,可将视觉跟踪算法分为基于对比度分析的目标跟踪、基于匹配的目标跟踪和基于运动检测的目标跟踪。基于对比度分析的跟踪算法主要利用目标和背景的对比度差异,实现目标的检测和跟踪。基于匹配的跟踪主要通过前后帧之间的特征匹配实现目标的定位。基于运动检测的跟踪主要根据目标运动和背景运动之间的差异实现目标的检测和跟踪。前两类方法都是对单帧图像进行处理,基于匹配的跟踪方法需要在帧与帧之间传递目标信息,对比度跟踪不需要在帧与帧之间传递目标信息。基于运动检测的跟踪需要对多帧图像进行处理。除此之外,还有一些算法不易归类到以上3类,如工程中的弹转机跟踪算法、多目标跟踪算法或其他一些综合算法。2基于对比度分析的目标跟踪算法基于对比度分析的目标跟踪算法利用目标与背景在对比度上的差异来提取、识别和跟踪目标。这类算法按照跟踪参考点的不同可以分为边缘跟踪、形心跟踪和质心跟踪等。这类算法不适合复杂背景中的目标跟踪,但在空中背景下的目标跟踪中非常有效。边缘跟踪的优点是脱靶量计算简单、响应快,在某些场合(如要求跟踪目标的左上角或右下角等)有其独到之处。缺点是跟踪点易受干扰,跟踪随机误差大。重心跟踪算法计算简便,精度较高,但容易受到目标的剧烈运动或目标被遮挡的影响。重心的计算不需要清楚的轮廓,在均匀背景下可以对整个跟踪窗口进行计算,不影响测量精度。重心跟踪特别适合背景均匀、对比度小的弱小目标跟踪等一些特殊场合。图像二值化之后,按重心公式计算出的是目标图像的形心。一般来说形心与重心略有差别[1-2]。

3基于匹配的目标跟踪算法

3.1特征匹配

特征是目标可区别与其他事物的属性,具有可区分性、可靠性、独立性和稀疏性。基于匹配的目标跟踪算法需要提取目标的特征,并在每一帧中寻找该特征。寻找的

文章编号:1002-8692(2010)12-0135-04

视频目标跟踪算法综述*

蔡荣太1,吴元昊2,王明佳2,吴庆祥1

(1.福建师范大学物理与光电信息科技学院,福建福州350108;

2.中国科学院长春光学精密机械与物理研究所,吉林长春130033)

【摘要】介绍了视频目标跟踪算法及其研究进展,包括基于对比度分析的目标跟踪算法、基于匹配的目标跟踪算法和基于运动检测的目标跟踪算法。重点分析了目标跟踪中特征匹配、贝叶斯滤波、概率图模型和核方法的主要内容及最新进展。此外,还介绍了多特征跟踪、利用上下文信息的目标跟踪和多目标跟踪算法及其进展。

【关键词】目标跟踪;特征匹配;贝叶斯滤波;概率图模型;均值漂移;粒子滤波

【中图分类号】TP391.41;TN911.73【文献标识码】A

Survey of Visual Object Tracking Algorithms

CAI Rong-tai1,WU Yuan-hao2,WANG Ming-jia2,WU Qing-xiang1

(1.School of Physics,Optics,Electronic Science and Technology,Fujian Normal University,Fuzhou350108,China;

2.Changchun Institute of Optics,Fine Mechanics and Physics,Chinese Academy of Science,Changchun130033,China)【Abstract】The field of visual object tracking algorithms are introduced,including visual tracking based on contrast analysis,visual tracking based on feature matching and visual tracking based on moving detection.Feature matching,Bayesian filtering,probabilistic graphical models,kernel tracking and their recent developments are analyzed.The development of multiple cues based tracking,contexts based tracking and multi-target tracking are also discussed.

【Key words】visual tracking;feature matching;Bayesian filtering;probabilistic graphical models;mean shift;particle filter

·论文·*国家“863”计划项目(2006AA703405F);福建省自然科学基金项目(2009J05141);福建省教育厅科技计划项目(JA09040)

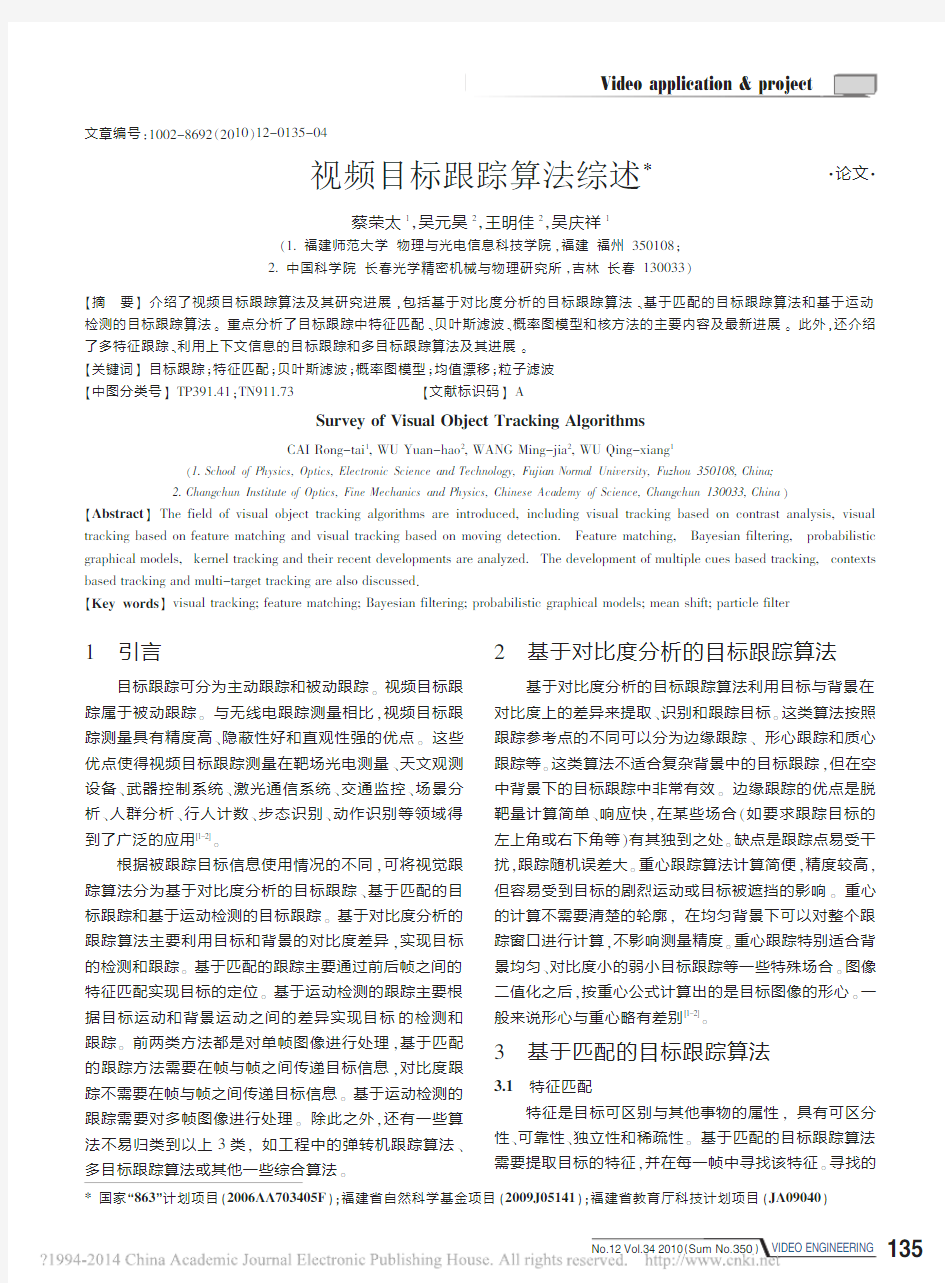

算法

描述能力状态表示方法拓扑结构KF 线性、高斯一个随机变量(向量)固定PF 非线性、任意分布

一个随机变量(向量)

固定HMMs 非线性、任意分布一个随机变量(向量)

固定DBNs

非线性、任意分布

随机变量(向量)集

可变

表1

贝叶斯跟踪方法

过程就是特征匹配过程。

特征提取是一种变换或者编码,将数据从高维的原始特征空间通过映射,变换到低维空间的表示。根据

Marr 的特征分析理论,有4种典型的特征计算理论:神经还原论、结构分解理论、特征空间论和特征空间的近似。神经还原论直接源于神经学和解剖学的特征计算理论,它与生物视觉的特征提取过程最接近,其主要技术是Gabor 滤波器、小波滤波器等。结构分解理论是到目前为止唯一能够为新样本进行增量学习提供原则的计算理论,目前从事该理论研究的有麻省理工学院实验组的视觉机器项目组等。特征空间论主要采用主分量分析(PCA )、独立分量分析(ICA )、稀疏分量分析(SCA )和非负矩阵分解(NMF )等技术抽取目标的子空间特征。特征空间的近似属于非线性方法,适合于解决高维空间上复杂的分类问题,主要采用流形、李代数、微分几何等技术[1]。

目标跟踪中用到的特征主要有几何形状、子空间特征、外形轮廓和特征点等。其中,特征点是匹配算法中常用的特征。特征点的提取算法很多,如Kanade Lucas

Tomasi (KLT )算法、Harris 算法、SIFT 算法以及SURF 算法等。特征点一般是稀疏的,携带的信息较少,可以通过集成前几帧的信息进行补偿。目标在运动过程中,其特征(如姿态、几何形状、灰度或颜色分布等)也随之变化。目标特征的变化具有随机性,这种随机变化可以采用统计数学的方法来描述。直方图是图像处理中天然的统计量,因此彩色和边缘方向直方图在跟踪算法中被广泛采用。

3.2贝叶斯跟踪

目标的运动往往是随机的,这样的运动过程可以采

用随机过程来描述。很多跟踪算法往往建立在随机过程的基础之上,如随机游走过程、马尔科夫过程、自回归(AR )过程等。文献[3]和文献[4]采用二阶AR 模型来跟踪目标的运动,采用一阶AR 模型来跟踪目标的尺度变化。随机过程的处理在信号分析领域较成熟,其理论和技术(如贝叶斯滤波)可以借鉴到目标跟踪中。

贝叶斯滤波中,最有名的是Kalman 滤波(KF )。KF 可以比较准确地预测平稳运动目标在下一时刻的位置,在弹道目标跟踪中具有非常成功的应用。一般而言,KF 可以用作跟踪方法的框架,用于估计目标的位置,减少特征匹配中的区域搜索范围,提高跟踪算法的运行速度。KF 只能处理线性高斯模型,KF 算法的两种变形

EKF 和UKF 可以处理非线性高斯模型。两种变形扩展了KF 的应用范围,但是不能处理非高斯非线性模型,这个时候就需要用粒子滤波(PF )。由于运动变化,目标的

形变、非刚体、缩放等问题,定义一个可靠的分布函数是非常困难的,所以在PF 中存在例子退化问题,于是引进了重采样技术。事实上,贝叶斯框架下视觉跟踪的很多工作都是在PF 框架下寻找更为有效的采样方法和建议概率分布。这些工作得到了许多不同的算法,如马尔可夫链蒙特卡洛(MCMC )方法、Unscented 粒子滤波器(UPF )、

Rao-Blackwellised 粒子滤波器(RBPF )等。文献[5]引入了一种新的自适应采样方法———序贯粒子生成方法,在该方法中粒子通过重要性建议概率密度分布的动态调整顺序产生。文献[6]根据率失真理论推导了确定粒子分配最优数目的方法,该方法可以最小化视觉跟踪中粒子滤波的整体失真。文献[7]计算最优重要性采样密度分布和一些重要密度分布之间的KL 距离,分析了这些重要密度分布的性能。文献[8]在粒子滤波框架下,采用概率分类器对目标观测量进行分类,确定观测量的可靠性,通过加强相关观测量和抑制不相关观测量的方法提高跟踪性能。

除了KF 和PF 之外,隐马尔科夫模型(HMMs )和动态贝叶斯模型(DBNs )[9]也是贝叶斯框架下重要的视觉跟踪方法。HMMs 和DBNs 将运动目标的内部状态和观测量用状态变量(向量)表示,DBNs 使用状态随机变量(向量)集,并在它们之间建立概率关联。HMMs 将系统建模为马尔科夫过程。这些算法的主要区别如表1所示。

表1中每个简单的算法都可以看成是下一行复杂算法的特例。反之,每个复杂算法都可以看成是简单算法的扩展。其中,DBNs 具有最佳的灵活性,可以处理不同的运动模型和不同的状态变量组合。

DBNs 又可以看作概率图模型(PGMs )[9]的一个例子。PGMs 的基本思想是用图形的方式将多变量概率分布分解,统计变量用图的节点表示,变量间的条件关系用图的连接或边表示。PGMs 可以分为有向图(DAGs )和无向图(Ugs )。前者能够处理时间模式,适合目标跟踪和场景理解等任务。后者能很好地描述图像像素之间的空间依赖性,适合图像分割和图像分析等任务。

通过组合图理论和概率理论,PGMs 可以用来处理问题描述中的不确定性。不确定性恰好符合人类视觉系统中天然的概率性和视觉模糊性(如遮挡、从3D 到2D 投影的信息损失)。通过规定概率模型元素之间的关系,PGMs

可以有效地表示、学习和计算复杂的概率模型。PGMs能够有效地组合目标的动态信息和外观信息,有效解决目标的运动估计问题,为目标跟踪提供了很好的理论框架。表1中算法都可以看成是PGMs的特殊形式。

3.3核方法

核方法的基本思想是对相似度概率密度函数或者后验概率密度函数采用直接的连续估计。这样处理一方面可以简化采样,另一方面可以采用估计的函数梯度有效定位采样粒子。采用连续概率密度函数可以减少高维状态空间引起的计算量问题,还可以保证例子接近分布模式,避免粒子退化问题。核方法一般都采用彩色直方图作为匹配特征。

Mean Shift[10]是核方法中最有代表性的算法,其含义正如其名,是“偏移的均值向量”。直观上看,如果样本点从一个概率密度函数中采样得到,由于非零的概率密度梯度指向概率密度增加最大的方向,从平均上来说,采样区域内的样本点更多的落在沿着概率密度梯度增加的方向。因此,对应的Mean Shift向量应该指向概率密度梯度的负方向。

Mean Shift跟踪算法反复不断地把数据点朝向Mean Shift矢量方向进行移动,最终收敛到某个概率密度函数的极值点。在Mean Shift跟踪算法中,相似度函数用于刻画目标模板和候选区域所对应的两个核函数直方图的相似性,采用的是Bhattacharyya系数。因此,这种方法将跟踪问题转化为Mean Shift模式匹配问题。核函数是Mean Shift算法的核心,可以通过尺度空间差的局部最大化来选择核尺度,若采用高斯差分计算尺度空间差,则得到高斯差分Mean Shift算法。

Mean Shift算法假设特征直方图足够确定目标的位置,并且足够稳健,对其他运动不敏感。该方法可以避免目标形状、外观或运动的复杂建模,建立相似度的统计测量和连续优化之间的联系。但是,Mean Shift算法不能用于旋转和尺度运动的估计。为克服以上问题,人们提出了许多改进算法,如多核跟踪算法、多核协作跟踪算法和有效的最优核平移算法等。文献[11]则针对可以获得目标多视角信息的情况,提出了一种从目标不同视角获得多个参考直方图,增强Mean Shift跟踪性能的算法。

4基于运动检测的目标跟踪算法基于运动检测的目标跟踪算法通过检测序列图像中目标和背景的不同运动来发现目标存在的区域,实现跟踪。这类算法不需要帧间的模式匹配,不需要在帧间传递目标的运动参数,只需要突出目标和非目标在时域或者空域的区别即可。这类算法具有检测多个目标的能力,可用于多目标检测和跟踪。这类运动目标检测方法主要有帧间图像差分法、背景估计法、能量积累法、运动场估计法等。

光流算法是基于运动检测的目标跟踪的代表性算法。光流是空间运动物体在成像面上的像素运动的瞬时速度,光流矢量是图像平面坐标点上的灰度瞬时变化率。光流的计算利用图像序列中的像素灰度分布的时域变化和相关性来确定各自像素位置的运动,研究图像灰度在时间上的变化与景象中物体结构及其运动的关系。将二维速度场与灰度相联系,引入光流约束方程,得到光流计算的基本算法。根据计算方法的不同,可以将光流算法分为基于梯度的方法、基于匹配的方法、基于能量的方法、基于相位的方法和基于神经动力学的方法。

文献[12]提出了一种基于摄像机光流反向相关的无标记跟踪算法,该算法利用反向摄像机消除光流中的相同成分,得到有效的跟踪效果。文献[13]将光流算法的亮度约束转化为上下文约束,把上下文信息集成到目标跟踪的运动估计里,仿照光流算法,提出了上下文流算法。文献[14]引入了几何流的概念,用于同时描述目标在空间上和时间上的运动,并基于李代数推导了它的矢量空间表示。几何流在几何约束条件下,将复杂运动建模为多个流的组合,形成一个随机流模型。该算法在运动估计中集成了点对和帧差信息。文献[15]介绍了使用互相关的对光照稳健的可变光流算法。文献[16]提出了基于三角化高阶相似度函数的光流算法——

—三角流算法。该算法采用高阶条件随机场进行光流建模,使之包含标准的光流约束条件和仿射运动先验信息,对运动估计参数和匹配准则进行联合推理。局部仿射形变的相似度能量函数可以直接计算,形成高阶相似度函数,用三角形网格求解,形成三角流算法。

5其他跟踪问题

视觉跟踪从不同的角度和应用场合出发,会遇到很多不同的问题,比如多模跟踪、多特征跟踪、多目标跟踪、多摄像机跟踪[17]、3D跟踪[18]和特定应用的跟踪等。

5.1多特征跟踪和利用上下文信息的目标跟踪

利用多特征刻画目标是一种非常有效的实现稳健跟踪的方法。不同的特征可以从相同的或者不同的传感器获得,如彩色和轮廓[19],彩色和梯度[20],Haar-Like特征和边缘[21],角点、彩色和轮廓[22],彩色和边缘[6],彩色和Wi-Fi 三角化[23]等。

在贝叶斯框架下,有三种方法可以集成多个特征:

1)假设特征之间是统计独立的,可以将多个特征以加权和的形式组合起来;2)假设多个特征之间的条件关联服从线性约束,可以将相似度概率密度分布表示为各个特征相似度概率密度分布的线性组合;3)文献[19]给出了一种更加复杂的方法,该方法不对各个特征施加关联约束,用概率方法建立各个特征之间的关联。

除了联合使用目标的多特征之外,还可以充分采用上下文、背景和辅助目标等信息来实现稳健的目标跟踪。如文献[24]设计了一种考虑上下文的跟踪算法。该算法采用数据挖掘技术在视频中获取辅助目标,并将辅助目标用在跟踪中。对目标和这些辅助目标的协作跟踪可以获得有效的跟踪性能。这里的辅助目标是至少在一小段时间内和目标同时出现,和目标具有相同的相关性运动并且比目标更容易跟踪的视频内容。文献[25]在跟踪算法中,同时采用目标和目标周围背景的特征点,将目标特征点用于跟踪,将背景特征点用于鉴别目标是否被遮挡。

5.2多目标跟踪

多目标跟踪(MTVT)在每帧图像中同时正确地对各个目标进行编号,主要算法有概率数据关联(PDAF)、联合概率数据关联(JPDAF)。

文献[26]给出了两种新的数据关联方法:联合相似度滤波(JLF)和约束的联合相似度滤波(CJLF)。前者是JPDAF算法的扩展,它增加了目标相对于摄像机的深度标志,能够预测目标之间的遮挡,可以采用不同的特征计算相似度。后者集成了目标的刚性关联和深度约束,能够更好地处理大目标之间的交叉。

随机集滤波和有限集统计算法是另外一类多目标跟踪方法。有限集统计算法中采用概率假设密度函数,可以解决目标状态变量和观测向量维度变化的问题,可以比较有效地解决目标数量的增减问题[3,27,28]。

6小结

笔者系统地介绍了基于对比度分析的目标跟踪算法、基于匹配的目标跟踪算法和基于运动检测的目标跟踪算法,重点介绍了特征匹配、贝叶斯与概率图模型下的视觉跟踪算法和核跟踪算法的主要技术内容及其最新进展,对多特征跟踪、上下文跟踪和多目标跟踪的进展也作了简单介绍。由于目标跟踪任务的复杂性,应该根据不同的应用场合选用不同的跟踪方法。在系统设计中,应该根据具体的精度要求、稳健性要求、计算复杂度要求和实时性要求等采用不同的算法。多种技术的联合应用可以有效克服单一技术的局限性。因此,目标跟踪算法的方向发展为多模跟踪、多特征融合跟踪、基于目标所在的上下文和运动轨迹等信息的跟踪。

参考文献:

[1]蔡荣太.非线性自适应滤波器在电视跟踪中的应用[D].北京:中国

科学院,2008.

[2]蔡荣太,雷凯,张旭光,等.基于.net的视频跟踪仿真平台设计[J].

计算机仿真,2007,24(12):181-184.

[3]MAGGIO E,TAJ M,CAVALLARO A.Efficient multi-target visual

tracking using random finite sets[J].IEEE Transactions on Circuits and Systems for Video Technology,2008,18(8):1016-1027. [4]XU X,LI B.Adaptive raoblackwellized particle filter and its evaluation

for tracking in surveillance[J].IEEE Transactions on Image Processing,2007,16(3):838-849.

[5]LAO Y,ZHU J,ZHENG Y.Sequential particle generation for visual

tracking[J].IEEE Transactions on Circuits and Systems for Video Technology,2009,19(9):1365-1378.

[6]PAN P,SCHONFILD D.Dynamic proposal variance and optimal

particle allocation in particle filtering for video tracking[J].IEEE Transaction on Circuits and Systems for Video Technology,2008,18(9):1268-1279.

[7]BOUAYNAYA N,SCHONFELD D.On the optimality of motion-

based particle filtering[J].IEEE Transactions on Circuits and Systems for Video Technology,2009,19(7):1068-1072.

[8]IOANNIS P,EDWIN H R.Coupled prediction classification for

robust visual tracking[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2010,32(9):1553-1567.

[9]SOTO D A,REGAZZONI M C S.Bayesian tracking for video

analytics[J].IEEE Signal Processing Magazine,2010,27(5):46-55.

[10]王宇.基于Mean Shift的序列图像手势跟踪算法[J].电视技术,

2010,34(6):99-101.

[11]LEICHTER I,LINDENBAUM M,RIVLIN E.Mean Shift tracking

with multiple reference color histograms[J].Computer Vision and Image Understanding,2010,114(3):400-408.

[12]GUPTA P,VITORIA L N,LAVIOLA J J.Markerless tracking using

polar correlation of camera optical flow[C]//Proc.2010IEEE Virtual Reality Conference.Waltham,MA,UK:IEEE Press,2010:223-226.

[13]WU Ying,FAN Jialue.Contextual flow[C]//Proc.2009IEEE

International Conference on Computer Vision,Miami,FL,USA:IEEE Press,2009:33-40.

[14]LIN D,GRIMSON E,FISHER J.Modeling and estimating persistent

motion with geometric flows[C]//Proc.2010IEEE International Con-ference on Computer Vision.San Francisco,CA,USA:IEEE Press,2010:1-8.

[15]MOLNAR J,CHETVERIKOV D,FAZEKAS S.Illumination-robust

variational optical flow using cross-correlation[J].Computer Vision and Image Understanding,2010,114(10):1104-1114.

[16]GLOCKER B,HEIBEL T H,NAVAB N,et al.Triangle flow:optical

flow with triangulation-based higher-order likelihoods[C]//Proc.

(下转第142页)

Lecture Notes in Computer Science(ECCV2010).Heraklion,Crete,Greece:[s.n.],2010:272-285.

[17]ESHEL R,MOSES Y.Tracking in a dense crowd using multiple

cameras[J].International Journal of Computer Vision,2010,88(1):129-143.

[18]LI R,TIAN T,SCLAROFF S,et al.3D human motion tracking with

a coordinated mixture of factor analyzers[J].International Journal

of Computer Vision,2010,87(1-2):170-190.

[19]NOGUER M F,SANFELIU A,SAMARAS D.Dependent multiple

cue integration for robust tracking[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2008,30(4):670-685.

[20]CHANG C,ANSARI R,KHOKHAR A.Multiple object tracking

with kernel particle filter[C]//Proc.IEEE Conference on Computer Vision and Pattern Recognition.San Diego,CA,USA:IEEE Press,2005:566-573.

[21]YANG C,DURAISWAMI R,DAVIS L.Fast multiple object tracking

via a hierarchical particle filter[C]//Proc.IEEE International Con-ference on Computer Vision.Beijing,China:IEEE Press,2005:212-219.

[22]MAKRIS A,KOSMOPOULOS D,PERANTONIS S,et al.Hierarchical

feature fusion for visual tracking[C]//Proc.IEEE International Con-ference on Image Processing,San Antonio,Texas,USA:IEEE Press,2007:289-292.

[23]MIYAKI T,YAMASAKI T,AIZAWA K.Tracking persons using

particle filter fusing visual and Wi-Fi localizations for widely distributed camera[C]//Proc.IEEE International Conference on Image Processing,San Antonio,Texas,USA:IEEE Press,2007:225-228.

[24]YANG M,HUA G,WU Y.Context-aware visual tracking[J].IEEE

Transactions on Pattern Analysis and Machine Intelligence,2009,31(7):1195-1209.

[25]KHAN Z H,GU I Y H.Joint feature correspondences and

appearance similarity for robust visual object tracking[J].IEEE Transactions on Information Forensics and Security,2010,5(3):591-606.

[26]RASMUSSEN C,HAGER G D.Probabilistic data association

methods for tracking complex visual objects[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2001,23(6):560-576.

[27]MAHLER R.Multi target Bayesian filter in via first-order multi

target moments[J].IEEE Transactions on Aerospace and Electronic Systems,2003,39(4):1152-1178.

[28]HUE C,CHDRE J P L,PEREZ P.Sequential Monte Carlo methods

for multiple target tracking and data fusion[J].IEEE Transactions on Signal Processing,2002,50(2):309-325.

笕作者简介:

蔡荣太(1979-),博士,讲师,研究方向为图像处理与计算机视觉,智能信息处理。

责任编辑:任健男收稿日期:2010-07-06

该系统采用信息推送技术,能够在没有用户干预的情况下(比如用户离线的情况下),根据用户定制的查询需求自动进行批量的智能信息检索处理,对通过热链接定制的查询需求,系统自动将检索结果按各自的发送周期定期推送到用户的电子邮箱中,用户无需登录系统,即可在个人计算机上查看检索结果;对通过温链接和冷链接定制的查询需求,系统自动将检索结果有或无的信息主动推送到用户的电子邮箱中,温链接的检索结果还将保留在系统内置的用户个人文件箱中。这样就实现了信息服务由被动地“拉”到主动地“推”的转变,提高了工作效率。

参考文献:

[1]KARIM S,TJOA A M.Towards the use of ontologies for improving

user interaction for people with special needs[EB/OL].[2009-01-02].

http://www.ifs.tuwien.ac.at/~skarim/Camera%20Ready-Ontologies% 20for%20Special%20People-v3_reviewed.pdf.

[2]CATARCI T,DONGILLI P,MASCIO T D,et al.An ontology based

visual tool for query formulation support[EB/OL].[2009-01-02].http: //https://www.360docs.net/doc/8d1581832.html,/url?q=http://https://www.360docs.net/doc/8d1581832.html,/viewdoc/download%

3Fdoi%3D10.1.1.4.7045%26rep%3Drep1%26type%3Dpdf&sa=U&ei= WWz_TJOcKsL3rQeTmaT-Bw&ved=0CBAQFjAA&usg=AFQjCNFAk4y Aq2BirvNTO_7cK06vri_rAg.

[3]GARC魱A E,SICILIA M A.Designing ontology-based interactive

information retrieval interfaces[EB/OL].[2009-01-02].http://www.

https://www.360docs.net/doc/8d1581832.html,/url?q=http://https://www.360docs.net/doc/8d1581832.html,/viewdoc/download% 3Fdoi%3D10.1.1.59.8830%26rep%3Drep1%26type%3Dpdf&sa= U&ei=wGz_TIe2F4jYrQesiZWFCA&ved=0CA8QFjAA&usg=AFQjCNH p8rzWWVc_RpBvTsRMh7O4LY8Gfg.

[4]GAUCH S,CHAFFEE J,PRETSCHNER A.Ontology-based personalized

search and browsing[EB/OL].[2009-01-02].https://www.360docs.net/doc/8d1581832.html,.

hk/url?q=http://https://www.360docs.net/doc/8d1581832.html,/viewdoc/download%3Fdoi%3D10.

1.1.93.3661%26rep%3Drep1%26type%3Dpdf&sa=U&ei=_mz_TNSv

CMmrrAePl52iCA&ved=0CBAQFjAA&usg=AFQjCNHvcLjPNNmCzIt R5ZJIJ2BfFbJAyA.

[5]TRAJKOVA J.Improving ontology-based user profiles[D].Kansas:

University of Kansas,2003.

笕作者简介:

张树东,博士后,副研究员,研究方向为网络与分布式计算;

陈燕,博士,高工,研究方向为管理信息系统。

责任编辑:哈宏疆收稿日期:2010-09-23

笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕笕(上接第138页)

目标跟踪相关研究综述

Artificial Intelligence and Robotics Research 人工智能与机器人研究, 2015, 4(3), 17-22 Published Online August 2015 in Hans. https://www.360docs.net/doc/8d1581832.html,/journal/airr https://www.360docs.net/doc/8d1581832.html,/10.12677/airr.2015.43003 A Survey on Object Tracking Jialong Xu Aviation Military Affairs Deputy Office of PLA Navy in Nanjing Zone, Nanjing Jiangsu Email: pugongying_0532@https://www.360docs.net/doc/8d1581832.html, Received: Aug. 1st, 2015; accepted: Aug. 17th, 2015; published: Aug. 20th, 2015 Copyright ? 2015 by author and Hans Publishers Inc. This work is licensed under the Creative Commons Attribution International License (CC BY). https://www.360docs.net/doc/8d1581832.html,/licenses/by/4.0/ Abstract Object tracking is a process to locate an interested object in a series of image, so as to reconstruct the moving object’s track. This paper presents a summary of related works and analyzes the cha-racteristics of the algorithm. At last, some future directions are suggested. Keywords Object Tracking, Track Alignment, Object Detection 目标跟踪相关研究综述 徐佳龙 海军驻南京地区航空军事代表室,江苏南京 Email: pugongying_0532@https://www.360docs.net/doc/8d1581832.html, 收稿日期:2015年8月1日;录用日期:2015年8月17日;发布日期:2015年8月20日 摘要 目标跟踪就是在视频序列的每幅图像中找到所感兴趣的运动目标的位置,建立起运动目标在各幅图像中的联系。本文分类总结了目标跟踪的相关工作,并进行了分析和展望。

动态视频目标检测和跟踪技术(入门)

动态视频目标检测和跟踪技术 传统电视监控技术只能达到“千里眼”的作用,把远程的目标图像(原始数据)传送到监控中心,由监控人员根据目视到的视频图像对现场情况做出判断。智能化视频监控的目的是将视频原始数据转化为足够量的可供监控人员决策的“有用信息”,让监控人员及时全面地了解所发生的事件:“什么地方”,“什么时间”,“什么人”,“在做什么”。将“原始数据”转化为“有用信息”的技术中,目标检测与跟踪技术的目的是要解决“什么地方”和“什么时间”的问题。目标识别主要解决“什么人”或“什么东西”的问题。行为模式分析主要解决“在做什么”的问题。动态视频目标检测技术是智能化视频分析的基础。 本文将目前几种常用的动态视频目标检测方法简介如下: 背景减除背景减除(Background Subtraction)方法是目前运动检测中最常用的一种方法,它是利用当前图像与背景图像的差分来检测出运动目标的一种技术。它一般能够提供相对来说比较全面的运动目标的特征数据,但对于动态场景的变化,如光线照射情况和外来无关事件的干扰等也特别敏感。实际上,背景的建模是背景减除方法的技术关键。最简单的背景模型是时间平均图像,即利用同一场景在一个时段的平均图像作为该场景的背景模型。由于该模型是固定的,一旦建立之后,对于该场景图像所发生的任何变化都比较敏感,比如阳光照射方向,影子,树叶随风摇动等。大部分的研究人员目前都致力于开发更加实用的背景模型,以期减少动态场景变化对于运动目标检测效果的影响。 时间差分时间差分(Temporal Difference 又称相邻帧差)方法充分利用了视频图像的特征,从连续得到的视频流中提取所需要的动态目标信息。在一般情况下采集的视频图像,若仔细对比相邻两帧,可以发现其中大部分的背景像素均保持不变。只有在有前景移动目标的部分相邻帧的像素差异比较大。时间差分方法就是利用相邻帧图像的相减来提取出前景移动目标的信息的。让我们来考虑安装固定摄像头所获取的视频。我们介绍利用连续的图像序列中两个或三个相邻帧之间的时间差分,并且用阈值来提取出视频图像中的运动目标的方法。我们采用三帧差分的方法,即当某一个像素在连续三帧视频图像上均有相

多个目标的实时视频跟踪的先进的算法

2008 10th Intl. Conf. on Control, Automation, Robotics and Vision Hanoi, Vietnam, 17–20 December 2008 多个目标的实时视频跟踪的先进的算法 1110200210俞赛艳 Artur Loza Department of Electrical and ElectronicEngineering University of Bristol Bristol BS8 1UB, United Kingdom artur.loza@https://www.360docs.net/doc/8d1581832.html, Miguel A. Patricio, Jes′us Garc′?a, and Jos′e M. Molina Applied Artificial Intelligence Group (GIAA) Universidad Carlos III de Madrid 28270-Colmenarejo, Spain mpatrici,jgherrer@inf.uc3m.es, molina@ia.uc3m.es 摘要——本文调查了用组合和概率的方法来实现实时的视频目标跟 踪。特殊兴趣是真实世界的场景,在这场景里.多目标和复杂背景构成对非平凡的自动追踪者的挑战。在一个规范的监控视频序列里,对象跟踪是以组合数据协会和粒子过滤器为基础,通过选择完成视觉跟踪技术实现的。以详细的分析性能的追踪器测试的优点为基础,已经确定了互补的失效模式和每种方法的计算要求。考虑到获得的结果,改善跟踪性能的混合策略被建议了,为不同追踪方法带来了最好的互补特性。 关键字--概率、组合、粒子过滤器、跟踪、监视、实时、多个目标. 1、介绍 最近人们对通过单个摄像机或一个网络摄像头提供来跟踪视频序列增加了兴趣。在许多监测系统中,可靠的跟踪方法至关重要的。因为它们使运营商在远程监控感兴趣的领域,增加对形势感知能力和帮助监测分析与决策过程。跟踪系统可以应用在一个广泛的环境如:交通系统、公共空间(银行、购物)购物中心、停车场等)、工业环境、政府或军事机构。跟踪的对象通常是移动的环境中的一个高可变性。这需要复杂的算法对视频采集,相机校正、噪声过滤、运动检测,能力学习和适应环境。因为它的情况往往现实场景,系统也应该能够处理多个目标出现在现场。 为了实现强大的和可靠的多个跟踪目标,,各种各样的问题,具体到这种场景,都必须加以解决。不仅要解决状态估计问题,而且还必须使执行数据联合运行得准确,特别是当多目标交互存在时。早期多个对象跟踪的工作,关注于一个固定的数字的目标,但是人们已经认识到,很有必要解释新出现的目标以及消失的目标造成的变量数量及多个轨道数量,具有相当良好的间隔。这是典型的用扩展状态估计框架联合跟踪所有检测目标[4]。联合跟踪目标[6],避免使用几个独

视频目标跟踪算法综述_蔡荣太

1引言 目标跟踪可分为主动跟踪和被动跟踪。视频目标跟踪属于被动跟踪。与无线电跟踪测量相比,视频目标跟踪测量具有精度高、隐蔽性好和直观性强的优点。这些优点使得视频目标跟踪测量在靶场光电测量、天文观测设备、武器控制系统、激光通信系统、交通监控、场景分析、人群分析、行人计数、步态识别、动作识别等领域得到了广泛的应用[1-2]。 根据被跟踪目标信息使用情况的不同,可将视觉跟踪算法分为基于对比度分析的目标跟踪、基于匹配的目标跟踪和基于运动检测的目标跟踪。基于对比度分析的跟踪算法主要利用目标和背景的对比度差异,实现目标的检测和跟踪。基于匹配的跟踪主要通过前后帧之间的特征匹配实现目标的定位。基于运动检测的跟踪主要根据目标运动和背景运动之间的差异实现目标的检测和跟踪。前两类方法都是对单帧图像进行处理,基于匹配的跟踪方法需要在帧与帧之间传递目标信息,对比度跟踪不需要在帧与帧之间传递目标信息。基于运动检测的跟踪需要对多帧图像进行处理。除此之外,还有一些算法不易归类到以上3类,如工程中的弹转机跟踪算法、多目标跟踪算法或其他一些综合算法。2基于对比度分析的目标跟踪算法基于对比度分析的目标跟踪算法利用目标与背景在对比度上的差异来提取、识别和跟踪目标。这类算法按照跟踪参考点的不同可以分为边缘跟踪、形心跟踪和质心跟踪等。这类算法不适合复杂背景中的目标跟踪,但在空中背景下的目标跟踪中非常有效。边缘跟踪的优点是脱靶量计算简单、响应快,在某些场合(如要求跟踪目标的左上角或右下角等)有其独到之处。缺点是跟踪点易受干扰,跟踪随机误差大。重心跟踪算法计算简便,精度较高,但容易受到目标的剧烈运动或目标被遮挡的影响。重心的计算不需要清楚的轮廓,在均匀背景下可以对整个跟踪窗口进行计算,不影响测量精度。重心跟踪特别适合背景均匀、对比度小的弱小目标跟踪等一些特殊场合。图像二值化之后,按重心公式计算出的是目标图像的形心。一般来说形心与重心略有差别[1-2]。 3基于匹配的目标跟踪算法 3.1特征匹配 特征是目标可区别与其他事物的属性,具有可区分性、可靠性、独立性和稀疏性。基于匹配的目标跟踪算法需要提取目标的特征,并在每一帧中寻找该特征。寻找的 文章编号:1002-8692(2010)12-0135-04 视频目标跟踪算法综述* 蔡荣太1,吴元昊2,王明佳2,吴庆祥1 (1.福建师范大学物理与光电信息科技学院,福建福州350108; 2.中国科学院长春光学精密机械与物理研究所,吉林长春130033) 【摘要】介绍了视频目标跟踪算法及其研究进展,包括基于对比度分析的目标跟踪算法、基于匹配的目标跟踪算法和基于运动检测的目标跟踪算法。重点分析了目标跟踪中特征匹配、贝叶斯滤波、概率图模型和核方法的主要内容及最新进展。此外,还介绍了多特征跟踪、利用上下文信息的目标跟踪和多目标跟踪算法及其进展。 【关键词】目标跟踪;特征匹配;贝叶斯滤波;概率图模型;均值漂移;粒子滤波 【中图分类号】TP391.41;TN911.73【文献标识码】A Survey of Visual Object Tracking Algorithms CAI Rong-tai1,WU Yuan-hao2,WANG Ming-jia2,WU Qing-xiang1 (1.School of Physics,Optics,Electronic Science and Technology,Fujian Normal University,Fuzhou350108,China; 2.Changchun Institute of Optics,Fine Mechanics and Physics,Chinese Academy of Science,Changchun130033,China)【Abstract】The field of visual object tracking algorithms are introduced,including visual tracking based on contrast analysis,visual tracking based on feature matching and visual tracking based on moving detection.Feature matching,Bayesian filtering,probabilistic graphical models,kernel tracking and their recent developments are analyzed.The development of multiple cues based tracking,contexts based tracking and multi-target tracking are also discussed. 【Key words】visual tracking;feature matching;Bayesian filtering;probabilistic graphical models;mean shift;particle filter ·论文·*国家“863”计划项目(2006AA703405F);福建省自然科学基金项目(2009J05141);福建省教育厅科技计划项目(JA09040)

(完整版)视频目标检测与跟踪算法综述

视频目标检测与跟踪算法综述 1、引言 运动目标的检测与跟踪是机器视觉领域的核心课题之一,目前被广泛应用在视频编码、智能交通、监控、图像检测等众多领域中。本文针对视频监控图像的运动目标检测与跟踪方法,分析了近些年来国内外的研究工作及最新进展。 2、视频监控图像的运动目标检测方法 运动目标检测的目的是把运动目标从背景图像中分割出来。运动目标的有效分割对于目标分类、跟踪和行为理解等后期处理非常重要。目前运动目标检测算法的难点主要体现在背景的复杂性和目标的复杂性两方面。背景的复杂性主要体现在背景中一些噪声对目标的干扰,目标的复杂性主要体现在目标的运动性、突变性以及所提取目标的非单一性等等。所有这些特点使得运动目标的检测成为一项相当困难的事情。目前常用的运动目标检测算法主要有光流法、帧差法、背景相减法,其中背景减除法是目前最常用的方法。 2.1帧差法 帧差法主要是利用视频序列中连续两帧间的变化来检测静态场景下的运动目标,假设f k(x, y)和f(k i)(x, y)分别为图像序列中的第k帧和第k+1帧中象素点(x,y)的象素值,则这两帧图像的差值图像就如公式2-1所示: Diff ki f k(x, y) f(k 1)(x, y)(2-1)2-1式中差值不为0的图像区域代表了由运动目标的运动所经过的区域(背景象素值不变),又因为相邻视频帧间时间间隔很小,目标位置变化也很小,所以运动目标的运动所经过的区域也就代表了当前帧中运动目标所在的区域。利用此原理便可以提取出目标。下图给出了帧差法的基本流程:1、首先利用2-1式得到第k帧和第k+1帧的差值图像Diff k 1;2、对所得到的差值图像Diff k 1二值化(如 式子2-2示)得到Qk+1 ;3、为消除微小噪声的干扰,使得到的运动目标更准 确,对Q k 1进行必要的滤波和去噪处理,后处理结果为M k 1。 1

多目标跟踪方法研究综述

经过近40多年的深入研究和发展,多目标跟踪技术在许多方面都有着广泛应用和发展前景,如军事视觉制导、机器人视觉导航、交通管 制、 医疗诊断等[1-2]。目前,虽然基于视频的多运动目标跟踪技术已取得了很大的成就,但由于视频中图像的变化和物体运动的复杂性,使得对多运动目标的检测与跟踪变得异常困难,如多目标在运动过程中互遮挡、监控场景的复杂性等问题,解决上述难题一直是该领域所面临的一个巨大挑战,因此,对视频中多目标跟踪技术研究仍然是近年来一个热门的研究课题[3-5]。 1、多目标跟踪的一般步骤 基于视频的多目标跟踪技术融合了图像处理、模式识别、人工智能、 自动控制以及计算机视觉等众多领域中的先进技术和核心思想。不同的多目标跟踪方法其实现步骤有一定的差异,但多目标跟踪的主要 流程是相同的,如图1所示,其主要包括图像预处理、 运动目标检测、多目标标记与分离、多目标跟踪四个步骤。 图1多目标跟踪基本流程图 2、多目标跟踪方法 多目标跟踪方法可以根据处理图像或视频获取视点的多少分为两大类,一类是单视点的多目标跟踪,另一类就是多视点的多目标跟踪。 2.1单视点的方法 单视点方法是针对单一相机获取的图像进行多目标的检测和跟踪。该方法好处在于简单且易于开发,但由于有限的视觉信息的获取,很难处理几个目标被遮挡的情况。 块跟踪(Blob-tracking)是一种流行的低成本的跟踪方法[6-7]。这种方法需要首先在每一帧中提取块,然后逐帧寻找相关联的块,从而实现跟 踪。 例如BraMBLe系统[8]就是一个基于已知的背景模型和被跟踪的人的外表模型计算出块的似然性的多块跟踪器。这种方法最大的不足之处在于:当由于相似性或者遮挡,多个目标合并在一起时,跟踪将导致失败。因此,可以取而代之的方法是通过位置、外观和形状保留清晰目标的状态。文献[9]利用组合椭圆模拟人的形状,用颜色直方图模拟不同人的外观,用一个增强高斯分布模拟背景以便分割目标,一旦场景中发现对应于运动头部的像素,一个MCMC方法就被用于获取多个人的轮廓的最大后验概率,在单相机的多人跟踪应用中取得了非常有意义的结果。Okuma等人提出了一种将Adaboost算法和粒子滤波相结合的方法[10]。该方法由于充分利用了两种方法的优点,相比于单独使用这两种方法本身,大大降低了跟踪失败的情形,同时也解决了在同一框架下检测和一致跟踪的问题。Brostow等人提出了一个用于在人群中检测单个行人的特征点轨迹聚类的概率框架[11]。这个框架有一个基本假设是一起运动的点对可能是同一个个体的一部分,并且把它用于检测和最终的跟踪。对于完全和部分遮挡目标以及外观变化,这些方法和另外一些相似的方法都有很大的局限性。 为了解决遮挡问题,一系列单视点跟踪技术应运而生。典型的方法 是利用块合并来检测遮挡的发生[12]。当被跟踪的点消失, 跟踪特征点的方法就简单的将其作为一个被遮挡特征点。近年来,基于目标轮廓和外观的跟踪技术利用隐含的目标到相机的深度变化来表示和估计目标间的遮挡关系。但大多数方法都只能解决部分遮挡,不能解决完全被遮挡 的情况。 另外,小的一致运动被假设为是可以从遮挡视点中可以预测运动模式的,这些给没有预测运动的较长时间的遮挡的处理带来问题。尽管这些单视点的方法有较长的研究历史,但这些方法由于不能明锐的 观察目标的隐藏部分,因此不能很好地解决有2或3个目标的遮挡问题。 2.2多视点的方法 随着复杂环境中对检测和跟踪多个被遮挡的人和计算他们的精确 位置的需要,多视点的方法成为研究的热点。 多视点跟踪技术的目的就是利用不同视点的冗余信息,减少被遮挡的区域,并提供目标和场景的3D信息。尽管通过相机不能很好地解决目标跟踪问题,但却提出了一些很好的想法,如选择最佳视点,但这些方法都以实际环境模型和相机校正为特征。 90年代后半期,在很多文献中给出了多视点相关的多目标跟踪方法。 比如利用一个或多个相机与观察区域相连的状态变化映射,同时给出一系列的行为规则去整合不同相机间的信息。利用颜色在多个视点中进行多目标的跟踪的方法,该方法模拟了从基于颜色直方图技术的 背景提取中获得的连接块并应用其去匹配和跟踪目标。 除此之外,也有在原来的单视点跟踪系统进行扩展的多视点跟踪方法。该方法主要是通过一个预测,当预测当前的相机不在有一个好的视点时,跟踪就从原来凯斯的那个单相机视点的跟踪转换到另外一个相机,从而实现多视点的跟踪。基于点与它对应的极线的欧氏距离的空间匹配方法、贝叶斯网络和立体相对合并的方法都是多目标多视点跟踪的常见方法。尽管这些方法都试图去解决遮挡问题,但由于遮挡的存在,基于特征的方法都不能根本解决,其次,这些方法中的遮挡关系的推理一般都是根据运动模型,卡尔曼滤波或者更普遍的马尔科夫模型的时间一致性来进行的。因此,当这个过程开始发散,这些方法也不能恢复遮挡关系。 最近一种基于几何结构融合多个视点信息的Homegraphicoccupancyconsrraint(HOC)[12]方法,可以通过在多场景平台对人的定位来解决遮挡问题。仅采用随时间变化的外表信息用于从背景中检测前景,这使得在拥挤人流的场景中的外表遮挡的解决更健壮。利用多视点中的前景信息,主要是试图找到被人遮挡的场景点的图像位置,然后这些被遮挡的信息用于解决场景中多个人的的遮挡和跟踪问题。在这种思想指导下,Mittal,Leibe,Franco等的研究工作和机器人导航中基于遮挡网格的距离传感器的并行工作是相似的,这些方法在融合3D空间信息的时候需要进行校正相机。但HOC方法是完全基于图像的,仅需要2D结构信息进行图像平面的融合。当然也有另外一些不需要进行相机校正的算法被提出,但需要学习一个与相机最小相关的信息。在目标跟踪过程中,由于这些方法依赖于单个相机的场景,对于拥挤场景中目标分布密度增加九无能为力了。在HOC的多视点的目标跟踪中,对于任何单一相机的场景,或者相机对的场景,都不需要进行定位和跟踪目标,而是从所有相机的场景中收集证据,形成一个统一的框架,由于该方法能够从多个时间帧的场景中进行场景被遮挡概率的全局轨迹优化,因此可以同时进行检测和跟踪。 3、总结 动态目标检测与跟踪是智能监控系统的重要组成部分,它融合了图像处理、模式识别、自动控制及计算机应用等相关领域的先进技术和研究成果,是计算机视觉和图像编码研究领域的一个重要课题,在军事武器、工业监控、交通管理等领域都有广泛的应用。尤其是对于多目标检测与跟踪中的遮挡与被遮挡的处理,对提高智能监控中目标的行为分析有着重要的意义。随着监控设备的发展和设施的铺设,多视点的场景图像是很容易得到的,因此借助信息融合的思想,充分利用不同角度对目标的描述信息,可以很大地改进目前基于单视点的多目标检测和跟踪的精度,能够很好地解决单视点方法中不能很好解决的遮挡问题。参考文献 [1]胡斌,何克忠.计算机视觉在室外移动机器人中的应用.自动化学报,2006,32(5):774-784. [2]A.Ottlik,H.-H.Nagel.InitializationofModel-BasedVehicleTrackinginVideoSequencesofInner-CityIntersections.InternationalJournalofComputerVision,2008,80(2):211-225.多目标跟踪方法研究综述 苏州联讯图创软件有限责任公司 陈宁强 [摘要]文章对目前现有的多目标跟踪方法从信息获取的不同角度进行了综述。主要分析比较了目前单视点和多视点目标跟踪方 法对于目标遮挡问题的处理性能,并指出多视点的基于多源信息融合的思想,可以较好地解决场景中目标的遮挡问题。[关键词]单视点多视点目标跟踪信息融合基金项目:本文系江苏省自然科学基金(BK2009593)。 作者简介:陈宁强(1973-),男,江苏苏州人,工程师,主要研究方向:GIS、模式识别和图像处理与分析。 目标跟踪多目标标记与分离 匹配 目标模型 运动检测当前帧图像 背景提取 去噪 ROI 预处理 视频序列 (下转第26页)

单目视觉定位方法研究综述

万方数据

万方数据

万方数据

万方数据

单目视觉定位方法研究综述 作者:李荣明, 芦利斌, 金国栋 作者单位:第二炮兵工程学院602教研室,西安,710025 刊名: 现代计算机:下半月版 英文刊名:Modem Computer 年,卷(期):2011(11) 参考文献(29条) 1.R.Horaud;B.Conio;O.Leboullcux An Analytic Solution for the Perspective 4-Point Problem 1989(01) 2.任沁源基于视觉信息的微小型无人直升机地标识别与位姿估计研究 2008 3.徐筱龙;徐国华;陈俊水下机器人的单目视觉定位系统[期刊论文]-传感器与微系统 2010(07) 4.邹伟;喻俊志;徐德基于ARM处理器的单目视觉测距定位系统[期刊论文]-控制工程 2010(04) 5.胡占义;雷成;吴福朝关于P4P问题的一点讨论[期刊论文]-自动化学报 2001(06) 6.Abdel-Aziz Y;Karara H Direct Linear Transformation from Comparator to Object Space Coordinates in Close-Range Ph- togrammetry 1971 7.Fishier M A;Bolles R C Random Sample Consensus:A Paradigm for Model Fitting with Applications to Image Analy-s~s anu Automated tartograpny 1981(06) 8.祝世平;强锡富用于摄像机定位的单目视觉方法研究[期刊论文]-光学学报 2001(03) 9.沈慧杰基于单目视觉的摄像机定位方法的研究 2009 10.任沁源;李平;韩波基于视觉信息的微型无人直升机位姿估计[期刊论文]-浙江大学学报(工学版) 2009(01) 11.刘立基于多尺度特征的图像匹配与目标定位研究[学位论文] 2008 12.张治国基于单目视觉的定位系统研究[学位论文] 2009 13.张广军;周富强基于双圆特征的无人机着陆位置姿态视觉测量方法[期刊论文]-航空学报 2005(03) 14.Zen Chen;JenBin Huang A Vision-Based Method for theCircle Pose Determination with a Direct Geometric Interpre- tation[外文期刊] 1999(06) 15.Safaee-Rad;I.Tchoukanov;K.C.Smith Three-Dimension of Circular Features for Machine Vision 1992 16.S.D.Ma;S.H.Si;Z.Y.Chen Quadric Curve Based Stereo 1992 17.D.A.Forsyth;J.L.Munday;A.Zisserman Projective In- variant Representation Using Implicit Algebraic Curves 1991(02) 18.吴朝福;胡占义PNP问题的线性求解算法[期刊论文]-软件学报 2003(03) 19.降丽娟;胡玉兰;魏英姿一种基于平面四边形的视觉定位算法[期刊论文]-沈阳理工大学学报 2009(02) 20.Sun Fengmei;Wang Weining Pose Determination from a Single Image of a Single Parallelogram[期刊论文]-Acta Automatica Sinica 2006(05) 21.吴福朝;王光辉;胡占义由矩形确定摄像机内参数与位置的线性方法[期刊论文]-软件学报 2003(03) 22.王晓剑;潘顺良;邱力为基于双平行线特征的位姿估计解析算法[期刊论文]-仪器仪表学报 2008(03) 23.刘晓杰基于视觉的微小型四旋翼飞行器位姿估计研究与实现 2009 24.刘士清;胡春华;朱纪洪一种基于灭影线的无人直升机位姿估计方法[期刊论文]-计算机工程与应用 2004(9) 25.Mukundan R;Raghu Narayanan R V;Philip N K A Vision Based Attitude and Position Estimation Algorithm for Rendezvous and Docking 1994(02)

目标跟踪算法综述

。 目标跟踪算法综述 大连理工大学卢湖川一、引言 目标跟踪是计算机视觉领域的一个重 要问题,在运动分析、视频压缩、行为识 别、视频监控、智能交通和机器人导航等 很多研究方向上都有着广泛的应用。目标 跟踪的主要任务是给定目标物体在第一帧 视频图像中的位置,通过外观模型和运动 模型估计目标在接下来的视频图像中的状 态。如图1所示。目标跟踪主要可以分为5 部分,分别是运动模型、特征提取、外观 模型、目标定位和模型更新。运动模型可 以依据上一帧目标的位置来预测在当前帧 目标可能出现的区域,现在大部分算法采用的是粒子滤波或相关滤波的方法来建模目标运动。随后,提取粒子图像块特征,利用外观模型来验证运动模型预测的区域是被跟踪目标的可能性,进行目标定位。由于跟踪物体先验信息的缺乏,需要在跟踪过程中实时进行模型更新,使得跟踪器能够适应目标外观和环境的变化。尽管在线目标跟踪的研究在过去几十年里有很大进展,但是由被跟踪目标外观及周围环境变化带来的困难使得设计一个鲁棒的在线跟踪算法仍然是一个富有挑战性的课题。本文将对最近几年本领域相关算法进行综述。 二、目标跟踪研究现状 1. 基于相关滤波的目标跟踪算法 在相关滤波目标跟踪算法出现之前,大部分目标跟踪算法采用粒子滤波框架来进行目标跟踪,粒子数量往往成为限制算法速度的一个重要原因。相关滤波提出了 一种新颖的循环采样方法,并利用循环样 本构建循环矩阵。利用循环矩阵时域频域 转换的特殊性质,将运算转换到频域内进 行计算,大大加快的分类器的训练。同时, 在目标检测阶段,分类器可以同时得到所 有循环样本得分组成的响应图像,根据最 大值位置进行目标定位。相关滤波用于目 标跟踪最早是在MOSSE算法[1]中提出 的。发展至今,很多基于相关滤波的改进 工作在目标跟踪领域已经取得很多可喜的 成果。 1.1. 特征部分改进 MOSSE[1] 算法及在此基础上引入循 环矩阵快速计算的CSK[2]算法均采用简单 灰度特征,这种特征很容易受到外界环境 的干扰,导致跟踪不准确。为了提升算法 性能,CN算法[3]对特征部分进行了优 化,提出CN(Color Name)空间,该空 间通道数为11(包括黑、蓝、棕、灰、绿、 橙、粉、紫、红、白和黄),颜色空间的引 入大大提升了算法的精度。 与此类似,KCF算法[4]采用方向梯度 直方图(HOG)特征与相关滤波算法结合, 同时提出一种将多通道特征融入相关滤波 的方法。这种特征对于可以提取物体的边 缘信息,对于光照和颜色变化等比较鲁棒。 方向梯度直方图(HOG)特征对于运 动模糊、光照变化及颜色变化等鲁棒性良 好,但对于形变的鲁棒性较差;颜色特征 对于形变鲁棒性较好,但对于光照变化不 够鲁棒。STAPLE算法[5]将两种特征进行 有效地结合,使用方向直方图特征得到相 关滤波的响应图,使用颜色直方图得到的 统计得分,两者融合得到最后的响应图像 并估计目标位置,提高了跟踪算法的准确 度,但也使得计算稍微复杂了一些。 图1 目标跟踪算法流程图

目标识别与跟踪综述

综述 摘要:人体的运动分析主要指的是对场景中的运动个体或者群体进行运动检测、运动跟踪与理解以到达描述人体行为的目的。通过阅读文献,本文将从人体检测,人体跟踪和人群运动分析三个方面介绍人群特征分析的方法。 1.绪论 随着社会的发展,公共需求的提高,群体运动的分析越来越受关注。并且随着人口的增长,人群活动日益增加,相应的人群安全问题也越来越突出。对人群的分析研究分别在社会学、心理学、建筑学、计算机等各个学科受到极大的关注。人群分析主要分为以下五个方面。 (1)人群管理:对大型集会的人群管理,是公共安全管理领域中最亟待解决的问题。人群分析可以更好的发展人群管理策略,避免因人群拥挤而发生的灾难事件,确保人身安全。 (2)虚拟环境:通过构造人群的数学模型结构,在虚拟环境下来模拟人群场景,来丰富人的生活体验。如一些虚拟的聊天室、电影或者动画制作过程中的特效应用等。 (3)智能环境:在一些涉及到大型人群的智能环境下,人群分析可以预协调人群。如在博物馆,人群的模式决定了如何疏散人群。 (4)公共场所设计:人群分析可以为公共场所的设计提供指导,如对商场的人流估计,使得商场的布局更方便于顾客或者最可能有效的利用空间优化办公室场所。 (5)视觉监控:人群分析可以用来自动检测场景中的异常情况。而且,在人群中的个体跟踪有助于协助安防人员捕捉嫌疑犯。 虽然人群运动分析技术研究已取得了一定的成果,但是人群运动的复杂性以及实际运动场景的多变性仍然给人群运动分析带来很多的研究难点。目前在人群运动的自动检测与跟踪方面,也没有相对完善的理论基础,各向技术也处在完善阶段。主要表现在: (1)运动检测与分割:在人群运动分析系统中,如何对人群运动实现快速而准确的分割是极为重要的难题。由于视频序列中运动场景极易受到各种客观因素的影响,如光照变化、背景与前景的混杂干扰、运动目标与环境之间或者运动目标之间的遮挡现象等,使得对人群运动实现有效分割变的十分的困难。目前常用的运动分割算法如帧间差分法或背景相减法都难以适应复杂或者拥挤场景的运动分