一种基于支持向量机的三维物体识别方法

第23卷 第4期 电子测量与仪器学报 Vol. 23 No. 4

2009年4月

JOURNAL OF ELECTRONIC MEASUREMENT AND INSTRUMENT

· 43 ·

本文于2008年7月收到。

* 基金项目: 2008德州仪器创新基金资助项目。

一种基于支持向量机的三维物体识别方法*

徐 胜 彭启琮 管 庆 赵明渊

(电子科技大学通信与信息工程学院, 成都 610054)

摘 要: 提出从三维物体的二维图像中提取仿射不变傅氏描述子、色彩矩及纹理特征, 组成一个25维的特征向量, 送入支持向量机训练并用于三维物体识别。算法利用了仿射不变傅氏描述子在物体发生仿射形变时具有不变性, 利用色彩矩和纹理特征区分形状相似但有不同颜色及纹理的物体, 并引入支持向量机作为分类器。基于三维物体图像数据库COIL-100测试了算法的识别性能, 当每个物体训练样本图像数量为36个(视角间隔10°)时达到了100%的识别率, 进一步减少训练视角数量也达到较满意的识别性能。

关键词: 三维物体识别;仿射不变傅氏描述子;色彩矩;纹理分析;支持向量机 中图分类号: TP391.4 文献标识码: A 国家标准学科分类代码: 520.2060

A method for 3-d object recognition based on support vector machine

Xu Sheng Peng Qicong Guan Qing Zhao Mingyuan

(School of Communication and Information Engineering, Univ. of Electron. Sci. & Tech. of China, Chengdu 610054, China)

Abstract: To improve the performance of 3D objects recognition system, a method is proposed to extract the af-fine-invariant Fourier descriptors (AIFD), color moments and texture features from the 2D images of 3D objects. These features are combined into a feature vector of 25 components and sent to support vector machines for training and rec-ognition. The invariance properties of AIFD under affine transformation (translation, scaling, rotation and shearing) for an object are used in this method. And color moment and texture features are used to distinguish the object of similar shape and different appearance. Support vector machines are used as classifier. Based on the public 3D objects dataset COIL-100 the method was assessed. 100% correct rate of recognition is achieved when the number of presented train-ing views for each object is 36 (10 degrees interval). When the number of training views is reduced, the correct rate of recognition is also satisfied.

Keywords: 3D object recognition; AIFD; color moments; texture analysis; support vector machine

1 引 言

目前出于城市规划、电子交通监控、工业测量自动化、军事侦察及医疗仪器等各个领域的大量应用需求, 三维物体识别已成为一个较活跃的研究领域, 具有很大的实用价值和重要意义[1]。基于外观(appearance-based)或基于视图(view-based)的三维物体识别算法研究, 近来成为人们研究的热点[2-5]。虽

然基于视图的方法不易克服物体重叠问题, 但当物体的几何建模很困难或根本不可能得到时, 就可利用该方法来识别三维物体[6]。在一副二维图像中, 三维物体的外观取决于其形状, 反射特性, 姿态和环境亮度等, Murase 等较早的提出了参数化的特征空间方法, 直接从三维物体的外观进行识别[7]。20世纪90年代初期,Vapnik 等在统计学习理论基础上提出了一种新的机器学习方法, 即支持向量机SVM (Sup-

·44 ·电子测量与仪器学报2009年

port Vector Machine)[8], 开始应用于三维物体识别问题。Roobaert[9]等比较了支持向量机在各种物体表达输入下的性能。文献[4]通过小波变换将图像分解为子图, 并对每个子图进行奇异值分解来提取特征向量, 然后送入支持向量机进行分类。Yang等[5,10]提出的基于视图的算法使用含有线性单元的网络SnoW (sparse network of winnows)来学习物体的表达, 转换二维彩色图像为32×32像素分辨率的灰度图像后, 使用基于象素和基于边缘的物体表达进行物体识别实验。

总结起来, 这些方法都从一个基本思想出发, 即通过视觉相似性来识别物体, 通过三维物体在二维图像中呈现出的不同姿态和不同光照条件来学习或训练系统, 然后在一副未知的二维图像中判断是否存在目标物。本文从这个基本思想出发, 对之前的工作[11]进行改进, 提出从三维物体的二维图像中仅提取少数几个显著特征, 包括仿射不变傅氏描述子、色彩矩和纹理特征组合作为三维物体的特征向量, 送入支持向量机进行训练并用于三维物体识别。仿射不变傅氏描述子对物体形状畸变不敏感, 在任意仿射变换下能保持不变的特性, 包括物体的平移(translation), 旋转(rotation), 缩放(scale)和剪切(shear)[12]; 颜色和纹理是物体最为直观的视觉属性, 包含了丰富的信息, 颜色的不同空间分布能够影响人对图像的理解, 纹理特征可对局部区域的象素关系进行刻画。因此算法选用了上述三种特征向量的组合进行三维物体识别, 理论上能够区分外观相似并具有不同颜色和纹理的三维物体。本文方法基于哥伦比亚物体图像库COIL-100 (columbia object image library)[7]的所有100个具有复杂外形的三维物体进行了测试, 在训练样本图像数量为每物体36个(视角间隔10°)情况下达到了100%的识别率。2相关理论基础

2.1仿射不变傅氏描述子

在实际场景中有相当多因素会影响物体的成像, 包括距离、天气、照相设备以及视觉角度等, 导致三维物体的二维成像发生仿射变形。对于二维空间中的任意一条曲线[x, y], 若[x', y']为其仿射变换后的曲线, 则仿射变换为:

[]T

11121

21222

,

a a b

x x

x y

y y

a a b

????

'

????

=+=+

????

????

'

????

????

????

A B(1)

仿射不变傅氏描述子(affine-invariant Fourier descriptors,下文简称AIFD)[12]是一种仿射不变量, 对物体形状畸变不敏感, 在仿射变换下能保持不变的特性, 本文将其用于抵抗三维物体在不同视角下投影为二维图像时产生的不可避免的失真。

提取AIFD特征首先要获得物体边缘轮廓的参数化描述, 这种参数必须相对于仿射变换是线性的, 只有这样后续的傅氏变换才能够保持仿射变换的线性; 另外这种参数能够使得所提取的不变特征量与仿射变换参数A,B及初始点选择无关。可利用文献[12]给出的一种参数化方法:

1

det((),()d

2

1

(()()()()d

2

t p p

x y y x

ξξξ

ξξξξξ

'

==

''

-

(2) 式中: 二维向量()

pξ由轮廓曲线坐标{(),()}

x y

ξξ构成, (),()

x y

ξξ

''分别是(),()

x y

ξξ的一阶导数。如果式(1)中0

B≠, 需要将坐标原点移到轮廓曲线的面积中心c p:

2()det((),())d

3det((),())d

c

p p p

p

p p

ξξξξ

ξξξ

'

=

'

(3) 参数化后, 边缘轮廓上的点可表示为:[]T

() ()

u t v t

=

p, 对两个分量分别作傅氏变换可以得到傅氏级数系数:

03

12

03

12

U U

U U

V V

V V

??

=??

??

F

文献[12]给出了如何由傅氏系数F构造仿射不变量AIFD的方法: 令*

det,

k k p

I F F k p

??

=≠

??

, 其中F k,

c

ò?

c

ò?

c

ò?

c

ò?

第4期 一种基于支持向量机的三维物体识别方法 · 45 ·

F p 为任意两个傅氏系数, 则:

,1,2,3,;k k p Q I I k == p 为任意常数

(4)

即得到与任意仿射变换参数A , B 和起始点无关的仿射不变量Q k 。 2.2 色彩矩

同几何特征相比, 物体的颜色特征更为稳健, 对于物体的大小和方向均不敏感, 表现出较强的鲁棒性, 并且用颜色特征描述图像中的物体简便有效。根据概率论, 一个概率分布可唯一的由其矩来表征。一副图像的色彩分布也可认为是一种概率分布, 所以颜色分布也可由其矩来决定。利用Stricker [13]提出存储一副图像的每个颜色通道的前三阶矩的方法来提取物体特征, 对于一副RGB 或HSI 格式的图像, 仅需计算9个矩值。每个颜色通道的第一阶矩是图像的色彩均值, 第二阶中心矩是图像的方差, 第三阶矩是图像每个通道的偏度。为了让矩值具有相同的单位, 可以使用图像的标准差和偏度的三次方根。

为了提取物体的色彩特征, 首先需要选择适宜的色彩空间。RGB 色彩空间是计算机图像处理中最常用的色彩模型, 但本文方法推荐使用HSI 色彩空间(即色度Hue, 饱和度Saturation 和亮度Intensity)。HSI 色彩模型更适合计算色彩矩, 因为色度和饱和度分量较为接近人类对色彩感知方式, 另外亮度分量与图像的色彩信息无关。若p ij 为离散图像f (x ,y )的象素, A 为图像区域, 则每个图像通道的前三阶矩定义如式(5)所示:

(

)(

)1/2

21/3

31

1, ,

1

ij ij i j i j

ij i j

p p A A s p A μσμ

μ??

==-??

??

??

??

=-??

??

??

∑∑∑∑∑∑ (5)

2.3 基于灰度共生矩阵(GLCM)的纹理特征

纹理分析广泛应用在遥感, 自动检测和医疗图像处理等领域。纹理是物体在图像中的一个重要特征, 可对图像中的空间信息进行一定程度的定量描述, 两幅颜色相似的图像通常可以利用其纹理进行

区分, 本文将其应用到了三维物体识别。灰度共生矩

阵GLCM(gray level co-occurrence matrix)[14]是一种使用较为广泛的纹理分析方法, 它使用二阶统计量来估计图像属性。构造灰度共生矩阵P d (i ,j )方法是: 其每个元素(i ,j )代表在原始图像中灰度值为i 和j 、相距为d 的象素对的数量。Haralick [14]提出从GLCM 中提取出14个统计特征, 用来估计各个不同灰度值i 和j 、相距不同距离d 的象素对的灰度共生矩阵的相似性。为减少计算复杂性, 本文仅选择了其中4个纹理特征作为二维图像中的三维物体的特征, 如表1所示。

表1 基于GLCM 的纹理特征

Table 1 Texture feature based on GLCM

2,Con ()(,)d i j

i j P i j =-∑

2,En (,)d i j

P i j =∑

,()()(,)

Cor x y d i j

x y

i u j u P i j σσ--=

∑

,(,)Hom 1d i j P i j i j

=+-∑

1) 对比度(contrast): 度量灰度共生矩阵的局部方差, 即测量整个图像中某个象素与其邻域的亮度对比度。

2) 相关性(correlation): 度量指定象素对出现的联合概率, 即测量整个图像中某个象素与其邻域相关性如何。表中u x , u y , σx , σy 分别是P x , P y 的均值和标准差, P x 是P d (i , j )每行之和, P y 是P d (i , j )每列之和。

3) 能量(energy): 计算灰度共生矩阵每个元素的平方和。

4) 同质性(homogeneity): 度量灰度共生矩阵各

元素分布与其对角线的靠近程度。 2.4 支持向量机

从二维图像中得到三维物体上述各种特征后, 根据特征进行三维物体的识别从模式识别角度看是一个分类问题。近年来, 支持向量机SVM(support vector machines)的研究广泛开展, 在解决小样本、非线性及高维模式识别问题中表现出许多特有的优势[4]。支持向量机以统计学理论为基础[8], 因而具有严格的理

· 46 · 电子测量与仪器学报 2009年

论和数学基础, 与神经网络结构设计相比, 无需依赖于设计者的经验及先验知识, 避免了神经网络实现中的经验成分; 算法可最终转化为凸优化问题, 因而可保证算法的全局最优性, 避免了神经网络无法解决的局部最小问题

[9,15]

。

设给定大小为l 的训练样本集{(x i , y i ), i =1,2,…,l }由两类模式组成, 如果x i ∈R N

属于第一类, 标记为正(y i =1); 如果属于第二类, 则标记为负(y i =-1)。如果训练样本集线性可分, 则存在分类超平面w ·x i +b =0使得

()1, 1,2,,i i y b i l ?+= ≥w x

(6)

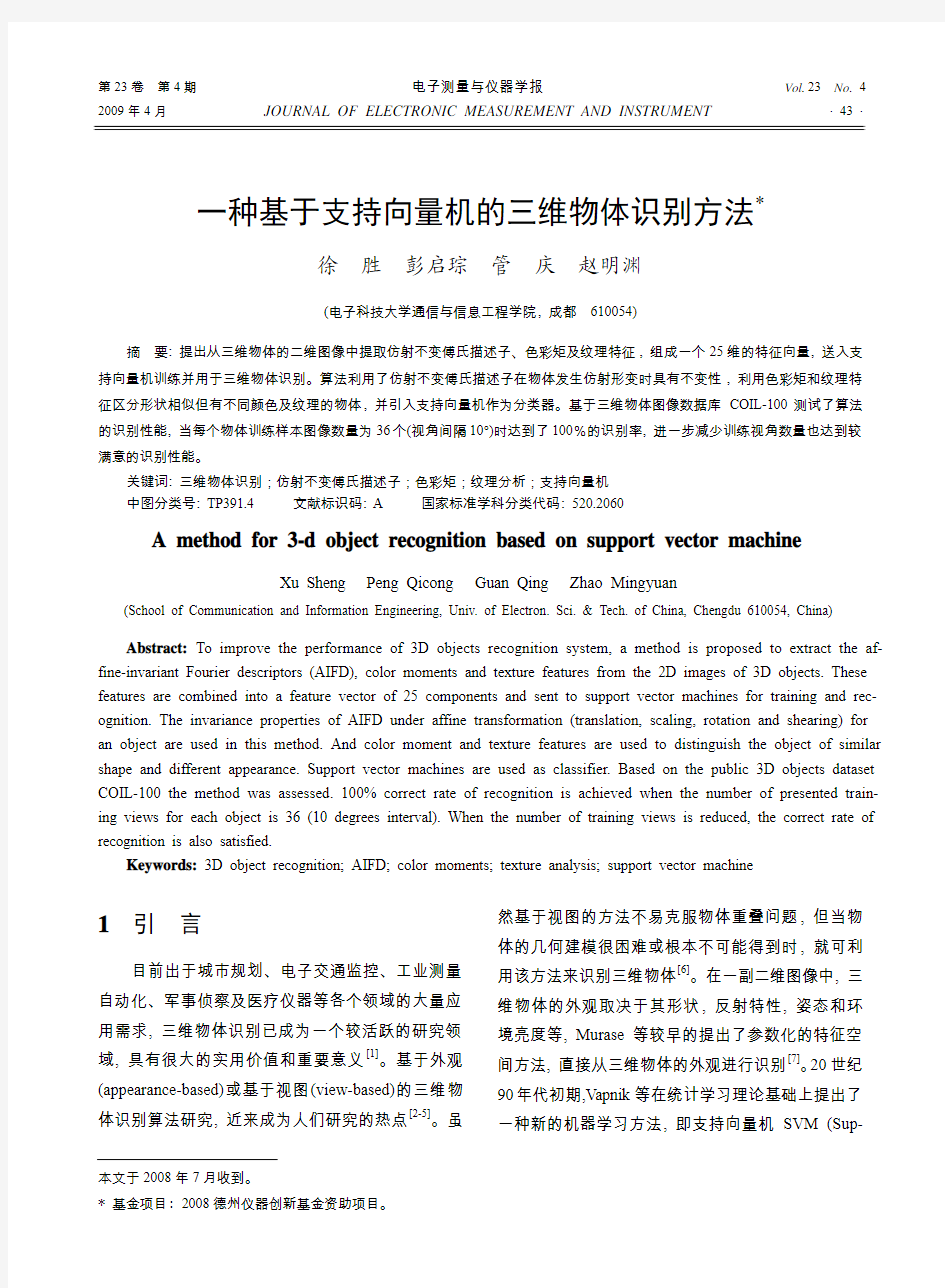

式中: w ∈R N 。由统计学习理论, 如果所有训练样本集被超平面正确的分开, 并且距离超平面最近的样本数据与超平面之间的距离达到最大, 则该超平面为最优超平面, 如图1所示。

图1 最优分类超平面

Fig. 1 Optimal Separating Hyperplane (OSH)

由于要求分类超平面不仅能将两类样本正确的分开, 而且要使间隔最大, 分类间隔等于2/||w ||, 因此最大化分类间隔等价于最小化||w ||2/2, 这样最优超平面的求解就变为如式(7)的二次规划问题:

2

1min

, 2..:()1, 1,2,,b i i s t y b i l

?+=w, ≥w w x (7)

本文所研究的三维物体识别属于非线性分类问题。当训练样本集非线性可分时, 可通过某一非线性函数φ(·)将训练集数据x 映射到一个高维线性特征空间, 在这个维数可能为无穷大的线性空间中构造最优分类超平面w ·φ (x i )+b =0

最优分类超平面问题(7)变为式(8)的形式:

2

11min , 2..:(())1,1,2,...,,0

l i b i i i i i C s t y b i l ξφξξ=??+ ???

?+-=∑,≥≥w w w x (8) 式中: ξi ,i =1,2,…,l 为非负松弛变量, C 为惩罚系数。采用拉格朗日乘子法, 求解该具有线性约束的二次规划问题, 可以得到: *

*11

(), ..:0,0l

l

i i i

i i i i i y s t y C αφαα====∑

∑≤≤w x (9)

因此判别函数为:

**1()sgn (,)l i i i i y x y K b α=????

=+??????

∑x x

(10)

式中:(,)()()i i K φφ=x x x x 为核函数。尽管通过非线性函数将样本数据映射到具有高维甚至无穷维的特征空间, 并在特征空间中构造最优分类超平面, 但在计算判别函数时, 并不需要显示计算该非线性函数, 而只需计算核函数, 从而避免特征空间维数灾难问题。选择满足Mercer 条件的不同的内积核函数, 就可构造不同的支持向量机。本文采用高斯核宽度为σ的高斯径向基RBF(radial basis function):

22(,)exp(||||/2)i i K σ=--x x x x

(11)

3 计算机仿真实验

基于哥伦比亚物体图像数据库C O I L -100 (Columbia object image library)[7]测试了本文方法的识别性能。COIL-100是目前使用较为广泛的用于评估三维物体识别算法的三维物体图像数据库, 包含100个外形和反射特性都有很大差异的物体, 每个物体有72个不同视角、分辨率为128×128的真彩图像, 共计7 200幅。该数据库的生成是将物体置于一个旋

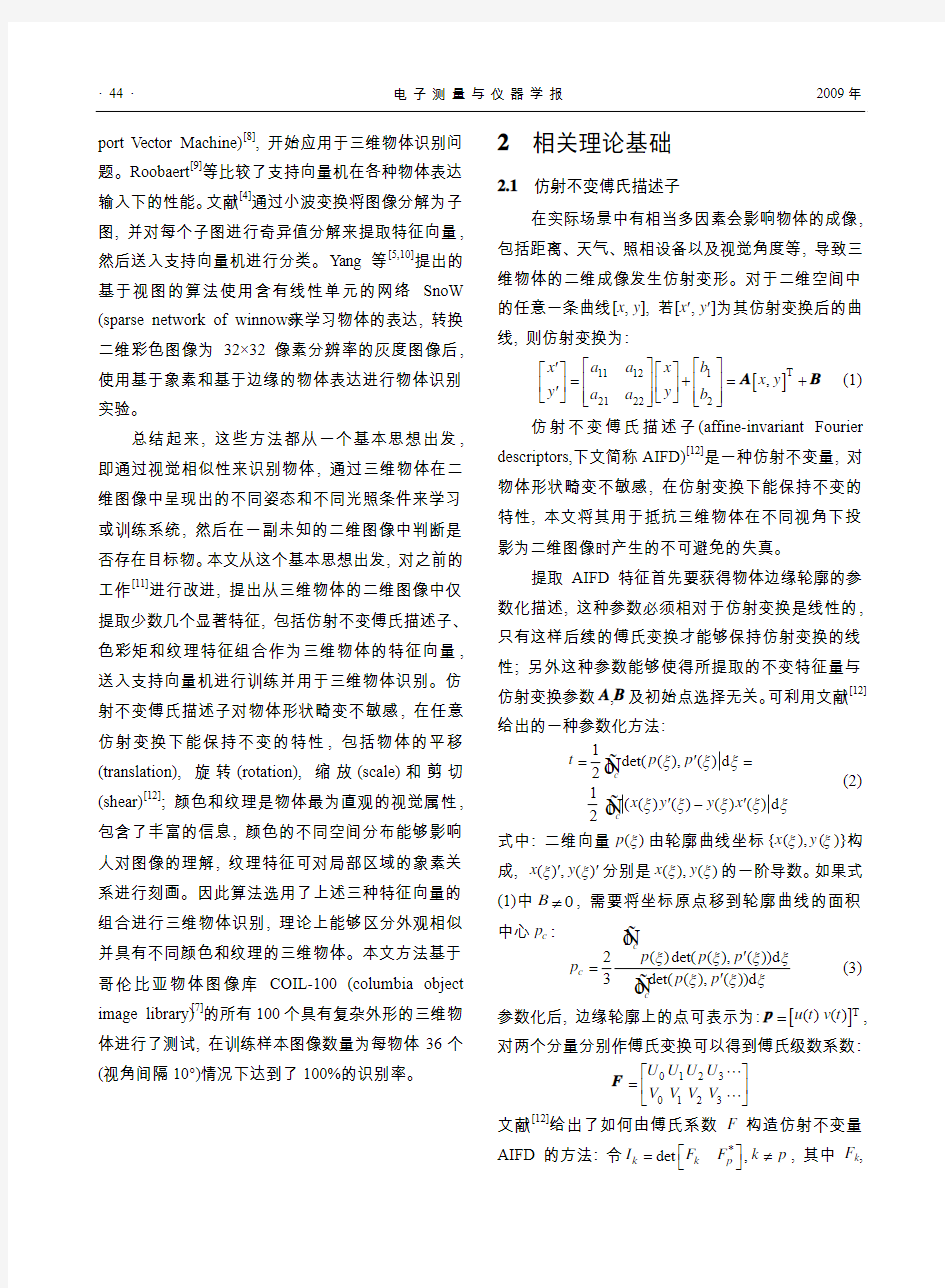

转台面, 每隔5°拍摄一个视角的图像, 为每个物体得到72个不同视角的姿态图。各物体在视角为30° 时的姿态如图2所示, 其余姿态图略过。

第4期一种基于支持向量机的三维物体识别方法·47 ·

图2 COIL-100数据库各物体视角为30°时姿态

Fig. 2 All objects in COIL-100 dataset with view

angle=30°

实验选择各三维物体每隔10°视角的图像作为训练样本集, 即0°, 10°,…, 350°, 每个物体36个训练视角, 100个物体共计3 600幅, 将其余3 600幅视角为5°, 15°,…, 355°的图像作为测试图像。

将3 600幅训练样本图像进行预处理后, 根据式(2)~(4)计算仿射不变傅氏描述子AIFD, 考虑到高阶AIFD计算量较大, 并且经过实验发现高阶AIFD对识别性能贡献也较小, 所以仅计算了k=1,2,3前3个AIFD作为物体特征。根据式(5)计算3 600幅训练样本图像的色彩矩, 选用HSI每个色彩通道的第一阶矩和第二阶中心矩, 共6个色彩特征向量。最后计算训练样本图像的不同象素距离在水平、垂直和两个对角线共4个方向上的灰度共生矩阵P d(i, j), 然后根据表1计算4个方向的对比度, 相关性, 能量和同质性, 得到16个纹理特征量。至此得到3种特征分量, 组合为一个25维的特征向量, 送入支持向量机进行训练, 然后送入测试图像测试识别性能。

初次实验中, 测试样本图像共3 600幅, 支持向量机对COIL-100数据库中所有100个物体达到了100%的识别正确率, 如表2测试结果第一行第一列所示。较之本文先前的工作[11]利用BP神经网络仅能识别COIL-100库中40个物体, 本文利用支持向量机大大提高了系统的识别性能, 体现出支持向量机在高维模式识别问题中的优势。

为了研究本文方法在更为真实情况下的性能, 进一步实验测试比较了支持向量机输入不同数量训练样本图像的识别性能, 即从每个物体36个训练视角(间隔10°)减少到2个训练视角(间隔180°)。训练视角为4个时物体姿态如图3所示, 识别性能测试结果如表2所示。可见训练视角减少为每物体18个时, 支持向量机仍达到99.81%的正确率(即5 400幅测试图像中仅有10幅图像误识)。在最困难的情况下, 视角间隔增大到180°, 即只使用0°和180°视角图像进行训练, 此时训练样本数量减少为200幅, 支持向量机仍达到了72.29%的正确识别率, 体现出支持向量机在小样本情况下的优势。表2中“边界SNoW”方法, “亮度SNoW”方法和“最近邻分类(NNC)”方法的识别结果引用于文献[5]。

图3 训练样本视角间隔90°时物体姿态Fig. 3 The views of 90°interval in training set for an

object

表2不同数量训练视角下的正确识别率

Table 2 Correct rate of recognition with varying view angles

每个物体训练视角数量

(训练样本图像数/测试样本图像数)

36

(3 600/3 600)

18

(1 800/5 400)

8

(800/6 400)

4

(400/6 800)

2

(200/7 000)

本文方法100% 99.81% 98.31% 91.38% 72.29%

·48 ·电子测量与仪器学报2009年

边界SNoW[5]96.25% 94.13% 89.23% 88.28% 无

亮度SNoW[5]95.81% 92.31% 85.13% 81.46% 无最邻近分类(NNC)[5]98.50% 87.54% 79.52% 74.63% 无

4结论

通过理论分析和仿真实验表明, 本文方法提取三维物体在二维图像中的仿射不变傅氏描述子、色彩矩和纹理特征, 组合作为三维物体的特征向量, 送入支持向量机进行训练并用于识别, 可达到较好的性能, 当每个物体训练视角数量为36个(间隔为10°)时达到了100%的识别率, 当训练视角数量减少(间隔增大)时, 仍然达到了比较满意的识别性能, 证明本文方法应用在三维物体识别领域是可行的。基于本文的工作, 可进一步研究: 1) 寻找可表达三维物体局部特征的方法来弥补色彩矩方法不能检测物体的局部特征的缺点; 2) 进一步提取三维物体具有其他属性的特征来训练支持向量机, 可以期望得到更高的识别性能, 特别是提高小样本(如仅有两个训练视角)情况下的识别率。

参考文献:

[1]李庆, 周曼丽, 柳健. 三维物体识别研究进展[J]. 中

国图象图形学报, 2000, 5(12): 985-993.

LI Q, ZHOU M L, LIU J. A review on 3d objects recog-

nition [J]. Journal of Image and Graphics, 2000, 5(12):

985-993.

[2]ZH L W, LI S W, LI L ZH. 3d object recognition and

pose estimation using kernel pca[C]. Proceedings of the

Third International Conference on Machine Learning

and Cybernetics. Shanghai, China, 2004: 3258-3262. [3]DELPONTE E, NOCETI N, Odone F, et.al. Appear-

ance-based 3d object recognition with time-invariant fea-

tures[C]. 14th International Conference on Image Analysis

and Processing (ICIAP 2007). Modena, Italy, 2007:

467-474.

[4]JUN H, ZHAO W X, FANG Z S,et al. View-based 3d

object recognition using wavelet multi-scale singular

value decomposition and support vector machine[C].

Beijing: Proceedings of the 2007 International Confe-

rence on Wavelet Analysis and Pattern Recognition.,

2007: 1428-1432.

[5]YANG M H, ROTH D, AHUJA N. Learning to recognize

3d objects with snow[J]. Computer Vision-ECCV, 2000:

439-454.

[6]PONTIL M., VERRI A. Support vector machines for 3d

object recognition[J]. IEEE Transactions on Pattern Anal-

ysis and Machine Intelligence, 1998, 20(6): 637-646. [7]MURASE H, NAYAR S K. Visual learning and recogni-

tion of 3-d objects from appearance[J]. International

Journal of Computer Vision, 1995, 14(1): 5-24.

[8]VAPNIK V. N. The nature of statistical learning theory

[M]. New York: Springer-Verlag, 1995: 180-188.

[9]ROOBAERT D, VANHULLE M M. View-based 3d ob-

ject recognition with support vector machines[C]. IEEE

International Workshop on Neural Networks for Signal

Processing. Madison, USA, 1999: 77-84.

[10]ROTH D, YANG M H, AHUJA N. Learning to recognize

three-dimensional objects [J]. Neural Computation, 2002,

14(5): 1071-1103.

[11]SHENG X P, Q C. 3d object recognition using multiple

features and neural network[C]. Chengdu: 2008 IEEE

International Conferences on Cybernetics & Intelligent

Systems (CIS), 2008: 434-439.

[12]ARBTER K W, SNYDER E, BURKHARDT H, et.al.

Application of affine-invariant Fourier descriptors to

recognition of 3-d objects[J]. IEEE Transactions on Pat-

tern Analysis and Machine Intelligence, 1990, 12(7):

640-647.

[13]STRICKER M A, ORENGO M. Similarity of color im-

ages[J]. Storage and Retrieval for Image and Video Da-

tabases (SPIE), 1995: 381-392.

[14]HARALICK R M, SHANMUGAM K, DINSTEIN I h.

Textural features for image classification[J]. IEEE Transac-

tions on Systems, Man and Cybernetics, 1973, SMC-3(6):

610-621.

[15]孙永奎, 陈光, 李辉. 支持向量机在模拟电路故障诊

断中应用[J]. 电子测量与仪器学报, 2008, 22(2): 72-75.

SUN Y K, CHEN G J, LI H. Support vector machine for

analog circuit fault diagnosis[J]. Journal of electronic

measurement and instrument, 2008, 22(2): 72-75.

作者简介:

第4期一种基于支持向量机的三维物体识别方法·49 ·

徐胜: 男, 2001年于电子科技大学获得学士学位, 2003年于电子科技大学获得硕士学位, 现为电子科技大学博士生。主要研究方向为目标识别, 图像处理和DSP技术应用。E-mail: xs@https://www.360docs.net/doc/8315922079.html,

Xu Sheng:received B.S. in Communication Engineering and M.S. in Signal Processing from University of Electronic Science and Technology of China (UESTC) in 2001 and 2003, respectively. Currently he is a Ph.D. candidate in the School of Communication and Information Engineering of UESTC. His research interests focus on object recognition, image processing and DSP applica-tion.

彭启琮: 男, 1968年于清华大学获

得学士学位, 1983年于电子科技大学获

得硕士学位, 现为电子科技大学教授,

博士生导师。主要研究方向为通信系统

信号处理, 实时信号处理, 自动测试系

统信号处理和DSP技术。

E-mail: qpeng@https://www.360docs.net/doc/8315922079.html,

Peng Qicong:received B.S. from Tsinghua

University in 1968, M.S. from University of

Electronic Science and Technology of Chi-na (UESTC) in 1983, respectively. Now he is professor and Ph.D. tutor in UESTC. His research interests include signal processing in communication systems, real-time signal processing, signal processing in automatic test system, DSP technology.

徐胜

彭启琮

(完整版)支持向量机(SVM)原理及应用概述

支持向量机(SVM )原理及应用 一、SVM 的产生与发展 自1995年Vapnik (瓦普尼克)在统计学习理论的基础上提出SVM 作为模式识别的新方法之后,SVM 一直倍受关注。同年,Vapnik 和Cortes 提出软间隔(soft margin)SVM ,通过引进松弛变量i ξ度量数据i x 的误分类(分类出现错误时i ξ大于0),同时在目标函数中增加一个分量用来惩罚非零松弛变量(即代价函数),SVM 的寻优过程即是大的分隔间距和小的误差补偿之间的平衡过程;1996年,Vapnik 等人又提出支持向量回归 (Support Vector Regression ,SVR)的方法用于解决拟合问题。SVR 同SVM 的出发点都是寻找最优超平面(注:一维空间为点;二维空间为线;三维空间为面;高维空间为超平面。),但SVR 的目的不是找到两种数据的分割平面,而是找到能准确预测数据分布的平面,两者最终都转换为最优化问题的求解;1998年,Weston 等人根据SVM 原理提出了用于解决多类分类的SVM 方法(Multi-Class Support Vector Machines ,Multi-SVM),通过将多类分类转化成二类分类,将SVM 应用于多分类问题的判断:此外,在SVM 算法的基本框架下,研究者针对不同的方面提出了很多相关的改进算法。例如,Suykens 提出的最小二乘支持向量机 (Least Square Support Vector Machine ,LS —SVM)算法,Joachims 等人提出的SVM-1ight ,张学工提出的中心支持向量机 (Central Support Vector Machine ,CSVM),Scholkoph 和Smola 基于二次规划提出的v-SVM 等。此后,台湾大学林智仁(Lin Chih-Jen)教授等对SVM 的典型应用进行总结,并设计开发出较为完善的SVM 工具包,也就是LIBSVM(A Library for Support Vector Machines)。LIBSVM 是一个通用的SVM 软件包,可以解决分类、回归以及分布估计等问题。 二、支持向量机原理 SVM 方法是20世纪90年代初Vapnik 等人根据统计学习理论提出的一种新的机器学习方法,它以结构风险最小化原则为理论基础,通过适当地选择函数子集及该子集中的判别函数,使学习机器的实际风险达到最小,保证了通过有限训练样本得到的小误差分类器,对独立测试集的测试误差仍然较小。 支持向量机的基本思想:首先,在线性可分情况下,在原空间寻找两类样本的最优分类超平面。在线性不可分的情况下,加入了松弛变量进行分析,通过使用非线性映射将低维输

立体几何中的向量方法

立体几何中的向量方法(二)——求空间角和距离 1. 空间向量与空间角的关系 (1)设异面直线l 1,l 2的方向向量分别为m 1,m 2,则l 1与l 2所成的角θ满足cos θ=|cos 〈m 1,m 2〉|. (2)设直线l 的方向向量和平面α的法向量分别为m ,n ,则直线l 与平面α所成角θ满足sin θ=|cos 〈m ,n 〉|. (3)求二面角的大小 1°如图①,AB 、CD 是二面角α—l —β的两个面内与棱l 垂直的直线,则二面角的大小θ=〈AB →,CD →〉. 2°如图②③,n 1,n 2分别是二面角α—l —β的两个半平面α,β的法向量,则二面角的大小θ满足cos θ=cos 〈n 1,n 2〉或-cos 〈n 1,n 2〉. 2. 点面距的求法 如图,设AB 为平面α的一条斜线段,n 为平面α的法向量,则B 到 平面α的距离d =|AB → ·n | |n | . 1. 判断下面结论是否正确(请在括号中打“√”或“×”)

(1)两直线的方向向量所成的角就是两条直线所成的角. ( × ) (2)直线的方向向量和平面的法向量所成的角就是直线与平面所成的角. ( × ) (3)两个平面的法向量所成的角是这两个平面所成的角. ( × ) (4)两异面直线夹角的范围是(0,π2],直线与平面所成角的范围是[0,π 2],二面角的 范围是[0,π]. ( √ ) (5)直线l 的方向向量与平面α的法向量夹角为120°,则l 和α所成角为30°. ( √ ) (6)若二面角α-a -β的两个半平面α、β的法向量n 1,n 2所成角为θ,则二面角α- a -β的大小是π-θ. ( × ) 2. 已知二面角α-l -β的大小是π 3 ,m ,n 是异面直线,且m ⊥α,n ⊥β,则m ,n 所成 的角为 ( ) A.2π3 B.π 3 C.π 2 D. π6 答案 B 解析 ∵m ⊥α,n ⊥β, ∴异面直线m ,n 所成的角的补角与二面角α-l -β互补. 又∵异面直线所成角的范围为(0,π 2], ∴m ,n 所成的角为π 3 . 3. 在空间直角坐标系Oxyz 中,平面OAB 的一个法向量为n =(2,-2,1),已知点P (-1,3,2),

6.2 立体几何中的向量方法(A卷提升篇)【解析版】

专题6.2 立体几何中的向量方法(A 卷基础篇)(浙江专用) 参考答案与试题解析 第Ⅰ卷(选择题) 一.选择题(共10小题,满分50分,每小题5分) 1.(2020·全国高二课时练习)已知(1,0,0)A ,(0,1,0)B ,(0,0,1)C ,则下列向量是平面ABC 法向量的是( ) A .(1,1,1)- B .(1,1,1)- C .? ? ? ??? D .?? ? ??? 【答案】C 【解析】 (1,1,0),(1,0,1)AB AC =-=-, 设(,,)n x y z =为平面ABC 的法向量, 则00n AB n AC ??=??=? ,化简得00x y x z -+=??-+=?, ∴x y z ==,故选C. 2.(2020·全国高二课时练习)空间直角坐标中A(1,2,3),B(-1,0,5),C(3,0,4),D(4,1,3),则直线AB 与CD 的位置关系是( ) A .平行 B .垂直 C .相交但不垂直 D .无法确定 【答案】A 【解析】 ∵空间直角坐标系中, A (1,2,3), B (﹣1,0,5), C (3,0,4), D (4,1,3), ∴AB =(﹣2,﹣2,2),CD =(1,1,﹣1), ∴AB =﹣2CD , ∴直线AB 与CD 平行. 故选A .

3.(2020·全国高二课时练习)已知平面α的法向量为(2,2,1)n =--,点(,3,0)A x 在平面α内,则点(2,1,4)P -到平面α的距离为 103,则x =( ) A .-1 B .-11 C .-1或-11 D .-21 【答案】C 【解析】 (2,2,4)PA x =+-,而103n d n PA ?= =, 103=,解得1x =-或-11. 故选:C 4.(2020·全国高二课时练习)已知向量,m n 分别是直线l 和平面α的方向向量和法向量,若 1cos ,2 m n =-,则l 与α所成的角为( ) A .030 B .060 C .0120 D .0150 【答案】A 【解析】 设线面角为θ,则1sin cos ,,302 m n θθ=??==. 5.(2020·全国高二课时练习)设直线l 与平面α相交,且l 的方向向量为a ,α的法向量为n ,若2,3a n π= ,则l 与α所成的角为( ) A .23π B .3π C .6π D .56 π 【答案】C 【解析】 结合题意,作出图形如下:

基于支持向量机的飞机图像识别算法

基于支持向量机的飞机图像识别算法 发布:2011-09-05 | 作者: | 来源: qihongchao | 查看:902次 | 用户关注: 计算机的模式识别技术是目前研究的热点,本文将探讨运用图像处理技术来进行飞机图像识别。通过神经网络的图像边缘检测方法得到飞机轮廓,再进行特征提取,运用模式识别技术将目标正确的分类。传统的分类方法,如人工神经网络在处理小样本问题时一方面容易出现过学习现像,导致算法的推广性差;另一方面学习的性能差,处理非线性问题算法复杂。而统计学习理论是一种专门的小样本统计理论,基于统计学习理论的支持向量机技术是一种新 计算机的模式识别技术是目前研究的热点,本文将探讨运用图像处理技术来进行飞机图像识别。 通过神经网络的图像边缘检测方法得到飞机轮廓,再进行特征提取,运用模式识别技术将目标正确的分类。传统的分类方法,如人工神经网络在处理小样本问题时一方面容易出现过学习现像,导致算法的推广性差;另一方面学习的性能差,处理非线性问题算法复杂。而统计学习理论是一种专门的小样本统计理论,基于统计学习理论的支持向量机技术是一种新的模式识别方法,能够较好地解决小样本学习问题。本文对基于支持向量机的飞机图像识别算法做了研究。 1 飞机图像识别算法 1.1 基于邻域灰度变化极值和神经网络的图像边缘检测方法 要提取物体的轮廓特征首先必须在图像上得到轮廓的位置,即得到边界象素在图像上的位置。传统的边缘检测算法,如sobel算子、robert算子等有一些缺点,一是提取的边缘很粗,无法精确得到边缘象素,而且边缘具有很强的方向性,使用某一方向性的算子造成的结果是与之垂直方向的边缘较为明显,而相同方向的边缘则检测不到。本文提出了基于邻域灰度变化极值和神经网络的图像边缘检测方法。 由于图像的数据量大,边缘检测网络的训练时间较长,而非边界候选象素对于图像边缘提取作用不大。因此,本文采用一种边界候选象素提取方法,使训练数据规模可观地减少。 图像中的边缘象素都是灰度变化较大的地方,边界候选象素提取算法就是找到这些点。为此,借鉴经典图像锐化的方法,引入一个3×3的检测窗口扫描图像,考察其中心象素与其邻域象素的灰度变化的最大值,通过设定适当的阈值将原始图像变换为二值边缘图像。假定点(x,y)与其邻域灰度变化的最大值为max,阈值为T,二值图像相应点处的值为g(x,y),则其实现算法为: 此方法求取边界候选象素的优点是对每一象素都考虑了其邻域象素的灰度信息,更符合图像的边缘灰度变化的特点,因此对各类图像都具有广泛的适

支持向量机算法

支持向量机算法 [摘要] 本文介绍统计学习理论中最年轻的分支——支持向量机的算法,主要有:以SVM-light为代表的块算法、分解算法和在线训练法,比较了各自的优缺点,并介绍了其它几种算法及多类分类算法。 [关键词] 块算法分解算法在线训练法 Colin Campbell对SVM的训练算法作了一个综述,主要介绍了以SVM为代表的分解算法、Platt的SMO和Kerrthi的近邻算法,但没有详细介绍各算法的特点,并且没有包括算法的最新进展。以下对各种算法的特点进行详细介绍,并介绍几种新的SVM算法,如张学工的CSVM,Scholkopf的v-SVM分类器,J. A. K. Suykens 提出的最小二乘法支持向量机LSSVM,Mint-H suan Yang提出的训练支持向量机的几何方法,SOR以及多类时的SVM算法。 块算法最早是由Boser等人提出来的,它的出发点是:删除矩阵中对应于Lagrange乘数为零的行和列不会对最终结果产生影响。对于给定的训练样本集,如果其中的支持向量是已知的,寻优算法就可以排除非支持向量,只需对支持向量计算权值(即Lagrange乘数)即可。但是,在训练过程结束以前支持向量是未知的,因此,块算法的目标就是通过某种迭代逐步排除非支持向时。具体的做法是,在算法的每一步中块算法解决一个包含下列样本的二次规划子问题:即上一步中剩下的具有非零Lagrange乘数的样本,以及M个不满足Kohn-Tucker条件的最差的样本;如果在某一步中,不满足Kohn-Tucker条件的样本数不足M 个,则这些样本全部加入到新的二次规划问题中。每个二次规划子问题都采用上一个二次规划子问题的结果作为初始值。在最后一步时,所有非零Lagrange乘数都被找到,因此,最后一步解决了初始的大型二次规划问题。块算法将矩阵的规模从训练样本数的平方减少到具有非零Lagrange乘数的样本数的平方,大减少了训练过程对存储的要求,对于一般的问题这种算法可以满足对训练速度的要求。对于训练样本数很大或支持向量数很大的问题,块算法仍然无法将矩阵放入内存中。 Osuna针对SVM训练速度慢及时间空间复杂度大的问题,提出了分解算法,并将之应用于人脸检测中,主要思想是将训练样本分为工作集B的非工作集N,B中的样本数为q个,q远小于总样本个数,每次只针对工作集B中的q个样本训练,而固定N中的训练样本,算法的要点有三:1)应用有约束条件下二次规划极值点存大的最优条件KTT条件,推出本问题的约束条件,这也是终止条件。2)工作集中训练样本的选择算法,应能保证分解算法能快速收敛,且计算费用最少。3)分解算法收敛的理论证明,Osuna等证明了一个定理:如果存在不满足Kohn-Tucker条件的样本,那么在把它加入到上一个子问题的集合中后,重新优化这个子问题,则可行点(Feasible Point)依然满足约束条件,且性能严格地改进。因此,如果每一步至少加入一个不满足Kohn-Tucker条件的样本,一系列铁二次子问题可保证最后单调收敛。Chang,C.-C.证明Osuna的证明不严密,并详尽地分析了分解算法的收敛过程及速度,该算法的关键在于选择一种最优的工

立体几何中的向量方法总结

立体几何中的向量方法基础篇一(几何证明) 一.求直线方向向量 1.已知()()4,2,2,2,1,1B A -且),,6(y x a =为直线AB 的方向向量,求y x ,。 二.平面的法向量 2.在空间中,已知()()()0,1,1,1,1,0,1,0,1C B A ,求平面ABC 的一个法向量。 3.如图,在四棱锥ABCD P -中,底面ABCD 为正方形, 2,==⊥DC PD ABCD PD 平面,E 为PC 中点 (1)分别写出平面PDC ABCD PAD ,,的一个法向量; (2)求平面EDB 的一个法向量; (3)求平面ADE 的一个法向量。 三.向量法证明空间平行与垂直 1.如图,已知正方形ABCD 和矩形ACEF 所在的平面互相垂直,M AF AB ,1,2== 为EF 的中点,求 证:BDE AM 平面//

2. 如图,正方体''''D C B A ABCD -中,F E ,分别为CD BB ,'的中点,求证:ADE F D 平面⊥'。 3. 如图,在四棱锥ABCD E -中,BCE CD BCE AB 平面平面⊥⊥, 0120,22=∠====BCE CD CE BC AB ,求证:平面ABE ADE 平面⊥。 巩固练习: 1. 如图,在正方体''''D C B A ABCD -中,P 是'DD 的中点,O 是底面ABCD 的中心, (1)求证:O B '为平面PAC 的一个法向量;(2)求平面CD B A ''的一个法向量。

2. 如图,在直棱柱'''C B A ABC -中,4',5,4,3====AA AB BC AC (1)求证:'BC AC ⊥ (2)在AB 上是否存在点D ,使得'//'CDB AC 平面,若存在,确定D 点位置,若不存在,说明理由。 3. 如图,已知长方体''''D C B A ABCD -中,2==BC AB ,E AA ,4'=为'CC 的上的点,C B BE '⊥, 求证:BED C A 平面⊥' 4. 在三棱柱'''C B A ABC -中,1',2,,'===⊥⊥AA BC AB BC AB ABC AA 平面,E 为'BB 的中点,求证:C C AA AEC '''平面平面⊥

支持向量机算法学习总结

题目:支持向量机的算法学习 姓名: 学号: 专业: 指导教师:、 日期:2012年6 月20日

支持向量机的算法学习 1. 理论背景 基于数据的机器学习是现代智能技术中的重要方面,研究从观测数据 (样本) 出发寻找规律,利用这些规律对未来数据或无法观测的数据进行预测。迄今为止,关于机器学习还没有一种被共同接受的理论框架,关于其实现方法大致可以分为三种: 第一种是经典的(参数)统计估计方法。包括模式识别、神经网络等在内,现有机器学习方法共同的重要理论基础之一是统计学。参数方法正是基于传统统计学的,在这种方法中,参数的相关形式是已知的,训练样本用来估计参数的值。这种方法有很大的局限性,首先,它需要已知样本分布形式,这需要花费很大代价,还有,传统统计学研究的是样本数目趋于无穷大时的渐近理论,现有学习方法也多是基于此假设。但在实际问题中,样本数往往是有限的,因此一些理论上很优秀的学习方法实际中表现却可能不尽人意。 第二种方法是经验非线性方法,如人工神经网络(ANN。这种方法利用已知样本建立非线性模型,克服了传统参数估计方法的困难。但是,这种方法缺乏一种统一的数学理论。 与传统统计学相比,统计学习理论( Statistical Learning Theory 或SLT) 是一种专门研究小样本情况下机器学习规律的理论。该理论针对小样本统计问题建立了一套新的理论体系,在这种体系下的统计推理规则不仅考虑了对渐近性能的要求,而且追求在现有有限信息的条件下得到最优结果。V. Vapnik 等人从六、七十年代开始致力于此方面研究[1] ,到九十年代中期,随着其理论的不断发展和成熟,也由于神经网络等学习方法在理论上缺乏实质性进展,统计学习理论开始受到越来越广泛的重视。 统计学习理论的一个核心概念就是VC维(VC Dimension)概念,它是描述函数集或学习机器的复杂性或者说是学习能力(Capacity of the machine) 的一个重要指标,在此概念基础上发展出了一系列关于统计学习的一致性(Consistency) 、收敛速度、推广性能(GeneralizationPerformance) 等的重要结论。 支持向量机方法是建立在统计学习理论的VC 维理论和结构风险最小原理基础上的,根据有限的样本信息在模型的复杂性(即对特定训练样本的学习精度,Accuracy) 和学习能力(即无错误地识别任意样本的能力)之间寻求最佳折衷,以

空间几何中的向量方法

第一讲:空间几何中的向量方法---------坐标运算与法向量 一、空间向量的坐标运算 1. 若123(,,)a a a a = ,123(,,)b b b b = ,则 (1)112233(,,)a b a b a b a b +=+++; (2)112233(,,)a b a b a b a b -=---; (3)123(,,),a a a a R λλλλλ=∈; (4)112233a b a b a b a b ?=++; (5)112233//,,,(0,)a b a b a b a b b R λλλλ?===≠∈; (6)1122330a b a b a b a b ⊥?++=; (7 )a == (8 )cos ,a b a b a b ?<>= = ?. 例1 已知(2,3,5),(3,1,4),a b =-=-- 求,,8,,a b a b a a b +-? 的坐标. 2.若111222(,,),(,,),A x y z B x y z 则212121(,,)AB x x y y z z =--- 练习1: 已知PA 垂直于正方形ABCD 所在的平面,M 、N 分别是AB,PC 的中点,且PA=AD=1, 求向量MN 的坐标. 二、空间直角坐标系中平面法向量的求法 1、 方程法 利用直线与平面垂直的判定定理构造三元一次方程组,由于有三个未知数,两个方程,要设定一个变量的值才能求解,这是一种基本的方法,容易接受,但运算稍繁,要使法向量简洁,设值可灵活,法向量有无数个,他们是共线向量,取一个就可以。 例1 已知(2,2,1),(4,5,3),AB AC == 求平面ABC 的法向量。 解:设(,,)n x y z = ,则由,,n AB n AC ⊥⊥ 得=0=0n AB n AC ??????? 即220453=0x y z x y z ++=?? ++? 不妨设1z =,得12 =-1 x y ?=? ???, 取1(,1,1)2n =-

支持向量机原理及应用(DOC)

支持向量机简介 摘要:支持向量机方法是建立在统计学习理论的VC 维理论和结构风险最小原理基础上的,根据有限的样本信息在模型的复杂性(即对特定训练样本的学习精度)和学习能力(即无错误地识别任意样本的能力)之间寻求最佳折衷,以求获得最好的推广能力 。我们通常希望分类的过程是一个机器学习的过程。这些数据点是n 维实空间中的点。我们希望能够把这些点通过一个n-1维的超平面分开。通常这个被称为线性分类器。有很多分类器都符合这个要求。但是我们还希望找到分类最佳的平面,即使得属于两个不同类的数据点间隔最大的那个面,该面亦称为最大间隔超平面。如果我们能够找到这个面,那么这个分类器就称为最大间隔分类器。 关键字:VC 理论 结构风险最小原则 学习能力 1、SVM 的产生与发展 自1995年Vapnik 在统计学习理论的基础上提出SVM 作为模式识别的新方法之后,SVM 一直倍受关注。同年,Vapnik 和Cortes 提出软间隔(soft margin)SVM ,通过引进松弛变量i ξ度量数据i x 的误分类(分类出现错误时i ξ大于0),同时在目标函数中增加一个分量用来惩罚非零松弛变量(即代价函数),SVM 的寻优过程即是大的分隔间距和小的误差补偿之间的平衡过程;1996年,Vapnik 等人又提出支持向量回归 (Support Vector Regression ,SVR)的方法用于解决拟合问题。SVR 同SVM 的出发点都是寻找最优超平面,但SVR 的目的不是找到两种数据的分割平面,而是找到能准确预测数据分布的平面,两者最终都转换为最优化问题的求解;1998年,Weston 等人根据SVM 原理提出了用于解

支持向量机训练算法综述_姬水旺

收稿日期:2003-06-13 作者简介:姬水旺(1977)),男,陕西府谷人,硕士,研究方向为机器学习、模式识别、数据挖掘。 支持向量机训练算法综述 姬水旺,姬旺田 (陕西移动通信有限责任公司,陕西西安710082) 摘 要:训练SVM 的本质是解决二次规划问题,在实际应用中,如果用于训练的样本数很大,标准的二次型优化技术就很难应用。针对这个问题,研究人员提出了各种解决方案,这些方案的核心思想是先将整个优化问题分解为多个同样性质的子问题,通过循环解决子问题来求得初始问题的解。由于这些方法都需要不断地循环迭代来解决每个子问题,所以需要的训练时间很长,这也是阻碍SVM 广泛应用的一个重要原因。文章系统回顾了SVM 训练的三种主流算法:块算法、分解算法和顺序最小优化算法,并且指出了未来发展方向。关键词:统计学习理论;支持向量机;训练算法 中图分类号:T P30116 文献标识码:A 文章编号:1005-3751(2004)01-0018-03 A Tutorial Survey of Support Vector Machine Training Algorithms JI Shu-i wang,JI Wang -tian (Shaanx i M obile Communicatio n Co.,Ltd,Xi .an 710082,China) Abstract:Trai n i ng SVM can be formulated into a quadratic programm i ng problem.For large learning tasks w ith many training exam ples,off-the-shelf opti m i zation techniques quickly become i ntractable i n their m emory and time requirem ents.T hus,many efficient tech -niques have been developed.These techniques divide the origi nal problem into several s maller sub-problems.By solving these s ub-prob -lems iteratively,the ori ginal larger problem is solved.All proposed methods suffer from the bottlen eck of long training ti me.This severely limited the w idespread application of SVM.T his paper systematically surveyed three mains tream SVM training algorithms:chunking,de -composition ,and sequenti al minimal optimization algorithms.It concludes with an illustrati on of future directions.Key words:statistical learning theory;support vector machine;trai ning algorithms 0 引 言 支持向量机(Support Vector M achine)是贝尔实验室研究人员V.Vapnik [1~3]等人在对统计学习理论三十多年的研究基础之上发展起来的一种全新的机器学习算法,也使统计学习理论第一次对实际应用产生重大影响。SVM 是基于统计学习理论的结构风险最小化原则的,它将最大分界面分类器思想和基于核的方法结合在一起,表现出了很好的泛化能力。由于SVM 方法有统计学习理论作为其坚实的数学基础,并且可以很好地克服维数灾难和过拟合等传统算法所不可规避的问题,所以受到了越来越多的研究人员的关注。近年来,关于SVM 方法的研究,包括算法本身的改进和算法的实际应用,都陆续提了出来。尽管SVM 算法的性能在许多实际问题的应用中得到了验证,但是该算法在计算上存在着一些问题,包括训练算法速度慢、算法复杂而难以实现以及检测阶段运算量大等等。 训练SVM 的本质是解决一个二次规划问题[4]: 在约束条件 0F A i F C,i =1,, ,l (1)E l i =1 A i y i =0 (2) 下,求 W(A )= E l i =1A i -1 2 E i,J A i A j y i y j {7(x i )#7(x j )} = E l i =1A i -1 2E i,J A i A j y i y j K (x i ,x j )(3)的最大值,其中K (x i ,x j )=7(x i )#7(x j )是满足Merce r 定理[4]条件的核函数。 如果令+=(A 1,A 2,,,A l )T ,D ij =y i y j K (x i ,x j )以上问题就可以写为:在约束条件 +T y =0(4)0F +F C (5) 下,求 W(+)=+T l -12 +T D +(6) 的最大值。 由于矩阵D 是非负定的,这个二次规划问题是一个凸函数的优化问题,因此Kohn -Tucker 条件[5]是最优点 第14卷 第1期2004年1月 微 机 发 展M icr ocomputer Dev elopment V ol.14 N o.1Jan.2004

支持向量机(SVM)算法推导及其分类的算法实现

支持向量机算法推导及其分类的算法实现 摘要:本文从线性分类问题开始逐步的叙述支持向量机思想的形成,并提供相应的推导过程。简述核函数的概念,以及kernel在SVM算法中的核心地位。介绍松弛变量引入的SVM算法原因,提出软间隔线性分类法。概括SVM分别在一对一和一对多分类问题中应用。基于SVM在一对多问题中的不足,提出SVM 的改进版本DAG SVM。 Abstract:This article begins with a linear classification problem, Gradually discuss formation of SVM, and their derivation. Description the concept of kernel function, and the core position in SVM algorithm. Describes the reasons for the introduction of slack variables, and propose soft-margin linear classification. Summary the application of SVM in one-to-one and one-to-many linear classification. Based on SVM shortage in one-to-many problems, an improved version which called DAG SVM was put forward. 关键字:SVM、线性分类、核函数、松弛变量、DAG SVM 1. SVM的简介 支持向量机(Support Vector Machine)是Cortes和Vapnik于1995年首先提出的,它在解决小样本、非线性及高维模式识别中表现出许多特有的优势,并能够推广应用到函数拟合等其他机器学习问题中。支持向量机方法是建立在统计学习理论的VC 维理论和结构风险最小原理基础上的,根据有限的样本信息在模型的复杂性(即对特定训练样本的学习精度,Accuracy)和学习能力(即无错误地识别任意样本的能力)之间寻求最佳折衷,以期获得最好的推广能力。 对于SVM的基本特点,小样本,并不是样本的绝对数量少,而是与问题的复杂度比起来,SVM算法要求的样本数是相对比较少的。非线性,是指SVM擅长处理样本数据线性不可分的情况,主要通过松弛变量和核函数实现,是SVM 的精髓。高维模式识别是指样本维数很高,通过SVM建立的分类器却很简洁,只包含落在边界上的支持向量。

立体几何中的向量方法—证明平行和垂直

1、依据学习目标。课前认真预习,完成自主学习内容; 2、课上思考,积极讨论,大胆展示,充分发挥小组合作优势,解决疑难问题; 3、当堂完成课堂检测题目; 4、★的多少代表题目的难以程度。★越多说明试题越难。不同层次学生选择相应题目完成 【学习目标】1.理解空间向量的概念;掌握空间向量的加法、减法和数乘; 2.了解空间向量的基本定理; 3.掌握空间向量的数量积的定义及其性质;理解空间向量的夹角的概念;掌握空间向量的数量积 的概念、性质和运算律;了解空间向量的数量积的几何意义;能用向量的数量积判断向量的共线与 垂直。 【教学重点】理解空间向量的概念;掌握空间向量的运算方法 【教学难点】理解空间向量的概念;掌握空间向量的运算方法 在四棱锥 设直线,则 v

的正方体 I 2. 如图,在棱长为a (1) 试证:A1、G、C三点共线; (2) 试证:A1C⊥平面 3.【改编自高考题】如图所示,四棱柱 的正方形,侧棱A (1)证明:AC⊥A1B; (2)是否在棱A1A上存在一点P,使得C1【学后反思】 本节课我学会了 掌握了那些? 还有哪些疑问? 2017届高二数学导学案编写邓兴明审核邓兴明审批

1、依据学习目标。课前认真预习,完成自主学习内容; 2、课上思考,积极讨论,大胆展示,充分发挥小组合作优势,解决疑难问题; 3、当堂完成课堂检测题目; 4、★的多少代表题目的难以程度。★越多说明试题越难。不同层次学生选择相应题目完成 【学习目标】1.掌握各种空间角的定义,弄清它们各自的取值范围.2.掌握异面直线所成的角,二面角的平面角,直线与平面所成的角的联系和区别.3.体会求空间角中的转化思想、数形结合思想,熟练掌握平移方法、射影方法等.4.灵活地运用各种方法求空间角. 【教学重点】灵活地运用各种方法求空间角 【教学难点】灵活地运用各种方法求空间角 —l—β的两个面α,β的法向量,则向量 的大小就是二面角的平面角的大小(如图②③). 【课堂合作探究】 利用向量法求异面直线所成的角 B1C1,∠ACB=90°,CA=CB=CC1,D 的正方体ABCD—A1B1C1D1中,求异面直线

立体几何中的向量方法

立体几何中的向量方法 Prepared on 22 November 2020

教学过程 一、课堂导入 空间平行垂直问题 1.两条直线平行与垂直; 2.直线与平面平行与垂直; 3.两个平面平行与垂直;空间夹角问题 1.两直线所成角; 2.直线和平面所成角; 3.二面角的概念;

空间距离问题 二、复习预习 (1)空间向量的直角坐标运算律:设231(,,)a a a a =,231(,,)b b b b =,则 112233(,,)a b a b a b a b +=+++,112233(,,)a b a b a b a b -=---, 123(,,)()a a a a R λλλλλ=∈, 112233a b a b a b a b ?=++, 112233//,,()a b a b a b a b R λλλλ?===∈, 1122330a b a b a b a b ⊥?++=. (2)若111(,,)A x y z ,222(,,)B x y z ,则212121(,,)AB x x y y z z =---. 一个向量在直角坐标系中的坐标等于表示这个向量的有向线段的终点的坐标减去 起点的坐标. (3)模长公式:若231(,,)a a a a =, 则 21||a a a a =?=+ (4)夹角公式: 2 1cos |||| a b a b a b a ? ?= = ?+ (5)两点间的距离公式:若111(,,)A x y z ,222(,,)B x y z ,则 221221221)()()(z z y y x x -+-+-== . 三、知识讲解 考点1 平面法向量的求法 在空间平面法向量的算法中,普遍采用的算法是设(,,)n x y z =,它和平面内的两个不共线的向量垂直,数量积为0,建立两个关于x ,y ,z 的方程,再对其中一个变量根据需要取特殊值,即可得到法向量.还有几种求平面法向量的办法也比较简便. 求法一:先来看一个引理: 若平面ABC 与空间直角坐标系x 轴、y 轴、z 轴的交点分别为A (a ,0,0)、B (0,b ,0)、C (0,0,c ),定义三点分别在x 轴、y 轴、z 轴上的坐标值x A = a , y B = b , z C = c

基于SVM支持向量机的水质图像分析

龙源期刊网 https://www.360docs.net/doc/8315922079.html, 基于SVM支持向量机的水质图像分析 作者:李昂金晓军万权性 来源:《电脑知识与技术》2018年第08期 摘要:针对运用水色图像来判别水质状况的问题,设计了一种基于计算机视觉与机器学习的水质图像评价方法。利用颜色矩阵对水质图像进行特征提取,采用SVM支持向量机算法对水质图像的RGB三通道特征进行数据分析,使用Python语言进行编程,得到一个水质评价模型。实验表明,该方法能有效通过水体的颜色对不同水质进行识别,具有一定的实际应用价值。 关键词:计算机视觉;机器学习;Pvthon;水质图像 中图分类号:TP391 文献标识码:A 文章编号:1009-3044(2018)08-0157-03 随着工业技术的日益提升,人类的生活变得越来越便利。但与此同时环境污染问题日趋严重,大气、土壤、水质污染是各个工业国家不得不面对的问题。污染需要治理,因此对于污染物的评价与监测十分重要。水产养殖业是我国国民经济的一个重要组成部分,在水产养殖过程中,选择没有污染的水域进行养殖十分重要。有经验的渔业生产从业者能够通过水体的颜色来判断水质的好坏,从而确定水体是否适合鱼类生长。在生产环境下,通常是以传统的肉眼观测法,以经验来观察判断,这种方式虽然有效,但观察结果不够稳定,主观性较强,容易引起观察性偏差。因此寻求一种定量分析有便于推广的方法十分必要。随着计算机视觉技术的快速发展,利用机器视觉代替人工视觉已经用于工业生产的诸多领域,同时也为水产养殖业提供了更好的技术支持。通过合理将计算机视觉技术与专家经验相结合,可以通过水体的颜色,对水质的优劣程度进行分级,对水质情况进行自动快速的识别。本文针对水质污染的评价方法进行研究,通过计算机科学技术对水质图像进行特征提取与数据分析,得到一个有效的水质自动评价模型。 1数据预处理 颜色直方图产生的特征维数一般大于颜色矩的特征维数,为了避免过多变量影响后续的分类效果,在本案例中选择采用颜色矩来提取水样图像的特征,即建立水样图像与反映该图像特征的数据信息关系,同时由有经验的专家对水样图像根据经验进行分类,建立水样数据信息与水质类别的专家样本库,进而构建分类模型,得到水样图像与水质类别的映射关系,并经过不断调整系数优化模型,最后利用训练好的分类模型,用户就能方便地通过水样图像判别出该水样的水质类别。水色分类如表1所示。 图1为基于图像处理的水质评价流程,主要包括以下步骤。

支持向量机训练算法的实验比较

支持向量机训练算法的实验比较 姬水旺,姬旺田 (陕西移动通信有限责任公司,陕西西安710082) 摘 要:S VM是基于统计学习理论的结构风险最小化原则的,它将最大分界面分类器思想和基于核的方法结合在一起,表现出了很好的泛化能力。并对目前的三种主流算法S VM light,Bsvm与SvmFu在人脸检测、M NIST和USPS手写数字识别等应用中进行了系统比较。 关键词:统计学习理论;支持向量机;训练算法 中图法分类号:TP30116 文献标识码:A 文章编号:100123695(2004)1120018203 Experimental C omparison of Support Vector Machine Training Alg orithms J I Shui2wang,J I Wang2tian (Shanxi Mobile Communication Co.,LTD,Xi’an Shanxi710082,China) Abstract:Support vector learning alg orithm is based on structural risk minimization principle.It combines tw o remarkable ideas:maxi2 mum margin classifiers and im plicit feature spaces defined by kernel function.Presents a com prehensive com paris on of three mainstream learning alg orithms:S VM light,Bsvm,and SvmFu using face detection,M NIST,and USPS hand2written digit recognition applications. K ey w ords:S tatistical Learning T heory;Support Vector Machine;T raining Alg orithms 1 引言 支持向量机(Support Vector Machine)是贝尔实验室研究人员V.Vapnik等人[30]在对统计学习理论三十多年的研究基础之上发展起来的一种全新的机器学习算法,也是统计学习理论第一次对实际应用产生重大影响。S VM是基于统计学习理论的结构风险最小化原则的,它将最大分界面分类器思想和基于核的方法结合在一起,表现出了很好的泛化能力。由于S VM 方法有统计学习理论作为其坚实的数学基础,并且可以很好地克服维数灾难和过拟合等传统算法所不可规避的问题,所以受到了越来越多的研究人员的关注。近年来,关于S VM方法的研究,包括算法本身的改进和算法的实际应用,都陆续提了出来。但是,到目前为止,还没有看到有关支持向量算法总体评价和系统比较的工作,大多数研究人员只是用特定的训练和测试数据对自己的算法进行评价。由于支持向量机的参数与特定的问题以及特定的训练数据有很大的关系,要对它们进行统一的理论分析还非常困难,本文试从实验的角度对目前具有代表性的算法和训练数据进行比较,希望这些比较所得出的经验结论能对今后的研究和应用工作有指导意义。本文所用的比较算法主要有S VM light[14],Bsvm[12]和SvmFu[25],它们分别由美国C ornell University的Thorsten Joachims教授,National T aiwan U2 niversity的Chih2Jen Lin教授和美国麻省理工学院Ryan Rifkin博士编写的,在实验的过程中,笔者对算法进行了修改。由于这些算法有很大的相似之处,而且训练支持向量机是一个凸函数的优化过程,存在全局唯一的最优解,训练得到的模型不依赖于具体的算法实现,因此,本文在实验过程中不对具体的算法做不必要的区别。实验所采用的训练和测试数据也是目前非常有代表性的,它们大部分由国内外研究人员提供。 2 比较所用数据简介 本文所用的人脸检测数据是从美国麻省理工学院生物和计算学习中心[31](Center for Biological and C omputational Lear2 ning)得到的,这些数据是C BC L研究人员在波士顿和剑桥等地收集的,每个训练样本是一个由19×19=361个像素组成的图像,我们用一个361维的向量来代表每一个图像,每一个分量代表对应的像素值。用于训练的样本共有6977个,其中有2429个是人脸,其余4548个是非人脸;在测试样本集中共有24045个样本,包含472个人脸和23573个非人脸。这是一个两类分类问题。图1是训练样本中部分人脸的图像。 图1 人脸检测数据中部分人脸的图像 M NIST手写数字识别数据是由美国AT&T的Y ann LeCun 博士收集的[32],每个样本是0~9中的一个数字,用28×28= 784维的向量表示。在训练集中有60000个样本,测试集中有10000个样本。图2是训练样本中前100个样本的图像。 USPS手写识别数据是由美国麻省理工学院和贝尔实验室的研究人员共同从U.S.P ostal Service收集的[33],每个样本是0~9中的一个数字,用16×16=256维的向量中的各个分量表示所对应像素的灰度值。训练集中共有7291个样本,测试集中有2007个样本。图3是训练集中部分样本的图像。 ? 8 1 ?计算机应用研究2004年 收稿日期:2003206220;修返日期:2003211212

13—立体几何中的向量方法

13—立体几何中的向量方法 【基础巩固】 1.已知a=(λ+1,0,2),b=(6,2μ-1,2λ),若a ∥b,则λ与μ的值可以是( ) (A)2, (B)-, (C)-3,2 (D)2,2 2.如图所示,PD 垂直于正方形ABCD 所在平面,AB=2,E 为PB 的中点,cos< , >=,若以DA,DC,DP 所在直线分别为x,y,z 轴建立空间直角坐标系,则点 E 的坐标为( ) (A)(1,1,1) (B)(1,1,) (C)(1,1,) (D)(1,1,2) 3.正方体ABCD A 1B 1C 1D 1的棱长为a,点M 在AC 1上且= ,N 为B 1B 的中点,则| |为( ) (A) a (B) a (C) a (D) a 4.如图所示,已知PA ⊥平面ABC,∠ABC=120°,PA=AB=BC=6,则| |等于( ) 5.若向量a=(1,λ,2),b=(2,-1,2)且a 与b 的夹角的余弦值为,则λ= . 6.已知A(4,1,3),B(2,3,1),C(3,7,-5),点P(x,-1,3)在平面ABC 内,则x= . 【空间三种角】 1.异面直线所成角 设异面直线a ,b 所成的角为θ,则cos θ=|a ·b | |a ||b |, 其中a ,b 分别是直线a ,b 的方向向量. 2.直线与平面所成角 如图所示,设l 为平面α的斜线,l ∩α=A ,a 为l 的方向向量,n 为平面α的法向量,φ为l 与α所成的角,则sin φ=|cos 〈a ,n 〉|=|a·n | |a ||n |. 3.二面角 (1)若AB ,CD 分别是二面角α-l -β的两个平面内与棱l 垂直的异面直线,则二面角(或其补角)的大小就是向量AB ―→与CD ―→ 的夹角,如图(1). 平面α与β相交于直线l ,平面α的法向量为n 1,平面β的法向量为n 2,〈n 1,n 2〉=θ,则二面角α -l -β为θ或π-θ.设二面角大小为φ,则|cos φ|=|cos θ|=|n 1·n 2||n 1||n 2 |,如图(2)(3). 考点一 异面直线所成角 [典例引领] (2015·全国卷Ⅰ)如图,四边形ABCD 为菱形,∠ABC =120°,E ,F 是平面ABCD 同一侧的两点,BE ⊥平面ABCD ,DF ⊥平面ABCD ,BE =2DF ,AE ⊥EC .(1)证明: