solrcloud高可用集群搭建

solrcloud 高可用集群搭建

一、环境准备 (3)

二、环境安装 (4)

1、CentOs 6.4安装 (4)

1)配制用户 (4)

2)修改当前机器名称 (4)

3)修改当前机器ip (4)

4)上传安装包(工具上传WinSCP) (5)

2、jdk安装 (5)

3、zookeeper集群安装 (6)

1)解压zookeeper 安装包 (6)

2)进入zookeeper-3.4.5文件夹,创建data 和log (6)

3)拷贝zookeeper配制文件zoo_sample.cfg (6)

4)修改zoo.cfg (7)

5)进入data文件夹建立对应的myid文件 (8)

6)制zookeeper-3.4.5文件夹到其他机器 (8)

7)开启zookeeper的端口 (8)

8)启动zookeeper (8)

4、solr集群安装 (9)

1)在solrcloud下新建solrhome,并赋于读写权限 (9)

2)将上传的solr.4.6.0压缩包解压缩, (9)

3)将solr.4.6.0/dist/solr-4.6.0.war 复制到/solrcloud/solrhome 并重命为

solr.war (9)

4)将上传的tomcat解压缩 (9)

5)进入tomcat bin目录,启动tomcat (9)

6)停tomcat 再次启动tomcat, webapps 下边多了解压出来的solr文件夹 (10)

7)将/solrcloud/solr-4.6.0/example/solr 文件夹下所有东西复制到

/solrcloud/solrhome (10)

8)复制solr-4.6.0/example/lib/ext下所有jar包到tomcat 的lib下 (11)

9)启动tomcat 访问http://localhost:8080/solr 如图,至此单机版solr配制完

成 (11)

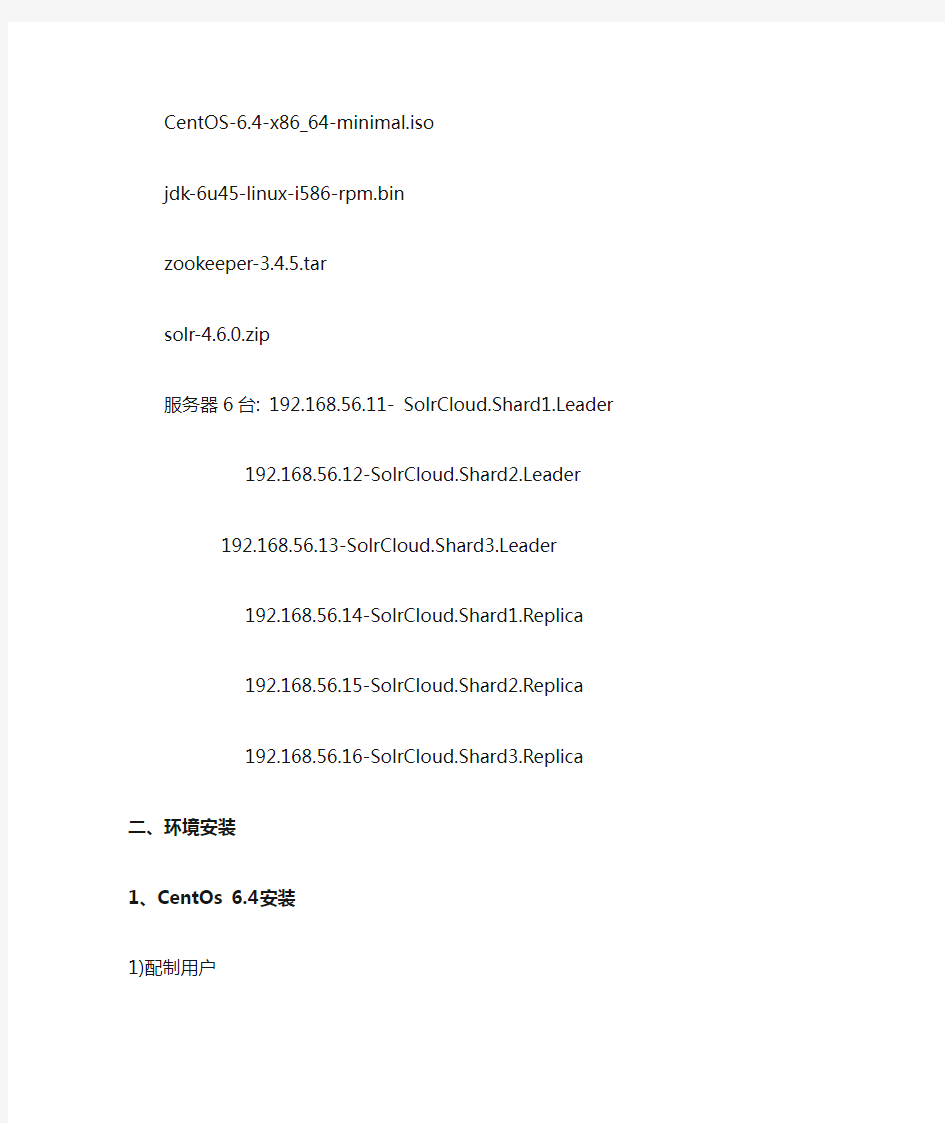

一、环境准备

CentOS-6.4-x86_64-minimal.iso

jdk-6u45-linux-i586-rpm.bin

zookeeper-3.4.5.tar

solr-4.6.0.zip

服务器6台: 192.168.56.11- SolrCloud.Shard1.Leader

192.168.56.12-SolrCloud.Shard2.Leader

192.168.56.13-SolrCloud.Shard3.Leader

192.168.56.14-SolrCloud.Shard1.Replica

192.168.56.15-SolrCloud.Shard2.Replica

192.168.56.16-SolrCloud.Shard3.Replica

二、环境安装

1、CentOs 6.4安装

1)配制用户

安装完后配制用户solrcloud 密码: solrcloud

[root@localhost ~]# useradd solrcloud

[root@ localhost ~]# passwd solrcloud

2)修改当前机器名称

vi etc/sysconfig/network

HOSTNAME=SolrCloud.Shard1.Leader

3)修改当前机器ip

vi /etc/sysconfig/network-scripts/ifcfg-eth0

DEVICE=eth0

HWADDR=08:00:27:5C:8C:BD

TYPE=Ethernet

UUID=4fc0a398-f82b-49e5-8657-27bf5b260444

ONBOOT=yes

NM_CONTROLLED=yes

IPADDR=192.168.56.11

NETMASK=255.255.255.0

重启服务service network restart

4)上传安装包(工具上传WinSCP)

创建文件夹mkdir /solrcloud

赋写权限chmod 777 /solrcloud

上传所需安装软件包到/solrcloud

2、jdk安装

默认jdk安装会报错,64位系统安装32位jdk报的错

需要安装glic , yum install glibc.i686

安装完后再安装jdk 进入/solrcloud目录

./jdk-6u45-linux-i586-rpm.bin

3、zookeeper集群安装

(集群安装测试时以ip为例说明,正式上线后可以配主机名称)

1)解压zookeeper 安装包

tar -zxvf zookeeper-3.4.5.tar.gz

2)进入zookeeper-3.4.5文件夹,创建data 和log

创建目录并赋于写权限

指定zookeeper的数据存放目录和日志目录

3)拷贝zookeeper配制文件zoo_sample.cfg

拷贝zookeeper配制文件zoo_sample.cfg并重命名zoo.cfg

cp /solrcloud/zookeeper-3.4.5/conf/zoo_sample.cfg /solrcloud/zookerper-3.4.5/conf/zoo.cfg

4)修改zoo.cfg

加入dataDir=/solrcloud/zookeeper-3.4.5/data

dataLogDir=/solrcloud/zookeeper-3.4.5/log

server.1=192.168.56.11:2888:3888

server.2=192.168.56.12:2888:3888

server.3=192.168.56.13:2888:3888

server.4=192.168.56.14:2888:3888

server.5=192.168.56.15:2888:3888

server.6=192.168.56.16:2888:3888

zoo.cfg配制完后如下:

# The number of milliseconds of each tick

tickTime=2000

# The number of ticks that the initial

# synchronization phase can take

initLimit=10

# The number of ticks that can pass between

# sending a request and getting an acknowledgement

syncLimit=5

# the directory where the snapshot is stored.

# do not use /tmp for storage, /tmp here is just

# example sakes.

dataDir=/solrcloud/zookeeper-3.4.5/data

dataLogDir=/solrcloud/zookeeper-3.4.5/log

# the port at which the clients will connect

clientPort=2181

#

# Be sure to read the maintenance section of the

# administrator guide before turning on autopurge.

#

# https://www.360docs.net/doc/fc18023200.html,/doc/current/zookeeperAdmin.html#sc_maintenance #

# The number of snapshots to retain in dataDir

#autopurge.snapRetainCount=3

# Purge task interval in hours

# Set to "0" to disable auto purge feature

#autopurge.purgeInterval=1

server.1=192.168.56.11:2888:3888

server.2=192.168.56.12:2888:3888

server.3=192.168.56.13:2888:3888

server.1=192.168.56.11:2888:3888

server.2=192.168.56.12:2888:3888

server.3=192.168.56.13:2888:3888

server.4=192.168.56.14:2888:3888

server.5=192.168.56.15:2888:3888

server.6=192.168.56.16:2888:3888

5)进入data文件夹建立对应的myid文件

例如server.1=192.168.56.11 data文件夹下的myid文件内容为1

6)制zookeeper-3.4.5文件夹到其他机器

7)开启zookeeper的端口

/sbin/iptables -I INPUT -p tcp --dport 2181 -j ACCEPT

/sbin/iptables -I INPUT -p tcp --dport 2888 -j ACCEPT

/sbin/iptables -I INPUT -p tcp --dport 3888 -j ACCEPT

/sbin/iptables -I INPUT -p tcp --dport 8080 -j ACCEPT--顺便启用tomcat 8080端口

/etc/rc.d/init.d/iptables save #将更改进行保存

/etc/init.d/iptables restart #重启防火墙以便改动生效

8)启动zookeeper

进入bin

./zkServer.sh start

查看集群状态

./zkServer.sh status 刚启动可能会有错误,集群中其他节点一并起来后就正常了

4、solr集群安装

1)在solrcloud下新建solrhome,并赋于读写权限

2)将上传的solr.4.6.0压缩包解压缩,

tar -zxvf solr-4.6.0.tgz

3)将solr.4.6.0/dist/solr-4.6.0.war 复制到/solrcloud/solrhome 并重命为solr.war

cp /solrcloud/solr-4.6.0/dist/solr-4.6.0.war /solrcloud/solrhome/solr.war 4)将上传的tomcat解压缩

tar -zxvf apache-tomcat-6.0.29.tar.gz

5)进入tomcat bin目录,启动tomcat

cd /solrcloud/apache-tomcat-6.0.29/bin进入bin目录

./startup.sh 启动tomcat 此时会在tomcat下的conf文件夹下多出一个目录Catalina

cd /solrcloud/apache-tomcat-6.0.29/conf/Catalina/localhost

新建solr.xml文件内容如下:

type="https://www.360docs.net/doc/fc18023200.html,ng.String" value="/solrcloud/solrhome" override="true" />

docBase="/solrcloud/solrhome/solr.war" 指定为solrcloud/solrhome下复制出来solr的war 包

6)停tomcat 再次启动tomcat, webapps 下边多了解压出来的solr文件夹

进入solr/WEB-INF/ 下修改web.xml

改为:

7)将/solrcloud/solr-4.6.0/example/solr 文件夹下所有东西复制到/solrcloud/solrhome

cp -r /solrcloud/solr-4.6.0/example/solr/* /solrcloud/solrhome

8)复制solr-4.6.0/example/lib/ext下所有jar包到tomcat 的lib下

cp /solrcloud/solr-4.6.0/example/lib/ext/* /solrcloud/apache-tomcat-6.0.29/lib/ 复制solr-4.6.0/example/resources/log4j.properties 到solr/WEB-INF/class

如果没有class先创建class文件夹,并赋于写权限

cp /solrcloud/solr-4.6.0/example/resources/log4j.properties

/solrcloud/apache-tomcat-6.0.29/webapps/solr/WEB-INF/class/

9)启动tomcat 访问http://localhost:8080/solr 如图,至此单机版solr配制完成

10)配制集群

将zookeeper和tomcat关联

192.168.56.11台机修改tomcat 的bin目录下catalina.sh文件在第二行加入

JAVA_OPTS="-Dbootstrap_confdir=/solrcloud/solrhome/collection1/conf

-Dcollection.configName=myconf

-DzkHost=192.168.56.11:2181,192.168.56.12:2181,192.168.56.13:2181,192.168.56 .14:2181,192.168.56.15:2181,192.168.56.16:2181 -DnumShards=3"

192.168.56.12-16 , 5台机都修改tomcat 的bin目录下catalina.sh文件在第二行加入

JAVA_OPTS="-DzkHost=192.168.56.11:2181,192.168.56.12:2181,192.168.56.13:2181 ,192.168.56.14:2181,192.168.56.15:2181,192.168.56.16:2181"

至此集群配制完毕

创建集合

http://192.168.56.11:8080/solr/admin/collections?action=CREATE&name=guangzhou&numShar ds=3&replicationFactor=3

任何一个ip均可访问

http://192.168.56.11:8080/solr/#/~cloud

高性能计算集群(HPC CLUSTER)

高性能计算集群(HPC CLUSTER) 1.1什么是高性能计算集群? 简单的说,高性能计算(High-Performance Computing)是计算机科学的一个分支,它致力于开发超级计算机,研究并行算法和开发相关软件。 高性能集群主要用于处理复杂的计算问题,应用在需要大规模科学计算的环境中,如天气预报、石油勘探与油藏模拟、分子模拟、基因测序等。高性能集群上运行的应用程序一般使用并行算法,把一个大的普通问题根据一定的规则分为许多小的子问题,在集群内的不同节点上进行计算,而这些小问题的处理结果,经过处理可合并为原问题的最终结果。由于这些小问题的计算一般是可以并行完成的,从而可以缩短问题的处理时间。 高性能集群在计算过程中,各节点是协同工作的,它们分别处理大问题的一部分,并在处理中根据需要进行数据交换,各节点的处理结果都是最终结果的一部分。高性能集群的处理能力与集群的规模成正比,是集群内各节点处理能力之和,但这种集群一般没有高可用性。 1.2 高性能计算分类 高性能计算的分类方法很多。这里从并行任务间的关系角度来对高性能计算分类。 1.2.1 高吞吐计算(High-throughput Computing) 有一类高性能计算,可以把它分成若干可以并行的子任务,而且各个子任务彼此间没有什么关联。因为这种类型应用的一个共同特征是在海量数据上搜索某些特定模式,所以把这类计算称为高吞吐计算。所谓的Internet计算都属于这一类。按照Flynn的分类,高吞吐计算属于SIMD(Single Instruction/Multiple Data,单指令流-多数据流)的范畴。 1.2.2 分布计算(Distributed Computing) 另一类计算刚好和高吞吐计算相反,它们虽然可以给分成若干并行的子任务,但是子任务间联系很紧密,需要大量的数据交换。按照Flynn的分类,分布式的高性能计算属于MIMD (Multiple Instruction/Multiple Data,多指令流-多数据流)的范畴。 1.3高性能计算集群系统的特点 可以采用现成的通用硬件设备或特殊应用的硬件设备,研制周期短; 可实现单一系统映像,即操作控制、IP登录点、文件结构、存储空间、I/O空间、作业管理系统等等的单一化; 高性能(因为CPU处理能力与磁盘均衡分布,用高速网络连接后具有并行吞吐能力); 高可用性,本身互为冗余节点,能够为用户提供不间断的服务,由于系统中包括了多个结点,当一个结点出现故障的时候,整个系统仍然能够继续为用户提供服务; 高可扩展性,在集群系统中可以动态地加入新的服务器和删除需要淘汰的服务器,从而能够最大限度地扩展系统以满足不断增长的应用的需要; 安全性,天然的防火墙; 资源可充分利用,集群系统的每个结点都是相对独立的机器,当这些机器不提供服务或者不需要使用的时候,仍然能够被充分利用。而大型主机上更新下来的配件就难以被重新利用了。 具有极高的性能价格比,和传统的大型主机相比,具有很大的价格优势; 1.4 Linux高性能集群系统 当论及Linux高性能集群时,许多人的第一反映就是Beowulf。起初,Beowulf只是一个著名的科学计算集群系统。以后的很多集群都采用Beowulf类似的架构,所以,实际上,现在Beowulf已经成为一类广为接受的高性能集群的类型。尽管名称各异,很多集群系统都是Beowulf集群的衍生物。当然也存在有别于Beowulf的集群系统,COW和Mosix就是另两类著名的集群系统。 1.4.1 Beowulf集群 简单的说,Beowulf是一种能够将多台计算机用于并行计算的体系结构。通常Beowulf系统由通过以太网或其他网络连接的多个计算节点和管理节点构成。管理节点控制整个集群系统,同时为计算节点提供文件服务和对外的网络连接。它使用的是常见的硬件设备,象普通PC、以太网卡和集线器。它很少使用特别定制的硬件和特殊的设备。Beowulf集群的软件也是随处可见的,象Linux、PVM和MPI。 1.4.2 COW集群 象Beowulf一样,COW(Cluster Of Workstation)也是由最常见的硬件设备和软件系统搭建而成。通常也是由一个控制节点和多个计算节点构成。

LVS keepalived负载均衡高可用 配置安装大全

LVS+Keepalived实现高可用集群 一、基础介绍 (2) 二、搭建配置LVS-NA T模式 (2) 三、搭建配置LVS-DR模式 (4) 四、另外一种脚本方式实现上面LVS-DR模式 (6) 五、keepalived + LVS(DR模式) 高可用 (8) 六、Keepalived 配置文件详细介绍 (11)

一、基础介绍 (一)根据业务目标分成三类: High Availability 高可用 Load Balancing 负载均衡 High Performance 高性能 (二)实现集群产品: HA类: rhcs、heartbeat、keepalived LB类: haproxy、lvs、nginx、f5、piranha HPC类: https://www.360docs.net/doc/fc18023200.html,/index/downfile/infor_id/42 (三)LVS 负载均衡有三种模式: LVS-DR模式(direct router)直接路由模式 进必须经过分发器,出就直接出 LVS-NAT模式(network address translation) 进出必须都经过分发器 LVS-TUN模式(ip tunneling)IP隧道模式 服务器可以放到全国各地 二、搭建配置LVS-NAT模式 1 、服务器IP规划: DR服务器添加一张网卡eth1,一个网卡做DIP,一个网口做VIP。 设置DIP、VIP IP地址: DIP的eth1和所有RIP相连同一个网段 CIP和DIP的eth0(Vip)相连同一个网段 Vip eth0 192.168.50.200 Dip eth1 192.168.58.4 客户机IP: Cip 192.168.50.3

最新高性能计算平台设计方案模板

XXXX 高性能计算平台建设方案 XXXXX 2013年4月

目录 1 概述 (2) 1.1 背景概况 (2) 1.2 建设内容 (3) 1.3 设计原则 (3) 2 总体架构 (5) 3 高性能计算平台硬件系统 (6) 3.1 平台架构图 (6) 3.2 主要设备选型 (8) 3.3 Cluster集群系统 (9) 3.4 计算节点 (10) 3.5 管理节点 (10) 3.6 I/O存储节点 (11) 3.7 网络系统方案............................................................................... 错误!未定义书签。 3.8 管理网络 (12) 3.9 监控网络 (12) 3.10 存储系统 (12) 4 高性能计算平台软件系统 (13) 4.1 64位Linux操作系统 (13) 4.2 集群管理软件 (14) 4.3 作业调度系统 (14) 4.4 并行文件系统 (15) 4.5 集群并行计算环境 (15) 4.6 标准库函数 (16) 4.7 标准应用软件 (16) 5 项目经费预算 (17) 5.1 经费来源 (17) 5.2 经费支出预算 (17) 附页——高性能计算平台技术参数要求 (18)

1概述 1.1背景概况 20世纪后半期,全世界范围掀起第三次产业革命的浪潮,人类开始迈入后 工业社会——信息社会。在信息经济时代,其先进生产力及科技发展的标志就是 计算技术。在这种先进生产力中高性能计算机(超级计算机)更是具有代表性。 时至今日,计算科学(尤其是高性能计算)已经与理论研究、实验科学相并列,成为现代科学的三大支柱之一。 三种科研手段中,理论研究为人类认识自然界、发展科技提供指导,但科学 理论一般并不直接转化为实用的技术;实验科学一方面是验证理论、发展理论的重要工具,另一方面,它是在理论的指导下发展实用技术,直接为经济发展服务;计算科学的发展也有相当悠久的历史,只是在计算机这一强大的计算工具问世之前,计算只能利用人类的大脑和简单的工具,计算应用于科学研究有天然的局限性,限制了它作用的发挥;随着计算机技术的发展,使用科学计算这一先进的技术手段不断普及,逐渐走向成熟。科学计算可以在很大程度上代替实验科学,并能在很多情况下,完成实验科学所无法完成的研究工作。科学计算也直接服务于实用科技,并为理论的发展提供依据和机会。在许多情况下,或者理论模型过于复杂甚至尚未建立,或者实验费用过于昂贵甚至不允许进行,此时计算模拟就成为求解问题的唯一或主要手段了。 目前,高性能计算已广泛应用于国民经济各领域,发挥着不可替代的重要作用: a) 基础学科中深入的知识发现,问题规模的扩大和求解精度的增加需要更 高性能的计算资源。例如,计算立体力学、计算材料学、计算电磁学。 b) 多学科综合设计领域中大量多部门协同计算需要构建高性能的综合平 台。例如,汽车设计、船舶设计。 c) 基于仿真的工程科学结合传统工程领域的知识技术与高性能计算,提供 经济高效地设计与实践方法。例如,基于仿真的医学实践、数字城市模拟、核电、油田仿真工具、新材料开发、碰撞仿真技术、数字风洞。

高性能计算集群项目采购需求

高性能计算集群项目采购需求 以下所有指标均为本项目所需设备的最小要求指标,供应商提供的产品应至少大于或等于所提出的指标。系统整体为“交钥匙”工程,厂商需确保应标方案的完备性。 投标商在投标方案中须明确项目总价和设备分项报价。数量大于“1”的同类设备,如刀片计算节点,须明确每节点单价。 硬件集成度本项目是我校校级高算平台的组成部分,供应商提供的硬件及配件要求必须与现有相关硬件设备配套。相关系统集成工作由供应商负责完成。 刀片机箱供应商根据系统结构和刀片节点数量配置,要求电源模块满配,并提供足够的冗余。配置管理模块,支持基于网络的远程管理。配置交换模块,对外提供4个千兆以太网接口,2个外部万兆上行端口,配置相应数量的56Gb InfiniBand接口 刀片计算节点双路通用刀片计算节点60个,单节点配置2个CPU,Intel Xeon E5-2690v4(2.6GHz/14c);不少于8个内存插槽,内存64GB,主频≥2400;硬盘裸容量不小于200GB,提供企业级SAS或SSD 硬盘;每节点配置≥2个千兆以太网接口,1个56Gb InfiniBand 接口;满配冗余电源及风扇。 刀片计算节点(大内存)双路通用刀片计算节点5个,单节点配置2个CPU,Intel Xeon E5-2690v4;不少于8个内存插槽,内存128GB,主频≥2400;硬盘裸容量不小于200GB,提供企业级SAS或SSD硬盘;每节点配置≥2个千兆以太网接口,1个56Gb InfiniBand接口;满配冗余电源及风扇。 GPU节点2个双路机架GPU节点;每个节点2个Intel Xeon E5-2667 v4每节点2块NVIDIA Tesla K80GPU加速卡;采用DDR4 2400MHz ECC内存,每节点内存16GB*8=128GB;每节点SSD 或SAS硬盘≥300GB;每节点配置≥2个千兆以太网接口,1个56Gb/s InfiniBand接口;满配冗余电源及风扇。 数据存储节点机架式服务器2台,单台配置2颗Intel Xeon E5-2600v4系列CPU;配置32GB内存,最大支持192GB;配置300GB 2.5" 10Krpm

利用LVS+Keepalived 实现高性能高可用负载均衡服务器

LVS+Keepalived 介绍 LVS LVS是Linux Virtual Server的简写,意即Linux虚拟服务器,是一个虚拟的服务器集群系统。本项目在1998年5月由章文嵩博士成立,是中国国内最早出现的自由软件项目之一。目前有三种IP负载均衡技术(VS/NAT、VS/TUN和VS/DR); 十种调度算法(rrr|wrr|lc|wlc|lblc|lblcr|dh|sh|sed|nq)。 Keepalvied Keepalived在这里主要用作RealServer的健康状态检查以及LoadBalance主机和BackUP 主机之间failover的实现 二. 网站负载均衡拓朴图 IP信息列表: 名称 IP LVS-DR-Master 61.164.122.6 ? LVS-DR-BACKUP 61.164.122.7 ? LVS-DR-VIP 61.164.122.8 ? WEB1-Realserver 61.164.122.9 ? WEB2-Realserver 61.164.122.10 ? GateWay 61.164.122.1 复制代码 三. 安装LVS和Keepalvied软件包 1. 下载相关软件包 #mkdir /usr/local/src/lvs ? #cd /usr/local/src/lvs ? #wget https://www.360docs.net/doc/fc18023200.html,/software/kernel-2.6/ipvsadm-1.24.tar.gz ? #wget https://www.360docs.net/doc/fc18023200.html,/software/keepalived-1.1.15.tar.gz 复制代码 2. 安装LVS和Keepalived #lsmod |grep ip_vs ? #uname -r ? 2.6.18-53.el5PAE ? #ln -s /usr/src/kernels/2.6.18-53.el5PAE-i686/ /usr/src/linux ? ? #tar zxvf ipvsadm-1.24.tar.gz ? #cd ipvsadm-1.24 ? #make && make install ? #find / -name ipvsadm # 查看ipvsadm的位置 ? ? #tar zxvf keepalived-1.1.15.tar.gz ? #cd keepalived-1.1.15 ? #./configure && make && make install

高性能计算集群(PC Cluster)用户指南

高性能计算集群(PC Cluster)用户指南 大气科学系应越 第二版2008-12 目录 -认识cluster -使用cluster -linux常用命令 -软件 -文件传输 第一章:认识cluster 1.什么是cluster系统 cluster一般由一台主机(master)和多台节点机(node)构成,是一种松散耦合的计算节点集合。为用户提供网络服务或应用程序的单一客户视图,同时提供接近容错机的故障恢复能力。通常cluster的每台机器通过相应的硬件及软件互连,每个群集节点都是运行其自己进程的独立服务器。这些进程可以彼此通信,对网络客户机来说就像是形成了一个单一系统,协同起来向用户提供应用程序、系统资源和数据。cluster概念的提出在70年代主要是为了进行一些大运算量的科学计算。随着网络的发展,之后的cluster系统还被用作网络服务器,发挥其故障恢复和均衡负载的能力。 使用PC机构建cluster的好处在于开发成本低,而且由于每台节点机都是普通的PC机,在某一台机器发生故障的时候,可以方便的进行维护,而不影响整个系统的运行。 大气科学系的cluster系统,由16台64位的PC机组成。其中一台主机(master),15台节点机(node01~node15)。这16台机器每台有两个4核的CPU,也就是说每个节点上可以同时提供8个CPU。操作系统使用的是CentOS的Linux发行版。图1为大气科学系cluster目前的结构。其中console 和c0101~c0107是大气系早期的cluster系统,节点安装的是RedHat的Linux发行版,precluster曾经作为门户机,目前已经更新为CentOS的操作系统。 登录master的IP地址为162.105.245.3,这个地址由于物理大楼的IP变动比较频繁,所以可能会时不时改变,而precluster的IP地址162.105.245.238则比较稳定。这两个地址目前都可以从校外访问。 cluster的应用主要集中在并行计算上。虽然单个节点的单CPU运算效率比普通的笔记本或是台式机都高很多,但是cluster当初被设计出来就是为了进行多CPU协同运算的,而不是仅仅为了提高单CPU的运算效率。所以我们鼓励用户在cluster上进行并行计算,而把一些单CPU也能解决的工作

数据库负载均衡解决方案

双节点数据库负载均衡解决方案 问题的提出? 在SQL Server数据库平台上,企业的数据库系统存在的形式主要有单机模式和集群模式(为了保证数据库的可用性或实现备份)如:失败转移集群(MSCS)、镜像(Mirror)、第三方的高可用(HA)集群或备份软件等。伴随着企业的发展,企业的数据量和访问量也会迅猛增加,此时数据库就会面临很大的负载和压力,意味着数据库会成为整个信息系统的瓶颈。这些“集群”技术能解决这类问题吗?SQL Server数据库上传统的集群技术 Microsoft Cluster Server(MSCS) 相对于单点来说Microsoft Cluster Server(MSCS)是一个可以提升可用性的技术,属于高可用集群,Microsoft称之为失败转移集群。 MSCS 从硬件连接上看,很像Oracle的RAC,两个节点,通过网络连接,共享磁盘;事实上SQL Server 数据库只运行在一个节点上,当出现故障时,另一个节点只是作为这个节点的备份; 因为始终只有一个节点在运行,在性能上也得不到提升,系统也就不具备扩展的能力。当现有的服务器不能满足应用的负载时只能更换更高配置的服务器。 Mirror 镜像是SQL Server 2005中的一个主要特点,目的是为了提高可用性,和MSCS相比,用户实现数据库的高可用更容易了,不需要共享磁盘柜,也不受地域的限制。共设了三个服务器,第一是工作数据库(Principal Datebase),第二个是镜像数据库(Mirror),第三个是监视服务器(Witness Server,在可用性方面有了一些保证,但仍然是单服务器工作;在扩展和性能的提升上依旧没有什么帮助。

高性能集群计算解决方案

https://www.360docs.net/doc/fc18023200.html,/sige_online/blog/item/d6aa74a9106a10ff1f17a224.html 和卫星遥测,遥感等探矿技术的发展,促使油气勘探的数据量爆炸性地增长, 要求信息系统能够获取,存储和处理TB级的巨量数据; 使用更精确的模型:为了提高探矿水平,必须使用规模更大,更精确数值模型来模拟地下矿藏的分布.5年前,模型的节点数一般不超过10万个;现在,经常需要使用节点数超过百万的3维模型来进行数值模拟; 提供更强的计算和数据管理能力:模型规模的扩大要求使用处理能力指数增长的计算机系统和更复杂的算法快速和精确地求解,同时也要求更强的数据管理能力来建立历史数据库,并把当前数据与长期积累的历史数据相比较,得到精确的综合预测结果; 支持功能丰富的应用软件:现代的油气探测应用软件必须具有直观的3维图象显示和输出,人机交互功能, 以提高工作效率; 降低成本:经济效益和市场竞争压力还迫使油气行业的信息系统在严格控制开支,降低总拥有成本条件下满足上述要求当前,传统的巨型机已经很难全面满足上述要求.油气行业要求使用更经济实惠的新解决方案来全面满足应用需求.Schluberger信息系统公司(SIS)是油气勘探信息处理领域中领先的厂商,也是HP在高性能技术计算领域重要的合作伙伴.该公司在使用基于安腾2的HP Integrity 服务器为计算节点的Linux集群上开发的面向油气矿藏模拟的ECLIPSE Parallel解决方案,能够全面满足油气矿藏勘探信息系统在性能和成本两方面的需求,提供解决人类社会现代化进程中能源问题的利器. 目标市场 ECLIPSE Parallel解决方案使用数值模拟方法满足油气行业探测石油和天然气地下分布状况和预测储量的需要, 油气公司从低级经理到高级主管各种类型的人员都可以得益于这一解决方案,包括:负责提供优化的矿藏分布和产量预测评估人员和经济分析师,负责作出开采决策的经理,信息系统管理人员;需要得到直观和实时矿藏信息的首席信息官(CIO)和首席执行官(CEO),负责监管的政府机构等等. 这一解决方案特别适合于要求打破油气行业使用巨型机传统,采用性能更高,价格/性能最佳的新颖解决方案的油气公司. 解决方案概貌 SIS ECLIPSE Parallel是一个基于英特尔和HP工业标准技术的成套解决方案,便于实施和灵活配置,提供先进的油气矿藏模拟功能.这一解决方案由系统平台和模拟软件两大部分组成(见下图). HP Linux ClusterBlocks集群系统是第一个经过认证的系统平台.这一Linux集群包括如下的层次: 计算节点:采用基于安腾2的HP Integrity rx2600服务器,使用新一代安腾2提供强大的64位处理能力; 互联设备:采用工业标准的高速Myrinet把计算节点联成一体,以太网联接管理节点; 操作环境:采用应用最广泛的RedHat Linux Advanced Server操作系统建立集群运行的操作环境; 集群管理和作业调度:采用Scali, Scyld或ClusterWare 公司著名的Linux工具软件管理集群系统;采用业界领先的Platform Computing的LSF 5.0软件来实现负载平衡,提高集群的工作效率上层的ECLIPSE Parallel模拟软件负责完成矿藏模拟的数值计算,它把整个数值求解问题分解成一系列较小的子问题,送到各个计算节点上并行地求解,然后再合成完整的结果. ECLIPSE Parallel解决方案这一基于Linux集群并行计算的设计思想,在性能,性价比,可伸缩性和可用性等方面都超过基于巨型机的传统解决方案,具有广阔的发展前途. 组成部件 SIS ECLIPSE Parallel软件与HP ClusterBlocks 集群结合在一起形成了一个把最先进硬件和软件完美地结合在一起的油气储藏模拟解决方案,它的主要组成部件有: 基于安腾2处理器的HP Integrity rx2600服务器; 工厂组装的基于Myrinet高速互联网络的16-128节点 Linux集群系统; RedHat Linux Advanced Server 2.1操作系统; Platform Computing的负载调度软件(LSF) 5.0:用于平衡集群内各节点的工作负载,提供运行效率; 消息传递接口(MPICH/GM):用于支持基于集群架构系统内的并行计算; 集群管理软件:允许采用Scali, Scyld, ClusterWareLinux 等公司的软件管理集群系统运行和资源共享; SIS ECLIPSE Parallel 油气储藏模拟软件 SIS ECLIPSE Parallel解决方案的硬件系统使用HP Integrity rx2600服务器作为计算节点,高速的Myrinet作为互联设备组成Linux集群,为油气储藏模拟软件提供高性能运行平台. ECLIPSE Parallel软件把整个模拟模型分解成若干个子区域.

高性能计算(HPC)数据中心解决方案

解决方案简介 面临的挑战 随着当前信息的爆炸式增长,以及在使用基于x86微芯片的通用硬件方面的不断创新,通常是由多台机器来提供计算以共同执行非常复杂的任务。这使得网络成为一个至关重要的HPC 组件。解决方案 瞻博网络提供一种高速的HPC 数据中心网络解决方案。此HPC 基础架构非常适合于那些希望近距离互连多台10GbE 服务器,而且延迟时间不能超过亚微秒的客户。优势 ? 基于10GbE 接入的模块化网络设计? 支持极大规模的低延迟连接? 提供多种功能来满足端到端的应用需求 高性能计算(HPC )数据中心解决方案 瞻博网络HPC 解决方案能够帮助客户执行密集的计算任务,并提供最大的网络效率和可靠性 面临的挑战 随着高性能集群解决方案和超级计算的日渐增加,越来越多的行业开始转向多节点集群应用。采用HPC 技术背后的主要驱动因素是越来越多的用户可以访问不断增加的数据量,这就需要进行计算以处理这些数据。由于基于以太网的集群解决方案的普及,以及在高性能业务中进行密集型计算和建模所带来的价值,很多企业开始重新审视计算集群为他们带来的经济效益。下面是多个行业从HPC 技术获得明显收益的实例: ? 设计工作室依靠计算集群来进行动画和视觉效果的渲染和建模。? 工程和建筑公司使用HPC 进行建模和3D 成像。? 石油和能源公司使用HPC 进行建模和地震研究。? 生物技术公司利用HPC 进行建模和预测性模型分析。? 投资公司和银行利用HPC 进行算法交易建模和快速市场分析。? 零售公司利用HPC 获得市场情报和进行基于视频的业务分析。? 学术界始终在挑战可以实现的最大计算能力。 一般说来,这些计算挑战对于网络提出了一系列极为苛刻的要求。局域网的最初设计目的是将相对较近的最终用户工作站连接在一起,并支持这些工作站与远程网络进行通信。HPC 网络对于网络的要求主要是服务器与服务器的连接性,局域网应用与现代数据中心在通信流量模式上有很大差距,与HPC 数据中心的差距就更大了。由于这些因素,我们看到以太网大约只服务于一半的HPC 市场,In? niband 还占有显著的市场份额。一直以来,Infiniband 都被视作服务于那些低延迟和极高性能的HPC 集群应用的传统技术。 不单单是现有的局域网架构不能很好地支持HPC 基础架构(瞻博网络基于1GbE 的集群交换fabric 技术可以解决这一问题),而且,长期以来以太网技术(实际上是局域网的基础)也缺乏某些HPC 集群所需的高性能特征。随着10GbE 的商业化,基于以太网的HPC 解决方案开始具有技术可行性和出色的经济性。

几种负载均衡策略比较~

PS:Nginx/LVS/HAProxy是目前使用最广泛的三种负载均衡软件,本人都在多个项目中实施过,参考了一些资料,结合自己的一些使用经验,总结一下。 一般对负载均衡的使用是随着网站规模的提升根据不同的阶段来使用不同的技术。具体的应用需求还得具体分析,如果是中小型的Web应用,比如日PV小于1000万,用Nginx就完全可以了;如果机器不少,可以用DNS轮询,LVS所耗费的机器还是比较多的;大型网站或重要的服务,且服务器比较多时,可以考虑用LVS。一种是通过硬件来进行进行,常见的硬件有比较昂贵的F5和Array等商用的负载均衡器,它的优点就是有专业的维护团队来对这些服务进行维护、缺点就是花销太大,所以对于规模较小的网络服务来说暂时还没有需要使用;另外一种就是类似于Nginx/LVS/HAProxy的基于Linux的开源免费的负载均衡软件,这些都是通过软件级别来实现,所以费用非常低廉。 目前关于网站架构一般比较合理流行的架构方案:Web前端采用 Nginx/HAProxy+Keepalived作负载均衡器;后端采用MySQL数据库一主多从和读写分离,采用LVS+Keepalived的架构。当然要根据项目具体需求制定方案。 下面说说各自的特点和适用场合。 一、Nginx Nginx的优点是: 1、工作在网络的7层之上,可以针对http应用做一些分流的策略,比如针对域名、目录结构,它的正则规则比HAProxy更为强大和灵活,这也是它目前广泛流行的主要原因之一,Nginx单凭这点可利用的场合就远多于LVS了。 2、Nginx对网络稳定性的依赖非常小,理论上能ping通就就能进行负载功能,这个也是它的优势之一;相反LVS对网络稳定性依赖比较大,这点本人深有体会; 3、Nginx安装和配置比较简单,测试起来比较方便,它基本能把错误用日志打印出来。LVS的配置、测试就要花比较长的时间了,LVS对网络依赖比较大。 3、可以承担高负载压力且稳定,在硬件不差的情况下一般能支撑几万次的并发量,负载度比LVS相对小些。 4、Nginx可以通过端口检测到服务器内部的故障,比如根据服务器处理网页返回的状态码、超时等等,并且会把返回错误的请求重新提交到另一个节点,不过其中缺点就是不支持url来检测。比如用户正在上传一个文件,而处理该上传的节点刚好在上传过程中出现故障,Nginx会把上传切到另一台服务器重新处理,而LVS就直接断掉了,如果是上传一个很大的文件或者很重要的文件的话,用户可能会因此而不满。 5、Nginx不仅仅是一款优秀的负载均衡器/反向代理软件,它同时也是功能强大的Web应用服务器。LNMP也是近几年非常流行的web架构,在高流量的环境中稳定性也很好。 6、Nginx现在作为Web反向加速缓存越来越成熟了,速度比传统的Squid服务器更快,可以考虑用其作为反向代理加速器。 7、Nginx可作为中层反向代理使用,这一层面Nginx基本上无对手,唯一可以对比

高性能计算集群的cae软件应用

随着计算机应用的广泛深入,不同领域处理问题的规模也越来越大,对计算速度的追求也在不断增长。例如,在气象预报、流体力学、能源工程、生物制药、图像处理等领域的问题都涉及到海量的计算数据,并且计算必须在能接收的时间内完成。所以,如何在短时间内完成计算任务,提高并行计算的效率已经成为这些领域要解决的问题。 商用CAE软件现在发展的非常之迅速,而且都致力于软件的并行化开发。目前,市场上的通用CAE软件都实现了集群中的并行运行,而且效果都非常良好。以ANSYS为例,作为目前最常用的有限元求解软件之一,它的求解模块种类多,多物理场实现耦合求解以及实现协同仿真技术等优点受到广大用户的欢迎。因此,通用CAE已经成为今后工程计算领域的重要工具。 1 CAE通用软件的发展 20世纪在50年代末、60年代初就投入大量的人力和物理开发具有强大功能的有限元分析程序。其中最为著名的是由美国国家宇航局在1965年委托美国计算科学公司和贝尔航空系统公司开发的NASTRAN有限元分析系统。此后有德国的ASKA、英国的PAFEC等公司的产品。 CAE在工程上初步开始使用一直到今天,已经经历了50多年的发展历史,其理论和算法都经历了从蓬勃发展到日趋成熟的过程。在航天、航空、机械、土木机构等领域的工程和产品结构分析中已经成为必不可少的数值计算工具,同时也是分析连续力学各类问题的一种重要手段。随着计算机技术的普及和不断提高,CAE系统的功能和计算精度都有很大提高,

各种基于产品数字建模的CAE系统应运而生,并已成为结构分析和结构优化的重要工具,同时也是计算机辅助4C系统(CAD/CAE/CAPP/CAM)的重要环节。CAE系统的核心思想是结构的离散化,即将实际结构离散为有限数目的规则单元组合体,实际结构的物理性能可以通过对离散体进行分析,得出满足工程精度的近似结果来替代对实际结构的分析,这样可以解决很多实际工程需要解决而理论分析又无法解决的复杂问题。 正因为CAE在制造企业中承担着关键的工具的作用,所以其高性能平台的选择也非常的重要,这个平台直接影响CAE的运行性能表现、整体成本和系统等方面的问题。所以,高性能计算平台与CAE软件的如何更好的配合要进行一个全面的权衡。 2 CAE模拟的步骤 2.1 建立物理模型 在研究一项具体的问题的时候,首先必须要明确研究对象及其物理特性。确定出一个具有特定便捷的研究区域,分析的特征与特性。其次根据研究内容的特征,做出简化假定和近似,忽略非本质的物理过程来简化整个物理模型。从而得出一个经过简化,比较有研究特点的物理模型。 2.2 建立数学模型 物理模型确定以后就要建立相应的数学模型,也就是用数学模型来反映问题各量之间的

高性能计算集群收费管理办法

中国矿业大学现代分析与计算中心 高性能计算集群收费管理办法(试行) 为进一步规范我校高性能计算集群的使用,合理、高效地利用计算资源为学校的教学科研和学科建设服务,确保学校承担的具有国际前沿水平及国家级重大科研项目的计算需求,依照学校有关仪器设备管理使用的规定,特制定我中心高性能计算集群的收费管理办法(以下简称本办法)。 第一条.本办法适用于中国矿业大学教职员工和在籍学生。缴费用户分为团队用户和个人用户,团队用户名下可以拥有多个注册账号用于登录团队独享的计算资源;个人用户对应一个注册账号,用于登录个人用户共享的计算资源,提交的计算作业须参与集体排队。 第二条.本收费管理办法将根据学校的规定和学校教学科研、学科建设的需要以及高性能计算发展的实际情况适时调整。 第三条.收费方式和收费标准 中心提供二种计费方式,用户可以根据自己实际使用的情况选择其一: 1. 团队方式:用户可根据需要申请多个计算节点资源,申请的计算资源为用户及用户允许的集群登陆账号专用,每计算节点¥500元/月,¥1200元/季度,¥1800元/半年,¥3000元/年。 2. 计时方式:依据集群记账管理中用户作业WallTime值,按每核每小时0.1元收取。 第四条.收费办法 1、采取用户预付费,中心定期结算的方式收取计算费用。 2、收费及结算办理: (1)矿业科学中心A308室:负责办理用户预付费手续; (2)矿业科学中心B501室:负责用户费用定期结算,并电子邮件通知用户。 第五条.注意事项

1、中心人员在收到用户的预付费和用户信息相关表格后,将在三个工作日内开通登录账号并通知用户。 2、定期结算时,如果用户预付费为0或欠费,将短信和电子邮件通知用户,七个工作日后,如不再预付费,中心将终止该用户登陆。十五个工作日后,注销该用户。 3、免收共享存储空间使用费,且不限制大小,但用户需按规定及时删除完成作业的数据,当所有用户使用的共享存储空间达到总存储空间的70%时,将通知用户强制清理过往作业占用的存储空间。 4、利用我中心高性能计算平台计算资源取得国内外有重要影响重大科研成果或发表SCI 论文的用户,我中心将根据具体情况给予一定的费用减免。 第六条. 本办法自2013年9月1日起执行。 中国矿业大学 现代分析与计算中心 2013年7月1日

nginx负载均衡高可用

n g i n x负载均衡高可用 This model paper was revised by the Standardization Office on December 10, 2020

1nginx负载均衡高可用 1.1什么是负载均衡高可用 nginx作为负载均衡器,所有请求都到了nginx,可见nginx处于非常重点的位置,如果nginx服务器宕机后端web服务将无法提供服务,影响严重。 为了屏蔽负载均衡服务器的宕机,需要建立一个备份机。主服务器和备份机上都运行高可用(High Availability)监控程序,通过传送诸如“I am alive”这样的信息来监控对方的运行状况。当备份机不能在一定的时间内收到这样的信息时,它就接管主服务器的服务IP并继续提供负载均衡服务;当备份管理器又从主管理器收到“I am alive”这样的信息时,它就释放服务IP地址,这样的主服务器就开始再次提供负载均衡服务。 1.2keepalived+nginx实现主备 1.2.1什么是keepalived keepalived是集群管理中保证集群高可用的一个服务软件,用来防止单点故障。 Keepalived的作用是检测web服务器的状态,如果有一台web服务器死机,或工作出现故障,Keepalived将检测到,并将有故障的web服务器从系统中剔除,当web服务器工作正常后Keepalived自动将web服务器加入到服务器群中,这些工作全部自动完成,不需要人工干涉,需要人工做的只是修复故障的web服务器。 1.2.2keepalived工作原理 keepalived是以VRRP协议为实现基础的,VRRP全称Virtual Router Redundancy Protocol,即虚拟路由冗余协议。

高性能计算平台建设方案

高性能计算平台建设方案1.验证理论、发展理论的重要工具,另一方面,它是在理论的指导下发展实 用技术,直接为经济发展服务;计算科学的发展也有相当悠久的历史,只是在计算机这一强大的计算工具问世之前,计算只能利用人类的大脑和简单的工具,计算应用于科学研究有天然的局限性,限制了它作用的发挥;随着计算机技术的发展,使用科学计算这一先进的技术手段不断普及,逐渐走向成熟。科学计算可以在很大程度上代替实验科学,并能在很多情况下,完成实验科学所无法完成的研究工作。科学计算也直接服务于实用科技,并为理论的发展提供依据和机会。在许多情况下,或者理论模型过于复杂甚至尚未建立,或者实验费用过于昂贵甚至不允许进行,此时计算模拟就成为求解问题的唯一或主要手段了。 目前,高性能计算已广泛应用于国民经济各领域,发挥着不可替代的重要作用: a) 基础学科中深入的知识发现,问题规模的扩大和求解精度的增加需要更高性能的计算资源。例如,计算立体力学、计算材料学、计算电磁学。 b) 多学科综合设计领域中大量多部门协同计算需要构建高性能的综合平台。例如,汽车设计、船舶设计。

c) 基于仿真的工程科学结合传统工程领域的知识技术与高性能计算,提供经济高效地设计与实践方法。例如,基于仿真的医学实践、数字城市模拟、核电、油田仿真工具、新材料开发、碰撞仿真技术、数字风洞。 d) 高性能计算提升众多行业服务、决策的时效性,提高经济效益。例如,实时天气预报、城市交通控制、视频点播服务、动漫设计、网络游戏、基于RFID 的货物跟踪、智能电子商务。 e) 数据密集型应用需要高性能数据处理,以应对数据爆炸式增长带来的难题。例如,高能物理实验数据处理、遥感数据处理、商业智能、生物信息学、RFID 数据挖掘、金融业分析抵押借贷、移动电话流量分析。 1.1建设内容 高性能计算平台是面向全校提供高速计算服务的公共计算平台,主要运行科研计算任务,并且能够根据应用任务对硬件资源的不同需求,动态分配和调整平台资源,管理计算作业。用户通过校园网或VPN远程提交计算作业、获取计算结果,并能够根据权限调整,实现权限控制,硬件细节对用户透明。用户界面实现图形化交互窗口和SSH登陆相结合方式。 平台的主要硬件设备有:管理节点、计算节点、存储IO节点、Infiniband交换机、高速存储、千兆以太网交换机;软件方面有:64位Linux操作系统、并行开发环境、并行文件系统、作业调度管理系统、硬件集群管理系统等,利用高速infiniband网络互联构成计算环境,通过并行计算支撑软件和作业调度系统使它们协同工作。 平台支持同时运行Ansys、Fluent、Gauss、Materials Studi、ADMS、Opera、HFSS、MTSS、MAGIC、CST、Icepak等商业软件,并支持C(C++)、Fortran77/90等语言的编译和运行环境,以保证学院自编应用程序的计算求解需求。

【高性能计算中心】高性能计算中心项目详细设计方案

高性能计算中心项目详细设计方案 1

目录 1 系统方案详细设计 (4) 1.1 计算系统 (4) 1.1.1 计算系统需求分析 (4) 1.1.2 刀片集群 (5) 1.1.3 SMP胖节点 (8) 1.1.4 Intel E5-2600v2处理器性能优势 (9) 1.1.5 AMD Opteron 6300系列处理器优势 (11) 1.2 网络系统 (16) 1.2.1 管理网络 (17) 1.2.2 万兆核心网络 (17) 1.2.3 Infiniband计算网 (18) 1.3 存储系统 (20) 1.3.1 高性能集群存储的需求特点 (20) 1.3.2 ParaStor200并行存储系统 (21) 1.3.3 文件服务器存储系统 (24) 1.4 前后处理节点 (24) 1.5 集群管理运维系统 (25) 1.5.1 管理/登陆节点 (25) 1.5.2 ClusKVM监控管理系统 (25) 1.5.3 集群管理系统 (26) 1.5.4 集群计费软件系统 (33) 1.5.5 集群节能软件系统 (35) 1.5.6 运维辅助软件 (36) 1.5.7 作业调度系统 (37) 1.6 安全系统 (41) 1.6.1 高性能集群整体安全解决方案 (41) 1.6.2 主机与应用安全(计算环境安全设计) (42) 1.6.3 区域边界安全设计 (45) 2

1.6.4 边界完整性检查 (46) 1.6.5 通信网络安全设计 (47) 1.6.6 系统管理 (48) 1.6.7 审计管理 (49) 1.6.8 安全管理体系 (49) 1.6.9 安全系统配置清单 (49) 1.7 集群基础软件环境 (50) 1.7.1 操作系统 (50) 1.7.2 编译环境 (50) 1.7.3 并行环境 (52) 1.7.4 数学库 (54) 1.8 终端 (56) 3

虚拟化群集中的网络负载平衡和高可用性

什么是群集?简单的说,群集(cluster)就是一组计算机,它们作为一个整体向用户提供一组网络资源。这些单个的计算机系统就是群集的节点(node)。一个理想的群集是,用户从来不会意识到群集系统底层的节点,在用户看来,群集是一个完整系统,而非多个计算机系统。并且群集系统的管理员可以随意增加和删改群集系统的节点。 服务器群集 如上图,由2台服务器(Server1,Server2)组成的群集方式,其中每台服务器的地位是平等的。都可以为客户端提供服务并且不用其它服务器的辅助。上图中Server3是服务器群集虚拟出来的主机,客户端所能看到的群集只是一台Server3主机。群集中的主机将均衡处理客户端发来的应用请求,以此来实现负载均衡(NLB);如果某一台服务器出现宕机,客户端发来的应用请求将被分配给另外一台服务器,通过这种方式来保障业务应用的高可用性(HA)。

虽然,根据群集系统的不同特征可以有多种分类方法,但是一般把群集系统分为两类:高可用(High Availability)群集,简称HA群集;性能计算(High Perfermance Computing)群集,简称HPC群集,也称为科学计算群集。在本文中我们只介绍前者。 HA群集,不难理解,这类群集致力于提供高度可靠的服务。就是利用群集系统的容错性对外提供7*24小时不间断的服务,如高可用的文件服务器、数据库服务等关键应用。HA群集和负载均衡(NLB)群集之间的界限有时非常模糊,负载均衡群集使任务可以在群集中尽可能平均地分摊到不同的计算机中进行处理,充分利用群集的处理能力,提高对任务的处理效率。在实际应用中,这几种群集类型可能会混合使用,以提供更加高效稳定的服务。如在一个使用的网络流量负载均衡群集中,就会包含高可用的网络文件系统、高可用的网络服务。 服务器群集技术常见的有Linux中的LVS和Windows中的NLB。NLB即Network Load Balancing,也就是网络负载平衡。Microsoft在所有的Windows Server操作系统上提供这一负载平衡技术。NLB的用途很广,将多台应用服务器通过NLB的方式捆绑在一起,这样以来NLB可以根据实际的访问流量均分开来减少各服务器的网络占用及资源占用,所以NLB 被广泛用于终端服务、Web服务、FTP服务等,用来解决大量并发访问服务问题,帮助用户使用较少的投资获得接近于大型主机的性能。同时,由于实际处理应用请求的服务器变为多台,高可用性也得到了有效的保证。 大致概括一下群集技术的主要优点,主要包括以下4个方面: (1)高可扩展性:群集系统的管理员可以随意增加和删改群集系统的节点。