人工神经网络第六章

第六章神经网络模式识别

梯度下降(gradient decent)法

准则函数: 准则函数: sum squared error, SSE

1 J = sse = 2S

BP 算法

∑ (t

j

S

j

− aj)

2

权值修正: 权值修正: 梯度下降法

∂J ∂J ∂n j ∂ J ( k −1) ∆ w j = −η = −η = −η a ∂w j ∂n j ∂w j ∂n j

§6.6 神经网络模式识别概述

神经网络模式识别方法是近几年的模式识别领域的一个重 要研究方向。由于神经网络的高速并行处理、分布式存储 信息等特性符合人类视觉系统的基本工作原理,且神经网 络具有很强的自学习性、自组织性、容错性、高度非线性、 联想记忆功能和逻辑推理功能等,能够实现目前基于计算 理论层次上的模式识别理论所无法完成的模式信息处理工 作。可以说,神经网络模式识别突破了传统模式识别技术 的束缚,开辟了模式识别发展的新途径。同时,神经网络 模式识别也成为神经网络最成功和最有前途的应用领域之 一。 神经网络模式识别的过程主要有两步:

j j j j j

j j j ji i

i

ij

j

i

ij

ij

ij

4. 径向基函数网络

前馈 网络

径向基函数网络:只有一个隐层,隐层单元采用径 向基函数。隐层把原始的非线性可分的特征空间变 换到另一个空间(通常是高维空间),使之可以线 性可分。 输出为隐层的线性加权求和。采用基函数的加权和 来实现对函数的逼近。 径向基函数(radial basis function, RBF):径向对称 的标量函数k(||x-xc||),最常用的RBF是高斯核函数

前馈 网络

(单层 单层) 2. (单层)感知器

人工神经网络理论及应用课件第6章 反馈神经网络

一个常数值,对应的稳定状态是网络的一个吸引子。

韩力群 施彦 制作

6.1.2.2 吸引子与能量函数

以上分析表明,在网络从初态向稳态 演变的过程中,网络的能量始终向减小的 方向演变,当能量最终稳定于一个常数时, 该常数对应于网络能量的极小状态,称该 极小状态为网络的能量井,能量井对应于 网络的吸引子。

反馈网络的输入就是网络的状态初始值,表示为 X(0)=[x1(0),x2(0),…,xn(0)]T

反馈网络在外界输入激发下,从初始状态进入动态演变过程,变 化规律为

x j f ( net j )

j=1,2,…,n

韩力群 施彦 制作

DHNN网的转移函数常采用符号函数

xj

sgn(net j)

1 1

韩力群 施彦 制作

6.1离散型Hopfield神经网络

6.1.1 网络的结构与工作方式

x1

x2 … xi

… xn

T1

T2 … Ti … Tn

离散型反馈网络的拓扑结构

韩力群 施彦 制作

(1)网络的状态

DHNN网中的每个神经元都有相同的功能,其输出称为状态,用

xj 表示。

所有神经元状态的集合就构成反馈网络的状态 X=[x1,x2,…,xn]T

2/3 1/3

0.0 x3

101

1/3 111 2/3

1/3

DHNN网络状态演变示意图

011 3/3

(b)

韩力群 施彦 制作

6.1.3 网络的权值设计

为了使所设计的权值满足要求,权值矩阵应符合以下要求:

⑴为保证异步方式工作时网络收敛,W 应为对称阵; ⑵为保证同步方式工作时网络收敛,W 应为非负定对称阵; ⑶保证给定样本是网络的吸引子,并且要有一定的吸引域。

第6章人工神经网络算法ppt课件

4.随机型神经网络 随机型神经网络其基本思想是:不但让网络的误差和能量函数向减小的方

向变化,而且还可按某种方式向增大的方向变化,目的是使网络有可能跳出局部 极小值而向全局最小点收敛。随机型神经网络的典型算法是模拟退火算法。

曲线越陡。

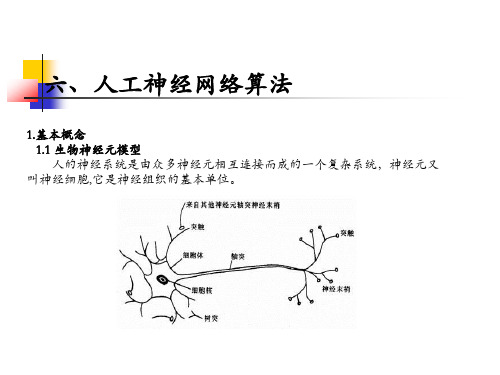

六、人工神经网络算法

1.基本概念 1.2 人工神经元模型 神经元采用了不同的激活函数,使得神经元具有不同的信息处理特性,并且

神经元的信息处理特性是决定神经网络整体性能的主要因素之一。 下面介绍四种常用的激活函数形式:

(4)高斯函数。高斯函数(也称钟型函数)也是极为重要的一类激活函数,常用 于径向基神经网络(RBF网络),其表达式为:

通过调整权值和阈值,使得误差能量达到最小时,网络趋于稳定状态,学习

结束。

(1)输出层与隐含层之间的权值调整。对每一个 wjk 的修正值为:

w jk

E

w jk

E

netk

netk w jk

J

式中: 为学习步长,取值介于(0,1),对式 netk wjkOj 求偏导得:

j0

netk wjk

Oj

x1

w1i

x2

w2ifΒιβλιοθήκη yixnwni

x0 1

六、人工神经网络算法

1.基本概念 1.2 人工神经元模型 在神经元中,对信号进行处理采用的是数学函数,通常称为激活函数、激励

函数或挤压函数,其输入、输出关系可描述为

u j

f

n

wij xi

j

i1

y f uj

式中xi i 1,2,,n是从其它神经元传来的输入信号; j 是该神经元的阈值;

第六章-神经网络

神经网络一、填空题1、神经元(即神经细胞)是由、、和四部分构成。

2、按网络结构分,人工神经元细胞可分为和,按照学习方式分可分为和。

3、人工神经网络常见的输出变换函数有和。

4、人工神经网络的学习规则有、和。

5、国内外学者提出了许多面向对象的神经网络控制结构和方法,从大类上看,较具代表性的有以下几种、和。

6、在一个神经网络中,常常根据处理单元的不同处理功能,将处理单元分成有以下三种、和。

7、在一个神经网络中,基本单元神经元的三个基本要素是、二、选择题1、一般认为,人工神经网络(ANN)适用于()A、线性系统B、多变量系统C、多输入多输出系统D、非线性系统2、最早提出人工神经网络思想的学者是()A、McCulloch-PittsB、HebbC、Widrow-HoffD、Rosenblatt3、神经元模型一般为()A、单输入多输出B、多输入单输出C、单输入单输出D、多输入多输出三、简答题1、简述神经网络的特点。

2、试画出一个2-3-5-2 BP网络的结构图,说明节点函数。

3、简要说明多层感知器的结构和学习算法。

4、前馈型神经网络有什么特点?哪些结构的神经网络属于前馈神经网络?5、简要说明典型的人工神经元模型。

6、神经网络控制系统的结构形式有哪些?7、什么是感知器?8、神经网络的基本属性是什么?9、试画出BP网络的结构图,并说明其特点。

10、给出典型的神经元模型。

11、人工神经网络有哪些学习方法?简述之。

12、试画出5输入、3个输出、蕴含层有10个神经元的3层BP网络,并说明BP 网络的优点。

13、BP基本算法的优缺点。

14、人工神经元网络的拓扑结构主要有哪几种?15、BP基本算法的优缺点。

1617、试论述对BP181920212223并适合什么样的网29、反馈神经网络的拓扑结构有什么特点?哪些神经网络属于反馈神经网络?30、什么是神经网络控制?其基本思想是什么?31、神经网络控制系统可以分为哪几类?举例说明三种神经网络控制系统的结构。

人工神经网络原理第6章习题参考答案

1.随机型神经网络的特点是什么?(1) 神经元的净输入不能决定其输出状态为0或1,决定神经元输出状态的是值为1或0的概率;(2) 在网络学习阶段,随机型神经网络并不基于某种确定性算法调整网络连接权值,而是按照某种概率分布进行处理;(3) 在网络运行阶段,随机型神经网络不是按照某种确定性的网络方程进行状态演变,而是按照某种概率分布决定网络状态的转移。

2.试述Boltzmann机的特点,并比较其与离散型Hopfield网络的异同。

从网络结构看,与离散型Hopfield神经网络相同的是,Boltzmann机网络为单层全互连结构,各个神经元之间采用双向对称连接方式,并且每个神经元到自身都无反馈;但与离散型Hopfield神经网络不同的是,Boltzmann机同时又考虑到了多层网络的特点,将神经元按照功能分为可视层与隐含层两大部分,其中的可视层又可以继续分为输入部分和输出部分,但是这些层次在Boltzmann机中并没有明显的划分界限。

从处理单元模型看,Boltzmann机网络的每个神经元的输出均为0、1二值离散输出,n 个神经元的状态集合构成了Boltzmann机网络的状态,即在给定时刻t,Boltzmann机网络的状态为X(t)=(x1, x2, …, x n),但与离散型Hopfield神经网络不同的是,Boltzmann机中的神经元不能通过其输入状态获得确定的输出状态,它的输出状态要由神经元净输入状态的概率决定,不同的净输入状态对应不同的输出状态概率。

从能量函数看,随着Boltzmann机的运行,从概率意义上说,网络的能量呈下降趋势。

这意味着在网络状态的演化过程中,尽管网络能量总的变化趋势是下降的,但不能排除在某一时刻某个神经元按照小概率事件进行状态变化,从而使网络的能量暂时上升;而随着离散型Hopfield神经网络的运行,王的能量是单调递减的。

3.为什么Boltzmann机可以避免陷入局部极小点?Boltzmann机的网络能量在概率意义上呈单调下降趋势,即在网络状态变化过程中,网络能量总的趋势是下降的,但也存在能量暂时上升的可能性,这种可能性使得Boltzmann机具有了跳出局部极小点的能力。

人工神经网络ppt课件

人工神经网络ppt课件

感知器

• 一种类型的ANN系统是以感知器为基础

• 感知器以一个实数值向量作为输入,计 算这些输入的线性组合,如果结果大于 某个阈值,就输出1,否则输出-1

o(x1,..xn .), 11w 0w 1o x1 t.h..ew nrxnw 0ise

其 值 率中,。每用特个来别w决地i是定 ,一输-w个入0是实xi阈对数值感常。知量器,输或出叫的做贡权献

• 算法的一种常用改进方法是随着梯度下降步数 的增加逐渐减小学习速率

2019.12.18

机器学习-人工神经网络 作者:Mitchell 译者:曾华军等 讲者:陶晓鹏

26

梯度下降的随机近似

• 梯度下降是一种重要的通用学习范型,它是搜 索庞大假设空间或无限假设空间一种策略

• 梯度下降应用于满足以下条件的任何情况

2019.12.18

机器学习-人工神经网络 作者:Mitchell 译者:曾华军等 讲者:陶晓鹏

33

可微阈值单元

• 使用什么类型的单元来构建多层网络?

• 多个线性单元的连接仍产生线性函数,而我们 希望构建表征非线性函数的网络

Байду номын сангаас

• 感知器单元可以构建非线性函数,但它的不连 续阈值使它不可微,不适合梯度下降算法

2019.12.18

机器学习-人工神经网络 作者:Mitchell 译者:曾华军等 讲者:陶晓鹏

25

梯度下降法则的推导(4)

• 梯度下降算法如下

– 选取一个初始的随机权向量 – 应用线性单元到所有的训练样例,根据公式4.7计算

每个权值的w 更新权值

• 因为误差曲面仅包含一个全局的最小值,所以 无论训练样例是否线性可分,算法都会收敛到 具有最小误差的权向量,条件是使用足够小的 学习速率

人工神经网络基础_ANN课件 第六章

实际上,在整个降温的过程中,各个粒子都可能经历了由高 能态向低能态、有时又暂时由低能态向高能态最终趋向低能 态的变化过程。

烈的自由运动;

当温度降低时,PHi(1)曲线变陡. PHi(1)相对于Hi的变化相当 敏感。当 时,曲线退化为一阶跃函数,则算法也从模拟退 火算法过渡到Hopfield算法。

可以说:Hopfield算法是模拟退火算法在 特例。

时的

反复进行网络的状态更新,且更新次数N足够大以 后,网络某状态出现的概率将服从分布:

但是如果开始就以T=0进行状态更新,则网络状态很可能陷

入局部极小点。因此需采用逐渐降温法实现状态更新,而且

只有降温速度合适才能保证网络状态收敛于全局最小点。

现己证明:按所示降温方案.能够保证网络收敛于全局最小

值。但用此方法也存在着一个很大缺陷,即网络的收敛时间 太长。为此,也可用下式所示方法实施降温:

上式表明:在模拟退火算法中,某神经元的输出不 象Hopfield算法中那样,是由以内部状态Hi为输入的 非线性函数的输出(阶跃函数)所决定的,而是由Hi

为变量的概率PHi(1)或PHi(0)所决定的。不同的Hi,对

应不同的概率PHi(1)或PHi(0)来决定输出为兴奋或者抑 制的。

将Hopfield网络能量函数的变化式重写:

第六章 随机型神经网络

6.1 随机型神经网络的基本思想 6.2 模拟退火算法 6.3 Boltzmann机与Boltzmann机工作规则 6.4 Boltzmann机学习规则 6.5 网络小结

[课件]湘潭大学 人工智能 神经网络系统PPT

轴突:输出信号

突触:与另一个神经元相联系的特殊部位

神经网络

生物神经网络

神经元的基本工作机制(简化):

一个神经元有两种状态:兴奋和抑制; 平时处于抑制状态的神经元,其树突和胞体接收其他 神经元由突触传来的兴奋电位,多个输入在神经元中 以代数和的方式叠加; 如果输入兴奋电位总量超过某个阈值,神经元会被激 发进入兴奋状态,发出输出脉冲,并由突触传递给其 他神经元。 神经元被触发后进入不应期,在不应期不能被触发, 然后阈值逐渐下降,恢复兴奋性。

进化计算:是一种对人类智能的演化模拟方法,它

是通过对生物遗传和演化过程的认识,用进化算法去 模拟人类智能的进化规律的。

模糊计算:是一种对人类智能的逻辑模拟方法,它

是通过对人类处理模糊现象的认知能力的认识,用模 糊逻辑去模拟人类的智能行为的。

神经网络

人工神经网络( ANN)是反映人脑结构及功能的 一种抽象数学模型,是由大量神经元节点互连而 成的复杂网络,用以模拟人类进行知识的表示与 存储以及利用知识进行推理的行为。

适应与集成:自适应和信息融合能力;

硬件实现:快速和大规模处理能力。

神经网络

生物神经系统是人工神经网络的基础。人工神经网络是对人脑神经 系统的简化、抽象和模拟,具有人脑功能的许多基本特征。

1. 生物神经系统简介

2. 人工神经网络简介

神经网络

生物神经网络

神经元结构包括四个部分:

胞体:神经细胞的本体,维持细胞生存功能 树突:接收来自其他神经元的信号(输入)

简单地讲,它是一个数学模型,可以用电子线路 来实现,也可以用计算机程序来模 为: 物理结构,计算模拟,存储与操作,训练

人工神经网络的发展

18第六章 人工神经网络

故有 w1' + w2' = −θ

w1'

−

w2'

−θ

>

0, (如取

1 2

)

− w1'

+

w2'

−θ

>

0, (如取

1 2

)

因此 − 2θ = 1

θ

=

−

1 2

,

w1'

=

w2'

=

1 4

1/4

o1

1

-1

1

x

z Θ=-1/2

1/4 o2 -1

y

从而

z

=

sign(

1 4

sign(− x

+

y

−

1 2

)

+

1 4

sign( x

Sign(x)

1

0

x

-1

1 - 15

计算智能 李翠华 教授, 曲延云 博士

功能函数f

Sigmoid函数模型

th(u/u0) 1

y(t

+ 1)

=

⎧ th⎨

1

[WX

(t)

−θ

]⎬⎫

⎩u0

ห้องสมุดไป่ตู้

⎭

u0

u

-1

这里的f(u) = th(u/u0)称为Sigmoid函数,也称为S型函数,

u0为陡度参数。有时也用下列形式的Sigmoid函数:

A0 (0, 0)

B1 (1, 0) x

1 - 21

计算智能 李翠华 教授, 曲延云 博士

如果用单层感知器(神经元)来模拟,则有

多传感器数据智能融合理论与应用 第6章 神经网络与多传感器数据融合

多传感器数据智能融合

27

3 BP神经网络与多传感器数据融合算法

多传感器数据智能融合

28

3 BP神经网络与多传感器数据融合算法

■融合算法的卡尔曼滤波公式如下所示

其中

为新的踪算法的 加速度方差。

即为系统的经过神经网络融合 后的最终输出滤波值

多传感器数据智能融合

29

4 Hopfield神经网络原理及应用

■1986年美国物理学家J. J. Hopfield利用非线性动力学系统理论 中的能量函数方法研究反馈人工神经网络的稳定性,提出了 Hopfield神经网络,并建立了求解优化计算问题的方程。

■基本的Hopfield神经网络是一个由非线性元件构成的全连接型 单层反馈系统,Hopfield网络中的每一个神经元都将自己的输 出通过连接权传送给所有其它神经元,同时又都接收所有其 它神经元传递过来的信息。Hopfield神经网络是一个反馈型神 经网络,网络中的神经元在时刻的输出状态实际上间接地与 自己的时刻的输出状态有关。

同时,相应的神经网络学术会议和神经网络学术刊 物的大量出现,给神经网络的研究者们提供了许多讨论 交流的机会。

多传感器数据智能融合

9

1 人工神经网络简介

虽然人们已对神经网络在人工智能领域的研究达成了 共识,对其巨大潜力也毋庸置疑,但是须知,人类对自身 大脑的研究,尤其是对其中智能信息处理机制的了解,还 十分肤浅。因而现有的研究成果仅仅处于起步阶段,还需 许多有识之士长期的艰苦努力。

多传感器数据智能融合

8

1 人工神经网络简介

再认识和应用研究期(1991~)

许多具备不同信息处理能力的神经网络已被提出来 并应用于许多信息处理领域,如模式识别、自动控制、 信号处理、决策辅助、人工智能等方面。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

2013-7-5 9

算法6-1 基本统计训练算法

ቤተ መጻሕፍቲ ባይዱ• 局部极小点

– 当E′<E不成立时,考虑使网络从局部极小点中 逃离出来,必须允许目标函数暂时变坏

• 循环控制

– 判断标准 – 用一个样本对网络的某一个联接权进行修改后, 是随机地抽取另一个联接权进行重复,还是再 选择下一个样本进行重复 – 对一个选定的样本,每次是否可以选取若干个 联接权进行修改?如果可以,还应做什么工作?

1 1 ( lim ) kT T 0 exp(E1 E 2) 0

2013-7-5

17

能量与温度

低温情况下: T非常小,E的大小对P(E) 的影响非常大 , 设E1>E2 P(E2) >> P(E1)。即,当温度趋近于0时, 系统几乎不可能处于高能量状态

2013-7-5

4

6.1 基本的非确定训练算法

• 基本数据结构 – 样本集:S={ (X1,Y1),(X2,Y2),…,(Xs,Ys)} – 输入向量:X=(x1,x2,…,xn) – 理想输出向量:Y=(y1,y2,…,ym) – L层: W(1) ,W(2) ,…,W(L)

2013-7-5

5

6.1 基本的非确定训练算法

2013-7-5

23

算法6-2 模拟退火算法

2.7 用{ wij(p) +Δwij(p) }代替{ wij(p) }; 2.8 if 样本集中还有未被选用的样本 then 转 2.1; 3 判断在此温度下,检验Metropolis抽样是否 稳定。如不稳定,则直接转2; 4 降低温度T; 5 如果T足够小,则结束,否则,转2。

第6章 非确定方法

6.1 6.2 6.3 6.4 基本的非确定训练算法 模拟退火算法 Cauchy训练 相关的几个问题

2013-7-5

2

第6章 非确定方法

• 确定的方法

– 前几章所给方法的共同特征

• 非确定的方法

– 生物神经网络按照概率运行

• 别称

– 统计方法(Statistical Method)。

• 调整量Δwij(p)的计算

– 可以根据Boltzmann分布或者Gaussian分布来 计算。也可以用其它的方法。下面讨论按 Gaussian分布进行计算的方法。我们取如下形 式的Gaussian分布函数。简洁起见,用符号w 代替符号wij(p): p(Δw)=

w exp( 2 ) T

2

2013-7-5

• 拓扑结构

x1

W(1)

W(2)

W(L)

o1

x2

o2

…

…

…

…

…

…

…

xn 输入层

2013-7-5

om

隐藏层 输出层

6

算法6-1 基本统计训练算法

从样本集S中取一样本(X,Y); 将X输入到网络中,计算出实际输出O; 求出网络关于Y,O的误差测度E; 随机地从W(1) ,W(2) ,…,W(L)中选择一 个联接权wij(p); 5 生成一个小随机数Δwij(p); 6 用Δwij(p)修改wij(p); 1 2 3 4

2013-7-5 8

算法6-1 基本统计训练算法

• 目标函数(Objective Function)

– 误差测度函数:实际输出与理想输出方差和

• 计算量

– 从W(1) ,W(2) ,…,W(L)中随机地选择wij – 共有n×H1+H1×H2+H2×H3+…+HM-1×m个 “变量”可供选择

• 伪随机数

2013-7-5

T0 T log( t ) 1

25

算法6-2 模拟退火算法

• T的初值T0 – T0= E({w (h) });即:取初始系统目标函数 (能量)的值 – T0=z E({w (h) })。即:取初始系统目标函 数(能量)值的若干倍 – 按照经验给出

2013-7-5

26

算法6-2 模拟退火算法

16

能量与温度

E1 ) exp( P ( E1) kT lim lim T 0 P ( E 2) T 0 E2 ) exp( kT E1 E 2 lim exp(( )) T 0 kT kT E1 E 2 lim exp( ) T 0 kT

13

步长和能量、温度的关系

目标函数的值 训练 大 大步长 小 小步长 高 可逃离 低 难逃离 网络的能量

步长与能量相关

步长与能量和温度相关 能量与温度相关

金属热加工

低能量 原子运动平稳 原子激烈随机运动 高温 低温 降温过程

14

高能量

2013-7-5

能量与温度

E lim exp( ) 1 T kT

18

模拟退火组合优化法

• 目标函数——能量函数 • 人工温度T——一个初值较大的数 • 依据网络的能量和温度来决定联接权的调 整量(称为步长)。 • 与金属的退火过程(Annealing)非常相似

2013-7-5

19

模拟退火组合优化法

• 基本思想

– 随机地为系统选择一个初始状态{wij(p)},在此 初始状态下,给系统一个小的随机扰动Δwij(p), 计算系统的能量变化 – ΔE=E({wij(p)+Δwij(p)})-E({wij(p)}) – 若 ΔE<0 则接受 E – 若ΔE≥0 则依据概率 exp kT 判断是否被接受 – 若 接 受 , 则 系 统 从 状 态 {wij(p)} 变 换 到 状 态 {wij(p)+Δwij(p)};否则,系统保持不变

2013-7-5 20

模拟退火组合优化法

– 在这个过程中,逐渐地降低温度T。所得的系 统状态序列{wij(p) }将满足下列分布

( E ({wijp ) }) f c(T ) exp kT

c( T ) exp(

2013-7-5

1 (p) E({w ij }) kT

2013-7-5 24

算法6-2 模拟退火算法

• 算法的第2步原则上应该对每一个样本调整 每一个权,调整的顺序是随机的; • 温度T的降低

– T=λT – λ叫做冷却率,一般情况下可以在[0.8,0.9]之 间取值 – Geman(1984年):温度下降必须与时间的对数 成反比,网络最终才能收敛到全局极小点

2013-7-5 31

Cauchy分布函数积分运算

w 0

T p( x )dx dx 2 2 T x 1 w T 0 dx 2 2 T x

w 0

x 1 T arct g T 0 T w arct g T

2013-7-5

w

32

Cauchy分布函数积分运算

2013-7-5 10

逃离局部极小点

D

• 联接权修改量

A

– 太小:落到A点后很难逃离 – 太大:导致在A、B两点来回抖动

B

• 解决办法

– 控制联接权修改量的大小:权修改量由大变小 – 允许暂时变坏

• 修改量的大小和网络的“能量”相关

– 模拟退火

2013-7-5 11

逃离局部极小点

D

A B

2013-7-5

2013-7-5

29

6.3 Cauchy训练

• Boltzmann分布 • Boltzmann训练 • 1987年,S. Szu和R. Hartley提出用Cauchy 分布去取代Gaussian分布 Cauchy分布 p(x)=

T T 2 x2

2013-7-5

30

6.3 Cauchy训练——优点

12

6.2 模拟退火算法

• 金属中原子的能量与温度有关 • 原子能量高的时候,有能力摆脱其原来的 能量状态而最后达到一个更加稳定的状 态——全局极小能量状态 • 在金属的退火过程中,能量的状态分布

E P(E)∝ exp kT

2013-7-5

P(E)——系统处于具有能量E 的状态的概率; k——Boltzmann常数; T——系统的绝对温度(Kelvin)

• 对于[C1,CN]中的任意一个C,它按照 Cauchy分布所能取到的联接权的调整量要 大于按照Boltzmann分布所能取到的联接权 的调整量 • 用Cauchy分布取代Boltzmann分布后,温 度可以下降得更快。这时,温度的下降变 得与时间成反比 :T0/(1+t) • Cauchy分布函数可以用常规的方法进行积 分运算

• 既可以用于训练,又可以用于运行

2013-7-5 3

6.1 基本的非确定训练算法

• 基本思想 – 从所给的网络中“随机地选取一个联接 权”,对该联接权提出一个“伪随机调 整量”,当用此调整量对所选的联接权 进行修改后,如果“被认为”修改改进 了网络的性能,则保留此调整;否则放 弃本次调整。

2013-7-5

第6章 非确定方法

• 主要内容:

– 统计网络的基本训练算法 – 模拟退火算法与收敛分析 – Cauchy训练 – 人工热与临界温度在训练中的使用 –BP算法与Cauchy训练的结合。

• 重点:统计网络的基本训练算法,BP算法 与Cauchy训练的结合 • 难点:模拟退火算法与收敛分析

2013-7-5 1

27

Monte Carlo法

• 数值积分法

– 根据网络的精度要求,设一个积分步长δ,然 后通过数值积分构造出如下形式的表格

Δw δ

C1

2δ

C2

3δ

C3

4δ

C4

…