聚类分析算法解析.doc

聚类分析算法解析

一、不相似矩阵计算

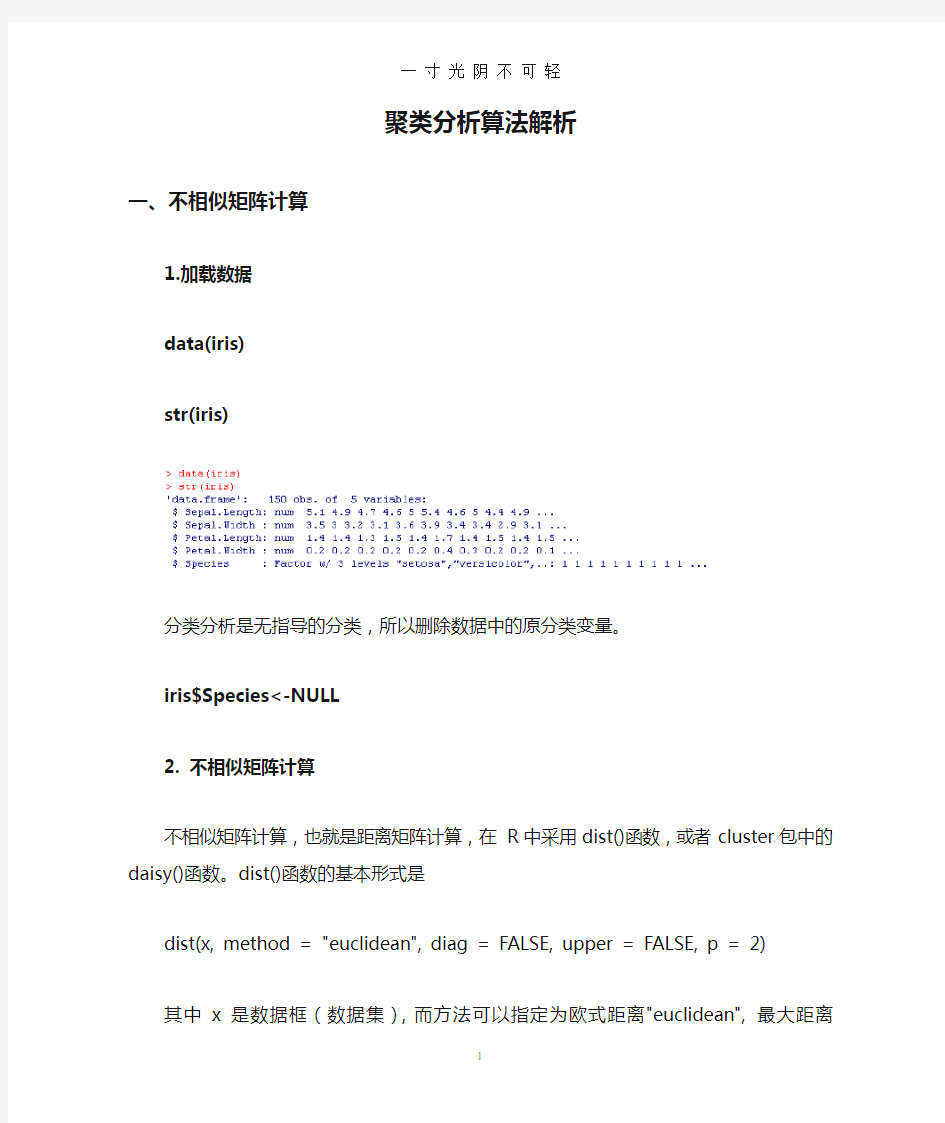

1.加载数据

data(iris)

str(iris)

分类分析是无指导的分类,所以删除数据中的原分类变量。

iris$Species<-NULL

2. 不相似矩阵计算

不相似矩阵计算,也就是距离矩阵计算,在R中采用dist()函数,或者cluster包中的daisy()函数。dist()函数的基本形式是

dist(x, method = "euclidean", diag = FALSE, upper = FALSE, p = 2)

其中x是数据框(数据集),而方法可以指定为欧式距离"euclidean", 最大距离"maximum", 绝对值距离"manhattan", "canberra", 二进制距离非对称"binary" 和明氏距离"minkowski"。默认是计算欧式距离,所有的属性必须是相同的类型。比如都是连续类型,或者都是二值类型。

dd<-dist(iris)

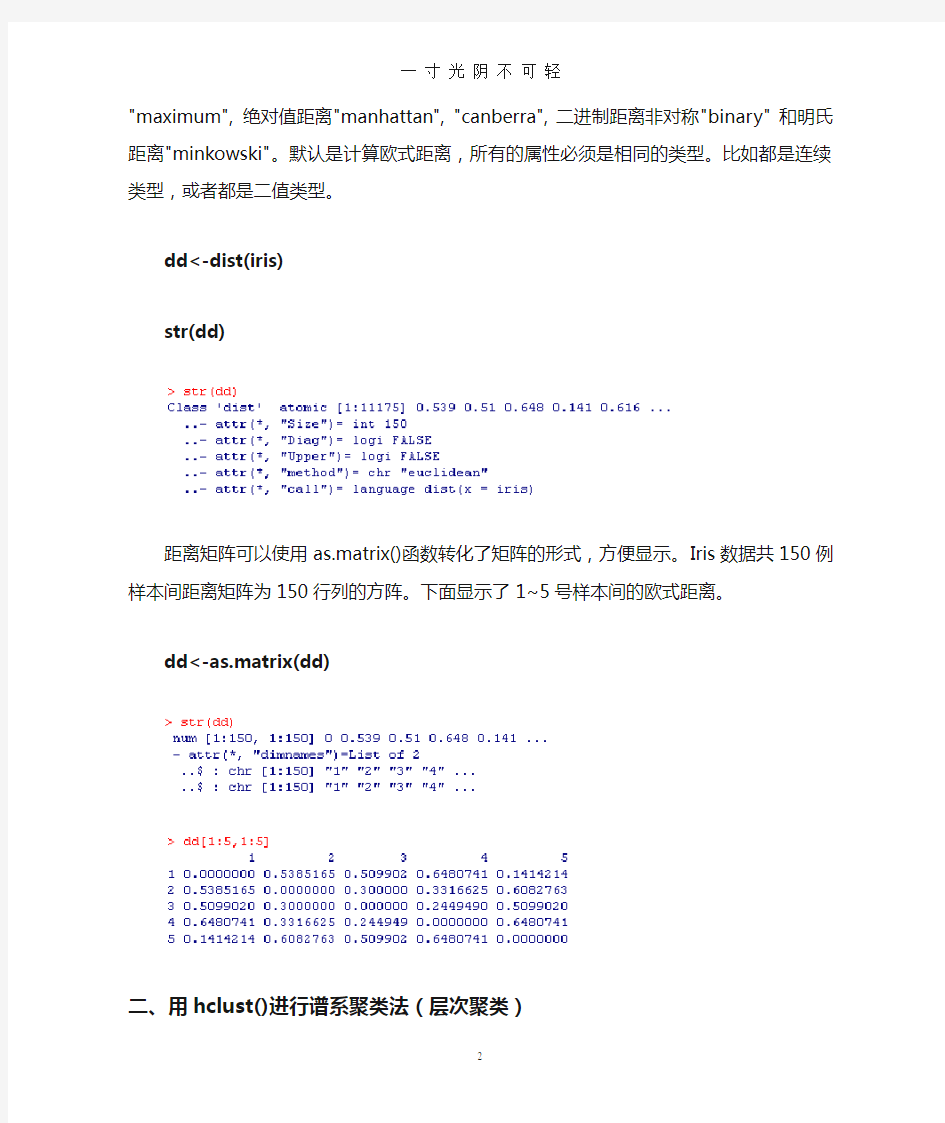

str(dd)

距离矩阵可以使用as.matrix()函数转化了矩阵的形式,方便显示。Iris数据共150例样本间距离矩阵为150行列的方阵。下面显示了1~5号样本间的欧式距离。

dd<-as.matrix(dd)

二、用hclust()进行谱系聚类法(层次聚类)

1.聚类函数

R中自带的聚类函数是hclust(),为谱系聚类法。基本的函数指令是

结果对象 <- hclust(距离对象, method=方法)

hclust()可以使用的类间距离计算方法包含离差法"ward",最短距离法"single",最大距离法"complete",平均距离法"average","mcquitty",中位数法 "median" 和重心法"centroid"。下面采用平均距离法聚类。

hc <- hclust(dist(iris), method="ave")

2.聚类函数的结果

聚类结果对象包含很多聚类分析的结果,可以使用数据分量的方法列出相应的计算结果。

str(hc)

下面列出了聚类结果对象hc包含的merge和height结果值的前6个。其行编号表示聚类过程的步骤,X1,X2表示在该步合并的两类,该编号为负代表原始的样本序号,编号为正代表新合成的类;变量height表示合并时两类类间距离。比如第1步,合并的是样本102和143,其样本间距离是0.0,合并后的类则使用该步的步数编号代表,即样本-102和-143合并为1类。再如第6行表示样本11和49合并,该两个样本的类间距离是0.1,合并后的类称为6类。

head (hc$merge,hc$height)

下面显示的聚类结果对象hc包含的merge和height结果值的50~55步的结果。第50步结果表明样本43与13类(即第13步的聚类合类结果)合并。所有的类编号负数j表示原数据的样本编号,正数i表示聚类过程的第i步形成的新类。再如54步,表示聚类过程第7步和第37步形成的类合并为新类,新类成为第54类,其类间距离是0.2641715。data.frame(hc$merge,hc$height)[50:55]

3.绘制聚类图

聚类完成后可以使用plot()绘制出聚类的树图。

plot(hc, hang = -1, labels=iris$Species)

4.指定分类和类中心聚类

通过观察树形图,可见由于数据例很多,使图形很乱,不容易确定合理的分类,为简化图形,使用cutree()来确定最初的分类结果,先初步确定各个样本的最初分类的类数后,然后用hclust()再次聚类,重新聚类后,得出最后的分类结果。

memb <- cutree(hc, k = 10) #确定10个分类

table(memb) #各类中的样本数

为了进行重新聚类,需要计算各类的类中心的类中心,这里用各类的均向量来代表各类的类中心,计算程序如下。

cent <- NULL

for(k in 1:10){

cent <- rbind(cent, colMeans(irisSample[memb == k, , drop = FALSE]))

}

有了各类的类中心后,再次使用hclust()函数,从10类起重新开始聚类。hclust()函数这时需要指定各类的类中心,并采用中心法来聚类。

hc1 <- hclust(dist(cent), method = "centroid", members = table(memb))

plot(hc1)

hc1

再次聚类的树形图就很精简了。从树形图上看,确定为三类是比较合适的。

4.输出最终分类结果

使用cutree()来确定输出各个样本的最后分类。

memb <- cutree(hc, k =3 #确定3个分类

table(memb) #各类中的样本数

下面将聚类结果和原始的分类比较可见聚类结果是不错的。错误率约为14/150=9.33%。

5.直接数据距离阵聚类

可以直接输入距离矩阵,然后用as.dist()函数转为hclust()可以使用的距离阵对象,然后再用hclust()再进行聚类分析。

x<-read.table(text="

id BA FI MI VO RM TO

BA 0 662 877 255 412 996

FI 662 0 295 468 268 400

MI 877 295 0 754 564 138

VO 255 468 754 0 219 869

RM 412 268 564 219 0 669

TO 996 400 138 869 669 0 ", header=T) https://www.360docs.net/doc/169496409.html,s(x)<-x$id

x$id<-NULL

x

转换为距离阵。

x<-as.dist(x)

hc <-hclust(x)

显示聚类过程。

data.frame(hc$merge,hc$height)

绘制聚类图。

plot(hc2)

从聚类图可见聚为两类比较合适。

cutree(hc2,2)

所以BA、VO、RM聚为1类而TO、FI、MI聚为另一类。

四、使用cluster包进行聚类分析

1.计算距离矩阵

除了可以使用dist()函数外,加载了cluster包后还可以使用daisy()函数,该函数可以使用的数据类型更多一些。当原始数据表中包含的数据是混合型即属性变量既有有连续又有分类的时候,dist()计算就不够完美,而采用daisy()函数就可以毫无问题。使用daisy()必须加载cluster包。第一次使用还必须安装。

install.packages(‘cluster’,repos=’htt//192.168.3.225/rpkg)

library(cluster)

daisy()函数的形式和dist()相似,可以采用的距离包含欧式距离"euclidean", 绝对值距离和"manhattan", "gower"。

dd2<-daisy(iris)

dd2<-as.matrix(dd1)

2.使用agens()聚类

cluster包提供了两种层次聚类的方法,一种是a bottom-up 自底而上,采用先将数据样本先各自看成一类,然后通过合并法的聚类过程,最终形成一个大类,包含全部样本,agnes()函数完成这个功能,这个称为合并层次聚类。而diana()则采用相反的方法,即 a top-down 自顶而下,先将所有样本看成一类,然后通过分裂类的过程将样品最终分为各自样本类,这个称为分裂法。

agens()函数的形式是

agnes(x, diss = TRUE|FALSE, metric = "euclidean", stand = FALSE|TRUE,

method = "average", par.method, keep.diss = n < 100, keep.data = !diss) 其中的diss指定x对象是否是不相似矩阵对象,与hclust()函数不同,agnes()既可以使用原始数据也可以采用距离阵。stand是要求对数据进行标准化,而可以采用的类间距离计算方法有“average”平均法,“UPGMA”,“single”最短距离法,“complete”最大距离法,“ward”离差法,“weighted”权重平均距离法和“flexible”弹性法。keep.diss和keep.data指定在结果中是否保留不相似矩阵和数据,保留这些结果需要更多的内存。

ag <- agnes(iris, diss=F, metric="euclidean", stand=F, method ="single")

data.frame(ag$merge,ag$height)[50:55,]

plot(ag, ask = FALSE, which.plots = NULL)

cutree(ag,k=3)

装载数据

load'adultuci.rdata')

str(AdultUCI)

删除原来的目标变量

AdultUCI$income<-NULL

删除原始据中数据缺失的数据例AdultUCI<-na.omit(AdultUCI)

PAM聚类算法的分析与实现

毕业论文(设计)论文(设计)题目:PAM聚类算法的分析与实现 系别: 专业: 学号: 姓名: 指导教师: 时间:

毕业论文(设计)开题报告 系别:计算机与信息科学系专业:网络工程 学号姓名高华荣 论文(设计)题目PAM聚类算法的分析与实现 命题来源□√教师命题□学生自主命题□教师课题 选题意义(不少于300字): 随着计算机技术、网络技术的迅猛发展与广泛应用,人们面临着日益增多的业务数据,这些数据中往往隐含了大量的不易被人们察觉的宝贵信息,为了得到这些信息,人们想尽了一切办法。数据挖掘技术就是在这种状况下应运而生了。而聚类知识发现是数据挖掘中的一项重要的内容。 在日常生活、生产和科研工作中,经常要对被研究的对象经行分类。而聚类分析就是研究和处理给定对象的分类常用的数学方法。聚类就是将数据对象分组成多个簇,同一个簇中的对象之间具有较高的相似性,而不同簇中的对象具有较大的差异性。 在目前的许多聚类算法中,PAM算法的优势在于:PAM算法比较健壮,对“噪声”和孤立点数据不敏感;由它发现的族与测试数据的输入顺序无关;能够处理不同类型的数据点。 研究综述(前人的研究现状及进展情况,不少于600字): PAM(Partitioning Around Medoid,围绕中心点的划分)算法是是划分算法中一种很重要的算法,有时也称为k-中心点算法,是指用中心点来代表一个簇。PAM算法最早由Kaufman和Rousseevw提出,Medoid的意思就是位于中心位置的对象。PAM算法的目的是对n个数据对象给出k个划分。PAM算法的基本思想:PAM算法的目的是对成员集合D中的N个数据对象给出k个划分,形成k个簇,在每个簇中随机选取1个成员设置为中心点,然后在每一步中,对输入数据集中目前还不是中心点的成员根据其与中心点的相异度或者距离进行逐个比较,看是否可能成为中心点。用簇中的非中心点到簇的中心点的所有距离之和来度量聚类效果,其中成员总是被分配到离自身最近的簇中,以此来提高聚类的质量。 由于PAM算法对小数据集非常有效,但对大的数据集合没有良好的可伸缩性,就出现了结合PAM的CLARA(Cluster LARger Application)算法。CLARA是基于k-中心点类型的算法,能处理更大的数据集合。CLARA先抽取数据集合的多个样本,然后用PAM方法在抽取的样本中寻找最佳的k个中心点,返回最好的聚类结果作为输出。后来又出现了CLARNS(Cluster Larger Application based upon RANdomized

聚类分析算法解析.doc

聚类分析算法解析 一、不相似矩阵计算 1.加载数据 data(iris) str(iris) 分类分析是无指导的分类,所以删除数据中的原分类变量。 iris$Species<-NULL 2. 不相似矩阵计算 不相似矩阵计算,也就是距离矩阵计算,在R中采用dist()函数,或者cluster包中的daisy()函数。dist()函数的基本形式是 dist(x, method = "euclidean", diag = FALSE, upper = FALSE, p = 2) 其中x是数据框(数据集),而方法可以指定为欧式距离"euclidean", 最大距离"maximum", 绝对值距离"manhattan", "canberra", 二进制距离非对称"binary" 和明氏距离"minkowski"。默认是计算欧式距离,所有的属性必须是相同的类型。比如都是连续类型,或者都是二值类型。 dd<-dist(iris) str(dd) 距离矩阵可以使用as.matrix()函数转化了矩阵的形式,方便显示。Iris数据共150例样本间距离矩阵为150行列的方阵。下面显示了1~5号样本间的欧式距离。 dd<-as.matrix(dd)

二、用hclust()进行谱系聚类法(层次聚类) 1.聚类函数 R中自带的聚类函数是hclust(),为谱系聚类法。基本的函数指令是 结果对象 <- hclust(距离对象, method=方法) hclust()可以使用的类间距离计算方法包含离差法"ward",最短距离法"single",最大距离法"complete",平均距离法"average","mcquitty",中位数法 "median" 和重心法"centroid"。下面采用平均距离法聚类。 hc <- hclust(dist(iris), method="ave") 2.聚类函数的结果 聚类结果对象包含很多聚类分析的结果,可以使用数据分量的方法列出相应的计算结果。 str(hc) 下面列出了聚类结果对象hc包含的merge和height结果值的前6个。其行编号表示聚类过程的步骤,X1,X2表示在该步合并的两类,该编号为负代表原始的样本序号,编号为正代表新合成的类;变量height表示合并时两类类间距离。比如第1步,合并的是样本102和143,其样本间距离是0.0,合并后的类则使用该步的步数编号代表,即样本-102和-143合并为1类。再如第6行表示样本11和49合并,该两个样本的类间距离是0.1,合并后的类称为6类。 head (hc$merge,hc$height)

各种聚类算法及改进算法的研究

论文关键词:数据挖掘;聚类算法;聚类分析论文摘要:该文详细阐述了数据挖掘领域的常用聚类算法及改进算法,并比较分析了其优缺点,提出了数据挖掘对聚类的典型要求,指出各自的特点,以便于人们更快、更容易地选择一种聚类算法解决特定问题和对聚类算法作进一步的研究。并给出了相应的算法评价标准、改进建议和聚类分析研究的热点、难点。上述工作将为聚类分析和数据挖掘等研究提供有益的参考。 1 引言随着经济社会和科学技术的高速发展,各行各业积累的数据量急剧增长,如何从海量的数据中提取有用的信息成为当务之急。聚类是将数据划分成群组的过程,即把数据对象分成多个类或簇,在同一个簇中的对象之间具有较高的相似度,而不同簇中的对象差别较大。它对未知数据的划分和分析起着非常有效的作用。通过聚类,能够识别密集和稀疏的区域,发现全局的分布模式,以及数据属性之间的相互关系等。为了找到效率高、通用性强的聚类方法人们从不同角度提出了许多种聚类算法,一般可分为基于层次的,基于划分的,基于密度的,基于网格的和基于模型的五大类。 2 数据挖掘对聚类算法的要求(1)可兼容性:要求聚类算法能够适应并处理属性不同类型的数据。(2)可伸缩性:要求聚类算法对大型数据集和小数据集都适用。(3)对用户专业知识要求最小化。(4)对数据类别簇的包容性:即聚类算法不仅能在用基本几何形式表达的数据上运行得很好,还要在以其他更高维度形式表现的数据上同样也能实现。(5)能有效识别并处理数据库的大量数据中普遍包含的异常值,空缺值或错误的不符合现实的数据。(6)聚类结果既要满足特定约束条件,又要具有良好聚类特性,且不丢失数据的真实信息。(7)可读性和可视性:能利用各种属性如颜色等以直观形式向用户显示数据挖掘的结果。(8)处理噪声数据的能力。(9)算法能否与输入顺序无关。 3 各种聚类算法介绍随着人们对数据挖掘的深入研究和了解,各种聚类算法的改进算法也相继提出,很多新算法在前人提出的算法中做了某些方面的提高和改进,且很多算法是有针对性地为特定的领域而设计。某些算法可能对某类数据在可行性、效率、精度或简单性上具有一定的优越性,但对其它类型的数据或在其他领域应用中则不一定还有优势。所以,我们必须清楚地了解各种算法的优缺点和应用范围,根据实际问题选择合适的算法。 3.1 基于层次的聚类算法基于层次的聚类算法对给定数据对象进行层次上的分解,可分为凝聚算法和分裂算法。 (1)自底向上的凝聚聚类方法。这种策略是以数据对象作为原子类,然后将这些原子类进行聚合。逐步聚合成越来越大的类,直到满足终止条件。凝聚算法的过程为:在初始时,每一个成员都组成一个单独的簇,在以后的迭代过程中,再把那些相互邻近的簇合并成一个簇,直到所有的成员组成一个簇为止。其时间和空间复杂性均为O(n2)。通过凝聚式的方法将两簇合并后,无法再将其分离到之前的状态。在凝聚聚类时,选择合适的类的个数和画出原始数据的图像很重要。 [!--empirenews.page--] (2)自顶向下分裂聚类方法。与凝聚法相反,该法先将所有对象置于一个簇中,然后逐渐细分为越来越小的簇,直到每个对象自成一簇,或者达到了某个终结条件。其主要思想是将那些成员之间不是非常紧密的簇进行分裂。跟凝聚式方法的方向相反,从一个簇出发,一步一步细化。它的优点在于研究者可以把注意力集中在数据的结构上面。一般情况下不使用分裂型方法,因为在较高的层很难进行正确的拆分。 3.2 基于密度的聚类算法很多算法都使用距离来描述数据之间的相似性,但对于非凸数据集,只用距离来描述是不够的。此时可用密度来取代距离描述相似性,即基于密度的聚类算法。它不是基于各种各样的距离,所以能克服基于距离的算法只能发现“类圆形”的聚类的缺点。其指导思想是:只要一个区域中的点的密度(对象或数据点的数目)大过某个阈值,就把它加到与之相近的聚类中去。该法从数据对象的分布密度出发,把密度足够大的区域连接起来,从而可发现任意形状的簇,并可用来过滤“噪声”数据。常见算法有DBSCAN,DENCLUE 等。[1][2][3]下一页 3.3 基于划分的聚类算法给定一个N个对象的元组或数据库,根据给定要创建的划分的数目k,将数据划分为k个组,每个组表示一个簇类(<=N)时满足如下两点:(1)每个组至少包含一个对象;(2)每个对

聚类算法总结

聚类算法的种类:

--------------------------------------------------------- 几种常用的聚类算法从可伸缩性、适合的数据类型、高维性(处理高维数据的能力)、异常数据的抗干扰度、聚类形状和算法效率6个方面进行了综合性能评价,评价结果如表1所示:

--------------------------------------------------------- 目前聚类分析研究的主要内容: 对聚类进行研究是数据挖掘中的一个热门方向,由于以上所介绍的聚类方法都 存在着某些缺点,因此近些年对于聚类分析的研究很多都专注于改进现有的聚 类方法或者是提出一种新的聚类方法。以下将对传统聚类方法中存在的问题以 及人们在这些问题上所做的努力做一个简单的总结: 1 从以上对传统的聚类分析方法所做的总结来看,不管是k-means方法,还是CURE方法,在进行聚类之前都需要用户事先确定要得到的聚类的数目。然而在 现实数据中,聚类的数目是未知的,通常要经过不断的实验来获得合适的聚类 数目,得到较好的聚类结果。 2 传统的聚类方法一般都是适合于某种情况的聚类,没有一种方法能够满足各 种情况下的聚类,比如BIRCH方法对于球状簇有很好的聚类性能,但是对于不 规则的聚类,则不能很好的工作;K-medoids方法不太受孤立点的影响,但是 其计算代价又很大。因此如何解决这个问题成为当前的一个研究热点,有学者 提出将不同的聚类思想进行融合以形成新的聚类算法,从而综合利用不同聚类 算法的优点,在一次聚类过程中综合利用多种聚类方法,能够有效的缓解这个 问题。 3 随着信息时代的到来,对大量的数据进行分析处理是一个很庞大的工作,这 就关系到一个计算效率的问题。有文献提出了一种基于最小生成树的聚类算法,该算法通过逐渐丢弃最长的边来实现聚类结果,当某条边的长度超过了某个阈值,那么更长边就不需要计算而直接丢弃,这样就极大地提高了计算效率,降 低了计算成本。 4 处理大规模数据和高维数据的能力有待于提高。目前许多聚类方法处理小规 模数据和低维数据时性能比较好,但是当数据规模增大,维度升高时,性能就 会急剧下降,比如k-medoids方法处理小规模数据时性能很好,但是随着数据 量增多,效率就逐渐下降,而现实生活中的数据大部分又都属于规模比较大、 维度比较高的数据集。有文献提出了一种在高维空间挖掘映射聚类的方法PCKA (Projected Clustering based on the K-Means Algorithm),它从多个维度中选择属性相关的维度,去除不相关的维度,沿着相关维度进行聚类,以此对 高维数据进行聚类。 5 目前的许多算法都只是理论上的,经常处于某种假设之下,比如聚类能很好 的被分离,没有突出的孤立点等,但是现实数据通常是很复杂的,噪声很大, 因此如何有效的消除噪声的影响,提高处理现实数据的能力还有待进一步的提高。

K-means文本聚类算法

最大距离法选取初始簇中心的K-means文本聚类算法的研究 的评论 背景 随着计算机技术和网络技术的飞速发展,人们的生活方式产生了极大的改变。计算机从一个有几个房子大小的巨无霸,已经变成了小巧的笔记本。网络设备也已经从PC端走向移动端。越来越丰富的网络设备,让人们能在网络里畅游,网络对于人们来说触手可及,同时也产生了巨大的数据流量。人们如何从海量的数据中找到有用的信息,成为了现在计算机学科的研究热点。聚类是数据挖掘中重要的一支。由于聚类具有无需先验知识的优势,可以根据数据自然分部而获取知识。聚类成为数据挖掘领域一个非常活跃的领域,而且得到了广泛的应用。聚类就是把一个数据集合分成几个簇,在同一个簇里,数据相关性最高,但是在2个不同的簇里,数据相关性最低。K-means聚类算法主要针对处理大数据集时,处理快速简单,并且算法具有高效性和可伸缩性。但是,K-means聚类算法随机的选择初始簇中心会导致以下缺点:(1)得到的聚类结果中容易出现局部最优,而不是全局最优;(2)聚类结果不具有稳定性,很大程度上依赖于初始簇中心;(3)聚类过程中的迭代次数增加使聚类过程中的总耗时增加。 传统的k-means聚类算法 传统的聚类算法思想:首先从N个数据对象集合中随机选择k个对象,然后计算剩余的N-k个对象与k个对象的距离(相似度),与k个对象中哪个对象的距离最小,就把分给那个对象;然后在计算每个簇中的簇中心,即是每个簇中对象的均值;不断重复这一过程步骤,直到标准测度函数E开始收敛为止。 K-means算法描述如下: 输入:迭代终止条件ε,最大的迭代次数为max,簇的总数目是k,样本集有N个数据对象。 输出:满足迭代终止条件的k个簇和迭代次数s。 随机初始化k个簇中心: 对每个数据对象,分别计算该对象与k个簇中心均值的距离,并选择距离最小的簇将该对象加个到该簇里; 重新计算k个簇的中心,利用函数E计算出此时的函数值; 如果带到最大迭代次数或满足:

(完整word版)各种聚类算法介绍及对比

一、层次聚类 1、层次聚类的原理及分类 1)层次法(Hierarchical methods)先计算样本之间的距离。每次将距离最近的点合并到同一个类。然后,再计算类与类之间的距离,将距离最近的类合并为一个大类。不停的合并,直到合成了一个类。其中类与类的距离的计算方法有:最短距离法,最长距离法,中间距离法,类平均法等。比如最短距离法,将类与类的距离定义为类与类之间样本的最短距离。 层次聚类算法根据层次分解的顺序分为:自下底向上和自上向下,即凝聚的层次聚类算法和分裂的层次聚类算法(agglomerative和divisive),也可以理解为自下而上法(bottom-up)和自上而下法(top-down)。自下而上法就是一开始每个个体(object)都是一个 类,然后根据linkage寻找同类,最后形成一个“类”。自上而下法就是反过来,一开始所有个体都属于一个“类”,然后根据linkage排除异己,最后每个个体都成为一个“类”。这两种路方法没有孰优孰劣之分,只是在实际应用的时候要根据数据特点以及你想要的“类”的个数,来考虑是自上而下更快还是自下而上更快。至于根据Linkage判断“类” 的方法就是最短距离法、最长距离法、中间距离法、类平均法等等(其中类平均法往往被认为是最常用也最好用的方法,一方面因为其良好的单调性,另一方面因为其空间扩张/浓缩的程度适中)。为弥补分解与合并的不足,层次合并经常要与其它聚类方法相结合,如循环定位。 2)Hierarchical methods中比较新的算法有BIRCH(Balanced Iterative Reducing and Clustering Using Hierarchies利用层次方法的平衡迭代规约和聚类)主要是在数据量很大的时候使用,而且数据类型是numerical。首先利用树的结构对对象集进行划分,然后再利用其它聚类方法对这些聚类进行优化;ROCK(A Hierarchical Clustering Algorithm for Categorical Attributes)主要用在categorical的数据类型上;Chameleon(A Hierarchical Clustering Algorithm Using Dynamic Modeling)里用到的linkage是kNN(k-nearest-neighbor)算法,并以此构建一个graph,Chameleon的聚类效果被认为非常强大,比BIRCH好用,但运算复杂度很高,O(n^2)。 2、层次聚类的流程 凝聚型层次聚类的策略是先将每个对象作为一个簇,然后合并这些原子簇为越来越大的簇,直到所有对象都在一个簇中,或者某个终结条件被满足。绝大多数层次聚类属于凝聚型层次聚类,它们只是在簇间相似度的定义上有所不同。这里给出采用最小距离的凝聚层次聚类算法流程: (1) 将每个对象看作一类,计算两两之间的最小距离; (2) 将距离最小的两个类合并成一个新类; (3) 重新计算新类与所有类之间的距离; (4) 重复(2)、(3),直到所有类最后合并成一类。

聚类分析K-means算法综述

聚类分析K-means算法综述 摘要:介绍K-means聚类算法的概念,初步了解算法的基本步骤,通过对算法缺点的分析,对算法已有的优化方法进行简单分析,以及对算法的应用领域、算法未来的研究方向及应用发展趋势作恰当的介绍。 关键词:K-means聚类算法基本步骤优化方法应用领域研究方向应用发展趋势 算法概述 K-means聚类算法是一种基于质心的划分方法,输入聚类个数k,以及包含n个数据对象的数据库,输出满足方差最小标准的k个聚类。 评定标准:同一聚类中的对象相似度较高;而不同聚类中的对象相似度较小。聚类相似度是利用各聚类中对象的均值所获得一个“中心对象”(引力中心)来进行计算。 解释:基于质心的划分方法就是将簇中的所有对象的平均值看做簇的质心,然后根据一个数据对象与簇质心的距离,再将该对象赋予最近的簇。 k-means 算法基本步骤 (1)从n个数据对象任意选择k 个对象作为初始聚类中心 (2)根据每个聚类对象的均值(中心对象),计算每个对象与这些中心对象的距离;并根据最小距离重新对相应对象进行划分 (3)重新计算每个(有变化)聚类的均值(中心对象) (4)计算标准测度函数,当满足一定条件,如函数收敛时,则算法终止;如果条件不满足则回到步骤(2) 形式化描述 输入:数据集D,划分簇的个数k 输出:k个簇的集合 (1)从数据集D中任意选择k个对象作为初始簇的中心; (2)Repeat (3)For数据集D中每个对象P do (4)计算对象P到k个簇中心的距离 (5)将对象P指派到与其最近(距离最短)的簇;

(6)End For (7)计算每个簇中对象的均值,作为新的簇的中心; (8)Until k个簇的簇中心不再发生变化 对算法已有优化方法的分析 (1)K-means算法中聚类个数K需要预先给定 这个K值的选定是非常难以估计的,很多时候,我们事先并不知道给定的数据集应该分成多少个类别才最合适,这也是K一means算法的一个不足"有的算法是通过类的自动合并和分裂得到较为合理的类型数目k,例如Is0DAIA算法"关于K一means算法中聚类数目K 值的确定,在文献中,根据了方差分析理论,应用混合F统计量来确定最佳分类数,并应用了模糊划分嫡来验证最佳分类数的正确性。在文献中,使用了一种结合全协方差矩阵RPCL算法,并逐步删除那些只包含少量训练数据的类。文献中针对“聚类的有效性问题”提出武汉理工大学硕士学位论文了一种新的有效性指标:V(k km) = Intra(k) + Inter(k) / Inter(k max),其中k max是可聚类的最大数目,目的是选择最佳聚类个数使得有效性指标达到最小。文献中使用的是一种称为次胜者受罚的竞争学习规则来自动决定类的适当数目"它的思想是:对每个输入而言不仅竞争获胜单元的权值被修正以适应输入值,而且对次胜单元采用惩罚的方法使之远离输入值。 (2)算法对初始值的选取依赖性极大以及算法常陷入局部极小解 不同的初始值,结果往往不同。K-means算法首先随机地选取k个点作为初始聚类种子,再利用迭代的重定位技术直到算法收敛。因此,初值的不同可能导致算法聚类效果的不稳定,并且,K-means算法常采用误差平方和准则函数作为聚类准则函数(目标函数)。目标函数往往存在很多个局部极小值,只有一个属于全局最小,由于算法每次开始选取的初始聚类中心落入非凸函数曲面的“位置”往往偏离全局最优解的搜索范围,因此通过迭代运算,目标函数常常达到局部最小,得不到全局最小。对于这个问题的解决,许多算法采用遗传算法(GA),例如文献中采用遗传算法GA进行初始化,以内部聚类准则作为评价指标。 (3)从K-means算法框架可以看出,该算法需要不断地进行样本分类调整,不断地计算调整后的新的聚类中心,因此当数据量非常大时,算法的时间开销是非常大 所以需要对算法的时间复杂度进行分析,改进提高算法应用范围。在文献中从该算法的时间复杂度进行分析考虑,通过一定的相似性准则来去掉聚类中心的候选集,而在文献中,使用的K-meanS算法是对样本数据进行聚类。无论是初始点的选择还是一次迭代完成时对数据的调整,都是建立在随机选取的样本数据的基础之上,这样可以提高算法的收敛速度。

聚类算法分析报告汇总

嵌入式方向工程设计实验报告 学院班级:130712 学生学号:13071219 学生姓名:杨阳 同作者:无 实验日期:2010年12月

聚类算法分析研究 1 实验环境以及所用到的主要软件 Windows Vista NetBeans6.5.1 Weka3.6 MATLAB R2009a 2 实验内容描述 聚类是对数据对象进行划分的一种过程,与分类不同的是,它所划分的类是未知的,故此,这是一个“无指导的学习” 过程,它倾向于数据的自然划分。其中聚类算法常见的有基于层次方法、基于划分方法、基于密度以及网格等方法。本文中对近年来聚类算法的研究现状与新进展进行归纳总结。一方面对近年来提出的较有代表性的聚类算法,从算法思想。关键技术和优缺点等方面进行分析概括;另一方面选择一些典型的聚类算法和一些知名的数据集,主要从正确率和运行效率两个方面进行模拟实验,并分别就同一种聚类算法、不同的数据集以及同一个数据集、不同的聚类算法的聚类情况进行对比分析。最后通过综合上述两方面信息给出聚类分析的研究热点、难点、不足和有待解决的一些问题等。 实验中主要选择了K 均值聚类算法、FCM 模糊聚类算法并以UCI Machine Learning Repository 网站下载的IRIS 和WINE 数据集为基础通过MATLAB 实现对上述算法的实验测试。然后以WINE 数据集在学习了解Weka 软件接口方面的基础后作聚类分析,使用最常见的K 均值(即K-means )聚类算法和FCM 模糊聚类算法。下面简单描述一下K 均值聚类的步骤。 K 均值算法首先随机的指定K 个类中心。然后: (1)将每个实例分配到距它最近的类中心,得到K 个类; (2)计分别计算各类中所有实例的均值,把它们作为各类新的类中心。 重复(1)和(2),直到K 个类中心的位置都固定,类的分配也固定。 在实验过程中通过利用Weka 软件中提供的simpleKmeans (也就是K 均值聚类算法对WINE 数据集进行聚类分析,更深刻的理解k 均值算法,并通过对实验结果进行观察分析,找出实验中所存在的问题。然后再在学习了解Weka 软件接口方面的基础上对Weka 软件进行一定的扩展以加入新的聚类算法来实现基于Weka 平台的聚类分析。 3 实验过程 3.1 K 均值聚类算法 3.1.1 K 均值聚类算法理论 K 均值算法是一种硬划分方法,简单流行但其也存在一些问题诸如其划分结果并不一定完全可信。K 均值算法的划分理论基础是 2 1 min i c k i k A i x v ∈=-∑∑ (1) 其中c 是划分的聚类数,i A 是已经属于第i 类的数据集i v 是相应的点到第i 类的平均距离,即

基于向量空间模型的文本聚类算法

基于向量空间模型的文本聚类算法 转自:https://www.360docs.net/doc/169496409.html,/2009/0910/15270.php 1 文本聚类研究现状 Internet 已经发展为当今世界上最大的信息库和全球范围内传播信息最主要的渠道。随着Internet 的大规模普及和企业信息化程度的提高,各种资源呈爆炸式增长。在中国互联网络信息中心(CNNIC)2007 年1 月最新公布的中国互联网络发展状况统计报告中显示,70.2% 的网络信息均以文本形式体现。对于这种半结构或无结构化数据,如何从中获取特定内容的信息和知识成为摆在人们面前的一道难题。近年来,文本挖掘、信息过滤和信息检索等方面的研究出现了前所未有的高潮。 作为一种无监督的机器学习方法,聚类技术可以将大量文本信息组成少数有意义的簇,并提供导航或浏览机制。 文本聚类的主要应用点包括: (1) 文本聚类可以作为多文档自动文摘等自然语言处理应用的预处理步骤。其中比较典型的例子是哥伦比亚大学开发的多文档自动文摘系统Newsblaster[1] 。该系统将新闻进行 聚类处理,并对同主题文档进行冗余消除、信息融合、文本生成等处理,从而生成一篇简明扼要的摘要文档。 (2) 对搜索引擎返回的结果进行聚类,使用户迅速定位到所需要的信息。比较典型的系统有Infonetware Real Term Search 。Infonetware 具有强大的对搜索结果进行主题分类的功能。另外,由Carrot Search 开发的基于Java 的开源Carrot2 搜索结果聚合聚类引擎2.0 版也是这方面的利用,Carrot2 可以自动把自然的搜索结果归类( 聚合聚类) 到相应的语义类别中,提供基于层级的、同义的以及标签过滤的功能。 (3) 改善文本分类的结果,如俄亥俄州立大学的Y.C.Fang 等人的工作[2] 。 (4) 文档集合的自动整理。如Scatter/Gather[3] ,它是一个基于聚类的文档浏览系统。 2 文本聚类过程 文本聚类主要依据聚类假设:同类的文档相似度较大,非同类的文档相似度较小。作为一种无监督的机器学习方法,聚类由于不需要训练过程、以及不需要预先对文档手工标注类别,因此具有较高的灵活性和自动化处理能力,成为对文本信息进行有效组织、摘要和导航的重要手段。文本聚类的具体过程如图 1 所示。 图 1 文本聚类过程

K-means聚类算法分析应用研究

K-means聚类算法分析应用研究 发表时间:2011-05-09T08:59:20.143Z 来源:《魅力中国》2011年3月上作者:李曼赵松林 [导读] 本文浅谈了数字图像处理的发展概况、研究背景并对彩色图像K-means算法进行分析。 李曼赵松林 (商丘职业技术学院河南商丘,476000) 中图分类号:TP39 文献标识码:A 文章编号:1673-0992(2011)03-0000-01 摘要:本文浅谈了数字图像处理的发展概况、研究背景并对彩色图像K-means算法进行分析.主要详细谈论了是对K-means算法的一些认识,并且介绍K-means聚类的算法思想、工作原理、聚类算法流程、以及对算法结果进行分析,得出其特点及实际使用情况。 关键字:数字图像处理;K-means算法;聚类 一、数字图像处理发展概况及边缘的概念 数字图像处理(Digital Image Processing)即计算机图像处理,就是利用计算机对图像进行去除噪声、增强、复原、分割、特征提取、识别等处理的理论、方法和技术[1]。最早出现于20世纪50年代,它作为一门学科大约形成于20世纪60年代初期。它以改善图像的质量为对象,以改善人的视觉效果为目的。在处理过程中,输入低质量图像,输出质量高图像,图像增强、复原、编码、压缩等都是图像处理常用的方法[1]。数字图像处理在航天、航空、星球探测、通信技术、军事公安、生物工程和医学等领域都有广泛的应用,并取得了巨大的成就。 边缘就是图像中灰度有阶跃变化或屋顶变化的像素的集合,边缘是图像最重要的特征之一,它包含了图像的大部分信息。实质上边缘检测就是采用算法提取图像中对象与背景间的交界线。在目标与背景、目标与目标、区域与区域、基元与基元之间都存在边缘,这是图像分割所依赖的最重要的特征之一。根据灰度变化的剧烈程度,边缘可以分为两种:一种是屋顶边缘,一种为阶跃性边缘。对于屋顶状边缘,二阶导数在边缘初取极值,而对阶跃性边缘,二阶导数在边缘处零交叉;。 二、彩色图像的K-means聚类算法 (一)K-means聚类 聚类就是把数据分成几组,按照定义的测量标准,同组内数据与其他组数据相比具有较强的相似性。K-means聚类就是首先从n个数据对象任选k个对象作为初始聚类中心;剩下的其它对象,则根据它们与这些聚类中心的距离(相似度),分别将它们分配给与其最相似的(聚类中心所代表的)聚类;然后再计算每个所获新聚类的聚类中心(该聚类中所有对象的均值);一直重复此过程直至标准测度函数收敛为止。通常都采用均方差作标准测度函数。k个聚类有以下特点:各聚类本身尽可能的紧凑,而各聚类之间尽可能的分开。 聚类的用途是很广泛的。在商业上,聚类可以帮助市场分析人员从消费者数据库中区分出不同的消费群体来,并且概括出每一类消费者的消费模式或者说习惯。它作为数据挖掘中的一个模块,可以作为一个单独的工具以发现数据库中分布的一些深层的信息,并且概括出每一类的特点,或者把注意力放在某一个特定的类上以作进一步的分析;并且,聚类分析也可以作为数据挖掘算法中其他分析算法的一个预处理步骤。 (二)算法思想分析 输入:聚类个数k,以及包含 n个数据对象的彩色图片。 输出:满足方差最小标准的k个聚类。 处理流程: (1)从 n个数据对象任意选择 k 个对象作为初始聚类中心; (2)根据每个聚类对象的均值(中心对象),计算每个对象与这些中心对象的距离;并根据最小距离重新对相应对象进行划分; (3)重新计算每个(有变化)聚类的均值(中心对象); (4)循环(2)到(3)直到每个聚类不再发生变化为止。 首先设置K值,也就是确定若干个聚类中心。使用rand函数随机获得K个颜色值,存放在矩阵miu中,第一次对每个像素点中的K种颜色进行迭代运算,得到最小的颜色矩阵的2范数,同时标记该颜色,依次相加的到各点的颜色矩阵总值。再次迭代得到K中颜色的各个矩阵均值。最后提取出标记的各个颜色,依次对各个点进行颜色赋值,使每个像素点的颜色归类。得到聚类后的图像。 (三)算法的数学描述 (四)算法过程分析 设置K值为8,读入一幅图片后计算图像上所有的像素点个数为N,即令N=size(X,1)*size(X,2),令颜色矩阵R为矩阵[N,K]并清零。随机获得颜色聚类中心为Miu=fix(255*rand(K,3))。

k-means文本聚类

目录 1 概念及应用背景 (1) 1.1概念 (1) 1.2应用背景................................................................................... 错误!未定义书签。 2 系统设计框架..................................................................................... 错误!未定义书签。 2.1总体框架................................................................................... 错误!未定义书签。 2.2文本聚类的具体过程 (1) 3应用程序具体实现及说明 (3) 3.1获取文档的输入....................................................................... 错误!未定义书签。 3.2提取文档的TF/IDF权重 (3) 3.3 k-means进行数据聚类 (4) 4 实验结果及分析................................................................................. 错误!未定义书签。 4.1实验结果................................................................................... 错误!未定义书签。 4.2结果分析................................................................................... 错误!未定义书签。5结论...................................................................................................... 错误!未定义书签。 5.1实验结论................................................................................... 错误!未定义书签。 5.2个人感受................................................................................... 错误!未定义书签。附录:项目框架和主程序代码............................................................. 错误!未定义书签。

聚类分析法总结

聚类分析法 先用一个例子引出聚类分析 一、聚类分析法的概念 聚类分析又叫群分析、点群分析或者簇分析,是研究多要素事物分类问题的数量,并根据研究对象特征对研究对象进行分类的多元分析技术,它将样本或变量按照亲疏的程度,把性质相近的归为一类,使得同一类中的个体都具有高度的同质性,不同类之间的个体都具有高度的异质性。 聚类分析的基本原理是根据样本自身的属性,用数学方法按照某种相似性或差异性指标,定量地确定样本之间的亲疏关系,并按这种亲疏关系程度对样本进行聚类。 描述亲属程度通常有两种方法:一种是把样本或变量看出那个p维向量,样本点看成P 维空间的一个点,定义点与点之间的距离;另一种是用样本间的相似系数来描述其亲疏程度。有了距离和相似系数就可定量地对样本进行分组,根据分类函数将差异最小的归为一组,组与组之间再按分类函数进一步归类,直到所有样本归为一类为止。 聚类分析根据分类对象的不同分为Q型和R型两类,Q--型聚类是对样本进行分类处理,R--型聚类是对变量进行分类处理。 聚类分析的基本思想是,对于位置类别的样本或变量,依据相应的定义把它们分为若干类,分类过程是一个逐步减少类别的过程,在每一个聚类层次,必须满足“类内差异小,类间差异大”原则,直至归为一类。评价聚类效果的指标一般是方差,距离小的样品所组成的类方差较小。 常见的聚类分析方法有系统聚类法、动态聚类法(逐步聚类法)、有序样本聚类法、图论聚类法和模糊聚类法等。 二、对聚类分析法的评价 聚类分析也是一种分类技术。与多元分析的其他方法相比,该方法较为粗糙,理论上还不完善,但应用方面取得了很大成功。与回归分析、判别分析一起被称为多元分析的三大方法。 聚类的目的:根据已知数据,计算各观察个体或变量之间亲疏关系的统计量(距离或相关系数)。根据某种准则(最短距离法、最长距离法、中间距离法、重心法),使同一类内的

编程实现聚类分析算法

编程实现聚类分析算法 调用函数: min1.m——求矩阵最小值,返回最小值所在行和列以及值的大小 min2.m——比较两数大小,返回较小值 std1.m——用极差标准化法标准化矩阵 ds1.m——用绝对值距离法求距离矩阵 cluster.m——应用最短距离聚类法进行聚类分析 print1.m——调用各子函数,显示聚类结果 聚类分析算法 假设距离矩阵为vector,a阶,矩阵中最大值为max,令矩阵上三角元素等于max 聚类次数=a-1,以下步骤作a-1次循环: (1)求改变后矩阵的阶数,计作c (2)求矩阵最小值,返回最小值所在行e和列f以及值的大小g (3)for l=1:c,为vector(c+1,l)赋值,产生新类 (4)令第c+1列元素,第e行和第f行所有元素为max,第e列和第f列所有元素 为max 5.1源程序 %std1.m,用极差标准化法标准化矩阵 function std=std1(vector) max=max(vector); %对列求最大值 min=min(vector); [a,b]=size(vector); %矩阵大小,a为行数,b为列数 for i=1:a for j=1:b std(i,j)= (vector(i,j)-min(j))/(max(j)-min(j)); end end %ds1.m,用绝对值法求距离 function d=ds1(vector); [a,b]=size(vector); d=zeros(a); for i=1:a for j=1:a for k=1:b d(i,j)=d(i,j)+abs(vector(i,k)-vector(j,k)); end end

聚类算法总结

聚类算法总结 一、概述 聚类,就是把整个数据集分成不同的簇,并且要使簇与簇之间的区别尽可能的大,而簇内的数据的差异尽可能的小。簇是数据样本的集合,聚类分析使得每簇内部的样本之间的相关性比其他簇中样本之间的相关性更紧密,即簇内的任意两个样本之间具有较高的相似度,而属于不同簇的两个样本间具有较高的相异度。相异度可以根据描述样本的属性值来计算,样本间的“距离”是最常采用的度量标准。 聚类分析(Cluster Analysis)又称群分析,是根据“物以类聚”的道理,对样品或指标进行分类的一种多元统计分析方法,同时也是数据挖掘的一个重要算法。通过聚类分析,可以在没有任何模式可供参考或依循,即在没有先验知识的情况下,将大量数据样本按各自的特性来进行合理的分类。 在开始聚类之前,用户并不知道要把数据集分成几个簇,也不知道划分的具体标准,在聚类分析时数据集的特征是未知的,聚类算法的任务正是要发现这些特征,并把具有相同特征的数据样本聚在一起。聚类与分类有相似之处,都是将数据进行分组,但两者又有本质的区别。分类中组(类别)是事先已经定义好的,但聚类中的组(在聚类分析中称为“簇”)不是预先定义的,而是根据实际数据的特征按照数据之间的相似性来定义的。 二、聚类算法的性能评价指标 数据挖掘对聚类的典型要求如下: (1)可伸缩性:当聚类对象由几百上升到几百万,我们希望最后的聚类结果的准确度能一致。 (2)处理不同类型属性的能力:有些聚类算法,其处理对象的属性的数据类型只能为数值类型,但是实际应用场景中,我们往往会遇到其他类型的数据,比如二元数据,分类数据等等。当然,在处理过程我们是可以将这些其他类型的数据预处理成数值型数据的,但是在聚类效率上或者聚类准确度上往往会有折损。 (3)发现任意形状的类簇:因为许多聚类算法是用距离(eg:欧几里得距离或者曼哈顿距离)来量化对象之间的相似度的,基于这种方式,我们往往只能发现相似尺寸和密度的球状类簇或者成为凸形类簇。但是,类簇的形状可能是任意的。 (4)对聚类算法初始化参数的知识需求的最小化:很多算法在分析过程中需要用户提供一定的初始参数,比如期望的类簇个数,类簇初始质点的设定。聚类结果对这些参数是十分敏感的。这不仅加重了用户的负担,也非常影响聚类结果的准确性。 三、聚类算法分类 聚类分析的研究已经有很多年的历史,研究成果主要集中在基于距离和基于相似度的方法上,也产生了大量的聚类算法,大体上,主要的聚类算法可以划分为如下几类:基于划分聚类算法;基于层次聚类算法;基于密度聚类算法;基于网格的聚类算法;基于神经网络的聚类算法;基于统计学的聚类算法以及模糊聚类算法。

基于文本的聚类算法研究本科毕设论文

摘要 聚类作为一种知识发现的重要方法,它广泛地与中文信息处理技术相结合,应用于网络信息处理中以满足用户快捷地从互联网获得自己需要的信息资源。文本聚类是聚类问题在文本挖掘中的有效应用,它根据文本数据的不同特征,按照文本间的相似性,将其分为不同的文本簇。其目的是要使同一类别的文本间的相似度尽可能大,而不同类别的文本间的相似度尽可能的小。整个聚类过程无需指导,事先对数据结构未知,是一种典型的无监督分类。 本文首先介绍了文本聚类的相关的技术,包括文本聚类的过程,文本表示模型,相似度计算及常见聚类算法。本文主要研究的聚类主要方法是k-均值和SOM 算法,介绍了两种算法的基本思想和实现步骤,并分析两种算法的聚类效果。同时介绍了两种算法的改进算法。 关键词:文本聚类聚类方法K-MEAN SOM

Abstract Clustering as an important knowledge discovery method, which extensively with Chinese information processing technology, used in network information processing to meet the users to quickly access from the Internet, the information resources they need. Text clustering is a clustering problem in the effective application of text mining, which according to the different characteristics of text data, according to the similarity between the text, the text will be divided into different clusters. The aim is to make the same class as large as possible the similarity between the text, and different types of text as small as possible the similarity between. The clustering process without guidance, prior to the data structure is unknown, is a typical unsupervised classification. This paper studies the effect of influencing factors that text clustering, text representation of the model such as the Boolean model, vector space model, probabilistic retrieval model and language model. Also studied the analysis of such text clustering algorithm: hierarchical clustering, agglomerative hierarchical clustering algorithm, hierarchical clustering algorithm to split and so on. Also studied the text clustering algorithm analysis and methods of improvement. Key words:Text clustering clustering method k-mean som