多元回归分析法的介绍及具体应用

多元回归分析法的介绍及具体应用

在数量分析中,经常会看到变量与变量之间存在着一定的联系。要了解变量之间如何发生相互影响的,就需要利用相关分析和回归分析。回归分析的主要类型:一元线性回归分析、多元线性回归分析、非线性回归分析、曲线估计、时间序列的曲线估计、含虚拟自变量的回归分析以及逻辑回归分析等。这里主要讲的是多元线性回归分析法。

1. 多元线性回归的定义

说到多元线性回归分析前,首先介绍下医院回归线性分析,一元线性回归分析是在排除其他影响因素或假定其他影响因素确定的条件下,分析某一个因素(自变量)是如何影响另一事物(因变量)的过程,所进行的分析是比较理想化的。其实,在现实社会生活中,任何一个事物(因变量)总是受到其他多种事物(多个自变量)的影响。

一元线性回归分析讨论的回归问题只涉及了一个自变量,但在实际问题中,影响因变量的因素往往有多个。例如,商品的需求除了受自身价格的影响外,还要受到消费者收入、其他商品的价格、消费者偏好等因素的影响;影响水果产量的外界因素有平均气温、平均日照时数、平均湿度等。

因此,在许多场合,仅仅考虑单个变量是不够的,还需要就一个因变量与多个自变量的联系来进行考察,才能获得比较满意的结果。这就产生了测定多因素之间相关关系的问题。

研究在线性相关条件下,两个或两个以上自变量对一个因变量的数量变化关系,称为多元线性回归分析,表现这一数量关系的数学公式,称为多元线性回归模型。

多元线性回归模型是一元线性回归模型的扩展,其基本原理与一元线性回归模型类似,只是在计算上更为复杂,一般需借助计算机来完成。

2. 多元回归线性分析的运用

具体地说,多元线性回归分析主要解决以下几方面的问题。

(1)、确定几个特定的变量之间是否存在相关关系,如果存在的话,找出它

们之间合适的数学表达式;

(2)、根据一个或几个变量的值,预测或控制另一个变量的取值,并且可以知道这种预测或控制能达到什么样的精确度;

(3)、进行因素分析。例如在对于共同影响一个变量的许多变量(因素)之间,找出哪些是重要因素,哪些是次要因素,这些因素之间又有什么关系等等。

3. 多元线性回归分析 3.1多元线性回归分析的原理

回归分析是一种处理变量的统计相关关系的一种数理统计方法。回归分析的基本思想是: 虽然自变量和因变量之间没有严格的、确定性的函数关系,但可以设法找出最能代表它们之间关系的数学表达形式。 3.2多元线性回归模型及其矩阵表示

设y 是一个可观测的随机变量,它受到p 个非随机因索1x ,2x ,…,p x 和随机因素ε的影响,若y 与1x ,2x ,…,p x 有如下线性关系:

ε

βββ++++=p p x x y 110 (1.1)

其中0β,1β,…,p β是1+p 个未知参数,ε是不可测的随机误差,且通常假定

),(20N ~σε.我们称式(1.1)为多元线性回归模型.称y 为被解释变量(因变量),),,2,1(p i x i =为解释变量(自变量).

称

p p x x y E βββ+++= 110)( (1.2)

为理论回归方程.

对于一个实际问题,要建立多元回归方程,首先要估计出未知参数0β,1β, …,p β,为此我们要进行n 次独立观测,得到n 组样本数据);,,,(21i ip i i y x x x ,

n i ,,2,1 =,他们满足式(1.1),即有

??

????

?+++++=+++++=+++++=n

np p n n n p p p p x x x y x x x y x x x y εββββεββββεββββ 221102

2222211021

112211101 (1.3)

其中n εεε,,,21 相互独立且都服从),0(2σN .

式(1.3)又可表示成矩阵形式: εβ+=X Y (1.4) 这里,T n y y y Y ),,,(21 =,T p ),,,(10ββββ =,T n ),,,(21εεεε =,

),0(~2n n I N σε,n I 为n 阶单位矩阵.

??

????

?

????

???=np n n p p x x x x x x

x x x X 2

1

22221

11211

111

)1(+?p n 阶矩阵X 称为资料矩阵或设计矩阵,并假设它是列满秩的,即1)(+=p X rank .

由模型(1.3)以及多元正态分布的性质可知,Y 仍服从n 维正态分布,它的期望向量为βX ,方差和协方差阵为n I 2σ,即),(~2n n I X N Y σβ. 3.3参数的最小二乘估计及其表示

1. 参数的最小二乘估计

与一元线性回归时的一样,多元线性回归方程中的未知参数p βββ,,,10 仍然可用最小二乘法来估计,即我们选择T p ),,,(10ββββ =使误差平方和

∑∑==-----=--===n

i ip p i i i T T n

i i x x x y X Y X Y Q 1

2

221101

2

)()

()(?)(ββββββεεεβ

达到最小.

由于)(βQ 是关于p βββ,,,10 的非负二次函数,因而必定存在最小值,

利用微积分的极值求法,得

???????

?????

???=------=??=------=??=------=??=------=??∑∑∑∑====n i ip

ip p i i i p n i ik ip p i i i k n i i ip p i i i n i ip

p i i i x x x x y Q x x x x y Q x x x x y Q x x x y Q 12211012211011

22110112211000)????(2)

?(0)????(2)?(0)????(2)?(0)????(2)?(ββββββββββββββββββββββββ 这里),,1,0(?p i i =β是),,1,0(p i i =β的最小二乘估计.上述对)(βQ 求偏导,求得正规方程组的过程可用矩阵代数运算进行,得到正规方程组的矩阵表

示:

0)?(=-β

X Y X T 移项得

Y X X X T T =β

? (1.5) 称此方程组为正规方程组.

依据假定1)(+=p X R ,所以1)()(+==p X R X X R T .故1)(-X X T 存在.解正

规方程组(1.5)得

Y X X X T T 1)(?-=β

(1.6)

称p p x x x y ββββ?????22110++++= 为经验回归方程. 2.误差方差2σ的估计

将自变量的各组观测值代入回归方程,可得因变量的估计量(拟合值)为

β?)?,,?,?(?221X y y y Y

p ==

向量Y H I Y X X X X I X Y Y Y e n

T T n )(])([??1-=-=-=-=-β 称为残差向量,其中T T X X X X H 1)(-=为n 阶对称幂等矩阵,n I 为n 阶单位阵.

称数Y X Y Y Y H I Y e e T T T n T T β?)(-=-= 为残差平方和(Error Sum of Squares,简写为SSE ).

由于βX Y E =)(且0)(=-X H I n ,则

)]()[(]})([{)(T n n T T E H I tr H I tr E e e E εεεε

-=-=

])([12T T n X X X X I tr --=σ ]})[({12X X X X tr n T T --=σ

)1(2--=p n σ

从而e e p n T 1

1

?2--=σ

为2σ的一个无偏估计.

3.4 逐步回归

当自变量的个数不多时,利用某种准则,从所有可能的回归模型中寻找最优

回归方程是可行的.但若自变量的数目较多时,求出所有的回归方程式很不容易的.为此,人们提出了一些较为简便实用的快速选择最优方程的方法,我们先根据“前进法”和“后退法”的思想,再详细介绍“逐步回归法”。 1.前进法和后退法

前进法:设所考虑的回归问题中,对因变量y 有影响的自变共有m 个,首先将这m 个自变量分别与y 建立m 个一元线性回归方程,并分别计算出这m 个一元回归方程的偏F 检验值,记为(1)(1)(1)

12{,,

,}m F F F ,若其中偏F 值最大者(为方

便叙述起见,不妨设为(1)1F )所对应的一元线性回归方程都不能通过显著性检验,则可以认为这些自变量不能与y 建立线性回归方程;若该一元方程通过了显著性检验,则首先将变量1x 引入回归方程;接下来由y 与1x 以及其他自变量(1)j x j ≠建立1m -个二元线性回归方程对这1m -个二元回归方程中的23,,,m x x x 的回归

系数做偏F 检验,检验值记为(2)(2)(2)

23{,,

,}m F F F ,

若其中最大者(不妨设为(2)2F )通过了显著性检验,则又将变量2x 引入回归方程,依此方法继续下去,直到所有未被引入方程的自变量的偏F 值都小于显著性检验的临界值,即再也没有自变量能够引入 回归方程为止.得到的回归方程就是最终确定的方程.

后退法:首先用m 个自变量与y 建立一个回归方程,然后在这个方程中剔除一个最不重要的自变量,接着又利用剩下的1m -个自变量与y 建立线性回归方程,再剔除一个最不重要的自变量,依次进行下去,直到没有自变量能够剔除为

止.

前进法和后退法都有其不足,人们为了吸收这两种方法的优点,克服它们的不足,提出了逐步回归法. 2. 逐步回归法

逐步回归法的基本思想是有进有出,具体做法是将变量一个一个得引入,引入变量的条件是通过了偏F 统计量的检验.同时,每引入一个新的变量后,对已入选方程的老变量进行检验,将经检验认为不显著的变量剔除,此过程经过若干步,直到既不能引入新变量,又不能剔除老变量为止.

设模型中已有1l -个自变量,记这1l -个自变量的集合为A ,当不在A 中的一个自变量k x 加入到这个模型中时,偏F 统计量的一般形式为

()

()(,)(,)1(,)

k k k k SSR x A SSE A SSE A x F SSE A x n l MSE A x -=

=

-- (2.1) 如下逐步回归法的具体步骤:

首先,根据一定显著水平,给出偏 统计量的两个临界值,一个用作选取自变量,记为E F ;

另一个用作剔除自变量,记为D F .一般地,取E D F F >,然后按下列步骤进行.

第一步:对每个自变量(1)i x i m ≤≤,拟合m 个一元线性回归模型

0i i y x ββε=++ (2.2)

这时,相当于统计量(2.1)中集合A 为空集,因此,()SSE A SST =,故

()()i i SSR x A SSR x =,(,)()i i MSE A x MSE x =,对每一个i ,计算

(1)()

,1,2,

,MSE()

i i i SSR x F i m x =

= (2.3)

设

11(1)(1)1max{}i i i m

F F ≤≤=

若1(1)i E F F >,则选择含自变量1i x 的回归模型为当前模型,否则,没有自变量

能进入模型,选择过程结束,即认为所有自变量对 的影响均不显著.

第二步:在第一步的选出模型的基础上,再将其余的1m -个自变量分别加入

到此模型中个,得到1m -个二元回归方程,计算

11(2)

1(),MSE(,)

i i i

i i SSR x x F i i x x =

≠ (2.4)

设

21

(2)(2)max{}i i i i F F ≠=

若2(2)i E F F >,则选取过程结束.第一步选择的模型为最优模型.若2(2)i E F F >,

则将自变量2i x 选入模型中,即得第二步的模型

11220i i i i y x x βββε=+++ (2.5)

进一步考察,当2i x 进入模型后,1i x 对y 的影响是否仍然显著.为此计算

121

12(2)

()MSE(,)

i i i i i SSR x x F x x =

(2.6)

若2(2)i D F F ≤ ,则剔除1i x .这时仅含有2i x 的回归模型为当前模型.

第三步:在第二步所选模型的基础上,在将余下的2m -个自变量逐个加入,

拟合各个模型并计算F 统计量值,与E F 比较决定是否有新变量引入,如果有新变量进入模型,还需要检验原模型中的老变量是否因这个新变量的进入而不再显著,那样就应该被剔除.

重复以上步骤,直到没有新的自变量能进入模型,同时在模型之中的老变量

都不能剔除,则结束选择过程,最后一个模型即为所求的最优回归模型。

4. 多元线性回归分析实现过程 多元线性回归分析实现过程如下图:

5. 多元线性回归分析案例

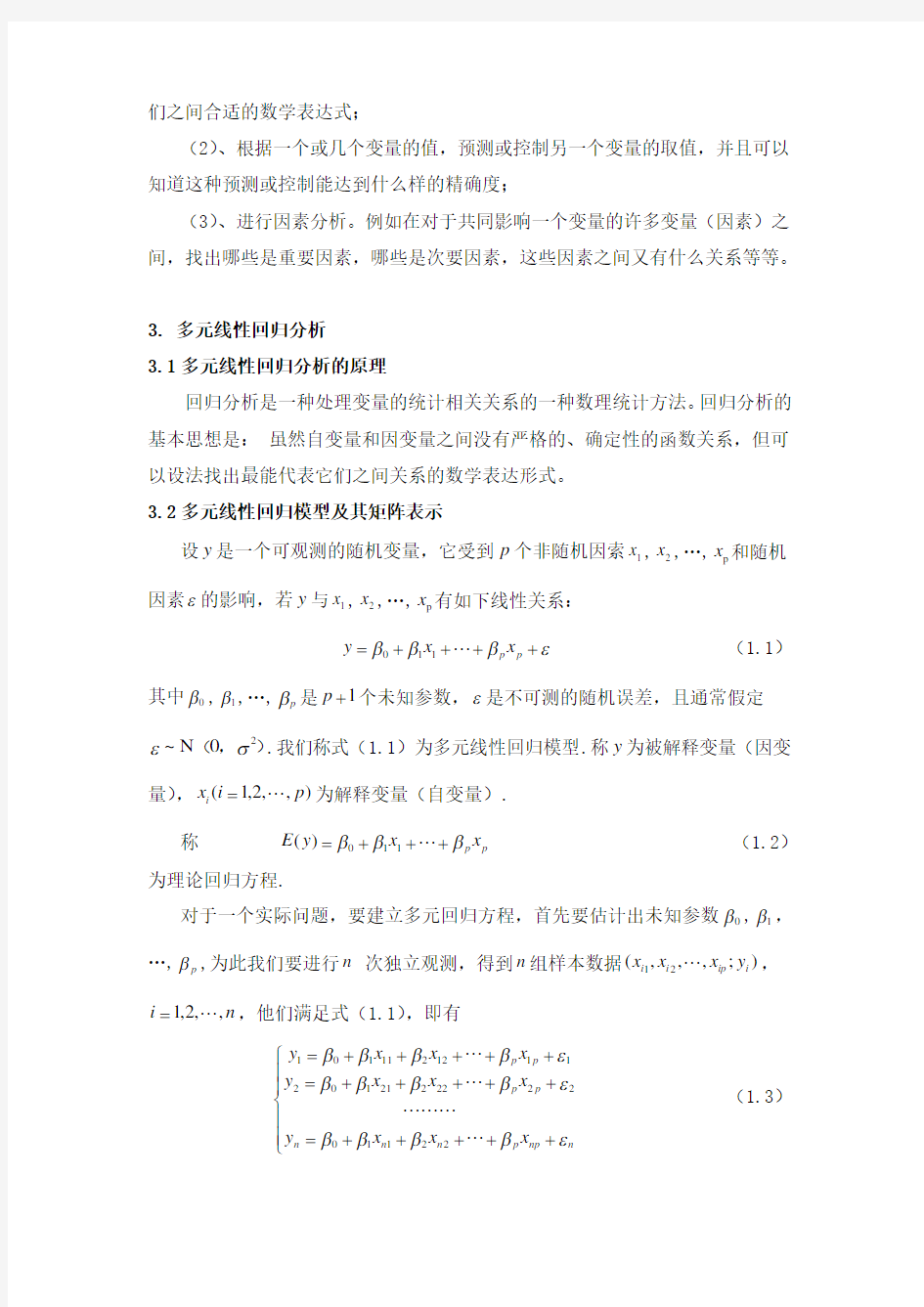

利用多元线性回归分析研究此后影响中国人口自然增长的主要原因,分析全国人口增长规律,与猜测中国未来的增长趋势。

为了全面反映中国“人口自然增长率”的全貌,选择人口自然增长率作为被解释变量,以反映中国人口的增长;选择“国名收入”及“人均GDP ”作为经济整体增长的代表;选择“居民消费价格指数增长率”作为居民消费水平的代表。国名总收入,居民消费价格指数增长率,人均GDP 作为解释变量暂不考虑文化程度及人口分布的影响。

通过对表1的数据进行分析,建立模型。其模型表达式为:

i i i i i u X X X Y ++++=332211ββββ (i=1,2,,3)

其中Y 表示人口自然增长率,X 1 表示国名总收入,X 2表示居民消费价格指数增长率,X 3表示人均GDP ,根据以往经验和对调查资料的初步分析可知,Y 与

建立模型

模型总结

参数估计

方差分析

模型预测

模型检验

X 1,X

2

,X3呈线性关系,因此建立上述三元线性总体回归模型。Xi则表示各解

释变量对税收增长的贡献。μi表示随机误差项。通过上式,我们可以了解到,每个解释变量增长1亿元,粮食总产值会如何变化,从而进行财政收入预测。(如下图表1)

年份人口自然增

长率(%。)Y

国民总收

入(亿元)

X1

居民消费价

格指数增长

率(CPI)%X2

人均GDP

(元)X3

1988 15.73 15037 18.8 1366 1989 15.04 17001 18 1519 1990 14.39 18718 3.1 1644 1991 12.98 21826 3.4 1893 1992 11.6 26937 6.4 2311 1993 11.45 35260 14.7 2998 1994 11.21 48108 24.1 4044 1995 10.55 59811 17.1 5046 1996 10.42 70142 8.3 5846 1997 10.06 78061 2.8 6420 1998 9.14 83024 -0.8 6796 1999 8.18 88479 -1.4 7159 2000 7.58 98000 0.4 7858 2001 6.95 108068 0.7 8622 2002 6.45 119096 -0.8 9398 2003 6.01 135174 1.2 10542 2004 5.87 159587 3.9 12336 2005 5.89 184089 1.8 14040 2006 5.38 213132 1.5 16024 2007 5.24 235367 1.7 17535 2008 5.45 277654 1.9 19264

利用上表中的数据,运用eview 软件,采用最小二乘法,对表中的数据进行线性回归,对所建模型进行估计 从估计结果可得模型:

321005881.0050364.0000392.077177.15?X X X Y -++=

从Y 关于X 1 X 2 X 3的散点图可以看出:Y 和X 1成线性相关关系;Y 和X 2成线性相关关系;Y 和X 3成线性相关关系。

模型估计结果说明,在假定其它变量不变的情况下,当年国民总收入每增长1亿元,人口增长率增长0.000392%;在假定其它变量不变的情况下,当年居民消费价格指数增长率每增长 1%,人口增长率增长0.050364%;在假定其它变量不变的情况下,当年人均GDP 没增加一元,人口增长率就会降低0.005881%。这与理论分析和经验判断相一致。

回归分析方法及其应用中的例子

3.1.2 虚拟变量的应用 例3.1.2.1:为研究美国住房面积的需求,选用3120户家庭为建模样本,回归模型为: 123log log P Y βββ++logQ= 其中:Q ——3120个样本家庭的年住房面积(平方英尺) 横截面数据 P ——家庭所在地的住房单位价格 Y ——家庭收入 经计算:0.247log 0.96log P Y -+logy=4.17 2 0.371R = ()() () 上式中2β=0.247-的价格弹性系数,3β=0.96的收入弹性系数,均符合经济学的常识,即价格上升,住房需求下降,收入上升,住房需求也上升。 但白人家庭与黑人家庭对住房的需求量是不一样的,引进虚拟变量D : 01i D ?=?? 黑人家庭 白人家庭或其他家庭 模型为:112233log log log log D P D P Y D Y βαβαβα+++++logQ= 例3.1.2.2:某省农业生产资料购买力和农民货币收入数据如下:(单位:十亿元) ①根据上述数据建立一元线性回归方程:

? 1.01610.09357y x =+ 20.8821R = 0.2531y S = 67.3266F = ②带虚拟变量的回归模型,因1979年中国农村政策发生重大变化,引入虚拟变量来反映农村政策的变化。 01i D ?=?? 19791979i i <≥年 年 建立回归方程为: ?0.98550.06920.4945y x D =++ ()() () 20.9498R = 0.1751y S = 75.6895F = 虽然上述两个模型都可通过显着性水平检验,但可明显看出带虚拟变量的回归模型其方差解释系数更高,回归的估计误差(y S )更小,说明模型的拟合程度更高,代表性更好。 3.5.4 岭回归的举例说明 企业为用户提供的服务多种多样,那么在这些服务中哪些因素更为重要,各因素之间的重要性差异到底有多大,这些都是满意度研究需要首先解决的问题。国际上比较流行并被实践所验证,比较科学的方法就是利用回归分析确定客户对不同服务因素的需求程度,具体方法如下: 假设某电信运营商的服务界面包括了A1……Am 共M 个界面,那么各界面对总体服务满意度A 的影响可以通过以A 为因变量,以A1……Am 为自变量的回归分析,得出不同界面服务对总体A 的影响系数,从而确定各服务界面对A 的影响大小。 同样,A1服务界面可能会有A11……A1n 共N 个因素的影响,那么利用上述方法也可以计算出A11……A1n 对A1的不同影响系数,由此确定A1界面中的重要因素。 通过两个层次的分析,我们不仅得出各大服务界面对客户总体满意度影响的大小以及不同服务界面上各因素的影响程度,同时也可综合得出某一界面某一因素对总体满意度的影响大小,由此再结合用户满意度评价、与竞争对手的比较等因素来确定每个界面细分因素在以后工作改进中的轻重缓急、重要性差异等,从而起到事半功倍的作用。 例 3.5.4:对某地移动通信公司的服务满意度研究中,利用回归方法分析各服务界面对总体满意度的影响。 a. 直接进入法 显然,这种方法计算的结果中,C 界面不能通过显着性检验,直接利用分析结果是错误

相关分析与回归分析的异同

问:请详细说明相关分析与回归分析的相同与不同之处 相关分析与回归分析都是研究变量相互关系的分析方法,相关分析是回归分析的基础,而回归分析则是认识变量之间相关程度的具体形式。 下面分为三个部分详细描述两种分析方法的异同: 第一部分:相关分析 一、相关的含义与种类 (一)相关的含义 相关是指自然与社会现象等客观现象数量关系的一种表现。 相关关系是指现象之间确实存在的一定的联系,但数量关系表现为不严格相互依存关系。即对一个变量或几个变量定一定值时,另一变量值表现为在一定范围内随机波动,具有非确定性。如:产品销售收入与广告费用之间的关系。 (二)相关的种类 1. 根据自变量的多少划分,可分为单相关和复相关 2. 根据相关关系的方向划分,可分为正相关和负相关 3. 根据变量间相互关系的表现形式划分,线性相关和非线性相关 4.根据相关关系的程度划分,可分为不相关、完全相关和不完全相关 二、相关分析的意义与内容 (一)相关分析的意义 相关分析是研究变量之间关系的紧密程度,并用相关系数或指数来表示。其目的是揭示现象之间是否存在相关关系,确定相关关系的表现形式以及确定现象变量间相关关系的密切程度和方向。 (二)相关分析的内容 1. 明确客观事物之间是否存在相关关系 2. 确定相关关系的性质、方向与密切程度 三、直线相关的测定 (一)相关表与相关图 1. 相关表 在定性判断的基础上,把具有相关关系的两个量的具体数值按照一定顺序平行排列在一张表上,以观察它们之间的相互关系,这种表就称为相关表。 2. 相关图

把相关表上一一对应的具体数值在直角坐标系中用点标出来而形成的散点图则称为相关图。利用相关图和相关表,可以更直观、更形象地表现变量之间的相互关系。 (二)相关系数 1. 相关系数的含义与计算 相关系数是直线相关条件下说明两个变量之间相关关系密切程度的统计分析指标。相关系数的理论公式为: y x xy r δδδ2= (1)xy 2δ 协方差 x δ x 的标准差 y δ y 的标准差 (2)xy 2δ 协方差对相关系数r 的影响,决定:???<>数值的大小正、负)或r r r (00 简化式 ()()2222∑∑∑∑∑∑∑-?--= y y n x x n y x xy n r 变形:分子分母同时除以2 n 得 r =???????????? ??-???????????? ??-?-∑∑∑∑∑∑∑2222n y n y n x n x n y n x n xy =()[]()[]2222y y x x y x xy -*-?-=y x y x xy δδ-?- n x x x ∑-=2)(δ=()[]n x x x x ∑+?-222=()222x n x x n x +??-∑∑ = () 22x x - 2. 相关系数的性质

SPSS多元线性回归分析实例操作步骤

SPSS统计分析 多元线性回归分析方法操作与分析 实验目得: 引入1998~2008年上海市城市人口密度、城市居民人均可支配收入、五年以上平均年贷款利率与房屋空置率作为变量,来研究上海房价得变动因素。 实验变量: 以年份、商品房平均售价(元/平方米)、上海市城市人口密度(人/平方公里)、城市居民人均可支配收入(元)、五年以上平均年贷款利率(%)与房屋空置率(%)作为变量。 实验方法:多元线性回归分析法 软件:spss19、0 操作过程: 第一步:导入Excel数据文件 1.open datadocument——open data——open; 2、Opening excel data source——OK、

第二步: 1、在最上面菜单里面选中Analyze——Regression——Linear ,Dependent(因变量)选择商品房平均售价,Independents(自变量)选择城市人口密度、城市居民人均可支配收入、五年以上平均年贷款利率、房屋空置率;Method选择Stepwise、 进入如下界面: 2、点击右侧Statistics,勾选RegressionCoefficients(回归系数)选项组中得Estimates;勾选Residuals(残差)选项组中得Durbin-Watson、Casewise diagnostics默认;接着选择Model fit、Collinearitydiagnotics;点击Continue、

3、点击右侧Plots,选择*ZPRED(标准化预测值)作为纵轴变量,选择DEPENDNT(因变量)作为横轴变量;勾选选项组中得Standardized Resi dual Plots(标准化残差图)中得Histogram、Normal probability plot;点击Continue、 4、点击右侧Save,勾选Predicted Vaniues(预测值)与Residu als(残差)选项组中得Unstandardized;点击Continue、

回归分析方法

第八章 回归分析方法 当人们对研究对象的内在特性和各因素间的关系有比较充分的认识时,一般用机理分析方法建立数学模型。如果由于客观事物内部规律的复杂性及人们认识程度的限制,无法分析实际对象内在的因果关系,建立合乎机理规律的数学模型,那么通常的办法是搜集大量数据,基于对数据的统计分析去建立模型。本章讨论其中用途非常广泛的一类模型——统计回归模型。回归模型常用来解决预测、控制、生产工艺优化等问题。 变量之间的关系可以分为两类:一类叫确定性关系,也叫函数关系,其特征是:一个变量随着其它变量的确定而确定。另一类关系叫相关关系,变量之间的关系很难用一种精确的方法表示出来。例如,通常人的年龄越大血压越高,但人的年龄和血压之间没有确定的数量关系,人的年龄和血压之间的关系就是相关关系。回归分析就是处理变量之间的相关关系的一种数学方法。其解决问题的大致方法、步骤如下: (1)收集一组包含因变量和自变量的数据; (2)选定因变量和自变量之间的模型,即一个数学式子,利用数据按照最小二乘准则计算模型中的系数; (3)利用统计分析方法对不同的模型进行比较,找出与数据拟合得最好的模型; (4)判断得到的模型是否适合于这组数据; (5)利用模型对因变量作出预测或解释。 应用统计分析特别是多元统计分析方法一般都要处理大量数据,工作量非常大,所以在计算机普及以前,这些方法大都是停留在理论研究上。运用一般计算语言编程也要占用大量时间,而对于经济管理及社会学等对高级编程语言了解不深的人来说要应用这些统计方法更是不可能。MATLAB 等软件的开发和普及大大减少了对计算机编程的要求,使数据分析方法的广泛应用成为可能。MATLAB 统计工具箱几乎包括了数理统计方面主要的概念、理论、方法和算法。运用MATLAB 统计工具箱,我们可以十分方便地在计算机上进行计算,从而进一步加深理解,同时,其强大的图形功能使得概念、过程和结果可以直观地展现在我们面前。本章内容通常先介绍有关回归分析的数学原理,主要说明建模过程中要做的工作及理由,如模型的假设检验、参数估计等,为了把主要精力集中在应用上,我们略去详细而繁杂的理论。在此基础上再介绍在建模过程中如何有效地使用MATLAB 软件。没有学过这部分数学知识的读者可以不深究其数学原理,只要知道回归分析的目的,按照相应方法通过软件显示的图形或计算所得结果表示什么意思,那么,仍然可以学到用回归模型解决实际问题的基本方法。包括:一元线性回归、多元线性回归、非线性回归、逐步回归等方法以及如何利用MATLAB 软件建立初步的数学模型,如何透过输出结果对模型进行分析和改进,回归模型的应用等。 8.1 一元线性回归分析 回归模型可分为线性回归模型和非线性回归模型。非线性回归模型是回归函数关于未知参数具有非线性结构的回归模型。某些非线性回归模型可以化为线性回归模型处理;如果知道函数形式只是要确定其中的参数则是拟合问题,可以使用MATLAB 软件的curvefit 命令或nlinfit 命令拟合得到参数的估计并进行统计分析。本节主要考察线性回归模型。 8.1.1 一元线性回归模型的建立及其MATLAB 实现 其中01ββ,是待定系数,对于不同的,x y 是相互独立的随机变量。 假设对于x 的n 个值i x ,得到 y 的n 个相应的值i y ,确定01ββ,的方法是根据最小二乘准则,要使 取最小值。利用极值必要条件令 01 0,0Q Q ββ??==??,求01ββ,的估计值01??ββ,,从而得到回归直线01 ??y x ββ=+。只不过这个过程可以由软件通过直线拟合完成,而无须进行繁杂的运算。

回归分析方法应用实例

4、回归分析方法应用实例 在制定运动员选材标准时,理论上要求先对不同年龄的运动员,各测试一个较大的样本,然后,计算出各年龄的平均数、标准差,再来制定标准。 但是,在实际工作中,有时某些年龄组不能测到较大的样本。这时能不能使用统计的方法,进行处理呢? 我们遇到一个实例。测得45名11至18岁男田径运动员的立定三级跳远数据。其各年龄组人数分布如表一。由于受到许多客观因素的限制,一时无法再扩大样本,因此决定使用统计方法进行处理。 第一步,首先用原始数据做散点图,并通过添加趋势线,看数据的变化趋势是否符合随年龄增长而变化的趋势,决定能否使用回归方程制定标准。如果趋势线不符合随年龄增长而变化的趋势,或者相关程度很差就不能用了。 本例作出的散点图如图1,图上用一元回归方法添加趋势线,并计算出年龄和立定三级跳远的: 一元回归方程:Y=2.5836+0.3392 X 相关系数 r=0.7945(P<0.01) 由于从趋势线可以看出,立定三级跳远的成绩是随年龄增加而逐渐增加,符合青少年的发育特点。而且, 相关系数r=0.7945,呈高度相关。因此,可以认为计算出的一元回归方程,反映了11至18岁男运动员年龄和立定三级跳远成绩的线性关系。决定用一元回归方程来制定各年龄组的标准。 第二步,用一元回归方程:Y=2.5836+0.3392 X 推算出各年龄的立定三级跳远回归值,作为各年龄组的第2等标准。 第三步,用45人的立定三级跳远数据计算出标准差为:0.8271。由于在正态分布下,如把平均数作为标准约有50%的人可达到标准,用平均数-0.25标准差制定标准则约有60%的人可达到,用平均数+0.25、+0.52、+0.84标准差制定标准约有40%、30%、20%的人可达到标准。本例用各年龄组回归值-0.25标准差、+0.25标准差、+0.52标准差、+0.84标准差计算出1至5等标准如表2、图2。

你应该要掌握的7种回归分析方法

你应该要掌握的7种回归分析方法 标签:机器学习回归分析 2015-08-24 11:29 4749人阅读评论(0) 收藏举报 分类: 机器学习(5) 目录(?)[+]转载:原文链接:7 Types of Regression Techniques you should know!(译者/刘帝伟审校/刘翔宇、朱正贵责编/周建丁) 什么是回归分析? 回归分析是一种预测性的建模技术,它研究的是因变量(目标)和自变量(预测器)之间的关系。这种技术通常用于预测分析,时间序列模型以及发现变量之间的因果关系。例如,司机的鲁莽驾驶与道路交通事故数量之间的关系,最好的研究方法就是回归。 回归分析是建模和分析数据的重要工具。在这里,我们使用曲线/线来拟合这些数据点,在这种方式下,从曲线或线到数据点的距离差异最小。我会在接下来的部分详细解释这一点。 我们为什么使用回归分析? 如上所述,回归分析估计了两个或多个变量之间的关系。下面,让我们举一个简单的例子来理解它: 比如说,在当前的经济条件下,你要估计一家公司的销售额增长情况。现在,你有公司最新的数据,这些数据显示出销售额增长大约是经济增长的2.5倍。那么使用回归分析,我们就可以根据当前和过去的信息来预测未来公司的销售情况。 使用回归分析的好处良多。具体如下: 1.它表明自变量和因变量之间的显著关系;

2.它表明多个自变量对一个因变量的影响强度。 回归分析也允许我们去比较那些衡量不同尺度的变量之间的相互影响,如价格变动与促销活动数量之间联系。这些有利于帮助市场研究人员,数据分析人员以及数据科学家排除并估计出一组最佳的变量,用来构建预测模型。 我们有多少种回归技术? 有各种各样的回归技术用于预测。这些技术主要有三个度量(自变量的个数,因变量的类型以及回归线的形状)。我们将在下面的部分详细讨论它们。 对于那些有创意的人,如果你觉得有必要使用上面这些参数的一个组合,你甚至可以创造出一个没有被使用过的回归模型。但在你开始之前,先了解如下最常用的回归方法: 1. Linear Regression线性回归 它是最为人熟知的建模技术之一。线性回归通常是人们在学习预测模型时首选的技术之一。在这种技术中,因变量是连续的,自变量可以是连续的也可以是离散的,回归线的性质是线性的。 线性回归使用最佳的拟合直线(也就是回归线)在因变量(Y)和一个或多个自变量(X)之间建立一种关系。 用一个方程式来表示它,即Y=a+b*X + e,其中a表示截距,b表示直线的斜率,e是误差项。这个方程可以根据给定的预测变量(s)来预测目标变量的值。

多元逐步回归算法

逐步回归分析的基本思想 在实际问题中, 人们总是希望从对因变量y有影响的诸多变量中选择一些变量作为自变量, 应用多元回归分析的方法建立“最优”回归方程以便对因变量y进行预报或控制。所谓“最优”回归方程, 主要是指希望在回归方程中包含所有对因变量y影响显著的自变量而不包含对影响不显著的自变量的回归方程。逐步回归分析正是根据这种原则提出来的一种回归分析方法。它的主要思路是在考虑的全部自变量中按其对y的作用大小, 显著程度大小或者说贡献大小, 由大到小地逐个引入回归方程, 而对那些对作用不显著的变量可能始终不被引人回归方程。另外, 己被引人回归方程的变量在引入新变量后也可能失去重要性, 而需要从回归方程中剔除出去。引人一个变量或者从回归方程中剔除一个变量都称为逐步回归的一步, 每一步都要进行F检验, 以保证在引人新变量前回归方程中只含有对y 影响显著的变量, 而不显著的变量已被剔除。 逐步回归分析的实施过程是每一步都要对已引入回归方程的变量计算其偏回归平方和(即贡献), 然后选一个偏回归平方和最小的变量, 在预先给定的水平下进行显著性检验, 如果显著则该变量不必从回归方程中剔除, 这时方程中其它的几个变量也都不需要剔除(因为其它的几个变量的偏回归平方和都大于最小的一个更不需要剔除)。相反, 如果不显著, 则该变量要剔除, 然后按偏回归平方和由小到大地依次对方程中其它变量进行检验。将对影响不显著的变量全部剔除, 保留的都是显著的。接着再对未引人回归方程中的变量分别计算其偏回归平方和, 并选其中偏回归平方和最大的一个变量, 同样在给定水平下作显著性检验, 如果显著则将该变量引入回归方程, 这一过程一直继续下去, 直到在回归方程中的变量都不能剔除而又无新变量可以引入时为止, 这时逐步回归过程结束。 在供选择的m个自变量中,依各自变量对因变量作用的大小,即偏回归平方和(partial regression sum of squares)的大小,由大到小把自变量依次逐个引入。每引入一个变量,就 ≤时,将该自变量引入回归方程。新变量引入回归方程后,对方对它进行假设检验。当Pα 程中原有的自变量也要进行假设检验,并把贡献最小且退化为不显著的自变量逐个剔出方程。因此逐步回归每一步(引入一个自变量或剔除一个自变量)前后都要进行假设检验,直至既没有自变量能够进入方程,也没有自变量从方程中剔除为止。回归结束,最后所得方程即为所求得的“最优”回归方程。 逐步回归分析的特点:双向筛选,即引入有意义的变量(前进法),剔除无意义变量(后退法) 多元线性回归的应用 1.影响因素分析 2.估计与预测用回归方程进行预测时,应选择 具有较高2 R值的方程。 3.统计控制指利用回归方程进行逆估计,即通 过控制自变量的值使得因变量Y为 给定的一个确切值或者一个波动范 围。此时,要求回归方程的2R值要 大,回归系数的标准误要小。 1.样本含量 应注意样本含量n与自变量个数m的比例。通常,

第六章相关与回归分析方法

第六章 相关与回归分析方法 第一部分 习题 一、单项选择题 1.单位产品成本与其产量的相关;单位产品成本与单位产品原材料消耗量的相关 ( )。 A.前者是正相关,后者是负相关 B.前者是负相关,后者是正相关 C.两者都是正相关 D.两者都是负相关 2.样本相关系数r 的取值范围( )。 A.-∞<r <+∞ B.-1≤r ≤1 C. -l <r <1 D. 0≤r ≤1 3.当所有观测值都落在回归直线 01y x ββ=+上,则x 与y 之间的相关系数( )。 A.r =0 B.r =1 C.r =-1 D.|r|=1 4.相关分析与回归分析,在是否需要确定自变量和因变量的问题上( )。 A.前者无需确定,后者需要确定 B.前者需要确定,后者无需确定 C.两者均需确定 D.两者都无需确定 5.直线相关系数的绝对值接近1时,说明两变量相关关系的密切程度是( )。 A.完全相关 B.微弱相关 C.无线性相关 D.高度相关 6.年劳动生产率x(千元)和工人工资y(元)之间的回归方程为y=10+70x ,这意味着年劳动生产率每提高1千元时,工人工资平均( )。 A.增加70元 B.减少70元 C.增加80元 D.减少80元 7.下面的几个式子中,错误的是( )。 A. y= -40-1.6x r=0.89 B. y= -5-3.8x r =-0.94 C. y=36-2.4x r =-0.96 D. y= -36+3.8x r =0.98 8.下列关系中,属于正相关关系的有( )。 A.合理限度内,施肥量和平均单产量之间的关系 B.产品产量与单位产品成本之间的关系 C.商品的流通费用与销售利润之间的关系 D.流通费用率与商品销售量之间的关系 9.直线相关分析与直线回归分析的联系表现为( )。 A.相关分析是回归分析的基础 B.回归分析是相关分析的基础 C.相关分析是回归分析的深入 D.相关分析与回归分析互为条件 10.进行相关分析,要求相关的两个变量( )。 A.都是随机的 B.都不是随机的 C.一个是随机的,一个不是随机的 D.随机或不随机都可以 11.相关关系的主要特征是( )。 A.某一现象的标志与另外的标志之间存在着确定的依存关系 B.某一现象的标志与另外的标志之间存在着一定的关系,但它们不是确定的关系 C.某一现象的标志与另外的标志之间存在着严重的依存关系 D.某一现象的标志与另外的标志之间存在着函数关系 12.相关分析是研究( )。 A.变量之间的数量关系 B.变量之间的变动关系 C.变量之间相互关系的密切程度 D.变量之间的因果关系 13.现象之间相互依存关系的程度越低,则相关系数( )。 A.越接近于0 B.越接近于-1 C.越接近于1 D.越接近于0.5 14.在回归直线01y x ββ=+中,若10 β<,则x 与y 之间的相关系数( )。 A. r=0 B. r=1 C. 0<r <1 D. —l <r <0 15.当相关系数r=0时,表明( )。 A.现象之间完全无关 B.相关程度较小

回归研究分析方法总结全面

回归分析方法总结全面

————————————————————————————————作者:————————————————————————————————日期:

一、什么是回归分析 回归分析(Regression Analysis)是研究变量之间作用关系的一种统计分析方法,其基本组成是一个(或一组)自变量与一个(或一组)因变量。回归分析研究的目的是通过收集到的样本数据用一定的统计方法探讨自变量对因变量的影响关系,即原因对结果的影响程度。 回归分析是指对具有高度相关关系的现象,根据其相关的形态,建立一个适当的数学模型(函数式),来近似地反映变量之间关系的统计分析方法。利用这种方法建立的数学模型称为回归方程,它实际上是相关现象之间不确定、不规则的数量关系的一般化。 二、回归分析的种类 1.按涉及自变量的多少,可分为一元回归分析和多元回归分析一元回归分析是对一个因变量和一个自变量建立回归方程。多元回归分析是对一个因变量和两个或两个以上的自变量建立回归方程。 2.按回归方程的表现形式不同,可分为线性回归分析和非线性回归分析 若变量之间是线性相关关系,可通过建立直线方程来反映,这种分析叫线性回归分析。 若变量之间是非线性相关关系,可通过建立非线性回归方程来反映,这种分析叫非线性回归分析。 三、回归分析的主要内容 1.建立相关关系的数学表达式。依据现象之间的相关形态,建立适当的数学模型,通过数学模型来反映现象之间的相关关系,从数量上近似地反映变量之间变动的一般规律。 2.依据回归方程进行回归预测。由于回归方程反映了变量之间的一般性关系,因此当自变量发生变化时,可依据回归方程估计出因变量可能发生相应变化的数值。因变量的回归估计值,虽然不是一个必然的对应值(他可能和系统真值存在比较大的差距),但至少可以从一般性角度或平均意义角度反映因变量可能发生的数量变化。 3.计算估计标准误差。通过估计标准误差这一指标,可以分析回归估计值与实际值之间的差异程度以及估计值的准确性和代表性,还可利用估计标准误差对因变量估计值进行在一定把握程度条件下的区间估计。 四、一元线性回归分析 1.一元线性回归分析的特点 1)两个变量不是对等关系,必须明确自变量和因变量。 2)如果x和y两个变量无明显因果关系,则存在着两个回归方程:一个是以x为自变量,y 为因变量建立的回归方程;另一个是以y为自变量,x为因变量建立的回归方程。若绘出图

回归分析与相关分析联系 区别

回归分析与相关分析联系、区别?? 简单线性回归分析是对两个具有线性关系的变量,研究其相关性,配合线性回归方程,并根据自变量的变动来推算和预测因变量平均发展趋势的方法。 回归分析(Regression analysis)通过一个变量或一些变量的变化解释另一变量的变化。 主要内容和步骤:首先依据经济学理论并且通过对问题的分析判断,将变量分为自变量和因变量,一般情况下,自变量表示原因,因变量表示结果;其次,设法找出合适的数学方程式(即回归模型)描述变量间的关系;接着要估计模型的参数,得出样本回归方程;由于涉及到的变量具有不确定性,接着还要对回归模型进行统计检验,计量经济学检验、预测检验;当所有检验通过后,就可以应用回归模型了。 回归的种类 回归按照自变量的个数划分为一元回归和多元回归。只有一个自变量的回归叫一元回归,有两个或两个以上自变量的回归叫多元回归。 按照回归曲线的形态划分,有线性(直线)回归和非线性(曲线)回归。 相关分析与回归分析的关系 (一)相关分析与回归分析的联系 相关分析是回归分析的基础和前提,回归分析则是相关分析的深入和继续。相关分析需要依靠回归分析来表现变量之间数量相关的具体形式,而回归分析则需要依靠相关分析来表现变量之间数量变化的相关程度。只有当变量之间存在高度相关时,进行回归分析寻求其相关的具体形式才有意义。如果在没有对变量之间是否相关以及相关方向和程度做出正确判断之前,就进行回归分析,很容易造成“虚假回归”。与此同时,相关分析只研究变量之间相关的方向和程度,不能推断变量之间相互关系的具体形式,也无法从一个变量的变化来推测另一个变量的变化情况,因此,在具体应用过程中,只有把相关分析和回归分析结合起来,才能达到研究和分析的目的。 (二)相关分析与回归分析的区别 1.相关分析中涉及的变量不存在自变量和因变量的划分问题,变量之间的关系是对等的;而在回归分析中,则必须根据研究对象的性质和研究分析的目的,对变量进行自变量和因变量的划分。因此,在回归分析中,变量之间的关系是不对等的。 2.在相关分析中所有的变量都必须是随机变量;而在回归分析中,自变量是确定的,因变量才是随机的,即将自变量的给定值代入回归方程后,所得到的因变量的估计值不是唯一确定的,而会表现出一定的随机波动性。 3.相关分析主要是通过一个指标即相关系数来反映变量之间相关程度的大小,由于变量之间是对等的,因此相关系数是唯一确定的。而在回归分析中,对于互为因果的两个变量(如人的身高与体重,商品的价格与需求量),则有可能存在多个回归方程。 需要指出的是,变量之间是否存在“真实相关”,是由变量之间的内在联系所决定的。相关分析和回归分析只是定量分析的手段,通过相关分析和回归分析,虽然可以从数量上反映变量之间的联系形式及其密切程度,但是无法准确判断变量之间内在联系的存在与否,也无法判断变量之间的因果关系。因此,在具体应用过程中,一定要注意把定性分析和定量分析结合起来,在定性分析的基础上展开定量分析。

相关系数与回归分析

第八章相关与回归分析 114、什么叫相关分析? 研究两个或两个以上变量之间相关程度大小以及用一定涵数来表达现象相互关系的方法。 115、什么叫相关关系? 相关关系是一种不完全确定的依存关系,即因素标志的每一个数值都可能有若干结果标志的数值与之对应。 116、判定现象之间有无相关关系的方法有哪些? 判断现象之间有无相关关系,首先要对其作定性分析,否则很可能把虚假相关现象拿来作相关分析。相关表和相关图都是判定现象之间有无相关关系的重要方法。而相关系数主要是用来测定现象之间相关的密切程度的指标,估计标准误差是判定回归方程式代表性大小的指标。所以判断方法有客观现象作定性分析、编制相关表、绘制相关图。 117、什么叫相关系数? 测定变量之间相关密切程度和相关方向的指标。 118、相关系数有何特点? 参与相关分析的两个变量是对等的,不分自变量与因变量,因此相关系数只有一个。相关系数有正负号反映相关关系的方向中,正负瓜果正相关,负号反映负相关。计算相关系数的两个变量都是随机变量。 119、某产品产量与单位成本的相关系数是-0.8;(乙)产品单位成本与利润率的相关系数是-0.95;(乙)比(甲)的相关程度高吗? 相关系数是说明相关程度大小的指标,相关系数的取值范围在±1之间,相关系数越接近±1,说明两变量相关程度越高,越接近于0,说明相关程度越低。因此,(乙)比(甲)的相关程度高。 120、什么叫回归分析? 对具有相关关系的两个或两个以上变量之间数量变化的一般关系进行测定,确定一个相应的数学表达式,已从一个已知量推算另一个未知量,为估计预测提供一个重要方法。 121、与相关分析相比,回归分析有什么特点? 两个变量是不对等的,必须区自变量与因变量;因变量是随机的,自变量是可以控制的;对于一个没有因果关系的两个变量,可以求得两个回归方程,一个是Y倚X的回归方程,另一个是X倚Y的回归方程。 122、回归方程中回归系数的涵义是什么? 回归系数表示:当自变量X每增减一个单位时,因变量Y的平均增减值。 123、当所有的观测值都落在直线y c=a+bx上时,则x与y之间的相关系数为多少?

SPSS多元线性回归分析实例操作步骤之欧阳歌谷创编

SPSS 统计分析 欧阳歌谷(2021.02.01) 多元线性回归分析方法操作与分析 实验目的: 引入1998~2008年上海市城市人口密度、城市居民人均可支配收入、五年以上平均年贷款利率和房屋空置率作为变量,来研究上海房价的变动因素。 实验变量: 以年份、商品房平均售价(元/平方米)、上海市城市人口密度(人/平方公里)、城市居民人均可支配收入(元)、五年以上平均年贷款利率(%)和房屋空置率(%)作为变量。 实验方法:多元线性回归分析法 软件:spss19.0 操作过程: 第一步:导入Excel数据文件 1.open data document——open data——open; 2. Opening excel data source——OK. 第二步: 1.在最上面菜单里面选中Analyze——Regression——Linear ,Dependent(因变量)选择商品房平均售价,Independents(自变量)选择城市人口密度、城市居民人均可支配收入、五年以上平均年贷款利率、房屋空置率;Method选择Stepwise. 进入如下界面: 2.点击右侧Statistics,勾选Regression Coefficients(回归系数)选项组中的Estimates;勾选Residuals(残差)选项组中的Durbin-Watson、Casewise diagnostics默认;接着选择Model fit、Collinearity diagnotics;点击Continue. 3.点击右侧Plots,选择*ZPRED(标准化预测值)作为纵轴变量,选择DEPENDNT(因变量)作为横轴变量;勾选选项组中的Standardized Residual Plots(标准化残差图)中的Histogram、Normal probability plot;点击Continue. 4.点击右侧Save,勾选Predicted Vaniues(预测值)和Residuals (残差)选项组中的Unstandardized;点击Continue. 5.点击右侧Options,默认,点击Continue.

回归分析方法

回归分析方法Newly compiled on November 23, 2020

第八章回归分析方法 当人们对研究对象的内在特性和各因素间的关系有比较充分的认识时,一般用机理分析方法建立数学模型。如果由于客观事物内部规律的复杂性及人们认识程度的限制,无法分析实际对象内在的因果关系,建立合乎机理规律的数学模型,那么通常的办法是搜集大量数据,基于对数据的统计分析去建立模型。本章讨论其中用途非常广泛的一类模型——统计回归模型。回归模型常用来解决预测、控制、生产工艺优化等问题。 变量之间的关系可以分为两类:一类叫确定性关系,也叫函数关系,其特征是:一个变量随着其它变量的确定而确定。另一类关系叫相关关系,变量之间的关系很难用一种精确的方法表示出来。例如,通常人的年龄越大血压越高,但人的年龄和血压之间没有确定的数量关系,人的年龄和血压之间的关系就是相关关系。回归分析就是处理变量之间的相关关系的一种数学方法。其解决问题的大致方法、步骤如下: (1)收集一组包含因变量和自变量的数据; (2)选定因变量和自变量之间的模型,即一个数学式子,利用数据按照最小二乘准则计算模型中的系数; (3)利用统计分析方法对不同的模型进行比较,找出与数据拟合得最好的模型; (4)判断得到的模型是否适合于这组数据; (5)利用模型对因变量作出预测或解释。 应用统计分析特别是多元统计分析方法一般都要处理大量数据,工作量非常大,所以在计算机普及以前,这些方法大都是停留在理论研究上。运用一般计算语言编程也要

占用大量时间,而对于经济管理及社会学等对高级编程语言了解不深的人来说要应用这些统计方法更是不可能。MATLAB 等软件的开发和普及大大减少了对计算机编程的要求,使数据分析方法的广泛应用成为可能。MATLAB 统计工具箱几乎包括了数理统计方面主要的概念、理论、方法和算法。运用MATLAB 统计工具箱,我们可以十分方便地在计算机上进行计算,从而进一步加深理解,同时,其强大的图形功能使得概念、过程和结果可以直观地展现在我们面前。本章内容通常先介绍有关回归分析的数学原理,主要说明建模过程中要做的工作及理由,如模型的假设检验、参数估计等,为了把主要精力集中在应用上,我们略去详细而繁杂的理论。在此基础上再介绍在建模过程中如何有效地使用MATLAB 软件。没有学过这部分数学知识的读者可以不深究其数学原理,只要知道回归分析的目的,按照相应方法通过软件显示的图形或计算所得结果表示什么意思,那么,仍然可以学到用回归模型解决实际问题的基本方法。包括:一元线性回归、多元线性回归、非线性回归、逐步回归等方法以及如何利用MATLAB 软件建立初步的数学模型,如何透过输出结果对模型进行分析和改进,回归模型的应用等。 8.1 一元线性回归分析 回归模型可分为线性回归模型和非线性回归模型。非线性回归模型是回归函数关于未知参数具有非线性结构的回归模型。某些非线性回归模型可以化为线性回归模型处理;如果知道函数形式只是要确定其中的参数则是拟合问题,可以使用MATLAB 软件的curvefit 命令或nlinfit 命令拟合得到参数的估计并进行统计分析。本节主要考察线性回归模型。 一元线性回归模型的建立及其MATLAB 实现 其中01ββ,是待定系数,对于不同的,x y 是相互独立的随机变量。

逐步回归分析

逐步回归分析 1、逐步回归分析的主要思路 在实际问题中, 人们总是希望从对因变量有影响的诸多变量中选择一些变量作为自变量, 应用多元回归分析的方法建立“最优”回归方程以便对因变量进行预报或控制。所谓“最优”回归方程, 主要是指希望在回归方程中包含所有对因变量影响显著的自变量而不包含对影响不显著的自变量的回归方程。逐步回归分析正是根据这种原则提出来的一种回归分析方法。它的主要思路是在考虑的全部自变量中按其对的作用大小, 显著程度大小或者说贡献大小, 由大到小地逐个引入回归方程, 而对那些对作用不显著的变量可能始终不被引人回归方程。另外, 己被引人回归方程的变量在引入新变量后也可能失去重要性, 而需要从回归方程中剔除出去。引人一个变量或者从回归方程中剔除一个变量都称为逐步回归的一步, 每一步都要进行检验, 以保证在引人新变量前回归方程中只含有对影响显著的变量, 而不显著的变量 已被剔除。 逐步回归分析的实施过程是每一步都要对已引入回归方程的变量计算其偏回归平方和(即贡献), 然后选一个偏回归平方和最小的变量, 在预先给定的水平下进行显著性检验, 如果显著则该变量不必从回 归方程中剔除, 这时方程中其它的几个变量也都不需要剔除(因为其它的几个变量的偏回归平方和都大于 最小的一个更不需要剔除)。相反, 如果不显著, 则该变量要剔除, 然后按偏回归平方和由小到大地依次对方程中其它变量进行检验。将对影响不显著的变量全部剔除, 保留的都是显著的。接着再对未引人回归方程中的变量分别计算其偏回归平方和, 并选其中偏回归平方和最大的一个变量, 同样在给定水平 下作显著性检验, 如果显著则将该变量引入回归方程, 这一过程一直继续下去, 直到在回归方程中的变量都不能剔除而又无新变量可以引入时为止, 这时逐步回归过程结束。 2、逐步回归分析的主要计算步骤 (1) 确定检验值 在进行逐步回归计算前要确定检验每个变量是否显若的检验水平, 以作为引人或剔除变量的标准。 检验水平要根据具体问题的实际情况来定。一般地, 为使最终的回归方程中包含较多的变量, 水平不宜取得过高, 即显著水平α不宜太小。水平还与自由度有关, 因为在逐步回归过程中, 回归方程中所含的变量的个数不断在变化, 因此方差分析中的剩余自由度也总在变化, 为方便起见常按计算自由度。为原始数据观测组数, 为估计可能选人回归方程的变量个数。例如, 估计可能有2~3个变量选入回归方程, 因此取自由度为15-3-1=11, 查分布表, 当α=0.1, 自由度, 时, 临界值, 并且在引入变量时, 自由度取, , 检验的临界值记, 在剔除

多元回归分析法的介绍及具体应用

多元回归分析法的介绍及具体应用 在数量分析中,经常会看到变量与变量之间存在着一定的联系。要了解变量之间如何发生相互影响的,就需要利用相关分析和回归分析。回归分析的主要类型:一元线性回归分析、多元线性回归分析、非线性回归分析、曲线估计、时间序列的曲线估计、含虚拟自变量的回归分析以及逻辑回归分析等。这里主要讲的是多元线性回归分析法。 1. 多元线性回归的定义 说到多元线性回归分析前,首先介绍下医院回归线性分析,一元线性回归分析是在排除其他影响因素或假定其他影响因素确定的条件下,分析某一个因素(自变量)是如何影响另一事物(因变量)的过程,所进行的分析是比较理想化的。其实,在现实社会生活中,任何一个事物(因变量)总是受到其他多种事物(多个自变量)的影响。 一元线性回归分析讨论的回归问题只涉及了一个自变量,但在实际问题中,影响因变量的因素往往有多个。例如,商品的需求除了受自身价格的影响外,还要受到消费者收入、其他商品的价格、消费者偏好等因素的影响;影响水果产量的外界因素有平均气温、平均日照时数、平均湿度等。 因此,在许多场合,仅仅考虑单个变量是不够的,还需要就一个因变量与多个自变量的联系来进行考察,才能获得比较满意的结果。这就产生了测定多因素之间相关关系的问题。 研究在线性相关条件下,两个或两个以上自变量对一个因变量的数量变化关系,称为多元线性回归分析,表现这一数量关系的数学公式,称为多元线性回归模型。 多元线性回归模型是一元线性回归模型的扩展,其基本原理与一元线性回归模型类似,只是在计算上更为复杂,一般需借助计算机来完成。 2. 多元回归线性分析的运用 具体地说,多元线性回归分析主要解决以下几方面的问题。 (1)、确定几个特定的变量之间是否存在相关关系,如果存在的话,找出它

逐步回归分析(教材)

第6节逐步回归分析 逐步回归分析实质上就是建立最优的多元线性回归方程,显然既实用而应用又最广泛。 6.1逐步回归分析概述 1 概念 逐步回归模型是以已知地理数据序列为基础,根据多元回归分析法和求解求逆紧凑变换法及双检验法而建立的能够反映地理要素之间变化关系的最优回归模型。 逐步回归分析是指在多元线性回归分析中,利用求解求逆紧奏变换法和双检验法,来研究和建立最优回归方程的并用于地理分析和地理决策的多元线性回归分析。它实质上就是多元线性回归分析的基础上派生出一种研究和建立最优多元线性回归方程的算法技巧。主要含义如下: 1)逐步回归分析的理论基础是多元线性回归分析法; 2)逐步回归分析的算法技巧是求解求逆紧奏变换法; 3)逐步回归分析的方法技巧是双检验法,即引进和剔除检验法; 4)逐步回归分析的核心任务是建立最优回归方程; 5)逐步回归分析的主要作用是降维。 主要用途:主要用于因果关系分析、聚类分析、区域规划、综合评价等等。 2 最优回归模型

1)概念 最优回归模型是指仅包含对因变量有显著影响的自变量的回归方程。逐步回归分析就是解决如何建立最优回归方程的问题。 2)最优回归模型的含义 最优回归模型的含义有两点: (1)自变量个数 自变量个数要尽可能多,因为通过筛选自变量的办法,选取自变量的个数越多,回归平方和越大,剩余平方和越小,则回归分析效果就越好,这也是提高回归模型分析效果的重要条件。 (2)自变量显著性 自变量对因变量y 有显著影响,建立最优回归模型的目的主要是用于预测和分析,自然要求自变量个数尽可能少,且对因变量y 有显著影响。若自变量个数越多,一方面预测计算量大,另一方面因n 固定,所以 Q S k n Q →--1 增大,即造成剩余标准差增大,故要求自变量个数要适 中。且引入和剔除自变量时都要进行显著性检验,使之达到最优化状态,所以此回归方程又称为优化模型。 3 最优回归模型的选择方法 最优回归模型的选择方法是一种经验性发展方法,主要有以下四种: (1)组合优选法 组合优选法是指从变量组合而建立的所有回归方程中选取最优着。其具体过程是:

回归分析方法总结全面

一、什么是回归分析 回归分析(Regression Analysis)是研究变量之间作用关系的一种统计分析方法,其基本组成是一个(或一组)自变量与一个(或一组)因变量。回归分析研究的目的是通过收集到的样本数据用一定的统计方法探讨自变量对因变量的影响关系,即原因对结果的影响程度。 回归分析是指对具有高度相关关系的现象,根据其相关的形态,建立一个适当的数学模型(函数式),来近似地反映变量之间关系的统计分析方法。利用这种方法建立的数学模型称为回归方程,它实际上是相关现象之间不确定、不规则的数量关系的一般化。 二、回归分析的种类 1.按涉及自变量的多少,可分为一元回归分析和多元回归分析一元回归分析是对一个因变量和一个自变量建立回归方程。多元回归分析是对一个因变量和两个或两个以上的自变量建立回归方程。 2.按回归方程的表现形式不同,可分为线性回归分析和非线性回归分析 若变量之间是线性相关关系,可通过建立直线方程来反映,这种分析叫线性回归分析。 若变量之间是非线性相关关系,可通过建立非线性回归方程来反映,这种分析叫非线性回归分析。 三、回归分析的主要内容 1.建立相关关系的数学表达式。依据现象之间的相关形态,建立适当的数学模型,通过数学模型来反映现象之间的相关关系,从数量上近似地反映变量之间变动的一般规律。 2.依据回归方程进行回归预测。由于回归方程反映了变量之间的一般性关系,因此当自变量发生变化时,可依据回归方程估计出因变量可能发生相应变化的数值。因变量的回归估计值,虽然不是一个必然的对应值(他可能和系统真值存在比较大的差距),但至少可以从一般性角度或平均意义角度反映因变量可能发生的数量变化。