融合光流速度与背景建模的目标检测方法_张水发

第16卷 第2期2011年2月

中国图象图形学报J o u r n a l o f I m a g e a n d G r a p h i c s

V o l .16,N o .2

F e b .,2011

中图法分类号:T P 391.41 文献标志码:A 文章编号:1006-8961(2011)02-0236-08

论文索引信息:张水发,张文生,丁欢,杨柳.融合光流速度与背景建模的目标检测方法[J ].中国图象图形学报,2011,16(2):236-243

收稿日期:2009-09-08;修回日期:2009-12-11

基金项目:国家基础研究发展计划项目(973)(2004C B 318103);国家高技术研究发展计划项目(863)(2007A A 012138578);国家自然科学基金项目(60033020);中国科学院海外杰出人才研究计划项目(06S 3011S 01);软件工程国家重点实验室开放基金支持项目(S K L S E 2008-07-19)。

第一作者简介:张水发(1985— ),男。现为中国科学院自动化研究所复杂系统与智能科学重点实验室模式识别与智能系统专业硕士研究生,主要研究方向为图像处理、行为识别。E -m a i l :z h a n g s f 85@g m a i l .c o m 。

融合光流速度与背景建模的目标检测方法

张水发,张文生,丁欢,杨柳

(中国科学院自动化研究所,北京 100190)

摘 要:为了克服传统基于像素的背景建模方法不能很好地描述背景运动的问题,提出了一种融合光流速度与背景建模的目标检测方法。结合像素的灰度信息、空间信息和时间信息计算出每个像素的光流速度,利用光流速度在时间域上的统计信息为背景建立光流速度场模型。利用建立的背景模型快速、准确地实现运动目标的检测。实验结果表明,融合光流速度的背景建模方法能有效地描述背景的运动,显著降低运动背景产生的噪音,鲁棒地实现运动目标检测。

关键词:背景建模;光流法;目标检测;混合高斯

B a c k g r o u n d m o d e l i n g a n do b j e c t d e t e c t i n g b a s e d o n

o p t i c a l f l o wv e l o c i t y f i e l d

Z h a n g S h u i f a ,Z h a n g W e n s h e n g ,D i n g H u a n ,Y a n g L i u

(I n s t i t u t e o f A u t o m a t i o n ,C h i n e s e A c a d e m y o f S c i e n c e s ,B e i j i n g 100190C h i n a )

A b s t r a c t :T h e t r a d i t i o n a l p i x e l -b a s e d b a c k g r o u n d m o d e l c a n n o t r e p r e s e n t t h e b a c k g r o u n dm o t i o n e f f i c i e n t l y .I n t h i s p a p e r ,an o v e l s t r a t e g y i s p r o p o s e d t o m o d e l b a c k g r o u n da n d t r a c km o v i n g o b j e c t s b a s e d o n o p t i c a l f l o wv e l o c i t y f i e l d .S t a t i s t i c s o n

i n t e n s i t y ,s p a t i a l a n dt e m p o r a l i n f o r m a t i o no f p i x e l sa r ee x t r a c t e dt og e n e r a t et h eo p t i c a l f l o wf i e l d ,w h i c hi su s e dt o f o r m u l a t ean o v e lb a c k g r o u n dm o d e l f o rt r a c k i n gm o v i n go b j e c t se f f i c i e n t l ya n d e x a c t l y .T h i so p t i c a l -f l o w -f i e l d -b a s e d s t r a t e g y c a n r e d u c e n o i s e g e n e r a t e db y b a c k g r o u n dm o t i o n s i g n i f i c a n t l y a n d t r a c k m o v i n g o b j e c t s r o b u s t l y ,a s i l l u s t r a t e d i n o u r e x p e r i m e n t s .K e y w o r d s :b a c k g r o u n d m o d e l i n g ;o p t i c a l f l o w ;o b j e c t d e t e c t i n g ;m i x t u r e o f G a u s s

0 引 言

运动目标检测是从图像序列中提取运动目标,有效分割运动目标对目标的分类、跟踪及行为理解等后期处理具有非常重要的意义。由于实际场景中,背景受光照、天气或其他因素影响,并不能保证完全静止,导致背景物体以及前景物体的运动同时

存在于待检测图片中,使运动目标检测成为一项相

当困难的工作,成为目前计算机视觉和图像理解研究的难点和热点问题之一。

背景减除法[1-6]

是目前最常用的运动目标检测

方法,通过对背景的学习得到背景模型,通过当前帧与背景模型比较,将不符合背景模型分布的部分判定为运动目标。理想情况下,背景完全静止,可表示为一帧背景图像;但大多数情况下,由于边缘像素抖

第2期张水发等:融合光流速度与背景建模的目标检测方法237

动、光照变化、设备噪音等因素,背景中的物体自身存在或多或少的运动。针对这种情况,国内外学者采用各种模型表示背景,其中典型的有:高斯模型[2]和混合高斯模型[3]用一个或多个高斯分布表示背景,可用于复杂、运动的背景建模,但当背景快速运动时,一个或者多个高斯模型并不能准确表示背景;非参数方法[4]利用像素点最近几帧的灰度值信息,使用窗函数密度估计得到该像素点的灰度值分布,但该方法计算每帧图像需遍历全部训练集,计算速度较慢;本征方法[5]将视频帧投影到本征背景空间,通过计算视频帧与背景帧在本征空间的差值实现前景检测,该方法利用主成分分析方法实现降维,检测速度快,但背景模型是通过初始化几十帧图片获得,因此资源消耗大,自适应能力差。上述几种建模方法均属于基于像素的背景建模方法,能够获得较细致的运动目标形状,但由于对像素点的时间信息和空间信息利用不充分,当背景物体不规则运动时,不能准确地描述背景运动。

本文试图跳出传统的基于像素背景建模方法,提出融合光流速度的背景建模算法。利用灰度值的统计信息描述背景,综合利用像素的灰度信息、空间信息、时间信息,以及光流速度在时间域上的统计信息,从像素运动速度入手,对背景进行像素级建模。用基于梯度的方法计算光流速度,然后利用其在时间域上的统计信息建立背景的光流速度场[7]模型,最后用于运动目标检测;同时在检测过程中实时更新背景模型,适应背景变化。本文算法利用光流速度准确地描述了背景运动,克服了树叶晃动等背景不规则运动对建模造成的不利影响,同时具有较好的自适应性,当背景中光照变化、物体被移走或遗留时,算法均能自适应背景变化。

1 光流法

光流(o p t i c a l f l o w)是空间运动物体被观测表面上像素点运动的瞬时速度,光流按照空间位置排列组成光流场。B a r r o n等人[8]按理论基础与数学方法不同,将光流计算方法分成5种:基于梯度的方法[9-11]、基于匹配的方法[12]、基于能量的方法[13]、基于相位的方法[14]和神经动力学方法[15]。

基于梯度的方法又称为微分法[9-11],利用时变图像像素灰度的时空微分计算其速度矢量,由于基于梯度的方法计算简单且结果较好,该方法得到了广泛的应用和研究;基于匹配的光流计算方法[12]包括基于特征和区域两种,对快速运动和亮度变化具有鲁棒性,但其计算的光流通常很稀疏,而且特征提取和精确匹配也十分困难;基于能量的方法[13]对输入图像序列进行时空滤波处理,但是会降低光流估计的空间和时间分辨率,并且存在高计算负荷的问题;基于相位的方法[14]是根据带通滤波器输出的相位特性确定速度,速度估计结果比较精确,但是计算复杂度较高,边缘处运动估计的时间分辨率较差,并对输入图像序列的时间混叠比较敏感;近几年有人提出用神经网络建立视觉运动感知的神经动力学模型来测量光流[15],但是这一技术尚不成熟。综上所述,光流场的计算技术经过多年的发展,已经形成一些比较经典的算法,B a r r o n等人[11]研究表明,基于梯度的方法计算复杂度较低,并且能得到比较精确的光流,因此本文选用基于梯度的方法[9-11]计算光流速度。

在文献[11]中H o r n-S c h u n c k提出基于梯度的方法,假设f(x,y,t)是关于变量x,y,t的连续函数。设t时刻,点(x,y)处的灰度值为f(x,y,t);在(t+Δt)时刻,运动到点(x+Δx y+Δy),灰度值为f(x+Δx, y+Δy,t+Δt),由于Δt是一个极小的时间段,假设f(x,y,t)=f(x+Δx,y+Δy,t+Δt)(1)将式(1)右边用泰勒公式展开,略去二次无穷小项,得

f

x

u+f

y

v+f

t

=0(2)式(2)是基本的光流约束方程,它反映了运动图像时间梯度与空间梯度间的时空微分关系。

在整个视频图像范围内,运动速度矢量场平滑变化,即相邻的图像像素点之间具有相似的速度矢量。速度矢量逐像素的变化可以通过速度矢量分量的空间梯度的模平方和(用E2c表示)来定量给出,可以证明图像的速度场越平滑,梯度值就越小。因此附加的光流平滑约束条件就是要求E2c最小。

定义像素点光流误差为

E b=

f(x,y,t)

x

u(x,y,t)+

f(x,y,t)

y

v(x,y,t)+

f(x,y,t)

t

(3) 通过求像素点光流误差与速度场逐像素变化数值加权和的最小值来估计每一个像素点处的速度矢量。

238

中国图象图形学报 w w w .c j i g .c n

第16卷

E 2

=m i n V (x ,y ,t )

A [E 2b (V )+a 2E 2

c (

V )]d x d y (4)式中A 代表连续图像的区域范围。α2

用来控制平滑约束条件的强度。通过最小化E 2

计算光流速度矢量,得到u (x ,y ,t )和v (x ,y ,t )的迭代方程

u n +1

=u n

-f x [f x u n +f y v n

+f t

][a 2+f 2x +f 2y ]

v

n +1

=v n -f y [f x u n +f y v n

+f t

][a 2+f 2x +f 2y ]

(5)

式中f x 表示

f (x ,y ,t ) x ,f y 表示 f (x ,y ,t ) y

,f t

表示 f (x ,y ,t )

t

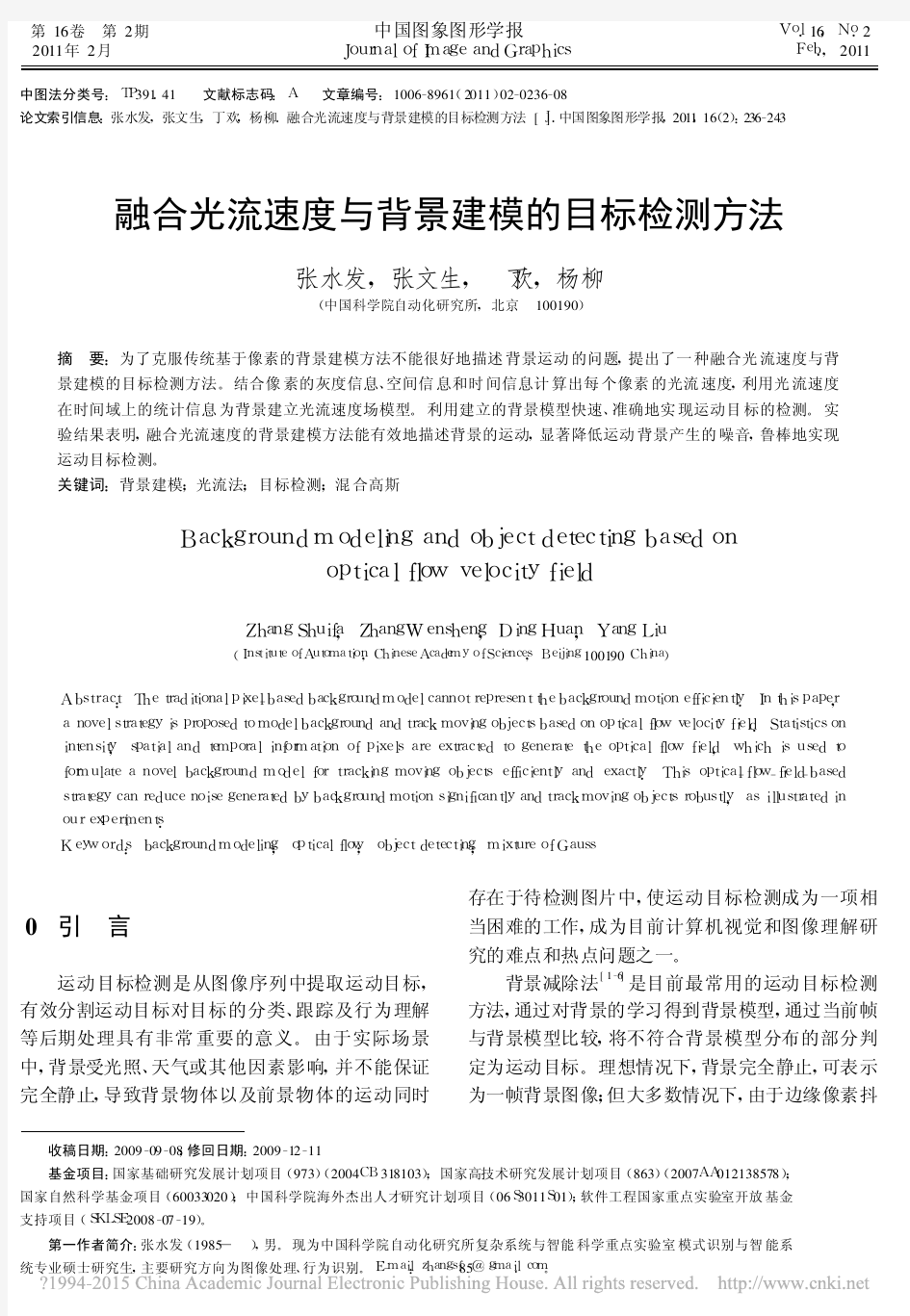

,n 是迭代次数。通过G a u s s -S e i d e l 迭代得到了每个像素x 方向和y 方向的光流速度,通过判断该速度大小可以把每个像素划分为前景点或背景点,实现运动目标检测。如图1所示,图1(a )是从V s s n 06v i d e o 4中截取的一帧,图1(b )是用H o r n -S c h u n c k 基于梯度的方法运动目标检测得到的二值图像,白色部分表示运动目标。从检测结果看出,

在检测目标物体的同时,把运动背景也检测为运动目标,产生了很大噪音。因此,为了消除运动背景对运动目标检测带来的影响,我们提出了融合光流速度的背景建模方法。

图1 光流法运动目标检测

F i g .1 O b j e c t d e t e c t i n g b a s e do n o p t i c a l f l o w

2 基于光流速度场背景建模

光流法可充分利用像素的时空信息计算图像中

每一个像素点的速度矢量,形成图像运动场,且能在不需要知道场景任何先验知识的条件下能得到完整的运动信息,适合检测相对复杂的运动,可用于动态背景。因此利用光流法计算出的光流速度场构造背景模型。

利用基于梯度的光流计算方法,提出了一种融合光流速度场的背景建模方法检测运动目标:首先利用融合梯度的光流法综合每个像素的时间信息、

空间信息和灰度信息计算每个像素的光流速度;然后统计每个像素的光流速度在时间域上的分布信息,构造背景模型。

传统的基于像素背景建模方法没有充分利用像

素的时间信息和空间信息,当背景物体不规则运动时,很难描述出背景运动;本文算法的优点在于综合利用了像素的灰度信息、时间信息、空间信息以及光流速度在时间域上的统计信息,通过光流速度更好的描述了背景运动。

传统的光流法通过判断像素运动幅度大小实现运动目标检测,当背景运动幅度大时,经常把背景运动误检为前景目标;本文算法在运动目标检测之前利用光流速度在时间域上的统计信息,建立光流速度场模型,描述背景运动,在检测过程中,利用建立的背景模型,能有效消除背景运动的影响。2.1 建立光流速度场背景模型

令x ={x 1,x 2,…,x n }表示一个像素上用来训练的n 个样本,x t (t ∈[1,n ])包括t 时刻像素上的灰度信息、像素邻域内的灰度信息以及t -1时刻,对应像素上的灰度信息与其邻域内的像素灰度信息;用c ={u ,v ,w }表示每个像素。u ,v ,w 具体表示为

u={u m i n ,u m a x ,u d i f f m i n ,u d i f f m a x }(6)v={v m i n ,u m a x ,v d i f f m i n ,v d i f f m a x }(7)w ={w m i n ,w m a x ,w d i f f m i n ,w d i f f m a x

}(8)

u m i n ,u m a x ,v m i n ,v m a x :所有训练样本在x ,y 方向速度的最小值和最大值;u d i f f m i n ,u d i f f m a x ,v d i f f m i n ,v d i f f m a x :相邻两帧在x ,y 方向速度差最小值和最大值。w m i n ,w m a x :

所有训练样本速度的最小值和最大值(w=u 2+v 2

);w d i f f m i n ,w d i f f m a x :相邻两帧训练样本速度差的最小值和最大值。

背景建模时,利用x t

(t ∈[1,n ])中包含的灰度信息、空间信息和时间信息计算像素x ,y 方向速度u t ,v t 和总速度w t ,分别与u t ,v t ,w t 做差得到u d i f f t ,v d i f f t ,w d i f f t ,对于背景中的每一个像素点,分别得到x 方向和y 方向速度的最大值和最小值以及相邻两帧训练样本x 方向和y 方向速度差的最大值和最小值,并在此基础上得到总速度的最大值和最小值以及相邻两帧训练样本间总速度差的最大值和最小值,建立的背景模型为

c ={u ,v ,w }

(9)

式中u={m i n t {u t },m a x t {u t },m i n t {u d i f f t },m a x t {u d i f f t }},v ={m i n t {v t },m a x t {v t },m i n t {v d i f f t

},

第2期张水发等:融合光流速度与背景建模的目标检测方法239

m a x t{v d i f f t}},w={m i n t{w t},m a x t{w t}, m i n t{w d i f f t},m a x t{w d i f f t}},t∈[1,n],是n帧训练样本中的第t帧。m i n t{x t},m a x t{x t}分别表示N 帧训练样本中的最小值和最大值。

具体实现算法如下:

1)初始化

u m i n,u d i f f m i n,v m i n,v d i f f m i n,w m i n,w d i f f m i n初始化为最大整数;

u m a x,u d i f f m a x,v m a x,v d i f f m a x,w m a x,w d i f f m a x初始化为最小整数;

预读一帧图像,为计算光流速度提供参考帧。

2)对所有的t∈[1,n]

(1)读入一帧图像,结合上一帧图像信息计算

光流速度u t,v t,w t(w t=u2t+v2t)

(2)与上一帧相应像素的速度u t-1,v t-1,w t-1做差得u d i f f,v d i f f,w d i f f

(3)把u t,v t,w t,u d i f f,v d i f f,w d i f f分别与u m i n,v m i n,w m i n,u d i f f m i n,v d i f f m i n,w d i f f m i n比较,i f (u tu m a x)t h e n u m a x=u t,同理更新v t,w t,u d i f f t,v d i f f t,w d i f f t。

经过背景学习,建立了光流速度场模型,描述背

景运动。当背景物体运动状态改变时,有可能把背景误检为运动目标。因此,在检测过程中还需要更新背景模型。

2.2 更新光流速度场背景模型

光照变化、天气变化、背景物体运动状态改变都

可能使原来的模型失效。由于本文为背景建立光流速度场模型,在计算光流速度时结合了像素灰度信息、空间信息以及相邻帧信息,当光照变化或天气变化时,会产生一帧或短时间误报,只要背景物体运动状态没变化,就可以不用考虑背景模型的更新,所以本文背景模型更新只针对背景物体运动状态的改变。

针对背景物体运动改变的3种可能(运动※不运动、不运动※运动、运动速度变化),使用两种不同的策略对背景模型进行像素级更新。运动目标检测期间,为每个像素点创建两个队列,分别记录当前像素点最近N帧被判定为前景点的次数和速度信息,以此来决定是否更新背景模型。两个队列的说

明如下:

n Z(t)表示(u,v,w)在0邻域范围的次数:

n Z(t)=

n Z(t-1)+1(u,v,w)在0的邻域范围内

n Z(t-1)(u,v,w)不在0的邻域范围内

(10)

F G(t)表示像素点被判断为前景点的次数: F G(t)=

F G(t-1)+1当前像素点被判断为前景点

F G(t-1)当前像素点不被判断为前景点

(11) 背景模型更新策略:

(u,v,w)=

(0,0,0)(u,v,w)不在0的邻域内且

n Z(t)-n Z(t-N)>κN

(u,v,w)n e w最近N个像素点有γN个被检测为前景点

(12)κ,γ表示背景更新的阈值,这里κ表示像素点在最近N帧中有κ的概率光流速度为0或者近似为0,κ理想情况下为1与背景运动物体宽度所占像素数与运动范围的像素数的比例之差,γ表示像素点在最近N帧中有γ的概率光流速度为(u,v,w)n e w,γ理想情况下为(1-κ),但是实际情况下,并不能确定背景物体宽度与其运动范围的像素数,所以通过先验知识对κ,γ取值,本文针对背景中树叶的运动进行更新的κ,γ为0.9,0.1。

2.3 融合光流速度的背景模型的运动目标检测

运动目标检测可以分为4步:二值化、去噪、数字形态学滤波和目标检测。将像素划分为背景点或者前景点,符合背景模型分布的为背景点,不符合背景模型分布的为前景点,用B(x)表示第t帧中像素x为背景像素还是前景像素。

首先利用像素的灰度信息和空间信息、时间信息计算出光流速度u t,v t,w t,然后判断光流速度是否符合背景模型的分布,符合则认为是背景点,否则认为是前景点:

B(x)=

0(背景)u t,v t,w t符合背景分布

1(前景)u t,v t,w t不符合背景分布

(13)

u d i f f m i n

u t-u m a x

v t-v m a x w t-w m a x 240 中国图象图形学报 w w w .c j i g .c n 第16卷 当u t ,v t 对式(14)(15)同时成立时,则认为u t ,v t ,w t 符合背景分布,属于背景点,当u t ,v t 对式(14)(15)都不成立时,则认为u t ,v t ,w t 不符合背景分布,属于前景点,当u t ,v t 其中之一对式(14)(15)成立时,如果w t 对式(16)成立,则认为u t ,v t ,w t 符合背景分布,属于背景点,否则认为u t ,v t ,w t 不符合背景分布,属于前景点。 3 实验结果及比较分析 为了验证本文提出的方法,我们主要在V s s n 06(4t h A C M I n t e r n a t i o n a l W o r k s h o p o n V i d e o S u r v e i l l a n c e &S e n s o r N e t w o r k )视频库上进行测试。V s s n 06包含多个室内、室外场景,提供的测试数据包括:背景运动、光照渐变、光照突变、阴影、物体遗留等,并提供了与运动目标对应的前景掩膜视频。在本文实验中主要在包含背景运动的v i d e o 4、光照突变的v i d e o 8、车辆停止在背景中的t u n n e l v i d e o 视频中进行测试。同时将实验结果与相同视频经混合高斯 [3] 、均值滤波和光流法处理后的结果进行比较。 实验在V C ++6.0平台下完成,实验得到的结果都 是进行了形态学滤波后的处理结果。3.1 背景存在运动条件下的运动目标检测图2(c )—(f )是在背景存在显著运动时的检测结果,实验对比了均值滤波、混合高斯、光流法和本文融合光流速度场背景建模算法的检测效果。图2(a )是V s s n 06v i d e o 4视频中截取的一帧,分辨率为384×240,背景存在复杂运动,尤其是左下角小黄花运动幅度大,运动速度快;而且当人运动到如图2(a )所示位置时,背景像素与人身体的像素灰度值接近,也给检测带来了很大的影响。实验效果如图2所示,图2(b )为V s s n 提供的理想二值图像,图2(c )—(f )分别是用均值滤波、混合高斯、融合光流速度场背景建模后检测得到的运动目标,图2(e )是光流法检测得到的运动目标。 从实验结果可以看出均值滤波背景建模检测到的前景存在大量的噪音;混合高斯背景建模比均值滤波更好的适应背景像素的运动,但是对于背景快速变化的边缘,仍然不能准确描述,并且当前景像素与背景像素亮度及颜色特征比较接近时会出现漏检现象;直接用光流法检测到的前景包含了图像中背景像素的运动;因为建模时为运动背景建立了光流 速度模型,所以本文融合光流速度场背景建模的方 图2 背景存在运动条件下的运动目标检测F i g .2 O b j e c t d e t e c t i n g b a s e do n m o v i n g b a c k g r o u n d 法能很好地去除运动背景,检测出完整的目标区域, 并很好的去除了由于背景物体运动产生的噪音。 利用上述实验得到的结果对均值滤波、混合高斯、光流法以及融合光流速度场的背景减除法进行像素级的分析。表1给出了分析对比结果,T P 与T N 分别是指将目标样本判断正确与错误的比例,F P 与F N 分别是指将非目标样本判断错误与正确的个数。对于v i d e o 4这种复杂的户外场景,背景存在快速明显的运动,均值滤波存在大量的由背景运动产生的噪音,并且检测到的目标区域也不完整;相比之下,混合高斯建模受背景运动的影响较小,但是依然无法适应快速的背景运动,而且因为图像帧目标所在的区域存在背景运动,检测时目标像素的亮度及灰度值符合混合高斯模型分布,所以,存在漏检现象,在表1中表现为T P 为76.00%,略小于均值滤波,而F P 为1.73%,比较均值滤波为好;用光流 表1 定量分析结果/% T a b .1 T h er e s u l t s o f q u a n t i t a t i v e a n a l y s i s /% 检测方法T P T N F P F N 均值滤波83.9916.016.1993.81混合高斯76.0024.001.7398.27光流法96.923.084.5295.48 第2期张水发等:融合光流速度与背景建模的目标检测方法241 法直接检测效果也不理想,受背景运动影响较大,F P 为4.52%,仅比均值滤波略好;融合光流速度场背景建模效果很好,不仅克服了背景运动的影响,还 能较完整地描述目标区域,目标区域的错误检测仅为5.50%,比均值滤波、混合高斯建模的错误检测率16.01%、24.00%好了很多,同时,F P 也比混合高斯少了30%,而且从图中可以清楚地看出,F P 主要集中在目标物体的边缘,这是因为当目标物体运动时,其周围存在光流场,对后续运动目标检测影响较小。3.2 光照改变条件下的运动目标检测 图3左边一列是在光照强度没有发生改变时的检测结果,右边一列是在光照发生突然变化时的检测结果,实验对比了当场景中光照改变时均值滤波、混合高斯、光流法和本文融合光流速度场背景建模的检测效果。v i d e o 8的特点是背景没有运动物体,但是在检测过程中右上角区域会出现光照变化。图3(a )(b )(c )分别是从视频中截取的第1、899、1088帧,第1帧和第1088帧右上角光照发生了明显变化,给检测和更新带来了很大的困难。 从图3检测结果中可以看出,利用均值滤波和混合高斯背景建模检测到的前景并没有消除光照条件变化带来的影响,并且在该区域出现的运动物体没被检测到;v i d e o 8视频中背景没有运动物体,因此融合光流速度场背景建模建立的背景模型中光流速度几乎处处为0。此时融合光流速度场背景建模检测到的前景与光流法检测到的前景几乎一样。当光照没有变化时,融合光流速度场背景建模检测到的前景与均值滤波、混合高斯背景建模得到的效果一样,当光照发生变化时,融合光流速度场背景建模不仅能很好地检测到目标区域,而且能很好地消除光照变化的影响。 v i d e o 8视频中,从138帧光照开始变化到597帧,光照恢复为背景学习时的样子,从970帧开始光照又发生了一次变化,知道第1189帧才恢复成原来的样子,共680帧。从表2的结果可以看出均值滤波和混合高斯容易受光照变化影响,当背景更新率为0时,只要背景光照发生变化,均值滤波和混合高斯建模就会把因为光照变化的部分误检为运动目标。当加入更新率后,误检的情况有所改善,但是受背景更新影响,检测到的目标前景出现了拖影和漏检。相比之下,本文方法因为结合了图像的前后帧信息计算背景模型,所以只有在光照改变的短时间 内出现少量误报。 图3 背景光照变化条件下的运动目标检测F i g .3 O b j e c t d e t e c t i n g b a s e d o ni l l u m i n a t i o nc h a n g e s 3.3 有遗留物体条件下的运动目标检测 图4第1列是汽车在运动时的检测结果,第2列是同一辆汽车静止在场景中的检测结果。实验对比了均值滤波、混合高斯和本文融合光流速度场背景建模算法在场景中有遗留物体的检测效果。 242 中国图象图形学报 w w w .c j i g .c n 第16卷 表2 光照变化错误检测结果/%T a b .2 T h er e s u l t s o f w r o n gd e t e c t b a s e do n i l l u m i n a t i o nc h a n g e s /% 学习率α=0α=0.01α=0.05α=0.1均值滤波10065.8818.2411.03混合高斯10045.5915.449.20本文方法 4.12 4.12 4.12 4. 12 图4 有遗留物体条件下的运动目标检测F i g .4 O b j e c t d e t e c t i n gb a s e do n l e f t o b j e c t 如图4所示,第1行第1列和第2列分别是V s s n 05t u n n e l v i d e o 中的第2958、4505帧。在第2958帧,当汽车进入场景时,均值滤波、混合高斯和本文融合光流速度场背景建模都检测到汽车的运 动,但是在第4505帧,当汽车停止不动后,均值滤波和混合高斯依然把静止的汽车检测为运动目标,而本文算法很好的把静止的汽车检测为背景。 t u n n e l v i d e o 视频中共有8005帧,其中3个场景大约5142帧存在遗留车辆。由表3的结果可以看出均值滤波和混合高斯容易受遗留车辆的影响,把 遗留物体误检为运动目标。当加入更新率后,经过 一段时间的背景更新,可以把遗留的车辆学习到背景中,但是受背景学习的影响,非遗留区域容易出现拖影和漏检的现象,尤其当学习率过大时,这种现象严重影响了正常运动目标检测。相比之下,本文方法结合了图像前后帧信息计算背景模型,在物体遗留的短时间内出现少量误报,大部分情况把遗留物体检测为背景。 表3 遗留物体错误检测结果/% T a b .3 T h e r e s u l t s o f w r o n g d e t e c t b a s e do nl e f t o b j e c t s /% 学习率α=0α=0.01α=0.05α=0.1均值滤波10062.2620.1113.56混合高斯10047.5914.6310.22本文方法 3.65 3.65 3.65 3.65 4 结 论 提出了一种融合光流速度的背景建模方法,把光流速度引入背景模型,充分利用了像素的空间信息、时间信息和光流速度信息,更好地描述了背景运动。算法既能从整体上描述背景运动,又能很好地描述每个像素的运动,从而减少了运动背景在运动目标检测中的影响,并能适应背景光照变化、物体丢失和遗留等因素的影响,能得到更加鲁棒的运动目标检测结果。本文算法在多个视频场景上与经典的均值滤波、混合高斯背景建模方法、光流法进行比较,实验结果表明本文提出的融合光流速度场背景建模方法能很好地适应背景光照变化、物体丢失和遗留等因素的影响,在保持较低漏检数的情况下,能 显著地去除运动背景的影响。 融合光流速度的背景建模方法也存在一些不足之处,即当目标区域的颜色特征与具有显著运动的背景区域重叠时,融合光流速度的背景建模方法仍然可能漏检,这是今后将要解决的问题。参考文献(R e f e r e n c e s ) [1] L i L ,L u o R .C o n t e x t -c o n t r o l l e d a d a p t i v e b a c k g r o u n ds u b t r a c t i o n [E B /O L ].[2009-12-3].h t t p ://w w w .c v g .r d g .a c .u k /P E T S 2006/P E T S 2006 P R O C E E D I N G S .p d f . 第2期张水发等:融合光流速度与背景建模的目标检测方法243 [2] W r e nC,A z a r b a y e j a n iA.P f i n d e r:R e a l-t i m et r a c k i n go ft h e h u m a nb o d y[J].I E E E T r a n s a c t i o n so nP a t t e r nA n a l y s i sa n d M a c h i n eI n t e l l i g e n c e,1997,19(7):780-785. [3] Z i v k o v i c Z.I m p r o v e d a d a p t i v e G a u s s i a n m i x t u r e m o d e l f o r b a c k g r o u n ds u b t r a c t i o n[J].P a t t e r n R e c o g n i t i o n,2004,2(17): 28-31. [4] E l g a m m a l A,D u r a i s w a m i R.B a c k g r o u n d a n d f o r e g r o u n d m o d e l i n g u s i n g n o n p a r a m e t r i c k e r n e l d e n s i t y e s t i m a t i o nf o r v i s u a l s u r v e i l l a n c e[E B/O L].[2009-12-3].h t t p://c i t e s e e r x.i s t. p s u.e d u/v i e w d o c/d o w n l o a d?d o i=10.1.1.20.215&r e p= r e p1&t y p e=p d f. [5] S h l e n s J.A t u t o r i a lo n p r i n c i p a lc o m p o n e n ta n a l y s i s[C]// S y s t e m s N e u r o b i o l o g yL a b o r a t o r y.S a nD i e g o,A m e r i c a n:U n i v e r s i t y o f C a l i f o r n i a,2005:1-26. [6] W a n g l i a n g,H uWe i m i n g.As u r v e yo f v i s u a l a n a l y s i s o f h u m a n m o t i o n[J].J o u r n a l o f C o m p u t e r s,2002,25(3):225-237.[王 亮,胡卫明.人运动的视觉分析综述[J].计算机学报, 2002,25(3):225-237.] [7] P a p e n b e r g N,B r u h nA.H i g h l ya c c u r a t e o p t i cf l o wc o m p u t a t i o n w i t h t h e o r e t i c a l l yj u s t i f i e dw a r p i n g[J].I n t e r n a t i o n a l J o u r n a l o f C o m p u t e r V i s i o n,2006,67(2):141-158. [8] B a r r o nJ,F l e e t D.P e r f o r m a n c e o f o p t i c a l f l o wt e c h n i q u e s[J]. I n t e r n a t i o n a l J o u r n a l o f C o m p u t e r V i s i o n,1994,12(1):43-77.[9] B r u h nA,We i c k e r t J.V a r i a t i o n a l o p t i c a l f l o w c o m p u t a t i o ni n r e a l t i m e[J].I m a g eP r o c e s s i n g,I E E ET r a n s a c t i o n s o n,2005, 14(5):608-615. [10] B r u h nA,We i c k e r tJ.L u c a s/K a n a d e M e e t sH o r n/S c h u n c k: C o m b i n i n g l o c a l a n dg l o b a l o p t i c f l o wm e t h o d s[J].I n t e r n a t i o n a l J o u r n a l o f C o m p u t e r V i s i o n,2005,61(3):211-231. [11] H o r nB,S c h u n c kB.D e t e r m i n i n go p t i c a lf l o w[J].A r t i f i c i a l I n t e l l i g e n c e,1981,17(1-3):185-203. [12] Y a n gC h a n g q i n g,Wa n gX i a o t o n g.F a s t p o i n t m a t c h i n gm e t h o d b a s e d o nf e a t u r eo p t i c a l f l o w[J].O p t o-E l e c t r o n i c E n g i n e e r i n g, 2006,33(004):85-88.[杨常清,王孝通.基于特征光流的 角点匹配快速算法[J].光电工程,2006,33(004):85-88.] [13] F e g h a l i R,M i t i c h e A.S p a t i o t e m p o r a l m o t i o nb o u n d a r yd e t e c t i o n a n d m o t i o n b o u n d a r y v e l o c i t y e s t i m a t i o n f o rt r a c k i n gm o v i n g o b j e c t s w i t ham o v i n gc a m e r a:al e v e l s e t s P D E s a p p r o a c hw i t h c o n c u r r e n t c a m e r a m o t i o nc o m p e n s a t i o n[J].I E E ET r a n s a c t i o n s o n I m a g e P r o c e s s i n g,2004,13(11):1473-1490. [14] G a u t a m a T,V a n H u l l e M.A p h a s e-b a s e d a p p r o a c h t o t h e e s t i m a t i o no f t h eo p t i c a lf l o w f i e l du s i n gs p a t i a lf i l t e r i n g[J]. I E E ET r a n s a c t i o n so nN e u r a l N e t w o r k s,2002,13(5):1127- 1136. [15] G r o s s b e r g S,K e l l yF.N e u r a l d y n a m i c s o f b i n o c u l a r b r i g h t n e s s p e r c e p t i o n[J].V i s i o nR e s e a r c h,1999,39(22):3796-3816. 摘要 运动目标检测方法是研究如何完成对视频图像序列中感兴趣的运动目标区域的“准确定位”问题。光流场指图像灰度模式的表面运动,它可以反映视频相邻帧之间的运动信息,因而可以用于运动目标的检测。MATLAB这种语言可移植性好、可扩展性强,再加上其中有丰富的图像处理函数,所以利用MATLAB 软件来用光流法对运动目标的检测中具有很大的优势。本设计主要可以借助matlab软件编写程序,运用Horn-Schunck算法对图像前后两帧进行处理,画出图像的光流场。而图像的光流场每个像素都有一个运动矢量,因此可以反映相邻帧之间的运动,分析图像的光流场就可以得出图像中的运动目标的运动情况。 关键字:光流法;Horn-Schunck算法;matlab 目录 1光流法的设计目的 (1) 2光流法的原理 (1) 2.1光流法的介绍 (1) 2.1.1光流与光流场的概念 (1) 2.1光流法检测运动目标的原理 (2) 2.1.1光流场计算的基本原理 (2) 2.2.2基于梯度的光流场算法 (2) 2.2.3Horn-Schunck算法 (3) 2.2.4光流法检测运动目标物体的基本原理概述 (5) 3光流法的程序具体实现 (6) 3.1源代码 (6) 3.1.1求解光流场函数 (6) 3.1.2求导函数 (9) 3.1.3高斯滤波函数 (9) 3.1.4平滑性约束条件函数 (10) 3.1.5画图函数 (10) 4仿真图及分析 (12) 结论 (13) 参考文献 (14) 1 光流法的设计目的 数字图像处理,就是用数字计算机及其他有关数字技术,对图像进行处理,以达到预期的目的。随着计算机的发展,图像处理技术在许多领域得到了广泛应用,数字图像处理已成为电子信息、通信、计算机、自动化、信号处理等专业的重要课程。 数字图像处理课程设计是在学习完数字图像处理的相关理论后,进行的综合性训练课程,其目的是:使学生进一步巩固数字图像处理的基本概念、理论、分析方法和实现方法;增强学生应用Matlab编写数字图像处理的应用程序及分析、解决实际问题的能力;尝试所学的内容解决实际工程问题,培养学生的工程实践能力。 运动目标检测是数字图像处理技术的一个主要部分,近些年来,随着多媒体技术的迅猛发展和计算机性能的不断提高,动态图像处理技术日益受到人们的青睞,并且取得了丰硕的成果,广泛应用于交通管理、军事目标跟踪、生物医学等领域。 因此,基于光流法,实现运动目标的检测是本文的研究对象。结合图书馆书籍、网上资料以及现有期刊杂志,初步建立起运动目标检测的整体思路和方法。 2 光流法的原理 2.1 光流法的介绍 2.1.1 光流与光流场的概念 光流是指空间运动物体在观测成像面上的像素运动的瞬时速度,它利用图像序列像素强度数据的时域变化和相关性来确定各自像素位置的“运动”,即反映图像灰度在时间上的变化与景物中物体结构及其运动的关系。将二维图像平面特定坐标点上的灰度瞬时变化率定义为光流矢量。视觉心理学认为人与被观察物体 万方数据 万方数据 万方数据 万方数据 万方数据 多传感器信息融合方法综述 作者:吴秋轩, 曹广益 作者单位:上海交通大学电子信息与电气工程学院,上海,200030 刊名: 机器人 英文刊名:ROBOT 年,卷(期):2003,25(z1) 被引用次数:2次 参考文献(5条) 1.周锐;申功勋;房建成基于信息融合的目标图像跟踪 1998(12) 2.张尧庭;桂劲松人工智能中的概率统计方法 1998 3.何友;王国宏;彭应宁多传感器信息融合 2000 4.罗志增;叶明Bayes方法的多感觉信息融合算法及其应用[期刊论文]-传感技术学报 2001(03) 5.张文修;吴伟业;梁吉业粗糙集理论与方法 2001 本文读者也读过(8条) 1.臧大进.严宏凤.王跃才.ZANG Da-jin.YAN Hong-feng.WANG Yue-cai多传感器信息融合技术综述[期刊论文]-工矿自动化2005(6) 2.多传感器信息融合及应用[期刊论文]-电子与信息学报2001,23(2) 3.赵小川.罗庆生.韩宝玲.ZHAO Xiao-chuan.LUO Qing-sheng.HAN Bao-ling机器人多传感器信息融合研究综述[期刊论文]-传感器与微系统2008,27(8) 4.范新南.苏丽媛.郭建甲.FAN Xin-nan.SU Li-yuan.GUO Jian-jia多传感器信息融合综述[期刊论文]-河海大学常州分校学报2005,19(1) 5.咸宝金.陈松涛智能移动机器人多传感器信息融合及应用研究[期刊论文]-宇航计测技术2010,30(2) 6.韩增奇.于俊杰.李宁霞.王朝阳信息融合技术综述[期刊论文]-情报杂志2010,29(z1) 7.肖斌多传感器信息融合及其在工业中的应用[学位论文]2008 8.丁伟.孙华.曾建辉.DING Wei.SUN Hua.ZENG Jian-hui基于多传感器信息融合的移动机器人导航综述[期刊论文]-传感器与微系统2006,25(7) 引证文献(2条) 1.武伟.郭三学基于多传感信息融合的轮胎气压监测系统[期刊论文]-轮胎工业 2006(5) 2.魏东.杨洋.李大寨.宗光华基于多传感器融合的机器人微深度环切[期刊论文]-传感器技术 2005(11) 本文链接:https://www.360docs.net/doc/7e14792445.html,/Periodical_jqr2003z1037.aspx 多传感器数据融合技术的理论及应用 张宁110101256 摘要:多传感器数据融合技术是一门新兴前沿技术。近年来,多传感器数据融合技术已经受到广泛关注,它的理论和方法已经被应用到许多研究领域。本文主要论述了多传感器数据融合的基本概念、工作原理、数据融合特点与结构、数据融合方法及其应用领域,并总结了当前数据融合研究中存在的主要问题及其发展趋势。 关键词:多传感器;数据融合;融合方法 1引言 多传感器数据融合是一个新兴的研究领域,是针对一个系统使用多种传感器这一特定问题而展开的一种关于数据处理的研究。多传感器数据融合技术是近几年来发展起来的一门实践性较强的应用技术,是多学科交叉的新技术,涉及到信号处理、概率统计、信息论、模式识别、人工智能、模糊数学等理论。近年来,多传感器数据融合技术无论在军事还是民事领域的应用都极为广泛。多传感器数据融合技术已成为军事、工业和高技术开发等多方面关心的问题。这一技术广泛应用于复杂工业过程控制、机器人、自动目标识别、交通管制、惯性导航、海洋监视和管理、农业、医疗诊断、模式识别等领域。实践证明:与单传感器系统相比,运用多传感器数据融合技术在解决探测、跟踪和目标识别等问题方面,能够增强系统生存能力,提高整个系统的可靠性和鲁棒性,增强数据的可信度,并提高精度,扩展整个系统的时间、空间覆盖率,增加系统的实时性和信息利用率等。 2基本概念及融合原理 2.1多传感器数据融合概念 数据融合又称作信息融合或多传感器数据融合,对数据融合还很难给出一个统一、全面的定义。随着数据融合和计算机应用技术的发展,根据国内外研究成果,多传感器数据融合比较确切的定义可概括为:充分利用不同时间与空间的多传感器数据资源,采用计算机技术对时间序列获得的多传感器观测数据,在一定准则下进行分析、综合、支配和使用,获得对被测对象的一致性解释与描述,进而实现相应的决策和估计,使系统获得比它的各组成部分更充分的信息。 运动序列目标检测算法研究及DSP实现 李文艳,王月琴,张笑微 (西南科技大学信息工程学院四川绵阳621010) 摘要:由于实际场景的多样性,目前常用的运动目标检测算法都还存在一定程度的缺陷,因此本文提出了一种将帧差法和背景减法相结合的方法,实现快速精确地检测和提取运动目标。实验结果表明,本方法是比较实用的,能较好满足实时视频监控系统的要求。最后将程序移植到基于DSP的平台上,进行相应的优化后基本满足了实时性的要求。 关键词:目标检测;帧差法;背景减法 中图分类号:TP751.1 文献标识码:A Algorism Research of Moving Object Detection and DSP Implementation LI Wen-yan,WANG Yue-qin,ZHANG Xiao-wei (Southwest University of Science and Technology Mianyang Sichuan China 621010) Abstract: Because of the environment’s variety, the methods that have been used for moving object detection need to be improved. An algorithm based on two consecutive frames subtraction and background subtraction is presented and it can detect and extract object quickly and accurately. The results show that the proposed method is a practical one. It can meet the need of the real time video surveillance and monitoring system. The coding is transplanted in DSP, and the project is executed successfully on CCS simulator. Keywords: Object detection; Frames subtraction; Background subtraction 引言 运动目标的检测在智能监控等领域中得到了广泛的应用。运动目标的检测就是从视频流中去除静止背景提取出运动的目标,运动目标的有效分割对跟踪等后期处理非常关键。 本文提出了将帧间差分和背景减法相结合的方法。首先选取一帧作为背景帧, 建立各像素点的高斯模型。再运用帧间差分法对相邻两帧图像进行差分处理, 区分出背景点和变化的区域。然后将变化区域与背景帧的对应区域进行模型拟合区分出显露区和运动物体。 1 运动目标检测算法总体流程 采用帧间差分与背景减法相结合的算法进行运动目标检测,包括运动目标的检测和将检测到的运动目标从背景中分割出来两部分,其系统框架流程图如图1所示。 图1 运动目标检测流程图 这种设计充分利用了被检测区域部分时间静止的特点,具有智能检测的功能,它只在检 多传感器数据融合 多传感器数据融合1引言数据融合一词最早出现在20世纪70年代末期。几十年来,随着传感器技术的迅速发展,尤其在军事指挥系统中对提高综合作战能力的迫切要求,使其得到了长足的发展。其早期主要是应用在军事上,而随着工业系统的复杂化和智能化,近年来该技术推广到了民用领域,如医疗诊断、空中交通管制、工业自动控制及机械故障诊断等。数据融合是针对一个系统中使用多个传感器这一问题而展开的一种信息处理的新的研究方向,所以数据融合也称为传感器融合。数据融合一直没有一个统一的定义,一般认为:利用计算机技术,对按时间顺序获得的若干传感器的观测信息,在一定的准则下加以自动分析、综合,从而完成所需要的决策和估计任务而进行的信息处理过程称为数据融合。2 数据融合技术的分类多传感器数据融合涉及到多方面的理论和技术如信号处理、估计理论、不确定性理论、模式识别最优化技术、神经网络和人工智能等。很多学者从不同角度出发提出了多种数据融合技术方案。从技术原理角度,可分为假设检验型数据融合、滤波跟踪型数据融合、聚类分析型数据融合、模式识别型数据融合、人工智能型数据融合等;按判决方式分有硬判决型和软判决型数据融合;按传感器的类型分有同类传感器数据融合和异类传感器数据融合按对数据的处理方式,可分为象素级融合、特征级融合和决策级融合;从方法来分有Bayes推理法、表决法、D-S 推理法、神经网络融合法等。从解决信息融合问题的指导思想或哲学观点加以划分,可分为嵌入约束观点、证据组合观点和人工神经网络观点三大类。3常用的数据融合方法数据融合方法种类繁多,图1归纳了常用的一些信息融合方法。估计方法 摘要 由于计算机技术的迅猛发展,使得基于内容的视频信息的存取、操作和检索不仅成为一种可能,更成为一种需要。同时,基于内容的视频编码标准MPEG-4和基于内容的视频描述标准MPEG-7正在发展和完善。因此提取和视频中具有语义的运动目标是一个急需解决的问题。运动目标提取和检测作为视频和图像处理领域的重要研究领域,有很强的研究和应用价值。运动检测就是将运动目标从含有背景的图像中分离出来,如果仅仅依靠一种检测算法,难以从复杂的自然图像序列中完整地检测出运动的目标。较高的检测精度和效率十分重要,因此融合多种检测方法的研究越来越受到重视。本文介绍了几种国内外文献中的经典的视频运动目标的检测和提取算法,并对各种方法进行了评价和总结。首先介绍了基本的运动目标检测的基本知识和理论,然后介绍了基本的几种目标检测方法及其各种改进方法。对今后的运动目标检测提取的相关研究提供一定的参考。 关键词:运动目标检测光流法帧差法背景建模方法 ABSTRACT Because of the rapid development of computer technology, it is possible to access, operate and retrieve the video information based on the content of the video. At the same time, based on the content of the video coding standard MPEG-4 and content-based video description standard MPEG-7 is developing and improving. Therefore, it is an urgent problem to be solved in the extraction and video. Moving object extraction and detection is a very important field of video and image processing, and has a strong research and application value. Motion detection is to separate moving objects from the image containing background, if only rely on a detection algorithm, it is difficult to from a complex natural image sequences to detect moving target. Higher detection accuracy and efficiency are very important, so the study of the fusion of multiple detection methods is becoming more and more important. In this paper, the detection and extraction algorithms of the classical video moving objects in the domestic and foreign literatures are introduced, and the methods are evaluated and summarized. Firstly, the basic knowledge and theory of basic moving target detection is introduced, and then the basic method of target detection is introduced. To provide a reference for the research on the extraction of moving target detection in the future. Keywords: Visual tracking Optical flow method Frame Difference Background modeling method 一、背景介绍: 多传感器数据融合是一种信号处理、辨识方法,可以与神经网络、小波变换、kalman 滤波技术结合进一步得到研究需要的更纯净的有用信号。 多传感器数据融合涉及到多方面的理论和技术,如信号处理、估计理论、不确定性理论、最优化理论、模式识别、神经网络和人工智能等。多传感器数据融合比较确切的定义可概括为:充分利用不同时间与空间的多传感器数据资源,采用计算机技术对按时间序列获得的多传感器观测数据,在一定准则下进行分析、综合、支配和使用,获得对被测对象的一致性解释与描述,进而实现相应的决策和估计,使系统获得比它的各组成部分更充分的信息。 多传感器信息融合技术通过对多个传感器获得的信息进行协调、组合、互补来克服单个传感器的不确定和局限性,并提高系统的有效性能,进而得出比单一传感器测量值更为精确的结果。数据融合就是将来自多个传感器或多源的信息在一定准则下加以自动分析、综合以完成所需的决策和估计任务而进行的信息处理过程。当系统中单个传感器不能提供足够的准确度和可靠性时就采用多传感器数据融合。数据融合技术扩展了时空覆盖范围,改善了系统的可靠性,对目标或事件的确认增加了可信度,减少了信息的模糊性,这是任何单个传感器做不到的。 实践证明:与单传感器系统相比,运用多传感器数据融合技术在解决探测、跟踪和目标识别等问题方面,能够增强系统生存能力,提高整个系统的可靠性和鲁棒性,增强数据的可信度,并提高精度,扩展整个系统的时间、空间覆盖率,增加系统的实时性和信息利用率等。信号级融合方法最简单、最直观方法是加权平均法,该方法将一组传感器提供的冗余信息进行加权平均,结果作为融合值,该方法是一种直接对数据源进行操作的方法。卡尔曼滤波主要用于融合低层次实时动态多传感器冗余数据。该方法用测量模型的统计特性递推,决定统计意义下的最优融合和数据估计。 多传感器数据融合虽然未形成完整的理论体系和有效的融合算法,但在不少应用领域根据各自的具体应用背景,已经提出了许多成熟并且有效的融合方法。多传感器数据融合的常用方法基本上可概括为随机和人工智能两大类,随机类方法有加权平均法、卡尔曼滤波法、多贝叶斯估计法、产生式规则等;而人工智能类则有模糊逻辑理论、神经网络、粗集理论、专家系统等。可以预见,神经网络和人工智能等新概念、新技术在多传感器数据融合中将起到越来越重要的作用。 数据融合存在的问题 (1)尚未建立统一的融合理论和有效广义融合模型及算法; (2)对数据融合的具体方法的研究尚处于初步阶段; (3)还没有很好解决融合系统中的容错性或鲁棒性问题; (4)关联的二义性是数据融合中的主要障碍; (5)数据融合系统的设计还存在许多实际问题。 二、算法介绍: 2.1多传感器数据自适应加权融合估计算法: 设有n 个传感器对某一对象进行测量,如图1 所示,对于不同的传感器都有各自不同的加权因子,我们的思想是在总均方误差最小这一最优条件下,根据各个传感器所得到的测量值以自适应的方式寻找各个传感器所对应的最优加权因子,使融合后的X值达到最优。 专业综合实践任务书 学生姓名:________专业班级: 指导教师: 工作单位: 信息工程学院 题目:检测交通视频中运动目标的程序设计 初始条件: (1)提供实验室机房及其matlab软件; (2)数字图像处理的基本理论学习。 要求完成的主要任务:(包括课程设计工作量及其技术要求,以及说明书撰写等具体 要求): (1)学习运动目标检测的原理及方法,并利用matlab设计程序完成以下功能;(2)读取交通视频文件; (3)运用一种背景建模方法,提取背景图像; (4)读取一帧有运动目标的图像,利用背景差分法,得到差分区域; (5)对差分区域进行数学形态学处理,得到完整的运动目标区域,并显示运动目标检测结果图; (6)对检测的结果进行分析比较; (7)要求阅读相关参考文献不少于5篇; (8)根据课程设计有关规范,按时、独立完成课程设计说明书。 时间安排: (1) 布置课程设计任务,查阅资料,确定方案 1.5天; (2) 进行编程设计、调试2天; (3) 完成课程设计报告书、答辩 1.5天; 指导教师签名: 年月日系主任(或责任教师)签名: 年月日 目录 摘要 (1) 1.概述 (2) 2.设计原理 (3) 2.1 背景提取与更新算法 (3) 2.1.1 手动背景法 (4) 2.1.2 统计中值法 (4) 2.1.3 算术平均法 (4) 2.1.4 Surendra算法 (5) 2.2 背景差分法运动目标检测 (6) 2.3 形态学滤波 (7) 2.4总体方案设定 (9) 2.4.1 算术平均法与Surendra算法相结合的背景建模 (9) 2.4.2 总体程序框图 (10) 3.软件编程实现 (11) 4.结果及分析 (13) 5.心得体会 (17) 参考文献 (18) 研究生课程论文 《光流法运动目标跟踪》 课程名称s 姓名 学号 专业 任课教师 教师评阅意见: 论文成绩评阅日期 课程论文提交时间:年月日 摘要本文实现了对运动目标的跟踪检测,重点研究金字塔Lucas-Kanade算法,在研究基于特征点的目标跟踪的一般方法,即采用改进的Harris角点提取点的方法。实验结果表明先采用Shi-Tomasi算法比Harris算法提取角点效果更好,之后用金字塔光流进行跟踪。 关键词运动目标跟踪Lucas-Kanade Shi-Tomasi 改进Harris 1.引言 近些年,模式识别领域的图像处理已经成为一个支柱,其中,动态目标的识别跟踪已经被研究者应用到工程上,而运动目标跟踪算法的优劣直接影响着运动目标跟踪的稳定性和精确性。本文主要是运动光流法等算法对运动目标进行跟踪。目标特征点的跟踪是计算机视觉中的一个基本而极具挑战性的研究课题,该课题在人机互动(HCI),目标识别,目标运动等领域有着非常重要的应用。虽然对运动目标跟踪算法能够完成对运动目标的可靠跟踪,大多数都存在处理数据量大,运算复杂等问题。因此,研究具有高精度且运算简单的目标检测与跟踪算法是图形跟踪迫切需要解决的问题,目前基于特征和光流的图像跟踪方法受到了极大的关注。 2.运动目标检测算法 运动目标检测技术是目标自动检测、识别与跟踪的基础,也是实现进一步处理视频编码、目标跟踪、目标分类及行为理解等的关键技术。基于视频或序列图像的分析一般可分为四个步骤:(1)运动目标的检测与提取,(2)运动目标的分类,(3)运动目标的跟踪,(4)运动目标的行为理解与分析,如图1所示。 图像序列运动检测目标分类目标跟踪行为理解 图1 分析过程 在计算机视觉处理中,运动目标检测技术处于中层处理级别,它是指在一个视频或者图像中,对需要研究的并且是处于运动状态的目标和背景进行分离,对于行为理解,行为分析等其他技术的研究,运动目标检测也是一种有效的方法。 目标检测要依据运动目标的主要特性,例如时间特性、边缘形状特性、颜色灰度特性、矢量特性等等。时间特性、区域作为视频序列时间差分和图像分割的基础,是运动目标最基本的特性。目标运动时在形状、大小、刚度等方面的差异称为形态特征,利用形态特征对运动目标检测,难点是对小目标的检测。 3.光流法 1950年,Gibuson首先提出了光流的概念,所谓光流就是指图像表现运动的速度。物体在运动的时候之所以能被人眼发现,就是因为当物理运动时,会在人的视网膜上形成一系列的连续变化的图像,这些变化信息在不同时间,不断的流过眼睛视网膜,就好像一种光流过一 运动检测(移动侦测)原理 一、引言 随着技术的飞速发展,人们对闭路电视监控系统的要求越来越高,智能化在监控领域也得到越来越多的应用。在某些监控的场所对安全性要求比较高,需要对运动的物体进行及时的检测和跟踪,因此我们需要一些精确的图像检测技术来提供自动报警和目标检测。运动检测作为在安防智能化应用最早的领域,它的技术发展和应用前景都受到关注。 运动检测是指在指定区域能识别图像的变化,检测运动物体的存在并避免由光线变化带来的干扰。但是如何从实时的序列图像中将变化区域从背景图像中提取出来,还要考虑运动区域的有效分割对于目标分类、跟踪等后期处理是非常重要的,因为以后的处理过程仅仅考虑图像中对应于运动区域的像素。然而,由于背景图像的动态变化,如天气、光照、影子及混乱干扰等的影响,使得运动检测成为一项相当困难的工作。 二、运动检测(移动侦测)原理 早期的运动检测如MPEG1是对编码后产生的I帧进行比较分析,通过视频帧的比较来检测图像变化是一种可行的途径。原理如下:MPEG1视频流由三类编码帧组成,它们分别是:关键帧(I 帧),预测帧(P帧)和内插双向帧(B帧)。I帧按JPEG标准编码,独立于其他编码帧,它是MPEG1视频流中唯一可存取的帧,每12帧出现一次。截取连续的I帧,经过解码运算,以帧为单位连续存放在内存的缓冲区中,再利用函数在缓冲区中将连续的两帧转化为位图形式,存放在另外的内存空间以作比较之用,至 于比较的方法有多种。此方法是对编码后的数据进行处理,而目前的MPEG1/MPEG4编码都是有损压缩,对比原有的图像肯定存在误报和不准确的现象。 目前几种常用的方法: 1.背景减除(Background Subtraction ) 背景减除方法是目前运动检测中最常用的一种方法,它是利用当前图像与背景图像的差分来检测出运动区域的一种技术。它一般能够提供最完全的特征数据,但对于动态场景的变化,如光照和外来无关事件的干扰等特别敏感。最简单的背景模型是时间平均图像,大部分的研究人员目前都致力于开发不同的背景模型,以期减少动态场景变化对于运动分割的影响。 2.时间差分(Temporal Difference ) 时间差分(又称相邻帧差)方法是在连续的图像序列中两个或三个相邻帧间采用基于像素的时间差分并且阈值化来提取出图像中的运动区域。时间差分运动检测方法对于动态环境具有较强的自适应性,但一般不能完全提取出所有相关的特征像素点,在运动实体内部容易产生空洞现象。 3.光流(Optical Flow) 基于光流方法的运动检测采用了运动目标随时间变化的光流特性,如Meyer[2] 等通过计算位移向量光流场来初始化基于轮廓的跟踪算法,从而有效地提取和跟踪运动目标。该方法的优点是在摄像机运动存在的前提下也能检测出独立的运动目标。然而, 视频图像中运动目标检测方法研究 毕业论文 题目视频图像中运动目标检测 方法研究 摘要 在很多现代化领域,运动目标检测都显示出了其重要的作用。尤其是近二十年的社会经济的飞速发展,运动目标检测都彰显了其重要性,在航空、通信、航海等各个方面都有关键性的作用,从而使运动目标检测方法的研究成为各国的研究热门课题。 通过阅读大量的相关论文、期刊及其网络资源,了解了高斯背景建模及背景更新的基本原理及思想。在本文中,首先介绍了运动目标检测方法的相关基础知识,如图像的二值化、图像的形态学处理、颜色空间模型。然后重点说明了三种常用的运动目标检测方法的研究,简要阐述了三种研究方法的基本思想。在老师的帮助下进行了相应的实验,最终得出了三种运动目标检测方法的优点和缺点,着重探究了高斯背景建模及其背景更新基本原理及思想。 最后,通过相关的程序及软件对混合高斯背景模型进行了相关的实验,进而发现了混合高斯背景建模算法存在的不足之处,如:高斯背景建模的计算量大、运动目标较大时检测效果差等问题,并对对这些问题提出了相关设想及改进。 关键词:运动目标检测;二值化;图像的形态学处理;高斯背景建模;背景更新 I ABSTRACT In many modern fields, moving target detection are showing its important role. Especially nearly twenty years of rapid development of social economy, the moving target detection has shown its importance, in various aviation, communication, navigation and so on have a key role, so the study of moving target detection method has become a research hot topic in countries. By reading relevant papers, a large number of journals and cyber source, understand the basic principle and thought of Gauss background modeling and updating the background. In this paper, firstly introduces the basic knowledge of moving target detection method, such as the two values image, morphological image processing, color space model. Then focus on the study of three methods used for moving object detection, a brief description of the basic ideas of the three kinds of research methods. By the experiment, the results of three kinds of method of moving target detection has advantages and disadvantages, this paper emphatically explores Gauss background modeling and background updating basic principle and thought. Finally, through the program and software related to mixed Gauss background model for the relevant experiments, and found the shortcomings, the presence of mixed Gauss background modeling algorithm such as: the problem of computing Gauss background modeling, moving target volume larger detection effect is poor, and on these problems put forward relevant ideas and improvement. Keywords: moving object detection; two values; I I 运动目标检测之Lucas-Kanade光流算法读书笔记 视觉是人类感知自身周围复杂环境最直接有效的手段之一,而在现实生活中大量有意义的视觉信息都包含在运动中,人眼对运动的物体和目标也更敏感,能够快速的发现运动目标。随着计算机技术、通信技术、图像处理技术的不断发展,计算机视觉己成为目前的热点研究问题之一。而运动目标检测是计算机视觉研究的核心课题之一,融合了图像处理、模式识别、人工智能、自动控制、计算机等众多领域的先进技术,在军事制导、视觉导航、视频监控、智能交通、医疗诊断、工业产品检测等方面有着重要的实用价值和广阔的发展前景。 一目标检测 运动目标检测运动目标检测是指从序列图像中将运动的前景目标从背景图像中提取出来。目前,已有的运动目标检测方法按照算法的基本原理可以分为三类:背景差分法,帧间差分法和光流法。 1背景差分法 背景差分法又称背景减除法,背景差分法的原理是将当前帧与背景图像进行差分来得到运动目标区域,但是需要构建一幅背景图像,这幅背景图像必须不含运动目标,并且应该能不断的更新来适应当前背景的变化,构建背景图像的方法有很多,比较常用的有基于单个高斯模型的背景构建,基于混合高斯模型的背景构建,基于中值滤波器的背景构造,基于卡尔曼滤波器的背景构造,基于核函数密度估计的背景模型构造。 缺点:因为要求背景是静止的,所以背景的变化,场景中有很多干扰,比如场景中有树枝和叶子在风中晃动、水面的波动等等,还有照明的变化和天气的变化等都可能影响检测的结果 2帧间差分法 帧间差分法是一种通过对视频图像序列中相邻两帧作差分运算来获得运动目标轮廓的方法,它可以很好地适用于存在多个运动目标和摄像机移动的情况。当监控场景中出现异常物体运动时,帧与帧之间会出现较为明显的差别,两帧相减,得到两帧图像亮度差的绝对值, 1 绪论 课题研究背景及意义 运动目标检测是图像处理与计算机视觉的一个分支,在理论和实践上都有重大意义,长久以来一直被国内外学者所关注。在实际中,视频监控利用摄像机对某一特定区域进行监视,是一个细致和连续的过程,它可以由人来完成,但是人执行这种长期枯燥的例行监测是不可靠,而且费用也很高,因此引入运动监测非常有必要[1]。它可以减轻人的负担,并且提高了可靠性。概括起来运动监测主要包括三个内容[2]:运动目标检测,方向判断和图像跟踪。运动目标检测是整个监测过程的基础,运动目标的提取准确与否,直接关系到后续高级过程的完成质量。 国内外研究现状 运动目标检测在国外已经取得了一些的研究成果[3],许多相关技术已经开始应用到实际系统中,但是国内研究相对落后,与国外还有较大差距。传统的视频目标提取大致可以分两类,一类以空间同性为准则,先用形态学滤波器或其他滤波器对图像作预处理;然后对该图像的亮度、色度或其他信息作空间上的分割以对区域作边缘检测;之后作运动估计,并合并相似的运动区域以得到最终的提取结果。如光流算法、主动轮廓模型算法。此类方法结果较为准确但是运算量相对较大。另一类算法主要以时间变化检测作为准则,这类算法主要通过帧差检测图像上的变化区域和不变区域,将运动物体与静止背景进行分割。此类方法运算量小,提取结果不如前类方法准确。此外,还有时空结合方法、时空亮度梯度信息结合的方法等等[4]。本文将围绕以时间变化监测为基础的方法展开分析和讨论。 本文结构 第1章介绍了本文的研究意义及国内外发展状况;第2章分为四个部分详细讲述了运动目标检测的方法,介绍了背景提取与更新算法,检测算法,阈值选取,形态学滤波等;第三章对全文作出了总结。 帧差法、光流法、背景减除法 运动目标检测是指在序列图像中检测出变化区域并将运动目标从背景图像中提取出来。通常情况下,目标分类、跟踪和行为理解等后处理过程仅仅考虑图像中对应于运动目标的像素区域,因此运动目标的正确检测与分割对于后期处理非常重要然而,由于场景的动态变化,如天气、光照、阴影及杂乱背景干扰等的影响,使得运动目标的检测与分割变得相当困难。根据摄像头是否保持静止,运动检测分为静态背景和运运动目标检测是指在序列图像中检测出变化区域并将运动目标从背景图像中提取出来。通常情况下,目标分类、跟踪和行为理解等后处理过程仅仅考虑图像中对应于运动目标的像素区域,因此运动目标的正确检测与分割对于后期处理非常重要然而,由于场景的动态变化,如天气、光照、阴影及杂乱背景干扰等的影响,使得运动目标的检测与分割变得相当困难。根据摄像头是否保持静止,运动检测分为静态背景和运动背景两类。大多数视频监控系统是摄像头固定的,因此静态背景下运动目标检测算法受到广泛关注,常用的方法有帧差法、光流法、背景减除法等。 (l)帧差法 帧差法是最为常用的运动目标检测和分割方法之一,基本原理就是在图像序列相邻两帧或三帧间采用基于像素的时间差分通过闭值化来提取出图像中的运动区域。首先,将相邻帧图像对应像素值相减得到差分图像,然后对差分图像二值化,在环境亮度变化不大的情况下,如果对应像素值变化小于事先确定的阂值时,可以认为此处为背景像素:如果图像区域的像素值变化很大,可以认为这是由于图像中运动物体引起的,将这些区域标记为前景像素,利用标记的像素区域可以确定运动目标在图像中的位置。由于相邻两帧间的时间间隔非常短,用前一帧图像作为当前帧的背景模型具有较好的实时性,其背景不积累,且更新速度快、算法简单、计算量小。算法的不足在于对环境噪声较为敏感,闽值的选择相当关键,选择过低不足以抑制图像中的噪声,过高则忽略了图像中有用的变化。对于比较大的、颜色一致的运动目标,有可能在目标内部产生空洞,无法完整地提取运动目标。 (2)光流法 光流法的主要任务就是计算光流场,即在适当的平滑性约束条件下,根据图像序列的时空梯度估算运动场,通过分析运动场的变化对运动目标和场景进行检测与分割。通常有基于全局光流场和特征点光流场两种方法。最经典的全局光流场计算方法是L-K(Lueas&Kanada)法和H-S(Hom&Schunck)法,得到全局光流场后通过比较运动目标与背景之间的运动差异对运动目标进行光流分割,缺点是计算量大。特征点光流法通过特征匹配求特征点处的流速,具有计算量小、快速灵活的特点,但稀疏的光流场很难精确地提取运动目标的形状。总的来说,光流法不需要预先知道场景的任何信息,就能够检测到运动对象,可处理背景运动的情况,但噪声、多光源、阴影和遮挡等因素会对光流场分布的计算结果造成严重影响;而且光流法计算复杂,很难实现实时处理。 (3)背景减除法 背景减除法是一种有效的运动对象检测算法,基本思想是利用背景的参数模型来近似背景图像的像素值,将当前帧与背景图像进行差分比较实现对运动区域的检测,其中区别较大的像素区域被认为是运动区域,而区别较小的像素区域被认为是背景区域。背景减除法必须要有背景图像,并且背景图像必须是随着光照或外部环境的变化而实时更新的,因此背景减除法的关键是背景建模及其更新。针对如何建立对于不同场景的动态变化均具有自适应性的背景模型,减少动态场景变化对运动分割的影响,研究人员已提出了许多背景建模算法,但总的来讲可以概括为非回归递推和回归递推两类。非回归背景建模算法是动态的利用从某一时刻开始到当前一段时间内存储的新近观测数据作为样本来进行背景建模。非回归背景建模方法有最简单的帧间差分、中值滤波方法、Toyama等利用缓存的样本像素来估计背景模型 多传感器数据融合技术 摘要:介绍多传感器数据融合技术的历史与研究现状,给出多传感器数据融合实现方法,最后给出应用和多传感器数据融合的不足与研究展望。 1 引言 多传感器数据融合是信息领域一个前景广阔的研究方向,世界各国都有学者和技术人员在开展数据融合技术的研究,我国对数据融合方面的研究也日益重视,国家自然科学基金和“863”计划已将其列入重点支持项目,因此,对多传感器数据融合进行学术与工程应用的研究具有重要意义[1]。 多传感器数据融合技术是对多种信息的获取、表示及其内在联系进行综合处理和优化的技术。多传感器数据融合技术从多信息的视角进行处理及综合,得到各种信息的内在联系和规律,从而剔除无用的和错误的信息,保留正确的和有用的成分,最终实现信息的优化,它也为智能信息处理技术的研究提供了新的观念。数据融合作为一门跨学科的综合信息处理理论,涉及系统论、信息论、控制论、人工智能和计算机通信等众多的领域和学科[2]。 本文介绍数据融合技术发展历史与研究现状,描述数据融合技术的几种典型实现方法,给出数据融合技术的主要应,最后对数据融合技术研究中存在的问题和发展前景进行了论述。 2 多传感器数据融合技术概述 2.1 数据融合的定义 数据融合也称为信息融合,它的定义有很多。Mango lini将数据融合定义为:一套利用具有不同性质的各种源数据的方法、工具、方式,目的是提高所需信息的质量,此定义着重于融合的方法。Hall 和Llinas的定义是“数据融合技术是将来自多传感器和相关数据库的有关信息进行综合,以得到精度上的改善和更加具体的推断,而这些也可以通过单个传感器来得到”。这种定义虽然提到了数据信息的质量,但是仍注重于方法。美国国防部定义为“数据融合是一个多级、多方面的过程,这个过程处理自动识别、连结、相关、估计以综合多源数据和信息.。”这一定义简单地说就是“处理自动识别、连结、相关、估计 运动目标检测光流法文件编码(008-TTIG-UTITD-GKBTT-PUUTI-WYTUI-8256) 摘要运动目标检测方法是研究如何完成对视频图像序列中感兴趣的运动目标区域的“准确定位”问题。光流场指图像灰度模式的表面运动,它可以反映视频相邻帧之间的运动信息,因而可以用于运动目标的检测。MATLAB这种语言可移植性好、可扩展性强,再加上其中有丰富的图像处理函数,所以利用MATLAB软件来用光流法对运动目标的检测中具有很大的优势。本设计主要可以借助matlab软件编写程序,运用Horn-Schunck 算法对图像前后两帧进行处理,画出图像的光流场。而图像的光流场每个像素都有一个运动矢量,因此可以反映相邻帧之间的运动,分析图像的光流场就可以得出图像中的运动目标的运动情况。 关键字:光流法;Horn-Schunck算法;matlab 目录 1 光流法的设计目的 数字图像处理,就是用数字计算机及其他有关数字技术,对图像进行处理,以达到预期的目的。随着计算机的发展,图像处理技术在许多领域得到了广泛应用,数字图像处理已成为电子信息、通信、计算机、自动化、信号处理等专业的重要课程。 数字图像处理课程设计是在学习完数字图像处理的相关理论后,进行的综合性训练课程,其目的是:使学生进一步巩固数字图像处理的基本概念、理论、分析方法和实现方法;增强学生应用Matlab编写数字图像处理的应用程序及分析、解决实际问题的能力;尝试所学的内容解决实际工程问题,培养学生的工程实践能力。 运动目标检测是数字图像处理技术的一个主要部分,近些年来,随着多媒体技术的迅猛发展和计算机性能的不断提高,动态图像处理技术日益受到人们的青睐,并且取得了丰硕的成果,广泛应用于交通管理、军事目标跟踪、生物医学等领域。 因此,基于光流法,实现运动目标的检测是本文的研究对象。结合图书馆书籍、网上资料以及现有期刊杂志,初步建立起运动目标检测的整体思路和方法。 2 光流法的原理 光流法的介绍 光流与光流场的概念 光流是指空间运动物体在观测成像面上的像素运动的瞬时速度,它利用图像序列像素强度数据的时域变化和相关性来确定各自像素位置的“运动”,即反映图像灰度在时间上的变化与景物中物体结构及其运动的关系。将二维图像平面特定坐标点上的灰度瞬时变化率定义为光流矢量。视觉心理学认为人与被观察物体发生相对运动时,被观察物体表面运动目标检测光流法

多传感器信息融合方法综述

多传感器数据融合技术的理论及应用

运动序列目标检测算法研究及 DSP 实现

多传感器数据融合

运动目标检测方法总结报告

多传感器数据融合算法.

检测交通视频中运动目标的程序设计

光流法运动目标跟踪论文

运动目标检测原理

视频图像中运动目标检测方法研究

LK光流算法总结

基于matlab的运动目标检测

帧差法、光流法、背景减除法

多传感器数据融合技术

运动目标检测光流法