模式识别考试重点汇总——王

第一章

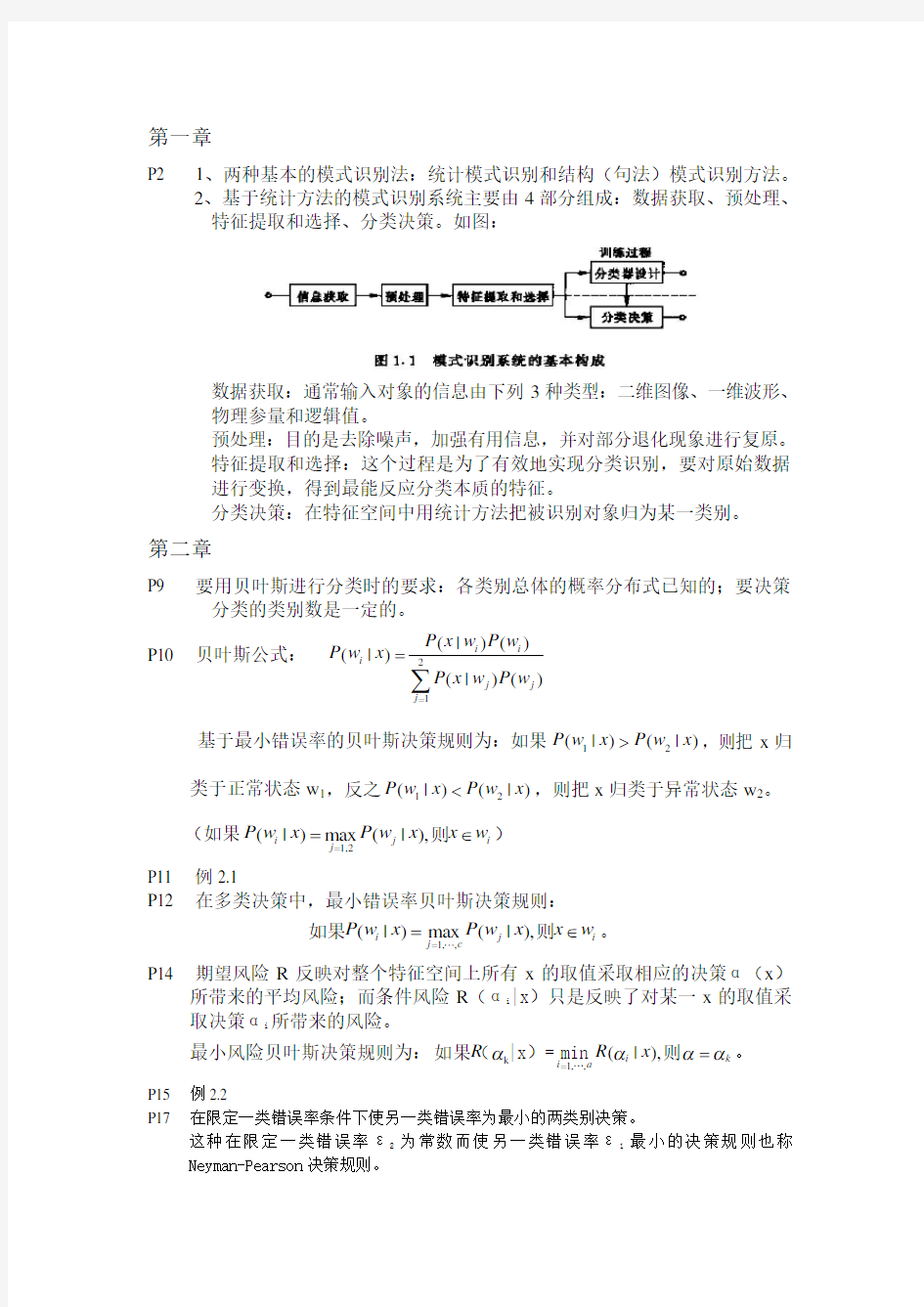

P2 1、两种基本的模式识别法:统计模式识别和结构(句法)模式识别方法。 2、基于统计方法的模式识别系统主要由4部分组成:数据获取、预处理、

特征提取和选择、分类决策。如图:

数据获取:通常输入对象的信息由下列3种类型:二维图像、一维波形、物理参量和逻辑值。

预处理:目的是去除噪声,加强有用信息,并对部分退化现象进行复原。 特征提取和选择:这个过程是为了有效地实现分类识别,要对原始数据进行变换,得到最能反应分类本质的特征。

分类决策:在特征空间中用统计方法把被识别对象归为某一类别。

第二章

P9 要用贝叶斯进行分类时的要求:各类别总体的概率分布式已知的;要决策

分类的类别数是一定的。

P10 贝叶斯公式: 2

1

(|)()

(|)

(|)()

i i

i j

j

j P x w P w P w x P x w

P w ==∑ 基于最小错误率的贝叶斯决策规则为:如果12(|)(|)P w x P w x >,则把x 归类于正常状态w 1,反之12(|)(|)P w x P w x <,则把x 归类于异常状态w 2。 (如果1,2

(|)max (|),i j i j P w x P w x x w ==∈则)

P11 例2.1

P12 在多类决策中,最小错误率贝叶斯决策规则:

1,,(|)max (|),i j i j c

P w x P w x x w ==∈如果则。

P14 期望风险R 反映对整个特征空间上所有x 的取值采取相应的决策α(x )

所带来的平均风险;而条件风险R (αi |x )只是反映了对某一x 的取值采取决策αi 所带来的风险。

最小风险贝叶斯决策规则为:k 1,,(|),i k i a

R R x αααα==如果(

|x )=min 则。 P15 例2.2

P17 在限定一类错误率条件下使另一类错误率为最小的两类别决策。

这种在限定一类错误率ε2为常数而使另一类错误率ε1最小的决策规则也称

Neyman-Pearson 决策规则。

P22 分类设计器两类情况下的判别函数

定义一个判别函数:12g()()()x g x g x =-,并将决策规则表示为:如果g (x )>0,

则决策w 1,g (x )<0,则决策w 2。

P31 最小距离分类器:若c 类的先验概率2(),1,

,P w i c =都相等,若要对观察x 进行分

类,只要计算x 到各类均值μ

i

的欧式距离平方2

i

x μ-,然后把x 归于具有的

2

1,,min i i c

x μ=-分类。

第三章

P46 从样本集推断总体概率分布的方法可归结为以下三类:

1、监督参数估计——样本所属的类别及类条件总体概率密度函数的形式

为已知,而表征概率密度函数的某些参数是未知的。

2、非监督参数估计——已知总体概率密度函数形式但未知样本所属类别,

要求推断出概率密度函数的某些参数。

3、非参数估计——已知样本所属类别,但未知总体概率密度函数的形式,

要求我们直接推断出概率密度函数本身。

第四章

P83 设计线性判别函数的几个准则:Fisher 准则,感知准则,最小错分样本数

准则,最小平方误差(MSE )准则和最小错误率线性判别函数准则。 P84 对两类问题的线性分类器可以采用以下决策规则: 令12()()()g x g x g x =-,如果1()0,g x x w >∈则决策,

如果2()0,g x x w <∈则决策,

如果()0g x =,可将x 任意分到某一类或拒绝。

P87 设计线性分类器的主要步骤:

1、 要有一组具有类别标志的样本集{}12,,

,N X x x x =。

2、要根据实际情况确定一个准则函数J ,它必须满足:(1)J 是样本集X 和w 、w 0

和a 的函数;(2)J 的值反映分类器的性能,它的极值解则对应于“最好”的决策。 3、用最优化技术求出准则函数的极值解w*和w 0*或a*。

4、这样就可以得到线性判别函数g (x )=*

0*)(w x w x g T +=或g(x)= y a T *。

Fisher 原理:我们考虑把d 维空间的样本投影到一条直线上,形成一维空间,即把维数压缩到一维。然而,即使样本在d 维空间里形成若干紧凑的互相分得开的集群,若把它们投影到一条任意的直线上,也可能使几类样本混在一起而变得无法识别。但在一般情况下,总可以找到某个方向,使在这个方向的直线上,样本的投影能分开得最好。

Fisher 法所要解决的就是如何根据实际情况找到这条最好、最易于分类的投影线。 P88

第五章

P122 分类器设计的基本问题是,在一定判别函数类内利用训练样本集确定分类

器的参数,即确定判别函数中的系数。设计线性分类器,就是确定权向量w 和阈值权w 0或广义权向量a 0而设计分断线性分类器,则是利用样本集

确定一组0l l i i w w 和。

三种情况:1.利用多类线性判别函救算法设计分段线性分类器2.已知子类

数目时的分段线性判别函数3、未知子类数目时的分段线性判别函数

P124 凹函数 例子:

P126 算法步骤

第六章

P140 K-近邻法的基本规则:在N 个已知样本中,找出x 的近K 个近邻。设这

N 个样本中,来自w 1类的样本有N 1个,来自w 2类的有N 2个,…,来自w c 类的有N c 个,若K 1,K 2,…,K c 分别是K 个近邻中属于w 1,w 2,…,

w c 类的样本数,则可定义判别函数为(),1,2,,i i g x K i c ==,决策规则为:

若()max i i i

g x K =,则决策j x w ∈。

第八章

P177 特征提取:原始特征的数量可能很大,或者说样本是处于一个高维空间中,通过映射(或变换)的方法用低维空间来表示样本的过程。 特征选择:从一组特征中挑选出一些最有效的特征以达到降低特征空间维

数的目的的过程。 P178

各类样本可以分开是因为它们位于特征空间中的不同区域,显然这些区域之

间距离越大类别可分性就趁大。对于空间中两个点之间的距离度量我们都很清楚,下面我们来求如何表示两个类区之间的距离。 P183 基于熵函数的可分性判别

P186

P194 例8.2 P199 算法

P205 特征选择几种新方法:模拟退火算法 Tabu 搜索算法 遗传算法 P208 遗传算法

第九章

P216 表示熵,作为一种表示不确定性的度量。

熵函数:1log D

R j j j H λλ==-∑,当所有j λ相等时,R H 最大,因此,若用d 个(小

于D )坐标轴表示x 而带来的对x 的不确定性,大于在j λ不相等的条件下,用与最大的d 个j λ相应的坐标轴表示x 时所造成的不确定性。当熵等于0时,所有关于x 的信息只存在于一个展开项中,把这个熵函数叫作表示熵。

P217 总体熵:[]log ()R H E P x =-

使当用同一类的特征量的均值所组成的向量代表该类的样本进行分类时,所引起的分

类不确定性度量为最小。

第十章

P230 非监督学习法分两类:基于概率密度函数估计的直接法和基于样本空间相

似性度量的间接聚类方法。 P235 动态聚类法思想、步骤

动态聚类法三个要点:①选定某种距离度t 作为样本间的相似性度量②确

定某个评价聚类结果质量的准则函数。③给定某个初始分类,然后用迭代算法找出使准则函数取极值的最好聚类结果。 P244 分级聚类常用的相似性度量有以下几种:

1、最近距离 ,(,)min (,)i j

i j y y y y δ∈Γ∈ΓΓΓ=

2、最远距离 ,(,)max (,)i j

i j y y y y δ∈Γ∈ΓΓΓ=

3、均值距离 (,)(,)i j i j m m δΓΓ= P245 三个距离的概念

第十一章

P254 反响传播算法(BP )主要思想是从后向前(反向)逐层传播输出层的误差,以间接算出隐层误差。算法分为两个阶段:1、(正向过程)输入信息,从输入层经隐层逐层计算出各单元的输出值;2、(反向传播过程)输出误差逐层会向前算出隐层各单元的误差,并用此误差修正前层权值。

感知器:学习的目标是通过改变权值使神经网络由给定的输入得到给定的

输出。作为分类器,可以用已知类别的模式向量或特征向量作为训练集,当输入为属于第j 类的特征向量X 时,应使对应于该类的物出Yi=1,而其他神经元的输出则为0(或-1)。 P257 径向基 RBF 理解

P265 多层前馈网络用于模式识别(理解、会用):多输出型,单输出型

P266 显然,在两类情况下,我们只需要一个单输出网络即可。将一类对应于输

出1,另一类对应于输出0,识别时只要输出大于0.5则决策为第一类,否则决策为第二类;或者也可以在两类之间设定一个域值,当输出在这个域值之间时作拒绝决策。

第十二章

P280 模糊C 均值算法,什么叫模糊模式识别

算法步骤:①设定聚类数目c 和参数b ②初始化各个聚类中心Mi 。③重复下面的运算,直到各个样本的隶属度值稳定:·用当前的聚类中心根据式(12-25 )计算隶属度函数:用当前的隶属度函数按式(12-2})更新计算各类聚类中心。当算法收敛时,就得到了各类的聚类中心和各个样本对于各类的隶属度值,从而完成了模糊聚类划分。

P285 1992年一1995年,在统计学习理论的基础上发展出了一种新的模式识别方法—支持向量机,在解决小样本、非线性及高维模式识别问题中表现出许多特有的优势,并能够推广应用到函数拟合等其他机器学习问题中。虽然统计学习理论和支持向量机方法中尚有很多问题需要进一步研究,但很多学者认为,它们正在成为继模式识别和神经网络研究之后机器学习领域新的研究热点,并将推动机器学习理论和技术有重大的发展。

第十三章

P290 将随机熵对所有可能的样本数为几的样本集数取期望值,就得到指示函数

集的熵,叫VC 熵。

VC 维对于一个指示函数集,如果其生长函数是线性的,则它的VC 维为

无穷大;而如果生长函数以参数为h 的对数函数为上界,则函数集的VC 维是有限的且等于h 。

P296 因为从某种意义上支持向量机可以表示成类似神经网络的形式,所以起初

也曾被叫支持向量网络。

P297 过两类样本中离分离面最近的点且平行于最优分类面的超平面H 1、H2上

的训练样本就是式[]()10,1,2,,i i y w x b i n +-≥=中使等号成立的那些样

本,叫支持向量。

P298 最优分类函数是{}()sgn (*)sgn *()*1i i i f x w x b y x x b α??

=+=+=±????∑

P300 支持向量机:

支持向量机的基本思想可以概括为:首先通过非线性变换将输人空间变

换到一个高维空间,然后在这个新空间中求取最优线性分类面,而这种非线性变换是通过定义适当的内积函数实现的。

P303 实例:1、多项式形式 [](,)

()1q

i i K x x x x =+ 1(,)()256

q

i i

K x x x x ??=????

2、核函数形式 2

2

(,)e x p i

i x x K x x σ??-??

=-??????

2

2(,)exp 256i i x x K x x σ??-??

=-??????

3、S 型函数 (,)tanh(())i i K x x v x x c =+

()

(,)tanh(

)256

i i b x x K x x c =-

分枝定界搜索算法

通过穷举法搜索进行的特征选择会导致计算量过高,而在分

枝定界搜索算法帮助下,有可能不需要显示评估所有d 个特征的可能组合而确定最优特征集。此算法的应用需假定特征选择准则满足单调性。用()j x 表示含有j 个特征的候选特征集,单调性指的是对于具有下列嵌套关系的特征集()j x

()()()()12j D x x x x ????

其准则函数()()

j J x 应满足 ()()()()

()()

12D J x J x J x ≤≤

≤

这点由构造特征评判准则的定义可得到保证。

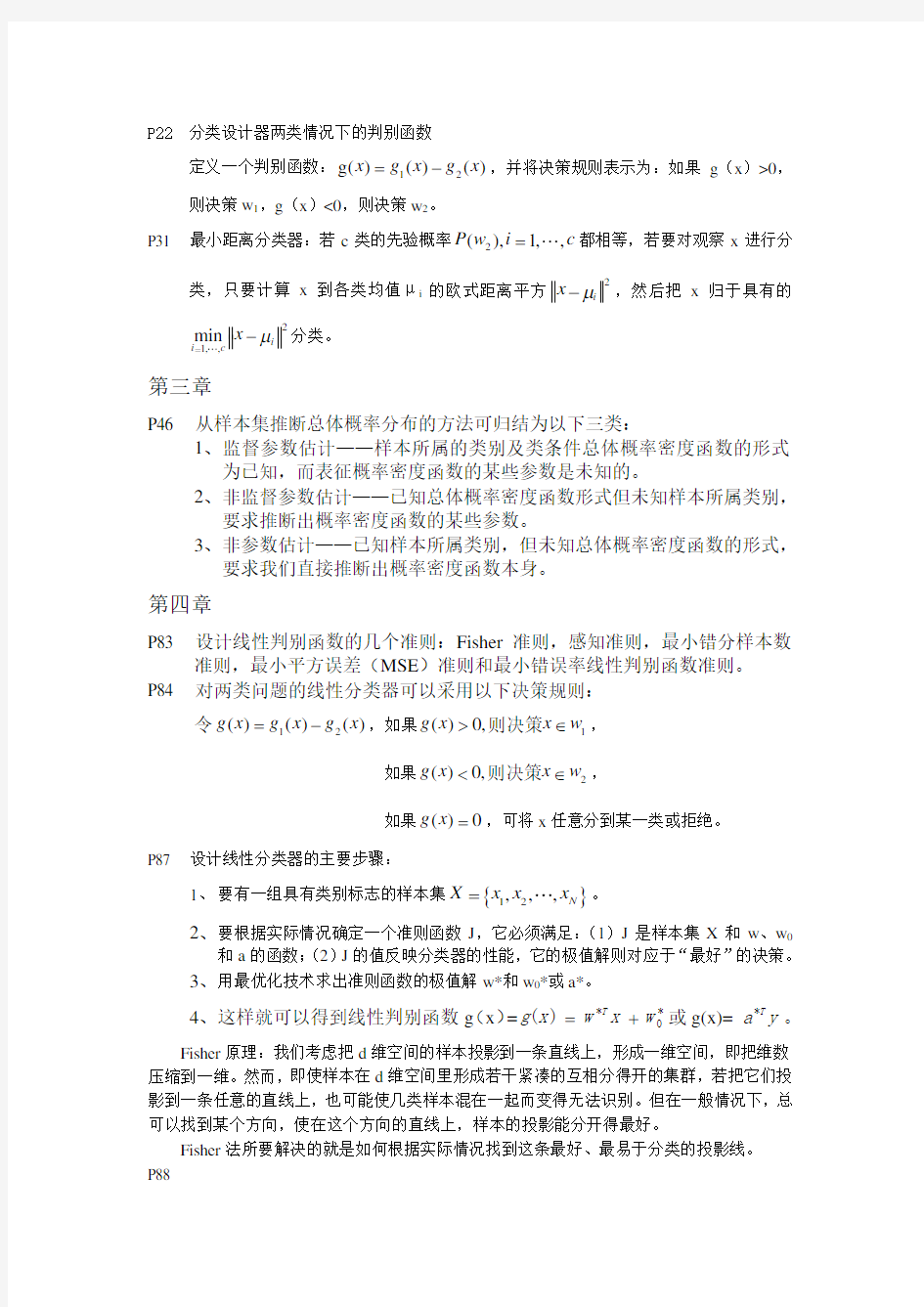

为引出分枝定界搜索算法的基本观点,考虑从5个特征中挑选2个特征值的问题。特征中所有可能组合如下图的树表示,顶称为根节点,底称为叶节点,中间称为枝节点,共有1D d -+层。

图 分枝定界搜索算法示意图

现假设自底向上,再由上向下的搜索方式从最右节点开始在树的每个节点评估特征,进行特征选择。设初始叶节点的J 为0J (为45x x 的准则函数),在每个节点处,将节点的准则函数值和目前最优特征集的J 值进行比较,如果节点准则函数值大于0J ,则还有发现更佳特征集的机会,

而且必须继续沿着最右边的未勘探

12x 13235

x 45

3424

14

25

1535

J,则此分枝搜索。如果到达了树底的叶节点且相应准则值大于

J则作为相应更新。

结点定义了当前新的最佳特征集,而

J,则以此节点另一方面,如果在某节点的准则函数值小于

为起始点的分支就不需勘探。因为根据单调性,再往下的特征组合将导致准则函数值的进一步减小。如此按这一规律,由底向上,再自上而下,从右向左搜索全树,可获得最佳的二特征组合。此搜索算法特别快捷有效。

主成分分析(Principal Component Analysis ,PCA )或者主元分析。是一种掌握事物主要矛盾的统计分析方法,它可以从多元事物中解析出主要影响因素,揭示事物的本质,简化复杂的问题。

独立成分分析(ICA,Independent Component Correlation Algorithm)简介

X=AS

X为n维观测信号矢量,S为独立的m(m<=n)维未知源信号矢量,矩阵A被称为混合矩阵。

ICA的目的就是寻找解混矩阵W(A的逆矩阵),然后对X 进行线性变换,得到输出向量U。

U=WX=WAS

模式识别试题答案

模 式 识 别 非 学 位 课 考 试 试 题 考试科目: 模式识别 考试时间 考生姓名: 考生学号 任课教师 考试成绩 一、简答题(每题6分,12题共72分): 1、 监督学习和非监督学习有什么区别? 参考答案:当训练样本的类别信息已知时进行的分类器训练称为监督学习,或者由教师示范的学习;否则称为非监督学习或者无教师监督的学习。 2、 你如何理解特征空间?表示样本有哪些常见方法? 参考答案:由利用某些特征描述的所有样本组成的集合称为特征空间或者样本空间,特征空间的维数是描述样本的特征数量。描述样本的常见方法:矢量、矩阵、列表等。 3、 什么是分类器?有哪些常见的分类器? 参考答案:将特征空中的样本以某种方式区分开来的算法、结构等。例如:贝叶斯分类器、神经网络等。 4、 进行模式识别在选择特征时应该注意哪些问题? 参考答案:特征要能反映样本的本质;特征不能太少,也不能太多;要注意量纲。 5、 聚类分析中,有哪些常见的表示样本相似性的方法? 参考答案:距离测度、相似测度和匹配测度。距离测度例如欧氏距离、绝对值距离、明氏距离、马氏距离等。相似测度有角度相似系数、相关系数、指数相似系数等。 6、 你怎么理解聚类准则? 参考答案:包括类内聚类准则、类间距离准则、类内类间距离准则、模式与类核的距离的准则函数等。准则函数就是衡量聚类效果的一种准则,当这种准则满足一定要求时,就可以说聚类达到了预期目的。不同的准则函数会有不同的聚类结果。 7、 一种类的定义是:集合S 中的元素x i 和x j 间的距离d ij 满足下面公式: ∑∑∈∈≤-S x S x ij i j h d k k )1(1 ,d ij ≤ r ,其中k 是S 中元素的个数,称S 对于阈值h ,r 组成一类。请说明, 该定义适合于解决哪一种样本分布的聚类? 参考答案:即类内所有个体之间的平均距离小于h ,单个距离最大不超过r ,显然该定义适合团簇集中分布的样本类别。 8、 贝叶斯决策理论中,参数估计和非参数估计有什么区别? 参考答案:参数估计就是已知样本分布的概型,通过训练样本确定概型中的一些参数;非参数估计就是未知样本分布概型,利用Parzen 窗等方法确定样本的概率密度分布规律。 9、 基于风险的统计贝叶斯决策理论中,计算代价[λij ]矩阵的理论依据是什么?假设这个矩阵是 M ?N ,M 和N 取决于哪些因素?

2015秋季学期信息期末考试试题讲解

2015年秋季学期高一年级信息技术期末测试试卷 (总分100分,时间:90分) 一、单项选择题(本大题共60小题,每小题1分,共60分。温馨提示:请在答题卡上作答, 在本试题上作答无效。) 1.下列选项中,属于信息载体的是 A.数学课本B.高考成绩C.上课铃声D.电视新闻 2.下列选项中,属于信息的是 A.起床铃声B.电视机C.体温计D.人民日报 3.“明修栈道,暗渡陈仓”主要体现信息具有 A.共享性B.时效性C.真伪性D.价值性 4.在人类社会发展历史上经历了五次信息技术革命。第五次信息技术革命将人类社会推进到了数字化的信息时代,其中最主要的表现是 A.语言的产生和使用B.文字的发明和使用 C.电报电话的发明和应用D.计算机技术与现代通信技术的普及应用 5.利用计算机模拟汽车碰撞的全过程,采用的是 A.虚拟现实技术B.语音合成技术C.智能代理技术D.传感交互技术 6.下列选项中,属于计算机输出设备的是 A.键盘B.鼠标C.扫描仪D.显示器 7.在中文标点符号状态下,要输入“、”(顿号),在键盘上应按的键是 A.B.C.D. 8.在网址https://www.360docs.net/doc/795921412.html,中,“http://”指的是 A.邮件协议B.网际协议C.文件传输协议D.超文本传输协议9.利用电子表格对校运会中的各项比赛成绩进行汇总并排名,这属于信息加工一般过程的()阶段。 A.记录信息B.加工信息C.发布信息D.存储信息 10.张晓在做“壮族文化”研究性学习时,有些数据不完整,他决定通过上网去查找。他的这个决定属于信息获取四个环节当中的 A.评价信息B.选择信息来源 C.定位信息需求D.确定信息获取方法并获取信息 11.小李收到了一条手机短信“……您获得了10万元大奖,请速汇1500元手续费至账号xxxxx……”。针对这条信息,以下做法较为妥当的是: A.不要轻信来历不明的信息B.直接拨打对方电话进行咨询 C.马上回复短信辱骂骗子D.按短信要求将钱汇入指定帐号 12.教师利用博客收集同学们对课后思考题的看法,该信息的来源属于()。 A.文献型信息源B.电子型信息源C.实物型信息源D.口头型信息源13.下列选项中,属于电子型信息源的是 A.报纸B.朋友C.动物园D.因特网 14.在Word中,选定一行文字,按Delete键后 A.选定行的文字被删除B.选定行的文字被保存 C.选定行的文字被复制D.选定行的文字被撤销

【模式识别】期末考试复习资料

题型: 1.填空题5题 填空题 2.名词解释4题 3.问答题4题 4.计算作图题3题 5.综合计算题1题 备注1:没有整理第一章和第六章,老师说不考的 备注2:非线性判别函数相关概念P69 概率相关定义、性质、公式P83以后 最小错误率贝叶斯决策公式P85 最小风险贝叶斯P86 正态贝叶斯P90 综合计算有可能是第六次作业 一、填空题 物以类聚人以群分体现的是聚类分析的基本思想。 模式识别分类:1.从实现方法来分模式识别分为监督分类和非监督分类;2.从理论上来分,有统计模式识别,统计模式识别,模糊模式识别,神经网络模式识别法 聚类分析是按照不同对象之间的差异,根据距离函数的规律做模式分类的。 模式的特性:可观察性、可区分性、相似性 模式识别的任务:一是研究生物体(包括人)是如何感知对象的,二是如何用计算机实现模式识别的理论和方法。 计算机的发展方向:1.神经网络计算机--模拟人的大脑思维;2.生物计算机--运用生物工程技术、蛋白分子作芯片; 3.光计算机--用光作为信息载体,通过对光的处理来完成对信息的处理。 训练学习方法:监督学习、无监督学习(无先验知识,甚至类别数也未知)。 统计模式识别有:1.聚类分析法(非监督);2.判决函数法/几何分类法(监督);3.基于统计决策的概率分类法 - 以模式集在特征空间中分布的类概率密度函数为基础,对总体特征进行研究,以取得分类的方法 数据的标准化目的:消除各个分量之间数值范围大小对算法的影响 模式识别系统的基本构成:书P7 聚类过程遵循的基本步骤:特征选择;近邻测度;聚类准则;聚类算法;结果验证;结果判定。 相似测度基础:以两矢量的方向是否相近作为考虑的基础,矢量长度并不重要。 确定聚类准则的两种方式:阈值准则,函数准则 基于距离阈值的聚类算法——分解聚类:近邻聚类法;最大最小距离聚类法 类间距离计算准则:1)最短距离法2)最长距离法3)中间距离法4)重心法5)类平均距离法6)离差平方和法P24 系统聚类法——合并的思想 用于随机模式分类识别的方法,通常称为贝叶斯判决。 BAYES 决策常用的准则:最小错误率;最小风险 错误率的计算或估计方法:①按理论公式计算;②计算错误率上界;③实验估计。

模式识别与机器学习期末考查试题及参考答案(20210221222717)

模式识别与机器学习期末考查 试卷 研究生姓名:入学年份:导师姓名:试题1:简述模式识别与机器学习研究的共同问题和各自的研究侧重点。 答:(1)模式识别是研究用计算机来实现人类的模式识别能力的一门学科,是指对表征事物或现象的各种形式的信息进行处理和分析,以对事物或现象进行描述、辨认、分类和解释的过程。主要集中在两方面,一是研究生物体(包括人)是如何感知客观事物的,二是在给定的任务下,如何用计算机实现识别的理论和方法。机器学习则是一门研究怎样用计算机来模拟或实现人类学习活动的学科,是研究如何使机器通过识别和利用现有知识来获取新知识和新技能。主要体现以下三方面:一是人类学习过程的认知模型;二是通用学习算法;三是构造面向任务的专用学习系统的方法。两者关心的很多共同问题,如:分类、聚类、特征选择、信息融合等,这两个领域的界限越来越模糊。机器学习和模式识别的理论和方法可用来解决很多机器感知和信息处理的问题,其中包括图像/ 视频分析(文本、语音、印刷、手写)文档分析、信息检索和网络搜索等。 (2)机器学习和模式识别是分别从计算机科学和工程的角度发展起来的,各自的研究侧重点也不同。模式识别的目标就是分类,为了提高分类器的性能,可能会用到机器学习算法。而机器学习的目标是通过学习提高系统性能,分类只是其最简单的要求,其研究更

侧重于理论,包括泛化效果、收敛性等。模式识别技术相对比较成熟了,而机器学习中一些方法还没有理论基础,只是实验效果比较好。许多算法他们都在研究,但是研究的目标却不同。如在模式识别中研究所关心的就是其对人类效果的提高,偏工程。而在机器学习中则更侧重于其性能上的理论证明。试题2:列出在模式识别与机器学习中的常用算法及其优缺点。答:(1)K 近邻法算法作为一种非参数的分类算法,它已经广泛应用于分类、 回归和模式识别等。在应用算法解决问题的时候,要注意的两个方面是样本权重和特征权重。 优缺点:非常有效,实现简单,分类效果好。样本小时误差难控制,存储所有样本,需要较大存储空间,对于大样本的计算量大。(2)贝叶斯决策法 贝叶斯决策法是以期望值为标准的分析法,是决策者在处理 风险型问题时常常使用的方法。 优缺点:由于在生活当中许多自然现象和生产问题都是难以完全准确预测的,因此决策者在采取相应的决策时总会带有一定的风险。贝叶斯决策法就是将各因素发生某种变动引起结果变动的概率凭统计资料或凭经验主观地假设,然后进一步对期望值进行分析,由于此概率并不能证实其客观性,故往往是主观的和人为的概率,本身带有一定的风险性和不肯定性。虽然用期望的大小进行判断有一些风险,但仍可以认为贝叶斯决策是一种兼科学性和实效性于一身的比较完善的用于解决风险型决策问题的方法,在实际中能够广泛应

模式识别试题

一、试问“模式”与“模式类”的含义。如果一位姓王的先生是位老年人,试问“王先生”和“老头”谁是模式,谁是模式类? 二、试说明Mahalanobis距离平方的定义,到某点的Mahalanobis距离平方为常数的轨迹的几何意义,它与欧氏距离的区别与联系。 三、试说明用监督学习与非监督学习两种方法对道路图像中道路区域的划分的基本做法,以说明这两种学习方法的定义与它们间的区别。 四、试述动态聚类与分级聚类这两种方法的原理与不同。 五、如果观察一个时序信号时在离散时刻序列得到的观察量序列表示为,而该时序信号的内在状态序列表示成。如果计算在给定O条件下出现S的概 率,试问此概率是何种概率。如果从观察序列来估计状态序列的最大似然估计,这与Bayes 决策中基于最小错误率的决策有什么关系。 六、已知一组数据的协方差矩阵为,试问 1.协方差矩阵中各元素的含义。 2.求该数组的两个主分量。 3.主分量分析或称K-L变换,它的最佳准则是什么? 4.为什么说经主分量分析后,消除了各分量之间的相关性。 七、试说明以下问题求解是基于监督学习或是非监督学习: 1. 求数据集的主分量非 2. 汉字识别有 3. 自组织特征映射非 4. CT图像的分割非 八、试列举线性分类器中最著名的三种最佳准则以及它们各自的原理。 九、在一两维特征空间,两类决策域由两条直线H1和H2分界, 其中 而包含H1与H2的锐角部分为第一类,其余为第二类。 试求: 1.用一双层感知器构造该分类器 2.用凹函数的并构造该分类器 十、设有两类正态分布的样本基于最小错误率的贝叶斯决策分界面,分别为X2=0,以及X1=3,其中两类的协方差矩阵,先验概率相等,并且有, 。 试求:以及。

人工智能期末试题及答案完整版

xx学校 2012—2013学年度第二学期期末试卷 考试课程:《人工智能》考核类型:考试A卷 考试形式:开卷出卷教师: 考试专业:考试班级: 一单项选择题(每小题2分,共10分) 1.首次提出“人工智能”是在(D )年 A.1946 B.1960 C.1916 D.1956 2. 人工智能应用研究的两个最重要最广泛领域为:B A.专家系统、自动规划 B. 专家系统、机器学习 C. 机器学习、智能控制 D. 机器学习、自然语言理解 3. 下列不是知识表示法的是 A 。 A:计算机表示法B:“与/或”图表示法 C:状态空间表示法D:产生式规则表示法 4. 下列关于不确定性知识描述错误的是 C 。 A:不确定性知识是不可以精确表示的 B:专家知识通常属于不确定性知识 C:不确定性知识是经过处理过的知识 D:不确定性知识的事实与结论的关系不是简单的“是”或“不是”。 5. 下图是一个迷宫,S0是入口,S g是出口,把入口作为初始节点,出口作为目标节点,通道作为分支,画出从入口S0出发,寻找出口Sg的状态树。根据深度优先搜索方法搜索的路径是 C 。 A:s0-s4-s5-s6-s9-sg B:s0-s4-s1-s2-s3-s6-s9-sg C:s0-s4-s1-s2-s3-s5-s6-s8-s9-sg D:s0-s4-s7-s5-s6-s9-sg 二填空题(每空2分,共20分) 1.目前人工智能的主要学派有三家:符号主义、进化主义和连接主义。 2. 问题的状态空间包含三种说明的集合,初始状态集合S 、操作符集合F以及目标

状态集合G 。 3、启发式搜索中,利用一些线索来帮助足迹选择搜索方向,这些线索称为启发式(Heuristic)信息。 4、计算智能是人工智能研究的新内容,涉及神经计算、模糊计算和进化计算等。 5、不确定性推理主要有两种不确定性,即关于结论的不确定性和关于证据的不确 定性。 三名称解释(每词4分,共20分) 人工智能专家系统遗传算法机器学习数据挖掘 答:(1)人工智能 人工智能(Artificial Intelligence) ,英文缩写为AI。它是研究、开发用于模拟、延伸和扩展人的智能的理论、方法、技术及应用系统的一门新的技术科学。人工智能是计算机科学的一个分支,它企图了解智能的实质,并生产出一种新的能以人类智能相似的方式做出反应的智能机器,该领域的研究包括机器人、语言识别、图像识别、自然语言处理和专家系统等 (2)专家系统 专家系统是一个含有大量的某个领域专家水平的知识与经验智能计算机程序系统,能够利用人类专家的知识和解决问题的方法来处理该领域问题.简而言之,专家系统是一种模拟人类专家解决领域问题的计算机程序系统 (3)遗传算法 遗传算法是一种以“电子束搜索”特点抑制搜索空间的计算量爆炸的搜索方法,它能以解空间的多点充分搜索,运用基因算法,反复交叉,以突变方式的操作,模拟事物内部多样性和对环境变化的高度适应性,其特点是操作性强,并能同时避免陷入局部极小点,使问题快速地全局收敛,是一类能将多个信息全局利用的自律分散系统。运用遗传算法(GA)等进化方法制成的可进化硬件(EHW),可产生超出现有模型的技术综合及设计者能力的新颖电路,特别是GA独特的全局优化性能,使其自学习、自适应、自组织、自进化能力获得更充分的发挥,为在无人空间场所进行自动综合、扩展大规模并行处理(MPP)以及实时、灵活地配置、调用基于EPGA的函数级EHW,解决多维空间中不确定性的复杂问题开通了航向 (4)机器学习 机器学习(Machine Learning)是一门多领域交叉学科,涉及概率论、统计学、逼近论、凸分析、算法复杂度理论等多门学科。专门研究计算机怎样模拟或实现人类的学习行为,以获取新的知识或技能,重新组织已有的知识结构使之不断改善自身的性能。它是人工智能的核心,是使计算机具有智能的根本途径,其应用遍及人工智能的各个领域,它主要使用归纳、综合而不是演绎 (5)数据挖掘 数据挖掘是指从数据集合中自动抽取隐藏在数据中的那些有用信息的非平凡过程,这些信息的表现形式为:规则、概念、规律及模式等。它可帮助决策者分析历史数据及当前数据,并从中发现隐藏的关系和模式,进而预测未来可能发生的行为。数据挖掘的

中科大模式识别试题

中国科学技术大学模式识别试题 (2012年春季学期) 姓名:学号:成绩: 一、填空与选择填空(本题答案写在此试卷上,30分) 1、模式识别系统的基本构成单元包括:、 和。 2、统计模式识别中描述模式的方法一般使用;句法模式识别中模式描述方法一般 有、、。 3、聚类分析算法属于;判别域代数界面方程法属于。 (1)无监督分类 (2)有监督分类(3)统计模式识别方法(4)句法模式识别方法 4、若描述模式的特征量为0-1二值特征量,则一般采用进行相似性度量。 (1)距离测度(2)模糊测度(3)相似测度(4)匹配测度 5、下列函数可以作为聚类分析中的准则函数的有。 (1) (4) 6、Fisher线性判别函数的求解过程是将N维特征矢量投影在中进行。 (1)二维空间(2)一维空间(3)N-1维空间 7、下列判别域界面方程法中只适用于线性可分情况的算法有;线性可分、不可分都适用的 有。 (1)感知器算法(2)H-K算法(3)积累位势函数法 8、下列四元组中满足文法定义的有。 (1)({A, B}, {0, 1}, {A→01, A→ 0A1 , A→ 1A0 , B→BA , B→ 0}, A) (2)({A}, {0, 1}, {A→0, A→ 0A}, A) (3)({S}, {a, b}, {S → 00S, S → 11S, S → 00, S → 11}, S) (4)({A}, {0, 1}, {A→01, A→ 0A1, A→ 1A0}, A) 二、(15分)简答及证明题 (1)影响聚类结果的主要因素有那些? (2)证明马氏距离是平移不变的、非奇异线性变换不变的。 (3)画出对样本集 ω1:{(0,0,0)T, (1,0,0)T, (1,0,1)T, (1,1,0)T,} PDF 文件使用 "pdfFactory Pro" 试用版本创建https://www.360docs.net/doc/795921412.html,

模式识别期末试题

一、填空与选择填空(本题答案写在此试卷上,30分) 1、模式识别系统的基本构成单元包括:模式采集、特征提取与选择 和模式分类。 2、统计模式识别中描述模式的方法一般使用特真矢量;句法模式识别中模式描述方法一般有串、树、网。 3、聚类分析算法属于(1);判别域代数界面方程法属于(3)。 (1)无监督分类 (2)有监督分类(3)统计模式识别方法(4)句法模式识别方法 4、若描述模式的特征量为0-1二值特征量,则一般采用(4)进行相似性度量。 (1)距离测度(2)模糊测度(3)相似测度(4)匹配测度 5、下列函数可以作为聚类分析中的准则函数的有(1)(3)(4)。

(1)(2) (3)

(4) 6、Fisher线性判别函数的求解过程是将N维特征矢量投影在(2)中进行。 (1)二维空间(2)一维空间(3)N-1维空间 7、下列判别域界面方程法中只适用于线性可分情况的算法有(1);线性可分、不可分都适用的有(3)。 (1)感知器算法(2)H-K算法(3)积累位势函数法 8、下列四元组中满足文法定义的有(1)(2)(4)。 (1)({A, B}, {0, 1}, {A?01, A ? 0A1 , A ? 1A0 , B ? BA , B ? 0}, A)(2)({A}, {0, 1}, {A?0, A ? 0A}, A) (3)({S}, {a, b}, {S ? 00S, S ? 11S, S ? 00, S ? 11}, S) (4)({A}, {0, 1}, {A?01, A ? 0A1, A ? 1A0}, A) 9、影响层次聚类算法结果的主要因素有(计算模式距离的测度、(聚类准则、类 间距离门限、预定的类别数目))。 10、欧式距离具有( 1、2 );马式距离具有(1、2、3、4 )。 (1)平移不变性(2)旋转不变性(3)尺度缩放不变性(4)不受量纲影响的特性11、线性判别函数的正负和数值大小的几何意义是(正(负)表示样本点位于判别 界面法向量指向的正(负)半空间中;绝对值正比于样本点到判别界面的距离。)。

2013年模式识别考试题和答案

2013–2014 学年度 模式识别 课程期末考试试题 一、计算题 (共20分) 在目标识别中,假定类型1ω为敌方目标,类型2ω为诱饵(假目标),已知先验概率P (1ω)=0.2和P (2ω)=0.8,类概率密度函数如下: ??? ??≤≤-<≤=其它021210)(1x x x x x p ω ?? ? ??≤≤-<≤=其它0323211-)(2x x x x x p ω 1、求贝叶斯最小误判概率准则下的判决域,并判断样本x =1.5属于哪一类; 2、求总错误概率p (e ); 3、假设正确判断的损失λ11=λ22=0,误判损失分别为λ12和λ21,若采用最小损失判决准则,λ12和λ21满足怎样的关系时,会使上述对x =1.5的判断相反? 解:(1)应用贝叶斯最小误判概率准则如果 )()()(2112ωω=x p x p x l <>)() (12ωωP P 则判 ???ωω∈21 x (2分) 得 l 12(1.5)=1 < )() (12ωωP P =4,故 x=1.5属于ω2 。(2分) (2)P(e)= 212121)()()(εω+εω=P P e P ??ΩΩωω+ωω=1 2 )()()()(2211x d x p P x d x p P = dx x x x ??-+- 1.2 1 2 1.2 10.8d )2(0.2)(=0.08 (算式正确2分,计算错误扣1~2分) (3) 两类问题的最小损失准则的似然比形式的判决规则为:

如果 ) )(())(()()(111212221221λ-λωλ-λω< >ωωP P x p x p 则判 ???ωω∈21 x 带入x=1.5得到 λ12≥4λ21 二、证明题(共20分) 设p(x)~N (μ,σ),窗函数?(x)~N (0,1),试证明Parzen 窗估计1 1 ?()( )N i N i N N x x p x Nh h ?=-= ∑ 有如下性质:22 ?[()](,)N N E p x N h μσ+ 。 证明:(1)(为书写方便,以下省略了h N 的下标N ) 22 22 22 2222222222 222211()()()()]22111exp[()()]2221111exp{[()2()]}221 1111exp[()]exp{()[2222y x y x y p y dy dy h h y x y dy h x x y y dy h h h x y h h μ?σμπσσ μμπσσσσ μπσσσ∞ ∞ -∞ -∞∞ -∞∞ -∞ ∞ -∞---=----=--= -+-+++=-+-+-? ??? ?2222()]}x h y dy h σμσ++ 222222 2222222222221 1()exp[(exp()22()2 11()exp[22()1()]2()x x h y dy h h h x h x h μσμπσσσσμπσσμσ∞ +=-+--+-=-+-=-+? (1-1) 121211?[()][()](,,...,)N i N N N i x x E p x p x x x dx dx dx Nh h ?∞ =-∞ -=∑??? 因为样本独立 121211?[()][()]()()...()N i N N N i x x E p x p x p x p x dx dx dx Nh h ?∞ =-∞ -=∑???

模式识别复习题1

模式识别 复习题 1. 简单描述模式识别系统的基本构成(典型过程)? 2. 什么是监督模式识别(学习)?什么是非监督模式识别(学习)? 对一副道路图像,希望把道路部分划分出来,可以采用以下两种方法: (1). 在该图像中分别在道路部分与非道路部分画出一个窗口,把在这两个窗口中的象素数据作为训练集,用某种判别准则求得分类器参数,再用该分类器对整幅图进行分类。 (2).将整幅图的每个象素的属性记录在一张数据表中,然后用某种方法将这些数据按它们的自然分布状况划分成两类。因此每个象素就分别得到相应的类别号,从而实现了道路图像的分割。 试问以上两种方法哪一种是监督学习,哪个是非监督学习? 3. 给出一个模式识别的例子。 4. 应用贝叶斯决策的条件是什么?列出几种常用的贝叶斯决策规 则,并简单说明其规则. 5. 分别写出在以下两种情况:(1)12(|)(|)P x P x ωω=;(2)12()() P P ωω=下的最小错误率贝叶斯决策规则。 6. (教材P17 例2.1) 7. (教材P20 例2.2),并说明一下最小风险贝叶斯决策和最小错误 率贝叶斯决策的关系。 8. 设在一维特征空间中有两类服从正态分布的样本, 12122,1,3,σσμμ====两类先验概率之比12(),() P e P ωω= 试确定按照最小错误率贝叶斯决策规则的决策分界面的x 值。

9. 设12{,,...,}N x x x =X 为来自点二项分布的样本集,即 1(,),0,1,01,1x x f x P P Q x P Q P -==≤≤=-,试求参数P 的最大似然估 计量?P 。 10. 假设损失函数为二次函数2??(,)()P P P P λ=-,P 的先验密度为均匀分布,即()1,01f P P =≤≤。在这样的假设条件下,求上题中的贝叶 斯估计量?P 。 11. 设12{,,...,}N x x x =X 为来自(|)p x θ的随机样本,其中0x θ≤≤时, 1 (|)p x θθ=,否则为0。证明θ的最大似然估计是max k k x 。 12. 考虑一维正态分布的参数估计。设样本(一维)12,,...,N x x x 都是由 独立的抽样试验采集的,且概率密度函数服从正态分布,其均值μ和方差2σ未知。求均值和方差的最大似然估计。 13. 设一维样本12{,,...,}N x x x =X 是取自正态分布2(,)N μσ的样本集,其中 均值μ为未知的参数,方差2σ已知。未知参数μ是随机变量,它的先验分布也是正态分布200(,)N μσ,200,μσ为已知。求μ的贝叶斯估计 ?μ 。 14. 什么是概率密度函数的参数估计和非参数估计?分别列去两种 参数估计方法和非参数估计方法。 15. 最大似然估计和Parzen 窗法的基本原理?

2015模式识别期末考试

2015模式识别期末考试

一:问答 1. 什么是模式? 通过对具体个别事物进行观测所得到的具有时间和空间分布的信息称为模式。模式所指的不是事物本身,而是我们从事物中获得的信息。 2. 模式识别系统主要由哪些部分组成? 信息获取,预处理,特征提取与选择,分类决策,后处理。 3. 最小错误率贝叶斯分类器设计过程? 答:根据训练数据求出先验概率 类条件概率分布 利用贝叶斯公式得到后验概率 如果输入待测样本X ,计算X 的后验概率根据后验概率大小进行分类决策分析。 4. 怎样利用朴素贝叶斯方法获得各个属性的类条件概率分布? 答:假设各属性独立,P(x| ωi) =P(x1, x2, …, xn |ωi) = P(x1| ωi) P(x2|ωi)… P(xn|ωi) 2 ,1),(=i w P i 2 ,1),|(=i w x p i ∑== 2 1 ) ()|() ()|()|(j j j i i i w P w x P w P w x P x w P

后验概率:P(ωi|x) = P(ωi) P(x1|ωi) P(x2|ωi)… P(xn|ωi) 类别清晰的直接分类算,如果是数据连续的,假设属性服从正态分布,算出每个类的均值方差,最后得到类条件概率分布。 均值: ∑==m i xi m x mean 1 1)( 方差: 2 )^(11)var(1 ∑=--=m i x xi m x 二:解答 1.设有如下三类模式样本集ω1,ω2和ω3,其先验概率相等,求Sw 和Sb ω1:{(1 0)T , (2 0) T , (1 1) T } ω2:{(-1 0)T , (0 1) T , (-1 1) T } ω3:{(-1 -1)T , (0 -1) T , (0 -2) T } 答:由于三类样本集的先验概率相等,则概率均为 1/3。 多类情况的类内散度矩阵,可写成各类的类内散布矩阵的先验概率的加权和,即: ∑∑===--=c i i i T i i c i i w C m x m x E P S 1 1 }|))(({)(ωω 其中Ci 是第i 类的协方差矩阵。其中 ??? ?? ? ??=31341m , ??? ?? ? ??=323 2-2m , ??? ?? ? ??=34-3 1-3m

模式识别试题

《模式识别》试题答案(A卷) 一、填空与选择填空(本题答案写在此试卷上,30分) 1、影响层次聚类算法结果的主要因素有(计算模式距离的测度、(聚类准则、类间距离门限、预定 的类别数目))。 2、欧式距离具有( 1、2 );马式距离具有(1、2、 3、4 )。(1)平移不变性(2)旋转不 变性(3)尺度缩放不变性(4)不受量纲影响的特性 3、线性判别函数的正负和数值大小的几何意义是(正(负)表示样本点位于判别界面法向量指向的 正(负)半空间中;绝对值正比于样本点到判别界面的距离。)。 4、感知器算法1。(1)只适用于线性可分的情况;(2)线性可分、不可分都适用。 5、积累势函数法较之于H-K算法的优点是(该方法可用于非线性可分情况(也可用于线性可分情 况));位势函数K(x,x k)与积累位势函数K(x)的关系为( ∑ ∈ = X x x x K x K ~ k k k ) , ( ) ( α )。 6、在统计模式分类问题中,聂曼-皮尔逊判决准则主要用于(某一种判决错误较另一种判决错误更 为重要)情况;最小最大判决准则主要用于(先验概率未知的)情况。 7、“特征个数越多越有利于分类”这种说法正确吗?(错误)。特征选择的主要目的是(从n个特 征中选出最有利于分类的的m个特征(m

模式识别v试题库.doc

《模式识别》试题库 一、基本概念题 1.1 模式识别的三大核心问题是:、、。 1.2、模式分布为团状时,选用聚类算法较好。 1.3 欧式距离具有。马式距离具有。 (1)平移不变性(2)旋转不变性(3)尺度缩放不变性(4)不受量纲影响的特性 1.4 描述模式相似的测度有:。 (1)距离测度(2)模糊测度(3)相似测度(4)匹配测度 1.5 利用两类方法处理多类问题的技术途径有:(1);(2); (3)。其中最常用的是第个技术途径。 1.6 判别函数的正负和数值大小在分类中的意义 是:, 。 1.7 感知器算法。 (1)只适用于线性可分的情况;(2)线性可分、不可分都适用。 1.8 积累位势函数法的判别界面一般为。 (1)线性界面;(2)非线性界面。 1.9 基于距离的类别可分性判据有:。 (1) 1 [] w B Tr S S - (2) B W S S (3) B W B S S S + 1.10 作为统计判别问题的模式分类,在()情况下,可使用聂曼-皮尔逊判决准则。 1.11 确定性模式非线形分类的势函数法中,位势函数K(x,x k)与积累位势函数K(x)的关系为 ()。 1.12 用作确定性模式非线形分类的势函数法,通常,两个n维向量x和x k的函数K(x,x k)若同时满足下列三个条件,都可作为势函数。 ①();

②( ); ③ K(x,x k )是光滑函数,且是x 和x k 之间距离的单调下降函数。 1.13 散度J ij 越大,说明ωi 类模式与ωj 类模式的分布( )。当ωi 类模式与ωj 类模式的分布相同时,J ij =( )。 1.14 若用Parzen 窗法估计模式的类概率密度函数,窗口尺寸h1过小可能产生的问题是( ),h1过大可能产生的问题是( )。 1.15 信息熵可以作为一种可分性判据的原因 是: 。 1.16作为统计判别问题的模式分类,在( )条件下,最小损失判决规则与最小错误判决规则是等价的。 1.17 随机变量l(x ρ)=p( x ρ|ω1)/p( x ρ|ω2),l( x ρ)又称似然比,则E {l( x ρ)|ω2}= ( )。在最小误判概率准则下,对数似然比Bayes 判决规则为( )。 1.18 影响类概率密度估计质量的最重要因素是 ( )。 1.19 基于熵的可分性判据定义为 )] |(log )|([1 x P x P E J i c i i x H ρ ρωω∑=-=,J H 越( ),说明模式的 可分性越强。当P(ωi | x ρ) =( )(i=1,2,…,c)时,J H 取极大值。 1.20 Kn 近邻元法较之于Parzen 窗法的优势在于 ( )。 上述两种算法的共同弱点主要是( )。 1.21 已知有限状态自动机Af=(∑,Q ,δ,q0,F),∑={0,1};Q={q0,q1}; δ:δ(q0,0)= q1,δ(q0,1)= q1,δ(q1,0)=q0,δ(q1,1)=q0;q0=q0;F={q0}。现有输入字符串:(a) 00011101011,(b) 1100110011,(c) 101100111000,(d)0010011,试问,用Af 对上述字符串进行分类的结果为( )。 1.22 句法模式识别中模式描述方法有: 。 (1)符号串 (2)树 (3)图 (4)特征向量

【模式识别】期末考试试卷02

《模式识别》期末考试试题( A ) 一、填空题( 15 个空,每空 2 分,共 30 分) 1 .基于机器学习的模式识别系统通常由两个过程组成 , 即( )和分类判决。 2 .统计模式识别把观察对象表达为一个随机向量 (即特征向量 ), 将 ( ) 表达为由有穷或无穷个具有相似数值特性的 模式组成的集合。 3 .特征一般有两种表达方法 : (1)将特征表达为 ( ); (2)将特征表达为基元。 4 .特征提取是指采用变换或映射实现由模式测量空间向 ( )的转变。 5 .同一类模式类样本的分布比较集中,没有或临界样本很少,这样的模式类称为 ( )。 6 .加权空间的所有 ( )都通过坐标原点。 7.线性多类判别: 若每两个模式类间可用判别平面分开, 在这种情况下, M 类有 ( )个判别函数 ,存在有不确定 区域。 8 .当取 ( )损失函数时 , 最小风险贝叶斯判决准则等价于最大后验概率判决准则。 9.Neyman-Pearson 决策的基本思想是 ( )某一错误率,同时追求另一错误率最小。 10.聚类 /集群:用事先不知样本的类别,而利用样本的先验知识来构造分类器属于 ( )学习。 11.相似性测度、 ( )和聚类算法称为聚类分析的三要素。 12. K/C 均值算法使用的聚类准则函数是 ( )准则,通过反复迭代优化聚类结果,使所有样本到各自所属类别的中 心的距离平方和达到最小。 13.根据神经元的不同连接方式,可将神经网络分为分层网络和相互连接型网络两大类。其中分层网络可细分为前向网 络、具有反馈的前向网络和 ( )三种互连方式。 14.神经网络的特性及能力主要取决于 ( )及学习方法。 15. BP 神经网络是采用误差反向传播算法的多层前向网络,其中,神经元的传输函数为 是一种 ( )映射关系。 二、简答题( 2 题,每小题 10 分,共 20 分) S 型函数,网络的输入和输出 1.简述有监督分类方法和无监督分类方法的主要区别。 1 1/ 2 2.已知一组数据的协方差矩阵为 ,试问: 1/2 1 (1) 协方差矩阵中各元素的含义是什么? (2) K-L 变换的最佳准则是什么? (3) 为什么说经 K-L 变换后消除了各分量之间的相关性? 三、计算题(2 题,每小题 13 分,共 26 分 ) 1.设有两类样本,两类样本的类内离散度矩阵分别为 S 1 1/ 2 , S 1 1/ 2 ,各类样本均值分别为 1 1/ 2 1 2 1/ 2 1 T T μ1 2 0 和 μ2 2 2 ,试用 Fisher 准则求其决策面方程。 2.设有两类正态分布的样本集,第一类均值 μ1 T 1 1/ 2 T 20,方差 1 1/ 2 ,第二类均值 μ2 22,方差 1 1 1/ 2 p( 2 ) 。试按最小错误率 Bayes 决策求两类的分界面。 2 1/ 2 ,先验概率 p( 1 ) 1

模式识别试题2

《模式识别》试题库 一、基本概念题 1模式识别的三大核心问题是:( )、( )、( )。 2、模式分布为团状时,选用( )聚类算法较好。 3 欧式距离具有( )。马式距离具有( )。(1)平移不变性(2)旋转不 变性(3)尺度缩放不变性(4)不受量纲影响的特性 4 描述模式相似的测度有( )。(1)距离测度 (2)模糊测度 (3)相似测度 (4) 匹配测度 5 利用两类方法处理多类问题的技术途径有:(1) (2) (3) 。其中最常用的是第( )个技术途径。 6 判别函数的正负和数值大小在分类中的意义是:( )。 7 感知器算法 ( )。(1)只适用于线性可分的情况;(2)线性可分、不可分都适用。 8 积累位势函数法的判别界面一般为( )。(1)线性界面;(2)非线性界面。 9 基于距离的类别可分性判据有:( ).(1)1[]w B Tr S S - (2) B W S S (3) B W B S S S + 10 作为统计判别问题的模式分类,在( )情况下,可使用聂曼-皮尔逊判决准则。 11 确定性模式非线形分类的势函数法中,位势函数K(x,xk)与积累位势函数K(x)的关系为 ( )。 12 用作确定性模式非线形分类的势函数法,通常,两个n 维向量x 和xk 的函数K(x,xk)若 同时满足下列三个条件,都可作为势函数。①( ); ②( );③ K(x,xk)是光滑函数,且是x 和xk 之间距离的单调下降函数。 13 散度Jij 越大,说明i 类模式与j 类模式的分布( )。当i 类 模式与j 类模式的分布相同时,Jij=( )。 14 若用Parzen 窗法估计模式的类概率密度函数,窗口尺寸h1过小可能产生的问题是 ( ),h1过大可能产生的问题是( )。 15 信息熵可以作为一种可分性判据的原因是:( )。 16作为统计判别问题的模式分类,在( )条件下,最小损失判决规则与最 小错误判决规则是等价的。 17 随机变量l(x )=p(x 1)/p(x 2),l(x )又称似然比,则E l( x )2= ( )。在最小误判概率准则下,对数似然比Bayes 判决规则为 ( )。 18 影响类概率密度估计质量的最重要因素( )。 19 基于熵的可分性判据定义为)]|(log )|([1x P x P E J i c i i x H ωω∑=-=,JH 越( ),说 明模式的可分性越强。当P(i| x ) =( )(i=1,2,…,c)时,JH 取极大值。 20 Kn 近邻元法较之于Parzen 窗法的优势在于( )。上 述两种算法的共同弱点主要是( )。 21 已知有限状态自动机Af=(,Q ,,q0,F),={0,1};Q={q0,q1};:(q0, 0)= q1,(q0,1)= q1,(q1,0)=q0,(q1,1)=q0;q0=q0;F={q0}。 现有输入字符串:(a) 000,(b) 11,(c) ,(d)0010011,试问,用Af 对上述字符串进行分

2015模式识别期末考试

一:问答 1. 什么是模式? 通过对具体个别事物进行观测所得到的具有时间和空间分布的信息称为模式。模式所指的不是事物本身,而是我们从事物中获得的信息。 2. 模式识别系统主要由哪些部分组成? 信息获取,预处理,特征提取与选择,分类决策,后处理。 3. 最小错误率贝叶斯分类器设计过程? 答:根据训练数据求出先验概率 类条件概率分布 利用贝叶斯公式得到后验概率 如果输入待测样本X ,计算X 的后验概率根据后验概率大小进行分类决策分析。 4. 怎样利用朴素贝叶斯方法获得各个属性的类条件概率分布? 答:假设各属性独立,P(x| ωi) =P(x1, x2, …, xn |ωi) = P(x1| ωi) P(x2|ωi)… P(xn|ωi) 后验概率:P(ωi|x) = P(ωi) P(x1|ωi) P(x2|ωi)… P(xn|ωi) 类别清晰的直接分类算,如果是数据连续的,假设属性服从正态分布,算出每个类的均值方差,最后得到类条件概率分布。 均值:∑==m i xi m x mean 1 1)( 方差:2)^(11)var(1∑=--=m i x xi m x 二:解答 1.设有如下三类模式样本集ω1,ω2和ω3,其先验概率相等,求Sw 和Sb ω1:{(1 0)T , (2 0) T , (1 1) T } ω2:{(-1 0)T , (0 1) T , (-1 1) T } ω3:{(-1 -1)T , (0 -1) T , (0 -2) T } 答:由于三类样本集的先验概率相等,则概率均为 1/3。 多类情况的类内散度矩阵,可写成各类的类内散布矩阵的先验概率的加权和,即: ∑∑===--=c i i i T i i c i i w C m x m x E P S 1 1 }|))(({)(ωω 其中Ci 是第i 类的协方差矩阵。其中?????? ??=31341m ,?? ???? ??=3232-2m ,??? ?? ? ??=34-31-3m 则 =++=321S w w w w S S S ??? ? ??=???? ??+???? ??+???? ??2/3 1/9-1/9- 2/32/3 1/3-1/3- 2/3312/3 1/31/3 2/3312/3 1/3-1/3- 2/331 类间散布矩阵常写成:T i i c i i b m m m m P S ))(()(001 --= ∑=ω 其中,0m 为多类模式(如共有c 类)分布的总体均值向量,即: 2,1),(=i w P i 2 ,1),|(=i w x p i ∑==21 )()|() ()|()|(j j j i i i w P w x P w P w x P x w P