云存储中的分布式文件系统的研究

云存储中的分布式文件系统的研究

(山东大学信息科学与工程学院,山东济南250100)

摘要:云存储专注于解决云计算系统中的海量数据存储问题;文件系统用来管理大量的文件信息,并负责对文件的存储空间进行分配;分布式文件系统不仅要管理本地计算机的数据文件,同时还要管理整个存储系统的中的数据文件。文章首先对云计算云存储概念简单介绍,并通过对云存储的技术原理、性能优势等进行分析,指出分布式文件系统对于云存储技术的重要性;最后对现有的云存储分布式文件系统进行详细评论。全文工作将指导我们进一步深入研究云存储技术。

关键词:云计算云存储分布式文件系统

1、引言

随着信息化程度不断提高,全球数据日益膨胀。面对当前PB级的海量数据存储需求,云存储以其扩展性强、性价比高、容错性好等优势得到了业界的广泛认同。云存储伴随云计算而生,它很早就进入了广大研究人员的视野,众多企业将其作为其进军云计算的第一步、文件系统【1】是操作系统的重要组成部分,用来管理和存储大量的文件信息,负责对文件的存储空间进行分配和管理,并对存入其中的文件进行保护和检索,同时为用户提供包括文件创建、删除、命名、读写、访问等一系列功能。

分布式文件系统除了具有本地文件系统的所有功能外,还必须管理整个系统中所有计算机上的文件资源,从而把整个分布式文件资源以统一的视图呈现给用户。此外,分布式文件系统还需要隐藏内部的实现细节,提供给用户统一的访问接口和方便的资源管理手段【2】。很明显,作为一种典型的分布式系统,云存储需要分布式文件系统的底层支撑以实现各种功能。

2、云存储和云计算

云存储是在云计算(cloud computing)概念上延伸和发展出来的一个新的概念,是指通过集群应用、网格技术或分布式文件系统等功能,将网络中大量各种不同类型的存储设备通过应用软件集合起来协同工作,共同对外提供数据存储和业务访问功能的一个系统。当云计算系统运算和处理的核心是大量数据的存储和管理时,云计算系统中就需要配置大量的存储设备,那么云计算系统就转变成为一个云存储系统,所以云存储是一个以数据存储和管理为核心的云计算系统。简单来说,云存储就是将储存资源放到云上供人存取的一种新兴方案。使用者可以在任何时间、任何地方,透过任何可连网的装置连接到云上方便地存取数据[3]。

云存储系统的结构模型由4层组成。

存储层

存储层是云存储最基础的部分。存储设备可以是FC光纤通道存储设备,可以是NAS 和iSCSI等IP存储设备,也可以是SCSI或SAS等DAS存储设备。云存储中的存储设备往往数量庞大且分布多不同地域,彼此之间通过广域网、互联网或者FC光纤通道网络连接在一起。

存储设备之上是一个统一存储设备管理系统,可以实现存储设备的逻辑虚拟化管理、多链路冗余管理,以及硬件设备的状态监控和故障维护。

基础管理

基础管理层是云存储最核心的部分,也是云存储中最难以实现的部分。基础管理层通过集群、分布式文件系统和网格计算等技术,实现云存储中多个存储设备之间的协同工作,使多个的存储设备可以对外提供同一种服务,并提供更大更强更好的数据访问性能。

应用接口

应用接口层是云存储最灵活多变的部分。不同的云存储运营单位可以根据实际业务类型,开发不同的应用服务接口,提供不同的应用服务。比如视频监控应用平台、IPTV和视频点播应用平台、网络硬盘引用平台,远程数据备份应用平台等。

访问层

任何一个授权用户都可以通过标准的公用应用接口来登录云存储系统,享受云存储服务。云存储运营单位不同,云存储提供的访问类型和访问手段也不同。

云存储系统是一个多存储设备、多应用、多服务协同工作的集合体,任何一个单点的存储系统都不是云存储。

云计算与云存储密不可分,我们可以说云存储是云计算服务的一种,即SaaS(storage as aservice,存储即服务)。甚至可以说,利用云计算系统来建立存储系统,此时的云存储概念相当于一个云计算服务,它往往称之为“存储云”。如亚马逊的S3服务,我们可以利用它来建立另外一个存储系统,S3服务本身就是云服务,所以这样的系统可以称为云存储。

另外,云计算系统需要底层海量文件的存储支持,这一般采用大型的分布式文件系统实现,这就是云存储的模型,它可以直接对外提供云的存储服务。所以可以说云存储位于云计算的底层。本文所出现的云存储概念均指这种关系,它是云计算系统的基础设施。

3、分布式文件系统

分布式文件系统(Distributed File System)是指文件系统管理的物理存储资源不一定直接连接在本地节点上,而是通过计算机网络与节点相连。分布式文件系统的设计基于客户机/服务器模式。一个典型的网络可能包括多个供多用户访问的服务器。另外,对等特性允许一些系统扮演客户机和服务器的双重角色。例如,用户可以“发表”一个允许其他客户机访问的目录,一旦被访问,这个目录对客户机来说就像使用本地驱动器一样,下面是三个基本的分布式文件系统。

云存储是云计算系统的基础和支撑,也是提供云计算IaaS服务核心系统。它是一种复杂的分布式文件系统。分布式文件系统有许多成熟而简单的架构方案,然而无法满足云存储和支持云计算系统的需求。这是因为面向云存储的分布式文件系统应该建立在超大规模的基础之上,并且具有海量文件存储能力、高并发低延迟的读写效率以及相当高的可靠性、稳定性和安全性。可见,面向云存储需求的应用目标为分布式文件系统的架构设计带来了新的挑战。

现有的云存储分布式文件系统包括GFS[4]、HDFS[5]、Lustre、PVFS、PFS、Dynamo[6]等。它们的许多设计理念相似,同时也各有特色。下面对现有的分布式文件系统进行详细介绍。

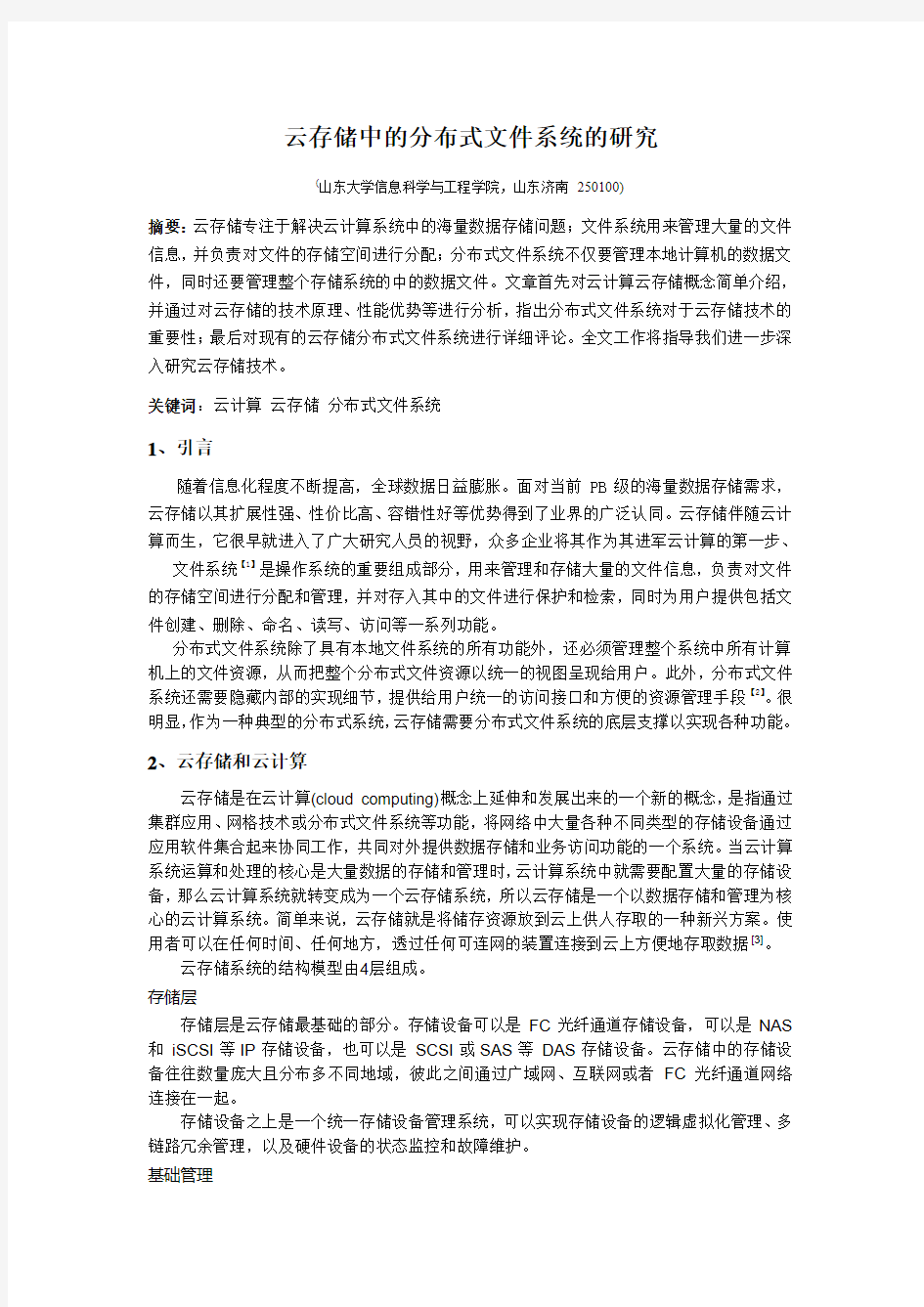

2.1 GFS(Google File System)架构研究

GFS与传统的分布式文件系统有很多相同的目标,但GFS的设计受到了当前及预期的应用方面的工作量及技术环境的驱动,这反映了它与早期的文件系统明显不同的设想。这就需要对传统的选择进行重新检验并进行完全不同的设计观点的研究[7]。

一个GFS集群由一个master和大量的chunk server构成,并被许多客户访问。如图2.1所示。Master和chunk server通常是运行用户层服务进程的Linux机器。只要资源和可靠性允许,chunk server和客户端可以运行在同一个机器上。master维护文件系统所以

的元数据,包括名字空间、访问控制信息、从文件到块的映射以及块的当前位置。它也控制系统范围的活动,如块租约管理,孤儿块的垃圾收集,chunk server间的块迁移。master 定期通过心跳消息与每一个chunk server通信,给chunk server传递指令并收集它的状态。

综上,GFS与以往的文件系统的架构的不同如下:

1.部件错误不再被当作异常,而是将其作为常见的情况加以处理。部件的数量和质量使得一些机器随时都有可能无法工作并且有一部分还可能无法恢复。所以实时地监控、错误检测、容错、自动恢复对系统来说必不可少。

2.海量文件分块的存储。设计中操作的参数、块的大小必须要重新考虑。对大型的文件的管理一定要能做到高效,对小型的文件也必须支持,但不必优化。

3.大部分文件的更新是通过添加新数据完成的,而不是改变已存在的数据。一旦写完,文件就只可读。

4.系统工作量主要由两种读操作构成。对大量数据的流方式的读操作和对少量数据的随机方式的读操作。此外,还包含许多对大量数据进行的、连续的、向文件添加数据的写操作。

由以上分析可以看出,GFS并不是一个通用的云存储系统,它更适合于大型的搜索业务以至于GFS的设计考虑了许多具体业务特性,如文件的大小、读写频率等,这些将限制GFS的业务应用。同时,主从式结构的单点失效和性能瓶颈问题也是业内关注的焦点[7]。当然,GFS本身也在优化和改进之中。

图2.1 GFS系统框架

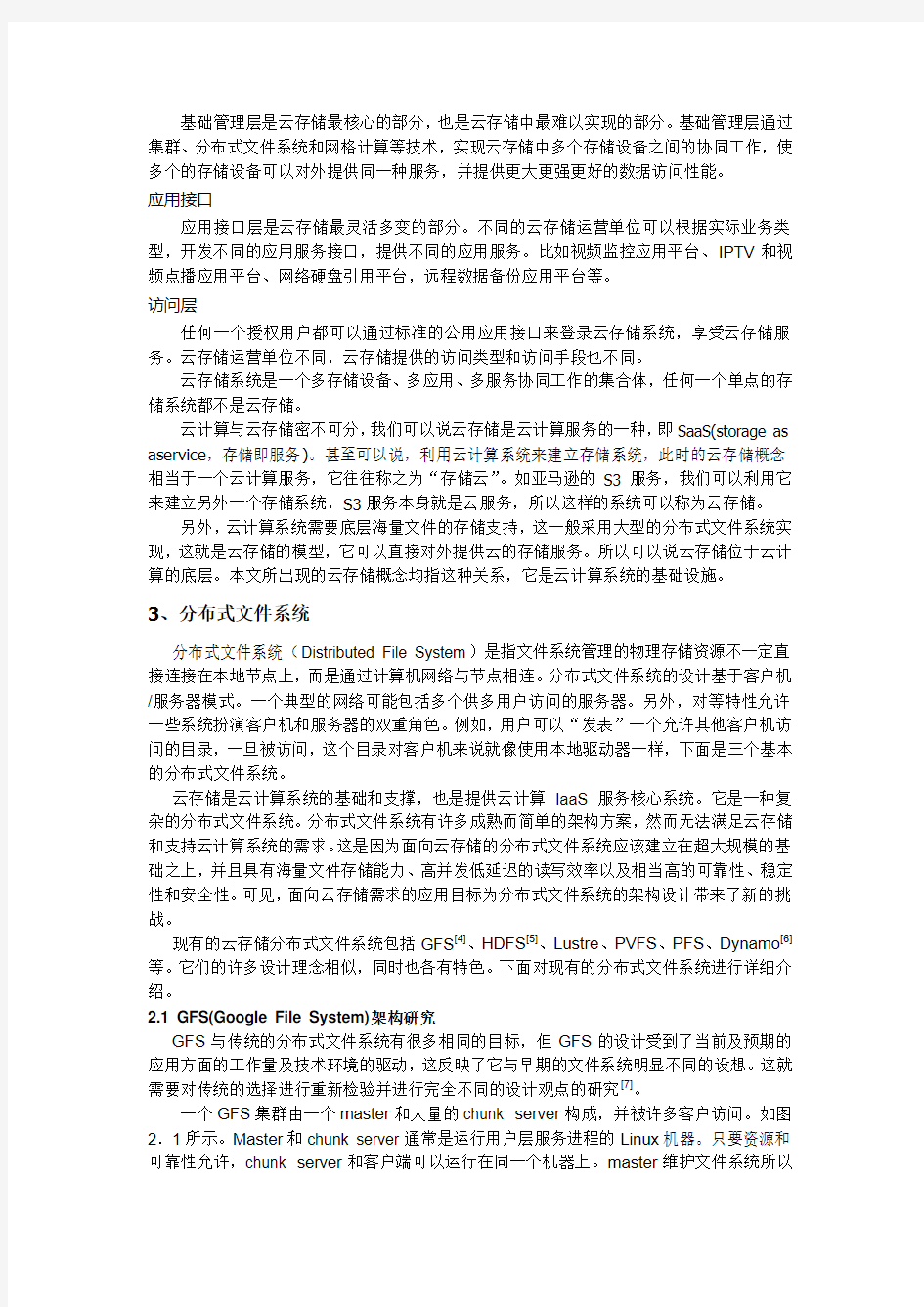

2.2 HDFS(Hadoop Distribute File System)

Hadoop是Apache开源组织的一个分布式计算框架,其主要包括HDFS、MapReduce 和HBase三个部分,它们分别对应谷歌云计算核心技术GFS、MapReduce和BigT able的开源实现。HDFS是Hadoop的存储基础,具有高容错、高吞吐等优点,其将硬件错误视为常态而非异常情况,并以错误监测和快速恢复为核心架构目标。

图2.2 HDFS系统框架

HDFS采用maLster/slaVe架构,如图2.2所示。一个HDFS集群是由一个Namenode 和一定数目的Datanodes组成。Namenode是一个中心服务器,负责管理文件系统的名字空间以及客户端对文件的访问[8]。集群中的Datanode一般是一个节点一个,负责管理它所在节点上的存储。HDFS暴露了文件系统的名字空间,用户能够以文件的形式在上面存储数据。从内部看,一个文件其实被分成一个或多个数据块,这些块存储在一组Datanode上。Namenode执行文件系统的名字空间操作,比如打开、关闭、重命名文件或目录。它也负责确定数据块到具体Datanode节点的映射。Datanode负责处理文件系统客户端的读写请求。在Namenode的统一调度下进行数据块的创建、删除和复制。

2.3 Dynamo架构深入研究

图2.3 Dynamo平台的架构

Dynamo是一个完全分布式的、无中心节点的存储系统。相比传统的集中式存储系统,Dynamo在设计之初就被定位为一个高可靠、高可用且具有良好容错性的系统。尽管这是一个很有争议的系统[9],然而,实践表明Dynamo作为亚马逊的key.value模式的存储平台,可用性和扩展性较高:读写访问中99.9%的响应时间都在300ms内[10]。

Dynamo采用了一些技术,解决了其对等式架构下的一致性问题。如表2.1所示。

问题采取的相关技术

数据均匀分布改进的一致性哈希算法

数据冲突处理响亮时钟

临时故障处理Hinted handoff数据回传机制

永久恢复处理Merlie哈希树

成员资格和错误监测基于Gossip的错误排查

表2.1 Dynamo架构中遇到的问题及相关技术

Dynamo按分布式系统常用的哈希算法切分数据,分放在不同的节点上。之所以采用该算法的原因是环上每个节点只需要处理落在它和它的前驱节点之间的数据,这样当有新的节点加入或者撤出时系统的震荡较小。

同时,一致性哈希是一种随机函数,在节点量较少的情况下很有可能造成节点数据分布的不均匀,而且基本的一致性哈希算法在选择节点位置时并没有考虑环上不同节点的性能差异。为了解决这个问题,亚马逊在Dynamo中引入了节点虚拟化的概念。每个虚拟节点都属于一个实际的物理节点。一个物理节点可能有多个虚拟节点。分布在一致性环上的虚拟节点有效的解决了性能不均问题。也可以理解为,它放在环上作为一个节点的是一组机器,这一组机器是通过同步机制保证数据一致的。

Dynamo的一个节点中的同步是由客户端来“解决”的,使用所谓的(Ⅳ冠形)模型,其中,N表示节点中机器的总数,尺表示一个读请求需要的机器参与总数,形代表一个写请求需要的机器参与总数,这些值由client端配置。

总的来说,Dynamo的架构有以下三个特点:

1.Dynamo最终一致性及同步的设计对于是节点故障是有价值的,但是却无法估算有多少数据未同步。如果改用常规的提交日志方式的话,很容易就能实现故障恢复并且计算未同步的数据量。

2.Dynamo很多一致性问题都是去中心化的设计所导致的。过去,中心化设计导致了很多灾难,我们意识到要远离中心化。去中心化后,系统会更简洁,更具有可扩展性及可用性。中心化确实会形成瓶颈,但是没有证据说明中心化就低可用性[11]。

3.Dynamo其实在部分情况下还是一个中心化的体系,如交换机故障发生了网络分片,服务器分成2个独立的小网,这时候Dynamo对客户端是不可用的,尽管客户端可以连接上Dynamo。

4、总结

自云计算技术出现以来,随着科学技术的不断发展,云计算应用不断发展壮大,云存储也从理论走向实践。本文首先对云计算云存储技术简要介绍,并对云存储的技术原理、性能优势等进行分析,同时指出分布式文件系统是实现云存储系统高可扩展性、高容错性。高性价比等一系列优势的基础保障。最后对现有的云存储分布式文件系统进行详细而深入的讨论。在云存储的发展和应用过程中,近年来不断涌现新的技术和创意。本文总结历年经验,希望为以后的云存储研究提供基础支撑。

参考文献:

[1]赵文辉,徐俊,周如林等,网络存储技术[M] 北京:清华大学出版社,2005

[2] Mario F Jauvin. A methodology for the new CPE pankligm in large UNIX networks[M]

Computer measurement group conference,1995

[3] 王鹏.云计算的关键技术及应用实例.第一版.中国:人民邮电出版社,2010.3.287

[4] Andrew S.Tanenbaum,Maarten Van Steen.Distributed Systems and

paradigms.China.Tsinghua,2007.5-234

[5] Hadoop Org.”Hadoop Documents”.http:∥hadoop.apaache.org

[6] 叶伟.SaaS架构设计.中国:电子工业出版社.2009.56.78

[7] Hoang Pham.Special Issue on Critical Reliability Challenges and Practices

IEEE transactions on systems.2007,3.37(2).141-142

[8] 邓自立.云计算中的网络拓扑设计和Hadoop平台研究.2009,5,12.13

[9] 刘鹏.云计算.第一版.中国:电子工业出版社,2010.9.85

[10] Iall Foster,Yong Zhao,Ioan Raicu,Shiyong Lu. Clud Computing and Grid

Computing 360—Degree Compared.Grid Computing EnVironments Workshop,

2008.2(8),1—10

[11] Zhan Ying,Sun Yong;Cloud Storage Management Technology,Second Intemational

Conference on Information and Computing Science,2009.301.3ll

ONEStor分布式存储系统介绍

ONEStor 分布式存储系统介绍 关于ONEStor 分布式存储系统介绍,小编已在金信润天 容: 技术特点 H3C ONEStor 存储系统采用分布式设计,可以运行在通用 x86服务器上,在部署该软件时, 会把所有服务器的本地硬盘组织成一个虚拟存储资源池,对上层应用提供块存储功能。 H3C ONEStor 分布式存储软件系统具有如下特点: 领先的分布式架构 H3CONEStor 存储软件的采用全分布式的架构: 分布式管理集群,分布式哈希数据分布算法, 分布式无状态客户端、分布式Cache 等,这种架构为存储系统的可靠性、 可用性、自动运维、 高性能等方面提供了有力保证。其系统架构组成如下图所示: jyionitors 上图中,ONEStor 逻辑上可分为三部分: OSD Monitor 、Client 。在实际部署中,这些逻辑 Get 到了部分资料,整理出以下内 QSDs CliEnt£ Object I/O V* Failure reporting, v ------ map distribution

组件可灵活部署,也就是说既可以部署在相同的物理服务器上,也可以根据性能和可靠性等方面的考虑,部署在不同的硬件设备上。下面对每一部分作一简要说明。 OSD:Object-based Storage Device OSD由系统部分和守护进程(OSD deamon两部分组成。OSD系统部分可看作安装了操作系统和文件系统的计算机,其硬件部分包括处理器、内存、硬盘以及网卡等。守护进程即运行在内存中的程序。在实际应用中,通常将每块硬盘(SSD或HDD对应一个OSD并将其视 为OSD的硬盘部分,其余处理器、内存、网卡等在多个OSD之间进行复用。ONEStor存储集群中的用户都保存在这些OSD中。OSDdeamon负责完成OSD的所有逻辑功能,包括与monitor 和其他OSD(事实上是其他OSD的deamon)通信以维护更新系统状态,与其他OSD共同完成数据的存储和维护,与client 通信完成各种数据对象操作等等。 Monitor : Monitor 是集群监控节点。Monitor 持有cluster map 信息。所谓Cluster Map ,粗略的说就是关于集群本身的逻辑状态和存储策略的数据表示。ONEStor Cluster Map包括Monitor map osd map pg map crush map等,这些map构成了集群的元数据。总之,可以认为Monitor 持有存储集群的一些控制信息,并且这些map信息是轻量级的,只有在集群的物理设备(如主机、硬盘)和存储策略发生变化时map信息才发生改变。 Client : 这里的Client可以看出外部系统获取存储服务的网关设备。client通过与OSD或者Monitor 的交互获取cluster map然后直接在本地进行计算,得出数据的存储位置后,便直接与对应的OSD 通信,完成数据的各种操作。在此过程中,客户端可以不依赖于任何元数据服务器,不进行任何查表操作,便完成数据访问流程。这一点正是ONEStor分布式存储系统可以实现扩展性的重要保证。 客户的数据到达Clie nt后,如何存储到OSD上,其过程大致如下图所示:

分布式汽车电气电子系统设计和实现架构

分布式汽车电气电子系统设计和实现 架构

分布式汽车电气/电子系统设计和实现架构在过去的十几年里,汽车的电气和电子系统已经变得非常的复杂。今天汽车电子/电气系统开发工程师广泛使用基于模型的功能设计与仿真来迎接这一复杂性挑战。新兴标准定义了与低层软件的标准化接口,最重要的是,它还为功能实现工程师引入了一个全新的抽象级。 这提高了软件组件的可重用性,但不幸的是,关于如何将基于模型的功能设计的结果转换成高度环境中的可靠和高效系统实现方面的指导却几乎没有。 另外,论述设计流程物理端的文章也非常少。本文概述了一种推荐的系统级设计方法学,包括、分布在多个ECU中的网络和任务调度、线束设计和规格生成。 为什么需要AUTOSAR? 即使在同一家公司,“架构设计”对不同的人也有不同的含义,这取决于她们站在哪个角度上。物理架构处理系统的有形一面,如布线和连接器,逻辑架构定义无形系统的结构和分配,如软件和通信协议。当前设计物理架构和逻辑架构的语言是独立的,这导致相同一个词的意思能够完全不同,设计团队和流程也是独立的,这也导致了一个非常复杂的设计流程(如图1所示)。

图1:物理和逻辑设计流程。 这种复杂性导致了次优设计结果,整个系统的正确功能是如此的难于实现,以致于几乎没有时间去寻求一种替代方法,它可导致更坚固的、可扩展性更好的和更具成本效益的解决方案。为了实现这样一种解决方案,设计师需要新的方法,它能够将物理和逻辑设计流程紧密相连,并依然允许不同的设计团队做她们的工作。 新兴的AUTOSAR标准为系统级汽车电子/电气设计方法学提供了一个技术上和经济上都可行的选择,尽管它主要针对软件层面,即逻辑系统的设计。不过,大量广泛的AUTOSAR元模型及其丰富的接口定义允许系统级电子/电气架构师以标准的格式表示她的设计思想。从经济上看,AUTOSAR标准打开了一个巨大的、统一的市场,它使得能够创立合适的设计工具。

分布式文件系统设计方案

分布式文件系统(DFS)解决方案 一“分布式文件系统(DFS)”概述 DFS并不是一种文件系统,它是Windows Server System上的一种客户/服务器模式的网络服务。它可以让把局域网中不同计算机上的不同的文件共享按照其功能组织成一个逻辑的分级目录结构。系统管理员可以利用分布式文件系统(DFS),使用户访问和管理那些物理上跨网络分布的文件更加容易。通过DFS,可以使分布在多个服务器或者不同网络位置的文件在用户面前显示时,就如同位于网络上的一个位置。用户在访问文件时不再需要知道和指定它们的实际物理位置。 例如,如果您的销售资料分散在某个域中的多个存储设备上,您可以利用DFS 使其显示时就好像所有的资料都位于同一网络共享下,这样用户就不必到网络上的多个位置去查找他们需要的信息。 二部署使用“分布式文件系统(DFS)”的原因 ●访问共享文件夹的用户分布在一个站点的多个位置或多个站点上; ●大多数用户都需要访问多个共享文件夹; ●通过重新分布共享文件夹可以改善服务器的负载平衡状况; ●用户需要对共享文件夹的不间断访问;

●您的组织中有供内部或外部使用的Web 站点; ●用户访问共享文件需要权限。 三“分布式文件系统(DFS)”类型 可以按下面两种方式中的任何一种来实施分布式文件系统: 1.作为独立的分布式文件系统。 ●不使用Active Directory。 ●至多只能有一个根目录级别的目标。 ●使用文件复制服务不能支持自动文件复制。 ●通过服务器群集支持容错。 2.作为基于域的分布式文件系统。 ●必须宿主在域成员服务器上。 ●使它的DFS 名称空间自动发布到Active Directory 中。 ●可以有多个根目录级别的目标。 ●通过FRS 支持自动文件复制。 ●通过FRS 支持容错。 四分布式文件系统特性 除了Windows Server System 中基于服务器的DFS 组件外,还有基于客户的DFS 组件。DFS 客户程序可以将对DFS 根目录或DFS 链接的引用缓存一段时间,该时间由管理员指定。此存储和读取过程对于

Hadoop分布式文件系统:架构和设计

Hadoop分布式文件系统:架构和设计 引言 (2) 一前提和设计目标 (2) 1 hadoop和云计算的关系 (2) 2 流式数据访问 (2) 3 大规模数据集 (2) 4 简单的一致性模型 (3) 5 异构软硬件平台间的可移植性 (3) 6 硬件错误 (3) 二HDFS重要名词解释 (3) 1 Namenode (4) 2 secondary Namenode (5) 3 Datanode (6) 4 jobTracker (6) 5 TaskTracker (6) 三HDFS数据存储 (7) 1 HDFS数据存储特点 (7) 2 心跳机制 (7) 3 副本存放 (7) 4 副本选择 (7) 5 安全模式 (8) 四HDFS数据健壮性 (8) 1 磁盘数据错误,心跳检测和重新复制 (8) 2 集群均衡 (8) 3 数据完整性 (8) 4 元数据磁盘错误 (8) 5 快照 (9)

引言 云计算(cloud computing),由位于网络上的一组服务器把其计算、存储、数据等资源以服务的形式提供给请求者以完成信息处理任务的方法和过程。在此过程中被服务者只是提供需求并获取服务结果,对于需求被服务的过程并不知情。同时服务者以最优利用的方式动态地把资源分配给众多的服务请求者,以求达到最大效益。 Hadoop分布式文件系统(HDFS)被设计成适合运行在通用硬件(commodity hardware)上的分布式文件系统。它和现有的分布式文件系统有很多共同点。但同时,它和其他的分布式文件系统的区别也是很明显的。HDFS是一个高度容错性的系统,适合部署在廉价的机器上。HDFS 能提供高吞吐量的数据访问,非常适合大规模数据集上的应用。 一前提和设计目标 1 hadoop和云计算的关系 云计算由位于网络上的一组服务器把其计算、存储、数据等资源以服务的形式提供给请求者以完成信息处理任务的方法和过程。针对海量文本数据处理,为实现快速文本处理响应,缩短海量数据为辅助决策提供服务的时间,基于Hadoop云计算平台,建立HDFS分布式文件系统存储海量文本数据集,通过文本词频利用MapReduce原理建立分布式索引,以分布式数据库HBase 存储关键词索引,并提供实时检索,实现对海量文本数据的分布式并行处理.实验结果表 明,Hadoop框架为大规模数据的分布式并行处理提供了很好的解决方案。 2 流式数据访问 运行在HDFS上的应用和普通的应用不同,需要流式访问它们的数据集。HDFS的设计中更多的考虑到了数据批处理,而不是用户交互处理。比之数据访问的低延迟问题,更关键的在于数据访问的高吞吐量。 3 大规模数据集 运行在HDFS上的应用具有很大的数据集。HDFS上的一个典型文件大小一般都在G字节至T字节。因此,HDFS被调节以支持大文件存储。它应该能提供整体上高的数据传输带宽,能在一个集群里扩展到数百个节点。一个单一的HDFS实例应该能支撑数以千万计的文件。

分布式文件系统Hadoop HDFS与传统文件系统Linux FS的比较与分析

6苏州大学学报(工科版)第30卷 图1I-IDFS架构 2HDFS与LinuxFS比较 HDFS的节点不管是DataNode还是NameNode都运行在Linux上,HDFS的每次读/写操作都要通过LinuxFS的读/写操作来完成,从这个角度来看,LinuxPS是HDFS的底层文件系统。 2.1目录树(DirectoryTree) 两种文件系统都选择“树”来组织文件,我们称之为目录树。文件存储在“树叶”,其余的节点都是目录。但两者细节结构存在区别,如图2与图3所示。 一二 Root \ 图2ItDFS目录树围3LinuxFS目录树 2.2数据块(Block) Block是LinuxFS读/写操作的最小单元,大小相等。典型的LinuxFSBlock大小为4MB,Block与DataN-ode之间的对应关系是固定的、天然存在的,不需要系统定义。 HDFS读/写操作的最小单元也称为Block,大小可以由用户定义,默认值是64MB。Block与DataNode的对应关系是动态的,需要系统进行描述、管理。整个集群来看,每个Block存在至少三个内容一样的备份,且一定存放在不同的计算机上。 2.3索引节点(INode) LinuxFS中的每个文件及目录都由一个INode代表,INode中定义一组外存上的Block。 HDPS中INode是目录树的单元,HDFS的目录树正是在INode的集合之上生成的。INode分为两类,一类INode代表文件,指向一组Block,没有子INode,是目录树的叶节点;另一类INode代表目录,没有Block,指向一组子INode,作为索引节点。在Hadoop0.16.0之前,只有一类INode,每个INode都指向Block和子IN-ode,比现有的INode占用更多的内存空间。 2.4目录项(Dentry) Dentry是LinuxFS的核心数据结构,通过指向父Den姆和子Dentry生成目录树,同时也记录了文件名并 指向INode,事实上是建立了<FileName,INode>,目录树中同一个INode可以有多个这样的映射,这正是连

分布式存储系统的一些理解和实践

分布式存储系统的一些理解和实践 张建伟 一、分布式存储系统介绍 1.简介 互联网数据规模越来越大,并发请求越来越高,传统的关系数据库,在很多使用场景下并不能很好的满足需求。分布式存储系统应运而生。它有良好的扩展性,弱化关系数据模型,甚至弱化一致性要求,以得到高并发和高性能。按功能分类,主要有以下几种: ?分布式文件系统 hdfs ceph glusterfs tfs ?分布式对象存储 s3(dynamo) ceph bcs(mola) ?分布式表格存储 hbase cassandra oceanbase ?块存储 ceph ebs(amazon) 分布式存储系统,包括分布式系统和单机存储两部分;不同的系统,虽在功能支持、实现机制、实现语言等方面是有差异的,但其设计时,关注的关键问题是基本相同的。单机存储的主流实现方式,有hash引擎、B+树引擎和LSM树(Log Structured Merge Tree)三种,不展开介绍。本文第二章节,主要结合hbase、cassandra和ceph,讲下分布式系统设计部分,需要关注的关键问题。 2.适用场景 各分布式存储系统功能定位不尽相同,但其适用和不适用的场景,在一定程度上是相同的,如下。

1)适用 大数据量(大于100T,乃至几十PB) key/value或者半结构化数据 高吞吐 高性能 高扩展 2)不适用 Sql查询 复杂查询,如联表查询 复杂事务 二、分布式存储系统设计要点 1.数据分布 分布式存储,可以由成千甚至上万台机器组成,以实现海量数据存储和高并发。那它最先要解决的就是数据分布问题,即哪些数据存储在哪些机器(节点)上。常用的有hash类算法和用meta表映射两种方式。一般完全分布式的设计(无master节点),会用hash类算法;而集中式的设计(有master节点)用meta表映射的方式。两者各有优缺点,后面讲到具体问题时再做比较。 1)一致性hash 将存储节点和操作的key(key唯一标识存储的object,有时也叫object name)都hash到0~2的32次方区间。映射到如下环中的某个位置。沿操作key的位置顺时针找到的第一个节点即为此key的primary存储节点。如下图所示:

分布式文件存储方案

1DFS系统 (DFS) 是AFS的一个版本,作为开放软件基金会(OSF)的分布 分布式文件系统 式计算环境(DCE)中的文件系统部分。 如果文件的访问仅限于一个用户,那么分布式文件系统就很容易实现。可惜的是,在许多网络环境中这种限制是不现实的,必须采取并发控制来实现文件的多用户访问,表现为如下几个形式: 只读共享任何客户机只能访问文件,而不能修改它,这实现起来很简单。 受控写操作采用这种方法,可有多个用户打开一个文件,但只有一个用户进行写修改。而该用户所作的修改并不一定出现在其它已打开此文件的用户的屏幕上。 并发写操作这种方法允许多个用户同时读写一个文件。但这需要操作系统作大量的监控工作以防止文件重写,并保证用户能够看到最新信息。这种方法即使实现得很好,许多环境中的处理要求和网络通信量也可能使它变得不可接受。 NFS和AFS的区别 NFS和AFS的区别在于对并发写操作的处理方法上。当一个客户机向服务器请求一个文件(或数据库记录),文件被放在客户工作站的高速缓存中,若另一个用户也请求同一文件,则它也会被放入那个客户工作站的高速缓存中。当两个客户都对文件进行修改时,从技术上而言就存在着该文件的三个版本(每个客户机一个,再加上服务器上的一个)。有两种方法可以在这些版本之间保持同步: 无状态系统在这个系统中,服务器并不保存其客户机正在缓存的文件的信息。因此,客户机必须协同服务器定期检查是否有其他客户改变了自己正在缓存的文件。这种方法在大的环境中会产生额外的LAN通信开销,但对小型LAN来说,这是一种令人满意的方法。NFS 就是个无状态系统。 回呼(Callback)系统在这种方法中,服务器记录它的那些客户机的所作所为,并保留它们正在缓存的文件信息。服务器在一个客户机改变了一个文件时使用一种叫回叫应答(callbackpromise)的技术通知其它客户机。这种方法减少了大量网络通信。AFS(及OSFDCE的DFS)就是回叫系统。客户机改变文件时,持有这些文件拷贝的其它客户机就被回叫并通知这些改变。 无状态操作在运行性能上有其长处,但AFS通过保证不会被回叫应答充斥也达到了这一点。方法是在一定时间后取消回叫。客户机检查回叫应答中的时间期限以保证回叫应答是当前有效的。回叫应答的另一个有趣的特征是向用户保证了文件的当前有效性。换句话说,若

中科分布式存储系统技术白皮书V2.0

LINGHANG TECHNOLOGIES CO.,LTD 中科分布式存储系统技术白皮书 北京领航科技 2014年04

目录 1、产品介绍 (3) 1.1 云时代的政府/企业烦恼 (3) 1.2 产品服务与定位 (3) 2、中科分布式存储应用场景 (4) 2.1 目标用户 (4) 2.2 产品模式 (4) 2.2.1高性能应用的底层存储 (4) 2.2.2企业级海量数据存储平台 (5) 2.2.3容灾备份平台 (5) 2.3 使用场景 (5) 2.3.1企业级数据存储 (5) 2.3.2私有云计算 (6) 2.3.3海量数据存储 (6) 2.3.4大数据分析 (7) 2.3.5 容灾备份 (7) 3、中科分布式存储核心理念 (8) 4、中科分布式存储功能服务 (9) 4.1 存储系统功能介绍 (9) 4.2 WEB监控管理端功能介绍 (11) 5、系统技术架构 (12) 5.1 系统总体架构 (12) 5.2 系统架构性特点 (12) 5.3 技术指标要求 (14) 5.4 系统软硬件环境 (15)

1、产品介绍 1.1云时代的政府/企业烦恼 ?政府、企事业单位每天产生的大量视频、语音、图片、文档等资料,存在 哪里? ?政府、企事业单位各个部门、各个子系统之间强烈的数据共享需求如何满 足? ?大数据如何高效处理以达到统一存取、实时互动、价值传播、长期沉淀? ?您是否为单位电子邮箱充斥大量冗余数据还要不断扩容而烦恼? ?政府、企事业单位的私有云平台为什么操作和数据存取这么慢? ?政府、企事业单位的存储平台数据量已接近临界值需要扩容,但上面有重 要业务在运行,如何能在线扩展存储空间? ?公司的每一个子公司都有重要客户数据,要是所在的任何一个城市发生大 规模灾难(比如地震)数据怎么办? ?政府、企事业单位有一些历史数据平时比较少用到,但又不能丢掉,占用 了大量的高速存储资源,能否移到更廉价的存储设备上去? 1.2产品服务与定位 大数据时代已经来临! 面对数据资源的爆炸性增长,政府、企事业单位每天产生的海量视频、语音、图片、文档和重要客户数据等资料如何有效存取?政府多个部门之间、公司和子公司之间、公司各个部门之间强烈的数据共享需求如何满足?如果

大型电商分布式架构设计与优化

大型电商分布式架构设计与优化 本文主题为电商网站架构案例,将介绍如何从电商网站的需求,到单机架构,逐步演变为常用的、可供参考的分布式架构原型。除具备功能需求外,还具备一定的高性能、高可用、可伸缩、可扩展等非功能质量需求(架构目标)。

本文大纲: 1. 使用电商案例的原因 2. 电商网站需求 3. 网站初级架构 4. 系统容量估算 5. 网站架构分析 6. 网站架构优化 根据实际需要,进行改造、扩展、支持千万PV,是没问题的。 使用电商案例的原因 分布式大型网站,目前看主要有几类: 1.大型门户(比如网易、新浪等); 2.SNS网站(比如校内、开心网等); 3.电商网站(比如阿里巴巴、京东商城、国美在线、汽车之家等)。

大型门户一般是新闻类信息,可以使用CDN、静态化等方式优化。而开心网等交互性比较多,可能会引入更多的NoSQL、分布式缓存、使用高性能的通信框架等。电商网站具备以上两类的特点,比如产品详情可以采用CDN,静态化,交互性高的需要采用NoSQL等技术。因此,我们采用电商网站作为案例,进行分析。 电商网站需求 客户需求: ?建立一个全品类的电子商务网站(B2C),用户可以在线购买商品,可以在线支付,也可以货到付款; ?用户购买时可以在线与客服沟通; ?用户收到商品后,可以给商品打分和评价; ?目前有成熟的进销存系统,需要与网站对接; ?希望能够支持3~5年,业务的发展; ?预计3~5年用户数达到1000万; ?定期举办双11、双12、三八男人节等活动; ?其他的功能参考京东或国美在线等网站。 客户就是客户,不会告诉你具体要什么,只会告诉你他想要什么,我们很多时候要引导、挖掘客户的需求。好在提供了明确的参考网站。因此,下一步要进行大量的分析,结合行业以及参考网站,给客户提供方案。其它的这里暂不展开。

典型分布式文件系统概述

分布式文件系统概述(一) 杨栋 yangdonglee@https://www.360docs.net/doc/9417764901.html, 2006-12 摘要 文件系统是操作系统用来组织磁盘文件的方法和数据结构。传统的文件系统指各种UNIX平台的文件系统,包括UFS、FFS、EXT2、XFS等,这些文件系统都是单机文件系统,也称本地文件系统。随着网络的兴起,为了解决资源共享问题,出现了分布式文件系统。分布式文件系统是指文件系统管理的物理存储资源不一定直接连接在本地节点上,而是通过计算机网络与节点相连。本文1简要回顾了本地文件系统,然后按照发展例程大致介绍了2006年之前各时期主要的分布式文件系统,最后从设计目标、体系结构及关键技术等方面比较了各个分布式文件系统的异同。目前很火的Hadoop文件系统、S3文件系统都是从NFS等早期文件系统一步步演化而来的,了解分布式文件系统的历史,有助于大家更加深刻地领会分布式文件系统的精髓。 1本文写于2006年底,借鉴了别人的大量资料,目的是为了与同学们分享分布式文件系统的发展史。笔者在硕士期间跟随中科院计算所的孟老师、熊老师和唐荣锋进行分布式文件系统的研究和开发。分布式文件系统源远流长,本文只是选择了其发展史上的部分实例进行简单描述,由于笔者水平十分有限,错误之处难免很多,各位同学发现问题之后麻烦回复邮件到yangdonglee@https://www.360docs.net/doc/9417764901.html,,我会尽全力完善,或者请各位同学自行修正。笔者目前在百度进行云计算方面的研究和开发,希望有兴趣的同学一起进行探讨。

目录 1.引言 (5) 2.本地文件系统 (5) 2.1FFS (6) 2.2LFS (6) 2.3Ext3 (7) 3.分布式文件系统 (7) 3.1 发展历程 (7) 3.2分布式文件系统分类 (8) 3.2.1 实现方法 (8) 3.2.2研究状况 (8) 3.3 NFS (9) 3.3.1概述 (9) 3.3.2 体系结构 (9) 3.3.3 通信机制 (10) 3.3.4进程 (10) 3.3.5 命名 (10) 3.3.6 同步机制 (11) 3.3.7 缓存和复制 (11) 3.3.8 容错性 (12) 3.3.9 安全性 (13) 3.4 AFS、DFS、Coda和InterMezzo (13) 3.5 SpriteFS和Zebra (14) 3.6xFS (16) 3.6.1 概述 (16) 3.6.2 体系结构 (16) 3.6.3 通信 (16) 3.6.4 进程 (17) 3.6.5 命名 (18) 3.6.6 缓存 (19)

分布式文件系统架构设计(20201126073806)

分布式文件系统架构设计 1. 前言...................................................... 3.

2. HDFS1 (3) 3. HDFS2 (5) 4. HDFS3 ............................................................................................. 1 1 5. 结语..................................................... 1.5

1. 刖言 Hadoop 是一个由Apache基金会所开发的分布式系统基础架构。用户可以在不了解分布式底层细节的情况下,开发分布式程序。充分利用集群的威力进行高速运算和存储。 Hadoop 实现了一个分布式文件系统(Hadoop Distributed File System ),简称HDFS,解 决了海量数据存储的问题;实现了一个分布式计算引擎MapReduce ,解决了海量数据如何计 算的问题;实现了一个分布式资源调度框架YARN,解决了资源调度,任务管理的问题。而我 们今天重点给大家介绍的是Hadoop 里享誉世界的优秀的分布式文件系统-HDFS。 Hadoop 重要的比较大的版本有:Hadoop1 ,Hadoop2 , hadoop3 。同时也相对应的有HDFS1 ,HDFS2,HDFS3三个大版本。后面的HDFS的版本,都是对前一个版本的架构进行了调整优 化,而在这个调整优化的过程当中都是解决上一个版本的架构缺陷,然而这些低版本的架构缺陷也是我们在平时工作当中会经常遇到的问题,所以这篇文章一个重要的目的就是通过给大家介绍HDFS不同版本的架构演进,通过学习高版本是如何解决低版本的架构问题从而来提升我 们的系统架构能力。 2. HDFS1

分布式存储系统设计方案——备份容灾

分布式存储系统设计方案——备份容灾 在分布式存储系统中,系统可用性是最重要的指标之一,需要保证在机器发生故障时,系统可用性不受影响,为了做到这点,数据就需要保存多个副本,并且多个副本要分布在不同的机器上,只要多个副本的数据是一致的,在机器故障引起某些副本失效时,其它副本仍然能提供服务。本文主要介绍数据备份的方式,以及如何保证多个数据副本的一致性,在系统出现机器或网络故障时,如何保持系统的高可用性。 数据备份 数据备份是指存储数据的多个副本,备份方式可以分为热备和冷备,热备是指直接提供服务的备副本,或者在主副本失效时能立即提供服务的备副本,冷备是用于恢复数据的副本,一般通过Dump的方式生成。 数据热备按副本的分布方式可分为同构系统和异步系统。同构系统是把存储节点分成若干组,每组节点存储相同的数据,其中一个主节点,其他为备节点;异构系统是把数据划分成很多分片,每个分片的多个副本分布在不同的存储节点,存储节点之间是异构的,即每个节点存储的数据分片集合都不相同。在同构系统中,只有主节点提供写服务,备节点只提供读服务,每个主节点的备节点数可以不一样,这样在部署上会有更大的灵活性。在异构系统中,所有节点都是可以提供写服务的,并且在某个节点发生故障时,会有多个节点参与故障节点的数据恢复,但这种方式需要比较多的元数据来确定各个分片的主副本所在的节点,数据同步机制也会比较复杂。相比较而言,异构系统能提供更好的写性能,但实现比较复杂,而同构系统架构更简单,部署上也更灵活。鉴于互联网大部分业务场景具有写少读多的特性,我们选择了更易于实现的同构系统的设计。 系统数据备份的架构如下图所示,每个节点代表一台物理机器,所有节点按数据分布划分为多个组,每一组的主备节点存储相同的数据,只有主节点能提供写服务,主节点负责把数据变更同步到所有的备节点,所有节点都能提供读服务。主节点上会分布全量的数据,所以主节点的数量决定了系统能存储的数据量,在系统容量不足时,就需要扩容主节点数量。在系统的处理能力上,如果是写能力不足,只能通过扩容主节点数来解决;而在写能力不足时,则可以通过增加备节点来提升。每个主节点拥有的备节点数量可以不一样,这在各个节点的数据热度不一样时特别有用,可以通过给比较热的节点增加更多的备节点实现用更少的资源来提升系统的处理能力。

分布式服务架构方案

高并发分布式服务架构方案 下图是一个非常全面的架构蓝图,针对不同的应用系统需要的模块各有不同。此架构方案主要包括以下几个方面的设计:数据存储和读取,基础服务,应用层(APP/业务/Proxy),日志监控等,下面对这些主要的问题提供具体的各项针对性技术方案。 数据的存储和读取 分布式系统应该根据应用对数据不同的一致性、可用性等要求和数据的不同特性,采用不同的数据存储和读取方案,主要有以下几种可选方案: 1)内存型数据库。内存型的数据库,以高并发高性能为目标,在事务性方面没那么严格, 适合进行海量数据的存储和读取。例如开源nosql数据库mongodb、redis等。 2)关系型数据库。关系型数据库在满足并发性能的同时,也需要满足事务性,可通过 读写分离,分库分表来应对高并发大数据量的情况。例如Oracle,Mysql等。 3)分布式数据库。对于数据的高并发的访问,传统的关系型数据库提供读写分离的方案, 但是带来的确实数据的一致性问题提供的数据切分的方案;对于越来越多的海量数据,传统的数据库采用的是分库分表,实现起来比较复杂,后期要不断的进行迁移维护;对

于高可用和伸缩方面,传统数据采用的是主备、主从、多主的方案,但是本身扩展性比较差,增加节点和宕机需要进行数据的迁移。对于以上提出的这些问题,分布式数据库HBase有一套完善的解决方案,适用于高并发海量数据存取的要求。 基础服务 基础服务主要是指数据层之上的数据路由,Cache,搜索等服务。 1)路由Router。对于数据库切分方案中的分库分表问题,需要解决在请求对应的数据时 定位需要访问的位置,可根据一致性Hash,维护路由表至内存数据库等方案解决。 2)Cache。对于高并发的系统来讲,使用Cache可以减轻对后端系统的压力,所有Cache 可承担大部分热数据的读操作。当前用的比较多的是redis和memcache,redis比memcache有丰富的数据操作的API,redis对数据进行了持久化,而memcache没有这个功能,因此memcache更加适合在关系型数据库之上的数据的缓存。 3)搜索。搜索可以支持应用系统的按照关键词的检索,搜索提示,搜索排序等功能。开源 开源的企业级搜索引擎主要有lucene, sphinx,选择搜索引擎主要考虑以下三个方面: a)搜索引擎是否支持分布式的索引和搜索,来应对海量的数据,支持读写分离,提高 可用性 b)索引的实时性 c)搜索引擎的性能 Solr是基于Lucene开发的高性能的全文搜索服务器,满足以上三个方面的考虑,而且目前在企业中应用非常广泛。 应用层 应用层主要包括面向用户的应用,网站、APP等,还包括相关的业务处理的运算等。 1)负载均衡-反向代理。一个大型的平台包括很多个业务域,不同的业务域有不同的集群, 可以用DNS做域名解析的分发或轮询,DNS方式实现简单。但是因存在cache而缺乏灵活性;一般基于商用的硬件F5、NetScaler或者开源的软负载lvs在做分发,当然会采用做冗余(比如lvs+keepalived)的考虑,采取主备方式。Nginx是基于事件驱动的、异步非阻塞的架构、支持多进程的高并发的负载均衡器/反向代理软件,可用作反向代理的工具。

分布式文件系统研究-GFS

分布式文件系统研究16:Global File System 分类:技术日志 前段时间比较忙,好久没发技术文章了,几天来一个,嘿嘿 Global File System 简介 GFS(Global File System)是Minnesota大学开发的基于SAN的共享存储的机群文件系统,后来Sis tina公司将GFS产品化。GFS在很长一段时间都是以源代码开放软件的形式出现的,后来由于Sistina希望通过向用户提供支持和服务的计划未能取得成功,为了要促进自己的财务收入,Sistina在2001年将GFS 变成了一种“专有软件”。Red Hat公司收购Sistina之后,在遵循GPL协议(General Public License)的条件下履行诺言公开了GFS的源代码。现在,GFS的全名被称为“红帽全球文件系统”(Red Hat Global File System ,GFS)的软件,每台服务器每年收取2200美元的费用。 可能是redhat为了更好的收取服务费的缘故,有关GFS的文档真是少之又少,我只能从网上一些零星的资料来看看GFS的概貌。 框架 GFS最初是在IRIX上开发的,后来移植到LINUX上,并开放源码。基本框架如下图所示。 图1 GFS的基本框架图 通过使用GFS,多台服务器可以共用一个文件系统来存储文件。信息既可以存储在服务器上,也可以存储在一个存储局域网络上。 GFS与GPFS结构相似,但它是全对称的机群文件系统,没有服务器,因而没有性能瓶颈和单一故障点。GFS将文件数据缓存于节点的存储设备中,而不是缓存在节点的内存中。并通过设备锁来同步不同节点对文件的访问,保持UNIX文件共享语义。GFS实现了日志,节点失效可以快速恢复。GFS使用SCSI

分布式文件系统MFS(moosefs)实现存储共享

由于用户数量的不断攀升,我对访问量大的应用实现了可扩展、高可靠的集群部署(即lvs+keepalived的方式),但仍然有用户反馈访问慢的问题。通过排查个服务器的情况,发现问题的根源在于共享存储服务器NFS。在我这个网络环境里,N个服务器通过nfs方式共享一个服务器的存储空间,使得 NFS服务器不堪重负。察看系统日志,全是nfs服务超时之类的报错。一般情况下,当nfs客户端数目较小的时候,NFS性能不会出现问题;一旦NFS服务器数目过多,并且是那种读写都比较频繁的操作,所得到的结果就不是我们所期待的。 下面是某个集群使用nfs共享的示意图: 这种架构除了性能问题而外,还存在单点故障,一旦这个NFS服务器发生故障,所有靠共享提供数据的应用就不再可用,尽管用rsync方式同步数据到另外一个服务器上做nfs服务的备份,但这对提高整个系统的性能毫无帮助。基于这样一种需求,我们需要对nfs服务器进行优化或采取别的解决方案,然而优化并不能对应对日益增多的客户端的性能要求,因此唯一的选择只能是采取别的解决方案了;通过调研,分布式文件系统是一个比较合适的选择。采用分布式文件系统后,服务器之间的数据访问不再是一对多的关系(1个NFS服务器,多个NFS 客户端),而是多对多的关系,这样一来,性能大幅提升毫无问题。 到目前为止,有数十种以上的分布式文件系统解决方案可供选择,如 lustre,hadoop,Pnfs等等。我尝试了 PVFS,hadoop,moosefs这三种应用,参看了lustre、KFS等诸多技术实施方法,最后我选择了moosefs(以下简称MFS)

这种分布式文件系统来作为我的共享存储服务器。为什么要选它呢?我来说说我的一些看法: 1、实施起来简单。MFS的安装、部署、配置相对于其他几种工具来说,要简单和容易得多。看看lustre 700多页的pdf文档,让人头昏吧。 2、不停服务扩容。MFS框架做好后,随时增加服务器扩充容量;扩充和减少容量皆不会影响现有的服务。注:hadoop也实现了这个功能。 3、恢复服务容易。除了MFS本身具备高可用特性外,手动恢复服务也是非常快捷的,原因参照第1条。 4、我在实验过程中得到作者的帮助,这让我很是感激。 MFS文件系统的组成 1、元数据服务器。在整个体系中负责管理管理文件系统,目前MFS只支持一个元数据服务器master,这是一个单点故障,需要一个性能稳定的服务器来充当。希望今后MFS能支持多个master服务器,进一步提高系统的可靠性。 2、数据存储服务器chunkserver。真正存储用户数据的服务器。存储文件时,首先把文件分成块,然后这些块在数据服务器chunkserver之间复制(复制份数可以手工指定,建议设置副本数为3)。数据服务器可以是多个,并且数量越多,可使用的“磁盘空间”越大,可靠性也越高。 3、客户端。使用MFS文件系统来存储和访问的主机称为MFS的客户端,成功挂接MFS文件系统以后,就可以像以前使用NFS一样共享这个虚拟性的存储了。 元数据服务器安装和配置

分布式文件系统架构设计

分布式文件系统架构设计

目录 1.前言 (3) 2.HDFS1 (3) 3.HDFS2 (5) 4.HDFS3 (11) 5.结语 (15)

1.前言 Hadoop是一个由Apache基金会所开发的分布式系统基础架构。用户可以在不了解分布式底层细节的情况下,开发分布式程序。充分利用集群的威力进行高速运算和存储。 Hadoop实现了一个分布式文件系统(Hadoop Distributed File System),简称HDFS,解决了海量数据存储的问题;实现了一个分布式计算引擎MapReduce,解决了海量数据如何计算的问题;实现了一个分布式资源调度框架YARN,解决了资源调度,任务管理的问题。而我们今天重点给大家介绍的是Hadoop里享誉世界的优秀的分布式文件系统-HDFS。 Hadoop重要的比较大的版本有:Hadoop1,Hadoop2,hadoop3。同时也相对应的有HDFS1,HDFS2,HDFS3三个大版本。后面的HDFS的版本,都是对前一个版本的架构进行了调整优化,而在这个调整优化的过程当中都是解决上一个版本的架构缺陷,然而这些低版本的架构缺陷也是我们在平时工作当中会经常遇到的问题,所以这篇文章一个重要的目的就是通过给大家介绍HDFS不同版本的架构演进,通过学习高版本是如何解决低版本的架构问题从而来提升我们的系统架构能力。 2.HDFS1

最早出来投入商业使用的的Hadoop的版本,我们称为Hadoop1,里面的HDFS就是HDFS1,当时刚出来HDFS1,大家都很兴奋,因为它解决了一个海量数据如何存储的问题。HDFS1用的是主从式架构,主节点只有一个叫:Namenode,从节点有多个叫:DataNode。 我们往HDFS上上传一个大文件,HDFS会自动把文件划分成为大小固定的数据块(HDFS1的时候,默认块的大小是64M,可以配置),然后这些数据块会分散到存储的不同的服务器上面,为了保证数据安全,HDFS1里默认每个数据块都有3个副本。Namenode是HDFS的主节点,里面维护了文件系统的目录树,存储了文件系统的元数据信息,用户上传文件,下载文件等操作都必须跟NameNode进行交互,因为它存储了元数据信息,Namenode为了能快速响应用户的操作,启动的时候就把元数据信息加载到了内存里面。DataNode是HDFS的从节点,干的活就很简单,就是存储block文件块。

分布式控制系统课程设计

分布式控制课程设计 设计题目:课题八:3台电动机的顺序控制 学校:上海工程技术大学 院系:机械工程学院

二任务描述: 在现代工业生产中,电动机自动与手动正反转的设置得到了广泛的应用。设计三台电动机的顺序控制程序的原则是: (1)自动每隔离十分钟启动一台电机,中间可急停,到了八小时后都自动关闭。 (2)手动顺序启动,手动反序停止。 设计四段程序,第一段是自动顺序启动三台电机,由SB1总起T0,T1延时触发。第二段程序是到点自动停止,每个电机配备一个定时器加计数器来实现。第三段程序是手动顺序启动由SB2总起,T5,T6延时触发。第四段程序是手动反序停止由中间继电器M1.0,M1.1,M1.2线圈触发,而在第三段程序的起停保电路中用它们的常闭触点来实现。 控制任务和要求: (1)启动操作:按启动按钮SB1,电动机M1启动,10s后电动机M2自动启动,又经过8s,电动机M3自动启动。 (2)停车操作:按停止按钮SB2,电动机M3立即停车;5s后,电动机M2自动停车;又经过4s,电动机M1自动停车。 (3)要求启动时,每隔10min依次启动1台,每台运行8h后自动停车。在运行中可用停止按钮将3台电动机同时停机。 三电动机及其PLC控制器的介绍 1.系统设计功能 1)电路设计 本课题的三台电动机应满足以下要求 (1)自动时,当第二台电动机延时启动时,不关闭第一台电动机。当第三台电动机延时启动时,不关闭第一,第二台电动机。且三者自各自启动就开始计数器计时,准备 关闭。 (2)用急停按钮使三台电动机同时停移,但时间必须在自动停止时间范围内。 (3)手动时,当第二台中动机延时启动时,必须等三台电动机按顺序都启动后才可以按下手动反序停止按钮,使他们各自停止。 2)主电路设计 由三台电机组成,启动电路由自动开关QF0.,接触器KM0-KM3.热继电器FR1-FR3各台电

主流分布式系统架构分析

主流分布式系统架构分析 主流分布式---系统架构分析

目录 一、前言 (3) 二、SOA架构解析 (3) 三、微服务( Microservices )架构解析 (7) 四、SOA和微服务架构的差别 (9) 五、服务网格( Service Mesh )架构解析 (9) 六、分布式架构的基本理论 ......................................................................................... 1 1 七、分布式架构下的高可用设计 (15) 八、总结 .......................................................................................................... 1 9

、八、 、 》 本文我们来聊一聊目前主流的分布式架构和分布式架构中常见理论以及如何才能设计出高可用的分布式架构好了。分布式架构中,SOA和微服务架构是最常见两种分布式架构,而且目前服务网格的 概念也越来越火了。那我们本文就先从这些常见架构开始。 、SOA架构解析 SOA全称是:Service Oriented Architecture ,中文释义为"面向服务的架构",它是一种设计理念,其中包含多个服务,服务之间通过相互依赖最终提供一系列完整的功能。各个服务通常以独立 的形式部署运行,服务之间通过网络进行调用。架构图如下:

Appl 跟SOA 相提并论的还有一个 ESB (企业服务总线),简单来说ESB 就是一根管道,用来连接各个服 务节点。 ESB 的存在是为了集成基于不同协议的不同服务, ESB 做了消息的转化、解释以及路由的工 作,以此来让不 同的服务互联互通;随着我们业务的越来越复杂, 会发现服务越来越多,SOA 架构下, 它们的调用关系会变成如下形式: App 2 App 6 App 3 App 4

分布式文件系统研究

分布式文件系统研究 由于工作性质的关系,我觉得自己很有必要对当今主流的分布式文件系统(Distributed File System,DFS)做系统的研究,总结优缺点,为下一步的工作提供必要的参考。因此,我动手搜集了不少资料,并进行了很初步的学习,以后我会把自己对DFS的学习心得整理起来,陆续放到博客上来。这就当是开篇吧,嘿嘿 概述 文件系统是操作系统的一个重要组成部分,通过对操作系统所管理的存储空间的抽象,向用户提供统一的、对象化的访问接口,屏蔽对物理设备的直接操作和资源管理。 根据计算环境和所提供功能的不同,文件系统可划分为四个层次,从低到高依次是:单处理器单用户的本地文件系统,如DOS的文件系统;多处理器单用户的本地文件系统,如OS/2的文件系统;多处理器多用户的本地文件系统,如Unix的本地文件系统;多处理器多用户的分布式文件系统,如Lustre文件系统。 本地文件系统(Local File System)是指文件系统管理的物理存储资源直接连接在本地节点上,处理器通过系统总线可以直接访问。分布式文件系统(Distributed File System)是指文件系统管理的物理存储资源不一定直接连接在本地节点上,而是通过计算机网络与节点相连。 由于互联网应用的不断发展,本地文件系统由于单个节点本身的局限性,已经很难满足海量数据存取的需要了,因而不得不借助分布式文件系统,把系统负载转移到多个节点上。 传统的分布式文件系统(如NFS)中,所有数据和元数据存放在一起,通过单一的存储服务器提供。这种模式一般称之为带内模式(In-band Mode)。随着客户端数目的增加,服务器就成了整个系统的瓶颈。因为系统所有的数据传输和元数据处理都要通过服务