信息论与编码课程设计报告

2024版信息论与编码教案

应用:算术编码在图像、视频和音频压 缩等领域具有广泛应用,如JPEG 2000、 H.264等标准中采用了算术编码技术。 与霍夫曼编码相比,算术编码具有更高 的压缩比和更好的性能表现。

06

多媒体信息压缩编码

多媒体信息压缩编码的基本概念与原理

压缩编码的必要性

多媒体数据量大,存储和传输成本高,需通过压缩编码降低数据 量。

典型编码方法

03

详细介绍几种典型的编码方法,如香农编码、哈夫曼编码、算

术编码等。

教学目标与要求

掌握信息论与编码的基本理论

通过学习,使学生能够深入理解信息论与编 码的基本概念和原理。

培养编码实践能力

通过案例分析、实验等环节,提高学生的编 码实践能力。

培养创新能力

鼓励学生探索新的编码方法,培养创新思维 和解决问题的能力。

编码分类

包括无损编码和有损编码,前者 可以完全恢复原始信息,后者则 会损失部分信息以换取更高的压 缩比。

霍夫曼编码的原理与应用

• 原理:霍夫曼编码是一种可变长度编码方法,根据信源符 号出现的概率来构造最优编码。它利用概率大的符号用较 短的码字表示,概率小的符号用较长的码字表示,从而实 现平均码长最短。

信息论的基本概念

信息

信息是事物运动状态或存在方式的不确定性的描述。

信息系统

由信源、信道、信宿等组成的传输和处理信息的系统。

信息论

研究信息的传输、处理、存储和检索等过程中的基本 理论和方法。

信息的度量与性质

信息的度量

用概率和统计的方法对信息进行量化,如香农 信息熵、互信息等。

信息的性质

包括普遍性、客观性、可传递性、可共享性、 可压缩性等。

压缩编码的可能性

《信息论与编码技术》实验教案

卷积码编码与译码方法探讨

卷积码原理

理解卷积码的基本原理和编码过程,包括卷积码 的生成函数和约束长度等概念。

编码实现

通过编程实现卷积码的编码过程,掌握卷积码编 码算法的实现方法。

译码方法

探讨卷积码的译码方法,包括维特比译码算法等 ,并通过仿真实验进行验证。

差错控制编码技术应用实践

应用场景

了解差错控制编码技术在通信、存储等领域的 应用场景和需求。

差错控制编码方法

介绍常用的差错控制编码方法,如奇偶校验码、循 环冗余校验码(CRC)等,并分析其性能特点。

阐述差错控制的基本概念、原理及其在数字 通信系统中的重要性。

差错控制策略设计与实现

通过实验,设计并实现一种基于特定编码方 法的差错控制策略,评估其在数字通信系统 中的性能。

图像压缩编码算法研究及实现

实验内容

设计并实现一个离散信道信息传输系统,通过输入不同的信源符号序列和信道 参数,观察并分析系统性能。

离散信道中的信息传输实验

实验步骤

1

2

1. 确定信源符号集及其概率分布;

3

2. 设计合适的信道编码方案;

离散信道中的信息传输实验

01

3. 在离散信道中实现编码后的信号传输;

02

4. 在接收端进行解码并计算误码率;

详细阐述Turbo码的编码算法、译码算法的具体实现步骤,包括交 织器设计、分量编码器选择、迭代译码算法等。

性能评估方法

介绍Turbo码性能评估的主要指标,如误码率、误帧率等,以及相 应的仿真实验方法和结果分析。

LDPC码编译码算法研究

LDPC码基本原理

介绍LDPC码的定义、分类、编码原理、译码原理等基本概念。

信息与编码论课程设计

信息与编码论课程设计一、课程目标知识目标:1. 学生能理解信息与编码的基本概念,掌握不同编码方式的特点及应用场景。

2. 学生能掌握二进制、十进制等数制转换方法,并运用这些方法进行编码和解码。

3. 学生了解信息安全的基本原理,认识到保护信息的重要性。

技能目标:1. 学生具备运用二进制进行简单计算和信息编码的能力。

2. 学生能够运用所学知识,分析并解决实际问题,例如:设计一个简单的加密和解密程序。

3. 学生能够通过合作与交流,共同探讨信息与编码的应用,提高团队协作能力。

情感态度价值观目标:1. 学生培养对信息科学的兴趣,激发探究精神,树立创新意识。

2. 学生认识到信息与编码在科技发展和社会生活中的重要作用,增强社会责任感。

3. 学生在合作交流中,学会尊重他人,培养良好的沟通能力和团队协作精神。

课程性质:本课程为理论与实践相结合的课程,旨在帮助学生掌握信息与编码的基本知识,提高实际操作能力。

学生特点:六年级学生具有一定的逻辑思维能力和自主学习能力,对新鲜事物充满好奇,喜欢探索和挑战。

教学要求:注重启发式教学,引导学生主动参与,培养实践操作能力;关注学生个体差异,因材施教,提高教学质量。

通过分解课程目标为具体学习成果,使学生在课程学习中获得全面、均衡的发展。

二、教学内容1. 信息与编码基本概念:介绍信息的定义、特性及编码的必要性;讲解不同编码方式(如:文字编码、图像编码、声音编码等)及其应用场景。

教材章节:第一章 信息与编码基本概念2. 数制转换:重点讲解二进制与十进制的转换方法,拓展至其他进制转换;通过实例分析,使学生掌握数制转换在实际应用中的运用。

教材章节:第二章 数制转换及其应用3. 编码与解码:以二进制编码为例,讲解编码和解码的基本原理;引导学生运用所学知识进行简单的编码与解码实践。

教材章节:第三章 编码与解码技术4. 信息安全:介绍信息安全的基本原理,如加密、解密、数字签名等;通过案例分析,使学生了解信息安全在现实生活中的重要性。

信息论与编码实验报告

中南大学信息论编码实验报告题目信息论编码学生姓名汤思远指导教师张祖平学院信息院学号 090912052专业班级电子1班完成时间 14/12/5实验一 关于信源熵的实验一、实验目的1. 掌握离散信源熵的原理和计算方法。

2. 熟悉matlab 软件的基本操作,练习使用matlab 求解信源的信息熵。

3. 自学图像熵的相关概念,并应用所学知识,使用matlab 或其他开发工具求解图像熵。

4. 掌握Excel 的绘图功能,使用Excel 绘制散点图、直方图。

二、实验原理1. 离散信源相关的基本概念、原理和计算公式产生离散信息的信源称为离散信源。

离散信源只能产生有限种符号。

随机事件的自信息量I (x i )为其对应的随机变量x i 出现概率对数的负值。

即:I (x i )= -log 2 p (x i )随机事件X 的平均不确定度(信源熵)H (X )为离散随机变量x i 出现概率的数学期望,即:∑∑-==i ii i i i x p x p x I x p X H )(log )()()()(2. 信源的信息熵设信源符号集X ={a1,a2,…,ar},每个符号发生的概率分别为p (a1)=p 1,p (a2)=p 2,…,p (ar),即信源的概率空间为,⎥⎦⎤⎢⎣⎡=⎥⎦⎤⎢⎣⎡)(...... )2(2 )1(1ar p ar a p a a p a P X 则该信源的信源熵为:H (X ) = - p (a1) log p (a1) –p (a2) log p (a2) –…–p (ar) log p (ar)3. 信道的数学模型与相关熵的计算• 单符号离散无噪声无损信道的信道容量 ()max (;)bit/i p x C I X Y =信道符号4. MATLAB 二维绘图用matlab 中的命令plot(x , y )就可以自动绘制出二维图来。

例1-2,在matlab 上绘制余弦曲线图,y = cos x ,其中0 ≤ x ≤ 2π。

信息论与编码课程设计(哈夫曼编码的分析与实现)..

吉林建筑大学电气与电子信息工程学院信息理论与编码课程设计报告设计题目:哈夫曼编码的分析与实现专业班级:电子信息工程101学生姓名:学号:指导教师:吕卅王超设计时间:2013.11.18-2013.11.29一、设计的作用、目的《信息论与编码》是一门理论与实践密切结合的课程,课程设计是其实践性教学环节之一,同时也是对课堂所学理论知识的巩固和补充。

其主要目的是加深对理论知识的理解,掌握查阅有关资料的技能,提高实践技能,培养独立分析问题、解决问题及实际应用的能力。

通过完成具体编码算法的程序设计和调试工作,提高编程能力,深刻理解信源编码、信道编译码的基本思想和目的,掌握编码的基本原理与编码过程,增强逻辑思维能力,培养和提高自学能力以及综合运用所学理论知识去分析解决实际问题的能力,逐步熟悉开展科学实践的程序和方法二、设计任务及要求通过课程设计各环节的实践,应使学生达到如下要求:1. 理解无失真信源编码的理论基础,掌握无失真信源编码的基本方法;2. 掌握哈夫曼编码/费诺编码方法的基本步骤及优缺点;3. 深刻理解信道编码的基本思想与目的,理解线性分组码的基本原理与编码过程;4. 能够使用MATLAB 或其他语言进行编程,编写的函数要有通用性。

三、设计内容一个有8个符号的信源X ,各个符号出现的概率为:编码方法:先将信源符号按其出现的概率大小依次排列,并取概率最小的字母分别配以0和1两个码元(先0后1或者先1后0,以后赋值固定),再将这两个概率相加作为一个新字母的概率,与未分配的二进制符号的字母重新排队。

并不断重复这一过程,直到最后两个符号配以0和1为止。

最后从最后一级开始,向前返回得到各个信源符号所对应的码元序列,即为对应的码字。

哈夫曼编码方式得到的码并非唯一的。

在对信源缩减时,两个概率最小的符号合并后的概率与其他信源符号的概率相同时,这两者在缩减中的排序将会导致不同码字,但不同的排序将会影响码字的长度,一般讲合并的概率放在上面,12345678,,,,,()0.40.180.10.10.070.060.050.04X x x x x x x x x P X ⎡⎤⎧⎫=⎨⎬⎢⎥⎣⎦⎩⎭这样可获得较小的码方差。

信息论与编码课程设计.docx

信息论与编码课程设计报告设计题目:统计信源熵与香农编码专业班级:学号:学生姓名:指导老师:教师评分:2015年3月24日目录一、设计任务与要求 (3)二、设计思路 (3)三、设计流程图 (4)四、程序运行及结果 (5)五、心得体会 (6)参考文献 (7)附录:源程序 (7)一、设计任务与要求1、统计信源熵要求:统计任意文本文件中各字符(不区分大小写)数量 ,计算字符概率 ,并计算信源熵。

2、香农编码要求:任意输入消息概率 ,利用香农编码方法进行编码 ,并计算信源熵和编码效率。

二、设计思路1、统计信源熵在VC++环境中进行编程:(1)打开一篇文章 ,将26个英文字母作为信源。

(2)计算每个字母出现的次数(不区分大小写) ,再通过计算信源总大小来计算在本篇文章中每个字母出现的频率。

(3)通过信源熵计算公式来计算信源熵。

2、香农编码设计思路香农编码主要是通过一系列步骤支出平均码长与信源之间的关系 ,同时是平均码长达到极限值 ,即选择的每个码字的长度k 满足下式: I (x )≤k <I(x)+1 具体步骤如下:a 、将信源消息符号按其出现的概率大小依次排列为:p1≥p2≥…≥pnb 、确定满足下列不等式的整数码长k 为:-lb(pi) ≤k ≤-lb(pi)+1c 、为了编成唯一可译码 ,计算第i 个消息的累加概率:pi =∑p (ak )i−1k=1d 、将累加概率Pi 变换成二进制。

e 、取Pi 二进制数的小数点后Ki 位即为该消息符号的二进制码字。

在香农编码中对于求解编码效率主要是依靠这个公式:R=H(X)/K,其中k =∑p (ai )ki n i=1对于求解信源熵主要依靠公式:H (X )=−∑p (xi )logp(xi)ni=1三、设计流程图1、统计信源熵:↓↓↓↓2、香农编码:↓↓↓↓↓↓↓四、程序运行及结果1、统计信源熵:2、香农编码:五、心得体会通过本次课程设计的练习,进一步巩固了信源熵、信源编码的基本原理,基本上掌握了编码方法,对编程软件的使用得到了很大的熟悉,有效增强了自主设计、编程调试的开发能力,同时也大大提高了本身的实践创新能力。

信息论与编码-课程设计报告

目录一:实验原理----------------------------1二:程序源代码--------------------------1三:实验分析-----------------------------6四:实验结论---------------------------7赫夫曼编码一:实验原理哈夫曼编码的具体步骤归纳如下:① 概率统计(如对一幅图像,或m幅同种类型图像作灰度信号统计),得到n个不同概率的信息符号。

② 将n个信源信息符号的n个概率,按概率大小排序。

③ 将n个概率中,最后两个小概率相加,这时概率个数减为n-1个。

④ 将n-1个概率,按大小重新排序。

⑤ 重复③,将新排序后的最后两个小概率再相加,相加和与其余概率再排序。

⑥ 如此反复重复n-2次,得到只剩两个概率序列。

⑦ 以二进制码元(0.1)赋值,构成哈夫曼码字。

编码结束。

哈夫曼码字长度和信息符号出现概率大小次序正好相反,即大概信息符号分配码字长度短,小概率信息符号分配码字长度长。

C、哈夫曼编码的特点(1)哈夫曼编码的构造顺序明确,但码不是唯一的(因以大赋1还是小的赋1而异;(2)哈夫曼编码的字长参差不齐,硬件实现不方便;(3)只有在概率分布很不均匀时,哈夫曼编码才有显著的效果,而在信源分布均匀时,一般不使用哈夫曼编码。

二:程序源代码:#define MAXVALUE 10000#define MAXLEAF 30#define MAXNODE 59#define MAXBIT 10#define LENTH 30#include "stdio.h"#include<iostream>typedef struct{float gailv;int flag;int parent;int lchild;int rchild;char ch;int t;}HNodeType;typedef struct{int bit[MAXBIT];int start;}HCodeType;typedef struct{float gailv;char letter;}mytype; /*it's the type of data save in file*/typedef struct filehuff{int count;mytype mydata[MAXLEAF];filehuff(){count=0; };};filehuff filedata;char code[MAXVALUE];HNodeType HuffNode[MAXNODE];void savetofile(){FILE *fp;if((fp=fopen("datafile.txt","wb"))==NULL){printf("打开失败 ....");return;}if(fwrite(&filedata,sizeof(filedata),1,fp)!=1) printf("写入文件失败 ....");fclose(fp);}void openfile(){ FILE *fp;if((fp=fopen("datafile.txt","rb"))==NULL){return;}fread(&filedata,sizeof(filedata),1,fp);}void translate(){char c;int i,j,k=0,m,n=0;printf("请输入你想要译码的二进制序列 ");printf("\n");getchar();scanf("%c",&c);for(i=0;(i<MAXVALUE)&&(c=='1'||c=='0');i++){ code[i]=c;scanf("%c",&c);}printf("对应的信源符号为:");for(j=0;j<=MAXVALUE&&HuffNode[j].parent!=-1;j++) m=j+1;for(j=0,k=m;j<=i;j++){if(code[j]=='0'){n=HuffNode[k].lchild;if(n==-1){printf("%c",HuffNode[k].ch);k=m;j--;continue;}k=n;}else{n=HuffNode[k].rchild;if(n==-1){printf("%c",HuffNode[k].ch);k=m;j--;continue;}k=n;}}}void Huffman(){HCodeType HuffCode[MAXLEAF],cd;int i,j,m1,m2,x1,x2,c,p,m;if(filedata.count==0){ printf("\n输入信源符号总数 : ");scanf("%d",&m);filedata.count=m;for(i=0;i<2*m-1;i++){ HuffNode[i].gailv=0;HuffNode[i].parent=-1;HuffNode[i].flag=0;HuffNode[i].lchild=-1;HuffNode[i].rchild=-1;HuffNode[i].ch='a';}for(i=0;i<m;i++){ printf("请输入 (概率,信源符号):");scanf("%f %c",&HuffNode[i].gailv,&HuffNode[i].ch); filedata.mydata[i].gailv=HuffNode[i].gailv; filedata.mydata[i].letter=HuffNode[i].ch;savetofile();}}else{ m=filedata.count;for(i=0;i<2*m-1;i++){ HuffNode[i].gailv=0;HuffNode[i].parent=-1;HuffNode[i].flag=0;HuffNode[i].lchild=-1;HuffNode[i].rchild=-1;HuffNode[i].ch=3;}for(i=0;i<m;i++){ HuffNode[i].gailv=filedata.mydata[i].gailv;HuffNode[i].ch=filedata.mydata[i].letter;}}for(i=0;i<m-1;i++){ m1=m2=MAXVALUE;x1=x2=0;for(j=0;j<m+i;j++){ if(HuffNode[j].gailv<m1&&HuffNode[j].flag==0){ m2=m1;x2=x1;m1=HuffNode[j].gailv;x1=j;}else if(HuffNode[j].gailv<m2&&HuffNode[j].flag==0){ m2=HuffNode[j].gailv;x2=j;}}HuffNode[x1].parent=m+i;HuffNode[x2].parent=m+i;HuffNode[x1].flag=1;HuffNode[x2].flag=1;HuffNode[m+i].gailv=HuffNode[x1].gailv+HuffNode[x2].gailv;HuffNode[m+i].lchild=x1;HuffNode[m+i].rchild=x2;}for(i=0;i<m;i++){ cd.start=m-1;c=i;p=HuffNode[c].parent;while(p!=-1){ if(HuffNode[p].lchild==c)cd.bit[cd.start]=0;else cd.bit[cd.start]=1;cd.start--;c=p;p=HuffNode[c].parent;}for(j=cd.start+1;j<m;j++)HuffCode[i].bit[j]=cd.bit[j]; HuffCode[i].start=cd.start;}printf("对应的赫夫曼编码如下:");printf("\n信源符号概率编码\n");for(i=0;i<m;i++){printf("%c %f ",HuffNode[i].ch,HuffNode[i].gailv); for(j=HuffCode[i].start+1;j<m;j++)printf("%d",HuffCode[i].bit[j]);printf("\n");}printf("按任意键继续......\n");}main(){char yn;printf("\n");printf("\n");printf(" 信息论与编码实验 \n");openfile();Huffman();for(;;){printf("\n是否想要把序列译码为信源符号 ?: (输入 y or n) "); scanf("%c",&yn);if(yn=='y'||yn=='Y')translate();elsebreak;}return 0;system("pause");}三:实验分析编码实例如下:由图中可以看出,符合基本的赫夫曼编码的原理,概率大的用短码,概率小的用长码。

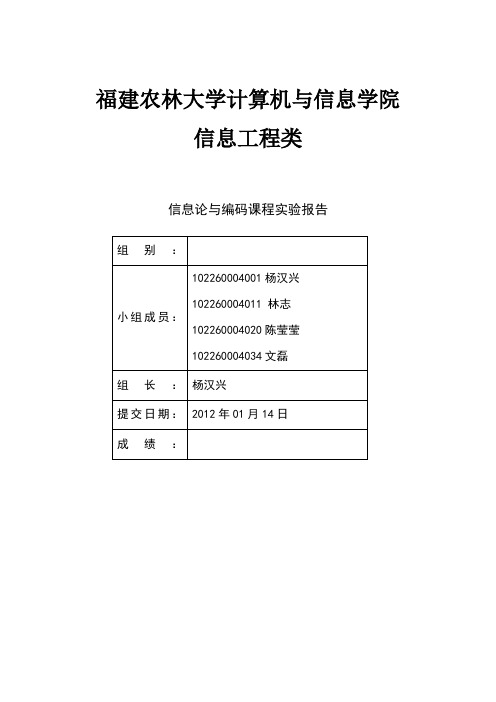

信息论与编码课程实验报告

福建农林大学计算机与信息学院信息工程类信息论与编码课程实验报告实验项目列表实验名称1:信源建模一、实验目的和要求(1)进一步熟悉信源建模;(2)掌握MATLAB程序设计和调试过程中数值的进制转换、数值与字符串之间的转换等技术。

二、实验内容(1)假设在一个通信过程中主要传递的对象以数字文本的方式呈现。

(2)我们用统计的方式,发现这八个消息分别是由N1,N2,…,N8个符号组成的。

在这些消息是中出现了以下符号(符号1,符号2,…,符号M)每个符号总共现了(次数1,次数2,…,次数M)我们认为,传递对象的信源模型可表示为:X为随机变量(即每次一个字符);取值空间为:(符号1,符号2,…,符号M);其概率分布列为:(次数1/(N1+…+N8),…,次数M/( N1+…+N8))三、实验环境硬件:计算机软件:MATLAB四、实验原理图像和语声是最常用的两类主要信源。

要充分描述一幅活动的立体彩色图像,须用一个四元的随机矢量场X(x,y,z,t),其中x,y,z为空间坐标;t 为时间坐标;而X是六维矢量,即表示左、右眼的亮度、色度和饱和度。

然而通常的黑白电视信号是对平面图像经过线性扫描而形成。

这样,上述四元随机矢量场可简化为一个随机过程X(t)。

图像信源的最主要客观统计特性是信源的幅度概率分布、自相关函数或功率谱。

关于图像信源的幅度概率分布,虽然人们已经作了大量的统计和分析,但尚未得出比较一致的结论。

至于图像的自相关函数,实验证明它大体上遵从负指数型分布。

其指数的衰减速度完全取决于图像类型与图像的细节结构。

实际上,由于信源的信号处理往往是在频域上进行,这时可以通过傅里叶变换将信源的自相关函数转换为功率谱密度。

功率谱密度也可以直接测试。

语声信号一般也可以用一个随机过程X(t)来表示。

语声信源的统计特性主要有语声的幅度概率分布、自相关函数、语声平均功率谱以及语声共振峰频率分布等。

实验结果表明语声的幅度概率分布可用伽玛(γ)分布或拉普拉斯分布来近似。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

目录一:实验原理----------------------------1二:程序源代码--------------------------1三:实验分析-----------------------------6四:实验结论---------------------------7赫夫曼编码一:实验原理哈夫曼编码的具体步骤归纳如下:① 概率统计(如对一幅图像,或m幅同种类型图像作灰度信号统计),得到n个不同概率的信息符号。

② 将n个信源信息符号的n个概率,按概率大小排序。

③ 将n个概率中,最后两个小概率相加,这时概率个数减为n-1个。

④ 将n-1个概率,按大小重新排序。

⑤ 重复③,将新排序后的最后两个小概率再相加,相加和与其余概率再排序。

⑥ 如此反复重复n-2次,得到只剩两个概率序列。

⑦ 以二进制码元赋值,构成哈夫曼码字。

编码结束。

哈夫曼码字长度和信息符号出现概率大小次序正好相反,即大概信息符号分配码字长度短,小概率信息符号分配码字长度长。

C、哈夫曼编码的特点(1)哈夫曼编码的构造顺序明确,但码不是唯一的(因以大赋1还是小的赋1而异;(2)哈夫曼编码的字长参差不齐,硬件实现不方便;(3)只有在概率分布很不均匀时,哈夫曼编码才有显著的效果,而在信源分布均匀时,一般不使用哈夫曼编码。

二:程序源代码:#define MAXVALUE 10000#define MAXLEAF 30#define MAXNODE 59#define MAXBIT 10#define LENTH 30#include ""#include<iostream>typedef struct{float gailv;int flag;int parent;int lchild;int rchild;char ch;int t;}HNodeType;typedef struct{int bit[MAXBIT];int start;}HCodeType;typedef struct{float gailv;char letter;}mytype; /*it's the type of data save in file*/typedef struct filehuff{int count;mytype mydata[MAXLEAF];filehuff(){count=0; };};filehuff filedata;char code[MAXVALUE];HNodeType HuffNode[MAXNODE];void savetofile(){FILE *fp;if((fp=fopen("","wb"))==NULL){printf("打开失败 ....");return;}if(fwrite(&filedata,sizeof(filedata),1,fp)!=1) printf("写入文件失败 ....");fclose(fp);}void openfile(){ FILE *fp;if((fp=fopen("","rb"))==NULL){return;}fread(&filedata,sizeof(filedata),1,fp);}void translate(){char c;int i,j,k=0,m,n=0;printf("请输入你想要译码的二进制序列 ");printf("\n");getchar();scanf("%c",&c);for(i=0;(i<MAXVALUE)&&(c=='1'||c=='0');i++){ code[i]=c;scanf("%c",&c);}printf("对应的信源符号为:");for(j=0;j<=MAXVALUE&&HuffNode[j].parent!=-1;j++) m=j+1;for(j=0,k=m;j<=i;j++){if(code[j]=='0'){n=HuffNode[k].lchild;if(n==-1){printf("%c",HuffNode[k].ch);k=m;j--;continue;}k=n;}else{n=HuffNode[k].rchild;if(n==-1){printf("%c",HuffNode[k].ch);k=m;j--;continue;}k=n;}}}void Huffman(){HCodeType HuffCode[MAXLEAF],cd;int i,j,m1,m2,x1,x2,c,p,m;if==0){ printf("\n输入信源符号总数 : ");scanf("%d",&m);=m;for(i=0;i<2*m-1;i++){ HuffNode[i].gailv=0;HuffNode[i].parent=-1;HuffNode[i].flag=0;HuffNode[i].lchild=-1;HuffNode[i].rchild=-1;HuffNode[i].ch='a';}for(i=0;i<m;i++){ printf("请输入 (概率,信源符号):");scanf("%f %c",&HuffNode[i].gailv,&HuffNode[i].ch);[i].gailv=HuffNode[i].gailv;[i].letter=HuffNode[i].ch;savetofile();}}else{ m=;for(i=0;i<2*m-1;i++){ HuffNode[i].gailv=0;HuffNode[i].parent=-1;HuffNode[i].flag=0;HuffNode[i].lchild=-1;HuffNode[i].rchild=-1;HuffNode[i].ch=3;}for(i=0;i<m;i++){ HuffNode[i].gailv=[i].gailv;HuffNode[i].ch=[i].letter;}}for(i=0;i<m-1;i++){ m1=m2=MAXVALUE;x1=x2=0;for(j=0;j<m+i;j++){ if(HuffNode[j].gailv<m1&&HuffNode[j].flag==0){ m2=m1;x2=x1;m1=HuffNode[j].gailv;x1=j;}else if(HuffNode[j].gailv<m2&&HuffNode[j].flag==0){ m2=HuffNode[j].gailv;x2=j;}}HuffNode[x1].parent=m+i;HuffNode[x2].parent=m+i;HuffNode[x1].flag=1;HuffNode[x2].flag=1;HuffNode[m+i].gailv=HuffNode[x1].gailv+HuffNode[x2].gailv;HuffNode[m+i].lchild=x1;HuffNode[m+i].rchild=x2;}for(i=0;i<m;i++){ =m-1;c=i;p=HuffNode[c].parent;while(p!=-1){ if(HuffNode[p].lchild==c)[]=0;else []=1;;c=p;p=HuffNode[c].parent;}for(j=+1;j<m;j++)HuffCode[i].bit[j]=[j];HuffCode[i].start=;}printf("对应的赫夫曼编码如下:");printf("\n信源符号概率编码\n");for(i=0;i<m;i++){printf("%c %f ",HuffNode[i].ch,HuffNode[i].gailv); for(j=HuffCode[i].start+1;j<m;j++)printf("%d",HuffCode[i].bit[j]);printf("\n");}printf("按任意键继续......\n");}main(){char yn;printf("\n");printf("\n");printf(" 信息论与编码实验 \n");openfile();Huffman();for(;;){printf("\n是否想要把序列译码为信源符号 : (输入 y or n) ");scanf("%c",&yn);if(yn=='y'||yn=='Y')translate();elsebreak;}return 0;system("pause");}三:实验分析编码实例如下:由图中可以看出,符合基本的赫夫曼编码的原理,概率大的用短码,概率小的用长码。

选择译码:结果如下:四:实验结论哈夫曼的具体实现,在数据结构的相关课程曾做相应的实验,所以无论在理解上或是实现上,都不是很困难,程序上实现哈夫曼的编码与译码,由于哈夫曼自身的特点,编码与译码均不是唯一,但是相同的编译码规则还是能实现正确的译码的。

本实验,除了实现编译码的具体实现,还实现数据的存储与读取,这给实验实现方便,不必每次从命令提示符输入数据。

总的来说,通过本次实验,对哈夫曼的编译码有了一个更好的认识。

通过本次试验,对书上的理论知识有了进一步的认识,但是由于对编程软件的知识欠缺,导致有很多地方还是搞不懂,只能向同学学习,讨论。

当然最终还是有一定的欠缺。

对于哈夫曼编码的认识,是在以前的数据结构课程中就接触到的,但是当时只是知道哈夫曼树的编码而已。

仅限于表面上的只是,并未曾想过用程序来实现它。

所以对于此次试验并未有太大的帮助。

通过实验,学到了很多东西,相信对以后的学习会更有帮助的。