数值最优化方法

5-非线性方程组的数值解法及最优化方法

非线性方程组的数值解法

不动点迭代法:根据非线性方程求根的迭代法,将方程组改 写为如下等价方程组

xi i x1, x2,, xn , i 1,2,, n

构造迭代公式

xik 1 i x1k , x2k ,, xnk , i 1,2,, n

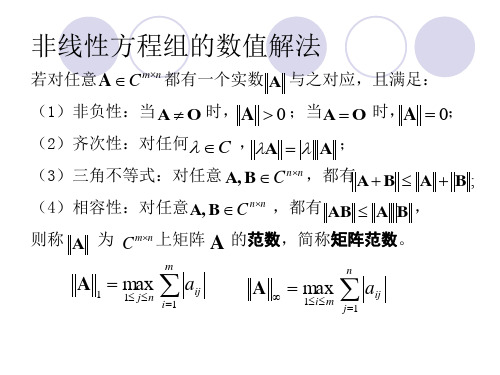

非线性方程组的数值解法

若对任意A Cmn 都有一个实数 A 与之对应,且满足:

(1)非负性:当 A O 时, A 0 ;当A O 时,A 0;

(2)齐次性:对任何 C ,A A ;

(3)三角不等式:对任意 A, B C nn ,都有A B A B ;

(4)相容性:对任意A, B C nn ,都有 AB A B ,

…

…

18

(0.2325670051,0.0564515197)

19

(0.2325670051,0.0564515197)

max

1 i 2

xik

xik

1

0.2250 0.0546679688 0.0138638640 0.0032704648 0.0008430541 0.0001985303 0.0000519694 0.0000122370 0.0000032485 0.0000007649

10-9

非线性方程组的数值解法

练习题:用牛顿迭代法求解方程组

取 X 0 1.6,1.2T

xx1122

x22 x22

4 1

结果:1.5811,1.2247

非线性方程组的数值解法

应用经过海底一次反射到达水听器阵的特征声线传播时间, 来反演海底参数。假设水中和沉积层声速都是恒定的,海底 沉积层上界面水平,下界面倾斜。特征声线由水中声源出发 折射进入沉积层,经过沉积层的下界面反射后,再折射进入 水中,由水中水听器阵接收。特征声线的传播时间为声线在 水中和沉积层中的传播时间之和。 三维坐标关系如图所示:

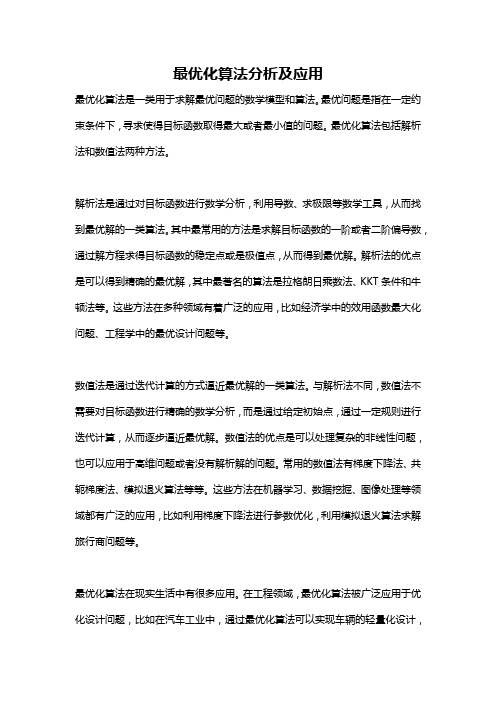

最优化算法分析及应用

最优化算法分析及应用最优化算法是一类用于求解最优问题的数学模型和算法。

最优问题是指在一定约束条件下,寻求使得目标函数取得最大或者最小值的问题。

最优化算法包括解析法和数值法两种方法。

解析法是通过对目标函数进行数学分析,利用导数、求极限等数学工具,从而找到最优解的一类算法。

其中最常用的方法是求解目标函数的一阶或者二阶偏导数,通过解方程求得目标函数的稳定点或是极值点,从而得到最优解。

解析法的优点是可以得到精确的最优解,其中最著名的算法是拉格朗日乘数法、KKT条件和牛顿法等。

这些方法在多种领域有着广泛的应用,比如经济学中的效用函数最大化问题、工程学中的最优设计问题等。

数值法是通过迭代计算的方式逼近最优解的一类算法。

与解析法不同,数值法不需要对目标函数进行精确的数学分析,而是通过给定初始点,通过一定规则进行迭代计算,从而逐步逼近最优解。

数值法的优点是可以处理复杂的非线性问题,也可以应用于高维问题或者没有解析解的问题。

常用的数值法有梯度下降法、共轭梯度法、模拟退火算法等等。

这些方法在机器学习、数据挖掘、图像处理等领域都有广泛的应用,比如利用梯度下降法进行参数优化,利用模拟退火算法求解旅行商问题等。

最优化算法在现实生活中有很多应用。

在工程领域,最优化算法被广泛应用于优化设计问题,比如在汽车工业中,通过最优化算法可以实现车辆的轻量化设计,从而降低燃料消耗和排放。

在物流领域,最优化算法可以帮助货物合理分配,提高物流效率,降低物流成本。

在电力系统中,最优化算法可以用于电力调度问题,从而实时调整发电机组的出力,保证电网的供需平衡。

在经济学中,最优化算法可以用来解决资源配置和决策问题,比如最大化收益、最小化成本等。

此外,最优化算法还可以应用于交通流量优化、医疗资源优化、网络传输优化等各个领域。

通过合理选择和应用最优化算法,可以提高效率,降低成本,优化资源配置,从而实现经济可持续发展和社会效益最大化。

总而言之,最优化算法是一类用于求解最优问题的数学模型和算法。

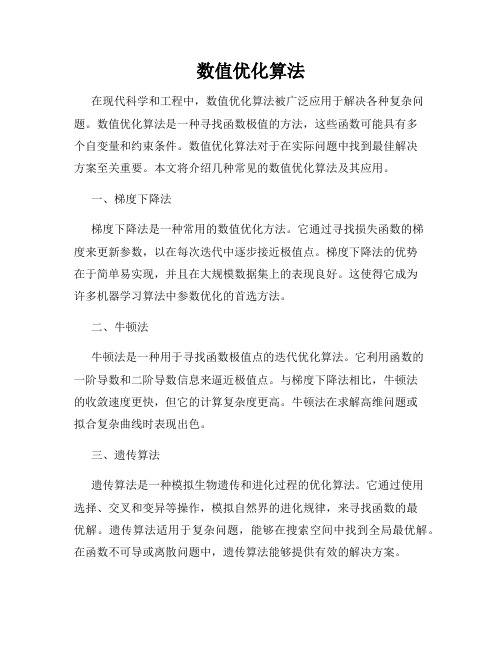

数值优化算法

数值优化算法在现代科学和工程中,数值优化算法被广泛应用于解决各种复杂问题。

数值优化算法是一种寻找函数极值的方法,这些函数可能具有多个自变量和约束条件。

数值优化算法对于在实际问题中找到最佳解决方案至关重要。

本文将介绍几种常见的数值优化算法及其应用。

一、梯度下降法梯度下降法是一种常用的数值优化方法。

它通过寻找损失函数的梯度来更新参数,以在每次迭代中逐步接近极值点。

梯度下降法的优势在于简单易实现,并且在大规模数据集上的表现良好。

这使得它成为许多机器学习算法中参数优化的首选方法。

二、牛顿法牛顿法是一种用于寻找函数极值点的迭代优化算法。

它利用函数的一阶导数和二阶导数信息来逼近极值点。

与梯度下降法相比,牛顿法的收敛速度更快,但它的计算复杂度更高。

牛顿法在求解高维问题或拟合复杂曲线时表现出色。

三、遗传算法遗传算法是一种模拟生物遗传和进化过程的优化算法。

它通过使用选择、交叉和变异等操作,模拟自然界的进化规律,来寻找函数的最优解。

遗传算法适用于复杂问题,能够在搜索空间中找到全局最优解。

在函数不可导或离散问题中,遗传算法能够提供有效的解决方案。

四、模拟退火算法模拟退火算法是一种启发式搜索算法,模拟了金属退火过程中原子随温度变化的行为。

模拟退火算法以一定的概率接受更差的解,并以较低的概率逐渐收敛到全局最优解。

模拟退火算法对局部极小点有一定的免疫能力,并且在大规模离散优化问题中表现出优越性。

五、粒子群算法粒子群算法是一种基于群体行为的优化算法。

它模拟了鸟群觅食的行为,通过迭代寻找问题的最优解。

粒子群算法通过评估适应度函数来引导粒子的移动,从而逐渐靠近最优解。

这种算法适用于多目标优化问题和高维函数优化。

结论数值优化算法在科学和工程领域扮演着至关重要的角色。

梯度下降法、牛顿法、遗传算法、模拟退火算法和粒子群算法是几种常见的数值优化方法。

它们各自具有不同的优势和适用范围,可以根据问题的特点选择合适的优化算法。

通过应用这些优化算法,可以帮助科学家和工程师在实际问题中找到最佳解决方案,推动技术的进步和创新。

数值最优化方法范文

数值最优化方法范文数值最优化是一种重要的数学方法,用于寻找函数最小值或最大值的数值解。

在实际问题中,很多情况下无法通过解析的方式求得最优解,此时数值最优化方法的应用就显得尤为重要。

本文将从优化问题的定义、数值最优化方法的分类及原理、优化算法的选择、数值最优化应用实例等方面进行详细介绍。

首先,我们来定义什么是优化问题。

优化问题可以理解为在一定约束条件下,求解函数的最小值或最大值。

数值最优化的目标是通过计算机算法求得这个最优解。

常见的优化问题包括线性规划、非线性规划、整数规划等。

接下来,我们来介绍一些常见的数值最优化方法。

数值最优化方法可以分为两类:无约束优化和有约束优化。

无约束优化是指没有约束条件,可以直接对函数进行优化;有约束优化是指在优化过程中需要满足一定的约束条件。

在无约束优化中,最简单的方法是算法,如穷举法和枚举法。

这些方法的缺点是计算量大,效率低。

更高效的无约束优化方法包括梯度下降法、牛顿法和拟牛顿法等。

梯度下降法是一种基于函数梯度的迭代算法,可以找到函数的局部最小值。

牛顿法和拟牛顿法则基于函数的二阶导数信息进行迭代计算,可以更快地逼近最优解。

这些方法的选择通常需要考虑函数是否可微、计算速度、收敛性等因素。

在有约束优化中,常用的方法包括线性规划法和非线性规划法。

线性规划法是一种求解线性约束下的最优解的方法,基于线性规划问题的性质可以通过简单的迭代计算求解。

非线性规划法则是一种求解非线性约束下的最优解的方法,如KKT条件、罚函数法等。

这些方法的选择通常需要考虑约束条件的性质、计算复杂度等因素。

在选择数值最优化算法时,应根据实际问题的特点进行选择。

一般而言,梯度法是一种通用的最优化算法,适用于大部分优化问题。

对于非光滑问题,拟牛顿法是一种较好的选择。

而牛顿法则适用于具有二阶导数信息的优化问题。

此外,随机优化方法如遗传算法、粒子群算法等也是值得考虑的选择。

最后,我们来看一下数值最优化方法在实际问题中的应用实例。

迭代法和牛顿迭代法的优缺点及应用

迭代法和牛顿迭代法的优缺点及应用在数值计算和算法设计中,迭代法和牛顿迭代法是两种常见的数值优化方法。

它们可以很好地用于解决非线性方程组、最优化问题以及数学模型的求解等问题。

在实际应用中,它们的优缺点各有不同,可根据问题的特点选择适合的方法。

本文将对迭代法和牛顿迭代法的优缺点及应用进行分析。

一、迭代法1、迭代法的原理迭代法是一种通过不断逼近目标值的方法。

其思想是将一个原问题转化为一个递归求解的过程。

假设我们要求解一个方程f(x) = 0,可以利用如下公式进行迭代:$x_{n+1} = g(x_n)$其中,$g(x_n)$是一个递推公式,用来表示如何从$x_n$ 得到$x_{n+1}$。

通过不断迭代,可以逐渐逼近解。

当迭代次数足够多时,可以得到符合精度的解。

2、迭代法的优点(1)实现简单:迭代法的计算过程非常简单,只需要考虑递推公式即可。

(2)收敛速度较快:迭代法的收敛速度要比其他方法要快,尤其是在某些非线性问题中,迭代法表现出了其优异的收敛性。

(3)适用范围广:迭代法可以用于解决各种类型的数学问题,包括求解非线性方程组、求解最优化问题以及求解微积分方程等。

3、迭代法的缺点(1)收敛不稳定:由于迭代法只是通过不断逼近目标值的过程,收敛的速度和稳定性都受到了影响,可能存在发散的情况。

(2)初值选择的影响:迭代法在求解问题时,对于初值的选择需要非常慎重,因为不同的初值会得到不同的收敛结果。

(3)依赖递推公式:迭代法需要依赖于递推公式,当递推公式难以求解或者导数难以计算时,迭代法的效果可能会受到影响。

二、牛顿迭代法1、牛顿迭代法的原理牛顿迭代法是一种利用函数的一阶导数和二阶导数来逼近根的方法。

对于一个非线性方程f(x)=0,设其在$x_0$处的导数不为0,则可以用如下公式进行迭代:$x_{n+1} = x_n −\frac {f(x_n)}{f′(x_n)}$其中$f'(x_n)$是$f(x_n)$的一阶导数。

Chapter2 非线性最小二乘法与数值最优化

第1章 非线性最小二乘法与数值最优化变量之间的关系更多地表现为非线性特征。

线性模型作为基础模型是非线性的近似,即任何非线性模型都可以通过线性模型来近似表达。

比如,模型01x y e u ββ=++通过泰勒级数展开表述为0000100101**01|()x x x x x y e x x ue x e x u x uβββββββ=≈+-+ =-++ =++模型201y x u ββ=++的线性近似表达式为0010201010**01(2)|()22x x y x x x ux x x ux uβββββββ=≈+-+ =-++ =++例 1.1 利用Monte Carlo 模拟的方法观察线性模型对非线性模型的近似。

设DGP 为:y=10+0.2*exp(x)+u ,x 为[1,3]区间的均匀分布。

利用线性模型与指数模型分别回归模型,并计算x 对y 的(平均)边际影响与(平均)弹性。

(数据文件:nonlin )但线性模型对非线性模型的近似程度取决于高阶部分是否充分小。

即使在样本内线性模型能够较好地拟合数据,也不能准确地体现变量的结构关系。

非线性模型中,x 对y 的边际影响(或弹性)是变化的;而线性模型中,x 对y 的边际影响(或弹性)是常数。

很多情况下,线性模型与非线性模型对边际影响或弹性的估计存在非常大的差异。

另外,利用线性模型拟合非线性数据存在潜在的危险,即区间外预测会存在越来越大的误差。

因此,正确设定模型的形式是进行准确推断和预测的重要环节。

对于一般的回归模型,如以下形式的模型,(,)f =+y X βu 1.1OLS 一般不能得到其解析解。

比如,运用OLS 方法估计模型(1.1),令S(β)表示残差平方和,即 2211()[(;)]n nii i i i S u y f ====-∑∑βX β 1.2 最小化S(β),即根据一阶条件可以得到1(;)()2[(;)]n i i i i f S y f =∂∂=--=∂∂∑X ββX β0ββ 以模型y x u γαβ=++为例,其一阶条件为20110()1[]02i nx i i S y e ββββ=∂=---=∂∑β220111()1[]02i i nx x i i S y e e βββββ=∂=---=∂∑β 2201212()1[]02i i nx x i i i S y e x e ββββββ=∂=---=∂∑β 上述方程组没有解析解,需要一般的最优化方法。

5-非线性方程组的数值解法及最优化方法

1 4 0

非线性方程组的数值解法

x10=0; x20=0; k=0; while 1 k=k+1; x1k=(1+x20-0.1*exp(x10))/4; x2k=(x10-x10^2/8)/4; %雅克比迭代法 %x2k=(x1k-x1k^2/8)/4; %高斯-赛德尔迭代法 err1=abs(x1k-x10); err2=abs(x2k-x20); err=max(err1,err2); if err<=0.00000000005 break; end x10=x1k; x20=x2k; end

0.0000055305 0.0000001511 0.0000000041 0.0000000001

非线性方程组的数值解法

牛顿迭代法:根据求解非线性方程的牛顿迭代法,如果已经 k k T ,则 ,, xn 给出方程组 Fx 0 的一个近似根 xk x1k , x2 可把函数 Fx 的分量 fi x, i 1,2,, n 在 x k 处按多元函数泰 勒公式展开,取其线性部分做近似,得

(0.2325668498,0.0564514831) (0.2325670008,0.0564515487) (0.2325670050,0.0564515196) (0.2325670051,0.0564515197) (0.2325670051,0.0564515197)

0.0002023950

所以有

1 x φx 1 2 x1

0

T

取初值 x 代公式收敛。

T 0 x 0 , 0 附近 φx 1,所以迭 0,0 ,在

1 1 x 1 e 40 x2 2 1 1 x1 x2 4 16

数值最优化方法

数值最优化方法数值最优化是指让数学模型的解达到最理想值或最优值的算法。

它主要用于在给定某种限制条件下求出最佳解,在现代数学和工程应用中被广泛使用,从而使解决问题者能够获得理想的解。

数值最优化方法可分为三类:随机搜索方法、梯度搜索方法及类模式搜索方法。

一、随机搜索方法随机搜索方法是一类基于随机过程的搜索算法,它的基本思路是用随机的方式搜索一定数量的可能的解,从而找出满足最佳化要求的最优解。

随机搜索方法不需要借助任何假定,它们可以用来解决各种类型的最优化问题,可以在没有充分知识的情况下构造模型。

随机搜索方法主要有模拟退火算法、JS散乱算法、粒子群算法(PSO)、贝叶斯优化算法、遗传算法、定时算法等。

模拟退火算法是一类基于热力学的随机搜索方法,它的基本思想是模拟热力学中的凝固过程,模拟加热和冷却的过程,最终可以将系统放入最终的冷却态,即最优化解。

该算法的基础原理非常简单,可以应用于各种复杂的问题,但是收敛较慢,耗时较长,算法的收敛强度难以控制。

JS散乱算法是一类以满足斯坦福大学计算机科学系终身教授John H. Conway及其相近的两个博士生Richard K. Guy和Brennen McHenry于1965年提出的算法。

该算法是一类基于局部搜索策略的随机搜索算法,算法的核心思想是组合局部搜索算法和比较算法,即在最优解附近搜索一个满足最优解的解,让其达到最优解,它的优点是时间复杂度低且可以收敛到局部最小点,但是劣势是实际收敛非常缓慢,而且难以控制局部最优解。

粒子群算法是一类基于社会行为学的随机搜索算法,该算法由Kennedy和Eberhart于1995年提出,其基本思想是模拟鸟群觅食行为,即让粒子的搜索行为类似于一群鸟群搜索食物的行为,从而找到最优解。

粒子群算法的优点是可以找到最优解,计算量较少,并且可以用来解决非凸问题,但缺点是可能在某局部范围内收敛,而且难以控制全局搜索空间大小。

贝叶斯优化算法是一类基于贝叶斯学派优化研究的算法,该算法旨在利用 Bayes式通过将优化目标模型转化为条件概率分布,并采用适当的抽样策略搜索最优解。