径向基函数神经网络.docx

数学建摸讲座之径向基函数神经网络最全PPT资料

RBF与BP神经网络的比较

从网络结构上比较: 传递函数不同;神经元层数可能不同;RBF网络隐层神经 元个数可以确定,BP网络不易确定。

从训练算法上比较: 需要确定的参数不同;训练算法不同。

RBF神经网络的优缺点分析

优点: 1.它具有唯一最佳逼近的特性,且无局部极小问题存 在。 2.RBF神经网络具有较强的输入和输出映射功能,并 且理论证明在前向网络中RBF网络是完成映射功能的 最优网络。 3.分类能力好。 4.学习过程收敛速度快。

RBF神经网络工作原理

• RBF解决异或问题

R1(X)

x1

X1

∑y

1 0

X2

R2(X)

输出

0

输入

径向基神经元

1

R1( x) e x1 2

1

1 1

x1

x2

1

0

0

1

R2 ( x) e x2 2

2

0 0

0

0

1

1

x 1 2 ( x1 1)2 ( x2 1)2 1

R1( x) e x1 2 e1 0.3679

分类: 解决非线性可分问题。RBF网络用隐层单元先将非线性可 分的输入空间设法变换到线性可分的特征空间(通常是高 维空间),然后用输出层来进行线性划分,完成分类功能。

RBF神经网络工作原理

• RBF解决异或问题

x2

R(x2)

1

1

0

1 x1

空间变换前

0.1353

0 0.3679

1 R(x1)

空间变换后

不再统一由训练算法确定

y w exp( || x c || ), j 1, 2,3,..., n A=tansig(n)

径向基神经网络RBF介绍

径向基神经网络RBF介绍径向基神经网络(Radial Basis Function Neural Network,以下简称RBF神经网络)是一种人工神经网络模型。

它以径向基函数为激活函数,具有快速学习速度和较高的逼近能力,被广泛应用于函数逼近、模式识别、时间序列预测等领域。

下面将详细介绍RBF神经网络的基本原理、结构和学习算法。

1.基本原理:RBF神经网络由输入层、隐藏层和输出层组成。

输入层接收外部输入数据,隐藏层由一组径向基函数组成,输出层计算输出值。

其基本原理是通过适当的权值与径向基函数的线性组合,将输入空间映射到高维特征空间,并在该空间中进行线性回归或分类。

RBF神经网络的关键在于选择合适的径向基函数和隐藏层节点的中心点。

2.网络结构:隐藏层是RBF神经网络的核心,它由一组径向基函数组成。

每个径向基函数具有一个中心点和一个半径。

典型的径向基函数有高斯函数和多项式函数。

高斯函数的形式为:φ(x) = exp(-β*,x-c,^2)其中,β为控制函数衰减速度的参数,c为径向基函数的中心点,x为输入向量。

隐藏层的输出由输入向量与每个径向基函数的权值进行加权求和后经过激活函数得到。

输出层通常采用线性激活函数,用于输出预测值。

3.学习算法:RBF神经网络的学习算法包括两个步骤:网络初始化和权值训练。

网络初始化时需要确定隐藏层节点的中心点和半径。

常用的方法有K-means 聚类和最大极大算法。

权值训练阶段的目标是通过输入样本和对应的目标值来调整权值,使得网络的输出尽可能接近目标值。

常用的方法有最小均方误差算法(Least Mean Square,LMS)和最小二乘法。

最小均方误差算法通过梯度下降法修改权值,使网络输出的均方误差最小化。

最小二乘法则通过求解线性方程组得到最优权值。

在训练过程中,需要进行误差反向传播,根据输出误差调整权值。

4.特点与应用:RBF神经网络具有以下特点:-输入输出非线性映射能力强,可以逼近复杂的非线性函数关系;-学习速度较快,只需通过非线性映射学习输出函数,避免了反向传播算法的迭代计算;-具有较好的泛化能力,对噪声和异常数据有一定的鲁棒性。

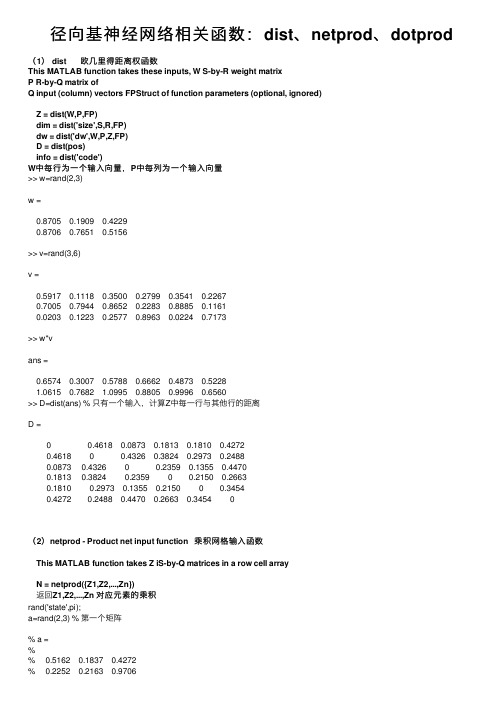

径向基神经网络相关函数:dist、netprod、dotprod

径向基神经⽹络相关函数:dist、netprod、dotprod (1) dist 欧⼏⾥得距离权函数This MATLAB function takes these inputs, W S-by-R weight matrixP R-by-Q matrix ofQ input (column) vectors FPStruct of function parameters (optional, ignored)Z = dist(W,P,FP)dim = dist('size',S,R,FP)dw = dist('dw',W,P,Z,FP)D = dist(pos)info = dist('code')W中每⾏为⼀个输⼊向量,P中每列为⼀个输⼊向量>> w=rand(2,3)w =0.8705 0.1909 0.42290.8706 0.7651 0.5156>> v=rand(3,6)v =0.5917 0.1118 0.3500 0.2799 0.3541 0.22670.7005 0.7944 0.8652 0.2283 0.8885 0.11610.0203 0.1223 0.2577 0.8963 0.0224 0.7173>> w*vans =0.6574 0.3007 0.5788 0.6662 0.4873 0.52281.0615 0.7682 1.0995 0.8805 0.9996 0.6560>> D=dist(ans) % 只有⼀个输⼊,计算Z中每⼀⾏与其他⾏的距离D =0 0.4618 0.0873 0.1813 0.1810 0.42720.4618 0 0.4326 0.3824 0.2973 0.24880.0873 0.4326 0 0.2359 0.1355 0.44700.1813 0.3824 0.2359 0 0.2150 0.26630.1810 0.2973 0.1355 0.2150 0 0.34540.4272 0.2488 0.4470 0.2663 0.3454 0(2)netprod - Product net input function 乘积⽹格输⼊函数This MATLAB function takes Z iS-by-Q matrices in a row cell arrayN = netprod({Z1,Z2,...,Zn})返回Z1,Z2,...,Zn 对应元素的乘积rand('state',pi);a=rand(2,3) % 第⼀个矩阵% a =%% 0.5162 0.1837 0.4272% 0.2252 0.2163 0.9706b=rand(2,3) % 第⼆个矩阵% b =%% 0.8215 0.0295 0.2471% 0.3693 0.1919 0.5672c=rand(2,3) % 第三个矩阵% c =%% 0.4331 0.0485 0.5087% 0.6111 0.8077 0.3153d=netprod({a,b,c}) % 计算⽹络输⼊% d =%% 0.1837 0.0003 0.0537% 0.0508 0.0335 0.1736a.*b.*c % 矩阵直接点乘%% ans =%% 0.1837 0.0003 0.0537% 0.0508 0.0335 0.1736(3)dotprod>> help dotproddotprod - Dot product weight functionThis MATLAB function takes these inputs, W S-by-R weight matrix PR-by-Q matrix of Q input (column) vectors FPStruct of function parameters (optional, ignored) Z = dotprod(W,P,FP)dim = dotprod('size',S,R,FP)dw = dotprod('dw',W,P,Z,FP)info = dotprod('code')rand('state',pi);w=rand(3,2); % 3个向量p=rand(2,4); % 4个向量Z=dotprod(w,p) % 计算内积% Z =%% 0.5039 0.0567 0.2502 0.3557% 0.3428 0.0886 0.2979 0.3586% 0.5094 0.1916 0.5959 0.6726(4)netsum 求和⽹格输⼊函数>> help netsumnetsum - Sum net input functionThis MATLAB function takes Z1 to Zn and optional function parameters, ZiS-by-Q matrices in a row cell array FPRow cell array of function parameters (ignored)N = netsum({Z1,Z2,...,Zn},FP)info = netsum('code')返回对应位置元素相加rand('state',pi);a=rand(2,3)% a =% 0.5162 0.1837 0.4272 % 0.2252 0.2163 0.9706 b=rand(2,3)% b =% 0.8215 0.0295 0.2471 % 0.3693 0.1919 0.5672 c=[0; -1];d=concur(c,3)% d =% 0 0 0% -1 -1 -1n = netsum({a,b,d})% n =% 1.3377 0.2132 0.6743 % -0.4054 -0.5918 0.5378。

径向基函数网络解读47页文档

END

பைடு நூலகம்

径向基函数网络解读

11、战争满足了,或曾经满足过人的 好斗的 本能, 但它同 时还满 足了人 对掠夺 ,破坏 以及残 酷的纪 律和专 制力的 欲望。 ——查·埃利奥 特 12、不应把纪律仅仅看成教育的手段 。纪律 是教育 过程的 结果, 首先是 学生集 体表现 在一切 生活领 域—— 生产、 日常生 活、学 校、文 化等领 域中努 力的结 果。— —马卡 连柯(名 言网)

13、遵守纪律的风气的培养,只有领 导者本 身在这 方面以 身作则 才能收 到成效 。—— 马卡连 柯 14、劳动者的组织性、纪律性、坚毅 精神以 及同全 世界劳 动者的 团结一 致,是 取得最 后胜利 的保证 。—— 列宁 摘自名言网

15、机会是不守纪律的。——雨果

16、业余生活要有意义,不要越轨。——华盛顿 17、一个人即使已登上顶峰,也仍要自强不息。——罗素·贝克 18、最大的挑战和突破在于用人,而用人最大的突破在于信任人。——马云 19、自己活着,就是为了使别人过得更美好。——雷锋 20、要掌握书,莫被书掌握;要为生而读,莫为读而生。——布尔沃

径向基函数神经网络学习动态

4 wh r

3 h

o

i 1

N i 1

N

hi hi

e || x1 c h || 0

2

4 wh r

2 h

e

hi

ohi ( xi c h ) 0

T

2(eh 1 wh oh ) oh

河南科技大学

HUST

通过上面三个式子我们可以得到:

HUST

河南科技大学

HUST

河南科技大学

• 概念: • 最小网络结构:在能对给定目标函数或训 练样本实现给定精度学习的RBF网络中, 称具有最少隐节点的网络为最小网络。 • 隐节点重合:算法收敛时,如果两个隐节 点具有相同的中心和宽度,则称这两个隐 节点重合,如果隐节点还具有相同的输出 权值,则称这两个隐节点完全重合。 • 隐节点外移:算法收敛前,某隐节点对样 本输出矢量不等于0,而算法收敛时该隐节 点的数据中心位于样本输入区域以外,且 其宽度也已经不足以影响输入区域的样本, 导致输出等于0的现象称为隐节点外移

T

2 h

o o

T h

c h

T h

oh oh

rh

2 h

rh

2 ( eh 1 wh oh ) oh

(1)

河南科技大学

其中

o 2 r

2 h T h

c h

[ oh1 ( x1 c h ), oh 2 ( x 2 c h ), , ohN ( x N c h )]

人工神经网络

Artificial Neural Networks ANN

李晓强 Email:sxxqli@ 河南科技大学

HUST

河南科技大学

径向基函数网络共28页文档

6、最大的骄傲于最大的自卑都表示心灵的最软弱无力。——斯宾诺莎 7、自知之明是最难得的知识。——西班牙 8、勇气通往天堂,怯懦通往地狱。——塞内加 9、有时候读书是一种巧妙地避开思考的方法。——赫尔普斯 10、阅读一切好书如同和过去最杰出的人谈话。——笛卡儿

径向基函数络

11、获得的成功越大,就越令人高兴 。野心 是使人 勤奋的 原因, 节制使 人枯萎 。 12、不问收获,只问耕耘。如同种树 ,先有 根茎, 再有枝 叶,尔 后花实 ,好好 劳动, 不要想 太多, 那样只 会使人 胆孝懒 惰,因 为不实 践,甚 至不接 触社会 ,难道 你是野 人。(名 言网) 13、不怕,不悔(虽然只有四个字,但 常看常 新。 14、我在心里默默地为每一个人祝福 。我爱 自己, 我用清 洁与节 制来珍 惜我的 身体, 我用智 慧和知 识充实 我的头 脑。 15、这世上的一切都借希望而完成。 农夫不 会播下 一粒玉 米,如 果他不 曾希望 它长成 种籽; 单身汉 不会娶 妻,如 果他不 曾希望 有小孩 ;商人 或手艺 人不会 工作, 如果他 不曾希 望因此 而有收 益。-- 马钉路 德。

Thank you

径向基函数网络

• 正规化网络

• 其中基函数一般选用高斯函数:

• 那么:

正规化网络是一个通用逼近器,只要隐单元足够多,它就可以逼近任意M元 连续函数。且对任一未知的非线性函数,总存在一组权值使网络对该函数的 逼近效果最好。

• 广义网络

• 当基函数为高斯函数时:

RBF神经网络两种模型

• 正规化网络RN:通用逼近器 • 基本思想: • 通过加入一个含有解的先验知识的约束来控制映射函数的光滑性,若输入一

径向基函数网络

• RBF神经网络定义 • RBF神经网络工作原理 • RBF神经网络模型 • RBF神经网络学习算法 • 实例

径向基函数网络(RBF网络)

• 径向基函数是多维空间插值的传统技术,根据生物神经元具有局部响应这一 特点,将RBF引入到神经网络设计中,产生了RBF神经网络。

• RBF网络能够逼近任意的非线性函数,可以处理系统内的难以解析的规律性, 具有良好的泛化能力,并有很快的学习收敛速度,已成功应用于非线性函数 逼近、时间序列分析、数据分类、模式识别、信息处理、图像处理、系统建 模、控制和故障诊断等。

自组织选取中心算法步骤

• 1.基于K-均值聚类方法求取基函数中心

• 2.求解方差 • 3.计算隐含层和输出层之间的权值

实例

根据RBF神经网络的网络结构和工作 原理,可确定以下编程步骤及相关语言: 初始化,确定RBF网络模型的输入,输出 向量。 用newrb()函数设计一个满足一定精度的 RBF网络。

运行程序,可得到函数逼近曲线和函数逼近 外推误差曲线分别为:

23

24

25

谢谢大家 !

20

下面看一个例子: 用RBF网络逼近Hermit多项式

y(x) 1.1(1 x 2x2 ) exp( x2 ) 2

RBF(径向基)神经网络

RBF(径向基)神经⽹络 只要模型是⼀层⼀层的,并使⽤AD/BP算法,就能称作 BP神经⽹络。

RBF 神经⽹络是其中⼀个特例。

本⽂主要包括以下内容:什么是径向基函数RBF神经⽹络RBF神经⽹络的学习问题RBF神经⽹络与BP神经⽹络的区别RBF神经⽹络与SVM的区别为什么⾼斯核函数就是映射到⾼维区间前馈⽹络、递归⽹络和反馈⽹络完全内插法⼀、什么是径向基函数 1985年,Powell提出了多变量插值的径向基函数(RBF)⽅法。

径向基函数是⼀个取值仅仅依赖于离原点距离的实值函数,也就是Φ(x)=Φ(‖x‖),或者还可以是到任意⼀点c的距离,c点称为中⼼点,也就是Φ(x,c)=Φ(‖x-c‖)。

任意⼀个满⾜Φ(x)=Φ(‖x‖)特性的函数Φ都叫做径向基函数,标准的⼀般使⽤欧⽒距离(也叫做欧式径向基函数),尽管其他距离函数也是可以的。

最常⽤的径向基函数是⾼斯核函数 ,形式为 k(||x-xc||)=exp{- ||x-xc||^2/(2*σ)^2) } 其中x_c为核函数中⼼,σ为函数的宽度参数 , 控制了函数的径向作⽤范围。

⼆、RBF神经⽹络 RBF神将⽹络是⼀种三层神经⽹络,其包括输⼊层、隐层、输出层。

从输⼊空间到隐层空间的变换是⾮线性的,⽽从隐层空间到输出层空间变换是线性的。

流图如下: RBF⽹络的基本思想是:⽤RBF作为隐单元的“基”构成隐含层空间,这样就可以将输⼊⽮量直接映射到隐空间,⽽不需要通过权连接。

当RBF的中⼼点确定以后,这种映射关系也就确定了。

⽽隐含层空间到输出空间的映射是线性的,即⽹络的输出是隐单元输出的线性加权和,此处的权即为⽹络可调参数。

其中,隐含层的作⽤是把向量从低维度的p映射到⾼维度的h,这样低维度线性不可分的情况到⾼维度就可以变得线性可分了,主要就是核函数的思想。

这样,⽹络由输⼊到输出的映射是⾮线性的,⽽⽹络输出对可调参数⽽⾔却⼜是线性的。

⽹络的权就可由线性⽅程组直接解出,从⽽⼤⼤加快学习速度并避免局部极⼩问题。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

径向基函数神经网络模型与学习算法

1985年,Powell提出了多变量插值的径向基丙数(Radical Basis Function,

RBF)方法。1988 年,Moody 和 Darken 提出 了一种神经网 络结构,即RBF

神经网络,属于前向神经网络类型,它能够以任意 精度逼近任意连续函数,

特别适合于解决分类问题。

RBF

网络的结构与多层前向网络类似,它是一种三层前向网络。 输入

层由信号源结点组成;第二层为隐含层,隐单元数视所描述问题 的需要而定,

隐单元的变换函数RBFO是对中心点径向对称且衰减 的非负非线性函数;第

三层为输出层,它对输入模式的作用作出响应。 从输入空间到隐含层空间的

变换是非线性的,而从隐含层空间的输出 层空间变换是线性的。

RBF网络的基本思想是:用RBF

作为隐单元的“基”构成隐含 层空间,

这样就可以将输入矢量直接(即不需要通过权接)映射到隐 空间。当RBF的

屮心点确定以后,这种映射关系也就确定了。而隐 含层空间到输出空间的映

射是线性的,即网络的输出是隐单元输出的 线性加权和。此处的权即为网络

可调参数。由此可见,从总体上看, 网络市输入到输出的映射是非线性的,

而网络输出对叮调参数而言却 又是线性的。这样网络的权就可由线性方程直

接解岀,从而大大加快 学习速度并避免局部极小问题。

1.1RBF

神经网络模型

径向基神经网络的神经元结构如图1所示。径向基神经网络的激 活函数

采用径向基函数,通常定义为空间任一点到某一中心之间欧氏 距离的单调函

数。由图1所示的径向基神经元结构可以看出,径向基 神经网络的激活函数

是以输入向量和权值向量之间的距离||dist||作为 自变量的。径向基神经网络的

激活函数的一般表达式为

/?(||dist||)= e~yist^ (1)

图1径向基神经元模型

随着权值和输入向量之间距离的减少,网络输出是递增的,当输 入向量

和权值向量一致时,神经元输出1。在图1中的b为阈值, 用于调整神经元

的灵敏度。利用径向基神经元和线性神经元可以建立 广义回归神经网络,该

种神经网络适用于函数逼近方面的应用;径向 基神经元和竞争神经元可以组

建概率神经网络,此种神经网络适用于 解决分类问题。

由输入层、隐含层和输岀层构成的一般径向基神经网络结构如图 2所示。

在RBF网络中,输入层仅仅起到传输信号的作用,与前面所 讲述的神经网络

相比较,输入层和隐含层之间可以看做连接权值为1 的连接。输出层和隐含层

所完成的任务是不同的,因而它们的学习策 略也不相同。输岀层是对线性权

进行调整,采用的是线性优化策略。 因而学习速度较快。而隐含层是对激活

函数(格林函数或高斯函数, 一般取高斯)的参数进行调整,采用的是非线性

优化策略,因而学习 速度较慢。

1.2 RBF

网络的学习算法

RBF神经网络学习算法需要求解的参数有3

个:基函数的中心、 方差

以及隐含层到输出层的权值。根据径向基函数中心选取方法的不 同,

RBF

网络有多种学习方法,如随机选取中心法、自组织选取中心 法、有监督选

取中心法和正交最小二乘法等。下面将介绍口组织选取 屮心的RBF神经网

络学习法。此方法由两个阶段组成:一是自组织 学习阶段,此阶段为无导

师学习过程,求解隐含层基函数的中心与方 法;二是有导师学习阶段,此

阶段求解隐含层到输出层之间的权值。

径向基神经网络中常用的径向基函数是高斯函数,因此径向基神

经网络的激活函数可表示为

高斯函数的屮心。

° 咼斯函数的方斧

O

由图2的径向基神经网络的结构可得到网络的输出为

f

1

2

、

< 2

CT

2

c

i

/

h

为

e“exp

(2)

式中

||xp-5

欧式范数。

式中 © =6"'对,…,圮;) ---------- 第P个输入样本。

P = 12…,P ---------- P

表示样本总数。

网络隐含层结点的中心。

-隐含层到输出层的连接权值。

------ 隐含层的节点数。

儿 ------- 与输入样本对应的网络的第j个输出结点的实

际输出。

设d是样本的期望输出值,那么基函数的方差可表示为

2

J却厂y

用|

学习算法具体步骤如下:

1. 基于K■均值聚类方法求解基函数屮心c

1) 网络初始化:随机选取力个训练样本作为聚类中心G(心12…

屈

2)

将输入的训练样本集合按最近邻规则分组:按照州与中心为°,之

间的欧式距离将©分配到输入样本的各个聚类集合色"i,2,…,P)中。

3)

重新调整聚类中心:计算各个聚类集合%中训练样本的平均值,

即新的聚类中心如果新的聚类中心不再发牛•变化,则所得到的5

即为RBF神经网络最终的基函数中心,否则返回2),进入下一轮的

中心求解。

2.

求解方差6

该RBF神经网络的基函数为高斯函数,因此方差5可由下式求

解:

(4)

式中

C

max --------------所选取中心之间的最大距离o

3 •计算隐含层和输出层Z

间的权值

隐含层至输出层之间神经元的连接权值可以用最小二乘法直接

计算得到,计算公式如下:

h

①=exp 丁 ",

\

"max