卷积神经网络CNN

卷积神经网络中的空洞卷积技术介绍(十)

卷积神经网络中的空洞卷积技术介绍卷积神经网络(Convolutional Neural Network, CNN)是一种深度学习模型,已经在计算机视觉、自然语言处理和语音识别等领域取得了巨大的成功。

在CNN中,卷积操作是一种核心的操作,而空洞卷积(Dilated Convolution)则是卷积神经网络中的一种重要技术,它在提取特征和增加感受野等方面具有独特的优势。

本文将介绍空洞卷积技术的原理、应用和优势。

空洞卷积的原理在传统的卷积操作中,卷积核中的每个元素都会与输入特征图中的相应元素进行点乘操作,然后将所有结果相加得到输出特征图中的一个元素。

而在空洞卷积中,卷积核中的元素之间会插入若干个空洞,这样可以增加卷积核的接受野(receptive field),也就是每个输出像素点受到输入特征图影响的范围。

举个例子,如果一个3x3的卷积核的空洞率(dilation rate)为1,那么它的感受野和普通的3x3卷积核是一样的;但是如果空洞率为2,那么它的感受野就相当于一个7x7的卷积核。

这样,通过调整空洞率,可以在不增加参数的情况下增加感受野,从而更好地捕捉输入特征图之间的空间信息。

空洞卷积的应用空洞卷积最早是由Fisher Yu和Vladlen Koltun在ICLR 2016的论文中提出的。

在深度学习领域,空洞卷积的应用非常广泛,特别是在图像分割、语义分割和图像生成等任务中。

在语义分割任务中,空洞卷积可以帮助网络更好地理解图像中的语义信息,从而提高分割的准确性和鲁棒性。

另外,空洞卷积还可以用于增加网络的感受野,从而提高网络对于输入图像的理解能力。

在一些需要对输入图像进行全局理解的任务中,比如场景分类和目标检测等,空洞卷积可以帮助网络更好地理解整个图像,而不仅仅是局部特征。

空洞卷积的优势与普通的卷积操作相比,空洞卷积具有以下几个优势。

首先,空洞卷积可以在不增加参数的情况下增加感受野,从而更好地捕捉输入特征图之间的空间信息。

使用卷积神经网络进行音频识别的教程

音频识别是一种将声音信号转换为文字或其他形式的技术,常用于语音识别、音乐识别等领域。

卷积神经网络(CNN)是一种深度学习模型,被广泛应用于图像处理和视频分析领域。

近年来,越来越多的研究表明CNN也可以用于音频识别。

本文将介绍如何使用卷积神经网络进行音频识别,包括数据预处理、模型构建和训练等步骤。

准备数据首先,我们需要准备音频数据集。

可以从公开数据集中下载,也可以自己采集和整理数据。

在这里,我们以一个简单的语音识别任务为例,假设我们要识别数字0到9的发音。

我们可以采集一些说数字的人的录音,并将其整理成训练集和测试集。

训练集用于训练模型,测试集用于评估模型性能。

预处理数据在将音频数据输入到卷积神经网络之前,我们需要对数据进行预处理。

首先,我们需要将音频数据转换成数字信号。

这可以通过采样和量化来实现。

然后,我们可以对数字信号进行短时傅里叶变换(STFT),将其转换成频谱图。

频谱图可以将音频数据转换成图像数据,便于卷积神经网络进行处理。

另外,我们还可以对频谱图进行归一化处理,将其数值范围限制在0到1之间,以加速训练过程。

构建模型接下来,我们需要构建卷积神经网络模型。

在这里,我们可以借鉴图像识别领域的一些经典模型,比如LeNet、AlexNet、VGG等。

这些模型已经在图像识别领域取得了很好的效果,我们可以通过迁移学习的方法,将它们应用到音频识别任务中。

另外,我们还可以根据具体任务的需求,设计和调整网络结构,比如增加更多的卷积层、池化层和全连接层等。

训练模型在模型构建完成后,我们需要将训练集输入到模型中进行训练。

训练过程中,我们需要选择合适的损失函数和优化算法,以及合适的超参数,比如学习率、批大小等。

训练过程通常需要花费一定的时间,我们可以通过监控训练集和测试集上的准确率和损失值来评估模型的性能,以及调整模型的参数和结构。

评估模型在模型训练完成后,我们需要使用测试集来评估模型的性能。

可以通过计算混淆矩阵、准确率、召回率等指标来评估模型的精度和泛化能力。

卷积神经网络与传统神经网络的对比与选择

卷积神经网络与传统神经网络的对比与选择近年来,随着人工智能技术的迅猛发展,神经网络成为了研究和应用的热点之一。

在神经网络中,卷积神经网络(Convolutional Neural Network,简称CNN)和传统神经网络常常被用于图像处理、语音识别等领域。

本文将对这两种神经网络进行对比,并探讨在不同场景下的选择。

首先,我们来看看卷积神经网络和传统神经网络的基本结构和工作原理。

传统神经网络采用全连接的方式,即每个神经元与前一层的所有神经元相连。

这种结构在一些任务中表现出色,如手写数字识别等。

然而,对于图像等高维数据的处理,全连接的方式会导致参数量过大,计算复杂度高的问题。

而卷积神经网络则采用了卷积层和池化层的结构,能够有效地减少参数量和计算复杂度。

卷积层通过卷积操作提取图像的特征,池化层则对特征进行降维。

这种层次化的结构使得卷积神经网络在图像处理等任务中表现出色。

其次,我们来比较一下卷积神经网络和传统神经网络在不同任务中的性能。

对于图像分类任务,卷积神经网络通常能够取得更好的效果。

这是因为卷积神经网络能够自动学习图像的局部特征,并通过池化操作进行降维,从而提取出更具有判别性的特征。

而传统神经网络在处理高维数据时,由于参数量过大,容易出现过拟合的问题,导致性能下降。

然而,在一些序列数据的处理中,传统神经网络仍然具有一定的优势。

传统神经网络能够较好地处理时序信息,如语音识别等任务。

在实际应用中,我们需要根据具体的场景和任务来选择合适的神经网络。

如果是处理图像等高维数据,卷积神经网络是一个不错的选择。

卷积神经网络能够通过卷积和池化操作提取图像的特征,并通过全连接层进行分类。

而传统神经网络在处理高维数据时,由于参数量过大,计算复杂度高,往往不适合。

然而,对于一些序列数据的处理,传统神经网络的循环结构能够更好地捕捉时序信息,因此在这些任务中传统神经网络是更好的选择。

除了结构和任务的不同,卷积神经网络和传统神经网络在训练和优化上也有一些区别。

基于卷积神经网络的车辆识别研究

基于卷积神经网络的车辆识别研究车辆识别是计算机视觉领域的一个重要问题,它主要指在图像或视频中识别不同类型的车辆。

在实际应用中,车辆识别具有诸多应用场景,例如交通管理、公安监控、智能交通等。

虽然车辆识别问题已经取得了一定的研究成果,但是仍然存在许多挑战和难点。

近年来,基于卷积神经网络的车辆识别方法逐渐成为研究热点,本文将对基于卷积神经网络的车辆识别研究进行简要介绍。

一、卷积神经网络简介卷积神经网络(Convolutional Neural Network,简称CNN)是一种特殊的人工神经网络,主要用于图像和语音信号的处理。

不同于常规的神经网络,CNN具有卷积层和池化层两种特殊的层结构。

卷积层可以自动学习出图像中的特征,池化层则可以对特征进行降维和抽象。

因此,CNN可以高效地处理大量的数据,并从中提取有用的特征。

二、基于CNN的车辆识别研究现状目前,基于CNN的车辆识别研究已经取得了一定的成果。

主要研究内容包括车型分类、车辆检测和车辆跟踪。

以下将分别进行介绍。

1. 车型分类车型分类是指将图像中的车辆按照品牌、车型等信息进行分类。

在基于CNN 的车型分类研究中,一般采用经典的ImageNet数据集进行训练。

经过深度学习训练后的CNN模型可以对汽车图像进行识别和分类。

根据研究结果,基于CNN的车型分类算法在准确率和泛化能力方面均有很好的表现。

2. 车辆检测车辆检测是指对图像或视频中的车辆进行边界框的定位和识别。

在基于CNN 的车辆检测研究中,通常采用深度卷积神经网络(Deep Convolutional NeuralNetwork,简称DCNN),如Faster R-CNN、YOLO等进行训练和预测。

这些算法均采用了多阶段处理流程,在图像的特征提取、特征匹配和边框回归等方面都有很好的表现。

3. 车辆跟踪车辆跟踪是指在视频中对车辆进行聚焦和追踪。

在基于CNN的车辆跟踪研究中,通常采用Siamese网络和跟踪器融合的方法。

如何解决卷积神经网络中的欠拟合问题

如何解决卷积神经网络中的欠拟合问题卷积神经网络(Convolutional Neural Network,简称CNN)是一种广泛应用于图像识别、目标检测等领域的深度学习模型。

然而,在实际应用中,我们常常会遇到CNN的欠拟合问题,即模型无法充分地学习到数据的特征,导致预测性能不佳。

本文将探讨如何解决CNN中的欠拟合问题,并提出一些有效的方法。

首先,我们需要了解欠拟合的原因。

欠拟合通常是由于模型的复杂度不足所导致的。

CNN是一种强大的模型,但是如果模型的层数过少或参数量不足,就容易发生欠拟合。

因此,我们可以通过增加模型的复杂度来解决这个问题。

一种常见的方法是增加网络的深度。

通过增加卷积层和全连接层的数量,可以增加模型的复杂度,使其能够更好地拟合数据。

此外,我们还可以增加每个卷积层和全连接层的神经元数量,以增加模型的表示能力。

然而,需要注意的是,增加模型的复杂度也会增加训练的难度和计算的复杂度,因此需要在准确性和效率之间进行权衡。

另一种解决欠拟合问题的方法是增加数据量。

数据量不足也是导致欠拟合的一个重要原因。

通过增加训练样本的数量,可以提供更多的信息给模型,帮助其更好地学习特征。

我们可以通过数据增强的方式来扩充数据集,例如旋转、平移、缩放、翻转等操作,以生成更多的训练样本。

此外,还可以利用迁移学习的方法,将已经训练好的模型在其他任务上的参数作为初始参数,以加速模型的训练和提高准确性。

除了增加模型复杂度和数据量,正则化也是解决欠拟合问题的一种重要手段。

正则化通过对模型的参数进行约束,防止其过拟合训练数据。

在CNN中,常用的正则化方法包括L1正则化和L2正则化。

L1正则化通过在损失函数中添加参数的绝对值之和,使得模型更加稀疏,减少不重要的特征对预测结果的影响;L2正则化通过在损失函数中添加参数的平方和,使得模型的参数更加平滑,减少参数之间的差异。

此外,还可以使用Dropout技术,随机地将一部分神经元的输出置为0,以减少模型的复杂度,防止过拟合。

卷积神经网络中常见的层类型及其作用

卷积神经网络中常见的层类型及其作用卷积神经网络(Convolutional Neural Network,简称CNN)是一种深度学习模型,广泛应用于计算机视觉领域。

在CNN中,不同的层类型扮演着不同的角色,起到了关键的作用。

本文将介绍CNN中常见的层类型及其作用。

一、卷积层(Convolutional Layer)卷积层是CNN的核心组成部分。

它通过滑动一个卷积核在输入图像上进行卷积操作,提取图像的局部特征。

卷积层具有以下几个作用:1. 特征提取:卷积层通过卷积操作,提取输入图像的不同特征,例如边缘、纹理等。

这些特征对于图像分类、目标检测等任务非常重要。

2. 参数共享:卷积层中的参数是共享的,这意味着同一卷积核在图像的不同位置上可以提取相同的特征。

这大大减少了参数的数量,提高了模型的训练效率。

3. 空间不变性:卷积操作具有平移不变性,即无论特征出现在图像的哪个位置,卷积层都能够检测到。

这使得CNN对于图像的平移、旋转等变换具有一定的鲁棒性。

二、池化层(Pooling Layer)池化层用于减小特征图的尺寸,并提取主要特征。

常见的池化操作有最大池化和平均池化。

池化层的作用包括:1. 降维:通过减小特征图的尺寸,池化层可以减少后续层的计算量,提高模型的运行效率。

2. 不变性:池化操作对于输入特征的微小变化具有一定的不变性,例如平移、旋转等。

这使得模型对于输入的微小变化具有一定的鲁棒性。

三、批归一化层(Batch Normalization Layer)批归一化层用于对输入进行归一化处理,加速模型的训练。

批归一化层的作用包括:1. 加速训练:批归一化可以使得每一层的输入分布更加稳定,加速模型的收敛速度。

2. 防止梯度消失/爆炸:批归一化可以减小梯度的范围,防止梯度消失或爆炸,提高模型的训练稳定性。

3. 正则化:批归一化层可以起到一定的正则化作用,减少过拟合的风险。

四、全连接层(Fully Connected Layer)全连接层是CNN中的最后一层,用于将卷积层和池化层提取的特征进行分类或回归。

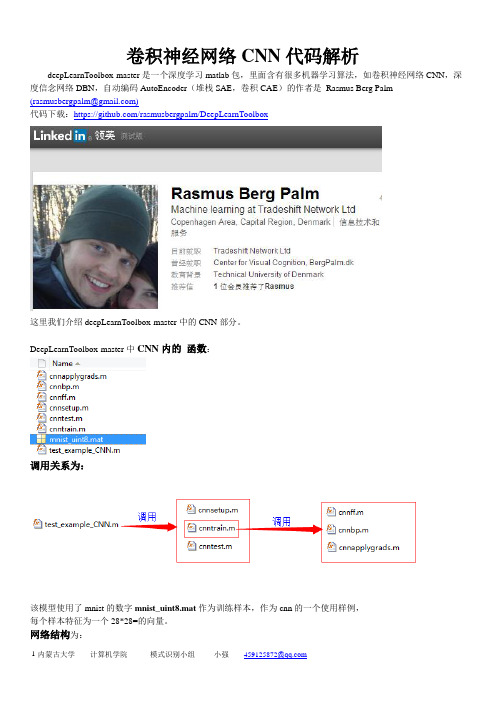

卷积神经网络CNN代码解析-matlab

卷积神经网络CNN代码解析deepLearnToolbox-master是一个深度学习matlab包,里面含有很多机器学习算法,如卷积神经网络CNN,深度信念网络DBN,自动编码AutoEncoder(堆栈SAE,卷积CAE)的作者是Rasmus Berg Palm(************************)代码下载:https:///rasmusbergpalm/DeepLearnToolbox这里我们介绍deepLearnToolbox-master中的CNN部分。

DeepLearnToolbox-master中CNN内的函数:调用关系为:该模型使用了mnist的数字mnist_uint8.mat作为训练样本,作为cnn的一个使用样例,每个样本特征为一个28*28=的向量。

网络结构为:让我们来看看各个函数:一、Test_example_CNN: (2)三、cnntrain.m (5)四、cnnff.m (6)五、cnnbp.m (7)五、cnnapplygrads.m (10)六、cnntest.m (10)一、Test_example_CNN:Test_example_CNN:1设置CNN的基本参数规格,如卷积、降采样层的数量,卷积核的大小、降采样的降幅2 cnnsetup函数初始化卷积核、偏置等3 cnntrain函数训练cnn,把训练数据分成batch,然后调用3.1 cnnff 完成训练的前向过程,3.2 cnnbp计算并传递神经网络的error,并计算梯度(权重的修改量)3.3 cnnapplygrads 把计算出来的梯度加到原始模型上去4 cnntest 函数,测试当前模型的准确率该模型采用的数据为mnist_uint8.mat,含有70000个手写数字样本其中60000作为训练样本,10000作为测试样本。

把数据转成相应的格式,并归一化。

设置网络结构及训练参数初始化网络,对数据进行批训练,验证模型准确率绘制均方误差曲线二、Cnnsetup.m该函数你用于初始化CNN的参数。

如何评估卷积神经网络模型的性能指标

如何评估卷积神经网络模型的性能指标卷积神经网络(Convolutional Neural Network,CNN)作为一种强大的深度学习模型,在图像分类、目标检测和语音识别等领域取得了巨大的成功。

然而,对于许多初学者来说,如何评估卷积神经网络模型的性能指标仍然是一个具有挑战性的问题。

在本文中,我们将探讨一些常用的评估方法和指标,帮助读者更好地理解和评估CNN模型的性能。

一、准确率(Accuracy)准确率是最常见的评估指标之一,它衡量了模型在所有样本上的预测准确性。

准确率的计算公式为:准确率=(预测正确的样本数)/(总样本数)。

然而,准确率并不能完全反映模型的性能,特别是在不平衡数据集上。

在某些情况下,模型可能倾向于预测多数类别,导致准确率偏高。

因此,在评估模型时,我们还需要考虑其他指标。

二、精确率(Precision)和召回率(Recall)精确率和召回率是用于评估二分类模型性能的重要指标。

精确率衡量了模型在预测为正类别的样本中的准确性,计算公式为:精确率=(真正例)/(真正例+假正例)。

召回率衡量了模型在所有真实正类别样本中能够正确预测的比例,计算公式为:召回率=(真正例)/(真正例+假负例)。

精确率和召回率之间存在一种权衡关系,我们可以通过调整分类阈值来平衡二者。

三、F1值F1值是精确率和召回率的调和平均数,用于综合评估模型的性能。

F1值的计算公式为:F1=2*(精确率*召回率)/(精确率+召回率)。

F1值越高,模型的性能越好。

F1值对于不平衡数据集具有较好的稳健性,因此在评估模型时,F1值是一个重要的指标。

四、ROC曲线和AUC值ROC曲线是用于评估二分类模型性能的另一种常用方法。

ROC曲线以假正例率(False Positive Rate,FPR)为横轴,真正例率(True Positive Rate,TPR)为纵轴绘制而成。

ROC曲线能够直观地展示模型在不同阈值下的性能表现。

AUC值是ROC曲线下的面积,用于衡量模型的整体性能。