神经网络3-6-2结构

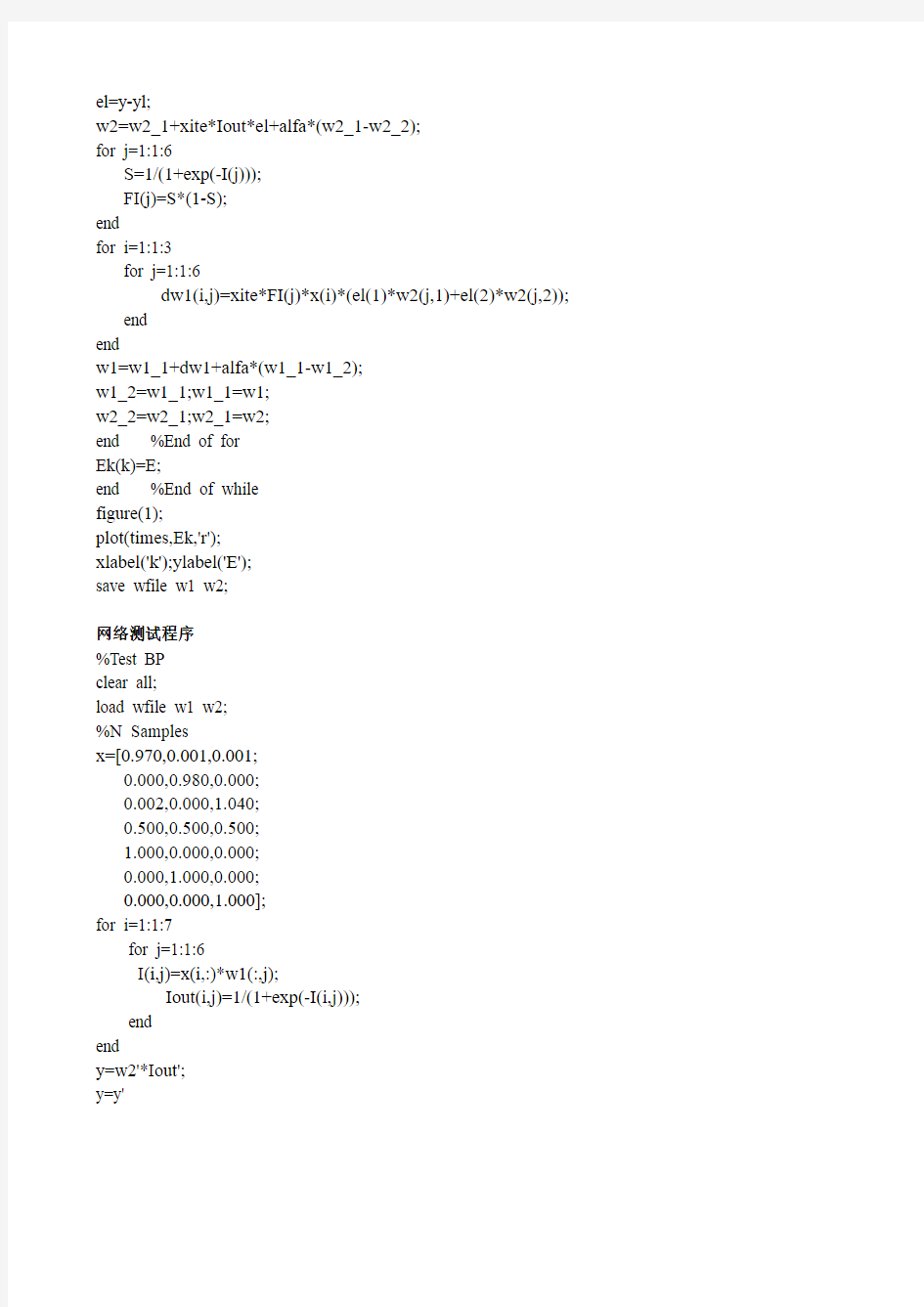

神经网络为3-6-2结构,权值Wij 、Wjl 的初始值取[-1,+1]之间的随机值,取学习率η=0.50,动量因子α=0.05。 网络训练程序

clear all;

close all; xite=0.50; alfa=0.05; w2=rands(6,2); w2_1=w2;w2_2=w2_1; w1=rands(3,6); w1_1=w1;w1_2=w1; dw1=0*w1;

I=[0,0,0,0,0,0]';

Iout=[0,0,0,0,0,0]'; FI=[0,0,0,0,0,0]'; OUT=2; k=0;

E=1.0; NS=3; while E>=1e-020

k=k+1; times(k)=k; for s=1:1:NS %MIMO Samples

xs=[1,0,0; 0,1,0; 0,0,1]; %Ideal Input ys=[1,0; 0,0.5; 0,1]; %Ideal Output x=xs(s,:);

for j=1:1:6 I(j)=x*w1(:,j); Iout(j)=1/(1+exp(-I(j))); end yl=w2'*Iout; yl=yl'; el=0; y=ys(s,:);

for l=1:1:OUT

el=el+0.5*(y(l)-yl(l))^2; %Output error

end

E=0;

if s==NS

for s=1:1:NS

E=E+el;

end

end 初始化V 、W 、E m in ,、η q=1,p=1,E =0

输入样本,计算各层输出: m 21j f y T j j ,...,,),(==X V l 21k f o T j k ,...,,),(==Y W 计算误差: ∑∑==-=P 1p l 1k 2k k o d 21E )(

计算各层误差信号: l 21k o o 1o d k k k k ,...,,,))((δo k =--=

m 21j y y 1w j j l 1k jk o k y j ,...,,))((=-=∑

=δδ 调整各层权值: m

10j l 21k j y o k jk w jk w ,...,,,...,,,,==+?ηδ n 10x m 21j x v v i y j ij ij ,...,,,...,,,==+?ηδ

Y p 增1,q 增1 p

结束

el=y-yl;

w2=w2_1+xite*Iout*el+alfa*(w2_1-w2_2);

for j=1:1:6

S=1/(1+exp(-I(j)));

FI(j)=S*(1-S);

end

for i=1:1:3

for j=1:1:6

dw1(i,j)=xite*FI(j)*x(i)*(el(1)*w2(j,1)+el(2)*w2(j,2));

end

end

w1=w1_1+dw1+alfa*(w1_1-w1_2);

w1_2=w1_1;w1_1=w1;

w2_2=w2_1;w2_1=w2;

end %End of for

Ek(k)=E;

end %End of while

figure(1);

plot(times,Ek,'r');

xlabel('k');ylabel('E');

save wfile w1 w2;

网络测试程序

%Test BP

clear all;

load wfile w1 w2;

%N Samples

x=[0.970,0.001,0.001;

0.000,0.980,0.000;

0.002,0.000,1.040;

0.500,0.500,0.500;

1.000,0.000,0.000;

0.000,1.000,0.000;

0.000,0.000,1.000];

for i=1:1:7

for j=1:1:6

I(i,j)=x(i,:)*w1(:,j);

Iout(i,j)=1/(1+exp(-I(i,j)));

end

end

y=w2'*Iout';

y=y'

人工神经网络的模型

人工神经网络的模型:人工神经元的模型、常用的激活转移函数、MP模型神经元 人工神经元的主要结构单元是信号的输入、综合处理和输出 人工神经元之间通过互相联接形成网络,称为人工神经网络 神经元之间相互联接的方式称为联接模式。相互之间的联接强度由联接权值体现。 在人工神经网络中,改变信息处理及能力的过程,就是修改网络权值的过程。 人工神经网络的构造大体上都采用如下的一些原则: 由一定数量的基本神经元分层联接; 每个神经元的输入、输出信号以及综合处理内容都比较简单; 网络的学习和知识存储体现在各神经元之间的联接强度上。 神经网络解决问题的能力与功效除了与网络结构有关外,在很大程度上取决于网络激活函数。人工神经网络是对人类神经系统的一种模拟。尽管人类神经系统规模宏大、结构复杂、功能神奇,但其最基本的处理单元却只有神经元。人工神经系统的功能实际上是通过大量神经元的广泛互连,以规模宏伟的并行运算来实现的。 人工神经网络模型至少有几十种,其分类方法也有多种。例如,若按网络拓扑结构,可分为无反馈网络与有反馈网络;若按网络的学习方法,可分为有教师的学习网络和无教师的学习网络;若按网络的性能,可分为连续型网络与离散型网络,或分为确定性网络与随机型网络;若按突触连接的性质,可分为一阶线性关联网络与高阶非线性关联网络。 人工神经网络的局限性: (1) 受到脑科学研究的限制:由于生理实验的困难性,因此目前人类对思维和记忆机制的认识还很肤浅,还有很多问题需要解决; (2) 还没有完整成熟的理论体系; (3) 还带有浓厚的策略和经验色彩; (4) 与传统技术的接口不成熟。 如果将大量功能简单的形式神经元通过一定的拓扑结构组织起来,构成群体并行分布式处理的计算结构,那么这种结构就是人工神经网络,在不引起混淆的情况下,统称为神经网络。根据神经元之间连接的拓扑结构上的不同,可将神经网络结构分为两大类:分层网络相互连接型网络 分层网络可以细分为三种互连形式: 简单的前向网络; 具有反馈的前向网络; 层内有相互连接的前向网络。 神经网络的学习分为三种类型:有导师学习、强化学习无导师学习 有导师学习:必须预先知道学习的期望结果——教师信息,并依此按照某一学习规则来修正权值。 强化学习:利用某一表示“奖/惩”的全局信号,衡量与强化输入相关的局部决策如何。 无导师学习:不需要教师信息或强化信号,只要给定输入信息,网络通过自组织调整,自学习并给出一定意义下的输出响应。 神经网络结构变化的角度,学习技术还可分为三种: 权值修正、拓扑变化、权值与拓扑修正学习技术又还可分为:确定性学习、随机性学习 人工神经网络 人工神经网络是生物神经网络的某种模型(数学模型);是对生物神经网络的模仿 基本处理单元为人工神经元 生物神经元(neuron)是基本的信息处理单元

(完整word版)BP神经网络的基本原理_一看就懂

5.4 BP神经网络的基本原理 BP(Back Propagation)网络是1986年由Rinehart和 McClelland为首的科学家小组提出,是一种按误差逆传播算 法训练的多层前馈网络,是目前应用最广泛的神经网络模型 之一。BP网络能学习和存贮大量的输入-输出模式映射关系, 而无需事前揭示描述这种映射关系的数学方程。它的学习规 则是使用最速下降法,通过反向传播来不断调整网络的权值 和阈值,使网络的误差平方和最小。BP神经网络模型拓扑结 构包括输入层(input)、隐层(hide layer)和输出层(output layer)(如图5.2所示)。 5.4.1 BP神经元 图5.3给出了第j个基本BP神经元(节点),它只模仿了生物神经元所具有的三个最基本 也是最重要的功能:加权、求和与转移。其中x 1、x 2 …x i …x n 分别代表来自神经元1、2…i…n 的输入;w j1、w j2 …w ji …w jn 则分别表示神经元1、2…i…n与第j个神经元的连接强度,即权 值;b j 为阈值;f(·)为传递函数;y j 为第j个神经元的输出。 第j个神经元的净输入值为: (5.12) 其中: 若视,,即令及包括及,则

于是节点j的净输入可表示为: (5.13)净输入通过传递函数(Transfer Function)f (·)后,便得到第j个神经元的输出: (5.14) 式中f(·)是单调上升函数,而且必须是有界函数,因为细胞传递的信号不可能无限增加,必有一最大值。 5.4.2 BP网络 BP算法由数据流的前向计算(正向传播)和误差信号的反向传播两个过程构成。正向传播时,传播方向为输入层→隐层→输出层,每层神经元的状态只影响下一层神经元。若在输出层得不到期望的输出,则转向误差信号的反向传播流程。通过这两个过程的交替进行,在权向量空间执行误差函数梯度下降策略,动态迭代搜索一组权向量,使网络误差函数达到最小值,从而完成信息提取和记忆过程。 设 BP网络的输入层有n个节点,隐层有q个节点,输出层有m个节点,输入层与隐层之间的权值为,隐层与输出层之间的权值为,如图5.4所示。隐层的传递函数为f (·), 1 (·),则隐层节点的输出为(将阈值写入求和项中): 输出层的传递函数为f 2

神经网络基本概念

二.神经网络控制 §2.1 神经网络基本概念 一. 生物神经元模型:<1>P7 生物神经元,也称作神经细胞,是构成神经系统的基本功能单元。虽然神经元的形态有极大差异,但基本结构相似。本目从信息处理和生物控制的角度,简述其结构和功能。 1.神经元结构 神经元结构如图2-1所示 图2-1

1) 细胞体:由细胞核、细胞质和细胞膜等组成。 2) 树突:胞体上短而多分支的突起,相当于神经元的输入端,接收传入的神经冲 动。 3) 轴突:胞体上最长枝的突起,也称神经纤维。端部有很多神经末梢,传出神经 冲动。 4) 突触:是神经元之间的连接接口,每一个神经元约有104~106 个突触,前一个 神经元的轴突末梢称为突触的前膜,而后一个神经元的树突称为突触的后膜。一个神经元通过其轴突的神经末梢经突触,与另一个神经元的树突连接,以实现信息传递。由于突触的信息传递是特性可变的,随着神经冲动传递方式的变化,传递作用强弱不同,形成了神经元之间连接的柔性,称为结构的可塑性。 5) 细胞膜电位:神经细胞在受到电的、化学的、机械的刺激后能产生兴奋,此时细胞膜内外由电位差,称为膜电位。其电位膜内为正,膜外为负。 2. 神经元功能 1) 兴奋与抑制:传入神经元的冲动经整和后使细胞膜电位提高,超过动作电 位的阈值时即为兴奋状态,产生神经冲动,由轴突经神经末梢传出。传入神经元的冲动经整和后使细胞膜电位降低,低于阈值时即为抑制状态,不产生神经冲动。 2) 学习与遗忘:由于神经元结构的可塑性,突触的传递作用可增强与减弱, 因此神经元具有学习与遗忘的功能。 二.人工神经元模型 ,<2>P96 人工神经元是对生物神经元的一种模拟与简化。它是神经网络的基本处理单元。图2-2显示了一种简化的人工神经元结构。它是一个多输入单输出的非线形元件。 图2-2 其输入、输出的关系可描述为 =-= n j i j ji i Q X W I 1 2-1 )I (f y i i = 其中i X (j=1、2、……、n)是从其他神经元传来的输入信号;

神经网络详解

一前言 让我们来看一个经典的神经网络。这是一个包含三个层次的神经网络。红色的是输入层,绿色的是输出层,紫色的是中间层(也叫隐藏层)。输入层有3个输入单元,隐藏层有4个单元,输出层有2个单元。后文中,我们统一使用这种颜色来表达神经网络的结构。 图1神经网络结构图 设计一个神经网络时,输入层与输出层的节点数往往是固定的,中间层则可以自由指定; 神经网络结构图中的拓扑与箭头代表着预测过程时数据的流向,跟训练时的数据流有一定的区别; 结构图里的关键不是圆圈(代表“神经元”),而是连接线(代表“神经元”之间的连接)。每个连接线对应一个不同的权重(其值称为权值),这是需要训练得到的。 除了从左到右的形式表达的结构图,还有一种常见的表达形式是从下到上来

表示一个神经网络。这时候,输入层在图的最下方。输出层则在图的最上方,如下图: 图2从下到上的神经网络结构图 二神经元 2.结构 神经元模型是一个包含输入,输出与计算功能的模型。输入可以类比为神经元的树突,而输出可以类比为神经元的轴突,计算则可以类比为细胞核。 下图是一个典型的神经元模型:包含有3个输入,1个输出,以及2个计算功能。 注意中间的箭头线。这些线称为“连接”。每个上有一个“权值”。

图3神经元模型 连接是神经元中最重要的东西。每一个连接上都有一个权重。 一个神经网络的训练算法就是让权重的值调整到最佳,以使得整个网络的预测效果最好。 我们使用a来表示输入,用w来表示权值。一个表示连接的有向箭头可以这样理解: 在初端,传递的信号大小仍然是a,端中间有加权参数w,经过这个加权后的信号会变成a*w,因此在连接的末端,信号的大小就变成了a*w。 在其他绘图模型里,有向箭头可能表示的是值的不变传递。而在神经元模型里,每个有向箭头表示的是值的加权传递。 图4连接(connection) 如果我们将神经元图中的所有变量用符号表示,并且写出输出的计算公式的话,就是下图。

神经网络3-6-2结构

神经网络为3-6-2结构,权值Wij 、Wjl 的初始值取[-1,+1]之间的随机值,取学习率η=0.50,动量因子α=0.05。 网络训练程序 clear all; close all; xite=0.50; alfa=0.05; w2=rands(6,2); w2_1=w2;w2_2=w2_1; w1=rands(3,6); w1_1=w1;w1_2=w1; dw1=0*w1; I=[0,0,0,0,0,0]'; Iout=[0,0,0,0,0,0]'; FI=[0,0,0,0,0,0]'; OUT=2; k=0; E=1.0; NS=3; while E>=1e-020 k=k+1; times(k)=k; for s=1:1:NS %MIMO Samples xs=[1,0,0; 0,1,0; 0,0,1]; %Ideal Input ys=[1,0; 0,0.5; 0,1]; %Ideal Output x=xs(s,:); for j=1:1:6 I(j)=x*w1(:,j); Iout(j)=1/(1+exp(-I(j))); end yl=w2'*Iout; yl=yl'; el=0; y=ys(s,:); for l=1:1:OUT el=el+0.5*(y(l)-yl(l))^2; %Output error end E=0; if s==NS for s=1:1:NS E=E+el; end end 初始化V 、W 、E m in ,、η q=1,p=1,E =0 输入样本,计算各层输出: m 21j f y T j j ,...,,),(==X V l 21k f o T j k ,...,,),(==Y W 计算误差: ∑∑==-=P 1p l 1k 2k k o d 21E )( 计算各层误差信号: l 21k o o 1o d k k k k ,...,,,))((δo k =--= m 21j y y 1w j j l 1k jk o k y j ,...,,))((=-=∑ =δδ 调整各层权值: m 10j l 21k j y o k jk w jk w ,...,,,...,,,,==+?ηδ n 10x m 21j x v v i y j ij ij ,...,,,...,,,==+?ηδ Y p 增1,q 增1 p

机器学习必知的八大神经网络架构

机器学习必知的八年夜神经网络架构 令狐采学 为什么需要机器学习? 有些任务直接编码较为庞杂,我们不克不及处理所有的细微之处和简单编码,因此,机器学习很有需要。相反,我们向机器学习算法提供年夜量数据,让算法不竭探索数据并构建模型来解决问题。比方:在新的杂乱照明场景内,重新的角度识别三维物体;编写一个计算信用卡交易诈骗几率的法度。 机器学习办法如下:它没有为每个特定的任务编写相应的法度,而是收集年夜量事例,为给定输入指定正确输出。算法利用这些事例产生法度。该法度与手写法度不合,可能包含数百万的数据量,也适用于新事例以及训练过的数据。若数据修改,法度在新数据上训练且被更新。年夜量的计算比支付手写法度要廉价的多。 机器学习的应用如下: 1.模式识别:识别实际场景的面部或脸色、语言识别。 2.识别异常:信用卡交易顺序异常,核电厂传感器读数模式异常。 3.预测:未来股价或货币汇率,个人观影喜好。

什么是神经网络? 神经网络是一种通用机器学习模型,是一套特定的算法集,在机器学习领域掀起了一场变动,自己就是普通函数的迫近,可以应用就任何机器学习输入到输出的庞杂映射问题。一般来说,神经网络架构可分为3类: 1.前馈神经网络:是最罕见的类型,第一层为输入,最后一层为输出。如果有多个隐藏层,则称为“深度”神经网络。它能够计算出一系列事件间相似转变的变更,每层神经元的活动是下一层的非线性函数。 2.循环神经网络:各节点之间构成循环图,可以依照箭头的标的目的回到初始点。循环神经网络具有庞杂的静态,难以训练,它模拟连续数据,相当于每个时间片段具有一个隐藏层的深度网络,除在每个时间片段上使用相同的权重,也有输入。网络可以记住隐藏状态的信息,可是很难用这点来训练网络。 3.对称连接网络:和循环神经网络一样,但单位间的连接是对称的(即在两个标的目的的连接权重相同),它比循环神经网络更容易阐发,可是功能受限。没有隐藏单位的对称连接的网络被称为“Hopfiels网络”,有隐藏单位的对称连接的网络则被称为“波兹曼机器”。

神经网络的基本机理和结构

神经网络的基本机理和结构 神经网络的基本组成单元是神经元,在数学上的神经元模型是和在生物学上的神经细胞对应的。或者说,人工神经网络理论是用神经元这种抽象的数学模型来描述客观世界的生物细胞的。 很明显,生物的神经细胞是神经网络理论诞生和形成的物质基础和源泉。这样,神经元的数学描述就必须以生物神经细胞的客观行为特性为依据。因此,了解生物神经细胞的行为特性就是一件十分重要而必须的事了。 神经网络的拓朴结构也是以生物学解剖中神经细胞互连的方式为依据的。对神经细胞相互作用情况的揭露也是十分重要的。 神经元是神经网络基本元素。只有了解神经元才能认识神经网络的本质。在这一节介绍神经元的生物学解副,信息的处理与传递方式,工作功能以及其数学模型。 一、神经元的生物学解剖 在人体内,神经元的结构形式并非是完全相同的;但是,无论结构形式如何,神经元都是由一些基本的成份组成的。神经元的生物学解剖可以用图1—1所示的结构表示。从图中可以看出:神经元是由细胞体,树突和轴突三部分组成。 1.细胞体 细胞体是由很多分子形成的综合体,内部含有一个细胞核、核糖体、原生质网状结构等,它是神经元活动的能量供应地,在这里进行新陈代谢等各种生化过程。神经元也即是整个细胞,整个细胞的最外层称为细胞膜。 2.树突 细胞体的伸延部分产生的分枝称为树突,树突是接受从其它神经元传人的信息的入口。 3.轴突 细胞体突起的最长的外伸管状纤维称为轴突。轴突最长可达1米以上。轴突是把神经元兴奋的信息传出到其它神经元的出口。 突触,是一个神经元与另一个神经元之间相联系并进行信息传送的结构。突触如图1—2所示。它由突触前成分,突触间隙和突触后成分组成。突触前成分是一·个神经元的轴突末梢。突触间隙是突触前成分与后成分之间的距离空间,间隙一般为200—300Å。突触后成分可以是细胞体,树突或轴突。突触的存在说明:两个神经元的细胞质并不直接连通,两者彼此联系是通过突触这种结构接口的。有时.也把突触看作是神经元之间的连接。 目前,根据神经生理学的研究,已经发现神经元及其问的突触起码有不同的4种行为。神经元的4种生物行为有: (1)能处于抑制或兴奋状态; (2)能产生爆发和平台两种情况; (3)能产生抑制后的反冲; (4)具有适应性。 突触的4种生物行为有: (1)能进行信息综合; (2)能产生渐次变化的传送; (3)有电接触和化学接触等多种连接方式; (4)会产生延时激发。 目前,人工神经网络的研究仅仅是对神经元的第一种行为和突触的第一种行为进行模拟,其它行为尚未考虑。所以,神经网络的研究只是处于起步的初级阶段,后边还有大量的工作等人们去探讨和研究。目前,神经网络的研究已向人们展示了其美好的前景;只要按阶段不断取得进展,神经元和突触的其它行为是完全可以实现人工模拟的。 二、神经元的信息处理与传递 1.神经元的兴奋与抑制 人工神经网络对神经元的兴奋与抑制进行模拟,故而首先应了解神经元的兴奋与抑制状态。 一个神经元的兴奋和抑制两种状态是由细胞膜内外之间不同的电位差来表征的。在抑制状态,细胞膜内外之间有内负外正的电位差,这个电位差大约在-50—-100mv之间。在兴奋状态,则产生内正外负的相反电位差,这时表现为约60—100mv的电脉冲。细胞膜内外的电位差是由膜内外的离子浓度不同导致的。细胞的兴奋电脉冲宽度一般大约为1ms。神经元的兴奋过程电位变化如图1—3所示。 图1-3.神经元的兴奋过程电位变化 2.神经元的信息传递及阀值特性 对神经细脑的研究结果表明:神经元的电脉冲几乎可以不衰减地沿着轴突传送到其它神经元去。

人工神经网络三要素及其特点

4.1.1人工神经网络三要素 人工神经网络是对生物神经系统的某种抽象、简化与模拟,是由许多并行互联的相同神经元模型组成。网络的信息处理由神经元之间的相互作用来实现;知识与信息存储在处理单元相互间的物理连接上;网络的学习和识别决定于各神经元连接权系数的动态演化过程。一个神经网络模型描述了一个网络如何将它的输入矢量转化为输出矢量的过程。通常,神经网络模型由网络模型的神经元特性、拓补结构和学习或训练规则三个要素确定。 一、神经元特性 作为神经网络基本单元的神经元模型也有其三个基本要素:l)一组连接权;2)一个求和单元:3)一个非线性激励函数。神经元是神经网络的基本处理单元,它一般是多输入单输出的非线性器件,其结构模型如图4一1所示。 式中j x (1,2,,)j p =???为输入信号,kj w (1,2,,)j p =???为神经元j 到神经元k 的连接权值, 1 p k kj j j u w x ==∑为线性组合结果,k θ为阈值。?为神经元激励函数,k y 为神经元的输出。 1. 激活函数 (Activation Functions) (1) 线性激活函数 x x purelin x f ==)()( (2) 硬限幅激活函数 ?? ?<≥==0 ,00 ,1)lim()(x x x hard x f () k k y v ?= x y

(3)对称的硬限幅激活函数 ? ? ?<-≥==0 ,10 ,1 )(lim )(x x x s hard x f (4)Sigmoid (S 形)激活函数 x e x sig x f λ-+= =11 )(log )(,0>λ 具有平滑和渐进性,并保持单调性,参数λ )(x f 性质:? ??+∞ →→无穷阶光滑λ ),lim()(x hard x f 二、神经网络结构 神经网络由大量并行分布的神经元广泛互联构成。网络的拓补结构是神经网络的一个重要特征,从连接方式看神经网络结构主要有两种。 (l)前馈型网络 前馈网络中神经元是分层排列的,每个神经元只与前一层的神经元相连。输 入层和输出层与外界相连,其它中间层称为隐层,隐层可为一层或多层。除了通 用的前馈网络外,还存在其变型,如前馈内层互连网络,网络在同一层内相互连 接,互相制约,从外部看还是一个前馈网络,很多自组织网络存在此种结构。 单隐层网络:常用;三、四层网络:特殊的目的;四层以上网络:罕见。 (2)反馈型网络 所有节点都是计算单元,也可接受输入,并向外界输出。网络的任意两个神经元之间都可能存在连接,信息在各神经元之间反复传递至趋于某一稳定状态。 三、神经网络的学习方法 1、学习方式 网络的学习可以分为3种基本类型:1)网络权值的学习;2)网络节点函数的 学习;3)网络拓补结构的学习。其中,网络权值的学习最为简单,目前大多数文 献中所谓的网络学习指的就是网络权值的学习。下文的介绍也围绕网络权值的 学习进行。学习的过程就是按某种预定的度量通过调节自身参数(如权值)来达到 性能改养的过程。学习方式有三种: (l)监督学习(有教师学习) x x 输入层 隐层 输出层

介绍人工神经网络的发展历程和分类

介绍人工神经网络的发展历程和分类 1943年,心理学家W.S.McCulloch和数理逻辑学家W.Pitts建立了神经网络和数学模型,称为MP模型。他们通过MP模型提出了神经元的形式化数学描述和网络结构方法,证明了单个神经元能执行逻辑功能,从而开创了人工神经网络研究的时代。1949年,心理学家提出了突触联系强度可变的设想。60年代,人工神经网络的到了进一步发展,更完善的神经网络模型被提出。其中包括感知器和自适应线性元件等。M.Minsky等仔细分析了以感知器为代表的神经网络系统的功能及局限后,于1969年出版了《Perceptron》一书,指出感知器不能解决高阶谓词问题。他们的论点极大地影响了神经网络的研究,加之当时串行计算机和人工智能所取得的成就,掩盖了发展新型计算机和人工智能新途径的必要性和迫切性,使人工神经网络的研究处于低潮。在此期间,一些人工神经网络的研究者仍然致力于这一研究,提出了适应谐振理论(ART网)、自组织映射、认知机网络,同时进行了神经网络数学理论的研究。以上研究为神经网络的研究和发展奠定了基础。1982年,美国加州工学院物理学家J.J.Hopfield提出了Hopfield神经网格模型,引入了“计算能量”概念,给出了网络稳定性判断。1984年,他又提出了连续时间Hopfield神经网络模型,为神经计算机的研究做了开拓性的工作,开创了神经网络用于联想记忆和优化计算的新途径,有力地推动了神经网络的研究,1985年,又有学者提出了波耳兹曼模型,在学习中采用统计热力学模拟退火技术,保证整个系统趋于全局稳定点。1986年进行认知微观结构地研究,提出了并行分布处理的理论。人工神经网络的研究受到了各个发达国家的重视,美国国会通过决议将1990年1月5日开始的十年定为“脑的十年”,国际研究组织号召它的成员国将“脑的十年”变为全球行为。在日本的“真实世界计算(RWC)”项目中,人工智能的研究成了一个重要的组成部分。