第二章 信息量和熵

第二章信息量和熵

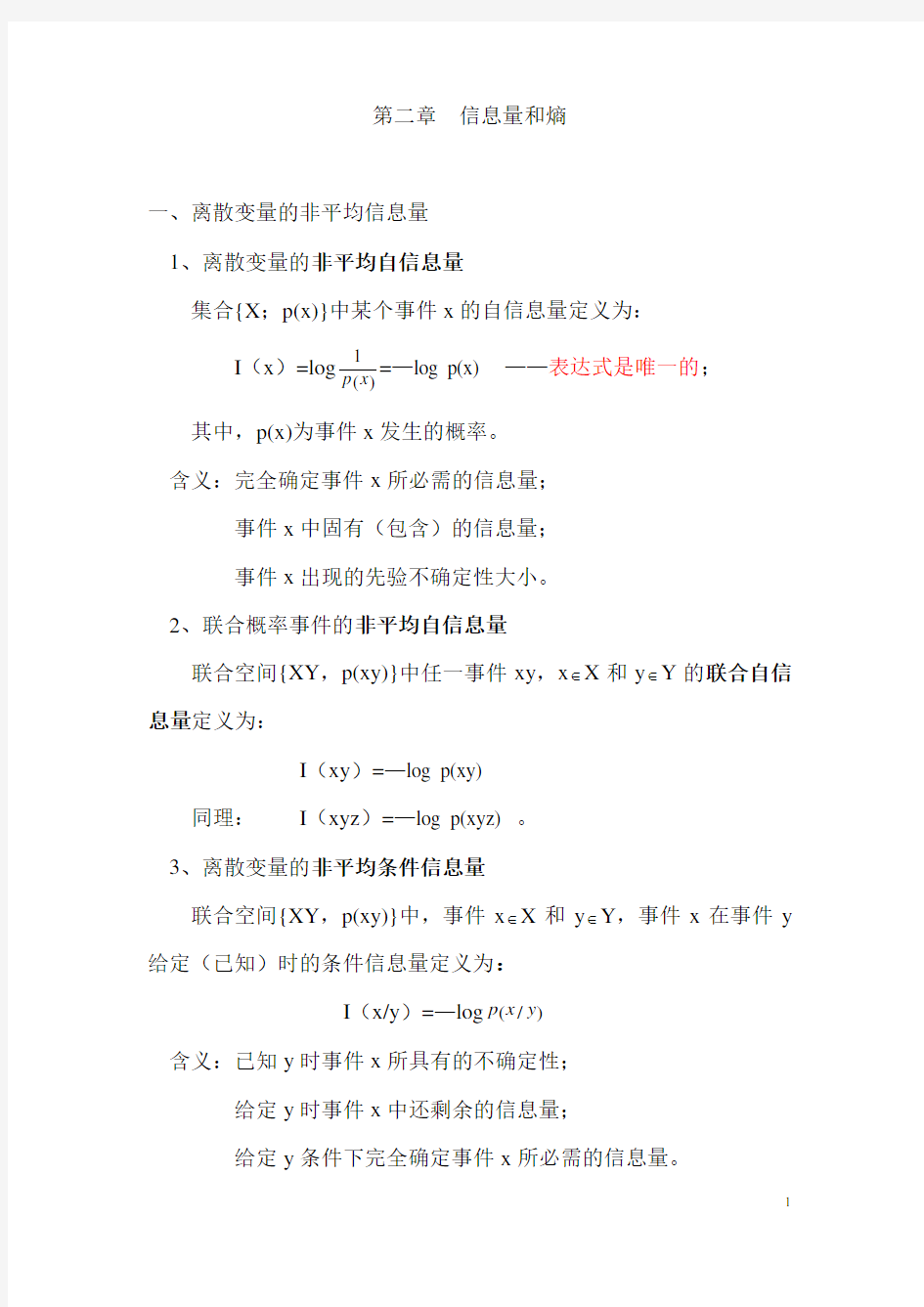

一、离散变量的非平均信息量

1、离散变量的非平均自信息量

集合{X;p(x)}中某个事件x的自信息量定义为:

=—log p(x) ——表达式是唯一的;

I(x)=log1

()

p x

其中,p(x)为事件x发生的概率。

含义:完全确定事件x所必需的信息量;

事件x中固有(包含)的信息量;

事件x出现的先验不确定性大小。

2、联合概率事件的非平均自信息量

联合空间{XY,p(xy)}中任一事件xy,x∈X和y∈Y的联合自信息量定义为:

I(xy)=—log p(xy)

同理:I(xyz)=—log p(xyz) 。

3、离散变量的非平均条件信息量

联合空间{XY,p(xy)}中,事件x∈X和y∈Y,事件x在事件y 给定(已知)时的条件信息量定义为:

I(x/y)=—log(/)

p x y

含义:已知y时事件x所具有的不确定性;

给定y时事件x中还剩余的信息量;

给定y条件下完全确定事件x所必需的信息量。

4、离散事件的非平均互信息量

两个离散事件集{X ,p(x)}和{Y ,p(y)}中,事件y ∈Y 的出现给出关于事件x ∈X 的信息量定义为: I (x ;y )=log (/)()

p x y p x

含义:事件x 和y 之间的互信息量;

从事件y 中可获得关于事件x 的信息量。 5、离散事件的非平均条件互信息量

对于三个离散事件集的联合概率空间{XYZ ,p(xyz )},给定事件

z Z

∈条件下,事件x X ∈和事件y Y ∈之间的条件互信息量定义为:

I (x ;y /z )=log (/)(/)

p x yz p x z =log

(/)(/)(/)

p xy z p x z p y z

注:I (x ;y /z )应理解为:I{(x ;y )/z}

含义:已知事件z 的条件下,从事件y 中可获得关于事件x 的信息量。

6、离散事件非平均信息量的性质 ● 非平均自信息量非负; I (x )=—log p(x)≥0; I (x/y )=—log (/)p x y ≥0 。 ● 非平均互信息量具有对称性; I (x ;y )= I (y ;x ); I (x ;y /z )= I (y ;x /z )。

注:非平均互信息量有可能为负值,如何理解?

x 和y 相互独立时,I (x ;y )=0;P(xy)=P(x)P(y),P(x/y)=p(x) 事件y 出现有益于事件x 的出现时,I (x ;y )≥0; 事件y 出现使事件x 出现的可能性减小时,I (x ;y )≤0。 ● 互信息量和条件自信息量不大于非条件自信息量: I (x ;y )≤I (x ) I (x ;y )≤I (y ) I (x/y )≤I (x ) ● 可加性:

I (xy )= I (x )+I (x/y ) = I (y )+I (y/x )

= I (x )+ I (y )—I (x ;y )

I (xyz )=I (x )+I (y/x )+I (z/xy ) I (x ;yz )=I (x ;y )+I (x ;z/y )

I{(u 1;u 2);u 3}=I (u 1)+ I (u 2)+ I (u 3)—I (u 1 u 2) —I (u 2 u 3)—I (u 1 u 3)+ I (u 1 u 2 u 3) I (u 1;u 2;u 3;…;u N )

=()i I u ∑—()i j I u u ∑+()i j k I u u u ∑—…+(-1)N-1

I (u 1 u 2… u N )

可加性几何解释:

I(x ;y)=0

二、熵——离散集的平均自信息量 1、熵的定义

集{X;q(x)}的平均自信息量定义为: H (X )=∑∈X

x q(x)I (x )=-∑∈X

x q(x)log q(x)

(1) 确定事件的信息量为0;

(2) 不可能事件的信息量为∞;但根据lim 0

→z z logz =0,它对熵的贡献为

0;

(3) 熵为集X 中一个事件出现的平均不确定性,既确定集X 中一个

事件出现平均所需的信息量。

(4) 例子:X{x1,x2}中,q(x1)=P, q(x2)=1-P,则 H(X)=-PlogP-(1-P)log(1-P)

2. 条件熵

(1)H(X/y)=∑x

P(x/y)I(x/y)=-∑x

P(x/y)log P(x/y)

(2) 在集{Y ,ω(y )}上对H(X/y)求均值,有 H(X/Y)= ∑y

ω(y )H(X/y)=-∑x ∑y

P(xy) log P(x/y)

注:集X 和集Y 统计独立时,P(xy)=p(x)P(y),即P(x/y)=P(x) 有:H(X/Y)=H(X) 3. 集X 和集Y 的联合熵

P

H(XY)= -∑x

∑y

P(xy) log P(xy)

4. 熵的性质

(1)对称性:熵值与概率矢量P=(P 1,P 2,…,P k )的次序无关,仅与概率分布有关; (2)非负;

(3)确定性: 概率空间中又确定事件时,其它事件为不可能事件,则熵为0;

(4)扩展性:lim 0

→εH k (P 1,P 2,…,P k ,ε)= H k (P 1,P 2,…,P k )

(5)可加性:H M (p 1q 11, p 1q 21,…,p 1q m 1,1, p 2q 12, p 2q 22,…,p 2q m 2,2, …, p K q 1K ,p K q 2K , …,p K q mK,K )

=H K (p 1, p 2,…, p K )+∑=K

k 1

p k H mk (q 1k , q 2k , …,q mK,K )

其中∑=K

k 1

p k =1, p k ≥0; ∑=K j 1q jk =1, q jk ≥0;M=∑=K

k 1

m k

(5) 极值性:最大离散熵定理 H K (p 1, p 2,…, p K )≤H K (K 1

,

K

1 ,…,

K

1)=logK

(6) H K (P )是概率矢量P=( p 1, p 2,…, p K )的上凸函数,即对于θ,

0≤θ≤1,和矢量P 1、P 2有:

H(θP 1+(1-θ) P 2)>θH (P 1)+(1-θ) H (P 2)

(7) 熵的唯一性定理:熵函数的定义表达式是唯一的,不可能有其

它形式的函数来表示熵。

(8)条件熵不大于无条件熵:H(X/Y) ≤H(X)

三、离散集的平均互信息量

1.I(x;y)是空间XY中的随机变量,对空间X上的概率分布求平均有:

I(X;y)=∑

x p(x/y)log

)

(

)

/

(

x

p

y

x

p,

含义:事件y∈Y出现时,给出的关于集合X中各事件的平均信息量。2.集{X,p(x)}和集{Y,p(y)}之间的平均互信息量为:

I(X;Y)=∑

x ∑

y

p(xy)log

)

(

)

/

(

x

p

y

x

p=∑

x

∑

y

p(y)p(x/y)log

)

(

)

/

(

x

p

y

x

p

含义:一个集合中事件出现给出关于另一集合事件出现的信息量的平均值。

3.平均条件互信息量

集{XYZ,p(Xxyz)}上随机变量I(x;y/z)的数学期望

I(X;Y/Z)=∑

x ∑

y

∑

z

p(xyz)log

)

/

(

)

/

(

z

x

p

yz

x

p

4. 平均互信息量的性质

(1)平均互信息量非负;根据lnx≤x-1可证。即:

- I(X;y) =∑

x p(x/y)log

)

/

(

)

(

y

x

p

x

p≤loge∑

x

p(x/y)[

)

/

(

)

(

y

x

p

x

p-1]=0,

则I(X;y)≥0。

(2)对称性,I(X;Y) = I(Y;X) (3)I(X;Y) =H(X)-H(X/Y)

=H(Y)-H(Y/X)

=H(X)+H(Y)-H(XY)

(4)X与Y相互独立时,I(X;Y)=0

H(X)=H(X/Y);H(Y)=H(Y/X);H(X)+H(Y)=H(XY)

(5)I(X;Y) ≤H(X);I(X;Y) ≤H(Y)

当X与Y完全相关时,p(x/y)=1,p(y/x)=1,有:

H(Y/X)=H(X/Y)=0, I(X;Y)=H(X)=H(Y)。

(6)I(X;YZ)=I(X;Y)+I(X;Z/Y)=I(X;Z)+I(X;Y/Z);

(6)(信息处理定理)信息不增原理

集X为观测对象,集Z为观测到的数据集,

集Y为对观测结果Z的处理结果;有Y=f(Z)

则:H(X/Z)≤H(X/f(Z))= H(X/Y)

I(X;Z)≥I(X;f(Z))=I(X;Y)

当每个z∈Z有唯一的y∈Y与之对应时,等号成立。

上述系统可理解为:在已知Z的条件下,集X与集Y统计独立。证明要点:p(y/zx)=p(y/z),

I(X;Y/Z)= ∑

x ∑

y

∑

z

p(xyz)log

)

/

(

)

/

(

z

y

p

xz

y

p=0;有:

I(X;Y)+I(X;Z/Y)=I(X;Z)+I(X;Y/Z)= I(X;Z)

得:I(X;Z)≥I(X;Y)。

含义:对所观测到的数据做任何处理都会造成信息损失,而不会使信息增加。

四、连续随机变量的互信息和相对熵 (一) 互信息 1.互信息的导出

离散随机事件的互信息I(x;y)=log )

()/(x p y x p =log

)

()()()/(y p x p y p y x p =log

)

()()(y p x p xy p

连续随机变量的互信息: I(x;y)=lim 0

→?→?x y log

y

y xp x p y x xy p ????)()()(= log

)

()()(y p x p xy p

其中p(xy)、p (x )、p (y )为概率密度; 条件:概率密度p (x )≠0、p (y )≠0。 2.连续集X 和Y 之间的平均互信息 I(X;Y)=??p(xy)log

)

()()(y p x p xy p

3. 连续随机变量和连续集的互信息与离散随机变量及离散集的互信息量定义类似,由概率密度代替了离散时的概率分布,积分代替了离散时的求和;且具有类似的性质。 (二)相对熵 1.概念提出

根据离散情况下的熵定义,设p x (x i )为概率密度,有: H(X)=-∑i

[p x (x i )Δx i ]log[p x (x i )Δx i ]

=-∑i

p x (x i )[log p x (x i )]Δx i -∑i

p x (x i )[log Δx i ]Δx i

当Δx i →0时,上式第二项为∞,说明连续变量的潜在信息量为∞。而实际中人或机器的分辨率有限,物理量的测量不必划分过细。

则比较两个连续事件的熵时,消去第二项(常称为绝对熵),而只留下第一项(相对熵)。

则相对熵(微分熵)为:H c (X)=-?∞

∞-p x (x)[log p x (x)]dx

例:正态随机变量,数学期望为m,方差为σ2,求相对熵。 解:概率密度为:p(x)=

σ

π21exp{-

σ

22

1

(x-m)2

} H c (x)=-?∞

∞

-p x (x)[log p x (x)]dx

=-?

∞

∞

-σ

π21exp{-

σ

22

1

(x-m)2

}[-σ

22

1

(x-m)2

-ln π

2σ]

=2

1ln2πe σ2(奈特) 其中,σ2=

e

π21e 2 Hc (x)—— 熵功率。

2.连续随机变量的相对熵具有与离散变量的熵类似的性质,但它不是非负的(略去了一个∞项)。 3.相对熵的极值

连续变量的相对熵为避免∞需要有一定的限制,如当功率为∞时,正态分布的熵也是∞。

(1)峰值功率受限:?-M

M

p(x)dx=1

当连续变量的峰值不超过M 时,x ∈(-M,M), ?-M

M

p(x)dx=1,则x 的相

对熵满足:H c (x)≤log2M 证:根据lnx ≤x-1

H c (x)-λ?-M

M

p(x)dx=-?-M

M

p(x)logp(x)dx-λ?-M

M

p(x)dx

=-?-M M

p(x)log a [a λ

p(x)]dx ≤log a e ?-M

M

p(x)[

)

(1

x p a λ

-1]dx

当

)

(1

x p a λ

=1时,等式成立为极值,此时有:p(x)=a λ- =

M

21,均匀分

布。极值H c (x)=log2M 。

(2)平均功率受限:σ2

=?∞

∞

-p(x)(x-m)2dx <∞

若连续随机变量x 的方差一定,则x 服从正态分布时相对熵最大。 一般情况下,H c (x)≤log πe 2σ

。

五、互信息的凸性 六、随机过程的信息量和熵

熵概念发展及衍生综述

熵概念发展及衍生综述 摘要:1864年Clausius在热力学中引入了熵的概念(称为宏观熵、热力学熵或Clausius熵),1889年Boltzmann又提出了微观熵的概念——Boltzmann 熵。Boltzmann熵是熵概念泛化的理论基础,在玻尔兹曼熵的影响下,熵概念开始得到泛化,使熵概念以自己崭新的面貌走入各个领域,开辟了一个又一个的研究领域,成为众多学科发展的“关节”和“引线”。 关键词:宏观熵、微观熵、负熵、麦克斯韦妖、信息熵 熵由鲁道夫·克劳修斯(Rudolf Clausius)提出,并应用在热力学中。是热力学中为了研究热现象的性质和规律而引入的一个描述体系的混乱度的状态函数,其数值由系统的状态唯一确定。系统处于不同的状态(P、V、T不同),熵值不同。我们可以通过计算系统在不同平衡态下的熵变情况,来判断系统进行的方向,也即利用熵增加原理判断宏观过程进行的方向。 根据熵在热力学中的定义,它在控制论、概率论、数论、天体物理、生命科学等领域都有重要应用,在不同的学科中也引申出了更为具体的定义,是各领域十分重要的参量。因此,本文有必要对熵概念发展及衍生作一综述。 1宏观熵与微观熵 在热力学中,克劳修斯定义的熵,称之为宏观熵,而在统计物理学中,玻尔兹曼定义的熵,称之为微观熵。 1864年,德国物理学家鲁道夫·克劳修斯(Rudolf Clausius)首次提出熵的概念,用来表示任何一种能量在空间中分布的均匀程度,能量分布得越均匀,熵就越大。一个体系的能量完全均匀分布时,这个系统的熵就达到最大值。在克劳修斯看来,在一个系统中,如

果听任它自然发展,那么,能量差总是倾向于消除的。让一个热物体同一个冷物体相接触,热就会以下面所说的方式流动:热物体将冷却,冷物体将变热,直到两个物体达到相同的温度为止。克劳修斯在研究卡诺热机时,根据卡诺定理得出了对任意循环过程都都适用的一个公式:dS=dQ/dT。式中,T为物质的热力学温度;dQ为熵增过程中加入物质的热量。 对于绝热过程Q=0,故S≥0,即系统的熵在可逆绝热过程中不变,在不可逆绝热过程中单调增大。这就是熵增加原理。由于孤立系统内部的一切变化与外界无关,必然是绝热过程,所以熵增加原理也可表为:一个孤立系统的熵永远不会减少。它表明随着孤立系统由非平衡态趋于平衡态,其熵单调增大,当系统达到平衡态时,熵达到最大值。熵的变化和最大值表述了孤立系统过程进行的方向和限度,熵增加原理就是热力学第二定律。在热力学中,熵是用来说明热运动过程的不可逆性的物理量,反映了自然界出现的热的变化过程是有方向性的,是不可逆的。 1889年波尔兹曼(Boltzmann)在研究气体分子运动过程中,用统计的方法来研究气体的行为时,对熵首先提出了微观解释,后经普朗克·吉布斯进一步研究,解释更为明确,S=k·lnΩ,k是玻尔兹曼常数,Ω热力学概率是指任意宏观态所包含的微观状态数。他们认为,在由大量粒子(原子、分子)构成的系统中,熵就表示粒子之间无规则的排列程度,或者说表示系统的紊乱程度,越“乱”,熵就越大;系统越有序,熵就越小。

熵的应用和意义

浅谈熵的意义及其应用 摘要:介绍了熵这个概念产生的原因,以及克劳修斯对熵变的定义式;介绍了玻尔兹曼从微观角度对熵的定义及玻尔兹曼研究工作的重要意义;熵在信息、生命和社会等领域的作用;从熵的角度理解人类文明和社会发展与环境的关系。 关键词:克劳修斯熵玻尔兹曼熵信息熵生命熵社会熵 0 前言:熵是热力学中一个非常重要的物理量,其概念最早是由德国物理学家克劳 修斯(R.Clausius)于1854年提出,用以定量阐明热力学第二定律,其表达式为 dS=(δQ/T)rev。但克劳修斯给出的定义既狭隘又抽象。1877年,玻尔兹曼(L.Boltzmann)运用几率方法,论证了熵S与热力学状态的几率W之间的关系,并由普朗克于1900给出微观表达式S=k logW,其中k为玻尔兹曼常数。玻尔兹曼对熵的描述开启了人们对熵赋予新的含义的大门,人们开始应用熵对诸多领域的概念予以定量化描述,促成了广义熵在当今自然及社会科学领域的广泛应用【1】【2】。 1 熵的定义及其意义 由其表达式可知,克劳修克劳修斯所提出的熵变的定义式为dS=(δQ/T)rev , 斯用过程量来定义状态函数熵,表达式积分得到的也只是初末状态的熵变,并没有熵的直接表达式,这给解释“什么是熵”带来了困难。【1】直到玻尔兹曼从微观角度理解熵的物理意义,才用统计方法得到了熵的微观表达式:S=k logW。这一公式对应微观态等概出现的平衡态体系。若一个系统有W个微观状态数,且出现的概率相等,即每一个微观态出现的概率都是p=1/W,则玻尔兹曼的微观表达式还可写为:S=-k∑plogp。玻尔兹曼工作的杰出之处不仅在于它引入了概率方法,为体系熵的绝对值计算提供了一种可行的方案,而且更在于他通过这种计算揭示了熵概念的一般性的创造意义和价值:上面所描述的并不是体系的一般性质量和能量的存在方式和状态,而是这些质量和能量的组构、匹配、分布的方式和状态。 玻尔兹曼的工作揭示了正是从熵概念的引入起始,科学的视野开始从对一般物的质量、能量的研究转入对一般物的结构和关系的研究,另外,玻尔兹曼的工作还为熵概念和熵理论的广义化发展提供了科学依据。正是玻尔兹曼开拓性的研究,促使熵概念与信息、负熵等概念联姻,广泛渗透,跨越了众多学科,并促

关于焓和熵的概念

关于焓和熵的概念 熵和焓的概念 (2008-11-22 15:23:21) 转载 标签: 杂谈 解释1、焓是物体的一个热力学能状态函数。在介绍焓之前我们需要了解一下分子热运动、热力学能和热力学第一定律:1827年,英国植物学家布朗把非常细小的花粉放在水面上并用显微镜观察,发现花粉在水面上不停地运动,且运动轨迹极不规则。起初人们以为是外界影响,如振动或液体对流等,后经实验证明这种运动的的原因不在外界,而在液体内部。原来花粉在水面运动是受到各个方向水分子的撞击引起的。于是这种运动叫做布朗运动,布朗运动表明液体分子在不停地做无规则运动。从实验中可以观察到,布朗运动随着温度的升高而愈加剧烈。这表示分子的无规则运动跟温度有关系,温度越高,分子的无规则运动就越激烈。正因为分子的无规则运动与温度有关系,所以通常把分子的这种运动叫做分子的热运动。在热学中,分子、原子、离子做热运动时遵从相同的规律,所以统称为分子。既然组成物体的分子不停地做无规则运动,那么,像一切运动着的物体一样,做热运动的分子也具有动能。个别分子的运动现象(速度大小和方向)是偶然的,但从大量分子整体来看,在一定条件下,他们遵循着一定的统计规律,与热运动有关的宏观量——温度,就是大量分子热运动的统计平均值。分子动能与温度有关,温度越高,分子的平均动能就越大,反之越小。所以从分子动理论的角度看,温度是物体分子热运动的平均动能的标志(即微观含义,宏观:表示物体的冷热程度)。分子间存在相互作用力,即化学上所说的分子间作用力(范德华力)。分子间作用力是分子引力与分子斥力的合力,存在一距离r0使引力等于斥力,在这个位置上分子间作用力为零。分子引力与分子斥力都随分子间距减小而增大,但是斥力的变化幅度相对较大,所以分子间距大于r0时表现为引力,小于r0时表现为斥力。因为分子间存在相互作用力,所以分子间具有由它们相对位置决定的势能,叫做分子势能。分子势能与弹簧弹性势能的变化相似。物体的体积发生变化时,分子间距也发生变化,所以分子势能同物体的体积有关系。物体中所有分子做热运动的动能和分子势能的总和叫做物体的热力学能,也叫做内能,

信源及信源熵习题答案

第二章: 试问四进制、八进制脉冲所含信息量是二进制脉冲的多少倍 解: 四进制脉冲可以表示4个不同的消息,例如:{0, 1, 2, 3} 八进制脉冲可以表示8个不同的消息,例如:{0, 1, 2, 3, 4, 5, 6, 7} 二进制脉冲可以表示2个不同的消息,例如:{0, 1} 假设每个消息的发出都是等概率的,则: 四进制脉冲的平均信息量H(X 1) = log 2n = log 24 = 2 bit/symbol 八进制脉冲的平均信息量H(X 2) = log 2n = log 28 = 3 bit/symbol 二进制脉冲的平均信息量H(X 0) = log 2n = log 22 = 1 bit/symbol 《 所以: 四进制、八进制脉冲所含信息量分别是二进制脉冲信息量的2倍和3倍。 居住某地区的女孩子有25%是大学生,在女大学生中有75%是身高160厘米以上的,而女孩子中身高160厘米以上的占总数的一半。假如我们得知“身高160厘米以上的某女孩是大学生”的消息,问获得多少信息量 解: 设随机变量X 代表女孩子学历 X x 1(是大学生) x 2(不是大学生) P(X) ( 设随机变量Y 代表女孩子身高 Y y 1(身高>160cm ) y 2(身高<160cm ) P(Y) " 已知:在女大学生中有75%是身高160厘米以上的 即:p(y 1/ x 1) = 求:身高160厘米以上的某女孩是大学生的信息量 即:bit y p x y p x p y x p y x I 415.15.075.025.0log )()/()(log )/(log )/(2111121111=??? ???-=? ? ????-=-= 一副充分洗乱了的牌(含52张牌),试问 (1) 任一特定排列所给出的信息量是多少 (2) 若从中抽取13张牌,所给出的点数都不相同能得到多少信息量 》 解: (1) 52张牌共有52!种排列方式,假设每种排列方式出现是等概率的则所给出的信息量是: bit x p x I i i 581.225!52log )(log )(2==-= (2) 52张牌共有4种花色、13种点数,抽取13张点数不同的牌的概率如下:

焓熵的相关概念

焓是物体的一个热力学能状态函数。<br/>在介绍焓之前我们需要了解一下分子热运动、热力学能和热力学第一定律:<br/>1827年,英国植物学家布朗把非常细小的花粉放在水面上并用显微镜观察,发现花粉在水面上不停地运动,且运动轨迹极不规则。起初人们以为是外界影响,如振动或液体对流等,后经实验证明这种运动的的原因不在外界,而在液体内部。原来花粉在水面运动是受到各个方向水分子的撞击引起的。于是这种运动叫做布朗运动,布朗运动表明液体分子在不停地做无规则运动。从实验中可以观察到,布朗运动随着温度的升高而愈加剧烈。这表示分子的无规则运动跟温度有关系,温度越高,分子的无规则运动就越激烈。正因为分子的无规则运动与温度有关系,所以通常把分子的这种运动叫做分子的热运动。<br/>在热学中,分子、原子、离子做热运动时遵从相同的规律,所以统称为分子。<br/>既然组成物体的分子不停地做无规则运动,那么,像一切运动着的物体一样,做热运动的分子也具有动能。个别分子的运动现象(速度大小和方向)是偶然的,但从大量分子整体来看,在一定条件下,他们遵循着一定的统计规律,与热运动有关的宏观量——温度,就是大量分子热运动的统计平均值。分子动能与温度有关,温度越高,分子的平均动能就越大,反之越小。所以从分子动理论的角度看,温度是物体分子热运动的平均动能的标志(即微观含义,宏观:表示物体的冷热程度)。<br/>分子间存在相互作用力,即化学上所说的分子间作用力(范德华力)。分子间作用力是分子引力与分子斥力的合力,存在一距离r0使引力等于斥力,在这个位置上分子间作用力为零。分子引力与分子斥力都随分子间距减小而增大,但是斥力的变化幅度相对较大,所以分子间距大于r0时表现为引力,小于r0时表现为斥力。因为分子间存在相互作用力,所以分子间具有由它们相对位置决定的势能,叫做分子势能。分子势能与弹簧弹性势能的变化相似。物体的体积发生变化时,分子间距也发生变化,所以分子势能同物体的体积有关系。<br/>物体中所有分子做热运动的动能和分子势能的总和叫做物体的热力学能,也叫做内能,焓是流动式质的热力学能和流动功之和,也可认为是做功能力。<br/>2、熵是热力系内微观粒子无序度的一个量度,熵的变化可以判断热力过程是否为可逆过程。(可逆过程熵不)热力学能与动能、势能一样,是物体的一个状态量。<br/>能可以转化为功,能量守恒定律宣称,宇宙中的能量必须永远保持相同的值。那么,能够把能量无止境地转化为功吗?既然能量不灭,那么它是否可以一次又一次地转变为功?<br/>1824年,法国物理学家卡诺证明:为了作功,在一个系统中热能必须非均匀地分布,系统中某一部分热能的密集程度必须大于平均值,另一部分则小于平均值,所能荼得的功的数量妈决于这种密集程度之差。在作功的同时,这种差异也在减小。当能量均匀分布时,就不能再作功了,尽管此时所有的能量依然还存在着。<br/>德国物理学家克劳修斯重新审查了卡诺的工作,根据热传导总是从高温到低温而不能反过来这一事实,在1850年的论文中提出:不可能把热量从低温物体传到高温物体而不引起其他变化。这就是热力学第二定律,能量守恒则是热力学第一定律。<br/>1854年,克劳修斯找出了热与温度之间的某一种确定产关系,他证明当能量密集程度的差异减小时,这种关系在数值上总在增加,由于某种原因,他在1856年的论文中将这一关系式称作“熵”(entropy),entropy一诩源于希腊语,本意是“弄清”或“查明”,但是这与克劳修斯所谈话的内容似乎没有什么联系。热力学第二定律宣布宇宙的熵永远在增加着。<br/>然而,随着类星体以及宇宙中其他神秘能源的发现,天文学家们现在已经在怀疑:热力学第二定律是否果真在任何地方任何条件下都成立<br/>熵与温度、压力、焓等一样,也是反映物质内部状态的一个物理量。它不能直接用仪表测量,只能推算出来,所以比较抽象。在作理论分析时,有时用熵的概念比较方便。<br/> 在自然界发生的许多过程中,有的过程朝一个方向可以自发地进行,而反之则不行。例如,如图4a所示,一个容器的两边装有温度、压力相同的两种气体,在将中间的隔板抽开后,两种气体会自发地均匀混合,但是,

熵的定义

热力学第二定律和熵 专业:能源与动力工程 班级:能源14-3班 姓名:王鑫 学号:1462162330

熵的表述 在经典热力学中,可用增量定义为 式中T为物质的热力学温度;dQ为熵增过程中加入物质的热量,下标“可逆”表示加热过程所引起的变化过程是可逆的。若过程是不可逆的,则dS>(dQ/T)不可逆。单位质量物质的熵称为比熵,记为S。熵最初是根据热力学第二定律引出的一个反映自发过程不可逆性的物质状态参量。热力学第二定律是根据大量观察结果总结出来的规律,有下述表述方式:①热量总是从高温物体传到低温物体,不可能作相反的传递而不引起其他的变化;②功可以全部转化为热,但任何热机不能全部地,连续不断地把所接受的热量转变为功(即无法制造第二类永动机);③在孤立系统中,实际发生过程,总使整个系统的熵值增大,此即熵增原理。摩擦使一部分机械能不可逆地转变为热,使熵增加。热量dQ由高温(T1)物体传至低温(T2)物体,高温物体的熵减少dS1=dQ/T1,低温物体的熵增加dS2=dQ/T2,把两个物体合起来当成一个系统来看,熵的变化是dS=dS2-dS1>0,即熵是增加的。 熵的相关定义 1.比熵:在工程热力学中,单位质量工质的熵,称为比熵。表达式为δq=Tds,s称为比熵,单位为J/ (kg·K) 或kJ/ (kg·K)。 2.熵流:系统与外界发生热交换,由热量流进流出引起的熵变。熵流可正可负,视热流方向而定。 3.熵产:纯粹由不可逆因素引起的熵的增加。熵产永远为正,其大小由过程不可逆性的大小决定,熵产为零时该过程为可逆过程。熵产是不可逆程度的度量。 熵增原理 孤立系统的熵永不自动减少,熵在可逆过程中不变,在不可逆过程中增加。 熵增加原理是热力学第二定律的又一种表述,它比开尔文、克劳修斯表述更为概括地指出了不可逆过程的进行方向;同时,更深刻地指出了热力学第二定律是大量分子无规则运动所具有的统计规律,因此只适用于大量分子构成的系统,不适用于单个分子或少量分子构成的系统 实质:熵增原理指出:凡事是孤立系统总熵减小的过程都是不可能发生的,理想可逆的情况也只能实现总熵不变,实际过程都不可逆,所以实际热力过程总是朝着使孤立系统总熵增大的方向进行,dS>0。熵增原理阐明了过程进行的方向。 熵增原理给出了系统达到平衡状态的判据。孤立系统内部存在不平衡势差是过程自发进行的推动力。随着过程进行,孤立系统内部由不平衡向平衡发展,总熵增大,当孤立系统总熵达到最大值时,过程停止进行,系统达到相应的平衡状态,这时的dS=0即为平衡判据。因而,熵增原理指出了热过程进行的限度。 熵增原理还指出如果某一过程的进行,会导致孤立系中各物体的熵同时减小,虽然或者各有增减但其中总和使系统的熵减小,则这种过程,不能单独进行除非有熵增大的过程,作为补

联合熵与条件熵

第6讲 联合熵与条件熵 信息熵H(X)反映了随机变量X 的取值不确定性。当X 是常量时,其信息 熵最小,等于0;当X 有n 个取值时,当且仅当这些取值的机会均等时,信息 熵H(X)最大,等于log n 比特。我们拓展信息熵H(X)的概念,考虑两个随机 变量X 和Y 的联合熵H(XY)和条件熵H(Y|X)。 1. 联合熵 设X ,Y 是两个随机变量, 则(X,Y)是二维随机变量,简写为XY 。 二维随机变量XY 的联合概率分布记为p (xy ),即 根据信息熵的定义可知,XY 的信息熵为 定义 1.1 二维随机变量XY 的信息熵H(XY)称为X 与Y 的联合熵(joint entropy )。 它反映了二维随机变量XY 的取值不确定性。我们把它理解为X 和Y 取值的 总的不确定性。 练习: 假设有甲乙两只箱子,每个箱子里都存放着100个球。甲里面有红蓝色球 各50个,乙里面红、蓝色的球分别为99个和1个。试计算H(XY) 我们将联合熵概念推广到任意多离散型随机变量上。 定义1.2 一组随机变量12,,,N X X X L 的联合熵定义为 注:为了简化记号,我们有时把12N X X X L 记为X N ,把12N x x x L 记为x N 。 物理意义: (1)12()N X H X X L 是这一组随机变量平均每一批取值 所传递的信息量。 (2)若N-维随机变量12N X X X L 表示某信源产生的任意一条长度为N 的消息, 则12()N X H X X L 是平均每条长度为N 的消息的信息量。因此,若该信源产生一 个长度为N 的消息,则在不知道其它条件的情况下,对该消息所含信息量的最

第二章信源熵-习题答案(精品文档)

· 1 · 2.1 试问四进制、八进制脉冲所含信息量是二进制脉冲的多少倍? 解: 四进制脉冲可以表示4个不同的消息,例如:{0, 1, 2, 3} 八进制脉冲可以表示8个不同的消息,例如:{0, 1, 2, 3, 4, 5, 6, 7} 二进制脉冲可以表示2个不同的消息,例如:{0, 1} 假设每个消息的发出都是等概率的,则: 四进制脉冲的平均信息量H(X 1) = log 2n = log 24 = 2 bit/symbol 八进制脉冲的平均信息量H(X 2) = log 2n = log 28 = 3 bit/symbol 二进制脉冲的平均信息量H(X 0) = log 2n = log 22 = 1 bit/symbol 所以: 四进制、八进制脉冲所含信息量分别是二进制脉冲信息量的2倍和3倍。 2.2 居住某地区的女孩子有25%是大学生,在女大学生中有75%是身高160厘米以上的,而女孩子中身高160厘米以上的占总数的一半。假如我们得知“身高160厘米以上的某女孩是大学生”的消息,问获得多少信息量? 解: 设随机变量X 代表女孩子学历 X x 1(是大学生) x 2(不是大学生) P(X) 0.25 0.75 设随机变量Y 代表女孩子身高 Y y 1(身高>160cm ) y 2(身高<160cm ) P(Y) 0.5 0.5 已知:在女大学生中有75%是身高160厘米以上的 即:p(y 1/ x 1) = 0.75 求:身高160厘米以上的某女孩是大学生的信息量 即:bit y p x y p x p y x p y x I 415.15.075.025.0log )()/()(log )/(log )/(2111121111=??? ???-=? ? ????-=-= 2.3 一副充分洗乱了的牌(含52张牌),试问 (1) 任一特定排列所给出的信息量是多少? (2) 若从中抽取13张牌,所给出的点数都不相同能得到多少信息量? 解: (1) 52张牌共有52!种排列方式,假设每种排列方式出现是等概率的则所给出的信息量是: bit x p x I i i 581.225!52log )(log )(2==-= (2) 52张牌共有4种花色、13种点数,抽取13张点数不同的牌的概率如下: bit C x p x I C x p i i i 208.134 log )(log )(4)(1352 13 2 213 52 13 =-=-==

信息论与编码第二章 信源熵习题的答案[最新]

2.1 试问四进制、八进制脉冲所含信息量是二进制脉冲的多少倍? 解: 四进制脉冲可以表示4个不同的消息,例如:{0, 1, 2, 3} 八进制脉冲可以表示8个不同的消息,例如:{0, 1, 2, 3, 4, 5, 6, 7} 二进制脉冲可以表示2个不同的消息,例如:{0, 1} 假设每个消息的发出都是等概率的,则: 四进制脉冲的平均信息量symbol bit n X H / 24log log )(1=== 八进制脉冲的平均信息量symbol bit n X H / 38log log )(2=== 二进制脉冲的平均信息量symbol bit n X H / 12log log )(0=== 所以: 四进制、八进制脉冲所含信息量分别是二进制脉冲信息量的2倍和3倍。 2.2 居住某地区的女孩子有25%是大学生,在女大学生中有75%是身高160厘米以上的,而女孩子中身高160厘米以上的占总数的一半。假如我们得知“身高160厘米以上的某女孩是大学生”的消息,问获得多少信息量? 解: 设随机变量X 代表女孩子学历 X x 1(是大学生) x 2(不是大学生) P(X) 0.25 0.75 设随机变量Y 代表女孩子身高 Y y 1(身高>160cm ) y 2(身高<160cm ) P(Y) 0.5 0.5 已知:在女大学生中有75%是身高160厘米以上的 即:bit x y p 75.0)/(11= 求:身高160厘米以上的某女孩是大学生的信息量 即:bit y p x y p x p y x p y x I 415.15 .075.025.0log )()/()(log )/(log )/(11111111=?-=-=-= 2.3 一副充分洗乱了的牌(含52张牌),试问 (1) 任一特定排列所给出的信息量是多少? (2) 若从中抽取13张牌,所给出的点数都不相同能得到多少信息量? 解: (1) 52张牌共有52!种排列方式,假设每种排列方式出现是等概率的则所给出的信息量是: ! 521)(=i x p bit x p x I i i 581.225!52log )(log )(==-= (2) 52张牌共有4种花色、13种点数,抽取13张点数不同的牌的概率如下:

熵

熵的由来 物理学中,熵有两个定义——热力学定义和统计力学定义。 熵最初是从热力学角度定义的。19世纪50年代,克劳修斯 (... R J E C lausius)编造了一个新名词:entropy,它来自希腊 词“trope”,意为“转变,变换”。为了与能量(energy)相对 应,克劳修斯在“trope”上加了一个前缀“en”。在克劳修斯看 来,“energy”和“entropy”这两个概念有某种相似性。前者从 正面量度运动转化的能力;后者从反面量度运动不能转化的能力, 即运动丧失转化能力的程度,表述能量的可转换能力(活力)丧失的程度,或能量僵化(蜕化)的程度(尽管能量总体是守恒的)。 例如,你用20元人民币购得一袋大米,你的价值总量(能量)不变,但一袋大米在市场上的再交换能力(活力)低于20元人民币。这种消费使其熵(经济)增大。按当初的设计,活力越丧失,能量越僵化,熵越大。热力学第一定律描述了自然界中各种形式的能量转换过程中量的守恒,并未指出不同形式能量的本质的差异。而热力学第二定律告诉我们,能量之间的品质是有差别的:有序运动的能量可以通过做功完全转变成无序运动的能量;而无序运动的能量不能完全转变成有序运动的能量(效率为100%的热机是不能实现的)。或者说,有序运动的能量转化为其他形式的能量的能力强,能被充分利用来做功,品质较高;而无序运动的能量转化能力弱,做功能力差,品质较低。根据热力学第二定律,高品质的能量转换为低品质的能量的过程是不可逆的。高品质的能量转换为低品质的能量后,就有一部分不能再做功了。我们把这样的过程称为能量的退化,通过物理学知识可以证明:退化的能量与系统的熵增成正比。于是,我们可以说:熵是能量不可用程度的度量。 “熵”的中文译名是我国物理学家胡刚复教授确定的。他于1923年5月为德国物理学家普朗克作《热力学第二定律及熵之观念》讲学时做翻译,把“entropy”译为“熵”。它是热量变化与温度之比(商),又与热学有关,就加了个“火”字旁,定名为熵。 我们知道,事物(封闭系统)变化的过程大多是不可逆的。从初态可变到终态,而终态却不能自发地(不影响周围环境)变回初态,尽管能量始终是守恒的。例如,封闭容器中气体分子可以自由膨胀充满整个容器,但却不能自发地回缩到原来的某个局部;瓷瓶落地成碎片,而碎瓶却不能自发复原成瓷瓶;生米煮成熟饭,熟饭却不能晾干成生米;热量可以自动从高温物体传递给与之相连的低温物体,但却不能自动逆向传递,等等。这就是说,这些初态与终态之间有着某种本质上的差别。物理学家用“熵”(S)这个物理概念来描述这种差别,进而用“熵变”(S ?)这个物理量来计算这种差别。认为初态(宏观)所含的微观状态数较少(即熵值小,较有序),而终态(宏观)则相反。在一封闭系统中,自然演变总是指向微观状态数多的方向(熵值大,较无序)发展,而不是相反。这就是熵增大原理:0 ?>。 S 增大的最终结果只能是大家都处在同等状态——平衡态,碎瓶越摔越碎,温度差越来越小。 1896年,奥地利物理学家玻尔兹曼从分子运动论的观点对熵做 了微观解释,认为熵是分子运动混乱程度的量度。这不仅是人们对 熵的理解豁然开朗,而且为熵概念的泛化(推广)创造了契机。玻 尔兹曼证明了,在系统的总能量、总分子数一定的情况下,表征系 统宏观状态的熵(S)与该宏观态对应的微观数W有如下关系: =? S k W ln 这就是著名的玻尔兹曼公式。它把熵和微观状态数联系起来,熵 越大,微观状态数越多,分子运动越混乱,熵成为分子运动混乱程

焓&熵

焓enthalpy 为了引出焓这个概念,我们先讨论恒容和恒压过程的热效应。 对于一个封闭体系,△U=Q-W,封闭体系,恒容变化(不做体积功),且不做非体积功时,△U=Q,即封闭系、恒容、W'=0时,△U=Q v(Q v为恒容热效应),dU=δQ v。 上式是热力学中常用的一个公式,使用此公式时,一定要满足前面的条件,请大家注意,在热力学中用公式必须满足条件。 在化学中,我们更关心恒压过程,因为化学效应一般是在恒压条件下进行的。 封闭体系、恒压时,△U=Q p-W,若W'=0,则Q p=△U+W=△U+P e△V=U2-U1+ (P e V2-P e V1),因恒压P e=P1=P2,则Q p=(U2+P2V2)-(U1+P1V1),为了数学表达的方便,引进一个物理量,焓:H=U+PV,这里要说明一下,焓在这里无明确的物理意义,可以理解为,为了表达方便,专门设为一个符号,H即U+PV,之所以要提出焓这一物理量,是因为U+PV经常会用到,所以专门用一个符号来代替它。则上式 Qp=H2-H1=△H。 ∴封闭体系、恒压、W'=0时, Qp=△H,dH=δQ p。 这里要特别说明的是,H是状态系数,因为U、P、V都是状态系数,状态确定,U、P、V都是一定值,当然H也是确定值,也就是说从始态→终态,所有途径的△H都是的一样的,也就是说,在计算△H时,可以设计一条方便计算得途径。 焓是热力学的基本概念之一,以后经常要用到。总的来说,封闭体系不做非体积功时的过程,内能变化可以通过测定恒容热效应来求,焓变可以通过测恒压热效应求得。 焓 焓(enthalpy),符号H,是一个系统的热力学参数。 物理意义:⑴H=U+pV 焓=流动内能+推动功 ⑵焓表示流动工质所具有的能量中,取决于热力状态的那部分能量 定义一个系统内: H = U + pV 式子中"H"为焓,U为系统内能,p为其压强,V则为体积。 对于在大气内进行的化学反应,压强一般保持常值,则有 ΔH = ΔU + pΔV 规定放热反应的焓取负值。如:

2015秋.信息论.第2章离散信源与信息熵

第2章离散信源与信息熵 信号 信号+干扰 消息 干扰 消息 信源 编码器 信道 译码器 信宿 噪声源 通信系统模型 信息

2.1 信源的分类和描述 信源是信息的发源地,可以是人、生物、机器或其他事物。信源的输出是包含信息的消息。消息的形式可以是离散的或连续的。 信源输出为连续信号形式(如语音),可用连续随机变量描述。 连续信源←→模拟通信系统 信源输出是离散的消息符号(如书信),可用离散随机变量描述。 离散信源←→数字通信系统

离散信源…X i…X j… 离散无记忆信源:输出符号X i X j 之间相互无影响; 离散有记忆信源:输出符号X i X j 之间彼此依存。 3 离散信源 无记忆 有记忆发出单个符号发出符号序列马尔可夫信源 非马尔可夫信源

y j 将一粒棋子随意地放 在棋盘中的某列; 棋子放置的位置是一 个随机事件; 可看做一个发出单个 符号的离散信源。 x i

1212,,...,(),(),...,()m m x x x X P p x p x p x ????=???????? 就数学意义来讲,信源就是一个概率场,可用概率空间来描述信源。由离散随机变量X 表示棋子位置: 10()1,()1m i i i p x p x =≤≤=∑i x 其中,代表随机事件的某一结果。

2.2离散信源的信息熵信息的可度量性是信息论建立的基础; 香农的信息论用事件发生概率的对数来描述事件的不确定性,得到消息的信息量,建立熵的概念。 2.2.1自信息量 –定义2.1 任意随机事件x i 的自信息量定义为: i i i 1(x )log log (x )(x ) I P P ==-

熵及熵增加的概念及意义

熵及熵增加的概念及意义 摘 要:熵是热学中一个及其重要的物理概念。自从克劳修斯于1865年提出熵概念以来,由于各学科之间的相互渗透,它已经超出物理学的范畴。本文从熵的概念出发,简述了熵的概念和意义及熵增加的概念和意义,促进我们对熵的理解。 关键词:熵;熵概念和意义; 一. 熵概念的建立及意义 1.克劳修斯对熵概念的推导 最初,克劳修斯引进态函数熵,其本意只是希望用一种新的形式,去表达一个热机在其循环过程所必须的条件。熵的最初定义建立于守恒上,无论循环是否理想,在每次结束时,熵都回到它最初的数值。首先将此过程限于可逆的过程。则有 0d =?T Q 图1-1 闭合的循环过程 公式0d =?T Q 的成立,足以说明存在个态函数。因此,对于任意一个平衡态,均可引 入态函数——熵:从状态O 到状态A ,S 的变化为 ? =-A O T Q S S d 0S 为一个常数,对应于在状态O 的S 值。对于无限小的过程,可写上式为 可逆)d ( d T Q S = 或 可逆)d (d Q S T = 在这里的态函数S 克劳修斯将其定义为熵。不管这一系统经历了可逆不可逆的变化过程,具体计算状态A 的熵,必须沿着某一可逆的变化途径。这里不妨以理想气体的自由膨胀为例来说明这一点。 p V

设总体积为2V 的容器,中间为一界壁所隔开。 图1-2 气体的自由膨胀 初始状态时,理想气体占据气体为1V 的左室,右室为真空气体2V 。然后,在界壁上钻一孔,气体冲入右室,直到重新达到平衡,气体均匀分布于整个容器为止。膨胀前后,气体温度没有变化,气体的自由膨胀显然是一个不可逆的问题。对于此过程,是无法直接利用公式(1-1)来计算熵的变化的。但为了便于计算,不一定拘泥于实际所经历的路线。不妨设想一个联系初、终状态的可逆过程,气体从体积1V 扩展到2V 得等温膨胀。在此过程中,热量Q 全部转化为功W 。 ??===T W T Q Q T T Q d 1d ??===?V P V V T T W T Q S d 1d 2112ln V V nR = 计算中引用了理想气体状态方程 pV =nRT = NkT 时至今日,科学的发展远远超出了克劳修斯当时引进熵的意图及目标。熵作为基本概念被引入热力学,竟带来了科学的深刻变化,拓展了物理内容,这是克劳修斯所没有预料到的。 2.熵的概念 熵,热力学中表征物质状态的参量之一,用符号S 表示,其物理意义是体系混乱程度的度量。 3.熵的性质及意义 自然界中所有不可逆的过程不仅不能反向进行,而且在不引起其它条件的变化下,用任何方式也不能回到原来状态,这就表明,自发过程单向性或不可逆性并不由过程进行的方式和路径决定,而是由系统的初、终状态决定。所以,根据态函数的定义,不可逆的过程的单向性或不可逆性具有以上态函数的性质,因而熵就是用来表征这个态函数。熵的单位J/K 。熵具有以下两个性质: (1)熵是一个广延量,具有相加性。体系的总熵等于体系各部分的熵的总和。 (2)体系熵的变化可分为两部分:一部分是由体系和外界环境间的相互作用引起的。另一部分是由体系内部的不可逆过程产生的。 熵的物理意义可以这样来理解,在孤立的体系中进行不可逆的过程,总包含有非平衡态向平衡态进行的过程,平衡态与非平衡态比较,系统内运动的微观粒子更为有序,因此,系统的熵增加过程与从有序态向无序态转变有联系。熵越大的态, 系统内热运动的微观粒子越

第二章信源与信息度量习题

第二章 信源与信息度量 习题 1. 某大学设置五个学院,每个学院的学生数分别为 学院: 数学 物理 外语 外贸 医学 人数: 300 400 500 600 200 问“某学生王某是外语学院学生”这一消息提供的信息量是多少? 2. 同时扔出两个正常的骰子,也就是各面呈现的概率都是1/6,求: (1) 事件“2和5同时呈现”的自信息量; (2) 事件“两个4同时呈现”的自信息量; (3) 事件“至少呈现一个1”的自信息量。 3. 字母“e ”在英文中出现的概率是0.103,字母“c ”出现的概率为0.022,字母“x ”出现的概率是0.001,求这些字母各自的自信息量。 4. 某电子厂共能生产A 、B 、C 、D 四种仪器,其中A 因技术落后停产了,B 占全部产量的20%,C 占30%,D 占50%。有两个消息“现在完成1台仪器B ”,和“现在完成1台仪器C ”,试确定哪一种消息提供的信息量大些?其中有什么规律? 5. 某地,35%的女孩上大学,65%的女大学生身高超过1.6米,而一个女孩身高超过1.6米的概率是50%,现有一条消息:说某一个身高超过1.6米的女孩是大学生,求这条消息的信息量。 6. 试求: (1) 在一付标准的扑克牌中抽出一张(每张牌均认为是不同的)的平均信息量。 (2) 若扑克牌仅按它的等级鉴定而不问它的花色(大、小王属同一等级),重复上述计算。 7. 某地的天气预报为:晴(占4/8),多云(占2/8),雨(占1/8),雪(占1/8),冰雹(占0/8);而当地老农对天气的预测只能做到:晴(占7/8),雨(占1/8)。试求两者对天气预报各自提供的平均信息量,并说明从中得到的规律。 8. 某离散无记忆平稳信源的概率空间为:12340123()3/81/41/41/8X x x x x p X ====????=????????,若某消息符号序列为:202 120 130 213 001 203 210 110 321 010 021 032 011 223 210,求: (1) 该消息的自信息量; (2) 该消息平均每个符号携带的信息量。 9. 若每帧电视图像由3×105 个像素组成,且像素是独立变化的。每个像素取128个不同的亮度电平,并设亮度电平等概率出现。 (1) 问每帧图像含有多少信息量? (2) 若现有一广播员在约10,000个汉字的字汇中选1,000个字来口述此电视图像,问广播员描述此图像所播出的信息量是多少?(假设,10,000个汉字字汇等概率分布,并彼此无依赖) (3) 若要恰当地描述出此图像的所有信息量,广播员在口述中至少需要多少汉字? 10. 设有一个信源,发送“0”和“1”两种符号,无论何时发出符号的概率均为p (0) = 0.4,p (1) = 0.6,并与以前发出的符号无关, (1) 问该信源是否是平稳信源? (2) 计算2()H X ,312()/H X X X 和lim ()N N H X →∞;

熵

熵 1 熵 1.1熵概念的引入 1.1.1“熵”的定义 1854 年克劳修斯[2]在《论热的动力理论的第二原理的另一形式》论文中根据热力学第 一定律和理想气体的状态方程得出:在循环过程中发生的所有转化的等效值是积分 ?dT dQ 他指出:对于可逆循环过程: 0=?可逆 dT dQ 对于不可逆循环过程: 0

即对于任意一个过程总满足: ?≥-=?B A A B Q S S S T d 其中,等号对应于可逆过程,不等号对应于不可逆过程。在一切孤立系统中,物质与外界的热交换不存在,即 0=dQ ,故有: 0≥?S 这就是著名的熵增加原理,也是热力学第二定律的定量的数学表达式,该式表明:对于一个孤立系统而言,可逆过程则熵值不变,不可逆过程则熵要增加。它的实质是阐明了热力学系统的不可逆性,如热传递的不可逆性或功热转换的不可逆性等。由此可见,熵是热力学系统自发变化的一个宏观描述量。 克劳修斯所引入的熵也称为“热力学熵”,对于系统给定的一个状态而言,谈论热力学熵S 的绝对值没有意义,但它从一个状态到另一个状态间的转变,却可以用来判断这种转变的正或负以及转变量的大小。热力学熵S 可以表示一个物质系统中能量的衰竭程度,是用以判别事物自发过程的一个状态函数,通过比较事物不同状态下系统的熵值大小,可以辩别出系统的转化方向。 1.1.2“熵”的命名 克劳修斯在选择“熵”这个名称时,曾写道:“在确定一些重要的科学量的名称时,我宁愿求助于古代的文字,这样做的目的是为了使这名称能在现有各种文字中表示同样的意思。”为熵S 命名时[6] ,他选用字义为“转变”的希腊语“τροπη” ,还要求熵S 在发音和字形上要与德文的能量“Energie ”(英文为 Energy )相似,因此就用“Entropie ”(英文为 Entropy )来命名熵。 其字根‘-tropy ’源于希腊文‘转变’,前缀‘en-’取自‘能量’。 而 entropy 的中文译名源自著名物理学家胡刚复教授:1923 年德国物理学家普朗克(I ·R ·Planck )来中国南京讲学,胡教授为其翻译时,首次将其译为熵,渊源于 entropy 这个概念太复杂,况且这个词是克劳修斯所造,不容易找到一个与此贴切的字。鉴于此,胡 先生就想到根据公式T dQ dS =,认为S 为热量与温度之商,而且此概念与火(象征着热)有 关,于是在商字上加火字旁,构成一个新字“熵”。胡先生利用汉字以偏旁来表达字义的特色,贴切而又形象地表达了态函数“Entropy ”的物理概念,从而使“熵”被广泛采用[2] 。 1.2熵变的意义 在热力学中,熵是平衡态热力学的一个态函数,它的定义为 ?+=2 1)(0可逆S T dQ S 其中,1和2是两个平衡态,积分路径沿着任意可逆过程,T 为热源温度,dQ 是某一微小过程中系统吸收的热量,这样定义的物理熵有以下几方面的意义[7]。

第二章信源信息熵

第二章信源与信息熵 主要内容:(1)信源的描述与分类;(2)离散信源熵和互信息;(3)离散序列信源的熵;(4)连续信源的熵和互信息;(5)冗余度。 重点:离散/连续信源熵和互信息。 难点:离散序列有记忆信源熵。 说明:本章内容主要针对信源,但是很多基本概念却是整个信息论的基础,所以安排了较多课时。由于求熵涉及一些概率论的基础知识,考虑到大四的同学可能对这部分知识已经遗忘,故适当复习部分概率论知识。较难的 2.1.2节马尔可夫信源部分放置在本章最后讲,便于同学理解。本章概念和定理较多,比较抽象,课堂教学时考虑多讲述一些例题,通过例题来巩固概念和消化定理。 作业: 2.1—2.7,2.10,2.12。 课时分配:10课时。 板书及讲解要点: 在信息论中,信源是发出消息的源,信源输出以符号形式出现的具体消息。如果符号是确定的而且预先是知道的,那么该消息就无信息而言。只有当符号的出现是随机的,预先无法确定,一旦出现某个符合就给观察者提供了信息。因此应该用随机变量或随机矢量来表示信源,运用概率论和随机过程的理论来研究信息,这就是香农信息论的基本点。 2.1 信源的描述与分类 在通信系统中收信者在未收到消息以前对信源发出什么消息是不确定的,是随机的,所以可用随机变量、随机序列或随机过程来描述信源输出的消息,或者说用一个样本空间及其概率测度——概率空间来描述信源。 信源:产生随机变量、随机序列和随机过程的源。 信源的基本特性:具有随机不确定性。 信源的分类 离散信源:文字、数据、电报——随机序列 连续信源:话音、图像——随机过程 离散信源:输出在时间和幅度上都是离散分布的消息。

消息数是有限的或可数的,且每次只输出其中一个消息,即两两不相容。 发出单个符号的无记忆信源 离散无记忆信源: 发出符号序列的无记忆信源 离散信源 离散有记忆信源: 发出符号序列的有记忆信源 发出符号序列的马尔可夫信源 概率论基础: 无条件概率,条件概率和联合概率的性质和关系: (1) 非负性 0()()(/)(/)()1i j j i i j i j p x p y p y x p x y p x y ≤≤,,,, (2) 完备性 111 1 11 ()1,()1,(/)1, (/)1,()1 n m n i j i j i j i m m n j i i j j j i p x p y p x y p y x p x y ===========∑∑∑∑∑∑ 1 1 ()(),()()n m i j j i j i i j p x y p y p x y p x ====∑∑ (3) 联合概率 ()()(/)()(/)()()()(/)()(/)() i j i j i j i j i j i j j i j i j i p x y p x p y x p y p x y X Y p x y p x p y p y x p y p x y p x =====当与相互独立时,, (4) 贝叶斯公式 1 1 () () (/)(/)() () i j i j i j j i n m i j i j i j p x y p x y p x y p y x p x y p x y === = ∑∑, 2.1.1 无记忆信源: 例如扔骰子,每次试验结果必然是1~6点中的某一个面朝上。可以用一个离散型随机变量X 来描述这个信源输出的消息。