神经网络的简单比较和介绍

遗传算法

遗传算法的最大优点:

你不需要知道怎么去解决一个问题;你需要知道的仅仅是,用怎么的方式对可行解进行编码,使得它能能被遗传算法机制所利用。

神经网络

人工神经网络的分类:

1. 按结构方式:前馈网络(BP网络)和反馈网络(Hopfield网络)

2. 按状态方式:离散型网络和连续型网络

3. 按学习方式:监督学习网络(BP、RBF网络)和无监督学习网络(自组织网络)

人类大脑的特点:

1. 能实现无监督的学习。这一现象称为可塑性。

2. 对损伤有冗余性。

3. 处理信息的效率极高。

4. 善于归纳推广。

人工神经网络的发展:

BP算法就是误差反向传播法,有了这个算法就可以处理非线性的运算。

人工神经网络的实质

其实质就是网络输入和输出的一种关系。

通过选取不同的模型结构和激励函数,可以形成不同的神经网络,达到不同的设计目的。

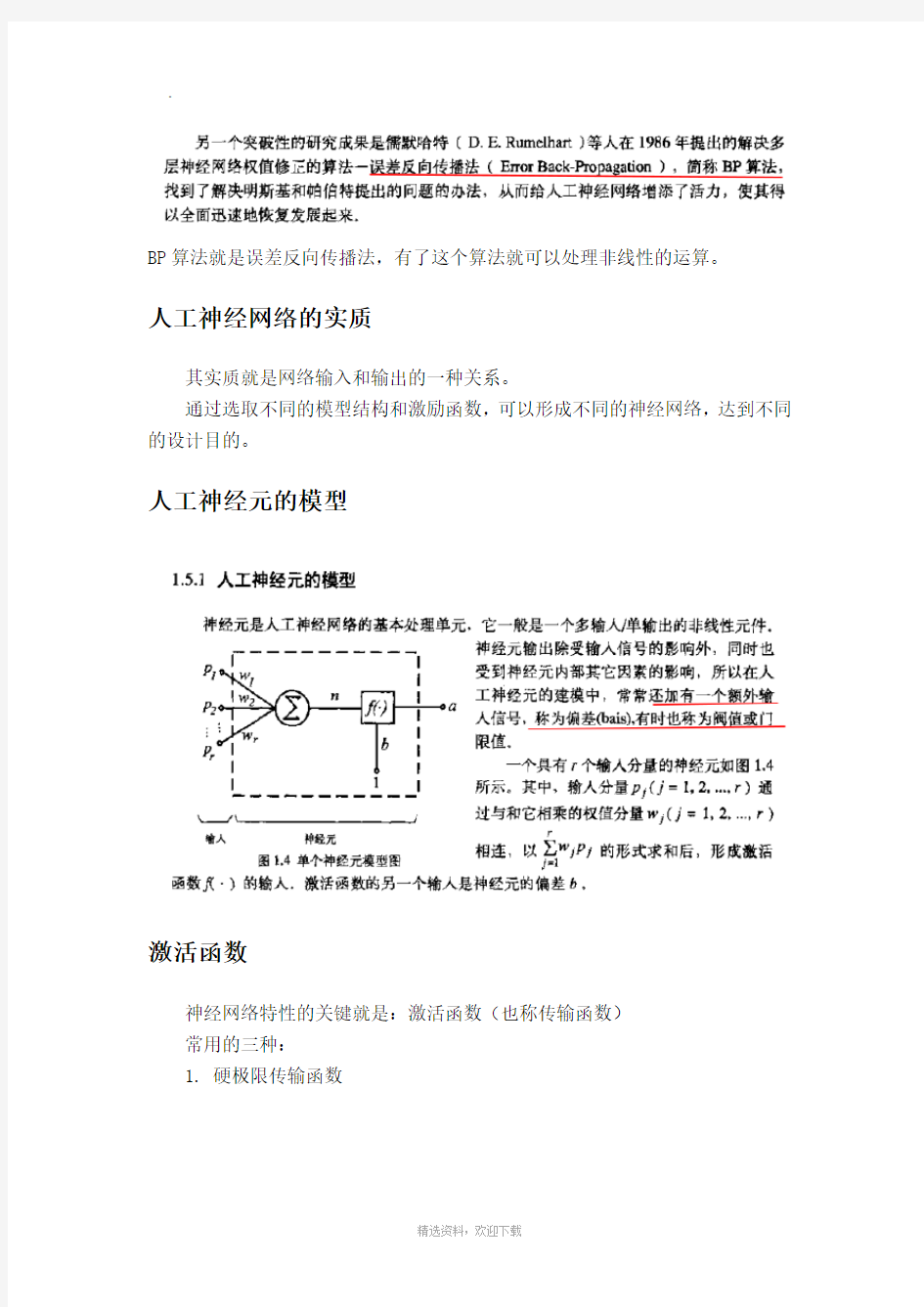

人工神经元的模型

激活函数

神经网络特性的关键就是:激活函数(也称传输函数)

常用的三种:

1. 硬极限传输函数

输出为0或1 Hardlim输出为0或1

Hardlims输出为-1或1

2. 线性传输函数

Purelin

饱和线性函数:satlin 范围为0~1,

3. 对数-S形传输函数

Logsig输出(0~1)

Tansig输出(-1~1)多层神经网络

多层神经网络设计时,隐含层的激活函数应该用非线性的,否则多层网络的计算能力并不比单层的强。

四层神经网络表示:一个输入层,两个隐含层和一个输出层。只有三个权值矩阵。

人工神经网络权值的确定不是通过计算,是通过网络的自身训练来完成的,这是神经网络在解决问题的方式上与其他方法的最大不同点。

三种网络:

1. 前馈网络(以感知机为代表)

2. 竞争网络(以hamming为代表)

3. 递归联想存储网络(以Hopfield为代表)

通过学习判别一个橘子和苹果的例子,明白了,感知机只有一个取值为-1或1代表橘子或苹果的输出;Hamming网络中也只有一个取值非0的神经元表示哪个输入的标准模式为最佳匹配。如果第一个神经元取非0,表示输入模式属于橘子类别,如果第二个神经元取非0表示输入的是苹果类别;在Hopfield网络中,标准模式本身将会出现在网络的输出上。

感知机输出的为二值,Hamming输出的非0来表示最佳的输入向量,Hopfield 输出标准的结果。

单层感知机

构造了一个线性判定边界对输入向量进行分类。所以处理的输入类别都是线性的,如果输入类别不能用线性边界划分,将会用到多层感知机。

感知机学习规则

学习规则就是修改神经网络的权值和偏置值的方法和过程。

大致有三类:

1.有监督学习

2.无监督学习

3.增强(分级)学习

1、神经网络优缺点

优点:

神经网络有很强的非线性拟合能力,可映射任意复杂的非线性关系,而且学习规则简单,便于计算机实现。具有很强的鲁棒性、记忆能力、非线性映射能力以及强大的自学习能力,因此有很大的应用市场。

缺点:

(1)最严重的问题是没能力来解释自己的推理过程和推理依据。

(2)不能向用户提出必要的询问,而且当数据不充分的时候,神经网络就无法进行工作。

(3)把一切问题的特征都变为数字,把一切推理都变为数值计算,其结果势必是丢失信息。

(4)理论和学习算法还有待于进一步完善和提高。

2、SVM的优缺点

优点:

(1)非线性映射是SVM方法的理论基础,SVM利用内积核函数代替向高维空间的非线性映射;

(2)对特征空间划分的最优超平面是SVM的目标,最大化分类边际的思想是SVM 方法的核心;

(3)支持向量是SVM的训练结果,在SVM分类决策中起决定作用的是支持向量.

(4)SVM 是一种有坚实理论基础的新颖的小样本学习方法.它基本上不涉及概率测度及大数定律等,因此不同于现有的统计方法.从本质上看,它避开了从归纳到演绎的传统过程,实现了高效的从训练样本到预报样本的“转导推理”,大大简化了通常的分类和回归等问题.

(5)SVM 的最终决策函数只由少数的支持向量所确定,计算的复杂性取决于支持向量的数目,而不是样本空间的维数,这在某种意义上避免了“维数灾难”. (6)少数支持向量决定了最终结果,这不但可以帮助我们抓住关键样本、“剔除”大量冗余样本,而且注定了该方法不但算法简单,而且具有较好的“鲁棒”性.这种“鲁棒”性主要体现在:

①增、删非支持向量样本对模型没有影响;

②支持向量样本集具有一定的鲁棒性;

③有些成功的应用中,SVM 方法对核的选取不敏感

缺点:

(1) SVM算法对大规模训练样本难以实施

由于SVM是借助二次规划来求解支持向量,而求解二次规划将涉及m阶矩阵的计算(m为样本的个数),当m数目很大时该矩阵的存储和计算将耗费大量的机器内存和运算时间.针对以上问题的主要改进有有J.Platt的SMO算法、T.Joachims 的SVM、C.J.C.Burges等的PCGC、张学工的CSVM以及O.L.Mangasarian等的SOR 算法

(2) 用SVM解决多分类问题存在困难

经典的支持向量机算法只给出了二类分类的算法,而在数据挖掘的实际应用中,一般要解决多类的分类问题.可以通过多个二类支持向量机的组合来解决.主要有一对多组合模式、一对一组合模式和SVM决策树;再就是通过构造多个分类器的组合来解决.主要原理是克服SVM固有的缺点,结合其他算法的优势,解决多类问题的分类精度.如:与粗集理论结合,形成一种优势互补的多类问题的组合分类器。

数学是有约束、有边界、有条件的,试图仅仅用数学描绘宇宙的想法与诗人无异!

最简单的神经网络算法

最简单的人工神经网络实现 人工神经网络算法是模拟人的神经网络的一种算法. 该算法像人一样,具有一定的学习能力。人工神经网络可以学会它所能表达的任何东西. 该算法在模拟人类抽象思维方面较传统的算法具有优势,如图像识别(人脸识别,车牌识别),声音识别方面已经有成熟的运用。 举个简单的例子可以说明人工神经网络和传统算法的差别所在(等会也要实现): 假设要解决这个问题: 写一个程序,判断0, 1, 2, 3 ... 9 这10个数的奇偶性 1. 如果是传统算法,则是模拟人的逻辑思维,对这个问题进行形式化和逻辑化: if (input 模 2 == 零) { input 是偶数 } else { input 是奇数 } 2. 如果是ANN算法,则要提供一组正确的数据对处理这个问题的神经网络ANN进行训练: 未进行训练的神经网络,就像刚出生的婴儿一样,什么都不懂。这个时候, 你要教他0 是偶数,1是奇数...., 教完之后问ANN懂了没有,懂了则停止训练(网络已经形成),不懂则继续训练. while (1) { 训练;

if (测试通过) { 跳出循环; } } 训练完之后,这个ANN以后便能够正确处理奇偶性判断的问题了. 处理上面这个问题,只需要模拟一个神经元即可,再复杂的问题,可能需要多个神经元,再再复杂,需要多层多神经元的配合来实现(以后再研究) 下面是实现: [cpp]view plaincopyprint? 1. /***************************************** 2. * 感知器判断数字奇偶性 3. * 4. * 关键点,阈值应该怎么定? 5. ****************************************/ 6. #include

外文翻译---神经网络概述

外文原文与译文 外文原文 Neural NetworkIntroduction 1.Objectives As you read these words you are using a complex biological neural network. You have a highly interconnected set of some 1011neurons to facilitate your reading, breathing, motion and thinking. Each of your biological neurons,a rich assembly of tissue and chemistry, has the complexity, if not the speed, of a microprocessor. Some of your neural structure was with you at birth. Other parts have been established by experience. Scientists have only just begun to understand how biological neural networks operate. It is generally understood that all biological neural functions, including memory, are stored in the neurons and in the connections between them. Learning is viewed as the establishment of new connections between neurons or the modification of existing connections. This leads to the following question: Although we have only a rudimentary understanding of biological neural networks, is it possible to construct a small set of simple artificial “neurons” and perhaps train them to serve a useful function? The answer is “yes.”This book, then, is about artificial neural networks. The neurons that we consider here are not biological. They are extremely simple abstractions of biological neurons, realized as elements in a program or perhaps as circuits made of silicon. Networks of these artificial neurons do not have a fraction of the power of the human brain, but they can be trained to perform useful functions. This book is about such neurons, the networks that contain them and their training. 2.History The history of artificial neural networks is filled with colorful, creative individuals from many different fields, many of whom struggled for decades to

BP神经网络测试例子(附数据)

Train.txt 5.0,3.0,1.6,0.2,1 5.0,3.4,1.6,0.4,1 5.2,3.5,1.5,0.2,1 5.2,3.4,1.4,0.2,1 4.7,3.2,1.6,0.2,1 4.8,3.1,1.6,0.2,1 5.4,3.4,1.5,0.4,1 5.2,4.1,1.5,0.1,1 5.5,4.2,1.4,0.2,1 4.9,3.1,1.5,0.1,1 5.0,3.2,1.2,0.2,1 5.5,3.5,1.3,0.2,1 4.9,3.1,1.5,0.1,1 4.4,3.0,1.3,0.2,1 5.1,3.4,1.5,0.2,1 5.0,3.5,1.3,0.3,1 4.5,2.3,1.3,0.3,1 4.4,3.2,1.3,0.2,1 5.0,3.5,1.6,0.6,1 5.1,3.8,1.9,0.4,1 4.8,3.0,1.4,0.3,1 5.1,3.8,1.6,0.2,1 4.6,3.2,1.4,0.2,1 5.3,3.7,1.5,0.2,1 5.0,3.3,1.4,0.2,1 6.6,3.0,4.4,1.4,2 6.8,2.8,4.8,1.4,2 6.7,3.0,5.0,1.7,2 6.0,2.9,4.5,1.5,2 5.7,2.6,3.5,1.0,2 5.5,2.4,3.8,1.1,2 5.5,2.4,3.7,1.0,2 5.8,2.7,3.9,1.2,2 6.0,2.7,5.1,1.6,2 5.4,3.0,4.5,1.5,2 6.0,3.4,4.5,1.6,2 6.7,3.1,4.7,1.5,2 6.3,2.3,4.4,1.3,2 5.6,3.0,4.1,1.3,2 5.5,2.5,4.0,1.3,2 5.5,2.6,4.4,1.2,2 6.1,3.0,4.6,1.4,2 5.8,2.6,4.0,1.2,2

Hopfield神经网络综述

题目:Hopfield神经网络综述 一、概述: 1.什么是人工神经网络(Artificial Neural Network,ANN) 人工神经网络是一个并行和分布式的信息处理网络结构,该网络结构一般由许多个神经元组成,每个神经元有一个单一的输出,它可以连接到很多其他的神经元,其输入有多个连接通路,每个连接通路对应一个连接权系数。 人工神经网络系统是以工程技术手段来模拟人脑神经元(包括细胞体,树突,轴突)网络的结构与特征的系统。利用人工神经元可以构成各种不同拓扑结构的神经网络,它是生物神经网络的一种模拟和近似。主要从两个方面进行模拟:一是结构和实现机理;二是从功能上加以模拟。 根据神经网络的主要连接型式而言,目前已有数十种不同的神经网络模型,其中前馈型网络和反馈型网络是两种典型的结构模型。 1)反馈神经网络(Recurrent Network) 反馈神经网络,又称自联想记忆网络,其目的是为了设计一个网络,储存一组平衡点,使得当给网络一组初始值时,网络通过自行运行而最终收敛到这个设计的平衡点上。反馈神经网络是一种将输出经过一步时移再接入到输入层的神经网络系统。 反馈网络能够表现出非线性动力学系统的动态特性。它所具有的主要特性为以下两点:(1).网络系统具有若干个稳定状态。当网络从某一初始状态开始运动,网络系统总可以收敛到某一个稳定的平衡状态; (2).系统稳定的平衡状态可以通过设计网络的权值而被存储到网络中。 反馈网络是一种动态网络,它需要工作一段时间才能达到稳定。该网络主要用于联想记忆和优化计算。在这种网络中,每个神经元同时将自身的输出信号作为输入信号反馈给其他神经元,它需要工作一段时间才能达到稳定。 2.Hopfiel d神经网络 Hopfield网络是神经网络发展历史上的一个重要的里程碑。由美国加州理工学院物理学家J.J.Hopfield 教授于1982年提出,是一种单层反馈神经网络。Hopfiel d神经网络是反馈网络中最简单且应用广泛的模型,它具有联想记忆的功能。 Hopfield神经网络模型是一种循环神经网络,从输出到输入有反馈连接。在输入的激励下,会产生不断的状态变化。 反馈网络有稳定的,也有不稳定的,如何判别其稳定性也是需要确定的。对于一个Hopfield 网络来说,关键是在于确定它在稳定条件下的权系数。 下图中,第0层是输入,不是神经元;第二层是神经元。

神经网络简介abstract( 英文的)

Abstract: Artificial Neural Network is a math model which is applied to process information of the structure which is similar to Brain synaptic connection in a distributed and parallel way. Artificial Neural Network is a computing model, and it contains of many neurons and the connection of the neurons. Every neuron represents a special output function which is called activation function. The connection of neurons represents a weighted value of the connection’s signal. Neuron is a basic and essential part of Artificial Neural Network, and it includes the sum of weighted value, single-input single-output (SISO) system and nonlinear function mapping. The element of neuron can represent different thing, such as feature, alphabet, conception and some meaningful abstract pattern. In the network, the style of neuron’s element divided into three categories: input element, output element and hidden element. The input element accepts the signal and data of outer world; the output element processes result output for system; the hidden element cannot find by outer world, it between input element and output element. The weighted value represents the strength of connection between neurons. Artificial Neural Network adopted the mechanisms that completely different from traditional artificial intelligence and information processing technology. It conquers the flaw of traditional artificial intelligence in Intuitive handling and unstructured information processing aspect. It is adaptive, self-organized and learning timely, and widely used in schematic identification signal processing.

神经网络一个简单实例

OpenCV的ml模块实现了人工神经网络(Artificial Neural Networks,ANN)最典型的多层感知器(multi-layer perceptrons, MLP)模型。由于ml模型实现的算法都继承自统一的CvStatModel基类,其训练和预测的接口都是train(),predict(),非常简单。 下面来看神经网络CvANN_MLP 的使用~ 定义神经网络及参数: [cpp]view plain copy 1.//Setup the BPNetwork 2. CvANN_MLP bp; 3.// Set up BPNetwork's parameters 4. CvANN_MLP_TrainParams params; 5. params.train_method=CvANN_MLP_TrainParams::BACKPROP; 6. params.bp_dw_scale=0.1; 7. params.bp_moment_scale=0.1; 8.//params.train_method=CvANN_MLP_TrainParams::RPROP; 9.//params.rp_dw0 = 0.1; 10.//params.rp_dw_plus = 1.2; 11.//params.rp_dw_minus = 0.5; 12.//params.rp_dw_min = FLT_EPSILON; 13.//params.rp_dw_max = 50.; 可以直接定义CvANN_MLP神经网络,并设置其参数。BACKPROP表示使用 back-propagation的训练方法,RPROP即最简单的propagation训练方法。 使用BACKPROP有两个相关参数:bp_dw_scale即bp_moment_scale: 使用PRPOP有四个相关参数:rp_dw0, rp_dw_plus, rp_dw_minus, rp_dw_min, rp_dw_max:

BP神经网络模型应用实例

BP神经网络模型 第1节基本原理简介 近年来全球性的神经网络研究热潮的再度兴起,不仅仅是因为神经科学本身取得了巨大的进展.更主要的原因在于发展新型计算机和人工智能新途径的迫切需要.迄今为止在需要人工智能解决的许多问题中,人脑远比计算机聪明的多,要开创具有智能的新一代计算机,就必须了解人脑,研究人脑神经网络系统信息处理的机制.另一方面,基于神经科学研究成果基础上发展出来的人工神经网络模型,反映了人脑功能的若干基本特性,开拓了神经网络用于计算机的新途径.它对传统的计算机结构和人工智能是一个有力的挑战,引起了各方面专家的极大关注. 目前,已发展了几十种神经网络,例如Hopficld模型,Feldmann等的连接型网络模型,Hinton等的玻尔茨曼机模型,以及Rumelhart等的多层感知机模型和Kohonen的自组织网络模型等等。在这众多神经网络模型中,应用最广泛的是多层感知机神经网络。多层感知机神经网络的研究始于50年代,但一直进展不大。直到1985年,Rumelhart等人提出了误差反向传递学习算法(即BP算),实现了Minsky的多层网络

设想,如图34-1所示。 BP 算法不仅有输入层节点、输出层节点,还可有1个或多个隐含层节点。对于输入信号,要先向前传播到隐含层节点,经作用函数后,再把隐节点的输出信号传播到输出节点,最后给出输出结果。节点的作用的激励函数通常选取S 型函数,如 Q x e x f /11)(-+= 式中Q 为调整激励函数形式的Sigmoid 参数。该算法的学习过程由正向传播和反向传播组成。在正向传播过程中,输入信息从输入层经隐含层逐层处理,并 传向输出层。每一层神经元的状态只影响下一层神经

人工智能-BP神经网络算法的简单实现

人工神经网络是一种模仿人脑结构及其功能的信息处理系统,能提高人们对信息处理的智能化水平。它是一门新兴的边缘和交叉学科,它在理论、模型、算法等方面比起以前有了较大的发展,但至今无根本性的突破,还有很多空白点需要努力探索和研究。 1 人工神经网络研究背景 神经网络的研究包括神经网络基本理论、网络学习算法、网络模型以及网络应用等方面。其中比较热门的一个课题就是神经网络学习算法的研究。 近年来己研究出许多与神经网络模型相对应的神经网络学习算法,这些算法大致可以分为三类:有监督学习、无监督学习和增强学习。在理论上和实际应用中都比较成熟的算法有以下三种: (1) 误差反向传播算法(Back Propagation,简称BP 算法); (2) 模拟退火算法; (3) 竞争学习算法。 目前为止,在训练多层前向神经网络的算法中,BP 算法是最有影响的算法之一。但这种算法存在不少缺点,诸如收敛速度比较慢,或者只求得了局部极小点等等。因此,近年来,国外许多专家对网络算法进行深入研究,提出了许多改进的方法。 主要有: (1) 增加动量法:在网络权值的调整公式中增加一动量项,该动量项对某一时刻的调整起阻尼作用。它可以在误差曲面出现骤然起伏时,减小振荡的趋势,提高网络训练速度; (2) 自适应调节学习率:在训练中自适应地改变学习率,使其该大时增大,该小时减小。使用动态学习率,从而加快算法的收敛速度; (3) 引入陡度因子:为了提高BP 算法的收敛速度,在权值调整进入误差曲面的平坦区时,引入陡度因子,设法压缩神经元的净输入,使权值调整脱离平坦区。 此外,很多国内的学者也做了不少有关网络算法改进方面的研究,并把改进的算法运用到实际中,取得了一定的成果: (1) 王晓敏等提出了一种基于改进的差分进化算法,利用差分进化算法的全局寻优能力,能够快速地得到BP 神经网络的权值,提高算法的速度; (2) 董国君等提出了一种基于随机退火机制的竞争层神经网络学习算法,该算法将竞争层神经网络的串行迭代模式改为随机优化模式,通过采用退火技术避免网络收敛到能量函数的局部极小点,从而得到全局最优值; (3) 赵青提出一种分层遗传算法与BP 算法相结合的前馈神经网络学习算法。将分层遗传算法引入到前馈神经网络权值和阈值的早期训练中,再用BP 算法对前期训练所得性能较优的网络权值、阈值进行二次训练得到最终结果,该混合学习算法能够较快地收敛到全局最优解;

Hopfield神经网络综述

题目: Hopfield神经网络综述 一、概述: 1.什么是人工神经网络(Artificial Neural Network,ANN) 人工神经网络是一个并行和分布式的信息处理网络结构,该网络结构一般由许多个神经元组成,每个神经元有一个单一的输出,它可以连接到很多其他的神经元,其输入有多个连接通路,每个连接通路对应一个连接权系数。 人工神经网络系统是以工程技术手段来模拟人脑神经元(包括细胞体,树突,轴突)网络的结构与特征的系统。利用人工神经元可以构成各种不同拓扑结构的神经网络,它是生物神经网络的一种模拟和近似。主要从两个方面进行模拟:一是结构和实现机理;二是从功能上加以模拟。 根据神经网络的主要连接型式而言,目前已有数十种不同的神经网络模型,其中前馈型网络和反馈型网络是两种典型的结构模型。 1)反馈神经网络(Recurrent Network) 反馈神经网络,又称自联想记忆网络,其目的是为了设计一个网络,储存一组平衡点,使得当给网络一组初始值时,网络通过自行运行而最终收敛到这个设计的平衡点上。反馈神经网络是一种将输出经过一步时移再接入到输入层的神经网络系统。 反馈网络能够表现出非线性动力学系统的动态特性。它所具有的主要特性为以下两点:(1).网络系统具有若干个稳定状态。当网络从某一初始状态开始运动,网络系统总可以收敛到某一个稳定的平衡状态; (2).系统稳定的平衡状态可以通过设计网络的权值而被存储到网络中。 反馈网络是一种动态网络,它需要工作一段时间才能达到稳定。该网络主要用于联想记忆和优化计算。在这种网络中,每个神经元同时将自身的输出信号作为输入信号反馈给其他神经元,它需要工作一段时间才能达到稳定。 2.Hopfield神经网络 Hopfield网络是神经网络发展历史上的一个重要的里程碑。由美国加州理工学院物理学家J.J.Hopfield 教授于1982年提出,是一种单层反馈神经网络。Hopfield神经网络是反馈网络中最简单且应用广泛的模型,它具有联想记忆的功能。 Hopfield神经网络模型是一种循环神经网络,从输出到输入有反馈连接。在输入的激励下,会产生不断的状态变化。 反馈网络有稳定的,也有不稳定的,如何判别其稳定性也是需要确定的。对于一个Hopfield 网络来说,关键是在于确定它在稳定条件下的权系数。 下图中,第0层是输入,不是神经元;第二层是神经元。

BP神经网络模型简介及相关优化案例

华东理工大学 2016-2017学年第2学期 研究生《石油化工单元数学模型》课程论文2017年6月 开课学院:化工学院任课教师:欧阳福生 考生姓名:丁桂宾学号:Y45160205 成绩:

BP 神经网络模型简介及相关优化案例 一、神经网络模型简介 现代神经生理学和神经解剖学的研究结果表明,人脑是极其复杂的,由约1010个神经元交织在一起,构成一个网状结构。它能完成诸如智能、思维、情绪等高级精神活动,被认为是最复杂、最完美、最有效的一种信息处理系统。人工神经网络(Artificial Neural Networks ,以下简写为 NN )是指模拟人脑神经系统的结构和功能,运用大量的处理部件,通过数学方法,由人工方式构造的网络系统[1] 。 图1表示作为 NN 基本单元的神经元模型,它有三个基本要素[2]: (1) 一组连接权(对应于生物神经元的突触),连接强度由各连接上的权值表示,权值为正表示激励,为负表示抑制。 (2) 一个求和单元,用于求取各输入信息的加权和(线性组合)。 (3) 一个非线性激励函数,起非线性映射作用并限制神经元输出幅度在一定的范围内(一般限制在[0,1]或[?1,+1]之间)。 图1 神经元模型 此外还有一个阈值k θ(或偏置 k k b θ-=)。以上作用可以用数学式表达为: ∑= =P j kj k j x w u ;

k k k u θν-=; ) (k k v y ?= 式中 P x x x x ,...,,,321为输入信号, kP k k k w w w w ,...,,,321为神经元k 的权值, k u 为 线性组合结果, k θ为阈值。(.)?为激励函数,k y 为神经元k 的输出。 神经网络理论突破了传统的、串行处理的数字电子计算机的局限,是一个非线性动力学系统,并以分布式存储和并行协同处理为特色,虽然单个神经元的结构和功能极其简单有限,但是大量的神经元构成的网络系统所实现的行为却是极其丰富多彩的。

BP神经网络matlab实例

神经网络Matlab p=p1';t=t1'; [pn,minp,maxp,tn,mint,maxt]=premnmx(p,t); %原始数据归一化net=newff(minmax(pn),[5,1],{'tansig','purelin'},'traingdx');%设置网络,建立相应的BP网络 net.trainParam.show=2000; % 训练网络 net.trainParam.lr=0.01; net.trainParam.epochs=100000; net.trainParam.goal=1e-5; [net,tr]=train(net ,pn,tn); %调用TRAINGDM算法训练BP网络 pnew=pnew1'; pnewn=tramnmx(pnew,minp,maxp); anewn=sim(net,pnewn); %对BP网络进行仿真 anew=postmnmx(anewn,mint,maxt); %还原数据 y=anew'; 1、BP网络构建 (1)生成BP网络 = net newff PR S S SNl TF TF TFNl BTF BLF PF (,[1 2...],{ 1 2...},,,) R?维矩阵。 PR:由R维的输入样本最小最大值构成的2

S S SNl:各层的神经元个数。 [1 2...] TF TF TFNl:各层的神经元传递函数。 { 1 2...} BTF:训练用函数的名称。 (2)网络训练 = [,,,,,] (,,,,,,) net tr Y E Pf Af train net P T Pi Ai VV TV (3)网络仿真 = [,,,,] (,,,,) Y Pf Af E perf sim net P Pi Ai T {'tansig','purelin'},'trainrp' BP网络的训练函数 训练方法训练函数 梯度下降法traingd 有动量的梯度下降法traingdm 自适应lr梯度下降法traingda 自适应lr动量梯度下降法traingdx 弹性梯度下降法trainrp Fletcher-Reeves共轭梯度法traincgf Ploak-Ribiere共轭梯度法traincgp Powell-Beale共轭梯度法traincgb 量化共轭梯度法trainscg 拟牛顿算法trainbfg 一步正割算法trainoss Levenberg-Marquardt trainlm

一种快速神经网络路径规划算法概要

文章编号 2 2 2 一种快速神经网络路径规划算法α 禹建丽? ∏ √ 孙增圻成久洋之 洛阳工学院应用数学系日本冈山理科大学工学部电子工学科 2 清华大学计算机系国家智能技术与系统重点实验室日本冈山理科大学工学部信息工学科 2 摘要本文研究已知障碍物形状和位置环境下的全局路径规划问题给出了一个路径规划算法其能量函数 利用神经网络结构定义根据路径点位于障碍物内外的不同位置选取不同的动态运动方程并针对障碍物的形状设 定各条边的模拟退火初始温度仿真研究表明本文提出的算法计算简单收敛速度快能够避免某些局部极值情 况规划的无碰路径达到了最短无碰路径 关键词全局路径规划能量函数神经网络模拟退火 中图分类号 ×°文献标识码 ΦΑΣΤΑΛΓΟΡΙΤΗΜΦΟΡΠΑΤΗΠΛΑΝΝΙΝΓ ΒΑΣΕΔΟΝΝΕΥΡΑΛΝΕΤ? ΟΡΚ ≠ 2 ? ? ≥ 2 ≥ ∏ ΔεπαρτμεντοφΜατηεματιχσ ΛυοψανγΙνστιτυτεοφΤεχηνολογψ Λυοψανγ

ΔεπαρτμεντοφΕλεχτρονιχΕνγινεερινγ ΦαχυλτψοφΕνγινεερινγ ΟκαψαμαΥνι?ερσιτψοφΣχιενχε 2 Ριδαι2χηο 2 ?απαν ΔεπαρτμεντοφΧομπυτερΣχιενχε Τεχηνολογψ ΣτατεΚεψΛαβοφΙντελλιγεντΤεχηνολογψ Σψστεμσ ΤσινγηυαΥνι?ερσιτψ Βει?ινγ ΔεπαρτμεντοφΙνφορματιον ΧομπυτερΕνγινεερινγ ΦαχυλτψοφΕνγινεερινγ ΟκαψαμαΥνι?ερσιτψοφΣχιενχε 2 Ριδαι2χηο 2 ?απαν Αβστραχτ ∏ √ √ √ × ∏ ∏ ∏ ∏ ∏ ∏ 2 ∏ √ × ∏ ∏ ∏ ∏ √ ∏ Κεψωορδσ ∏ ∏ ∏ 1引言Ιντροδυχτιον 机器人路径规划问题可以分为两种一种是基于环境先验完全信息的全局路径规划≈ 另一种是基于传感器信息的局部路径规划≈ ?后者环境是未知或者部分未知的全局路径规划已提出的典型方法有可视图法 ! 图搜索法≈ ! 人工势场法等可视图法的优点是可以求得最短路径但缺乏灵活性并且存在组合爆炸问题图搜索法比较灵活机器人的起始点和目标点的改变不会造成连通图的重新构造但不是任何时候都可以获得最短路径可视图法和图搜索法适用于多边形障碍物的避障路径规划问题但不适用解决圆形障碍物的避障路径规划问题人工势场法的基本思想是通过寻找路径点的能量函数的极小值点而使路径避开障碍物但存在局部极小值问题且不适于寻求最短路径≈ 文献≈ 给出的神经网络路径规划算法我们称为原算法引入网络结构和模拟退火等方法计算简单能避免某些局部极值情况且具有并行性及易于从二维空间推广到三维空间等优点对人工势场法给予了较大的改进但在此算法中由于路径点的总能量函数是由碰撞罚函数和距离函数两部分的和构成的而路径点 第卷第期年月机器人ΡΟΒΟΤ? α收稿日期

神经网络基本概念

二.神经网络控制 §2.1 神经网络基本概念 一. 生物神经元模型:<1>P7 生物神经元,也称作神经细胞,是构成神经系统的基本功能单元。虽然神经元的形态有极大差异,但基本结构相似。本目从信息处理和生物控制的角度,简述其结构和功能。 1.神经元结构 神经元结构如图2-1所示 图2-1

1) 细胞体:由细胞核、细胞质和细胞膜等组成。 2) 树突:胞体上短而多分支的突起,相当于神经元的输入端,接收传入的神经冲 动。 3) 轴突:胞体上最长枝的突起,也称神经纤维。端部有很多神经末梢,传出神经 冲动。 4) 突触:是神经元之间的连接接口,每一个神经元约有104~106 个突触,前一个 神经元的轴突末梢称为突触的前膜,而后一个神经元的树突称为突触的后膜。一个神经元通过其轴突的神经末梢经突触,与另一个神经元的树突连接,以实现信息传递。由于突触的信息传递是特性可变的,随着神经冲动传递方式的变化,传递作用强弱不同,形成了神经元之间连接的柔性,称为结构的可塑性。 5) 细胞膜电位:神经细胞在受到电的、化学的、机械的刺激后能产生兴奋,此时细胞膜内外由电位差,称为膜电位。其电位膜内为正,膜外为负。 2. 神经元功能 1) 兴奋与抑制:传入神经元的冲动经整和后使细胞膜电位提高,超过动作电 位的阈值时即为兴奋状态,产生神经冲动,由轴突经神经末梢传出。传入神经元的冲动经整和后使细胞膜电位降低,低于阈值时即为抑制状态,不产生神经冲动。 2) 学习与遗忘:由于神经元结构的可塑性,突触的传递作用可增强与减弱, 因此神经元具有学习与遗忘的功能。 二.人工神经元模型 ,<2>P96 人工神经元是对生物神经元的一种模拟与简化。它是神经网络的基本处理单元。图2-2显示了一种简化的人工神经元结构。它是一个多输入单输出的非线形元件。 图2-2 其输入、输出的关系可描述为 =-= n j i j ji i Q X W I 1 2-1 )I (f y i i = 其中i X (j=1、2、……、n)是从其他神经元传来的输入信号;

神经网络应用实例

神经网络 在石灰窑炉的建模与控制中的应用神经网络应用广泛,尤其在系统建模与控制方面,都有很好应用。下面简要介绍神经网络在石灰窑炉的建模与控制中的应用,以便更具体地了解神经网络在实际应用中的具体问题和应用效果。 1 石灰窑炉的生产过程和数学模型 石灰窑炉是造纸厂中一个回收设备,它可以使生产过程中所用的化工原料循环使用,从而降低生产成本并减少环境污染。其工作原理和过程如图1所示,它是一个长长的金属圆柱体,其轴线和水平面稍稍倾斜,并能绕轴线旋转,所以又 CaCO(碳酸钙)泥桨由左端输入迴转窑,称为迴转窑。含有大约30%水分的 3 由于窑的坡度和旋转作用,泥桨在炉内从左向右慢慢下滑。而燃料油和空气由右端喷入燃烧,形成气流由右向左流动,以使泥桨干燥、加热并发生分解反应。迴转窑从左到右可分为干燥段、加热段、煅烧段和泠却段。最终生成的石灰由右端输出,而废气由左端排出。 图1石灰窑炉示意图 这是一个连续的生产过程,原料和燃料不断输入,而产品和废气不断输出。在生产过程中首先要保证产品质量,包括CaO的含量、粒度和多孔性等指标,因此必须使炉内有合适的温度分布,温度太低碳酸钙不能完全分解,会残留在产品中,温度过高又会造成生灰的多孔性能不好,费燃料又易损坏窑壁。但是在生产过程中原料成分、含水量、进料速度、燃油成分和炉窑转速等生产条件经常会发生变化,而且有些量和变化是无法实时量测的。在这种条件下,要做到稳定生产、高质量、低消耗和低污染,对自动控制提出了很高的要求。 以前曾有人分析窑炉内发生的物理-化学变化,并根据传热和传质过程来建立窑炉的数学模型,认为窑炉是一个分布参数的非线性动态系统,可以用二组偏

深度神经网络全面概述

深度神经网络全面概述从基本概念到实际模型和硬件基础 深度神经网络(DNN)所代表的人工智能技术被认为是这一次技术变革的基石(之一)。近日,由IEEE Fellow Joel Emer 领导的一个团队发布了一篇题为《深度神经网络的有效处理:教程和调研(Efficient Processing of Deep Neural Networks: A Tutorial and Survey)》的综述论文,从算法、模型、硬件和架构等多个角度对深度神经网络进行了较为全面的梳理和总结。鉴于该论文的篇幅较长,机器之心在此文中提炼了原论文的主干和部分重要内容。 目前,包括计算机视觉、语音识别和机器人在内的诸多人工智能应用已广泛使用了深度神经网络(deep neural networks,DNN)。DNN 在很多人工智能任务之中表现出了当前最佳的准确度,但同时也存在着计算复杂度高的问题。因此,那些能帮助DNN 高效处理并提升效率和吞吐量,同时又无损于表现准确度或不会增加硬件成本的技术是在人工智能系统之中广泛部署DNN 的关键。 本文旨在提供一个关于实现DNN 的有效处理(efficient processing)的目标的最新进展的全面性教程和调查。特别地,本文还给出了一个DNN 综述——讨论了支持DNN 的多种平台和架构,并强调了最新的有效处理的技术的关键趋势,这些技术或者只是通过改善硬件设计或者同时改善硬件设计和网络算法以降低DNN 计算成本。本文也会对帮助研究者和从业者快速上手DNN 设计的开发资源做一个总结,并凸显重要的基准指标和设计考量以评估数量快速增长的DNN 硬件设计,还包括学界和产业界共同推荐的算法联合设计。 读者将从本文中了解到以下概念:理解DNN 的关键设计考量;通过基准和对比指标评估不同的DNN 硬件实现;理解不同架构和平台之间的权衡;评估不同DNN 有效处理技术的设计有效性;理解最新的实现趋势和机遇。 一、导语 深度神经网络(DNN)目前是许多人工智能应用的基础[1]。由于DNN 在语音识别[2] 和图像识别[3] 上的突破性应用,使用DNN 的应用量有了爆炸性的增长。这些DNN 被部署到了从自动驾驶汽车[4]、癌症检测[5] 到复杂游戏[6] 等各种应用中。在这许多领域中,DNN 能够超越人类的准确率。而DNN 的出众表现源于它能使用统计学习方法从原始感官数据中提取高层特征,在大量的数据中获得输入空间的有效表征。这与之前使用手动提取特征或专家设计规则的方法不同。 然而DNN 获得出众准确率的代价是高计算复杂性成本。虽然通用计算引擎(尤其是GPU),已经成为许多DNN 处理的砥柱,但提供对DNN 计算更专门化的加速方法也越来越热门。本文的目标是提供对DNN、理解DNN 行为的各种工具、有效加速计算的各项技术的概述。 该论文的结构如下: ?Section II 给出了DNN 为什么很重要的背景、历史和应用。 ?Section III 给出了DNN 基础组件的概述,还有目前流行使用的DNN 模型。 ?Section IV 描述了DNN 研发所能用到的各种资源。 ?Section V 描述了处理DNN 用到的各种硬件平台,以及在不影响准确率的情况下改进吞吐量(thoughtput)和能量的各种优化方法(即产生bit-wise identical 结果)。 ?Section VI 讨论了混合信号回路和新的存储技术如何被用于近数据处理(near-data processing),从而解决DNN 中数据流通时面临的吞吐量和能量消耗难题。 ?Section VII 描述了各种用来改进DNN 吞吐量和能耗的联合算法和硬件优化,同时最小化对准确率的影响。 ?Section VIII 描述了对比DNN 设计时应该考虑的关键标准。 二、深度神经网络(DNN)的背景

BP神经网络的Matlab语法要点

1. 数据预处理 在训练神经网络前一般需要对数据进行预处理,一种重要的预处理手段是归一化处理。下面简要介绍归一化处理的原理与方法。 (1) 什么是归一化? 数据归一化,就是将数据映射到[0,1]或[-1,1]区间或更小的区间,比如 (0.1,0.9) 。 (2) 为什么要归一化处理? <1>输入数据的单位不一样,有些数据的范围可能特别大,导致的结果是神经网络收敛慢、训练时间长。 <2>数据范围大的输入在模式分类中的作用可能会偏大,而数据范围小的输入作用就可能会偏小。 <3>由于神经网络输出层的激活函数的值域是有限制的,因此需要将网络训练的目标数据映射到激活函数的值域。例如神经网络的输出层若采用S形激活函数,由于S形函数的值域限制在(0,1),也就是说神经网络的输出只能限制在(0,1),所以训练数据的输出就要归一化到[0,1]区间。 <4>S形激活函数在(0,1)区间以外区域很平缓,区分度太小。例如S形函数f(X)在参数a=1时,f(100)与f(5)只相差0.0067。 (3) 归一化算法 一种简单而快速的归一化算法是线性转换算法。线性转换算法常见有两种形式: <1> y = ( x - min )/( max - min ) 其中min为x的最小值,max为x的最大值,输入向量为x,归一化后的输出向量为y 。上式将数据归一化到[ 0 , 1 ]区间,当激活函数采用S形函数时(值域为(0,1))时这条式子适用。 <2> y = 2 * ( x - min ) / ( max - min ) - 1 这条公式将数据归一化到[ -1 , 1 ] 区间。当激活函数采用双极S形函数(值域为(-1,1))时这条式子适用。 (4) Matlab数据归一化处理函数 Matlab中归一化处理数据可以采用premnmx ,postmnmx ,tramnmx 这3个函数。 <1> premnmx 语法:[pn,minp,maxp,tn,mint,maxt] = premnmx(p,t) 参数: pn:p矩阵按行归一化后的矩阵 minp,maxp:p矩阵每一行的最小值,最大值

神经网络模型应用实例

BP 神经网络模型 近年来全球性的神经网络研究热潮的再度兴起,不仅仅是因为神经科学本身取得了巨大的进展.更主要的原因在于发展新型计算机和人工智能新途径的迫切需要.迄今为止在需要人工智能解决的许多问题中,人脑远比计算机聪明的多,要开创具有智能的新一代计算机,就必须了解人脑,研究人脑神经网络系统信息处理的机制.另一方面,基于神经科学研究成果基础上发展出来的人工神经网络模型,反映了人脑功能的若干基本特性,开拓了神经网络用于计算机的新途径.它对传统的计算机结构和人工智能是一个有力的挑战,引起了各方面专家的极大关注. 目前,已发展了几十种神经网络,例如Hopficld 模型,Feldmann 等的连接型网络模型,Hinton 等的玻尔茨曼机模型,以及Rumelhart 等的多层感知机模型和Kohonen 的自组织网络模型等等。在这众多神经网络模型中,应用最广泛的是多层感知机神经网络。多层感知机神经网络的研究始于50年代,但一直进展不大。直到1985年,Rumelhart 等人提出了误差反向传递学习算法(即BP 算),实现了Minsky 的多层网络设想,如图34-1所示。 BP 算法不仅有输入层节点、输出层节点,还可有1个或多个隐含层节点。对于输入信号,要先向前传播到隐含层节点,经作用函数后,再把隐节点的输出信号传播到输出节点,最后给出输出结果。节点的作用的激励函数通常选取S 型函数,如 Q x e x f /11 )(-+= 式中Q 为调整激励函数形式的Sigmoid 参数。该算法的学习过程由正向传播和反向传播组成。在正向传播过程中,输入信息从输入层经隐含层逐层处理,并传向输出层。每一层神经元的状态只影响下一层神经元的状态。如果输出层得不到期望的输出,则转入反向传播,将误差信号沿原来的连接通道返回,通过修改各层神经元的权值,使得误差信号最小。 社含有n 个节点的任意网络,各节点之特性为Sigmoid 型。为简便起见,指定网络只有一个输出y ,任一节点i 的输出为O i ,并设有N 个样本(x k ,y k )(k =1,2,3,…,N ),对某一输入x k ,网络输出为y k 节点i 的输出为O ik ,节点j 的输入为net jk = ∑i ik ij O W 并将误差函数定义为∑=-=N k k k y y E 12 )(21