如何批量提取网页图片

https://www.360docs.net/doc/a212056623.html,

如何批量提取网页图片

很多人需要在网页上收集大量的图片,一个个下载费事费力。今天教给大家一个批量提取网页图片的方法,供大家提高工作效率。

采集网站:

https://www.360docs.net/doc/a212056623.html,/search/index?tn=baiduimage&ipn=r&ct=201326592&cl=2&lm=-1&st=-1&fm=result&fr= &sf=1&fmq=1511164186444_R&pv=&ic=0&nc=1&z=&se=1&showtab=0&fb=0&width=&height=&face=0&isty pe=2&ie=utf-8&hs=2&word=%E5%A4%8F%E7%9B%AE%E5%8F%8B%E4%BA%BA%E5%B8%90

使用功能点:

●?Ajax下拉滚动

/tutorialdetail-1/ajgd_7.html

●?分页列表信息采集

/tutorialdetail-1/fylb-70.html

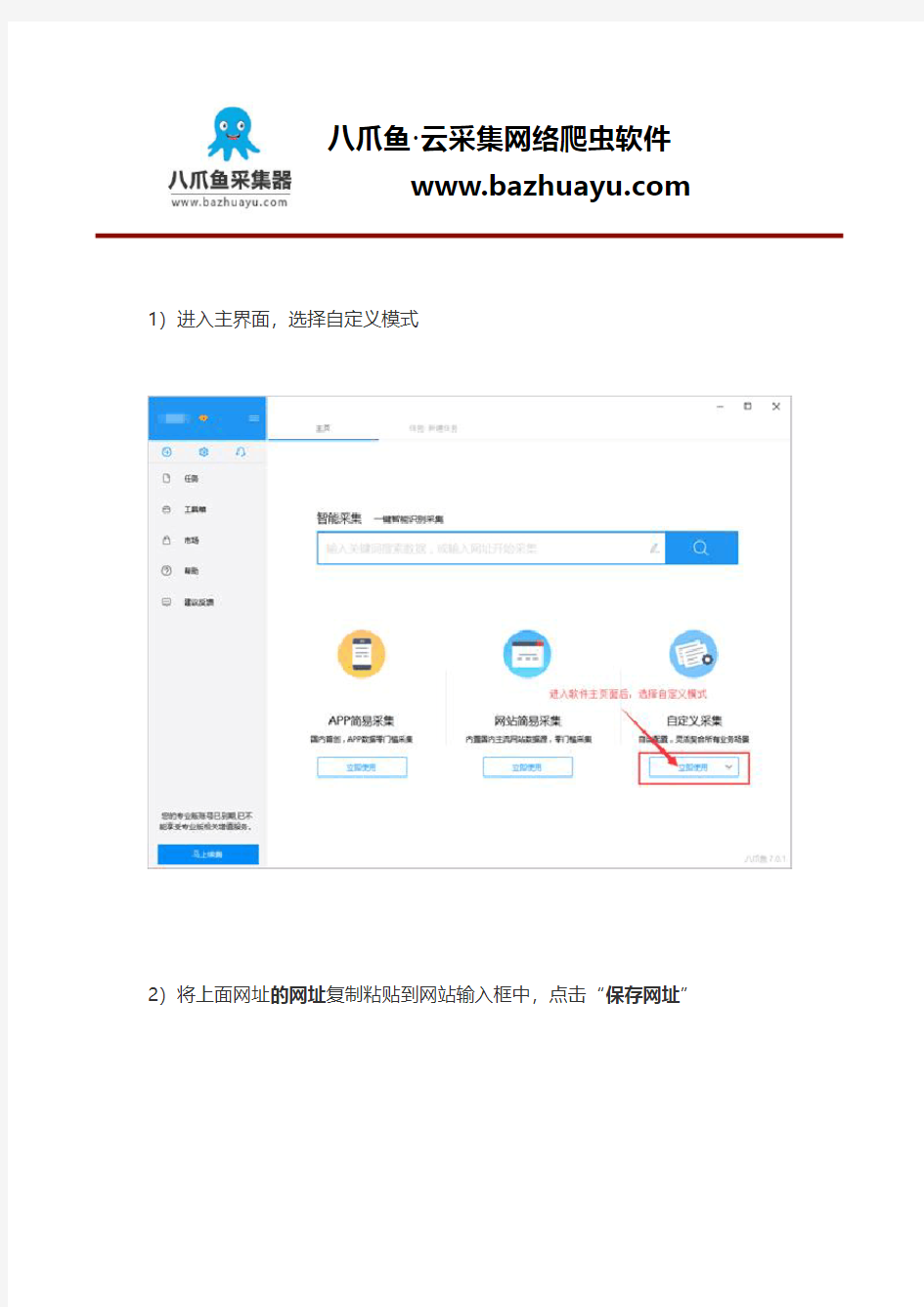

步骤1:创建采集任务

https://www.360docs.net/doc/a212056623.html, 1)进入主界面,选择自定义模式

2)将上面网址的网址复制粘贴到网站输入框中,点击“保存网址”

https://www.360docs.net/doc/a212056623.html,

3)系统自动打开网页。我们发现,百度图片网是瀑布流的网页,经过每一次下拉加载,都会出现新的数据。当图片足够多的时候,可无数次下拉加载。因而,此网页涉及AJAX技术,需要设置AJAX 超时,以便确保数据采集的时候不会遗漏。

https://www.360docs.net/doc/a212056623.html,

选中“打开网页”步骤,打开“高级选项”,勾选“页面加载完成向下滚动”,设置滚动次数为“5次”(根据自身需求进行设置),时间为“2秒”,滚动方式为“向下滚动一屏”;最后点击“确定”

注意:示例网站,没有翻页按钮,滚动次数、滚动方式会影响数据采集数量,可按需设置

步骤2:采集图片URL

https://www.360docs.net/doc/a212056623.html,

1)选中页面内第一个图片,系统会自动识别同类图片。在操作提示框中,选择“选中全部”

2)选择“采集以下图片地址”

https://www.360docs.net/doc/a212056623.html,

步骤3:修改Xpath

1)选中“循环”步骤,打开“高级选项”。可以看到八爪鱼系统自动采用的是“不固定元素列表”循环,Xpath为://DIV[@id='imgid']/DIV[1]/UL[1]/LI

https://www.360docs.net/doc/a212056623.html,

2)将此条Xpath://DIV[@id='imgid']/DIV[1]/UL[1]/LI,复制到火狐浏览器中进行观察——仅可定位到网页中22张图片

https://www.360docs.net/doc/a212056623.html,

3)我们需要一条能够定位到网页中全部所需图片的Xpath。观察网页源码并将Xpath修改为://DIV[@id='imgid']/DIV/UL[1]/LI,网页中全部所需的图片均被定位了

https://www.360docs.net/doc/a212056623.html,

4)将修改后的Xpath://DIV[@id='imgid']/DIV/UL[1]/LI,复制粘贴到八爪鱼中相应位置,完成后点击“确定”

https://www.360docs.net/doc/a212056623.html,

5)点击“保存”,再点击“开始采集”,这里选择“启动本地采集”

https://www.360docs.net/doc/a212056623.html,

说明:本地采集占用当前电脑资源进行采集,如果存在采集时间要求或当前电脑无法长时间进行采集可以使用云采集功能,云采集在网络中进行采集,无需当前电脑支持,电脑可以关机,可以设置多个云节点分摊任务,10个节点相当于10台电脑分配任务帮你采集,速度降低为原来的十分之一;采集到的数据可以在云上保存三个月,可以随时进行导出操作。

步骤4:数据采集及导出

1)采集完成后,会跳出提示,选择导出数据

https://www.360docs.net/doc/a212056623.html,

2)选择合适的导出方式,将采集好的数据导出

https://www.360docs.net/doc/a212056623.html,

步骤5:将图片URL批量转换为图片

经过如上操作,我们已经得到了要采集的图片的URL。接下来,再通过八爪鱼专用的图片批量下载工具,将采集到的图片URL中的图片,下载并保存到本地电脑中。

图片批量下载工具:https://https://www.360docs.net/doc/a212056623.html,/s/1c2n60NI

1)下载八爪鱼图片批量下载工具,双击文件中的MyDownloader.app.exe文件,打开软件

https://www.360docs.net/doc/a212056623.html, 2)打开File菜单,选择从EXCEL导入(目前只支持EXCEL格式文件)

https://www.360docs.net/doc/a212056623.html,

3)进行相关设置,设置完成后,点击OK即可导入文件

选择EXCEL文件:导入你需要下载图片地址的EXCEL文件

EXCEL表名:对应数据表的名称

文件URL列名:表内对应URL的列名称

保存文件夹名:EXCEL中需要单独一个列,列出图片想要保存到文件夹的路径,可以设置不同图片存放至不同文件夹

如果要把文件保存到文件夹,则路径需要以“\”结尾,例如:“D:\同步\”,如果要下载后按照指定的文件名保存,则需要包含具体的文件名,例如“D:\同步\1.jpg”

如果下载的文件路径和文件名完全一样,则原先存在的文件会被删除

https://www.360docs.net/doc/a212056623.html,

相关采集教程:

网站图片采集

https://www.360docs.net/doc/a212056623.html,/tutorial/hottutorial/qita/tupian

豆瓣图片采集并下载保存本地的方法

https://www.360docs.net/doc/a212056623.html,/tutorial/tpcj-7

ebay爬虫抓取图片

https://www.360docs.net/doc/a212056623.html,/tutorial/ebaypicpc

https://www.360docs.net/doc/a212056623.html,

微博图片采集

https://www.360docs.net/doc/a212056623.html,/tutorial/wbpiccj

阿里巴巴图片抓取下载

https://www.360docs.net/doc/a212056623.html,/tutorial/alibabapiccj

网站图片采集方法

https://www.360docs.net/doc/a212056623.html,/tutorial/webpiccj

京东商品图片采集详细教程

https://www.360docs.net/doc/a212056623.html,/tutorial/jdpiccj

淘宝买家秀图片采集详细教程

https://www.360docs.net/doc/a212056623.html,/tutorial/tbmjxpic

八爪鱼——90万用户选择的网页数据采集器。

1、操作简单,任何人都可以用:无需技术背景,会上网就能采集。完全可视化流程,点击鼠标完成操作,2分钟即可快速入门。

2、功能强大,任何网站都可以采:对于点击、登陆、翻页、识别验证码、瀑布流、Ajax脚本异步加载数据的网页,均可经过简单设置进行采集。

https://www.360docs.net/doc/a212056623.html,

3、云采集,关机也可以。配置好采集任务后可关机,任务可在云端执行。庞大云采集集群24*7不间断运行,不用担心IP被封,网络中断。

4、功能免费+增值服务,可按需选择。免费版具备所有功能,能够满足用户的基本采集需求。同时设置了一些增值服务(如私有云),满足高端付费企业用户的需要。

教你如何提取网页中的视频、音乐歌曲、

教你如何提取网页中的视频、音乐歌曲、flash、图片等多媒体文件(很实用) 打开网页后,发现里面有好看的视频、好听的音乐、好看的图片、很炫的flash,是不是想把它们弄到自己电脑上或手机、mp4上?但很多时候视频无法下载,音乐只能试听,或者好听的背景音乐根本就不知道什么名字,更别说怎么下了;至于图片直接右键另存为即可,不过如果网页突然关掉了,但又想把看过的图片弄下来,而忘了图片网页地址或者不想再通过历史记录打开,这时又该怎么办? 其实这些问题都能很好的解决,并且很简单,只要用一个软件 来替你从电脑的缓存中搜索一下就OK了,因为网页中显示的内容基本 上全部都在缓存中,如果自己手动搜索,那将是很累人滴,又不好找,东西太多,又没分类。 无意中发现一个小软件很强(对此感兴趣,本人玩过无数小软件),我一直在用,也是用它帮了很多网友的忙,为了让更多的网友解决问题,于是拿来和亲们分享一下。不废话了,下面进入主题: 这款免费小软件就是YuanBox(元宝箱)v1.6,百度一搜就能下载。 下面是我自己整理的使用步骤,供亲们参考(其实不用看就行,软件简单,不用学就会),我只是用的时间长了,很熟练罢了: 软件下好后,解压,打开里面的YuanBox.exe即可,不用安装;打开此软件前,先打开你要提取东西的网页(之后再关掉也行),这是为了保证电脑缓存中有你要的东西。 运行软件,初始界面如下图:

之后直接是flv格式视频搜索结果的界面,原因就是此软件的全称是 元宝箱FLV视频下载专家,不想要视频的话,点击最上面的设置或者最下面的高级设置,即可进行搜索范围设定

下面是搜索条件设定界面 以swf格式flash为例,进行搜索,选择类型中的第二项 点击确定,开始搜索,结果如下:

淘宝图片抓取工具使用方法

https://www.360docs.net/doc/a212056623.html, 淘宝图片抓取工具使用方法 对于电商设计师来说,抓取竞品的宝贝的图片和店铺装修图片,来分析设计自己店铺的风格并做出差异化,是非常有用的方法哦。 本文向大家介绍一款网络数据采集工具【八爪鱼数据采集器】,以【淘宝图片】为例,教大家如何使用八爪鱼采集软件采集淘宝图片的方法。 本文介绍使用八爪鱼7.0采集淘宝商品图片的方法:首先将淘宝商品搜索结果网页中图片的URL采集下来,再通过八爪鱼专用的图片批量下载工具,将采集到的淘宝商品图片URL,下载并保存到本地电脑中。 采集网址:淘宝商品搜索页面 比如T恤(可更换其他关键词对淘宝商品图片进行采集): https://https://www.360docs.net/doc/a212056623.html,/search?q=T%E6%81%A4&imgfile=&commend=all &search_type=item&sourceId=tb.index&spm=a21bo.2017.201856-taob ao-item.1&ie=utf8&initiative_id=tbindexz_20170306 采集数据内容:淘宝商品图片地址

https://www.360docs.net/doc/a212056623.html, 使用功能点: ●翻页设置 ●图片链接采集 步骤1:创建淘宝商品图片采集任务1)进入八爪鱼采集器主界面,选择自定义模式 淘宝商品图片采集步骤1

https://www.360docs.net/doc/a212056623.html, 2)将上面网址的网址复制粘贴到网站输入框中,点击“保存网址” 淘宝商品图片采集步骤2 3)如下图红色框中的淘宝商品图片即为本次要采集的内容。

https://www.360docs.net/doc/a212056623.html, 淘宝商品图片采集步骤3 步骤2:创建翻页循环 ●找到翻页按钮,设置翻页循环 ●设置ajax翻页时间 ●设置滚动页面 1)将淘宝商品搜索结果页页面下拉到底部,找到下一页按钮,鼠标点击,在右侧操作提示框中,选择“循环点击下一页”这个选项。

网页图片提取方法

https://www.360docs.net/doc/a212056623.html, 网页图片提取方法 对于新媒体运营来说,平日一定要注意积累图片素材,这样到写文案用的时候,才不会临时来照图片,耗费大量的时间。 本文向大家介绍一款网络数据采集工具【八爪鱼数据采集器】,以【图片采集】为例,教大家如何使用八爪鱼采集软件采集网络图片的方法。 1、图片采集 在八爪鱼中,采集图片有以下几大步 1、先采集网页图片的地址链接url 2、通过八爪鱼提供的专用图片批量下载工具将URL转化为图片 八爪鱼图片批量下载工具:https://https://www.360docs.net/doc/a212056623.html,/s/1c2n60NI 2、常见应用情景 1)非瀑布流网站纯图片采集 采集示例:豆瓣网图片采集教程https://www.360docs.net/doc/a212056623.html,/tutorial/tpcj-7 2)瀑布流网站纯图片采集 这类瀑布流网站的采集需要按下面的步骤对采集规则进行设置:

https://www.360docs.net/doc/a212056623.html, ①点击采集规则打开网页步骤的高级选项; ②勾选页面加载完成后下滚动; ③填写滚动的次数及每次滚动的间隔; ④滚动方式设置为:直接滚动到底部; 完成上面的规则设置后,再对页面中图片的url进行采集 采集示例:百度网图片采集教程https://www.360docs.net/doc/a212056623.html,/tutorial/bdpiccj 3)文章图文采集 需要将文章里的文字和图片都采集下来,一般有两种方法 方法1:判断条件,设置判断条件分别采集文字和图片 采集示例:https://www.360docs.net/doc/a212056623.html,/tutorial/txnewscj 方法2:先整体采集文字,再循环采集图片 采集示例:https://www.360docs.net/doc/a212056623.html,/tutorial/ucnewscj 3、教程目的 采集图片URL这个步骤,以上图片采集教程中都有详细说明,不再赘述。本文将重点讲解图片采集的采集技巧和注意事项。 4、采集图片URL操作步骤 以下演示一个采集图片URL的具体操作步骤,以百度图片url采集为例。不同的网站图片url会遇到不同的情况,请大家灵活处理。

如何抓取网页数据,以抓取安居客举例

如何抓取网页数据,以抓取安居客举例 互联网时代,网页上有丰富的数据资源。我们在工作项目、学习过程或者学术研究等情况下,往往需要大量数据的支持。那么,该如何抓取这些所需的网页数据呢? 对于有编程基础的同学而言,可以写个爬虫程序,抓取网页数据。对于没有编程基础的同学而言,可以选择一款合适的爬虫工具,来抓取网页数据。 高度增长的抓取网页数据需求,推动了爬虫工具这一市场的成型与繁荣。目前,市面上有诸多爬虫工具可供选择(八爪鱼、集搜客、火车头、神箭手、造数等)。每个爬虫工具功能、定位、适宜人群不尽相同,大家可按需选择。本文使用的是操作简单、功能强大的八爪鱼采集器。以下是一个使用八爪鱼抓取网页数据的完整示例。示例中采集的是安居客-深圳-新房-全部楼盘的数据。 采集网站:https://https://www.360docs.net/doc/a212056623.html,/loupan/all/p2/ 步骤1:创建采集任务 1)进入主界面,选择“自定义模式”

如何抓取网页数据,以抓取安居客举例图1 2)将要采集的网址复制粘贴到网站输入框中,点击“保存网址”

如何抓取网页数据,以抓取安居客举例图2 步骤2:创建翻页循环 1)在页面右上角,打开“流程”,以展现出“流程设计器”和“定制当前操作”两个板块。将页面下拉到底部,点击“下一页”按钮,在右侧的操作提示框中,选择“循环点击下一页”,以建立一个翻页循环

如何抓取网页数据,以抓取安居客举例图3 步骤3:创建列表循环并提取数据 1)移动鼠标,选中页面里的第一个楼盘信息区块。系统会识别此区块中的子元素,在操作提示框中,选择“选中子元素”

如何抓取网页数据,以抓取安居客举例图4 2)系统会自动识别出页面中的其他同类元素,在操作提示框中,选择“选中全部”,以建立一个列表循环

网页链接提取方法

https://www.360docs.net/doc/a212056623.html, 网页链接提取方法 网页链接的提取是数据采集中非常重要的部分,当我们要采集列表页的数据时,除了列表标题的链接还有页码的链接,数据采集只采集一页是不够,还要从首页遍历到末页直到把所有的列表标题链接采集完,然后再用这些链接采集详情页的信息。若仅仅靠手工打开网页源代码一个一个链接复制粘贴出来,太麻烦了。掌握网页链接提取方法能让我们的工作事半功倍。在进行数据采集的时候,我们可能有提取网页链接的需求。网页链接提取一般有两种情况:提取页面内的链接;提取当前页地址栏的链接。针对这两种情况,八爪鱼采集器均有相关功能实现。下面介绍一个网页链接提取方法。 一、八爪鱼提取页面内的超链接 在网页里点击需要提取的链接,选择“采集以下链接地址”

https://www.360docs.net/doc/a212056623.html, 网页链接提取方法1 二、八爪鱼提取当前地址栏的超链接 从左边栏拖出一个提取数据的步骤出来(如果当前页已经有其他的提取字段,这一步可省略)点击“添加特殊字段”,选择“添加当前页面网址”。可以看到,当前地址栏的超链接被抓取下来

https://www.360docs.net/doc/a212056623.html, 网页链接提取方法2 而批量提取网页链接的需求,一般是指批量提取页面内的超链接。以下是一个使用八爪鱼批量提取页面内超链接的完整示例。 采集网站: https://https://www.360docs.net/doc/a212056623.html,/search?initiative_id=tbindexz_20170918&ie=utf8&spm=a21 bo.50862.201856-taobao-item.2&sourceId=tb.index&search_type=item&ssid=s5-e&commend=all&imgfile=&q=手表&suggest=history_1&_input_charset=utf-8&wq=&suggest_query=&source=sugg est

网站图片抓取方法

https://www.360docs.net/doc/a212056623.html, 网站图片抓取方法 你是否有过想将网站上看到的图片抓取保存到本地电脑?图片少量时,还可以手动一张张下载,但是图片量巨大时,这个时候手动下载既耗费时间精力,效率又极其低下。遇到这种情况怎么办呢?让八爪鱼来帮你把~只需要在八爪鱼软件中配置相应的流程,图片下载到电脑就是so easy~下面就为大家介绍最全的网站图片抓取方法。 1、图片采集 在八爪鱼中,采集图片有以下几大步 1、先采集网页图片的地址链接url 2、通过八爪鱼提供的专用图片批量下载工具将URL转化为图片 八爪鱼图片批量下载工具:https://https://www.360docs.net/doc/a212056623.html,/s/1c2n60NI 2、常见应用情景 1)非瀑布流网站纯图片采集 采集示例:豆瓣网图片采集教程https://www.360docs.net/doc/a212056623.html,/tutorial/tpcj-7 2)瀑布流网站纯图片采集 这类瀑布流网站的采集需要按下面的步骤对采集规则进行设置: ①点击采集规则打开网页步骤的高级选项; ②勾选页面加载完成后下滚动; ③填写滚动的次数及每次滚动的间隔;

https://www.360docs.net/doc/a212056623.html, ④滚动方式设置为:直接滚动到底部; 完成上面的规则设置后,再对页面中图片的url进行采集 采集示例:百度网图片采集教程https://www.360docs.net/doc/a212056623.html,/tutorial/bdpiccj 3)文章图文采集 需要将文章里的文字和图片都采集下来,一般有两种方法 方法1:判断条件,设置判断条件分别采集文字和图片 采集示例:https://www.360docs.net/doc/a212056623.html,/tutorial/txnewscj 方法2:先整体采集文字,再循环采集图片 采集示例:https://www.360docs.net/doc/a212056623.html,/tutorial/ucnewscj 3、教程目的 采集图片URL这个步骤,以上图片采集教程中都有详细说明,不再赘述。本文将重点讲解图片采集的采集技巧和注意事项。 4、采集图片URL操作步骤 以下演示一个采集图片URL的具体操作步骤,以百度图片url采集为例。不同的网站图片url会遇到不同的情况,请大家灵活处理。

国内主要信息抓取软件盘点

国内主要信息抓取软件盘点 近年来,随着国内大数据战略越来越清晰,数据抓取和信息采集系列产品迎来了巨大的发展 机遇,采集产品数量也出现迅猛增长。然而与产品种类快速增长相反的是,信息采集技术相 对薄弱、市场竞争激烈、质量良莠不齐。在此,本文列出当前信息采集和数据抓取市场最具 影响力的六大品牌,供各大数据和情报中心建设单位采购时参考: TOP.1 乐思网络信息采集系统 乐思网络信息采系统的主要目标就是解决网络信息采集和网络数据抓取问题。是根据用户自定义的任务配置,批量而精确地抽取因特网目标网页中的半结构化与非结构化数据,转化为结构化的记录,保存在本地数据库中,用于内部使用或外网发布,快速实现外部信息的获取。 主要用于:大数据基础建设,舆情监测,品牌监测,价格监测,门户网站新闻采集,行业资讯采集,竞争情报获取,商业数据整合,市场研究,数据库营销等领域。 TOP.2 火车采集器 火车采集器是一款专业的网络数据采集/信息挖掘处理软件,通过灵活的配置,可以很轻松迅速地从网页上抓取结构化的文本、图片、文件等资源信息,可编辑筛选处理后选择发布到网站后台,各类文件或其他数据库系统中。被广泛应用于数据采集挖掘、垂直搜索、信息汇聚和门户、企业网信息汇聚、商业情报、论坛或博客迁移、智能信息代理、个人信息检索等领域,适用于各类对数据有采集挖掘需求的群体。 TOP.3 熊猫采集软件 熊猫采集软件利用熊猫精准搜索引擎的解析内核,实现对网页内容的仿浏览器解析,在此基础上利用原创的技术实现对网页框架内容与核心内容的分离、抽取,并实现相似页面的有效比对、匹配。因此,用户只需要指定一个参考页面,熊猫采集软件系统就可以据此来匹配类似的页面,来实现用户需要采集资料的批量采集。 TOP.4 狂人采集器 狂人采集器是一套专业的网站内容采集软件,支持各类论坛的帖子和回复采集,网站和博客文章内容抓取,通过相关配置,能轻松的采集80%的网站内容为己所用。根据各建站程序

网页正文提取

我为开源做贡献,网页正文提取——Html2Article 2014-1-7 14:38|发布者: 红黑魂|查看: 16722|评论: 4|原作者: StanZhai|来自: 博客园 摘要: 为什么要做正文提取一般做舆情分析,都会涉及到网页正文内容提取。对于分析而言,有价值的信息是正文部分,大多数情况下,为了便于分析,需要将网页中和正文不相干的部分给剔除。可以说正文提取的好坏,直接影响了分 ... 为什么要做正文提取 一般做舆情分析,都会涉及到网页正文内容提取。对于分析而言,有价值的信息是正文部分,大多数情况下,为了便于分析,需要将网页中和正文不相干的部分给剔除。可以说正文提取的好坏,直接影响了分析结果的好坏。 对于特定的网站,我们可以分析其html结构,根据其结构来获取正文信息。先看一下下面这张图: 正文部分,不同的网站,正文所在的位置不同,并且Html的结构也不同,对于 爬虫而言,抓取的页面是各种各样的,不可能针对所有的页面去写抓取规则来提取正文内容,因此需要一种通用的算法将正文提取出来。

现有的网页正文提取算法 ?基于标签用途的正文提取算法(比如title或h1,h2标签一般用作标题,p一 般表示正文段落,根据标签的含义去提取正文) ?基于标签密度判定(这个简单,说白了就是字符统计,正文部分html标签的密度比较低,确定一个阈值,按照标签密度提取正文部分) ?基于数据挖掘思想的网页正文抽取方法(这里会涉及到统计学和概率论的一些知识,在高深点就成了机器学习了,没有深入研究) ?基于视觉网页块分析技术的正文抽取(CV这种高端大气上档次的东西,岂是 我等这么容易就能研究明白的。虽然实现上复杂,但就提取效果而言,这种方法提取的精度还是不错的) 前2中方法还是比较容易实现的,主要是处理简单,先前我把标签密度的提取算法实现了,但实际用起来错误率还是蛮高的;后2种方法在实现上就略复杂了,从算法效率上讲应该也高不了哪去。 我们需要的是一种简单易实现的,既能保证处理速度,提取的准确率也不错的算法。于是结合前两种算法,研究网页html页面结构,有了一种比较好的处理思 路,权且叫做基于文本密度的正文提取算法吧。后来从网上找了一下类似的算法,发现也有使用类似的处理方法来处理正文提取的,不过还是有些不同。接下来跟大家分享一下这个算法的一些处理思想。 网页分析 我任意取了百度,搜狐,网易的一篇新闻类网页,拿来作分析。 先看一篇百度的文章 任正非为什么主动与我合影,https://www.360docs.net/doc/a212056623.html,/article/2011 首先请求这个页面,然后过滤到所有的html标签,只保留文本信息,我们可以 看到正文信息集中在一下位置:

最全的网页图片采集方法

https://www.360docs.net/doc/a212056623.html, 最全的网页图片采集方法 1、图片采集 在八爪鱼中,采集图片有以下几大步 1、先采集网页图片的地址链接url 2、通过八爪鱼提供的专用图片批量下载工具将URL转化为图片 八爪鱼图片批量下载工具:https://https://www.360docs.net/doc/a212056623.html,/s/1c2n60NI 2、常见应用情景 1)非瀑布流网站纯图片采集 采集示例:豆瓣网图片采集教程https://www.360docs.net/doc/a212056623.html,/tutorial/tpcj-7 2)瀑布流网站纯图片采集 这类瀑布流网站的采集需要按下面的步骤对采集规则进行设置: ①点击采集规则打开网页步骤的高级选项; ②勾选页面加载完成后下滚动; ③填写滚动的次数及每次滚动的间隔; ④滚动方式设置为:直接滚动到底部; 完成上面的规则设置后,再对页面中图片的url进行采集

https://www.360docs.net/doc/a212056623.html, 采集示例:百度网图片采集教程https://www.360docs.net/doc/a212056623.html,/tutorial/bdpiccj 3)文章图文采集 需要将文章里的文字和图片都采集下来,一般有两种方法 方法1:判断条件,设置判断条件分别采集文字和图片 采集示例:https://www.360docs.net/doc/a212056623.html,/tutorial/txnewscj 方法2:先整体采集文字,再循环采集图片 采集示例:https://www.360docs.net/doc/a212056623.html,/tutorial/ucnewscj 3、教程目的 采集图片URL这个步骤,以上图片采集教程中都有详细说明,不再赘述。本文将重点讲解图片采集的采集技巧和注意事项。 4、采集图片URL操作步骤 以下演示一个采集图片URL的具体操作步骤,以百度图片url采集为例。不同的网站图片url会遇到不同的情况,请大家灵活处理。

网页抓取工具如何进行http模拟请求

网页抓取工具如何进行http模拟请求 在使用网页抓取工具采集网页是,进行http模拟请求可以通过浏览器自动获取登录cookie、返回头信息,查看源码等。具体如何操作呢?这里分享给大家网页抓取工具火车采集器V9中的http模拟请求。许多请求工具都是仿照火车采集器中的请求工具所写,因此大家可以此为例学习一下。 http模拟请求可以设置如何发起一个http请求,包括设置请求信息,返回头信息等。并具有自动提交的功能。工具主要包含两大部分:一个MDI父窗体和请求配置窗体。 1.1请求地址:正确填写请求的链接。 1.2请求信息:常规设置和更高级设置两部分。 (1)常规设置: ①来源页:正确填写请求页来源页地址。 ②发送方式:get和post,当选择post时,请在发送数据文本框正确填写发布数据。 ③客户端:选择或粘贴浏览器类型至此处。 ④cookie值:读取本地登录信息和自定义两种选择。 高级设置:包含如图所示系列设置,当不需要以上高级设置时,点击关闭按钮即可。 ①网页压缩:选择压缩方式,可全选,对应请求头信息的Accept-Encoding。 ②网页编码:自动识别和自定义两种选择,若选中自定义,自定义后面会出现编

码选择框,在选择框选择请求的编码。 ③Keep-Alive:决定当前请求是否与internet资源建立持久性链接。 ④自动跳转:决定当前请求是否应跟随重定向响应。 ⑤基于Windows身份验证类型的表单:正确填写用户名,密码,域即可,无身份认证时不必填写。 ⑥更多发送头信息:显示发送的头信息,以列表形式显示更清晰直观的了解到请求的头信息。此处的头信息供用户选填的,若要将某一名称的头信息进行请求,勾选Header名对应的复选框即可,Header名和Header值都是可以进行编辑的。 1.3返回头信息:将详细罗列请求成功之后返回的头信息,如下图。 1.4源码:待请求完毕后,工具会自动跳转到源码选项,在此可查看请求成功之后所返回的页面源码信息。 1.5预览:可在此预览请求成功之后返回的页面。 1.6自动操作选项:可设置自动刷新/提交的时间间隔和运行次数,启用此操作后,工具会自动的按一定的时间间隔和运行次数向服务器自动请求,若想取消此操作,点击后面的停止按钮即可。 配置好上述信息后,点击“开始查看”按钮即可查看请求信息,返回头信息等,为避免填写请求信息,可以点击“粘贴外部监视HTTP请求数据”按钮粘贴请求的头信息,然后点击开始查看按钮即可。这种捷径是在粘贴的头信息格式正确的前提下,否则会弹出错误提示框。 更多有关网页抓取工具或网页采集的教程都可以从火车采集器的系列教程中学习借鉴。

教你如何提取网页中的视频(主要flv),音乐,flash,图片等多媒体文件

教你如何提取网页中的视频(主要flv),音乐,flash,图片 等多媒体文件 打开网页后,发现里面有好看的视频、好听的音乐、好看的图片、很炫的flash,是不是想把它们弄到自己电脑上或手机、mp4上?但很多时候视频无法下载,音乐只能试听,或者好听的背景音乐根本就不知道什么名字,更别说怎么下了;至于图片直接右键另存为即可,不过如果网页突然关掉了,但又想把看过的图片弄下来,而忘了图片网页地址或者不想再通过历史记录打开,这时又该怎么办? 其实这些问题都能很好的解决,并且很简单,只要用一个软件来替你从电脑的缓存中搜索一下就OK了,因为网页中显示的内容基本上全部都在缓存中,如果自己手动搜索,那将是很累人滴,又不好找,东西太多,又没分类。 无意中发现一个小软件很强(对此感兴趣,本人玩过无数小软件),我一直在用,也是用它帮了很多网友的忙,为了让更多的网友解决问题,于是拿来和亲们分享一下。 工具/原料 这款免费小软件就是YuanBox(元宝箱)v1.6,全称:元宝箱FLV视频下载专家,百度一搜就能下载。 下面是我自己整理的使用步骤,供亲们参考(其实不用看就行,软件简单,不用学就会),我只是用的时间长了,很熟练罢了: 软件下好后,解压,打开里面的YuanBox.exe即可,不用安装;打开此软件前,先打开你要提取东西的网页(之后再关掉也行),这是为了保证电脑缓存中有你要的东西。 步骤/方法 ○11运行软件,初始界面如下图:

○22之后直接是flv格式视频搜索结果的界面,原因就是此软件的全称是 元宝箱FLV视频下载专家,不想要视频的话,点击最上面的设置或者最下面的高级设置,即可进行搜索范围设定 ○33下面是搜索条件设定界面

图片爬虫如何使用

https://www.360docs.net/doc/a212056623.html, 图片爬虫如何使用 目标网站上有许多我们喜欢的图片,想用到自己的工作或生活中去,但苦于工作量太大,图片一张张保存太过耗时耗力,因此总是力不从心。 本文向大家介绍一款网络数据采集工具【八爪鱼数据采集器】,以【ebay】为例,教大家如何使用八爪鱼采集软件采集ebay网站的方法。 可以将网页中图片的URL采集下来,再通过八爪鱼专用的图片批量下载工具,将采集到的图片URL中的图片,下载并保存到本地电脑中。 采集网站: https://https://www.360docs.net/doc/a212056623.html,/sch/i.html?_from=R40&_trksid=p2050601.m570.l1313.TR0.TRC0.H0.Xnik e.TRS0&_nkw=nike&_sacat=0 使用功能点: ●分页列表信息采集 ●执行前等待 ●图片URL转换

https://www.360docs.net/doc/a212056623.html, 步骤1:创建采集任务 1)进入主界面,选择“自定义采集” ebay爬虫采集步骤1 2)将上面网址的网址复制粘贴到网站输入框中,点击“保存网址”

https://www.360docs.net/doc/a212056623.html, ebay爬虫采集步骤2 3)系统自动打开网页,红色方框中的图片是这次演示要采集的内容

https://www.360docs.net/doc/a212056623.html, ebay爬虫采集步骤3 步骤二:创建翻页循环 1)点击右上角的“流程”,即可以看到配置流程图。将页面下拉到底部,找到下一页的大于号标志按钮,鼠标点击,在右侧操作提示框中,选择“循环点击单个链接” ebay爬虫采集步骤4 由于该网页每次翻页网址随之变化,所以不是ajax页面,不需要设置ajax。如果有网站每次翻页,网址不变,则需要在高级选项设置ajax加载。

网页数据抓取方法详解

https://www.360docs.net/doc/a212056623.html, 网页数据抓取方法详解 互联网时代,网络上有海量的信息,有时我们需要筛选找到我们需要的信息。很多朋友对于如何简单有效获取数据毫无头绪,今天给大家详解网页数据抓取方法,希望对大家有帮助。 八爪鱼是一款通用的网页数据采集器,可实现全网数据(网页、论坛、移动互联网、QQ空间、电话号码、邮箱、图片等信息)的自动采集。同时八爪鱼提供单机采集和云采集两种采集方式,另外针对不同的用户还有自定义采集和简易采集等主要采集模式可供选择。

https://www.360docs.net/doc/a212056623.html, 如果想要自动抓取数据呢,八爪鱼的自动采集就派上用场了。 定时采集是八爪鱼采集器为需要持续更新网站信息的用户提供的精确到分钟的,可以设定采集时间段的功能。在设置好正确的采集规则后,八爪鱼会根据设置的时间在云服务器启动采集任务进行数据的采集。定时采集的功能必须使用云采集的时候,才会进行数据的采集,单机采集是无法进行定时采集的。 定时云采集的设置有两种方法: 方法一:任务字段配置完毕后,点击‘选中全部’→‘采集以下数据’→‘保存并开始采集’,进入到“运行任务”界面,点击‘设置定时云采集’,弹出‘定时云采集’配置页面。

https://www.360docs.net/doc/a212056623.html, 第一、如果需要保存定时设置,在‘已保存的配置’输入框内输入名称,再保存配置,保存成功之后,下次如果其他任务需要同样的定时配置时可以选择这个配置。 第二、定时方式的设置有4种,可以根据自己的需求选择启动方式和启动时间。所有设置完成之后,如果需要启动定时云采集选择下方‘保存并启动’定时采集,然后点击确定即可。如果不需要启动只需点击下方‘保存’定时采集设置即可。

网页内容如何批量提取

https://www.360docs.net/doc/a212056623.html, 网页内容如何批量提取 网站上有许多优质的内容或者是文章,我们想批量采集下来慢慢研究,但内容太多,分布在不同的网站,这时如何才能高效、快速地把这些有价值的内容收集到一起呢? 本文向大家介绍一款网络数据采集工具【八爪鱼数据采集】,以【新浪博客】为例,教大家如何使用八爪鱼采集软件采集新浪博客文章内容的方法。 采集网站: https://www.360docs.net/doc/a212056623.html,/s/articlelist_1406314195_0_1.html 采集的内容包括:博客文章正文,标题,标签,分类,日期。 步骤1:创建新浪博客文章采集任务 1)进入主界面,选择“自定义采集”

https://www.360docs.net/doc/a212056623.html, 2)将要采集的网址URL复制粘贴到网站输入框中,点击“保存网址”

https://www.360docs.net/doc/a212056623.html, 步骤2:创建翻页循环

https://www.360docs.net/doc/a212056623.html, 1)打开网页之后,打开右上角的流程按钮,使制作的流程可见状态。点击页面下方的“下一页”,如图,选择“循环点击单个链接”,翻页循环创建完成。(可在左上角流程中手动点击“循环翻页”和“点击翻页”几次,测试是否正常翻页。) 2)由于进入详情页时网页加载很慢,网址一直在转圈状态,无法立即执行下一个步骤,因此在“循环翻页”的高级选项里设置“ajax加载数据”,超时时间设置为5秒,点击“确定”。

https://www.360docs.net/doc/a212056623.html, 步骤3:创建列表循环 1)鼠标点击列表目录中第一个博文,选择操作提示框中的“选中全部”。 2)鼠标点击“循环点击每个链接”,列表循环就创建完成,并进入到第一个循环项的详情页面。

如何对整个网页页面进行截图

一、在键盘右上侧有一个键print screen sys rq键(打印屏幕),可以用它将显示屏显示的画面抓下来,复制到“剪贴板”中,然后再把图片粘贴到“画图”、“Photoshop”之类的图像处理软件中,进行编辑处理后保存成图片文件,或粘贴到“Word”、“Powerpoint”、“Wps”等支持图文编辑的应用软件里直接使用。 1、截获屏幕图像 ①将所要截取的画面窗口处于windows窗口的最前方(当前编辑窗口); ②按键盘上的“Print Screen”键,系统将会截取全屏幕画面并保存到“剪贴板”中; ③打开图片处理软件(如“画图”),点击该软件工具栏上的“粘贴”按钮或编辑菜单中的“粘贴”命令,图片被粘贴到该软件编辑窗口中(画布上),编辑图片,保存文件。 或打开(切换到)图文编辑软件(如“Word”、“Powerpoint”等),点击该软件工具栏上的“粘贴”按钮或编辑菜单中的“粘贴”命令,图片被粘贴到编辑窗口中,也可以使用该类软件的图片工具进行编辑。 注意,当粘贴到“画图”中时,可能会弹出一个“剪贴板中的图像比位图大,是否扩大位图?”对话框,此时点击“是”即可。 2、抓取当前活动窗口 我们经常不需要整个屏幕,而只要屏幕中的一个窗口,比如我们要“Word”窗口的图片。按下Alt键,同时按Print Screen即可。 ①将所要截取的窗口处于windows窗口的最前方(即当前编辑窗口); ②同时按下Alt键和“Print Screen”键,系统将会截取当前窗口画面并保存到“剪贴板”中; ③粘贴到图像处理软件中或图文编辑软件中。 二、直接点击Ctrl+Alt+A键,然后可见鼠标的箭头变成彩色的,按住左键移动鼠标选择截图范围,然后在截图内右键鼠标另存为即可,可方便了. 三、用第三方软件如QQ截图:点击聊天框截图---显示彩色鼠标---用其圈定所选目标(右键取消)----双击(单击左键为重新选择)---进入QQ聊天框--右键另存为---到达所到地址 如果想上传则:右键点击图片---编辑---另存为---把保存类型改为JPEG格式即可。 方法1.1 屏幕截图 登陆QQ—→按下“Ctrl+Alt+A”组合键—→按下鼠标左键不放选择截取范围—→用鼠标左键调整截取范围的大小和位置—→截取范围内双击鼠标左键。所截图像保存在系统剪贴板。

百度贴吧内容抓取工具-让你的网站一夜之间内容丰富

百度贴吧内容抓取工具-让你的网站一夜之间内容丰富 [hide]

var $getreplytime=1; var $showimg=1; var $showcon=1; var $showauthor=1; var $showreplytime=1; var $showsn=0; var $showhr=0; var $replylista=array(); var $pat_reply="<\/a>(.+?)

<\/td>\r\n<\/tr><\/table>"; var $pat_pagecount="尾页<\/font><\/a>"; var $pat_title="(.+?)<\/font>"; var $pat_replycon="<\/td>\r\n \r\n