多重共线性的处理(主成分回归方法)-瑟嘉

本文主要是对多重共线性的处理(主成分回归法)的介绍。

1.思路:

A:确定是否存在共线

B:找出多重共线的自变量

C:用主成分回归法。

2:具体操作:

1)一般的书都有共线性的判断指标。这里就省略了(^_^)

2)找出多多重共线性的自变量:

以下是具体操作:

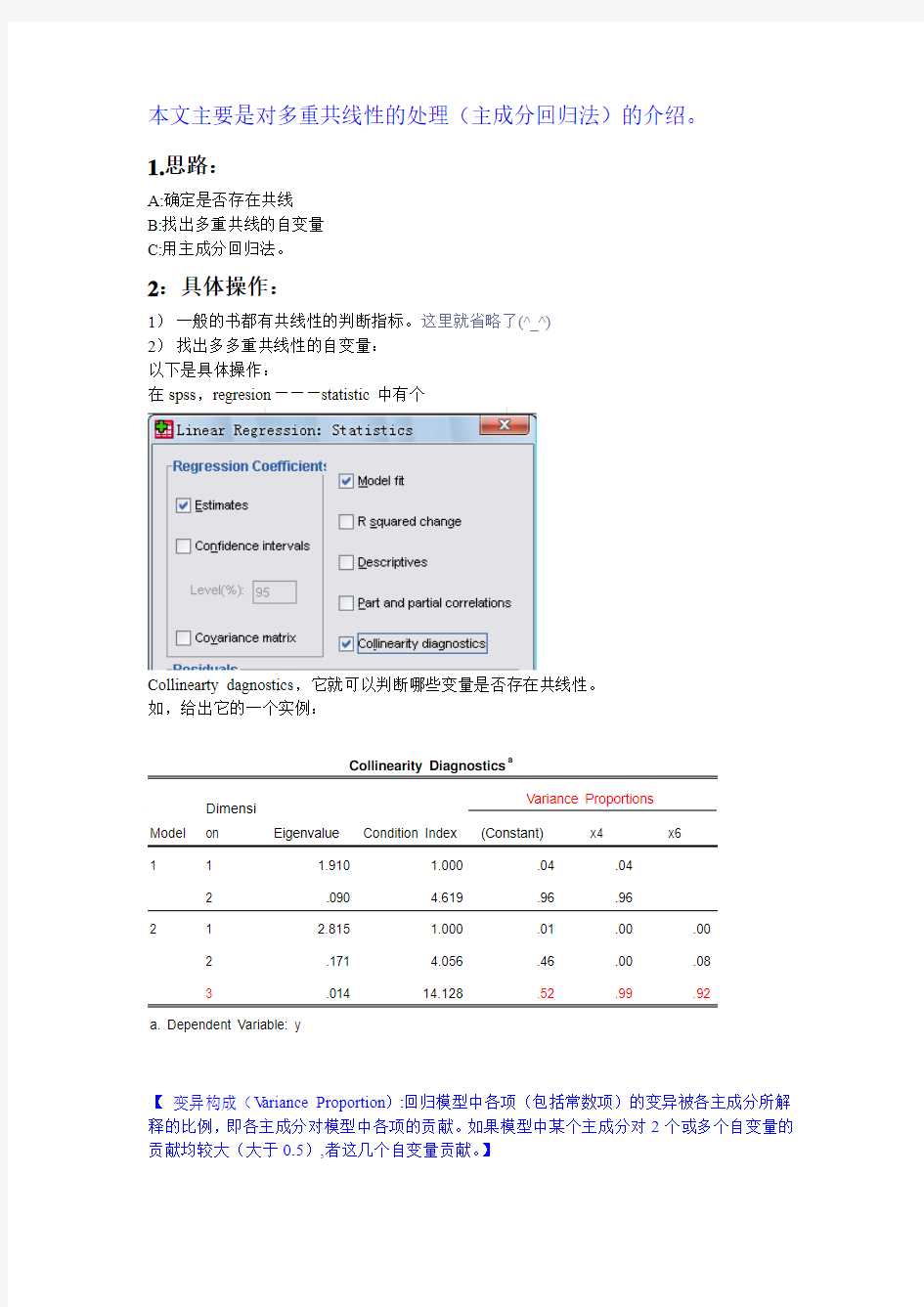

在spss,regresion―――statistic中有个

Collinearty dagnostics,它就可以判断哪些变量是否存在共线性。

如,给出它的一个实例:

【变异构成(V ariance Proportion):回归模型中各项(包括常数项)的变异被各主成分所解释的比例,即各主成分对模型中各项的贡献。如果模型中某个主成分对2个或多个自变量的贡献均较大(大于0.5),者这几个自变量贡献。】

上面例子可以看出,x4,x6之间存在共线性。

3)主成分回归。

这个包括3部分:

A:找到主成分:用上面确定了有共线的几个变量拿来做成分分析,保留主成分得分。

(这个在factor中,应该狠容易实现吧,那我就省略了,^_^)

B:回归分析:将A步骤求得的主成分得分,与其他的自变量(没共线性的其他自变量)拿来做回归分析,当然会得到回归模型。(MODEL,代表)

C:用那些共线性变量,来替换MODEL中的主成分变量.

(因为可以用主成分回归系数,根据主成分的表达式,很容易用自变量代替主成分)

PLS回归在消除多重共线性中的作用

PL S回归在消除多重共线性中的作用 王惠文 朱韵华 (北京航空航天大学管理学院,北京,100083) 摘 要 本文详细阐述了解释变量的多重共线性在回归建模与分析中的危害作用,并指出目前常用的几种消除多重线性影响的方法,以及它们的不足之处。本文结合实证研究指出:利用一种新的建模思路 PLS回归,可以更好地消除多重共线性对建模准确性与可靠性所带来的影响。 关键词:多重共线性 PLS回归 一、引 言 在多元回归的建模与分析中,解释变量之间存在高度相关性的现象十分普遍。在这种情况下,要很好地解释模型中某个自变量对因变量的效应,是非常困难的。然而,在从事建模工作过程中,为了更完备地描述系统,尽可能不遗漏一些举足轻重的系统特征,分析人员往往倾向于尽可能周到地选取有关指标,在这样构成的多变量系统中必然经常出现变量多重相关的现象。事实上,许多社会、经济及技术指标都有同步增长的趋势,因此,在多元回归建模实施过程中,变量多重相关的现象是很难避免的。 二、多重共线性在回归建模中的危害作用 1.危害性讨论 多重共线性的现象是由Fr isch.A.K在其著名论著 完全回归体系的统计合流分析 中首次提出的,用数学语言来描述,它是指变量之间存在着线性关系。在多重共线性现象存在的情况下,对多元回归分析会产生如下影响: (1)如果变量之间存在完全的多重共线性,那么将无法估计变量的回归系数。而由于各个自变量的回归系数无法估计,所以也就无法估计各个自变量单独对因变量的影响,自然也就无法判断自变量对因变量的效应,即使自变量之间不存在完全的多重共线性,但是当自变量有较高度的相关关系时,一个自变量的回归系数,在模型中只反映这个自变量对因变量边际的或部分的效应,因而所得到的回归模型是不准确的。 (2)回归系数的估计方差为无穷大。例如在一个简单的多元回归中,自变量X1和X2之间 收稿日期:1996年2月9日 *本文系国家自然科学基金资助项目

多重共线性问题的几种解决方法

多重共线性问题的几种解决方法 在多元线性回归模型经典假设中,其重要假定之一是回归模型的解释 变量之间不存在线性关系,也就是说,解释变量X 1,X 2 ,……,X k 中的任何一个 都不能是其他解释变量的线性组合。如果违背这一假定,即线性回归模型中某一个解释变量与其他解释变量间存在线性关系,就称线性回归模型中存在多重共线性。多重共线性违背了解释变量间不相关的古典假设,将给普通最小二乘法带来严重后果。 这里,我们总结了8个处理多重共线性问题的可用方法,大家在遇到多重共线性问题时可作参考: 1、保留重要解释变量,去掉次要或可替代解释变量 2、用相对数变量替代绝对数变量 3、差分法 4、逐步回归分析 5、主成份分析 6、偏最小二乘回归 7、岭回归 8、增加样本容量 这次我们主要研究逐步回归分析方法是如何处理多重共线性问题的。 逐步回归分析方法的基本思想是通过相关系数r、拟合优度R2和标准误差三个方面综合判断一系列回归方程的优劣,从而得到最优回归方程。具体方法分为两步: 第一步,先将被解释变量y对每个解释变量作简单回归: 对每一个回归方程进行统计检验分析(相关系数r、拟合优度R2和标准误差),并结合经济理论分析选出最优回归方程,也称为基本回归方程。

第二步,将其他解释变量逐一引入到基本回归方程中,建立一系列回归方程,根据每个新加的解释变量的标准差和复相关系数来考察其对每个回归系数的影响,一般根据如下标准进行分类判别: 1.如果新引进的解释变量使R2得到提高,而其他参数回归系数在统计上和经济理论上仍然合理,则认为这个新引入的变量对回归模型是有利的,可以作为解释变量予以保留。 2.如果新引进的解释变量对R2改进不明显,对其他回归系数也没有多大影响,则不必保留在回归模型中。 3.如果新引进的解释变量不仅改变了R2,而且对其他回归系数的数值或符号具有明显影响,则认为该解释变量为不利变量,引进后会使回归模型出现多重共线性问题。不利变量未必是多余的,如果它可能对被解释变量是不可缺少的,则不能简单舍弃,而是应研究改善模型的形式,寻找更符合实际的模型,重新进行估计。如果通过检验证明回归模型存在明显线性相关的两个解释变量中的其中一个可以被另一个很好地解释,则可略去其中对被解释变量影响较小的那个变量,模型中保留影响较大的那个变量。 下边我们通过实例来说明逐步回归分析方法在解决多重共线性问题上的具体应用过程。 具体实例 例1设某地10年间有关服装消费、可支配收入、流动资产、服装类物价指数、总物价指数的调查数据如表1,请建立需求函数模型。 表1 服装消费及相关变量调查数据

主成分回归多重共线性

实验八:主成分回归 实验题目:对例5、5的Hald水泥问题用主成分方法建立模型,并与其她方法的结果进行比较。例5、5如下:本例为回归经典的Hald水泥问题。某种水泥在凝固时放出的热量y(卡/克,cal/g)与水泥中的四种化学成分的含量(%)有关,这四种化学成分分别就是x1铝酸三钙(3CaO、Al2O3),x2硅酸三钙(3CaO、SiO2),x3铁铝酸四钙(4CaO、Al2O3、Fe2O3),x4硅酸三钙(2CaO、SiO2)。现观测到13组数据,如表5-3所示。 实验目的: SPSS输出结果及答案: 一、主成分法: 多重共线性诊断:

N 13 13 13 13 13 **、在、01 水平(双侧)上显著相关。 由表可知,x1,x2,x4的相关性都比较大,较接近,所以存在多重共线性 主成分回归: 解释的总方差 成份 初始特征值提取平方与载入 合计方差的 % 累积 % 合计方差的 % 累积 % 1 2、236 55、893 55、893 2、236 55、893 55、893 2 1、576 39、402 95、294 1、576 39、402 95、294 3 、187 4、665 99、959 、187 4、665 99、959 4 、002 、041 100、000 、002 、041 100、000 提取方法:主成份分析。 输出结果显示有四个特征根,最大的就是λ1=2、236,最小的就是λ4=0、002。 方差百分比显示第一个主成分Factor1的方差百分比近56%的信息量;前两个主成 分累计包含近95、3%的信息量。因此取两个主成分就已经足够。 由于前两个主成分的方差累计已经达到95、3%,故只保留前两个主成分。 成份矩阵a 成份 1 2 3 4 x1 、712 -、639 、292 、010 x2 、843 、520 -、136 、026 x3 -、589 、759 、275 、011 x4 -、819 -、566 -、084 、027 提取方法:主成分 a.已提取了 4 个成份。 由解释的总方差表中累计贡献性知,f1与f2的累计贡献性就在85%~95%之间。所以主成分取f1,f2。 得到因子得分的数值,并对其进行处理:sqrt(2、236)* FAD1_1, sqrt(1、576)* FAD2_1可以得出主成分表(f1 f2)。

多重共线性的解决之法

第七章 多重共线性 教学目的及要求: 1、重点理解多重共线性在经济现象中的表现及产生的原因和后果 2、掌握检验和处理多重共线性问题的方法 3、学会灵活运用Eviews 软件解决多重共线性的实际问题。 第一节 多重共线性的产生及后果 一、多重共线性的含义 1、含义 在多元线性回归模型经典假设中,其重要假定之一是回归模型的解释变量之间不存在线性关系,也就是说,解释变量X 1,X 2,……,X k 中的任何一个都不能是其他解释变量的线性组合。如果违背这一假定,即线性回归模型中某一个解释变量与其他解释变量间存在线性关系,就称线性回归模型中存在多重共线性。多重共线性违背了解释变量间不相关的古典假设,将给普通最小二乘法带来严重后果。 2、类型 多重共线性包含完全多重共线性和不完全多重共线性两种类型。 (1)完全多重共线性 完全多重共线性是指线性回归模型中至少有一个解释变量可以被其他解释变量线性表示,存在严格的线性关系。 如对于多元线性回归模型 i ki k i i i X X X Y μββββ+++++= 22110 (7-1) 存在不全为零的数k λλλ,,,21 ,使得下式成立: 0X X X 2211=+++ki k i i λλλ (7-2) 则可以说解释变量k X ,,X ,X 21 之间存在完全的线性相关关系,即存在完全多重共线性。 从矩阵形式来看,就是0' =X X , 即1)(- 不完全多重共线性是指线性回归模型中解释变量间存在不严格的线性关系,即近似线性关系。 如对于多元线性回归模型(7-1)存在不全为零的数k λλλ,,,21 ,使得下式成立: 0X X X 2211=++++i ki k i i u λλλ (7-3) 其中i u 为随机误差项,则可以说解释变量k X ,,X ,X 21 之间存在不完全多重共线性。随机误差项表明上述线性关系是一种近似的关系式,大体上反映了解释变量间的相关程度。 完全多重共线性与完全非线性都是极端情况,一般说来,统计数据中多个解释变量之间多少都存在一定程度的相关性,对多重共线性程度强弱的判断和解决方法是本章讨论的重点。 二、多重共线性产生的原因 多重共线性在经济现象中具有普遍性,其产生的原因很多,一般较常见的有以下几种情况。 (一)经济变量间具有相同方向的变化趋势 在同一经济发展阶段,一些因素的变化往往同时影响若干经济变量向相同方向变化,从而引起多重共线性。如在经济上升时期,投资、收入、消费、储蓄等经济指标都趋向增长,这些经济变量在引入同一线性回归模型并作为解释变量时,往往存在较严重的多重共线性。 (二)经济变量间存在较密切关系 由于组成经济系统的各要素之间是相互影响相互制约的,因而在数量关系上也会存在一定联系。如耕地面积与施肥量都会对粮食总产量有一定影响,同时,二者本身存在密切关系。 (三)采用滞后变量作为解释变量较易产生多重共线性 一般滞后变量与当期变量在经济意义上关联度比较密切,往往会产生多重共线性。如在研究消费规律时,解释变量因素不但要考虑当期收入,还要考虑以往各期收入,而当期收入与滞后收入间存在多重共线性的可能很大。 (四)数据收集围过窄,有时会造成变量间存在多重共线性问题。 三、多重共线性产生的后果 由前述可知,多重共线性分完全多重共线性和不完全多重共线性两种情况,两种情况都会对模型进行最小二乘估计都会产生严重后果。 多元线性回归中多重共线问题的解决方法综述 摘 要 在回归分析中,当自变量之间出现多重共线性现象时,常会严重影响到参数估计,扩大模型误差,并破坏模型的稳健性,因此消除多重共线性成为回归分析中参数估计的一个重要环节。现在常用的解决多元线性回归中多重共线性的回归模型有岭回归(Ridge Regression )、主成分回归(Principal Component Regression 简记为PCR)和偏最小二乘回归(Partial Least Square Regression 简记为PLS)。 关键词:多重共线性;岭回归;主成分回归;偏最小二乘回归 引言 在多元线性回归分析中,变量的多重相关性会严重影响到参数估计,增大模型误差,并破坏模型的稳健性 由于多重共线性问题在实际应用中普遍存在,并且危害严重,因此设法消除多重性的不良影响无疑具有巨大的价值常用的解决多元线性回归中多重共线问题的回归模型主要有主成分回归岭回归以及偏最小二乘回归。 1、 多元线性回归模型 1.1 回归模型的建立 设Y 是一个可观测的随机变量,它受m 个非随机因素X 1,X 2,…,X p-1和随机因素ε的影响, 若有如下线性关系 我们对变量进行了n 次观察,得到n 组观察数据(如下),对回归系数 进行估计 一般要求n>P 。于是回归关系可写为 采用矩阵形式来表示 0112211p p Y X X X ββββε--=+++++n i X X X Y p i i i i ,,1,,,,)1(2,1???=???-1011121211(1)1 2012122212(1)2 011221(1)p p p p n n n p n p n Y X X X Y X X X Y X X X ββββεββββεββββε------=+++++??=+++++?? ? ?=+++++?11121,(1)121222,(1)212,(1)111, 1 p p n n n n p n n p X X X Y X X X Y Y X Y X X X ---??????????????==??????????????)1(10,,,p -???βββ 第七章 多重共线性及其处理 第一部分 学习辅导 一、本章学习目的与要求 1.理解多重共线性的概念; 2.掌握多重共线性存在的主要原因; 3.理解多重共线性可能造成的后果; 4.掌握多重共线性的检验与修正的方法。 二、本章内容提要 本章主要介绍计量经济模型的计量经济检验。即多重共线性问题。 多重共线性是多元回归模型可能存在的一类现象,分为完全共线与近似共线两类。模型的多个解释变量间出现完全共线性时,模型的参数无法估计。更多的情况则是近似共线性,这时,由于并不违背所有的基本假定,模型参数的估计仍是无偏、一致且有效的,但估计的参数的标准差往往较大,从而使得t 统计值减小,参数的显著性下降,导致某些本应存在于模型中的变量被排除,甚至出现参数正负号方面的一些混乱。显然,近似多重共线性使得模型偏回归系数的特征不再明显,从而很难对单个系数的经济含义进行解释。多重共线性的检验包括检验多重共线性是否存在以及估计多重共线性的范围两层递进的检验。而解决多重共线性的办法通常有逐步回归法、差分法以及使用额外信息、增大样本容量等方法。 (一)多重共线性及其产生的原因 当我们利用统计数据进行分析时,解释变量之间经常会出现高度多重共线性的情况。 1.多重共线性的基本概念 多重共线性(Multicollinearity )一词由弗里希(Frish )于1934年在其撰写的《借助于完全回归系统的统计合流分析》中首次提出。它的原义是指一个回归模型中的一些或全部解释变量之间存在有一种“完全”或准确的线性关系。 如果在经典回归模型Y X βε=+中,经典假定(5)遭到破坏,则有()1R X k <+,此时称解释变量k X X X ,,,21ΛΛ间存在完全多重共线性。解释变量的完全多重共线性,也就是解释变量之间存在严格的线性关系,即数据矩阵X 的列向量线性相关。因此,必有一个列向量可由其余列向量线性表示。 同时还有另外一种情况,即解释变量之间虽然不存在严格的线性关系,但是却有近似的线性关系,即解释变量之间高度相关。 2.多重共线性产生的原因 多元线性回归模型产生多重共线性的原因很多,主要有: (1)经济变量的内在联系 这是产生多重共线性的根本原因。 (2)解释变量中含有滞后变量 (3)经济变量变化趋势的“共向性” 必须指出,多重共线性基本上是一种样本现象。因为人们在设定模型时,总是尽量避免将理论上具有严格线性关系的变量作为解释变量收集在一起,因此,实际问题中的多重共线性并不是解释变量之间存在理论上或实际上的线性关系造成的,而是由所收集的数据(解释变量观察值)之间存在近似的线性关系所致。 (二)多重共线性的影响 多重共线性会产生以下问题: (1)增大了OLS 估计量的方差 (2)难以区分每个解释变量的单独影响 (3)回归模型缺乏稳定性 (4)t 检验的可靠性降低 (三)多重共线性的判别 在应用多元回归模型中,人们总结了许多检验多重共线性的方法。 1.系数判定法 计量经济学多元线性回归、多重共线性、异方差实验报告记录 ————————————————————————————————作者:————————————————————————————————日期: 计量经济学实验报告 多元线性回归、多重共线性、异方差实验报告 一、研究目的和要求: 随着经济的发展,人们生活水平的提高,旅游业已经成为中国社会新的经济增长点。旅游产业是一个关联性很强的综合产业,一次完整的旅游活动包括吃、住、行、游、购、娱六大要素,旅游产业的发展可以直接或者间接推动第三产业、第二产业和第一产业的发展。尤其是假日旅游,有力刺激了居民消费而拉动内需。2012年,我国全年国内旅游人数达到亿人次,同比增长%,国内旅游收入万亿元,同比增长%。旅游业的发展不仅对增加就业和扩大内需起到重要的推动作用,优化产业结构,而且可以增加国家外汇收入,促进国际收支平衡,加强国家、地区间的文化交流。为了研究影响旅游景区收入增长的主要原因,分析旅游收入增长规律,需要建立计量经济模型。 影响旅游业发展的因素很多,但据分析主要因素可能有国内和国际两个方面,因此在进行旅游景区收入分析模型设定时,引入城镇居民可支配收入和旅游外汇收入为解释变量。旅游业很大程度上受其产业本身的发展水平和从业人数影响,固定资产和从业人数体现了旅游产业发展规模的内在影响因素,因此引入旅游景区固定资产和旅游业从业人数作为解释变量。因此选取我国31个省市地区的旅游业相关数据进行定量分析我国旅游业发展的影响因素。 二、模型设定 根据以上的分析,建立以下模型 Y=β 0+β 1 X 1 +β 2 X 2 +β 3 X 3 +β 4 X 4 +Ut 参数说明: Y ——旅游景区营业收入/万元 X 1 ——旅游业从业人员/人 X 2 ——旅游景区固定资产/万元 X 3 ——旅游外汇收入/万美元 X 4 ——城镇居民可支配收入/元 解决多元线性回归中多重共线性问题的方法分析 谢小韦,印凡成 河海大学理学院,南京 (210098) E-mail :xiexiaowei@https://www.360docs.net/doc/af9761021.html, 摘 要:为了解决多元线性回归中自变量之间的多重共线性问题,常用的有三种方法: 岭回 归、主成分回归和偏最小二乘回归。本文以考察职工平均货币工资为例,利用三种方法的 SAS 程序进行了回归分析,根据分析结果总结出三种方法的优缺点,结果表明如果能够使用 定性分析和定量分析结合的方法确定一个合适的k 值,则岭回归可以很好地消除共线性影 响;主成分回归和偏最小二乘回归采用成份提取的方法进行回归建模,由于偏最小二乘回归 考虑到与因变量的关系,因而比主成分回归更具优越性。 关键词:多重共线性;岭回归;主成分回归;偏最小二乘回归 1. 引言 现代化的工农业生产、社会经济生活、科学研究等各个领域中,经常要对数据进行分析、 拟合及预测,多元线性回归是常用的方法之一。多元线性回归是研究多个自变量与一个因变 量间是否存在线性关系,并用多元线性回归方程来表达这种关系,或者定量地刻画一个因变 量与多个自变量间的线性依存关系。 在对实际问题的回归分析中,分析人员为避免遗漏重要的系统特征往往倾向于较周到地 选取有关指标,但这些指标之间常有高度相关的现象,这便是多变量系统中的多重共线性现 象。在多元线性回归分析中,这种变量的多重相关性常会严重影响参数估计,扩大模型误差, 破坏模型的稳健性,从而导致整体的拟合度很大,但个体参数估计值的t 统计量却很小,并 且无法通过检验。由于它的危害十分严重,存在却又十分的普遍,因此就要设法消除多重线 性的不良影响。 常用的解决多元线性回归中多重共线性问题的模型主要有主成分回归、岭回归以及偏最 小二乘回归。三种方法采用不同的方法进行回归建模,决定了它们会产生不同的效果。本文 以统计职工平均货币工资为例,考察一组存在共线性的数据,运用SAS 程序对三种回归进 行建模分析,并对结果进行比较,总结出它们的优势与局限,从而更好地指导我们解决实际 问题。 2. 共线性诊断 拟合多元线性回归时,自变量之间因存在线性关系或近似线性关系,隐蔽变量的显著性, 增加参数估计的方差,导致产生一个不稳定的模型,因此共线性诊断的方法是基于自变量的 观测数据构成的矩阵T x x 进行分析,使用各种反映自变量间相关性的指标。共线性诊断常 用统计量有方差膨胀因子VIF (或容限TOL )、条件指数和方差比例等。 一般认为:若VIF>10,说明模型中有很强的共线性关系;若条件指数值在10与30间 为弱相关,在30与100间为中等相关,大于100为强相关;在大的条件指数中由方差比例 超过0.5的自变量构成的变量子集就认为是相关变量集[1]。 3. 三种解决方法 岭回归基本思想: 当出现多重共线性时,有0T X X ≈,从而使参数的1?()T T X X X Y β ?=很不稳定,出现不符合含义的估计值,给T X X 加上一个正常数矩阵(0)KI K >,则T X X KI +等 一、引言 回归分析是一种比较成熟的预测模型,也是在预测过程中使用较多的模型,在自然科学管理科学和社会经济中有着非常广泛的应用,但是经典的最小二乘估计,必需满足一些假设条件,多重共线性就是其中的一种。实际上,解释变量间完全不相关的情形是非常少见的,大多数变量都在某种程度上存在着一定的共线性,而存在着共线性会给模型带来许多不确定性的结果。 二、认识多重共线性 (一)多重共线性的定义 设回归模型01122p p y x x x ββββε=+++?++如果矩阵X 的列向量存在一组不全 为零的数012,,p k k k k ?使得011220i i p i p k k x k x k x +++?+=, i =1,2,…n ,则称其存在完全共线性,如果022110≈+?+++p i p i i x k x k x k k , i =1,2,…n ,则称其存在 近似的多重共线性。 (二)多重共线性的后果 1.理论后果 对于多元线性回归来讲,大多数学者都关注其估计精度不高,但是多重共线性不可 能完全消除,而是要用一定的方法来减少变量之间的相关程度。多重共线性其实是由样本容量太小所造成的后果,在理论上称作“微数缺测性”,所以当样本容量n 很小的时候,多重共线性才是非常严重的。 多重共线性的理论后果有以下几点: (1)保持OLS 估计量的BLUE 性质; (2) 戈德伯格提出了近似多重共线性其实是样本观测数刚好超过待估参数个数时出现的 情况。所以多重共线性并不是简单的自变量之间存在的相关性,也包括样本容量的大小问题。 (3)近似的多重共线性中,OLS 估计仍然是无偏估计。无偏性是一种多维样本或重复抽样 的性质;如果X 变量的取值固定情况下,反复对样本进行取样,并对每个样本计算OLS 估计量,随着样本个数的增加,估计量的样本值的均值将收敛于真实值。 (4)多重共线性是由于样本引起的。即使总体中每一个X 之间都没有线性关系,但在具体 取样时仍存在样本间的共线性。 2.现实后果 (1)虽然存在多重共线性的情况下,得到的OLS 估计是BLUE 的,但有较大的方差和协方差, 估计精度不高; (2)置信区间比原本宽,使得接受0H 假设的概率更大; 定义:线性回归模型中的解释变量有多个。一般表现形式:多元线性回归模型k :解释变量个数;i =1,2…,n βj :回归参数(Regression Coefficient );j=1,2…,k 习惯上:把常数项看成为一虚变量的系数,该虚变量的样本观测值始终取1。这样: i ki k i i i X X X Y μββββ++???+++=22110虚变量 X 0=1模型中解释变量的数目为(k+1) 指2个或2个以上 多元线性回归模型总体回归函数的随机表达形式: i ki k i i i X X X Y μββββ++???+++=22110总体回归函数非随机表达式: ki k i i ki i i i X X X X X X Y E ββββ+???+++=2211021),,|( 偏回归系数βj :在其他解释变量保持不变的情况下,X j 每变化1个单位时,Y 的均值E(Y)的变化;或者说X j 的单位变化对Y 均值的“直接”或“净”(不含其他变量)影响。 方程表示:各变量X 值给定时Y 的平均响应。 总体回归模型n 个随机方程的矩阵表达式为 μ X βY +=)1(212221212111111+?????????????=k n kn n n k k X X X X X X X X X X 121????? ????????=n n Y Y Y Y 1)1(210?+????????????????=k k ββββ β1 21?????????????=n n μμμ μ其中n :样本容量k :解释变量的个数 e i 称为残差或剩余项(Residuals),μi 的近似替代样本回归函数: ki ki i i i X X X Y ββββ?????22110++++= 其随机表示式: i ki ki i i i e X X X Y +++++=ββββ????22110 βX Y ??=e βX Y +=???????? ??=k βββ????10 β?????? ? ??=n e e e 21e 其中 或样本回归函数的矩阵表达: 多重共线性的解决之 法 第七章多重共线性 教学目的及要求: 1、重点理解多重共线性在经济现象中的表现及产生的原因和后果 2、掌握检验和处理多重共线性问题的方法 3、学会灵活运用Eviews软件解决多重共线性的实际问题。 第一节多重共线性的产生及后果 一、多重共线性的含义 1、含义 在多元线性回归模型经典假设中,其重要假定之一是回归模型的解释变量之间不存在线性关系,也就是说,解释变量X1,X2,……,X k中的任何一个都不能是其他解释变量的线性组合。如果违背这一假定,即线性回归模型中某一个解释变量与其他解释变量间存在线性关系,就称线性回归模型中存在多重共线性。多重共线性违背了解释变量间不相关的古典假设,将给普通最小二乘法带来严重后果。 2、类型 多重共线性包含完全多重共线性和不完全多重共线性两种类型。 (1)完全多重共线性 完全多重共线性是指线性回归模型中至少有一个解释变量可以被其他解释变量线性表示,存在严格的线性关系。 如对于多元线性回归模型 i ki k i i i X X X Y μββββ+++++= 22110 (7- 1) 存在不全为零的数k λλλ,,,21 ,使得下式成立: 0X X X 2211=+++ki k i i λλλ (7-2) 则可以说解释变量k X ,,X ,X 21 之间存在完全的线性相关关系,即存在完全多重共 线性。 从矩阵形式来看,就是0'=X X , 即1)(- 实验六-多元线性回归和多重共线性 实验六多元线性回归和多重共线性 姓名:何健华 学号:201330110203 班级:13金融数学2班 一 实验目的: 掌握多元线性回归模型的估计方法、掌握多重共线性模型的识别和修正。 二 实验要求: 应用教材P140例子4.3.1案例做多元线性回归模型,并识别和修正多重共线性。 三 实验原理: 普通最小二乘法、简单相关系数检验法、综合判断法、逐步回归法。 四 预备知识: 最小二乘法估计的原理、t 检验、F 检验、R 2值。 五 实验步骤: 有关的研究分析表明,影响国内旅游市场收入的主要因素,除了国内旅游人数和旅游支出外,还可能与基础设施有关。因此考虑影响国内旅游收入Y (单位为亿元)的以下几个因素:国内旅游人数X1、城镇居民人均旅游支出X2(单位为元)、农村居民人均旅游支出X3(单位为元)、并以公路里程X4(单位为万公里)和铁路里程X5(单位为万公里)作为相关设施的代表,根据这些变量建立如下的计量经济模型: 01122334455y x x x x x ββββββμ=++++++ 为了估计上述模型,从《中国统计年鉴》收集到1994年到2003年的有关统计数据。 Year Y X1 X2 X3 X4 X5 1994 1023.5 52400 414.7 54.9 111.78 5.9 1995 1375.7 62900 464 61.5 115.7 5.97 1996 1638.4 63900 534.1 70.5 118.58 6.49 1997 2112.7 64400 599.8 145.7 122.64 6.6 1998 2391.2 69450 607 197 127.85 6.64 实验八:主成分回归 实验题目:对例5.5的Hald水泥问题用主成分方法建立模型,并与其他方法的结果进行比较。 例5.5如下:本例为回归经典的Hald水泥问题。某种水泥在凝固时放出的热量y(卡/克,cal/g)与水泥中的四种化学成分的含量(%)有关,这四种化学成分分别是x1铝酸三钙(3CaO.Al2O3),x2硅酸三钙(3CaO.SiO2),x3铁铝酸四钙(4CaO.Al2O3.Fe2O3),x4硅酸三钙(2CaO.SiO2)。现观测到13组数据,如表5-3所示。 表5-3 实验目的: SPSS输出结果及答案: 一、主成分法: 多重共线性诊断: 已提取了 4 个成份。 由解释的总方差表中累计贡献性知,f1和f2的累计贡献性就在85%~95%之间。所以主成分取f1,f2。 得到因子得分的数值,并对其进行处理:sqrt(2.236)*FAD1_1,sqrt(1.576)*FAD2_1可以得出 主成分表(f1 f2)。 对f1 f2进行普通最小二乘线性回归 f1=-0.643+0.081x1+0.036x2-0.062x3-0.033x4 对f2和x1x2x3x4进行回归 模型非标准化系数标准系数 t Sig. B 标准误差试用版 1 (常量) -.938 .000 -1119037.661 .000 x1 -.087 .000 -.405 -9710099.545 .000 x2 .027 .000 .330 3071727.057 .000 x3 .094 .000 .482 10459854.955 .000 x4 -.027 .000 -.359 -3177724.589 .000 a.因变量: f2 f2=-0.938-0.087x1+0.027x2+0.094x3-0.027x4 一、作业 教材P214 三。 二、自我练习 (一)教材P213 一。 (二)是非题 1.当一组资料的自变量为分类变量时,对这组资料不能做多重线性回归分析。( ) 2.若多重线性方程模型有意义.则各个偏回归系数也均有统计学意义。〔) 3.回归模型变量的正确选择在根本上依赖于所研究问题本身的专业知识。() 4.从各自变量偏回归系数的大小.可以反映出各自变量对应变量单位变化贡献的大小。( ) 5.在多元回归中,若对某个自变量的值都增加一个常数,则相应的偏回归系数不变。( ) (三)选择题 1. 多重线性回归分析中,共线性是指(),导致的某一自变量对Y的作用可以由其他自变量的线性函数表示。 A. 自变量相互之间存在高度相关关系 B. 因变量与各个自变量的相关系数相同 C. 因变量与自变量间有较高的复相关关系 D. 因变量与各个自变量之间的回归系数相同 2. 多重线性回归和Logistic 回归都可应用于()。 A. 预测自变量 B. 预测因变量Y 取某个值的概率π C. 预测风险函数h D. 筛选影响因素(自变量) 3.在多重回归中,若对某个自变量的值都增加一个常数,则相应的偏回归系数: A.不变 B.增加相同的常数 C.减少相同的常数 D.增加但数值不定 4.在多元回归中,若对某个自变量的值都乘以一个相同的常数k,则: A.该偏回归系数不变 B.该偏回归系数变为原来的 1/k倍 C.所有偏回归系数均发生改变 D.该偏回归系数改变,但数值不定 5.作多重线性回归分析时,若降低进入的F 界值,则进入方程的变量一般会: A.增多 B.减少 C.不变 D.可增多也可减少(四)筒答题 1.为什么要做多重线性回归分析? 岭回归分析 一、普通最小二乘估计带来的问题 当设计矩阵X 呈病态时,X 的列向量之间有较强的线性相关性,即解释变量间出现严重的多重共线性,在这种情况下,用普通最小二乘法估计模型参数,往往参 数估计的方差太大,即jj jj j L C 2)?var(σβ=很大,j β?就很不稳定,在具体取值上与真值有较大的偏差,有时会出现与实际经济意义不符的正负号。下面看一个例子,可以说明这一点。 假设已知1x ,2x 与y 的关系服从线性回归模型:ε+++=213210x x y ,给定1x ,2x 的10个值,如下表1,2行所示: 表7.1 然后用模拟的方法产生10个正态随机数,作为误差项ε,见表第3行。然后再由回归模型i i i i x x y ε+++=213210计算出10个i y 值,见表第4行。现在假设回归系数与误差项是未知的,用普通最小二乘法求回归系数的估计得:0 ?β=11.292,1?β=11.307,2 ?β=-6.591,而原模型的参数0β=10,1β=2,2β=3看来相差太大。计算1x ,2x 的样本相关系数得12r =0.986,表明1x 与2x 之间高度相关。通过这个例子可以看到解释变量之间高度相关时,普通最小二乘估计明显变坏。 二、岭回归的定义 当自变量间存在多重共线性,|X X '|≈0时,设想给X X '加上一个正常数矩阵kI (k>0)那么X X '+kI 接近奇异的程度就会比X X '接近奇异的程度小得多。考虑到变量的量纲问题,先要对数据标准化,标准化后的设计矩阵仍用X 表示,定义y X kI X X k '+'=-1)()(?β称为β的岭回归估计,其中,k 称为岭参数。由于假设X 已经标准化,所以X X '就是自变量样本相关阵。y 可以标准化也可以未标准化, 如果y 也经过标准化,那么计算的实际是标准化岭回归估计。)(?k β 作为β的估计应比最小二乘估计β ?稳定,当k=0时的岭回归估计)0(?β就是普通的最小二乘估计。因为岭参数k 不是唯一确定的,所以得到的岭回归估计)(?k β 实际是回归参数β的一个估计族。 多重共线性和非线性回归的问题 (1)多重共线性问题 我们都知道在进行多元回归的时候,特别是进行经济上指标回归的时候,很多变量存在共同趋势相关性,让我们得不到希望的回归模型。这里经常用到的有三种方法,而不同的方法有不同的目的,我们分别来看看: 第一个,是最熟悉也是最方便的——逐步回归法。 逐步回归法是根据自变量与因变量相关性的大小,将自变量一个一个选入方法中,并且每选入一个自变量都进行一次检验。最终留在模型里的自变量是对因变量有最大显著性的,而剔除的自变量是与因变量无显著线性相关性的,以及与其他自变量存在共线性的。用逐步回归法做的多元回归分析,通常自变量不宜太多,一般十几个以下,而且你的数据量要是变量个数3倍以上才可以,不然做出来的回归模型误差较大。比如说你有10个变量,数据只有15组,然后做拟合回归,得到9个自变量的系数,虽然可以得到,但是精度不高。这个方法我们不仅可以找到对因变量影响显著的几个自变量,还可以得到一个精确的预测模型,进行预测,这个非常重要的。而往往通过逐步回归只能得到几个自变量进入方程中,有时甚至只有一两个,令我们非常失望,这是因为自变量很多都存在共线性,被剔除了,这时可以通过第二个方法来做回归。 第二个,通过因子分析(或主成分分析)再进行回归。 这种方法用的也很多,而且可以很好的解决自变量间的多重共线性。首先通过因子分析将几个存在共线性的自变量合为一个因子,再用因子分析得到的几个因子和因变量做回归分析,这里的因子之间没有显著的线性相关性,根本谈不上共线性的问题。通过这种方法可以得到哪个因子对因变量存在显著的相关性,哪个因子没有显著的相关性,再从因子中的变量对因子的载荷来看,得知哪个变量对因变量的影响大小关系。而这个方法只能得到这些信息,第一它不是得到一个精确的,可以预测的回归模型;第二这种方法不知道有显著影响的因子中每个变量是不是都对因变量有显著的影响,比如说因子分析得到三个因子,用这三个因子和因变量做回归分析,得到第一和第二个因子对因变量有显著的影响,而在第一个因子中有4个变量组成,第二个因子有3个变量组成,这里就不知道这7个变量是否都对因变量存在显著的影响;第三它不能得到每个变量对因变量准确的影响大小关系,而我们可以通过逐步回归法直观的看到自变量前面的系数大小,从而判断自变量对因变量影响的大小。 第三个,岭回归。 通过逐步回归时,我们可能得到几个自变量进入方程中,但是有时会出现自变量影响的方向出现错误,比如第一产业的产值对国民收入是正效应,而可能方程中的系数为负的,这种肯定是由于共线性导致出现了拟合失真的结果,而这样的结果我们只能通过自己的经验去判断。通常我们在做影响因素判断的时候,不仅希望得到各个因素对因变量真实的影响关系,还希望知道准确的影响大小,就是每个自变量系数的大小,这个时候,我们就可以通过岭回归的方法。 岭回归是在自变量信息矩阵的主对角线元素上人为地加入一个非负因子k,从而使回归系数的估计稍有偏差、而估计的稳定性却可能明显提高的一种回归分析方法,它是最小二乘法的一种补充,岭回归可以修复病态矩阵,达到较好的效果。在SPSS中没有提供岭回归的模块,可以直接点击使用,只能通过编程来实现,当然在SAS、Matlab中也可以实现。做岭回归的时候,需要进行多次调试,选择适当的k值,才能得到比较满意的方程,现在这个方法应用 第二章 回归分析概要 第五节 多元线性回归分析 一 模型的建立与假定条件 在一元线性回归模型中,我们只讨论了包含一个解释变量的一元线性回归模型,也就是假定被解释变量只受一个因素的影响。但是在现实生活中,一个被解释变量往往受到多个因素的影响。例如,商品的消费需求,不但受商品本身的价格影响,还受到消费者的偏好、收入水平、替代品价格、互补品价格、对商品价格的预测以及消费者的数量等诸多因素的影响。在分析这些问题的时候,仅利用一元线性回归模型已经不能够反映各变量间的真实关系,因此,需要借助多元线性回归模型来进行量化分析。 1. 多元线性回归模型的基本概念 如果一个被解释变量(因变量)t y 有k 个解释变量(自变量)tj x ,k j ,...,3,2,1=, 同时,t y 不仅是tk x 的线性函数,而且是参数0β和k i i ,...3,2,1=,β(通常未知)的线性函数,随即误差项为t u ,那么多元线性回归模型可以表示为: ,...22110t tk k t t t u x x x y +++++=ββββ ),..,2,1(n t = 这里tk k t t t x x x y E ββββ++++=...)(22110为总体多元线性回归方程,简称总体回归方程。 其中,k 表示解释变量个数,0β称为截距项,k βββ...21是总体回归系数。k i i ,...3,2,1=,β表示在其他自变量保持不变的情况下,自变量tj X 变动一个单位所引起的因变量Y 平均变动的数量,因而也称之为偏回归系数。 当给定一个样本n t x x x y tk t t t ,...2,1),,...,,(21=时,上述模型可以表示为: ???? ??? ???????????+++++=+++++=+++++=+++++=t tk k t t t k k k k k k u x x x y u x x x y u x x x y u x x x y ββββββββββββββββ (22110333223110322222211021112211101) 此时,t y 与tj x 已知,i β与t u 未知。 其相应的矩阵表达式为: 实验六多元线性回归和多重共线性 姓名:何健华 学号:201330110203 班级:13金融数学2班 一 实验目的: 掌握多元线性回归模型的估计方法、掌握多重共线性模型的识别和修正。 二 实验要求: 应用教材P140例子4.3.1案例做多元线性回归模型,并识别和修正多重共线性。 三 实验原理: 普通最小二乘法、简单相关系数检验法、综合判断法、逐步回归法。 四 预备知识: 最小二乘法估计的原理、t 检验、F 检验、R 2值。 五 实验步骤: 有关的研究分析表明,影响国内旅游市场收入的主要因素,除了国内旅游人数和旅游支出外,还可能与基础设施有关。因此考虑影响国内旅游收入Y (单位为亿元)的以下几个因素:国内旅游人数X1、城镇居民人均旅游支出X2(单位为元)、农村居民人均旅游支出X3(单位为元)、并以公路里程X4(单位为万公里)和铁路里程X5(单位为万公里)作为相关设施的代表,根据这些变量建立如下的计量经济模型: 01122334455y x x x x x ββββββμ=++++++ 为了估计上述模型,从《中国统计年鉴》收集到1994年到2003年的有关统计数据。 Year Y X1 X2 X3 X4 X5 1994 1023.5 52400 414.7 54.9 111.78 5.9 1995 1375.7 62900 464 61.5 115.7 5.97 1996 1638.4 63900 534.1 70.5 118.58 6.49 1997 2112.7 64400 599.8 145.7 122.64 6.6 1998 2391.2 69450 607 197 127.85 6.64 1999 2831.9 71900 614.8 249.5 135.17 6.74 2000 3175.5 74400 678.6 226.6 140.27 6.87 2001 3522.4 78400 708.3 212.7 169.8 7.01 2002 3878.4 87800 739.7 209.1 176.52 7.19 2003 3442.3 87000 684.9 200 180.98 7.3 1、 请用普通最小二乘方法估计模型参数; 2、 检验模型是否存在多重共线性,如果存在共线性,试采用适当的方法消除共线性。 解决多重共线性之岭回归分析 展开全文 上篇文章,我们介绍了几种处理共线性的方法。比如逐步回归法、手动剔除变量法是最常使用的方法,但是往往使用这类方法会剔除掉我们想要研究的自变量,导致自己希望研究的变量无法得到研究。因而,此时就需要使用更为科学的处理方法即岭回归。 岭回归岭回归分析(Ridge Regression)是一种改良的最小二乘法,其通过放弃最小二乘法的无偏性,以损失部分信息为代价来寻找效果稍差但回归系数更符合实际情况的模型方程。 简单来说,当方程变量中存在共线性时,一个变量的变化也会导致其他变量改变。岭回归就是在原方程的基础上加入了一个会产生偏差,但可以保证回归系数稳定的正常数矩阵KI。虽然会导致信息丢失,但可以换来回归模型的合理估计。分析步骤岭回归分析步骤共为2步:(1)结合岭迹图寻找最佳K值;(2)输入K值进行回归建模。 第一步:拖入数据,生成岭迹图,寻找最合适的K值。 SPSSAU岭迹图 K值的选择原则是各个自变量的标准化回归系数趋于稳定时的最小K值。K值越小则偏差越小,当K值为0时则为普通线性OLS回归;SPSSAU提供K值智能建议,也可通过主观识别判断选择K值。 第二步:对于K值,其越小越好,通常建议小于1;确定好K值后,即可输入K值,得出岭回归模型估计,查看分析结果。 岭回归分析案例(1)背景 现测得胎儿身高、头围、体重和胎儿受精周龄数据,希望建立胎儿身高、头围、体重去和胎儿受精周龄间的回归模型。根据医学常识情况(同时结合普通线性最小二乘法OLS回归测量),发现三个自变量之间有着很强的共线性,VIF值高于200;可知胎儿身高、体重之间肯定有着很强的正相关关系,多元线性回归中多重共线问题的解决方法综述

第七章 多共线性及其处理

计量经济学多元线性回归、多重共线性、异方差实验报告记录

解决多元线性回归中多重共线性问题的方法分析

岭回归解决多重共线性

多元线性回归概述

最新多重共线性的解决之法

实验六-多元线性回归和多重共线性

主成分回归多重共线性

多重线性回归分析

岭回归分析

多重共线性和非线性回归及解决方法

回归分析概要(多元线性回归模型)

实验六多元线性回归和多重共线性

解决多重共线性之岭回归分析