Some computable Wiener-Hopf determinants and polynomials orthogonal on an arc of the unit c

匈牙利算法 计算机题目

匈牙利算法计算机题目摘要:1.匈牙利算法的概述2.匈牙利算法的应用领域3.匈牙利算法在计算机题目中的应用实例4.如何使用匈牙利算法解决计算机题目5.结论正文:一、匈牙利算法的概述匈牙利算法(Hungarian algorithm)是一种求解二分图最大匹配问题的算法,由匈牙利数学家Mátéi Kálmán 于1937 年提出。

该算法采用贪心策略,通过不断迭代寻找图中未被匹配的顶点,并将其与待匹配的顶点配对,直到所有顶点都被匹配或者无法找到匹配的顶点为止。

匈牙利算法在计算机科学、运筹学、图论等领域具有广泛的应用。

二、匈牙利算法的应用领域1.任务分配:在项目管理中,可以将任务分配给具有不同技能和时间的团队成员,以实现最优任务分配。

2.资源调度:在资源有限的情况下,通过匈牙利算法可以实现最优资源调度,提高资源利用率。

3.数据融合:在数据融合领域,匈牙利算法可以应用于数据融合和数据挖掘,提高数据分析效果。

4.社交网络:在社交网络中,匈牙利算法可以用于寻找最优好友推荐,提高用户满意度。

三、匈牙利算法在计算机题目中的应用实例以N 个学生和N 个课程为例,每个学生可以选择修习若干课程,每个课程有一定的容量限制。

要求通过匈牙利算法找到学生和课程之间的最大匹配数,使得每个学生的课程总容量不超过其限制,同时所有课程都被充分使用。

四、如何使用匈牙利算法解决计算机题目1.构建邻接矩阵:根据题目中给出的学生和课程信息,构建一个N×N 的邻接矩阵,表示学生和课程之间的选择关系。

2.初始化匹配矩阵:初始化一个N×N 的匹配矩阵,用于记录学生和课程之间的匹配情况。

3.迭代寻找匹配:根据邻接矩阵和匹配矩阵,采用贪心策略迭代寻找未被匹配的顶点,并将其与待匹配的顶点配对,更新匹配矩阵。

4.判断匹配情况:当所有顶点都被匹配或者无法找到匹配的顶点时,迭代结束。

若所有顶点都被匹配,输出匹配矩阵;否则,输出无法找到匹配的顶点。

07844 人工智能导论

人工智能导论复习资料(课程代码:07844)知识点汇总:1.人工智能是一门综合性的交叉学科和边缘学科。

2.人工智能的含义最早由一位科学家于1950年提出,并且同时提出一个机器智能的测试模型,请问这个科学家是图灵。

3.人工智能的远期目标是制造智能机器,近期目标是实现机器智能。

4.要想让机器具有智能,必须让机器具有知识。

因此,在人工智能中有一个研究领域,主要研究计算机如何自动获取知识和技能,实现自我完善,这门研究分支学科叫机器学习。

5.编译原理不属于人工智能的研究的一个领域。

6.AI的英文缩写是Artifical intelligence。

7.“图灵实验”是为了判断一台机器是否具备智能的实验,实验由三个封闭的房间组成,分别放置主持人、参与人和机器。

8.语义网络表达知识时,有向弧AKO 链、ISA 链是用来表达节点知识的继承性。

9.(A->B)∧A => B是假言推理10.命题是可以判断真假的陈述句11.问题归约法是指已知初始问题的描述,通过一系列变换把此问题最终变为一个子问题集合,这些子问题的解可以直接得到,从而解决了初始问题。

12.仅个体变元被量化的谓词称为一阶谓词13.MGU是最一般合一14.关系不在人工智能系统的知识包含的4个要素中15.当前归结式是空子句时,则定理得证。

16.或图通常称为状态图17.不属于人工智能的学派是机会主义18.所谓不确定性推理就是从不确定性的初始证据出发,通过运用不确定性的知识,最终推出具有一定程度的不确定性但却是合理或者近乎合理的结论的思维过程。

( )19.用户不是专家系统的组成部分20.产生式系统的推理不包括简单推理21.C(B|A) 表示在规则A->B中,证据A为真的作用下结论B为真的信度22.在图搜索中,选择最有希望的节点作为下一个要扩展的节点,这种方法叫做有序搜索23.人工神经网络属于反馈网络的是BP网络24.使用一组槽来描述事件的发生序列,这种知识表示法叫做剧本表示法25.产生式系统的推理不包括简单推理26.从已知事实出发,通过规则库求得结论的产生式系统的推理方式是正向推理。

多层感知机计算响应函数例题

多层感知机计算响应函数例题

多层感知机(MLP)是一种人工神经网络,它由多个神经元组成的多层结构。

在MLP中,每个神经元与上一层的所有神经元连接,每个连接都有一个权重,而每个神经元还有一个偏置。

MLP通过前向传播和反向传播来进行训练和预测。

现在让我们来看一个简单的例题,来计算多层感知机的响应函数。

假设我们有一个包含两个输入特征的二分类问题,我们的MLP 有一个隐藏层,隐藏层有两个神经元,输出层有一个神经元。

我们使用Sigmoid激活函数。

首先,我们计算隐藏层的响应。

对于第一个隐藏层的第一个神经元,我们有:

z1 = w1 x1 + w2 x2 + b1。

其中w1和w2是输入特征的权重,x1和x2是输入特征的值,b1是偏置。

然后,我们将z1输入Sigmoid激活函数得到隐藏层第一个神经元的输出:

a1 = σ(z1)。

同样地,我们可以计算第一个隐藏层的第二个神经元的输出a2。

接下来,我们计算输出层的响应。

对于输出层的神经元,我们有:

z2 = w3 a1 + w4 a2 + b2。

其中w3和w4是隐藏层到输出层的权重,b2是输出层的偏置。

然后,我们将z2输入Sigmoid激活函数得到最终的输出:

ŷ = σ(z2)。

这个ŷ就是我们MLP对输入数据的预测。

这就是一个简单的多层感知机计算响应函数的例题。

通过这个

例子,我们可以看到多层感知机是如何通过权重和偏置以及激活函

数来计算并得出最终的预测结果的。

希望这个例子能帮助你更好地

理解多层感知机的工作原理。

综述Representation learning a review and new perspectives

explanatory factors for the observed input. A good representation is also one that is useful as input to a supervised predictor. Among the various ways of learning representations, this paper focuses on deep learning methods: those that are formed by the composition of multiple non-linear transformations, with the goal of yielding more abstract – and ultimately more useful – representations. Here we survey this rapidly developing area with special emphasis on recent progress. We consider some of the fundamental questions that have been driving research in this area. Specifically, what makes one representation better than another? Given an example, how should we compute its representation, i.e. perform feature extraction? Also, what are appropriate objectives for learning good representations?

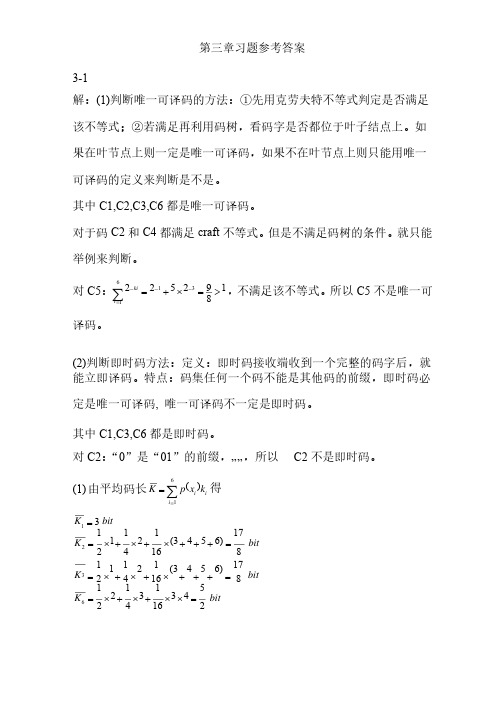

《信息论与编码》第三章部分习题参考答案

第三章习题参考答案第三章习题参考答案3-1解:(1)判断唯一可译码的方法:①先用克劳夫特不等式判定是否满足该不等式;②若满足再利用码树,看码字是否都位于叶子结点上。

如果在叶节点上则一定是唯一可译码,如果不在叶节点上则只能用唯一可译码的定义来判断是不是。

可译码的定义来判断是不是。

其中C1,C2,C3,C6都是唯一可译码。

都是唯一可译码。

对于码C2和C4都满足craft 不等式。

但是不满足码树的条件。

但是不满足码树的条件。

就只能就只能举例来判断。

举例来判断。

对C5:61319225218ki i ---==+´=>å,不满足该不等式。

所以C5不是唯一可译码。

译码。

(2)判断即时码方法:定义:即时码接收端收到一个完整的码字后,就能立即译码。

特点:码集任何一个码不能是其他码的前缀,即时码必定是唯一可译码, 唯一可译码不一定是即时码。

唯一可译码不一定是即时码。

其中C1,C3,C6都是即时码。

都是即时码。

对C2:“0”是“01”的前缀,……,所以C2不是即时码。

不是即时码。

(1) 由平均码长61()i i i K p x k ==å得1236 3 1111712(3456) 241681111712(3456) 2416811152334 24162K bitK bit K bitK bit==´+´+´+++==´+´+´+++==´+´+´´=62111223366()()log () 2 /()266.7%3()294.1%178()294.1%178()280.0%52i i i H U p u p u H U K H U K H U K H U K h h h h ==-=============å比特符号3-7解:(1)信源消息的概率分布呈等比级数,按香农编码方法,其码长集合为自然数数列1, 2, 3, ···, i, ·, i, ····;对应的编码分别为:0, 10, 110, ···, 111…110 ( i 110 ( i –– 1个1), ·1), ····。

第五章霍普菲尔德(Hopfield)神经网络

反馈网络(Recurrent Network),又称自联 想记忆网络,如下图所示:

x1

x2

x3

y1

y2

y3

图 3 离散 Hopfield 网络

考虑DHNN的节点状态,用yj(t)表示第j个神经元,即节点j在时 刻t的状态,则节点的下一个时刻t+1的状态可以求出如下:

1, u j (t) 0 y j (t 1) f[u j (t)] 0, u j (t) 0 u j (t) w i, j y i (t) x j θ j

在不考虑外部输入时,则有

j 1,2,..., n

n y j (t 1) f w i, j yi (t) θ j i 1

•通常网络从某一初始状态开始经过多次更新后才可 能达到某一稳态。使用异步状态更新策略有以下优点: (1)算法实现容易,每个神经元节点有自己的状态 更新时刻.不需要同步机制; (2)以串行方式更新网络的状态可以限制网络的输 出状态,避免不同稳态以等概率出现。 一旦给出HNN的权值和神经元的阈值,网络的状态转 移序列就确定了。

5.2 离散Hopfield网络

• Hopfield最早提出的网络是神经元的输出为 0-1二值的NN,所以,也称离散的HNN (简称为 DHNN).

–下面分别讨论DHNN的

• • • • 结构 动力学稳定性(网络收敛性) 联想存储中的应用 记忆容量问题

人工智能一选择题

人工智能一选择题一、名词说明1.专家体系2.产生式3.启发式搜刮4.归结道理5.原子集二、选择题1.非构造化的常识的表示法是()。

A. 语义收集表示B. 谓词逻辑表示C. 框架表示法中D. 面向对象表示2.归结策略中,()是完全的。

Ⅰ. 线性输入策略Ⅱ. 支撑集策略Ⅲ. 单文字策略Ⅳ. 祖先过滤策略A. Ⅰ,ⅡB. Ⅰ, ⅢC. Ⅱ, ⅣD. Ⅲ, Ⅳ3.在证据理论中,信任函数与似然函数对(Bel(A),Pl(A))的值为(0,0)时,表示()。

A. A为真B. 对A一窍不通C. A为假D. 对A为真有必定信任4.在主不雅Bayes方法中,专家给出的Ln和LS值,不克不及显现下两种情形()。

Ⅰ. LN<1, LS<1 Ⅱ. LN<1, LS>1 Ⅲ. LN>1, LS<1 Ⅳ. LN>1, LS>1A. Ⅰ,ⅡB. Ⅱ, ⅢC. Ⅰ, ⅣD. Ⅱ, Ⅳ5.在证据理论中,信任函数与似然函数的关系为()。

A. Bel(A)≤Pl(A)B. Bel(A)<Pl(A)C. Bel(A)≥Pl(A)D. Bel(A)>Pl(A)6.不完全的搜刮过程是()A.广度优先搜刮 B.深度优先搜刮C.有界深度优先搜刮 D.价值树广度优先搜刮7.在主不雅Bayes方法中,规矩E→H,有LS=LN=1,这意味:()A.E对H 没有阻碍B. E支撑HC. -E支撑HD. E支撑-H8.在可托度方法中,若证据A的可托度CF(F)=0, 这意味:()A. 证据A弗成信B. 对证据A一窍不通C. 证据A可托D.没有意义9.人工智能研究的范畴不包含()。

A. 天然说话明白得B. 主动法度榜样设计C. 法度榜样设计方法D. 主动定理证实10.用归结反演证实定理时,若当前归结式为(),则定理得证A.永真式B.包含式(subsumed)C.原子谓词D.空子句11.在主不雅 Bayes方法中,证据E支撑结论H时,有()。

薛定谔—麦克斯韦尔方程径向解的存在性和多重性(英文)

In 1887, the German physicist Erwin Schrödinger proposed a radial solution to the Maxwell-Schrödinger equation. This equation describes the behavior of an electron in an atom and is used to calculate its energy levels. The radial solution was found to be valid for all values of angular momentum quantum number l, which means that it can describe any type of atomic orbital.The existence and multiplicity of this radial solution has been studied extensively since then. It has been shown that there are infinitely many solutions for each value of l, with each one corresponding to a different energy level. Furthermore, these solutions can be divided into two categories: bound states and scattering states. Bound states have negative energies and correspond to electrons that are trapped within the atom; scattering states have positive energies and correspond to electrons that escape from the atom after being excited by external radiation or collisions with other particles.The existence and multiplicity of these solutions is important because they provide insight into how atoms interact with their environment through electromagnetic radiation or collisions with other particles. They also help us understand why certain elements form molecules when combined together, as well as why some elements remain stable while others decay over time due to radioactive processes such as alpha decay or beta decay.。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

Unfortunately, the associated orthogonal polynomials on the interval [−1, 1] are not explicitly known. On the other hand, many systems of orthogonal polynomials on an interval have been extensively investigated. Thus, taking various w (x) for which the associated polynomials are known, we can hope to obtain the corresponding Wiener-Hopf determinants. However, for most known weight functions w (x) the limit limn→∞ Dn (f ) does not have proper convergence. So it is only in very special cases that we get Wiener-Hopf determinants. Those we calculate correspond to √ 1 − x2 , r ≥ 0. (4) w (x) = 1 − γ 2r2 x2 3

arXiv:math/0310172v1 [math.FA] 12 Oct 2003

Some computable Wiener-Hopf determinants and polynomials orthogonal on an arc of the unit circle.

I. V. Krasovsky

1

1

Introduction

1 2π

∞ −∞

Let σ (x) be an integrable function on the real line and K (x) = δ (x) − e−iξx σ (ξ )dξ.

The Wiener-Hopf operator on L2 (0, 2s) corresponding to the symbol σ (ξ ) is defined by its kernel K (x) as follows: (W (σ )g )(x) =

2π 0

e−i(j −k)θ f (θ)dθ,

j, k = 0, 1, . . . , n.

(3)

We denote the associated Toeplitz determinant by Dn (f ) = det Tn (f ). There are many examples of Toeplitz determinants for which an explicit expression for all n can be given. One reason for this is a simple relation between Toeplitz matrices and orthogonal polynomials (see below). The situation in the Wiener-Hopf case is more complicated. In the present paper we calculate some Wiener-Hopf determinants whose symbols are zero on an interval. Note that the known variants of the strong Szeg˝ o limit theorem, which gives large s asymptotics of Wiener-Hopf determinants (see [1, 2, 3]), are not valid in this case. The asymptotics of our Wiener-Hopf determinants 2 have the factor e−s /2 in them, and in that, resemble the asymptotics of Toeplitz determinants with symbols f (θ) on circular arcs found by Widom [4]. This reflects the fact that, in both cases, the symbols are zero on intervals (on (−α, α), 0 < α < π , for f (θ) [4], and on (−1, 1) for σ (ξ ) in our examples). 2

Technische Universit¨ at Berlin Institut f¨ ur Mathematik MA 7-2 Strasse des 17. Juni 136, D-10623, Berlin, Germany E-mail: ivk@math.tu-berlin.de

Abstract. Some Wiener–Hopf determinants on [0, s] are calculated explicitly for all s > 0. Their symbols are zero on an interval and they are related to the determinant with the sine-kernel appearing in the random matrix theory. The determinants are calculated by taking limits of Toeplitz determinants, which in turn are found from the related systems of polynomials orthogonal on an arc of the unit circle. As is known, the latter polynomials are connected to those orthogonal on an interval of the real axis. This connection is somewhat extended here. The determinants we compute originate from the Bernstein-Szeg˝ o (in particular Chebyshev) orthogonal polynomials.

2s 0

(δ (x − y ) − K (x − y ))g (y )dy.

(1)

If I − W (σ ) is of trace class there exists the determinant (see, e.g., [1]):

s det W = |δ (x − y ) − K (x − y )|2 0 .

2 /2

s−1/4 21/12 e3ζ (−1) (1 + Ohere ζ ′ (x) is the derivative of Riemann’s zeta function. Note that appear′ ance of the constant 21/12 e3ζ (−1) has not yet been rigorously justified. To get our results, we use the following observations: 1) Some Wiener-Hopf determinants can be obtained as the n → ∞ limit of Toeplitz ones Dn (f ) if f (θ) is allowed to depend on n [7, 2]. For example, if f (θ) = f0 (θ) = 1 on the arc α ≤ θ ≤ 2π − α, α = 2s/n, and otherwise f0 (θ) = 0, we have limn→∞ Dn (f0 ) = det W0 . 2) Dn (f ) can be easily obtained given the polynomials Φn (eiθ ) orthogonal on the unit circle with the weight function f (θ) (see [10] and Lemma 3.1). 3) Suppose f (θ) is symmetric (f (θ) = f (2π − θ)). Then, by the formulas of Szeg˝ o, f (θ) and the polynomials Φn (eiθ ) are related to a weight function w (x) on the interval [−1, 1] and the orthogonal polynomials associated with it. A variant of this connection simplified and adopted for weights f (θ) on an arc and symmetric w (x) (w (x) = w (−x)) is Lemma 2.1 below (cf. [15]). The Wiener-Hopf determinant for the kernel sin x/πx corresponds to w (x) = (1 − γ 2 x2 )−1/2 , s γ = cos . n

In this case the polynomials can be explicitly written in terms of BernsteinSzeg˝ o polynomials. The corresponding function f (θ) is asymptotically (n → ∞) 1 on the unit circle except for a small (of order 1/n) neighbourhood of θ = 0 (cf f0 (θ)). Our main result is Theorem 1.1 (Bernstein-Szeg˝ o Fredholm determinant.) Let the kernel KBS (r, z ) = Then sin z 1 − πz π