多元统计分析讲义(第四章)

应用多元统计分析课后习题答案高惠璇第四章部分习题解答

4

第四章 回归分析

令

L(a0 , 2 ) 2 2 L(a0 , ) 2 [( y1 a0 ) ( y2 a0 ) 3( y3 3a0 ) 0 a0 2

可得

令 ln L(a ˆ0 , 2 ) 3 1 2 ˆ [( y a ) ] 0 1 0 2 2 2 2 2 2( ) drf 可得 ˆ 2 1 2 ˆ0 ) 2 ( y2 a ˆ0 ) 2 ( y3 3a ˆ0 ) 2 ˆ0 ( y1 a

1

经验证:① B-A是对称幂等阵; ② rank(B-A)=tr(B-A)=2-1=1;

25 80 35 1 256 112 330 49

8

第四章 回归分析

③ A(B-A)=O3×3 .由第三章§3.1的结论6知

Y AY与Y ( B A)Y相互独立;也就是 ˆ ˆ 与 ˆ 相互独立.

ˆi y ˆ ) ( yi y )( y i 1

n n n i 1 i 1 2

R

2

2 2 ˆ ˆ ( y y ) ( y y ) i i

2 ˆi y ) ( y i 1

n n n i 1 i 1

2

2 2 ˆ ˆ ( y y ) ( y y ) i i

(因 1n C张成的空间 , 这里有H1n 1n )

n n i 1 i 1

(2) 因 ( yi y )( y ˆi y ˆ ) ( yi y ˆi y ˆ i y )( y ˆi y )

ˆ i )( y ˆi y ) ( y ˆi y )2 ( yi y

《多元统计分析》PPT课件

gi (Y ) 2y1i i1i

将上式中提-2,得

gi

(Y )

2(y

1 i

0.5i1i)

令 fi (Y ) (y1i 0.5i1i)

则距离判别法的判别函数为:

§2 距离判别

(一)马氏距离

距离判别的最直观的想法是计算样品到第i类 总体的平均数的距离,哪个距离最小就将它判 归哪个总体,所以,我们首先考虑的是是否能 够构造一个恰当的距离函数,通过样本与某类 别之间距离的大小,判别其所属类别。

设 x (x1, x2,, xm )和 y ( y1, y2,, ym ) 是从

样本,来检验方法是否稳定的问题。

判类

原类

G1 G2 Gk

G1

G2

合计

Gk

m11

m12

m1k

n1

m21

m22

m2k

n2

mk1

mk 2

mkk

nk

简单错判率:p

1 n

k i 1

k

mij

j 1

ji

加权错判率:

设qi是第i类的先验概率, pi是第i类的错判 概率,则加权错判率为

1 1

1

1 1

)

2y1(1 2 ) (1 2 )1(1 2 )

2[y

(1

2

2

)]1 (1

2

)

令 1 2

2

1(1 2 ) (a1, a2,, ap )

多元统计分析课后习题解答_第四章

多元统计分析课后习题解答_第四章(共12页)--本页仅作为文档封面,使用时请直接删除即可----内页可以根据需求调整合适字体及大小--第四章判别分析简述欧几里得距离与马氏距离的区别和联系。

答:设p维欧几里得空间中的两点X=和Y=。

则欧几里得距离为。

欧几里得距离的局限有①在多元数据分析中,其度量不合理。

②会受到实际问题中量纲的影响。

设X,Y是来自均值向量为,协方差为的总体G中的p维样本。

则马氏距离为D(X,Y)=。

当即单位阵时,D(X,Y)==即欧几里得距离。

因此,在一定程度上,欧几里得距离是马氏距离的特殊情况,马氏距离是欧几里得距离的推广。

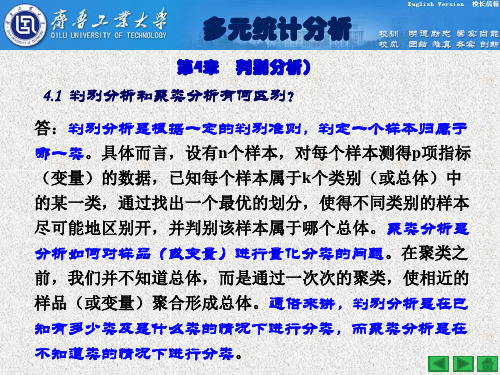

试述判别分析的实质。

答:判别分析就是希望利用已经测得的变量数据,找出一种判别函数,使得这一函数具有某种最优性质,能把属于不同类别的样本点尽可能地区别开来。

设R1,R2,…,Rk 是p 维空间R p 的k 个子集,如果它们互不相交,且它们的和集为,则称为的一个划分。

判别分析问题实质上就是在某种意义上,以最优的性质对p 维空间构造一个“划分”,这个“划分”就构成了一个判别规则。

简述距离判别法的基本思想和方法。

答:距离判别问题分为①两个总体的距离判别问题和②多个总体的判别问题。

其基本思想都是分别计算样本与各个总体的距离(马氏距离),将距离近的判别为一类。

①两个总体的距离判别问题设有协方差矩阵∑相等的两个总体G 1和G 2,其均值分别是1和 2,对于一个新的样品X ,要判断它来自哪个总体。

计算新样品X 到两个总体的马氏距离D 2(X ,G 1)和D 2(X ,G 2),则X ,D2(X ,G1)D 2(X ,G 2)X,D 2(X ,G 1)> D 2(X ,G 2, 具体分析,2212(,)(,)D G D G -X X111122111111111222*********()()()()2(2)2()-----------''=-----''''''=-+--+'''=-+-X μΣX μX μΣX μX ΣX X ΣμμΣμX ΣX X ΣμμΣμX ΣμμμΣμμΣμ11211212112122()()()2()22()2()---''=-++-'+⎛⎫=--- ⎪⎝⎭''=--=--X ΣμμμμΣμμμμX ΣμμX μααX μ 记()()W '=-X αX μ 则判别规则为X ,W(X)X ,W(X)<0②多个总体的判别问题。

应用多元统计分析-北大版-第四章

第四章 §4.1 经典多元线北性大数回学学归院

回归方程的显著性检验—定理4.1.3

定理4.1.3 在模型(4.1.3)下有

23

第四章 §4.1 经典多元线北性大数回学学归院

回归方程的显著性检验

为检验H0, Total SS=MSS+ESS

可构造检验假设的检验统计量F F= MSS / fm = MMS (模型均方)

我们假定E(Y)=β0+β1 x1+…+βmxm ,如果Y与x1, x2,. . , xm之间均无线性相关关系,则以上模型中 xi(i=1,2,…,m)的系数βi 应均为0.

17

第四章 §4.1 经典多元线北性大数回学学归院

回归方程的显著性检验

首先应检验以下假设:

H0: β1 = β2 =…..=βm = 0

E(Q(b)) E( P ) E(tr( P ))

E(tr(P )) tr[PE( )]

tr(P 2 In ) 2tr(P) 2 (n m 1) (定理4.1.2的证明) 16

第四章 §4.1 经典多元线北性大数回学学归院

回归方程的显著性检验

i 1

i 1

y

1 n

n i 1

yi

1xi1 m xim (i

(4.1.4) 1,, n).

19

第四章 §4.1 经典多元线北性大数回学学归院

回归方程的显著性检验--平方和分解公式

而β^=(C′C)-1C′Y是β的最小二乘估计. 公式(4.1.4)称为平方和分解公式. 平方和分解公式(4.1.4)的左边∑(yi-y)2体现了Y

北大数学学院

多元统计分析第4章作业题选讲

多元统计分析

解:由已知可得,

1 (1) 1 6 2 4 (2) x x 2 2 2 1 0.5

^

4 3 1 9 3 1 =S p 27 3 4 3 9 ^ ^ ^ ^ 1 9 3 4 1 1 a 1 2 27 3 4 3 0 x1 4 ^ ^ x 1 1 x 4 记x , 则W ( x) a x 1 1 x 0 x 2 2 2 6 6 当x , 则W ( x) 6 4=2 0 ,所以,x 属于总体G1. 0 0

i

1 令 W x a x μ ,其中 μ 2 μ1 μ2

i

i

a Σ 1 μ1 μ2 ,则上述判别规则可简化为:

x G1 , 若W x 0 x G2 , 若W x 0 待判, 若W x =0

由s≤min(k−1,p)知,组数k=2时只有一个判别式,k=3时最

多只有两个判别式,判别式的个数不可能超过原始变量的个 数p。

多元统计分析

第三步 写出判别式 第一判别式:y1=t1′x; 第二判别式:y2=t2′x;

一般地,第i判别式:yi=ti′x,i=1,2,⋯,s。

多元统计分析

(2)判别规则 选取前r(≤s)个判别式y1,y2,⋯,yr,使累计贡献率:

k

k

使ECM达到最小的判别规则:

k

l 1 l i

x l , 若 q j f j x C l | j min q j f j x C i | j

应用多元统计分析课后习题答案高惠璇第四章部分习题解答市公开课获奖课件省名师示范课获奖课件

0

2

)

3 2

(ˆ

2

)

3 2

ˆ 2 ˆ 0 2

3

2

V

3 2

下列来讨论与V等价旳统计量分布:

ˆ 2

1 3

( y1

aˆ)2

( y2

2aˆ

bˆ)2

( y3

aˆ

2bˆ)2

1 3

( y1

yˆ1 ) 2

( y2

yˆ2 )2

( y3

yˆ3 )2

1 3

(Y

Xˆ )(Y

Xˆ )

1Y 3

(I3

X

(

X

X

)1

Q(β)=(Y-Cβ) '(Y-Cβ) . 试证明β^=(C'C)-1C'Y是在下列四种意义下达最小:

(1) trQ(β^)≤trQ(β) (2) Q(β^)≤Q(β) (3) |Q(β^)|≤|Q(β)|

(4) ch1(Q(β^))≤ch1(Q(β)),其中ch1(A)表达A

旳最大特征值. 以上β是(m+1)×p旳任意矩阵.

[(

y1

aˆ0

)2

]

0

可得

ˆ

2

1 3

( y1

aˆ0 )2

( y2

aˆ0 )2

( y3

3aˆ0 )2

drf

ˆ

2 0

似然比统计量旳分子为

L(aˆ0

,ˆ

2 0

)

(2

)

3 2

(ˆ 0 2

)

3 2

exp[

3 2

].

5

第四章 回归分析

似然比统计量为

L(aˆ0 ,ˆ02 ) L(aˆ,bˆ,ˆ 2 )

应用多元统计分析-第四章 均值向量和协差阵检验

假设检验的过程-以妇女身高为例

形式上,上面的关于总体均值的H0 相对 于H1的检验记为:

H 0 : 160cm H1 : 160cm

我们将 H1 : 160cm 的假设称为双 尾检验 ,即前面说述的假设检验。

假设检验的过程-以妇女身高为例

如果备选假设为: H1 : 160cm

第三,确定显著性水平 根据样本所得的数据来拒绝零假设的概 率应小于0.05,当然也可能是0.01, 0.005,0.001等等。 显著性水平就是小概率水平,但小概率 并不能说明不会发生,仅仅是发生的概 率很小罢了。拒绝正确零假设的错误常 被称为第一类错误(type I error)。

假设检验的过程

有第一类错误,就有第二类错误; 那是备选假设正确时反而说零假设正确 的错误,称为第二类错误(type II error)。 在一般的假设检验问题中,由于备选假 设往往不是一个点,所以无法算出犯第 二类错误的概率。

假设检验的过程

第四,根据数据计算检验统计量的实现 值(t-值)和根据这个实现值计算p-值; 这一步一般都可由计算机软件来完成。 第五,进行判断:如果p-值小于或等于a, 就拒绝零假设,这时犯错误的概率最多 为 ;如果p-值大于 ,就不拒绝零假 设,因为证据不足。

这就是双尾概率,p值为0.045,即p=4.5%

假设检验的过程-以妇女身高为例

首先要提出一个原假设,如妇女身高的 均值等于160cm( 160cm )。这种原假 设也称为零假设(null hypothesis),记 为H0。 与此同时必须提出对立假设,如妇女身 高均值不等于160cm( 160cm )。对立 假设又称为备选假设或备择假设 (alternative hypothesis)记为H1。

《多元统计分析讲义》第四章判别分析

**

**

目录 上页 下页 返回 结束

§4.6 判别分析方法步骤及框 图 研究者首先应该关注被解释变量。被解释变量的组数可以是

两个或更多,但这些组必须具有相互排斥性和完全性。被解 释变量有时确实是定性的变量。然而也有一些情况,即使被 解释变量不是真的定性变量,判别分析也是适用的。我们可 能有一个被解释变量是顺序或者间隔尺度的变量,而要作为 定性变量使用。这种情况下我们可以创建一个定性变量。

*

*

目录 上页 下页 返回 结束

§4.1 判别分析的基本理

论

判别分析的假设之一,是每一个判别变量(解释变量)不 能是其他判别变量的线性组合。即不存在多重共线性问题。 判别分析的假设之二,是各组变量的协方差矩阵相等。判 别分析最简单和最常用的形式是采用线性判别函数,它们 是判别变量的简单线性组合。在各组协方差矩阵相等的假 设条件下,可以使用很简单的公式来计算判别函数和进行 显著性检验。 判别分析的假设之三,是各判别变量之间具有多元正态分 布,即每个变量对于所有其他变量的固定值有正态分布。 在这种条件下可以精确计算显著性检验值和分组归属的概 率。当违背该假设时,计算的概率将非常不准确。

**

目录 上页 下页 返回 结束

§4.3 Bayes判别

**

XXX

**

目录 上页 下页 返回 结束

§4.4 Fisher判别

**

**

目录 上页 下页 返回 结束

§4.4 Fisher判别

**

**

目录 上页 下页 返回 结束

§4.4 Fisher判别

**

**

目录 上页 下页 返回 结束

§4.4 Fisher判别

**

**

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

Equation Chapter 1 Section 1 Array《多元统计分析》Multivariate Statistical Analysis;^)主讲:统计学院许启发()统计学院应用统计学教研室School of Statistics2004年9月第三章 主成分分析【教学目的】1.让学生了解主成分分析的背景、基本思想; 2.掌握主成分分析的基本原理与方法; 3.掌握主成分分析的操作步骤和基本过程; 4.]5.学会应用主成分分析解决实际问题。

【教学重点】1.主成分分析的几何意义; 2.主成分分析的基本原理。

§1 概述一、什么是主成分分析1.研究背景在实际问题的研究中,为了全面分析问题,往往涉及众多有关的变量。

但是,变量太多不但会增加计算的复杂性,而且也给合理地分析问题和解释问题带来困难。

一般说来,虽然每个变量都提供了一定的信息,但其重要性有所不同。

实际上,在很多情况下,众多变量间有一定的相关关系,人们希望利用这种相关性对这些变量加以“改造”,用为数较少的新变量来反映原变量所提供的大部分信息,通过对新变量的分析达到解决问题的目的。

主成分分析及典型相关分析便是在这种降维的思维下产生的处理高维数据的统计方法。

本章主要介绍主成分分析。

主成分分析的基本方法是通过构造原变量的适当的线性组合,以产生一系列互不相关的新变量,从中选出少数几个新变量并使它们含有尽可能多的原变量带有的信息,从而使得用这几个新变量代替原变量分析问题和解决问题成为可能。

当研究的问题确定之后,变量中所含“信息”的大小通常用该变量的方差或样本方差来度量。

>概括地说,主成分分析(principal component analysis )就是一种通过降维技术把多个指标约化为少数几个综合指标的综合统计分析方法,而这些综合指标能够反映原始指标的绝大部分信息,它们通常表现为原始几个指标的线性组合。

主成分概念最早是由Karl Parson 于1901年引进的,1933年Hotelling 把这个概念推广到随机向量。

在实践中,主成分分析既可以单独使用,也可和其它方法结合使用,如主成分回归可克服多重共线性。

2.基本思想及意义哲学理念:抓住问题的主要矛盾。

主成分分析将具有一定相关性的众多指标重新组合成新的无相互关系的综合指标来代替。

通常数学上的处理就是将这p 个指标进行线性组合作为新的综合指标。

问题是:这样的线性组合会很多,如何选择如果将选取的第一个线性组合即第一个综合指标记为1F ,希望它能尽可能多地反映原来指标的信息,即1()Var F 越大,1F 所包含的原指标信息①就越多,1F 的方差应该最大,称1F 为第一主成分。

如果第一主成分1F 不足以代表原来p 个指标的信息,再考虑选取2F 即选择第二个线性组合。

为了有效地反映原来的信息,1F 中已包含的信息,无须出现在2F 中,即12(,)0Cov F F ,称2F 为第二主成分。

仿此可以得到p 个主成分。

①度量信息最经典的方差是方差。

我们可以发现这些主成分之间互不相关且方差递减,即数据的信息包含在前若干个主成分中,因而只需挑选前几个主成分就基本上反映了原始指标的信息。

这种既减少了变量的数目又抓住了主要矛盾的做法有利于问题的解决。

二、主成分分析的数学模型及几何意义[1.数学模型(总体主成分)设有n 个样品,每个样品观测p 个指标:12,,,p X X X ,得到原始数据资料阵:()11121212221212,,,p p p n n np X X X X X X X X XX X X X ⎛⎫⎪⎪= ⎪ ⎪ ⎪⎝⎭。

其中,12i i i ni X X X X ⎛⎫⎪ ⎪= ⎪ ⎪⎝⎭。

其协方差矩阵为()[][]ijp pE X EX X EX σ⨯'∑--它是一个p 阶半正定矩阵。

设()12,,,(1,2,,)i i i pi a a a a i p '==为p 个常数向量,考虑如下的线性组合1111121212212122221122p p p p p p p p pp p F a X a X a X a X F a X a X a X a X F a X a X a X a X '⎧=+++⎪'=+++⎪⎨⎪⎪'=+++⎩简记为1122i i i i pi pF a X a X a X a X '=+++(1,2,,)i p =易知有()()i i i i Var F Var a X a a ''=∑(,)(,),i j i j i jCov F F Cov a X a X a a i j '''==∑≠(,1,2,,)i j p =…如果我们希望用1F 代替原来p 个变量12,,,p X X X ,这就要求1F 尽可能地反映原p 个变量的信息。

这里,“信息”用1F 的方差来度量,即1()Var F 越大,表示1F 所含的12,,,p X X X 中的信息越多。

但由方差的表达式可知,必须对i a 加以限制,否则1()Var F 无界。

而最方便的限制是要求所有i a 具有单位长度,即1i i a a '=因此,我们希望在约束条件111a a '=之下,求1a 使1()Var F 达到最大,由此1a 所确定的随机变量11F a X '=称为12,,,p X X X 的第一主成分。

如果第一主成分1F 还不足以反映原变量的信息,考虑采用2F 。

为了有效地反映原变量的信息,1F 中已有的信息就不必要再包含在2F 中,用统计的语言来讲,要求1F 与2F 不相关,即1212(,)0Cov F F a a '=∑= 于是,在约束条件221a a '=及120a a '∑=之下,求2a 使2()Var F 达到最大,由此2a 所确定的随机变量22F a X '=称为12,,,p X X X 的第二主成分。

一般地,在约束条件1i i a a '=及()(,)01,2,,1i k i k Cov F F a a k i '=∑==-之下,求i a 使()i Var F 达到最大,由此i a 所确定的随机变量i i F a X '=称为12,,,p X X X 的第i 主成分。

2.主成分的几何意义从代数学观点看主成分就是12,,,p X X X 的一些特殊的线性组合,而在几何上这些线性组合正是把12,,,p X X X 构成的坐标系旋转产生的新的坐标系,新坐标系使之通过样品方差最大化方向。

下面以二元正态变量为例说明主成分的几何意义。

当2p =时,原变量是12,X X ,设122(,)~(,)X X X N μ'=∑,它们有下图的相关关系:}对于二元正态变量,n 个点的散布大致是一个椭圆,在其长轴方向取坐标轴1F ,在其短轴方向取坐标轴2F 。

这相当于在平面上作一坐标变换,即按逆时针方向旋转θ角度,得112212cos sin sin cos F X X F X X θθθθ=+⎧⎨=-+⎩ 或1122cos sin sin cos F X U X F X θθθθ⎛⎫⎛⎫⎛⎫= ⎪ ⎪ ⎪-⎝⎭⎝⎭⎝⎭这里的U 为正交矩阵,即U U I '=。

因此,在12F oF 坐标系中有如下性质:}(1)1F 和2F 为12,X X 的线性组合; (2)1F 与2F 不相关;(3)1X 与2X 的总方差大部分归结为1F 轴上,而2F 轴上很少。

几何意义:一般情况,p 个变量组成p 维空间,n 个样品点就是p 维空间的n 个点,对p 元正态分布变量来说,找主成分的问题就是找p 维空间中椭球体的主轴问题。

§2 主成分的推导及性质这里首先从理论上给出总体主成分,探讨总体主成分的性质,而后再给出样本主成分。

一、总体主成分1.总体主成分的推导 设1122p p Fa X a X a X a X '=+++,其中()12,,,p a a a a '=且1a a '=,()12,,,p X X X X '=。

求主成分的过程就是寻找X 的线性组合a X ',使相应的方差尽可能地大的过程。

()()()()Var F Var a X a E X EX X EX a a a ''''=--=∑:设协差阵∑的特征根为120p λλλ≥≥≥>,相应的正交单位特征向量为()12,,,p U U U U '=,则11p i i i i p U U U U λλλ=⎛⎫ ⎪''∑==⎪ ⎪⎝⎭∑因此,()()()()()21111ppppi i i i i i i i i i i i i i i a a a U U a a U U a a U a U a U λλλλ===='''''''''∑====∑∑∑∑所以,()()()2111111pi i a a a U a U a U a UU a a a λλλλλ=''''''''∑≤====∑而事实上,当1a U =时有()()()2111111111111p pi i i i i i i i U U U U U U U U U U U U λλλλ==⎛⎫''''''∑==== ⎪⎝⎭∑∑由此可知,在约束条件1a a '=之下,当1a U =时,使()Var a X a a ''=∑达到最大值,且1111()Var U X U U λ''=∑=。

同理可求()i i i i Var U X U U λ''=∑=,且()()()11(,)0p p i j i j i k k k j k i k k j k k Cov U X U X U U U U U U U U U U i j λλ==⎡⎤⎡⎤'''''''=∑===≠⎢⎥⎢⎥⎣⎦⎣⎦∑∑【结论:()12,,,p X X X X '=的主成分就是以∑的特征向量为系数的线性组合,它们互不相关,其方差为∑的特征根,主成分的名次是按照特征根大小的顺序排列的。

2.总体主成分的性质性质1:设F a X '=为X 的主成分,则其协差阵为由X 的协差所对应特征根组成的对角阵。

性质2:1111()()ppppi ii i i i i i i Var X Var F σλ=======∑∑∑∑。