jaynes最大熵原理

最大熵原理及其应用

论文名称:最大熵原理及其应用班级:13级通信工程班专业:通信工程学号:学生姓名:指导老师:时间:2015年11月8日摘要熵是源于物理学的基本概念,后来Shannon在信息论中引入了信息熵的概念,它在统计物理中的成功使人们对熵的理论和应用有了广泛和高度的重视。

最大熵原理是一种在实际问题中已得到广泛应用的信息论方法。

本文从信息熵的概念出发,对最大熵原理做了简要介绍,并论述了最大熵原理的合理性,最后提及它在一些领域的应用,通过在具体例子当中应用最大熵原理,展示该原理的适用场合,以期对最大熵原理及其应用有更深刻的理解。

关键词:熵;信息熵;最大熵原理;不适定性问题引言科学技术的发展使人类跨入了高度发展的信息化时代。

在政治、军事、经济等各个领域,信息的重要性不言而喻,有关信息理论的研究正越来越受到重视,信息论方法也逐渐被广泛应用于各个领域。

信息论一般指的是香农信息论,主要研究在信息可以度量的前提下如何有效地、可靠地、安全地传递信息,涉及消息的信息量、消息的传输以及编码问题。

1948年C.E.Shannon 为解决通信工程中不确定信息的编码和传输问题创立信息论,提出信息的统计定义和信息熵、互信息概念,解决了信息的不确定性度量问题,并在此基础上对信息论的一系列理论和方法进行了严格的推导和证明,使以信息论为基础的通信工程获得了巨大的发展。

信息论从它诞生的那时起就吸引了众多领域学者的注意,他们竞相应用信息论的概念和方法去理解和解决本领域中的问题。

近年来,以不确定性信息为研究对象的信息论理论和方法在众多领域得到了广泛应用,并取得了许多重要的研究成果。

迄今为止,较为成熟的研究成果有:A.N.Kolmogorov在1956年提出的关于信息量度定义的三种方法——概率法,组合法,计算法;A.N.Kolmogorov在1968年阐明并为J.Chaitin在1987年系统发展了的关于算法信息的理论。

这些成果大大丰富了信息理论的概念、方法和应用范围。

浅谈最大熵原理和统计物理学

浅谈最大熵原理和统计物理学摘要在本文中我们将分别从物理和信息论角度简单讨论熵的意义并介绍由E.T.Jaynes所奠立基础的最大熵原理的原始理解。

透过研究理想气体,我们将阐述如何运用最大熵原理研究真实问题。

同时藉由简短分析统计物理学研究方法的问题,本文会给出最大熵原理更深层涵义及其应用。

我们将称之为最大熵原理第二延伸。

最后透过真实气体的研究,我们将描绘出如何运用第二延伸来帮助我们思考及研究热力学系统。

一、前言长时间以来人们对于熵有物理上的理解也有二、最大熵原理(Information theory) 上的理解。

物理上l、什么是最大熵原理信息论的熵可以说明热力学系统的演化方向、热平衡的达相信物理系学生和物理研究人员都很熟悉成与否亦或是代表系统的混乱程度等[1-3]。

在信Clausius的经验准则-热力学第二定律[1,2]。

该定息论里,信息熵则代表量测信息系统的可信度或者律说明当一个热力学系统达到最后热平衡状态时,是忽略度[3,4]。

然而不管物理或是信息论上对熵该系统的熵会达到最大值。

进一步的研究指出当系的理解,实际上仍局限于将熵视为一个量测的工统的熵最大时,其自由能将会成为最小。

在此一具。

正如我们可藉由系统能量的量测来了解系统状特性的影响下人们惯性的倾向于将熵视为类似能态稳定与否。

然而由于E.T.Jaynes的贡献,熵可量的巨观物理量。

此一物理量成为描述系统乱度的依据。

此后由于 Gibbs 引入 ensemble 观念,开视为一种研究问题的推理工具,这一层意义才为人所知[5,6]。

时至今日,我们虽然仍无法全盘了解启微观角度的研究方法因而奠立近代统计力学理熵的真正意含,但是我们也渐渐掌握熵在物理学尤解熵的理论基础。

在统计力学的观念中,观察者所其是统计物理中所能扮演的角色。

通过本文浅显的量测到该系统热力学性质之巨观物理量诸如系统介绍,我们将从过去Jaynes对于熵的认识到今日内能或压力,基本上只能以平圴值来表现。

最大熵原理和分析

最大熵原理和分析熵是信息论中一个非常重要的概念,它表示一个随机变量的不确定性。

对于一个离散随机变量X,其熵H(X)定义为:H(X) = -∑ P(x) log P(x)其中,P(x)表示X取一些值x的概率。

熵的值越大,表示随机变量的不确定性越高,反之,熵的值越小,表示随机变量的不确定性越低。

最大熵原理认为,当我们对一个问题缺乏先验知识,也就是无法对一些事件的概率分布进行确定时,我们应该选择一个与我们已知信息最为吻合,即最为均匀的分布。

最大熵原理的核心思想是在保持已知信息的基础上,尽可能避免引入不可验证的假设。

1.定义问题和确定已知信息:首先,我们需要清楚地定义问题,并确定我们已知的信息和限制条件。

这些已知信息可以是一些约束条件,也可以是一些期望值等。

2.确定特征函数:为了表示我们所关心的问题,我们需要选择一组合适的特征函数。

特征函数是一个从问题的状态空间映射到实数的函数,它可以度量一些状态的特征或属性。

3.确定约束条件:根据已知信息和特征函数,我们可以得到一组约束条件。

这些约束条件可以是一些状态的期望值等。

4.定义最大熵模型:最大熵模型是在满足已知信息和约束条件的条件下,找到最大熵分布的模型。

最大熵模型可以通过最优化方法来求解。

5.模型评估和应用:通过最大熵模型,我们可以得到概率分布或其他输出。

我们可以使用这些输出来进行模型评估、分类、预测等任务。

然而,最大熵原理也存在一些限制。

首先,在实际应用中,特征函数的选择往往具有一定的主观性。

其次,最大熵模型的计算复杂度较高,当特征函数和约束条件较多时,求解最大熵模型可能会变得困难。

另外,最大熵原理本身并没有提供一种判断模型的好坏的准则。

综上所述,最大熵原理是一种基于信息论的概率模型学习方法。

它通过最大化系统的熵,来求解最为均匀和不确定的概率分布。

最大熵原理在统计学、自然语言处理、机器学习等领域有广泛的应用,但同时也存在一些局限性。

最大熵模型简介

H ( p) p(x) log2 p(x)

x

p* arg max H ( p)

最大熵模型

❖ 例如: 给定一个词

假定已知存在四种词性:名词、动词、介词、指代词 ❖ 如果该词在语料库中出现过,并且属于名词的概率为70%,则判断

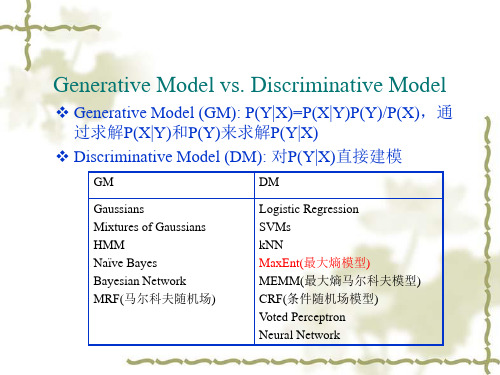

Generative Model vs. Discriminative Model

❖ Generative Model (GM): P(Y|X)=P(X|Y)P(Y)/P(X),通 过求解P(X|Y)和P(Y)来求解P(Y|X)

❖ Discriminative Model (DM): 对P(Y|X)直接建模

纲要

❖ 最大熵原理 ❖ 最大熵模型定义 ❖ 最大熵模型中的一些算法 ❖ 最大熵模型的应用 ❖ 总结 ❖ 思考题

最大熵模型(Maximum Entropy

Model)

❖

假设有一个样本集合 (x1, x2 ,... xn )

特征(j对f1, pf2的...制fk )约可以表示为

,我们给出k个特征 , Ep( f j ) E~p( f j )

p(X=3)=p(X=4)=p(X=5)=p(X=6)=0.1

最大熵原理

❖ 最大熵原理:1957 年由E.T.Jaynes 提出。 ❖ 主要思想:

在只掌握关于未知分布的部分知识时,应该选取符合这些知识但熵值最 大的概率分布。

❖ 原理的实质:

前提:已知部分知识 关于未知分布最合理的推断=符合已知知识最不确定或最随机的推断。 这是我们可以作出的唯一不偏不倚的选择,任何其它的选择都意味着我 们增加了其它的约束和假设,这些约束和假设根据我们掌握的信息无法 作出。

浅谈最大熵原理和统计物理学

浅谈最大熵原理和统计物理学摘要在本文中我们将分别从物理和信息论角度简单讨论熵的意义并介绍由E.T.Jaynes所奠立基础的最大熵原理的原始理解。

透过研究理想气体,我们将阐述如何运用最大熵原理研究真实问题。

同时藉由简短分析统计物理学研究方法的问题,本文会给出最大熵原理更深层涵义及其应用。

我们将称之为最大熵原理第二延伸。

最后透过真实气体的研究,我们将描绘出如何运用第二延伸来帮助我们思考及研究热力学系统。

一、前言长时间以来人们对于熵有物理上的理解也有二、最大熵原理(Information theory) 上的理解。

物理上l、什么是最大熵原理信息论的熵可以说明热力学系统的演化方向、热平衡的达相信物理系学生和物理研究人员都很熟悉成与否亦或是代表系统的混乱程度等[1-3]。

在信Clausius的经验准则-热力学第二定律[1,2]。

该定息论里,信息熵则代表量测信息系统的可信度或者律说明当一个热力学系统达到最后热平衡状态时,是忽略度[3,4]。

然而不管物理或是信息论上对熵该系统的熵会达到最大值。

进一步的研究指出当系的理解,实际上仍局限于将熵视为一个量测的工统的熵最大时,其自由能将会成为最小。

在此一具。

正如我们可藉由系统能量的量测来了解系统状特性的影响下人们惯性的倾向于将熵视为类似能态稳定与否。

然而由于E.T.Jaynes的贡献,熵可量的巨观物理量。

此一物理量成为描述系统乱度的依据。

此后由于 Gibbs 引入 ensemble 观念,开视为一种研究问题的推理工具,这一层意义才为人所知[5,6]。

时至今日,我们虽然仍无法全盘了解启微观角度的研究方法因而奠立近代统计力学理熵的真正意含,但是我们也渐渐掌握熵在物理学尤解熵的理论基础。

在统计力学的观念中,观察者所其是统计物理中所能扮演的角色。

通过本文浅显的量测到该系统热力学性质之巨观物理量诸如系统介绍,我们将从过去Jaynes对于熵的认识到今日内能或压力,基本上只能以平圴值来表现。

最大熵

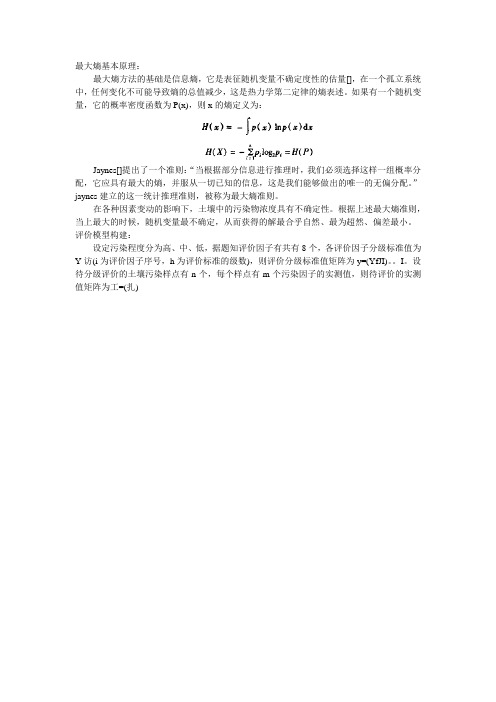

最大熵基本原理:

最大熵方法的基础是信息熵,它是表征随机变量不确定度性的估量[],在一个孤立系统中,任何变化不可能导致熵的总值减少,这是热力学第二定律的熵表述。

如果有一个随机变量,它的概率密度函数为P(x),则x的熵定义为:

Jaynes[]提出了一个准则:“当根据部分信息进行推理时,我们必须选择这样一组概率分配,它应具有最大的熵,并服从一切已知的信息,这是我们能够做出的唯一的无偏分配。

”jaynes建立的这一统计推理准则,被称为最大熵准则。

在各种因素变动的影响下,土壤中的污染物浓度具有不确定性。

根据上述最大熵准则,当上最大的时候,随机变量最不确定,从而获得的解最合乎自然、最为超然、偏差最小。

评价模型构建:

设定污染程度分为高、中、低,据题知评价因子有共有8个,各评价因子分级标准值为Y访(i为评价因子序号,h为评价标准的级数),则评价分级标准值矩阵为y=(YfJI)。

I。

设待分级评价的土壤污染样点有n个,每个样点有m个污染因子的实测值,则待评价的实测值矩阵为工=(扎)。

最大熵原理

注:戴帽子的表示统计量(不含任何未知量,可以直接从训练数据中计算得到的也说成是经验的),不 戴帽子表示概率模型是从训练数据中抽象出来的。

2.1.2 特征函数

假设给出了的很多有关数据的先验信息(就像例子中的������(������ = ������, ������ = 0) + ������(������ = ������, ������ = 0) = 0.6),我们要怎么将这些先验信息(约束条件)体现在我们的模型 中呢?为了解决这一问题,引入了特征函数的概念。

方案 1:

x

y

0

1

a

0.5

0.1

b

0.1

0.3

0.6

1.0表格 2.方案源自2:xy0

1

a

0.3

0.2

b

0.3

0.2

0.6

1.0

表格 3.

显然方案 1 和 2,都是满足约束P(x = a, y = 0) + p(x = b, y = 0) = 0.6的,但是最 大熵原理告诉我们方案 2 会比方案 1 更好,更能接近事实。这里约束条件只有一个, 我们能很快的给出,熵最大的分布(可以通俗的理解为怎么填表格中的数值,使得熵最

大)。但是,实际应用中,我们约束远不止 1 条,这种情况,就很难直接填表格中的数 值了,所以最大熵模型应运而生。

2. 最大熵模型:

最大熵原理认为,学习概率模型时,在所有可能的概率模型中,熵最大的模型最 好,最能反映实际情况。通常用约束条件来确定模型的集合,所以,最大熵原理可以理 解为在满足给定约束的条件下,选择熵最大的模型。

������∈∁ ������

对偶问题为:

������������������ ������������������ ������(������, ������)

生物学最大熵原理与应用

最大熵测量例

• 命题1: 设有 n (3k1 n 3k )枚硬币,其中有

一假,且知其较轻或较重; 那么,发现假币 的最少称重次数k满足:

k 1 log n / log 3 k

39

最大熵测量例

• 命题2: 设有n ( 3k1 n 3k )枚硬币,其中有一

假,且满足:①这些硬币分成两组A、B; A有a枚,B有b枚,a+b=n; ②若假币属 于A,则其较轻;若假币属于B,则其较重 ;那么,发现假币的最少称重次数k满足 :

1,

,n

r 1

n

m

其中 Z exp(0 ) exp[ r gr (xi )]

i 1

r 1

m

0

r g r ( xi )

pi e

r 1

13

最大熵:

m

H max ln Z ra r

r 1

14

•证 求有约束极值

n

n

L pi log pi (0 1)( pi 1)

i 1

i 1

骰子的各面朝上的概率是不均匀的。除概率的归 一性外,我们知道的信息仅有平均值,这对于确定6 个面的概率是不完整的信息, 4 p4 5 p5 6 p6 4.5

27

4.5

1

212 313 414 515 616 1 12 13 14 15 16

•

44

熵集中定理

•熵集中定理是最大熵原理的依据。 可以证明,具有最大熵的概率分布具 有最多的实现方法数,因此更容易被 观察到,而且是满足某些条件的分布 所产生的熵绝大部分在最大熵附近。

45

46

熵集中定理

假设做N次随机实验,每次实验有n个结

果,每种结果出现的次数为 N i ,设每

熵最大原理

一、熵物理学概念宏观上:热力学定律——体系的熵变等于可逆过程吸收或耗散的热量除以它的绝对温度(克劳修斯,1865)微观上:熵是大量微观粒子的位置和速度的分布概率的函数,是描述系统中大量微观粒子的无序性的宏观参数(波尔兹曼,1872)结论:熵是描述事物无序性的参数,熵越大则无序。

二、熵在自然界的变化规律——熵增原理一个孤立系统的熵,自发性地趋于极大,随着熵的增加,有序状态逐步变为混沌状态,不可能自发地产生新的有序结构。

当熵处于最小值, 即能量集中程度最高、有效能量处于最大值时, 那么整个系统也处于最有序的状态,相反为最无序状态。

熵增原理预示着自然界越变越无序三、信息熵(1)和熵的联系——熵是描述客观事物无序性的参数。

香农认为信息是人们对事物了解的不确定性的消除或减少,他把不确定的程度称为信息熵(香农,1948 )。

随机事件的信息熵:设随机变量ξ,它有A1,A2,A3,A4,……,An共n种可能的结局,每个结局出现的概率分别为p1,p2,p3,p4,……,pn,则其不确定程度,即信息熵为(2)信息熵是数学方法和语言文字学的结合。

一个系统的熵就是它的无组织程度的度量。

熵越大,事件越不确定。

熵等于0,事件是确定的。

举例:抛硬币,p(head)=0.5,p(tail)=0.5H(p)=-0.5log2(0.5)+(-0.5l og2(0.5))=1说明:熵值最大,正反面的概率相等,事件最不确定。

四、最大熵理论在无外力作用下,事物总是朝着最混乱的方向发展。

事物是约束和自由的统一体。

事物总是在约束下争取最大的自由权,这其实也是自然界的根本原则。

在已知条件下,熵最大的事物,最可能接近它的真实状态。

五、基于最大熵的统计建模:建模理论以最大熵理论为基础的统计建模。

为什么可以基于最大熵建模?Jaynes证明:对随机事件的所有相容的预测中,熵最大的预测出现的概率占绝对优势。

Tribus证明,正态分布、伽马分布、指数分布等,都是最大熵原理的特殊情况。

最大熵产生原理系列论文的读书笔记 转

最大熵产生原理系列论文的读书笔记转越来越感到最大熵产生原理的重要性了,尤其是他的统计物理基础。

利用暑假时间,我快速地把几篇重要文章使劲儿读了读,深深感觉到自己数学功底并不算强。

不过饿补过微积分和基本的物理知识以后,还可以理解这些文章。

强烈希望数学、物理背景出身的人能读到这篇文章,并能对这个问题真的感兴趣!谁要是突破了这里面的道道,那真的是一个不小的突破!而且肯定能用到很多实际领域中。

下面就来贴我的读书笔记。

读文笔记引言:最近读了不少有关统计物理、熵、最大熵产生原理等文章,在此,就我所理解的部分做一个总结,以便帮助我屡清思路,也方便对这一领域感兴趣的人能够更有效率地继续研究下去。

下面,主要沿着这几篇文章的思路讲解,它们是:E.T.Jaynes的《Information theory and statistical physics》、E.T.Jaynes的《Brandeis Lectures(1963)》、L.M.Martyushev和V.D.Seleznev的《Maximum entropy production principle inphysics,chemistry and biology》、R.C.Dewar的《Maximum entropy production and the fluctuation theorem》和《Information theory explanation of the fluctuation theorem,maximum entropy production and self-organized criticality in non-equilibrium stationary states》。

第一篇:E.T.Jaynes的《Information theory and statistical physics》+《Brandeis Lectures(1963)》1、两句废话很多人看到统计物理四个字就头疼,原因是,里面有太多难以理解的概念,以及艰深的数学。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

jaynes最大熵原理

一、背景

最大熵原理最早由美国物理学家和统计学家Edwin T. Jaynes在1957年提出,是基于信息论的一种方法。

信息论是由克劳德·香农于1948年提出的,研究信息的量和传输。

在信息论中,熵是衡量随机变量不确定性的度量,而最大熵原理则是基于熵的概念,提供了一种确定概率分布的方法。

二、原理

最大熵原理的核心思想是,在缺乏具体信息的情况下,应该选择一种概率分布,使得其熵最大。

也就是说,在不知道具体信息的情况下,我们应该选择一种最“均匀”的概率分布。

这是因为最“均匀”的分布具有最大的不确定性,可以避免引入不必要的主观偏见。

具体来说,假设我们有一些约束条件,比如某些随机变量的期望值或者方差等。

在这些约束条件下,最大熵原理的目标是找到一种概率分布,使得其熵最大,并且满足这些约束条件。

通过求解最大熵模型,我们可以得到一个概率分布,使得在缺乏具体信息的情况下,我们对待预测的事件的判断更加客观和中立。

三、应用

最大熵原理在各个领域都有广泛的应用。

在自然语言处理中,最大熵模型被广泛应用于文本分类、命名实体识别、句法分析等任务中。

在机器学习领域,最大熵模型被用于分类、回归、聚类等问题的建模和求解。

在经济学中,最大熵原理被用于估计经济模型中的参数,从而更准确地预测经济变量的发展趋势。

在物理学中,最大熵原理可以用来推导统计力学中的各种定律和公式。

四、局限性

尽管最大熵原理在许多领域都有广泛的应用,但它也存在一些局限性。

首先,最大熵原理在缺乏具体信息的情况下,给出的概率分布是一种最均匀的分布。

然而,在某些情况下,我们可能需要考虑其他因素,比如先验知识或者特定的领域背景。

其次,最大熵原理的求解过程可能会非常复杂,需要大量的计算资源和时间。

在实际应用中,我们需要权衡模型的准确性和计算效率。

总结:

Jaynes最大熵原理是一种基于信息论的方法,用于处理缺乏具体信息的问题。

它的核心思想是选择一种最“均匀”的概率分布,在满足约束条件的情况下,使得熵最大。

最大熵原理在各个领域都有广泛的应用,包括自然语言处理、机器学习、经济学和物理学等。

然而,最大熵原理也存在一些局限性,需要在实际应用中进行权衡和调整。

通过深入理解和应用最大熵原理,我们可以更好地处理不完备信息,做出合理和准确的决策。