汉语普通话语音可视化技术技术

普通话语音合成技术的研究与发展

普通话语音合成技术的研究与发展一、引言普通话语音合成技术是指利用计算机程序模仿人的声音语音实现人机交互的一种新型技术。

随着近年来科技的快速发展与普及应用,普通话语音合成技术在现代社会中扮演着越来越重要的角色。

本文主要介绍普通话语音合成技术的研究与发展,分析技术的现状及未来发展方向。

二、发展历程1、早期技术研究早在20世纪50年代初,科学家就开始研究计算机语音合成技术。

当时的技术比较简单,只能合成一些单个词汇或短语。

20世纪70年代,语音合成技术得到了进一步发展,科学家们开始研究如何合成完整的句子和语音。

2、发展现状随着计算机处理能力越来越强大,目前普通话语音合成技术已经取得了巨大的进展,能够实现高质量的语音合成,让合成声音更加自然。

当前的普通话语音合成技术主要采用的是基于数据库或者基于统计模型两种方式。

其中基于数据库的方法采用一些预制的语音单元构建数据库,再根据语音的特征来进行合成;而基于统计模型的方法则根据大量的训练数据来建立统计模型,从而实现语音合成。

三、技术现状1、语音单元的设计语音单元指的是一些基本的语音音素,如元音、辅音、音节等,这些语音单元会被组合成各种不同的语音。

目前,普通话语音合成技术采用基于数据库的方法,使用自然录音,并通过上下文扩展技术来改进语音单元的设计,从而让语音合成更加自然。

2、语音合成的声学模型语音合成的声学模型主要包括传统的规则模型和新型的基于学习的模型。

传统的规则模型需要人工设计规则,并进行相应的参数设置,所以难以满足现代语音合成技术的需求。

而基于学习的模型则可以通过自我学习或分类器模型来实现语音的准确识别和分析,因此更加适合当前的语音合成技术。

3、语音合成的音数据库语音合成的音数据库指的是存储多种声音单元和语音模型的数据库,是语音合成技术中至关重要的一个环节。

目前,普通话语音合成技术主要采用大型的语音数据库,并结合语音信号处理算法对语音进行处理和优化,从而实现优化的语音合成。

汉语文本-可视语音转换的研究

汉语文本-可视语音转换的研究

王志明;蔡莲红;吴志勇;陶建华

【期刊名称】《小型微型计算机系统》

【年(卷),期】2002(023)004

【摘要】本文通过对发音者可见器官动作的研究,从视觉方面抽取汉语发音的26个基本口形,并利用MPEG-4所规定的面部动画参数(FAP)来描述这些口形,从而获得了符合国际标准的描述汉语发音的视觉参数.另外,我们研究了这些参数在连续语流中的变化及协同发音对口形的影响,基于已有的汉语文语转换系统(Sonic)和二维网格人脸模型(P1aneFace)实现了一个汉语文本-可视语音转换系统(TTVS).

【总页数】4页(P474-477)

【作者】王志明;蔡莲红;吴志勇;陶建华

【作者单位】清华大学,计算机科学与技术系,北京,100084;清华大学,计算机科学与技术系,北京,100084;清华大学,计算机科学与技术系,北京,100084;清华大学,计算机科学与技术系,北京,100084

【正文语种】中文

【中图分类】TP311

【相关文献】

1.汉语耳语音转换为正常音的研究 [J], 樊星;卢晶;徐柏龄

2.基于数据驱动方法的汉语文本-可视语音合成 [J], 王志明;蔡莲红;艾海舟

3.IPv6下的TTS文本语音转换 [J], 王天琦;王学明;王恒

4.基于语义的汉语普通话电子喉语音转换增强 [J], 钱兆鹏; 肖克晶; 刘蝉; 孙悦

5.非平行文本下基于变分自编码器和辅助分类器生成对抗网络的语音转换 [J], 李燕萍;曹盼;石杨;张燕;钱博

因版权原因,仅展示原文概要,查看原文内容请购买。

基于汉语视频三音素的可视语音合成

基于汉语视频三音素的可视语音合成

赵晖;唐朝京

【期刊名称】《电子与信息学报》

【年(卷),期】2009(031)012

【摘要】为了合成具有真实感的视频序列,该文提出一种基于汉语视频三音素的可视语音合成方法.根据汉语的发音规律和音素与视素的对应关系,该文提出"视频三音素"的概念.在此基础上,建立隐马尔可夫(HMM)训练与合成模型,在训练过程中使用了视频音频联合特征,并加入了动态特征.在合成过程中,连接视频三音素HMM模型形成句子HMM,并从中提取特征参数,合成可视语音.从主观和客观评估结果来看,合成视频的真实感强,满意度较高.

【总页数】5页(P3010-3014)

【作者】赵晖;唐朝京

【作者单位】国防科技大学电子科学与工程学院,长沙,410073;国防科技大学电子科学与工程学院,长沙,410073

【正文语种】中文

【中图分类】TP391.42

【相关文献】

1.基于多流三音素DBN模型的音视频语音识别和音素切分 [J], 吕国云;蒋冬梅;樊养余;赵荣椿;H.Sahli;W.Verhelst

2.面向语音合成的藏语单音素与三音素自动切分算法研究 [J], 张金溪;李永宏;单广

荣;李照耀;江静

3.基于数据驱动方法的汉语文本-可视语音合成 [J], 王志明;蔡莲红;艾海舟

4.基于音素及其特征参数的维吾尔语音合成技术 [J], 姑丽加玛丽·麦麦提艾力;艾斯卡尔·艾木都拉

5.维吾尔语基于音素的波形拼接语音合成技术 [J], 皮丹艾合买提·帕尔哈提;木尼拉·吐尔洪

因版权原因,仅展示原文概要,查看原文内容请购买。

基于深度学习的普通话语音识别系统设计

基于深度学习的普通话语音识别系统设计1. 引言普通话作为中国的官方语言,被广泛使用。

随着互联网和智能硬件的发展,普通话语音识别技术被越来越多地应用到人机交互、智能客服、智能家居等领域中。

而深度学习作为一种新兴的机器学习技术,被广泛应用于图像处理、自然语言处理等领域,在语音识别领域也有很大的应用前景。

本文主要讨论基于深度学习的普通话语音识别系统的设计。

2. 相关技术介绍(1)语音信号预处理语音信号预处理是将原始语音信号转化为可供机器学习使用的数据形式。

该步骤包括音频读取、时频转换、特征提取等主要操作。

音频读取:使用Python中的wave库或PyAudio库读取音频文件或麦克风中录制的语音信号。

时频转换:将时域上的语音信号转换成频域信号,使用傅里叶变换等方法对信号进行变换。

特征提取:使用Mel频率倒谱系数(MFCC)等方法将语音信号转换成特征向量。

(2)深度学习模型深度学习模型是语音识别系统中的核心模块。

常用的深度学习模型包括卷积神经网络(CNN)、循环神经网络(RNN)等。

CNN:用于处理时频特征矩阵,提取频域上的局部特征。

RNN:用于处理时序信号,通过前向传播和后向传播学习时间序列上的特征。

(3)声学模型和语言模型声学模型和语言模型是语音识别系统中的两个重要模块。

声学模型:用于学习声音和文本之间的对应关系,将特征向量映射为概率分布。

语言模型:用于计算语句的概率分布,根据语句的概率和声学模型输出的概率计算语音识别的结果。

3. 系统设计(1)特征提取首先读取音频文件,对原始音频进行预处理,获取MFCC特征向量。

MFCC可以提取出语音信号在频域的重要特征,常用的MFCC参数包括帧长、帧移、倒谱阶数等。

在MFCC提取后,还可以进一步进行特征归一化、数据增强等操作。

(2)声学模型采用基于深度学习的声学模型,使用CNN/RNN模型处理MFCC特征序列,把它们映射到对应的输出概率分布。

其中RNN 模型可以处理时序信号,捕捉序列之间的高层次关系。

基于机器学习的中文语音识别技术研究与实现

基于机器学习的中文语音识别技术研究与实现中文语音识别技术是一种能够将人类语言转化为计算机可识别的形式的技术。

随着人工智能和机器学习的发展,中文语音识别技术取得了重要的突破和进展。

本文将探讨基于机器学习的中文语音识别技术的研究与实现,从其基本原理、关键技术以及应用场景等方面进行阐述。

首先,基于机器学习的中文语音识别技术的基本原理是通过大量的语音数据进行训练,利用机器学习算法来建立语音模型,并将输入的语音与这些已训练好的模型进行匹配和识别。

在语音信号的处理过程中,需要进行特征提取、声学建模、语言建模等关键步骤。

特征提取是语音识别的第一步,其目的是将语音信号转化为计算机可识别的特征表示形式。

常用的特征提取方法包括梅尔频率倒谱系数(MFCC)、自相关系数(ACF)等。

通过提取特定的频谱特征,可以减少语音信号的冗余信息,并更好地表征语音的重要特征。

声学建模是中文语音识别技术的核心之一,其作用是对每个语音单元进行建模,以便进行后续的识别和匹配。

常用的声学建模方法包括隐马尔可夫模型(HMM)、深度神经网络(DNN)等。

HMM可以对语音信号中的时序信息进行建模,而DNN则可以更好地表达复杂的非线性映射关系,提高识别准确率。

语言建模是用于对语音识别过程中的语言信息进行建模,以提高语音识别的准确性和鲁棒性。

语言建模可以通过统计语言模型或者神经网络语言模型来实现。

通过对大规模的语料库进行建模,可以更好地理解和预测输入语音的语义信息。

其次,基于机器学习的中文语音识别技术的研究与实现面临着一些挑战和困难。

首先,中文是一种复杂的语言,具有丰富的语音变体和语流变化。

这就要求语音识别系统需要具备较高的鲁棒性和泛化能力,能够适应不同说话人、不同场景下的语音输入。

另外,中文语音识别技术还需要解决声音的均衡性和音节的连续性等问题。

由于中文语音中存在较多的轻声现象,会导致声音的能量变弱,影响语音信号的特征提取和识别。

此外,中文语言中的音节具有较高的内在连续性,必须通过合理的建模方法来解决内在连续性问题。

基于数据驱动方法的汉语文本-可视语音合成

基于数据驱动方法的汉语文本-可视语音合成王志明;蔡莲红;艾海舟【期刊名称】《软件学报》【年(卷),期】2005(016)006【摘要】Text-To-Visual speech (TTVS) synthesis by computer can increase the speech intelligibility and make the human-computer interaction interfaces more friendly. This paper describes a Chinese text-to-visual speech synthesis system based on data-driven (sample based) approach, which is realized by short video segments concatenation. An effective method to construct two visual confusion trees for Chinese initials and finals is developed. A co-articulation model based on visual distance and hardness factor is proposed, which can be used in the recording corpus sentence selection in analysis phase and the unit selection in synthesis phase. The obvious difference between bound ary images of the concatenation video segments is smoothed by image morphing technique. By combining with the acoustic Text-To-Speech (TTS) synthesis, a Chinese text-to-visual speech synthesis system is realized.%计算机文本-可视语音合成系统(TTVS)可以增强语音的可懂度,并使人机交互界面变得更为友好.给出一个基于数据驱动方法(基于样本方法)的汉语文本-可视语音合成系统,通过将小段视频拼接生成新的可视语音.给出一种构造汉语声韵母视觉混淆树的有效方法,并提出了一个基于视觉混淆树和硬度因子的协同发音模型,模型可用于分析阶段的语料库选取和合成阶段的基元选取.对于拼接边界处两帧图像的明显差别,采用图像变形技术进行平滑并.结合已有的文本-语音合成系统(TTS),实现了一个中文文本视觉语音合成系统.【总页数】10页(P1054-1063)【作者】王志明;蔡莲红;艾海舟【作者单位】北京科技大学,计算机科学与技术系,北京,100083;清华大学,计算机科学与技术系,北京,100084;清华大学,计算机科学与技术系,北京,100084【正文语种】中文【中图分类】TP18【相关文献】1.基于汉语视频三音素的可视语音合成 [J], 赵晖;唐朝京2.基于协同发音现象的一种汉语语音合成方法 [J], 张钦;李辉;戴蓓倩3.基于小波变换的汉语语音合成方法 [J], 刘轶;王昕4.CSCP汉语文本——语音合成系统 [J], 朱瑞康;季汉涛5.基于数据驱动的航天器演训任务可视化方法 [J], 王佳伟;罗毓芳;邱瑞因版权原因,仅展示原文概要,查看原文内容请购买。

声音可视化音流学艺术应用

探索AI生成艺术与人类创作在声音可视化与音流学艺术领域的结合方式,推动艺术的创新 与发展。

感谢您的观看

THANKS

时间和空间中的表现。

表现形式

音流学艺术作品通常以声音、视 觉、装置等多种形式展现,强调

观众的沉浸式和交互式体验。

发展历程

音流学艺术起源于20世纪的音乐 和视觉艺术实验,如今已经成为

当代艺术的一个重要分支。

声音可视化在音流学艺术中的应用意义

增强表现力

拓展创作手段

提升观众体验

通过声音可视化技术,音流学艺术作 品能够更直观地展现声音的变化和流 动,从而增强作品的表现力。

三维声音可视化技术

空间维度

三维声音可视化技术在传统的时间、频率维度基础上,引 入空间维度,实现声音在空间中的传播与变化可视化。

虚拟现实

结合虚拟现实技术,三维声音可视化能够提供更沉浸式的 音流学艺术体验,让观众能够直观地感受声音在三维空间 中的动态变化。

多角度观察

三维可视化技术允许从多个角度观察和分析声音,为艺术 家和研究者提供更全面的视角,促进音流学艺术的创新与 发展。

声音可视化音流学艺术应用

汇报人: 日期:

目 录

• 引言 • 声音可视化技术 • 音流学艺术中的声音可视化应用 • 声音可视化音流学艺术应用实践 • 声音可视化音流学艺术的未来发展

01

引言

声音可视化概述

定义与原理

声音可视化是将声音转化为视 觉形式的过程,通常通过映射 声音波形、频率、振幅等属性

来实现。

04

声音可视化音流学艺术应 用实践

实践一:基于声音可视化的音乐创作

声音波形呈现

音高与色彩映射

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

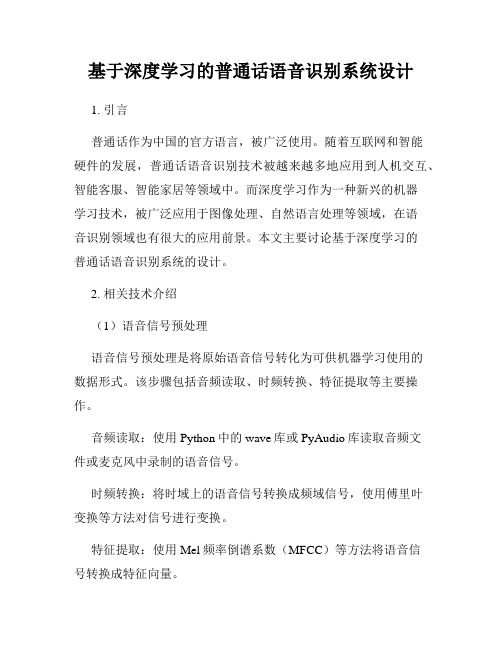

汉语普通话语音可视化技术(技术)

成果简介:语音是人们之间进行交流最为重要的手段之一,在人们的日常生活中是不可或缺的。

然而,对于听力受损人群来说,生理上的缺陷导致他们无法通过听觉来有效地感知语音,给学习和生活带来了极大的不便。

本技术为一种汉语语音的可视化方法,将语音以某种视觉图像显示,从而达到使人们能够通过观察视图来有效感知语音的目的,为听力受损人群理解语音、练习正确的发音提供帮助。

项目来源:自行开发

技术领域:信息技术

应用范围:

(1)聋儿的言语训练,帮助聋哑儿童练习发音。

(2)对外汉语教学,帮助外国人学习汉语发音。

(3)提高普通话发音水平,尤其针对普通话等级考试、带口音人群、幼儿等。

现状特点:国内领先

技术创新:探索汉语普通话语音的视觉表示方法,最终实现汉语普通话的视觉感知。

所在阶段:研发阶段

成果知识产权:已申请发明专利3项

成果转让方式:合作开发/技术转让/技术许可/合作办厂等

市场状况及效益分析:目前市场上尚无此类产品,因此该技术的产品化可产生巨大的社会效益和经济效益。

图片展示:

/a,o, e, i, u, ü /可视化效果图。