极大似然估计法

极大似然估计法

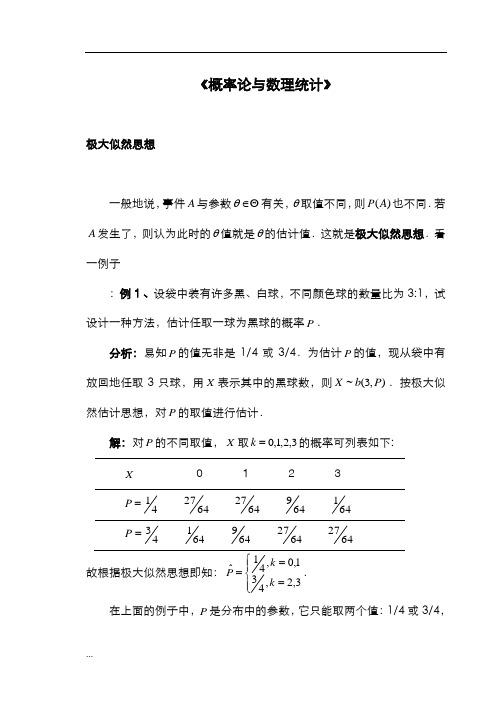

《概率论与数理统计》极大似然思想一般地说,事件A 与参数Θ∈θ有关,θ取值不同,则)(A P 也不同.若A 发生了,则认为此时的θ值就是θ的估计值.这就是极大似然思想.看一例子:例1、设袋中装有许多黑、白球,不同颜色球的数量比为3:1,试设计一种方法,估计任取一球为黑球的概率P .分析:易知P 的值无非是1/4或3/4.为估计P 的值,现从袋中有放回地任取3只球,用X 表示其中的黑球数,则),3(~P b X .按极大似然估计思想,对P 的取值进行估计.解:对P 的不同取值,X 取3,2,1,0=k 的概率可列表如下:X 0 1 2 341=P 6427 6427 649 64143=P641 64964276427故根据极大似然思想即知:⎪⎩⎪⎨⎧===3,2,431,0,41ˆk k P .在上面的例子中,P 是分布中的参数,它只能取两个值:1/4或3/4,需要通过抽样来决定分布中参数究竟是1/4还是3/4.在给定了样本观测值后去计算该样本出现的概率,这一概率依赖于P 的值,为此需要用1/4、3/4分别去计算此概率,在相对比较之下,哪个概率大,则P 就最象那个.二、似然函数与极大似然估计1、离散分布场合:设总体X 是离散型随机变量,其概率函数为);(θx p ,其中θ是未知参数.设n X X X ,,,21 为取自总体X 的样本.n X X X ,,,21 的联合概率函数为∏=ni i X p 1);(θ,这里,θ是常量,n X X X ,,,21 是变量.若我们已知样本取的值是n x x x ,,,21 ,则事件},,,{2211n n x X x X x X === 发生的概率为∏=ni i x p 1);(θ.这一概率随θ的值而变化.从直观上来看,既然样本值n x x x ,,,21 出现了,它们出现的概率相对来说应比较大,应使∏=ni i x p 1);(θ取比较大的值.换句话说,θ应使样本值n x x x ,,,21 的出现具有最大的概率.将上式看作θ的函数,并用)(θL 表示,就有:∏===ni i n x p x x x L L 121);();,,,()(θθθ (1)称)(θL 为似然函数.极大似然估计法就是在参数θ的可能取值围Θ,选取使)(θL 达到最大的参数值θˆ,作为参数θ的估计值.即取θ,使);,,,(max )ˆ;,,,()(2121θθθθnn x x x L x x x L L Θ∈== (2) 因此,求总体参数θ的极大似然估计值的问题就是求似然函数)(θL 的最大值问题.这可通过解下面的方程0)(=θθd dL (3) 来解决.因为L ln 是L 的增函数,所以L ln 与L 在θ的同一值处取得最大值.我们称)(ln )(θθL l =为对数似然函数.因此,常将方程(3)写成:0)(ln =θθd L d (4) 方程(4)称为似然方程.解方程(3)或(4)得到的θˆ就是参数θ的极大似然估计值.如果方程(4)有唯一解,又能验证它是一个极大值点,则它必是所求的极大似然估计值.有时,直接用(4)式行不通,这时必须回到原始定义(2)进行求解.2、连续分布场合:设总体X 是连续离散型随机变量,其概率密度函数为);(θx f ,若取得样本观察值为n x x x ,,,21 ,则因为随机点),,,(21n X X X 取值为),,,(21n x x x 时联合密度函数值为∏=ni i x f 1);(θ.所以,按极大似然法,应选择θ的值使此概率达到最大.我们取似然函数为∏==ni i x f L 1);()(θθ,再按前述方法求参数θ的极大似然估计值.三、求极大似然估计的方法1、可通过求导获得极大似然估计:当函数关于参数可导时,常可通过求导方法来获得似然函数极大值对应的参数值.例2、设某工序生产的产品的不合格率为p ,抽n 个产品作检验,发现有T 个不合格,试求p 的极大似然估计.分析:设X 是抽查一个产品时的不合格品个数,则X 服从参数为p 的二点分布),1(p b .抽查n 个产品,则得样本n X X X ,,,21 ,其观察值为n x x x ,,,21 ,假如样本有T 个不合格,即表示n x x x ,,,21 中有T 个取值为1,T n -个取值为0.按离散分布场合方法,求p 的极大似然估计.解:(1)写出似然函数:∏=--=ni x x i i P p p L 11)1()((2)对)(p L 取对数,得对数似然函数)(p l :∑∑==--+-=--+=ni i ni i i p p x p n p x p x p l 11)]1ln([ln )1ln()]1ln()1(ln [)((3)由于)(p l 对p 的导数存在,故将)(p l 对p 求导,令其为0,得似然方程:0)1(11)111(1)(11=-+--=-++--=∑∑==ni i n i i x p p p n p p x p n dp p dl (4)解似然方程得:x x n pni i ==∑=11ˆ (5)经验证,在x p =ˆ时,0)(22<dpp l d ,这表明x p =ˆ可使似然函数达到最大(6)上述过程对任一样本观测值都成立,故用样本代替观察值便得p 的极大似然估计为:X p=ˆ 将观察值代入,可得p 的极大似然估计值为:nTx p==ˆ,其中∑==ni i x T 1.若总体X 的分布中含有多个未知参数k θθθ,,,21 时,似然函数L 是这些参数的多元函数),,(1k L θθ .代替方程(3),我们有方程组),,2,1(0)(ln k i L i==∂∂θ,由这个方程组解得kθθθˆ,,ˆ,ˆ21 分别是参数k θθθ,,,21 的极大似然估计值.例3、设某机床加工的轴的直径与图纸规定的中心尺寸的偏差服从),(2σμN ,其中2,σμ未知.为估计2,σμ,从中随机抽取100=n 根轴,测得其偏差为10021,,,x x x .试求2,σμ的极大似然估计.分析:显然,该问题是求解含有多个(两个)未知参数的极大似然估计问题.通过建立关于未知参数2,σμ的似然方程组,从而进行求解.解:(1)写出似然函数:212222)(2212)(2)2(21),(σμσμπσσπσμ∑===---=--∏ni i i x n ni x ee L(2)写出对数似然函数:21222)(21)2ln(2),(∑=---=n i i x n l μσπσσμ(3)将),(2σμl 分别对2σμ、求偏导,并令它们都为0,得似然方程组为:⎪⎪⎩⎪⎪⎨⎧=-+-=∂∂=-=∂∂∑∑==0)(212),(0)(1),(1242221222ni i ni i x n l x l μσσσσμμσμσμ (4)解似然方程组得:x =μˆ,∑=-=ni i x x n 122)(1ˆσ (5)经验证2ˆ,ˆσμ使),(2σμl 达到极大, (6)上述过程对一切样本观察值成立,故用样本代替观察值,便得2,σμ的极大似然估计分别为:X =μˆ,2122)(1ˆn n i i S X X n =-=∑=σ.2、不可通过求导方法获得极大似然估计:当似然函数的非零区域与未知参数有关时,通常无法通过解似然方程来获得参数的极大似然估计,这时可从定义(2)出发直接求)(θL 的极大值点.例4、设总体X 服从均匀分布),0(θU ,从中获得容量为n 的样本n X X X ,,,21 ,其观测值为n x x x ,,,21 ,试求θ的极大似然估计.分析:当写出其似然函数)(θL 时,我们会发现)(θL 的非零区域与θ有关,因而无法用求导方法来获得θ的极大似然估计,从而转向定义(2)直接求)(θL 的极大值.解:写出似然函数:⎩⎨⎧≤≤≤=-其它场合,00,)()()1(θθθn n x x L 为使)(θL 达到极大,就必须使θ尽可能小,但是θ不能小于)(n x ,因而θ取)(n x 时使)(θL 达到极大,故θ的极大似然估计为:)(ˆn X =θ. 进一步,可讨论估计θˆ的无偏性: 由于总体),0(~θU X ,其密度函数与分布函数分别为:⎪⎩⎪⎨⎧<<=其它,00,1)(θθx x p ,⎪⎩⎪⎨⎧≥<<≤=θθθx x x x x F ,10,0,0)(,从而)(ˆn X =θ的概率密度函数为:θθθ<<==--y ny y p y F n p nn n 0,)()]([11ˆ θθθθθθθ≠+====⎰⎰1)()()ˆ(0ˆ)(n ndy ny dy y yp X E E nnn 这说明θ的极大似然估计)(ˆn X =θ不是θ的无偏估计,但对θˆ作一修正可得θ的无偏估计为:)(11ˆn X nn +=θ. 通过修正获得未知参数的无偏估计,这是一种常用的方法.在二次世界大战中,从战场上缴获的纳粹德国的枪支上都有一个编号,对最大编号作一修正便获得了德国生产能力的无偏估计.综上,可得求极大似然估计值的一般步骤.四、求极大似然估计的一般步骤1、由总体分布导出样本的联合概率函数(或联合密度);2、把样本联合概率函数(或联合密度)中自变量看成已知常数,而把参数θ看作自变量,得到似然函数)(θL ;3、求似然函数)(θL 的最大值点(常转化为求对数似然函数)(θl 的最大值点);4、在最大值点的表达式中,用样本值代入就得参数的极大似然估计值.五、极大似然估计的不变性求未知参数θ的某种函数)(θg 的极大似然估计可用极大似然估计的不变原则,证明从略.定理(不变原则)设θˆ是θ的极大似然估计,)(θg 是θ的连续函数,则)(θg 的极大似然估计为)ˆ(θg . 例5、设某元件失效时间服从参数为λ的指数分布,其密度函数为0,);(≥=-x e x f x λλλ,λ未知.现从中抽取了n 个元件测得其失效时间为n x x x ,,,21 ,试求λ及平均寿命的极大似然估计.分析:可先求λ的极大似然估计,由于元件的平均寿命即为X 的期望值,在指数分布场合,有λ1)(=X E ,它是λ的函数,故可用极大似然估计的不变原则,求其极大似然估计.解:(1)写出似然函数:∑===-=-∏ni iix nni x eeL 11)(λλλλλ(2)取对数得对数似然函数:∑=-=ni i x n l 1ln )(λλλ(3)将)(λl 对λ求导得似然方程为:0)(1=-=∑=ni i x n d dl λλλ(4)解似然方程得:xxnni i1ˆ1==∑=λ经验证,λˆ能使)(λl 达到最大,由于上述过程对一切样本观察值成立,故λ的极大似然估计为:X1ˆ=λ; 根据极大似然估计的不变原则,元件的平均寿命的极大似然估计为:X X E ==λˆ1)(. 五、小结1、极大似然估计的思想;2、求解未知参数极大似然估计的一般步骤;3、极大似然估计的不变原则.。

极大似然法

极大似然估计的不变性

• 分为X析的:期可望先值求,在的指极数大分似布然场估合计,,有由于E元( X件)的平1均,寿它命是即

的函数,故可用极大似然估计的不变原则,求其极大似然

估计.

n

•

解:(1)写出似然函数:L()

n

e e xi

xi

n

i 1

i 1

n

(2)取对数得对数似然函数: l() n ln xi i 1

• 2、把样本联合概率函数(或联合密度)中自变量看

成已知常数,而把参数 看作自变量,得到似然函数

L( )

• 3、求似然函数 L( ) 的最大值点(常转化为求对数似

然函数 l( ) 的最大值点);

• 4、在最大值点的表达式中,用样本值代入就得参数 的极大似然估计值.

极大似然估计的不变性

• 求未知参数 的某种函数 g( )的极大似然估计可用极大

n

L( ) L(x1, x2 ,, xn ; ) p(xi ; ) i1

称 L( )为似然函数.

求总体参数 的极大似然估计值的问题就是求似

然函数 L( )的最大值问题.

似然函数与极大似然估计

• 2、连续分布场合:

设总体 X 是连续离散型随机变量,其概率密

度函数为 f (x; ) ,若取得样本观察值为

取x1值, x为2 ,(x1,,xxn2,,则, 因xn为)时随联机合点密(度X1函, X数2 ,值,为X n )

n

f (xi ; ) 。所以,按极大似然法,应选

择i1 的值使此概率达到最大.我们取 )

再按前述方法求参数

的极大似然估i1计值.

极大似然函数

极大似然估计,是以极大似然函数为基础。 所谓“似然函数”,就是构造一个以观察数据和

参数估计极大似然法

将其取对数,然后对 1 , 2 ,, 2 , , k ) 0 1 ln L( 1 , 2 , , k ) 0 k

该方程组的解 ˆi ˆi (x1, x2 ,, xn ),i 1,2,, k , 即为 i 的极 大似然估计值.

求极大似然估计的一般步骤归纳如下:

(1)求似然函数 L( ) ;

(2)求出 ln L( ) 及方程

d ln L( ) 0 d

;

(3)解上述方程得到极大似然估计值

ˆ ˆ( x , x ,, x ) 1 2 n .

(4)解上述方程得到极大似然估计量

ˆ ˆ( X , X ,, X ) 1 2 n .

令

ˆ( x , x ,, x ) 解此方程得θ的极大似然估计值 1 2 n ,

从而得到θ的极大似然估计量ˆ( X1, X 2 ,, X n ) .

因为 解方程

L( )

与

ln L( )

具有相同的最大值点

d ln L( ) 0 d

也可得θ的极大似然估计值

ˆ( x , x ,, x ) 和θ的极大似然估计量 ˆ( X , X ,, X ) . 1 2 n 1 2 n

~ x d 2 ln L() 且 0 2 d ~ x

~ 从而得出λ的极大似然估计量为 X

例:设总体 X 服从参数为λ 的指数分布,其中λ 未

( x1 , x2 ,, xn ) ( X 1 , X 2 ,, X n ) 为从总体抽取一个样本, 知,

为其样本观测值, 试求参数λ 的极大似然估计值和 估计量.

例:设随机变量X服从泊松分布:

P{ X k}

k e

k!

,

极大似然估计方法

极大似然估计方法极大似然估计(Maximum Likelihood Estimation,MLE)方法是一种用于估计参数的统计方法,它基于观测到的样本数据,通过选择最大化观测数据出现的概率的参数值来估计未知参数。

极大似然估计是概率论和统计学中最重要的方法之一,广泛应用于各个领域的数据分析与建模中。

极大似然估计方法的核心思想是基于某一参数下观测数据出现的概率,选择使得这个概率最大的参数值。

具体而言,给定一个观测数据集合X,其来自于一个具有参数θ的概率分布,我们要估计未知参数θ的值。

极大似然估计的目标是找到一个参数值θ^,使得给定θ^条件下观测数据集合X出现的概率最大。

数学上,极大似然估计可以通过最大化似然函数来求解。

似然函数是一个参数的函数,表示给定某个参数θ下观测数据出现的概率。

似然函数的定义如下:L(θ|X) = P(X|θ)数的函数,表示给定某个参数θ下观测数据出现的概率。

极大似然估计的目标是寻找一个参数θ^,使得似然函数最大化,即:θ^ = arg max L(θ|X)为了方便计算,通常将似然函数转化为其对数形式,即对数似然函数:l(θ|X) = log L(θ|X)本文将主要介绍如何利用极大似然估计来估计参数。

具体而言,将分为两个部分:首先是介绍极大似然估计的理论基础,包括似然函数和对数似然函数的定义,以及如何通过最大化似然函数来估计参数;其次是通过一个实际的例子,展示如何使用极大似然估计来求解参数。

理论基础似然函数是极大似然估计的核心概念之一。

似然函数是一个参数的函数,表示给定某个参数θ下观测数据出现的概率。

似然函数的定义如下:L(θ|X) = P(X|θ)数的函数,表示给定某个参数θ下观测数据出现的概率。

似然函数的值越大,则表示给定参数θ的取值越可能产生观测数据X。

对数似然函数是似然函数的对数变换,通常在实际计算中会更加方便。

它的定义如下:l(θ|X) = log L(θ|X)对数似然函数和似然函数存在着一一对应关系,因此在求解参数时,两者等价。

极大似然估计方法

极大似然估计方法极大似然估计方法是统计学中一种常用的参数估计方法,用于根据已知的样本数据来估计未知的参数值。

该方法的核心思想是选择使得观测到的样本数据出现的概率最大的参数值作为估计值。

在进行极大似然估计之前,首先需要确定一个概率分布模型。

以伯努利分布为例,假设有一组二元观测数据{0,1,1,0,1},其中1表示成功,0表示失败。

我们希望通过这组数据来估计成功的概率p。

假设成功的概率p服从伯努利分布,则观测到这组数据的概率为p^3*(1-p)^2。

极大似然估计的目标是找到一个使得观测到的样本数据的概率最大的参数值。

通常通过对似然函数取对数,转化为求解极值的问题。

对于上述的伯努利分布模型,我们可以计算出对数似然函数L(p)为3log(p)+2log(1-p)。

为了找到使得L(p)最大的p值,可以对L(p)求导,令导数等于0,并解方程求解。

极大似然估计方法的优点是可以直接利用样本数据来进行参数估计,而无需对概率分布的形式做出过多的假设。

因此,它具有广泛的应用领域。

例如,在医学研究中,可以利用极大似然估计来估计某种疾病的患病率;在金融风险管理中,可以利用极大似然估计来估计某种金融产品的违约概率。

然而,极大似然估计方法也存在一些限制和注意事项。

首先,估计结果的准确性依赖于样本数据的质量和数量。

如果样本数据存在较大的误差或者样本量较小,估计结果可能会失真。

其次,极大似然估计方法对假设的概率分布模型敏感。

如果所选择的模型与真实分布不匹配,估计结果也可能不准确。

因此,在使用极大似然估计方法时,需要对所选择的模型进行合理性检验。

极大似然估计方法是一种常用的参数估计方法,具有广泛的应用领域。

它通过最大化样本数据出现的概率来估计参数值,充分利用了样本数据的信息。

然而,在使用极大似然估计方法时,需要注意样本数据的质量和数量,以及所选择的概率分布模型的合理性。

只有在这些条件满足的情况下,才能得到准确可靠的参数估计结果。

极大似然估计法及其在统计中的应用

极大似然估计法及其在统计中的应用统计学是一门研究样本数据的收集、分析和解释的学科。

统计方法在各个学科中都有着广泛的应用,例如医学、经济学、社会学、心理学等。

而在统计中,极大似然估计法是一种常用的推断方法,本文将详细介绍极大似然估计法及其在统计学中的应用。

一、极大似然估计法的基本原理极大似然估计法的基本思想是:在已知样本的前提下,选择一个最合适的参数值,使得样本中出现该参数值的概率最大。

这里的“概率”指的是似然函数,即以参数值为自变量,样本出现的概率为因变量的函数。

以简单的二项分布为例,其概率函数为:P(X=k)=C(n,k)p^k(1-p)^(n-k)其中,X表示二项分布的随机变量,k表示X的取值,n表示试验次数,p表示成功的概率。

在已知样本的情况下,极大似然估计法的目标是确定p的最佳估计值。

首先,根据已知样本的情况,似然函数L(p)为:L(p)=f(x1)f(x2)...f(xn)其中,f(x)表示二项分布中取值为x的概率密度函数,n表示样本容量,x1,x2,...,xn为样本中的数据。

而根据似然函数的定义,选择最合适的p值即为最大化似然函数L(p)。

因此,极大似然估计法的估计值为:p^=argmax L(p)最后,通过求解该表达式的导数,可以求得p的最佳估计值为:p^=k/n其中,k表示样本中成功的次数,n表示样本容量。

二、极大似然估计的应用极大似然估计法在统计学中有着广泛的应用,本节将介绍其中的一些常见应用。

1. 线性回归在线性回归中,极大似然估计法通常被用来估计参数向量。

对于给定的样本数据,线性回归的目标是找到一组最优参数,使得样本数据的误差平方和最小。

而误差平方和的似然函数则可以表示为一个高斯分布的概率密度函数。

通过极大似然估计法,可以求解该高斯分布的均值和方差,从而得到最佳参数估计值。

2. 逻辑回归在逻辑回归中,极大似然估计法通常被用来估计模型中的系数。

逻辑回归是一种用来处理二元分布数据的分类算法,其目标是根据已知的样本数据,预测模型中某个事件发生的概率。

极大似然估计法步骤

极大似然估计法步骤极大似然估计法(Maximum Likelihood Estimation,MLE)是一种常用的参数估计方法,它利用样本数据来估计概率模型的参数。

它的基本思想是选择参数值使得观测到的样本出现的概率最大化。

极大似然估计法被广泛应用于统计学、机器学习以及其他领域。

极大似然估计法的步骤可以概括为以下几个主要步骤:1.确定参数化模型:首先,必须确定概率模型的形式和参数化,以便进行参数估计。

例如,对于二项分布模型,我们需要确定参数p 表示成功概率。

2.构建似然函数:接下来,需要构建似然函数。

似然函数是指在给定模型参数条件下观测到的样本的条件概率密度(或离散情况下的概率质量函数)。

似然函数的形式可以根据不同的概率模型进行定义。

例如,对于离散情况下的伯努利分布,似然函数可以表示为:L(p) = p^k * (1-p)^(n-k),其中k是观测到的成功次数,n是总的观测次数。

对于连续情况下的正态分布,似然函数可以表示为:L(μ,σ) = (2πσ^2)^(-n/2) * exp[-(1/2σ^2) * Σ(xi-μ)^2]。

3.对数似然函数的求解:通常,为了便于计算和优化,我们会使用对数似然函数进行求解。

对数似然函数和似然函数具有相同的最大值点,但其大大简化了计算过程。

4.最大化对数似然函数:确定参数的MLE估计值等于使得对数似然函数最大化时的参数值。

常见的最大化方法包括数值方法(如牛顿法、梯度下降法等)和解析方法。

对于某些简单的模型,可以通过求导数等条件判断来获得解析解。

例如,对于伯努利分布中的参数p,可以通过求取对数似然函数的一阶导数,并令其等于0,解得MLE估计值为p = k/n。

5.参数估计:得到MLE估计值后,就可以根据估计参数进行进一步的分析和预测了。

通常,MLE估计值具有良好的频率特性,即当样本数量趋近于无穷大时,估计值收敛到真实参数。

极大似然估计法的优点在于其较好的性质和理论基础。

极大似然估计法

n

(3) 对似然函数求导,令其为零,得到似然估计值

n n dl( p) n 1 1 n 1 xi ( ) xi 0 dp 1 p i 1 p 1 p 1 p p(1 p) i 1

1 n T ˆ p xi n i 1 n

6

例2:设某机床加工的轴的直径与图纸规定的中心 尺寸的偏差服从N (, 2 ) ,其中参数 , 2 未知。为 了估计 , 2 ,从中随机抽取n=100根轴,测得其偏 差为x1,x2…x100。试求 , 2的极大似然估计。

i 1 N

如果不要求 的分布密度,只要问 的值为多少 (最可能的值),那么就只要求 使得:

L y1 y N max

14

对于确定了的观测值Y而言,似然函数仅仅是参数 的函数。由极大似然原理可知,ˆML 满足以下方程:

L ˆ

ˆ ˆ ML

0

考虑到似然函数一般为指数函数,而指数函数和 对数函数都是单调的,为了方便求解,上式等价于 如下方程:

ln L ˆ

ˆ ˆ ML

0

ˆ 在特殊情况下,ML 能够通过方程得到解,但在一 般情况下,上式不容易得到解析解,需要采用数值 方法来求近似解。

15

下面利用极大似然原理,分析动态系统模型参数 的极大似然估计问题。首先分析极大似然估计和最 小二乘估计的关系。

考虑系统模型为线性差分方程:

极大似然的思想

先看一个简单例子:

某位同学与一位猎人一起外出打猎,一只野 兔从前方窜过。只听一声枪响,野兔应声到下了, 如果要你推测,这一发命中的子弹是谁打的?

你就会想,只发一枪便打中,由于猎人命中 的概率一般大于这位同学命中的概率,看来这一 枪应该是猎人射中的。这个例子所作的推断就体 现了极大似然的基本思想。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

。这里n ,p(X i 1

i

,是 )

如果样本取值x1x2…xn,则事件 {X1 x1, , X n xn}

发生的概率为 n i1

p(

xi

,

)

。这一概率随

的值变化而

变化。从直观上来看,既然样本值x1x2…xn已经出现

了,它们出现的概率相对来说应比较大,应使其概

率取比较大的值。取似然函数如下:

n

1

nN

v2 (k )

2 N k n1

根据极大似然原理,对数似然函数取极值,等价于:

V (ˆML )

1 N

nN

v2 (k )

k n1

ˆML

min

式中v(k)满足约束条件。

23

综合以上分析,极大似然估计就是使得 V (ˆML) min 因为V () 是参数c1,c2…cn的非线性函数,只能通过 迭代法求解.这里介绍Newton-Raphson法。

nN v2 (k) ˆ 2 1

k n1

N

nN v2 (k)

k n1

(3) 计算J的梯度J / ˆ和Hessian矩阵2 J / ˆ T

J

ˆ

nN k n1

v(k

)

v(k

ˆ

)

其中:

v(k) y(k i) aˆi

n j 1

cˆi

v(k aˆi

j)

v(k )

bˆi

u(k

i)

n j 1

cˆi

v(k bˆi

14

对于确定了的观测值Y而言,似然函数仅仅是参数

的函数。由极大似然原理可知,ˆML 满足以下方程:

L

ˆ

ˆˆML

0

考虑到似然函数一般为指数函数,而指数函数和

对数函数都是单调的,为了方便求解,上式等价于

如下方程:

ln L

ˆ 0 ˆˆML

在特殊情况下,ˆML 能够通过方程得到解,但在一 般情况下,上式不容易得到解析解,需要采用数值

j)

v(k) v(k i)

cˆi

n j 1

cˆi

v(k cˆi

j)

25

可以看出上面三个等式为差分方程,这些差分方程

的初始条件为0,可以求解这些差分方程,分别求出

v(k)关于aˆ1, , aˆn,bˆ0, ,bˆn,cˆ1, ,cˆn的全部偏导数。

再由向量 J / ˆ 对参数向量 ˆ求偏导数,得到

ai

y(k

i)

n i0

biu(k

i)

n i1

ci

(k

i)

20

(k) y(k)

n i1

ai

y(k

i)

n i0

biu(k

i)

n i1

ci

(k

i)

在独立观测的前提下,得到输入输出数据{y(k)}和

{u(k)},测量N次,得到N值白噪声向量为:

(n 1) (n 2) (n N)T N 0, 2I

可以表示成以下向量问题:

16

Y e

Y y(n 1) y(n 2) y(n N)T

e (n 1) (n 2) (n N)T

a1 a2 an b0 b1 bn T

y(n)

y(n 1)

y(n N 1)

y(1) u(n 1) y(2) u(n 2)

y(N) u(n N)

分析:设X是抽查一个产品时的不合格品的个数 ,则X服从参数为p的两点分布。抽查n个产品, 则得样本X1,X2,…Xn,其观察值为x1,x2…xn,假 如样本有T个不合格,即表示x1,x2…xn中有T个取 值为1,有n-T个取值为0。基于此求参数p的极大 似然估计值。

5

(1) 写出似然函数

n

L( p) pxi (1 p)1xi i 1

估计的求解。

19

2.数值解法

考虑模型为如下形式: A(z1) y(k) B(z1)u(k) C(z1) (k)

A(z1) 1 a1z1 B(z1) b0 b1z1 C(z1) 1 c1z1

an zn bn zn cn zn

上式可以改写为:

(k) y(k)

n i1

的不同的参数值,将有不同的概率密度函数。

当 ˆML ,得到该观测值{y1,y2,…,yN}的可能性最 大。也就是说,当观测结果为{y1,y2,…,yN}的条件

下,ˆML是接近于参数 真实值的可能性最大的参数

估计值。

13

极大似然法需要构造一个以数据和未知参数为自 变量的似然函数,并通过极大化似然函数,获得模 型的参数估计值。

求似然函数 L( ) 最大值问题。这通过解方程dL() / d 0

来得到。因为 ln L( )和 L( )的增减性相同,所以它们

在 的同一值处取得最大值,称 ln L( ) 为对数似然

函数。可以通过求解下列方程来得到极大似然解。

d ln L( ) 0 d

4

例1:设某工序生产的产品的不合格率为p,抽n个 产品作检验,发现有T个不合格,试求p的极大似 然估计值。

似然函数,并求对数得到:

ln

L

N 2

ln

2

N 2

ln

2

1

2

2

nN

v2 (k )

k n1

其中:

ln L

ˆ 2

0

ˆ 2

1 N

nN v2 (k)

k n1

v(k) y(k)

n i1

aˆi

y(k

i)

n i0

bˆiu(k

i)

n i1

cˆiv(k

i)

22

进一步得到:

ln L const N ln

数 , 2 的似然方程组,从而进行求解。

7

n

L(, 2 ) i1

n

1

( xi )2

e (2 ) e 2 2

2

n 2

( xi )2 i1

2 2

2

l(,

2

)

n 2

ln(2

2

)

1

2

2

n

( xi

i 1

)2

l(, 2 )

1

2

n

( xi

i 1

) 0

l

(

,

2

)

2

n

2 2

1

2 4

340 410 450 520 620 190 210 800 1100

9

L( )

n i 1

1

e

xi

e n

1

n i1

xi

ln

L

n

ln

1

n

i 1

xi

d ln L

d

n

1

2

n

xi

i 1

0

ˆ

1 n

n

xi

i 1

x

1

n

n i 1

xi

1 5723 318 18

10

极大似然估计的法的运算步骤: 1、由总体分布导出样本的联合概率函数; 2、把样本联合概率函数中自变量看成已知常数,

(1) 选定初始值ˆ(0) 。对于ˆ(0)中的参数a1,a2…an, b0,b1…bn,可按模型:

v(k) Aˆ (z1) y(k) Bˆ (z1)u(k) 用最小二乘法求得,对于ˆ(0) 中的c0,c1…cn可以先 假定一些值。

24

(2) 计算预测误差 v(k) y(k) yˆ(k)

J 1 2

(2) 对似然函数取对数,得到对数似然函数:

n

l( p) [xi ln p (1 xi ) ln(1 p)] i 1

n

n ln(1 p) xi[ln p ln(1 p)] i 1

(3) 对似然函数求导,令其为零,得到似然估计值

dl( p)

dp

n 1 p

n i1

1 xi ( p

1) 1 p

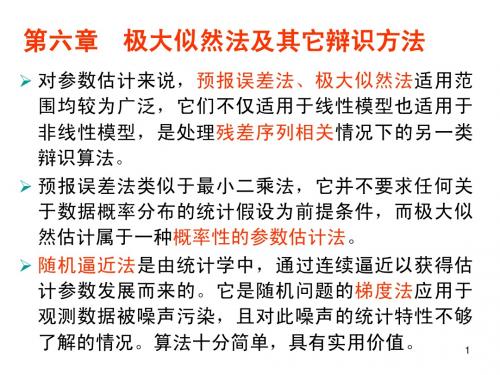

➢ 随机逼近法是由统计学中,通过连续逼近以获得估 计参数发展而来的。它是随机问题的梯度法应用于 观测数据被噪声污染,且对此噪声的统计特性不够 了解的情况。算法十分简单,具有实用价值。

1

极大似然的思想

先看一个简单例子:

某位同学与一位猎人一起外出打猎,一只野 兔从前方窜过。只听一声枪响,野兔应声到下了, 如果要你推测,这一发命中的子弹是谁打的?

2J

ˆˆT

nN k n1

v(k )

ˆ

v(k )

ˆT

nN k n1

v(k

)

2v(k)

ˆˆT

因为v(k)是个小量,

n k

N n 1

v(k

)

2v(k)

ˆˆT

可以忽略。

2 J

ˆˆT

nN v(k) v(k)

kn1 ˆ ˆT

26

(4) 按照Newton-Raphson法计算:

ˆ(k

1)

ˆ(k

)

ˆML T 1 TY

18

这与最小二乘法的结果相同,这说明当噪声为高斯

白噪声时,参数 的极大似然估计和最小二乘估计

是等价的。进一步,由:

ln L

2

2

2 ML

0

ˆ

2 ML

1 N

Y ˆML

T

Y ˆML

在实际问题中,e(k) 往往不是白噪声序列,而是相

关噪声序列。下面讨论残差相关的情况下极大似然

而把参数 看作自变量,得到似然函数L( ) ;

3、求似然函数的最大值点(常转化为求对数似 然函数的最大值点);

4、在最大值点的表达式中,用样本值代入就得 参数的极大似然估计值。

11

作业:设总体的密度函数为: