多标签(multi-label)数据问题常用的分类器或者分类策略

多标签多分类算法

多标签多分类算法

多标签多分类算法指的是同时将一个样本分到多个分类标签中的分类算法。

在传统的分类算法中,每个样本只能被分到一个分类标签中,而多标签多分类算法可以将一个样本分到多个分类标签中,从而更准确地描述样本的特征。

常见的多标签多分类算法包括:

1. One-vs-Rest (OvR):将每个分类标签作为一个二分类问题,训练多个分类器,将样本分到每个分类标签中的一个或多个分类器中。

2. Binary Relevance (BR):将多标签多分类问题转化为多个二分类问题,每个标签对应一个二分类问题,训练多个二分类器,将样本分到每个标签中的一个分类器中。

3. Classifier Chains (CC):将每个标签作为一个二分类问题,但是每个分类器的输入还包括前面的分类结果,训练多个二分类器,将样本按照一定的顺序传递给不同的分类器进行分类。

4. Label Powerset (LP):将每个样本的多个标签组合成一个新的标签,将多标签多分类问题转化为多分类问题,训练一个多分类器。

5. Random k-labelsets (RAkEL):随机选择k个标签子集,将多标签多分类问题转化为多个二分类问题,训练多个二分类器,根据预测结果组合成最终的标签集。

这些算法各有优缺点,适用于不同的问题和数据集。

在选择多

标签多分类算法时,需要根据实际情况考虑算法的复杂度、准确性和可扩展性等因素。

机器学习技术中的多标签分类问题解决方法

机器学习技术中的多标签分类问题解决方法在机器学习领域中,分类问题一直是一个重要的研究方向。

传统的分类问题通常是将输入样本分配到预定义的单个类别中。

然而,在现实生活中,很多样本可能属于多个不同的类别,这就引出了多标签分类问题。

多标签分类问题可以描述为给定一个样本,预测其对应的多个标签。

解决多标签分类问题的方法有很多种,下面将介绍几种常用的方法。

1. 问题转化方法问题转化方法是将多标签分类问题转化为多个独立的单标签分类问题。

常用的转化方法有二进制关联、标签级联和问题转变方法。

- 二进制关联是将每个标签视为一个独立的二分类问题。

对于每个标签,训练一个二分类模型来判断样本是否属于该标签。

这种方法简单直接,但忽略了标签之间的关联。

- 标签级联是依次训练多个分类器,每个分类器预测一个标签。

每个分类器的训练样本由前面的分类器预测的结果进行调整。

这种方法考虑了标签之间的顺序关系,但忽略了标签之间的相关性。

- 问题转变方法是将多标签分类问题转化为单标签分类问题。

根据样本的标签情况,将多标签问题转化为一系列的单标签问题。

例如,可以将多标签问题转化为多个二分类问题,每个二分类问题用来判断样本是否属于某个标签或不属于任何标签。

这种方法可以充分利用现有的单标签分类方法,但会引入标签之间的错误传播问题。

2. 算法改进方法除了问题转化方法,还有一些针对多标签分类问题的算法改进方法。

- One-vs-Rest (OvR) 方法:OvR 方法是将多标签问题转化为多个二分类问题。

对于每个标签,训练一个二分类模型以区分该标签是否出现。

最后,将每个二分类模型的预测结果组合起来得到最终的多标签分类结果。

- K-Nearest Neighbors (KNN) 方法:KNN 方法是一种基于实例的方法。

对于一个待分类的样本,KNN 方法会找出其最近的 K 个邻居,并基于这 K 个邻居的标签情况进行分类。

KNN 方法可以灵活地处理多标签问题,但对于大规模数据集可能计算开销较大。

机器学习技术中的多值分类方法比较

机器学习技术中的多值分类方法比较在机器学习领域,分类是一种常见的任务,它将数据分为不同的类别。

然而,有些问题需要将数据分为多个类别,这就需要用到多值分类方法。

本文将对机器学习技术中的多值分类方法进行比较和介绍。

一、一对多方法(One-vs-Rest)一对多方法是最常见和简单的多值分类方法之一。

它将多值分类问题转化为多个二值分类问题。

具体来说,对于有N个类别的分类问题,该方法将数据分为一个正类别和N-1个负类别。

然后针对每个类别,训练一个二值分类器来判断数据是否属于该类别。

在预测阶段,将数据输入所有的二值分类器中并选择概率最高的类别作为最终分类结果。

优点:简单易实现,适用于各种分类算法。

缺点:在某些情况下,不同类别之间的相互关系可能被忽略。

二、多标签方法(Multi-label)多标签方法是另一种处理多值分类问题的方法。

与一对多方法不同,多标签方法允许一个样本属于多个类别。

这在某些场景下是非常有用的,比如图像分类中的物体识别,一个图像中可能同时包含多个物体。

常用的多标签方法包括二值化方法(Binary Relevance)和连续输出方法(Continuous Output)。

二值化方法将每个类别视为独立的二值分类问题,然后将多个二值分类结果合并成一个多标签分类结果。

而连续输出方法则使用多值回归技术,将每个类别的输出看作一个连续值,然后根据阈值将连续输出离散为多个类别。

优点:能够处理一个样本属于多个类别的情况。

缺点:类别之间的关联性可能被忽略。

三、多类别方法(Multi-class)多类别方法是直接处理多值分类问题的方法,它可以将数据划分为多个类别而不是通过转化为多个二值分类问题。

常见的多类别方法包括最大概率方法(One-vs-One)和最大边际方法(One-vs-All)。

最大概率方法将多值分类问题转化为多个二值问题,但是每次只训练两个类别之间的分类器,而不是所有类别之间的分类器。

在预测阶段,通过将数据输入所有二值分类器并计算各个类别的概率,选择概率最高的类别作为最终分类结果。

如何应对机器学习中的多类别分类问题

如何应对机器学习中的多类别分类问题机器学习中的多类别分类问题在实际应用中经常遇到。

在这个问题中,我们需要将数据实例分为三个或更多个不同的类别。

例如,在图像分类中,我们可能需要将图像分类为动物、交通工具和食品等多个类别。

本文将介绍一些常见的方法和技术,以帮助应对机器学习中的多类别分类问题。

首先,我们需要了解多类别分类问题的特点和挑战。

相比于二分类问题,多类别分类问题需要考虑更多的类别和更复杂的决策边界。

对于每个类别,我们需要学习到一组特定的特征和规律,以便对新的实例进行准确分类。

因此,多类别分类问题需要更复杂和精细的模型。

以下是一些应对多类别分类问题的方法和技术:1. 一对多方法(One-vs-Rest):这是一种常见的方法,它将多类别分类问题转化为多个二分类问题。

对于每个类别,我们训练一个分类器来区分该类别与其他所有类别的实例。

在预测时,我们使用这些分类器对新的实例进行分类,选择概率最高的类别作为最终分类结果。

虽然这种方法简单易懂,但是由于每个分类器只关注一对类别,可能会导致类别间的不平衡问题。

2. 多标签分类方法(Multilabel Classification):这种方法将多类别分类问题转化为多个二分类问题,每个二分类问题表示一个类别的存在与否。

不同于一对多方法,多标签分类方法允许一个实例属于多个类别。

在训练时,我们为每个类别训练一个二分类器,并且在预测时,我们可以根据需要选择一个或多个类别作为最终分类结果。

这种方法适用于存在重叠类别的情况,例如图像中的多个对象同时出现。

3. 多分类器方法(Multiple Classifier System):这种方法使用多个分类器来解决多类别分类问题。

每个分类器负责分类一部分类别,全部分类器的预测结果经过集成或投票得到最终分类结果。

这种方法可以降低每个分类器的复杂度,提高整体的分类精度。

常见的多分类器方法包括随机森林和AdaBoost等。

4. 神经网络方法(Neural Network):神经网络在多类别分类问题中表现良好。

多标签分类方法

多标签分类方法

多标签分类方法是一种机器学习技术,它可以将一个数据样本分配到多个标签中。

这种方法在现实生活中有很多应用,例如音乐、影视、图片和文本分类等。

多标签分类方法通常需要面对高维度和复杂的数据,因此需要采用一些有效的方法来处理这些数据。

传统的多标签分类方法包括二元关联规则、决策树和朴素贝叶斯等,但这些方法的准确率和效率都有所限制。

近年来,随着深度学习技术的发展,深度神经网络逐渐成为多标签分类方法的主流,其表现非常出色。

常见的深度神经网络模型包括卷积神经网络(CNN)、循环神经网络(RNN)和注意力机制(Attention)等。

除了深度神经网络,还有一些其他的多标签分类方法,例如标签传递算法、标签一致化和多输出学习等。

在选择多标签分类方法时,需要根据具体的数据特点和应用场景来选择最合适的方法。

- 1 -。

多标签分类(multi-labelclassification)综述

多标签分类(multi-labelclassification)综述意义⽹络新闻往往含有丰富的语义,⼀篇⽂章既可以属于“经济”也可以属于“⽂化”。

给⽹络新闻打多标签可以更好地反应⽂章的真实意义,⽅便⽇后的分类和使⽤。

难点(1)类标数量不确定,有些样本可能只有⼀个类标,有些样本的类标可能⾼达⼏⼗甚⾄上百个。

(2)类标之间相互依赖,例如包含蓝天类标的样本很⼤概率上包含⽩云,如何解决类标之间的依赖性问题也是⼀⼤难点。

(3)多标签的训练集⽐较难以获取。

⽅法⽬前有很多关于多标签的学习算法,依据解决问题的⾓度,这些算法可以分为两⼤类:⼀是基于问题转化的⽅法,⼆是基于算法适⽤的⽅法。

基于问题转化的⽅法是转化问题数据,使之使⽤现有算法;基于算法适⽤的⽅法是指针对某⼀特定的算法进⾏扩展,从⽽能够处理多标记数据,改进算法,适⽤数据。

基于问题转化的⽅法基于问题转化的⽅法中有的考虑标签之间的关联性,有的不考虑标签的关联性。

最简单的不考虑关联性的算法将多标签中的每⼀个标签当成是单标签,对每⼀个标签实施常见的分类算法。

具体⽽⾔,在传统机器学习的模型中对每⼀类标签做⼆分类,可以使⽤SVM、DT、Naïve Bayes、DT、Xgboost等算法;在深度学习中,对每⼀类训练⼀个⽂本分类模型(如:textCNN、textRNN等)。

考虑多标签的相关性时候可以将上⼀个输出的标签当成是下⼀个标签分类器的输⼊。

在传统机器学习模型中可以使⽤分类器链,在这种情况下,第⼀个分类器只在输⼊数据上进⾏训练,然后每个分类器都在输⼊空间和链上的所有之前的分类器上进⾏训练。

让我们试着通过⼀个例⼦来理解这个问题。

在下⾯给出的数据集⾥,我们将X作为输⼊空间,⽽Y作为标签。

在分类器链中,这个问题将被转换成4个不同的标签问题,就像下⾯所⽰。

黄⾊部分是输⼊空间,⽩⾊部分代表⽬标变量。

在深度学习中,于输出层加上⼀个时序模型,将每⼀时刻输⼊的数据序列中加⼊上⼀时刻输出的结果值。

机器学习中的多标签分类问题解析

机器学习中的多标签分类问题解析一、引言机器学习是人工智能领域的重要分支,其在许多领域和任务中都取得了显著的成就。

多标签分类是机器学习中常见的问题之一,它在许多现实场景中都具有重要应用价值。

本文将对机器学习中的多标签分类问题进行解析和探讨。

二、多标签分类问题的定义多标签分类问题是指在给定一组输入样本的情况下,将每个样本分配给多个标签。

相比于传统的单标签分类问题,多标签分类问题的挑战在于一个样本可能属于多个类别,需要对这些类别进行准确的预测。

三、多标签分类的应用领域多标签分类在许多领域中都具有广泛的应用,包括文本分类、图像分类、音频分类等。

以文本分类为例,多标签分类可以应用于新闻分类、情感分析、垃圾邮件过滤等任务中。

在图像分类领域,多标签分类可以应用于物体识别、人脸识别等任务中。

四、传统方法在机器学习的早期阶段,研究人员主要使用传统的方法来解决多标签分类问题。

这些方法包括Binary Relevance、Label Powerset、Classifier Chains等。

这些方法将多标签分类问题转化为单标签分类问题的组合,通过建立多个分类器来预测每个标签的结果。

五、基于深度学习的方法随着深度学习的发展,越来越多的研究者将其应用于多标签分类问题中,并取得了显著的进展。

基于深度学习的方法利用深度神经网络的强大表示学习能力,能够从数据中自动学习到更加有用的特征表示。

目前,常用的基于深度学习的方法包括Multi-Layer Perceptron (MLP)、Convolutional Neural Network (CNN)、Recurrent Neural Network (RNN)等。

六、评价指标在多标签分类问题中,评价指标起着至关重要的作用。

常用的评价指标包括准确率、召回率、F1值等。

准确率衡量了预测值和真实值之间的匹配程度,召回率衡量了分类器对正样本的识别能力,F1值综合了准确率和召回率。

七、应对挑战在解决多标签分类问题时,研究人员面临着一些挑战。

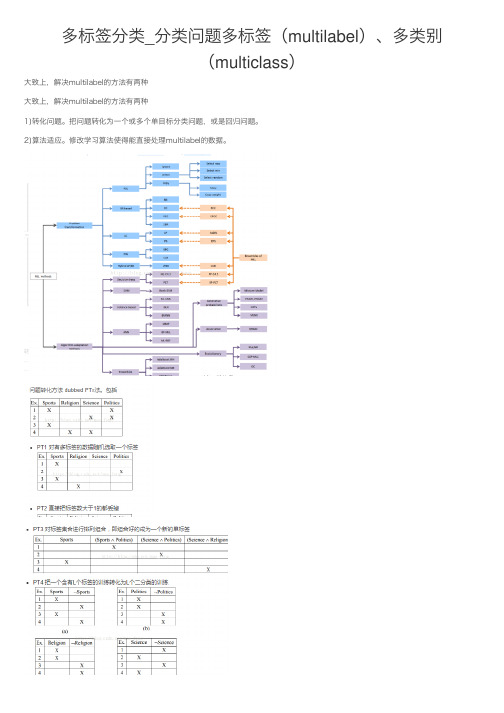

多标签分类_分类问题多标签(multilabel)、多类别(multiclass)

多标签分类_分类问题多标签(multilabel)、多类别(multiclass)⼤致上,解决multilabel的⽅法有两种⼤致上,解决multilabel的⽅法有两种1)转化问题。

把问题转化为⼀个或多个单⽬标分类问题,或是回归问题。

2)算法适应。

修改学习算法使得能直接处理multilabel的数据。

结论是PT3效果很好,PT4较好也应⽤⽐较⼴泛,PT6由于数据不平衡(如果标签密度太⼩会导致⼤量的-1)。

另外,以下⼏个问题是需要关注和进⼀步研究的Dimensionality Reduction 降维Label Dependence 标注依赖Active learning 主动学习Multi-instance multi-label learning (MIML) 多实例多标签Multi-view learning. 多视⾓Multi-task learning (MTL) 多任务Hierarchical multi-label classification (HMC) 多层多标签1、multilabel classification的⽤途多标签分类问题很常见, ⽐如⼀部电影可以同时被分为动作⽚和犯罪⽚, ⼀则新闻可以同时属于政治和法律,还有⽣物学中的基因功能预测问题, 场景识别问题,疾病诊断等。

2. 单标签分类在传统的单标签分类中,训练集中的每⼀个样本只有⼀个相关的标签 l ,这个标签来⾃于⼀个不重合的标签集合L,|L| > 1.当|L|=2时,这就是⼀个⼆分类问题,或⽂本和⽹页数据的过滤(filtering)问题。

当|L| > 2 时是多分类问题。

3、多标签分类问题的定义简单的说就是同⼀个实例,可以有多个标签, 或者被分为多个类。

和多分类的区别是, 多分类中每个实例只有⼀个标签。

下⾯是⼏个形式化的定义。

⽤代表样本空间,= 为有限标签集合, 我们假设中的样本实例和的⼀个⼦集相关,这个⼦集称作相关标签集。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

多标签(multi-label)数据问题常用的分类器或者分类策略

多标记分类和传统的分类问题相比较,主要难点在于以下两个方面:

(1)类标数量不确定,有些样本可能只有一个类标,有些样本的类标可能高达几十甚至上百个。

(2)类标之间相互依赖,例如包含蓝天类标的样本很大概率上包含白云,如何解决类标之间的依赖性问题也是一大难点。

对于多标记学习领域的研究,国外起步较早,起源于2000年Schapire R E等人提出的基于boost方法的文本多分类,著名的学者有G Tsoumakas、Eyke Hüllermeier、Jesse Read,Saso Dzeroski等等。

在国内,南京大学的周志华和张敏灵和哈工大的叶允明等等学者在这一领域较都有很好研究成果。

目前有很多关于多标签的学习算法,依据解决问题的角度,这些算法可以分为两大类:一是基于问题转化(Problem Transformation)的方法,二是基于算法适应的方法和算法适应方法(Algorithm Adaptation)。

基于问题转化的多标记分类是转化问题数据,使之适用现有算法;基于算法适应的方法是指针对某一特定的算法进行扩展,从而能够直接处理多标记数据,改进算法,适应数据。

基于这两种思想,目前已经有多种相对成熟的算法被提出,如下图所示:

问题转化方法(Problem Transformation):该类方法的基本思想是通过对多标记训练样本进行处理,将多标记学习问题转换为其它已知的学习问题进行求解。

代表性学习算法LP[1],Binary Relevance[2],Calibrated Label Ranking[3],Random k-labelsets[4]。

总体来说,这类方法有考虑类标之间的联系,但是对于类标较多、数据量较大的数据集,这类方法的计算复杂度是一个很明显的缺陷。

算法适应方法与问题转化方法不同,问题转化方法是将多标记问题转化成一个或者多个单类标问题,算法适应方法是在多标记的基础上研究算法。

近年来,用于多标记的算法适应的算法越来越多,代表性学习算法ML-kNN[5],Rank-SVM[6],LEAD[7],CML。

对于分类策略,基于考察标记之间相关性的不同方式,已有的多标记学习算法的策略思路大致可以分为以下三类[8]:

a) “一阶(first-order)”策略:该类策略通过逐一考察单个标记而忽略标记之间的相关性,如将多标记学习问题分解为个独立的二类分类问题,从而构造多标记学习系统。

该类方法效率较高且实现简单,但由于其完全忽略标记之间可能存在的相关性,其系统的泛化性能往往较低。

b) “二阶(second-order)”策略:该类策略通过考察两两标记之间的相关性,如相关标记与无关标记之间的排序关系,两两标记之间的交互关系等等,从而构造多标记学习系统。

该类方法由于在一定程度上考察了标记之间的相关性,因此其系统泛化性能较优。

c) “高阶(high-order)”策略:该类策略通过考察高阶的标记相关性,如处理任一标记对其它所有标记的影响,处理一组随机标记集合的相关性等等,从而构造多标记学习系统。

该类方法虽然可以较好地反映真实世界问题的标记相关性,但其模型复杂度往往过高,难以处理大规模学习问题。

[1] Madjarov G, Kocev D, Gjorgjevikj D, et al. An extensive experimental comparison

of methods for multi-label learning[J]. Pattern Recognition, 2012, 45(9): 3084-3104.

[2] Boutell M R, Luo J, Shen X, Brown C M. Learning multi-label scene classification.

Pattern Recognition, 2004, 37(9): 1757-1771.

[3] Fürnkranz J, Hüllermeier E, LozaMencía E, Brinker K. Multilabel classification via

calibrated label ranking. Machine Learning, 2008, 73(2): 133-153.

[4] Tsoumakas G, Vlahavas I. Random k-labelsets: An ensemble method for multilabel

classification. In: Kok J N, Koronacki J, de Mantaras R L, Matwin S, Mladenič D, Skowron A, eds. Lecture Notes in Artificial Intelligence 4701, Berlin: Spr inger,

2007, 406-417.

[5] Zhang M-L, Zhou Z-H. ML-kNN: A lazy learning approach to multi-label learning.

Pattern Recognition, 2007, 40(7): 2038-2048.

[6] Elisseeff A, Weston J. A kernel method for multi-labelled classification. In: Dietterich

T G, Becker S, Ghahramani Z, eds. Advances in Neural Information Processing Systems 14 (NIPS’01), Cambridge, MA: MIT Press, 2002, 681-687.

[7] Zhang M-L, Zhang K. Multi-label learning by exploiting label dependency. In: Pro

ceedings of the 16th ACM SIGKDD International Conference on Knowledge Discov ery and Data Mining (KDD’10), Washington, D. C., 2010, 999-1007.

[8] Zhang M L, Zhang K. Multi-label learning by exploiting label dependency[C]// ACM

SIGKDD International Conference on Knowledge Discovery and Data Mining.

ACM, 2010:999-1008.。