概率神经网络

概率神经网络概述

令狐采学

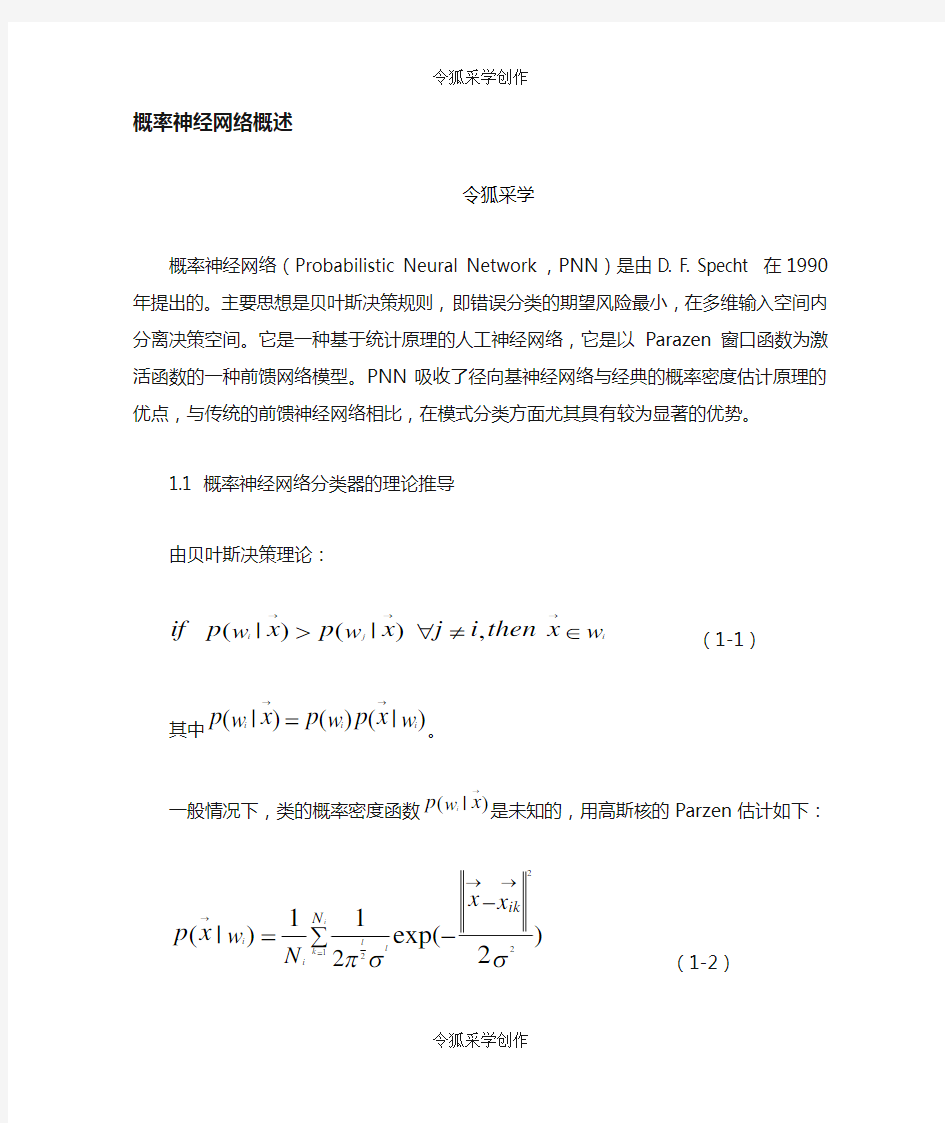

概率神经网络(Probabilistic Neural Network ,PNN )是由D. F. Specht 在1990年提出的。主要思想是贝叶斯决策规则,即错误分类的期望风险最小,在多维输入空间内分离决策空间。它是一种基于统计原理的人工神经网络,它是以Parazen 窗口函数为激活函数的一种前馈网络模型。PNN 吸收了径向基神经网络与经典的概率密度估计原理的优点,与传统的前馈神经网络相比,在模式分类方面尤其具有较为显著的优势。

1.1 概率神经网络分类器的理论推导 由贝叶斯决策理论:

w

w w i

j

i

x then i j x p x p if ∈≠?>→

→→ , )|()|(

(1-1)

其中)|()()|(w w w i

i

i x p p x p →

→

=

。

一般情况下,类的概率密度函数)|(→x p w i

是未知的,用高斯核的Parzen 估计如下:

)

2exp(1

1

)|(2

2

1

2

2σ

σ

π→

→

-∑

-

=

=→

x x N

w ik

N i

k l

l i

i

x p

(1-2)

其中,→

x ik 是属于第w i 类的第k 个训练样本,l 是样本向量的维数,σ是平滑参数,N i 是第w i 类的训练样本总数。

去掉共有的元素,判别函数可简化为:

∑-=→

→

→

-

=

N

ik

i

k i

i

i

x x N

w g p x 1

2

2

)

2exp()()(σ

(1-3)

1.2 概率神经元网络的结构模型

PNN 的结构以及各层的输入输出关系量如图1所示,共由四层组成,当进行并行处理时,能有效地进行上式的计算。

图1 概率神经网络结构

如图1所示,PNN 网络由四部分组成:输入层、样本层、求和层和竞争层。PNN 的工作过程:首先将输入向量→

x 输入到输入层,在输入层中,网络计算输入向量与训练样本向量之间

的差值|-|

→

→x ik

x 的大小代表着两个向量之间的距离,所得的向量

由输入层输出,该向量反映了向量间的接近程度;接着,输入层的输出向量→

→

x ik x -送入到样本层中,样本层节点的数目等于训练样本数目的总和,∑===M

i i i

N

N

1

,其中M 是类的总数。样本层

的主要工作是:先判断哪些类别输入向量有关,再将相关度高的类别集中起来,样本层的输出值就代表相识度;然后,将样本层的输出值送入到求和层,求和层的结点个数是M ,每个结点对应一个类,通过求和层的竞争传递函数进行判决;最后,判决的结果由竞争层输出,输出结果中只有一个1,其余结果都是0,概率值最大的那一类输出结果为1。

2.基本学习算法

第一步:首先必须对输入矩阵进行归一化处理,这样可以减小误差,避免较小的值呗较大的值“吃掉”。设原始输入矩阵为:

??

???

????

???=X X X

X X

X X X

X

mn

m m n

n

2

1

222

21

112

11

X

(2-1)

从样本的矩阵如式(2-1)中可以看出,该矩阵的学习样本由m 个,每一个样本的特征属性有n 个。在求归一化因子之前,必须先计算B T

矩阵:

然后计算:

[]??

??

?

??

?????=

????????

?????????

?

=?=????C C

C C C C C C

C M

x

M x

M x

M

x

M

x

M

x

M x

M x

M x

X

B C

mn

m m n n m

mn

m

m m

m n

n

n

m n

m n

m

2

1

222

21112

11

2

1

2

22

22

2

211

11

12

1

11

11

111 (2-2)

式中,∑∑∑======n

k m

n k n

k x M x M x M mk

k k 1

2

1

2

2

1

2

1,,,21

则归一化后的学习矩阵为C 。在式(2-2)中,符号

”“?表示矩阵在做乘法运算时,相应元素之间的乘积。

第二步:将归一化好的m 个样本送入网络样本层中。因

为是有监督的学习算法,所以很容易就知道每个样本属于哪种类型。假设样本有m 个,那么一共可以分为c 类,并且各类样本的数目相同,设为k ,于是m=k*c 。

第三步:模式距离的计算,该距离是指样本矩阵与学习矩阵中相应元素之间的距离。假设将由P 个n 维向量组成的矩阵称为待识别样本矩阵,则经归一化后,需要待识别的输入样本矩阵为:

??

??

?

??

?????=

d d

d d d d d d

d pn

p p n n D 2

1

222

21

112

11

(2-3)

计算欧氏距离:就是需要是别的样本向量,样本层中各个网络节点的中心向量,这两个向量相应量之间的距离:

?????

?

???

???=??????

?

??

?

??

?

?=∑-∑-∑-∑-∑-∑-∑-∑-∑-=========E E E

E

E E E E E

c d c d c d c d c d c d c d c d c d pm

p p m m

n

k n

k n k n

k n

k n k n

k n

k n k mk

pk k

pk k pk mk

k k

k k

k mk k k

k k

k E

2

1

222

21

112

11

12

1

2

1

2

1

2

1

2

12

12

12

12

212222212111

(2-4)

第四步:样本层径向基函数的神经元被激活。学习样本与待识别样本被归一化后,通常取标准差1.0=σ的高斯型函数。激活后得到出事概率矩阵:

(2-5)

第五步:假设样本有m 个,那么一共可以分为c 类,并且各类样本的数目相同,设为k ,则可以在网络的求和层求得各个样本属于各类的初始概率和:

??

???????

???=??????

?

???????=∑∑∑∑∑∑∑∑∑+-=+==+-=+==+-=+==S S S S

S S S S S P P

P

P P

P P P

P pc

p p c

c

m

k m l pl

k

k l pl

k l pl

m k m l l

k k l l

k l l

m

k m l l

k

k l l

k

l l

S

2

1

222

21

112

11

1

21

1

1

221

2121

12111

1 (2-6)

上式中,S ij 代表的意思是:将要被识别的样本中,第i 个样本属于第j 类的初始概率和。

第六步:计算概率ij prob ,即第i 个样本属于第j 类的概率。

∑==

c l il

ij

ij

S

S

prob 1

(2-7)

3.特点

概率神经网络具有如下特性:

(1) 训练容易,收敛速度快,从而非常适用于实时处理; (2) 可以完成任意的非线性变换,所形成的判决曲面与贝叶

斯最优准则下的曲面相接近;

(3) 具有很强的容错性;

(4) 模式层的传递函数可以选用各种用来估计概率密度的

核函数,并且,各分类结果对核函数的形式不敏感;

(5) 各层神经元的数目比较固定,因而易于硬件实现。

4.不足之处

概率神经网络的不足主要集中在其结构的复杂性和网络参数的选择上。PNN 网络进行模式分类的机理是基于贝叶斯最小风险决策,为了获得贝叶斯准则下的最优解,必须保证有足够多的训练样本。PNN 的拓扑结构和训练样本数目成直接比例关系,每个训练样本决定一个隐含层神经元,所以当训练样本数量巨大时,将导致规模庞大的神经网络结构,阻碍了PNN 网络

的推广和应用。而且,PNN的网络参数(比如连接权重,Parzen 窗函数的平滑因子等),也很大程度的决定着网络的性能。此外PNN对训练样本的代表性要求高;需要的存储空间更大。

5.应用领域

概率神经网络主要应用于分类个模式识别领域,其中分类方面应用最为广泛,这种网络已较广泛地应用于非线性滤波、模式分类、联想记忆和概率密度估计当中。

神经网络在数据挖掘中的应用

神经网络在数据挖掘中的应用

————————————————————————————————作者:————————————————————————————————日期: ?

神经网络在数据挖掘中的应用 摘要:给出了数据挖掘方法的研究现状,通过分析当前一些数据挖掘方法的局限性,介绍一种基于关系数据库的数据挖掘方法——神经网络方法,目前,在数据挖掘中最常用的神经网络是BP网络。在本文最后,也提出了神经网络方法在数据挖掘中存在的一些问题. 关键词:BP算法;神经网络;数据挖掘 1.引言 在“数据爆炸但知识贫乏”的网络时代,人们希望能够对其进行更高层次的分析,以便更好地利用这些数据。数据挖掘技术应运而生。并显示出强大的生命力。和传统的数据分析不同的是数据挖掘是在没有明确假设的前提下去挖掘信息、发现知识。所得到的信息具有先未知,有效性和实用性三个特征。它是从大量数据中寻找其规律的技术,主要有数据准备、规律寻找和规律表示三个步骤。数据准备是从各种数据源中选取和集成用于数据挖掘的数据;规律寻找是用某种方法将数据中的规律找出来;规律表示是用尽可能符合用户习惯的方式(如可视化)将找出的规律表示出来。数据挖掘在自身发展的过程中,吸收了数理统计、数据库和人工智能中的大量技术。作为近年来来一门处理数据的新兴技术,数据挖掘的目标主要是为了帮助决策者寻找数据间潜在的关联(Relation),特征(Pattern)、趋势(Trend)等,发现被忽略的要素,对预测未来和决策行为十分有用。 数据挖掘技术在商业方面应用较早,目前已经成为电子商务中的关键技术。并且由于数据挖掘在开发信息资源方面的优越性,已逐步推广到保险、医疗、制造业和电信等各个行业的应用。 数据挖掘(Data Mining)是数据库中知识发现的核心,形成了一种全新的应用领域。数据挖掘是从大量的、有噪声的、随机的数据中,识别有效的、新颖的、有潜在应用价值及完全可理解模式的非凡过程。从而对科学研究、商业决策和企业管理提供帮助。 数据挖掘是一个高级的处理过程,它从数据集中识别出以模式来表示的知识。它的核心技术是人工智能、机器学习、统计等,但一个DM系统不是多项技术的简单组合,而是一个完整的整体,它还需要其它辅助技术的支持,才能完成数据采集、预处理、数据分析、结果表述这一系列的高级处理过程。所谓高级处理过程是指一个多步骤的处理过程,多步骤之间相互影响、反复调整,形成一种螺旋式上升过程。最后将分析结果呈现在用户面前。根据功能,整个DM系统可以大致分为三级结构。 神经网络具有自适应和学习功能,网络不断检验预测结果与实际情况是否相符。把与实际情况不符合的输入输出数据对作为新的样本,神经网络对新样本进行动态学习并动态改变网络结构和参数,这样使网络适应环境或预测对象本身结构和参数的变化,从而使预测网络模型有更强的适应性,从而得到更符合实际情况的知识和规则,辅助决策者进行更好地决策。而在ANN的

(完整word版)模糊神经网络的预测算法在嘉陵江水质评测中的应用2

模糊神经网络的预测算法 ——嘉陵江水质评价 一、案例背景 1、模糊数学简介 模糊数学是用来描述、研究和处理事物所具有的模糊特征的数学,“模糊”是指他的研究对象,而“数学”是指他的研究方法。 模糊数学中最基本的概念是隶属度和模糊隶属度函数。其中,隶属度是指元素μ属于模糊子集f的隶属程度,用μf(u)表示,他是一个在[0,1]之间的数。μf(u)越接近于0,表示μ属于模糊子集f的程度越小;越接近于1,表示μ属于f的程度越大。 模糊隶属度函数是用于定量计算元素隶属度的函数,模糊隶属度函数一般包括三角函数、梯形函数和正态函数。 2、T-S模糊模型 T-S模糊系统是一种自适应能力很强的模糊系统,该模型不仅能自动更新,还能不断修正模糊子集的隶属函数。T-S模糊系统用如下的“if-then”规则形式来定义,在规则为R i 的情况下,模糊推理如下: R i:If x i isA1i,x2isA2i,…x k isA k i then y i =p0i+p1i x+…+p k i x k 其中,A i j为模糊系统的模糊集;P i j(j=1,2,…,k)为模糊参数;y i为根据模糊规则得到的输出,输出部分(即if部分)是模糊的,输出部分(即then部分)是确定的,该模糊推理表示输出为输入的线性组合。 假设对于输入量x=[x1,x2,…,x k],首先根据模糊规则计算各输入变量Xj的隶属度。 μA i j=exp(-(x j-c i j)/b i j)j=1,2,…,k;i=1,2,…,n式中,C i j,b i j分别为隶属度函数的中心和宽度;k为输入参数数;n为模糊子集数。 将各隶属度进行模糊计算,采用模糊算子为连乘算子。 ωi=μA1j(x1)*μA2j(x2)*…*μA k j i=1,2,…,n 根据模糊计算结果计算模糊型的输出值y i。 Y I=∑n i=1ωi(P i0+P i1x1+…+P i k xk)/ ∑n i=1ωi 3、T-S模糊神经网络模型 T-S模糊神经网络分为输入层、模糊化层、模糊规则计划层和输出层四层。输入层与输入向量X I连接,节点数与输入向量的维数相同。模糊化层采用隶属度函数对输入值进行模

神经网络详解

一前言 让我们来看一个经典的神经网络。这是一个包含三个层次的神经网络。红色的是输入层,绿色的是输出层,紫色的是中间层(也叫隐藏层)。输入层有3个输入单元,隐藏层有4个单元,输出层有2个单元。后文中,我们统一使用这种颜色来表达神经网络的结构。 图1神经网络结构图 设计一个神经网络时,输入层与输出层的节点数往往是固定的,中间层则可以自由指定; 神经网络结构图中的拓扑与箭头代表着预测过程时数据的流向,跟训练时的数据流有一定的区别; 结构图里的关键不是圆圈(代表“神经元”),而是连接线(代表“神经元”之间的连接)。每个连接线对应一个不同的权重(其值称为权值),这是需要训练得到的。 除了从左到右的形式表达的结构图,还有一种常见的表达形式是从下到上来

表示一个神经网络。这时候,输入层在图的最下方。输出层则在图的最上方,如下图: 图2从下到上的神经网络结构图 二神经元 2.结构 神经元模型是一个包含输入,输出与计算功能的模型。输入可以类比为神经元的树突,而输出可以类比为神经元的轴突,计算则可以类比为细胞核。 下图是一个典型的神经元模型:包含有3个输入,1个输出,以及2个计算功能。 注意中间的箭头线。这些线称为“连接”。每个上有一个“权值”。

图3神经元模型 连接是神经元中最重要的东西。每一个连接上都有一个权重。 一个神经网络的训练算法就是让权重的值调整到最佳,以使得整个网络的预测效果最好。 我们使用a来表示输入,用w来表示权值。一个表示连接的有向箭头可以这样理解: 在初端,传递的信号大小仍然是a,端中间有加权参数w,经过这个加权后的信号会变成a*w,因此在连接的末端,信号的大小就变成了a*w。 在其他绘图模型里,有向箭头可能表示的是值的不变传递。而在神经元模型里,每个有向箭头表示的是值的加权传递。 图4连接(connection) 如果我们将神经元图中的所有变量用符号表示,并且写出输出的计算公式的话,就是下图。

模糊神经网络讲义

模糊神经网络(备课笔记) 参考书: 杨纶标,高英仪。《模糊数学原理及应用》(第三版),广 州:华南理工大学出版社 彭祖赠。模糊数学及其应用。武汉:武汉科技大学 胡宝清。模糊理论基础。武汉:武汉大学出版社 王士同。模糊系统、模糊神经网络及应用程序设计。 《模糊系统、模糊神经网络及应用程序设计》 本书全面介绍了模糊系统、模糊神经网络的基本要领概念与原理,并以此为基础,介绍了大量的应用实例及编程实现实例。 顾名思义,模糊神经网络就是模糊系统和神经网络的结合,本质上就是将常规的神经网络(如前向反馈神经网络,Hopfield神经网络)赋予模糊输入信号和模糊权值。 选自【模糊神经网络P17】 预备知识 复杂的东西是难以精确化的,这使得人们所需要的精确性和问题的复杂性间形成了尖锐的矛盾。 正如模糊数学的创始人L.A.Zadeh(查德)教授(美国加利福尼亚大学)所说:“当系统的复杂性增加时,我们使它精确化的能力将减小。直到达到一个阈值,一旦超越它,复杂性和精确性将相互排斥。”这就是著名的“互克性原理”。 该原理告诉我们,复杂性越高,有意义的精确化能力就越低;而复杂性意味着因素众多,以致人们往往不可能同时考察所有因素,只能把研究对象适当简化或抽象成模型,即抓住其中的主要部分而忽略掉次要部分。当在一个被压缩了的低维因素空间考虑问题时,即使本来是明确的概念,也会变得模糊起来。或者某些抽象简化模型本身就带有概念的不清晰,如“光滑铰链”这个力学模型,什么叫“光滑”、什么叫“粗糙”就没有一个明确的定义,客观上两者之间没有绝对分明的界限;主观上,决策者对此类非程序化决策做出判断时,主要是根据他的经验、能力和直观感觉等模糊概念进行决策的。 或者判断一个人的好坏,本来有很多因素,比如人品、性格、相貌

概率神经网络

概率神经网络概述 概率神经网络(Probabilistic Neural Network ,PNN )是由D. F. Specht 在1990年提出的。主要思想是贝叶斯决策规则,即错误分类的期望风险最小,在多维输入空间内分离决策空间。它是一种基于统计原理的人工神经网络,它是以Parazen 窗口函数为激活函数的一种前馈网络模型。PNN 吸收了径向基神经网络与经典的概率密度估计原理的优点,与传统的前馈神经网络相比,在模式分类方面尤其具有较为显著的优势。 1.1 概率神经网络分类器的理论推导 由贝叶斯决策理论: w w w i j i x then i j x p x p if ∈≠?>→ → → , )|()|( (1-1) 其中 )|()()|(w w w i i i x p p x p → →=。 一般情况下,类的概率密度函数)|(→ x p w i 是未知的,用高斯核的Parzen 估 计如下: )2exp(1 1 )|(2 2 1 2 2σ σ π→ → -∑ - = =→ x x N w ik N i k l l i i x p (1-2) 其中,→ x ik 是属于第w i 类的第k 个训练样本,l 是样本向量的维数,σ是 平滑参数,N i 是第w i 类的训练样本总数。 去掉共有的元素,判别函数可简化为: ∑-=→ → → - = N ik i k i i i x x N w g p x 1 2 2 )2exp()()(σ (1-3)

1.2 概率神经元网络的结构模型 PNN 的结构以及各层的输入输出关系量如图1所示,共由四层组成,当进行并行处理时,能有效地进行上式的计算。 图1 概率神经网络结构 如图1所示,PNN 网络由四部分组成:输入层、样本层、求和层和竞争层。PNN 的工作过程:首先将输入向量→ x 输入到输入层,在输入层中,网络计算输入 向量与训练样本向量之间的差值 |-|→→ x ik x 的大小代表着两个向量之间的距离, 所得的向量由输入层输出,该向量反映了向量间的接近程度;接着,输入层的输出向量 →→x ik x -送入到样本层中,样本层节点的数目等于训练样本数目的总和,∑===M i i i N N 1 ,其中M 是类的总数。样本层的主要工作是:先判断哪些类别输入 向量有关,再将相关度高的类别集中起来,样本层的输出值就代表相识度;然后,将样本层的输出值送入到求和层,求和层的结点个数是M , 每个结点对应一个类,

概率神经网络

概率神经网络概述 令狐采学 概率神经网络(Probabilistic Neural Network ,PNN )是由D. F. Specht 在1990年提出的。主要思想是贝叶斯决策规则,即错误分类的期望风险最小,在多维输入空间内分离决策空间。它是一种基于统计原理的人工神经网络,它是以Parazen 窗口函数为激活函数的一种前馈网络模型。PNN 吸收了径向基神经网络与经典的概率密度估计原理的优点,与传统的前馈神经网络相比,在模式分类方面尤其具有较为显著的优势。 1.1 概率神经网络分类器的理论推导 由贝叶斯决策理论: w w w i j i x then i j x p x p if ∈≠?>→ →→ , )|()|( (1-1) 其中)|()()|(w w w i i i x p p x p → → = 。 一般情况下,类的概率密度函数)|(→x p w i 是未知的,用高斯核的Parzen 估计如下:

) 2exp(1 1 )|(2 2 1 2 2σ σ π→ → -∑ - = =→ x x N w ik N i k l l i i x p (1-2) 其中,→ x ik 是属于第w i 类的第k 个训练样本,l 是样本向量的维数,σ是平滑参数,N i 是第w i 类的训练样本总数。 去掉共有的元素,判别函数可简化为: ∑-=→ → → - = N ik i k i i i x x N w g p x 1 2 2 ) 2exp()()(σ (1-3) 1.2 概率神经元网络的结构模型 PNN 的结构以及各层的输入输出关系量如图1所示,共由四层组成,当进行并行处理时,能有效地进行上式的计算。 图1 概率神经网络结构 如图1所示,PNN 网络由四部分组成:输入层、样本层、求和层和竞争层。PNN 的工作过程:首先将输入向量→ x 输入到输入层,在输入层中,网络计算输入向量与训练样本向量之间

模糊神经网络技术研究的现状及展望

模糊神经网络技术研究的现状及展望 摘要:本文对模糊神经网络技术研究的现状进行了综述,首先介绍了模糊控制技术和神经网络技术的发展,然后结合各自的特点讨论了模糊神经网络协作体的产生以及优越性,接着对模糊神经网络的常见算法、结构确定、规则的提取等进行了阐述,指出了目前模糊神经网络的研究发展中还存在的一些问题,并对模糊神经网络的发展进行了展望。 关键字:模糊控制;神经网络;模糊神经网络 引言 系统的复杂性与所要求的精确性之间存在尖锐的矛盾。为此,通过模拟人类学习和自适应能力,人们提出了智能控制的思想。控制理论专家Austrom(1991)在IFAC大会上指出:模糊逻辑控制、神经网络与专家控制是三种典型的智能控制方法。通常专家系统建立在专家经验上,并非建立在工业过程所产生的操作数据上,且一般复杂系统所具有的不精确性、不确定性就算领域专家也很难把握,这使建立专家系统非常困难。而模糊逻辑和神经网络作为两种典型的智能控制方法,各有优缺点。模糊逻辑与神经网络的融合——模糊神经网络由于吸取了模糊逻辑和神经网络的优点,避免了两者的缺点,已成为当今智能控制研究的热点之一了。 1 模糊神经网络的提出 模糊集理论由美国著名控制论专家L.A.Zadeh于1965年创立[1]。1974年,英国著名学者E.H.Mamdani将模糊逻辑和模糊语言用于工业控制,提出了模糊控制论。至今,模糊控制已成功应用在被控对象缺乏精确数学描述及系统时滞、非线性严重的场合。 人工神经网络理论萌芽于上世纪40年代并于80年代中后期重掀热潮,其基本思想是从仿生学的角度对人脑的神经系统进行功能化模拟。人工神经网络可实现联想记忆,分类和优化计算等功能,在解决高度非线性和严重不确定系统的控制问题方面,显示了巨大的优势和潜力 模糊控制系统与神经网络系统具有整体功能的等效性[2],两者都是无模型的估计器,都不需要建立任何的数学模型,只需要根据输入的采样数据去估计其需要的决策:神经网络根据学习算法,而模糊控制系统则根据专家提出的一些语言规则来进行推理决策。实际上,两者具有相同的正规数学特性,且共享同一状态空间[3]。 另一方面,模糊控制系统与神经网络系统具有各自特性的互补性[。神经网络系统完成的是从输入到输出的“黑箱式”非线性映射,但不具备像模糊控制那样的因果规律以及模糊逻辑推理的将强的知识表达能力。将两者结合,后者正好弥补前者的这点不足,而神经网络的强大自学习能力则可避免模糊控制规则和隶属函数的主观性,从而提高模糊控制的置信度。 因此,模糊逻辑和神经网络虽然有着本质上的不同,但由于两者都是用于处理不确定性问题,不精确性问题,两者又有着天然的联系。Hornik和White(1989)证明了神经网络的函数映射能力[4];Kosko(1992)证明了可加性模糊系统的模糊逼近定理(FAT,Fuzzy Approximation Theorem)[5];Wang和Mendel(1992)、Buckley和Hayashi(1993)、Dubots 和Grabish(1993)、Watkins(1994)证明了各种可加性和非可加性模糊系统的模糊逼近定理[6]。这说明模糊逻辑和神经网络有着密切联系,正是由于这类理论上的共性,才使模糊逻辑

概率神经网络

概率神经网络概述 概率神经网络(Probabilistic Neural Network,PNN)就是由D 、 F 、 Specht 在1990年提出的。主要思想就是贝叶斯决策规则,即错误分类的期望风险最小,在多维输入空间内分离决策空间。它就是一种基于统计原理的人工神经网络,它就是以Parazen 窗口函数为激活函数的一种前馈网络模型。PNN 吸收了径向基神经网络与经典的概率密度估计原理的优点,与传统的前馈神经网络相比,在模式分类方面尤其具有较为显著的优势。 1、1 概率神经网络分类器的理论推导 由贝叶斯决策理论: w w w i j i x then i j x p x p if ∈≠?>→ →→ , )|()|( (1-1) 其中 )|()()|(w w w i i i x p p x p → →=。 一般情况下,类的概率密度函数)|(→ x p w i 就是未知的,用高斯核的Parzen 估 计如下: ) 2exp(1 1 )|(2 2 1 2 2σ σ π→ → -∑ - = =→ x x N w ik N i k l l i i x p (1-2) 其中,→ x ik 就是属于第w i 类的第k 个训练样本,l 就是样本向量的维数,σ就 是平滑参数,N i 就是第w i 类的训练样本总数。 去掉共有的元素,判别函数可简化为:

∑- =→ → → - = N ik i k i i i x x N w g p x 1 2 2 )2exp()()(σ (1-3) 1、2 概率神经元网络的结构模型 PNN 的结构以及各层的输入输出关系量如图1所示,共由四层组成,当进行并行处理时,能有效地进行上式的计算。 图1 概率神经网络结构 如图1所示,PNN 网络由四部分组成:输入层、样本层、求与层与竞争层。PNN 的工作过程:首先将输入向量→ x 输入到输入层,在输入层中,网络计算输入向量 与训练样本向量之间的差值 |-|→→ x ik x 的大小代表着两个向量之间的距离,所得

基于神经网络的COCOMO估算(IJISA-V4-N9-3)

I.J. Intelligent Systems and Applications, 2012, 9, 22-28 Published Online August 2012 in MECS (https://www.360docs.net/doc/5c10190055.html,/) DOI: 10.5815/ijisa.2012.09.03 COCOMO Estimates Using Neural Networks Anupama Kaushik, Assistant Professor, Dept. of IT, Maharaja Surajmal Institute of Technology, GGSIP University, Delhi, India anupama@msit.in Ashish Chauhan, Deepak Mittal, Sachin Gupta Dept. of IT, Maharaja Surajmal Institute of Technology, GGSIP University, Delhi, India Ashish.chauhan004@https://www.360docs.net/doc/5c10190055.html,; deepakm905@https://www.360docs.net/doc/5c10190055.html,; sachin.gupta_15@https://www.360docs.net/doc/5c10190055.html, Abstract—Software cost estimation is an important phase in software development.It predicts the amount of effort and development time required to build a software system. It is one of the most critical tasks and an accurate estimate provides a strong base to the development procedure. In this paper, the most widely used software cost estimation model, the Constructive Cost Model (COCOMO) is discussed. The model is implemented with the help of artificial neural networks and trained using the perceptron learning algorithm. The COCOMO dataset is used to train and to test the network. The test results from the trained neural network are compared with that of the COCOMO model. The aim of our research is to enhance the estimation accuracy of the COCOMO model by introducing the artificial neural networks to it. Index Terms—Artificial Neural Network, Constructive Cost Model, Perceptron Network, Software Cost Estimation I.Introduction Software cost estimation is one of the most significant activities in software project management. Accurate cost estimation is important because it can help to classify and prioritize development projects to determine what resources to commit to the project and how well these resources will be used. The accuracy of the management decisions will depend on the accuracy of the software development parameters. These parameters include effort estimation, development time estimation, cost estimation, team size estimation, risk analysis, etc. These estimates are calculated in the early development phases of the project. So, we need a good model to calculate these parameters. An early and accurate estimation model reduces the possibilities of conflicts between members in the later stages of project development. In the last few decades many software cost estimation models have been developed. The algorithmic models also known as conventional models use a mathematical formula to predict project cost based on the estimates of project size, the number of software engineers, and other process and product factors [1]. These models can be built by analysing the costs and attributes of completed projects and finding the closest fit formula to actual experience. COCOMO (Constructive Cost Model), is the best known algorithmic cost model published by Barry Boehm in 1981 [2]. It was developed from the analysis of sixty three software projects. These conventional approaches lacks in terms of effectiveness and robustness in their results. These models require inputs which are difficult to obtain during the early stages of a software development project. They have difficulty in modelling the inherent complex relationships between the contributing factors and are unable to handle categorical data as well as lack of reasoning capabilities [3]. The limitations of algorithmic models led to the exploration of the non-algorithmic models which are soft computing based. Non algorithmic models for cost estimation encompass methodologies on fuzzy logic (FL), artificial neural networks (ANN) and evolutionary computation (EC).These methodologies handle real life situations by providing flexible information processing capabilities. This paper proposed a neural network technique using perceptron learning algorithm for software cost estimation which is based on COCOMO model. Neural networks have been found as one of the best techniques for software cost estimation. Now-a-days many researchers and scientists are constantly working on developing new software cost estimation techniques using neural networks [4, 5, 6, 7]. The rest of the paper is organized as follows: section 2 and 3 describes the COCOMO model and artificial neural network concepts respectively.Section3 and 4 discusses the related work and proposed neural model. Section 4 and 5 presents the proposed model and the training algorithm implemented. Section 6 discusses the experimental results and evaluation criteria. Finally Section 7 concludes the paper. II.COCOMO Model The COCOMO model [2] is the most widely used algorithmic cost estimation technique due to its

一种新的在线训练神经网络算法

一种新的在线训练神经网络算法 速度估计和PMSG风力发电系统的自适应控制 最大功率提取* B Fernando Jaramillo Lopez,Francoise Lamnabhi Lagarrigue *,godpromesse肯尼, 一个该DES signaux等系统,Supelec高原都moulon Gif sur伊维特,91192,法国 B该d'automatique等信息学系的精灵appliquee,电气,iut-fv Bandjoun,Universite de姜村,喀麦隆 这是一个值得注意的问题。 有一个房间 文章历史: 在本文中,自适应控制系统最大功率点跟踪单机PMSG风 涡轮系统(WTS)了。一种新的程序来估计风速导出。实现 这一神经网络识别?ER(NNI)是为了近似的机械转矩设计 WTS。有了这些信息,风速计算的基础上的最佳机械扭矩点。 NNI接近实时的机械转矩信号,它不需要离线训练 得到其最佳参数值。这样,它可以真正接近任何机械扭矩值 精度好。为了将转子转速调节到最优转速值,采用块反推 控制器导出。使用Lyapunov证明了一致渐近稳定的跟踪误差来源 争论。一个标准的被动为基础的控制器的数值模拟和比较

为了显示所提出的自适应方案的良好性能。 三月20日收到2014 以书面形式收到 2015七月4 接受25七月2015 可在线8月13日2015 关键词: 风力发电系统 风速估计 非线性系统 人工神经网络人工? 反推控制 ?2015 Elsevier公司保留所有权利。 1。介绍 使风产业的趋势是设计和建造变量— 高速涡轮机的公用事业规模安装[ 2 ]。 可再生能源发电的兴趣增加 由于污染排放,在其他原因。风 能源是各种可再生能源中最为成熟的能源之一技术,并得到了很多的青睐,在世界的许多地方[ 1 ]。 根据风速、VST可以在3区域操作,因为它

图同构问题的决策神经网络模型

图同构问题的决策神经网络模型 南晋华,齐欢 (华中科技大学控制科学与工程系武汉430074) 摘要图的同构问题是研究两个图之间相互关系范畴。这对图表面上似乎不同,但本质上完全相同。由于图的同构问题在以系统建模、电路布线等众多问题中有直接的应用,因而,吸引了不少的学者从事这方面的研究。本文意在建立一种局域连接的、模拟人脑决策思维模式的、可用于优化信息处理的神经网络模型。文中在过去建立求解图的同构问题人工神经网络模型的基础上,拟应用人脑决策局域化的思想,提出了一种新的用于图的同构问题的人工神经网络模型。该模型中增加了一个自然的约束条件,加快了运算速度。 关键词图;同构;决策;神经网络 中图分类号TP301 The decision-making neural networks model for solving the graph isomorphism problem NAN Jin-Hua1)QI Huan1) 1) (Department of Control Science and Engineering,Huazhong University of Science and Technology,Wuhan 430074) Abstract The graph isomorphism problem is to study the relationship between two graphs which seem to be different, but essentially identical. This problem can be widely used in the system modeling, circuit wiring and many other issues. Therefore, this paper is aimed to establish a kind of neural networks model that are of local-connection, simulation human’s decision-making thinking, and also can be applied to solve the optimization for information. On this basis, we use a natural constraint in this model in order to speed up the operations, and then a new artificial neural network model is proposed to solve the graph isomorphism problem. Keywords Graph; Isomorphism; Decision-making; Neural networks model 1引言 图的同构问题不仅是数学,特别是图论自身学科研究中的一个核心内容,而且具有良好的应用背景,在工程技术领域,特别是大系统建模、电路设计、机械设计、模式识别以及系统建模中有着广泛的应用。对于系统建模,如果能够证明需建模型与已知模型同构,则可以节省大量人力物力财力。多数学者认为图的同构判定问题属于NP-完全问题。但至今没有定论,即它究竟是P问题还是NP问题?目前关于图的同构问题的判定性算法不少,有诸如经典判定算法[1-8]、对在实际工程中有着广泛应用的图的拟同构问题算法[9-12]、进化计算方法[13]、人工神经网络求解算法[14-18] 以及最新的DNA计算模型[19-20]等。在经典的图同构算法中,在此主要介绍两种算法,一种是所谓的矢量列表法,另一种是回溯算法。 研究图的同构问题,一个重要的环节是如何表示图的信息。在这个问题上,Comeil 与Hffman等人曾引入“模块”这一概念来表示各个顶点及其邻接顶点信息。在此基础上Riaz提出一种有效的判定图同构问题的算法-矢量列表法,即把各顶点所代表的信息用模块表示,所有模块组合在一起构成矢量列表。设计算法依次比较各模块,最终得到

BP神经网络预测模型

BP 神经网络模型 基本原理 ( 1) 神经网络的定义简介 神经网络是由多个神经元组成的广泛互连的神经网络, 能够模拟生物神经系统真实世界及物体之间所做出的交互反应. 人工神经网络处理信息是通过信息样本对神经网络的训练, 使其具有人的大脑的记忆, 辨识能力, 完成名种信息处理功能. 它不需要任何先验公式, 就能从已有数据中自动地归纳规则, 获得这些数据的内在规律, 具有良好的自学习, 自适应, 联想记忆, 并行处理和非线性形转换的能力, 特别适合于因果关系复杂的非确定性推理, 判断, 识别和分类等问题. 对于任意一组随机的, 正态的数据, 都可以利用人工神经网络算法进行统计分析, 做出拟合和预测. 基于误差反向传播(Back propagation)算法的多层前馈网络(Multiple-layer feedforward network, 简记为BP 网络), 是目前应用最成功和广泛的人工神经网络. ( 2) BP 模型的基本原理[3] 学习过程中由信号的正向传播与误差的逆向传播两个过程组成. 正向传播时, 模式作用于输入层, 经隐层处理后, 传入误差的逆向传播阶段, 将输出误差按某种子形式, 通过隐层向输入层逐层返回, 并“分摊”给各层的所有单元, 从而获得各层单元的参考误差或称误差信号, 以作为修改各单元权值的依据. 权值不断修改的过程, 也就是网络学习过程. 此过程一直进行到网络输出的误差准逐渐减少到可接受的程度或达到设定的学习次数为止. BP 网络模型包括其输入输出模型, 作用函数模型, 误差计算模型和自学习模型. BP 网络由输入层, 输出层以及一个或多个隐层节点互连而成的一种多层网, 这种结构使多层前馈网络可在输入和输出间建立合适的线性或非线性关系, 又不致使网络输出限制在-1和1之间. 见图( 1) . O 1 O 2 O i O m ( 大于等于一层) W (1)… ( 3) BP 神经网络的训练 BP 算法通过“训练”这一事件来得到这种输入, 输出间合适的线性或非线性关系. “训练”的过程可以分为向前传输和向后传输两个阶段: 输入层 输出层 隐含层 图1 BP 网络模型

基于神经网络和决策树分类器的工艺参数优化研究

基于神经网络和决策树分类器的工艺参数优化研究 摘要:提出了基于神经网络和决策树分类器的机械加工工艺参数寻优方法,根据已有的样本训练数据建立分类和神经网络模型,针对要求的加工目标,通过对分类规则的提取,生成预测数据集,结合建立的神经网络模型,迅速准确的预测出对应的加工工艺参数。 关键词:神经网络分类器决策树工艺参数分类规则 1. 引言 在机械加工中,加工参数的选择对加工生产率和经济效益具有重要的影响,而加工参数一般是有经验的机械师的操作记录,这些记录再编纂成机械加工手册。但手册中的数据仅仅适用于特定的机加工条件,对于略有不同的机加工条件就可能不适用。而在通常加工系统中,加工参数的选择主要依靠加工手册、工人的经验等来确定,因此正确性难以保证。同时,现代工业生产中的计算机在加工过程中采集大量的数据,这些数据及其关系人工一般是很难理解、辨认和优化的,特别对一个新的加工工艺,没有参考的经验和手册,只有不断积累的数据,这时要迅速的建立优化的加工参数,按照传统的技术和方法,难度是较大的。本文针对这种问题,提出了基于决策树分类器和神经网络的加工参数寻优的新方法。 2. 基本原理与概念 2.1 分类 分类要解决的问题是为一个事件或对象归类,在已有数据的基础上学会一个分类函数或构造出一个分类模型。

分类的一般性描述如下:给定数据库D ={t1,t2,…,tn },元组ti ?D ,类的集合C ={C1,……,Cm },分类问题定义为从数据库到类集合的映射f :D ->C ,即数据库中的元组ti 分配到某个类Cj 中,有Cj ={ti | f (ti ) = Cj ,1≤i≤n ,且ti ∈D } 构造决策树分类器,需要有一个训练样本数据集作为输入。训练集(Training set ) 由一组记录或元组构成,每个记录是一个由有关字段值组成的特征向量,这些字段称做属性(Attribute ),用于分类的属性称为标签(Label ),标签属性即训练集的类别标记。一个具体的样本的形式可以表示为(sv1,v2,… ,vn ;c ), 其中vi 表示字段值,c 表示类别。标签属性的类型必须是离散的,且标签属性的可能值的数目越少越好。 决策树分类器在确定分类节点时,采用信息论中信息熵理论来选择节点,信息熵为信息论中用于描述每个消息的信息量以及信源的平均不确定性,决策树分类器中用其作为特征判别能力的度量,以其下降的速度作为测试属性的标准,其概念如下所述: 设S 是具有s 个样本的集合,假定决策属性是类标号属性,具有m 个不同的值,定义了不同的类别Ci (i=1,2,…,m )。假设si 是类别Ci 中的样本数,样本分类所需的信息量由下式给出: 121log() m m i i i I p p =∑(s ,s ,......s )=- 其中pi 是任意样本属于Ci 的概率,并用si/s 估计。设属性A 取v 个不同的值{a1,a2,…,av}。利用属性A 可以将集合S 划分为v 个子集{S1,S2,…,Sv},其中Sj 包含了S 集合中属性A 取aj 值的数

基于神经网络的高管层决策支持系统

基于神经网络的高管层决策支持系统 摘要:本文针对中国企业中常见的高管层计算机水平较低,决策经验化等现象,使用人工神经网络设计了决策支持系统,阐明了基于人工神经网络的决策可以有 效地帮助企业高管层进行科学管理。 关键词:神经网络决策支持系统 引言 随着当今社会的发展,我们正处于一个信息爆炸的时代。每天被海量信息所 包围,如何从这些信息中甄选出有用的信息,以便做出正确的决策,这几乎是每 一个企业的高层管理者所关心的问题。随着信息技术的发展,决策支持系统的出现,管理者可以使用决策支持系统处理大量信息而不必为冗余信息所干扰,这样 就大大提高了决策的科学性与准确性。 1 基础理论概述 1.1 决策支持系统概述决策支持系统(Decision Support System,简称DSS)是辅 助决策者通过数据、模型和知识,以人机交互方式进行半结构化或非结构化决策 的计算机应用系统,它为决策者提供分析问题、建立模型、模拟决策过程和方案 的环境,调用各种信息资源和分析工具,帮助决策者提高决策水平和质量。 决策支持系统的核心是数据库和模型库,一个典型的数据支持系统还包括对 话管理器。管理者和决策者可以根据存储在数据库中的大量数据进行定性分析, 并借助模型库进行定量分析。 1.2 神经网络概述神经网络(Neuronic Network)一种模仿动物神经网络行为 特征,进行分布式并行信息处理的算法数学模型。这种网络依靠系统的复杂程度,通过调整内部大量节点之间相互连接的关系,从而达到处理信息的目的。从概念 上讲,神经网络包含三个层次的虚拟神经元,一个是输入层,一个是输出层,在 它们中间的是隐藏层,当然可能有多个隐藏层。神经网路的有点有:①学习,并根据新环境自行调整;②进行大量的并行处理;③可以在信息不完整或信息结 构不够良好的情况下工作;④可以大量处理变量间有依赖关系的信息;⑤分析 信息的非线性关系,又称曲线回归分析。 2 系统仿真及应用 2.1 仿真实现用户由终端输入数据,数据会根据事先预设的判断条件判断数 据是否合法,如果数据非法,为了系统安全(如保证企业机密不会泄露),系统 会报告数据错误,之后推出程序;而对于合法数据,则可以存储到数据库当中。 对于存储到数据库中的数据,则可以结合其它情况进行调用判断,如果条件 不够充分,系统就会显示无法调用;如果条件允许,则调用决策支持系统。而使 用决策支持系统帮助决策这项工作则是通过神经网络算法对存储的数据进行处理 完成的。这些数据主要是企业的经营状况指标,而神经网络模型会事先接受训练,学会根据这些指标判断企业的经营状况是否良好,发展的潜力有多大等等。形化 的形式输出处理的结果。 2.2 管理层应用在实际应用中,公司的高管层可以根据本公司的实际情况设 置训练条件,这些情况包括公司的经营状况、发展前景以及管理者自身的水平等。例如,管理人员可以将公司的财务数据输入系统,或是将同行业的其它公司的数 据输入系统,经过训练的系统会自动输出公司的财务分析评价报告,或者是行业 对比报告,有助于决策者的判断,尤其是对于一些关键问题,例如企业是否盈利、企业经营概况是否良好、企业出现问题能否及时发现并应对、企业今后的发展趋