基于粒子群优化算法的神经网络在

基于粒子群优化算法的神经网络在农药定量构效关系建模中的应用

张丽平 俞欢军3 陈德钊 胡上序

(浙江大学化工系,杭州310027)

摘 要 神经网络模型能有效模拟非线性输入输出关系,但其常规训练算法为BP 或其它梯度算法,导致训练时间较长且易陷入局部极小点。本实验探讨用粒子群优化算法训练神经网络,并应用到苯乙酰胺类农药的定量构效关系建模中,对未知化合物的活性进行预测来指导新药的设计和合成。仿真结果表明,粒子群优化算法训练的神经网络不仅收敛速度明显加快,而且其预报精度也得到了较大的提高。关键词 粒子群优化算法,神经网络,定量构效关系

2004201204收稿;2004207225接受

本文系国家自然科学基金资助项目(N o.20276063)

1 引 言

药物定量构效关系(QS AR )是研究药物生理活性和药物分子结构参数间的量变规律并建立相应的

数学模型,进而研究药物的作用机理,从而用于预测未知化合物的生物活性,探讨药物的作用机理,指导新药的设计和合成,在药物和农药的研究与设计中已经显示出广阔的应用前景1。以往QS AR 的建模方法大多基于统计原理,局限于线性模型,只进行简单的非线性处理,由此所建立的模型很难契合实际构效关系,并且其处理过程都比较繁琐2。神经网络通过学习将构效关系知识隐式分布在网络之中,适用于高度非线性体系。

在药物QS AR 中采用神经网络(NN )始于20世纪80年代末3,此后得到迅速的发展,目前已发展为除多重线性回归和多元数据分析之外的第3种方法4。通常多层前传网络采用BP 算法,通过误差反传,按梯度下降的方向调整权值。其缺点是可能陷入局部极小点,且对高维输入收敛速度非常缓慢。

粒子群优化算法(particle swarm optimization ,PS O )是K ennedy 等5源于对鸟群、鱼群和人类社会行为的研究而发展的一种新的进化型寻优技术。PS O 已成为进化寻优算法研究的热点,其最主要特点是简单、收敛速度快,且所需领域知识少。本实验拟将该方法初始化前传神经网络为苯乙酰胺类农药建立良好适用的QS AR 模型。

2 苯乙酰胺类农药的Q SAR 问题

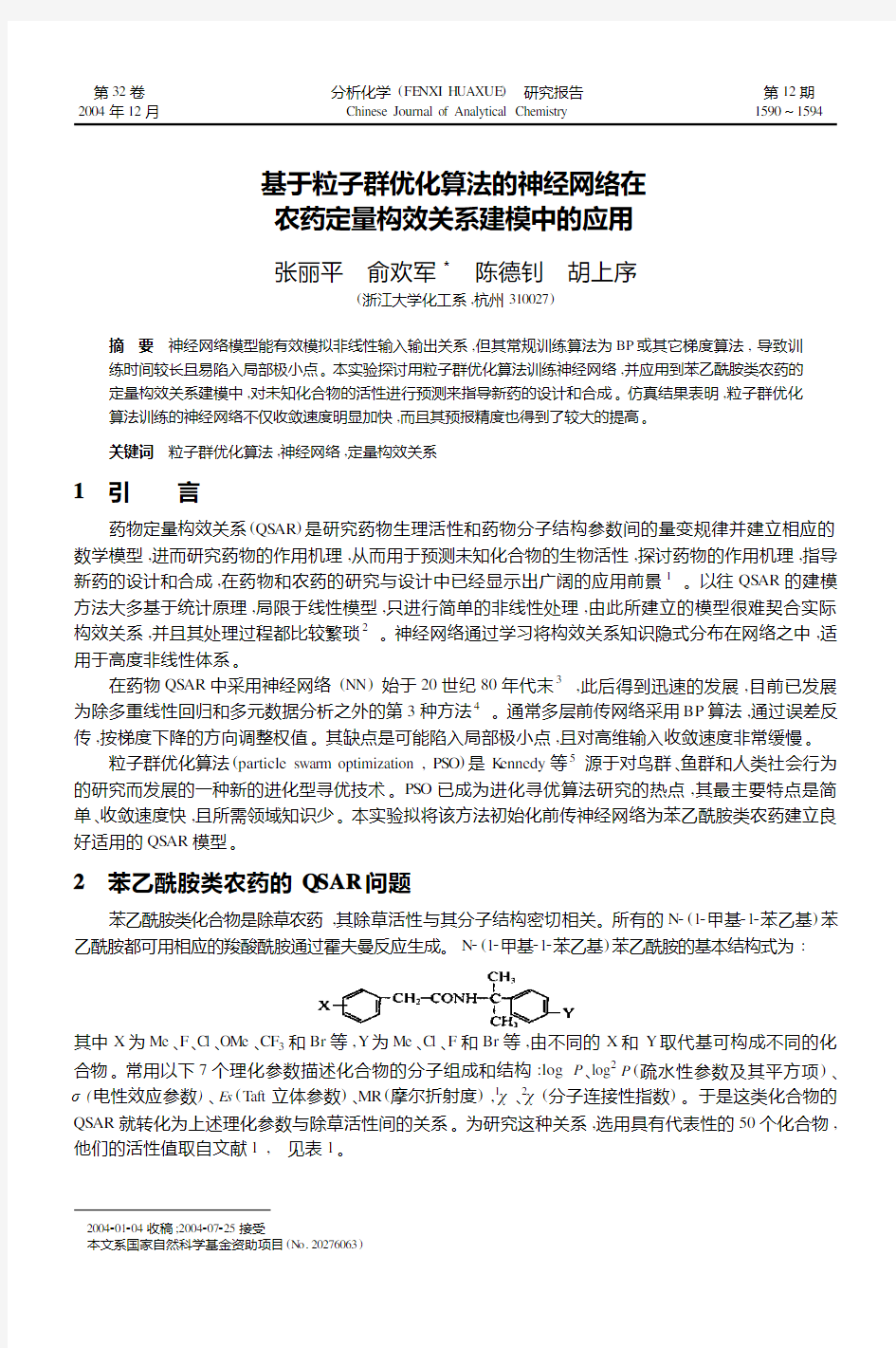

苯乙酰胺类化合物是除草农药,其除草活性与其分子结构密切相关。所有的N 2(12甲基212苯乙基)苯乙酰胺都可用相应的羧酸酰胺通过霍夫曼反应生成。N 2(12甲基212苯乙基)苯乙酰胺的基本结构式为

:

其中X 为Me 、F 、Cl 、OMe 、CF 3和Br 等,Y 为Me 、Cl 、F 和Br 等,由不同的X 和Y 取代基可构成不同的化合物。常用以下7个理化参数描述化合物的分子组成和结构:log P 、log 2P (疏水性参数及其平方项)、

σ(电性效应参数)、E s (T aft 立体参数)、MR (摩尔折射度),1χ、2

χ(分子连接性指数)。于是这类化合物的QS AR 就转化为上述理化参数与除草活性间的关系。为研究这种关系,选用具有代表性的50个化合物,

他们的活性值取自文献1,见表1。

第32卷2004年12月分析化学(FE NXI H UAX UE ) 研究报告Chinese Journal of Analytical Chemistry 第12期1590~1594

表1 苯乙酰胺类化合物分子结构参数与除草活性值

T able1 S tructural parameters and anti2scipusjuncoides activity of N2phenylacetamides

序号N o.

自变量Independent variables

log PσMR E s1χ2χlog2P

因变量

Dependent variable

活性Activity

1 1.12-0.349.240.007.31 5.59 1.254 5.85

20.70-0.11 4.510.78 6.93 5.170.490 5.68

3 1.270.069.620.277.42 5.70 1.613 5.72

40.54-0.4411.460.697.43 5.480.292 6.07

5 1.12-0.249.240.007.31 5.65 1.254 5.89

6 1.270.209.620.277.41 5.7

7 1.613 6.00

7 1.270.069.620.277.42 5.70 1.662 5.58

80.850.29 4.89 1.057.03 5.280.722 5.44

9 1.420.4610.000.547.52 5.81 2.016 5.65

100.69-0.0411.840.967.53 5.590.476 5.46

11 1.270.169.620.277.41 5.76 1.613 5.57

12 1.420.6010.000.547.51 5.88 2.016 5.65

130.690.1011.840.967.52 5.630.476 5.42

14 1.270.069.620.277.41 5.76 1.613 5.18

15 1.420.4610.000.547.51 5.88 2.016 5.41

16 1.12-0.249.240.007.31 5.65 1.254 5.79

170.70-0.01 4.510.78 6.92 5.230.490 5.92

18 1.270.169.620.277.41 5.75 1.613 6.10

190.54-0.3411.460.697.42 5.530.292 5.79

20 1.12-0.149.240.007.30 5.71 1.254 5.82

21 1.270.309.620.277.40 5.83 1.613 6.22

22 1.440.368.61-1.167.39 5.66 2.074 5.73

23 1.420.1612.470.087.80 6.27 2.016 4.64

240.94-0.3116.060.038.00 5.800.884 4.32 250.700.17 4.510.78 6.92 5.200.490 6.47 260.850.57 4.89 1.057.02 5.310.722 6.57

27 1.270.209.620.277.41 5.76 1.613 6.49

280.850.43 4.89 1.057.02 5.340.7227.04

29 1.420.6010.000.547.51 5.87 2.016 6.71

300.690.1011.840.967.52 5.650.476 6.53

31 1.270.309.620.277.40 5.83 1.613 6.38

32 1.420.7410.000.547.51 5.94 2.016 6.95

33 1.570.6212.850.357.90 6.32 2.465 6.47

340.56-0.349.240.007.31 5.640.314 5.82 350.70-0.11 4.510.78 6.92 5.220.490 6.01

36 1.270.069.620.277.41 5.75 1.613 6.22

370.54-0.4411.460.697.42 5.530.292 5.82 380.56-0.249.240.007.30 5.700.314 5.89

39 1.270.209.620.277.40 5.82 1.613 5.92

400.70-0.11 4.510.78 6.92 5.190.490 6.25 410.850.29 4.89 1.057.02 5.310.7227.05 420.12-0.21 6.73 1.477.03 5.080.014 6.44 430.70-0.01 4.510.78 6.91 5.260.490 6.50 440.850.43 4.89 1.057.02 5.370.722 6.39

45 1.270.069.620.277.41 5.76 1.613 6.68

460.850.29 4.89 1.057.02 5.340.722 6.63

47 1.420.4610.000.547.51 5.87 2.016 6.91

48 1.270.169.620.277.40 5.82 1.613 6.84

49 1.000.297.740.867.41 5.79 1.000 6.60

50 1.570.6012.850.357.90 6.39 2.465 6.49 1951

第12期张丽平等:基于粒子群优化算法的神经网络在农药定量构效关系建模中的应用

3 前传神经网络

3.1 网络结构

网络有7个输入端和1个输出端,分别与7个理化参数和1个活性值相对应。根据经验规则,网络中权重总数应等于或小于样本容量,所得数学模型才比较稳定6。由此,在本实验中隐层结点为5比较合适,网络结构为72521,共46个权值。3.2 样本使用

由于各变量表示样本的各种性质,往往使用不同的度量单位,其观测值也可能相差十分悬殊。这样绝对值大的变量其影响可能盖过绝对值小的变量,使后者应有的作用得不到反映。为了确保各变量在分析中的地位相同,故对输入端的7个变量实施极差标准化。

为避免偶然性,采用交叉验证法,将50个样品构成10个组合,每组均有45个样品作训练用,另外5个样品作预报用,因此每个样品有9次作训练用,1次作预报用。3.3 过拟合控制

为了避免训练网络时出现过拟合,实验使用测试集监控训练的过程,即由训练所得数学模型计算预报误差,如果测试集的训练误差曲线显著上升,并且预报误差和训练误差为可接受的大小,则训练终止。实验表明,该方法可以有效地降低过拟合程度。3.4 初始化前传神经网络的PSO 算法

与其他进化寻优算法相类似,PS O 算法也将通过个体间的协作与竞争,实现多维空间中最优解的搜索。PS O 方法首先生成初始种群,即在可行解空间中随机初始化一群粒子,每个粒子都为寻优问题的一个可行解,并用某个函数计算出相应的适应值以确定是否达到寻优目标。每个粒子将在解空间中运动,并由一个矢量决定其运动方向和位移。通常粒子将追随当前的最优粒子而动,并经逐代搜索最后得到最优解。在每一代中,粒子将跟踪两个极值,一为粒子本身迄今找到的最优解,代表该粒子自身对寻优方向的认知水平;另一为全种群迄今找到的最优解,代表社会认知水平。

设第i 个粒子位置为x i =(x i 1,x i 2,……x in )T ,其位移为v i =(v i 1,v i 2,……v in )T 。它的个体最优值点为p i =(p i 1,p i 2,……p in )T ,种群的全局最优值点为p g =(p g 1,p g 2,……p gn )T 。按追随当前最优粒子的原理,粒子x i 将按式(1)和(2)改变位移方向和步长。

v id (t +1)=wv id (t )+c 1r 1(p id (t )-x id (t ))+c 2r 2(p gd (t )-x id (t ))

(1)x id (t +1)=x id (t )+v id (t +1)

(2)

其中:w 为惯性权值,通常随进化代数从0.9线性递减至0.4,d =1,2,…n ,n 为解空间的维数,即自变量个数,d 为n 维中的第d 维,t 为当前进化代数,i =1,2,…S ,S 为种群规模,r 1和r 2为分布于[0,1]之间的随机数,c 1和c 2为位移变化的限定因子,通常取为2。设定位移上限V max 控制粒子位移不致过大。PS O 算法主要计算步骤为:(1)初始化,设定位移因子c 1和c 2,惯性权值w ,最大进化代数T max ,将当前进化代数置为t ,在定义空间R n 中随机产生S 个粒子x 1,x 2,…,x s ,组成初始种群X (t );随机产生各粒子初始位移变化v 1,v 2,…,v s ,组成位移变化矩阵V (t );(2)评价种群X (t );(3)按式(1)和(2)更新粒子的位移方向和步长,产生新种群X (t +1);(4)检查结束条件,若满足,则结束寻优;否则t =t +1,转至2。结束条件为寻优达到最大进化代数T max ,或评价值小于给定精度ε。本实验中,粒子取20,最大进化代数为2500,粒子的搜索空间即为46维权值空间,适应值函数为误差平方和的均值:

E AV =

1

n s

6n

s j =1

6

m

k =1

(t jk -f jk )

2

(3)

其中t jk 是目标值,f jk 是计算值,m 是输出结点数,n s 是训练集样本数。

4 结果和讨论

4.1 训练结果

2951 分析化学第32卷

给定网络的最大允许迭代次数,分别对样本的10种组合,采用PS O 算法训练网络(PS O 2NN ),各训

练10次。完成训练的网络模型可以记为y (x ),x 为网络的输入矢量,有y (x )为网络的实际输出。定义网络模型的自检和预报相对误差为:

S Er (x i )=|y (x i )-

y i /y i |,PEr (x k )=|y (x k )

-y k /y k |(4)式中x i 和y i 为训练样本的输入和目标输出,x k 和y k 为预报样本的输入和目标输出。对于每个样本组

合,自检相对误差的均值记为AS Er ,它反映了网络模型的训练精度。预报相对误差的均值记为A PEr ,它反映了网络模型的预报能力。各值列于表2。作为比较,将BP 算法的训练结果也列入表中(BP 2NN ),BP 算法最大迭代轮数取50000。

表2 自检和预报相对误差T able 2 The relative error of self 2checking and prediction

序号

N o.PS O 算法训练的神经网络PS O 2NN

自检相对误差

AS Er (%)

预报相对误差

APEr (%)

BP 算法训练的神经网络BP 2NN

自检相对误差

AS Er (%)

预报相对误差

APEr (%)

1 3.67 5.5

2 4.27 6.212 3.828.21 4.0610.86

3 4.2512.02 4.3215.81

4 4.16 1.23 4.17 5.47

5 3.95 6.81 4.5910.31

6 3.64 3.52 4.32 1.89

7 4.03 3.04 4.06 4.12

8 4.18 1.47 4.05 4.08

9 4.17 4.18 4.08 4.4110

3.96 5.76

4.31 6.41平均值Average

3.98

5.18

4.22

6.96

PS O 2NN :particle swarm optimization 2neural netw orks ;BP 2NN :back propagation 2neural netw orks

4.2 训练速度

定义从训练开始到最大迭代次数为每次训练时间。计算表明,10次训练的平均时间,PS O 为8s ,BP 算法则需74s 。说明PS O 算法比BP 算法快得多。其原因主要是PS O 算法引入了并行机制,在多维空间

图1 两种方法计算结果比较Fig.1 Results comparing between tw o methods

(○)BP 2NN ;(●)PS O 2NN 。

中实行有效的整体搜索,从而克服了BP 算法的缺点,加速了收敛的进程。

4.3 PS O 算法和BP 算法的模型精度比较

模型精度又分训练精度和预报精度,后者更为重要,它体现了网络模型预测未知农药化合物的除草活性的能力。由表2可知,PS O 算法训练前传神经网络,其训练精度和预报精度均有提高,预报精度提高更显著。以第3组数据为例,训练中

可观察到,在训练初期两种算法适应值函数下降都较快,但随

后BP 算法陷入局部极小点,其适应值函数下降速度十分缓慢;而PS O 算法则可较快地继续使适应值函数下降。将两种训练算法对第3组数据的计算结果与观测结果进行比较,示于

图1。从图中可看出,PS O 2NN 结果明显好于BP 2NN 。PS O 2NN 的点比较均匀的分布在45度线的两边,而BP 2NN 点有向左上偏移的倾向,可判断这里存在一个系统偏差,说明PS O 算法的容噪性能较BP 好,可

训练出比较稳定的网络模型。4.4 几种计算方法的结果比较

文献1列举了几种为农药QS AR 建模方法,包括序列多重回归(sequential multiple regression ,S MR )、主成分分析(principal com ponents analysis ,PC A )和偏最小二乘回归(partial least square regression ,P LSR )。为比较将其计算结果列于表3中。由表3可知,P LS 和PC A 法自检相对误差较小,但其预报相对误差较大,故有理由认为这两种方法存在一定的过拟合,而通过神经网络可以使其预报精度得到进一步的提

3

951第12期张丽平等:基于粒子群优化算法的神经网络在农药定量构效关系建模中的应用

高,这是十分可贵的性质。

表3 不同方法结果比较T able 3 C omparis ons between different methods

不同方法

Different methods

自检相对误差

Self 2checking relative error

预报相对误差

Prediction relative error

基于原始数据矩阵的序列多重回归S MR based on

X ] 6.407.12基于扩展数据矩阵的序列多重回归S MR based on X e ]

3.74 6.57基于原始数据矩阵的主成分分析PCA based on X ]

5.667.04基于扩展数据矩阵的主成分分析PCA based on X e ]

3.6913.973由方差贡献选择3个成分

Three com ponent selected according to variance contribution 6.407.12由相关系数选择个20个成分

T wenty com ponent selected according to correlative coefficient 3.74 6.5723个成分的偏最小二乘回归P LS regression of 23com ponents

3.217.89基于BP 算法的神经网络BP 2NN

4.22 6.96基于PS O 算法的神经网络PS O 2NN

3.98

5.18

3表示相对误差大于100%未计(relative error 100%);X ]为原始数据矩阵(original data matrix );X e ]为扩展数据矩阵(expanded data

matrix )

4.5 结论

新药的开发是一个长期的、花费巨大的过程,故缩短药物开发周期是制药业首要考虑的因素。已经将神经网络用于药物数据处理。结果表明:PS O 算法对于实际的复杂化学模式的研究是可行的,其训练神经网络的速度快于BP 算法,而且精度高,表现出明显的优势。R eferences

1 Chen Y aqiu ,Chen Dezhao ,He Chunyan ,Hu https://www.360docs.net/doc/a218994078.html,b.Syst.,1999,45:267~2762 Erikss on L ,Johansss on https://www.360docs.net/doc/a218994078.html,b.Syst.,1996,34:1~193 A oyama T ,Suzuki Y,Ichikawa H.J.Med.Chem.,1990,33:905~908

4 Zhang Y axiong (张雅雄),Li Hua (李 华),Havel J.Chinese J.Anal.Chem .(分析化学),2004,32(5):673~6785 K ennedy J ,Eberhart R.Proc.IEEE Int.Conf.on Neural Networks ,1995:1942~1948

6 Xu Lu (许 禄),Wu Y aping (吴亚平),Hu Changyu (胡昌玉),Li Hua (李 华).Science in China (Series B )(中国科学

(B 辑)),2000,30(1):1~7

Application of N eural N etw orks B ased on P article Sw arm Algorithm for

Modeling Q uantitative Structure 2Activity R elationships of H erbicides

Zhang Liping ,Y u Huanjun 3,Chen Dezhao ,Hu Shangxu

(Department o f Chemical Engineering ,Zhejiang Univer sity ,Hangzhou 310027)

Abstract Neural netw orks (NNs )have become one of idea tools in m odeling nonlinear relationship between inputs and desired outputs.H owever ,the training of NNs by conventional back 2propagation method ,i.e.the BP 2NNs ,has intrinsic vulnerable weakness in slow convergence and local minima.In this w ork ,particle swarm optimization (PS O )was proposed to train NNs ,named PS O 2NNs ,to establish a quantitative structure 2activity relationships m od 2el for herbicidal N 2(12methyl 212phenylethyl )phenylacetamides ,which provides a rational basis for understanding mechanisms of biological performance and how to alter chemical structure to achieve im proved performance.Since neural netw orks can express com plicated structure 2activity relationships ,and the combination of PS O Alg orithms can help the netw orks to jum p out from the local optimal points.The numerical results showed that PS O 2NNs exhibit faster convergence rate and better predicting accuracy than the BP 2NNs.K eyw ords Particle swarm optimization alg orithm ,neural netw orks ,quantitative structure 2activity relationships

(Received 4January 2004;accepted 5July 2004)

4951 分析化学第32卷

基于粒子群优化算法的图像分割

安康学院 学年论文(设计) 题目_____________________________________________ 学生姓名_______________ 学号_____________________________ 所在院(系)_______________________________________ 专业班级__________________________________________________ 指导教师_____________________________________________ 年月曰

基于粒子群优化算法的图像分割 (作者:) () 指导教师: 【摘要】本文通过对粒子群优化算法的研究,采用Java编程,设计出一套用于图像分割的系统。 基于粒子群优化算法的图像分割系统,可以将一幅给定的图像进行分割,然后将分割结果保存。图像分割的目的是将感兴趣的区域从图像中分割出来,从而为计算机视觉的后续处理提供依据。图像分割的方法有多种,阈值法因其实现简单而成为一种有效的图像分割方法。而粒子群优化(PSO)算法是一类随机全局优化技术,它通过粒子间的相互作用发现复杂搜索空间中的最优区域缩短寻找阈值的时间。因此,基于粒子群优化算法的图像分割以粒子群优化算法为寻优工具,建立具有自适应和鲁棒性的分割方法。从而可以在最短的时间内,准确地确定分割阈值。 关键词:粒子群优化(PSO,图像分割,阈值法,鲁棒性 Abstract T his paper based on the particle swarm optimizati on algorithm, desig ns a set of system for image segme ntati on using Java program min g. Image segme ntati on system based on particle swarm optimizati on algorithm, the image can be a given segmentation, and then the segmentation results would be saved. Image segmentation is the purpose of the interested area from the image, thus providing the basis for the subsequent processing of computer vision. There are many methods of image segmentation, threshold method since its simple realization, becomes a kind of effective method in image segmentation. Particle swarm optimization (PSO) algorithm is a stochastic global optimization technique; it finds optimal regions of complex search spaces for threshold time shorte ned through the in teractio n betwee n particles. Therefore, particle swarm optimization algorithm of image segmentation based on particle swarm optimization algorithm based on optimizati on tools; establish segme ntati on method with adaptive and robust. Therefore, it is possible for us in the shortest possible time to accurately determ ine the segme ntati on threshold. Key word s: PSO, image segmentation, threshold method, robust. 1引言 1.1研究的背景和意义 技术的不断向前发展,人们越来越多地利用计算机来获取和处理视觉图像信息。据统计,人类

matlab粒子群优化算法进行传感器优化配置程序

1.Pso算法 function [xm,fv] = SAPSO( fitness,N,c1,c2,wmax,wmin,M ) % fitness 适应度函数 % N 种群个数 % c1 % c2 % wmax 最大权重 % wmin 最小权重 % M 迭代次数 cg=32;%传感器个数 format long; %-----------------------初始化种群个体 ------------------------------------- for i=1:N %粒子个数为n a1=-17.5:10:12.5; a11=a1*(i+5)/10; [a2,a3]=meshgrid(a1,a11); a4=reshape(a2,1,16); a5=reshape(a3,1,16); b1=-12.5:10:17.5; b11=b1*(i+5)/10; [b2,b3]=meshgrid(b1,b11); b4=reshape(b2,1,16); b5=reshape(b3,1,16); x11=[a4,b4;a5,b5]+20;%ó|ó?μè±èàyà?é¢y1ì?¨ x(:,:,i)=x11';%初始化传感器个数为20 v(:,:,i)=10*rand(cg,2); end %----------------------计算各个粒子适应度------------------------------for i=1:N; p(i)=fitness(x(:,:,i)); y(:,:,i)=x(:,:,i); end pg=x(:,:,N); %pg为全局最优 for i=1:(N-1) if fitness(x(:,:,i)) 粒子群算法在神经网络非线性函数 拟合中的应用 一、本文研究和解决的问题 在自动控制问题中,系统辨识的目的是为了建立被控对象的数学模型。多年来,控制领域对于复杂的非线性对象的辨识一直未能很好的解决,神经网络所具有的非线性特性和学习能力使其在系统辨识方面有很大的潜力。为解决具有复杂的非线性、不确定性和不确知对象的辨识问题开辟了一条有效的途径。基于神经网络的系统辨识是以神经网络作为被辨识对象的模型,利用其非线性特性,可建立非线性系统的静态或动态模型。理论上,多层前馈神经网络能够以任意精度逼近任意非线性映射。 但传统神经网络学习算法中存在的收敛速度慢、容易陷入局部最优等缺点,于是设计了基于标准粒子群算法的神经网络非线性函数拟合系统。 二、传统的BP神经网络 BP 神经网络即采用误差反向传播算法的网络,是一种至今仍然最为流行的前馈型神经网络模型。BP 神经网络有很强的非线性映射能力,它能学习和存贮大量输入-输出模式映射关系,而无需事先了解描述这种映射关系的数学方程。只要能提供足够多的样本模式对供给网络进行学习训练,它便能完成由n 维输入空间到m 维输出空间的非线性映射。BP 学习算法属于误差修正型学习,其关键在于根据误差修正输出层和隐含层的连接权值。其学习的基本实现方法是基于最小平方误差准则和梯度下降优化方法来确定权值调整法则。 BP网络建模特点: 非线性映照能力:神经网络能以任意精度逼近任何非线性连续函数。在建模过程中的许多问题正是具有高度的非线性。 并行分布处理方式:在神经网络中信息是分布储存和并行处理的,这使它具有很强的容错性和很快的处理速度。 自学习和自适应能力:神经网络在训练时,能从输入、输出的数据中提取出规律性的知识,记忆于网络的权值中,并具有泛化能力,即将这组权值应用于一般情形的能力。神经网络的学习也可以在线进行。 数据融合的能力:神经网络可以同时处理定量信息和定性信息,因此它可以利用传统的工程技术(数值运算)和人工智能技术(符号处理)。 多变量系统:神经网络的输入和输出变量的数目是任意的,对单变量系统与多变量系统提供了一种通用的描述方式,不必考虑各子系统间的解耦问题。 收稿日期:2009-12-13 基金项目:国家自然科学基金资助项目(60674021) 作者简介:卢 峰(1982-),男,辽宁抚顺人,东北大学博士研究生;高立群(1949-),男,辽宁沈阳人,东北大学教授,博士生导师 第32卷第9期2011年9月东北大学学报(自然科学版)Journal of Northeastern U niversity(Natural Science)Vol 32,No.9Sep.2011 基于改进粒子群算法的优化策略 卢 峰,高立群 (东北大学信息科学与工程学院,辽宁沈阳 110819) 摘 要:为提高传统粒子群算法的搜索速度和搜索精度,提出了一种改进的自适应粒子群优化算法 将正则变化函数和慢变函数引入传统位置更新和速度更新公式当中,形成两种新的更新机制:搜索算子和开发算子 在算法运行的初始阶段,种群中大部分个体将按照搜索算子进行更新,搜索算子将有助于种群遍历整个解空间;随着迭代次数的增加,按照搜索算子进行更新的个体将逐渐减少,而按照开发算子进行更新的个体将逐渐增多,开发算子将有效地克服陷入局部最优解的问题 通过典型测试函数的仿真实验,新算法在加快收敛速度同时,提高了算法的全局搜索能力 关 键 词:进化算法;粒子群算法;全局优化;慢变函数;自适应 中图分类号:T G 273 文献标志码:A 文章编号:1005 3026(2011)09 01221 04 Novel Optimization Mechanism Based on Improved Particle Swarm Optimization L U Feng ,GAO L i qun (School of Information Science &Engineering,Northeaster n U niv ersity,Shenyang 110819,China.Corresponding author :LU F eng,E mail:feng.lu.lf @g https://www.360docs.net/doc/a218994078.html,) Abstract :To accelerate searching speed and optimization accuracy of traditional PSO,an improved particle swarm optimization (PSO )algorithm w as presented.Regularly vary ing function and slow ly varying function were introduced in the position and velocity update formula.New mechanisms such as explorative operator and exploitative operator are formulated.At the beginning,most elements will be updated by explorative operator in the entire search space sufficiently.Within the iterations,more and more particles w ill be handled by ex ploitative operator,which are useful to overcome the deceptions of multiple local optima.It can be seen from the simulation results of the standard benchm ark test functions that the proposed algorithm not only accelerates the convergence process,but also improves g lobal optim ization ability. Key words:evolutionary algorithms;particle sw arm optimization;global optimization;slow ly v arying function;self adaptive 20世纪90年代初,产生了模拟自然生物群体行为的优化方法,被称为群智能优化方法 Dorigo 等人通过模拟蚂蚁的寻径行为,提出了蚁群优化算法(ant colony optimization)[1] ;Eberhart 等人基于对鸟群、鱼群的模拟,提出了粒子群优化算法(particle sw arm optim ization )[2] 作为一种群智能优化方法的代表,粒子群算法通过个体间的协作来寻找最优解,每个个体都被赋予一个随机速度并在整个解空间中搜索,通 过个体之间的合作与竞争来实现个体进化 由于粒子群优化算法运算简单,易于实现,具有良好的解决非线性、不可微和多峰值复杂优化问题的能力,已被广泛应用于科学和工程实际领域[3-5] 但是,粒子群优化算法是根据全体粒子和自身的搜索经验向着最优解的方向进化,在进化后期收敛速度将变得缓慢,同时算法在收敛到一定精度时,容易陷入停滞,无法继续进化更新,因此,存在早熟和陷入局部极值点的现象 毕业论文 题目粒子群算法及其参数设置专业信息与计算科学 班级计算061 学号3060811007 学生xx 指导教师徐小平 2016年 I 粒子群优化算法及其参数设置 专业:信息与计算科学 学生: xx 指导教师:徐小平 摘要 粒子群优化是一种新兴的基于群体智能的启发式全局搜索算法,粒子群优化算法通过粒子间的竞争和协作以实现在复杂搜索空间中寻找全局最优点。它具有易理解、易实现、全局搜索能力强等特点,倍受科学与工程领域的广泛关注,已经成为发展最快的智能优化算法之一。论文介绍了粒子群优化算法的基本原理,分析了其特点。论文中围绕粒子群优化算法的原理、特点、参数设置与应用等方面进行全面综述,重点利用单因子方差分析方法,分析了粒群优化算法中的惯性权值,加速因子的设置对算法基本性能的影响,给出算法中的经验参数设置。最后对其未来的研究提出了一些建议及研究方向的展望。 关键词:粒子群优化算法;参数;方差分析;最优解 II Particle swarm optimization algorithm and its parameter set Speciality: Information and Computing Science Student: Ren Kan Advisor: Xu Xiaoping Abstract Particle swarm optimization is an emerging global based on swarm intelligence heuristic search algorithm, particle swarm optimization algorithm competition and collaboration between particles to achieve in complex search space to find the global optimum. It has easy to understand, easy to achieve, the characteristics of strong global search ability, and has never wide field of science and engineering concern, has become the fastest growing one of the intelligent optimization algorithms. This paper introduces the particle swarm optimization basic principles, and analyzes its features. Paper around the particle swarm optimization principles, characteristics, parameters settings and applications to conduct a thorough review, focusing on a single factor analysis of variance, analysis of the particle swarm optimization algorithm in the inertia weight, acceleration factor setting the basic properties of the algorithm the impact of the experience of the algorithm given parameter setting. Finally, its future researched and prospects are proposed. Key word:Particle swarm optimization; Parameter; Variance analysis; Optimal solution III 对于函数f=x*sin(x)*cos(2*x)-2*x*sin(3*x),求其在区间[0,20]上该函数的最大值。 ?初始化种群 已知位置限制[0,20],由于一维问题较为简单,因此可以取初始种群N 为50,迭代次数为100,当然空间维数d 也就是1。 位置和速度的初始化即在位置和速度限制内随机生成一个N×d 的矩阵,对于此题,位置初始化也就是在0~20内随机生成一个50×1的数据矩阵,而对于速度则不用考虑约束,一般直接在0~1内随机生成一个50×1的数据矩阵。 此处的位置约束也可以理解为位置限制,而速度限制是保证粒子步长不超限制的,一般设置速度限制为[-1,1]。 粒子群的另一个特点就是记录每个个体的历史最优和种群的历史最优,因此而二者对应的最优位置和最优值也需要初始化。其中每个个体的历史最优位置可以先初始化为当前位置,而种群的历史最优位置则可初始化为原点。对于最优值,如果求最大值则初始化为负无穷,相反地初始化为正无穷。 每次搜寻都需要将当前的适应度和最优解同历史的记录值进行对比,如果超过历史最优值,则更新个体和种群的历史最优位置和最优解。 ?速度与位置的更新 速度和位置更新是粒子群算法的核心,其原理表达式和更新方式如下: 每次更新完速度和位置都需要考虑速度和位置的限制,需要将其限制在规定范围内,此处仅举出一个常规方法,即将超约束的数据约束到边界(当位置或者速度超出初始化限制时,将其拉回靠近的边界处)。当然,你不用担心他会停住不动,因为每个粒子还有惯性和其他两个参数的影响。 代码如下: clc;clear;close all; %% 初始化种群 f= @(x)x .* sin(x) .* cos(2 * x) - 2 * x .* sin(3 * x); % 函数表达式figure(1);ezplot(f,[0,0.01,20]); N = 50; % 初始种群个数 d = 1; % 空间维数 ger = 100; % 最大迭代次数 limit = [0, 20]; % 设置位置参数限制 vlimit = [-1, 1]; % 设置速度限制 w = 0.8; % 惯性权重 c1 = 0.5; % 自我学习因子 c2 = 0.5; % 群体学习因子 for i = 1:d 基本粒子群算法的原理和matlab程序 作者——niewei120(nuaa) 一、粒子群算法的基本原理 粒子群优化算法源自对鸟群捕食行为的研究,最初由Kennedy和Eberhart提出,是一种通用的启发式搜索技术。一群鸟在区域中随机搜索食物,所有鸟知道自己当前位置离食物多远,那么搜索的最简单有效的策略就是搜寻目前离食物最近的鸟的周围区域。PSO 算法利用这种模型得到启示并应用于解决优化问题。PSO 算法中,每个优化问题的解都是粒子在搜索 空间中的位置,所有的粒子都有一个被优化的目标函数所决定的适应值,粒子还有一个速度值决定它们飞翔的方向和距离,然后粒子群就追随当前的最优粒子在解空间中搜索。 PSO 算法首先在给定的解空间中随机初始化粒子群,待优化问题的变量数决定了解空间的维数。每个粒子有了初始位置与初始速度。然后通过迭代寻优。在每一次迭代中,每个粒子通过跟踪两个“极值”来更新自己在解空间中的空间位置与飞翔速度。第一个极值就是单个粒子本身在迭代过程中找到的最优解粒子,这个粒子叫做个体极值。另一个极值是种群所有粒子在迭代过程中所找到的最优解粒子,这个粒子是全局极值。上述的方法叫全局粒子群算法。如果不用种群所有粒子而只用其中一部分作为该粒子的邻居粒子,那么在所有邻居粒子中的极值就是局部极值,该方法称为局部PSO 算法。 速度、位置的更新方程表示为: 每个粒子自身搜索到的历史最优值p i ,p i=(p i1,p i2,....,p iQ),i=1,2,3,....,n。所有粒子搜索到的最优值p g,p g=(p g1,p g2,....,p gQ),注意这里的p g只有一个。 是保持原来速度的系数,所以叫做惯性权重。 是粒子跟踪自己历史最优值的权重系数,它表示粒子自身的认识,所以叫“认知”。通常设置为2。 是粒子跟踪群体最优值的权重系数,它表示粒子对整个群体知识的认识,所以叫做“社会知识”,经常叫做“社会”。通常设置为2。 是[0,1]区间内均匀分布的随机数。 是对位置更新的时候,在速度前面加的一个系数,这个系数我们叫做约束因子。通常设 置为1 。 基于粒子群优化的BP神经网络 【摘要】人工神经网络的优化学习是其研究中的一个重要课题。将粒子群优化算法用于BP神经网络的学习,将粒子优化算法的全局搜索和BP神经网的局部搜索相结合,并设计一网络实例加以训练,达到了比较满意的效果。 【关键词】粒子群优化算法BP神经网络BP算法BP网络(Back Propagation Network)是用途最为广泛的一类神经网络,具有很强的信息处理能力。但是,由于BP算法的基本思想是最小二乘法,采用的是梯度搜索技术,难免存在收敛速度慢、局部极小等问题。粒子群优化算法(Particle Swarm Optimaziton,简称PSO )是由Kennedy J和Eberhart R C于1995年提出的一种优化算法,源于对鸟群和鱼群群体运动行为的研究。由于其容易理解,易于实现,不要求目标函数和约束条件是可微的,并能以较大概率求得全局最优解,目前已在许多优化问题中得到成功应用。由于它具有并行计算的特点,而且可以提高计算速度。因此,可以用粒子群优化算法来优化BP网络。 一、BP神经网络及其算法 BP网络是一种具有三层或三层以上的单向传播的多层前馈网络,其拓扑结构如图1。 图1 拓扑结构图 BP算法的执行步骤如下: (1)对各层权系数置一个较小Wij的非零随机数。(2)输入一个样本X=(X1,X2,…,x n),以及对应期望输出) Y=(y1,y2,…,yn)。(3)计算各层的输出。 对于第k 层第i个神经元的输出有:Uki=∑WijXk-1i,Xki=f(Uki)(一般为sigmoid 函数,即f(x)=1/(1-epx(-x))。(4)求各层的学习误差dki。对于输出层,有,k=m,dmi=Xmi(1-Xmi)(Xmi-Ymi)。 对于其他各层,有dxi=Xki(1-Xki)∑Wijdk+1i。(5)修正权系数Wij。Wij (t+1)=Wij-η•dki•Xk-1j。(6)当求出各层权系数之后,可判别是否满足要求。如果满足要求,则算法结束;如果未满足要求,则返回(3)执行。 二、粒子群优化算法 粒子群算法解决函数优化问题 1、群智能算法研究背景 粒子群优化算法(Particle Swarm Optimization,PSO)是由Kennedy 和Eberhart 在研究鸟类和鱼类的群体行为基础上于1995 年提出的一种群智能算法,其思想来源于人工生命和演化计算理论,模仿鸟群飞行觅食行为,通过鸟集体协作使群体达到优。 PSO算法作为一种新的群智能算法,可用于解决大量非线性、不可微和多峰值的复杂函数优化问题,并已广泛应用于科学和工程领域,如函数优化、神经网络训练、经济调度、模式识别与分类、结构设计、电磁场和任务调度等工程优化问题等。 PSO算法从提出到进一步发展,仅仅经历了十几年的时间,算法的理论基础还很薄弱,自身也存在着收敛速度慢和早熟的缺陷。如何加快粒子群算法的收敛速度和避免出现早熟收敛,一直是大多数研究者关注的重点。因此,对粒子群算法的分析改进不仅具有理论意义,而且具有一定的实际应用价值。 2、国内外研究现状 对PSO算法中惯性权重的改进:Poli等人在速度更新公式中引入惯性权重来更好的控制收敛和探索,形成了当前的标准PSO算法。 研究人员进行了大量的研究工作,先后提出了线性递减权值( LDIW)策略、模糊惯性权值( FIW) 策略和随机惯性权值( RIW) 策略。其中,FIW 策略需要专家知识建立模糊规则,实现难度较大,RIW 策略被用于求解动态系统,LDIW策略相对简单且收敛速度快, 任子晖,王坚于2009 年,又提出了基于聚焦距离变化率的自适应惯性权重PSO算法。 郑春颖和郑全弟等人,提出了基于试探的变步长自适应粒子群算 法。这些改进的PSO算法既保持了搜索速度快的特点, 又提高了全局搜索的能力。 对PSO算法的行为和收敛性的分析:1999 年采用代数方法对几种典型PSO算法的运行轨迹进行了分析,给出了保证收敛的参数选择范围。在收敛性方面Fransvan den Bergh引用Solis和Wets关于随机性算法的收敛准则,证明了标准PSO算法不能收敛于全局优解,甚至于局部优解;证明了保证收敛的PSO算法能够收敛于局部优解,而不能保证收敛于全局优解。 国内的学者:2006 年,刘洪波和王秀坤等人对粒子群优化算法的收敛性进行分析,指出它在满足收敛性的前提下种群多样性趋于减小,粒子将会因速度降低而失去继续搜索可行解的能力,提出混沌粒子群优化算法。 2008 年,黄翀鹏和熊伟丽等人分析惯性权值因子大小对PSO算法收敛性所带来的影响,对粒子群算法进行了改进。2009 年,高浩和冷文浩等人,分析了速度因子对微粒群算法影响,提出了一种基于Gaussian 变异全局收敛的粒子群算法。并证明了它能以概率 1 收敛到全局优解。 2010 年,为提高粒子群算法的收敛性,提出了基于动力系统的稳定性理论,对惯性权重粒子群模型的收敛性进行了分析,提出了使得在算法模型群模型收敛条件下的惯性权重和加速系数的参数约束关系,使算法在收敛性方面具有显著优越性。在PSO算法中嵌入别的算法的思想和技术。 1997年,李兵和蒋慰孙提出混沌优化方法; 1998年,Angeline在PSO算法中引入遗传算法中的选择算子,该算法虽然加快了算法的收敛速度,但同时也使算法陷入局部优的概率大增,特别是在优化Griewank 基准函数的优值时得到的结果不理想; 2004 年,高鹰和谢胜利将混沌寻优思想引入到粒子群优化算法中,首先对当前群体中的优粒子进行混沌寻优, 再用混沌寻优的结果随机替换群体中的一个粒子,这样提出另一种混沌粒子群优化算法。 主函数源程序(main.m) %------基本粒子群优化算法(Particle Swarm Optimization)-----------%------名称:基本粒子群优化算法(PSO) %------作用:求解优化问题 %------说明:全局性,并行性,高效的群体智能算法 %------初始格式化--------------------------------------------------clear all; clc; format long; %------给定初始化条件---------------------------------------------- c1=1.4962;%学习因子1 c2=1.4962;%学习因子2 w=0.7298;%惯性权重 MaxDT=1000;%最大迭代次数 D=10;%搜索空间维数(未知数个数) N=40;%初始化群体个体数目 eps=10^(-6);%设置精度(在已知最小值时候用) %------初始化种群的个体(可以在这里限定位置和速度的范围)------------for i=1:N for j=1:D x(i,j)=randn;%随机初始化位置 v(i,j)=randn;%随机初始化速度 end end %------先计算各个粒子的适应度,并初始化Pi和Pg----------------------for i=1:N p(i)=fitness(x(i,:),D); y(i,:)=x(i,:); end pg=x(1,:);%Pg为全局最优 for i=2:N if fitness(x(i,:),D) 附录 程序1 当22111==c c ,5.12212==c c ,2.1=w 。 a)%主函数源程序(main.m ) %------基本粒子群算法 (particle swarm optimization ) %------名称: 基本粒子群算法 %------初始格式化 clear all ; %清除所有变量 clc; %清屏 format long ; %将数据显示为长整形科学计数 %------给定初始条条件------------------ N=40; %3初始化群体个数 D=10; %初始化群体维数 T=100; %初始化群体最迭代次数 c11=2; %学习因子1 c21=2; %学习因子2 c12=1.5; c22=1.5; w=1.2; %惯性权重 eps=10^(-6); %设置精度(在已知最小值的时候用) %------初始化种群个体(限定位置和速度)------------ x=zeros(N,D); v=zeros(N,D); for i=1:N for j=1:D x(i,j)=randn; %随机初始化位置 v(i,j)=randn; %随机初始化速度 end end %------显示群位置---------------------- figure(1) for j=1:D if(rem(D,2)>0) subplot((D+1)/2,2,j) else subplot(D/2,2,j) end plot(x(:,j),'b*');grid on xlabel('粒子') ylabel('初始位置') tInfo=strcat('第',char(j+48),'维'); if(j>9) tInfo=strcat('第',char(floor(j/10)+48),char(rem(j,10)+48),'维'); end title(tInfo) end %------显示种群速度 figure(2) for j=1:D if(rem(D,2)>0) subplot((D+1)/2,2,j) else subplot(D/2,2,j) end plot(x(:,j),'b*');grid on xlabel('粒子') ylabel('初始速度') tInfo=strcat('第,char(j+48),'维'); if(j>9) tInfo=strcat('第',char(floor(j/10)+48), char(rem(j,10)+48),'维); end title(tInfo) end figure(3) 基本粒子群算法的原理和matlab 程序 作者—— niewei120 (nuaa) 一、粒子群算法的基本原理 粒子群优化算法源自对鸟群捕食行为的研究,最初由Kennedy 和 Eberhart 提出,是一种通 用的启发式搜索技术。一群鸟在区域中随机搜索食物,所有鸟知道自己当前位置离食物多远, 那么搜索的最简单有效的策略就是搜寻目前离食物最近的鸟的周围区域。PSO 算法利用这种模型得到启示并应用于解决优化问题。PSO 算法中,每个优化问题的解都是粒子在搜索 空间中的位置,所有的粒子都有一个被优化的目标函数所决定的适应值,粒子还有一个速度值决定它们飞翔的方向和距离,然后粒子群就追随当前的最优粒子在解空间中搜索。 PSO 算法首先在给定的解空间中随机初始化粒子群,待优化问题的变量数决定了解空间的维数。每个粒子有了初始位置与初始速度。然后通过迭代寻优。在每一次迭代中,每个粒子通过跟踪两个“极值”来更新自己在解空间中的空间位置与飞翔速度。第一个极值就是单个粒子本身在迭代过程中找到的最优解粒子,这个粒子叫做个体极值。另一个极值是种群所有粒子在迭代过程中所找到的最优解粒子,这个粒子是全局极值。上述的方法叫全局粒子群算法。如果不用种群所有粒子而只用其中一部分作为该粒子的邻居粒子,那么在所有邻居粒子中的极值就是局部极值,该方法称为局部PSO 算法。 速度、位置的更新方程表示为: 每个粒子自身搜索到的历史最优值p i,p i=(p i1 ,p i2 ,....,p iQ ), i=1,2,3,....,n 。所有粒子搜索到的最优值p g, p g=(p g1 ,p g2,....,p gQ ),注意这里的p g只有一个。 是保持原来速度的系数,所以叫做惯性权重。 是粒子跟踪自己历史最优值的权重系数,它表示粒子自身的认识,所以叫“认知”。通常设置为 2 。 是粒子跟踪群体最优值的权重系数,它表示粒子对整个群体知识的认识,所以叫做“社会知识”,经常叫做“社会”。通常设置为2。 是[0,1] 区间内均匀分布的随机数。 是对位置更新的时候,在速度前面加的一个系数,这个系数我们叫做约束因子。通常设 置为 1 。 基于粒子群优化算法的神经网络在农药定量构效关系建模中的应用 张丽平 俞欢军3 陈德钊 胡上序 (浙江大学化工系,杭州310027) 摘 要 神经网络模型能有效模拟非线性输入输出关系,但其常规训练算法为BP 或其它梯度算法,导致训练时间较长且易陷入局部极小点。本实验探讨用粒子群优化算法训练神经网络,并应用到苯乙酰胺类农药的定量构效关系建模中,对未知化合物的活性进行预测来指导新药的设计和合成。仿真结果表明,粒子群优化算法训练的神经网络不仅收敛速度明显加快,而且其预报精度也得到了较大的提高。关键词 粒子群优化算法,神经网络,定量构效关系 2004201204收稿;2004207225接受 本文系国家自然科学基金资助项目(N o.20276063) 1 引 言 药物定量构效关系(QS AR )是研究药物生理活性和药物分子结构参数间的量变规律并建立相应的 数学模型,进而研究药物的作用机理,从而用于预测未知化合物的生物活性,探讨药物的作用机理,指导新药的设计和合成,在药物和农药的研究与设计中已经显示出广阔的应用前景1。以往QS AR 的建模方法大多基于统计原理,局限于线性模型,只进行简单的非线性处理,由此所建立的模型很难契合实际构效关系,并且其处理过程都比较繁琐2。神经网络通过学习将构效关系知识隐式分布在网络之中,适用于高度非线性体系。 在药物QS AR 中采用神经网络(NN )始于20世纪80年代末3,此后得到迅速的发展,目前已发展为除多重线性回归和多元数据分析之外的第3种方法4。通常多层前传网络采用BP 算法,通过误差反传,按梯度下降的方向调整权值。其缺点是可能陷入局部极小点,且对高维输入收敛速度非常缓慢。 粒子群优化算法(particle swarm optimization ,PS O )是K ennedy 等5源于对鸟群、鱼群和人类社会行为的研究而发展的一种新的进化型寻优技术。PS O 已成为进化寻优算法研究的热点,其最主要特点是简单、收敛速度快,且所需领域知识少。本实验拟将该方法初始化前传神经网络为苯乙酰胺类农药建立良好适用的QS AR 模型。 2 苯乙酰胺类农药的Q SAR 问题 苯乙酰胺类化合物是除草农药,其除草活性与其分子结构密切相关。所有的N 2(12甲基212苯乙基)苯乙酰胺都可用相应的羧酸酰胺通过霍夫曼反应生成。N 2(12甲基212苯乙基)苯乙酰胺的基本结构式为 : 其中X 为Me 、F 、Cl 、OMe 、CF 3和Br 等,Y 为Me 、Cl 、F 和Br 等,由不同的X 和Y 取代基可构成不同的化合物。常用以下7个理化参数描述化合物的分子组成和结构:log P 、log 2P (疏水性参数及其平方项)、 σ(电性效应参数)、E s (T aft 立体参数)、MR (摩尔折射度),1χ、2 χ(分子连接性指数)。于是这类化合物的QS AR 就转化为上述理化参数与除草活性间的关系。为研究这种关系,选用具有代表性的50个化合物, 他们的活性值取自文献1,见表1。 第32卷2004年12月分析化学(FE NXI H UAX UE ) 研究报告Chinese Journal of Analytical Chemistry 第12期1590~1594 龙源期刊网 https://www.360docs.net/doc/a218994078.html, 改进粒子群算法的目标函数变化分类动态优化 作者:苏玉孔国利 来源:《现代电子技术》2017年第07期 摘要:由于优化问题的目标函数和约束条件都随着时间而改变导致其最优值也发生改变,提出一种基于改进粒子群算法的目标函数变化分类动态优化算法。首先对动态优化问题进行定义,明确问题的研究对象,提出对目标函数随时间变化程度分类的思想,通过对变化的函数进行监测的方法将其分为剧烈变化、中等程度变化和弱变化三种类型,并针对不同的强度变化对粒子群算法采用不同的改进策略,最后将不同的策略融入计算。通过采用移动多峰问题进行测试,结果表明,提出的改进粒子群优化算法能监测目标函数变化,并能随时跟踪到最优解,平均离线误差相对于标准粒子群算法更小,性能更稳定。 关键词:粒子群算法;动态优化;目标函数时变分类;移动峰问题 中图分类号: TN911.1?34; TP301.6 文献标识码: A 文章编号: 1004?373X(2017)07?0175?04 Dynamic optimization of objective function changing classification based on improved particle swarm optimization SU Yu, KONG Guoli (College of Information Engineering, Zhongzhou University, Zhengzhou 450001,China) Abstract: The objective function and constraint condition for the optimization problem are changed with time, and may change its optimal value. A dynamic optimization of the objective function changing classification based on improved particle swarm optimization is proposed. The dynamic optimization problem is defined to determine the study object of the problem. The classification thought that the objective function is changed with the time varying degree is put forward. The varying function is divided into the types of drastic change, medium grade change and weak change with the monitoring method. Different strategies are adopted for the particle swarm optimization according to the different intensity changes, and integrated for computation. The algorithm was tested with the moving multi?peak problem. The test results show that the improved particle swarm optimization can monitor the changes of the objective function, track the optimal solution momentarily, its average offline error is smaller than that of the standard particle swarm optimization algorithm, and the performance is more stable.粒子群算法在神经网络非线性函数拟合中的应用【精品文档】(完整版)

基于改进粒子群算法的优化策略

粒子群优化算法及其参数设置

基于MATLAB的粒子群优化算法的应用示例

(完整word版)基本粒子群算法的原理和matlab程序

基于粒子群优化的BP神经网络

粒子群算法解决函数优化问题

基本粒子群算法的matlab源程序

粒子群优化算法及其参数设置

(完整word版)基本粒子群算法的原理和matlab程序.doc

基于粒子群优化算法的神经网络在

改进粒子群算法的目标函数变化分类动态优化