光流法原理详细

光流法基本原理

从二维图像序列中检测物体的运动、提取运动参数并且分析物体运动的相关规律是运动图像序列分析的主要研究内容。光流法是进行运动图像分析的重要方法,在视觉运动研究中具有举足轻重的作用。

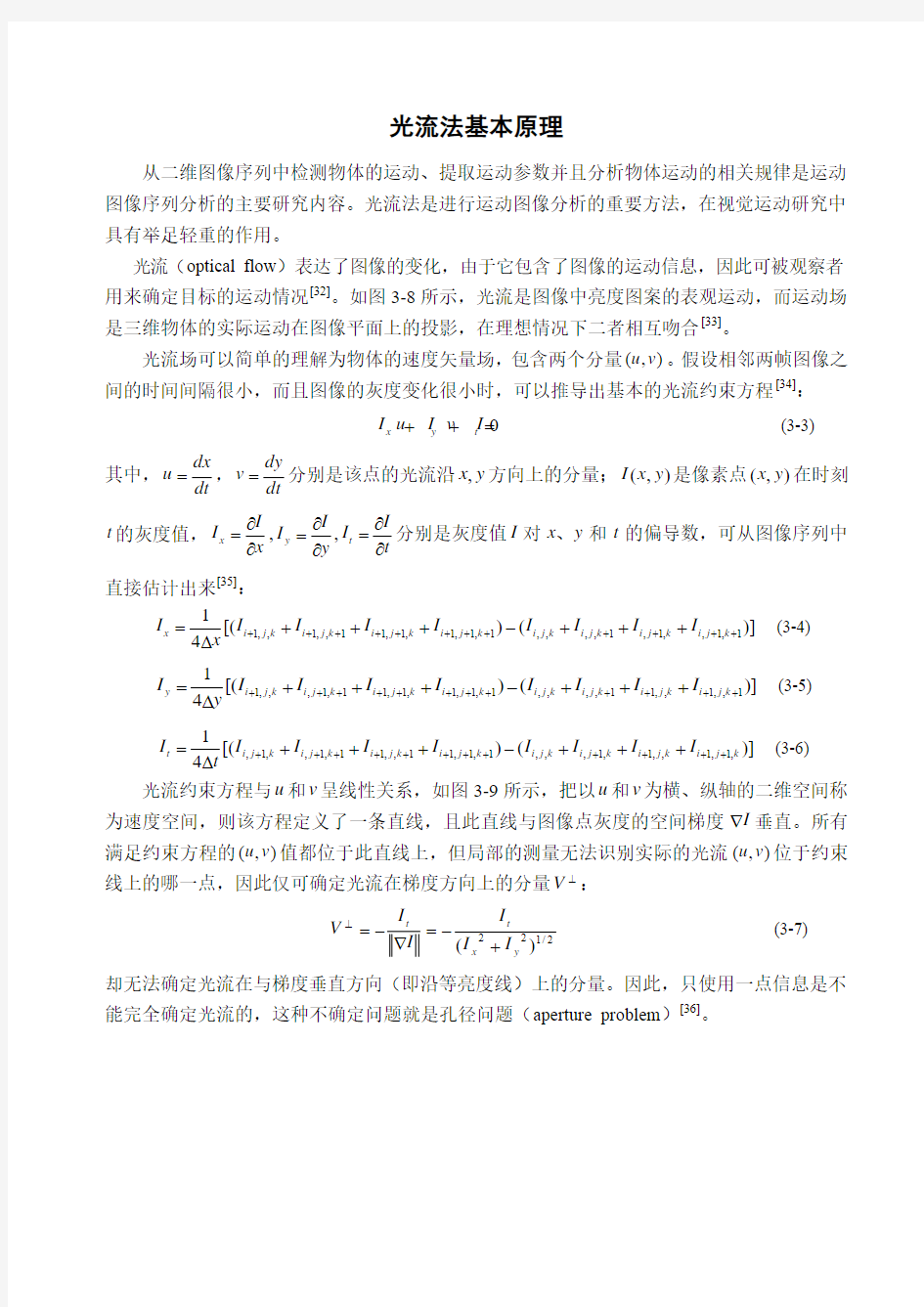

光流(optical flow )表达了图像的变化,由于它包含了图像的运动信息,因此可被观察者用来确定目标的运动情况[32]。如图3-8所示,光流是图像中亮度图案的表观运动,而运动场是三维物体的实际运动在图像平面上的投影,在理想情况下二者相互吻合[33]。

光流场可以简单的理解为物体的速度矢量场,包含两个分量(,)u v 。假设相邻两帧图像之间的时间间隔很小,而且图像的灰度变化很小时,可以推导出基本的光流约束方程[34]:

0x y t I u I v

I ++= (3-3) 其中,dx u dt

=

,dy

v dt =分别是该点的光流沿,x y 方向上的分量;(,)I x y 是像素点(,)x y 在时刻

t 的灰度值,x I I x ?=

?,y I

I y

?=?,t I I t ?=?分别是灰度值I 对x 、y 和t 的偏导数,可从图像序列中直接估计出来[35]: 1,,1,,11,1,1,1,1,,,,1,1,,1,11[()()]4x i j k i j k i j k i j k i j k i j k i j k i j k I I I I I I I I I x

++++++++++++=+++-+++? (3-4)

1,,,1,11,1,1,1,1,,,,11,,1,,11

[()()]4y i j k i j k i j k i j k i j k i j k i j k i j k I I I I I I I I I y

++++++++++++=+++-+++? (3-5) ,1,,1,11,,11,1,1,,,1,1,,1,1,1

[()()]4t i j k i j k i j k i j k i j k i j k i j k i j k I I I I I I I I I t

++++++++++++=

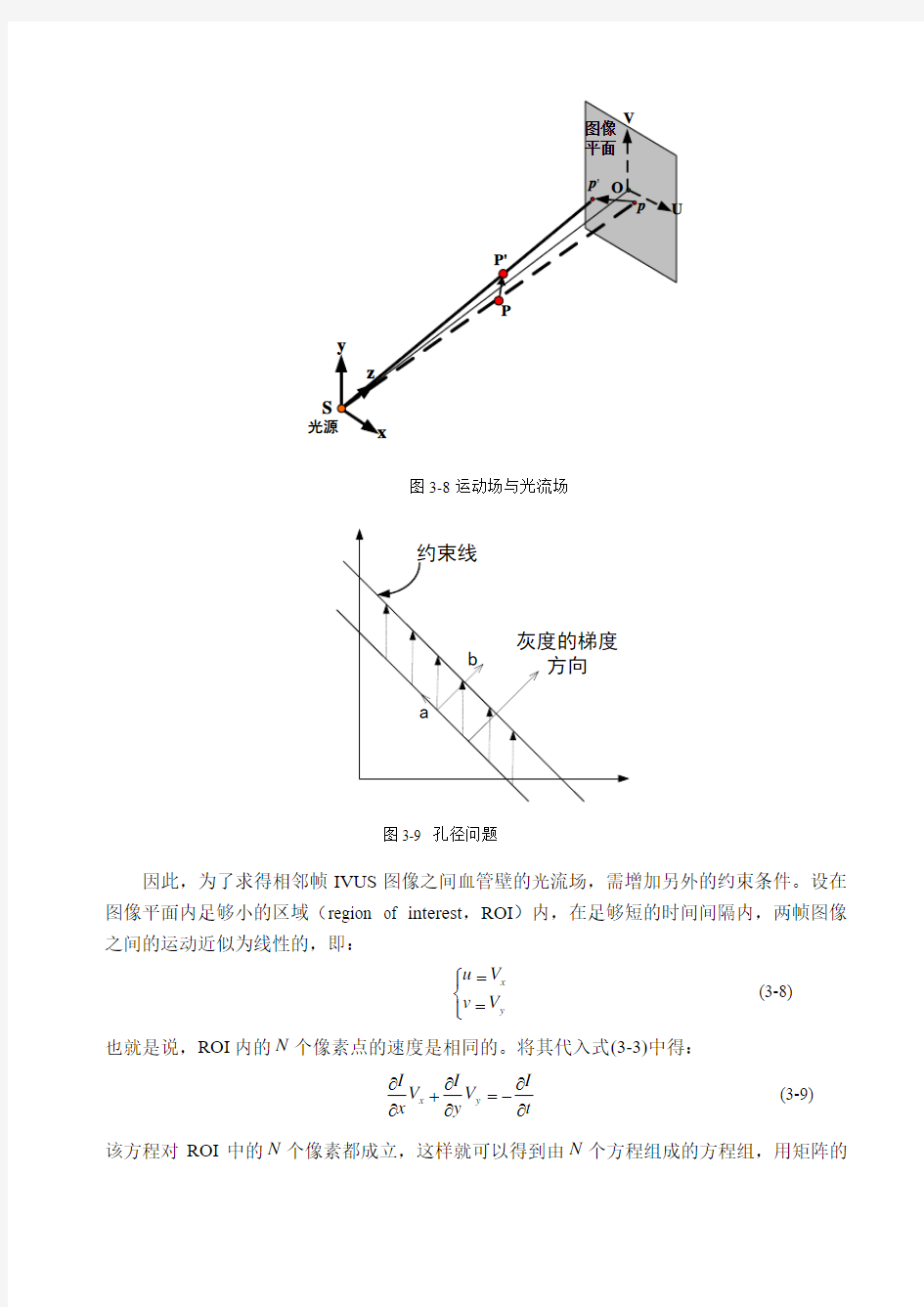

+++-+++? (3-6) 光流约束方程与u 和v 呈线性关系,如图3-9所示,把以u 和v 为横、纵轴的二维空间称为速度空间,则该方程定义了一条直线,且此直线与图像点灰度的空间梯度I ?垂直。所有满足约束方程的(,)u v 值都位于此直线上,但局部的测量无法识别实际的光流(,)u v 位于约束线上的哪一点,因此仅可确定光流在梯度方向上的分量⊥V :

2/122)

(y x t t I I I

I I V +-=?-

=⊥ (3-7) 却无法确定光流在与梯度垂直方向(即沿等亮度线)上的分量。因此,只使用一点信息是不能完全确定光流的,这种不确定问题就是孔径问题(aperture problem )[36]。

图3-8运动场与光流场

图3-9 孔径问题

因此,为了求得相邻帧IVUS 图像之间血管壁的光流场,需增加另外的约束条件。设在图像平面内足够小的区域(region of interest ,ROI )内,在足够短的时间间隔内,两帧图像之间的运动近似为线性的,即:

x

y

u V v V =???

=?? (3-8)

也就是说,ROI 内的N 个像素点的速度是相同的。将其代入式(3-3)中得:

x y I I I

V V x y t

???+=-??? (3-9) 该方程对ROI 中的N 个像素都成立,这样就可以得到由N 个方程组成的方程组,用矩阵的

形式表示如下:

111222.

........N N N x y t x y t x y x y t I I I I I I V V I I I -????

????-???

?????

??

?

???=???????????????

?????-????

(3-10) 这就产生了方程的超定问题:2个未知数,N 个方程。采用最小二乘法可以很容易地求解该方程,所花费的计算时间比常用的迭代法要少。

运动目标检测光流法

摘要 运动目标检测方法是研究如何完成对视频图像序列中感兴趣的运动目标区域的“准确定位”问题。光流场指图像灰度模式的表面运动,它可以反映视频相邻帧之间的运动信息,因而可以用于运动目标的检测。MATLAB这种语言可移植性好、可扩展性强,再加上其中有丰富的图像处理函数,所以利用MATLAB 软件来用光流法对运动目标的检测中具有很大的优势。本设计主要可以借助matlab软件编写程序,运用Horn-Schunck算法对图像前后两帧进行处理,画出图像的光流场。而图像的光流场每个像素都有一个运动矢量,因此可以反映相邻帧之间的运动,分析图像的光流场就可以得出图像中的运动目标的运动情况。 关键字:光流法;Horn-Schunck算法;matlab

目录 1光流法的设计目的 (1) 2光流法的原理 (1) 2.1光流法的介绍 (1) 2.1.1光流与光流场的概念 (1) 2.1光流法检测运动目标的原理 (2) 2.1.1光流场计算的基本原理 (2) 2.2.2基于梯度的光流场算法 (2) 2.2.3Horn-Schunck算法 (3) 2.2.4光流法检测运动目标物体的基本原理概述 (5) 3光流法的程序具体实现 (6) 3.1源代码 (6) 3.1.1求解光流场函数 (6) 3.1.2求导函数 (9) 3.1.3高斯滤波函数 (9) 3.1.4平滑性约束条件函数 (10) 3.1.5画图函数 (10) 4仿真图及分析 (12) 结论 (13) 参考文献 (14)

1 光流法的设计目的 数字图像处理,就是用数字计算机及其他有关数字技术,对图像进行处理,以达到预期的目的。随着计算机的发展,图像处理技术在许多领域得到了广泛应用,数字图像处理已成为电子信息、通信、计算机、自动化、信号处理等专业的重要课程。 数字图像处理课程设计是在学习完数字图像处理的相关理论后,进行的综合性训练课程,其目的是:使学生进一步巩固数字图像处理的基本概念、理论、分析方法和实现方法;增强学生应用Matlab编写数字图像处理的应用程序及分析、解决实际问题的能力;尝试所学的内容解决实际工程问题,培养学生的工程实践能力。 运动目标检测是数字图像处理技术的一个主要部分,近些年来,随着多媒体技术的迅猛发展和计算机性能的不断提高,动态图像处理技术日益受到人们的青睞,并且取得了丰硕的成果,广泛应用于交通管理、军事目标跟踪、生物医学等领域。 因此,基于光流法,实现运动目标的检测是本文的研究对象。结合图书馆书籍、网上资料以及现有期刊杂志,初步建立起运动目标检测的整体思路和方法。 2 光流法的原理 2.1 光流法的介绍 2.1.1 光流与光流场的概念 光流是指空间运动物体在观测成像面上的像素运动的瞬时速度,它利用图像序列像素强度数据的时域变化和相关性来确定各自像素位置的“运动”,即反映图像灰度在时间上的变化与景物中物体结构及其运动的关系。将二维图像平面特定坐标点上的灰度瞬时变化率定义为光流矢量。视觉心理学认为人与被观察物体

光流法运动目标跟踪论文

研究生课程论文 《光流法运动目标跟踪》 课程名称s 姓名 学号 专业 任课教师 教师评阅意见: 论文成绩评阅日期 课程论文提交时间:年月日

摘要本文实现了对运动目标的跟踪检测,重点研究金字塔Lucas-Kanade算法,在研究基于特征点的目标跟踪的一般方法,即采用改进的Harris角点提取点的方法。实验结果表明先采用Shi-Tomasi算法比Harris算法提取角点效果更好,之后用金字塔光流进行跟踪。 关键词运动目标跟踪Lucas-Kanade Shi-Tomasi 改进Harris 1.引言 近些年,模式识别领域的图像处理已经成为一个支柱,其中,动态目标的识别跟踪已经被研究者应用到工程上,而运动目标跟踪算法的优劣直接影响着运动目标跟踪的稳定性和精确性。本文主要是运动光流法等算法对运动目标进行跟踪。目标特征点的跟踪是计算机视觉中的一个基本而极具挑战性的研究课题,该课题在人机互动(HCI),目标识别,目标运动等领域有着非常重要的应用。虽然对运动目标跟踪算法能够完成对运动目标的可靠跟踪,大多数都存在处理数据量大,运算复杂等问题。因此,研究具有高精度且运算简单的目标检测与跟踪算法是图形跟踪迫切需要解决的问题,目前基于特征和光流的图像跟踪方法受到了极大的关注。 2.运动目标检测算法 运动目标检测技术是目标自动检测、识别与跟踪的基础,也是实现进一步处理视频编码、目标跟踪、目标分类及行为理解等的关键技术。基于视频或序列图像的分析一般可分为四个步骤:(1)运动目标的检测与提取,(2)运动目标的分类,(3)运动目标的跟踪,(4)运动目标的行为理解与分析,如图1所示。 图像序列运动检测目标分类目标跟踪行为理解 图1 分析过程 在计算机视觉处理中,运动目标检测技术处于中层处理级别,它是指在一个视频或者图像中,对需要研究的并且是处于运动状态的目标和背景进行分离,对于行为理解,行为分析等其他技术的研究,运动目标检测也是一种有效的方法。 目标检测要依据运动目标的主要特性,例如时间特性、边缘形状特性、颜色灰度特性、矢量特性等等。时间特性、区域作为视频序列时间差分和图像分割的基础,是运动目标最基本的特性。目标运动时在形状、大小、刚度等方面的差异称为形态特征,利用形态特征对运动目标检测,难点是对小目标的检测。 3.光流法 1950年,Gibuson首先提出了光流的概念,所谓光流就是指图像表现运动的速度。物体在运动的时候之所以能被人眼发现,就是因为当物理运动时,会在人的视网膜上形成一系列的连续变化的图像,这些变化信息在不同时间,不断的流过眼睛视网膜,就好像一种光流过一

光流算法

它是一种运动模式,这种运动模式指的是一个物体、表面、边缘在一个视角下由一个观察者(比如眼睛、摄像头等)和背景之间形成的明显移动。光流技术,如运动检测和图像分割,时间碰撞,运动补偿编码,三维立体视差,都是利用了这种边缘或表面运动的技术。 光流的概念:(Optical flow or optic flow)二维图像的移动相对于观察者而言是三维物体移动的在图像平面的投影。 有序的图像可以估计出二维图像的瞬时图像速率或离散图像转移。 光流算法: 它评估了两幅图像的之间的变形,它的基本假设是体素和图像像素守恒。它假设一个物体的颜色在前后两帧没有巨大而明显的变化。基于这个思路,我们可以得到图像约束方程。不同的光流算法解决了假定了不同附加条件的光流问题。 Lucas–Kanade算法: 这个算法是最常见,最流行的。它计算两帧在时间t 到t + δt之间每个每个像素点位置的移动。由于它是基于图像信号的泰勒级数,这种方法称为差分,这就是对于空间和时间坐标使用偏导数。 图像约束方程可以写为I(x,y,z,t) = I(x+ δx,y+ δy,z+ δz,t+ δt) I(x, y,z, t)为在(x,y,z)位置的体素。 我们假设移动足够的小,那么对图像约束方程使用泰勒公式,我们可以

得到: H.O.T. 指更高阶,在移动足够小的情况下可以忽略。从这个方程中我们可以得到: 或者 我们得到: V x,V y,V z分别是I(x,y,z,t)的光流向量中x,y,z的组成。, , 和则是图像在(x,y,z,t)这一点向相应方向的差分。 所以 I x V x + I y V y + I z V z= ?I t。 写做: 这个方程有三个未知量,尚不能被解决,这也就是所谓光流算法的光圈问题。那么要找到光流向量则需要另一套解决的方案。而Lucas-Kanade算法是一个非迭代的算法: 假设流(Vx,Vy,Vz)在一个大小为m*m*m(m>1)的小窗中是一个常数,那么从像素 1...n, n = m3中可以得到下列一组方程: 三个未知数但是有多于三个的方程,这个方程组自然是个超定方程,也就是说方程组内有冗余,方程组可以表示为:

LK光流算法

光流的概念是Gibson于1950年首先提出的。所谓光流是指图像中模式运动的速 。1981年,Horn等人在相邻图像间的时间间隔很小,并且图像灰度变化也很小的 提下,推导出灰度图像光流场计算的基本等式,这是经典光流方法[18,24]。 光流的算法多种多样,其用于目标跟踪常用的算法有:检测和跟踪特征点[25]、跟 好的特征点[26]、金字塔图像的Lucas Kanade特征点跟踪算法(因为其跟踪过程是迭 的光流法计算过程,因此,为了更好的体现光流的作用,本文将其简称为:Lucas nad光流法)[27]。在这三种光流跟踪方法中,跟踪性能最优的是Lucas Kanade光流 –26–第四章目标跟踪 法,由于该算法仅跟踪少量的特征点、迭代法收敛速度也很快而且算法的计算量不大, 已被广泛的应用于运动车辆跟踪和人脸特征点跟踪[47,48];下面介绍文献[27],并对其 进行相关实验。 §4.3.1问题提出 用I和J来代表两个灰度图像。那么I(x)=I(x,y)和J(x)=J(x,y)代表了这两个灰度图 像在点X=[x,y]T的灰度值,x和y是图像的点X坐标。称图像I为第一幅图像,称J为 第二幅图像。从实际的图像来说,I和J是两个离散的函数,并且左上角的像素点坐标 是[0,0]T。用nx和ny表示图像的宽度和高度,右下端图像的坐标是[nx?1,ny?1]T。 考虑第一幅图像I(X)=I(x,y)上的一点,跟踪的目的就是在第二幅图像J(X)= J(x,y)上找到与之相对应的一点,d=[d x ,d y ] T 是在点X处图像的速度,即点X处图像的 光流。令ωx和ωy表示两个整数,假定图像速度d是使得下面的残差函数ε最小的函数:ε(d)=ε(dx,dy)= ux+ωx x=ux?ωx uy+ωy y=uy?ωy (I(x,y)?J(x+dx,y+dy)) 2 (4-3-5) 根据上面的定义,相似度的函数被在(2ωx+1,2ωy+1)的区域内定义。这个区域也 称之为积分窗口。典型的ωx、ωy是2、3、4、5、6、7个像素。 §4.3.2跟踪算法描述 基于特征点的跟踪的两个关键问题是准确度和鲁棒性。准确度是从直觉上来说, 为了不抹去图像中的细节,需要小的积分窗口。鲁棒性因素需要考虑光照变化,图像 运动时对尺寸变化的敏感性。特别的,为了了解大矢量运动的问题需要一个大的积分 窗口。实际上,仅仅考虑等式(4-3-5),理想的情况是dx<ωx,dy<ωy。这样我们就必 须兼顾准确度和鲁棒性来选择积分窗口。为了更好的解决这个问题,采用了基于金字 塔图像的光流跟踪方法。这个方法对局部跟踪的准确性提出了一个很好的解决方案。 一、金字塔图像表示 描述一个nx×ny的图像I,令I0=I表示第0层图像(原始图像),那么金字塔图

LK光流算法总结-精选.doc

运动目标检测之Lucas-Kanade 光流算法读书笔记 视觉是人类感知自身周围复杂环境最直接有效的手段之一,而在现实生活中大量有意义的视觉信息都包含在运动中,人眼对运动的物体和目标也更敏感,能够快速的发现运动目标。随着计算机技术、通信技术、图像处理技术的不断发展,计算机视觉己成为目前的热 点研究问题之一。而运动目标检测是计算机视觉研究的核心课题之一,融合了图像处理、模式识别、人工智能、自动控制、计算机等众多领域的先进技术,在军事制导、视觉导航、视频监控、智能交通、医疗诊断、工业产品检测等方面有着重要的实用价值和广阔的发展 前景。 一目标检测 运动目标检测运动目标检测是指从序列图像中将运动的前景目标从背景图像中提取出 来。目前,已有的运动目标检测方法按照算法的基本原理可以分为三类:背景差分法,帧间差 分法和光流法。 1 背景差分法 背景差分法又称背景减除法,背景差分法的原理是将当前帧与背景图像进行差分来得到 运动目标区域,但是需要构建一幅背景图像,这幅背景图像必须不含运动目标,并且应该能不断的更新来适应当前背景的变化,构建背景图像的方法有很多,比较常用的有基于单个高 斯模型的背景构建,基于混合高斯模型的背景构建,基于中值滤波器的背景构造,基于卡尔曼滤波器的背景构造,基于核函数密度估计的背景模型构造。 缺点:因为要求背景是静止的,所以背景的变化,场景中有很多干扰,比如场景中 有树枝和叶子在风中晃动、水面的波动等等,还有照明的变化和天气的变化等都可能影响检 测的结果 2 帧间差分法 帧间差分法是一种通过对视频图像序列中相邻两帧作差分运算来获得运动目标轮廓的 方法,它可以很好地适用于存在多个运动目标和摄像机移动的情况。当监控场景中出现异常 物体运动时,帧与帧之间会出现较为明显的差别,两帧相减,得到两帧图像亮度差的绝对值,

LK光流算法总结

运动目标检测之Lucas-Kanade光流算法读书笔记 视觉是人类感知自身周围复杂环境最直接有效的手段之一,而在现实生活中大量有意义的视觉信息都包含在运动中,人眼对运动的物体和目标也更敏感,能够快速的发现运动目标。随着计算机技术、通信技术、图像处理技术的不断发展,计算机视觉己成为目前的热点研究问题之一。而运动目标检测是计算机视觉研究的核心课题之一,融合了图像处理、模式识别、人工智能、自动控制、计算机等众多领域的先进技术,在军事制导、视觉导航、视频监控、智能交通、医疗诊断、工业产品检测等方面有着重要的实用价值和广阔的发展前景。 一目标检测 运动目标检测运动目标检测是指从序列图像中将运动的前景目标从背景图像中提取出来。目前,已有的运动目标检测方法按照算法的基本原理可以分为三类:背景差分法,帧间差分法和光流法。 1背景差分法 背景差分法又称背景减除法,背景差分法的原理是将当前帧与背景图像进行差分来得到运动目标区域,但是需要构建一幅背景图像,这幅背景图像必须不含运动目标,并且应该能不断的更新来适应当前背景的变化,构建背景图像的方法有很多,比较常用的有基于单个高斯模型的背景构建,基于混合高斯模型的背景构建,基于中值滤波器的背景构造,基于卡尔曼滤波器的背景构造,基于核函数密度估计的背景模型构造。 缺点:因为要求背景是静止的,所以背景的变化,场景中有很多干扰,比如场景中有树枝和叶子在风中晃动、水面的波动等等,还有照明的变化和天气的变化等都可能影响检测的结果 2帧间差分法 帧间差分法是一种通过对视频图像序列中相邻两帧作差分运算来获得运动目标轮廓的方法,它可以很好地适用于存在多个运动目标和摄像机移动的情况。当监控场景中出现异常物体运动时,帧与帧之间会出现较为明显的差别,两帧相减,得到两帧图像亮度差的绝对值,

帧差法、光流法、背景减除法

帧差法、光流法、背景减除法 运动目标检测是指在序列图像中检测出变化区域并将运动目标从背景图像中提取出来。通常情况下,目标分类、跟踪和行为理解等后处理过程仅仅考虑图像中对应于运动目标的像素区域,因此运动目标的正确检测与分割对于后期处理非常重要然而,由于场景的动态变化,如天气、光照、阴影及杂乱背景干扰等的影响,使得运动目标的检测与分割变得相当困难。根据摄像头是否保持静止,运动检测分为静态背景和运运动目标检测是指在序列图像中检测出变化区域并将运动目标从背景图像中提取出来。通常情况下,目标分类、跟踪和行为理解等后处理过程仅仅考虑图像中对应于运动目标的像素区域,因此运动目标的正确检测与分割对于后期处理非常重要然而,由于场景的动态变化,如天气、光照、阴影及杂乱背景干扰等的影响,使得运动目标的检测与分割变得相当困难。根据摄像头是否保持静止,运动检测分为静态背景和运动背景两类。大多数视频监控系统是摄像头固定的,因此静态背景下运动目标检测算法受到广泛关注,常用的方法有帧差法、光流法、背景减除法等。 (l)帧差法 帧差法是最为常用的运动目标检测和分割方法之一,基本原理就是在图像序列相邻两帧或三帧间采用基于像素的时间差分通过闭值化来提取出图像中的运动区域。首先,将相邻帧图像对应像素值相减得到差分图像,然后对差分图像二值化,在环境亮度变化不大的情况下,如果对应像素值变化小于事先确定的阂值时,可以认为此处为背景像素:如果图像区域的像素值变化很大,可以认为这是由于图像中运动物体引起的,将这些区域标记为前景像素,利用标记的像素区域可以确定运动目标在图像中的位置。由于相邻两帧间的时间间隔非常短,用前一帧图像作为当前帧的背景模型具有较好的实时性,其背景不积累,且更新速度快、算法简单、计算量小。算法的不足在于对环境噪声较为敏感,闽值的选择相当关键,选择过低不足以抑制图像中的噪声,过高则忽略了图像中有用的变化。对于比较大的、颜色一致的运动目标,有可能在目标内部产生空洞,无法完整地提取运动目标。 (2)光流法 光流法的主要任务就是计算光流场,即在适当的平滑性约束条件下,根据图像序列的时空梯度估算运动场,通过分析运动场的变化对运动目标和场景进行检测与分割。通常有基于全局光流场和特征点光流场两种方法。最经典的全局光流场计算方法是L-K(Lueas&Kanada)法和H-S(Hom&Schunck)法,得到全局光流场后通过比较运动目标与背景之间的运动差异对运动目标进行光流分割,缺点是计算量大。特征点光流法通过特征匹配求特征点处的流速,具有计算量小、快速灵活的特点,但稀疏的光流场很难精确地提取运动目标的形状。总的来说,光流法不需要预先知道场景的任何信息,就能够检测到运动对象,可处理背景运动的情况,但噪声、多光源、阴影和遮挡等因素会对光流场分布的计算结果造成严重影响;而且光流法计算复杂,很难实现实时处理。 (3)背景减除法 背景减除法是一种有效的运动对象检测算法,基本思想是利用背景的参数模型来近似背景图像的像素值,将当前帧与背景图像进行差分比较实现对运动区域的检测,其中区别较大的像素区域被认为是运动区域,而区别较小的像素区域被认为是背景区域。背景减除法必须要有背景图像,并且背景图像必须是随着光照或外部环境的变化而实时更新的,因此背景减除法的关键是背景建模及其更新。针对如何建立对于不同场景的动态变化均具有自适应性的背景模型,减少动态场景变化对运动分割的影响,研究人员已提出了许多背景建模算法,但总的来讲可以概括为非回归递推和回归递推两类。非回归背景建模算法是动态的利用从某一时刻开始到当前一段时间内存储的新近观测数据作为样本来进行背景建模。非回归背景建模方法有最简单的帧间差分、中值滤波方法、Toyama等利用缓存的样本像素来估计背景模型

光流法

光流的概念是Gibson在1950年首先提出来的。它是空间运动物体在观察成像平面上的像素运动的瞬时速度,是利用图像序列中像素在时间域上的变化以及相邻帧之间的相关性来找到上一帧跟当前帧之间存在的对应关系,从而计算出相邻帧之间物体的运动信息的一种方法。一般而言,光流是由于场景中前景目标本身的移动、相机的运动,或者两者的共同运动所产生的。其计算方法可以分为三类:(1)基于区域或者基于特征的匹配方法; (2)基于频域的方法; (3)基于梯度的方法; 简单来说,光流是空间运动物体在观测成像平面上的像素运动的“瞬时速度”。光流的研究是利用图像序列中的像素强度数据的时域变化和相关性来确定各自像素位置的“运动”。研究光流场的目的就是为了从图片序列中近似得到不能直接得到的运动场。 光流法的前提假设: (1)相邻帧之间的亮度恒定; (2)相邻视频帧的取帧时间连续,或者,相邻帧之间物体的运动比较“微小”;(3)保持空间一致性;即,同一子图像的像素点具有相同的运动 这里有两个概念需要解释: 运动场,其实就是物体在三维真实世界中的运动; 光流场,是运动场在二维图像平面上的投影。

如上图所示,H中的像素点(x,y)在I中的移动到了(x+u,y+v)的位置,偏移量为(u,v)。 光流法用于目标检测的原理:给图像中的每个像素点赋予一个速度矢量,这样就形成了一个运动矢量场。在某一特定时刻,图像上的点与三维物体上的点一一对应,这种对应关系可以通过投影来计算得到。根据各个像素点的速度矢量特征,可以对图像进行动态分析。如果图像中没有运动目标,则光流矢量在整个图像区域是连续变化的。当图像中有运动物体时,目标和背景存在着相对运动。运动物体所形成的速度矢量必然和背景的速度矢量有所不同,如

光流法

光流法 光流是一种简单实用的图像运动的表达方式,通常定义为一个图像序列中的图像亮度模式的表观运动,即空间物体表面上的点的运动速度在视觉传感器的成像平面上的表达。 中文名:光流法属于:简单实用的图像运动 表示:一种几何变化分为:匹配的方法频域的方法梯度的方法 人类主要通过眼睛,耳朵和大脑来获取、处理与理解获得的信息。然而图像具有最直观、明了、让人一看就懂的特质,因为人们获取信息70%以上依靠视觉,20%左右依靠听觉,10%左右依靠触觉和嗅觉,这就是为什么“百闻不如一见”,一幅图像说明一切问题,胜过千言万语。 计算机视觉这一领域的先驱可追溯到很早的时候,但是直到20世纪70年代后期,当计算机的性能提高到足以处理诸如图像这样的大规模数据时,计算机视觉才得到了正式的关注和发展。计算机视觉就是用各种成象系统代替视觉器官作为输入敏感手段,由计算机来代替大脑完成处理和解释,也包括对视觉信息的采集,传输,处理,存储与理解等过程。计算机视觉最终研究目标就是使计算机能像人那样通过视觉观察和理解世界,具有自主适应环境的能力,要经过长期的努力才能达到的目标。因此,在实现最终目标以前,人们努力的中期目标是建立一种视觉系统,这个系统能依据视觉敏感和反馈的某种程度的智能完成一定的任务。计算机视觉应用领域较广泛,包括航空航天、卫星照片、军事导弹精确制导、移动机器人视觉导航、工业自动化系统、医学辅助诊断等。 计算机视觉系统的结构形式很大程度上依赖于其具体应用方向。有些是独立工作的,用于解决具体的测量或检测问题,也有些作为某个大型复杂系统的组成部分出现,比如工业控制系统,汽车导航系统。计算机视觉系统的具体实现方法同时也由其功能决定,有些是预先固定的,有些是在运行过程中自动学习调整。尽管如此,以下几个功能却几乎是每个计算机系统都需要具备的。 图像获取,一幅数字图像是由一个或多个图像感知器产生的,例如摄像机,红外遥感摄像仪,雷达,超声波接收器等,所产生的图片包括二维图像,三维图像或者一个图像序列。 预处理,在对图像实施具体的计算机视觉方法来提取某种特定的信息前,首先通过一种或一些方法预先对图像进行处理,以满足后继图像处理的要求,包括二次取样,平滑去噪,提高对比度等。 特征提取,是使用计算机提取图像信息,检查每个像素确定该像素是否代表一个特征,例如边缘提取,边角检验,斑点检验。图像分割,对图像进行分割来提取有价值的信息用于后继处理的部分。 光流法的基本原理

光流法OPenCV

/* --Sparse Optical Flow Demo Program-- * Written by David Stavens (david.stavens@https://www.360docs.net/doc/d418436469.html,) */ #include

光流法c++完整代码

光流法是比较经典的运动估计方法,本文不仅叙述简单明了,而且附代码,故收藏. 在空间中,运动可以用运动场描述。而在一个图像平面上,物体的运动往往是通过图像序列中不同图象灰度分布的不同体现的。从而,空间中的运动场转移到图像上就表示为光流场,光流场反映了图像上每一点灰度的变化趋势。 光流可以看作带有灰度的像素点在图像平面运动产生的瞬时速度场。下面我们推导光流方程: 假设E(x,y,t)为(x,y)点在时刻t的灰度(照度)。设t+dt时刻该点运动到(x+dx,y+dy)点,他的照度为 E(x+dx,y+dy,t+dt)。我们认为,由于对应同一个点,所以 E(x,y,t) = E(x+dx,y+dy,t+dt) ——光流约束方程 将上式右边做泰勒展开,并令dt->0,则得到:Exu+Eyv+Et = 0,其中: Ex = dE/dx Ey = dE/dy Et = dE/dt u = dx/dt v = dy/dt 上面的Ex,Ey,Et的计算都很简单,用离散的差分代替导数就可以了。光流法的主要任务就是通过求解光流约束方程求出u,v。但是由于只有一个方程,所以这是个病态问题。所以人们提出了各种其他的约束方程以联立求解。但是由于我们用于摄像机固定的这一特定情况,所以问题可以大大简化。 摄像机固定的情形 在摄像机固定的情形下,运动物体的检测其实就是分离前景和背景的问题。我们知道对于背景,理想情况下,其光流应当为0,只有前景才有光流。所以我们并不要求通过求解光流约束方程求出u,v。我么只要求出亮度梯度方向的速率就可以了,即求出sqrt(u*u+v*v)。 而由光流约束方程可以很容易求到梯度方向的光流速率为V = abs(Et/sqrt(Ex*Ex+Ey*Ey))。这样我们设定一个阈值T。 V(x,y) > T 则(x,y)是前景,反之是背景 C++实现 在实现摄像机固定情况的光流法时,需要有两帧连续的图像,下面的算法针对RGB24格式的图像计算光流: void calculate(unsigned char* buf) { int Ex,Ey,Et; int gray1,gray2; int u; int i,j; memset(opticalflow,0,width*height*sizeof(int)); memset(output,255,size); for(i=2;i 光流法基本原理 从二维图像序列中检测物体的运动、提取运动参数并且分析物体运动的相关规律是运动图像序列分析的主要研究内容。光流法是进行运动图像分析的重要方法,在视觉运动研究中具有举足轻重的作用。 光流(optical flow )表达了图像的变化,由于它包含了图像的运动信息,因此可被观察者用来确定目标的运动情况[32]。如图3-8所示,光流是图像中亮度图案的表观运动,而运动场是三维物体的实际运动在图像平面上的投影,在理想情况下二者相互吻合[33]。 光流场可以简单的理解为物体的速度矢量场,包含两个分量(,)u v 。假设相邻两帧图像之间的时间间隔很小,而且图像的灰度变化很小时,可以推导出基本的光流约束方程[34]: 0x y t I u I v I ++= (3-3) 其中,dx u dt = ,dy v dt =分别是该点的光流沿,x y 方向上的分量;(,)I x y 是像素点(,)x y 在时刻 t 的灰度值,x I I x ?= ?,y I I y ?=?,t I I t ?=?分别是灰度值I 对x 、y 和t 的偏导数,可从图像序列中直接估计出来[35]: 1,,1,,11,1,1,1,1,,,,1,1,,1,11[()()]4x i j k i j k i j k i j k i j k i j k i j k i j k I I I I I I I I I x ++++++++++++=+++-+++? (3-4) 1,,,1,11,1,1,1,1,,,,11,,1,,11 [()()]4y i j k i j k i j k i j k i j k i j k i j k i j k I I I I I I I I I y ++++++++++++=+++-+++? (3-5) ,1,,1,11,,11,1,1,,,1,1,,1,1,1 [()()]4t i j k i j k i j k i j k i j k i j k i j k i j k I I I I I I I I I t ++++++++++++= +++-+++? (3-6) 光流约束方程与u 和v 呈线性关系,如图3-9所示,把以u 和v 为横、纵轴的二维空间称为速度空间,则该方程定义了一条直线,且此直线与图像点灰度的空间梯度I ?垂直。所有满足约束方程的(,)u v 值都位于此直线上,但局部的测量无法识别实际的光流(,)u v 位于约束线上的哪一点,因此仅可确定光流在梯度方向上的分量⊥V : 2/122) (y x t t I I I I I V +-=?- =⊥ (3-7) 却无法确定光流在与梯度垂直方向(即沿等亮度线)上的分量。因此,只使用一点信息是不能完全确定光流的,这种不确定问题就是孔径问题(aperture problem )[36]。 Journal of Image and Signal Processing 图像与信号处理, 2016, 5(2), 66-72 Published Online April 2016 in Hans. https://www.360docs.net/doc/d418436469.html,/journal/jisp https://www.360docs.net/doc/d418436469.html,/10.12677/jisp.2016.52009 Visual Obstacle Avoidance System Based on Optical Flow Method Hongyan Huang, Siwen Gao, Yanmei Yu*, Xiaohai He Institute of Image Information, College of Electronics and Information Engineering, Sichuan University, Chengdu Sichuan Received: Apr. 2nd, 2016; accepted: Apr. 16th, 2016; published: Apr. 21st, 2016 Copyright ? 2016 by authors and Hans Publishers Inc. This work is licensed under the Creative Commons Attribution International License (CC BY). https://www.360docs.net/doc/d418436469.html,/licenses/by/4.0/ Abstract To solve the problems of effective orientation and obstacle recognition in autonomous flight of Unmanned Aerial Vehicles, this essay has studied the visual obstacle avoidance principle based on Pyramid LK optical flow and the obstacle detection method as well as the relevant obstacle avoid-ance strategy with the foundation of optical flow. Combining with the 320 × 240 pixle camera- equipped visual module and high-performance embedded computing platform, we constitute a complete real-time visual obstacle avoidance system. Experiments show that the proposed algo-rithm can recognize obstacle well and react with relevant obstacle avoidance action, which has good real-time and robustness features. Keywords Unmanned Aerial Vehicles, Optical Flow Method, Pyramid LK Algorithm, Visual Obstacle Avoidance 基于光流法的视觉避障系统研究 黄宏燕,高斯文,余艳梅*,何小海 四川大学电子信息学院,图像信息研究所,四川成都 收稿日期:2016年4月2日;录用日期:2016年4月16日;发布日期:2016年4月21日 *通讯作者。 光流场可以简单的理解为物体的速度矢量场,包括两个分量u,v 。设平面上有一点(x ,y ),他它代表的是场景中某一点(x,y,z )在图像平面上的投影,该点在时刻t 的灰度值为I(x,y,t)。假定该点在t +△t)时运动到(x+△x,y+△y ),在很短的时间间隔△t 内灰度值保持不变,即: I(x+u △t,y+v △t,t+△t)=I(x,y,t) 式中,u,v 分别是该点的光流的x,y 方向上的分量。 假设亮度I (x,y)随时间t 平滑变化,可以将上式按泰勒公式展开,得到: ) ,,(),,(t y x I e t I t y I y x I x t y x I =+???+???+???+ 其中e 包括△x ,△y ,△t 的二次以上的项,上式消去I(x,y,t),用△t 除等式两边,并取△t →0的极限后,可求得: =??+??+??t I dt dy y I dt dx x I 此式实际上是0 dt dI =的展开式,可以用下边形式简写: =++t y x I v I u I 其中, dt dx u = , dt dy v = , x I I x ??= , y I I y ??= , t I I t ??= 这就是光流约束方程,I 代表的是像素点(x,y)在时刻t 的灰度值,x I I x ??= , y I I y ??= , t I I t ??= 分别对I 求偏导数,他们可以直接从图像中估计出来。 ) ()[(411,1,,1,1,,,,1,1,1,1,11,,1,,1+++++++++++++++-+++?= k j i k j i k j i k j i k j i k j i k j i k j i x I I I I I I I I x I )] ()[(411,,1,,11,,,,1,1,1,1,11,1,,1,+++++++++++++++-+++?= k j i k j i k j i k j i k j i k j i k j i k j i I I I I I I I I y Iy )] ()[(t 41,1,1,,1,1,,,1,1,11,,11,1,,1,t k j i k j i k j i k j i k j i k j i k j i k j i I I I I I I I I I +++++++++++++++-+++?= 也就是说每个像素处的偏导数都是已知的。 而光流有两个分量u,v ,但是方程 =++t y x I v I u I 只有一个,一个方程,两个未知数,无 法求得u,v 。因此需要另外的约束条件。 为了求得u,v ,我们认定在图像平面内足够小的区域ROI 内,而且在足够短的时间间隔内,两帧图像间的运动可以近似为线性的,即 x V u =, y V v = 也就是认定在ROI 区域内的N 个像素点的速度是相同的,而且这N 个点的速度都为 X V 和 y V 。将其带入 =++t y x I v I u I 得 基于前—后向光流点匹配运动熵的视频抖动检测算法 1问题描述 本文主要研究的是视频监控诊断系统中的视频画面抖动检测问题。正常情况下,运动图像序列的连续多帧之间过渡是平滑的,画面相关性比较连续,但是如果它们之间的相关性出现大波动,视频就会出现抖动的情况。在视频监控中,摄像头一般都是固定在某个位置,因此造成视频画面抖动现象的原因主要有: 1)摄像头受到环境的干扰( 比如强风) 发生有规律的摆动从而造成图像的上下或左右抖动; 2) 摄像头正在被人移动,造成画面抖动。任何一种情况,都会导致画面出现周期性振颤或不规则扭曲,都意味着摄像头工作出现了异常。 2问题分析 常见的运动参数估计算法主要有灰度投影法、块匹配法、特征点匹配和光流法。针对视频监控画面抖动检测问题,本文提出一种实时有效、具有较高精度的检测算法。算法采用稀疏型的光流特征和ORB 特征点匹配相融合的策略,采用前向—后向误差作为检验标准过滤错误匹配的光流点,然后根据正确匹配的点集合估计视频帧之间的全局运动方向和幅度等参数。在一个时间段内,利用运动熵衡量连续帧的运动混乱程度,判断视频画面是否发生抖动异常现象。 本文针对视频质量诊断的抖动异常检测问题:1)提出融合光流点与特征点匹配,利用前-后向误差的方式验证并获取有效匹配点集的策略,可以缓解大位移抖动的影响,增强匹配点的可靠性;2)引入运动熵衡量连续帧间运动一致性程度,用于判断是否发生抖动,方法简单有效,实际可操作性比较好。最后面向实际应用,搜集了各种在实际中发生抖动异常的视频监控录像数据,在数据集上测试了本文算法的 性能,并进行了比较。实验证明,本文算法达到了实时性要求,具备较高的检测精度,能够满足现实监控系统视频质量诊断的工作要求。 3算法描述 视频发生抖动,意味着整个画面都将发生运动,同一帧画面上的点总体运动趋势保持一致。基于这个假设前提,可以通过计算画面的全局运动参数来估计画面的整体运动情况。鉴于光流特征能够较好地反映视频画面丰富的运动信息,特征点匹配对于环境适应性较好,本文提出将稀疏型光流特征与特征点匹配相融合的策略用于估计运动过程参数,有效互补它们各自的优点。 在视频的整个画面空间上进行快速Harris 角点检测,将画面均匀划分成若干栅格区域( 如3* 3的划分),然后在每个栅格区域随机选取若干个角点,形成均匀分布于画面空间的角点点集,计算它们的光流特征。由于采样的点数远小于图像的像素个数,其稀疏型光流特征的计算量将大大降低。根据光流特征,可以粗略估计当前点在下一帧的大致位置。为了避免光流受大位移抖动的影响,减少匹配误差,算法在光流点估计位置的局部邻域范围内进行特征点匹配,一方面可以利用特征点匹配的良好适应性,同时可以避免特征点全局画面匹配的计算量。最后算法根据前-后向误差的标准,选取更为可靠的匹配点对估计全局运动参数。光流法原理详细

基于光流法的视觉避障系统研究

光流法原理

光流法