应用回归分析_第3章课后习题参考答案

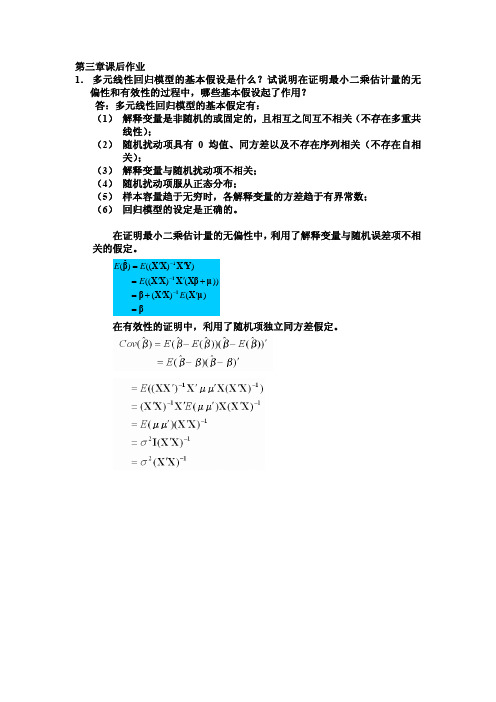

第三章课后作业

(2) ˆ0 = Y − α ˆ1 X 1 − α ˆ 2 X 2 = (Y − X 1 ) − (α ˆ1 − 1) X 1 − α ˆ2 X 2 α ˆ X −β ˆ X = (Y − X ) − β

1 1 1 2 2

ˆ =β

0

证毕。

(3)设: Z i = Yi − X 1i (a)式的拟合优度为:

2 i 3i 2 3i

2 i 3i 2 3i

2 i 3i 2 3i

ˆ1 − 1 =α & & (y & −x & ) ∑x ∑x & x & & (y & −x & ) x ∑x ˆ = ∑ β & & x & ∑x ∑x & x & & ∑x ∑x & & y & & & ∑x ∑x ∑x ∑x & x & & y & & x & & x & ∑x ∑x ∑x ∑x = − & & x & & & x & ∑x ∑x ∑x ∑x & x & & & x & & ∑x ∑x ∑x ∑x

证明: 根据 OLS 估计原理依次求解上述待估参数可证明。 或

ˆi 为: 由回归方程(2)可得残差ν ˆ0 − α ˆ1 X 2i ,将其带入回归方程(3)可得: νˆi = X 1i − α ˆ0 − α ˆ1 X 2i ) + γ 2 X 2i + wi Yi = γ 0 + γ 1 ( X 1i − α ˆ 0 ) + γ 1 X 1i + (γ 2 − γ 1α ˆ1 ) X 2i + wi = (γ 0 − γ 1α

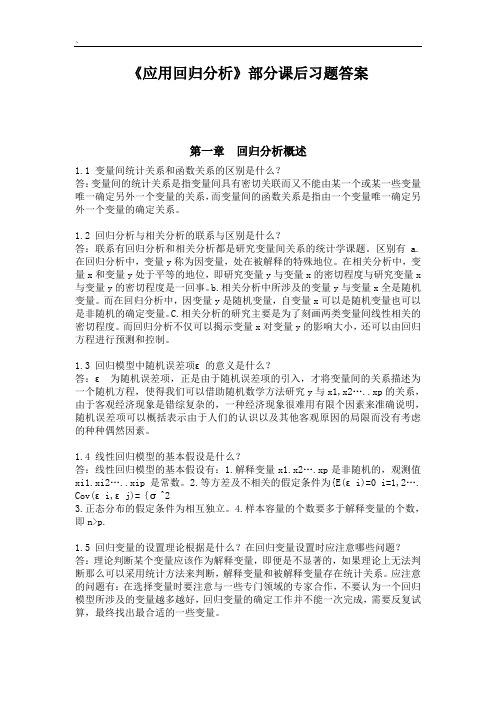

《应用回归分析》部分课后习题答案-何晓群版

《应用回归分析》部分课后习题答案第一章回归分析概述1.1 变量间统计关系和函数关系的区别是什么?答:变量间的统计关系是指变量间具有密切关联而又不能由某一个或某一些变量唯一确定另外一个变量的关系,而变量间的函数关系是指由一个变量唯一确定另外一个变量的确定关系。

1.2 回归分析与相关分析的联系与区别是什么?答:联系有回归分析和相关分析都是研究变量间关系的统计学课题。

区别有 a.在回归分析中,变量y称为因变量,处在被解释的特殊地位。

在相关分析中,变量x和变量y处于平等的地位,即研究变量y与变量x的密切程度与研究变量x与变量y的密切程度是一回事。

b.相关分析中所涉及的变量y与变量x全是随机变量。

而在回归分析中,因变量y是随机变量,自变量x可以是随机变量也可以是非随机的确定变量。

C.相关分析的研究主要是为了刻画两类变量间线性相关的密切程度。

而回归分析不仅可以揭示变量x对变量y的影响大小,还可以由回归方程进行预测和控制。

1.3 回归模型中随机误差项ε的意义是什么?答:ε为随机误差项,正是由于随机误差项的引入,才将变量间的关系描述为一个随机方程,使得我们可以借助随机数学方法研究y与x1,x2…..xp的关系,由于客观经济现象是错综复杂的,一种经济现象很难用有限个因素来准确说明,随机误差项可以概括表示由于人们的认识以及其他客观原因的局限而没有考虑的种种偶然因素。

1.4 线性回归模型的基本假设是什么?答:线性回归模型的基本假设有:1.解释变量x1.x2….xp是非随机的,观测值xi1.xi2…..xip是常数。

2.等方差及不相关的假定条件为{E(εi)=0 i=1,2…. Cov(εi,εj)={σ^23.正态分布的假定条件为相互独立。

4.样本容量的个数要多于解释变量的个数,即n>p.1.5 回归变量的设置理论根据是什么?在回归变量设置时应注意哪些问题?答:理论判断某个变量应该作为解释变量,即便是不显著的,如果理论上无法判断那么可以采用统计方法来判断,解释变量和被解释变量存在统计关系。

应用回归分析课后习题

使用其中的一个。

2.12* 如果把自变量观测值都乘以 2,回归参数的最小二乘估计 ˆ0 和 ˆ1 会发生什么变化?

#;

.

如果把自变量观测值都加上 2,回归参数的最小二乘估计 ˆ0 和 ˆ1 会发生什么变化?

2.13 如果回归方程 yˆ ˆ0 ˆ1x 相应的相关系数 r 很大,则用它预测时,预测误差一定较小。

#;

.

第三章 习题

3.1 写出多元线性回归模型的矩阵表示形式,并给出多元线性回归模型的基本假设。 3.2 讨论样本量 n 与自变量个数 p 的关系,它们对模型的参数估计有何影响?

3.3 证明ˆ 2 1 SSE 是误差项方差 2 的无偏估计。 n p 1

3.4 一个回归方程的复相关系数 R=0.99,样本决定系数 R2 0.9801 ,我们能判断这个回归

2.15 一家保险公司十分关心其总公司营业部加班的程度,决定认真调查一下现状。经过 10

周时间,收集了每周加班工作时间的数据和签发的新保单数目,x 为每周签发的新保单数目,

y 为每周加班工作时间(小时)。见表

周序 1

2

3

4

5

6

7

8

9

10

号

X

825 215 1070 550 480 920 1350 325 670 1215

【分析】应用回归分析课后习题参考答案全部版何晓群刘文卿

【关键字】分析第一章回归分析概述1.2 返回分析与相关分析的联系与区别是什么?答:联系有返回分析和相关分析都是研究变量间关系的统计学课题。

区别有a.在返回分析中,变量y称为因变量,处在被解释的特殊地位。

在相关分析中,变量x和变量y处于平等的地位,即研究变量y与变量x的密切程度与研究变量x与变量y的密切程度是一回事。

b.相关分析中所涉及的变量y与变量x全是随机变量。

而在返回分析中,因变量y是随机变量,自变量x可以是随机变量也可以是非随机的确定变量。

C.相关分析的研究主要是为了刻画两类变量间线性相关的密切程度。

而返回分析不仅可以揭示变量x对变量y的影响大小,还可以由返回方程进行预测和控制。

1.3 返回模型中随机误差项ε的意义是什么?答:ε为随机误差项,正是由于随机误差项的引入,才将变量间的关系描述为一个随机方程,使得我们可以借助随机数学方法研究y与x1,x2…..xp的关系,由于客观经济现象是错综复杂的,一种经济现象很难用有限个因素来准确说明,随机误差项可以概括表示由于人们的认识以及其他客观原因的局限而没有考虑的种种偶然因素。

1.4 线性返回模型的基本假设是什么?答:线性返回模型的基本假设有:1.解释变量x1.x2….xp是非随机的,观测值xi1.xi2…..xip 是常数。

2.等方差及不相关的假定条件为{E(εi)=0 i=1,2…. Cov(εi,εj)={σ^23.正态分布的假定条件为相互独立。

4.样本容量的个数要多于解释变量的个数,即n>p.第二章一元线性返回分析思考与练习参考答案2.1 一元线性返回有哪些基本假定?答:假设1、解释变量X是确定性变量,Y是随机变量;假设2、随机误差项ε具有零均值、同方差和不序列相关性:E(εi)=0 i=1,2, …,nVar (εi)= 2 i=1,2, …,nCov(εi, εj)=0 i≠j i,j= 1,2, …,n假设3、随机误差项ε与解释变量X之间不相关:Cov(Xi, εi)=0 i=1,2, …,n假设4、ε服从零均值、同方差、零协方差的正态分布εi~N(0, 2 ) i=1,2, …,n2.3 证明(2.27式),ei =0 ,eiXi=0 。

应用回归分析课后答案

应用回归分析课后答案第二章一元线性回归2.14 解答:EXCEL结果:SUMMARY OUTPUT回归统计Multiple R0.944911R Square0.892857Adjusted R Square0.857143标准误差0.597614观测值5方差分析df SS MS F Significance F回归分析18.9285718.928571250.015392残差3 1.0714290.357143总计410Coefficients标准误差t Stat P-value Lower 95%Upper 95%下限95.0%上限95.0% Intercept-0.214290.6962-0.307790.778371-2.4299 2.001332-2.4299 2.001332 X Variable 10.1785710.03571450.0153920.0649130.292230.0649130.29223RESIDUAL OUTPUT观测值预测Y残差1 1.571429-0.571432 1.5714290.4285713 3.357143-0.357144 3.3571430.6428575 5.142857-0.14286SPSS结果:(1)散点图为:(2)x 与y 之间大致呈线性关系。

(3)设回归方程为01y x ββ∧∧∧=+1β∧=12217()ni ii nii x y n x yxn x --=-=-=-∑∑0120731y x ββ-∧-=-=-⨯=-17y x ∧∴=-+可得回归方程为(4)22ni=11()n-2i i y y σ∧∧=-∑ 2n 01i=11(())n-2i y x ββ∧∧=-+∑=2222213⎡⎤⨯+⨯+⨯⎢⎥+⨯+⨯⎣⎦(10-(-1+71))(10-(-1+72))(20-(-1+73))(20-(-1+74))(40-(-1+75)) []1169049363110/3=++++=1330 6.13σ∧=≈ (5)由于211(,)xxN L σββ∧1112()/xxxxL t L ββσσ∧∧-==服从自由度为n-2的t 分布。

《应用回归分析》课后题答案

、《应用回归分析》部分课后习题答案第一章回归分析概述1.1 变量间统计关系和函数关系的区别是什么?答:变量间的统计关系是指变量间具有密切关联而又不能由某一个或某一些变量唯一确定另外一个变量的关系,而变量间的函数关系是指由一个变量唯一确定另外一个变量的确定关系。

1.2 回归分析与相关分析的联系与区别是什么?答:联系有回归分析和相关分析都是研究变量间关系的统计学课题。

区别有a.在回归分析中,变量y称为因变量,处在被解释的特殊地位。

在相关分析中,变量x和变量y处于平等的地位,即研究变量y与变量x的密切程度与研究变量x 与变量y的密切程度是一回事。

b.相关分析中所涉及的变量y与变量x全是随机变量。

而在回归分析中,因变量y是随机变量,自变量x可以是随机变量也可以是非随机的确定变量。

C.相关分析的研究主要是为了刻画两类变量间线性相关的密切程度。

而回归分析不仅可以揭示变量x对变量y的影响大小,还可以由回归方程进行预测和控制。

1.3 回归模型中随机误差项ε的意义是什么?答:ε为随机误差项,正是由于随机误差项的引入,才将变量间的关系描述为一个随机方程,使得我们可以借助随机数学方法研究y与x1,x2…..xp的关系,由于客观经济现象是错综复杂的,一种经济现象很难用有限个因素来准确说明,随机误差项可以概括表示由于人们的认识以及其他客观原因的局限而没有考虑的种种偶然因素。

1.4 线性回归模型的基本假设是什么?答:线性回归模型的基本假设有:1.解释变量x1.x2….xp是非随机的,观测值xi1.xi2…..xip是常数。

2.等方差及不相关的假定条件为{E(εi)=0 i=1,2…. Cov(εi,εj)={σ^23.正态分布的假定条件为相互独立。

4.样本容量的个数要多于解释变量的个数,即n>p.1.5 回归变量的设置理论根据是什么?在回归变量设置时应注意哪些问题?答:理论判断某个变量应该作为解释变量,即便是不显著的,如果理论上无法判断那么可以采用统计方法来判断,解释变量和被解释变量存在统计关系。

《应用回归分析》课后题答案要点

《应用回归分析》部分课后习题答案第一章回归分析概述1.1 变量间统计关系和函数关系的区别是什么?答:变量间的统计关系是指变量间具有密切关联而又不能由某一个或某一些变量唯一确定另外一个变量的关系,而变量间的函数关系是指由一个变量唯一确定另外一个变量的确定关系。

1.2 回归分析与相关分析的联系与区别是什么?答:联系有回归分析和相关分析都是研究变量间关系的统计学课题。

区别有 a.在回归分析中,变量y称为因变量,处在被解释的特殊地位。

在相关分析中,变量x和变量y处于平等的地位,即研究变量y与变量x的密切程度与研究变量x与变量y的密切程度是一回事。

b.相关分析中所涉及的变量y与变量x全是随机变量。

而在回归分析中,因变量y是随机变量,自变量x可以是随机变量也可以是非随机的确定变量。

C.相关分析的研究主要是为了刻画两类变量间线性相关的密切程度。

而回归分析不仅可以揭示变量x对变量y的影响大小,还可以由回归方程进行预测和控制。

1.3 回归模型中随机误差项ε的意义是什么?答:ε为随机误差项,正是由于随机误差项的引入,才将变量间的关系描述为一个随机方程,使得我们可以借助随机数学方法研究y与x1,x2…..xp的关系,由于客观经济现象是错综复杂的,一种经济现象很难用有限个因素来准确说明,随机误差项可以概括表示由于人们的认识以及其他客观原因的局限而没有考虑的种种偶然因素。

1.4 线性回归模型的基本假设是什么?答:线性回归模型的基本假设有:1.解释变量x1.x2….xp是非随机的,观测值xi1.xi2…..xip是常数。

2.等方差及不相关的假定条件为{E(εi)=0 i=1,2…. Cov(εi,εj)={σ^23.正态分布的假定条件为相互独立。

4.样本容量的个数要多于解释变量的个数,即n>p.1.5 回归变量的设置理论根据是什么?在回归变量设置时应注意哪些问题?答:理论判断某个变量应该作为解释变量,即便是不显著的,如果理论上无法判断那么可以采用统计方法来判断,解释变量和被解释变量存在统计关系。

应用回归分析,第3章课后习题参考答案

第3章 多元线性回归思考与练习参考答案3.2 讨论样本容量n 与自变量个数p 的关系,它们对模型的参数估计有何影响?答:在多元线性回归模型中,样本容量n 与自变量个数p 的关系是:n>>p 。

如果n<=p 对模型的参数估计会带来很严重的影响。

因为: 1. 在多元线性回归模型中,有p+1个待估参数β,所以样本容量的个数应该大于解释变量的个数,否则参数无法估计。

2. 解释变量X 是确定性变量,要求()1rank p n =+<X ,表明设计矩阵X 中的自变量列之间不相关,即矩阵X 是一个满秩矩阵。

若()1rank p <+X ,则解释变量之间线性相关,1()X X -'是奇异阵,则β的估计不稳定。

3.3证明随机误差项ε的方差σ2的无偏估计。

证明:22122222111112221111ˆ(),111()()(1)(1)()(1)1ˆ()()1n i i n n nnnii ii iiii i i i i i ni i SSE e e e n p n p n p E e D e h h n h n p E E e n p σσσσσσσ======='===------∴==-=-=-=--∴==--∑∑∑∑∑∑∑3.4 一个回归方程的复相关系数R=0.99,样本决定系数R 2=0.9801,我们能判断这个回归方程就很理想吗? 答:不能断定这个回归方程理想。

因为:1. 在样本容量较少,变量个数较大时,决定系数的值容易接近1,而此时可能F 检验或者关于回归系数的t 检验,所建立的回归方()1ˆ2--=p n SSE σ程都没能通过。

2. 样本决定系数和复相关系数接近于1只能说明Y 与自变量X1,X2,…,Xp 整体上的线性关系成立,而不能判断回归方程和每个自变量是显著的,还需进行F 检验和t 检验。

3. 在应用过程中发现,在样本容量一定的情况下,如果在模型中增加解释变量必定使得自由度减少,使得 R 2往往增大,因此增加解释变量(尤其是不显著的解释变量)个数引起的R 2的增大与拟合好坏无关。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

第3章 多元线性回归

思考与练习参考答案

见教材P64-65

讨论样本容量n 与自变量个数p 的关系,它们对模型的参数估计有何影响?

答:在多元线性回归模型中,样本容量n 与自变量个数p 的关系是:n>>p 。

如果n<=p 对模型的参数估计会带来很严重的影响。

因为: 1. 在多元线性回归模型中,有p+1个待估参数β,所以样本容量的个数应该大于解释变量的个数,否则参数无法估计。

2. 解释变量X 是确定性变量,要求()1rank p n =+<X ,表明设计矩阵X 中的自变量列之间不相关,即矩阵X 是一个满秩矩阵。

若

()1rank p <+X ,则解释变量之间线性相关,1()X X -'是奇异阵,则β

的估计不稳定。

证明 随机误差项ε的方差2

的无偏估计。

证明:

2

21

2

2

2

2

21

1

1

1

1

2

22

1

111

ˆ(),111()()(1)(1)()(1)1

ˆ()()1n

i i n n n

n

n

i

i ii ii

ii i i i i i n

i i SSE e e e n p n p n p E e D e h h n h n p E E e n p σσσ

σ

σσσ======='===------∴==-=-=-=--∴==--∑∑∑∑∑∑∑Q

一个回归方程的复相关系数R=,样本决定系数R 2

=,我们能断定这个回归方程就很理想吗?

答:不能。

复相关系数R 与样本决定系R 2

数都是用来表示回归方程对原始数据拟合程度的好坏。

样本决定系数取值在【0,1】区间内,

一般来说,R2越接近1,即R2取值越大,说明回归拟合的效果越好。

但由于R2的大小与样本容量n和自变量个数p有关,当n与p的值接近时,R2容易接近1,说明R2中隐含着一些虚假成分。

而当样本容量n较小,自变量个数p较大时,尽管R2很大,但参数估计效果很不稳定。

所以该题中不能仅仅因为R2很大而断定回归方程很理想。

如何正确理解回归方程显著性检验拒绝H0,接受H0?

答:一般来说,当接受假设H0时,认为在给定的显著性水平α之下,自变量x1,x2,…,x p对因变量y无显著性影响,则通过x1,x2,…,x p 去推断y就无多大意义。

此时,一方面可能该问题本应该用非线性模型描述,我们误用线性模型描述了,使得自变量对因变量无显著影响;另一方面可能是在考虑自变量时,由于认识上的局限性把一些影响因变量y的自变量漏掉了,这就从两个方面提醒我们去重新考虑建模问题。

当拒绝H0时,也不能过于相信该检验,认为该模型已经很完美。

其实当拒绝H时,我们只能认为该回归模型在一定程度上说明了自变量x1,x2,…,x p与因变量y的线性关系。

因为这时仍不能排除我们漏掉了一些重要自变量。

此检验只能用于辅助性的,事后验证性的目的。

(详细内容可参考课本P95~P96评注。

)

数据中心化和标准化在回归分析中的意义是什么?

答:原始数据由于自变量的单位往往不同,会给分析带来一定的困难;又由于设计的数据量较大,可能会以为舍入误差而使得计算结果并不理想。

中心化和标准化回归系数有利于消除由于量纲不同、数量级不

同带来的影响,避免不必要的误差。

验证ˆˆ,1,2,,j

j

j p ββ*==L 证明:多元线性回归方程模型的一般形式为:

01122p p y x x x ββββε

=+++++L

其经验回归方程式为

01122ˆˆˆˆˆp p

y x x x ββββ=++++L ,

又01122ˆˆˆˆp p

y x x x ββββ=----L , 故111222ˆˆˆˆ()()()p p p

y y x x x x x x βββ=+-+-++-L , 中心化后,则有111222ˆˆˆˆ()()()i p p p

y y x x x x x x βββ-=-+-++-L ,

=

令21

(),1,2,,n

jj ij j i L x x i n ==-=∑L ,1,2,,j p =L

12()ˆˆˆp x x y x x βββ-=++L 样本数据标准化的公式为

1,2,,ij i x x y x y i n **-=

=

=L ,1,2,,j p =L

则上式可以记为

1

1

2

2

1122ˆˆˆˆˆˆi i i p

ip

i i p ip

y x x x x x x ββββββ*

*

*

*******=+++=⨯+⨯++⨯L L

则有

ˆˆ,1,2,,j

j

j p β*==L 验证

验证决定系数R 2与F 值之间的关系式:p

p n F F

R /)1(2--+=

验证决定系数R 2与F 值之间的关系式:p

p n F F

R /)1(2--+=

证明:

2/,

/(1)1

1

1(1)/1

SSR p

F SSE n p F SSE

SSR p

n p F SSE

p

SSR SSR F p F n p R F SSE SST SSR SSE F p n p F n p p

p SSE n p =

--⋅∴=⨯--⋅⨯⨯--∴=====

⋅+⨯+--+--⨯+--Q。