牛人写的神经网络通俗易懂的解释

神经网络基本知识

神经网络基本知识一、内容简述神经网络是机器学习的一个重要分支,是一种模拟生物神经网络结构和功能的计算模型。

它以其强大的学习能力和自适应能力广泛应用于多个领域,如图像识别、语音识别、自然语言处理等。

《神经网络基本知识》这篇文章将带领读者了解神经网络的基本概念、原理和应用。

1. 神经网络概述神经网络是一种模拟生物神经系统结构和功能的计算模型。

它由大量神经元相互连接构成,通过学习和调整神经元之间的连接权重来进行数据处理和模式识别。

神经网络的概念自上世纪五十年代提出以来,经历了漫长的发展历程,逐渐从简单的线性模型演变为复杂的多层非线性结构。

神经网络在人工智能领域发挥着核心作用,广泛应用于计算机视觉、语音识别、自然语言处理等领域。

神经网络的基本构成单元是神经元,每个神经元接收来自其他神经元的输入信号,通过特定的计算方式产生输出信号,并传递给其他神经元。

不同神经元之间的连接强度称为权重,通过训练过程不断调整和优化。

神经网络的训练过程主要是通过反向传播算法来实现的,通过计算输出层误差并反向传播到输入层,不断调整权重以减小误差。

神经网络具有强大的自适应能力和学习能力,能够处理复杂的模式识别和预测任务。

与传统的计算机程序相比,神经网络通过学习大量数据中的规律和特征,自动提取高级特征表示,避免了手动设计和选择特征的繁琐过程。

随着深度学习和大数据技术的不断发展,神经网络的应用前景将更加广阔。

神经网络是一种模拟生物神经系统功能的计算模型,通过学习和调整神经元之间的连接权重来进行数据处理和模式识别。

它在人工智能领域的应用已经取得了巨大的成功,并将在未来继续发挥重要作用。

2. 神经网络的历史背景与发展神经网络的历史可以追溯到上个世纪。

最初的神经网络概念起源于仿生学,模拟生物神经网络的结构和功能。

早期的神经网络研究主要集中在模式识别和机器学习的应用上。

随着计算机科学的快速发展,神经网络逐渐成为一个独立的研究领域。

在20世纪80年代和90年代,随着反向传播算法和卷积神经网络的提出,神经网络的性能得到了显著提升。

什么是神经网络

什么是神经网络古老的东西没有任何的设计思想可言,然而,随着科学和技术的发展,人类已经可以站在宇宙的设计师的角度去设计思惙,神经网络正是其中最有成效的例子。

神经网络十分广泛地应用于人工智能,它能够通过分析大量数据,产生出超过人类智能的结果。

本文旨在介绍神经网络,以便大家轻松入门并最终掌握这门学科。

一、概念介绍神经网络是一种人工模拟生物神经网络的技术。

它由许多神经元组成,从而建模和模仿人的中控脑的神经架构,从而实现复杂的计算功能。

它可以执行大量分析和计算,学习输入和输出的联系,并通过学习输出受控制。

二、神经网络应用1、大数据领域应用:神经网络是大数据分析的有力工具,可用于模仿真实生态系统中的自然过程,并以真实细节达到预期的准确性。

2、语言和视觉领域应用:语言神经网络可以准确地理解微观语言结构,从而能够精准地解析语义关系,从而完成宝贵的文本分析任务,如机器翻译、文本理解等。

视觉神经网络可以准确识别形态,并帮助自动驾驶或机器视觉检测和检测任务。

3、自然语言处理领域应用:神经网络技术可以帮助机器迅速理解非结构化的自然语言内容,增强其理解能力,从而完成大量具有挑战性的自然语言处理任务。

三、构成神经网络神经网络由三个基本元素构成:1、输入层:神经网络的输入层由输入的信号和数据节点组成,每一个节点就是一个输入信号。

2、隐藏层:隐藏层是神经网络复杂性的核心,是把输入和输出两层之间的桥梁,它可以有几个甚至数十个神经元组成,它分析输入数据和反馈信息,最终产生输出结果。

3、输出层:输出层可以是一个或几层神经元,它根据网络计算出来的结果和反馈信息,产生最终的输出结果。

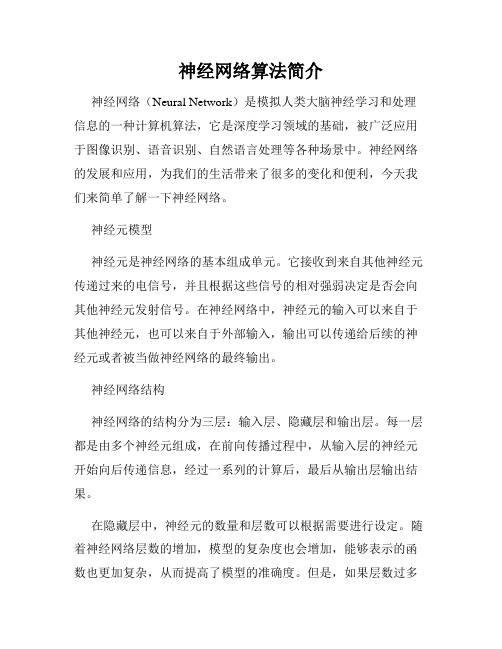

神经网络算法简介

神经网络算法简介神经网络(Neural Network)是模拟人类大脑神经学习和处理信息的一种计算机算法,它是深度学习领域的基础,被广泛应用于图像识别、语音识别、自然语言处理等各种场景中。

神经网络的发展和应用,为我们的生活带来了很多的变化和便利,今天我们来简单了解一下神经网络。

神经元模型神经元是神经网络的基本组成单元。

它接收到来自其他神经元传递过来的电信号,并且根据这些信号的相对强弱决定是否会向其他神经元发射信号。

在神经网络中,神经元的输入可以来自于其他神经元,也可以来自于外部输入,输出可以传递给后续的神经元或者被当做神经网络的最终输出。

神经网络结构神经网络的结构分为三层:输入层、隐藏层和输出层。

每一层都是由多个神经元组成,在前向传播过程中,从输入层的神经元开始向后传递信息,经过一系列的计算后,最后从输出层输出结果。

在隐藏层中,神经元的数量和层数可以根据需要进行设定。

随着神经网络层数的增加,模型的复杂度也会增加,能够表示的函数也更加复杂,从而提高了模型的准确度。

但是,如果层数过多或者神经元数量过多,就会导致模型出现过拟合的现象,出现这种情况时,就需要对模型进行优化调整。

神经网络的训练神经网络的训练需要大量的数据来进行模型的调整和学习,训练数据可以分为训练集、验证集和测试集三个部分。

其中,训练集用来训练模型,验证集用来验证模型的准确度,在训练过程中,如果出现了过拟合的现象,就需要通过验证集的误差来进行模型的调整。

最后,测试集是用来测试最终的模型精度的数据集。

神经网络的训练过程通常采用反向传播算法(Backpropagation Algorithm)。

它通过计算损失函数的梯度,从而进行网络参数的更新。

损失函数常用的有均值平方差(Mean Squared Error)和交叉熵(Cross-Entropy)等。

神经网络的优化神经网络优化是指在保持预测准确性的同时,降低模型的计算复杂度和训练时间。

在神经网络中,常用的优化算法有梯度下降法(Gradient Descent)、随机梯度下降法(Stochastic Gradient Descent)、自适应矩估计(Adaptive Moment Estimation,简称Adam)、自适应随机梯度下降法(Adaptive Stochastic Gradient Descent,简称AdaGrad)等。

神经网络

• 图4中是一个3层的前馈神经网络,其中第一层是输入单元, 第二层称为隐含层,第三层称为输出层(输入单元不是神 经元,因此图中有2层神经元)。

• (2) 反馈神经网络

• 反馈型神经网络是一种从输出到输入具有反馈连 接的神经网络,其结构比前馈网络要复杂得多。 典型的反馈型神经网络有:Elman网络和Hopfield 网络。

• (3) 自组织网络 ( SOM ,Self-Organizing Neural Networks )

自组织神经网络是一种无导师学习网络。它通 过自动寻找样本中的内在规律和本质属性,自组 织、自适应地改变网络参数与结构。

4. 神经网络工作方式

• 神经网络运作过程分为学习和工作两种状态。

• (1)神经网络的学习状态

人工神经元模型

• 图中x1~xn是从其他神经元传来的输入信号 ,wij表示表示从神经元j到神经元i的连接权 值,θ表示一个阈值 ( threshold ),或称为 偏置( bias )。则神经元i的输出与输入的关 系表示为:

• 图中 yi表示神经元i的输出,函数f称为激活 函数 ( Activation Function )或转移函数 ( Transfer Function ) ,net称为净激活(net activation)。若将阈值看成是神经元i的一个 输入x0的权重wi0,则上面的式子可以简化 为:

常用激活函数

• (1) 线性函数 ( Liner Function )

• (2) 斜面函数 ( Ramp Function )

• (3) 阈值函数 ( Threshold Function ) • (4) S形函数 ( Sigmoid Function )

该函数的导函数:

• (5) 双极S形函数 该函数的导函数:

神经网络讲解

大家好,我们小组为大家介绍的是深度学习代表模型的原理,案例分析及其在交通领域的应用下面我将从三个方面进行分享首先是神经网络的概念人工神经网络是一种受人脑神经网络启发而设计的计算系统。

我们先看人脑神经网络1.1人脑神经网络是一个复杂而精密的系统,它由大量的神经元和突触连接组成,是人类大脑中数以亿计的神经元之间形成的复杂网络。

1.2这些神经元通过突触相互连接,通过电信号传递信息,形成了传递信息的通路,是我们思考、感知和行动的基础。

在人脑神经网络中为神经元提供输入的电线是树突。

在某些情况下,一个神经元会向另一个神经元发送信号,这些向外发送信号的导线被称为轴突。

轴突可能与一个或多个树突相连,这种交叉点称为突触。

这些神经元通过突触相互连接,通过电信号传递信息,形成了传递信息的通路。

1.3而人工神经网络是为模拟人脑神经网络而设计的一种计算模型,它从结构、实现机理和功能上模拟人脑神经网络。

与生物神经元类似,人工神经网络由一系列互相连接的神经元组成,可以通过学习和调整神经元之间的连接权重,来实现对输入数据的处理和分类。

那什么是权重呢?权重就像可调节的旋钮,决定着你输入的数据对最终输出结果的影响程度。

例如,为了找到适当的平衡(数据),我们要给输入值加上适当的权重。

然后将每个输入值(神经元)与权重相乘并相加,我们就能实现 "线性组合"。

实现线性组合后,再把他传递给 "激活函数"。

什么是激活函数呢?激活函数就像一个开关,它决定信号是否应该通过,使神经网络能够有效地学习和解决不同的问题。

从系统观点看,人工神经元网络就是由大量神经元通过极其丰富和完善的连接而构成的自适应非线性动态系统。

1.4接下来是神经网络的发展历程,神经网络的发展经历了五个阶段,从启蒙阶段,提出相关理论,因无法解决线性不可分的两类样本分类问题,发展进入低潮状态第三阶段是复兴时期,这个时期中,反向传播算法重新激发了人们对神经网络的兴趣。

神经网络原理 pdf

神经网络原理 pdf神经网络是一种模仿人脑神经元网络结构和工作原理的计算模型,它由大量的人工神经元组成,并通过它们之间的连接进行信息传递和处理。

神经网络在近年来得到了广泛的应用,如图像识别、语音识别、自然语言处理等领域都取得了显著的成果。

本文将介绍神经网络的基本原理,包括神经元模型、激活函数、网络结构和训练方法等内容。

首先,我们来介绍神经元模型。

神经元是神经网络的基本组成单元,它接收来自其他神经元的输入信号,并通过激活函数处理后产生输出。

常用的神经元模型包括,感知机模型、Sigmoid模型、ReLU模型等。

这些模型在不同的场景下有不同的应用,选择合适的神经元模型对神经网络的性能有着重要的影响。

其次,激活函数也是神经网络中的重要组成部分。

激活函数决定了神经元的输出方式,常用的激活函数有,Sigmoid函数、tanh函数、ReLU函数等。

不同的激活函数对神经网络的训练速度和收敛性有着不同的影响,选择合适的激活函数可以提高神经网络的性能。

接着,我们来谈谈神经网络的结构。

神经网络的结构包括输入层、隐藏层和输出层,其中隐藏层可以有多层。

神经网络的结构决定了网络的拟合能力和表达能力,合理的网络结构可以提高神经网络的性能。

此外,还有一些特殊的网络结构,如卷积神经网络、循环神经网络等,它们在特定的领域有着重要的应用。

最后,我们来介绍神经网络的训练方法。

常用的训练方法包括,梯度下降法、反向传播算法、随机梯度下降法等。

这些训练方法可以有效地调整神经网络中的参数,使得网络能够更好地拟合训练数据。

此外,还有一些提高训练效果的技巧,如正则化、Dropout等,它们可以有效地避免过拟合问题。

综上所述,神经网络是一种强大的计算模型,它在各个领域都有着重要的应用。

了解神经网络的原理对于深入理解神经网络的工作原理和提高神经网络的性能都有着重要的意义。

希望本文对您有所帮助,谢谢阅读!。

神经网络的介绍范文

神经网络的介绍范文

神经网络(Neural Networks)是一种利用统计学习的方法,来解决

计算机视觉,自然语言处理,以及其他各种智能问题。

基本的神经网络架

构是由多个由具有可学习的权重的神经元构成的多层网络,每个神经元都

有一个可以被其他神经元影响的活动函数(例如逻辑函数或非线性函数)。

在简单的神经网络中,神经元可以接收输入信号并输出一个基于输入

信号。

输入信号可以是一维数组或多维数组,输出值可以是一维数组,也

可以是多维数组。

神经元可以有不同的连接强度,一些强连接的神经元可

以更大程度的影响输出,而连接弱的神经元则起到一个较小的作用。

神经

元之间的权重(weights)可以用梯度下降算法调整,以更精确的拟合数据。

分类器神经网络(Classifier Neural Networks)是使用神经网络来

实现分类任务的一种技术,类似于支持向量机(SVM)和朴素贝叶斯分类

器(Naive Bayes Classifier)。

该网络包含多个输入层,隐藏层和输出层。

输入层接收原始信号,隐藏层处理特征和聚类,然后输出层将结果转

换为有意义的分类结果。

神经网络基本介绍PPT课件

神经系统的基本构造是神经元(神经细胞 ),它是处理人体内各部分之间相互信息传 递的基本单元。

每个神经元都由一个细胞体,一个连接 其他神经元的轴突和一些向外伸出的其它 较短分支—树突组成。

轴突功能是将本神经元的输出信号(兴奋 )传递给别的神经元,其末端的许多神经末 梢使得兴奋可以同时传送给多个神经元。

将神经网络与专家系统、模糊逻辑、遗传算法 等相结合,可设计新型智能控制系统。

(4) 优化计算 在常规的控制系统中,常遇到求解约束

优化问题,神经网络为这类问题的解决提供 了有效的途径。

常规模型结构的情况下,估计模型的参数。 ② 利用神经网络的线性、非线性特性,可建立线

性、非线性系统的静态、动态、逆动态及预测 模型,实现非线性系统的建模。

(2) 神经网络控制器 神经网络作为实时控制系统的控制器,对不

确定、不确知系统及扰动进行有效的控制,使控 制系统达到所要求的动态、静态特性。 (3) 神经网络与其他算法相结合

4 新连接机制时期(1986-现在) 神经网络从理论走向应用领域,出现

了神经网络芯片和神经计算机。 神经网络主要应用领域有:模式识别

与图象处理(语音、指纹、故障检测和 图象压缩等)、控制与优化、系统辨识 、预测与管理(市场预测、风险分析) 、通信等。

神经网络原理 神经生理学和神经解剖学的研究表 明,人脑极其复杂,由一千多亿个神经 元交织在一起的网状结构构成,其中大 脑 皮 层 约 140 亿 个 神 经 元 , 小 脑 皮 层 约 1000亿个神经元。 人脑能完成智能、思维等高级活动 ,为了能利用数学模型来模拟人脑的活 动,导致了神经网络的研究。

(2) 学习与遗忘:由于神经元结构的可塑 性,突触的传递作用可增强和减弱,因 此神经元具有学习与遗忘的功能。 决定神经网络模型性能三大要素为:

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

上面我们看到了生物的大脑是由许多神经细胞组成,同样,模拟大脑的人工神经网络 ANN 是由许多叫做人工神经细胞(Artificial neuron,也称人工神经原,或人工神经元)的 细小结构模块组成。人工神经细胞就像真实神经细胞的一个简化版,但采用了电子方式来模 拟实现。一个人工神经网络中需要使用多少个数的人工神经细胞,差别可以非常大。有的神 经网络只需要使用 10 个以内的人工神经细胞,而有的神经网络可能需要使用几千个人工神 经细胞。这完全取决于这些人工神经网络准备实际用来做什么。

用平常语言介绍神经网络 (Neural Networks in Plain English)

因为我们没有能够很好了解大脑,我们经常试图用最新的技术作为一种模型来解释它。在我

童年的时候,我们都坚信大脑是一部电话 交换机 。(否则它还能是什么呢?) 我当时还看

到英国著名神经学家谢林顿把大脑的工作挺有趣地比作一部电报机。更早些时候,弗罗伊德

正是由于数量巨大的连接,使得大脑具备难以置信的能力。尽管每一个神经细胞仅仅工作 于大约 100Hz 的频率,但因各个神经细胞都以独立处理单元的形式并行工作着,使人类的 大脑具有下面这些非常明显的特点:

能实现无监督的学习。 有关我们的大脑的难以置信的事实之一,就是它们能够自己进行 学习,而不需要导师的监督教导。如果一个神经细胞在一段时间内受到高频率的刺激,则它 和输入信号的神经细胞之间的连接强度就会按某种过程改变,使得该神经细胞下一次受到激 励时更容易兴奋。这一机制是 50 多年以前由 Donard Hebb 在他写的 Organination of Behavior 一书中阐述的。他写道:

对损伤有冗余性(tolerance)。 大脑即使有很大一部分受到了损伤,它仍然能够执行复杂的 工作。一个著名的试验就是训练老鼠在一个迷宫中行走。然后,科学家们将其大脑一部分一 部分地、越来越大地加以切除。他们发现,即使老鼠的很大的一部大脑被切除后,它们仍然 能在迷宫中找到行走路径。这一事实证明了,在大脑中,知识并不是保存在一个局部地方。 另外所作的一些试验则表明,如果大脑的一小部分受到损伤,则神经细胞能把损伤的连接重 新生长出来。

神经细胞利用电-化学过程交换信号。输入信号来自另一些神经细胞。这些神经细胞的轴 突末梢(也就是终端)和本神经细胞的树突相遇形成突触(synapse),信号就从树突上的突 触进入本细胞。信号在大脑中实际怎样传输是一个相当复杂的过程,但就我们而言,重要的 是把它看成和现代的计算机一样,利用一系列的 0 和 1 来进行操作。就是说,大脑的神经细 胞也只有两种状态:兴奋(fire)和不兴奋(即抑制)。发射信号的强度不变,变化的仅仅是 频率。神经细胞利用一种我们还不知道的方法,把所有从树突上突触进来的信号进行相加, 如果全部信号的总和超过某个阀值,就会激发神经细胞进入兴奋(fire)状态,这时就会有 一个电信号通过轴突发送出去给其他神经细胞。如果信号总和没有达到阀值,神经细胞就不 会兴奋起来。这样的解释有点过分简单化,但已能满足我们的目的。

我希望本书传递给你的就是这种“啊哈!”感觉。当我们学完遗传算法时,你可能已尝到 了一点感觉,但你希望这种感觉是美妙的话,那就要等把神经网络部分整个学完。

生物学的神经网络-大脑 (A Biological Neural Network–The Brain )

你的大脑是一块灰色的、像奶冻一样的东西。它并不像电脑中的 CPU 那样,利用单个的 处理单元来进行工作。如果你有一具新鲜地保存到福尔马林中的尸体,用一把锯子小心地将 它的头骨锯开,搬掉头盖骨后,你就能看到熟悉的脑组织皱纹。大脑的外层象一个大核桃那 样,全部都是起皱的[图 0 左] ,这一层组织就称皮层(Cortex)。如果你再小心地用手指把整 个大脑从头颅中端出来,再去拿一把外科医生用的手术刀,将大脑切成片,那么你将看到大 脑有两层[图 0 右] : 灰色的外层(这就是“灰质”一词的来源,但没有经过福尔马林固定的新 鲜大脑实际是粉红色的。) 和白色的内层。灰色层只有几毫米厚,其中紧密地压缩着几十亿 个被称作 neuron(神经细胞、神经元)的微小细胞。白色层在皮层灰质的下面,占据了皮层 的大部分空间,是由神经细胞相互之间的无数连接组成。皮层象核桃一样起皱,这可以把一 个很大的表面区域塞进到一个较小的空间里。这与光滑的皮层相比能容纳更多的神经细胞。 人的大脑大约含有 1OG(即 100 亿)个这样的微小处理单元;一只蚂蚁的大脑大约也有 250,OOO 个。

每个神经细胞通过它的树突和大约 10,000 个其他的神经细胞相连。这就使得你的头脑中 所有神经细胞之间连接总计可能有 l,000,000,000,000,000 个。这比 100 兆个现代电话交换机 的连线数目还多。所以毫不奇怪为什么我们有时会产生头疼毛病!

有趣的事实

曾经有人估算过,如果将一个人的大脑中所有神经细胞的轴突和树突依次连接起 来,并拉成一根直线,可从地球连到月亮,再从月亮返回地球。如果把地球上所有人脑的轴 突和树突连接起来,则可以伸展到离开们最近的星系!

善于归纳推广。 脑和数字计算机不同,它极擅长的事情之一就是模式识别,并能根据 已熟悉信息进行归纳推广(generlize)。例如,我们能够阅读他人所写的手稿上的文字,即使 我们以前从来没见过他所写的东西。

它是有意识的。 意识(consciousness)是神经学家和人工智能的研究者广泛而又热烈地 在辩论的一个话题。有关这一论题已有大量的文献出版了,但对于意识实际究竟是什么,至 今尚未取得实质性的统一看法。我们甚至不能同意只有人类才有意识,或者包括动物王国中 人类的近亲在内才有意识。一头猩猩有意识吗?你的猫有意识吗?上星期晚餐中被你吃掉的 那条鱼有意识吗?

有趣的事实

有一个叫 Hugo de Garis 的同行,曾在一个雄心勃勃的工程中创建并训练了一个包 含 1000,000,000 个人工神经细胞的网络。这个人工神经网络被他非常巧妙地建立起来了,它 采用蜂房式自动机结构,目的就是为一机器客户定制一个叫做 CAM BrainMachine(“CAM 大脑机器”) 的机器(CAM 就是 Cellular Automata Machine 的缩写)。此人曾自夸地宣称这 一人工网络机器将会有一只猫的智能。许多神经网络研究人员认为他是在“登星”了,但不 幸的是,雇用他的公司在他的梦想尚未实现之前就破产了。此人现在犹他州,是犹他州大脑 工程(Utah Brain Project)的领导。时间将会告诉我们他的思想最终是否能变成实际有意义 的东西。[译注]

神经细胞利用电-化学过程交换信号。输入信号来自另一些神经细胞。这些神经细胞的轴 突末梢(也就是终端)和本神经细胞的树突相遇形成突触(synapse),信号就从树突上的突 触进入本细胞。信号在大脑中实际怎样传输是一个相当复杂的过程,但就我们而言,重要的 是把它看成和现代的计算机一样,利用一系列的 0 和 1 来进行操作。就是说,大脑的神经细 胞也只有两种状态:兴奋(fire)和不兴奋(即抑制)。发射信号的强度不变,变化的仅仅是 频率。神经细胞利用一种我们还不知道的方法,把所有从树突上突触进来的信号进行相加, 如果全部信号的总和超过某个阀值,就会激发神经细胞进入兴奋(fire)状态,这时就会有 一个电信号通过轴突发送出去给其他神经细胞。如果信号总和没有达到阀值,神经细胞就不 会兴奋起来。这样的解释有点过分简单化,但已能满足我们的目的。

因此,一个人工神经网络(Artificial neural network,简称 ANN)就是要在当代数字计算机现有 规模的约束下,来模拟这种大量的并行性,并在实现这一工作时,使它能显示许多和生物学 大脑相类似的特性。下面就让我们瞧瞧它们的表演吧!

***************************************************************888 (连载之二)

以下表 1 显示了人和几种动物的神经细胞的数目。

表 l 人和几种动物的神经细胞的数目

动 物 种 类 经细胞的数目(数量级) 蜗 牛 10,000 (=10^4) 蜜 蜂 100,000 (=10^5) 蜂 雀 10,000,000 (=10^7)

老 鼠 100,000,000 (=10^8) 人 类 10,000,000,000 (=10^10) 大 象 100,000,000,000 (=10^11)

这样几个星期后,在一个美丽的日子里,当时我在苏格兰海边度假,当我越过一层薄雾凝 视着狭长的海湾时,我的头脑突然受到一个冲击。一下子悟到了人工神经网络是怎样工作的。 我得到“啊哈!”的感觉了!但我此时身边只有一个帐篷和一个睡袋,还有半盒子的脆玉米 片,没有电脑可以让我迅速写出一些代码来证实我的直觉。Arghhhhh!这时我才想到我应该 买一台手提电脑。不管怎样,几天后我回到家了,我立刻让我的手指在键盘上飞舞起来。几 个小时后我的第一人工神经网络程序终于编成和运行了,并且工作得挺好!自然,代码写的 有点乱,需要进行整理,但它确实已能工作了,并且,更重要的是,我还知道它为什么能工 作!我可以告诉你,那天我是一位非常得意的人。

处理信息的效率极高。 神经细胞之间电-化学信号的传递,与一台数字计算机中 CPU 的 数据传输相比,速度是非常慢的,但因神经细胞采用了并行的工作方式,使得大脑能够同时 处理大量的数据。例如,大脑视觉皮层在处理通过我们的视网膜输入的一幅图象信号时,大 约只要 100ms 的时间就能完成。考虑到你的神经细胞的平均工作频率只有 100Hz,100ms 的时间就意味只能完成 10 个计算步骤!想一想通过我们眼睛的数据量有多大,你就可以看 到这真是一个难以置信的伟大工程了。

“当神经细胞 A 的一个轴突重复地或持久地激励另一个神经细胞 B 后,则其中的一 个或同时两个神经细胞就会发生一种生长过程或新陈代谢式的变化,使得激励 B 细胞之一 的 A 细胞的效能会增加”

与此相反的是,如果一个神经细胞在一段时间内不受到激励,那么它的连接的有效性就会 慢慢地衰减。这一现象就称可塑性(plasticity)。