eCognition Developer软件常用算法与特征.

eCognition的基本介绍

版权归Father Jacob所有,转载请注明。

摘要:Trimble最近发布了eCognition Suite9.1版本以及eCognition Essentials 1.1版本的更新。

本文重点介绍eCognition Essentials 1.1的基本功能以及相关更新情况。

公司介绍:eCognition是一家初创于2000年5月的德国软件公司,专注于使用计算机手段从遥感影像中提取信息。

相较于传统的基于像素的进行分析的图像处理手段,eCognition以图像中的对象(相关的一组像素)为基本单位,对遥感影像进行多尺度分析。

这也是eCognition系列软件的特点。

2010年6月,为了扩展其空间信息业务,美国著名的测量仪器生产销售以及测绘解决方案提供公司Trimble Navigation收购了eCognition。

eCognition软件产品线介绍:具体来说,eCognition软件是一种可以自动从影像数据和遥感数据中提取可供GIS以及相关用户使用特定信息(往往包括统计数据、矢量图层、分类点云等)的一个软件工具。

eCognition软件产品线主要包括eCognitonSuite以及eCognition Essentials。

前者又具体包括eCognition Developer(开发与分析环境)、eCognition Server(定制划应用), 以及eCognition Architect(处理环境)三个组件。

这些相关的开发、分析、定制以及应用的软件组件可以根据客户需求,在相关的专业人士手中发挥强大的影响处理功能,并囊括从数据生产,影像处理到数据转换和数据发布的所有流程(以后有机会具体阐述)。

而eCognition Essentials则是基于eCognition Suite开发出的即用型地标分类覆盖分类软件。

任何水平的用户经过简单的熟悉,就可高效,更智能地得到高质量的可直接用于GIS以及相关用户所需要的数据成果。

eCognition算法

原文地址:ecognition 常用算法介绍作者:fucupChessboard SegmentationSplit the pixel domain or an image object domain into square image objects. A square grid aligned to the image left and top borders of fixed size is applied to all objects in the domain and each object is cut along these grid lines.Quad Tree Based SegmentationSplit the pixel domain or an image object domain into a quad tree grid formed by square objects.A quad tree grid consists of squares with sides each having a power of 2 and aligned to the image left and top borders is applied to all objects in the domain and each object is cut along this grid lines. The quad tree structure is build in a way that each square has first maximum possible size and second fulfills the homogeneity criteria as defined by the mode and scale parameter.Contrast Split SegmentationUse the contrast s plit segmentation algorithm to segment an image or an image object into dark and bright regions.The algorithm achieves the optimization by considering different pixel values as potential thresholds. The test thresholds range from the minimum threshold to the maximum threshold, with intermediate values chosen according to the step size and stepping type parameter. If a test threshold sati sfies the minimum dark area and minimum bright area criterion, the contrast between bright and dark objects is evaluated. The test threshold causing the largest contrast is chosen as best threshold and used for splitting.Spectral Difference SegmentationMerge neighboring image objects according to their mean image layer intensity values. Neighboring image objects are merged if the difference between their layer mean intensities is below the value given by the maximum spectral difference.NoteThis algorithm cannot be used to create new image object levels based on the pixel level domain.Contrast Filter SegmentationUse pixel filters to detect potential objects by contrast and gradient and create suitable object primitives. An integrated reshaping operation modifies the shape of image objects to help form coherent and compact image objects.The resulting pixel classification is stored in an internal thematic layer. Each pixel is classified as oneof the following classes: no object, object in first layer, object in second layer, object in both layers, ignored by threshold.Finally a chessboard segmentation is used to convert this thematic layer into an image object level.Use this algorithm as first step of your analysis to improve overall image analysis performance substantially.Assign ClassAssign all objects of the image object domain to the class specified by the Use class parameter.The membership value for the assigned class is set to 1 for all objects independent of the class description. The second and third best classification results are set to 0 .ClassificationEvaluates the membership value of an image object to a list of selected classes. The classification result of the image object is updated according to the class evaluation result. The three best classes are stored in the image object classification result. Classes without a class description are assumed to have a membership value of 1.Hierarchical ClassificationEvaluate the membership value of an image object to a list of selected classes. The classification result of the image object is updated according to the class evaluation result. The three best classes are stored as the image object classification result. Classes without a class description are assumed to have a membership value of 0. Class related features are considered only if explicitly enabled by the according parameter.NoteThis algorithm is optimized for applying complex class hierarchies to entire image object levels. This reflects the classification algorithm of eCognition Professional 4. When working with domain specific classification in processes the algorithms assign class and classification are recommended.Find Domain ExtremaClassify image objects fulfilling a local extrema condition within the image object domain according to an image object feature. This means that either the image object with smallest or the largest feature value within the domain will be classified according to the classification settings.Find Local ExtremaClassify image objects fulfilling a local extrema condition according to an image object feature within a search domain in their neighborhood. Image objects with either the smallest or the largest feature value within a specific neighborhood will be classified according to the classification settings.Find Enclosed by ClassFind and classify image objects that are completely enclosed by image objects belongin g to certain classes. If an image object is located at the border of the image, it will not be found and classified by find enclosed by class. The shared part of the outline with the image border will not be recognized as enclosing border.ConnectorClassify the image objects which connect the current image object with the shortest path to another image object that meets the conditions described by the connection settings.The process starts from the current image object to search along objects that meet th e conditions as specified by Connect via and Super object mode via until it reaches image objects that meet the conditions specified by Connect to and Super object mode to. The maximum search range can be specified in Search range in pixels. When the algorithm has found the nearest image object that can be connected to it classifies all image objects of the connection with the selected class.Optimal BoxGenerate member functions for classes by looking for the best separating features based upon sample training.Update VariablePerform an arithmetic operation on a variable.Compute Statistical ValuePerform a statistical operation on the feature distribution within an image object domain and stores the result in a scene variable.Grow RegionEnlarge image objects defined in the image object domain by merging them with neighboring image objects ("candidates") that match the criteria specified in the parameters.The grow region algorithm works in sweeps. That means each execution of the algorithm merges all direct neighboring image objects according to the parameters. To grow image objects into a larger space, you may use the Loop while something changes check box or specify a specific number of cycles.Multiresolution Segmentation Region GrowGrow image objects according to the multiresolution segmentation criteria. Precondition: The project must first be segmented by another segmentation process. For detailed description of all parameters see the algorithm multiresolution segmentation.Image Object FusionDefine a variety of growing and merging methods and specify in detail the conditions for merger of the current image object with neighboring objects.TipIf you do not need a fitting functions, we recommend that you use the algorithms merge region and grow regions. They require fewer parameters for configuration and provide higher performance.Convert to SubobjectsSplit all image objects of the image object domain into their subobjects.Precondition: The image objects in the domain need to have subobjects.Border OptimizationChange the image object shape by either adding subobjects from the outer border to the image object or removing subobjects from the inner border from the image object.DestinationChoose the classes you wish to consider for the neighboring objects of the current image object. To be considered by the Dilatation, subobjects need to be part of an image object classified with one of the selected classes. To be considered by the E rosion subobjects need to be moveable to an image object classified with one of the selected classes. This parameter has no effect for the E xtraction.MorphologyPerform the pixel based binary morphology operations Opening or Closing on all image objects of an image object domain. Both will result in a smoothed border of the image objectWatershed TransformationCalculate an inverted distance map based on the inverted distances for each pixel to the image object border. Afterwards, the minima are flooded by increasing the level (inverted distance). Where the individual catchment basins touch each other (watersheds), the image objects are split.Example of purpose: The watershed transformation algorithm is used to separate image objects from others.Precondition: Image objects that you wish to split should already be identif ied and classified.Configure Object TableDisplay a list of all image objects together with selected feature values in the Image Object Table window .Classified Image Objects to SamplesCreate a sample for each classified image object in the image object domain.Cleanup Redundant SamplesRemove all samples with membership values higher than the membership threshold.Nearest Neighbor ConfigurationSelect classes, features and function slope to use for nearest neighbor classification.Disconnect All SamplesDisconnect samples from image objects, to enable creation of samples that are not lost when image objects are deleted. They are stored in the solution file.Create Temporary Image LayerCreate a temporary image layer with values calculated from a selected feature for the image objects selected in the image object domain.Delete Image LayerDelete one selected image layer.TipThis algorithm is often used in conjunction with the create temporary image layer algorithm to remove this image layer after you finished working with it.Convolution FilterApply a convolution filter to the image. It offers two options; a preset Gaussian smoothing filter and a user-defined kernel.A convolution filter uses a kernel, which is a square matrix of a values that is applied to the image pixels. Each pixel value is replaced by the average of the square area of the matrix centered on the pixel.Layer NormalizationThe layer normalization algorithm offers two options to normalize images. The linear normalization filter stretches pixel values to the entire pixel value range. The histogram normalization changes pixel values based on the accumulated histogram of the image.Median FilterUse the median filter algorithm to replace the pixel value with the median value of neighboring pixels.The median filter may preserve image detail better than a mean filter. Both can be used to reduce noise.Pixel Frequency FilterThe pixel frequency filter algorithm scans the input layer and select the color that is found in the greatest number of pixels. The frequency is checked in the area defined by the size of the kernel.Edge Extraction Lee SigmaExtract edges using a specific edge filter that creates two individual layers from the original image. One layer represents bright edges, the other one dark edges.To extract two layers, one with bright, one with dark edges, this algorithm must be applied two times with the appropriate settings changed.If two edge layers are created, it is important to give them two individual image layer aliases. Otherwise, the first existing layer would be overwritten by the second generated layer.Edge Extraction CannyEnhance or extract feature boundaries, using Canny's algorithm. Edge extraction filters may be used to enhance or extract feature boundaries.Surface CalculationUse the surface calculation algorithm to derive the slope for each pixel of a digital elevation model (DEM). This can be used to determine whether an area within a landscape is flat or steep and is independent from the absolute height values.Layer ArithmeticsThe layer arithmetic algorithm uses a pixel-based operation that enables the merger of up to four layers by mathematical operations (+– * /). The layer created displays the result of this mathematical operation. This operation is performed on the pixel level which means, that all pixels of the image layers are used.For example Layer 2 can be subtracted from Layer 1. This would mean that whenever the same pixel value in both layers exist, the result would be 0.Before or after the operation, the layers can be normalized. Furthermore, weights can be used for each individual layer to influence the result.Synchronize Image Object HierarchyChange an image object level to exactly represent the thematic layer. Image objects smaller than the overlapping thematic object will be merged, image objects intersecting with several thematic objects will be cut.Read Thematic AttributesCreate and assign local image object variables according to a thematic layer attribute table. A variable with the same name as the thematic attribute will be created, attached to each image object in the domain and filled with the value given by the attribute table.Write Thematic AttributesGenerate a attribute column entry from an image object feature. The updated attribu te table can be saved to a.shp file.Export Object StatisticsExport image object statistics of selected features to file. This generates one file per project.Export Object Statistics for ReportExport image object statistics to a file. This generates one file per workspace.Submit Scenes for AnalysisExecute a subroutine.This algorithm enables you to connect subroutines with any process of the main process tree or other subroutines. You also can also choose whether to stitch the results of the analysi s of subset copies.NoteA rule set that contains the submit scenes for analysis algorithm can only be executed if you are connected to Definiens eCognition Server. Rule sets that include subroutines cannot be process on a local machine.Read Subscene StatisticsRead in exported result statistics and perform a defined mathematical summary operation. The resulting value is stored as a variable that can be used for further calculations or export operations concerning the main scene.This algorithm summarizes all values in the selected column in selected export item, using the selected summary type.In cases the analysis of subscenes results in exporting statistics per each scene, the algorithm allows you to collect and merge the statistical results of multiple files. The advantage is that you do not need to stitch the subscenes results for result operations concerning the main scene.。

reshaping算法学习

Ecognition之Remove Objects算法讲解一、基本介绍:合并图像对象域中的图像对象。

每个图像对象被合并到具有最大公共边界的相邻图像对象中。

该算法对去除细小破碎对象特别有帮助。

二、理论学习:该算法对于消除杂乱特别有帮助可以选择形状合并或是颜色合并。

形状合并的默认设置,意味着它要合并到与他共享最长边界的图像对象中,同时还可以设置最小公共边界阈值。

另一种是通过颜色合并,可以通过颜色阈值控制合并效果只有色差值小于阈值才会对其进行合并。

三、举例说明:图1现在我们想通过像素块的面积大小来优化黄色对象,例如将像素块小于等于4的对象转为灰色类对象。

那么就可以像以下操作:图2得到如下效果图:图3如果情况稍微复杂一点多了一个橙色类,并且我们的目标类为橙色和灰色对象,现在本文希望将像素块小于等于10的黄色对象合并为灰色或橙色对象:图4具体如何操作与图2类似只需要修改像素面积和目标类。

其结果如下:图5虽然我们的目标类是灰色和橙色但是被圈出来的区域仍然被合并到了灰色其原因在于灰色对象与黄色对象共享边界更多。

但是如果我们将形状修改为颜色,结果看起来就会有所不同。

图6其原因在于从光谱信息上来看黄色与橙色更加的接近。

图7如果我们想合并小于等于10像素的黄色类到橙色类中这种情况是不成立的,因为上图中黄色类和橙色类是没有邻接关系的。

四、实例练习此处以成都市2020年30m遥感影像局部截图为例。

图8 分类体系与结果如下:图91、基于形状合并可以看到部分不透水地面内存有少量农用地,现在我们希望将面积小于等于10个像素块的农用地合并到不透水面中,此时我们就可以利用remove object算法。

具体步骤如下:图10图11可以清晰的看到面积小于10个像素块的农田被合并到了不透水面(具有最大邻接边)当中。

2、基于颜色合并以上算法基于形状,那么我们看看基于颜色阈值会有什么不同的地方。

图12图13执行算法后可以发现小块的1个像素块的农用地合并为了不透水面,稍大且与其他类邻近的农用地合并为了其他类,其原因在于光谱的相似性更强。

eCognition的概论 1

eCognition的概论eCognition是北京天目创新科技有限公司代理的德国DefiniensImaging公司的遥感影像分析软件,它是人类大脑认知原理与计算机超级处理能力有机结合的产物,即计算机自动分类的速度+人工判读解译的精度,更智能,更精确,更高效地将对地观测遥感影像数据转化为空间地理信息。

eCognition突破了传统影像分类方法的局限性,提出了革命性的分类技术-面向对象分类。

eCognition分类针对的是对象而不是传统意义上的像素,充分利用了对象信息(色调,形状,纹理,层次),类间信息(与邻近对象,子对象,父对象的相关特征)。

eCognition基于Windows操作系统,界面友好简单。

与其他遥感,地理信息软件互操作性强,广泛应用于:自然资源和环境调查,农业,林业,土地利用,国防,管线管理,电信城市规划,制图,自然灾害监测,海岸带和海洋制图,地矿等方面。

面向影像对象:*面向像素的解算模式将像元孤立化分析,解译精度较低且斑点噪声难以消除;*利用影像分割技术把影像分解成具有一定相似特征的像元的集合—影像对象;*影像对象和像元相比,具有多元特征:颜色、大小、形状、匀质性等;基于对象属性特点:- 颜色信息丰富- 形状接近真实地物- 大小区分明显- 纹理信息突出- 上下文关系明确基于像素属性特点:- 基本上只以颜色信息来区分主要分类过程介绍:采用eCognition软件对影像进行分类操作非常简单,可以主要以三个步骤来形容如下:1.分割分割是面向对象分类的前提,多尺度分割是影像对象提取的专利技术,可以根据目标任务和所用影像数据的不同以任意选定的尺度分割出有意义的影像对象原型。

2.分类多尺度分割的结果是影像对象层次网络,每一层是一次分割的结果,影像对象层次网络在不同的尺度同时表征影像信息。

3.导出导出分类结果。

eCognition提供的专业分类工具包括* 多源数据融合* 多尺度分割* 基于样本的监督分类* 基于知识的模糊分类* 人工分类* 自动分类多源数据融合工具:可用来融合不同分辨率的对地观测影像数据和GIS数据,如Landsat,Spot,IRS,IKONOS, QuickBird,SAR,航空影像,LIDAR等,不同类型的影像数据和矢量数据同时参与分类。

ecognition中文操作指南

操作指南操作指南通过不同的例子向用户介绍软件的使用。

您将会发现eCognition可以操作不同的数据,并可应用于不同的领域。

操作指南涉及软件全部的重要特征。

通过这个指南,可了解新的术语和技术。

(由于eCognition现升级为4.0,故指南中可能有部分在软件4.0版使用中有出入,待4.0版的说明书正式出版后再做修正,且水平有限,给您造成的不便请谅解!)例1: TM影像的切割(子集)关键字:多分辨率分割,样本对象,最邻近分类,训练检测区域掩模,特征空间优化例2:分析城区表面的不可渗透度(如水泥,沥青等路面)关键字:训练检测区域掩模,基于分类的分割,多层分类,利用多尺度信息,精度评估,导出专题层例3高分辨率的航空数字化关键字:成员函数,数字表面模型,专题层,类相关特征,边界优化例4 印度尼西亚热带雨林雷达图像关键字:子对象线性分析分割,基于子对象的线特征例5航空照片和丹麦的LIDAR表面模型关键字:自定义特征,自动操作,多重窗口函数,基于分类的分割此操作手册如果和其它eCognition的解释性章节结合起来使用,效果会更好。

更有利于用户掌握eCognition的特征。

Orange Country(美国加利福尼亚州)地区的TM影像的切割在这个练习中,您可以利用LANDSAT TM数据进行最邻近分类。

最邻近分类可以很容易快速获得分类结果,只需点到即可分类!在这一练习中,您可学会:·导入和显示栅格数据,·图像分割,·创建一个简单的类层次,·在类描述中插入最邻近分类器,·分类·进行分类质量评估。

数据提供方; PCI Geomatics导入栅格图像1.运行eCognition,从Project菜单中选择New...或者在工具栏中点击图标.2.浏览目录”…\data\orangecounty\”,一次选中此目录下的五个文件(可用鼠标全部选中,也可通过SHIFT键选中),然后打开。

eCognition简要介绍

u为影像区域整体紧致度; v为影像区域边界光滑度; E为影像区域实际的边界长 度;

N为影像区域的像元总数; L为包含影像区域范围的矩 形边界总长度

E为区域A的红色边界的长度 L为青色矩形的周长 N为区域A所包含的像素数 紧致度u衡量区域的饱满程度 光滑度v衡量区域边界的光滑(破碎)程度

合并后的区域异质性计算[4]

EC软件操作实验

面向对象分类(基于规则) 面向对象分类(基于样本)

基本概念[1]

基本概念[1]

分割 VS 分类

分割:cut the image into pieces for further analysis

分类:label these objects according to their attributes

分类精度得到保障

对象能够准确反映地物的真实边界、轮廓信息,从而从根本上减少错 分、漏分的几率,同时能有效避免椒盐现象

分割尺度可控

针对不同地物目标的提取需求,可灵活控制分割尺度,满足多尺度分 割分类要求

多尺度分割思想[3]

多尺度分割(异质性最小的区域合并算法[4])

区域异质性f

光谱异质性x(画图) n x pii i 1

形状异质性y(画图)

w1为光谱权值,x为光谱异 质性,y为形状异质性

w2为紧致度的权重; u为影像区域整体紧致度; v为影像区域边界光滑度; E为影像区域实际的边界长 度;N为影像区域的像元总 数;L为包含影像区域范围 的矩形边界总长度

形状参数(紧致度&光滑度)

Y_min

S

X_min

Y_max X_max

对象(子对象,父对象,相邻对象)

对象:包含状态(数据)和行为(操作)的集合体,用来描述真实世界的 (物理或逻辑概念上的)物体。

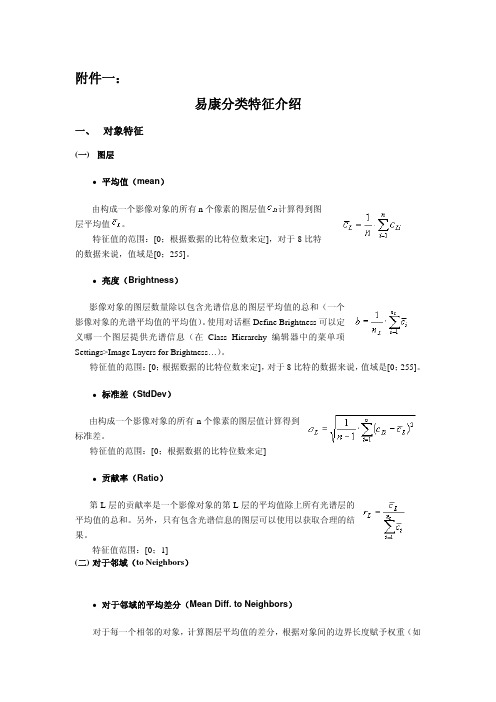

易康分类特征介绍

附件一:易康分类特征介绍一、 对象特征(一)图层z平均值(mean)由构成一个影像对象的所有n个像素的图层值计算得到图层平均值。

特征值的范围:[0;根据数据的比特位数来定],对于8比特的数据来说,值域是[0;255]。

z亮度(Brightness)影像对象的图层数量除以包含光谱信息的图层平均值的总和(一个影像对象的光谱平均值的平均值)。

使用对话框Define Brightness可以定义哪一个图层提供光谱信息(在Class Hierarchy编辑器中的菜单项Settings>Image Layers for Brightness…)。

特征值的范围:[0;根据数据的比特位数来定],对于8比特的数据来说,值域是[0;255]。

z标准差(StdDev)由构成一个影像对象的所有n个像素的图层值计算得到标准差。

特征值的范围:[0;根据数据的比特位数来定]z贡献率(Ratio)第L层的贡献率是一个影像对象的第L层的平均值除上所有光谱层的平均值的总和。

另外,只有包含光谱信息的图层可以使用以获取合理的结果。

特征值范围:[0;1](二)对于邻域(to Neighbors)z对于邻域的平均差分(Mean Diff. to Neighbors)对于每一个相邻的对象,计算图层平均值的差分,根据对象间的边界长度赋予权重(如果它们是直接相邻的,特征距离=0)或者根据相邻对象的面积赋予权重(如果被讨论的影像对象周围的邻域已用某一范围(像素级)来定义,特征距离>0)。

对于直接相邻对象的平均差分如下计算:所关心的影像对象的边界长度与第i个直接相邻对象共同的边界长度所关心的影像对象的图层平均值第i个相邻对象的图层平均值相邻对象的数量如果你用某一个范围内的对象来定义领域(参见特征距离(feature distance),平均差分则计算如下:所有领域对象的总面积第i领域对象的面积所关心的影像对象的图层平均值第i领域对象的图层平均值相邻对象的数量特征值的范围:[0;根据数据的比特位数来定]z对于邻域的平均差分(绝对值)(Mean Diff. to Neighbors(abs)和对于邻域的平均差分相同,不同是差分使用的是绝对值。

ecognition培训文本课件

分类原理

因此,可以建立语义层次结构,综合各种特征对影 像进行分类。

算法与最邻近法相似,对每一个特征,计算特征 值,选择适当的隶属度函数,将其归属到[0-1]的隶 属 度 , 有 不 同 特 征 时 , 可 以 通 过 “ and” 、 “ or” 和 “not”等操作进行组合。

分类原理

可以用的描述特征主要有两类:Obect Features, Class-related Features. ❖1.Object Features(对象特征):评价影像对象本 身以及它们在影像对象层的结构情况获得的信息。

主要内容

❖ 1.ecognition简介 ❖ 2.ecognition的特点 ❖ 3.创建工程 ❖ 4.多尺度分割 ❖ 5.分类

1.ecognition简介

❖ eCognition是由德国Definiens Imaging公司开发的智能化影像分 析软件。

❖ eCognition是目前所有商用遥感软件中第一个基于目标信息的遥 感信息提取软件。

❖ 它采用决策专家系统支持的模糊分类算法,突破了传统商业遥 感软件单纯基于光谱信息进行影像分类的局限性,提出了革命 性的分类技术——面向对象的分类方法,大大提高了高空间分 辨率数据的自动识别精度,有效地满足了科研和工程应用的需 求。

1.ecognition简介

❖ eCognition所采用的面向对象的信息提取方法,针对的是 对象而不是传统意义上的像素,充分利用了对象信息 (色调、形状、纹理、层次),类间信息(与邻近对象、 子对象、父对象的相关特征)。

本的监督分类或基于知识的模糊分类、二者结合 分类及人工分类,影像对象和分类结果易于导出 成常用GIS数据格式,可以用于集成或GIS数据库 更新。

可以导入的数据类型

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

智能影像分析专家

eCognition Developer 软件常用算法与特征

ReferenceBook 对 eCognition Developer 软件所有算法与特征都有较为详尽的说明,具体用法请参见 ReferenceBook 。

下面是一些常用算法与特征的说明, 以下截图均为 8.7.2版本下的截图。

一、常用算法

1. 分割

1多尺度分割 multiresolution segmentation

多尺度影像分割从任一个像元开始 , 采用自下而上的区域合并方法形成对象。

小的对象可以经过若干步骤合并成大的对象 , 每一对象大小的调整都必须确保合并后对象的异质性小于给定的阈值。

因此 , 多尺度影像分割可以理解为一个局部优化过程 , 而异质性则是由对象的光谱 (spectral 和形状 (shape 差异确定的 , 形状的异质性则由其光滑度和紧凑度来衡量。

显然 , 设定了较大的分割尺度 , 则对应着较多的像元被合并 , 因而产生较大面积的对象。

多尺度分割

2棋盘分割 chessboard segmentation

棋盘分割是最简单的分割算法。

它把整幅或特定的影像对象裁剪成一个给定大小的相等正方形。

置各波重

否使用矢尺度参数

形状因子紧致度因子

智能影像分析专家

棋盘分割

因为棋盘分割算法产生简单的正方形对象,所以它经常用来细分影像与影像对象。

3四叉树分割

四叉树分割与棋盘分割类似,但是它要创建出不同大小的正方形。

您可以使用Scale Parameter 定义每个正方形内的颜色差异上限。

在裁剪出一个初始的正方形网格后,四叉树分割继续如下:如果不符合同质性标准, 那么把每个正方形裁剪成四个较小的正方形。

例如:正方形对象中最大的颜色差异要比定义的尺度值大。

重复以上过程直到在每个正方形中都符合同质性标准。

四叉树分割

尺度参数

是否使用矢量参与分割

2. 分类

1 assign Class 根据限制条件将对象分为指定类别,一次只能分一类。

是否使用矢量参与分割设置各波段权重尺度参数

2 C lassification 可以一次对多个类进行分类。

3 assign class by thematic layer 使用矢量进行分类。

分类类别

分类类别, 可以是多个类别

算法作用范围算法作用范围

根据矢量层属性表的某个属性进行分类

4 remove classification 擦除指定分类结果。

是否擦除规则集分类结果是否擦除手动分类结果

3. 分类后处理

1 merge region 合并

是否融合父对象是否使用矢量

2 find enclosed by class 找出被某个类别包含的对象 , 并对其进行分类

3 remove objects 一般用来合并或去掉面积比较小的对象

4 pixel-based objects resizing 用来对地物形状进行规范化处理外面包含的类别

将里面被包含的类别分为哪个类别

里面被包含的

类别,可以是

一个也可以是

多个

将小对象指定分为某个类别,或者根据其与相邻对象相对边界最大的对象确定其类别 (none的情况下

4. 输出

export vector layer 输出矢量数据这里有三种模式可选 : Growing 、Shrinking 、 Coating

5. 地图、层相关 1 copy map 复制地图添加要输出的属性

复制的影像波段层及矢量层

2 copy image object level 复制影像对象层(只能在同一地图下用

复制之后的影像对象层放在源层的上面或下面

3 synchronize map 同步地图, 用于将一个地图下某个层的分类结果同步到另一个地图下的

智能影像分析专家

某个层上。

二、各地物类别分类时常用特征

下面以 worldview 数据为例, Layer1、 Layer2、 Layer3、 Layer4分别对应蓝blue 、绿 green 、红 red 、近红外 nir 四个波段。

1. 水体

水体在近红外波段反射率较低,在影像上常表现为暗色调,因此分类水体时常采用与近红外波段有关的特征:如近红外波段均值、植被指数 NDVI 、水体指数NDWI 等。

是否同步完整的层次结构

智能影像分析专家

近红外波段均值

创建自定义特征

植被指数 NDVI=(nir-red /(nir+red

水体指数 NDWI=(green-nir /(green+nir

2. 植被(耕地、园地、林地、草地

对植被进行分类时常用的特征是植被指数 NDVI 。

各植被类别之间的区分的常用特征有:绿波段比率、近红外波段标准差、纹理特征等。

智能影像分析专家

绿波段比率

近红外波段标准差

智能影像分析专家纹理特征 3.道路道路在影像上表现为长条带状,提取时可使用形状特征,如边界指数 Border index、密度 Density 等,也可使用长宽比Length/Width 特征,同时可结合使用亮度值 Brightness、各波段均值等进行分类。

智能影像分析专家形状特征长宽比 4.房屋建筑房屋建筑物各波段反射率较高,在影像上一般表现为亮色调,建筑群体表面较为粗糙,各波段标准差比较大,分类时可使用亮度值、各波段均值及各波段标准差。

亮度值、各波段均值各波段标准差

智能影像分析专家 5.裸露地表、构筑物、人工堆掘地裸露地表、构筑物、人工堆掘地由于没有地物覆盖,反射率较高,在遥感影像上一般表现为亮色调,提取时一般使用亮度值 Brightness、各波段均值。