MATLAB特征提取代码

sift算法matlab复杂代码

一、介绍SIFT算法SIFT(Scale-Invariant Feature Transform)算法是一种用于图像处理和计算机视觉领域的特征提取算法,由David Lowe在1999年提出。

SIFT算法具有旋转、尺度、光照等方面的不变性,能够对图像进行稳健的特征点提取,被广泛应用于物体识别、图像匹配、图像拼接、三维重建等领域。

二、SIFT算法原理SIFT算法的主要原理包括尺度空间极值点检测、关键点定位、关键点方向确定、关键点描述等步骤。

其中,尺度空间极值点检测通过高斯差分金字塔来检测图像中的极值点,关键点定位则利用DoG响应函数进行关键点细化,关键点方向确定和关键点描述部分则通过梯度方向直方图和关键点周围区域的梯度幅度信息来完成。

三、使用Matlab实现SIFT算法在Matlab中实现SIFT算法,需要对SIFT算法的每个步骤进行详细的编程和调试。

需要编写代码进行图像的高斯金字塔和高斯差分金字塔的构建,计算尺度空间极值点,并进行关键点定位。

需要实现关键点的方向确定和描述子生成的算法。

将所有步骤整合在一起,完成SIFT算法的整体实现。

四、SIFT算法复杂代码的编写SIFT算法涉及到的步骤较多,需要编写复杂的代码来实现。

在编写SIFT算法的Matlab代码时,需要考虑到算法的高效性、可扩展性和稳定性。

具体来说,需要注意以下几点:1. 高斯差分金字塔和高斯金字塔的构建:在构建高斯差分金字塔时,需要编写代码实现图像的高斯滤波和图像的降采样操作,以得到不同尺度空间的图像。

还需要实现高斯差分金字塔的构建,以检测图像中的极值点。

2. 尺度空间极值点检测:在检测图像中的极值点时,需要编写代码实现对高斯差分金字塔的极值点检测算法,以找到图像中的潜在关键点。

3. 关键点的定位:关键点定位阶段需要编写代码实现对尺度空间极值点的精确定位,消除低对比度点和边缘响应点,并进行关键点的精细化操作。

4. 关键点的方向确定和描述子生成:在这一步骤中,需要编写代码实现对关键点周围区域的梯度幅度信息的计算和关键点方向的确定,以及生成关键点的描述子。

matlab 灰度共生矩阵特征提取

一、灰度共生矩阵概述灰度共生矩阵(Gray Level Co-occurrence Matrix,GLCM)是一种用于描述图像局部纹理特征的统计方法,它可以通过对图像进行灰度级别的统计分析,提取出图像纹理信息,被广泛应用于图像处理、模式识别和计算机视觉领域。

二、灰度共生矩阵原理在一幅图像中,灰度共生矩阵是通过计算每个像素与其在一定距离和方向内的相邻像素之间的灰度值关系而得到的。

假设图像灰度级别为0到N-1,定义距离d和角度θ,对于每个灰度值i和j,统计出现在给定方向和距离内的i和j同时出现的次数,构成灰度共生矩阵。

三、灰度共生矩阵特征提取1. 对比度(Contrast)对比度是描述图像纹理粗细程度的特征之一,可以通过灰度共生矩阵计算得到。

公式如下:\[Contrast = \sum_{i=0}^{N-1}\sum_{j=0}^{N-1}(i-j)^2P_{ij}\]其中,\(P_{ij}\)表示灰度共生矩阵的元素值。

2. 相关性(Correlation)相关性是描述图像灰度分布状况的特征,可以通过灰度共生矩阵计算得到。

公式如下:\[Correlation = \sum_{i=0}^{N-1}\sum_{j=0}^{N-1}\frac{(i-\mu)(j-\mu)P_{ij}}{\sigma^2}\]其中,\(\mu\)表示灰度共生矩阵的均值,\(\sigma^2\)表示灰度共生矩阵的方差。

3. 能量(Energy)能量是描述图像纹理统计规律的特征,可以通过灰度共生矩阵计算得到。

公式如下:\[Energy = \sum_{i=0}^{N-1}\sum_{j=0}^{N-1}P_{ij}^2\]4. 同质性(Homogeneity)同质性是描述图像灰度分布均匀程度的特征,可以通过灰度共生矩阵计算得到。

公式如下:\[Homogeneity = \sum_{i=0}^{N-1}\sum_{j=0}^{N-1}\frac{P_{ij}}{1+(i-j)^2}\]四、 matlab 实现灰度共生矩阵特征提取在 matlab 中,可以使用“graatrix”函数计算灰度共生矩阵,并通过“graycoprops”函数提取灰度共生矩阵的特征。

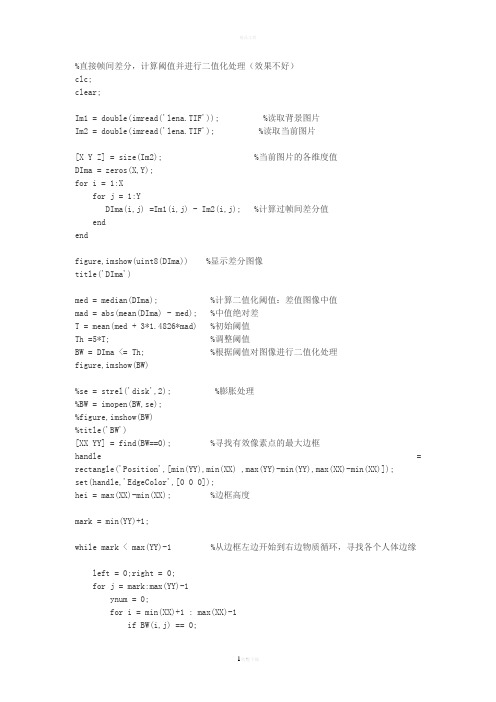

图像特征提取matlab程序

%直接帧间差分,计算阈值并进行二值化处理(效果不好)clc;clear;Im1 = double(imread('lena.TIF')); %读取背景图片Im2 = double(imread('lena.TIF'); %读取当前图片[X Y Z] = size(Im2); %当前图片的各维度值DIma = zeros(X,Y);for i = 1:Xfor j = 1:YDIma(i,j) =Im1(i,j) - Im2(i,j); %计算过帧间差分值endendfigure,imshow(uint8(DIma)) %显示差分图像title('DIma')med = median(DIma); %计算二值化阈值:差值图像中值mad = abs(mean(DIma) - med); %中值绝对差T = mean(med + 3*1.4826*mad) %初始阈值Th =5*T; %调整阈值BW = DIma <= Th; %根据阈值对图像进行二值化处理figure,imshow(BW)%se = strel('disk',2); %膨胀处理%BW = imopen(BW,se);%figure,imshow(BW)%title('BW')[XX YY] = find(BW==0); %寻找有效像素点的最大边框handle = rectangle('Position',[min(YY),min(XX) ,max(YY)-min(YY),max(XX)-min(XX)]);set(handle,'EdgeColor',[0 0 0]);hei = max(XX)-min(XX); %边框高度mark = min(YY)+1;while mark < max(YY)-1 %从边框左边开始到右边物质循环,寻找各个人体边缘left = 0;right = 0;for j = mark:max(YY)-1ynum = 0;for i = min(XX)+1 : max(XX)-1if BW(i,j) == 0;ynum = ynum + 1;endendif ynum > 0.1*hei %如果该列上像素点个数大于边框高度的某个阈值 left = j %认为找到了左边界mark = j;breakendendif left~= 0 %如果找到了左边界for j = left+1 : max(YY)-1 %则从左边界到边框右边界寻找人体右边界 ynum = 0;for i = min(XX)+1 : max(XX)-1if BW(i,j) == 0;ynum = ynum + 1;endendif ynum < 0.1*hei %如果该列上像素点个数小于边框高度的某个阈值right= j %认为找到了左边界mark = j;breakendendif left~=right %如果左右边界值不相等,即同时找到了左右边界,继续以左右边界为界寻找上下边界[top,bottom] = Find_edge(BW,min(XX)+1,max(XX),left,right,0.1);handle = rectangle('Position',[left,top,right-left,bottom-top]); set(handle,'EdgeColor',[0 0 0]); %显示图像中人体有效边界endendmark = mark + 1;end % while。

matlab最大最小特征值

在MATLAB中,要求最大最小特征值,可以使用`eig` 函数和`diag` 函数。

首先,你需要创建一个矩阵A。

然后,使用`eig(A)` 来获取矩阵A的特征值和特征向量。

返回的特征值存储在矩阵y的对角线元素中,从小到大排列;而对应的特征向量则存储在矩阵x的每一列中。

如果你只对最大或最小的特征值感兴趣,你可以使用`diag` 函数来提取矩阵y的对角线元素,然后找到最大或最小的特征值。

例如,要找到最大的特征值,你可以使用`max(diag(eig(A)))`。

同样地,要找到最小的特征值,你可以使用`min(diag(eig(A)))`。

sift matlab 代码

sift matlab 代码Sift Matlab 代码Sift算法(Scale-invariant feature transform)是一种用于图像处理和计算机视觉中的特征提取算法。

Matlab是一种常用的编程语言和软件工具,用于实现各种算法和程序。

本文将介绍如何使用Matlab 编写Sift算法的代码,并对其原理和实现进行详细说明。

一、Sift算法原理Sift算法是一种基于局部特征的图像匹配算法,其主要思想是在图像中寻找关键点(keypoints),并对这些关键点进行描述,以便在不同图像之间进行匹配。

Sift算法具有尺度不变性和旋转不变性,能够稳定地提取图像的特征。

Sift算法的主要步骤包括尺度空间极值检测、关键点定位、关键点描述和关键点匹配等。

在尺度空间极值检测中,算法会在图像的不同尺度下检测局部极值点,这些点被认为是关键点的候选。

然后,通过对这些候选点进行精确定位和剔除不稳定点,最终得到真正的关键点。

接着,算法会对每个关键点周围的图像区域进行描述,生成描述子向量。

最后,通过比较不同图像的关键点描述子,实现图像匹配。

二、Matlab实现Sift算法在Matlab中实现Sift算法,可以使用现成的开源库或者自己编写代码。

一种常见的做法是使用vlfeat工具包,该工具包提供了Sift算法的Matlab接口,并包含了各种图像处理和特征提取的函数。

需要安装vlfeat工具包,并将其添加到Matlab的路径中。

然后,可以使用vl_sift函数来提取图像的Sift特征。

该函数会返回关键点的位置、尺度、方向以及描述子等信息,可以根据需要进行进一步处理和分析。

除了使用vlfeat工具包,也可以根据Sift算法的原理,编写自己的Sift代码。

在Matlab中,可以通过图像梯度计算、高斯金字塔构建和关键点描述等步骤,实现Sift算法的各个功能模块。

三、总结本文介绍了Sift算法的原理和在Matlab中的实现方法。

matlab中的extracthogfeatures函数

matlab中的extracthogfeatures函数Matlab中的extractHOGFeatures函数是一个用于提取图像的方向梯度直方图(Histogram of Oriented Gradients,简称HOG)特征的函数。

HOG特征是一种用于图像识别和目标检测的特征表示方法,它能够有效地描述图像中的形状和纹理。

本文将以提问的方式,一步一步地回答有关extractHOGFeatures函数的问题。

1. 什么是HOG特征?HOG特征是一种被广泛应用于计算机视觉和图像处理领域的特征提取方法。

它通过计算图像中每个像素点的局部梯度方向和幅值,并将其转化为方向梯度直方图来描述图像的纹理和形状信息。

HOG特征在图片中提取目标的位置、姿态和形状等信息方面起到了非常关键的作用。

2. extractHOGFeatures函数有哪些输入和输出参数?extractHOGFeatures函数的输入参数包括待提取特征的图像,以及一些可选的参数。

其中最重要的是CellSize参数和BlockSize参数,用于控制HOG描述符的计算范围和尺度。

函数的输出参数是一个包含提取的HOG 特征的向量。

3. 请解释一下CellSize和BlockSize参数的作用。

CellSize参数用于确定图像被划分为多少个小单元格。

每个小单元格内的像素梯度方向和幅值将贡献到对应的方向梯度直方图中,从而构成了HOG特征。

较小的CellSize可以提取更细节的特征,但会导致维度较高的特征向量。

另一方面,较大的CellSize可以提取更粗糙的特征,但特征向量的维度较低。

BlockSize参数用于确定计算HOG特征的块的大小。

块是由多个相邻的小单元格组成的区域。

将方向梯度直方图在块内进行归一化处理可以增强特征的鲁棒性。

BlockSize参数指定了块的大小,例如[2 2]表示每个块由2x2个小单元格组成。

4. extractHOGFeatures函数还有哪些可选参数?除了CellSize和BlockSize参数外,extractHOGFeatures函数还有其他几个可选参数。

特征选择、特征提取MATLAB算法实现(模式识别)

特征选择、特征提取MATLAB算法实现(模式识别)6特征选择6.1问题对“threethreelarge.m”数据,采⽤任意⼀种特征选择算法,选择2个特征6.2思路采⽤简单特征选择法(simple feature selection approach),⾸先计算每⼀个特征的分类能⼒值,再选择出其中最⼤分类能⼒的l个特征。

6.3结果eigs=8.92340.00000.0767SelectedFeature=13也就是说,选取x和z坐标作为特征。

6.4代码%特征选择代码,见FSthrthrlrg.m⽂件m1=[0,0,0];m2=[0,0,0];m3=[0,0,0];m=[0,0,0];for i=1:200m1(1)=m1(1)+(x1(i,1)-m1(1))/i;m1(2)=m1(2)+(x1(i,2)-m1(2))/i;m1(3)=m1(3)+(x1(i,3)-m1(3))/i;end;for i=1:190m2(1)=m2(1)+(x2(i,1)-m2(1))/i;m2(2)=m2(2)+(x2(i,2)-m2(2))/i;m2(3)=m2(3)+(x2(i,3)-m2(3))/i;end;for i=1:210m3(1)=m3(1)+(x3(i,1)-m3(1))/i;m3(2)=m3(2)+(x3(i,2)-m3(2))/i;m3(3)=m3(3)+(x3(i,3)-m3(3))/i;end;m(1)=(m1(1)+m2(1)+m3(1))/3;m(2)=(m1(2)+m2(2)+m3(2))/3;m(3)=(m1(3)+m2(3)+m3(3))/3;sw1=zeros(3,3);sw2=zeros(3,3);sw3=zeros(3,3);sw=zeros(3,3);sb=zeros(3,3);for i=1:200sw1=sw1+([x1(i,1),x1(i,2),x1(i,3)]-m1)'*([x1(i,1),x1(i,2),x1(i,3)]-m1);end;for i=1:190sw2=sw2+([x2(i,1),x2(i,2),x2(i,3)]-m2)'*([x2(i,1),x2(i,2),x2(i,3)]-m2);end;for i=1:210sw3=sw3+([x3(i,1),x3(i,2),x3(i,3)]-m3)'*([x3(i,1),x3(i,2),x3(i,3)]-m3);end;N1=200;N2=190;N3=210;N=N1+N2+N3;p1=N1/N;p2=N2/N;p3=N3/N;sw1=sw1/N1;sw2=sw2/N2;sw3=sw3/N3;sw=p1*sw1+p2*sw2+p3*sw3;sb=p1*(m1-m)'*(m1-m)+p2*(m2-m)'*(m2-m)+p3*(m3-m)'*(m3-m);s=inv(sw)*sb;j1=trace(s)eigs=eig(s)';eigsIndex=[1,2,3];%冒泡法排序,注意的是特征值顺序变化的同时要与相对应的下标同步for i=1:3for j=i:3if(eigs(i)eigstemp=eigs(i);eigs(i)=eigs(j);eigs(j)=eigstemp;eigsIndextemp=eigsIndex(i);eigsIndex(i)=eigsIndex(j);eigsIndex(j)=eigsIndextemp;end;end;end;%降序排列后的特征值,直接选取前L个特征SelectedFeature=[eigsIndex(1),eigsIndex(2)]%FSthrthrlrg.m程序结束6.5讨论从实验结果中我们可以看到y特征的分类能⼒最⼩,这⼀点可以从实验数据中得到验证——三类数据在y⽅向的分布⼏乎是相同的(见下图)。

matlab灰度共生矩阵纹理特征提取

matlab灰度共生矩阵纹理特征提取灰度共生矩阵(Gray-Level Co-occurrence Matrix,GLCM)是一种用于描述图像纹理特征的方法。

它通过统计图像中像素灰度值在一定距离和方向上出现的概率,得到一个矩阵,从而提取出图像的纹理特征。

在matlab中,可以使用graycomatrix函数来生成灰度共生矩阵。

该函数需要输入图像矩阵和距离、方向等参数,输出一个灰度共生矩阵。

例如,下面的代码生成了一个距离为1、方向为0度的灰度共生矩阵:```img = imread('lena.png');glcm = graycomatrix(img,'Offset',[0 1],'Symmetric',true);```生成的灰度共生矩阵是一个对称矩阵,每个元素表示在给定距离和方向上,两个像素灰度值出现的概率。

可以使用matlab中的graycoprops函数来计算灰度共生矩阵的纹理特征,例如对比度、能量、熵等。

下面的代码计算了灰度共生矩阵的对比度和能量:```contrast = graycoprops(glcm,'Contrast');energy = graycoprops(glcm,'Energy');```对比度表示灰度共生矩阵中不同灰度值之间的差异程度,对比度越大表示图像的纹理越明显。

能量表示灰度共生矩阵中每个元素的平方和,能量越大表示图像的纹理越均匀。

通过计算灰度共生矩阵的纹理特征,可以对图像进行纹理分析和分类。

灰度共生矩阵是一种有效的图像纹理特征提取方法,可以用于图像分类、目标检测等应用。

在matlab中,可以使用graycomatrix和graycoprops函数来生成和计算灰度共生矩阵的纹理特征。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

for i=1:26

f=strcat('D:\bishe\',num2str(i));

image=strcat(f,'.jpg');

PS=imread(image);

PS=imresize(PS,[300,300],'bilinear');%归一化大小

PS=rgb2gray(PS);

[m,n]=size(PS); %测量图像尺寸参数

GP=zeros(1,256); %预创建存放灰度出现概率的向量

for k=0:255

GP(k+1)=length(find(PS==k))/(m*n); %计算每级灰度出现的概率,将其存入GP中相应位置

end

%直方图均衡化

S1=zeros(1,256);

for i=1:256

for j=1:i

S1(i)=GP(j)+S1(i); %计算Sk

end

end

S2=round((S1*256)+0.5); %将Sk归到相近级的灰度

%图像均衡化

f=PS;

for i=0:255

f(find(PS==i))=S2(i+1); %将各个像素归一化后的灰度值赋给这个像素

end

figure,imshow(f);

%边缘检测

f=edge(f,'canny',0.25);

imshow(f);

%二值法锐化图像

f=double(f);

[x,y]=gradient(f);

g=sqrt(x.*x+y.*y);

i=find(g>=0.5);

g(i)=256;

j=find(g<0.5);

g(j)=0;

imshow(g);

title('二值法锐化图像');

%中值滤波

g=medfilt2(g);

g=dither(g);

imshow(g);

%提取面积,矩形度,圆形度,拉伸度特征

[x,y]=size(g);

BW = bwperim(g,8); % 检测边缘跟踪,用于计算周长

%检测垂直方向连读的周长像素点%

P1=0;

P2=0;

Ny=0; % 记录垂直方向连续周长像素点的个数

for i=1:x

for j=1:y

if (BW(i,j)>0)

P2=j;

if ((P2-P1)==1) % 判断是否为垂直方向连续的周长像素点 Ny=Ny+1;

end

P1=P2;

end

end

end

%检测水平方向连读的周长像素点

P1=0;

P2=0;

Nx=0; % 记录水平方向连续周长像素点的个数

for j=1:y

for i=1:x

if (BW(i,j)>0)

P2=i;

if ((P2-P1)==1) % 判断是否为水平方向连续的周长像素点 Nx=Nx+1;

end

P1=P2;

end

end

end

SN=sum(sum(BW)); % 计算周长像素点的总数

Nd=SN-Nx-Ny; % 计算奇数码的链码数目

H=max(sum(g)); % 计算目标的高度

W=max(sum(g')); % 图象g经矩阵转置后,计算宽度

L=sqrt(2)*Nd+Nx+Ny; % 计算周长

%====形态特征值计算===%

A=bwarea(g); % 计算目标的面积

R=A/(H*W); % 计算矩形度

E=min(H,W)/max(H,W); % 计算伸长度

temp1=[A,R,E];

%提取不变矩特征

[x,y]=meshgrid(1:N,1:M);

x=x(:);

y=y(:);

g=g(:);

m.m00=sum(g);

if(m.m00==0)

m.m00=eps;

end

m.m10=sum(x.*g);

m.m01=sum(y.*g);

m.m11=sum(x.*y.*g);

m.m20=sum(x.^2.*g);

m.m02=sum(y.^2.*g);

m.m30=sum(x.^3.*g);

m.m03=sum(y.^3.*g);

m.m12=sum(x.*y.^2.*g);

m.m21=sum(x.^2.*y.*g);

xbar=m.m10/m.m00;

ybar=m.m01/m.m00;

e.eta11=(m.m11-ybar*m.m10)/m.m00^2;

e.eta20=(m.m20-xbar*m.m10)/m.m00^2;

e.eta02=(m.m02-ybar*m.m01)/m.m00^2;

e.eta30=(m.m30-3*xbar*m.m20+2*xbar^2*m.m10)/m.m00^2.5;

e.eta03=(m.m03-3*ybar*m.m02+2*ybar^2*m.m01)/m.m00^2.5;

e.eta21=(m.m21-2*xbar*m.m11-ybar*m.m20+2*xbar^2*m.m01)/m.m00^2.5;

e.eta12=(m.m12-2*ybar*m.m11-xbar*m.m02+2*ybar^2*m.m10)/m.m00^2.5;

phi(1)=e.eta20+e.eta02;

phi(2)=(e.eta20-e.eta02)^2+4*e.eta11^2;

phi(3)=(e.eta30-3*e.eta12)^2+(3*e.eta21-e.eta03)^2;

phi(4)=(e.eta30+e.eta12)^2+(e.eta21+e.eta03)^2;

phi(5)=(e.eta30-3*e.eta12)*(e.eta30+e.eta12)*((e.eta30+e.eta12)^2-3*(e.eta21 +e.eta03)^2+(3*e.eta21-e.eta03)* (e.eta21+e.eta03)*(3*(e.eta30+e.eta12)^2 -(e.eta21+e.eta03)^2));

phi(6)=(e.eta20-e.eta02)*((e.eta30+e.eta12)^2-(e.eta21+e.eta03)^2)+4*e.eta11 *(e.eta30+e.eta12)*(e.eta21+e.eta03);

phi(7)=(3*e.eta21-e.eta03)*(e.eta30+e.eta12)*((e.eta30+e.eta12)^2-3*(e.eta21 +e.eta03)^2)+(3*e.eta12-e.eta30)* (e.eta21+e.eta03)*(3*(e.eta30+e.eta12)^ 2-(e.eta21+e.eta03)^2);

temp2 = abs(log(phi));%包含七个特征值

temp=[temp1,temp2]

end。