信息论与编码期末考试复习

信息论与编码-复习

第6章 信道编码

计算:

对于循环码,已知(n,k)循环码 会求g(x),并根据g(x)求G, 例p191-192 6.3.3,p193 6.3.4 会求h(x)=(xn+1)/g(x),并根据h(x), 例p193 6.3.4 会求系统循环码码字:由G经过初等行变换得Gs, 再通过C=mGS得系统循环码码字

第4章 信息率失真函数

计算:

对于离散信源(如作业4.1(3)):

R(D)的计算、R(D)与D的关系图 只要求等概信源,对称失真的R(D),见P120 (4.2.50式) 关系图见P109 图4.1.1(注意区分离散和连续信源), 所取的点的纵坐标根据R(D)的计算式求得

第4章 信息率失真函数

计算:

会计算达到稳态时的状态概率分布(作业2.16(1))和 极限熵(作业2.16(2),2.17(2)和p48 例2.2.4);

给定状态转移概率,会画状态转移图,反之亦要求。

第二章 ——续

计算:

信源冗余度的计算(作业2.17(3)) 根据给出的离散信源,能够进行定长编码,求出码字。

掌握信源编码器的性能指标(编码效率η)及其与码 长(k)之间的关系。

第3章 信道容量

掌握离散无记忆信道的N次扩展信道的容量的求解

CN次扩展 NC单符号无记忆信道

无噪信道的容量:见作业3.14 应用连续信道的信道容量公式进行解题

连续信道的容量 所需的信号功率

S 如作业3.19,使用公式 C连续 B log 2 (1 ) N 注意:

C就是信号的传输速率 dB表示的信噪比在代入时要进行转换

能够通过分析电路的运行过程,得到生成的循环码字。 见课件

信息论与编码期末考试题

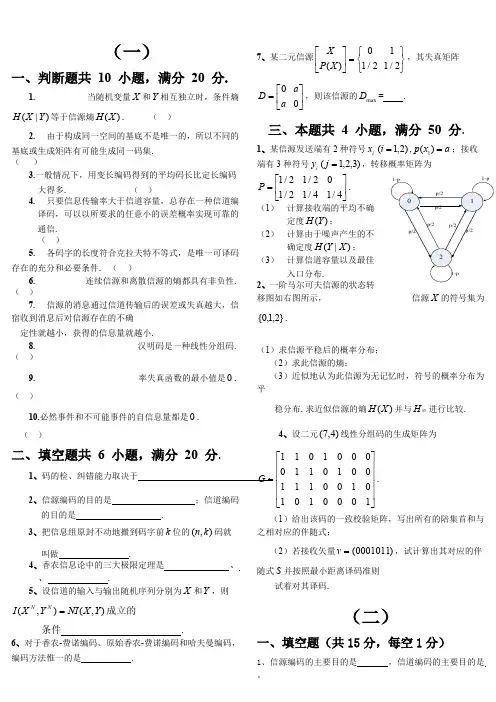

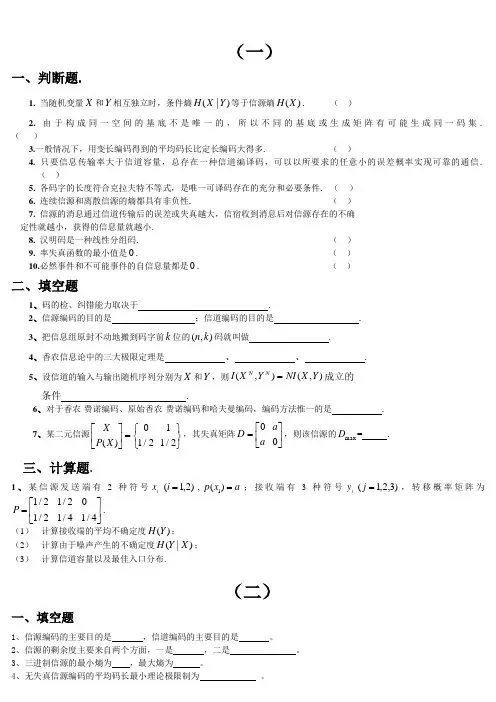

信息论与编码期末考试题(一)一、判断题.1. 当随机变量X 和Y 相互独立时,条件熵)|(Y X H 等于信源熵)(XH . ()2. 由于构成同一空间的基底不是唯一的,所以不同的基底或生成矩阵有可能生成同一码集. ()3.一般情况下,用变长编码得到的平均码长比定长编码大得多. ()4. 只要信息传输率大于信道容量,总存在一种信道编译码,可以以所要求的任意小的误差概率实现可靠的通信. ()5. 各码字的长度符合克拉夫特不等式,是唯一可译码存在的充分和必要条件. ()6. 连续信源和离散信源的熵都具有非负性. ()7. 信源的消息通过信道传输后的误差或失真越大,信宿收到消息后对信源存在的不确定性就越小,获得的信息量就越小.8. 汉明码是一种线性分组码. ()9. 率失真函数的最小值是0. ()10.必然事件和不可能事件的自信息量都是0. ()二、填空题1、码的检、纠错能力取决于 .2、信源编码的目的是;信道编码的目的是 .3、把信息组原封不动地搬到码字前k 位的),(k n 码就叫做 .4、香农信息论中的三大极限定理是、、 .5、设信道的输入与输出随机序列分别为X 和Y ,则),(),(Y X NI Y X I N N =成立的条件 ..6、对于香农-费诺编码、原始香农-费诺编码和哈夫曼编码,编码方法惟一的是 .7、某二元信源01()1/21/2X P X =,其失真矩阵00a D a ??=,则该信源的max D = . 三、计算题.1、某信源发送端有2种符号i x )2,1(=i ,a x p =)(1;接收端有3种符号i y )3,2,1(=j ,转移概率矩阵为1/21/201/21/41/4P ??=. (1)计算接收端的平均不确定度()H Y ;(2)计算由于噪声产生的不确定度(|)H Y X ;(3)计算信道容量以及最佳入口分布.(二)一、填空题1、信源编码的主要目的是,信道编码的主要目的是。

信息论与编码期末复习篇

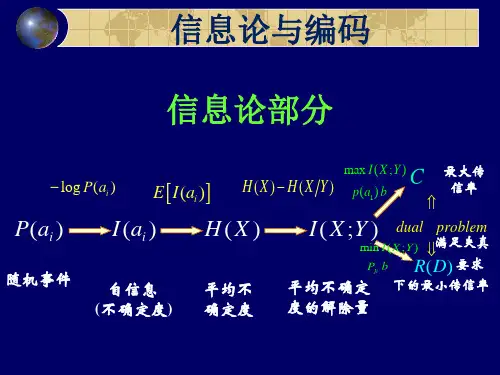

平均信息量。它不是指人们可以获得多少信息;而是指客观存在

多少信息,因而数学关系仅是平均不确定度的量。

而连续信源的相对熵,则是指相对平均不定度。

HC (X ) p(x) log p(x)dx

RX

课程复习大纲

➢ 熵函数的性质 (指离散熵)

1. 对称性: H ( p1, p2,K , pn ) H ( p2, p1, p3 K , pn ) 2. 非负性: H (X ) 0

r

C loga

a

Aj

j

迭代算法

连续信道

5

高斯信道:

C

1 2

log(1

Pwi

2 n

)

限时限频限功率 加性高斯白噪声信道

信道的容量

C L log(1 PS / N0 ) L log(1 PS ) WT log(1 PS )

2

2W 2 2

各种熵之间的关系

名称

无 条 件 熵

条 件 熵 条 件 熵 联 合 熵 交 互 熵

符号

H(X) H (Y )

H(X /Y) H (Y / X )

H(XY) H(YX)

I (X ;Y ) I (Y; X )

关系

H(X) H(X /Y) H(X /Y) I(X;Y)

H (X ) H (XY) H (Y / X )

图示

Y

X

Y

X

Y

X

Y

X

Y

X

Y

熵 、互信息

➢ 冗余度

R 1 H Hm

or R 1 Hm H0

理解两种冗余度的物理意义。

信息论与编码复习期末考试要点

30

1

1

2 W1

2W3

W1

Wi pij Wj

i

1 4W1

13W2

3 4

W3

15W4

W2

W3

2 3

W2

4 5

W4

W4

W1 W2 W3 W4 1

• 稳态分布概率

W 1 3 3 5 , W 2 3 6 5 , W 3 1 2 3 3 3 6 5 5 ,1 3 W 3 6 4 5 1 4 7 4 3 6 5 1 5 7 4 3 9 5

14

三、互信息

• 互信息

• 定义为 xi的后验概率与先验概率比值的对数

I(xi;yj)lo2gp(p x(ix|iy)j)

• 互信息I(xi;yj):表示接收到某消息yj后获得 的关于事件xi的信息量。

15

平均互信息

• 平均互信息定义

I ( X ; Y ) H ( X ) H ( X |Y ) H ( Y ) H ( Y |X )

I(X ; Y ) H (X ) H (Y )

38

• 2)无嗓有损信道 –多个输入变成一个输出(n>m)

p(bi | aj ) 1或0

p(ai

|

bj

)

1或0

• 噪声熵H(Y|X) = 0 • 损失熵H(X|Y) ≠ 0

I(X ; Y )H (Y )H (X )

Cm axI(X ;Y )m axH (Y ) p(a i) 39

加密

y 信道编码

k 加密 密钥

z

信

解密 密钥

道 z'

信宿 v

信源解码

x' 解密

y'

信道解码

信息论与编码期末考试题(全套)..

分) (2)(3分)最大后验概率准则下,有,八(10').二元对称信道如图。

1)若,,求、和()430=p ()411=p ()X H ()Y X H |;()Y X I ; 2)求该信道的信道容量。

解:1)共6分(14.3)(71==∑=i i i l a p L 831.014.361.2)(===LX H R1)求此分组码n=?,k=?共有多少码字?2)求此分组码的生成矩阵G 。

3)写出此分组码的所有码字。

4)若接收到码字(101001),求出伴随式并给出翻译结果。

解:1)n=6,k=3,共有8个码字。

(3分)2)设码字由得()012345C C C C C C C =rT T HC 0=(3分)⎪⎩⎪⎨⎧=⊕⊕⊕=⊕⊕=⊕⊕0000135034012C C C C C C C C C C 令监督位为,则有()012C C C(3分)⎪⎩⎪⎨⎧⊕=⊕=⊕=340451352CC C C C C C C C 生成矩阵为 (2分)⎥⎥⎥⎦⎤⎢⎢⎢⎣⎡1011001100100110013)所有码字为000000,001101,010011,011110,100110,101011,110101,111000。

(4分)4)由得TTHR S =,(2分)该码字在第5位发生错误,()101=S (101001)纠正为(101011),即译码为(101001)(1分)(六)一、概念简答题(每题5分,共40分)1.什么是平均自信息量与平均互信息,比较一下这两个概念的异同?2.简述最大离散熵定理。

对于一个有m 个符号的离散信源,其最大熵是多少?3.解释信息传输率、信道容量、最佳输入分布的概念,说明平均互信息与信源的概率分布、信道的传递概率间分别是什么关系?4.对于一个一般的通信系统,试给出其系统模型框图,并结合此图,解释数据处理定理。

5.写出香农公式,并说明其物理意义。

当信道带宽为5000Hz ,信噪比为30dB 时求信道容量。

信息论与编码期末考试题

(一)一、判断题.1. 当随机变量X 和Y 相互独立时,条件熵)|(Y X H 等于信源熵)(X H . ( )2. 由于构成同一空间的基底不是唯一的,所以不同的基底或生成矩阵有可能生成同一码集. ( )3.一般情况下,用变长编码得到的平均码长比定长编码大得多. ( )4. 只要信息传输率大于信道容量,总存在一种信道编译码,可以以所要求的任意小的误差概率实现可靠的通信. ( )5. 各码字的长度符合克拉夫特不等式,是唯一可译码存在的充分和必要条件. ( )6. 连续信源和离散信源的熵都具有非负性. ( )7. 信源的消息通过信道传输后的误差或失真越大,信宿收到消息后对信源存在的不确定性就越小,获得的信息量就越小.8. 汉明码是一种线性分组码. ( )9. 率失真函数的最小值是0. ( )10.必然事件和不可能事件的自信息量都是0. ( )二、填空题1、码的检、纠错能力取决于 .2、信源编码的目的是 ;信道编码的目的是 .3、把信息组原封不动地搬到码字前k 位的),(k n 码就叫做 .4、香农信息论中的三大极限定理是 、 、 .5、设信道的输入与输出随机序列分别为X 和Y ,则),(),(Y X NI Y X I NN =成立的 条件 .6、对于香农-费诺编码、原始香农-费诺编码和哈夫曼编码,编码方法惟一的是 .7、某二元信源01()1/21/2X P X ⎡⎤⎧⎫=⎨⎬⎢⎥⎣⎦⎩⎭,其失真矩阵00a D a ⎡⎤=⎢⎥⎣⎦,则该信源的max D = . 三、计算题.1、某信源发送端有2种符号i x )2,1(=i ,a x p =)(1;接收端有3种符号i y )3,2,1(=j ,转移概率矩阵为1/21/201/21/41/4P ⎡⎤=⎢⎥⎣⎦. (1) 计算接收端的平均不确定度()H Y ;(2) 计算由于噪声产生的不确定度(|)H Y X ;(3) 计算信道容量以及最佳入口分布.(二)一、填空题1、信源编码的主要目的是 ,信道编码的主要目的是 。

信息论与编码期末复习试题2套含答案(大学期末复习资料)

莆田学院期末考试试卷(A)卷2011 — 2012 学年第一学期课程名称:信息论与编码适用年级/专业: 09/电信(通信)试卷类别开卷()闭卷(√)学历层次本科考试用时 120分钟《.考生注意:答案要全部抄到答题纸上,做在试卷上不给分.........................》.一、简答题(每小题8分,共32分)1.对于一个一般的通信系统,试给出其系统模型框图,并结合此图,解释数据处理定理。

2. 香农信息论研究了哪些内容?试讲述香农第二编码定理。

3. 什么是唯一可译码?什么是即时码(前缀码)?构造唯一可译码的充要条件?(10分)4. 什么是信源编码?什么是信道编码?为何要进行这两者编码?二、证明题(每小题6分,共6分)对于任意的事件X、Y,试证明下列不等式成立:H(X|Y)<=H(X),并说明等式成立的条件。

三、计算题(第1、5题各16分,第2题12分,第3题10分,第4题8分,共62分)1.(16分)一黑白气象传真图的消息只有黑色和白色两种,即信源X={黑,白}。

设黑色出现的概率为P(黑)=0.3,白色的出现概率P(白)=0.7。

求(1)假设图上黑白消息出现前后没有关联,求熵H(X);(2)假设消息前后有关联,其依赖关系为P(白/白)=0.9,P(黑/白)=0.1,P(白/黑)=0.2,P(黑/黑)=0.8,求此一阶马尔可夫信源的熵H2(X);(3)分别求上述两种信源的剩余度,比较和的大小,并说明其物理意义。

2.(12分)一信源产生概率为P(1)=0.005, P(0)=0.995的统计独立二进制数符。

这些数符组成长度为100的数符组。

我们为每一个少于3个“1”的源数符组提供一个二进制码字,所有码字的长度相等。

(1)求出为所规定的所有源符组都提供码字所需的最小码长。

(2)求信源发出一数符组,而编码器无相应码字的概率。

3.(10分)已知一个(6,3)线性分组码的全部码字为001011,110011,010110,101110,100101,111000,011101,000000。

2020年信息论与编码期末考试题

信息论与编码期末考试题(一)一、判断题. 当随机变量和相互独立时,条件熵等于信源熵. ()由于构成同一空间的基底不是唯一的,所以不同的基底或生成矩阵有可能生成同一码集. ()一般情况下,用变长编码得到的平均码长比定长编码大得多. ()只要信息传输率大于信道容量,总存在一种信道编译码,可以以所要求的任意小的误差概率实现可靠的通信. ()各码字的长度符合克拉夫特不等式,是唯一可译码存在的充分和必要条件. ()连续信源和离散信源的熵都具有非负性. ()信源的消息通过信道传输后的误差或失真越大,信宿收到消息后对信源存在的不确定性就越小,获得的信息量就越小. 汉明码是一种线性分组码. ()率失真函数的最小值是. () 1.必然事件和不可能事件的自信息量都是. ()二、填空题 1、码的检、纠错能力取决于 . 2、信源编码的目的是;信道编码的目的是 . 3、把信息组原封不动地搬到码字前位的码就叫做. 4、香农信息论中的三大极限定理是、、 . 5、设信道的输入与输出随机序列分别为和,则成立的条件 .. 6、对于香农-费诺编码、原始香农-费诺编码和哈夫曼编码,编码方法惟一的是 . 7、某二元信源,其失真矩阵,则该信源的=.三、计算题. 1、某信源发送端有2种符号,;接收端有3种符号,转移概率矩阵为. (1)计算接收端的平均不确定度;(2)计算由于噪声产生的不确定度;(3)计算信道容量以及最佳入口分布. 2、一阶马尔可夫信源的状态转移图如右图所示,信源的符号集为. (1)求信源平稳后的概率分布;(2)求此信源的熵;(3)近似地认为此信源为无记忆时,符号的概率分布为平稳分布.求近似信源的熵并与进行比较. 3、设码符号为,信源空间为试构造一种三元紧致码. 4、设二元线性分组码的生成矩阵为. (1)给出该码的一致校验矩阵,写出所有的陪集首和与之相对应的伴随式;(2)若接收矢量,试计算出其对应的伴随式并按照最小距离译码准则试着对其译码. (二)一、填空题 1、信源编码的主要目的是,信道编码的主要目的是。

信息论与编码期末复习

第三部分、信道编码

3.2 线性分组码

3.2 线性分组码:

码长为n,信息位为k ,记作(n , k); 监督位r =n-k

1、编码

C = K•G

和 P(X)Y0 0..1 22 10 0..1 04 90 0..3 05 9

H(Y | X)= – 0.21log0.3 –0.14log0.2 –0.35log0.5

–0.12log0.4 –0.09log0.3–0.09log0.3

= 1.5114 bit/符号

m

(4)接收符号熵:由 p(yj ) p(xi yj ) i1 P(Y)=(0.21+0.12,0.14+0.09,0.35+0.09)

第二部分、无失真信源编码

2.2 编码方法

1.2 编码方法:

1、Huffman编码:

(1)信源符号按概率大小排队。

(2)合并概率最小的两个符合为一个节点。 (3)节点参与排队放在与自己概率相等符号后面。 (4)重复这个过程直到合并完全部符号。 (5)标记每个分支的的0与1。 (6)从根到叶的路径就给出了相应符号的码字。 (7)计算平均码长与编码效率。

i1

(2)噪声熵 (散布度):

ms

H (Y|X) p(aibj)lop(g bj|ai)

i 1j 1m s

(3)联合熵: H(X)Y p(aibj)lop(g aibj)

i1j1

(4)接收符号熵:

m

H(Y) p(bj)lopg(bj)

(5)损失熵(后验熵):

i1

ms

H (X|Y) p(aibj)lop(g ai|bj)

信息论与编码期末考试题----学生复习用

《信息论基础》参考答案一、填空题1、信源编码的主要目的是提高有效性,信道编码的主要目的是提高可靠性。

2、信源的剩余度主要来自两个方面,一是信源符号间的相关性,二是信源符号的统计不均匀性。

3、三进制信源的最小熵为0,最大熵为32log bit/符号。

4、无失真信源编码的平均码长最小理论极限制为信源熵(或H(S)/logr= H r (S))。

5、当R=C 或(信道剩余度为0)时,信源与信道达到匹配。

6、根据信道特性是否随时间变化,信道可以分为恒参信道和随参信道。

7、根据是否允许失真,信源编码可分为无失真信源编码和限失真信源编码。

8、若连续信源输出信号的平均功率为2σ,则输出信号幅度的概率密度是高斯分布或正态分布或()22212x f x eσπσ-=时,信源具有最大熵,其值为值21log 22e πσ。

9、在下面空格中选择填入数学符号“,,,=≥≤〉”或“〈”(1)当X 和Y 相互独立时,H (XY )=H(X)+H(X/Y)=H(Y)+H(X)。

(2)()()1222H X X H X =≥()()12333H X X X H X =(3)假设信道输入用X 表示,信道输出用Y 表示。

在无噪有损信道中,H(X/Y)> 0, H(Y/X)=0,I(X;Y)<H(X)。

三、已知信源1234560.20.20.20.20.10.1S s s s s s s P ⎡⎤⎡⎤=⎢⎥⎢⎥⎣⎦⎣⎦(1)用霍夫曼编码法编成二进制变长码;(6分) (2)计算平均码长L ;(4分)(3)计算编码信息率R ';(2分)(4)计算编码后信息传输率R ;(2分) (5)计算编码效率η。

(2分)(1)010101111.00.20.20.20.20.10.11S 2S 3S 4S 5S 6S编码结果为:1234560001100101110111S S S S S S ====== (2)610.420.63 2.6i i i L P ρ===⨯+⨯=∑码元符号(3)bit log r=2.6R L '=符号(4)() 2.53bit0.9732.6H S R L ===码元其中,()()bit 0.2,0.2,0.2,0.2,0.1,0.1 2.53H S H ==符号 (5)()()0.973log H S H S L rLη===四、某信源输出A 、B 、C 、D 、E 五种符号,每一个符号独立出现,出现概率分别为1/8、1/8、1/8、1/2、1/8。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

②状态转移概率矩阵、状态转移图、网格图转换关系;

③平稳马尔可夫信源熵的计算;

④状态平稳分布计算。

第五章

1、区分非奇异码与奇异码、异前置码;

2、区分及时码与非及时码;

3、求非唯一可译码;

对于定长码:非奇异码即为唯一可译码;

非奇异码

变长码:同时满足{

;

异前置码

4、编码定理的掌握;Kraft 定理的理解;

(4)η = ������ = 0.831

������������������������

或者η

=

������(������) ������′

=

0.831

7/7

=

∑������

������(������������ )������(������/������������ )

=

������(0)������

(������)

0

+

������(1)������

(������)

1

+

������(2)������

(������)

2

= 1 ������[���̅���, 0, ������] + 1 ������[������, ���̅���, 0] + 1 ������[0, ������, ���̅���] = ������[������]

1/36。不同点出现时有 15 种,概率 1/18。

H(i,

j)

=

6

∗

1 36

∗

log2

36

+

15

∗

1 18

∗

log2

18

=

4.3366������������������/事件

(4)

i + j 2 3 4 5 6 7 8 9 10 11 12

P(i + j) 1 2 3 4 5 6 5 4 3 2 1 36 36 36 36 36 36 36 36 36 36 36

由状态转移图可知:该马尔可夫链具有遍历性,平稳后状态的

极限分布存在。

由∑������ ������������ ������������������ = ������������和 ∑������ ������������������ = ������������可得方程组

������1 = ���̅���������1 + ������������2 ������2 = ���̅���������2 + ������������3 ������3 = ������������1 + ���̅���������3 {������1+������2 + ������3 = 1

001

������3

011

������4

100

������5

101

������6

1110

6/7

《信息论与编码》复习

������7

1110

(1)计算平均码长���̅���;

(2)编码后信息传输率 R;

(3)编码信息率R‘;

(4)编码效率η。

解:(1)

�Байду номын сангаас����

���̅��� = ∑ ������(������������)������������ = 3.14 (码元/信源符号)

������=0

11

H(Y|X) = − ∑ ∑ P(������������)P(������������|������������)logP(������������|������������) = 0.918 bit/符号

������=0 ������=0

H(XY)=H(X)+H(y|x)=1.729 bit/符号

例题

例 1:同时掷两个正常的骰子,也就是各面呈现的概率都是 l/6,求:

(1)“3 和 5 同时出现”事件的自信息量;

(2)“两个 1 同时出现”事件的自信息量;

(3) 两个点数的各种组合(无序对)的熵或平均信息量;

(4) 两个点数之和(即 2,3,„,12 构成的子集)的熵;

(5) 两个点数中至少有一个是 1 的自信息。

3

3

3

例 4:设二进制对称信道的概率转移矩阵为[21//33 12//33],

(1)若P(������0)

=

3 4

,P(������1)

+

1/4,求

H(X),H(X|Y),H(Y|X)和

I(X;Y)。

(2)求该信道的信道容量及其达到信道容量时的输入概率分布.

解:(1)

1

H(X) = − ∑ ������(������������)������������������������(������������) = 0.811 ������������������/符号

������=0 5/7

《信息论与编码》复习

P(������0) = P(������0)P(������0|������0) + P(������1)P(������0|������1) = 7/12

P(������������) = 1 − P(������0) = 5/12

1

H(Y) = − ∑ ������(������������)������������������������(������������) = 0.980 ������������������/符号

解:(1)P(3、5 或 5、3)=P(3、5)+P(5、3)=1/18

I = log2 18 = 4.1699������������������ (2)P(1、1)=l/36。I = log2 36 = 5.1699������������������ (3)相同点出现时(11、22、33、44、55、66)有 6 种,概率

������=1

例 5:对信源*������������+ = *0������.12

������2 0.19

������3 0.18

������4 0.17

������5 0.15

������6 0.10

0���.���071+进行

二元编码,编码方案为

信息符号

对应码字

������1

000

������2

5、变长码中求������;̅

6、二元、三元哈夫曼编码;编码效率;信息传输速率的计算;

第六章

1、离散信道模型; 2、无噪信道中,无损、确定、无损确定的判断;容量 C 的求解;

2/7

《信息论与编码》复习

3、对称信道容量 C 的计算; 4、级联信道容量 C 的计算; 5、并联、和信道容量 C 的计算;

第三章

离散无记忆信源 主要考点 {

离散马尔可夫信源 离散无记忆信源

信源符号的概率模型

①*���P���+ = *������(������1������)1

������2 … … ������������ ������(������2) … … P(������������)

+

1/7

《信息论与编码》复习

H(X|Y)=H(XY)-H(Y)=0.749 bit/符号

I(X;Y)=H(X)-H(X|Y)=0.062 bit/符号

(2)该信道为对称 DMC 信道,因此在P(������0) = P(������1) = 1/2时,取得 信道容量为:

2

C = log2 + ∑ ������������������������������������������������������ = 0.082 ������������������/符号

②*������������+ P

=

[������(������������1′1′ )

������2′ … … ���������′��� ������(������2′ ) … … P(���������′���)

]

H(X)、H(������������) 的计算。

离散马尔可夫信源

①离散马尔可夫信源的定义;

《信息论与编码》复习

《信息论与编码》复习

第一章

通信系统的模型、主要性能指标

第二章

1、自信息、联合自信息、条件自信息的求解; 2、自信息的物理含义; 3、互信息求解、物理含义、性质; 4、条件互信息求解; 5、信息熵、条件殇、联合熵的计算; 6、信息熵的物理含义; 7、平均互信息的计算,与各熵的关系; 注:这章几基本概念较多,同学们要注意理解

例 2:居住某地区的女孩中有 25%是大学生,在女大学生中有 75% 身高为 1.6m 以上,而女孩中身高 1.6m 以上的占总数一半。假如得知 “身高 1.6m 以上的某女孩是大学生”的消息,问获得多少信息量? 解:P(女大学生)=1/4;

P(身高>1.6m / 女大学生)=3/4; P(身高>1.6m)=1/2; P(女大学生/身高>1.6m)=P(身高>1.6m、女大学生)/P(身高>1.6m) =3/4*1/4*2=3/8; I=log2(8/3)=1.4150bit。

H(i+j)=H(1/36 2/36 3/36 4/36 5/36 6/36 5/36 4/36 3/36 2/36 1/36)

=3.2744bit/事件。

3/7

《信息论与编码》复习

(5)P(1、1or1、j or i、 1)=1/36+5/36+5/36=11/36。 I= log2(36/11)=1.7105bit/事件

������=1

(2)H(S)=2.61(比特/信源符号)