《人工神经网络原理与应用》试题

人工神经网络原理第8章习题参考答案

1.人工神经网络适合于解决哪些问题?试举例说明。

人工神经网络技术在处理对内部规律不甚了解,也不能用一组规则和方程等数学表达式描述的较为复杂的问题时具有一定的优越性,尤其对容错性有一定要求的任务,例如图形的检测与识别、诊断、特征提取、推论等,人工神经网络都是比较合适的处理手段,对于上述任务,即使输入数据是模糊的或不完善的,人工神经网络仍然能够对其进行处理。

示例略。

2.一个人工神经网络应用的开发要经过哪些阶段?明确需求、选取模型、设计神经网络节点、设计神经网络结构、设计神经网络训练算法、选择训练和测试样本、网络训练与测试、实现神经网络。

3.若要用神经网络实现对0~9十个数字字符的识别,应当如何选取适当的人工神经网络模型?参见表8-1,可以选择BP、Hopfield等神经网络模型。

4.若要实现一个简单的交通标志识别系统,应当如何选取适当的人工神经网络模型?参见表8-1,可以选择BP、Hopfield等神经网络模型。

5.若有一个私人医生,每天可接受10个预约病人的上门服务。

若要为该医生设计一条当天的巡诊路线,以使该医生的巡诊距离最短,应当如何选取适当的人工神经网络模型?这是一个优化问题,可以选择Hopfield神经网络。

6.试述对习题2、3、4中选取的人工神经网络模型进行设计开发的全过程。

略。

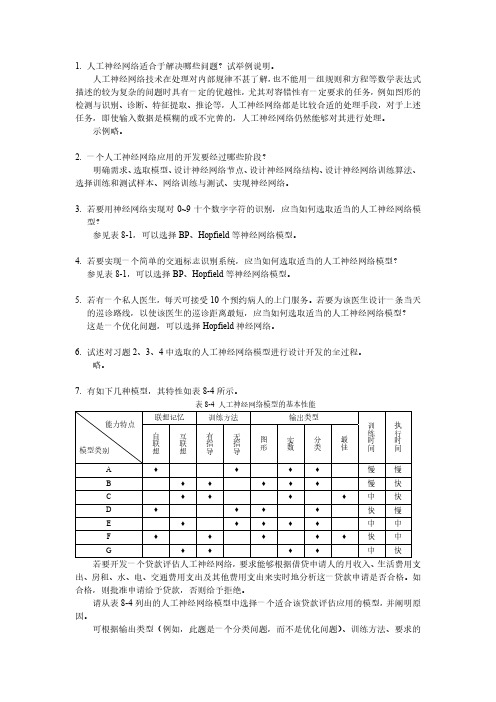

7.有如下几种模型,其特性如表8-4所示。

表8-4 人工神经网络模型的基本性能若要开发一个贷款评估人工神经网络,要求能够根据借贷申请人的月收入、生活费用支出、房租、水、电、交通费用支出及其他费用支出来实时地分析这一贷款申请是否合格。

如合格,则批准申请给予贷款,否则给予拒绝。

请从表8-4列出的人工神经网络模型中选择一个适合该贷款评估应用的模型,并阐明原因。

可根据输出类型(例如,此题是一个分类问题,而不是优化问题)、训练方法、要求的训练时间和执行时间等选取各项指标都符合具体需求的模型。

此题只是一个示例,让读者掌握如何选取适当的人工神经网络模型,具体选取过程略。

人工神经网络试卷

一、填空题1、人工神经网络是生理学上的真实人脑神经网络的结构和功能,以及若干基本特性的某种理论抽象、简化和模拟而构成的一种信息处理系统。

从系统的观点看,人工神经网络是由大量神经元通过及其丰富和完善的连接而构成的自适应非线性动态系统。

2、神经元(即神经细胞)是由细胞体、树突、轴突和突触四部分组成。

3、NN的特点:信息的分布存储、大规模并行协同处理、自学习、自组织、自适应性、NN大量神经元的集体行为。

4、膜电位:以外部电位作为参考电位的内部电位。

5、神经元的兴奋:产生膜电位约为100mv,时宽约为1ms,分为四个过程:输入信号期、兴奋期、绝对不应期、相对不应期。

6、神经元的动作特征:空间性相加、时间性相加、阀值作用、不应期、疲劳、可塑性。

7、阀值作用:膜电位上升不超过一定值55mv,神经元不兴奋。

8、学习形式按照输出y划分为:二分割学习、输出值学习、无教师学习。

9、权重改变方式:训练期的学习方式、模式学习方式。

10、稳定的平稳状态指当由于某些随机因素的干扰,使平衡状态发生偏移,随着时间的推移,偏移越来越小,系统最后回到平衡状态。

二、简答题1、学习规则可以分为那几类?答:(1)相关规则:仅根据连接间的激活水平改变权系;(2)纠错规则:基于或等效于梯度下降方法,通过在局部最大改善的方向上,按照小步逐次进行修正,力图达到表示函数功能问题的全局解;(3)无导师学习规则:学习表现为自适应与输入空间的检测规则。

2、简述神经网络按照不同标准分类。

答:按网络结构分为前馈型和反馈型;按网络的性能分为连续性和离散性、确定性和随机性网络;按照学习方式分为有导师(指导)和无导师(自组织学习包括在内)学习;按照突触连接性质分为一阶线性关联与高阶非线性关联网络。

3、误差反传算法的主要思想?答:误差反传算法把学习过程分为两个阶段:第一阶段(正向传播过程),给出输入信息通过输入层经隐含层逐层处理并计算每个单元的实际输出值;第二阶段(反向过程),若在输出层未能得到期望的输出值,则逐层递归的计算实际输出与期望输出之差值(即误差),以便根据此差调节权值。

人工神经网络单选练习题

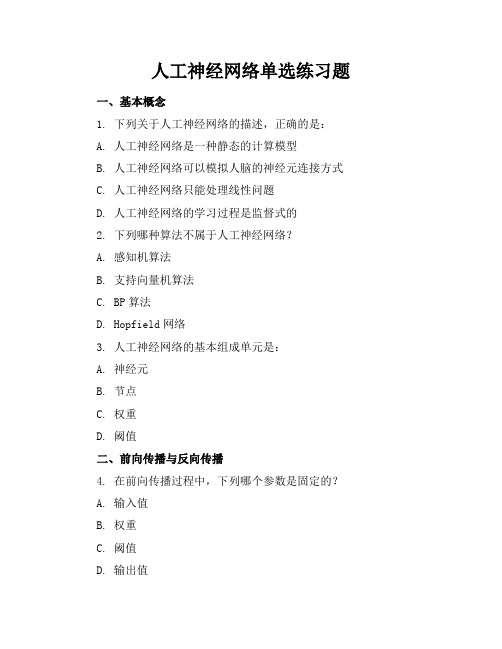

人工神经网络单选练习题一、基本概念1. 下列关于人工神经网络的描述,正确的是:A. 人工神经网络是一种静态的计算模型B. 人工神经网络可以模拟人脑的神经元连接方式C. 人工神经网络只能处理线性问题D. 人工神经网络的学习过程是监督式的2. 下列哪种算法不属于人工神经网络?A. 感知机算法B. 支持向量机算法C. BP算法D. Hopfield网络3. 人工神经网络的基本组成单元是:A. 神经元B. 节点C. 权重D. 阈值二、前向传播与反向传播4. 在前向传播过程中,下列哪个参数是固定的?A. 输入值B. 权重C. 阈值D. 输出值5. 反向传播算法的主要目的是:A. 更新输入值B. 更新权重和阈值C. 计算输出值D. 初始化网络参数6. 下列关于BP算法的描述,错误的是:A. BP算法是一种监督学习算法B. BP算法可以用于多层前馈神经网络C. BP算法的目标是最小化输出误差D. BP算法只能用于解决分类问题三、激活函数7. 下列哪种激活函数是非线性的?A. 步进函数B. Sigmoid函数C. 线性函数D. 常数函数8. ReLU激活函数的优点不包括:A. 计算简单B. 避免梯度消失C. 提高训练速度D. 减少过拟合9. 下列哪种激活函数会出现梯度饱和现象?A. Sigmoid函数B. ReLU函数C. Tanh函数D. Leaky ReLU函数四、网络结构与优化10. 关于深层神经网络,下列描述正确的是:A. 深层神经网络一定比浅层神经网络效果好B. 深层神经网络更容易过拟合C. 深层神经网络可以减少参数数量D. 深层神经网络训练速度更快11. 下列哪种方法可以降低神经网络的过拟合?A. 增加训练数据B. 减少网络层数C. 增加网络参数D. 使用固定的学习率12. 关于卷积神经网络(CNN),下列描述错误的是:A. CNN具有局部感知能力B. CNN具有参数共享特点C. CNN可以用于图像识别D. CNN无法处理序列数据五、应用场景13. 下列哪种问题不适合使用人工神经网络解决?A. 图像识别B. 自然语言处理C. 股票预测D. 线性规划14. 下列哪个领域不属于人工神经网络的应用范畴?A. 医学诊断B. 金融预测C. 智能家居D. 数值计算15. 关于循环神经网络(RNN),下列描述正确的是:A. RNN无法处理长距离依赖问题B. RNN具有短期记忆能力C. RNN训练过程中容易出现梯度消失D. RNN只能处理序列长度相同的数据六、训练技巧与正则化16. 下列哪种方法可以用来防止神经网络训练过程中的过拟合?A. 提前停止B. 增加更多神经元C. 减少训练数据D. 使用更大的学习率17. 关于Dropout正则化,下列描述错误的是:A. Dropout可以减少神经网络中的参数数量B. Dropout在训练过程中随机丢弃一些神经元C. Dropout可以提高模型的泛化能力D. Dropout在测试阶段不使用18. L1正则化和L2正则化的主要区别是:A. L1正则化倾向于产生稀疏解,L2正则化倾向于产生平滑解B. L1正则化比L2正则化更容易计算C. L2正则化可以防止过拟合,L1正则化不能D. L1正则化适用于大规模数据集,L2正则化适用于小规模数据集七、优化算法19. 关于梯度下降法,下列描述正确的是:A. 梯度下降法一定会找到全局最小值B. 梯度下降法在鞍点处无法继续优化C. 梯度下降法包括批量梯度下降、随机梯度下降和小批量梯度下降D. 梯度下降法的学习率在整个训练过程中保持不变20. 下列哪种优化算法可以自动调整学习率?A. 随机梯度下降(SGD)B. Adam优化算法C. Momentum优化算法D. 牛顿法21. 关于Adam优化算法,下列描述错误的是:A. Adam结合了Momentum和RMSprop算法的优点B. Adam算法可以自动调整学习率C. Adam算法对每个参数都使用相同的学习率D. Adam算法在训练初期可能会不稳定八、损失函数22. 在分类问题中,下列哪种损失函数适用于二分类问题?A. 均方误差(MSE)B. 交叉熵损失函数C. Hinge损失函数D. 对数损失函数23. 关于均方误差(MSE)损失函数,下列描述错误的是:A. MSE适用于回归问题B. MSE对异常值敏感C. MSE的输出范围是[0, +∞)D. MSE损失函数的梯度在接近最小值时趋近于024. 下列哪种损失函数适用于多分类问题?A. 交叉熵损失函数B. Hinge损失函数C. 对数损失函数D. 均方误差(MSE)九、模型评估与超参数调优25. 下列哪种方法可以用来评估神经网络的性能?A. 训练误差B. 测试误差C. 学习率D. 隐层神经元数量26. 关于超参数,下列描述正确的是:A. 超参数是在模型训练过程中自动学习的B. 超参数的值通常由经验丰富的专家设定C. 超参数的调整对模型性能没有影响D. 超参数包括学习率、批量大小和损失函数27. 关于交叉验证,下列描述错误的是:A. 交叉验证可以减少过拟合的风险B. 交叉验证可以提高模型的泛化能力C. 交叉验证会降低模型的训练速度D. 交叉验证适用于小规模数据集十、发展趋势与挑战28. 下列哪种技术是近年来人工神经网络的一个重要发展方向?A. 深度学习B. 线性回归C. 决策树D. K最近邻29. 关于深度学习,下列描述错误的是:A. 深度学习需要大量标注数据B. 深度学习模型通常包含多层神经网络C. 深度学习可以处理复杂的非线性问题D. 深度学习不适用于小规模数据集30. 下列哪种现象是训练深度神经网络时可能遇到的挑战?A. 梯度消失B. 参数过多C. 数据不平衡D. 所有上述选项都是挑战答案一、基本概念1. B2. B二、前向传播与反向传播4. B5. B6. D三、激活函数7. B8. D9. A四、网络结构与优化10. B11. A12. D五、应用场景13. D14. D15. C六、训练技巧与正则化16. A17. A18. A七、优化算法19. C20. B八、损失函数22. B23. D24. A九、模型评估与超参数调优25. B26. B27. D十、发展趋势与挑战28. A29. D30. D。

人工神经网络题库

人工神经网络系别:计算机工程系班级: 1120543 班学号: 13 号姓名:日期:2014年10月23日人工神经网络摘要:人工神经网络是一种应用类似于大脑神经突触联接的结构进行信息处理的数学模型。

在工程与学术界也常直接简称为神经网络或类神经网络。

神经网络是一种运算模型,由大量的节点(或称神经元)之间相互联接构成,由大量处理单元互联组成的非线性、自适应信息处理系统。

它是在现代神经科学研究成果的基础上提出的,试图通过模拟大脑神经网络处理、记忆信息的方式进行信息处理。

关键词:神经元;神经网络;人工神经网络;智能;引言人工神经网络的构筑理念是受到生物(人或其他动物)神经网络功能的运作启发而产生的。

人工神经网络通常是通过一个基于数学统计学类型的学习方法(Learning Method )得以优化,所以人工神经网络也是数学统计学方法的一种实际应用,通过统计学的标准数学方法我们能够得到大量的可以用函数来表达的局部结构空间,另一方面在人工智能学的人工感知领域,我们通过数学统计学的应用可以来做人工感知方面的决定问题(也就是说通过统计学的方法,人工神经网络能够类似人一样具有简单的决定能力和简单的判断能力),这种方法比起正式的逻辑学推理演算更具有优势。

一、人工神经网络的基本原理1-1神经细胞以及人工神经元的组成神经系统的基本构造单元是神经细胞,也称神经元。

它和人体中其他细胞的关键区别在于具有产生、处理和传递信号的功能。

每个神经元都包括三个主要部分:细胞体、树突和轴突。

树突的作用是向四方收集由其他神经细胞传来的信息,轴突的功能是传出从细胞体送来的信息。

每个神经细胞所产生和传递的基本信息是兴奋或抑制。

在两个神经细胞之间的相互接触点称为突触。

简单神经元网络及其简化结构如图2-2所示。

从信息的传递过程来看,一个神经细胞的树突,在突触处从其他神经细胞接受信号。

这些信号可能是兴奋性的,也可能是抑制性的。

所有树突接受到的信号都传到细胞体进行综合处理,如果在一个时间间隔内,某一细胞接受到的兴奋性信号量足够大,以致于使该细胞被激活,而产生一个脉冲信号。

人工神经网络原理第4章习题参考答案

1. 试比较BP 学习算法与感知机学习算法的异同。

同:两种学习算法均基于纠错学习规则,采用有指导的学习方式,根据来自输出节点的外部反馈(期望输出)调整连接权,使得网络输出节点的实际输出与外部的期望输出一致。

异:感知机学习算法中,隐含层处理单元不具备学习能力,其模式分类能力仍然非常有限;而BP 学习算法采用非线性连续变换函数,使隐含层神经元具有了学习能力。

BP 学习算法基于最小均方误差准则,采用误差函数按梯度下降的方法进行学习,其学习过程分为模式顺传播,误差逆传播、记忆训练、学习收敛4个阶段。

2. 试述BP 神经网络有哪些优点和缺点。

优点:具有良好的非线性映射能力、泛化能力和容错能力。

缺点:学习算法的收敛速度慢;存在局部极小点;隐含层层数及节点数的选取缺乏理论指导;训练时学习新样本有遗忘旧样本的趋势。

3. 试举例说明BP 神经网络擅长解决哪些问题,并针对一个具体应用实例,描述BP 神经网络解决该问题的具体方案。

擅长解决函数拟合问题(例如,拟合多项式函数),线性与非线性的分类问题(例如,疾病病例分类),预测问题(例如,房屋价格预测),模式识别问题(例如,手写数字识别)。

具体应用实例及解决方案略。

4. 请给出一个BP 神经网络的具体应用实例。

略。

5. 什么是BP 神经网络的泛化能力?如何提高BP 神经网络的泛化能力?BP 神经网络的泛化能力是指BP 神经网络对未训练样本的逼近程度或对于未知数据的预测能力。

即:BP 神经网络学习训练完成后会将所提取的样本模式对中的非线性映射关系存储在网络连接权向量中,在其后的正常工作阶段,当向BP 神经网络输入训练时未曾见过的数据时,BP 神经网络也能够完成由输入模式到输出模式的正确映射。

提高BP 神经网络泛化能力的方法包括: 1) 增加训练集中的样本数; 2) 适当减少隐藏节点个数;3) 增加网络结构中的因子数(考虑更多可能影响结果的因子作为额外的输入项); 4) 对于选取的数据样本,要尽量保证包含拐点处的数据样本,同时尽可能保证相邻样本的变化率小于误差精度要求。

人工神经网络及应用知到章节答案智慧树2023年长安大学

人工神经网络及应用知到章节测试答案智慧树2023年最新长安大学第一章测试1.Synapse is the place where neurons connect in function. It is composed ofpresynaptic membrane, synaptic space and postsynaptic membrane.()参考答案:对2.Biological neurons can be divided into sensory neurons, motor neurons and()according to their functions.参考答案:interneurons3.Neurons and glial cells are the two major parts of the nervous system. ()参考答案:对4.Neurons are highly polarized cells, which are mainly composed of two parts:the cell body and the synapse. ()参考答案:对5.The human brain is an important part of the nervous system, which containsmore than 86 billion neurons. It is the central information processingorganization of human beings. ()参考答案:对第二章测试1.In 1989, Mead, the father of VLSI, published his monograph "( )", in which agenetic neural network model based on evolutionary system theory wasproposed.参考答案:Analog VLSI and Neural Systems2.In 1989, Yann Lecun proposed convolutional neural network and applied itto image processing, which should be the earliest application field of deeplearning algorithm. ()参考答案:对3.In 1954, Eccles, a neurophysiologist at the University of Melbourne,summarized the principle of Dale, a British physiologist, that "each neuron secretes only one kind of transmitter ".()参考答案:对4.In 1972, Professor Kohonen of Finland proposed a self-organizing featuremap (SOFM) neural network model. ()参考答案:对5.Prediction and evaluation is an activity of scientific calculation andevaluation of some characteristics and development status of things orevents in the future according to the known information of objective objects.()参考答案:对第三章测试1.The function of transfer function in neurons is to get a new mapping outputof summer according to the specified function relationship, and thencompletes the training of artificial neural network. ()参考答案:对2.The determinant changes sign when two rows (or two columns) areexchanged. The value of determinant is zero when two rows (or two columns) are same. ()参考答案:对3.There are two kinds of phenomena in the objective world. The first is thephenomenon that will happen under certain conditions, which is calledinevitable phenomenon. The second kind is the phenomenon that may ormay not happen under certain conditions, which is called randomphenomenon. ()参考答案:对4.Logarithmic S-type transfer function, namely Sigmoid function, is also calledS-shaped growth curve in biology. ()参考答案:对5.Rectified linear unit (ReLU), similar to the slope function in mathematics, isthe most commonly used transfer function of artificial neural network. ()参考答案:对第四章测试1.The perceptron learning algorithm is driven by misclassification, so thestochastic gradient descent method is used to optimize the loss function. ()参考答案:misclassification2.Perceptron is a single-layer neural network, or neuron, which is the smallestunit of neural network. ()参考答案:对3.When the perceptron is learning, each sample will be input into the neuronas a stimulus. The input signal is the feature of each sample, and the expected output is the category of the sample. When the output is different from thecategory, we can adjust the synaptic weight and bias value until the output of each sample is the same as the category. ()参考答案:对4.If the symmetric hard limit function is selected for the transfer function, theoutput can be expressed as . If the innerproduct of the row vector and the input vector in the weight matrix is greater than or equal to -b, the output is 1, otherwise the output is -1. ()参考答案:对5.The basic idea of perceptron learning algorithm is to input samples into thenetwork step by step, and adjust the weight matrix of the network according to the difference between the output result and the ideal output, that is tosolve the optimization problem of loss function L(w,b). ()参考答案:对第五章测试1.The output of BP neural network is ()of neural network.参考答案:the output of the last layer2.BP neural network has become one of the most representative algorithms inthe field of artificial intelligence. It has been widely used in signal processing, pattern recognition, machine control (expert system, data compression) and other fields. ()参考答案:对3.In 1974, Paul Werbos of the natural science foundation of the United Statesfirst proposed the use of error back propagation algorithm to train artificial neural networks in his doctoral dissertation of Harvard University, anddeeply analyzed the possibility of applying it to neural networks, effectively solving the XOR loop problem that single sensor cannot handle. ()参考答案:对4.In the standard BP neural network algorithm and momentum BP algorithm,the learning rate is a constant that remains constant throughout the training process, and the performance of the learning algorithm is very sensitive to the selection of the learning rate. ()参考答案:对5.L-M algorithm is mainly proposed for super large scale neural network, andit is very effective in practical application. ()参考答案:错第六章测试1.RBF neural network is a novel and effective feedforward neural network,which has the best local approximation and global optimal performance. ()参考答案:对2.At present, RBF neural network has been successfully applied in nonlinearfunction approximation, time series analysis, data classification, patternrecognition, information processing, image processing, system modeling,control and fault diagnosis. ()参考答案:对3.The basic idea of RBF neural network is to use radial basis function as the"basis" of hidden layer hidden unit to form hidden layer space, and hiddenlayer transforms input vector. The input data transformation of lowdimensional space is mapped into high-dimensional space, so that theproblem of linear separability in low-dimensional space can be realized inhigh-dimensional space. ()参考答案:对4.For the learning algorithm of RBF neural network, the key problem is todetermine the center parameters of the output layer node reasonably. ()参考答案:错5.The method of selecting the center of RBF neural network by self-organizinglearning is to select the center of RBF neural network by k-means clustering method, which belongs to supervised learning method. ()参考答案:错第七章测试1.In terms of algorithm, ADALINE neural network adopts W-H learning rule,also known as the least mean square (LMS) algorithm. It is developed fromthe perceptron algorithm, and its convergence speed and accuracy have been greatly improved. ()参考答案:对2.ADALINE neural network has simple structure and multi-layer structure. It isflexible in practical application and widely used in signal processing, system identification, pattern recognition and intelligent control. ()参考答案:对3.When there are multiple ADALINE in the network, the adaptive linear neuralnetwork is also called Madaline which means many Adaline neural networks.()参考答案:对4.The algorithm used in single-layer ADALINE network is LMS algorithm,which is similar to the algorithm of perceptron, and also belongs tosupervised learning algorithm. ()参考答案:对5.In practical application, the inverse of the correlation matrix and thecorrelation coefficient are not easy to obtain, so the approximate steepestdescent method is needed in the algorithm design. The core idea is that theactual mean square error of the network is replaced by the mean squareerror of the k-th iteration.()参考答案:对第八章测试1.Hopfield neural network is a kind of neural network which combines storagesystem and binary system. It not only provides a model to simulate humanmemory, but also guarantees the convergence to ().参考答案:local minimum2.At present, researchers have successfully applied Hopfield neural network tosolve the traveling salesman problem (TSP), which is the most representative of optimization combinatorial problems. ()参考答案:对3.In 1982, American scientist John Joseph Hopfield put forward a kind offeedback neural network "Hopfield neural network" in his paper NeuralNetworks and Physical Systems with Emergent Collective ComputationalAbilities. ()参考答案:对4.Under the excitation of input x, DHNN enters a dynamic change process, untilthe state of each neuron is no longer changed, it reaches a stable state. Thisprocess is equivalent to the process of network learning and memory, andthe final output of the network is the value of each neuron in the stable state.()参考答案:对5.The order in which neurons adjust their states is not unique. It can beconsidered that a certain order can be specified or selected randomly. Theprocess of neuron state adjustment includes three situations: from 0 to 1, and1 to 0 and unchanged. ()参考答案:对第九章测试pared with GPU, CPU has higher processing speed, and has significantadvantages in processing repetitive tasks. ()参考答案:错2.At present, DCNN has become one of the core algorithms in the field of imagerecognition, but it is unstable when there is a small amount of learning data.()参考答案:错3.In the field of target detection and classification, the task of the last layer ofneural network is to classify. ()参考答案:对4.In AlexNet, there are 650000 neurons with more than 600000 parametersdistributed in five convolution layers and three fully connected layers andSoftmax layers with 1000 categories. ()参考答案:错5.VGGNet is composed of two parts: the convolution layer and the fullconnection layer, which can be regarded as the deepened version of AlexNet.()参考答案:对第十章测试1.The essence of the optimization process of D and G is to find the().参考答案:minimax2.In the artificial neural network, the quality of modeling will directly affect theperformance of the generative model, but a small amount of prior knowledge is needed for the actual case modeling.()参考答案:错3. A GAN mainly includes a generator G and a discriminator D. ()参考答案:对4.Because the generative adversarial network does not need to distinguish thelower bound and approximate inference, it avoids the partition functioncalculation problem caused by the traditional repeated application of Markov chain learning mechanism, and improves the network efficiency. ()参考答案:对5.From the perspective of artificial intelligence, GAN uses neural network toguide neural network, and the idea is very strange. ()参考答案:对第十一章测试1.The characteristic of Elman neural network is that the output of the hiddenlayer is delayed and stored by the feedback layer, and the feedback isconnected to the input of the hidden layer, which has the function ofinformation storage. ()参考答案:对2.In Elman network, the transfer function of feedback layer is nonlinearfunction, and the transfer function of output layer islinear function.()参考答案:对3.The feedback layer is used to memorize the output value of the previous timeof the hidden layer unit and return it to the input. Therefore, Elman neuralnetwork has dynamic memory function.()参考答案:对4.The neurons in the hidden layer of Elman network adopt the tangent S-typetransfer function, while the output layer adopts the linear transfer function. If there are enough neurons in the feedback layer, the combination of thesetransfer functions can make Elman neural network approach any functionwith arbitrary precision in finite time.()参考答案:对5.Elman neural network is a kind of dynamic recurrent network, which can bedivided into full feedback and partial feedback. In the partial recurrentnetwork, the feedforward connection weight can be modified, and thefeedback connection is composed of a group of feedback units, and theconnection weight cannot be modified. ()参考答案:对第十二章测试1.The loss function of AdaBoost algorithm is().参考答案:exponential function2.Boosting algorithm is the general name of a class of algorithms. Theircommon ground is to construct a strong classifier by using a group of weak classifiers. Weak classifier mainly refers to the classifier whose predictionaccuracy is not high and far below the ideal classification effect. Strongclassifier mainly refers to the classifier with high prediction accuracy. ()参考答案:对3.Among the many improved boosting algorithms, the most successful one isthe AdaBoost (adaptive boosting) algorithm proposed by Yoav Freund ofUniversity of California San Diego and Robert Schapire of PrincetonUniversity in 1996. ()参考答案:对4.The most basic property of AdaBoost is that it reduces the training errorcontinuously in the learning process, that is, the classification error rate onthe training data set until each weak classifier is combined into the final ideal classifier. ()参考答案:对5.The main purpose of adding regularization term into the formula ofcalculating strong classifier is to prevent the over fitting of AdaBoostalgorithm, which is usually called step size in algorithm. ()参考答案:对第十三章测试1.The core layer of SOFM neural network is().参考答案:competition layer2.In order to divide the input patterns into several classes, the distancebetween input pattern vectors should be measured according to thesimilarity. ()are usually used.参考答案:Euclidean distance method and cosine method3.SOFM neural networks are different from other artificial neural networks inthat they adopt competitive learning rather than backward propagationerror correction learning method similar to gradient descent, and in a sense, they use neighborhood functions to preserve topological properties of input space. ()参考答案:对4.For SOFM neural network, the competitive transfer function (CTF) responseis 0 for the winning neurons, and 1 for other neurons.()参考答案:错5.When the input pattern to the network does not belong to any pattern in thenetwork training samples, SOFM neural network can only classify it into the closest mode. ()参考答案:对第十四章测试1.The neural network toolbox contains()module libraries.参考答案:five2.The "netprod" in the network input module can be used for().参考答案:dot multiplication or dot division3.The "dotrod" in the weight setting module is a normal dot product weightfunction.()参考答案:错4.The mathematical model of single neuron is y=f(wx+b).()参考答案:对5.The neuron model can be divided into three parts: input module, transferfunction and output module. ()参考答案:对第十五章测试1.In large-scale system software design, we need to consider the logicalstructure and physical structure of software architecture. ()参考答案:对2.The menu property bar has "label" and "tag". The label is equivalent to thetag value of the menu item, and the tag is the name of the menu display.()参考答案:错3.It is necessary to determine the structure and parameters of the neuralnetwork, including the number of hidden layers, the number of neurons inthe hidden layer and the training function.()参考答案:对4.The description of the property "tooltipstring" is the prompt that appearswhen the mouse is over the object. ()参考答案:对5.The description of the property "string" is: the text displayed on the object.()参考答案:对第十六章测试1.The description of the parameter "validator" of the wx.TextCtrl class is: the().参考答案:validator of control2.The description of the parameter "defaultDir" of class wx.FileDialog is: ().参考答案:default path3.In the design of artificial neural network software based on wxPython,creating GUI means building a framework in which various controls can be added to complete the design of software functions. ()参考答案:对4.When the window event occurs, the main event loop will respond and assignthe appropriate event handler to the window event. ()参考答案:对5.From the user's point of view, the wxPython program is idle for a large partof the time, but when the user or the internal action of the system causes the event, and then the event will drive the wxPython program to produce the corresponding action.()参考答案:对。

《人工神经网络:模型、算法及应用》习题参考答案

习题2.1什么是感知机?感知机的基本结构是什么样的?解答:感知机是Frank Rosenblatt在1957年就职于Cornell航空实验室时发明的一种人工神经网络。

它可以被视为一种最简单形式的前馈人工神经网络,是一种二元线性分类器。

感知机结构:2.2单层感知机与多层感知机之间的差异是什么?请举例说明。

解答:单层感知机与多层感知机的区别:1. 单层感知机只有输入层和输出层,多层感知机在输入与输出层之间还有若干隐藏层;2. 单层感知机只能解决线性可分问题,多层感知机还可以解决非线性可分问题。

2.3证明定理:样本集线性可分的充分必要条件是正实例点集所构成的凸壳与负实例点集构成的凸壳互不相交.解答:首先给出凸壳与线性可分的定义凸壳定义1:设集合S⊂R n,是由R n中的k个点所组成的集合,即S={x1,x2,⋯,x k}。

定义S的凸壳为conv(S)为:conv(S)={x=∑λi x iki=1|∑λi=1,λi≥0,i=1,2,⋯,k ki=1}线性可分定义2:给定一个数据集T={(x1,y1),(x2,y2),⋯,(x n,y n)}其中x i∈X=R n , y i∈Y={+1,−1} , i=1,2,⋯,n ,如果存在在某个超平面S:w∙x+b=0能够将数据集的正实例点和负实例点完全正确地划分到超平面的两侧,即对所有的正例点即y i=+1的实例i,有w∙x+b>0,对所有负实例点即y i=−1的实例i,有w∙x+b<0,则称数据集T为线性可分数据集;否则,称数据集T线性不可分。

必要性:线性可分→凸壳不相交设数据集T中的正例点集为S+,S+的凸壳为conv(S+),负实例点集为S−,S−的凸壳为conv(S−),若T是线性可分的,则存在一个超平面:w ∙x +b =0能够将S +和S −完全分离。

假设对于所有的正例点x i ,有:w ∙x i +b =εi易知εi >0,i =1,2,⋯,|S +|。

人工神经网络 试题

1、简要说明误差反向传播的BP算法的基本原理,讨论BP基本算法的优缺点。

并采用BP神经网络进行模式识别。

设计一个BP网络对附图中的英文字母进行分类。

输入向量含16个分量,输出向量分别用[1,-1,-1]T,[-1,1,-1]T,[-1,-1,1]T代表字符A,I,O。

采用不同的学习算法(traingd,traingdm,traingdx,trainlm)进行比较。

并测试施加5%噪声与输入时的测试结果。

要求:给出matlab的源程序(可调用matlab NN工具箱),网络结构,初始权值,训练结果,测试结果。

2、简要说明误差反向传播的BP算法的基本原理,讨论BP基本算法的优缺点。

并采用BP神经网络设计实现一个9*9表。

采用不同的学习算法(traingd,traingdm,traingdx,trainlm)进行比较。

要求:给出matlab的源程序(可调用matlab NN工具箱),网络结构,初始权值,训练结果,测试结果。

(考虑将其中的数改为二进制)3、简要说明误差反向传播的BP算法的基本原理,讨论BP基本算法的优缺点。

表1中给出了某结构在多种状态下的特征向量,表2给出了某时刻结构的特征向量,请使用人工神经网络根据表2中的特征向量判断其所属状态。

表1表2网络结构设计输入个数为10,输出个数为1,故神经元个数为1,结构如下图。

本题是一个模式识别问题,采用自组织竞争人工神经网络。

图1-1 网络结构图画出6个状态在坐标系中如图1-2所示。

%创建输入向量X=[0 1;0 1]clusters=6;points=10;std_dev=0.05;P=nngenc(X,clusters,points,std_dev);plot(P(1,:),P(2,:),'+r')title('Input Vectors');xlabel('p(1)');ylabel('p(2)');%创建自组织竞争神经网络net=newc([0 1;0 1],6,.1);net=init(net);w=net.IW{1};hold off;plot(P(1,:),P(2,:),'+r');hold on; plot(w(:,1),w(:,2),'ob');xlabel('p(1)');ylabel('p(2)');hold off;net.trainParam.epochs=7;hold on;net=init(net);more off;net=train(net,P);TRAINR, Epoch 0/7TRAINR, Epoch 7/7TRAINR, Maximum epoch reached. %训练该网络hold on ;net=init(net); more off;w=net.IW{1};delete(findobj(gcf,'color',[0 0 1])); hold offplot(P(1,:),P(2,:),'+r');hold off;hold on; plot(w(:,1),w(:,2),'ob'); xlabel('p(1)');ylabel('p(2)');hold off;%仿真该网络p=[0.794;0.271];a=sim(net,p);ac=vec2ind(a)。

《人工神经网络原理与应用》试题

《人工神经网络原理与应用》试题1、试论述神经网络的典型结构,常用的作用函数以及各类神经网络的基本作用,举例说明拟定结论。

2、试论述BP 算法的基本思想,讨论BP 基本算法的优缺点,以及改进算法的思路和方法。

以BP 网络求解XOR 问题为例,说明BP 网络隐含层单元个数与收敛速度,计算时间之间的关系。

要求给出计算结果的比较表格,以及相应的计算程序(.m 或者.c )3、试论述神经网络系统建模的几种基本方法。

利用BP 网络对以下非线性系统进行辨识。

非线性系统 )(5.1)1()(1)1()()1(22k u k y k y k y k y k y +-++-=+ 1)首先利用[-1,1]区间的随机信号u(k),样本点500,输入到上述系统,产生y(k), 用于训练BP 网络;2)网络测试,利用u(k)=sin(2*pi*k/10)+1/5*sin(2*pi*k/100),测试点300~500,输入到上述系统,产生y(k),检验BP 网络建模效果要求给出程序流程,matlab 程序否则c 程序,训练样本输入输出图形,检验结果的输入输出曲线。

4、试列举神经网络PID 控制器的几种基本形式,给出相应的原理框图。

5、试论述连续Hopfield 网络的工作原理,讨论网络状态变化稳定的条件。

6、谈谈学习神经网络课程后的心得体会,你准备如何在你的硕士(博士)课题中应用神经网络理论和知识解决问题(给出一到两个例)。

《人工神经网络原理与应用》试题1、试论述神经网络的典型结构,常用的作用函数以及各类神经网络的基本作用,举例说明拟定结论。

2、试论述BP 算法的基本思想,讨论BP 基本算法的优缺点,以及改进算法的思路和方法。

以BP 网络求解XOR 问题为例,说明BP 网络隐含层单元个数与收敛速度,计算时间之间的关系。

要求给出计算结果的比较表格,以及相应的计算程序(.m 或者.c )3、试论述神经网络系统建模的几种基本方法。

神经网络试题

学生姓名__________学号_____________专业___________导师姓名___________ ------------------------密-----------------------封-------------------------线----------------------烟台大学硕士研究生20 09 ~20 10 学年第一学期人工神经网络及其应用试卷一、填空题(20分,每空2分)1. 人工神经网络模型主要考虑:网络连接的拓扑结构、()()等。

2. 神经元的学习方式有:无监督学习、()()。

3. 在人工神经网络中,使用监督学习的神经网络模型有( )、( )等。

4. 人工神经网络结构有()、分布性、互联性、可塑性等特点。

5.( )是修改神经网络权值和偏置值的方法和过程。

6. 现有一个单层神经网络,有6个输入2个输出,则此网络需要神经元数目为 ( ),权值矩阵W的维数为( ) 。

7. 一个单输入神经元的输入是1.0,其权值是1.5,偏置值是—2,则传输函数的净输入是(),当传输函数为硬极限函数,则神经元的输出是()。

8. 硬极限函数a=hardlim (0.02)=( )。

9. Hammin网络是专门为求解()问题而设计的。

10. Hammin网络的目标是()。

11. Hamming网络同时使用了()和(),因此该网络有许多特殊的特性。

12.人工神经网络特有的( )处理能力,克服了传统人工智能方法对于直觉,如模式、语音识别、非结构化信息处理方面的缺陷。

13. 根据连接的拓扑结构,神经网络模型可以分为()和()。

二.简答题(80分)1. 人工神经网络(ANN)的基本功能?(5分)2. Hopfield网络的特点:(5分)3. 感知机的特点:(5分)4. 什么是神经网络?(5分)5. 什么是有监督学习规则?(5分)6. 如何选取一种神经网络的结构?(5分)7. 请列出人工神经网络具有四个基本特征及神经网络应用的相关领域?(5分)8.与门感知机设计步骤?(5分)9. 一个单输入神经元的输入是2.0,其权值是2.1,偏置是-2。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

1 / 1 《人工神经网络原理与应用》试题

试论述神经网络的典型结构,常用的作用函数以及各类神经网络的基本作用,举例说明拟定结论。

试论述BP 算法的基本思想,讨论BP 基本算法的优缺点,以及改进算法的思路和方法。

以BP 网络求解XOR 问题为例,说明BP 网络隐含层单元个数与收敛速度,计算时间之间的关系。

要求给出计算结果的比较表格,以及相应的计算程序(.m 或者.c )试论述神经网络系统建模的几种基本方法。

利用BP 网络对以下非线性系统进行辨识。

非线性系统 )(5.1)

1()(1)1()()1(22k u k y k y k y k y k y +-++-=+ 首先利用[-1,1]区间的随机信号u(k),样本点500,输入到上述系统,产生y(k), 用于训练BP 网络;网络测试,利用u(k)=sin(2*pi*k/10)+1/5*sin(2*pi*k/100),测试点300~500,输入到上述系统,产生y(k),检验BP 网络建模效果要求给出程序流程,matlab 程序否则c 程序,训练样本输入输出图形,检验结果的输入输出曲线。

试列举神经网络PID 控制器的几种基本形式,给出相应的原理框图。

试论述连续Hopfield 网络的工作原理,讨论网络状态变化稳定的条件。

谈谈学习神经网络课程后的心得体会,你准备如何在你的硕士(博士)课题中应用神经网络理论和知识解决问题(给出一到两个例)。

《人工神经网络原理与应用》试题

试论述神经网络的典型结构,常用的作用函数以及各类神经网络的基本作用,举例说明拟定结论。

试论述BP 算法的基本思想,讨论BP 基本算法的优缺点,以及改进算法的思路和方法。

以BP 网络求解XOR 问题为例,说明BP 网络隐含层单元个数与收敛速度,计算时间之间的关系。

要求给出计算结果的比较表格,以及相应的计算程序(.m 或者.c )试论述神经网络系统建模的几种基本方法。

利用BP 网络对以下非线性系统进行辨识。

非线性系统 )(5.1)

1()(1)1()()1(22k u k y k y k y k y k y +-++-=+ 首先利用[-1,1]区间的随机信号u(k), 样本点500,输入到上述系统,产生y(k), 用于训练BP 网络;网络测试,利用u(k)=sin(2*pi*k/10)+1/5*sin(2*pi*k/100),测试点300~500,输入到上述系统,产生y(k),检验BP 网络建模效果要求给出程序流程,matlab 程序否则c 程序,训练样本输入输出图形,检验结果的输入输出曲线。

试列举神经网络PID 控制器的几种基本形式,给出相应的原理框图。

试论述连续Hopfield 网络的工作原理,讨论网络状态变化稳定的条件。

谈谈学习神经网络课程后的心得体会,你准备如何在你的硕士(博士)课题中应用神经网络理论和知识解决问题(给出一到两个例)。