卷积步长计算公式

卷积的几种计算方法以及程序实现FFT算法

数字信号处理

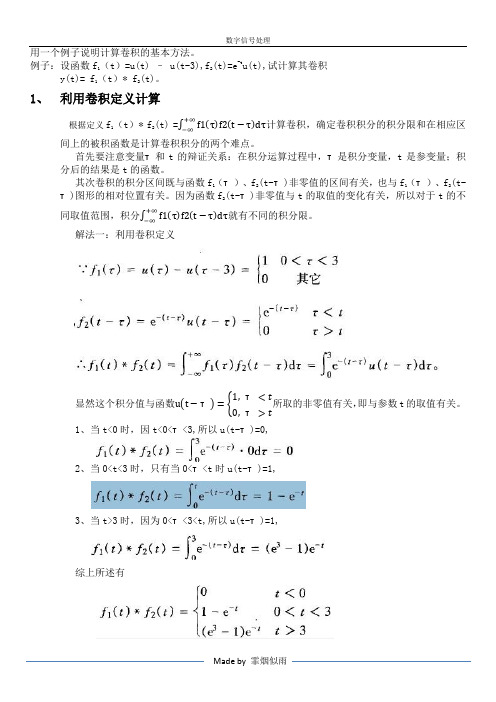

用一个例子说明计算卷积的基本方法。 例子:设函数 f1(t)=u(t) – u(t-3),f2(t)=e-tu(t),试计算其卷积 y(t)= f1(t)* f2(t)。

e ( t 1) )u(t 2)

Made by 霏烟似雨

数字信号处理

ht 1

e

t 2

u (t ) u (t 2)

e t 1

e t u (t )

O

t

波形

O

2

t

2. 今有一输油管道,长 12 米,请用数字信号处理的方法探测管道内部的损伤,管道的损伤可能为焊 缝,腐蚀。叙述你的探测原理,方法与结果。 (不是很清楚) 探测原理:因为输油管道不是很长,可以考虑设计滤波器器通过信号测量来测试管道的损伤,当有 焊缝时,所接受的信号会有所损失,当管道式腐蚀时,由于管壁变得不再是平滑的时候,信号的频率 就会有所改变。

1 e 2

u( ) u( 2) e (t ) u(t ) d

e t e 2 u ( )u (t )d e t e 2 u ( 2)u (t )d

4) 定积分限(关键)

3 当 t>3 时,f1(τ )与 f2(t-τ )的图形的图形仅在[0,3]内有重叠,如图 c,所以

综上所述有:

3、 利用卷积的特性计算

卷积作为一种数学运算方法, 具有某些特殊的有用特性。在卷积运算中要注意应用卷积的 特性简化运算,尤其要重视应用奇异函数的卷积特性。 (1) 微积分等效特性

onnx 中的公式

onnx 中的公式ONNX是一种开源的深度学习模型交换格式,它能够让不同的深度学习框架之间互相转换模型,使得深度学习应用更加便捷。

在ONNX 中,存在多种公式,这些公式包含了不同的数学运算和神经网络层,本文将介绍ONNX中的一些常用公式。

1. 矩阵乘法公式矩阵乘法是深度学习模型中最基本的数学运算之一,其公式为: C=AB其中,A、B、C分别为矩阵,A的列数等于B的行数。

在ONNX中,矩阵乘法公式的实现可以使用Gemm节点,其输入参数包括A、B、C、alpha、beta等。

2. 卷积公式卷积层是深度学习中经常使用的神经网络层之一,其公式为:y(i,j)=b+∑(k,l) x(i+k,j+l)w(k,l)其中,x为输入数据,w为卷积核,b为偏置项,(i,j)为输出特征图的坐标,(k,l)为卷积核在输入数据上的偏移量。

在ONNX中,卷积层的实现可以使用Conv节点,其输入参数包括输入数据、卷积核、步长、填充等。

3. 池化公式池化层是深度学习中常用的降采样层,其公式为:y(i,j)=max((k,l)∈R(x(i+k,j+l)))其中,x为输入数据,R为池化窗口,y为输出数据,max为取最大值操作。

在ONNX中,池化层的实现可以使用MaxPool节点或AveragePool 节点,其输入参数包括输入数据、池化窗口、步长、填充等。

4. 激活函数公式激活函数是深度学习中常用的非线性变换,其公式为:y=f(x)其中,x为输入数据,f为激活函数,y为输出数据。

在ONNX中,常用的激活函数包括Sigmoid、ReLU、Tanh等,其实现可以使用Sigmoid节点、Relu节点、Tanh节点等。

总结:本文介绍了一些ONNX中常用的公式,包括矩阵乘法、卷积、池化和激活函数等。

了解这些公式,可以更好地理解深度学习模型的基本运算和神经网络层的实现方式。

conv3d输入输出计算公式

标题:深度学习中的3D卷积网络输入输出计算公式详解1. 概述深度学习领域近年来取得了巨大的进展,其中3D卷积网络在视瓶处理、医疗图像分析等领域有着重要的应用。

在使用3D卷积网络时,了解其输入输出计算公式对于深入理解网络结构和运作原理至关重要。

本文将详细解释3D卷积网络的输入输出计算公式,帮助读者更好地理解和运用这一重要的深度学习工具。

2. 3D卷积网络输入计算公式3D卷积网络的输入计算公式包括输入体积的大小、卷积核的大小以及步长等参数。

具体而言,假设输入体积的大小为D×H×W,卷积核的大小为d×h×w,步长为s,则3D卷积网络的输入计算公式为:输出深度 = (输入深度 - 卷积核深度) / 步长 + 1输出高度 = (输入高度 - 卷积核高度) / 步长 + 1输出宽度 = (输入宽度 - 卷积核宽度) / 步长 + 1在实际应用中,输入体积的大小和卷积核的大小往往是已知的,而步长则是根据具体的网络结构和任务需求来确定的。

通过输入计算公式,可以计算出3D卷积网络的输出体积的大小,为后续的网络连接提供重要的参数。

3. 3D卷积网络输出计算公式在了解了3D卷积网络的输入计算公式后,接下来我们将解释其输出计算公式。

输出计算公式涉及到输出体积的大小以及卷积核的大小和步长等参数。

具体而言,假设输出体积的大小为D'×H'×W',卷积核的大小为d×h×w,步长为s,则3D卷积网络的输出计算公式为:输入深度 = (输出深度 - 1) * 步长 + 卷积核深度输入高度 = (输出高度 - 1) * 步长 + 卷积核高度输入宽度 = (输出宽度 - 1) * 步长 + 卷积核宽度通过输出计算公式,我们可以根据已知的输出体积大小、卷积核大小和步长来计算出输入体积的大小,从而为网络的前向传播提供必要的参数。

4. 实例分析为了更好地理解3D卷积网络的输入输出计算公式,我们将通过一个实例来进行分析。

卷积层计算公式

卷积层计算公式

卷积层是深度学习中的一种重要结构,用于提取图像的特征信息。

它

的计算主要包括五个步骤:1.输入图片;2.将卷积核(也可看做过滤器)

与图片进行卷积,其中卷积核沿着图像的每一列、每一行都进行滑动;3.

计算卷积结果(也叫激活值),卷积结果由卷积核移动的次数决定;4.使

用激活函数,激活函数的取值一般为sigmoid或者relu;5.通过池化操

作(maxpool),将结果按照一定大小的步伐,进行重新组合。

每一步的具体计算公式:1.输入图片:输入图片由图像分辨率决定,

输入图片大小是I行J列(I,J);2.将卷积核与图片进行卷积:每一步

卷积操作的计算公式为:

$$T(i,j) = \sum_{m=-k}^{k}\sum_{n=-k}^{k} (I(i-m,j-

n)*W_{m,n})$$。

其中,I(i-m,j-n)表示卷积操作时,以(i,j)为中心的感受野,W (m,n)表示卷积核的权重,k表示核的大小;3.计算卷积结果:将卷积

结果记做Z;4.使用激活函数:激活函数的取值一般为sigmoid或者relu,对应的计算公式为:

$$A=\sigma (Z)$$。

$$A=max(0,Z)$$。

其中,σ为sigmoid函数,max为取最大值函数;5.经过池化操作:

池化操作一般使用maxpool,计算公式为:

$$A(i,j)=max \quad (A(i,j), A(i,j+1), A(i+1,j),

A(i+1,j+1))$$。

其中,A(i,j)表示原输。

卷积后尺寸计算公式(一)

卷积后尺寸计算公式(一)卷积后尺寸计算公式在深度学习中,卷积操作是一种常用的神经网络层,它对输入数据进行特征提取和降维,常常用于图像处理、自然语言处理等任务中。

在进行卷积操作时,计算输入数据经过卷积后的尺寸是很重要的。

下面将介绍常见的卷积后尺寸计算公式,并通过具体示例进行解释说明。

一维卷积后尺寸计算公式对于一维卷积,输入数据的形状可以表示为(batch_size,input_length, input_channels),输出数据的形状可以表示为(batch_size, output_length, output_channels)。

其中,输入长度为input_length,卷积核的大小为kernel_size,卷积步长为stride,填充大小为padding。

卷积后的尺寸计算公式如下:output_length = [(input_length - kernel_size + 2*padding) / stride] + 1示例:假设输入数据的长度为100,卷积核的大小为5,步长为1,填充为0,则卷积后的尺寸计算公式为:output_length = [(100 - 5 + 2*0) / 1] + 1 = 96因此,输入长度为100的数据经过大小为5的卷积核进行卷积后,输出长度为96的数据。

二维卷积后尺寸计算公式对于二维卷积,输入数据的形状可以表示为(batch_size,input_height, input_width, input_channels),输出数据的形状可以表示为(batch_size, output_height, output_width,output_channels)。

其中,输入高度为input_height,输入宽度为input_width,卷积核的大小为(kernel_height, kernel_width),卷积步长为(stride_height, stride_width),填充大小为(padding_height, padding_width)。

卷积输出尺寸计算公式

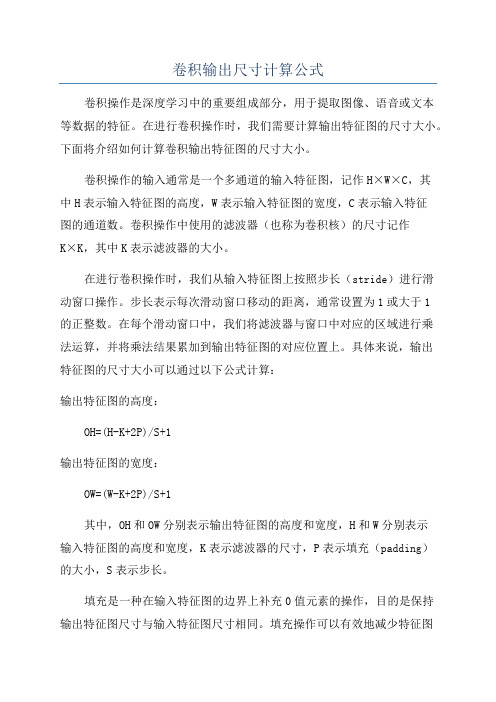

卷积输出尺寸计算公式卷积操作是深度学习中的重要组成部分,用于提取图像、语音或文本等数据的特征。

在进行卷积操作时,我们需要计算输出特征图的尺寸大小。

下面将介绍如何计算卷积输出特征图的尺寸大小。

卷积操作的输入通常是一个多通道的输入特征图,记作H×W×C,其中H表示输入特征图的高度,W表示输入特征图的宽度,C表示输入特征图的通道数。

卷积操作中使用的滤波器(也称为卷积核)的尺寸记作K×K,其中K表示滤波器的大小。

在进行卷积操作时,我们从输入特征图上按照步长(stride)进行滑动窗口操作。

步长表示每次滑动窗口移动的距离,通常设置为1或大于1的正整数。

在每个滑动窗口中,我们将滤波器与窗口中对应的区域进行乘法运算,并将乘法结果累加到输出特征图的对应位置上。

具体来说,输出特征图的尺寸大小可以通过以下公式计算:输出特征图的高度:OH=(H-K+2P)/S+1输出特征图的宽度:OW=(W-K+2P)/S+1其中,OH和OW分别表示输出特征图的高度和宽度,H和W分别表示输入特征图的高度和宽度,K表示滤波器的尺寸,P表示填充(padding)的大小,S表示步长。

填充是一种在输入特征图的边界上补充0值元素的操作,目的是保持输出特征图尺寸与输入特征图尺寸相同。

填充操作可以有效地减少特征图边缘信息的损失,并且有助于更好地提取特征。

填充的大小通常是根据滤波器的尺寸和步长来确定的。

如果P=0,表示无填充;如果P>0,表示有填充。

为了方便理解,下面举例说明公式的具体计算过程。

假设输入特征图的尺寸为H=32,W=32,C=3,滤波器的尺寸为K=5,填充的大小为P=2,步长为S=1、我们可以计算输出特征图的尺寸如下:输出特征图的高度:OH=(32-5+2*2)/1+1=32输出特征图的宽度:OW=(32-5+2*2)/1+1=32可以看出,输出特征图的尺寸与输入特征图的尺寸相同。

在深度学习中,卷积操作通常涉及多通道输入和多个滤波器的情况。

resnet18卷积公式

resnet18卷积公式ResNet18是一种深度卷积神经网络模型,它在计算机视觉领域中广泛应用于图像分类、目标检测和语义分割等任务。

在理解ResNet18的卷积公式之前,我们先来了解一下ResNet18的整体结构。

ResNet18由多个卷积层、池化层、全连接层和残差块组成。

其中,残差块是ResNet18的核心,通过引入跳跃连接(skip connection)解决了深度神经网络中的梯度消失问题,使得网络更易于训练。

在ResNet18中,卷积层是实现特征提取的关键部分。

卷积操作可以看作是一个滑动窗口在输入图像上进行特征提取的过程。

下面是ResNet18中常用的卷积公式:1. 输入图像的尺寸为H_in × W_in,通道数为C_in。

2. 卷积核的尺寸为K × K,通道数为C_out。

3. 卷积操作的步长为S,填充大小为P。

4. 经过卷积操作后,输出特征图的尺寸为H_out × W_out,通道数为C_out。

根据上述公式,我们可以计算出输出特征图的尺寸和通道数。

具体计算公式如下:H_out = (H_in + 2P - K) / S + 1W_out = (W_in + 2P - K) / S + 1C_out = 卷积核的个数在ResNet18中,常用的卷积核尺寸为3 × 3,步长为1,填充大小为1。

这样可以保持输入特征图的尺寸不变。

同时,卷积核的个数会随着网络的深度逐渐增加,以提取更加丰富的特征信息。

除了普通的卷积操作,ResNet18还引入了残差块。

残差块由两个卷积层和一个跳跃连接组成。

跳跃连接将输入特征图直接与输出特征图相加,使得网络可以学习残差信息。

这种设计可以有效地减少梯度消失问题,提高网络的训练效果。

总结起来,ResNet18的卷积公式可以通过输入图像的尺寸、卷积核的尺寸、步长和填充大小来计算输出特征图的尺寸和通道数。

卷积操作是ResNet18中实现特征提取的关键步骤,而残差块的引入则进一步提高了网络的性能。

卷积特征提取中涉及的公式

卷积特征提取中涉及的公式

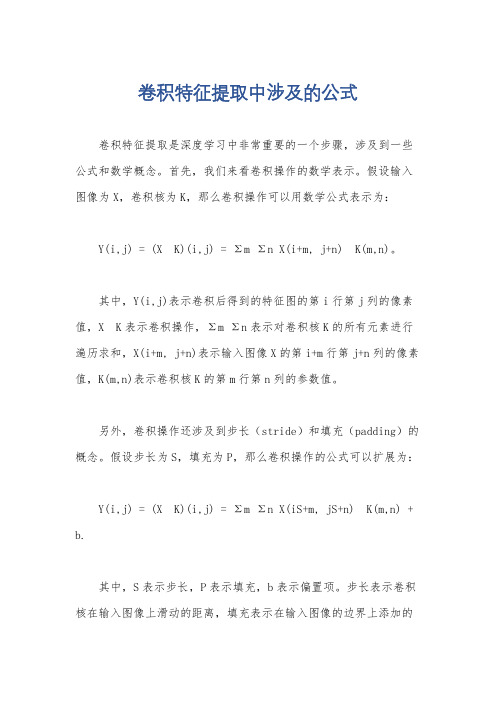

卷积特征提取是深度学习中非常重要的一个步骤,涉及到一些公式和数学概念。

首先,我们来看卷积操作的数学表示。

假设输入图像为X,卷积核为K,那么卷积操作可以用数学公式表示为:

Y(i,j) = (X K)(i,j) = Σm Σn X(i+m, j+n) K(m,n)。

其中,Y(i,j)表示卷积后得到的特征图的第i行第j列的像素值,X K表示卷积操作,Σm Σn表示对卷积核K的所有元素进行遍历求和,X(i+m, j+n)表示输入图像X的第i+m行第j+n列的像素值,K(m,n)表示卷积核K的第m行第n列的参数值。

另外,卷积操作还涉及到步长(stride)和填充(padding)的概念。

假设步长为S,填充为P,那么卷积操作的公式可以扩展为:

Y(i,j) = (X K)(i,j) = Σm Σn X(iS+m, jS+n) K(m,n) + b.

其中,S表示步长,P表示填充,b表示偏置项。

步长表示卷积核在输入图像上滑动的距离,填充表示在输入图像的边界上添加的

像素值,偏置项表示每个卷积核对应的偏置参数。

除了基本的卷积操作,卷积特征提取还涉及到激活函数的应用,常见的激活函数包括ReLU函数、Sigmoid函数和Tanh函数。

激活

函数的引入可以增加网络的非线性表达能力,从而提高特征的表达

能力。

总的来说,卷积特征提取涉及到卷积操作、步长、填充、偏置

项以及激活函数等数学概念和公式。

这些公式和概念的理解对于深

度学习中的卷积神经网络的理解至关重要。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

卷积步长的计算公式通常与具体的卷积核大小和输入图像的尺寸有关。

对于宽度和高度相同的卷积核(例如3x3),步长(stride)可以定义为卷积核在水平和垂直方向上移动的像素数量。

假设输入图像的宽度和高度为W和H,卷积核的宽度和高度为K(均为奇数),步长为S,填充大小为P,那么卷积步长S的计算公式为:

S = (W - K + 2×P) / (W - 1)

对于宽度和高度不同的卷积核(例如1x3或3x1),步长也可以不同。

在这种情况下,水平方向的步长为:S_h = (W - K + 2×P) / (W - 1)

垂直方向的步长为:

S_w = (H - K + 2×P) / (H - 1)

以上信息仅供参考,如果需要更多信息,建议咨询专业人士。