第三章 多元线性回归模型的参数估计

多元线性回归

Y

X

i

Y

1i i

X ki

XX 1i ki

XX 2i ki

X 2 ki

bˆk

X

k

Y

ii

正规方程

矩阵形式

n

X

X

X 1i

X 1i

X2 1i

X 2i

X X 2i 1i

2

ee ~ (n k 1)

ˆ

t

i

i ~ t(n k 1)

c ee ii n k 1

H : 0成立下,t

0

i

ˆ i

c ee ii n k 1

若 |t | t临

拒绝 H 0

认为 与0有显著的差异 i

或者根据t 查t分布表的概率p, 若

p

E[((X X )1 X ( XB N ) B)((X X )1 X ( XB N ) B)]

E[(X X )1 X NN X ( X X )1]

( X X )1 X E(NN ) X ( X X )1

E(NN )(X X )1 X X ( X X )1

最小的)

线性

Bˆ ( X X )1 X Y

无偏性

E(Bˆ) E[(X X )1 X Y ] E[(X X )1 X ( XB N )] E[(X X )1 X XB ( X X )1 X N ] B ( X X )1 E( X N ) B

i

i

ESS

2

第三章多元线性回归模型(计量经济学,南京审计学院)

Yˆ 116.7 0.112X 0.739P

R2 0.99

(9.6) (0.003) (0.114)

Y和X的计量单位为10亿美元 (按1972不变价格计算).

P

食品价格平减指数 总消费支出价格平减指数

100,(1972

100)

3

多元线性回归模型中斜率系数的含义

上例中斜率系数的含义说明如下: 价格不变的情况下,个人可支配收入每上升10

c (X X )1 X D

从而将 的任意线性无偏估计量 * 与OLS估计量 ˆ 联系

起来。

28

cX I

由

可推出:

(X X )1 X X DX I

即 I DX I

因而有 D X 0

cc (X X )1 X D (X X )1 X D ( X X )1 X D X ( X X )1 D

第三章 多元线性回归模型

简单线性回归模型的推广

1

第一节 多元线性回归模型的概念

在许多实际问题中,我们所研究的因变量的变动 可能不仅与一个解释变量有关。因此,有必要考虑线 性模型的更一般形式,即多元线性回归模型:

Yt β0 β1X1t β2 X 2t ... βk X kt ut t=1,2,…,n

Yt

ˆ0

βˆ 1

X

1t

... βˆ K X Kt

2

为最小,则应有:

S

S

S

ˆ0 0, ˆ1 0, ..., ˆ K 0

我们得到如下K+1个方程(即正规方程):

13

β0 n

β1 X1t ...... β K X Kt Yt

β 0 X 1t β1 X 1t 2 ...... β K X 1t X Kt X 1tYt

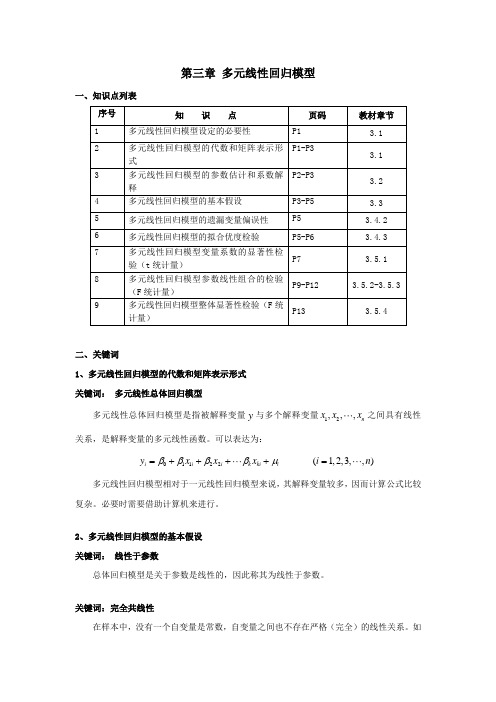

第三章 多元线性回归模型 知识点

第三章 多元线性回归模型一、知识点列表二、关键词1、多元线性回归模型的代数和矩阵表示形式 关键词: 多元线性总体回归模型多元线性总体回归模型是指被解释变量y 与多个解释变量12,,,n x x x 之间具有线性关系,是解释变量的多元线性函数。

可以表达为:01122(1,2,3,,)i i i k ki iy x x x i n ββββμ=++++=多元线性回归模型相对于一元线性回归模型来说,其解释变量较多,因而计算公式比较复杂。

必要时需要借助计算机来进行。

2、多元线性回归模型的基本假设 关键词: 线性于参数总体回归模型是关于参数是线性的,因此称其为线性于参数。

关键词:完全共线性在样本中,没有一个自变量是常数,自变量之间也不存在严格(完全)的线性关系。

如果方程中有一个自变量是其他自变量的线性组合,那么我们说这个模型遇到了完全共线性问题。

关键词:零条件数学期望给定解释变量的任何值,误差的期望值为零,即:12(|,,,)0n E u x x x =。

关键词:内生解释变量和外生解释变量如果解释变量满足零条件数学期望,则称该自编为内生解释变量;反之,则为外生解释变量。

关键词:同方差对于解释变量的所有观测值,随机误差项有相同的方差,即:22()(),(1,2,3,,)i i Var u E u i n δ===关键词:无序列相关性随机误差项两两不相关。

即(,)(,)0,(,,1,2,3,,)i i i i Cov u u E u u i j i j n ==≠=关键词:最优线性无偏估计量满足以下假设条件的OLS 估计量称为最优线性无偏估计量:(1)线性与参数;(2)X 固定;(3)X 有变异;(4)不存在完全共线性;(5)零条件数学期望;(6)同方差;(7)无序列相关性。

关键词:经典正态线性回归模型如果回归模型的OLS 估计量为最优线性无偏估计量,并且随机误差项u 服从均值为零,方差为2δ的正态分布,则称该线性回归模型为经典正态线性回归模型。

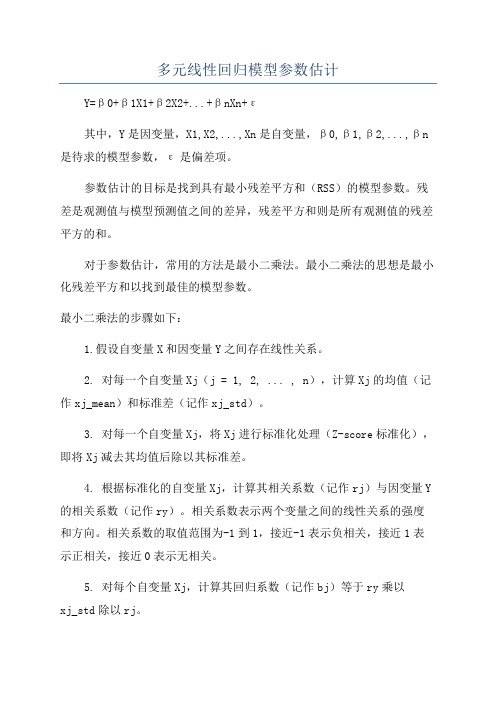

多元线性回归模型参数估计

多元线性回归模型参数估计Y=β0+β1X1+β2X2+...+βnXn+ε其中,Y是因变量,X1,X2,...,Xn是自变量,β0,β1,β2,...,βn 是待求的模型参数,ε是偏差项。

参数估计的目标是找到具有最小残差平方和(RSS)的模型参数。

残差是观测值与模型预测值之间的差异,残差平方和则是所有观测值的残差平方的和。

对于参数估计,常用的方法是最小二乘法。

最小二乘法的思想是最小化残差平方和以找到最佳的模型参数。

最小二乘法的步骤如下:1.假设自变量X和因变量Y之间存在线性关系。

2. 对每一个自变量Xj(j = 1, 2, ... , n),计算Xj的均值(记作xj_mean)和标准差(记作xj_std)。

3. 对每一个自变量Xj,将Xj进行标准化处理(Z-score标准化),即将Xj减去其均值后除以其标准差。

4. 根据标准化的自变量Xj,计算其相关系数(记作rj)与因变量Y 的相关系数(记作ry)。

相关系数表示两个变量之间的线性关系的强度和方向。

相关系数的取值范围为-1到1,接近-1表示负相关,接近1表示正相关,接近0表示无相关。

5. 对每个自变量Xj,计算其回归系数(记作bj)等于ry乘以xj_std除以rj。

6. 计算截距项(记作b0)等于Y的均值减去所有回归系数bj与自变量Xj的均值相乘的和。

7.得到完整的多元线性回归模型。

在进行参数估计时,需要注意以下几点:1.数据的准备:确保数据符合多元线性回归模型的假设,包括自变量与因变量的线性关系、多重共线性等。

2.异常值的处理:需要检测和处理可能存在的异常值,以避免对参数估计的干扰。

3.模型的评估:通过评估模型的适应度指标(如决定系数R^2、调整决定系数等)来判断模型的拟合优度,并对模型进行修正。

4.参数的解释:对于得到的参数估计结果,需要解释其含义和影响,以便进行预测和决策。

总之,多元线性回归模型的参数估计是通过最小二乘法等方法来找到最佳的模型参数,以拟合数据并进行预测。

3多元线性回归模型参数估计

3多元线性回归模型参数估计多元线性回归是一种用于预测多个自变量与因变量之间关系的统计模型。

其模型形式为:Y=β0+β1X1+β2X2+...+βnXn+ε,其中Y是因变量,X1、X2、..、Xn是自变量,β0、β1、β2、..、βn是模型的参数,ε是误差项。

多元线性回归模型参数的估计可以使用最小二乘法(Ordinary Least Squares,OLS)来进行。

最小二乘法的基本思想是找到一组参数估计值,使得模型预测值与实际观测值之间的平方差最小。

参数估计过程如下:1.根据已有数据收集或实验,获取因变量Y和自变量X1、X2、..、Xn的观测值。

2.假设模型为线性关系,即Y=β0+β1X1+β2X2+...+βnXn+ε。

3.使用最小二乘法,计算参数估计值β0、β1、β2、..、βn:对于任意一组参数估计值β0、β1、β2、..、βn,计算出模型对于所有观测值的预测值Y'=β0+β1X1+β2X2+...+βnXn。

计算观测值Y与预测值Y'之间的平方差的和,即残差平方和(RSS,Residual Sum of Squares)。

寻找使得RSS最小的参数估计值β0、β1、β2、..、βn。

4.使用统计方法计算参数估计值的显著性:计算回归平方和(Total Sum of Squares, TSS)和残差平方和(Residual Sum of Squares, RSS)。

计算决定系数(Coefficient of Determination, R^2):R^2 = (TSS - RSS) / TSS。

计算F统计量:F=(R^2/k)/((1-R^2)/(n-k-1)),其中k为自变量的个数,n为观测值的个数。

根据F统计量的显著性,判断多元线性回归模型是否合理。

多元线性回归模型参数估计的准确性和显著性可以使用统计假设检验来判断。

常见的参数估计的显著性检验方法包括t检验和F检验。

t检验用于判断单个参数是否显著,F检验用于判断整个回归模型是否显著。

多元线性回归模型参数估计

多元线性回归模型参数估计多元线性回归是一种用于建立自变量与因变量之间关系的统计模型。

它可以被视为一种预测模型,通过对多个自变量进行线性加权组合,来预测因变量的值。

多元线性回归模型的参数估计是指利用已知的数据,通过最小化误差的平方和来估计回归模型中未知参数的过程。

本文将介绍多元线性回归模型参数估计的基本原理和方法。

Y=β0+β1X1+β2X2+...+βpXp+ε其中,Y是因变量,X1、X2、..、Xp是自变量,β0、β1、β2、..、βp是回归系数,ε是残差项。

参数估计的目标是找到使得误差的平方和最小的回归系数。

最常用的方法是最小二乘法(Ordinary Least Squares, OLS)。

最小二乘法通过最小化残差的平方和来确定回归系数的值。

残差是观测值与回归模型预测值之间的差异。

为了进行最小二乘法参数估计,需要计算回归模型的预测值。

预测值可以表示为:Y^=β0+β1X1+β2X2+...+βpXp其中,Y^是因变量的预测值。

参数估计的目标可以表示为:argmin(∑(Y - Y^)²)通过对目标函数进行求导,可以得到参数的估计值:β=(X^TX)^-1X^TY其中,X是自变量的矩阵,Y是因变量的向量,^T表示矩阵的转置,^-1表示矩阵的逆。

然而,在实际应用中,数据往往存在噪声和异常值,这可能导致参数估计的不准确性。

为了解决这个问题,可以采用正则化方法,如岭回归(Ridge Regression)和LASSO回归(Least Absolute Shrinkage and Selection Operator Regression)。

这些方法通过在目标函数中引入正则化项,可以降低估计结果对噪声和异常值的敏感性。

岭回归通过在目标函数中引入L2范数,可以限制回归系数的幅度。

LASSO回归通过引入L1范数,可以使得一些回归系数等于零,从而实现变量选择。

这些正则化方法可以平衡模型的拟合能力与泛化能力,提高参数估计的准确性。

多元线性回归模型的参数估计

在最小二乘法基础上,对不同的观测值赋予不同的权重,以调整其 对回归参数估计的影响。

广义最小二乘法(GLS)

考虑自变量之间的相关性,通过转换自变量和因变量来消除自变量 之间的多重共线性影响。

03

参数估计的方法

普通最小二乘法

最小二乘法是一种常用的参数估计方法,通过最小化误差 平方和来估计参数。在多元线性回归模型中,普通最小二 乘法通过求解线性方程组来得到参数的估计值。

模型选择

选择多元线性回归模型作 为预测模型,以商品价格 和用户评价作为自变量, 销量作为因变量。

参数估计

使用最小二乘法进行参数 估计,通过最小化误差平 方和来求解回归系数。

模型检验

对模型进行假设检验,确 保满足线性回归的前提假 设。

结果解释与模型评估

结果解释

根据回归系数的大小和符号,解释各自变量对因变量 的影响程度和方向。

05

参数估计的实例分析

数据来源与预处理

数据来源

数据来源于某大型电商平台的销售数据,包括商 品价格、销量、用户评价等。

数据清洗

对原始数据进行清洗,去除异常值、缺失值和重 复值,确保数据质量。

数据转换

对连续变量进行离散化处理,对分类变量进行独 热编码,以便进行回归分析。

模型建立与参数估计

01

02

03

THANKS

感谢观看

04

参数估计的步骤

确定模型形式

确定自变量和因变

量

首先需要确定回归模型中的自变 量和因变量,通常因变量是研究 的响应变量,自变量是对响应变 量有影响的预测变量。

确定模型的形式

根据自变量和因变量的关系,选 择合适的回归模型形式,如线性 回归、多项式回归等。

3多元线性回归模型参数估计

3多元线性回归模型参数估计多元线性回归是一种回归分析方法,用于建立多个自变量和一个因变量之间的关系模型。

多元线性回归模型可以表示为:Y=β0+β1X1+β2X2+…+βnXn+ε其中,Y表示因变量,X1,X2,…,Xn表示自变量,β0,β1,β2,…,βn表示模型参数,ε表示误差项。

多元线性回归模型的目标是估计出模型参数β0,β1,β2,…,βn,使得实际观测值与模型预测值之间的误差最小化。

参数估计的方法有很多,下面介绍两种常用的方法:最小二乘法和梯度下降法。

1. 最小二乘法(Ordinary Least Squares, OLS):最小二乘法是最常用的多元线性回归参数估计方法。

它的基本思想是找到一组参数估计值,使得模型预测值与实际观测值之间的残差平方和最小化。

首先,我们定义残差为每个观测值的实际值与模型预测值之间的差异:εi = Yi - (β0 + β1X1i + β2X2i + … + βnXni)其中,εi表示第i个观测值的残差,Yi表示第i个观测值的实际值,X1i, X2i, …, Xni表示第i个观测值的自变量,β0, β1, β2, …,βn表示参数估计值。

然后,我们定义残差平方和为所有观测值的残差平方的总和:RSS = ∑(Yi - (β0 + β1X1i + β2X2i + … + βnXni))^2我们的目标是找到一组参数估计值β0,β1,β2,…,βn,使得残差平方和最小化。

最小二乘法通过数学推导和求导等方法,可以得到参数估计值的解析解。

2. 梯度下降法(Gradient Descent):梯度下降法是一种迭代优化算法,可以用于估计多元线性回归模型的参数。

它的基本思想是通过迭代调整参数的值,使得目标函数逐渐收敛到最小值。

首先,我们定义目标函数为残差平方和:J(β) = 1/2m∑(Yi - (β0 + β1X1i + β2X2i + … + βnXni))^2其中,m表示样本数量。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

由于:

(Y

=0

i

ˆ )(Y ˆ Y ) e (Y ˆ Y ) Y i i i

所以有:

2 2 ˆ ˆ TSS (Yi Yi ) (Yi Y ) RSS ESS

注意:一个有趣的现象

Y Y Y Yˆ Yˆ Y Y Y Y Yˆ Yˆ Y Y Y Y Yˆ Yˆ Y

1 Y1 X 1n Y2 Y X kn n

即

ˆ X Y (X X) β

由于X’X满秩,故有 1 ˆ β ( X X) X Y

例3.2.1:在例2.1.1的家庭收入-消费支出例中,

1 1 1 Xn 1 X1 X2 n X i Xn

由各解释变量的离差为元素组成的nk阶矩阵

x11 x x 1n x k1 x kn

假设6,回归模型的设定是正确的。

3.2 多元线性回归模型的估计

一、普通最小二乘估计

二、参数估计量的性质

说 明

估计方法:

3大类方法:OLS、ML或者MM

– 在经典模型中多应用OLS

1 ) E E (μμ n

1

12 1 n n E 2 n n 1

var( 1 ) cov( 1 , n ) 2 0 2I cov( , ) 0 2 var( ) n 1 n

这里利用了假设: E(X’)=0

3、有效性(最小方差性)

Var ( )

其中利用了

ˆ ( X X) 1 X Y β

( X X ) 1 X ( Xβ μ) β ( X X ) 1 X μ

和

) 2I E (μμ

2 1 Var ( ) ( X ' X ) 根据高斯----马尔可夫定理,

第三章

经典单方程计量经济学模型: 多元线性回归模型

• 多元线性回归模型 • 多元线性回归模型的参数估计 • 多元线性回归模型的统计检验

3.1 多元线性回归模型

一、多元线性回归模型

二、多元线性回归模型的基本假定

一、多元线性回归模型

多元线性回归模型:表现在线性回归模型中的 解释变量有多个。 一般表现形式:

假设4,向量 有一多维正态分布,即

μ~ N (0, 2 I)

同一元回归一样,多元回归还具有如下两个重 要假设:

假设5,样本容量趋于无穷时,各解释变量的 方差趋于有界常数,即n∞时,

1 1 2 2 x ( X X ) Qj ji ji j n n

或

1 xx Q n

其中:Q为一非奇异固定矩阵,矩阵x是

⃟正规方程组 的另一种写法

对于正规方程组

ˆ XY XXβ

ˆ X e X Xβ ˆ X Xβ

于是

Xe 0

(*)

或

e

i

i

0

ji i

X

e 0

(**)

(*)或(**)是多元线性回归模型正规方程组 的另一种写法。

二、参数估计量的性质

在满足基本假设的情况下,其结构参数的 普通最小二乘估计、最大似然估计仍具有: 线性性、无偏性、有效性。

0.0003 0.7226 可求得: ( XX) 0.0003 1.35 E 07

1

于是:

ˆ 0.7226 0.0003 15674 103 .172 1 ˆ β ˆ 0 . 0003 1 . 35 E 07 39648400 0 . 7770 2

在所有无偏估计量的方差中是最小的.

3.3

多元线性回归模型的统计检验

一、拟合优度检验

二、方程的显著性检验(F检验)

一、拟合优度检验

1、可决系数与调整的可决系数 总离差平方和的分解

则

TSS (Yi Y ) 2 ˆ ) (Y ˆ Y )) 2 ((Yi Y i i ˆ ) 2 2 (Y Y ˆ )(Y ˆ Y ) (Y ˆ Y )2 (Yi Y i i i i i

Yi 0 1 X 1i 2 X 2 i k X ki i

i=1,2…,n

其中:k为解释变量的数目,j称为回归参数 (regression coefficient)。

习惯上:把常数项看成为一虚变量的系 数,该虚变量的样本观测值始终取1。于是: 模型中解释变量的数目为(k+1)

i=1,2…n

n

• 根据最 小二乘原 理,参数 估计值应 该是右列 方程组的 解

ˆ 0 ˆ 1 ˆ 2 ˆ k

Q 0 Q 0 Q 0 Q 0

其 中

ˆ )2 Q e (Yi Y i

解该(k+1) 个方程组成的线性代数方程组,即

$ , j 012 , , ,, k 。 可得到(k+1) 个待估参数的估计值 j

□正规方程组的矩阵形式

n X 1i X ki

X X

1i 2 1i

X X X

ki

X

ki

X 1i

ˆ 1 1 0 ˆ X 11 X 12 1i ki 1 2 ˆ X X ki k k1 X k 2

假设4,随机项满足正态分布

j 1,2, k

i ~ N ( 0, )

2

上述假设的矩阵符号表示式:

假设1,n(k+1)矩阵X是非随机的,且X的秩 =k+1,即X满秩。

假设2,

1 E ( 1 ) E (μ) E 0 E ( ) n n

Yi 0 1 X 1i 2 X 2 i k X ki i

也被称为 总体回归函数 的 随机表达形式 。它的 非随机表达式为:

E(Yi | X 1i , X 2i , X ki ) 0 1 X 1i 2 X 2i k X ki

假设3,E(X’

i E ( i ) X 1i i X 1i E ( i ) E )=0,即 0 X ቤተ መጻሕፍቲ ባይዱ X E ( ) Ki i Ki i

i 1 2 i i 1

n

ˆ ˆ X ˆ X ˆ X )) (Yi ( 0 1 1i 2 2i k ki

i 1

n

2

于是得到关于待估参数估计值的正规方程组:

ˆ ˆ X ˆ X ˆ X ) Y ( 0 1 1i 2 2i k ki i ˆ ˆ ˆ X ˆ X ) X Y X ( X 0 1 1i 2 2i k ki 1i i 1i ˆ ˆ ˆ X ˆ X ) X Y X ( 0 1 X 1i 2i 2i k ki 2i i 2i ˆ ˆ ˆ ˆ ( 0 1 X 1i 2 X 2 i k X ki ) X ki Yi X ki

1、线性性

ˆ ( X X) 1 X Y CY β

其中,C=(X’X)-1 X’ 为一仅与固定的X有关的 行向量

2、无偏性

ˆ ) E (( X X ) 1 X Y ) E (β E (( X X ) 1 X ( Xβ μ )) β ( X X ) 1 E ( X μ ) β

i i i i i 2 2 2 i i i 2 2 i i i i

2

可决系数

ESS RSS R 1 TSS TSS

2

该统计量越接近于1,模型的拟合优度越高。 问题:在应用过程中发现,如果在模型中增 加一个解释变量, R2往往增大(Why?) 这就给人一个错觉:要使得模型拟合得好,

–

在非经典模型中多应用ML或者MM

一、普通最小二乘估计

• 对于随机抽取的n组观测值 (Yi , X ji ), i 1,2,, n, j 0,1,2, k 如果样本函数的参数估计值已经得到,则有:

ˆ ˆ X ˆ X ˆ X ˆ Y i 0 1 1i 2 2i ki Ki

样本回归函数的矩阵表达:

ˆ Xβ ˆ Y

或

ˆ e Y Xβ

其中:

ˆ 0 ˆ ˆ β 1 ˆ k

e1 e2 e e n

二、多元线性回归模型的基本假定

假设1,解释变量是非随机的或固定的,且各 X之间互不相关(无多重共线性)。

0 1 β 2 k

X 11 X 12 X 1n

X 21 X 22 X 2n

X k1 X k2 X kn n ( k 1 )

( k 1 )1

1 μ 2 n n 1

用来估计总体回归函数的样本回归函数为:

ˆ ˆ X ˆ X ˆ X ˆ Y i 0 1 1i 2 2i ki ki

ˆ ˆ X ˆ X ˆ X e 其随机表示式: Yi 0 1 1i 2 2i ki ki i

ei称为残差或剩余项(residuals),可看成是 总体回归函数中随机扰动项i的近似替代。

假设2,随机误差项具有零均值、同方差及不 序列相关性。