SIFT的讲解

SIFT算法的介绍和应用

SIFT算法的介绍和应用SIFT(Scale-Invariant Feature Transform)算法是一种用于图像特征提取和匹配的算法,由David Lowe于1999年首次提出。

SIFT算法具有尺度不变性和旋转不变性,能够在不同尺度和旋转角度下检测并描述图像中的局部特征。

因此,SIFT算法在计算机视觉领域广泛应用于图像拼接、目标识别、图像检索、三维重建等任务。

尺度空间极值点检测是SIFT算法的关键步骤之一、该步骤通过在不同的尺度下使用高斯差分金字塔来检测图像中的关键点。

SIFT算法使用了DoG(Difference of Gaussians)来近似尺度空间的Laplacian of Gaussian(LoG)金字塔。

通过对高斯金字塔中不同尺度上的图像之间进行差分操作,我们可以得到一组差分图像。

SIFT算法通过在这些差分图像中找到局部最小值和最大值,来检测图像中的关键点。

关键点精确定位是SIFT算法的另一个重要步骤。

在粗略检测到的关键点位置附近,SIFT算法利用高斯曲率空间来精确定位关键点。

具体做法是,在检测到的关键点位置处通过Taylor展开近似曲线,并通过求解偏导数为零的方程来计算关键点的位置。

方向分配是SIFT算法的下一个步骤。

该步骤用于给每个关键点分配一个主方向,以增强特征的旋转不变性。

SIFT算法在关键点周围的像素中计算梯度幅值和方向,然后生成一个梯度方向直方图。

直方图中最大的值对应于关键点的主方向。

特征描述是SIFT算法的另一个核心步骤。

在这个步骤中,SIFT算法根据关键点周围的梯度方向直方图构建一个128维的特征向量,该特征向量描述了关键点的局部特征。

具体做法是,将关键点附近的像素划分为若干个子区域,并计算每个子区域内的梯度幅值和方向,然后将这些信息组合成一个128维的向量。

特征匹配是SIFT算法的最后一步。

在这个步骤中,SIFT算法通过比较特征向量之间的欧氏距离来进行特征匹配。

sift算法的原理和步骤

sift算法的原理和步骤SIFT算法的原理和步骤SIFT算法是一种用于图像特征提取的算法,它能够从图像中提取出具有独特性、稳定性和可重复性的关键点,用于图像匹配、目标跟踪等任务。

本文将介绍SIFT算法的原理和步骤。

一、原理1. 尺度空间尺度空间是指同一物体在不同尺度下的表现形式。

SIFT算法采用高斯金字塔来实现尺度空间的构建,即将原始图像不断缩小并平滑处理,得到一系列模糊程度不同的图像。

2. 关键点检测在尺度空间中,SIFT算法采用DoG(Difference of Gaussian)来检测关键点。

DoG是指两个不同尺寸的高斯滤波器之间的差值,可以有效地提取出具有高斯拉普拉斯变换极值点(LoG)特征的区域。

3. 方向确定对于每个关键点,在其周围区域内计算梯度幅值和方向,并统计梯度直方图。

最终确定该关键点最显著的梯度方向作为其主方向。

4. 描述子生成以关键点为中心,生成一个16x16的方形区域,并将其分为4x4的小块。

对于每个小块,计算其内部像素的梯度方向直方图,并将其串联成一个128维的向量,作为该关键点的描述子。

5. 匹配通过计算不同图像之间的关键点描述子之间的距离来进行匹配。

采用最近邻法(Nearest Neighbor)和次近邻法(Second Nearest Neighbor)来进行筛选,从而得到最终的匹配结果。

二、步骤1. 构建高斯金字塔对于原始图像,采用高斯滤波器进行平滑处理,并将其缩小一定比例后再次平滑处理,得到一系列不同尺度下的图像。

这些图像构成了高斯金字塔。

2. 构建DoG金字塔在高斯金字塔中,相邻两层之间做差得到一组DoG金字塔。

通过在DoG金字塔上寻找局部极值点来检测关键点。

3. 确定关键点主方向对于每个关键点,在其周围区域内计算梯度幅值和方向,并统计梯度直方图。

最终确定该关键点最显著的梯度方向作为其主方向。

4. 生成描述子以关键点为中心,生成一个16x16的方形区域,并将其分为4x4的小块。

SIFT算法详解及应用

SIFT算法详解及应用SIFT(Scale-Invariant Feature Transform)是一种图像处理算法,它能够在不同尺度、旋转、光照条件下进行特征点匹配。

SIFT算法是计算机视觉领域的一个重要算法,广泛应用于目标识别、图像拼接、图像检索等方面。

首先,尺度空间极值检测是指在不同尺度上检测图像中的极值点,即图像中的局部最大值或最小值。

这样可以使特征点能够对应不同尺度的目标,使算法对尺度变化有鲁棒性。

为了实现这一步骤,SIFT算法使用了高斯差分金字塔来检测尺度空间中的极值点。

接下来是关键点定位,即确定在尺度空间极值点的位置以及对应的尺度。

SIFT算法通过比较每个极值点与其周围点的响应值大小来判断其是否为关键点。

同时,为了提高关键点的稳定性和准确性,算法还会对关键点位置进行亚像素精确化。

然后是关键点方向的确定,即为每个关键点分配一个主方向。

SIFT算法使用图像梯度方向的直方图来确定关键点的方向。

这样可以使得特征描述子具有旋转不变性,使算法在目标旋转的情况下仍能进行匹配。

最后是关键点的描述。

SIFT算法使用局部图像的梯度信息来描述关键点,即构建关键点的特征向量。

特征向量的构建过程主要包括将关键点周围的图像划分为若干个子区域,计算每个子区域的梯度直方图,并将所有子区域的直方图拼接成一个特征向量。

这样可以使得特征向量具有局部不变性和对光照变化的鲁棒性。

SIFT算法的应用非常广泛。

首先,在目标识别领域,SIFT算法能够检测和匹配图像中的关键点,从而实现目标的识别和定位。

其次,在图像拼接方面,SIFT算法能够提取图像中的特征点,并通过匹配这些特征点来完成图像的拼接。

此外,SIFT算法还可以应用于图像检索、三维重建、行人检测等领域。

总结起来,SIFT算法是一种具有尺度不变性和旋转不变性的图像处理算法。

它通过提取图像中的关键点,并构建关键点的描述子,实现了对不同尺度、旋转、光照条件下的目标识别和图像匹配。

sift算法原理

sift算法原理SIFT算法原理。

SIFT(Scale-invariant feature transform)算法是一种用于图像处理和计算机视觉领域的特征提取算法。

它能够在不同尺度和旋转角度下提取出稳定的特征点,并且对光照、噪声等干扰具有较强的鲁棒性。

SIFT算法由David Lowe于1999年提出,至今仍被广泛应用于图像拼接、目标识别、三维重建等领域。

本文将介绍SIFT算法的原理及其关键步骤。

1. 尺度空间极值检测。

SIFT算法首先通过高斯滤波构建图像的尺度空间金字塔,然后在不同尺度空间上寻找局部极值点作为关键点。

这些关键点在不同尺度下具有不变性,能够在不同大小的目标上被检测到。

2. 关键点定位。

在尺度空间极值点的基础上,SIFT算法通过对尺度空间进行插值,精确定位关键点的位置和尺度。

同时,为了提高关键点的稳定性,还会对梯度方向进行进一步的精确计算。

3. 方向分配。

为了使关键点对旋转具有不变性,SIFT算法会计算关键点周围像素点的梯度方向直方图,并选择主方向作为关键点的方向。

这样可以使得关键点对于图像的旋转具有不变性。

4. 特征描述。

在确定了关键点的位置、尺度和方向后,SIFT算法会以关键点为中心,提取周围区域的梯度信息,并将其转换为具有较强区分度的特征向量。

这些特征向量可以很好地描述关键点周围的图像信息,从而实现对图像的匹配和识别。

5. 特征匹配。

最后,SIFT算法使用特征向量进行特征匹配,通常采用欧氏距离或者余弦相似度进行特征匹配。

通过匹配不同图像的特征点,可以实现图像的配准、目标的识别等应用。

总结。

SIFT算法作为一种经典的特征提取算法,在图像处理和计算机视觉领域具有重要的应用价值。

其关键在于通过尺度空间极值点的检测和特征描述子的构建,实现了对图像的稳健特征提取。

同时,SIFT算法对于光照、噪声等干扰具有较强的鲁棒性,能够应对复杂环境下的图像处理任务。

因此,SIFT算法在目标识别、图像拼接、三维重建等领域有着广泛的应用前景。

SIFT算法原理

SIFT算法原理SIFT(Scale-Invariant Feature Transform)算法是一种用于检测和描述图像中的局部特征的算法,它具有尺度不变性和旋转不变性的特点。

SIFT算法由David G. Lowe在1999年提出,被广泛应用于计算机视觉领域的图像匹配、目标识别等任务。

1.尺度空间的构建:SIFT算法首先构建图像的尺度空间,通过对原始图像进行高斯模糊操作得到一组图像。

具体操作是利用高斯核对图像进行卷积,每次卷积后将图像尺寸缩小一半,得到不同尺度的图像。

这样可以在不同尺度上寻找到特征点,使算法具有尺度不变性。

2.关键点的检测:在不同尺度的图像中,SIFT算法通过在每个像素点周围进行高斯差分操作,来寻找潜在的关键点。

具体操作是计算每个像素点的高斯差分空间,找到极大值和极小值点。

这些极值点成为候选关键点。

3.关键点的定位:在候选关键点的基础上,SIFT算法通过对梯度方向和梯度幅值进行计算,进一步筛选出具有稳定性的关键点。

具体操作是在关键点周围的邻域内,计算图像的梯度方向和梯度幅值,并将邻域划分为8个方向的子区域,求出每个子区域内的梯度方向直方图。

通过梯度方向直方图的峰值来确定关键点的主要方向。

4.关键点的描述:SIFT算法通过关键点的主方向,对其周围的图像区域进行描述。

具体操作是在关键点周围的邻域内,将邻域划分为多个子区域,并计算每个子区域内的梯度方向和梯度幅值。

这样可以得到一个向量组成的特征向量,用来描述关键点周围的图像区域。

为了保持对尺度和旋转的不变性,SIFT算法对特征向量进行归一化和抗干扰处理。

5.特征点的匹配:在进行目标识别等任务时,SIFT算法需要对图像中的特征点进行匹配。

为了提高匹配的准确性,在进行特征点匹配时,SIFT算法采用了一种特殊的匹配方法,基于最近邻和次近邻的比值。

对于每个特征点,找到其在另一幅图像中的最近邻点和次近邻点,通过计算这两个点之间的距离比值,进行匹配判断。

SIFT算法分析.pptx

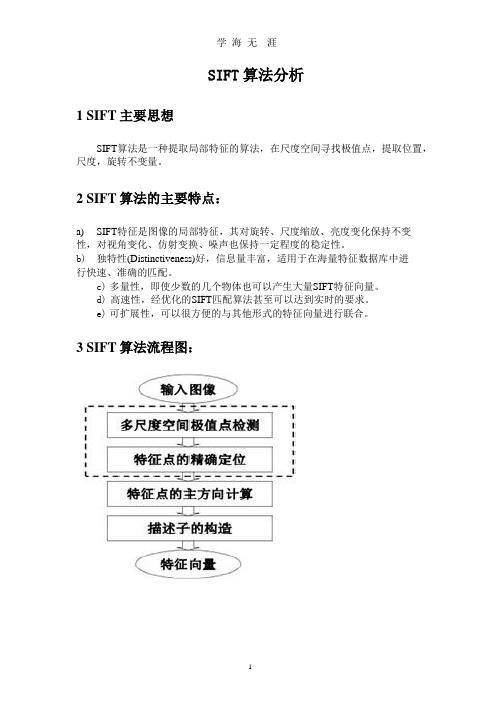

5)关键点方向分配

利用关键点邻域像素的梯度方向分布特性为每个关键点指定方向参数,使算 子具备旋转不变性。

4

学海无涯

在垂直边缘的方向有较小的主曲率。主曲率通过一个2x2 的Hessian矩阵H求出:

H

Dxx Dxy

DxБайду номын сангаас

D

yy

导数由采样点相邻差估计得到。

D的主曲率和H的特征值成正比,令 为最大特征值, 为最小的特征值,

则

令 ,则:

(r + 1)2/r的值在两个特征值相等的时候最小,随着r的增大而增大,因此, 为了检测主曲率是否在某域值r下,只需检测

定义为:

L(x, y, ) G(x, y, ) I(x, y)

其中 G(x, y, ) 是尺度可变高斯函数, G(x, y, )

1

e / 2 ( x2 y2 )

2

2 2

(x,y)是空间坐标, 是尺度坐标。 大小决定图像的平滑程度,大尺度

对应图像的概貌特征,小尺度对应图像的细节特征。大的 值对应粗糙尺度(低

①空间尺度函数 D(x, y, )

D(x, y, ) Dx0 , y0 ,

DT X 0

X

1 X T 2 D

2

X

2 0

X

)泰勒展开式如下:

D(x, y, ) Dx, y, DT x 1 Tx 2 D x

x 2 x2

对上式求导,并令其为0,得到精确的位置 xˆ , xˆ 2D1 D x 2 x

N0

N20o,

M

0

M0 2o

注:在Lowe的文章中,Lowe使用了如下的参数:

0.5, 1.6 21/ S , o 1, S 3

SIFT定位算法关键步骤的说明

SIFT定位算法关键步骤的说明1. SIFT算法中⼀些符号的说明I(x,y)表⽰原图像。

G(x,y,σ)表⽰⾼斯滤波器,其中G(x,y,σ)=12πσ2exp(−(x2+y2)/2σ2)。

L(x,y,σ)表⽰由⼀个⾼斯滤波器与原图像卷积⽽⽣成的图像,即L(x,y,σ)=G(x,y,σ)⊗I(x,y)。

⼀系列的σi,则可以⽣成⼀系列的L(x,y,σi)图像,此时我们把这⼀系列的L(x,y,σ)图像称为原图像的⼀个尺度空间表⽰。

关于尺度空间的知识可以参考:图像特征提取:尺度空间理论。

DOG表⽰⾼斯差分(Difference of Gaussians),也可以表⽰为D(x,y,σ),其中D(x,y,σ)=(G(x,y,kσ)–G(x,y,σ))⊗I(x,y)=L(x,y,kσ)–L(x,y,σ)。

上⾯特别值得注意的是尺度为σ的⾼斯差分图像由于尺度为kσ与尺度为σ的L图像⽣成的。

k为两相邻尺度空间倍数的常数。

O:⾼斯⾦字塔的组数(Octave),其中值得注意的是在实际构建中,第⼀组的索引可以为0也可以为-1,这个在后⾯解释原理。

S:⾼斯⾦字塔每⼀组的层数。

在实际最开始构建尺度空间图像,即L图像的时候,构建了S+3层,⼀定要把这个S+3与S区分开,为什么是S+3后⾯分析。

2. 构建⾼斯差分⾦字塔2.1 第⼀组第⼀层图像的⽣成很多初涉SIFT的都会被这个问题所困惑,这⾥要分两种情况:其⼀是把第⼀组的索引定为0;其⼆是把第⼀组的索引定为-1。

我们先考虑第⼀组索引为0的情况,我们知道第⼀组第⼀层的图像是由原图像与σo(⼀般设置为1.6)的⾼斯滤波器卷积⽣成,那么原图像是谁呢?是I(x,y)吗?不是!为了图像反⾛样的需要,通常假设输⼊图像是经过⾼斯平滑处理的,其值为σn=0.5,即半个像元。

意思就是说我们采集到的图像I(x,y),已经被σ=σn=0.5的⾼斯滤波器平滑过了。

所以我们不能直接对I(x,y)⽤σ0的⾼斯滤波器平滑,⽽应该⽤σ=√σ20−σ2n的⾼斯滤波器去平滑I(x,y),即FirstLayer(x,y)=I(x,y)⊗G(x,y,√σ20−σ2n)其中FirstLayer(x,y)表⽰整个尺度空间为第1组第1层的图像,σo⼀般取1.6,σn=0.5。

SIFT算法详解及应用(课件)

• 高斯模糊具有线性可分的性质,也可以在二维图像上对两个独立的一 维空间分别进行计算。这样可以大大减少了运算的次数。

• 对一幅图像进行多次连续高斯模糊的效果与一次更大的高斯模糊可以 产生同样的效果,大的高斯模糊的半径是所用多个高斯模糊半径平方 和的平方根。例如,使用半径分别为 6 和 8 的两次高斯模糊变换得 到的效果等同于一次半径为 10 的高斯模糊效果, 62 82 10 根据这个关系,使用多个连续较小的高斯模糊处理不会比单个高斯较 大处理时间要少。

SIFT

Scale Invariant Feature Transform

Octave 5 Octave 4 Octave 3

…

8

…

4

…

2

…

Octave 2

…

Octave 1

2013/7/11

17

关键点检测的相关概念

• 高斯图像金字塔共o组、s层, 则有:

SIFT

Scale Invariant Feature Transform

SIFT

Scale Invariant Feature Transform

0.00002292 0.00078633 0.00655965 0.01330373 0.00655965 0.00078633 0.00002292

0.00000067 0.00002292 0.00019117 0.00038771 0.00019117 0.00002292 0.00000067

高斯函数

( x xi )2 ( y yi )2 G xi , yi , exp 2 2 2 2 1

L x, y, G x, y, * I x, y

SIFT算法详解及应用

SIFT算法详解及应用SIFT(Scale-Invariant Feature Transform)是一种在计算机视觉中常用的特征点提取算法,由David Lowe在1999年提出,并在2004年的论文中进行了详细阐述。

SIFT算法可以在不同尺度和旋转下保持图像的特征点不变性,因此在图像拼接、目标识别、图像匹配等领域具有广泛的应用。

1.尺度空间构建:SIFT算法使用高斯差分函数来检测不同尺度下的特征点。

通过在图像中采用不同尺度的高斯滤波,构建尺度空间,从而检测到不同尺度的图像特征。

2.关键点提取:在构建的尺度空间中,SIFT算法通过在每个像素点检测局部极值点来获取关键点。

具体的做法是对每个像素点在尺度空间上进行比较,找出该点与它相邻像素点和尺度上的极值,从而得到关键点。

3. 关键点定位:在关键点提取后,SIFT算法通过利用二阶偏导数的Hessian矩阵来对关键点进行进一步定位。

Hessian矩阵可以描述图像对灰度变化的响应,通过计算关键点周围像素点的Hessian矩阵,可以对关键点进行精确定位。

4.方向分配:在关键点定位后,SIFT算法为每个关键点分配一个主导方向。

通过对关键点周围的图像梯度进行统计,找到梯度方向分布最大的方向作为主导方向,以此来保证关键点对旋转具有不变性。

5.特征描述:在分配了主导方向后,SIFT算法使用局部图像梯度的方向直方图来描述关键点的局部特征。

将关键点周围的16x16邻域划分为4x4的小格子,计算每个小格子内的梯度方向直方图,最终得到一个128维的特征向量来表示关键点的局部特征。

1.尺度不变性:SIFT算法通过在不同尺度下检测特征点,使得算法对于图像缩放具有不变性。

这一特性使得SIFT在目标识别和图像匹配等领域具有广泛应用,可以应对不同尺寸的目标和场景。

2.旋转不变性:SIFT算法通过为每个关键点分配主导方向,使得算法对于图像旋转具有不变性。

这一特性使得SIFT在图像拼接和图像匹配中能够应对图像的旋转变换。

SIFT算法详解

SIFT算法详解SIFT(Scale-Invariant Feature Transform)算法是一种用于计算图像特征的算法,最早由David Lowe于1999年提出,是一种用于在不同尺度和旋转下具有不变性的特征描述算法。

1.关键点检测:SIFT算法首先对图像进行多尺度空间的检测,即在图像中寻找尺度空间极值点。

为了实现尺度不变性,SIFT算法采用了高斯金字塔的方法来对图像进行多尺度模糊处理。

金字塔的每一层可以通过对上一层图像进行下采样和卷积来生成。

然后,在每一层金字塔上使用一种拉普拉斯算子来计算尺度空间的极值点,这些极值点包括图像的边缘点、角点和斑点等。

极值点的检测是通过对每个像素点的周围像素点进行梯度计算和方向估计来实现的。

2.关键点描述:在关键点检测之后,SIFT算法通过计算每个关键点的局部图像梯度直方图来对关键点进行描述。

首先,将关键点周围的领域分为若干个子区域,一般为16个,每个子区域可以通过将关键点周围的区域划分为4×4个小区域来实现。

然后,对每个小区域中的像素点计算其梯度幅值和方向,并将其分到相应的方向直方图中。

通过对所有子区域的梯度方向直方图进行拼接,就可以得到整个关键点的描述子。

描述子的维度一般为128维,特征向量的每个维度包含了关键点的领域中的梯度方向信息。

3.特征匹配:在关键点描述之后,SIFT算法使用一种基于特征向量距离的匹配方法来实现图像特征点的匹配。

常用的方法是计算两个特征向量之间的欧式距离,并使用一个阈值来筛选出较为相似的特征点。

为了提高匹配的准确性和稳定性,SIFT算法使用了一种自适应的阈值筛选方法,通过计算两个特征向量距离的比值来判断特征点的匹配性。

总结来说,SIFT算法通过对图像进行多尺度的检测、关键点的描述和特征的匹配,实现了对图像特征的提取和匹配。

这种算法对于图像的尺度变化、旋转变换和部分遮挡等具有一定的不变性,因此被广泛应用于图像处理、目标识别和三维重建等领域。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

This is a 3x3 linear system

14-59 2011-9-28

Localization

∂2 D ∂σ 2 2 ∂ D ∂σy ∂2 D ∂σx ∂2D ∂σy ∂2D ∂y 2 ∂2D ∂yx ∂2D ∂D ∂σ ∂σx σ ∂D ∂2 D y = − ∂yx ∂y x ∂D ∂2 D ∂x ∂x 2

Derivatives approximated by finite differences,

example:

∂D Dki ,+j1 − Dki ,−j1 = ∂σ 2 ∂ 2 D Dki ,−j1 − 2 Dki , j + Dki ,+j1 = ∂σ 2 1 ∂ 2 D ( Dki +1, j − Dki +1, j ) − ( Dki −1, j − Dki −1, j ) +1 −1 +1 −1 = ∂σy 4

Multiple orientations assigned to keypoints from an orientation histogram

Significantly improve stability of matching

17-59

2011-9-28

Choosing the right image descriptors

Distinctive image features using local descriptors

Mudit Agrawal Aniruddha Kembhavi

CMSC828J: Object recognition and representation

1

Contents

Overall picture Region detectors Scale invariant detection Localization Orientation assignment Region description SIFT approach Local Jet Storing and matching State of the art - Video Google

6-59

2011-9-28

Scale Invariant Detection

The problem: how do we choose corresponding circles independently in each image?

7-59

2011-9-28

Scale Invariant Detection

Distribution-Based

Luminance based approaches

Histograms of pixel intensities and location SIFT – Based on gradient distribution in the region

Geometric based approaches

m( x, y ) = ( L( x + 1, y ) − L( x − 1, y )) 2 + ( L( x, y + 1) − L( x, y − 1)) 2

Hale Waihona Puke θ ( x, y ) = a tan 2(( L( x, y + 1) − L( x, y − 1)) /( L( x + 1, y ) − L( x − 1, y )))

= L( x, y, kσ ) − L( x, y,σ )

Efficient to compute Close approximation to scale-normalized Laplacian of Gaussian,

9-59

σ 2∇ 2G

2011-9-28

Image space to scale space

Which is the most popularly used image descriptor ?

a. Local intensity histogram

b. SIFT

c. Local Jets

d. Fourier transform based

21-59

2011-9-28

Local image descriptor - SIFT

2-59

2011-9-28

Our goal

Detecting repeatable image regions

Obtaining reliable and distinctive descriptors

?

Searching an image database for an object efficiently

If X’ is > 0.5 in any dimension, process repeated

15-59 2011-9-28

Being picky!

Contrast (use prev. equation):

If | D(X) | < 0.03, throw it out

1 ∂DT ˆ ˆ D( Χ) = D + X 2 ∂Χ

Two significant eigenvalues indicate an interest point

Harris-Laplace – Invariant to rotation and scale Uses Laplacian of Gaussian operator

SIFT - Scale space extrema using Difference of Gaussian

k4σ k3σ k2σ kσ σ

10-59 2011-9-28

Relationship of D to σ ∇ G

2 2

Diffusion equation: ∂G = σ∇ 2G

∂σ

Approximate ∂G/∂σ:

giving,

∂G G ( x, y, kσ ) − G ( x, y,σ ) ≈ ∂σ kσ − σ

Miscellaneous

Using generalized moment invariants – characterize shape and intensity distribution

19-59

2011-9-28

Who wants to be a Millionaire?

20-59

2011-9-28

5-59 2011-9-28

Scale Invariant Detection

Consider regions (e.g. circles) of different sizes around a point Regions of corresponding sizes will look the same in both images

13-59

2011-9-28

Localization

3D quadratic function is fit to the local sample points Start with Taylor expansion with sample point as the origin

where

∂DT 1 T ∂2D D(Χ) = D + Χ+ Χ Χ 2 ∂Χ 2 ∂Χ

Edge-iness:

Use ratio of principal curvatures to throw out poorly defined peaks

Dxx Dxy Curvatures come from Hessian: H = D D yy xy No need to explicitly calculate eigenvalues. We only need

3-59 2011-9-28

Invariance vital

Scale Rotation Orientation Illumination Noise Affine

4-59

2011-9-28

Region detectors

Harris points - Invariant to rotation

Shape context

Spatial-Frequency Techniques

Fourier transform based – No spatial information Gabor filters and wavelets – Large number of filters

18-59 2011-9-28

their ratio!

16-59

2011-9-28

Orientation assignment

Descriptor computed relative to keypoint’s orientation achieves rotation invariance Precomputed along with mag. for all levels (useful in descriptor computation)

Choosing the right image descriptors

Differential descriptors

Local Jets - Set of image derivatives Steerable filters – steering derivatives in the direction of the gradient

where

G ( x, y , σ ) =

1 2πσ

2

e

−( x 2 + y 2 ) / 2σ 2