肖哲民 RBF神经网络模型及仿真设计 课程设计

人工神经网络第5章RBF

radbas (n) e

n2

3.设计径向基网络newrb( ) net=newrb(X,T,goal,spread)

式中,X为输入向量;T 为目标向量;goal为目标

均方差,默认为0;spread为径向基函数的分布系

数(宽度),默认为1;net为生成的网络。 利用函数 newrb( ) 建立的径向基网络,能够

f ( x) x

工具箱函数purelin()

RBF网络的结构

隐层神经元(也称RBF节点)

乘积 距离

径向基传 输函数

偏置值

隐层神经元(也称RBF节点) 矢量间的距离 dist(w,p)

w p

(w p )

i i

2

w 为 RBF 神经元的权值向量,也称为 RBF 神经元的中 心向量,其维数与输入向量维数相同; p 为输入向 量。

RBF传输函数的净输入

net w p b

权值向量W与输入向量p之间的向量距离乘以偏值b。

隐层神经元(也称RBF节点) 径向基传输函数

传输函数采用高斯函数,或者其它象高斯核函 数那样的辐射状作用函数。

f ( x) e

Matlab函数

x2 2 2

radbas (neti ) e

RBF网络与BP网络

采用径向基函数网络来完成函数逼近任务,将结 果同 BP 网络以及改进 BP 算法的前向网络的训练结 果做比较后,发现径向基函数网络所用的时间最短。

但并不等于径向基网络就可以取代其它前馈网络。 这是因为径向基网络很可能需要比BP网络多得多的 隐 含 层 神 经 网 络 元 来 完 成 工 作 。 BP 网 络 使 用 sigmoid( )函数,这样的神经元有很大的输入可见区 域。而径向基网络使用的径向基函数,输入空间区 域很小。这就导致了在实际需要的输入空间较大时, 需要很多的径向基神经元。

RBF网络模型及其预测程序

RBF 神经网络模型径向基函数(RBF Radial Basis Function )神经网络是由J.Moody 和C.Darken 在20世纪80年代末提出的一种神经网络,它是具有单隐层的三层前馈网络。

由于它模拟了人脑中局部调整、相互覆盖接受域(或称感受野-Receptive Field )的神经网络结构,因此,RBF 网络使一种局部逼近网络,已证明它能以任意精度逼近任意连续函数。

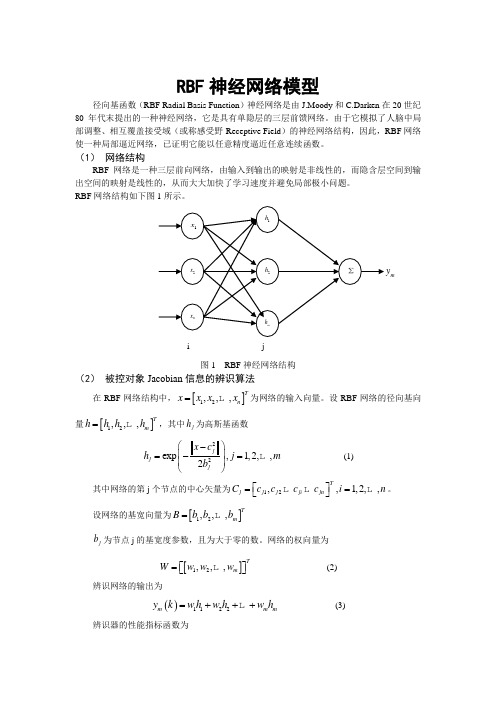

(1) 网络结构RBF 网络是一种三层前向网络,由输入到输出的映射是非线性的,而隐含层空间到输出空间的映射是线性的,从而大大加快了学习速度并避免局部极小问题。

RBF 网络结构如下图1所示。

图1 RBF 神经网络结构(2) 被控对象Jacobian 信息的辨识算法在RBF 网络结构中,[]12,,,Tn x x x x = 为网络的输入向量。

设RBF 网络的径向基向量[]12,,,Tm h h h h = ,其中j h 为高斯基函数22exp ,1,2,,2jj j x c h j m b ⎛⎫- ⎪=-= ⎪⎝⎭(1) 其中网络的第j 个节点的中心矢量为12,,1,2,,Tj j j ji jn C c c c c i n ⎡⎤==⎣⎦ 。

设网络的基宽向量为[]12,,,Tm B b b b =j b 为节点j 的基宽度参数,且为大于零的数。

网络的权向量为[]12,,,Tm W w w w ⎡⎤=⎣⎦ (2)辨识网络的输出为()1122m m m y k w h w h w h =+++ (3)辨识器的性能指标函数为my()()()212mJ y k y k =- (4)根据梯度下降法,输出权、节点中心及节点基宽参数的迭代算法如下()()()()j m j w k y k y k h η∆=-()()()()()()112j j j j j w k w k w k w k w k α=-+∆+---()()()()23jj m j jjX C b k y k y k w h bη-∆=-()()()()()112j j j j j b k b k b b k b k α=-+∆+---()()()()2j jiji m jjx c c k y k y k w b η-∆=-()()()()()()112ji ji ji ji ji c k c k c k c k c k α=-+∆+---式中,η为学习速率,α为动量因子。

基于RBF神经网络的时延预测模型与仿真

2 基于 R B F神经 网络时延预测模型仿真

2 . 1 R B F神 经 网络 MA T L A B仿 真

本文用 到 MA T L A B工具 箱 中 的函数 , 主 要包括 以下 几种 : 1 ) n e w r b函数

格式 : n e t =n e w r b[ n e t , t r ] =n e w r b ( P , T , g o a l , s p r e a d , M N , D F ) 说明: 设计 R B F神经 网络函数 n e w r b利用的是迭代方法 , 在该方法 中每实现一次迭代相应 的神经 网络元就增加一个 , 一直到误差下降到 目标误差 以下或隐含层神经元个数达到最大值时迭代停止。 其中 P : 输人矢量 ; T : 目标矢量 ; g o a l : 均方误差, 默认 时为 0 ; M N : 最大的神经元个数 ; s p r e a d : 函数 的 分布 , 默认时为 1 . 0 ; D F : 迭代频率, 默认时为 2 5 。 2 ) r a d b a s ( ) 径向基传递函数 格式 : A= r a d b a s ( N) i n f o= r a d b a s ( c o d e ) 说明: r a d b a s 是径向基传递函数 , 计算层 的输 出是根据网络的输入来确定的。

神 经元 的线性权 值 和激 活 , 采 用 的是 非 线性优 化 策略 ( 公式 3 ) , 而对线 性权 进行调 整是 输 出层 的 主要 任

务, 网络的输出是 隐含层单元输出的线性加权和 , 采用的是线性优化策略( 公式 4 ) 。R B F 神经网络所表

收稿 日期 : 2 0 1 4— 0 1— 2 5

式中 d 通常取值为 1 , 这样 T 之后下一个时间点的 X 值可以根据 函数 f 来预测。 通过对输入序列使用滑动窗 口( S l i d i n g Wi n d o w ) , 从而实现 R B F神经 网络预测功能。即以连续 2 O 步时序时延采样数据作为网络输人 , 网络输 出时用 2 O步采样值的均值来实现, 为了提供样本数据映射 对在整个训练集上“ 滑动” ( 采用滑动窗口技术) , 来对神经网络进行训练 ; 使得 R B F 神经网络经过训练 后能够较好地实现拟合时延特性 。因此 , 如果要得到下一时刻数据的预测值 , 可以利用当前采样点前的 2 0个 数据作 为输 入 , 得 到 的输 出值可 看作 是预 测值 。其 数学 描述 为 :

RBF神经网络设计及其在COD软测量中的应用研究的开题报告

RBF神经网络设计及其在COD软测量中的应用研究的开题报告一、选题背景随着人类社会的不断发展,化工过程在工业生产中越来越受到重视,尤其是对于其过程控制的需求。

而过程控制的一项重要技术——软测量技术,可以帮助化工生产企业获得更精确的数据,从而实现更高效、更稳定的生产。

因此,探究软测量技术的相关研究成为热点。

近年来,人工神经网络被广泛应用于软测量技术中,其中Radial Basis Function (RBF)神经网络由于其具有全局最优解、容错能力强等特点,在化工领域广泛应用。

RBF神经网络具有良好的适应性、快速的学习速度和优异的接近度等特点,被认为是化工系统建模、预测、控制及优化的有效方法。

二、研究内容本次研究将探究RBF神经网络的理论基础,并结合化工软测量技术的实际应用,设计出基于RBF神经网络的软测量模型。

具体内容包括以下几个方面:1.理论基础研究——介绍人工神经网络基础理论、RBF神经网络原理和优势等,并对其进行深入解析;2.数据采集和处理——收集化工过程中可能涉及的各类数据,进行规范化、归一化等处理,使其符合RBF神经网络的输入要求;3.模型构建和训练——对数据进行划分和训练,构建最优的RBF神经网络模型,使其具有更强的预测能力;4.模型验证和应用——对构建的RBF神经网络模型进行验证,并应用于COD软测量中进行实验,验证其效果。

三、研究方法本研究将采用文献综述法、实验法、分析法、建模法等多种方法进行探究,并结合化工软测量技术实际应用情况,提出合理的RBF神经网络模型构建方案,进而进行实验验证。

四、研究意义本研究旨在通过对RBF神经网络进行深入研究,并结合化工软测量技术的实际应用情况,设计出更加完善的基于RBF神经网络的软测量模型。

此模型不仅能在化工过程控制中提供精确的测量数据,更可以有效提升化工企业的生产效率与竞争力,具有重要的实际应用价值。

五、预期成果1.熟练掌握RBF神经网络的基本原理和模型构建方法;2.设计出分析化工软测量的基于RBF神经网络的模型;3. 根据实验结果对模型进行优化和改进,提升其预测精度;4.文献综述和实验研究的结论。

实验四、RBF神经网络实验报告

如果对于输入空间的某个局部区域只有少数几个连接权值影响输出,则该网络称为局部逼近网络。常见的局部逼近网络有RBF网络、小脑模型(CMAC)网络、B样条网络等。

广义RBF网络

Cover定理指出:将复杂的模式分类问题非线性地映射到高维空间将比投影到低维空间更可能线性可分。

广义RBF网络:从输入层到隐藏层相当于是把低维空间的数据映射到高维空间,输入层细胞个数为样本的维度,所以隐藏层细胞个数一定要比输入层细胞个数多。从隐藏层到输出层是对高维空间的数据进行线性分类的过程,可以采用单层感知器常用的那些学习规则,参见神经网络基础和感知器。

寻找逼近函数F(x)通过最小化下面的目标函数来实现:

加式的第一项好理解,这是均方误差,寻找最优的逼近函数,自然要使均方误差最小。第二项是用来控制逼近函数光滑程度的,称为正则化项,λ是正则化参数,D是一个线性微分算子,代表了对F(x)的先验知识。曲率过大(光滑度过低)的F(x)通常具有较大的||DF||值,因此将受到较大的惩罚。

3)Inverse multiquadrics(拟多二次)函数

σ称为径向基函数的扩展常数,它反应了函数图像的宽度,σ越小,宽度越窄,函数越具有选择性。

完全内插存在一些问题:

1)插值曲面必须经过所有样本点,当样本中包含噪声时,神经网络将拟合出一个错误的曲面,从而使泛化能力下降。K,K<P,从样本中选取K个(假设不包含噪声)作为Φ函数的中心。

隐藏层的作用是把向量从低维m映射到高维P,低维线性不可分的情况到高维就线性可分了。

基于RBF神经网络整定的PID控制器设计及仿真_毕业设计(论文)

华北电力大学毕业设计(论文)题目基于RBF神经网络整定的PID控制器设计及仿真基于RBF神经网络整定的PID控制器设计及仿真摘要目前,因为PID控制具有简单的控制结构,可通过调节比例积分和微分取得基本满意的控制性能,在实际应用中又较易于整定,所以广泛应用于过程控制和运动控制中,尤其在可建立精确模型的确定性控制系统中应用比较多。

然而随着现代工业过程的日益复杂,对控制要求的逐步增高(如稳定性、准确性、快速性等),经典控制理论面临着严重的挑战。

对工业控制领域中非线性系统,采用传统PID 控制不能获得满意的控制效果。

采用基于梯度下降算法优化RBF神经网络,它将神经网络和PID控制技术融为一体,既具有常规PID控制器结构简单、物理意义明确的优点,同时又具有神经网络自学习、自适应的功能。

因此,本文通过对RBF神经网络的结构和计算方法的学习,设计一个基于RBF神经网络整定的PID控制器,构建其模型,进而编写M语言程序。

运用MATLAB软件对所设计的RBF神经网络整定的PID控制算法进行仿真研究。

然后再进一步通过仿真实验数据,研究本控制系统的稳定性,鲁棒性,抗干扰能力等。

关键词:PID;RBF神经网络;参数整定SETTING OF THE PID CONTROLLER BASED ON RBF NEURAL NETWORK DESIGN AND SIMULATIONAbstractAt present, because the PID control has a simple control structure, through adjusting the proportional integral and differential gain basic satisfactory control performance, and is relatively easy to setting in practical application, so widely used in process control and motion control, especially in the accurate model can be built more deterministic control system application. With the increasingly complex of the modern industrial process, however, increased step by step to control requirements (e.g., stability, accuracy and quickness, etc.), classical control theory is faced with severe challenges. Non-linear systems in industrial control field, using the traditional PID control can not obtain satisfactory control effect. Optimized RBF neural network based on gradient descent algorithm, it will be integrated neural network and PID control technology, with a conventional PID controller has simple structure, physical meaning is clear advantages, at the same time with neural network self-learning, adaptive function. Therefore, this article through to the RBF neural network structure and the calculation method of learning, to design a setting of the PID controller based on RBF neural network, constructs its model, and then write M language program. Using the MATLAB software to design the RBF neural network setting of PID control algorithm simulation research. Data and then further through simulation experiment, the control system stability, robustness, anti-interference ability, etc.Keywords: PID; RBF neural network; Parameter setting目录摘要 (Ⅰ)Abstract (Ⅱ)1 绪论 (1)1.1 课题研究背景及意义 (1)1.2神经网络的发展历史 (3)2 神经网络 (6)2.1神经网络的基本概念和特点 (6)2.2人工神经网络构成的基本原理 (7)2.3神经网络的结构 (8)2.3.1前馈网络 (8)2.3.2 反馈网络 (8)2.4神经网络的学习方式 (9)2.4.1监督学习(有教师学习) (9)2.4.2非监督学习(无教师学习) (9)2.4.3再励学习(强化学习) (9)2.5 RBF神经网络 (10)2.5.1 RBF神经网络的发展简史 (10)2.5.2 RBF的数学模型 (10)2.5.3被控对象Jacobian信息的辨识算法 (11)2.5.4 RBF神经网络的学习算法 (12)2.6 本章小结 (14)3 PID控制器 (14)3.1 PID控制器简介 (14)3.2 经典PID控制原理 (14)3.3 现有PID控制器参数整定方法 (16)3.4 PID控制的局限 (17)3.5本章小结 (17)4 基于RBF神经网络整定的PID控制器设计 (17)4.1 RBF神经网络的PID整定原理 (17)4.2 神经网络PID控制器的设计 (18)4.3 本章小结 (19)5 仿真分析 (19)5.1 系统的稳定性分析 (19)5.2 系统抗干扰能力分析 (21)5.3 系统鲁棒性分析 (22)5.4 本章小结 (24)结论 (25)参考文献 (26)致谢 (27)附录仿真程序 (28)1 绪论1.1 课题研究背景及意义PID控制器(按比例、积分和微分进行控制的调节器)是最早发展起来的应用经典控制理论的控制策略之一,是工业过程控制中应用最广泛,历史最悠久,生命力最强的控制方式,在目前的工业生产中,90%以上的控制器为PID控制器。

基于Matlab的RBF神经网络设计与仿真试验

青年与社会 2014年6月上 第16期总第562期人工神经网络(ANN-Artificial Neural Network)是一种与传统计算机系统不同的信息处理工具,具有人脑的某些功能特征,可用来解决模式识别与人工智能中用传统方法难以解决的问题。

神经网络具有高度的自学习、自组织和自适应能力,通过学习和训练网络模型的输入、输出数据就可以获得网络的权值和结构,从而得出隐含在输入、输出数据中的关系。

这种关系隐含在神经网络内部,它不需要知道具体的精确模型,只需用神经网络就能逼近输入和输出之间的多维非线性特性,从而建立输入与输出之间的关系,这种非线性映射能力在人工智能、模式识别、信息处理等工程领域得到了广泛的应用。

随着神经网络理论研究和实际应用的不断深入,《人工神经网络》课程逐渐受到较多高校的重视,并将其列入教学计划,成为电气信息类学科的一门专业选修课。

但《人工神经网络》课程的理论性非常强,对本科生的教学具有一定的难度。

作为入门课程,本科生的教学重点应放对各种网络模型的结构和特点的理解,并结合应用实例,使学生能够获取一些初步设计经验的基础上,掌握有关模型的用法和性能。

因此,笔者以RBF神经网络为例设计仿真试验,通过实例增强学生的对神经网络模型的设计和仿真的认识,加深学生神经网络理论的理解。

一、RBF神经网络RBF网络可以根据问题确定相应的网络拓扑结构,学习速度快,不存在局部最小问题。

RBF网络的优良特性使得它基于Matlab的RBF神经网络设计与仿真试验石 岩(重庆科技学院 电气工程系,重庆 401331)【摘 要】人工神经网络是一门理论性很强而又应用广泛的课程,将神经网络应用于本科毕业设计能促进高校培养出工程应用型人才。

文章利用MATLAB平台将实验仿真教学与理论学习相结合,以RBF神经网络为例设计仿真试验,通过实例增强学生的对神经网络模型的设计和仿真的认识,加深学生神经网络理论的理解和应用设计能力。

【关键词】Matlab;RBF神经网络;仿真试验经济等原因所迫,不得已把子女留于家乡,而自己在外打工。

径向基(RBF)神经网络的介绍及其案例实现

人 脸 识 别

Company Logo

Contents

1 2

什么是神经网络 径向基(RBF)神经网络

3

ቤተ መጻሕፍቲ ባይዱ

Matlab案例实现

Company Logo

RBF 神经网络

几 种 常 见 的 神 经 网 络

Matlab案例实现

%% 清空环境变量 clc clear % 产生训练样本(训练输入,训练输出) % ld为样本例数 ld=100; % 产生2*ld的矩阵 x=rand(2,ld); % 将x转换到[-1.5 1.5]之间 x=(x-0.5)*1.5*2; %% 建立RBF神经网络 % 采用approximate RBF神经网络。spread 为默认值 net=newrb(x,F); % 计算网络输出F值 F=20+x1.^2-10*cos(2*pi*x1)+x2.^210*cos(2*pi*x2); % x的第一列为x1,第二列为x2. x1=x(1,:); x2=x(2,:);

y w1* x1 w2 * x2 w3 * x3 w4 * x4 wi * xi

i 1

Company Logo

n

RBF 神经网络

RBF神经网络概况:

神经网络基础知识

Company Logo

RBF 神经网络

60 50 40 30 20 10 0 2 2 0 0 -2 -2

Company Logo

1000

60 50 40 30 20 10 0 2 2 0 0 -2 -2

60 50 40 30 20 10 0 2 2 0 0 -2 -2

60 50 40 30 20 10 0 2 2 0 0 -2 -2

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

课程设计任务书课程名称:专业综合实验及设计题目:RBF神经网络模型及仿真设计学院:信息工程学院系:自动化专业:自动化班级:自动化062学号:6101206078学生姓名:肖哲民起讫日期:2010.1.06——2008.1.20指导教师:曾芸职称:系分管主任:审核日期:说明1.课程设计任务书由指导教师填写,并经专业学科组审定,下达到学生。

2.进度表由学生填写,交指导教师签署审查意见,并作为课程设计工作检查的主要依据。

3.学生根据指导教师下达的任务书独立完成课程设计。

4.本任务书在课程设计完成后,与论文一起交指导教师,作为论文评阅和课程设计答辩的主要档案资料。

目录1.课程设计目的 (3)2.课程设计题目描述和要求 (3)3.课程设计原理 (3)4.设计内容 (8)5.心得体会 (11)6.参考文献 (12)一、课程设计目的:1、综合运用所学课程的理论知识和实践知识进行仿真设计,培养学生理论与实际相结合能力,并使所学知识得到进一步巩固、加强和发展。

2、培养学生分析和解决仿真设计问题的能力,树立正确的设计思想,掌握仿真设计的基本方法和步骤,对仿真设计有个较全面的认识。

3、要求学生熟悉常见的人工神经网络的结构和特性,包括智能系统描述模型、人工神经网络方法的特点,并重点对RBF神经网络进行较全面的认识和了解,并能进行相关的模型及仿真设计。

二、课程设计题目描述和要求:1、题目描述:运用智能控制中所学到的理论知识以及查阅的相关文献资料为指导以MATLAB软件为工具独立完成RBF神经网络模型的建立及仿真设计。

2、设计要求:(1)RBF神经网络模型及原理。

(2)主要采用智能控制原理,实现RBF神经网络的建立,完成算法以及matlab程序的编辑以及仿真的相关图形。

三、课程设计原理:RBF(RBF-Radial Basis Function)神经网络是一种前馈式神经网络(Feedforward Neural Networks)。

前馈式神经网络是一种单方向层次网络模块,它包括输入层、输出层和中间隐层。

从学习的观点来看,前馈式神经网络是一种强有力的学习系统;从信息处理的观点来看,前馈式神经网络是一类信息“映射”处理系统。

由于前馈式神经网络具有通过样本学习完成任意空间映射的能力,即泛函逼近能力,所以它成为非线性系统建模、仿真和预测的主要工具,在信号系统、模式识别和智能控制中,前馈式神经网络是应用极广泛的模型。

RBF神经网络作为一种较特殊的前馈式神经网络是由J.Moody 和C.Darken在80年代末提出的一种神经网络,它是只具有单隐层的三层前馈网络。

由于它模拟了人脑中局部调整、相互覆盖接收域(或称感受野-Receptive Field)的神经网络结构,因此,RBF网络是一种局部逼近网络。

(2)RBF神经网络特点:RBF 网络作为一种性能良好的前馈式网络.作用函数为高斯基函数,相对于BP网络的作用函数为Sigmoid函数,其值在输入空间中无限大的范围内为非零值而言其值在输入空间中有限范围内为非零值,为全局逼近的神经网络而言,RBF神经网络是一种局部逼近的神经网络。

已证明RBF网络具有唯一最佳逼近的特性,且无局部极小。

且它能任意精度逼近任意连续函数。

RBF神经网络是只具有单隐层的三层前向网络,由于输入到输出的映射是非线性的,而隐含层空间到输出空间的映射是线性的,从而可以大大加快学习速度并避免局部极小问题。

如下图(1)所示为多输入单输出的RBF网络结构。

图(1)多输入单输出RBF网络结构(4)RBF神经网络的常见学习算法:①正交最小二乘法OLS。

这个算法是基于Gram—Schmidt正交化过程,若学习样本有n个,则网络初始化时隐层设为n个节点,以每个输入样本作为每个聚类的中心通过正交化运算,计算优化的隐层节点数.每做一次正交运算,记算一个能量值,随着运算次数的增加,网络的输出误差平方逐步减小到容许的精度范围内。

②梯度下降法。

RBF 神经网络的梯度下降训练方法与BP 算法训练多层感知器的原理类似,也是通过最小化目标函数实现对各隐节点数据中心、宽度和输出权值的学习。

(4)RBF 神经网络逼近:图2 RBF 神经网络逼近对象结构图RBF 神经网络逼近一对象的结构如上图所示:下面是基于梯度下降法分析RBF 神经网络逼近问题。

首先设定在RBF 网络结构中,X=[x 1,x 2,…x n ]T 为网络的输入向量。

设RBF 网络的径向基向量H=[h 1,h 2,…h j ..h m ]T ,其中h j 为高斯基函数:式中,网络的第j 个结点的中心向量为:C j =[c 1j ,c 2j …c ij …c nj ]T其中 i=1,2,…n。

设网络的基宽向量为:B=[b 1,b 2,…b m ]Tb j 为节点j 的基宽参数,且为大于零的数。

网络的权向量为:W=[w 1,w 2,…w m ]T .k 时刻RBF 网络的输出为: y m (k)=wh=w 1h 1+w 2h 2+…+w m h mmj bX jj ,2,1),2C -ex p(-h 22j ==设理想输出为y(k),则RBF 网络逼近的性能指标函数为: E(k)=[y(k)-y m (k)]2 /2根据梯度下降法,输出权、节点中心及节点基宽参数的迭代算法如下:(其中, 为学习速率, 为动量因子) 取RBF 网络的第一个输入为u (k ),即x 1=u (k ),则Jacobian 阵(即为对象的输出对控制输入的灵敏度信息)算法为:四、设计内容:(1)RBF 神经网络逼近仿真的对象选取:用RBF 网络对函数对象:y(k)=u(k)3+2)1(3)1(2-+-k y k y 逼近。

))2()1((---++=k w k w h y y ηw w j j j m j j α(k))-(k)(1)-(k (k)32j j jj m j b C X h w y y b -(k ))-(k )(=∆2))-(k -1)-(k (1)-(k (k)j j j j j b b b ηb b α+∆+=2-(k))-(k)(Δjji j j j m ji b c x h w y y c =2))-(k -1)-(k (1)-(k (k)ij ij ij ij ij c c c ηc c α++= Δηα∑=-=∂∂≈∂∂mj jj jj m b x c h w k u k y k u k y 1211)()()()(在该网络中,网络输入信号为两个,即u(k),y(k-1)。

网络初始权值及高斯函数参数初始权值可取随机值,也可通过仿真测试后获得。

(2)输入信号及相关参数的设定:输入信号为正弦信号:u(k)=0.5sin(2πt),采样时间为0.001s,网络隐层神经元个数取m=4,网络结构设定为2-4-1,网络的初始权值取随机值,高斯函数的初始值取C j=[0.5 0.5]T,B=[1.5 1.5 1.5 1.5]T。

网络学习参数ɑ=0.05, =0.5。

(3)使用matlab编辑仿真程序。

仿真程序如下:%RBF identificationclear all;close all;alfa=0.05;xite=0.5;x=[0,0]';b=1.5*ones(4,1);c=0.5*ones(2,4);w=rands(4,1);w_1=w;w_2=w_1;c_1=c;c_2=c_1;b_1=b;b_2=b_1;d_w=0*w;d_b=0*b;y_1=0;ts=0.001;for k=1:1:2000time(k)=k*ts;u(k)=0.50*sin(1*2*pi*k*ts);y(k)=u(k)^3+2*y_1/(3+y_1^2);x(1)=u(k);x(2)=y_1;for j=1:1:4h(j)=exp(-norm(x-c(:,j))^2/(2*b(j)*b(j)));endym(k)=w'*h';em(k)=y(k)-ym(k);for j=1:1:4d_w(j)=xite*em(k)*h(j);d_b(j)=xite*em(k)*w(j)*h(j)*(b(j)^-3)*norm(x-c(:,j))^2;for i=1:1:2d_c(i,j)=xite*em(k)*w(j)*h(j)*(x(i)-c(i,j))*(b(j)^-2);endendw=w_1+d_w+alfa*(w_1-w_2);b=b_1+d_b+alfa*(b_1-b_2);c=c_1+d_c+alfa*(c_1-c_2);yu=0;for j=1:1:4yu=yu+w(j)*h(j)*(c(1,j) -x(1))/b(j)^2;enddyu(k)=yu;y_1=y(k);w_2=w_1;w_1=w;c_2=c_1;c_1=c;b_2=b_1;b_1=b;endfigure(1);plot(time,y,'r',time,ym,'b');xlabel('time(s)');ylabel('y and ym');10figure(2);plot(time,y-ym,'r');xlabel('time(s)');ylabel('idengtification error');figure(3);plot(time,dyu,'r');xlabel('time(s)');ylabel('dyu');(4)仿真结果如下图所示:图3 RBF 网络辨识结果图4 RBF 网络辨识误差图5 Jacobian信息的辨识(5)仿真小结:RBF神经网络具有BP网络无法比拟的优点:全局优化、最佳逼近的性质,相对快速的学习方法,BP网络应用的局限性口益突显也使得RBF网络的应用越来越广泛。

应用RBF神经网络进行函数逼近学习速度快,网络性能好。

神经网络的输出与要求符合,仿真成功。

五、心得体会:回顾起在这整整半个月日子的课程设计,我感慨颇多,从理论到实践,我学到很多很多的东西,不仅巩固了以前所学过的知识,而且学到了很多在书本上所没有学到过的内容。

通过这次课程设计使我懂得了理论与实际相结合是很重要的,只有理论知识是远远不够的,只有把所学的理论知识与实践相结合起来,从理论中得出结论,才是真正的知识,才能提高自己的实际动手能力和独立思考的能力。

在设计11的过程遇到了各种各样的问题,同时在设计的过程中发现了自己的不足之处,发现对以前所学过的知识理解得不够深刻,掌握得不够牢固,通过这次课程设计,把以前所学过的知识重新温故,巩固和升华了所学的知识。