最新模式识别期末考试

最新模式识别期末考试

问答1. 什么是模式?通过对具体个别事物进行观测所得到的具有时间和空间分布的信息称为模式。

模式所指的不是事物本身,而是我们从事物中获得的信息。

2. 模式识别系统主要由哪些部分组成?信息获取,预处理,特征提取与选择,分类决策,后处理。

3. 最小错误率贝叶斯分类器设计过程?答:根据训练数据求出先验概率类条件概率分布 p ( x |W i ), i =1,2 \ P (X | W j ) P (w j )如果输入待测样本 X ,计算X 的后验概率根据后验概率大小进行分类决策分析。

4. 怎样利用朴素贝叶斯方法获得各个属性的类条件概率分布?答:假设各属性独立,P(x| 3 i) =P(x1, x2, …,xn | 3 i) = P(x1| 3 i) P(x2| 3 i)…P(xn| 3 i)后验概率: P( 3 i|x) = P( 3 i) P(x1|3 i) P(x2| 3 i)…P(xn| 3 i) 类别清晰的直接分类算,如果是数据连续的,假设属性服从正态分布,算出每个类的均 值方差,最后得到类条件概率分布。

方差:var(x) (x^x)A 2 m —1 i 二二:解答1.设有如下三类模式样本集 3 1, 3 2和3 3,其先验概率相等,求 S W 和Sb3 1 : {(1 0) T , (2 0) T , (1 1)、3 2 : {(-1 0) T , (0 1) T, (-1 1)T}3 3: {(-1-1) T, (0 -1) T , (0 -2) T }答:由于三类样本集的先验概率相等,则概率均为1/3。

多类情况的类内散度矩阵,可写成各类的类内散布矩阵的先验概率的加权和,即:ccS w P®i )E{(x —m)(x —mJ T|斜}=送 C ii =1i 4类间散布矩阵常写成:cS b「P(・i)(m i - m °)(m i - m °)T其中,m 。

为多类模式(如共有 c 类)分布的总体均值向量,即:P ( X | W i ) P (W i ) 2利用贝叶斯公式得到后验概率 P(W i | x)二均值:1mmean(x)xim y 其中Ci 是第i 类的协方差矩阵。

(完整word版)【模式识别】期末考试试卷01

《模式识别》期末考试试题(B)一、填空题(15个空,每空2分,共30分)1.基于机器学习的模式识别系统通常由两个过程组成, 即分类器设计和()。

2.统计模式识别把( )表达为一个随机向量(即特征向量), 将模式类表达为由有穷或无穷个具有相似数值特性的模式组成的集合.3.特征一般有两种表达方法:(1)将特征表达为数值;(2)将特征表达为()。

4.特征提取是指采用( )实现由模式测量空间向特征空间的转变。

5.同一类模式类样本的分布比较集中,没有或临界样本很少,这样的模式类称为()。

6.加权空间的所有分界面都通过()。

7.线性多类判别:若每两个模式类间可用判别平面分开, 在这种情况下,M类有( )个判别函数,存在有不确定区域.8.当取0—1损失函数时,最小风险贝叶斯判决准则等价于( )判决准则。

9.Neyman-Pearson决策的基本思想是()某一错误率,同时追求另一错误率最小。

10.聚类/集群:用事先不知样本的类别,而利用样本的先验知识来构造分类器属于( )学习. 11.相似性测度、聚类准则和( )称为聚类分析的三要素。

12.K/C均值算法使用的聚类准则函数是误差平方和准则,通过反复迭代优化聚类结果,使所有样本到各自所属类别的中心的()达到最小。

13.根据神经元的不同连接方式,可将神经网络分为分层网络和相互连接型网络两大类。

其中分层网络可细分为前向网络、( )和层内互连前向网络三种互连方式.14.神经网络的特性及能力主要取决于网络拓扑结构及( )。

15.BP神经网络是采用误差反向传播算法的多层前向网络,其中,神经元的传输函数为S型函数,网络的输入和输出是一种( )映射关系。

二、简答题(2题,每小题10分,共20分)1.两类问题的最小风险Bayes决策的主要思想是什么?2.已知一组数据的协方差矩阵为11/21/21⎡⎤⎢⎥⎣⎦,试问: (1)协方差矩阵中各元素的含义是什么? (2)K —L 变换的最佳准则是什么?(3)为什么说经K-L 变换后消除了各分量之间的相关性?三、 计算题(2题,每小题13分,共26分)1.已知有两类样本集,分别为ω1={x 1, x 2}={(1,2)T , (-1,0)T }; ω2={x 3, x 4} ={(—1,—2)T , (1,-1)T }设初始权值w 1=(1,1,1)T , ρk =1,试用感知器固定增量法求判别函数,画出决策面。

人工智能之模式识别_北京理工大学中国大学mooc课后章节答案期末考试题库2023年

人工智能之模式识别_北京理工大学中国大学mooc课后章节答案期末考试题库2023年1.采用非线性激活函数可以实现感知器解决非线性分类问题。

参考答案:错误2.下列关于最大池化的说法中错误的是?参考答案:LeNet采用的是最大池化方法3.填充树法由顶向底的方法和由底向顶填充相反。

参考答案:正确4.语言可以是无限的但是句子必须是有限的。

参考答案:正确5.文法是由下列哪些参数构成的?参考答案:起始符S_终止符V_T_非终止符V_N_产生式P6.感知器算法应用什么方法求解准则函数的最优值?参考答案:梯度下降法7.下列关于对比散度算法的说法中错误的是?参考答案:深度信念网中多层受限玻尔兹曼机同时通过对比散度算法完成预训练8.下列选项中,属于模式识别系统的环节是?参考答案:分类器训练_模式采集_分类决策_预处理与特征生成9.分类器函数的VC维h越大,将使下列选项中的哪些数据发生变化?参考答案:置信风险越大_结构风险越大_分类器泛化能力越差10.利用SVM将低维空间中的非线性问题映射到高维空间,存在哪些问题?参考答案:不确定需要映射到多少维的空间上,非线性问题才会转化为线性问题_如何找到合适的映射函数φ_增加计算量,可能会因为维数灾难无法解决11.本课程中介绍的与句法模式识别相关的基本概念有?参考答案:字母表_句子(链)_文法_语言12.下列选项中属于贝叶斯分类器的特点的是?参考答案:分类决策存在错误率_先验概率已知,以新获得的信息对先验概率进行修正13.贝叶斯分类器的训练,是从样本集数据中估计出____。

参考答案:类条件概率_先验概率14.下列选项中属于特征降维的优点的是?参考答案:降低模式识别任务的复杂度_提升分类决策的正确率_用更少的代价设计出更加优秀的模式识别系统15.下列说法中正确的是?参考答案:聚类结果受特征选取和聚类准则的影响_数据聚类没有预先分好类的样本集_聚类结果受各特征量纲标尺的影响_数据聚类没有已知的分类决策规则16.设计一个组合分类器需要满足什么要求?参考答案:每个基分类器的训练集和训练结果要有差异_组合分类器需要重点考虑方差和偏差_基分类器的分类正确率大于50%17.下列选项中属于决策树分类器的特点的是?参考答案:需选择分支后两个子节点纯度最高的特征作为一个节点的测试特征_速度快,分类决策规则明确_未考虑特征间的相关性_有监督学习方法18.下列选项中属于Adaboost算法的特点的是?参考答案:异常数据(离群点)影响大_不易实现并行化训练_只能解决二分类问题_算法的组合过程能减小偏差19.下列选项中属于反馈型神经网络的是?参考答案:Hopfield网络_受限玻尔兹曼机20.调节以下哪些部分可以对神经网络的性能造成影响?参考答案:权值_激活函数_隐层单元_阈值21.下列选项中关于前馈网络和反馈网络的说法中正确的是?参考答案:前馈网络输出不作用在网络的输入中_前馈网络为静态网络_反馈网络下一时刻的输出与上一时刻的输出有关_反馈网络为动态网络22.下列选项中属于BP网络的不足的是?参考答案:容易陷入局部极小值_全连接网络计算大_隐层神经元数量难以确定_无法做到深度很深,会产生梯度消失23.下列选项中属于深度学习的特点的是?参考答案:需要大量样本进行训练_逐层抽象,发现数据集的特征_是层数较多的大规模神经网络_需要大规模并行计算能力的支持24.利用链式求导法则需要哪些信息?参考答案:损失函数与网络输出向量之间的函数关系_激活函数输出对净激励的导数25.深度信念网不能用于图像识别的原因是?参考答案:深度信念网为一维向量输入,不能直接用于二位图像_需要进行认知-重构的双向计算,学习速度不够快_受限玻尔兹曼机的层间全连接,权值数量太多26.Jp作为类内、类间可分性的概率距离度量时应该满足下列选项中哪些条件?参考答案:当两类完全不可分时,Jp等于0_当两类完全可分时,Jp取得最大值27.特征选择的算法包括以下哪些?参考答案:分支定界法_顺序后退法_穷举法_顺序前进法28.特征降维的方法包括特征选择和特征提取。

最新模式识别与机器学习期末考查试题及参考答案

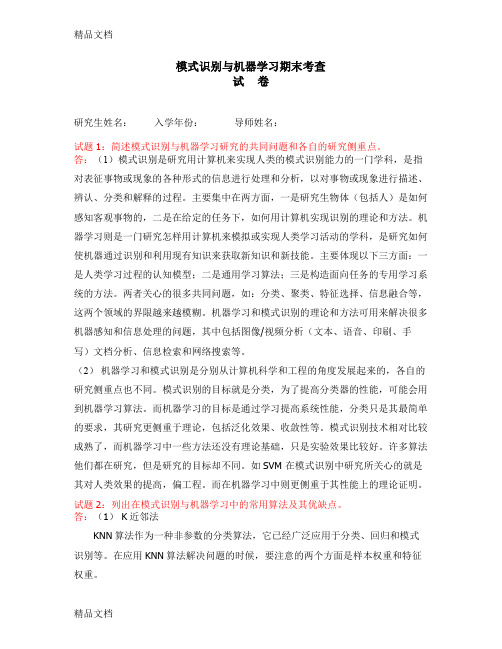

模式识别与机器学习期末考查试卷研究生姓名:入学年份:导师姓名:试题1:简述模式识别与机器学习研究的共同问题和各自的研究侧重点。

答:(1)模式识别是研究用计算机来实现人类的模式识别能力的一门学科,是指对表征事物或现象的各种形式的信息进行处理和分析,以对事物或现象进行描述、辨认、分类和解释的过程。

主要集中在两方面,一是研究生物体(包括人)是如何感知客观事物的,二是在给定的任务下,如何用计算机实现识别的理论和方法。

机器学习则是一门研究怎样用计算机来模拟或实现人类学习活动的学科,是研究如何使机器通过识别和利用现有知识来获取新知识和新技能。

主要体现以下三方面:一是人类学习过程的认知模型;二是通用学习算法;三是构造面向任务的专用学习系统的方法。

两者关心的很多共同问题,如:分类、聚类、特征选择、信息融合等,这两个领域的界限越来越模糊。

机器学习和模式识别的理论和方法可用来解决很多机器感知和信息处理的问题,其中包括图像/视频分析(文本、语音、印刷、手写)文档分析、信息检索和网络搜索等。

(2)机器学习和模式识别是分别从计算机科学和工程的角度发展起来的,各自的研究侧重点也不同。

模式识别的目标就是分类,为了提高分类器的性能,可能会用到机器学习算法。

而机器学习的目标是通过学习提高系统性能,分类只是其最简单的要求,其研究更侧重于理论,包括泛化效果、收敛性等。

模式识别技术相对比较成熟了,而机器学习中一些方法还没有理论基础,只是实验效果比较好。

许多算法他们都在研究,但是研究的目标却不同。

如SVM 在模式识别中研究所关心的就是其对人类效果的提高,偏工程。

而在机器学习中则更侧重于其性能上的理论证明。

试题2:列出在模式识别与机器学习中的常用算法及其优缺点。

答:(1) K近邻法KNN算法作为一种非参数的分类算法,它已经广泛应用于分类、回归和模式识别等。

在应用KNN算法解决问题的时候,要注意的两个方面是样本权重和特征权重。

优缺点:非常有效,实现简单,分类效果好。

模式识别期末试题及答案

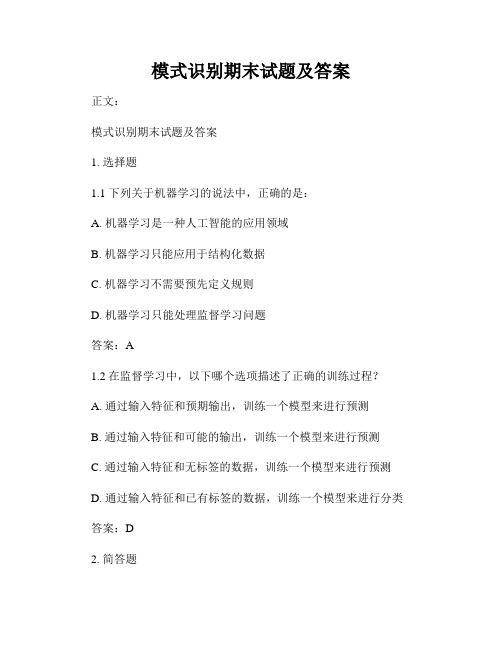

模式识别期末试题及答案正文:模式识别期末试题及答案1. 选择题1.1 下列关于机器学习的说法中,正确的是:A. 机器学习是一种人工智能的应用领域B. 机器学习只能应用于结构化数据C. 机器学习不需要预先定义规则D. 机器学习只能处理监督学习问题答案:A1.2 在监督学习中,以下哪个选项描述了正确的训练过程?A. 通过输入特征和预期输出,训练一个模型来进行预测B. 通过输入特征和可能的输出,训练一个模型来进行预测C. 通过输入特征和无标签的数据,训练一个模型来进行预测D. 通过输入特征和已有标签的数据,训练一个模型来进行分类答案:D2. 简答题2.1 请解释什么是模式识别?模式识别是指在给定一组输入数据的情况下,通过学习和建模,识别和分类输入数据中的模式或规律。

通过模式识别算法,我们可以从数据中提取重要的特征,并根据这些特征进行分类、聚类或预测等任务。

2.2 请解释监督学习和无监督学习的区别。

监督学习是一种机器学习方法,其中训练数据包含了输入特征和对应的标签或输出。

通过给算法提供已知输入和输出的训练样本,监督学习的目标是学习一个函数,将新的输入映射到正确的输出。

而无监督学习则没有标签或输出信息。

无监督学习的目标是从未标记的数据中找到模式和结构。

这种学习方法通常用于聚类、降维和异常检测等任务。

3. 计算题3.1 请计算以下数据集的平均值:[2, 4, 6, 8, 10]答案:63.2 请计算以下数据集的标准差:[1, 3, 5, 7, 9]答案:2.834. 综合题4.1 对于一个二分类问题,我们可以使用逻辑回归模型进行预测。

请简要解释逻辑回归模型的原理,并说明它适用的场景。

逻辑回归模型是一种用于解决二分类问题的监督学习算法。

其基本原理是通过将特征的线性组合传递给一个非线性函数(称为sigmoid函数),将实数值映射到[0,1]之间的概率。

这个映射的概率可以被解释为某个样本属于正类的概率。

逻辑回归适用于需要估计二分类问题的概率的场景,例如垃圾邮件分类、欺诈检测等。

模式识别期末试题

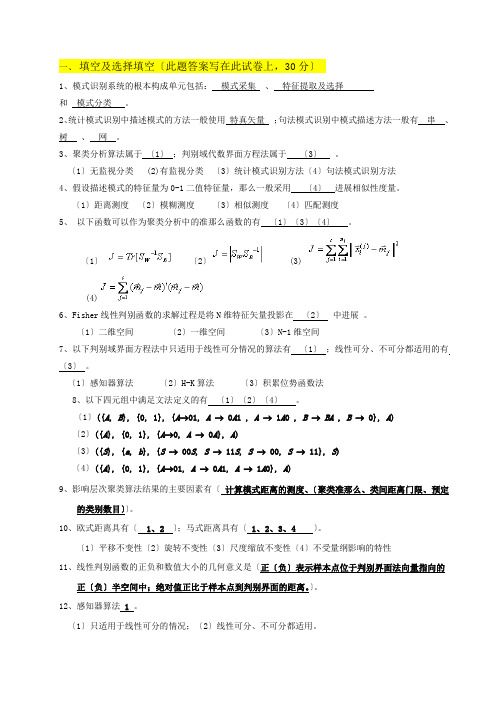

一、填空及选择填空〔此题答案写在此试卷上,30分〕1、模式识别系统的根本构成单元包括:模式采集、特征提取及选择和模式分类。

2、统计模式识别中描述模式的方法一般使用特真矢量;句法模式识别中模式描述方法一般有串、树、网。

3、聚类分析算法属于〔1〕;判别域代数界面方程法属于〔3〕。

〔1〕无监视分类 (2)有监视分类〔3〕统计模式识别方法〔4〕句法模式识别方法4、假设描述模式的特征量为0-1二值特征量,那么一般采用〔4〕进展相似性度量。

〔1〕距离测度〔2〕模糊测度〔3〕相似测度〔4〕匹配测度5、以下函数可以作为聚类分析中的准那么函数的有〔1〕〔3〕〔4〕。

〔1〕〔2〕 (3)(4)6、Fisher线性判别函数的求解过程是将N维特征矢量投影在〔2〕中进展。

〔1〕二维空间〔2〕一维空间〔3〕N-1维空间7、以下判别域界面方程法中只适用于线性可分情况的算法有〔1〕;线性可分、不可分都适用的有〔3〕。

〔1〕感知器算法〔2〕H-K算法〔3〕积累位势函数法8、以下四元组中满足文法定义的有〔1〕〔2〕〔4〕。

〔1〕({A, B}, {0, 1}, {A→01, A→ 0A1 , A→ 1A0 , B→BA , B→ 0}, A)〔2〕({A}, {0, 1}, {A→0, A→ 0A}, A)〔3〕({S}, {a, b}, {S → 00S, S → 11S, S → 00, S → 11}, S)〔4〕({A}, {0, 1}, {A→01, A→ 0A1, A→ 1A0}, A)9、影响层次聚类算法结果的主要因素有〔计算模式距离的测度、〔聚类准那么、类间距离门限、预定的类别数目〕〕。

10、欧式距离具有〔 1、2 〕;马式距离具有〔1、2、3、4 〕。

〔1〕平移不变性〔2〕旋转不变性〔3〕尺度缩放不变性〔4〕不受量纲影响的特性11、线性判别函数的正负和数值大小的几何意义是〔正〔负〕表示样本点位于判别界面法向量指向的正〔负〕半空间中;绝对值正比于样本点到判别界面的距离。

模式识别期末试题汇编

一、填空与选择填空(本题答案写在此试卷上,30分)1、模式识别系统的基本构成单元包括:模式采集、特征提取与选择和模式分类。

2、统计模式识别中描述模式的方法一般使用特真矢量;句法模式识别中模式描述方法一般有串、树、网。

3、聚类分析算法属于(1);判别域代数界面方程法属于(3)。

(1)无监督分类 (2)有监督分类(3)统计模式识别方法(4)句法模式识别方法4、若描述模式的特征量为0-1二值特征量,则一般采用(4)进行相似性度量。

(1)距离测度(2)模糊测度(3)相似测度(4)匹配测度5、下列函数可以作为聚类分析中的准则函数的有(1)(3)(4)。

(1)(2) (3)(4)6、Fisher线性判别函数的求解过程是将N维特征矢量投影在(2)中进行。

(1)二维空间(2)一维空间(3)N-1维空间7、下列判别域界面方程法中只适用于线性可分情况的算法有(1);线性可分、不可分都适用的有(3)。

(1)感知器算法(2)H-K算法(3)积累位势函数法8、下列四元组中满足文法定义的有(1)(2)(4)。

(1)({A, B}, {0, 1}, {A→01, A→ 0A1 , A→ 1A0 , B→BA , B→ 0}, A)(2)({A}, {0, 1}, {A→0, A→ 0A}, A)(3)({S}, {a, b}, {S → 00S, S → 11S, S → 00, S → 11}, S)(4)({A}, {0, 1}, {A→01, A→ 0A1, A→ 1A0}, A)9、影响层次聚类算法结果的主要因素有(计算模式距离的测度、(聚类准则、类间距离门限、预定的类别数目))。

10、欧式距离具有( 1、2 );马式距离具有(1、2、3、4 )。

(1)平移不变性(2)旋转不变性(3)尺度缩放不变性(4)不受量纲影响的特性11、线性判别函数的正负和数值大小的几何意义是(正(负)表示样本点位于判别界面法向量指向的正(负)半空间中;绝对值正比于样本点到判别界面的距离。

《模式识别》试题库(共享).docx

《模式识别》试题库一、基本概念题1.1 模式识别的三大核心问题:是:、、。

1.2、模式分布为团状时,选用聚类算法较好。

1.3欧式距离具有o 马式距离具有o(1)平移不变性(2)旋转不变性(3)尺度缩放不变性(4)不受量纲影响的特性1.4描述模式相似的测度有:=(1)距离测度(2)模糊测度(3)相似测度(4)匹配测度1.5利用两类方法处理多类问题的技术途径有:(1);(2);(3) o其中最常用的是第个技术途径。

1.6判别函数的正负和数值大小在分类中的意义是:,__________________________________________________________________________________1.7感知器算法=(1)只适用于线性可分的情况;(2)线性可分、不可分都适用。

1.8积累位势函数法的判别界面一般为o(1)线性界面;(2)非线性界面。

1.9基于距离的类别可分性判据有:oS B S B(1)『「[,”咒](2)(3)1.10作为统计判别问题的模式分类,在()情况下,可使用聂曼-皮尔逊判决准则。

1.11确定性模式非线形分类的势函数法中,位势函数K(x,xQ与积累位势函数K(x)的关系为()O1.12用作确定性模式非线形分类的势函数法,通常,两个n维向量X和Xk的函数K(x,xD若同时满足下列三个条件,都可作为势函数。

①();②();③K(x, x k)是光滑函数,且是x和珏之间距离的单调下降函数。

1.13散度J”越大,说明。

类模式与①」类模式的分布( )。

当。

类模式与®类模式的分布相同时,Jij=()。

1.14若用Parzen窗法估计模式的类概率密度函数,窗口尺寸hl过小可能产生的问题是( ),hl过大可能产生的问题是( )01.15信息炳可以作为一种可分性判据的原因是:。

1.16作为统计判别问题的模式分类,在( )条件下,最小损失判决规则与最小错误判决规则是等价的。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

一:问答1. 什么是模式?通过对具体个别事物进行观测所得到的具有时间和空间分布的信息称为模式。

模式所指的不是事物本身,而是我们从事物中获得的信息。

2. 模式识别系统主要由哪些部分组成?信息获取,预处理,特征提取与选择,分类决策,后处理。

3. 最小错误率贝叶斯分类器设计过程?答:根据训练数据求出先验概率 类条件概率分布 利用贝叶斯公式得到后验概率如果输入待测样本X ,计算X 的后验概率根据后验概率大小进行分类决策分析。

4. 怎样利用朴素贝叶斯方法获得各个属性的类条件概率分布?答:假设各属性独立,P(x| ωi) =P(x1, x2, …, xn |ωi) = P(x1| ωi) P(x2|ωi)… P(xn|ωi)后验概率:P(ωi|x) = P(ωi) P(x1|ωi) P(x2|ωi)… P(xn|ωi)类别清晰的直接分类算,如果是数据连续的,假设属性服从正态分布,算出每个类的均值方差,最后得到类条件概率分布。

均值:∑==mi xi m x mean 11)( 方差:2)^(11)var(1∑=--=m i x xi m x 二:解答1.设有如下三类模式样本集ω1,ω2和ω3,其先验概率相等,求Sw 和Sbω1:{(1 0)T , (2 0) T , (1 1) T}ω2:{(-1 0)T , (0 1) T , (-1 1) T}ω3:{(-1 -1)T , (0 -1) T , (0 -2) T}答:由于三类样本集的先验概率相等,则概率均为 1/3。

多类情况的类内散度矩阵,可写成各类的类内散布矩阵的先验概率的加权和,即:∑∑===--=ci ii Ti i c i i w C m x m x E P S 11}|))(({)(ωω其中Ci 是第i 类的协方差矩阵。

其中⎪⎪⎪⎪⎭⎫ ⎝⎛=31341m ,⎪⎪⎪⎪⎭⎫⎝⎛=3232-2m ,⎪⎪⎪⎪⎭⎫ ⎝⎛=34-31-3m则=++=321S w w w w S S S ⎪⎪⎭⎫ ⎝⎛=⎪⎪⎭⎫ ⎝⎛+⎪⎪⎭⎫ ⎝⎛+⎪⎪⎭⎫ ⎝⎛2/3 1/9-1/9- 2/32/3 1/3-1/3- 2/3312/3 1/31/32/3312/3 1/3-1/3- 2/331 类间散布矩阵常写成:T i ici ib m m m mP S ))(()(001--=∑=ω其中,0m 为多类模式(如共有c 类)分布的总体均值向量,即: 2,1),(=i w P i 2,1),|(=i w x p i ∑==21)()|()()|()|(j j j i i i w P w x P w P w x P x w Pc i m P x E m i ci i i ,,2,1,,)(}{10 =∀==∑=ωω⎪⎪⎪⎪⎭⎫ ⎝⎛=⎪⎪⎪⎪⎭⎫ ⎝⎛=91-9131-31310m 则T i i ci i b m m m m P S ))(()(001--=∑=ω=⎪⎪⎭⎫⎝⎛=⎪⎪⎭⎫ ⎝⎛+⎪⎪⎭⎫ ⎝⎛+⎪⎪⎭⎫ ⎝⎛0.7654 0.16050.1605 0.76541.4938 0.54320.5432 0.1975310.6049 0.6049-0.6049- 0.6049310.1975 0.54320.5432 1.493831 2. 设有如下两类样本集,其出现的概率相等:ω1:{(0 0 0)T , (1 0 0) T , (1 0 1) T , (1 1 0) T}ω2:{(0 0 1)T , (0 1 0) T , (0 1 1) T , (1 1 1) T} 用K-L 变换,分别把特征空间维数降到二维和一维。

答:把1w 和2w 两类模式作为一个整体来考虑,故0 1 1 1 0 0 0 1 0 0 0 1 0 1 1 1 0 0 1 0 1 0 1 1x ⎛⎫ ⎪= ⎪ ⎪⎝⎭0.5{}0.50.5m E x ⎛⎫⎪== ⎪ ⎪⎝⎭符合K-L 变换进行特征压缩的最佳条件。

因P(ω1)=P(ω2)=0.5,故协方差矩阵0.25 0 0{()()} 0 0.25 0 0 0 0.25x C E x m x m ⎛⎫⎪'=--= ⎪⎪⎝⎭从题中可以看出,协方差矩阵x C 已经是个对角阵,故x C 的本征值1230.25λλλ=== 其对应的特征向量为:1231000,1,0001φφφ⎛⎫⎛⎫⎛⎫⎪ ⎪ ⎪=== ⎪ ⎪ ⎪ ⎪ ⎪ ⎪⎝⎭⎝⎭⎝⎭(1)、将其降到二维的情况:选λ1和λ2对应的变换向量作为变换矩阵,在这里我们取1φ和2φ,得到100100⎛⎫⎪Φ= ⎪⎪⎝⎭。

由y x '=Φ得变换后的二维模式特征为1w :0111{,,,}0001⎛⎫⎛⎫⎛⎫⎛⎫⎪ ⎪ ⎪ ⎪⎝⎭⎝⎭⎝⎭⎝⎭2w :0001{,,,}0111⎛⎫⎛⎫⎛⎫⎛⎫ ⎪ ⎪ ⎪ ⎪⎝⎭⎝⎭⎝⎭⎝⎭(2)、将其降到一维的情况:选λ1对应的变换向量作为变换矩阵,由y x'=Φ得变换后的一维模式特征为w:{0,1,1,1}1w:{0,0,0,1}2三:编程:1. 已知样本集呈现正态分布,采用基于最小错误率的贝叶斯决策方法,编程待定样本x=(2,0)T的类别,并画出分界线。

解:clearD1=[1,1,2;1,0,-1;];D2=[-1,-1,-2;1,0,-1;];u1=mean(D1,2);u2=mean(D2,2);c1=zeros(size(D1,1),size(D1,1));for i=1:size(D1,2)c1=c1+D1(:,i)*D1(:,i)';endc1=c1/size(D1,2)-u1*u1';c2=zeros(size(D2,1),size(D2,1));for i=1:size(D2,2)c2=c2+D2(:,i)*D2(:,i)';endc2=c2/size(D2,2)-u2*u2';I=eye(size(c1,1),size(c1,1));ic1=c1\I;ic2=c2\I;W1=-0.5*ic1;W2=-0.5*ic2;w1=ic1*u1;w2=ic2*u2;w10=-0.5*log(det(c1))-0.5*u1'*ic1*u1;w20=-0.5*log(det(c2))-0.5*u2'*ic2*u2;syms x1 x2;x=[x1;x2];fprintf('决策界面方程为:')D=x'*(W1-W2)*x+(w1-w2)'*x+(w10-w20);pretty(D)fprintf('(2,0)代入决策面方程的值为:')value=subs(D,{x1,x2},[2 0])figureezplot(D)hold onplot(D1(1,:),D1(2,:),'bo')plot(D2(1,:),D2(2,:),'ks')plot(2,0,'rp')决策界面方程为:48 x1 - 9 x1 conj(x2) - 9 x2 conj(x1)(2,0)代入决策面方程的值为:value =96有运行结果看出x=(2 0)T属于第一类2. 已知四个训练样本w1={(0,0),(0,1)} w2={(1,0),(1,1)} 使用感知器固定增量法求判别函数设w0=(1,1,1,1) ρ=1要求编写程序,写出判别函数,并打出图表。

解:clear allw=[0 0 1;0 1 1;-1 0 -1;-1 -1 -1];W=[1 1 1];flag=1;flagS=zeros(1,size(w,1));rowk=1;k=0;while flagfor i=1:size(w,1)if isempty(find(flagS==0))flag=0;break; end k=k+1; pb=w(i,:)*W'; if pb<=0 flagS(i)=0; W=W+rowk*w(i,:); elseflagS(i)=1; end end end disp('W=') disp(W) disp('k=') disp(k) wp1=[0 0;0 1]; wp2=[1 0;1 1];plot(wp1(:,1),wp1(:,2),'o') hold onplot(wp2(:,1),wp2(:,2),'*') hold on y=-0.2:1/100:1.2;plot(1/3*ones(1,size(y)),y,'r-') axis([-0.25 1.25 -0.25 1.25]) 结果:W=-3 0 1 k=17判别函数为:13)(1+-=x x g3. 编程实现下列样本的fisher 法分类:解:x1=[0 1 1 1];y1=[0 0 0 1];z1=[0 0 1 0]; x2=[0 0 0 1];y2=[0 1 1 1];z2=[1 1 0 1]; m1x=mean(x1(:)); m1y=mean(y1(:)); m1z=mean(z1(:)); m1=[m1x m1y m1z]; m2x=mean(x2(:)); m2y=mean(y2(:)); m2z=mean(z2(:)); m2=[m2x m2y m2z]; S1=zeros(3,3); for i=1:4S1=S1+([x1(i),y1(i),z1(i)]'-m1)*([x1(i),y1(i),z1(i)]'-m1)'; endS2=zeros(3,3); for i=1:4S2=S2+([x2(i),y2(i),z2(i)]'-m2)*([x2(i),y2(i),z2(i)]'-m2)'; end Sw=S1+S2;W=(inv(Sw))*(m1-m2); x=0:.1:2.5; y=0:.1:3;[X,Y]=meshgrid(x,y); Z=(W(1)*X+W(2)*Y)/(-W(3)); mesh(X,Y ,Z) hold on ; hidden off ; Y1=0; for i=1:4Y1=Y1+W'*[x1(i),y1(i),z1(i)]'; end M1=Y1/4; Y2=0; for i=1:4()()()(){}()()()(){}12:000,100,101,110:001,011,010,111T T T TT T T TωωY2=Y2+W'*[x2(i),y2(i),z2(i)]'; endM2=Y2/4;Y0=(M1+M2)/2;X1=[0 0 0]';if W'*X1>Y0disp('点X1(0,0,0)属于第一类') plot3(0,0,0,'or')elsedisp('点X1(0,0,0)属于第二类') plot3(0,0,0,'ob')endX2=[1 0 0]';if W'*X2>Y0disp('点X2(1,0,0)属于第一类') plot3(1,0,0,'or')elsedisp('点X2(1,0,0)属于第二类') plot3(1,0,0,'ob')endX3=[1 0 1]';if W'*X3>Y0disp('点X3(1,0,1)属于第一类') plot3(1,0,1,'or')elsedisp('点X3(1,0,1)属于第二类') plot3(1,0,1,'ob')endX4=[1 1 0]';if W'*X4>Y0disp('点X4(1,1,0)属于第一类') plot3(1,1,0,'or')elsedisp('点X4(1,1,0)属于第二类') plot3(1,1,0,'ob')endX5=[0 0 1]';if W'*X5>Y0disp('点X5(0,0,1)属于第一类') plot3(0,0,1,'or')elsedisp('点X5(0,0,1)属于第二类') plot3(0,0,1,'ob')endX6=[0 1 1]'; if W'*X6>Y0disp('点X6(0,1,1)属于第一类') plot3(0,1,1,'or') elsedisp('点X6(0,1,1)属于第二类') plot3(0,1,1,'ob') end X7=[0 1 0]'; if W'*X7>Y0disp('点X7(0,1,0)属于第一类') plot3(0,1,0,'or') elsedisp('点X7(0,1,0)属于第二类') plot3(0,1,0,'ob') end X8=[1 1 1]'; if W'*X8>Y0disp('点X8(1,1,1)属于第一类') plot3(1,1,1,'or') elsedisp('点X8(1,1,1)属于第二类') plot3(1,1,1,'ob') end4. 已知欧氏三维空间中两类9个训练样本1:用最近邻法编程求样本(0 0)T的分类,并画出分界线。