信息理论基础第四章课件

合集下载

数字通信原理4信息论基础1103页PPT文档

xMy1,pxMy1 xMy2,pxMy2 ...xMyN,pxMyN

满足条件:

M i1

N j1pxiyj 1

2020/4/5

11

离散信源的联合熵与条件熵(续)

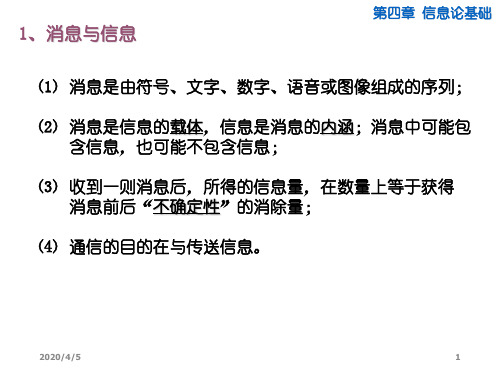

第四章 信息论基础

两随机变量的联合熵

定义4.2.3 两随机变量 X :x iy Y j,i 1 , 2 ,. M ; .j .1 , 2 ,,. N ..,

I[P(xM)]

H(X)

图4-2-1 符号的平均信息量与各个符号信息量间关系 的形象表示

2020/4/5

7

离散信源的熵(续) 示例:求离散信源

X: 0 1 2 3

pX: 38 14 14 18

的熵。

第四章 信息论基础

按照定义:

H X i4 1pxilopg xi 8 3lo8 3g 1 4lo1 4g 1 4lo1 4g 8 1lo8 1g

2020/4/5

6

4、离散信源的平均信息量:信源的熵

第四章 信息论基础

离散信源的熵

定义4.2.2 离散信源 X:xi,i 1 ,2 ,.N ..的,熵

H X iN 1p xilop x g i

熵是信源在统计意义上每个符号的平均信息量。

I[P(x1)]

I[P(x2)]

I[P(x3)]

I[P(x4)]

同时满足概率函数和可加性两个要求。

2020/4/5

4

离散信源信的息量(续)

第四章 信息论基础

定义 离散消息xi的信息量:

IPxi loP g1xiloP gxi

信息量的单位与对数的底有关:

log以2为底时,单位为比特:bit

log以e为底时,单位为奈特:nit

信息理论基础 第四章 信道及信道容量

N N i 1 i 1

则存在:I ( X ; Y ) I ( X i ; Yi )

i 1

N

由定理1和定理2

当信源和信道都是无记忆时有:

N

I ( X ; Y ) I ( X i ; Yi )

i 1

当每个序列中的分量Xi取值于同一信源符号集, 且具有同一种概率分布,则输出Y的分量Yi也取值同一 符号集,则各I(Xi;Yi)是相等的。即:

a1 0

1 p

p p

0 b1

X

a2 1

Y

1 p

1 b2

其中:p表示传输中发生错误的概率

0 0 1 p 1 p 1 p 1 p

P

二元对称信道(BSC)(二进制对称信道)

a1 0

p

1 p 1 q

0 b1

? b2

1 b3

2.传输概率

p( y | x) p(Y b j | X ai ) p(b j | ai )

p(y|x)——描述信道中干扰影响的大小

3.信道矩阵P

——完全反映信道的特性

p11 p12 p1s p21 p22 p2 s P pr1 pr 2 prs

2.按其输入/输出之间关系的记忆性划分

无记忆信道:在某一时刻信道的输出消息仅与当前

信道的输入消息有关,而与之前时刻 的信道输入无关

在任一时刻信道的输出不仅与当前输 有记忆信道: 入有关,而且还与以前时刻输入有关

3.按其输入/输出信号之间是否是确定关系来分

有噪信道: 存在噪声,不存在确定关系

——实用价 值大,研究的理想对象

如果有 p( yn j | xn i) p( ym j | xm i) ,则信道为平

则存在:I ( X ; Y ) I ( X i ; Yi )

i 1

N

由定理1和定理2

当信源和信道都是无记忆时有:

N

I ( X ; Y ) I ( X i ; Yi )

i 1

当每个序列中的分量Xi取值于同一信源符号集, 且具有同一种概率分布,则输出Y的分量Yi也取值同一 符号集,则各I(Xi;Yi)是相等的。即:

a1 0

1 p

p p

0 b1

X

a2 1

Y

1 p

1 b2

其中:p表示传输中发生错误的概率

0 0 1 p 1 p 1 p 1 p

P

二元对称信道(BSC)(二进制对称信道)

a1 0

p

1 p 1 q

0 b1

? b2

1 b3

2.传输概率

p( y | x) p(Y b j | X ai ) p(b j | ai )

p(y|x)——描述信道中干扰影响的大小

3.信道矩阵P

——完全反映信道的特性

p11 p12 p1s p21 p22 p2 s P pr1 pr 2 prs

2.按其输入/输出之间关系的记忆性划分

无记忆信道:在某一时刻信道的输出消息仅与当前

信道的输入消息有关,而与之前时刻 的信道输入无关

在任一时刻信道的输出不仅与当前输 有记忆信道: 入有关,而且还与以前时刻输入有关

3.按其输入/输出信号之间是否是确定关系来分

有噪信道: 存在噪声,不存在确定关系

——实用价 值大,研究的理想对象

如果有 p( yn j | xn i) p( ym j | xm i) ,则信道为平

《信息论基础》课件

2

信息论与数学中的概率论、统计学、组合数学等 学科密切相关,这些学科为信息论提供了重要的 数学工具和理论基础。

3

信息论与物理学中的量子力学、热力学等学科也 有密切的联系,这些学科为信息论提供了更深层 次的理论基础。

信息论未来发展趋势

信息论将继续深入研究量子信 息论和网络信息论等领域,探 索更高效、更安全的信息传输

和处理技术。

随着人工智能和大数据等技 术的快速发展,信息论将在 数据挖掘、机器学习等领域

发挥更大的作用。

信息论还将继续关注网络安全 、隐私保护等问题,为构建安 全可靠的信息社会提供重要的

理论支持。

2023

REPORTING

THANKS

感谢观看

海明码(Hamming Code): 一种能够纠正一位错误的线性 纠错码。

里德-所罗门码(ReedSolomon Code):一种广泛 应用于数据存储和通信领域的 强纠错码。

差错控制机制

前向纠错(FEC)

01

在发送端采用纠错编码,使得接收端能够自动纠正传输过程中

的错误。

自动重传请求(ARQ)

02

接收端检测到错误后请求发送端重传数据,直到接收正确为止

常见信道编码技术

线性分组码

将信息序列划分为若干组,对每组进行线性 编码,常见的有汉明码、格雷码等。

循环码

将信息序列进行循环移位后进行编码,常见的有 BCH码、RS码等。

卷积码

将信息序列进行卷积处理后进行编码,常见 的有Convolutional Code等。

2023

PART 04

信息传输与错误控制

。

混合纠错(HEC)

03

结合前向纠错和自动重传请求,以提高数据传输的可靠性和效

信息技术基础第四章第三节ppt课件

高中信息技术

(必修)

第四章—— 信息的加工与表达(下)

第一节

第二节

第三节

第四节

4.3 信息的发布与交流

4.3.1 合乎规范地发布信息 1、交流: 信息发布的方式

类 型

视觉

听觉

视觉和听觉

途 径

报纸、杂志、书籍、网络

广播

电影、电视

信息接受者可以决定自己 接受者既不能控制 视觉的冲击较强烈,听觉处

速度,想停就停,不懂之 播音员的速度,也 于辅助的地位,而视觉所见

特 点

处可以重复看,其思索的 余地较大。接受者可以自 由地支配地点和时间。

不能要求播音员重 复播放,必须在声 音所及的范围内。

的是一瞬即逝的图像,往往 感性上的认识多,理性上的 认识则有一个有待上升的过

程,接受者使用时必须受到

完整版ppt课件

时间和地点的限制。 1

高中信息技术 (必修)

第四章—— 信息的加工与表达(下)

电子邮件是一种非常方便的非实时性的联系方式,也是信息社会中一种新型的通信方 式,能够快捷有效地进行信息的发布。

网络技术论坛 新闻组服务

利用网络技术论坛可以发布有关学术方面的信息。

新闻组就像是一个可以离线浏览的BBS,它是个人向新闻服务器粘贴邮件的集合地。 电脑在线时,我们可以通过新闻组浏览软件将新闻组里的帖子(邮件)全部下载到本 地电脑中来阅读,当然,我们也可以自由地在新闻组服务器上粘贴消息。使用新闻组 既可以节省大量上网时间,又可以阅读到大量资料,可谓一举两得。

第一节

第二节

第三节

第四节

2、在发布信息的过程中必须遵守一定的道德规范

不同的人,一同的信息类型,发布信息的方式往往不一样。在信息发布的过程 中,我们必须遵守一定的道德规范,才能够使信息的有效性、时效性和真实性得到 保证。 (1)不能不经授权随意转载别人的文章或资料,侵犯别人的知识产权。 (2)不得发布攻击、谩骂别人的言论。 (3)不得发布有黄、赌、毒方面的信息。计算机网络容易传播黄赌毒,那是一种罪 恶的诱惑,不要以为偶而放纵自己无所谓,不要因一念之差陷入罪恶的深渊。 (4)不得向别人发送垃圾邮件、带病毒的邮件,不要因为自己一时的好奇而给别人 制造不必要的麻烦。 (5)不得发布有损国家形象的信息,不得泄露国家机密。

(必修)

第四章—— 信息的加工与表达(下)

第一节

第二节

第三节

第四节

4.3 信息的发布与交流

4.3.1 合乎规范地发布信息 1、交流: 信息发布的方式

类 型

视觉

听觉

视觉和听觉

途 径

报纸、杂志、书籍、网络

广播

电影、电视

信息接受者可以决定自己 接受者既不能控制 视觉的冲击较强烈,听觉处

速度,想停就停,不懂之 播音员的速度,也 于辅助的地位,而视觉所见

特 点

处可以重复看,其思索的 余地较大。接受者可以自 由地支配地点和时间。

不能要求播音员重 复播放,必须在声 音所及的范围内。

的是一瞬即逝的图像,往往 感性上的认识多,理性上的 认识则有一个有待上升的过

程,接受者使用时必须受到

完整版ppt课件

时间和地点的限制。 1

高中信息技术 (必修)

第四章—— 信息的加工与表达(下)

电子邮件是一种非常方便的非实时性的联系方式,也是信息社会中一种新型的通信方 式,能够快捷有效地进行信息的发布。

网络技术论坛 新闻组服务

利用网络技术论坛可以发布有关学术方面的信息。

新闻组就像是一个可以离线浏览的BBS,它是个人向新闻服务器粘贴邮件的集合地。 电脑在线时,我们可以通过新闻组浏览软件将新闻组里的帖子(邮件)全部下载到本 地电脑中来阅读,当然,我们也可以自由地在新闻组服务器上粘贴消息。使用新闻组 既可以节省大量上网时间,又可以阅读到大量资料,可谓一举两得。

第一节

第二节

第三节

第四节

2、在发布信息的过程中必须遵守一定的道德规范

不同的人,一同的信息类型,发布信息的方式往往不一样。在信息发布的过程 中,我们必须遵守一定的道德规范,才能够使信息的有效性、时效性和真实性得到 保证。 (1)不能不经授权随意转载别人的文章或资料,侵犯别人的知识产权。 (2)不得发布攻击、谩骂别人的言论。 (3)不得发布有黄、赌、毒方面的信息。计算机网络容易传播黄赌毒,那是一种罪 恶的诱惑,不要以为偶而放纵自己无所谓,不要因一念之差陷入罪恶的深渊。 (4)不得向别人发送垃圾邮件、带病毒的邮件,不要因为自己一时的好奇而给别人 制造不必要的麻烦。 (5)不得发布有损国家形象的信息,不得泄露国家机密。

信息论基础教学课件ppt信息论基础概述信息论基础概论

33

§1.2.1 通信系统模型

例如,奇偶纠错 将信源编码输出的每个码组的尾补一个1或0 当传输发生奇数差错,打乱了“1”数目的奇偶性,就 可以检测出错误。

34

§1.2.1 通信系统模型

(a) 无检错

(b) 可检错 (奇校验) (c) 可纠错(纠一个错)

图1.4 增加冗余符号增加可靠性示意图

35

§1.2.1 通信系统模型

信源的消息中所包含的信息量 以及信息如何量度

核心 问题

29

§1.2.1 通信系统模型

编码器(Encoder)

编码器的功能是将消息变成适合于信道传输的信号 编码器包括:

信源编码器(source encoder) 信道编码器(channel encoder) 调制器(modulator)

信源编码器

信道编码器

调制器

功能:将编码器的输出符号变成适合信道传输的信号 目的:提高传输效率 信道编码符号不能直接通过信道输出,要将编码器的输 出符号变成适合信道传输的信号,例如,0、1符号变成 两个电平,为远距离传输,还需载波调制,例如,ASK, FSK,PSK等。

36

§1.2.1 通信系统模型

信道(channel)

13

§1.1.2 信息的基本概念

1949年,Weaver在《通信的数学》中解释香农的工 作时,把通信问题分成三个层次: 第一层:通信符号如何精确传输?(技术问题) 第二层:传输的符号如何精确携带所需要的含义?(语义问题) 第三层:所接收的含义如何以所需要的方式有效地影响行为? (效用问题)

14

§1.1.2 信息的基本概念

§1.1.2 信息的基本概念

信息的三个基本层次:

语法(Syntactic)信息 语义(Semantic) 信息 语用(Pragmatic)信息

§1.2.1 通信系统模型

例如,奇偶纠错 将信源编码输出的每个码组的尾补一个1或0 当传输发生奇数差错,打乱了“1”数目的奇偶性,就 可以检测出错误。

34

§1.2.1 通信系统模型

(a) 无检错

(b) 可检错 (奇校验) (c) 可纠错(纠一个错)

图1.4 增加冗余符号增加可靠性示意图

35

§1.2.1 通信系统模型

信源的消息中所包含的信息量 以及信息如何量度

核心 问题

29

§1.2.1 通信系统模型

编码器(Encoder)

编码器的功能是将消息变成适合于信道传输的信号 编码器包括:

信源编码器(source encoder) 信道编码器(channel encoder) 调制器(modulator)

信源编码器

信道编码器

调制器

功能:将编码器的输出符号变成适合信道传输的信号 目的:提高传输效率 信道编码符号不能直接通过信道输出,要将编码器的输 出符号变成适合信道传输的信号,例如,0、1符号变成 两个电平,为远距离传输,还需载波调制,例如,ASK, FSK,PSK等。

36

§1.2.1 通信系统模型

信道(channel)

13

§1.1.2 信息的基本概念

1949年,Weaver在《通信的数学》中解释香农的工 作时,把通信问题分成三个层次: 第一层:通信符号如何精确传输?(技术问题) 第二层:传输的符号如何精确携带所需要的含义?(语义问题) 第三层:所接收的含义如何以所需要的方式有效地影响行为? (效用问题)

14

§1.1.2 信息的基本概念

§1.1.2 信息的基本概念

信息的三个基本层次:

语法(Syntactic)信息 语义(Semantic) 信息 语用(Pragmatic)信息

《信息经济学第四章》PPT课件

精选PPT

我们知道,在没有任何干预的市场经济 中,保险公司欢迎低风险顾客,低风险 者出于规避风险也愿意参伽投保,但结 果却是低风险者在不利选择中被排除出 保险市场。 也就是说,在隐藏的信息的情况下,市 场的运行并不能带来高效率的结果(与 完全信息的情况相比)。 此时,政府的干预有时是有效的,但并 非总是如此,因为如果搜集信息对私人 公司来说需要很高的代价,那么对政府 来说也是如此。

精选PPT

在这种情况下,风险规避者希望不确定性降到 最低限度(最低限度是多少?) ,那么,最好 的情况就是没有任何风险或不确定性。这意味 着,投保人在任何一种情况下,都将拥有相同 数量的财产,即

40,000

一0.01K

C1=C2 =30,000+0,99K

由此得出:

K =10 , 000 (元)

我们得出的结论是:面临公平费率的情况下, 厌恶风险的投保人将对可能遭受的损失进行全 额保险。在上面这个例子中.投保人会支付 100 元 的 保 险 费 , 购 买 一 张 最 高 赔 偿 额 为 10 ,000 元的保险单。

可以通过下面这个简单的例子来说明.

精选PPT

假定您现有财产总数为40 ,000 元,您 面临损失10 ,000 元的可能性(遭窃、 失火、生病住院等),发生损失的可能 性为1 % ,保险费率为г ,即您需要支付 г K 来购买一张金额(最高赔偿额)为K 的保险单。如果损失没有发生,那么您 拥有的财产将是:

精选PPT

4. 2 败德行为 如果像上面描述的那样,世界就会平安无事。投 保人转移了全部风险,保险公司赚取一定的利润。 但是,购买了全额保险之后.人们的行为会变得 不合情理。 比如说,买了医疗保险的人会让医生多开一些不 必要的药, 买了住院保险的人病已痊愈还迟迟不肯出院, 买了自行车盗窃保险的人会将没有上锁的自行车 随处停放。 更广义地说,领取失业救济金的人(可将他们看 作购买了“失业保险”的人)会不急于寻找工作, 而吃“大锅饭”的人(可视作买了“就业保险” 的人)不愿卖力干活。 所有这些行为都被称作“败德行为”。

我们知道,在没有任何干预的市场经济 中,保险公司欢迎低风险顾客,低风险 者出于规避风险也愿意参伽投保,但结 果却是低风险者在不利选择中被排除出 保险市场。 也就是说,在隐藏的信息的情况下,市 场的运行并不能带来高效率的结果(与 完全信息的情况相比)。 此时,政府的干预有时是有效的,但并 非总是如此,因为如果搜集信息对私人 公司来说需要很高的代价,那么对政府 来说也是如此。

精选PPT

在这种情况下,风险规避者希望不确定性降到 最低限度(最低限度是多少?) ,那么,最好 的情况就是没有任何风险或不确定性。这意味 着,投保人在任何一种情况下,都将拥有相同 数量的财产,即

40,000

一0.01K

C1=C2 =30,000+0,99K

由此得出:

K =10 , 000 (元)

我们得出的结论是:面临公平费率的情况下, 厌恶风险的投保人将对可能遭受的损失进行全 额保险。在上面这个例子中.投保人会支付 100 元 的 保 险 费 , 购 买 一 张 最 高 赔 偿 额 为 10 ,000 元的保险单。

可以通过下面这个简单的例子来说明.

精选PPT

假定您现有财产总数为40 ,000 元,您 面临损失10 ,000 元的可能性(遭窃、 失火、生病住院等),发生损失的可能 性为1 % ,保险费率为г ,即您需要支付 г K 来购买一张金额(最高赔偿额)为K 的保险单。如果损失没有发生,那么您 拥有的财产将是:

精选PPT

4. 2 败德行为 如果像上面描述的那样,世界就会平安无事。投 保人转移了全部风险,保险公司赚取一定的利润。 但是,购买了全额保险之后.人们的行为会变得 不合情理。 比如说,买了医疗保险的人会让医生多开一些不 必要的药, 买了住院保险的人病已痊愈还迟迟不肯出院, 买了自行车盗窃保险的人会将没有上锁的自行车 随处停放。 更广义地说,领取失业救济金的人(可将他们看 作购买了“失业保险”的人)会不急于寻找工作, 而吃“大锅饭”的人(可视作买了“就业保险” 的人)不愿卖力干活。 所有这些行为都被称作“败德行为”。

大学计算机基础第3版参考课件-第07讲-信息论基础

——《菜根谭》

信言 息

人言吾心自悟之

3

信息

什么是信息? 信息的定义

信息是客观存在的表现形式,是事物之间相互作用的 媒介,是事物复杂性和差异性的反映。。

香农(Claude Elwood Shannon)

信息是用来消除随机不定性的东西 信息是事物运动状态或存在方式的不确定性的描述

作为一个严谨的科学术语,信息的定义 却不存在一个统一的观点,这是由它的 极端复杂性决定的。

=−

信息熵:事件集的平均信息量

H = −∑

比特:

用于传递 消息的 0/1数量

6

例4-3~4-6的理解

比特:用于传递消息的0/1数量

7

4

信息

“信息是用来消除随机不定性的东西”

盛夏预报:明天无雪

B

A

C

盛夏预报:明天有雪

获得信息量为0 获得信息量巨大

5

信息量的定义

P(x ) 表示消息x发生的概率,I(x ) 表示信息量

I 和P 的关系满足5个条件(教材P84),重点理解:

(4) I 和P 成反比;(5) P=1时,I=0,P=0时,I=

大学计算机基础

第4章 信息编码及数据表示

1

信息论基础(4.1节)

信息是一个新词? 音信消息

宋 陈亮 《梅花》

“欲传春信息,不怕雪埋藏。”

得快,旬日便知信息。”

巴金 《家》

“二表哥的事情怎样了?为什么连信息也不给我一个?”

2

事理因人言而悟者,有悟还 有迷,不如自悟之了了

信言 息

人言吾心自悟之

3

信息

什么是信息? 信息的定义

信息是客观存在的表现形式,是事物之间相互作用的 媒介,是事物复杂性和差异性的反映。。

香农(Claude Elwood Shannon)

信息是用来消除随机不定性的东西 信息是事物运动状态或存在方式的不确定性的描述

作为一个严谨的科学术语,信息的定义 却不存在一个统一的观点,这是由它的 极端复杂性决定的。

=−

信息熵:事件集的平均信息量

H = −∑

比特:

用于传递 消息的 0/1数量

6

例4-3~4-6的理解

比特:用于传递消息的0/1数量

7

4

信息

“信息是用来消除随机不定性的东西”

盛夏预报:明天无雪

B

A

C

盛夏预报:明天有雪

获得信息量为0 获得信息量巨大

5

信息量的定义

P(x ) 表示消息x发生的概率,I(x ) 表示信息量

I 和P 的关系满足5个条件(教材P84),重点理解:

(4) I 和P 成反比;(5) P=1时,I=0,P=0时,I=

大学计算机基础

第4章 信息编码及数据表示

1

信息论基础(4.1节)

信息是一个新词? 音信消息

宋 陈亮 《梅花》

“欲传春信息,不怕雪埋藏。”

得快,旬日便知信息。”

巴金 《家》

“二表哥的事情怎样了?为什么连信息也不给我一个?”

2

事理因人言而悟者,有悟还 有迷,不如自悟之了了

《信息论基础》PPT课件

精选ppt

9

信息论的研究内容

狭义信息论(经典信息论)

研究信息测度,信道容量以及信源和信道编码理论

一般信息论

研究信息传输和处理问题,除经典信息论外还包括噪 声理论,信号滤波和预测,统计检测和估值理论,调 制理论,信息处理理论和保密理论

广义信息论

除上述内容外,还包括自然和社会领域有关信息的内 容,如模式识别,计算机翻译,心理学,遗传学,神 经生理学

精选ppt

10

Shannon理论

Shannon定理的证明是非构造性的,而且也不够严格,但 他的“数学直观出奇地正确”(A. N. Kolmogrov,1963)。 已在数学上严格地证明了Shannon编码定理,而且发现了 各种具体可构造的有效编码理论和方法,可以实现 Shannon指出的极限。

几乎无错地经由Gaussian信道传信 对于非白Gassian信道,Shannon的注水定理和多载波调制(MCM) CDMA、MCM(COFDM)、TCM、BCM、各种均衡、对消技术、

精选ppt

12

I信源编码与数据压缩-关键理论进展 的十个里程碑[Kieffer 1993]

1. 无扰信源编码的诞生(1948, C. E. Shannon)。 2. Huffman算法的发现(1952, D. A. Huffman)。 3. 建立Shannon-McMillan定理(1953, B. McMillan)。 4. 发现Lloyd算法(1957, S. P. Lloyd ,1982年发表,)。 5. 率失真理论系统化(1959, C. E. Shannon,)。 6. Kolmogorov Complexity概念诞生(1964, A. N. Kolmogorov,)。 7. 通用信源编码理论系统化(1973, L. D. Davission)。 8. 多端信源编码理论诞生(1973, D. Slepian和J. K. Wolf)。 9. 第一个实际的算术编码方案(1976, J. Rissannen和R. Pasco

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

j 1 s

注:1. 要达到信道容量,必须输出分布为等概分布。 2. 如何保证?看如下定理。

定理

对于离散对称信道,当输入分布是等概分布时,输 出分布必能达到等概分布。

证明:(思考讨论) 于是如下定理成立。

定理

对于离散对称信道,当输入分布是等概分布时,达 到信道容量。

s

C log s H (Y | xi ) log s pij log pij

定理

对于离散准对称信道,当输入分布是等概分布时, 可以达到信道容量。

C log r N k log( Mk ) H ( p1 , p2 ,

k 1

n

, ps )

其中Nk为第k个子阵中行元素之和,Mk为第k 个子阵中列元素之和。 例子4.2-4.3

§4.2.5 一般离散信道的信道容量。

C=max I ( X ;Y ) max[ H ( X ) H ( X | Y )]

p( x ) p( x )

max[ H (Y ) H (Y | X )]

p( x ) p( x )

max H (Y ) H (Y / X )

C log s H (Y | xi ) log s pij log pij

例子:

1 3 1 6

1 3 1 6

1 6 1 3

1 6 1 3

1 2 1 6 1 3

1 3 1 2 1 6

1 6 1 3 1 2

0.8 0.1 0.1 0.1 0.1 0.8

定义

若信道中输入符号与输出符号个数相同,且信道中 总的错误概率分布为p,平均分配给r-1个输出符号, 则称此类信道为均匀信道(强对称信道)。

p( yi | xi ) Pr Y yi | X xi , i 1, , r , j 1, , s

信道传递概率实际上是一个传递概率矩阵,称为信道矩阵。

y1 y2 ys

P p( yi | xi )r s

x1 p( y1 | x1 ) p( y1 | x2 ) x2 xr p( y1 | xr )

j 1

log s H ( p1 , p2 ,

, ps )

均匀信道是一种特殊的对称信道,其信道容量有如下推论。

推论

对于均匀信道,当输入分布是等概分布时,达到信 道容量,信道容量如下:

C log s H ( p1 , p2 , p log r H ( p, , r 1

常见的离散单符号信道

• 二进制对称信道(BSC)

1-p 0 p p 0

1 1-p

1

p 1 p P p 1 p

• 离散无记忆信道

a1 a2 b1 b2

an

bm

p11 p 21 P pn1

p12 p22 pn 2

p1m p2 m pnm

• 离散输入、连续输出信道

X Y

+

G

pY ( y / ai )

1 2

e

( y ai ) 2 / 2 2

• 波形信道(模拟信道)

x(t)

y(t)

+

n(t)

pY ( y / x) pY ( y1 , y 2 , y L / x1 , x2 , x L ) pY ( y / x) p x , y ( x, y ) p x ( x) p x , y ( x, n ) p x ( x) p n ( n)

下面给出一般的离散单符号信道的一些概率关系。

设信道输入随机变量的概率空间为:

X x1 p( x ) p( x ) 1

满足非负性和完备性。

x2 p( x2 )

xr p( xr )

设信道输出随机变量的概率空间为:

Y y1 p( x ) p( y ) 1

R I ( X ;Y ) H ( X ) H ( X | Y )

如果考虑平均传输一个符号需要t秒,则信道平均每秒传 输的信息量为:

1 Rt I ( X ;Y ) t 通常称之为信息传输率。

平均互信息I(X;Y)在给定的信道转移概率分布下是关于 输入分布上凸函数。因此,存在最大值,称此最大值为信 道容量。相应的输入概率分布称为最佳输入分布。

p( x ) p( x ) p( x )

2.具有归并性能的无噪信道

其信道矩阵如下。

1 1 P 0 0 0 0 0 1 1 1

无噪信道的噪声熵H(Y|X)=0,于是信道容量为:

C max I ( X ;Y ) max H (Y ) H (Y | X ) max H (Y ) log s

p( x ) p( x ) p( x )

注:1. 要达到信道容量,必须输出分布为等概分布。 2. 如何保证?。 只有在某些特殊的情况下可以达到此要求。

3.具有意义对应关系的的无噪无损信道

其信道矩阵如下:

1 0 P 0 0

0 1 0 0

0 0 1 0

0 0 0 1

p( y2 | x1 ) p( y2 | x2 ) p( y2 | xr )

p( y s | x1 ) p( y s | x2 ) p( y s | xr )

为了表述方便,通常写成:

p11 p 21 P pr1

p12 p22 pr 2

p1s p2 s prs

第四章 信道与信道容量

前言:1. 信道是传输信息的通道。 2. 信息传输包括空间是时间意义上的传输。 3. 信道的主要问题有: 模型(建模)、信道传输信息的能力的计算(信 道容量)、在有噪信道中实现信息的传输问题。 本章解决前两个问题,第6章解决第三个问题。 信道分类和表示参数 离散单个符号信道及其容量 离散序列信道及其容量 连续信道及其容量

定义

信道容量为平均互信息关于输入概率分布的最大值。

C max I ( X ;Y )

p( x )

单位为比特/符号。

如果考虑平均传输一个符号需要t秒,则信道在单位时间 内平均传输的最大信息量为:

1 Ct max I ( X ;Y ) t p( x )

注:1.信道容量是信道传输信息的最大能力的度量。 2.信道实际传输的信息量不能大于信道容量。(例4.1)

§4.1 信道的分类与数学模型

干扰

X

P(Y|X)

Y

•分类方法有很多,主要是从时间和幅度上的取值、记忆性、 平稳性、输入和输出信号之间的关系、用户等方面考虑。 •时间 离散 连续 •幅度 离散 连续 时间和幅度取值都是离散的信道为离散信道(数字信道); 时间离散、幅度连续的信道为连续信道; 时间连续、幅度连续的信道为模拟信道; 时间连续、幅度离散的信道无价值。

§4.1 离散单符号信道及其信道容量

离散单符号信道的数学模型

干扰

X

P(Y|X)

Y

它是最简单的信道。 设输入随机变量X有r个不同的取值xi,i=1,2,…,r,输出随机 变量Y有s个不同的取值yj,j=1,2,…,s,由于噪声的存在,符号 在传输的过程中会产生错误,可以用传递概率(条件概率)来 描述。

§4.2.3 几种特殊信道的信道容量。

1.具有扩展性能的无损信道

其信道矩阵如下。

1 2 P 0

1 2 0

0 1 3

0 1 3

0 1 3

无损信道的信道疑义度H(X|Y)=0,于是信道容量为:

C max I ( X ;Y ) max H ( X ) H ( X | Y ) max H ( X ) log r

信道容量定义为平均互信息在固定条件分布下的极 大值,前面已经给出平均互信息是输入概率分布的上凸 函数,因此极大值必定存在(可以用拉格朗日乘子法求 这个条件极值)。 设辅助函数:

F I ( X ;Y ) p( xi )

, ps )

p , ) r 1 p p log r p log p ( r 1) log( ) r 1 r 1 p log r p log p p log( ) r 1 log r p log( r 1) H ( p)

注:1. 当r=2时,通常称为二元对称信道,其信道容量 是多少?。 2. 对于一般的行对称信道,信道容量可以如何表示? 有什么问题?。 3.对于准对称信道,也是达不到理想中的信道容量? 但有如下定理。

向概率:

p( xi | y j )

p( xi y j ) p( y j )

p( xi ) p( y j | xi )

p( x

k 1

r

k

) p( y j | xk )

§4.2பைடு நூலகம்2 信道容量的概念

平均互信息I(X;Y)是收到输出符号集Y以后所获得关于输 入符号集X的信息量,由于干扰的存在,收到Y以后对信源 仍然存在不确定,其不确定性为H(X|Y), H(X|Y)又称为信道 疑义度。 平均互信息I(X;Y)也可以理解为每传输一个符号流经信 道的信息量,因此,又称为信息传输率。通常用R表示。

称 p( xi ) 为先验概率 称 p( yi | xi ) 为前向概率(信道传递概率)

称 p( xi | y j ) 为后验概率(后向概率)

2.由全概率公式,根据先验概率和前向概率可以求得输

出符号的概率:

p ( y j ) p( x i ) p ( y j | x i )

i 1

r

3.由贝叶斯公式,根据先验概率和前向概率可以求得后

p11 p 21 P pr1

p12 p22 pr 2

p1s p2 s prs

注:1. 要达到信道容量,必须输出分布为等概分布。 2. 如何保证?看如下定理。

定理

对于离散对称信道,当输入分布是等概分布时,输 出分布必能达到等概分布。

证明:(思考讨论) 于是如下定理成立。

定理

对于离散对称信道,当输入分布是等概分布时,达 到信道容量。

s

C log s H (Y | xi ) log s pij log pij

定理

对于离散准对称信道,当输入分布是等概分布时, 可以达到信道容量。

C log r N k log( Mk ) H ( p1 , p2 ,

k 1

n

, ps )

其中Nk为第k个子阵中行元素之和,Mk为第k 个子阵中列元素之和。 例子4.2-4.3

§4.2.5 一般离散信道的信道容量。

C=max I ( X ;Y ) max[ H ( X ) H ( X | Y )]

p( x ) p( x )

max[ H (Y ) H (Y | X )]

p( x ) p( x )

max H (Y ) H (Y / X )

C log s H (Y | xi ) log s pij log pij

例子:

1 3 1 6

1 3 1 6

1 6 1 3

1 6 1 3

1 2 1 6 1 3

1 3 1 2 1 6

1 6 1 3 1 2

0.8 0.1 0.1 0.1 0.1 0.8

定义

若信道中输入符号与输出符号个数相同,且信道中 总的错误概率分布为p,平均分配给r-1个输出符号, 则称此类信道为均匀信道(强对称信道)。

p( yi | xi ) Pr Y yi | X xi , i 1, , r , j 1, , s

信道传递概率实际上是一个传递概率矩阵,称为信道矩阵。

y1 y2 ys

P p( yi | xi )r s

x1 p( y1 | x1 ) p( y1 | x2 ) x2 xr p( y1 | xr )

j 1

log s H ( p1 , p2 ,

, ps )

均匀信道是一种特殊的对称信道,其信道容量有如下推论。

推论

对于均匀信道,当输入分布是等概分布时,达到信 道容量,信道容量如下:

C log s H ( p1 , p2 , p log r H ( p, , r 1

常见的离散单符号信道

• 二进制对称信道(BSC)

1-p 0 p p 0

1 1-p

1

p 1 p P p 1 p

• 离散无记忆信道

a1 a2 b1 b2

an

bm

p11 p 21 P pn1

p12 p22 pn 2

p1m p2 m pnm

• 离散输入、连续输出信道

X Y

+

G

pY ( y / ai )

1 2

e

( y ai ) 2 / 2 2

• 波形信道(模拟信道)

x(t)

y(t)

+

n(t)

pY ( y / x) pY ( y1 , y 2 , y L / x1 , x2 , x L ) pY ( y / x) p x , y ( x, y ) p x ( x) p x , y ( x, n ) p x ( x) p n ( n)

下面给出一般的离散单符号信道的一些概率关系。

设信道输入随机变量的概率空间为:

X x1 p( x ) p( x ) 1

满足非负性和完备性。

x2 p( x2 )

xr p( xr )

设信道输出随机变量的概率空间为:

Y y1 p( x ) p( y ) 1

R I ( X ;Y ) H ( X ) H ( X | Y )

如果考虑平均传输一个符号需要t秒,则信道平均每秒传 输的信息量为:

1 Rt I ( X ;Y ) t 通常称之为信息传输率。

平均互信息I(X;Y)在给定的信道转移概率分布下是关于 输入分布上凸函数。因此,存在最大值,称此最大值为信 道容量。相应的输入概率分布称为最佳输入分布。

p( x ) p( x ) p( x )

2.具有归并性能的无噪信道

其信道矩阵如下。

1 1 P 0 0 0 0 0 1 1 1

无噪信道的噪声熵H(Y|X)=0,于是信道容量为:

C max I ( X ;Y ) max H (Y ) H (Y | X ) max H (Y ) log s

p( x ) p( x ) p( x )

注:1. 要达到信道容量,必须输出分布为等概分布。 2. 如何保证?。 只有在某些特殊的情况下可以达到此要求。

3.具有意义对应关系的的无噪无损信道

其信道矩阵如下:

1 0 P 0 0

0 1 0 0

0 0 1 0

0 0 0 1

p( y2 | x1 ) p( y2 | x2 ) p( y2 | xr )

p( y s | x1 ) p( y s | x2 ) p( y s | xr )

为了表述方便,通常写成:

p11 p 21 P pr1

p12 p22 pr 2

p1s p2 s prs

第四章 信道与信道容量

前言:1. 信道是传输信息的通道。 2. 信息传输包括空间是时间意义上的传输。 3. 信道的主要问题有: 模型(建模)、信道传输信息的能力的计算(信 道容量)、在有噪信道中实现信息的传输问题。 本章解决前两个问题,第6章解决第三个问题。 信道分类和表示参数 离散单个符号信道及其容量 离散序列信道及其容量 连续信道及其容量

定义

信道容量为平均互信息关于输入概率分布的最大值。

C max I ( X ;Y )

p( x )

单位为比特/符号。

如果考虑平均传输一个符号需要t秒,则信道在单位时间 内平均传输的最大信息量为:

1 Ct max I ( X ;Y ) t p( x )

注:1.信道容量是信道传输信息的最大能力的度量。 2.信道实际传输的信息量不能大于信道容量。(例4.1)

§4.1 信道的分类与数学模型

干扰

X

P(Y|X)

Y

•分类方法有很多,主要是从时间和幅度上的取值、记忆性、 平稳性、输入和输出信号之间的关系、用户等方面考虑。 •时间 离散 连续 •幅度 离散 连续 时间和幅度取值都是离散的信道为离散信道(数字信道); 时间离散、幅度连续的信道为连续信道; 时间连续、幅度连续的信道为模拟信道; 时间连续、幅度离散的信道无价值。

§4.1 离散单符号信道及其信道容量

离散单符号信道的数学模型

干扰

X

P(Y|X)

Y

它是最简单的信道。 设输入随机变量X有r个不同的取值xi,i=1,2,…,r,输出随机 变量Y有s个不同的取值yj,j=1,2,…,s,由于噪声的存在,符号 在传输的过程中会产生错误,可以用传递概率(条件概率)来 描述。

§4.2.3 几种特殊信道的信道容量。

1.具有扩展性能的无损信道

其信道矩阵如下。

1 2 P 0

1 2 0

0 1 3

0 1 3

0 1 3

无损信道的信道疑义度H(X|Y)=0,于是信道容量为:

C max I ( X ;Y ) max H ( X ) H ( X | Y ) max H ( X ) log r

信道容量定义为平均互信息在固定条件分布下的极 大值,前面已经给出平均互信息是输入概率分布的上凸 函数,因此极大值必定存在(可以用拉格朗日乘子法求 这个条件极值)。 设辅助函数:

F I ( X ;Y ) p( xi )

, ps )

p , ) r 1 p p log r p log p ( r 1) log( ) r 1 r 1 p log r p log p p log( ) r 1 log r p log( r 1) H ( p)

注:1. 当r=2时,通常称为二元对称信道,其信道容量 是多少?。 2. 对于一般的行对称信道,信道容量可以如何表示? 有什么问题?。 3.对于准对称信道,也是达不到理想中的信道容量? 但有如下定理。

向概率:

p( xi | y j )

p( xi y j ) p( y j )

p( xi ) p( y j | xi )

p( x

k 1

r

k

) p( y j | xk )

§4.2பைடு நூலகம்2 信道容量的概念

平均互信息I(X;Y)是收到输出符号集Y以后所获得关于输 入符号集X的信息量,由于干扰的存在,收到Y以后对信源 仍然存在不确定,其不确定性为H(X|Y), H(X|Y)又称为信道 疑义度。 平均互信息I(X;Y)也可以理解为每传输一个符号流经信 道的信息量,因此,又称为信息传输率。通常用R表示。

称 p( xi ) 为先验概率 称 p( yi | xi ) 为前向概率(信道传递概率)

称 p( xi | y j ) 为后验概率(后向概率)

2.由全概率公式,根据先验概率和前向概率可以求得输

出符号的概率:

p ( y j ) p( x i ) p ( y j | x i )

i 1

r

3.由贝叶斯公式,根据先验概率和前向概率可以求得后

p11 p 21 P pr1

p12 p22 pr 2

p1s p2 s prs