淘宝分布式大数据及实时流数据技术架构48

淘宝分布式服务框架

HSF演进过程

• 配置使用方式的改进

– 使用示例

<bean id=“helloWorld” class=“com.taobao.hsf.test.HelloWorldImpl” />

HSF演进过程

• 发布服务

HSF演进过程

• 演进过程中的一些小功能

– 服务动态归组 – 服务限流 – 服务延迟注册 – 服务调用上下文支持 – Rpc框架与业务交互(常见如:remotehost) – 服务NDI方式调用 – 运行期动态发布数据 – 服务降级 – Jar包升级

– 业务层

问题

QA?

服务治理

• 服务监控

– 安全监控 – 报警 – 问题定位

分布式跟踪系统

• 类似google的dapper, Twi^er Zipkin • 基于tcp方式,h^p方式支持但是未全局推广

分布式跟踪系统

分布式跟踪系统

• 分布式跟踪系统链路图

QOS

协议层

容 器 接 入 层

核心服务层

HSF运行原理

Ip地址为 192.168.1.2的机器 提供了A服务 好的,A服务地址: 192.168.1.2 , 我要订阅A服务,把 192.168.1.3 A服务的地址给我吧 Ip地址为 192.168.1.3的机器 提供了A服务 谢谢,我会根据相 应规则选择一台机 器发起调用的。

HSF演进过程

• 部署及隔离方式改进

– 与应用分开部署,运行期依赖 – 外部采用与应用独立的classloader隔离,内部采 用OSGI隔离

• 优点vs缺点?

HSF演进过程

• 网络通讯改进

– 基于mina封装TB-‐Remo8ng – 分阶段序列化(java,hessian) – 连接采用长连接

淘宝技术架构介绍, 了解淘宝,了解淘宝的架构需求

pipeline 页面布局

Screen Layout Control

多模板引擎

Jsp Velocity FreeMarker

V2.0 淘宝项目管理工具 AntX

类似maven 脚本编程语言 AutoConfig 依赖管理,冲突检测

V2.1 的需求

提高性能 增加开发效率 降低成本

V2.1 2004.10 – 2007.01

TBStore

Read/Write

Oracle Oracle Oracle Oracle

dump

Search

Read/Write

Node Node

1

2 ……

Node n

V2.1逻辑结构

表示层

Service

业务请求转发

Framework

S

UC

UC 业务流程处理 UC

UC

P

R

AO

AO

AO

AO

I

业务逻辑层

Node 1

Node 2

Node n

V2.1 TaobaoCDN

squid apache+php lighttpd 静态页面(包括php页面)、图片、描述 最初只有杭州和上海两个站点 现在发展到北京、广州、西安、天津、武

汉、济南等近10个站点 现在每天高峰期30G流量/秒

V2.1 session框架

Put/Get Data

Node 1

Node 2

Node n

V2.2 搜索引擎

垂直/水平 分割

AAPPPP

AAPPPP

Merge

Node1

Node2 ……

Node n

Col1

Node 1

淘宝服务端技术架构详解

淘宝服务端技术架构详解目录一、前言 (3)二、单机架构 (4)三、多机部署 (4)四、分布式缓存 (5)五、Session 共享解决方案 (7)六、数据库读写分离 (9)七、CDN 加速与反向代理 (10)八、分布式文件服务器 (11)九、数据库分库分表 (11)十、搜索引擎与NoSQL (13)十一、后序 (13)一、前言以淘宝网为例,简单了解一下大型电商的服务端架构是怎样的。

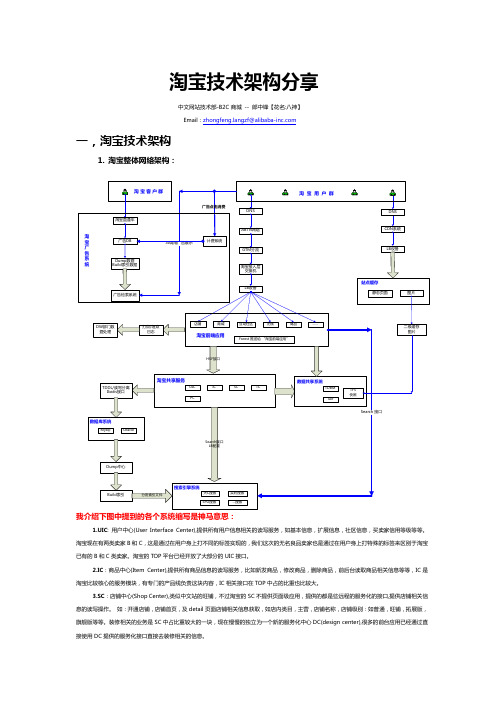

如图所示最上面的就是安全体系系统,中间的就是业务运营系统,包含各个不同的业务服务,下面是一些共享服务,然后还有一些中间件,其中ECS 就是云服务器,MQS 是队列服务,OCS 是缓存等等,右侧是一些支撑体系服务。

除图中所示之外还包含一些我们看不到的,比如高可用的体现。

淘宝目前已经实现多机房容灾和异地机房单元化部署,为淘宝的业务也提供了稳定、高效和易于维护的基础架构支撑。

这是一个含金量非常高的架构,也是一个非常复杂而庞大的架构,当然这个架构不是一天两天演进成这样的,也不是一开始就设计并开发成这样的,对于初创公司而言,很难在初期就预估到未来流量千倍、万倍的网站架构会是怎样的状况,同时如果初期就设计成千万级并发的流量架构,也很难去支撑这个成本。

因此一个大型服务系统,都是从小一步一步走过来的,在每个阶段找到对应该阶段网站架构所面临的问题,然后不断解决这些问题,在这个过程中,整个架构会一直演进,同时内含的代码也就会演进,大到架构、小到代码都是在不断演进和优化的。

所以说高大上的项目技术架构和开发设计实现不是一蹴而就的,这是所谓的万丈高楼平地起。

二、单机架构从一个小网站说起,一般来说初始一台服务器就够了,文件服务器、数据库以及应用都部署在一台机器上。

也就是俗称的 allinone 架构。

这篇推荐看下:厉害了,淘宝千万并发,14 次架构演进…三、多机部署随着网站用户逐渐增多,访问量越来越大,硬盘、cpu、内存等开始吃紧,一台服务器难以支撑。

淘宝技术框架分析报告

淘宝技术框架分析报告淘宝作为国首屈一指的大型电子商务,每天承载近30亿PV的点击量,拥有近50PB的海量数据,那么淘宝是如确保其的高可用的呢?本文将对淘宝在构建大型过程中所使用到的技术框架做一个总结,并结合银行现有技术框架进展比照分析。

另外,本文还会针对金融互联网以及公司未来技术开展向给出个人看法。

淘宝技术分析CDN技术及多数据中心策略国的网络由于运营商不同〔分为电信、联通、移动〕,造成不同运营商网络之间的互访存在性能问题。

为了解决这个问题,淘宝在全国各地建立了上百个CDN节点,当用户访问淘宝时,浏览器首先会访问DNS效劳器,通过DNS解析域名,根据用户的IP将访问分配到不同的入口。

如果客户的IP属于电信运营商,那么就会被分配到同样是电信的CDN节点,并且保证访问的〔这里主要指JS、CSS、图片等静态资源〕CDN节点是离用户最近的。

这样就将巨大的访问量分散到全国各地。

另外,面对如此巨大的业务请求,任一个单独的数据中心都是无法承受的,所以淘宝在全国各主要城市都建立了数据中心,这些数据中心不但保证了容灾,而且各个数据中心都在提供效劳。

不管是CDN技术还是多个数据中心,都涉及到复杂的数据同步,淘宝很好的解决了这个问题。

银行现在正在筹建两地三中心,但主要目的是为了容灾,数据中心的利用率差,而淘宝的多个数据中心利用率为100%。

LVS技术淘宝的负载均衡系统采用了LVS技术,该技术目前由淘宝的章文嵩博士负责。

该技术可以提供良好的可伸缩性、可靠性以及可管理型。

只是这种负载均衡系统的构建是在Linux操作系统上,其他操作系统不行,并且需要重新编译Linux操作系统核,对系统核的了解要求很高,是一种软负载均衡技术。

而银行那么通过F5来实现负载均衡,这是一种硬负载均衡技术。

Session框架Session对于Web应用是至关重要的,主要是用来保存用户的状态信息。

但是在集群环境下需要解决Session共享的问题。

目前解决这个问题通常有三种式,第一个是通过负载均衡设备实现会话保持,第二个是采用Session复制,第三个那么是采用集中式缓存。

淘宝分布式大数据及实时流数据技术架构50页文档

❖ 知识就是财富 ❖ 丰富你的人生

71、既然我已经踏上这条道路,那么,任何东西都不应妨碍我沿着这条路走下去。——康德 72、家庭成为快乐的种子在外也不致成为障碍物但在旅行之际却是夜间的伴侣。——西塞罗 73、坚持意志伟大的事业需要始终不渝的精神。——伏尔泰பைடு நூலகம்74、路漫漫其修道远,吾将上下而求索。——屈原 75、内外相应,言行相称。——韩非

淘宝分布式大数据及实时流数据技术 架构

16、云无心以出岫,鸟倦飞而知还。 17、童孺纵行歌,斑白欢游诣。 18、福不虚至,祸不易来。 19、久在樊笼里,复得返自然。 20、羁鸟恋旧林,池鱼思故渊。

谢谢你的阅读

淘宝海量数据服务平台:架构与实践

実计

日志

开发

测试 计算成 本 成本优 化 管理生命周期 数据可视化

搜索

计费 缓存 帮劣

单元测试框架 自劢化测试接口/持续集成接口

工作流引擎、资源调度 分析工具集 Dashboard 线上部署 运行时监控 运行

监控告警,数据质量, 生命周期

数据质量监 控 结果数据集成

…

结果集成,OLAP/CUBE,数据可视化

8

30

数据云——现状

每天提交的分析仸务数10K

每天的集成/挖掘仸务数100K

数据分析用户 数据开发用户

数据分析 数据分析平台 数据开发平台 数据云

数据集成/数据挖掘

存储:总数据量30PB 数据每天增长100T

规模:2000 台 计算:读取数据量5PB,写出数据量

500TB 每天消耗的总CPU*S数:2.4Gs * 2.4GHz

调度系统

存储于 ZooKeeper

工 作 流 实 例 日 志

工作流引擎 (备)(备) 工作流引擎(主) 仸务队列 资源调度(备) 资源调度(主) 组调度 组调度 器 器 仸 务 队 列 实 时 负 载 仸 务 队 列 实 时 负 载

工 作 流 仓 库

代 码 仓 库

组调度 器 仸 务 队 列 实 时 负 载 Load Balance & Fail over

调 度

监 控 告 警

基础设施 数据总线 & 元数据总线 规则引擎 底层接口 极限存储 极限计算 调优框架 生命周期 流程引擎

外 部 系 统 接 口

淘宝数据服务平台

产品 架构 实践

实践

成本

产 品

架 构 实 践

可用性

伸缩性

淘宝技术架构分享

淘宝的 HSF 在使用方式上面和 Dubbo 有比较大的区别,HSF 使用的时候需要单独的下载一个 hsf.sar 文件放置到 jboss 的 deploy 下面这样 做的好处是:hsf 的升级不需要应用做改动,方便统一升级统一管理;弊端也很明显:增加了环境的复杂度,需要往 jboss 下扔 sar 文件,对 jboss 版本也有要求,这也是当初 Dubbo 没有完全参考 hsf 设计的主要原因。HSF 工作原理如下图:

UIC[用户中心]

IC[商品中心]

TC[交易中心]

PC[促销中心]

DC[装修中心]

RC[评价中心]

SC[店铺中心]

Forest[类目体系]

核心业务服务:提供各种核心业务模块的服务化接口,接口按使用方式分两类:

(1)通过HSF方式调用的远程服务化接口 (2)通过定期推送服务端数据文件到客户端的CS调用 图中:蓝色标注的系统的部分接口使用第二中方式调用,其他系统基本都是基于HSF方式的远程调用。

购和使用,广告系统,社区发帖,淘宝客等等,前台浏览相对使用较少。

(2)买家行为:集中在前台:店铺浏览,宝贝的浏览,社区浏览等比重较大,买家后台功能主要定位在后台的“我是买家”Tab 页下,包括拍

商品,付款,确认,退款,评价,社区互动等。

产品:淘宝对产品定义和 B2B 有差别,淘宝的业务拆分较细,服务化做的较成熟,所以前台应用对应的业务非常纯粹,如 Detail 系统可

2.淘宝服务化架构:

客户(卖和买)

店铺

商城

社区

无名良品

商品

交易

无线

….

前台系统:直接和用户打交道,它们依赖于各种核心业务中心提供的服务化接口,淘宝服务

淘宝大数据量产品技术架构(PPT 33页)

•

•

51、当眼泪流尽的时候,留下的应该 是坚强 。

•

•

52、上天完全是为了坚强你的意志, 才在道 路上设 下重重 的障碍 。

•

•

53、没有播种,何来收获;没有辛苦 ,何来 成功; 没有磨 难,何 来荣耀 ;没有 挫折, 何来辉 煌。

•

•

54、只要路是对的,就不怕路远。

•

•

55、生命对某些人来说是美丽的,这 些人的 一生都 为某个 目标而 奋斗。

•

2、虚心使人进步,骄傲使人落后。

•

•

3、谦虚是学习的朋友,自满是学习的 敌人。

•

•

4、若要精,人前听。

•

•

5、喜欢吹嘘的人犹如一面大鼓,响声 大腹中 空。

•

•

6、强中更有强中手,莫向人前自夸口 。

•

•

7、请教别人不折本,舌头打个滚。

•

•

8、人唯虚,始能知人。 满招损,谦受益。 满必溢,骄必败。

请求解析

配置解析

缓存是系统化的工程

缓存系统

URL请求,nocache?

data

前端产品

glider

nocache?

一级缓存

nocache?

二级缓存

etag, http header ttl, http header Min (ttl)

小结

□ 用中间层隔离前后端

• 底层架构对前端透明 • 水平可扩展性

•

•

56、浪花总是着扬帆者的路开放的。

•

•

•

74、失败是什么?没有什么,只是更 走近成 功一步 ;成功 是什么 ?就是 走过了 所有通 向失败 的路, 只剩下 一条路 ,那就 是成功 的路。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

输入 顺序IO,存储HDFS,

单输入,单输出

输入独立计过数算程据Di

Latency(i)

下载 Map

latency

输出

shuffle reduce

独立数据Dn

Latency(n)

Mapreduce Job

IProcess Job

Hadoop之于实时

• 问题(hadoop本质是为全量而生)

– 任务内串行 – 重吞吐量,响应时间完全没有保证 – 中间结果不可见,不可共享 – 单输入单输出,链式浪费严重 – 链式MR不能并行 – 粗粒度容错,可能会造成陷阱 – 图计算不友好 – 迭代计算不友好

– 触发下一个环节

IProcess的存储

• 树结构的存储

– 不同的一致性和事务模型

• 区分实时数据与其它数据的存储 • 两级容错

– 应用级和系统级

• 运算时动态扩容 • 保序 • Latency、throughput、可靠性

– 动态tradeoff

IProcess的存储

MR模型的本质Reduce(key,valueList,context) 实现STCacheStrategy接口 QStore:持久化 存储。

Pregel vs. IProcess图计算

• IProcess

乱序执行,避免了不必要的超步 实时图计算,图计算注定慢,但是效果的可以渐显。

迭代计算

• 特点

– 结构固定

• 本质

– Update

• 方案

– 传统MR模型,hadoop效率太低 – Haloop – Iprocess0.4

实时计算业界进展

– MapReduce本质上保证了Reduce触发的条件, 即所有map都结束(但这点很容易被忽视)。

– 实时计算Condition很容易被忽略。很多只是考 虑了streaming,而没有考虑Condition。

• 实时(Streaming) • 成本(Throughput) • 有所为有所不为

– 通用计算框架,用户组件只需关心业务逻辑。 – 涉及到业务逻辑统统不做。

IProcess

• 通用的分布式流数据实时与持续计算平台

– 有向图模型

• 节点为用户编写的组件、边为事件

– 触发器模duce时数据集生成(k‐mean) – 树存储模型,支持不同级别定制不同一致性模型和事

务模型 – 可扩展的编程模型

– 不可枚举 – 用户搜索(online),DB SQL

• 持续计算

– 计算相对固定、可枚举 – 数据流动 – SQL、MR

IProcess

整体架构

整体拓扑

运行过程

• 三个步骤

– 简单事件发射(分布式) – 复杂事件完备性判断(集中式、分布式)

• 分布式事务

– 尽量避免(机制保证) – 强事务(MVCC)、逻辑事务、弱事务

视图、counter… – 分布式系统的容错,自动扩展,通讯,调度 – 保序…

IProcess

• 基础的运行系统

– 引入CEP规则引擎模块(RPM),类似hive与MR – 引入数据集控制(用于机器学习),BI – 引入类SQL语言,DSL引擎 – 引入图计算模型

逻辑模型

持续计算

• Ad‐Hoc Query

• 提出并支持树型实时MR和增量/定时MR

IProcess

• 通用的分布式流数据实时与持续计算平台

– 持续与AdHoc计算(endpoint)

– 微内核+组件系统(系统级组件+用户组件) – 多任务服务化,任务沙箱,优先级,任务调度 – 两级容错:应用级和系统级,运算时动态扩容 – 系统级组件系统:实时join、二级索引、倒排表、物化

计算和流数据保序的实时场景 – 容错性较差 – 集群无法动态扩展

业界进展

• 其它

– StreamBase – Borealis – StreamInsight – Percolator – Hbase coprocessor – Pregel – dremel –…

设计理念

• 负责任(Condition)

• 实时搜索、个人实时信息服务、SNS等

背景

• 技术背景 – MapReduce、Dryad等全量/增量计算平台 – S4、Storm等流计算框架 – CEP以及EDA模型 – Pregel等图计算模型

传统方案与业界进展

• 传统方案

– MAPREDUCE:HDFS加载,存储LOCALITY(容

错性),

图计算

• MapReduce为什么不适合图计算?

– 迭代 – 边的量级远大于节点

• 图计算特点

– 适应于事件机制,规模大(边),但单条数据不大 – 很难分布式(locality、partition,一直都是难点) – 容错性

– Google Pregel

• 本质上还是全量 • 中间结果不可见 • 超步过多(IProcess)

设计理念

• 举例

– 实时JOIN(后面有具体代码)

在storm(不考虑Condition)框架下,实现join, 需要用户代码自己hold条件,判断条件,进而 触 发join后的逻辑处理。但在我们的设计理念下, 这些condition完全可以抽象为复杂完备事件模 型 ,所以作为通用系统应该提供condition的通 用功 能,用户只需进行配置而不是编码就可以 完成 condition,那么实时join在iprocess体系下, 用户 无需编码处理condition,而只需处理join后 的逻 辑。

• S4

– 2010年底,Yahoo,0.3,window todo

业界进展

• Storm:2011.9,twitter,0.5.2

业界进展‐Storm

系统边界

• S4、Storm

– 只能处理“独立”的流数据 – 无法处理“复杂”事件(condition),需要用户

handle复杂的条件 – 不能很好的适用于大部分需要相关数据集执行

淘宝分布式大数据 及实时流数据 技术架构

提纲

• 背景 • 目标 • 传统方案与业界进展 • 设计理念(重点) • 技术架构 • 要点 • 例子 • 系统边界 • 计划

背景

• 应用背景 – 数据量急剧增加 – Web 1.0 web 2.0, publicego net – 电子商务、移动互联网、移动支付 – 欺诈、风控对海量交易实时性 – 用户体验的个性化和实时性 – 由点到面