信息论与编码理论

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

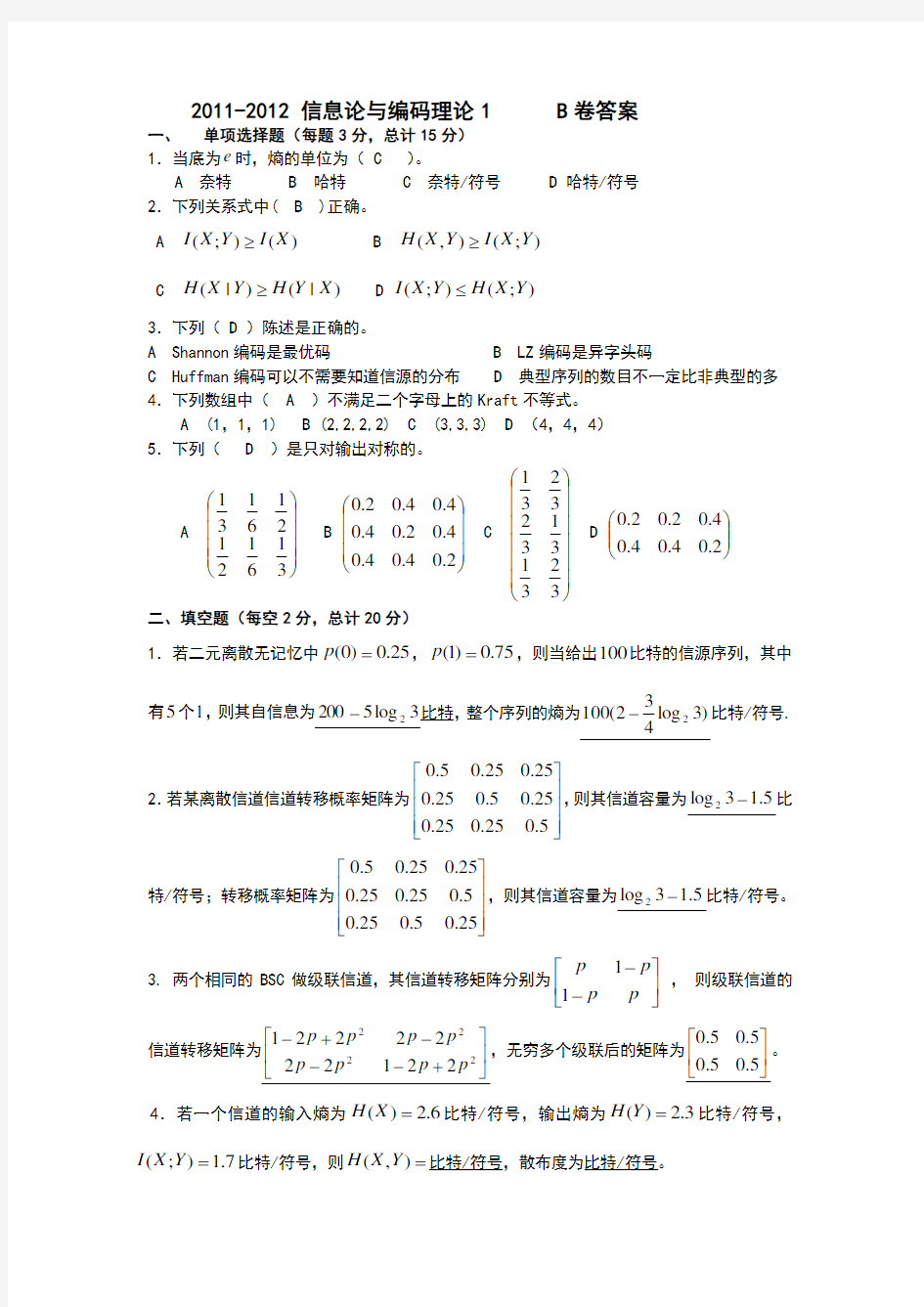

2011-2012 信息论与编码理论1 B 卷答案

一、 单项选择题(每题3分,总计15分) 1.当底为e 时,熵的单位为( C )。

A 奈特

B 哈特

C 奈特/符号

D 哈特/符号 2.下列关系式中( B )正确。

A )();(X I Y X I ≥

B );(),(Y X I Y X H ≥

C )|()|(X Y H Y X H ≥

D );();(Y X H Y X I ≤

3.下列( D )陈述是正确的。

A Shannon 编码是最优码

B LZ 编码是异字头码

C Huffman 编码可以不需要知道信源的分布

D 典型序列的数目不一定比非典型的多 4.下列数组中( A )不满足二个字母上的Kraft 不等式。

A (1,1,1)

B (2,2,2,2)

C (3,3,3)

D (4,4,4) 5.下列( D )是只对输出对称的。

A ⎪⎪⎪⎪

⎭

⎫ ⎝⎛316

121216131 B ⎪⎪⎪⎭⎫ ⎝⎛2.04.04.04.02.04.04.04.02.0 C ⎪⎪⎪⎪

⎪

⎪⎭

⎫ ⎝⎛32313132

3231 D ⎪⎪⎭

⎫ ⎝⎛2.04.04.04.02.02.0 二、填空题(每空2分,总计20分)

1.若二元离散无记忆中25.0)0(=p ,75.0)1(=p ,则当给出100比特的信源序列,其中有5个1,则其自信息为3log 52002-比特,整个序列的熵为)3log 4

3

2(1002-

比特/符号. 2.若某离散信道信道转移概率矩阵为⎥⎥

⎥⎦⎤⎢⎢⎢⎣⎡5.025.025.025.05.025.025.025.05.0,则其信道容量为5.13log 2-比

特/符号;转移概率矩阵为⎥⎥⎥⎦

⎤

⎢⎢⎢⎣⎡25.05.025.05.025.025.025.025.05.0,则其信道容量为5.13log 2-比特/符号。 3. 两个相同的BSC 做级联信道,其信道转移矩阵分别为⎥⎦⎤

⎢

⎣⎡--p p

p p 11 , 则级联信道的信道转移矩阵为⎥⎦⎤⎢⎣⎡+---+-22222212222221p p p

p p p p p ,无穷多个级联后的矩阵为⎥⎦⎤

⎢⎣⎡5.05.05.05.0。 4.若一个信道的输入熵为6.2)(=X H 比特/符号,输出熵为3.2)(=Y H 比特/符号,

7.1);(=Y X I 比特/符号,则=),(Y X H 比特/符号,散布度为比特/符号。

5.在二元LZ 编码中,若信源有K 个,某段信源序列共有M 个字典,则码长

⎡⎤⎡⎤K M 22log log +。

6.存在D 元唯一可译码,其平均码长必小于

1log )

(+D

U H 。

三、判断题(每题2分,总计10分) 1. 概率小的事件自信息大 (√ )

2. 若一个码字集合中的码字长度满足Kraft 不等式 ,则其必为逗点码。 (⨯ )

3. 若码字都被配置在树的叶子节点处,则这种码一定是异字头码。( √ )

4. 平均互信息是下凸函数。( ⨯ )

5. 算数编码需要知道信源的分布。 (√) 四、计算题(55分)

1)(15分)设随机变量Y X ,的联合概率分布如下:

XY Z =。分别求);(),|(),(),(Z X I Y X H Y H X H 。

解: X 的分布率为

则1)(=X H 比特/符号.

Y 的分布率为

则3log 4

3

2)(2-=Y H 比特/符号.

)0()0,0()0|0(====

==Y P Y X p Y X p =1,)1()1,0()1|0(======Y P Y X p Y X p =3

1

)0()0,1()0|1(====

==Y P Y X p Y X p =0,)1()1,1()1|1(======Y P Y X p Y X p = 3

2

)1|0(log )1,0()0|0(log )0,0()|(22p p p p Y X H --=)1|1(log )1,1()0|1(log )0,1(22p p p p -- =32log 210log 031log 411log 412222----=2

1

3log 432-比特/符号.

)0()0,0()0|0(====

==Z P Z X p Z X p =1,)

1()

1,0()1|0(======Z P Z X p Z X p =0

)0()0,1()0|1(======Z P Z X p Z X p =0,)

1()

1,1()1|1(======Z P Z X p Z X p =1

则

)

1()

1|1(log )1,1()1()0|1(log )0,1()0()1|0(log )1,0()0()0|0(log )0,0();(2

222

=+=+=+==X p p p X p p p X p p p X p p p Z X I =0比特/符号.

2)(20分)若离散无记忆信源的概率分布为

⎪⎪⎭

⎫ ⎝⎛=4.03.02.01.0d c b a U

①

分别构造二元,三元Huffman 编码(要求码长方差最小,但不需求出),Shannon

编码,Fano 编码,Shannon-Fano-Elias 编码。

② 并求①中二元Huffman 编码的编码效率。(只列出式子即可)