决策树算法例题

决策树例题经典案例

决策树例题经典案例1. 引言决策树是一种常见且有用的机器学习算法,在许多实际问题中都得到了广泛应用。

它是一种基于树结构的分类模型,通过对数据的特征进行判断,构建出一个树状的决策过程。

本文将通过一个经典的案例,来介绍决策树的基本原理和应用。

2. 案例背景假设我们是一家电子商务平台的运营团队,我们最近推出了一种新产品,并希望根据用户的特征来预测他们是否会购买这个产品。

为了解决这个问题,我们决定使用决策树算法来构建一个分类模型。

3. 数据集介绍我们已经收集了一些用户的相关数据,包括年龄、性别、收入和是否购买产品。

数据集如下:用户ID年龄性别收入是否购买产品125男5000元以上是230女3000-5000元是335男3000-5000元否440男3000-5000元否535男3000-5000元是645女5000元以上是750男2000-3000元否860男3000-5000元是4. 构建决策树模型在构建决策树模型之前,我们需要对数据进行预处理。

首先,将年龄、性别和收入这些特征进行编码转换,方便计算机处理。

然后,将数据集分为训练集和测试集,训练集用于构建模型,测试集用于评估模型的性能。

接下来,我们使用Python中的scikit-learn库来构建决策树模型。

首先,导入相关的库和模块:from sklearn import treeimport pandas as pd然后,读取数据并进行特征编码:data = pd.read_csv('data.csv')# 特征编码data['年龄'] = data['年龄'].map({'25': 0, '30': 1, '35': 2, '40': 3, '45': 4, '50': 5, '60': 6}) data['性别'] = data['性别'].map({'男': 0, '女': 1}) data['收入'] = data['收入'].map({'5000元以上': 0, '3000-5000元': 1, '2000-3000元': 2})# 提取特征和标签X = data[['年龄', '性别', '收入']]y = data['是否购买产品']接着,创建决策树模型并训练:# 创建决策树模型model = tree.DecisionTreeClassifier()# 训练模型model.fit(X, y)最后,使用测试集评估模型的性能:```python # 读取测试集数据 test_data =pd.read_csv(’test_data.csv’)特征编码test_data[‘年龄’] = test_data[‘年龄’].map({’25’: 0, ‘30’: 1, ‘35’: 2, ‘40’: 3, ‘45’: 4, ‘50’: 5, ‘60’: 6}) test_data[‘性别’] = test_data[‘性别’].map({’男’: 0, ‘女’: 1}) test_data[‘收入’] = test_data[‘收入’].map({’5000元以上’: 0, ‘3000-5000元’: 1, ‘2000-3000元’: 2})提取特征和标签X_test = test_data[[‘年龄’, ‘性别’, ‘收入’]] y_test = test_data[‘是否购买产品’]预测结果y_pred = model.predict(X_test)计算准确率accuracy = (y_pred == y_test).mean() print(。

人工智能决策树例题经典案例

人工智能决策树例题经典案例一、经典案例:天气预测决策树在天气预测中有广泛应用,下面是一个关于是否适宜进行户外运动的示例:1. 数据收集:- 温度:高(>30℃)/中(20℃-30℃)/低(<20℃)- 降水:是/否- 风力:高/中/低- 天气状况:晴朗/多云/阴天/雨/暴雨- 应该户外运动:是/否2. 构建决策树:- 根据温度将数据分为三个分支:高温、中温、低温- 在每个分支中,继续根据降水、风力和天气状况进行划分,最终得到是否适宜户外运动的决策3. 决策树示例:温度/ / \高温中温低温/ | | \ |降水无降水风力适宜/ \ | | / \是否高中低| |不适宜适宜- 如果温度是高温且有降水,则不适宜户外运动- 如果温度是高温且无降水,则根据风力判断,如果风力是高,则不适宜户外运动,如果风力是中或低,则适宜户外运动 - 如果温度是中温,则不论降水和风力如何,都适宜户外运动- 如果温度是低温,则需要考虑风力,如果风力是高,则适宜户外运动,如果风力是中或低,则不适宜户外运动4. 参考内容:决策树的构建和应用:决策树通过对输入特征进行划分,构建了一棵树形结构,用于解决分类或回归问题。

构建决策树主要包括数据预处理、特征选择、划分策略和停止条件等步骤。

特征选择可以使用信息增益、基尼指数等算法,划分策略可以使用二叉划分或多叉划分,停止条件可以是叶子节点纯度达到一定阈值或达到预定的树深度。

决策树的应用包括数据分类、特征选择和预测等任务。

天气预测案例中的决策树:将天气预测问题转化为分类问题,通过构建决策树,可以得到识别是否适宜户外运动的规则。

决策树的决策路径可以用流程图或树状图表示,帮助理解和解释决策过程。

决策树的节点表示特征值,分支表示判断条件,叶子节点表示分类结果。

决策树的生成算法可以基于启发式规则或数学模型,如ID3、C4.5、CART等。

决策树的优缺点:决策树具有可解释性强、易于理解和实现、能处理非线性关系等优点。

id3决策树算法例题

ID3决策树算法例题简介决策树是一种常见的机器学习算法,用于解决分类和回归问题。

其中,ID3(Iterative Dichotomiser 3)决策树算法是最早被提出的决策树算法之一。

本文将以一个例题为例,深入探讨ID3决策树算法的原理和应用。

例题描述假设我们要根据以下特征来判断一个水果是苹果还是橘子: 1. 颜色:红、橙 2. 直径:大、中等、小 3. 纹理:平滑、凹凸我们已经收集到了一些水果的样本数据,如下所示:编号颜色直径纹理类别1 红大平滑苹果2 红大凹凸苹果3 橙大平滑橘子4 橙小平滑橘子5 红中等平滑苹果我们希望构建一个决策树模型,通过输入颜色、直径和纹理这3个特征,能够预测水果的类别。

ID3决策树算法原理ID3决策树算法的核心思想是选择每次划分时信息增益最大的特征作为决策节点。

它采用自顶向下的贪心策略,递归地构建决策树。

下面详细介绍ID3算法的原理。

1. 计算信息熵首先,我们需要计算每个特征的信息熵,以此来衡量特征对分类结果的纯度影响。

信息熵的计算公式如下:H (D )=−∑p i Ni=1log 2p i其中,H (D )表示数据集D 的信息熵,N 表示类别的个数,p i 表示类别i 在数据集D 中的比例。

2. 计算信息增益接下来,对于每个特征A ,我们需要计算其信息增益Gain (D,A )。

信息增益是指特征A 对于数据集D 的纯度提升程度,计算公式如下:Gain (D,A )=H (D )−∑|D v ||D |Vv=1H (D v ) 其中,V 表示特征A 的取值个数,D v 表示特征A 取值为v 的样本子集。

3. 选择最佳划分特征根据计算得到的信息增益,选择信息增益最大的特征作为决策节点。

4. 递归构建决策树将选择的特征作为决策节点,以该特征的不同取值作为分支,递归地构建决策树。

计算步骤根据上面的原理,我们来逐步计算示例中的决策树。

1. 计算初始数据集的信息熵H (D )根据表格中的数据,我们可以计算出初始数据集的信息熵H (D ),其中苹果出现的概率为35,橘子出现的概率为25。

决策树例题经典案例280

决策树例题经典案例280决策树是一种常用的机器学习算法,它可以用于分类和回归任务。

决策树通过对数据集进行分割,构建一个树形结构,从而实现对数据的预测或分类。

在本文中,我们将通过经典案例来介绍决策树的应用和实现。

案例背景:假设我们有一个电商平台,我们希望通过用户的行为数据来预测用户是否会购买某种产品。

我们收集了一些用户的行为数据,包括浏览页面次数、点击广告次数、加入购物车次数等。

我们希望通过这些数据来构建一个决策树模型,从而预测用户的购买行为。

数据集:我们收集了1000个用户的行为数据,每个用户有以下特征:1. 浏览页面次数(0-100)。

2. 点击广告次数(0-10)。

3. 加入购物车次数(0-5)。

4. 是否购买(是/否)。

数据预处理:在构建决策树模型之前,我们需要对数据进行预处理。

首先,我们将数据集分为训练集和测试集,其中训练集占80%,测试集占20%。

然后,我们对特征进行归一化处理,将所有特征缩放到0-1之间,以便模型能够更好地学习特征之间的关系。

决策树模型构建:我们使用Python中的scikit-learn库来构建决策树模型。

首先,我们选择合适的决策树算法,比如ID3、CART等。

然后,我们通过训练集来训练模型,调整模型的参数,如最大深度、最小样本分割数等,以提高模型的准确性和泛化能力。

模型评估:在模型训练完成后,我们需要对模型进行评估。

我们使用测试集来评估模型的准确性、精确度、召回率等指标,以及绘制ROC曲线、混淆矩阵等来评估模型的性能。

模型预测:最后,我们使用训练好的决策树模型来对新的用户数据进行预测。

当有新的用户数据输入时,模型可以根据用户的行为特征来预测用户是否会购买产品,从而为电商平台提供决策支持。

总结:通过本案例的介绍,我们了解了决策树在电商平台中的应用。

决策树模型可以通过用户的行为数据来预测用户的购买行为,为电商平台提供决策支持。

同时,我们也学习了如何使用Python中的scikit-learn库来构建和评估决策树模型。

c4.5决策树例题

c4.5决策树例题决策树是一种常见的机器学习算法,用于分类和预测任务。

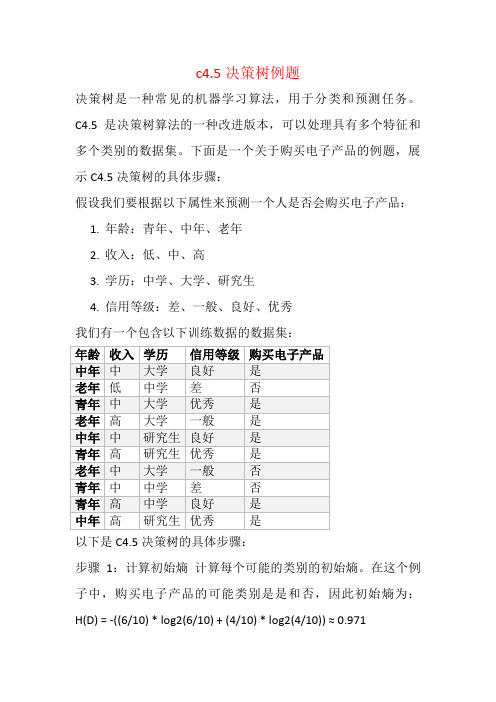

C4.5是决策树算法的一种改进版本,可以处理具有多个特征和多个类别的数据集。

下面是一个关于购买电子产品的例题,展示C4.5决策树的具体步骤:假设我们要根据以下属性来预测一个人是否会购买电子产品:1.年龄:青年、中年、老年2.收入:低、中、高3.学历:中学、大学、研究生4.信用等级:差、一般、良好、优秀我们有一个包含以下训练数据的数据集:以下是C4.5决策树的具体步骤:步骤1:计算初始熵计算每个可能的类别的初始熵。

在这个例子中,购买电子产品的可能类别是是和否,因此初始熵为:H(D) = -((6/10) * log2(6/10) + (4/10) * log2(4/10)) ≈ 0.971步骤2:计算每个属性的信息增益计算每个属性的信息增益(即使用该属性进行划分后的熵的减少量)。

对于每个属性,计算其每个可能值的条件熵,并将其与初始熵进行比较来计算信息增益。

具体步骤如下:a) 对于属性"年龄",计算其各个值的条件熵:•年龄=青年:购买(2是, 2否),条件熵=-((2/4) * log2(2/4) + (2/4) * log2(2/4)) = 1.0•年龄=中年:购买(3是, 1否),条件熵=-((3/4) * log2(3/4) + (1/4) * log2(1/4)) ≈ 0.811•年龄=老年:购买(1是, 1否),条件熵=-((1/2) * log2(1/2) + (1/2) * log2(1/2)) = 1.0然后,计算年龄属性的信息增益:Gain(年龄) = H(D) - ((4/10) *1.0 + (4/10) * 0.811 + (2/10) * 1.0) ≈ 0.124b) 对于属性"收入",计算其各个值的条件熵:•收入=低:购买(1是, 1否),条件熵=-((1/2) * log2(1/2) + (1/2) * log2(1/2)) = 1.0•收入=中:购买(3是, 1否),条件熵=-((3/4) * log2(3/4) + (1/4) * log2(1/4)) ≈ 0.811•收入=高:购买(2是, 2否),条件熵=-((2/4) * log2(2/4) + (2/4) * log2(2/4)) = 1.0然后,计算收入属性的信息增益:Gain(收入) = H(D) - ((2/10) * 1.0 + (4/10) * 0.811 + (4/10) * 1.0) ≈ 0.291c) 对于属性"学历",计算其各个值的条件熵:•学历=中学:购买(1是, 1否),条件熵=-((1/2) * log2(1/2) + (1/2) * log2(1/2)) = 1.0•学历=大学:购买(3是, 2否),条件熵=-((3/5) * log2(3/5) + (2/5) * log2(2/5)) ≈ 0.971•学历=研究生:购买(3是, 1否),条件熵=-((3/4) * log2(3/4) + (1/4) * log2(1/4)) ≈ 0.811然后,计算学历属性的信息增益:Gain(学历) = H(D) - ((2/10) *1.0 + (5/10) * 0.971 + (3/10) * 0.811) ≈ 0.128d) 对于属性"信用等级",计算其各个值的条件熵:•信用等级=差:购买(0是, 1否),条件熵=0•信用等级=一般:购买(1是, 1否),条件熵=-((1/2) * log2(1/2) + (1/2) * log2(1/2)) = 1.0•信用等级=良好:购买(2是, 1否),条件熵=-((2/3) * log2(2/3) + (1/3) * log2(1/3)) ≈ 0.918•信用等级=优秀:购买(3是, 1否),条件熵=-((3/4) * log2(3/4) + (1/4) * log2(1/4)) ≈ 0.811然后,计算信用等级属性的信息增益:Gain(信用等级) = H(D) - ((1/10) * 0 + (2/10) * 1.0 + (3/10) * 0.918 + (4/10) * 0.811) ≈ 0.115步骤3:选择信息增益最大的属性作为当前节点的划分属性根据信息增益,选择信息增益最大的属性作为当前节点的划分属性。

决策树例题分析及解答

各点效益值计算过程是:

点2:13.5×0.8×3+172.9×0.8+25.5×0.2×3+206.5×0.2-25(投资)=202.3万元

点3:15×0.8×3+105×0.8+15×0.2×3+105×0.2-10(投资)=140万元

点4:21.5×0.6×7年+29.5×0.4×7年=172.9万元

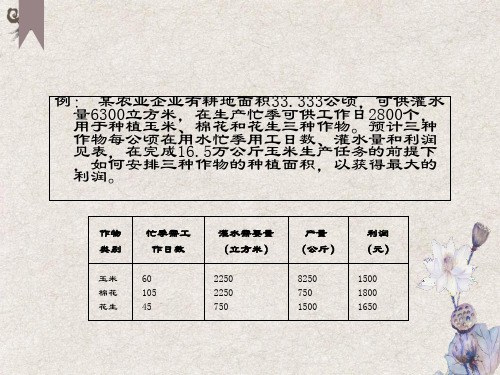

例: 某农业企业有耕地面积33.333公顷,可供灌水量6300立方米,在生产忙季可供工作日2800个,用于种植玉米、棉花和花生三种作物。预计三种作物每公顷在用水忙季用工日数、灌水量和利润见表,在完成16.5万公斤玉米生产任务的前提下,如何安排三种作物的种植面积,以获得最大的利润。

作物类别

忙季需工作日数

建设大工厂需要投资600万元,可使用10年。销路好每年赢利200万元,销路不好则亏损40万元。

建设小工厂投资280万元,如销路好,3年后扩建,扩建需要投资400万元,可使用7年,每年赢利190万元。不扩建则每年赢利80万元。如销路不好则每年赢利60万元。

试用决策树法选出合理的决策方案。 经过市场调查,市场销路好的概率为0.7,销路不好的概率为0.3。

甲

乙

丙

丁

需求量较高 需求量一般 需求量较低 需求量很低

600 400 -150 -350

800 350 -350 -700

350 220 50 -100

40求量一般

需求量较低

需求量很低

max

甲

600

400

-150

-350

600

乙

800

350

-350

-700

800

*

1

4

2

3

6

5

数据挖掘决策树算法例题

数据挖掘决策树算法例题数据挖掘决策树算法是一种流行的机器学习算法,广泛应用于分类和预测分析。

这种算法基于一组数据生成一棵考虑各种可能性的决策树。

本文将通过例题解释该算法的原理和应用。

1. 例题在一个电商网站上,有多个用户对不同产品进行了评价,其中包括商品的价格、尺寸和性能等。

该网站想要建立一个模型预测该商品是否受欢迎。

为此,请使用决策树算法解决以下问题:- 建立一个分类模型,预测商品是否受欢迎。

- 确定最重要的评价因素。

2. 数据准备首先,需要将原始数据转换为可以用于决策树算法的格式。

假设原始数据包含以下字段:价格(price)、尺寸(size)、性能(performance)和受欢迎程度(popularity)。

其中,价格、尺寸和性能为输入变量,受欢迎程度为输出变量。

3. 算法应用使用决策树算法生成一个分类模型,可以将原始数据拆分成不同的类别。

例如,可能会将价格范围为10-15美元的所有商品放入一个类别,将价格大于30美元的商品放入另一个类别。

为了确定最重要的评价因素,需要进行以下步骤:- 计算每个变量的信息增益。

信息增益是根据变量计算的一种度量,它表示将该变量算入模型后,能多少地提高预测准确率。

- 确定最大信息增益的变量。

选择具有最大信息增益的变量作为初始分裂变量。

- 重复以上步骤,直到建立决策树模型。

4. 结论通过以上步骤可以生成一个预测模型,用于预测商品是否受欢迎。

同时,可以确定最重要的评价因素,该因素将成为分裂变量。

例如,根据计算结果,性能变量对于预测商品受欢迎程度的影响最大。

如果性能较好,那么这款产品的受欢迎程度也比较高。

从而可以更容易地开发出受欢迎的产品。

决策树算法是一种强大的工具,可以使用它来生成复杂的模型并预测输出变量。

在数据挖掘和机器学习领域中,该算法已被广泛使用,并受到越来越多的关注。

通过了解决策树算法的原理和应用,可以更好地应用它来解决实际问题。

决策树例题经典案例

决策树例题经典案例决策树是一种常用的机器学习算法,它能够通过构建一棵树来对数据进行分类或者回归预测。

决策树通过对每个样本的特征进行划分,从而逐步构建树结构,最终得到一棵用于分类或者回归的决策树。

下面我们来看一个经典的决策树例题。

假设我们有一个数据集,包含了一些二分类问题的样本,每个样本有两个特征,特征1表示是否有房产(是/否),特征2表示是否有工作(是/否)。

我们的目标是通过这两个特征来预测样本的类别(是/否)。

我们可以根据这个问题构建一个决策树。

首先,我们需要选择一个特征来进行划分。

通常我们选择的划分特征是能够最大程度地将样本分开的特征。

在这个例子中,我们可以选择特征1作为划分特征。

然后,我们将特征1的取值分别为“是”和“否”的样本分成两个子集。

对于特征1取值为“是”的样本,我们可以看到它们的类别都为“是”,所以我们可以将其划分为一个叶子节点,并且将类别设为“是”。

对于特征1取值为“否”的样本,我们需要选择另一个特征来划分。

同样地,我们选择特征2作为划分特征。

对于特征2取值为“是”的样本,我们可以看到它们的类别有一部分为“是”,一部分为“否”,所以我们还需要继续划分。

我们选择特征1作为再次划分的特征。

对于特征2取值为“否”的样本,我们可以看到它们的类别都为“否”,所以我们可以将其划分为一个叶子节点,并且将类别设为“否”。

对于特征2取值为“是”,特征1取值为“否”的样本,我们可以看到它们的类别全部为“否”,所以我们可以将其划分为一个叶子节点,并且将类别设为“否”。

最后,我们得到的决策树如下:特征1是|--- 类别:是特征1否|--- 特征2是| |--- 类别:是||--- 特征2否|--- 类别:否通过这个决策树,我们可以根据样本的特征值来进行预测。

例如,对于一个样本,特征1为“是”,特征2为“否”,按照决策树的规则,我们可以预测该样本的类别为“否”。

决策树是一种直观、易于解释的机器学习算法,它能够根据数据集的特征进行分类或者预测,对于解决一些简单的二分类问题非常有效。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

决策树算法例题

一、决策树基本概念与原理

决策树是一种基于树结构的分类与回归模型。

它通过一系列的问题对数据进行划分,最终得到叶子节点对应的分类结果或预测值。

决策树的构建过程通常采用自上而下、递归划分的方法。

二、决策树算法实例解析

以一个简单的决策树为例,假设我们要预测一个人是否喜欢户外运动。

已知特征:性别、年龄、是否喜欢晒太阳。

可以通过以下决策树划分:

1.根据性别划分,男性为喜欢户外运动,女性为不喜欢户外运动。

2.若性别为男性,再根据年龄划分,年龄小于30分为喜欢户外运动,大于30分为不喜欢户外运动。

3.若性别为女性,无论年龄如何,均分为喜欢户外运动。

通过这个决策树,我们可以预测一个人是否喜欢户外运动。

三、决策树算法应用场景及优缺点

1.应用场景:分类问题、回归问题、关联规则挖掘等。

2.优点:易于理解、可解释性强、泛化能力较好。

3.缺点:容易过拟合、对噪声敏感、构建过程耗时较长。

四、实战演练:构建决策树解决实际问题

假设我们要预测房价,已知特征:面积、卧室数量、卫生间数量、距市中心距离。

可以通过构建决策树进行预测:

1.选择特征:根据相关性分析,选择距市中心距离作为最佳划分特征。

2.划分数据集:将数据集划分为训练集和测试集。

3.构建决策树:采用递归划分方法,自上而下构建决策树。

4.模型评估:使用测试集评估决策树模型的预测性能。

通过以上步骤,我们可以运用决策树算法解决实际问题。