卷积神经网络CNN代码解析-matlab

卷积神经网络算法分析及图像处理示例

卷积神经网络算法分析及图像处理示例卷积神经网络(Convolutional Neural Network, CNN)是一种广泛应用于图像处理、语音识别等领域的深度神经网络,在计算机视觉中被广泛应用。

它的特殊之处在于,它的网络结构与人类的视觉神经结构有异曲同工之妙,能够有效提取图片中的图像特征。

下面将介绍我们是如何应用卷积神经网络对图像进行处理的,并对算法进行分析。

首先来看卷积神经网络的基本算法思想。

卷积神经网络是由卷积层、池化层、全连接层等基本组件构成的,其中卷积层是卷积神经网络的核心,因为它负责特征提取。

这么说可能还不是很清楚,下面就来详细分析一下卷积神经网络的算法。

卷积神经网络的算法分析主要分为两个方面:卷积层的算法和反向传播算法。

1. 卷积层的算法卷积神经网络的卷积层基本操作是使用固定大小的窗口在输入特征图(inputfeature map)的每个位置上对应进行卷积,然后将这些卷积结果组合成输出特征图(output feature map)。

一个卷积滤波器(卷积核)从输入特征图的左上角开始移动,每次向右移动一个像素,然后再向下移动一个像素。

卷积核内的值与输入特征值相乘之和(即内积)即为卷积结果,而这个卷积结果则成为输出特征值。

在卷积过程中,卷积核通常是可以学习的,也就是说,网络会自适应地训练卷积核以自动提取有用的特征。

这个训练过程是通过反向传播实现的。

2. 反向传播算法反向传播算法是卷积神经网络使用的一种优化算法,用于计算网络的误差梯度,以便对网络进行调整。

反向传播算法主要分为两个步骤:前向传播和反向传播。

前向传播是卷积神经网络中的重要环节,通过这一步骤可以得到每个节点的输出(forward pass)。

它通过不断迭代多次前向传播来计算最终输出。

反向传播是指统计误差并利用误差信息来训练网络(backward pass)。

它通过计算误差的反向传播,逐层更新每个节点的权重来训练网络,完成优化操作。

卷积运算的matlab命令及其参数设置规则

卷积运算是数字信号处理和图像处理中常用的一种运算方式,它在图像滤波、特征提取等领域中发挥着重要作用。

在Matlab中,卷积运算可以通过一些内置的函数实现,同时可以通过设置不同的参数来实现不同的卷积操作。

本文将结合实际案例,介绍卷积运算在Matlab 中的常用命令及其参数设置规则。

一、卷积运算的基本概念在数字信号处理和图像处理中,卷积运算是一种重要的数学运算。

它通常用于图像滤波、特征提取等方面。

卷积运算的基本原理是将一个函数与另一个函数的翻转及平移进行积分。

在离散情况下,卷积运算可以用离散的形式来表示如下:\[y[n] = \sum_{k=-\infty}^{\infty} x[k] \cdot h[n-k]\]其中,\(x[k]\)和\(h[n]\)分别代表输入信号和卷积核,\(y[n]\)代表卷积运算的输出结果。

二、Matlab中的卷积运算函数在Matlab中,可以使用conv函数来进行一维和二维的卷积运算。

conv函数的基本语法如下:```y = conv(x, h)```其中,x和h分别代表输入信号和卷积核,y代表卷积运算的输出结果。

这里需要注意的是,x和h的长度必须是有限的,而且二者不能交换位置。

在进行二维卷积运算时,可以使用conv2函数。

conv2函数的基本语法如下:```y = conv2(x, h)```其中,x和h分别代表输入图像和卷积核,y代表二维卷积运算的输出结果。

三、卷积运算参数的设置规则在进行卷积运算时,需要注意一些参数的设置规则,以确保卷积运算的正确性和有效性。

以下是一些常见的参数设置规则:1. 卷积核的选择:卷积核的选择对卷积运算的结果影响很大。

通常情况下,可以根据具体的应用需求来选择合适的卷积核,例如高斯滤波、边缘检测等。

2. 边界处理:在进行卷积运算时,往往需要考虑图像或信号的边界处理。

常见的处理方式包括零填充、边界拓展、周期延拓等。

3. 步长和填充:在进行卷积运算时,可以通过设置步长和填充参数来控制输出结果的大小。

使用MATLAB进行卷积运算的常见错误及解决方法

使用MATLAB进行卷积运算的常见错误及解决方法引言:卷积运算是数字信号处理中常用的一种操作,广泛应用于图像处理、音频处理、通信等领域。

而MATLAB作为一款强大的数学软件,也提供了方便快捷的卷积函数供我们使用。

然而,在实际操作中,由于对卷积运算的理解不够深入或者对MATLAB函数的使用不够熟悉,很容易犯一些常见的错误。

本文将针对使用MATLAB进行卷积运算的常见错误进行介绍,并给出相应的解决方法。

一、错误一:输入信号维度不匹配在进行卷积运算时,输入信号的维度必须相匹配。

一般情况下,MATLAB中的卷积函数conv()要求输入的两个信号长度相等或者至少有一个信号的长度大于另一个信号的长度,即两个信号的维度要满足M>=N(M和N分别为两个信号的长度)。

如果输入信号的维度不匹配,就会产生错误或得到错误的结果。

解决方法:确保要用于卷积运算的两个信号的维度匹配。

可以通过使用MATLAB函数reshape()或者resize()来重新调整信号的维度,使其满足卷积运算的要求。

二、错误二:边界效应处理不当在卷积运算中,边界效应是一个常见的问题。

默认情况下,MATLAB中的卷积函数conv()会采用边界补零(zero padding)的方式处理输入信号的边界,这可能会导致卷积结果出现不符合预期的边界效应。

解决方法:可以通过使用MATLAB函数padarray()来指定合适的填充方式,并对输入信号进行合适的边界处理。

常用的填充方式有:1. 边界复制(replicate):将信号边界的元素复制到填充位置。

2. 对称填充(symmetric):将信号的边界元素按对称方式填充到填充位置。

3. 循环填充(circular):将信号进行循环补充。

三、错误三:卷积核颠倒在进行卷积运算时,常常需要将卷积核(也称为滤波器)进行颠倒操作。

这是因为卷积运算中,卷积核是沿着输入信号进行滑动的,颠倒操作可以保证卷积核与输入信号的顺序一致,得到正确的卷积结果。

matlab_convolution2dlayer用法_概述及解释说明

matlab convolution2dlayer用法概述及解释说明1. 引言1.1 概述在计算机科学和图像处理领域,卷积神经网络(Convolutional Neural Networks, CNN)是一种强大的深度学习模型,被广泛应用于图像识别、目标检测、图像分割等任务中。

而MATLAB作为一款功能强大的数值计算软件,提供了许多方便实用的函数和工具包来支持CNN的构建与训练。

本文将重点介绍MATLAB中一个关键的组件——卷积层(Convolution2DLayer),以及其相关使用方法和参数设置。

通过深入理解卷积层的原理和应用场景,读者将能更好地运用该层进行图像特征提取和模式识别任务。

1.2 文章结构本文主要包括以下几个部分:- 引言:介绍文章的研究背景、目的和结构。

- MATLAB中的卷积层(Convolution2DLayer): 详细解释什么是卷积层,并对其使用方法进行说明。

- 卷积核与步长设置:讨论卷积核及步长对结果影响,并给出相应的设置建议。

- Convolutional Neural Networks (CNN)简介:概述CNN基本原理及其在图像处理领域的应用场景。

- 结论与总结:对本文的内容进行总结,并展望卷积层在未来的应用前景。

1.3 目的本文旨在全面介绍MATLAB中卷积层(Convolution2DLayer)的概念、使用方法和参数设置,以帮助读者深入理解该功能模块在图像处理中的重要性和应用场景。

通过学习本文,读者将能够更加熟练地运用MATLAB中的卷积层进行图像特征提取和分析,从而提高图像处理任务的效果和准确率。

2. MATLAB中的卷积层(Convolution2DLayer):2.1 卷积层概述:在深度学习中,卷积神经网络(Convolutional Neural Network, CNN)是一种常用的神经网络模型。

卷积层是CNN中的核心组件之一,它在图像处理和计算机视觉任务中发挥重要作用。

如何进行MATLAB神经网络的训练和预测

如何进行MATLAB神经网络的训练和预测【第一章】MATLAB神经网络的基础知识神经网络是一种模拟人类神经系统运行方式的计算模型,它通过模拟人类的感知、学习和决策过程,可以对复杂的问题进行处理和求解。

在实际应用中,MATLAB是一个常用的工具来进行神经网络的训练和预测。

本章将介绍MATLAB 神经网络的基础知识,包括神经网络的原理、MATLAB的神经网络工具箱以及神经网络训练和预测的一般步骤。

1.1 神经网络的原理神经网络由神经元(neuron)组成,每个神经元接收多个输入并产生一个输出。

神经网络的基本单元是感知器(perceptron),它由权重、偏置和激活函数组成。

权重决定了输入对输出的影响程度,偏置用于调整输出的偏移量,激活函数用于处理神经元的输出。

通过调整权重和偏置,神经网络可以学习和适应不同的输入输出模式。

常见的神经网络包括前馈神经网络(feedforward neural network)、循环神经网络(recurrent neural network)和卷积神经网络(convolutional neural network)。

前馈神经网络是最基本的神经网络类型,信息只能在网络中的一个方向流动,即从输入层到输出层。

循环神经网络具有反馈连接,可以记忆之前的状态信息,适用于序列数据的处理。

卷积神经网络则主要用于图像和语音等二维数据的处理。

1.2 MATLAB神经网络工具箱MATLAB提供了一个神经网络工具箱(Neural Network Toolbox),用于设计、训练和模拟神经网络。

该工具箱包括多种神经网络类型、各种激活函数、训练算法和性能函数等各种功能模块。

使用MATLAB神经网络工具箱可以方便地进行神经网络的建模和仿真。

在MATLAB神经网络工具箱中,神经网络被表示为一个网络对象(network object)。

网络对象由一系列图层(layer)组成,每个图层由若干个神经元组成。

网络对象还包括连接权重矩阵、偏置向量和训练参数等属性。

BP神经网络与卷积神经网络(CNN)

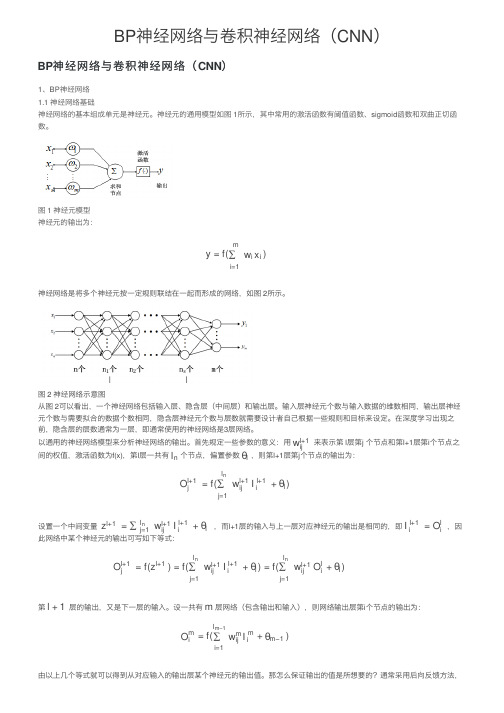

BP 神经⽹络与卷积神经⽹络(CNN )BP 神经⽹络与卷积神经⽹络(CNN )1、BP 神经⽹络 1.1 神经⽹络基础神经⽹络的基本组成单元是神经元。

神经元的通⽤模型如图 1所⽰,其中常⽤的激活函数有阈值函数、sigmoid 函数和双曲正切函数。

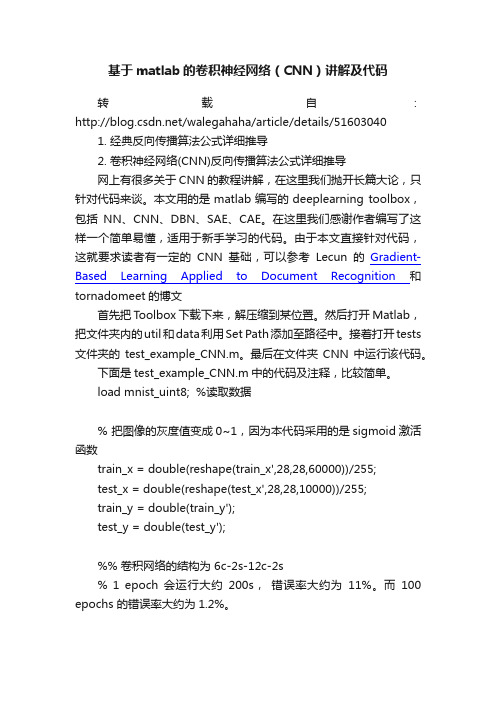

图 1 神经元模型 神经元的输出为:神经⽹络是将多个神经元按⼀定规则联结在⼀起⽽形成的⽹络,如图 2所⽰。

图 2 神经⽹络⽰意图从图 2可以看出,⼀个神经⽹络包括输⼊层、隐含层(中间层)和输出层。

输⼊层神经元个数与输⼊数据的维数相同,输出层神经元个数与需要拟合的数据个数相同,隐含层神经元个数与层数就需要设计者⾃⼰根据⼀些规则和⽬标来设定。

在深度学习出现之前,隐含层的层数通常为⼀层,即通常使⽤的神经⽹络是3层⽹络。

以通⽤的神经⽹络模型来分析神经⽹络的输出。

⾸先规定⼀些参数的意义:⽤ 来表⽰第 l 层第j 个节点和第l+1层第i 个节点之间的权值,激活函数为f(x),第l 层⼀共有 个节点,偏置参数 ,则第l+1层第j 个节点的输出为:设置⼀个中间变量 ,⽽l+1层的输⼊与上⼀层对应神经元的输出是相同的,即 ,因此⽹络中某个神经元的输出可写如下等式:第 层的输出,⼜是下⼀层的输⼊。

设⼀共有 层⽹络(包含输出和输⼊),则⽹络输出层第i 个节点的输出为:由以上⼏个等式就可以得到从对应输⼊的输出层某个神经元的输出值。

那怎么保证输出的值是所想要的?通常采⽤后向反馈⽅法,y =f()∑i=1mw i x i w l+1ij l n θl =f(+)O l+1j ∑j=1l nw l+1ij I l+1iθl =+z l+1∑l nj=1w l+1ij I l+1i θl =I l+1i O l i=f()=f(+)=f(+)O l+1jzl+1∑j=1l nw l+1ij I l+1i θl ∑j=1l nw l+1ij O li θl l +1m =f(+)O m i∑i=1l m−1w m ij I mi θm−1将误差层层传递,并利⽤梯度下降法更新每⼀层的参数,这就是BP 神经⽹络。

基于matlab的卷积神经网络(CNN)讲解及代码

基于matlab的卷积神经网络(CNN)讲解及代码转载自:/walegahaha/article/details/516030401.经典反向传播算法公式详细推导2.卷积神经网络(CNN)反向传播算法公式详细推导网上有很多关于CNN的教程讲解,在这里我们抛开长篇大论,只针对代码来谈。

本文用的是matlab编写的deeplearning toolbox,包括NN、CNN、DBN、SAE、CAE。

在这里我们感谢作者编写了这样一个简单易懂,适用于新手学习的代码。

由于本文直接针对代码,这就要求读者有一定的CNN基础,可以参考Lecun的Gradient-Based Learning Applied to Document Recognition和tornadomeet的博文首先把Toolbox下载下来,解压缩到某位置。

然后打开Matlab,把文件夹内的util和data利用Set Path添加至路径中。

接着打开tests 文件夹的test_example_CNN.m。

最后在文件夹CNN中运行该代码。

下面是test_example_CNN.m中的代码及注释,比较简单。

load mnist_uint8; %读取数据% 把图像的灰度值变成0~1,因为本代码采用的是sigmoid激活函数train_x = double(reshape(train_x',28,28,60000))/255;test_x = double(reshape(test_x',28,28,10000))/255;train_y = double(train_y');test_y = double(test_y');%% 卷积网络的结构为 6c-2s-12c-2s% 1 epoch 会运行大约200s,错误率大约为11%。

而100 epochs 的错误率大约为1.2%。

rand('state',0) %指定状态使每次运行产生的随机结果相同yers = {struct('type', 'i') % 输入层struct('type', 'c', 'outputmaps', 6, 'kernelsize', 5) % 卷积层struct('type', 's', 'scale', 2) % pooling层struct('type', 'c', 'outputmaps', 12, 'kernelsize', 5) % 卷积层struct('type', 's', 'scale', 2) % pooling层};opts.alpha = 1; % 梯度下降的步长opts.batchsize = 50; % 每次批处理50张图opts.numepochs = 1; % 所有图片循环处理一次cnn = cnnsetup(cnn, train_x, train_y); % 初始化CNNcnn = cnntrain(cnn, train_x, train_y, opts); % 训练CNN [er, bad] = cnntest(cnn, test_x, test_y); % 测试CNN%plot mean squared errorfigure; plot(cnn.rL);assert(er<0.12, 'Too big error');•1•2•3•4•5•6•7•8•9•10•11•12•13•14•15•16•17•18•19•20•21•22•23•24•25•26•27•28•29•30•31•32•33•34下面是cnnsetup.m中的代码及注释。

Matlab编程实例视频教程系列45:深度学习(卷积神经网络)图像数据集读取输入 卷积层全连接层

freexyn编程实例视频教程系列45Matlab与深度学习(卷积神经网络)45.0 概述1.主要内容运用Matlab编程处理深度学习在图像的分类识别和回归预测方面的应用,主要内容就是学习卷积神经网络。

作者:freexyn45.1一个实例入门深度学习1 深度学习概念2 流程数据准备:训练数据,验证数据,测试数据知识准备:神经网络的概念和用法(推荐系列43)典型的深度学习神经网络:卷积神经网络3 编程演示:一个手写体识别实例入门深度学习45.2 图像数据集读取并输入网络:表table1 介绍图像数据集(看66.35)THE MNIST DATABASE of handwritten digits2 图像数据(灰度图和彩色图)在Matlab中表达方式3 数据集读取到Matlab,介绍图像集和标签集数据格式(元胞数组,分类数组),并预览图像;4 作为训练/验证数据传递给卷积神经网络的格式(table)45.3 网络分类识别并计算准确率classify1 使用已训练好的深度神经网络对图像进行分类识别;2 计算识别准确率;3 可视化预览识别结果,以及识别有误的结果。

45.4 图像输入层imageInputLayer1 图像输入层(imageInputLayer)把二维图像输入到网络2 数据归一化(四种归一化方法);'zerocenter' (default)'zscore''rescale-symmetric''rescale-zero-one''none'45.5 卷积的原理1 卷积的基本概念和运算定义2 深度网络中卷积的原理3 概念:滤波器filter、步长stride、特征图Feature Maps、填充Padding、膨胀因子DilationFactor45.6 卷积层convolution2dLayer1 卷积层属性列表介绍;2 权重参数可视化。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

卷积神经网络CNN代码解析

deepLearnToolbox-master是一个深度学习matlab包,里面含有很多机器学习算法,如卷积神经网络CNN,深度信念网络DBN,自动编码AutoEncoder(堆栈SAE,卷积CAE)的作者是Rasmus Berg Palm

(************************)

代码下载:https:///rasmusbergpalm/DeepLearnToolbox

这里我们介绍deepLearnToolbox-master中的CNN部分。

DeepLearnToolbox-master中CNN内的函数:

调用关系为:

该模型使用了mnist的数字mnist_uint8.mat作为训练样本,作为cnn的一个使用样例,

每个样本特征为一个28*28=的向量。

网络结构为:

让我们来看看各个函数:

一、Test_example_CNN: (2)

三、cnntrain.m (5)

四、cnnff.m (6)

五、cnnbp.m (7)

五、cnnapplygrads.m (10)

六、cnntest.m (11)

一、Test_example_CNN:

Test_example_CNN:

1设置CNN的基本参数规格,如卷积、降采样层的数量,卷积核的大小、降采样的降幅

2 cnnsetup函数初始化卷积核、偏置等

3 cnntrain函数训练cnn,把训练数据分成batch,然后调用

3.1 cnnff 完成训练的前向过程,

3.2 cnnbp计算并传递神经网络的error,并计算梯度(权重的修改量)

3.3 cnnapplygrads 把计算出来的梯度加到原始模型上去

4 cnntest 函数,测试当前模型的准确率

该模型采用的数据为mnist_uint8.mat,

含有70000个手写数字样本其中60000作为训练样本,10000作为测试样本。

把数据转成相应的格式,并归一化。

设置网络结构及训练参数

初始化网络,对数据进行批训练,验证模型准确率

绘制均方误差曲线

二、Cnnsetup.m

该函数你用于初始化CNN的参数。

设置各层的mapsize大小,

初始化卷积层的卷积核、bias

尾部单层感知机的参数设置

*

bias统一设置为0

权重设置为:-1~1之间的随机数/sqrt(6/(输入神经元数量+输出神经元数量))

对于卷积核权重,输入输出为fan_in, fan_out

fan_out = yers{l}.outputmaps * yers{l}.kernelsize ^ 2;

%卷积核初始化,1层卷积为1*6个卷积核,2层卷积一共6*12=72个卷积核。

对于每个卷积输出featuremap,%fan_in = 表示该层的一个输出map,所对应的所有卷积核,包含的神经元的总数。

1*25,6*25

fan_in = numInputmaps * yers{l}.kernelsize ^ 2;

fin =1*25 or 6*25

fout=1*6*25 or 6*12*25

yers{l}.k{i}{j} = (rand(yers{l}.kernelsize) - 0.5) * 2 * sqrt(6 / (fan_in + fan_out));

1 卷积降采样的参数初始化

2尾部单层感知机的参数(权重和偏量)设置:

三、cnntrain.m

该函数用于训练CNN。

生成随机序列,每次选取一个batch(50)个样本进行训练。

批训练:计算50个随机样本的梯度,求和之后一次性更新到模型权重中。

在批训练过程中调用:

Cnnff.m 完成前向过程

Cnnbp.m 完成误差传导和梯度计算过程

Cnnapplygrads.m把计算出来的梯度加到原始模型上去

四、cnnff.m

1、取得CNN的输入

2、两次卷积核降采样层处理

3、尾部单层感知机的数据处理,需要把subFeatureMap2连接成为一个(4*4)*12=192的向量,但是由于采用了50样本批训练的方法,subFeatureMap2被拼合成为一个192*50的特征向量fv;

Fv作为单层感知机的输入,全连接的方式得到输出层

五、cnnbp.m

该函数实现2部分功能,计算并传递误差,计算梯度

1、计算误差和LossFunction

2、计算尾部单层感知机的误差

3、把单层感知机的输入层featureVector的误差矩阵,恢复为subFeatureMap2的4*4二维矩阵形式

插播一张图片:

4、误差在特征提取网络【卷积降采样层】的传播

如果本层是卷积层,它的误差是从后一层(降采样层)传过来,误差传播实际上是用降采样的反向过程,也就是降采样层的误差复制为2*2=4份。

卷积层的输入是经过sigmoid处理的,所以,从降采样层扩充来的误差要经过sigmoid 求导处理。

如果本层是降采样层,他的误差是从后一层(卷积层)传过来,误差传播实际是用卷积的反向过程,也就是卷积层的误差,反卷积(卷积核转180度)卷积层的误差,原理参看插图。

5、计算特征抽取层和尾部单层感知机的梯度

五、cnnapplygrads.m

该函数完成权重修改,更新模型的功能

1更新特征抽取层的权重weight+bias

2 更新末尾单层感知机的权重weight+bias

六、cnntest.m

验证测试样本的准确率

11

内蒙古大学计算机学院模式识别小组小强****************。