信息论基础教程第二版第六章课后习题答案

信息论基础各章参考答案

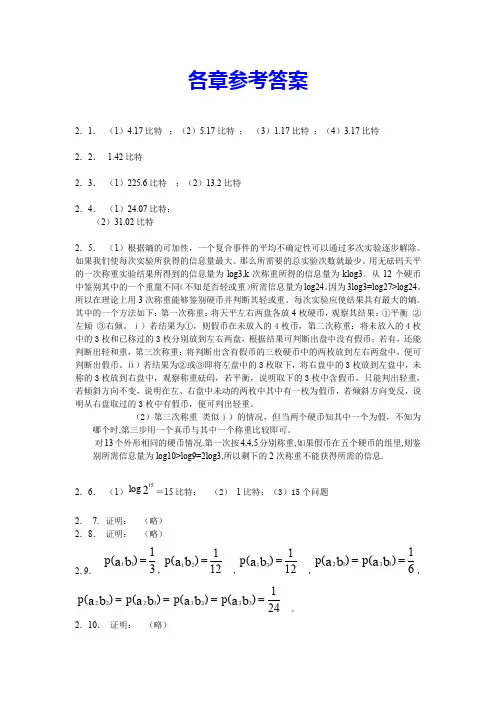

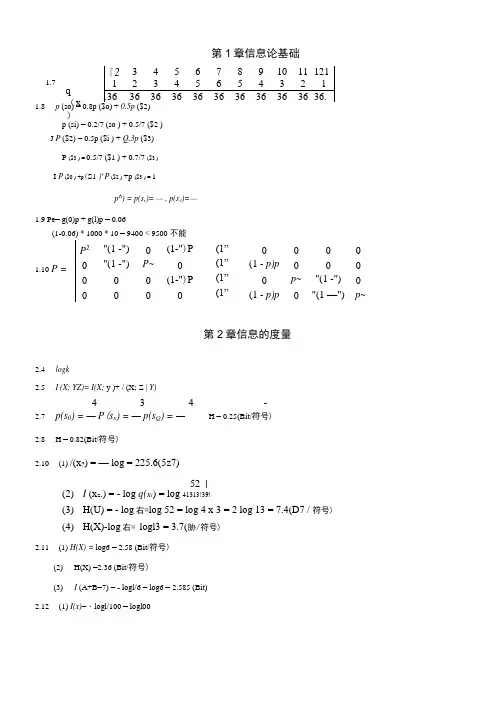

各章参考答案2.1. (1)4.17比特 ;(2)5.17比特 ; (3)1.17比特 ;(4)3.17比特2.2. 1.42比特2.3. (1)225.6比特 ;(2)13.2比特2.4. (1)24.07比特; (2)31.02比特2.5. (1)根据熵的可加性,一个复合事件的平均不确定性可以通过多次实验逐步解除。

如果我们使每次实验所获得的信息量最大。

那么所需要的总实验次数就最少。

用无砝码天平的一次称重实验结果所得到的信息量为log3,k 次称重所得的信息量为klog3。

从12个硬币中鉴别其中的一个重量不同(不知是否轻或重)所需信息量为log24。

因为3log3=log27>log24。

所以在理论上用3次称重能够鉴别硬币并判断其轻或重。

每次实验应使结果具有最大的熵。

其中的一个方法如下:第一次称重:将天平左右两盘各放4枚硬币,观察其结果:①平衡 ②左倾 ③右倾。

ⅰ)若结果为①,则假币在未放入的4枚币,第二次称重:将未放入的4枚中的3枚和已称过的3枚分别放到左右两盘,根据结果可判断出盘中没有假币;若有,还能判断出轻和重,第三次称重:将判断出含有假币的三枚硬币中的两枚放到左右两盘中,便可判断出假币。

ⅱ)若结果为②或③即将左盘中的3枚取下,将右盘中的3枚放到左盘中,未称的3枚放到右盘中,观察称重砝码,若平衡,说明取下的3枚中含假币,只能判出轻重,若倾斜方向不变,说明在左、右盘中未动的两枚中其中有一枚为假币,若倾斜方向变反,说明从右盘取过的3枚中有假币,便可判出轻重。

(2)第三次称重 类似ⅰ)的情况,但当两个硬币知其中一个为假,不知为哪个时,第三步用一个真币与其中一个称重比较即可。

对13个外形相同的硬币情况.第一次按4,4,5分别称重,如果假币在五个硬币的组里,则鉴别所需信息量为log10>log9=2log3,所以剩下的2次称重不能获得所需的信息.2.6. (1)215log =15比特; (2) 1比特;(3)15个问题2. 7. 证明: (略) 2.8. 证明: (略)2.9.31)(11=b a p ,121)(21=b a p ,121)(31=b a p ,61)()(1312==b a b a p p ,241)()()()(33233222====b a b a b a b a p p p p。

信息论基础智慧树知到课后章节答案2023年下潍坊学院

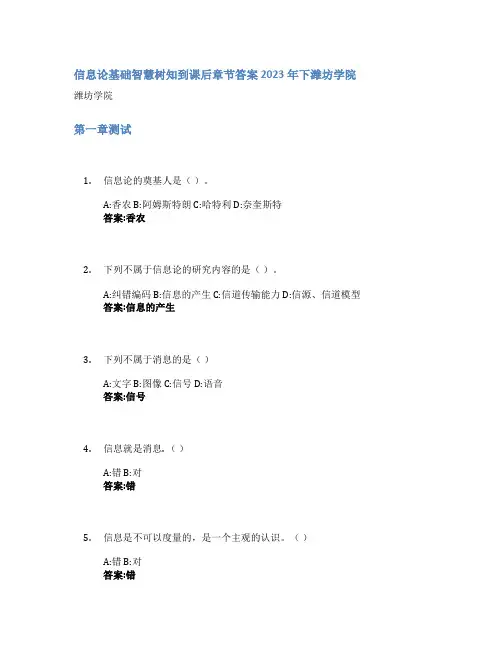

信息论基础智慧树知到课后章节答案2023年下潍坊学院潍坊学院第一章测试1.信息论的奠基人是()。

A:香农 B:阿姆斯特朗 C:哈特利 D:奈奎斯特答案:香农2.下列不属于信息论的研究内容的是()。

A:纠错编码 B:信息的产生 C:信道传输能力 D:信源、信道模型答案:信息的产生3.下列不属于消息的是()A:文字 B:图像 C:信号 D:语音答案:信号4.信息就是消息. ()A:错 B:对答案:错5.信息是不可以度量的,是一个主观的认识。

()A:错 B:对答案:错6.任何已经确定的事物都不含有信息。

()A:对 B:错答案:对7.1948年香农的文章《通信的数学理论》奠定了香农信息理论的基础。

()A:错 B:对答案:对8.信息论研究的目的就是要找到信息传输过程的共同规律,以提高信息传输的(),使信息传输系统达到最优化。

A:有效性 B:认证性 C:可靠性 D:保密性答案:有效性;认证性;可靠性;保密性9.下列属于香农信息论的主要研究理论的是()。

A:压缩理论 B:调制理论 C:保密理论 D:传输理论答案:压缩理论;保密理论;传输理论10.信源编码的作用包含()。

A:检错纠错 B:对信源的输出进行符号变换 C:数据压缩 D:提升信息传输的安全性答案:对信源的输出进行符号变换;数据压缩第二章测试1.信息传输系统模型中,用来提升信息传输的有效性的部分为()A:信源 B:信道编码器、信道译码器 C:信道 D:信源编码器、信源译码器答案:信源编码器、信源译码器2.对于自信息,以下描述正确的是()A:以2为底时,单位是奈特。

B:以2为底时,单位是比特。

C:以10为底时,单位是奈特。

D:以e为底时,单位是比特答案:以2为底时,单位是比特。

3.信息熵的单位是()A:比特 B:比特每符号 C:无法确定答案:比特每符号4.必然事件和不可能事件的自信息量都是0 。

()A:错 B:对答案:错5.概率大的事件自信息量大。

信息论与编码第二版答案第六章曹雪虹

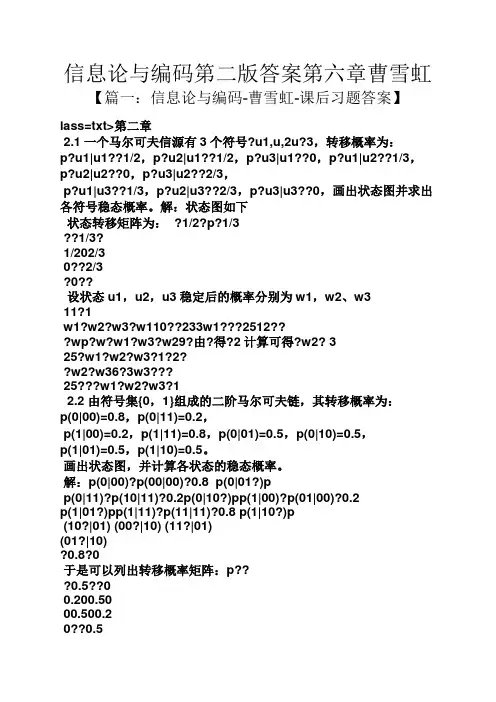

信息论与编码第二版答案第六章曹雪虹【篇一:信息论与编码-曹雪虹-课后习题答案】lass=txt>第二章2.1一个马尔可夫信源有3个符号?u1,u,2u?3,转移概率为:p?u1|u1??1/2,p?u2|u1??1/2,p?u3|u1??0,p?u1|u2??1/3,p?u2|u2??0,p?u3|u2??2/3,p?u1|u3??1/3,p?u2|u3??2/3,p?u3|u3??0,画出状态图并求出各符号稳态概率。

解:状态图如下状态转移矩阵为: ?1/2?p?1/3??1/3?1/202/30??2/3?0??设状态u1,u2,u3稳定后的概率分别为w1,w2、w311?1w1?w2?w3?w110??233w1???2512???wp?w?w1?w3?w29?由?得?2计算可得?w2? 325?w1?w2?w3?1?2??w2?w36?3w3???25???w1?w2?w3?12.2 由符号集{0,1}组成的二阶马尔可夫链,其转移概率为:p(0|00)=0.8,p(0|11)=0.2,p(1|00)=0.2,p(1|11)=0.8,p(0|01)=0.5,p(0|10)=0.5,p(1|01)=0.5,p(1|10)=0.5。

画出状态图,并计算各状态的稳态概率。

解:p(0|00)?p(00|00)?0.8 p(0|01?)pp(0|11)?p(10|11)?0.2p(0|10?)pp(1|00)?p(01|00)?0.2p(1|01?)pp(1|11)?p(11|11)?0.8 p(1|10?)p(10?|01) (00?|10) (11?|01)(01?|10)?0.8?0于是可以列出转移概率矩阵:p???0.5??00.200.5000.500.20??0.5? 0??0.8?状态图为:设各状态00,01,10,11的稳态分布概率为w1,w2,w3,w4 有5?w1??14?0.8w1?0.5w3?w1???w2?10.2w1?0.5w3?w2?wp?w????470.5w2?0.2w4?w3 得计算得到 ???wi?11?0.5w2?0.8w4?w4???w3??i?1??7w1?w2?w3?w4?1???5?w4?14?2.3 同时掷出两个正常的骰子,也就是各面呈现的概率都为1/6,求:(1) “3和5同时出现”这事件的自信息;(2) “两个1同时出现”这事件的自信息;(3) 两个点数的各种组合(无序)对的熵和平均信息量; (4) 两个点数之和(即2, 3, ? , 12构成的子集)的熵; (5) 两个点数中至少有一个是1的自信息量。

信息论基础教材习题答案.docx

第

9.6共有28=256个码字,不能由一个码字的循环产生所有的码字,因为码长为8位,由一个码字循环移位 最多能产生8个码字。

9.7根据伴随式定义:5(x)=j(x) [mod g(x)],由于码多项式都是g(x)的倍式,如果接受矢量y(x)是码多 项式,则它的的伴随式等于0,如果y(Q不是码多项式,则伴随式s(Q不等于0。

0

0

0

0

0

1

1

0

1

0

0

0

0

0

0

0

0

0

0

1

0

1

0

0

1

0

0

0

0

0

0

0

0

0

1

1

0

0

0

0

1

0

0

0

0

0

0

0

0

1

1

1

0

0

0

0

1

0

0

0

0

0

0

1

0

0

1

G =

0

0

0

0

0

1

0

0

0

0

0

1

1

1

0

0

0

0

0

0

0

1

0

0

0

0

1

0

1

1

0

0

0

0

0

0

0

1

0

0

0

1

1

0

0

0

0

0

0

0

0

0

0

信息管理学教程课后习题答案

第一章1、信息管理:是在管理科学的一般原理指导下,对信息活动中的各种要素,包括信息、人员、资金、设备、技术等,进行科学地规划、组织、协调和控制,以充分开发和有效利用信息资源,从而最大限度地满足社会的信息需求。

2、MIS(Management Information System ):管理信息系统。

3、IRM(Information Resource Management ):信息资源管理。

4、SCM(Supply Chain Management ):供应链管理。

5、BPR(Business Process Reengineer):企业过程再工程。

6、ERP(Enterprise Resource Planning):企业资源计划。

7、CRM(Customer Relationship Management):客户关系管理。

1.管理的基本职能包括:、、、、。

2.管理思想的发展过程也就是从科学管理的思想到信息资源管理的思想的演变过程,是管理重心从的管理到管理再到管理的变化过程。

3.EPR实现的手段有两个使能器:一个是,一个是。

第二章1、信息:是事物的状态、特征及其变化的客观反映,是客观事物通过一定的物质载体传递。

2、信息资源:是信息与资源两个概念整合衍生出来的新概念,只有满足一定条件的信息才能称之为信息资源,作为资源的信息,也就是所谓“有用的信息”或“可以利用的信息”。

也就是可以利用的信息的集合。

3、狭义的信息资源:是指信息本身或信息内容,即是经过加工处理的,对决策者有用数据。

4、广义的信息资源:信息资源是信息活动中各种要素的总称(包括信息、技术、设备、资金和人等要素),是将信息资源作为系统概念看待。

5、信息科学:是研究不同领域里有关信息的收集、加工、存储、传递以及使用的学科,也是认识信息和利用信息的科学。

1.在一个具体的组织内部,有信息(高层)、信息(中层)、信息(基层)。

2.从信息管理的角度看,信息按加工深度分为信息(原始信息)、信息(对原始信息加工处理后的信息)、信息(管理决策信息)。

信息论基础第二版习题答案

信息论基础第二版习题答案信息论是一门研究信息传输和处理的学科,它的基础理论是信息论。

信息论的基本概念和原理被广泛应用于通信、数据压缩、密码学等领域。

而《信息论基础》是信息论领域的经典教材之一,它的第二版是对第一版的修订和扩充。

本文将为读者提供《信息论基础第二版》中部分习题的答案,帮助读者更好地理解信息论的基本概念和原理。

第一章:信息论基础1.1 信息的定义和度量习题1:假设有一个事件发生的概率为p,其信息量定义为I(p) = -log(p)。

求当p=0.5时,事件的信息量。

答案:将p=0.5代入公式,得到I(0.5) = -log(0.5) = 1。

习题2:假设有两个互斥事件A和B,其概率分别为p和1-p,求事件A和B 同时发生的信息量。

答案:事件A和B同时发生的概率为p(1-p),根据信息量定义,其信息量为I(p(1-p)) = -log(p(1-p))。

1.2 信息熵和条件熵习题1:假设有一个二进制信源,产生0和1的概率分别为p和1-p,求该信源的信息熵。

答案:根据信息熵的定义,信源的信息熵为H = -plog(p) - (1-p)log(1-p)。

习题2:假设有两个独立的二进制信源A和B,产生0和1的概率分别为p和1-p,求两个信源同时发生时的联合熵。

答案:由于A和B是独立的,所以联合熵等于两个信源的信息熵之和,即H(A,B) = H(A) + H(B) = -plog(p) - (1-p)log(1-p) - plog(p) - (1-p)log(1-p)。

第二章:信道容量2.1 信道的基本概念习题1:假设有一个二进制对称信道,其错误概率为p,求该信道的信道容量。

答案:对于二进制对称信道,其信道容量为C = 1 - H(p),其中H(p)为错误概率为p时的信道容量。

习题2:假设有一个高斯信道,信道的信噪比为S/N,求该信道的信道容量。

答案:对于高斯信道,其信道容量为C = 0.5log(1 + S/N)。

信息论与编码理论基础(第六章)

§6.2 线性分组码

证明 (要证明,第一个码中任一个码字也是第二个码中的码 字;第二个码中任一个码字也是第一个码中的码字) 设在第一个码中,u是信息向量x的码字: u=xG; 则在第二个码中,u是信息向量xM-1的码字: u=xM-1MG= xM-1G’。 设在第二个码中,u是信息向量x的码字: u=xG’; 则在第一个码中,u是信息向量xM的码字: u=xMM-1G’= xMG。 证完。

命题5 命题 设一个D元(N, L)线性分组码的生成矩阵为G。设另一 个D元(N, L)线性分组码的生成矩阵为G’=MG,其中M是L 阶可逆方阵。则两个码的码字集合完全重合,只是信息向 量与码字的对应关系不同。 换句话说,如果把线性分组码的生成矩阵G做可逆行变换变成 另一个生成矩阵,则不改变码字集合,只改变信息向量与 码字的对应关系。

2011-3-23 16

§6.2 线性分组码

线性分组码的特例: 线性分组码的特例:系统码 定义(p178) D元(N, L)线性分组码的生成矩阵为 定义 G=[PL×(N-L), IL], 其中IL是L阶单位阵, PL×(N-L)是(N-L)×L阶矩阵。则称此码 为系统码。此时信息向量(x1, x2, …, xL)的码字是 (u1, u2, …, uN)=(x1, x2, …, xL)G =((x1, x2, …, xL) PL×(N-L), x1, x2, …, xL)。 码字的后L位恰好是信息向量(x1, x2, …, xL),称为码字的信 息位。称码字的前N-L位为码字的一致校验位。

1 1 0 0 1 1 1 0 = 0 +1+ 0 − 0 − 0 − 0 = 1 ≠ 0 0

2011-3-23

6

§6.1 分组码的概念

信息论 基础理论与应用课后答案 全

X

a1 a2

P = 0.070.93

问男同志回答“是”所获昨的信息量为:

I 问男同志回答“否”所获得的信息量为:

比特/符号

I 男同志平均每个回答中含有的信息量为

比特/符号

H(X) = −∑P(x)log P(x) = 0.366 比特/符号

同样,女同志红绿色盲的概率空间为

Y

b1

b2

P = 0.0050.995

A′ ={ai ,i =1,2,...,2q},并且各符号的概率分布满足

Pi′= (1−e)Pi i =1,2,...,q

Pi′= ePi

i = q +1,q + 2,...,2q

试写出信源 S′的信息熵与信源 S 的信息熵的关系。

解:

H(S′) = −∑P(x)log P(x)

∑ ∑ = − (1−e)Pi log(1−e)Pi − ePi logePi ∑ ∑ ∑ ∑ = −(1−e) Pi log(1−e) − (1−e) Pi log Pi −e Pi loge −e Pi log Pi

即函数 f (x) 为减函数,因此有 f (0) ≥ f (e),即

(p1 −e)log(p1 −e) + (p2 + e)log(p2 + e) ≤ p1 log p1 + p2 log p2

因此 H(X) ≤ H(X ′)成立。

【解释】 当信源符号的概率趋向等概率分布时,不确定性增加,即信息熵是增加的。

(1)求质点 A 落入任一格的平均自信息量,即求信息熵,首先得出质点 A 落入任 一格的概率空间为:

= XP

48a11 48a12 48a13 a48148 平均自信息量为

信息论基础各章参考答案.doc

= pQhb) = = pWLh)124各章参考答案2. 1. (1) 4.17 比特;(2) 5.17 比特;(3) 1.17 比特; (4) 3.17 比特 2. 2. 1.42比特2. 3.(1) 225.6 比特;(2) 13.2 比特2. 4. (1) 24.07 比特;(2) 31.02 比特2. 5. (1)根据炳的可加性,一个复合事件的平均不确定性可以通过多次实验逐步解除。

如果我们使每次实验所获得的信息量最大。

那么所需要的总实验次数就最少。

用无秩码天平 的一次称重实验结果所得到的信息量为log3,k 次称重所得的信息量为klog3o 从12个硬币 中鉴别其中的一个重量不同(不知是否轻或重)所需信息量为log24。

冽31og3=log27>log24o 所以在理论上用3次称重能够鉴别硬币并判断其轻或重。

每次实验应使结果具有最大的炳。

其中的一个方法如下:第一次称重:将天平左右两盘各放4枚硬币,观察其结果:①平衡 ② 左倾③右倾。

i )若结果为①,则假币在未放入的4枚币,第二次称重:将未放入的4枚 中的3枚和已称过的3枚分别放到左右两盘,根据结果可判断出肃中没有假币;若有,还能 判断出轻和重,第三次称重:将判断出含有假币的三枚硬币中的两枚放到左右两盘中,便可 判断出假币。

订)若结果为②或③即将左盘中的3枚取下,将右盘中的3枚放到左盘中,未 称的3枚放到右盘中,观察称重缺码,若平衡,说明取下的3枚中含假币,只能判出轻重, 若倾斜方的不变,说明在左、右盘中未动的两枚中其中有一枚为假币,若倾斜方向变反,说 明从右盘取过的3枚中有假币,便可判出轻重。

(2)第三次称重类似i )的情况,但当两个硬币知其中一个为假,不知为哪个时, 第三步用一个真币与其中一个称重比较即可。

对13个外形相同的硬币情况.第一次按4,4,5分别称重,如果假币在一五个硬币的组里,则鉴 别所需信息量为Iogl0>log9=21og3,所以剩下的2次称重不能获得所需的信息.2. 6. (1) log2“=15 比特;(2)1比特;(3) 15个问题2. 7. 证明: (略)2. 8.证明: (略)/ 、 111 、 12.9. P (dibi) = - p(ci\bi )= 12P (cM — — P (sb) < , 12 ,6,2. 10.证明: (略) 2. 11.证明: (略)2.12.证明: (略)2 [3.(1) H(X) = H(Y) = 1, H(Z) = 0.544, H(XZ) = 1.406, H(YZ) = 1.406,H(XKZ) = 1.812(2)H(X/Y) = H(Y/X) = 0.810f H(X/Z) = 0.862, H(Z/X) = H(Z/Y) =0.405 , H(Y/Z) = 0.862, H(X/YZ) = H(Y/XZ) = 0.405, H(Z/XY) =(3)1(X;K) = 0.188 Z(X;Z) = 0.138 Z(K;Z) = 0.138 7(X;Y/Z) =0.457 , I(Y;Z/X) = I(X;Z/Y) = 0.406(单位均为比特/符号)p 游(000) = 1)= Pg(l°l)=服z(l 1°)= 714. X 1 Z ■,(2)P加(°°°)=P宓(111)= !(3)P加(°°°)= 〃加(°。

信息论与编码理论基础(第六章)

信道编码主要分为:检验码、纠错码。

检验码只检查信息在传输过程中是否有差错, 而纠错码不但检查是否有差错,而且还可以 将错误的信息纠正。

3

2013-7-15

为什么要引入线性码

信道编码研究的主要问题是:发现或构造实际 上可实现的好码(纠错能力和传信率都比较理 想的码)。

注3:有限域GF(D)与实数域的区别是:传统的“逼 近”、“极限”的概念消失了。

2013-7-15 13

预备知识 -- Galois域

例:GF(2)上的方阵 1 0 1 是否可逆?

1 0 1 1 0 0

回答是肯定的。两种不同的判别方法都能够证明它是可逆的 : (1)它经过可逆行变换能够变成单位阵; (2)它的行列式不等于0。(等于1!)

信道编码的引入

信息传输系统的基本功能是:在系统输 出端及时、准确地再现系统输入端发送 的信息。

我们希望信息传输多快好省,但现实与 我们的良好愿望之间总是存在差距。

首先,信息传输的速度受信道容量的限制, 不可能无限大; 其次,由于信道噪声的干扰,传输错误不可 避免。

1

2013-7-15

信道编码的引入

编码方案太多,以至全局搜索好码是不可能的,现 实的做法是对编码方案加以一定的约束,在一个子集中 寻找局部最优,这种约束既要能包含尽可能好的码,又 要便于分析,便于译码,目前对线性系统的研究远比非 线性系统充分

2013-7-15 4

线性分组码定义

n长向量 k长信息分组 。。。。。 n长码字 。。。。。

香农的信道编码定理指出:只要信息传输速 率低于信道容量,通过对信息进行适当的编 码,可以在不牺牲信息传输或存储速率的情 况下,将有噪信道或存储媒质引入的差错降 到任意低的程度。 这就是说,可以通过编码使通信过程实际上 不发生错误,或者使错误控制在允许的数值 之下。