第二章:双变量线性回归分析

第二章 双变量模型

概念: 概念:

在给定解释变量Xi条件下被解释变量Yi的期 望轨迹称为总体回归线 总体回归线(population 总体回归线 regression line),或更一般地称为总体回 总体回 归曲线(population regression curve)。 归曲线 相应的函数: E (Y | X i ) = f ( X i ) 称为(双变量)总体回归函数(population 总体回归函数( 总体回归函数 regression function, PRF)。 )

变量间的关系

经济变量之间的关系,大体可分为两类: (1)确定性关系 函数关系:研究的是确定 确定性关系或函数关系 确定性关系 函数关系: 现象非随机变量间的关系。

相关关系: (2)统计依赖 相关关系: 研究的是非确定现 )统计依赖或相关关系 象随机变量间的关系。

回归与相关

相关分析的主要目的在于研究变量之间统计 线性关联的程度,将变量均视为随机变量。 回归分析的主要目的在于研究变量之间统计 关联的形式,目的在于揭示被解释变量如何依赖 解释变量的变化而变化的规律,将解释变量视为 确定性的,而将被解释变量视为随机变量。

二、回归分析的基本概念

回归分析(regression analysis)是研究一个变量关 回归分析 是研究一个变量关 于另一个( 于另一个(些)变量的具体依赖关系的计算方法 和理论。 和理论 其用意:在于通过后者的已知或设定值, 其用意:在于通过后者的已知或设定值,去估计和 预测前者的(总体)均值。 (或)预测前者的(总体)均值 这里:前一个变量被称为被解释变量(Explained 被解释变量( 被解释变量 Variable)或应变量(Dependent Variable), 应变量( ) 应变量 ), 后一个(些)变量被称为解释变量 解释变量 (Explanatory Variable)或自变量 ) 自变量 (Independent Variable)。 )

双变量线性回归分析结果的报告以及案例

数据清洗

处理缺失值、异常值和重复数据,确保数据质 量。

数据探索

初步分析数据,了解变量之间的关系和分布情况。

模型建立

确定变量

选择与响应变量相关的预测变量,并考虑变量的 多重共线性。

建立模型

使用最小二乘法或其他优化算法拟合线性回归模 型。

模型诊断

检查模型的残差图、散点图等,确保模型满足线 性回归的前提假设。

卧室数量与房价之间存 在正相关关系,但影响 较小。

地理位置对房价有显著 影响,靠近市中心的房 屋价格更高。

周边设施对房价有积极 影响,特别是学校和公 园等设施。

05 双变量线性回归分析的未 来研究方向

深度学习与线性回归的结合

01

深度学习技术可以用于特征提 取,将原始数据转化为更高级 别的特征表示,然后利用线性 回归模型进行预测。

双变量线性回归分析结果的报告以 及案例

目录

• 双变量线性回归分析概述 • 线性回归分析的步骤 • 双变量线性回归分析的案例 • 线性回归分析的局限性 • 双变量线性回归分析的未来研究方向

01 双变量线性回归分析概述

定义与原理

双变量线性回归分析是一种统计学方法,用于研究两个变量之间的线性关系。通 过最小二乘法等数学手段,找到一条最佳拟合直线,使得因变量能够根据自变量 进行预测。

线性回归分析假设因变量和自变 量之间存在线性关系,但在实际 应用中,非线性关系可能更为常 见。

独立性假设

自变量之间应相互独立,但在实 际数据中,自变量之间可能存在 多重共线性,影响回归结果的准 确性。

无异常值和缺失值

假设

数据集中不应含有异常值和缺失 值,否则会影响回归模型的稳定 性和准确性。

模型泛化能力

计量经济学第二章经典线性回归模型

Yt = α + βXt + ut 中 α 和 β 的估计值 和

,

使得拟合的直线为“最佳”。

直观上看,也就是要求在X和Y的散点图上

Y

* * Yˆ ˆ ˆX

Yt

* **

Yˆt

et * *

*

*

**

*

**

**

*

Xt

X

图 2.2

残差

拟合的直线 Yˆ ˆ ˆX 称为拟合的回归线.

对于任何数据点 (Xt, Yt), 此直线将Yt 的总值 分成两部分。

β

K

βK

β1 β1

...

βK

βK

Var(β 0 )

Cov(β1 ,β

0

)

Cov(β 0 ,β1 )

Var(β1 )

...

Cov(β

0

,β

K

)

...

Cov(β1

,β

K

)

...

...

...

...

Cov(β

K

,β

0

)

Cov(β K ,β1 )

...

Var(β K )

不难看出,这是 β 的方差-协方差矩阵,它是一 个(K+1)×(K+1)矩阵,其主对角线上元素为各 系数估计量的方差,非主对角线上元素为各系 数估计量的协方差。

ut ~ N (0, 2 ) ,t=1,2,…n

二、最小二乘估计

1. 最小二乘原理

为了便于理解最小二乘法的原理,我们用双

变量线性回归模型作出说明。

对于双变量线性回归模型Y = α+βX + u, 我 们

的任务是,在给定X和Y的一组观测值 (X1 ,

资料的统计分析——双变量及多变量分析

资料的统计分析——双变量及多变量分析双变量及多变量分析是指在统计分析中,同时考察两个或多个变量之间的关系。

通过对多个变量进行综合分析,可以更全面地了解变量之间的相互作用和影响。

双变量分析是指考察两个变量之间的关系,常用的方法包括相关分析和回归分析。

相关分析是用来评价两个变量之间的线性关系的强度和方向。

常用的相关系数有皮尔逊相关系数和斯皮尔曼相关系数。

皮尔逊相关系数适用于两个变量都为连续型变量的情况,而斯皮尔曼相关系数适用于至少一个变量为有序分类变量或者两个变量都为有序分类变量的情况。

回归分析是用来探究一个变量(因变量)与一个或多个变量(自变量)之间的关系的强度和方向。

常用的回归分析方法有简单线性回归分析和多元线性回归分析。

简单线性回归分析是用来研究一个自变量与一个因变量之间的线性关系的情况,而多元线性回归分析则可以同时研究多个自变量与一个因变量之间的关系。

在进行双变量分析之前,需要先进行数据的描述性分析。

描述性分析是对数据的基本特征进行总结和描述,包括样本数量、均值、方差、最小值、最大值等。

多变量分析是指同时考虑多个变量之间的关系。

常用的方法包括多元方差分析、聚类分析和因子分析。

多元方差分析是用来比较多个因素对于一个或多个因变量的影响的强度和方向。

聚类分析是用来将样本按照其中一种相似度划分为不同的群组,从而研究变量之间的内部关系。

因子分析是用来探究多个变量之间的潜在结构,从而找出变量之间的共性和差异。

除了以上方法,还可以采用交叉表分析、卡方检验和回归分析等方法来研究多个变量之间的关系。

在进行双变量及多变量分析时,需要注意以下几个问题:首先,需要选择合适的统计方法,根据变量的类型和变量之间的关系特点来选择合适的分析方法。

其次,需要注意变量之间的相关性,避免多重共线性的问题。

此外,还需要注意样本的选择和样本量的大小,以及结果的解释和推断的注意事项。

总之,双变量及多变量分析是一种重要的统计方法,可以帮助我们更全面地了解变量之间的相互作用和影响。

双变量问题处理技巧

双变量问题处理技巧双变量问题处理技巧双变量问题是指涉及两个变量之间的关系或相互影响的问题。

在许多领域中,如统计学、经济学和社会科学等,研究人员经常遇到需要处理双变量问题的情况。

下面将介绍一些处理双变量问题的技巧。

1. 散点图分析:散点图是一种常用的数据可视化方法,可以用来展示两个变量之间的关系。

通过绘制散点图,可以观察到变量之间的相关性,包括线性关系、非线性关系或者无关系。

根据散点图的形状和趋势,可以判断变量之间的关系类型,并进一步分析相关性的强度。

2. 相关性分析:相关性分析用于度量两个变量之间的相关性程度。

常用的相关性系数包括皮尔逊相关系数和斯皮尔曼相关系数。

皮尔逊相关系数适用于线性关系的变量,而斯皮尔曼相关系数适用于非线性关系的变量。

相关性分析可以帮助我们了解两个变量之间的关系强度和方向。

3. 线性回归分析:线性回归分析是一种用于建立两个变量之间线性关系的模型。

通过拟合数据点到一条直线或曲线上,可以建立一个数学模型来预测或解释一个变量对另一个变量的影响。

线性回归分析可以帮助我们确定两个变量之间的因果关系,并进行预测和解释。

4. 多元回归分析:多元回归分析是一种用于处理多个自变量和一个因变量之间关系的方法。

当我们需要控制其他变量的影响,以及确定多个自变量对因变量的独立贡献时,可以使用多元回归分析。

通过多元回归分析,我们可以建立一个多变量的模型,更全面地理解变量之间的关系。

5. 因果推断:在处理双变量问题时,我们常常需要确定两个变量之间的因果关系。

因果推断是一种从相关性到因果关系的推断方法,可以帮助我们确定一个变量对另一个变量的影响。

在进行因果推断时,需要注意排除混淆变量的干扰,并使用实验证据或因果分析方法来支持因果关系的存在。

总之,处理双变量问题需要运用适当的技巧和方法来分析和解释两个变量之间的关系。

通过散点图分析、相关性分析、线性回归分析、多元回归分析和因果推断等方法,我们可以更好地理解和解释双变量问题,并得出有意义的结论。

第2章 双变量回归模型(2)

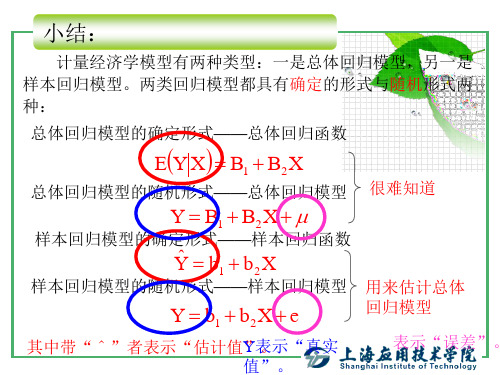

计量经济学模型有两种类型:一是总体回归模型,另一是 样本回归模型。两类回归模型都具有确定的形式与随机形式两 种: 总体回归模型的确定形式——总体回归函数

EY X B1 B2 X

总体回归模型的随机形式——总体回归模型

很难知道

Y B1 B2 X

样本回归模型的确定形式——样本回归函数

因此,由该样本估计的回归方程为:

ˆ Yi 103.172 0.777X i

即可支配收入每上升一个百分点,则消费支出上升0.777个百 分点;截距-103.172表明没有收入是负支出,这里没有经济意义。 另一样本结果

ˆ Yi 99.978 0.757 X i

综合图示

不同可支配收入水平组家庭消费支出的条件分布图

1、用OLS法得出的样本回归线经过样本均值点,即

Y b1 b2 X

2、残差的均值总为0,即

e e

n

i

0

3、对残差与解释变量的积求和,其值为0,即

e X

i

i

0

三、用EXCEL和Eviews实现最小二乘法

以“美国高年级学生平均智能测试结果”建立词汇分数 与数学分数的关系,用数学分数(X) 来预测词汇分数(Y) 。

3500 每 月 消 费 支 出 (元) 3000 2500 2000 1500 1000 500 0 0 500 1000 1500 2000 2500 3000 3500 4000 每月可支配收入(元) 每月家庭消费支出Y 条件均值Y* 样本1 预测 样本 样本2 预测 样本2

问题:如何检验?

二、普通最小二乘估计量的一些重要性质

一、参数的普通最小二乘估计(OLS)

建立双变量总体回归模型PRF

ch02 线性回归的基本思想:双变量模型

2.2 总体回归函数(PRF)

一个假设的例子

2.2 总体回归函数(PRF)

条件均值( 条件期望值)

总体回归线

2.2 总体回归函数(PRF)

一个假设的例子

若将总体回归线用线性近似,用如下函数形式表示: (2-1) 式(2-1)中,E(Y|Xi)表示给定X值相应的(或条件的) Y的均值;下

(1)用OLS法得出的样本回归线经过样本均值点,即:

(2)残差的均值

e ( e / n)总为0。

i

Yi b1 b2 X

(2.18)

(3)对残差与解释变量的积求和,其值为零,即这两个变量不相关。

e X

i

i

0

(2.19)

这条性质也可用来检查最小二乘法计算结果。

ˆ (4)对残差与 Yi (估计的 Yi)的积求和,其值为0;即:

2.5 样本回归函数(SRF)

2.5 样本回归函数(SRF)

样本回归函数(SRF)

“拟合” 样本数据的直线,称之为样本回归线。 用样本回归函数来表示样本回归线: (2-3)

式(2-3)中, 表示总体条件均值【E(Y|Xi】的估计量;b1和b2

分别为B1和B2的估计量。

注:估计量或样本统计量是总体参数的估计公式 ;

安徽财经大学

统计与应用数学学院 统计学系

计量经济学

(Econometrics)

石绍炳

1

目录

第1章 计量经济学的特征及研究范围 第2章 线性回归的基本思想:双变量模型 第3章 双变量模型:假设检验 第4章 多元回归:估计与假设检验 第5章 回归模型的函数形式 第6章 虚拟变量回归模型 第7章 模型选择:标准与检验 第8章 多重共线性:解释变量相关会有什么后果 第9章 异方差:误差非常数会有什么后果 第10章 自相关:误差项相关会有什么后果 第11章 联立方程模型

双变量回归模型分析案例及模型形式的探讨

双变量回归模型分析案例及模型形式的探讨首先,我们来讨论一个实际案例,即研究收入和教育水平之间的关系。

假设我们收集了一组数据,包括每位受访者的收入和教育水平。

我们想要探究这两个变量之间的关系,即教育水平对收入的影响。

这时候,我们可以使用双变量回归模型进行分析。

在进行回归分析之前,我们首先需要确定要使用的模型形式。

常见的双变量回归模型包括线性回归模型、非线性回归模型和多项式回归模型等。

在这个案例中,我们可以使用线性回归模型来建立收入和教育水平之间的关系。

假设教育水平为自变量X,收入为因变量Y,那么线性回归模型可以写为:Y=β0+β1*X+ε其中,Y表示因变量(收入),X表示自变量(教育水平),β0表示截距项,β1表示自变量的系数,ε表示误差项。

在进行实际分析时,我们需要采集一定数量的数据,并使用统计软件进行回归分析。

通过拟合数据,我们可以得到回归方程的系数估计值,并根据显著性检验来判断自变量的影响是否具有统计学意义。

在本案例中,我们可以通过拟合数据得到回归方程的系数估计值,比如β0=3000,β1=1000。

这个结果可以被解释为,每增加一个教育水平单位,平均收入会增加1000元。

同时,我们还可以通过t检验或F检验来评估系数的显著性。

除了线性回归模型外,我们还可以使用非线性回归模型或多项式回归模型来分析双变量关系。

非线性回归模型可以用于探究非线性关系,例如指数关系或对数关系。

多项式回归模型可以用于探究曲线关系,例如二次曲线关系或三次曲线关系。

总之,双变量回归模型是一种常见的统计分析方法,在实际研究中具有广泛应用。

通过建立适当的模型形式,我们可以研究两个变量之间的关系,并通过回归分析得到相关参数的估计值。

这些参数可以帮助我们了解变量之间的关系,并为实际问题的解决提供参考依据。

线性回归分析——双变量模型

线性回归分析——双变量模型在进行线性回归分析之前,我们首先需要明确我们要解决的问题,确定自变量和因变量。

比如,我们可以研究体重和身高之间的关系,其中体重是因变量,身高是自变量。

收集到数据后,我们可以进行描述性统计分析来对数据进行初步的了解。

我们可以计算出体重和身高的平均值、方差、最大值和最小值等统计指标。

此外,我们还可以绘制散点图来观察变量之间的关系。

在进行线性回归分析之前,我们需要满足一些假设条件。

首先,我们假设自变量和因变量之间存在线性关系。

其次,我们假设观测误差服从正态分布。

最后,我们假设观测误差的方差是常数。

接下来,我们可以通过最小二乘法来估计线性回归模型的参数。

最小二乘法的目标是最小化观测值与预测值之间的残差的平方和。

我们可以使用统计软件或者编程语言来进行计算。

线性回归模型可以表示为:Y=β0+β1X+ε其中,Y表示因变量,X表示自变量,β0表示截距,β1表示斜率,ε表示观测误差。

在进行参数估计后,我们可以对模型进行拟合优度的评估。

拟合优度指标可以帮助我们判断模型的拟合程度。

常见的拟合优度指标有R方值、调整R方值和残差分析。

R方值表示因变量的变异程度可以由自变量解释的比例。

R方值的取值范围是0到1,越接近1表示模型的拟合效果越好。

调整R方值是在R方值的基础上考虑模型中自变量的个数进行修正。

残差分析可以用来评估模型中未解释的部分。

在进行结果解释时,我们需要注意解释截距和斜率的意义。

截距表示当自变量为0时,因变量的值。

斜率表示自变量的单位变化对因变量的影响。

最后,我们还可以对模型的统计显著性进行检验。

常见的方法有t检验和F检验。

t检验可以用来判断截距和斜率的显著性,F检验可以用来判断模型整体的显著性。

总结:线性回归分析是一种常用的数据分析方法,可以用于研究两个变量之间的线性关系。

通过收集数据,建立模型,估计参数和进行拟合优度评估,我们可以获得对变量之间关系的深入认识。

同时,我们还可以通过检验模型的显著性来判断模型的可靠性。

经典线性回归模型

就变量而言是线性的

—— Y 的条件均值是 X 的线性函数 就参数而言是线性的 —— Y 的条件均值是参数 的线性函数

“线性”的判断

E(Yi X i ) 1 2 X i

E(Yi X i ) 1 2 X i 性” E(Yi X i ) 1 2 X i

2

变量、参数均为“线性” 参数“线性”,变量”非线

每 月 家 庭 消 费 支 出 Y

1489 1538

1600 1702

1712 1778

1841 1886

2078 2179

2298 2316

2289 2313

2398 2423

2487 2513

2538 2567

2853 2934

3110

3142 3274

1900

2012

2387

2498 2589

(单位:元)

每 月 家 庭 可 支 配 收 入 X

4000 2037 2110 2225 2319 2321 2365 2398 4500 2275 2388 2426 2488 2587 2650 2789 5000 2464 2589 2790 2856 2900 3021 3064 5500 2824 3038 3150 3201 3288 3399

2453

2487 2586 2150

2610

2710

E(Y X i )

900

1150

1400

1650

1900

2400

2650

2900

3150

例:100个家庭构成的总体

1000 820 888 932 960 1500 962 1024 1121 1210 1259 1324 2000 1108 1201 1264 1310 1340 1400 1448 2500 1329 1365 1410 1432 1520 1615 1650 3000 1632 1726 1786 1835 1885 1943 2037 3500 1842 1874 1906 1068 2066 2185 2210

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

[计量经济学] 第二章:双变量线性回归分析§1 经典正态线性回归模型(CNLRM)一、一些基本概念1、一个例子条件分布:以X取定值为条件的Y的条件分布条件概率:给定X的Y的概率,记为P(Y|X)。

例如,P(Y=55|X=80)=1/5;P(Y=150|X=260)=1/7。

条件期望(conditional Expectation):给定X的Y的期望值,记为E(Y|X)。

例如,E(Y|X=80)=55×1/5+60×1/5+65×1/5+70×1/5+75×1/5=65总体回归曲线(Popular Regression Curve)(总体回归曲线的几何意义):当解释变量给定值时因变量的条件期望值的轨迹。

2、总体回归函数(PRF)E(Y|X i)=f(X i)当PRF的函数形式为线性函数,则有,E(Y|X i)=β1+β2X i其中β1和β2为未知而固定的参数,称为回归系数。

β1和β2也分别称为截距和斜率系数。

上述方程也称为线性总体回归函数。

3、PRF的随机设定将个别的Y I围绕其期望值的离差(Deviation)表述如下:u i=Y i-E(Y|X i)或Y i=E(Y|X i)+u i其中u i是一个不可观测的可正可负的随机变量,称为随机扰动项或随机误差项。

4、“线性”的含义“线性”可作两种解释:对变量为线性,对参数为线性。

本课“线性”回归一词总是指对参数β为线性的一种回归(即参数只以它的1次方出现)。

模型对参数为线性?模型对变量为线性?是不是是LRM LRM不是NLRM NLRM注:LRM=线性回归模型;NLRM=非线性回归模型。

5、随机干扰项的意义随机扰动项是从模型中省略下来的而又集体地影响着Y 的全部变量的替代物。

显然的问题是:为什么不把这些变量明显地引进到模型中来?换句话说,为什么不构造一个含有尽可能多个变量的复回归模型呢?理由是多方面的: (1)理论的含糊性 (2)数据的欠缺(3)核心变量与周边变量 (4)内在随机性 (5)替代变量 (6)省略原则(7)错误的函数形式6、样本回归函数(SRF ) (1)样本回归函数iY ˆ=1ˆβ+2ˆβi X 其中Y ˆ=E(Y|X i )的估计量;1ˆβ=1β的估计量;2ˆβ=2β的估计量。

估计量(Estimator ):一个估计量又称统计量,是指一个规则、公式或方法,是用已知的样本所提供的信息去估计总体参数。

在应用中,由估计量算出的数值称为估计值。

样本回归函数的随机形式为:其中i u ˆ表示(样本)残差项(residual )。

(2)样本回归线的几何意义二、经典线性回归模型(CLRM )的基本假定: 假定1:干扰项的均值为零。

即,E(u i |X i )=0假定2:同方差性或u i 的方差相等。

即,Var(u i |X i )=σ2假定3:各个干扰项无自相关。

即,Cov(u i ,u j |X i ,X j )=0 假定4:u i 和X i 的协方差为零。

即,Cov(u i ,X i )=E(u i X i )=0 假定5:在重复抽样中X 的值是固定的(非随机)§2 估计问题(β和σ2) 一、普通最小二乘法 1、问题:PRF :Y i =β1+β2X i +u iSRF :i Y =1ˆβ+2ˆβi X +i u ˆ=i Y ˆ+i u ˆ i u ˆ=i Y -iY ˆ=i Y -(1ˆβ+2ˆβi X ) minf(1ˆβ,2ˆβ)=min ∑i u ˆ2=min ∑[i Y -(1ˆβ+2ˆβiX )]22、正规方程(Normal equation ) 由1ˆβ∂∂f=0,以及2ˆβ∂∂f =0得到的方程组称为正规方程。

即,二、β的估计 1、公式:解上述正规方程组得到1ˆβ和2ˆβ估计值:其中X 和Y 是X 和Y 的样本均值。

定义离差:i x =i X -X ,i y =i Y -Y 。

用小写字母表示对均值的离差。

2、对OLS 估计量的说明(1)OLS 估计量可由观测值计算; (2) OLS 估计量是点估计量;(3)一旦从样本数据得到OLS 估计值,就可画出样本回归线。

3、样本回归线的性质:(1)通过Y 和X 的样本均值:Y =1ˆβ+2ˆβX ; (2)估计的Y 的均值等于实际的Y 的均值:Y ˆ=Y ; (3)残差i uˆ的均值为零:E(i u ˆ)=0; (4)残差i u ˆ与iY ˆ不相关:∑i u ˆi y ˆ=0;(5)残差i uˆ与i X 不相关:∑i u ˆi x =0。

三、σ2的估计五、OLS 的性质(高斯-马尔可夫定理)OLS 估计量1ˆβ和2ˆβ是BLUE (Best Linear Unbiased Estimator )的。

(1)线性:它是一个随机变量,如因变量Y 的线性函数。

(2)无偏:它的均值等于真值,E(2ˆβ)=β2 (3)最小方差:在所有线性无偏估计量中OLS 下的估计量有最小方差。

注:有最小方差的无偏估计量叫有效估计量。

§3 拟合优度检验拟合优度检验是指样本回归线与样本观测值之间拟合程度的检验。

度量拟合程度的指标是判定系数R 2。

一、平方和公式总平方和(TSS ):∑-=∑22)(Y Y y i i =实测的Y 值围绕其均值的总变异;解释平方和(ESS ):∑-=∑22)ˆˆ(ˆY Y y ii =估计的Y 值围绕其均值的总变异;残差平方和(RSS ):∑-=∑22)ˆ(ˆii i Y Y u =未被解释的围绕回归线的Y 值的变异。

二、R 2公式性质:102≤≤R ;三、R 2与相关系数r 不同在回归分析中,R 2是一个比r 更有意义的度量,因为前者告诉我们在因变量的变异中由解释变量解释的部分占怎样一个比例,因而对一个变量的变异在多大程度上决定另一个变量的变异,提供了一个总的度量。

§4 置信区间本节要解决的问题: OLS 估计值2ˆβ是一个点估计值,它离真实值2β有多近? 一、区间估计的一些基本概念为了回答上述问题,我们试求两个正数δ和α,α位于0与1之间,使得随机区间(2ˆβ-δ,2ˆβ+δ)包含2β的概率为1-α。

用符号表示,Pr(2ˆβ-δ≤2β≤2ˆβ+δ)=1-α 这样的一个区间如果存在的话,就称为置信区间(Confidence interval );1-α称为置信系数(Confidence coefficient );α(0<α<1)称为显著(性)水平(Level of significance ); 置信区间的端点称为置信限(Confidence limits );2ˆβ-δ为置信下限(Lower Confidence limit );2ˆβ+δ为置信上限(Upper Confidence limit )。

二、回归系数β1和β2的置信区间在u i 的正态性假定下,OLS 估计量1ˆβ和2ˆβ本身就是正态分布的, ),0(~2σN u i ⇒),(ˆ2222∑i x N σββ~⇒)1,0(~/ˆ2222N x Z i∑-=σββ 但是2σ很少能知道,在实践中用无偏估计量2ˆσ来代替,则统计量t 服从自由度为n-2的t 分布:)2(~/ˆˆ)ˆ(ˆ2222222-∑-=-=n t x se t i σβββββ其中∑=222/ˆ)ˆ(i x se σβ表示估计量2ˆβ的标准差(∑22/ix σ)的估计值。

由ααα-=≤≤-1)Pr(22t t t 得:同样,β1显著水平为α的置信区间为:)](),([121121ββββααse t se t +- 三、σ2的置信区间在正态性的假设下,变量222ˆ)2(σσχ-=n服从自由度为n-2的2χ分布。

故可以用其来建立σ2的置信区间。

由αχχχαα-=≤≤-1)Pr(22/222/1得,§5假设检验(t )问题:某一给定的观测或发现是否与某一声称的假设(stated hypothesis )相符?此处用“相符”一词表示观测的值与假设的值“足够相近”,因而我们不拒绝所声称的假设。

虚拟假设(Null hypothesis ):一种信以为真的、意在维护的或理论上的假设,并用H 0表示。

与之对立的假设称为对立假设(alternative hypothesis ),记为H 1。

对立假设可以是简单的或复合的。

例如,H 1:β2=1是一个简单假设,但是H 1:β2≠1则是一个复合假设。

方法:有显著性检验和置信区间两种方法。

一、显著性检验1、t 检验(检验系数)方法: H 0:*22ββ=;H 1:*22ββ≠如果H 0为真,则因为)2(~/ˆˆ)ˆ(ˆ2222222-∑-=-=n t x se t i σβββββ 所以有,ασββαα-=≤∑-≤-1)/ˆˆPr(222*222t x t i从而,)]ˆ(),ˆ([ˆ22*222*22βββββααse t se t +-∈ 检验2ˆβ的估计值是否在此区间,如果在则接受H 0假设,否则拒绝H 0假设。

2、置信区间方法H 0:*22ββ=;H 1:*22ββ≠构造一个β2的显著水平为α的置信区间为:)]ˆ(ˆ),ˆ(ˆ[222222ββββααse t se t +-。

若β2在假设H 0:*22ββ=之下落入此区间,就不要拒绝H 0假设,但落在区间之外,就拒绝H 0假设。

3、t 检验方法的直接计算: H 0:*22ββ=;H 1:*22ββ≠。

计算 ∑-=-=2222222/ˆˆ)ˆ(ˆi x se t σβββββ比较|t |与2αt :|t |>2αt (t 值大)⇔“统计量的值落入临界域上⇔统计量是统计上显著的 ⇔拒绝H 0假设⇔Pr(t)<α(P 值小)。

二、σ2检验的显著性(χ2检验) H 0:22*σσ=;H 1:22*σσ≠。

构造σ2显著水平为α的置信区间:]ˆ)2(,ˆ)2[(22/1222/2ααχσχσ---n n检验σ2的检验值2*σ是否在此区间内,在则接受,不在就拒绝。

三、假设检验中的两类错误 第一类错误:拒绝真实; 第二类错误:接受错误。

两类错误之间存在一种替代关系(Trade-off)。

§6 F 检验(总显著水平))2,1(~ˆˆ2/ˆˆ)(/)(/ 222222-∑=∑-∑===n F x n u x RSS df RSS ESS df ESS RSS of MSS ESS of MSS F ii i σββ 算出F 的估计值,与F 分布表在选定显著水平上读出的F 临界值相比较;或查找F 统计量的估计值的P 值。

§7 预测样本回归函数的一个用途是“预测”或“预报”对应于给定X 的未来的Y 值。