回归分析操作方法

回归分析的基本步骤

回归分析的基本步骤回归分析是一种用来探究变量之间关系的统计方法。

通过回归分析,可以确定自变量对因变量的影响程度,并用回归方程来预测因变量的值。

本文将介绍回归分析的基本步骤,包括数据收集与准备、回归模型的选择、模型拟合以及模型评估等。

数据收集与准备在进行回归分析之前,首先需要收集与问题相关的数据。

这些数据可以通过实验、观测或问卷调查等方式获得。

在数据收集过程中需要注意保证数据的准确性和完整性,以及避免数据的缺失。

收集到数据后,还需要进行数据的预处理。

这包括数据的清洗和转换。

数据清洗主要是去除异常值和错误数据。

数据转换可以包括对变量进行标准化、对非线性关系进行变量转换等操作,以使数据符合回归分析的假设。

回归模型的选择在回归分析中,需要选择适当的回归模型来描述自变量和因变量之间的关系。

常见的回归模型包括线性回归模型、多项式回归模型、指数回归模型等等。

在选择回归模型时,需要考虑以下几点:1.因变量和自变量之间的关系类型:线性还是非线性关系;2.自变量之间是否存在多重共线性:即自变量之间是否存在相关性;3.应用领域的特点:不同领域对变量之间关系的要求不同。

模型拟合选择好回归模型后,需要对模型进行拟合。

拟合模型的目标是通过最小化残差平方和来找到最优的回归系数。

常用的拟合方法有最小二乘法和最大似然法。

最小二乘法是通过最小化实际观测值与回归模型预测值之间的差异来确定回归系数。

最大似然法是基于观测数据的概率分布来估计模型参数。

两种方法都可以得到相似的结果,选择哪种方法取决于实际问题和数据的性质。

模型评估在模型拟合完成后,需要对模型进行评估。

评估模型的好坏可以通过各种统计指标来衡量,如决定系数(R-squared)、均方差(MSE)等。

决定系数是指模型能够解释因变量变异性的比例,其取值范围为0到1。

值越接近1,说明模型对数据的拟合程度越好。

均方差是指观测值与模型预测值之间的平均偏差。

均方差越小,说明模型的预测精度越高。

你应该要掌握的7种回归分析方法

你应该要掌握的7种回归分析⽅法你应该要掌握的7种回归分析⽅法标签:机器学习回归分析2015-08-24 11:29 4749⼈阅读评论(0) 收藏举报分类:机器学习(5)⽬录(?)[+]转载:原⽂链接:7 Types of Regression Techniques you should know!(译者/刘帝伟审校/刘翔宇、朱正贵责编/周建丁)什么是回归分析?回归分析是⼀种预测性的建模技术,它研究的是因变量(⽬标)和⾃变量(预测器)之间的关系。

这种技术通常⽤于预测分析,时间序列模型以及发现变量之间的因果关系。

例如,司机的鲁莽驾驶与道路交通事故数量之间的关系,最好的研究⽅法就是回归。

回归分析是建模和分析数据的重要⼯具。

在这⾥,我们使⽤曲线/线来拟合这些数据点,在这种⽅式下,从曲线或线到数据点的距离差异最⼩。

我会在接下来的部分详细解释这⼀点。

我们为什么使⽤回归分析?如上所述,回归分析估计了两个或多个变量之间的关系。

下⾯,让我们举⼀个简单的例⼦来理解它:⽐如说,在当前的经济条件下,你要估计⼀家公司的销售额增长情况。

现在,你有公司最新的数据,这些数据显⽰出销售额增长⼤约是经济增长的2.5倍。

那么使⽤回归分析,我们就可以根据当前和过去的信息来预测未来公司的销售情况。

使⽤回归分析的好处良多。

具体如下:1.它表明⾃变量和因变量之间的显著关系;2.它表明多个⾃变量对⼀个因变量的影响强度。

回归分析也允许我们去⽐较那些衡量不同尺度的变量之间的相互影响,如价格变动与促销活动数量之间联系。

这些有利于帮助市场研究⼈员,数据分析⼈员以及数据科学家排除并估计出⼀组最佳的变量,⽤来构建预测模型。

我们有多少种回归技术?有各种各样的回归技术⽤于预测。

这些技术主要有三个度量(⾃变量的个数,因变量的类型以及回归线的形状)。

我们将在下⾯的部分详细讨论它们。

对于那些有创意的⼈,如果你觉得有必要使⽤上⾯这些参数的⼀个组合,你甚⾄可以创造出⼀个没有被使⽤过的回归模型。

统计学中的回归分析方法

统计学中的回归分析方法回归分析是统计学中经常被使用的一种方法,它用于研究两个或多个变量之间的关系。

通过回归分析,我们可以预测一个变量如何随着其他变量的变化而变化,或者确定变量之间的因果关系。

在本文中,我将介绍几种常见的回归分析方法,帮助读者更好地理解和应用这一统计学方法。

一、简单线性回归分析简单线性回归分析是回归分析的最基本形式。

它适用于只涉及两个变量的场景,并且假设变量之间的关系可以用一条直线来描述。

在进行简单线性回归分析时,我们需要收集一组观测数据,并使用最小二乘法来拟合直线模型,从而得到最优的回归方程。

通过该方程,我们可以根据自变量的取值预测因变量的值,或者评估自变量对因变量的影响程度。

二、多元线性回归分析多元线性回归分析扩展了简单线性回归模型,允许多个自变量同时对因变量进行解释和预测。

当我们要考察一个因变量与多个自变量之间的复杂关系时,多元线性回归分析是一种有力的工具。

在进行多元线性回归分析时,我们需收集多组观测数据,并建立一个包含多个自变量的回归模型。

通过拟合最优的回归方程,我们可以分析每个自变量对因变量的影响,进一步理解变量之间的关系。

三、逻辑回归分析逻辑回归分析是回归分析的一种特殊形式,用于处理因变量为二元变量(如真与假)时的回归问题。

逻辑回归分析的目标是根据自变量的取值,对因变量的分类进行概率预测。

逻辑回归模型是通过将线性回归模型的输出映射到一个概率区间(通常为0到1)来实现的。

逻辑回归在实际应用中非常广泛,如市场预测、医学诊断等领域。

四、岭回归分析岭回归是一种用于解决多重共线性问题的回归分析方法。

多重共线性指多个自变量之间存在高度相关性的情况,这会导致回归分析结果不稳定。

岭回归通过在最小二乘法的基础上加入一个惩罚项,使得回归系数的估计更加稳定。

岭回归分析的目标是获得一个优化的回归方程,从而在存在多重共线性的情况下提高预测准确度。

五、非线性回归分析在某些情况下,变量之间的关系不是线性的,而是呈现出曲线或其他非线性形态。

回归模型操作方法

回归模型操作方法

回归模型是一种用来预测连续因变量的统计模型。

常见的回归模型有线性回归、多项式回归、岭回归、Lasso回归等。

下面介绍回归模型的操作方法:

1. 数据准备:首先需要准备好回归分析所需的数据。

数据包括自变量和因变量,自变量是用来预测因变量的变量,因变量是需要被预测的变量。

2. 模型选择:选择适合问题的回归模型。

根据问题的特点和数据的分布选择合适的回归模型,如线性回归模型适用于自变量与因变量之间存在线性关系的情况,多项式回归模型适用于自变量与因变量之间存在非线性关系的情况。

3. 模型训练:使用已选择的回归模型对数据进行训练。

通过最小化损失函数的方法,根据现有数据来估计模型的参数,得到回归模型。

4. 模型评估:对训练得到的回归模型进行评估。

可以使用各种评估指标,如均方误差(MSE)、决定系数(R squared)等,来评估模型的预测效果。

5. 模型应用:使用训练好的回归模型来进行预测。

将新的自变量输入到回归模型中,通过模型公式计算得到对应的因变量预测值。

6. 模型调优:如果发现模型的表现不理想,可以通过调整模型的参数或选择其他回归模型进行优化。

以上是回归模型的一般操作步骤,具体操作方法还需根据具体问题和数据进行调整。

回归分析的基本方法

因变量之间的关系。

3

评估模型

4

评估模型的准确性和可行性,使用指 标如R²和标准误差。

收集数据

收集涉及自变量和因变量的相关数据。

拟合数据

使用回归模型对数据进行拟合,找到 最佳拟合曲线或平面。

回归模型的假设和前提条件

1 线性关系

2 独立误差

假设自变量和因变量之间存在线性关系。

假设误差项之间是相互独立的。

和应用回归分析。 • 了解不同类型的回归分析方法和应用可以帮助您选择适合您研究问题

的方法。 • 回归分析有其优势和局限性,因此在应用和解释结果时需要谨慎。

3 多重共线性

要求自变量之间没有多重共线性。

4 正态分布

假设误差项是正态分布的。

回归模型的评估和解释

评估

• 确定回归系数的显著性。 • 评估模型适合度和预测的准确性。

解释

• 解释回归系数的含义和影响。 • 识别哪些自变量对因变量的影响最大。

常见的回归分析方法和应用

简单线性回归

用于研究一个自变量和一个因 变量之间的关系。

回归分析的基本方法

通过回归分析,我们可以揭示变量之间的关系以及预测未来的趋势。

理解回归分析的基本概念和目 的

回归分析是一种统计方法,用于探索和解释变量之间的关系,以及预测和预 测未来的趋势。

其目的是找到一个最佳拟合曲线或平面,以便通过已知的自变量预测因变量 的值。

回归分析的基本步骤

1

建立模型

2

选择适当的回归模型来描述自变量和

多元线回归

用于研究多个自变量和一个因 变量之间的关系。

逻辑回归

用于研究自变量与一个二元因 变量之间的关系。

回归分析的优势和局限性

回归分析的六大基本步骤

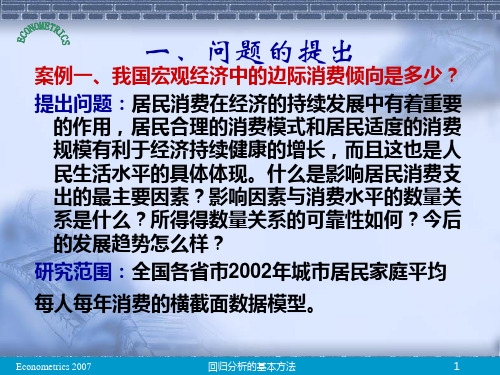

Econometrics 2007

回归分析的基本方法

16

注:四种模型检验

一、经济意义检验 二、统计推断检验 三、计量经济学检验 四、模型预测检验

Econometrics 2007

回归分析的基本方法

17

基本步骤示例

(六)模型应用

经济预测之点预测

➢西部地区的城市居民人均年可支配收入第一步争 取达到1000美元(按当时的汇率即人民币8270元), 代入模型得 Yˆf1 282.2434 0.7585118270 6555.132 ➢第二步再争取达到1500美元(即人民币12405元), 利用所估计的模型可预测这时城市居民可能达到的 人均年消费支出水平

10

2、操 作---计量经济学与计算机

▪ 必须指出,模型的建立和实际使用,离开了 计算机几乎是不可能的。

▪ 常见的一些计量软件:

SAS;SPSS;EViews;GAUSS;MATLAB; MICROTSP;STATA;MINITAB;SHAZAM; DATA-FIT;RATS……

▪ 本课程采用EViews进行教学,因为EViews简单 易学,功能强大,和计量经济学结合紧密, 所以要求同学们掌握该软件。

Econometrics 2007

回归分析的基本方法

11

学习计量软件的要求 鼯鼠五能,不如乌贼一技!

Econometrics 2007

回归分析的基本方法

12

(1)散 点 图

Econometrics 2007

回归分析的基本方法

13

(2)相关系数

Econometrics 2007

回归分析的基本方法

6958.56 11137.20 7315.32 6822.72 7238.04 6610.80 5944.08 7240.56 8079.12 6330.84 6151.44 6170.52 6067.44 6899.64

统计学中的回归分析方法

统计学中的回归分析方法回归分析是一种常用的统计学方法,旨在分析变量之间的关系并预测一个变量如何受其他变量的影响。

回归分析可以用于描述和探索变量之间的关系,也可以应用于预测和解释数据。

在统计学中,有多种回归分析方法可供选择,本文将介绍其中几种常见的方法。

一、简单线性回归分析方法简单线性回归是最基本、最常见的回归分析方法。

它探究了两个变量之间的线性关系。

简单线性回归模型的方程为:Y = β0 + β1X + ε,其中Y是因变量,X是自变量,β0和β1是回归系数,ε是残差项。

简单线性回归的目标是通过拟合直线来最小化残差平方和,从而找到最佳拟合线。

二、多元线性回归分析方法多元线性回归是简单线性回归的扩展形式,适用于多个自变量与一个因变量之间的关系分析。

多元线性回归模型的方程为:Y = β0 +β1X1 + β2X2 + ... + βnXn + ε,其中X1, X2, ..., Xn是自变量,β0, β1,β2, ..., βn是回归系数,ε是残差项。

多元线性回归的目标是通过拟合超平面来最小化残差平方和,从而找到最佳拟合超平面。

三、逻辑回归分析方法逻辑回归是一种广义线性回归模型,主要用于处理二分类问题。

逻辑回归将线性回归模型的输出通过逻辑函数(如Sigmoid函数)映射到概率范围内,从而实现分类预测。

逻辑回归模型的方程为:P(Y=1|X) =1 / (1 + exp(-β0 - β1X)),其中P(Y=1|X)是给定X条件下Y=1的概率,β0和β1是回归系数。

逻辑回归的目标是通过最大似然估计来拟合回归系数,从而实现对未知样本的分类预测。

四、岭回归分析方法岭回归是一种用于处理多重共线性问题的回归分析方法。

多重共线性是指自变量之间存在高度相关性,这会导致估计出的回归系数不稳定。

岭回归通过在最小二乘法的目标函数中引入一个正则化项(L2范数),从而降低回归系数的方差。

岭回归模型的方程为:Y = β0 +β1X1 + β2X2 + ... + βnXn + ε + λ∑(β^2),其中λ是正则化参数,∑(β^2)是回归系数的平方和。

如何进行回归分析:步骤详解

回归分析是一种统计学方法,用来分析两个或多个变量之间的关系。

它可以帮助我们理解变量之间的相关性,并进行预测和控制。

在实际应用中,回归分析被广泛用于经济学、社会学、医学等领域。

下面我将详细介绍如何进行回归分析的步骤,希望能对初学者有所帮助。

第一步:确定研究的目的和问题在进行回归分析之前,首先需要明确研究的目的和问题。

你需要想清楚你想要研究的变量是什么,以及你想要回答的问题是什么。

比如,你想要研究收入和教育水平之间的关系,那么你的目的就是确定这两个变量之间的相关性,并回答是否教育水平对收入有影响。

第二步:收集数据一旦确定了研究的目的和问题,接下来就需要收集相关的数据。

数据可以通过调查、实验、观察等方式获取。

在收集数据的过程中,需要注意数据的质量和完整性。

确保数据的准确性对于回归分析的结果至关重要。

第三步:进行描述性统计分析在进行回归分析之前,通常会先进行描述性统计分析。

这可以帮助我们对数据的基本特征有一个初步的了解,比如平均值、标准差、分布情况等。

描述性统计分析可以帮助我们确定变量之间的大致关系,为后续的回归分析奠定基础。

第四步:建立回归模型建立回归模型是回归分析的核心步骤。

在建立回归模型时,需要确定自变量和因变量,并选择合适的回归方法。

常见的回归方法包括线性回归、多元线性回归、逻辑回归等。

在选择回归方法时,需要考虑自变量和因变量之间的关系,以及数据的分布情况。

第五步:进行回归分析一旦建立了回归模型,接下来就可以进行回归分析了。

回归分析的主要目的是确定自变量和因变量之间的关系,并评估回归模型的拟合程度。

在进行回归分析时,需要注意检验回归模型的显著性、自变量的影响程度以及模型的预测能力。

第六步:解释回归结果进行回归分析后,需要解释回归结果。

这包括解释自变量对因变量的影响程度,以及回归模型的可解释性。

在解释回归结果时,需要注意避免过度解释或误导性解释,确保解释的准确性和可信度。

第七步:进行敏感性分析在完成回归分析后,通常会进行敏感性分析。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

P-value:检验t检验的值是否显著,若P值小于0.05,则t检验显著,则单个自变量与因变量存在相关关系。

例题中因变量为:销售额

自变量为:广告支出、扩张支出、竞争对手的销售额

5、输出结果示例

区域

销售额

广告支出

扩张支出

竞争对手的销售额

塞尔扣克

101.8

1.3

0.2

20.4

Suaquehanna

44.4

0.7

0.2

30.5

基特里

108.3

1.4

0.3

24.6

阿克顿

85.1

0.5

0.4

19.6

苏各湖群

77.1

标准误差:总体的标准误差,计算方法为:

观测值:样本数量

方差分析:df:自由度。回归分析的自由度为:m(变量数)。残差的自由度为:n-m-1,n为样本数量。总计的自由度为:n-1.

SS:误差平方和。回归分析的SS为:回归平方和(能被自变量解释的变化)。残差的SS为:残差平方和(不能被自变量解释的变化)。总计的SS为(总变化):回归平方和+残差平方和

MS:均方误差=SS/df.

F值:自变量的联合检验,检验所有自变量与因变量相关关系,一般情况下,F值越大,相关性越大。

Significant F:检验F的值是否显著,一般设置的临界值为0.05,即,Significant F的值小于0.05,则F值具有显著性,即自变量与因变量确实存在相关关系。

Intercept:常数项系数。

0.5

0.6

25.5

伯克希尔

158.7

1.9

0.4

21.7森特勒尔180 Nhomakorabea41.2

1

6.8

普罗维登斯

64.2

0.4

0.4

12.6

纳舒厄

74.6

0.6

0.5

31.3

邓斯特

143.4

1.3

0.6

18.6

恩迪克特

120.6

1.6

0.8

19.9

五镇

69.7

1

0.3

25.6

Waldeboro

67.8

0.8

0.2

回归分析的Excel操作方法

1、加载宏——分析工具库——(在“工具”菜单中出现“数据分析”命令)

2、07以前版本的word:点击“工具”菜单中的“数据分析”命令

07版以后的word,点击“数据”,点击“数据分析”命令。

3、点击“回归”

4、在上图“Y值输入区域”中选中“因变量”,“X值输入区域”中所有的自变量,并选中“残差”、“残差图”等项

27.4

杰克逊

106.7

0.6

0.5

24.3

斯托

119.6

1.1

0.3

13.7

结果分析:

回归分析:Multiple:代表相关系数

R Square:即R方,取值范围0~1.一般情况下,越大越好。表示能被自变量解释的变化部分占总变化的比值。

Adjusted R:调整的R方,与R方有相同的含义。一般情况下越大越好。