第6章-最大似然估计

第六章-最大似然估计

第 2 页 共 27 页

第六章 最大似然估计

与非线性回归的情况一样,在 ML 估计中也需要假定参数的可识别性,具体如下:

假定(可识别假定):对参数空间 的任意

,有

其中, 为参数 的真值。

这里需要说明一下,与 LS 估计不同,在 ML 估计的框架中,用于保证估计量性质的约 束条件无法很清晰的划分为几类简单的假定。因此,更常用的做法是直接给出这些约束条件 (正则条件),而不是作为假定提出。我们之所以单独列出可识别假定,是因为它是整个极 值估计的核心假定,且在性质证明中能直接看出。

CRLB 是指任意无偏估计量的方差所能达到的最低水平,计算如下:

(6-8)

以下简单证明 CRLB 的性质。

证明: 已知密度函数

,满足

,其得分函数为 ,则有

。记

的估计量

其中,

注意到,对任意矩阵 得

所以有 当估计量为无偏估计时,即

,存在满秩矩阵 ,则有

,上式可化简为:

。 。

,使

其中,

为

。

证明完毕。

称为

的估计量的 CRLB。当

第六章 最大似然估计

,对应的检验统计量计算如下:

(6-23)

LR 检验统计量: LM 检验统计量:

(6-24)

(6-25)

其中, 和 分别表示无约束和有约束下的 ML 估计, 和 似然函数的估计。

在零假设下,上述的 Wald 检验、LR 检验和 LM 检验都收敛于

个数。

分别表示对应的 ,其中 J 为约束的

考虑线性约束

,Wald 检验统计量可计算如下:

(6-27)

其中,

,

;

残差。

又,有约束的对数似然函数可计算如下:

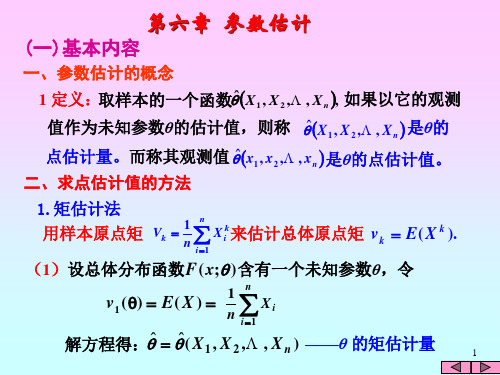

第六章参数估计

113第六章 参数估计一、 知识点1. 点估计的基本概念2. 点估计的常用方法(1) 矩估计法① 基本思想:以样本矩作为相应的总体矩的估计,以样本矩的函数作为相应的总体矩的同一函数的估计。

(2) 极大似然估计法设总体X 的分布形式已知,其中),,,(21k θθθθΛ=为未知参数,),,(21n X X X Λ为简单随机样本,相应的),,,(21n x x x Λ为它的一组观测值.极大似然估计法的步骤如下:① 按总体X 的分布律或概率密度写出似然函数∏==ni i n x p x x x L 121);();,,,(θθΛ (离散型)∏==ni i n x f x x x L 121);();,,,(θθΛ (连续型)若有),,,(ˆ21nx x x Λθ使得);,,,(max )ˆ;,,,(2121θθθn n x x x L x x x L ΛΛΘ∈=,则称这个θˆ为参数θ的极大似然估计值。

称统计量),,,(ˆ21nX X X Λθ为参数θ的极大似然估计量。

② 通常似然函数是l θ的可微函数,利用高等数学知识在k θθθ,,,21Λ可能的取值范围内求出参数的极大似然估计k l x x x nl l ,,2,1),,,,(ˆˆ21ΛΛ==θθ 将i x 换成i X 得到相应的极大似然估计量k l X X X nl l ,,2,1),,,,(ˆˆ21ΛΛ==θθ 注:当);,,,(21θn x x x L Λ不可微时,求似然函数的最大值要从定义出发。

3. 估计量的评选标准(1) 无偏性:设),,(ˆˆ21nX X X Λθθ=是参数θ的估计量,如果θθ=)ˆ(E ,则称θˆ为θ的无偏估计量。

(2) 有效性:设1ˆθ,2ˆθ是θ的两个无偏估计,如果)ˆ()ˆ(21θθD D ≤,则称1ˆθ较2ˆθ更有效。

4. 区间估计114 (1) 定义 设总体X 的分布函数族为{}Θ∈θθ),;(x F .对于给定值)10(<<αα,如果有两个统计量),,(ˆˆ111n X X Λθθ=和),,(ˆˆ122n X X Λθθ=,使得{}αθθθ-≥<<1ˆˆ21P 对一切Θ∈θ成立,则称随机区间)ˆ,ˆ(21θθ是θ的双侧α-1置信区间,称α-1为置信度;分别称1ˆθ和2ˆθ为双侧置信下限和双侧置信上限. (2) 单侧置信区间(3) 一个正态总体下未知参数的双侧置信区间(置信度为α-1)二、 习题 1. 选择题(1) 设n X X X ,,,21Λ是来自总体X 的一个样本,则以下统计量①)(211n X X + ②)2(14321n X X X X X n ++++-Λ ③)2332(101121n n X X X X +++-作为总体均值μ的估计量,其中是μ的无偏估计的个数是A.0B.1C.2D.3(2) 设321,,X X X 是来自正态总体)1,(μN 的样本,现有μ的三个无偏估计量321332123211216131ˆ;1254131ˆ;2110351ˆX X X X X X X X X ++=++=++=μμμ其中方差最小的估计量是A.1ˆμB.2ˆμC. 3ˆμD.以上都不是 (3) 设0,1,0,1,1为来自0-1分布总体B(1,p)的样本观察值,则p 的矩估计值为 。

概率论与数理统计教材第六章习题

X σ0 n

~ N(0,1)

对于置信水平1- ,总体均值的置信区间为 对于置信水平 -α,总体均值 的置信区间为

X

σ0

n

uα < < X +

2

σ0

n

uα

2

(2)设总体 ~ N(,σ 2 ), 未知 ,求的置信区间。 设总体X~ 未知σ, 的置信区间。 设总体 的置信区间

σ 0 ,则样本函数 t = X ~ t(n 1) 用 S 代替 S n

i =1

n1

n1

F

1

α ∑ Yj 2

2 j =1

n2

(

)

2

n2

10

2 2 及 (1)设两个总体 ~ N(1,σ1 ) 及Y~ N(2 ,σ 2 ), 未知 1 2, )设两个总体X~ ~

2 σ1 的置信区间。 求 2 的置信区间。 σ2

选取样本函数 选取样本函数

2 2 S1 σ1 F = 2 2 ~ F(n1 1, n2 1) S2 σ2

∑x

i =1

n

i =1

i

n = 0.

1 p

得 p 的极大似然估计值为 p =

n

∑x

i =1

n

1 = x

i

12

1 θ 2. 设总体 服从拉普拉斯分布:f ( x;θ ) = e ,∞< x < +∞, 设总体X 服从拉普拉斯分布: 2θ 求参数 θ 其中 > 0. 如果取得样本观测值为 x1 , x2 ,L, xn , 求参数θ

第六章 参数估计

(一)基本内容

一、参数估计的概念 1 定义:取样本的一个函数θ ( X 1 , X 2 ,L , X n ), 如果以它的观测 定义:

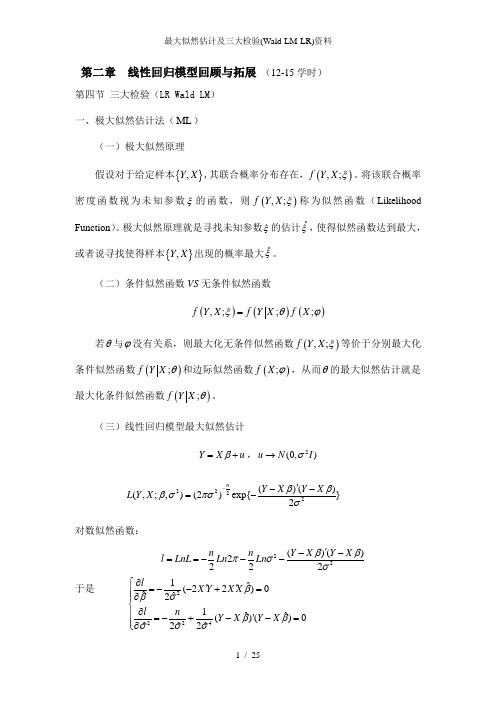

最大似然估计及三大检验(Wald-LM-LR)资料

第二章 线性回归模型回顾与拓展 (12-15学时)第四节 三大检验(LR Wald LM ) 一、极大似然估计法(ML )(一)极大似然原理假设对于给定样本{},Y X ,其联合概率分布存在,(),;f Y X ξ。

将该联合概率密度函数视为未知参数ξ的函数,则(),;f Y X ξ称为似然函数(Likelihood Function )。

极大似然原理就是寻找未知参数ξ的估计ˆξ,使得似然函数达到最大,或者说寻找使得样本{},Y X 出现的概率最大ˆξ。

(二)条件似然函数VS 无条件似然函数()()(),;;;f Y X f Y X f X ξθϕ=若θ与ϕ没有关系,则最大化无条件似然函数(),;f Y X ξ等价于分别最大化条件似然函数();f Y X θ和边际似然函数();f X ϕ,从而θ的最大似然估计就是最大化条件似然函数();f Y X θ。

(三)线性回归模型最大似然估计Y X u β=+,2(0,)u N I σ→2222()()(,;,)(2)exp{}2nY X Y X L Y X βββσπσσ-'--=-对数似然函数:22()()2222n n Y X Y X l LnL Ln Ln ββπσσ'--==---于是 22241ˆ(22)0ˆˆ21ˆˆ()()0ˆˆˆ22l X Y X X l n Y X Y X βσβββσσσ∂⎧''=--+=⎪⎪∂⎨∂⎪'=-+--=⎪∂⎩得到 12ˆ()1ˆMLML X X X Y e e n βσ-⎧''=⎪⎨'=⎪⎩(三)得分(Score )和信息矩阵(Information Matrix )(;,)lf Y X θθ∂=∂称为得分; 12...k l l l l θθθθ∂⎡⎤⎢⎥∂⎢⎥∂⎢⎥⎢⎥∂⎢⎥∂⎢⎥=∂⎢⎥⎢⎥⎢⎥⎢⎥∂⎢⎥⎢⎥∂⎣⎦得分向量;(Gradient ) 海瑟矩阵(Hessian Matrix ):2l H θθ∂='∂∂信息矩阵:三*、带约束条件的最小二乘估计(拉格朗日估计)在计量经济分析中,通常是通过样本信息对未知参数进行估计。

概率论与数理统计-第6章-第2讲-最大似然估计法

P(X1 1)P(X2 0)P(X3 1)

3

本讲内容

01 求最大似然估计的一般步骤 02 典型例题

01 求最大似然估计的一般步骤

(1) 构造似然函数 L(θ)

设X1, , X n是来自X 的样本, x1, , xn是其一组样本值,

若总体X 属离散型,其分布律 P( X x) p(x; ),

概率论与数理统计

第6章 参数估计

第2讲 最大似然估计法

主讲教师 |

第2讲 最大似然估计法

上一讲介绍了矩估计,这一讲介绍点估计的另外一种方法— —最大似然估计法,它是在总体类型已知条件下使用的一种参数 估计方法 .

它首先是由数学家高斯在1821年提出的,费歇在1922年重 新发现了这一方法,并研究了它的一些性质 ,从而得到广泛应 用.

即

L(

x1

,,

xn

;ˆ)

max

L(

x1,,

xn

;

)

ˆ(x1, , xn )称为参数的最大似然估计值.

ˆ( X1, , X n )称为参数的最大似然估计量.

一般, 可由下式求得:

dL( ) 0或 d ln L( ) 0.

d

d

似然方程

6

01 求最大似然估计的一般步骤

注1

未知参数可以不止一个, 如1,…, k

ln

L

n

i1

(xi )2 2 2

n 2

ln(2

)

n 2

ln(

2)

似然 方程 组为

ln

L

1

2

n

(xi

i1

)

0

(

2 ) ln

L

1

系统辨识--第6章-极大似然估计

2.有色噪声情况

系统差分方程

a(z 1 ) y(k ) b(z 1 ) u(k ) c(z 1 ) (k )

a( z

1 )

1

a1 z

1

an z n

b( z

1 )

b0

b1 z 1

bn z n

c( z 1 ) 1 c1 z 1 cn z n

e(k) y(k) yˆ(k)

1、极大似然法 Ronald Aylmer Fisher (1890~1962) 英国实验遗传学家兼统计学家 把渐进一致性、渐进有效性等作为参 数估计量应具备的基本性质 在1912年提出了极大似然法

6.1 极大似然法

1、极大似然法

辨识准则

以观测值的出现概率最大为准则

思路

设一随机试验已知有若干个结果A,B,C,…,如果在一次 试验中A发生了,则可认为当时的条件最有利于A发生, 故应如此选择分布的参数,使发生A的概率最大 。

aˆn

bˆ0

bˆn

cˆ1

T

cˆn

用基本LS辨识获取 任意取值

(2) 计算预测误差(残差)及J值

预测误差:

e(k) y(k) yˆ(k)

指标函数J值:

J

1

n N

e2 (k )

2 k n1

误差方差估计值: ˆ 2 2 J

N

2、动态系统模型参数的极大似然估计

(3)计算梯度矩阵及海赛矩阵

J nN e(k ) e(k )

2J θ 2

1

J

θ

θ θˆ 0

J 称为J的梯度矩阵

θ

2J θ 2

称为J的海赛矩阵

注意:上式中J的梯度矩阵和海赛矩阵,依不同辨识对象,需进行 详细推导,推导出矩阵中每个元素的具体表达式。

西北工业大学《概率论与数理统计》课件-第六章 参数估计

(2) 似然函数

定义6.1 设总体X的分布密度(或分布律)为 p(x; ), 其中 (1, 2, ,m )为未知参数. 又设

( x1, x2,, xn ) 为自总体X的样本(X1,X2,…,Xn) 的一 个观察值,则称样本的联合分布

n

L( ) p(x1, x2, … , xn; ) p( xi; )

2º似然估计方程组与最大似然估计之间没有必 然

从中解得 pˆ k n

参数 p的估计值

这时, 对一切 0< p <1, 均有

P{Y k; pˆ } P{Y k; p}

综上所述: 设某试验的可能结果为: A1, A2 , ···, Ai , ···

若在一次试验中,某结果 Ai 出现,则应选择参 数使Ai 出现的概率最大.

以上这种选择一个参数使得实验结果具有

(k 1,2,, m)

(4) 求最大似然估计(MLE)的步骤:

1 写出似然函数

(1, 2 , ,m )

n

L( ) L( x1, x2,, xn; ) p( xi; )

n

i 1

2 取对数 ln L( ) ln p( xi; )

i 1

3 解似然方程(组)

ln L

ln L

2

为来自总体X的简单随机样本. 矩估计法的具体步骤:

1 求出k E( X k ) (1,2,,m ), k 1,2,,m;

2 要求k Ak , k 1,2,, m

这是一个包含 m个未知参数1,2 ,,m的方程组.

3 解出其中1,2,,m , 用ˆ1,ˆ2,,ˆm表示.

4 用方程组的解ˆ1, ˆ2 , ,ˆm 分别作为 1,2 ,,m的估计量,这个估计量称为

概率论与数理统计第6章参数区间估计2,3节

n

E(X

k

)

E(X

k)

i1

i1

二、有效性

未知参数 的无偏估计量不是唯一的.

设 ^1 和 ^2 都是参数 的无偏估计量,

θˆ 1

θˆ 2

集中

分散

蓝色是采用估^ 计量 1 , 用 14 个样本值得到的 14 个估计值. 紫色是采用估^ 计量 2 , 用 14 个样本值得到的 14 个估计值.

若limD(ˆ)0, 则ˆ是的一致估 . 计量 n

回顾例子.设总体X的概率密度为

f(x)6x3 (x),0x;

0, 其他

X1, X2,…, Xn 是取自总体X 的简单随机样本, (1) 求的矩估计量 ˆ;

(2) 求ˆ的方差D(ˆ).

解:矩估计 ˆ量 2X. D(ˆ)4D(X)4D(X)2

若滚珠直径服从正态分布X ~ N( , 2), 并且已知 = 0.16(mm),求滚珠直径均值的置信水平为95%

的置信区间.

解:由上面求解的置信水平为1- 的置信区间

Xσn 0 uα/,2 Xσn 0 uα/2

已 n 知 1,0 0 0 .1,6 0 .0,5 x110i110xi 14.92,

若进行n次独立重复抽样,得到n个样本观测值,

每个样本观测 个值 随确 机(定 ˆ1区 ,ˆ2一 )间 .那么

每个区间的 可真 能 , 或 值 包不 含包 的含 真 , 值

根据伯努利大数定理, 在这n个随机区间中,

包含 真值1 的 0(1 0 约 )% 占 ,不包含 10 的 % 0. 约

便得 k的 到 最大似 ˆk(X 1,然 X 2, ,估 X n).计

第二节 判别估计量好坏的标准

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

通过抽取随机样本 y1 , , yn 来估计 。 假 设 y1 , , yn 为 iid , 则 样 本 数 据 的 联 合 密 度 函 数 为

f ( y1; ) f ( y2 ; ) f ( yn ; ) 。

在抽样前, y1 , , yn 为随机向量。 抽样后, y1 , , yn 有了特定的样本值,可将样本联合密度 函数视为在 y1 , , yn 给定情况下,未知参数 的函数。

0 0

最后一步用到了信息矩阵等式。

25

假设ˆ 是对真实参数 0 的任意无偏估计,则在一定的正则 条件(regularity conditions)下,ˆ 的方差不会小于[ I ( 0 )]1,即 ˆ) [ I ( )]1。 Var( 0 称[ I ( 0 )]1为 “克莱默-劳下限” (Cramer-Rao Lower Bound)。 无偏估计所能达到的最小方差与信息矩阵有关。曲率 I ( 0 ) 越大,则[ I ( 0 )]1越小,无偏估计可能达到的最小方差越小。 在古典线性回归模型中,可证明(参见附录)

5

一阶条件要求,对数似然函数的梯度向量(gradient,偏导 数、斜率) s( ; y ) 为 0 ,实际上是 K 个未知参数 (1 2 K ) ,K 个方程的方程组。 该 向 量 也 称 “ 得 分 函 数 ”(score function) 或 “ 得 分 向 量”(score vector)。 得分函数 s( ; y ) 是 y 的函数,也是随机向量。 在下面,记真实参数为 θ0 ,而 θ 为该参数的任何可能取值。

ln L( ; y1 , , yn ) i 1 ln f ( yi ; )

n

3

“最大似然估计法”(Maximum Likelihood Estimation,简 记 MLE 或 ML)的思想:给定样本取值后,该样本最有可能 来自参数 为何值的总体。 使得观测到样本数据的可能性最大, 即最大化对 寻找ˆML , 数似然函数(loglikelihood function):

18

方法二为“高斯-牛顿法”(Gauss-Newton method)。

图 6.2 牛顿法

19

牛顿法收敛很快,是二次的。比如,如果本次迭代的误差 为 0.1,则下次迭代的误差约为 0.12。 如果初始值 x0 选择不当,可能出现迭代不收敛的情形。 使 用 牛 顿 法 得 到 的 可 能 只 是 “ 局 部 最 大 值 ” (local maximum),而非“整体最大值”(global maximum)。 牛顿法也适用于多元函数的情形 f ( x ) 0 ,将切线替换为 (超)切平面即可。 如对原函数 f ( x) 作二阶近似(二阶泰勒展开),称为“牛顿拉夫森法”(Newton-Raphson method)。

max ln L( ; y )

最大似然估计量ˆML 可写为,

ˆML arg max ln L( ; y )

4

其中,“argmax”(argument of the maximum) 表示能使 ln L( ; y ) 最大化的 取值。 假设存在唯一内点解,一阶条件:

ln L( ; y ) 1 ln L( ; y ) s ( ; y ) 0 ln L( ; y ) K

12

图 6.1 选择参数使观测到样本的可能性最大

13

例(非正式) 某人操一口浓重的四川口音,则判断他最有 可能来自四川。 考虑线性回归模型:

y = X

假设 | X ~ N (0 , 2 I n ) ,则 y | X ~ N ( X , 2 I n ) ,条件密度 函数为:

ln L( ; y ) 2 ln L( ; y )

10

为 负 定 矩 阵 , 即 对 数 似 然 函 数 为 严 格 凹 函 数 (strictly concave)。黑赛矩阵可分解为

n n 2 ln L(θ ; yi ) 2 ln L(θ ; y ) H (θ ; y ) H i (θ ; yi ) θ θ θ θ i 1 i 1

1 f ( y | X ) (2 2 ) n 2 exp 2 ( y X )( y X ) 2

14

, 2 代替真实 , 2 ,取对数可得 用假想

n n 1 2 2 )( y X ) ln L( , ) ln 2 ln 2 ( y X 2 2 2

ln f ( yi ; ) 其中, si ( ; yi ) 为第 i 个观测值对得分函数的

贡献。 在上例中, s ( ; y ) ( yi ) ,而 si ( , yi ) ( yi ) 。

i 1 n

二阶条件要求,对数似然函数的黑赛矩阵(Hessian matrix)

I ( ) 包含了 是否容易估计的信息,故称“信息矩阵”。

22

图 6.3 平坦(左)与陡峭(右)的对数似然函数

23

命题 (信息矩阵等式) 在 θ θ0 处 , 以 下 “ 信 息 矩 阵 等 式 ”(information matrix equality)成立,

2 ln L( 0 ; y ) I ( 0 ) E ln L( 0 ; y ) ln L( 0 ; y ) E E s ( 0 ; y ) s ( 0 ; y )

7

其得分函数为,

L( ) n ( yi ) s ( ) i 1

故得分函数的期望值为,

E s ( ) E( yi ) 0

i 1 i 1 n n

在 0 处,

8

E s ( ) 0

n n 1 2 第二步。对数似然函数变为 ln 2 ln 2 ee ,称 2 2 2

为 “集中对数似然函数” (concentrated log likelihood function), 的取值已在第一步固定,称为“ concentrated with 因为 ” 2 求导可得 respect to 。对

20

6.4 信息矩阵与无偏估计的最小方差 定义信息矩阵 (information matrix)为对数似然函数的黑塞 矩阵之期望值(对 y 求期望)的负数,

2 ln L( ; y ) I ( ) E 2 ln L 一维情形下, 为对数似然函数的二阶导数之负数。 2 对数似然函数为凹函数, 故二阶导数为负数, 加负号为正数。

证明参见附录。

24

命题 (得分函数的方差为信息矩阵) 在 θ θ0 处,信息矩阵 I(θ0 ) 就是得分函数的协方差矩阵 Var s (θ0 ; y ) 。 证明:

Var s ( 0 ; y ) E s ( 0 ; y ) s ( 0 ; y ) E s ( 0 ; y ) E s ( 0 ; y ) E s ( 0 ; y ) s ( 0 ; y ) I ( 0 )

。第二步, 2 ,选择最优 分两步最大化。第一步,给定 ,选择最优 2。 代入第一步的最优 只出现在第三项中,故等价于使 第一步。由于 )( y X ) 最小,正是 OLS 的目标函数 ee 。 (y X

15

ˆ ( X X ) 1 X y ˆ ML OLS

6.2 线性回归模型的最大似然估计 例 假设 X ~ N ( , 2 ) ,其中 2 已知,得到一个样本容量 为 1 的样本 x1 2 ,求对 的最大似然估计。

(2 ) 2 似然函数为 L( ) exp 。 2 2 2 2 1

ˆ 2 处取最大值,见图 6.1。 似然函数在

其中, H i (θ; yi ) 为第 i 个观测值对黑赛矩阵的贡献。

s ( ) 在 上 例 中 , H ( ; y ) s ( ) ( yi ) H i ( ; yi ) i 1。

11

i 1 ( yi )

n

n , 而

21

2 ln L( ; y ) 表示对数似然函数在 空间中的曲率

(curvature),取期望值之后为平均曲率(对 y 进行平均)。 如果曲率大, 对数似然函数陡峭, 较易根据样本分辨真实 的位置;反之,如果曲率小,对数似然函数平坦,不易根据 样本判断真实 的位置。 如果似然函数完全平坦,则似然函数不存在唯一最大值, MLE 没有唯一解;则无法根据样本数据来判断 的位置。

n 1 1 ee 0 2 4 2 2

求解 2 的 MLE 估计量为

16

ˆ

2 ML

ee ee 2 ˆ OLS s2 n nK

MLE 对 的估计与 OLS 一样,但对 2 的估计略有不同, 此差别在大样本下消失。

2 ˆ ML 故 MLE 估计量 由于 OLS 估计量 s 2 是对 2 的无偏估计, 是有偏的(小样本性质)。

© 陈强,《高级计量经济学及 Stata 应用》课件,第二版,2014 年,高等教育出版社。

第 6 章 最大似然估计 如果回归模型存在非线性, 常使用最大似然估计法(MLE)。

6.1 最大似然估计法的定义 假设随机向量 y 的概率密度函数为 f ( y; ) ,其中 为 K 维 未知参数向量, 。

2

定义似然函数(likelihood function)为

L( ; y1 , , yn ) f ( yi ; )

i 1 n

似然函数与联合密度函数完全相等,只是 与 y1 , , yn 的 角色互换,即把 作为自变量,而视 y1 , , yn 为给定。 为了运算方便,常把似然函数取对数: